2 ����Ԥ����

����Ԥ�����Ĺ���:�������ݡ���>ģ�͡���>�������

��������������һ��һ����,һ��һ������

| ���� | ѧ�� | ���� | �Ա� | ��н |

|---|---|---|---|---|

| 25 | ˶ʿ | 2 | Ů | 10000 |

| 20 | ���� | 3 | �� | 8000 |

| �� | �� | �� | �� | �� |

����Ԥ������ؿ�:

# �������ѧϰ����Ŀ�ѧ���㹤�߰�---����Ԥ������

import sklearn.preprocessing as sp

������ѧϰ������Python����Ԥ����:�������������һ��

2.1 ��ֵ�Ƴ�(����)

����һ�������IJ�ͬ����ֵ����ϴ�,������ʹ�����л���ѧϰ�㷨������������

��ֵ�Ƴ�(����):�����������е�ÿһ�еľ�ֵΪ0,����Ϊ1

ת����ʽ: x i �� = x i ? �� �� {x_i^{'}}=\frac{{x_i-\mu}}{\sigma} xi��?=��xi??��?

���ʹ���������е�ÿһ�е�ƽ��ֵΪ0��?

# ������һ������ֵ��ʾ����:[17,20,23]

mean=(17+20+23)/3=20

a'=17-20=-3

b'=20-20=0

c'=23-20=3

# ���!

���ʹ���������е�ÿһ�еı���Ϊ1��?

a'=-3

b'=0

c'=3

s'=std(a',b',c')

[a'/s',b'/s',c'/s']

# ���!

��ֵ�Ƴ�(����)API:

import sklearn.preprocessing as sp

# scale�������ڶ����ݽ���Ԥ����,ʵ�־�ֵ�Ƴ�(����)

# ����AΪ��ֵ�Ƴ�(����)��Ľ��

A=sp.scale(ԭʼ��������)

����:

import numpy as np

# ����Ԥ������

import sklearn.preprocessing as sp

raw_samples=np.array([

[17,90,4000],

[20,80,5000],

[23,75,5500]])

# ��ֵ�Ƴ�(����)

result=sp.scale(raw_samples)

# axis:����,axis=0:��������

print(result.mean(axis=0))

print(result.std(axis=0))

result

2.2 ��Χ(����)����

��Χ(����)����:�����������е�ÿһ�е���Сֵ�����ֵ�趨Ϊ��ͬ������,ͳһ��������ֵ�ķ�Χ

һ������»������ֵ������[0,1]����

ת����ʽ: x i �� = x i ? x m i n x m a x {x_i^{'}}=\frac{{x_i-x_{min}}}{x_{max}} xi��?=xmax?xi??xmin??

���ʹһ������ֵ����СֵΪ0��?

# ������һ������ֵ��ʾ����:

[17,20,23]

# ÿ��Ԫ�ؼ�ȥ����ֵ��������Ԫ�ص���Сֵ����:

17-17=0

20-17=3

23-17=6

[0,3,6]

# ���!

���ʹһ������ֵ�����ֵΪ1��?

[0,3,6]

# ����ֵ�����ÿ��Ԫ�س������ֵ����:

0/6=0

3/6=1/2

6/6=1

[0,1/2,1]

# ���!

��Χ(����)����API:

import sklearn.preprocessing as sp

# ����MinMax������

mms=sp.MinMaxScaler(feature_range=(0,1))

# ����mms����ķ���ִ�����Ų���,�������ź�Ľ��

result=mms.fit_transform(ԭʼ��������)

����:

# ��������Ԥ������ʵ��

import numpy as np

# ����Ԥ������

import sklearn.preprocessing as sp

raw_samples=np.array([

[17,90,4000],

[20,80,5000],

[23,75,5500]])

# ��Χ(����)����

mms=sp.MinMaxScaler(feature_range=(0,1))

result=mms.fit_transform(raw_samples)

result

17 k + b = 0 23 k + b = 1 \begin{array}{l} 17k + b = 0\\ 23k + b = 1 \end{array} 17k+b=023k+b=1?

[ 17 1 23 1 ] [ k b ] = [ 0 1 ] \left[ {\begin{array}{cc} {17}&1\\ {23}&1 \end{array}} \right]\left[ {\begin{array}{cc} k\\ b \end{array}} \right]{\rm{ = }}\left[ {\begin{array}{cc} 0\\ 1 \end{array}} \right] [1723?11?][kb?]=[01?]

����:

# δ��������Ԥ������,�ֶ�����ʵ��

import numpy as np

raw_samples=np.array([

[17,90,4000],

[20,80,5000],

[23,75,5500]])

print(raw_samples)

print("\n",raw_samples.T)

new_samples=[]

# raw_samples.T:����ת��,���б�Ϊ��,ȡ��ÿ����Сֵ�����ֵ,Ҳ����ԭʼ�����ÿ����Сֵ�����ֵ

for row in raw_samples.T:

min_val=row.min()

max_val=row.max()

# ��������������Թ�ϵ(y=kx+b,��xk+b=y)����Ҫ�ľ���:A��B

A=np.array([

[min_val,1],

[max_val,1]

])

B=np.array([0,1])

# np.linalg.solve(A,B):�ⷽ����:�����������AX=B�ķ�����

# X��shape(��״)��Bһ��,X:����k��b��ֵ,k=X[0],b=X[1]

X=np.linalg.solve(A,B)

print("\n",X)

new_row=row*X[0]+X[1]

new_samples.append(new_row)

# ת����ʾԭʼ��������ķ�Χ���Ž��

print("\n",np.array(new_samples).T)

2.3 ��һ��

��Щ���ÿ��������ÿ������ֵ�����ֵ������Ҫ,����ÿ����������ֵ��ռ�ȸ�����Ҫ

| ���� | ���� | ���� | |

|---|---|---|---|

| ���� | 10 | 20 | 5 |

| ���� | 2 | 4 | 1 |

| ���� | 11 | 13 | 18 |

��һ��:��ÿ��������ÿ������ֵ���Ը�������������ֵ����ֵ���ܺ�

�任�����������,ÿ������������ֵ����ֵ֮��Ϊ1

ת����ʽ: x i �� = x i �� i = 1 n �O x i �O {x_i^{'}}=\frac{{{x_i}}}{{\sum\limits_{i=1}^n{\left|{{x_i}}\right|}}} xi��?=i=1��n?�Oxi?�Oxi??

��һ�����API:

import sklearn.preprocessing as sp

# norm ����

# l1---L1����:�����еĸ���Ԫ�ؾ���ֵ֮��

# l2---L2����:�����еĸ���Ԫ��ƽ��֮��

# ���ع�һ��Ԥ���������������

sp.normalize(ԭʼ��������,norm='l1')

����:

import numpy as np

# ����Ԥ������

import sklearn.preprocessing as sp

samples=np.array([

[10,21,5],

[2,4,1],

[11,18,18]])

# ת����������

samples=samples.astype(np.float64)

# ��ʽ1:

# ��һ��

# L1����:�����е�Ԫ�ؾ���ֵ֮��

result=sp.normalize(samples,norm='l1')

# axis:����,axis=1:��������

print(abs(result).sum(axis=1))

print(result)

# ��ʽ2:

for row in samples:

# ÿ��������ÿ������ֵ���Ը�������������ֵ����ֵ���ܺ�

row/=abs(row).sum()

# axis:����,axis=1:��������

print(abs(samples).sum(axis=1))

samples

2.4 ��ֵ��

��Щҵ����Ҫ�����������ϸ��������(����ͼ���Եʶ��ֻ��Ҫ������ͼ���Ե����),���Ը���һ�����ȸ�������ֵ,��0��1��ʾ����ֵ�����ڻ������ֵ����ֵ�����������ÿ��Ԫ�ط�0��1,�ﵽ����ѧģ�͵�Ŀ��

��ֵ�����API:

# ������ֵ,��ȡ��ֵ����

bin=sp.Binarizer(threshold=��ֵ)

# ����transform������ԭʼ����������ж�ֵ��Ԥ��������

result=bin.transform(ԭʼ��������)

����:

import numpy as np

# ����Ԥ������

import sklearn.preprocessing as sp

samples=np.array([

[10,21,5],

[2,4,1],

[11,18,18]])

# ��ʽ1:

# ��ֵ��

bin=sp.Binarizer(threshold=10)

result=bin.transform(samples)

print(result)

# ��ʽ2:

# ��������

new_samples=samples.copy()

new_samples[new_samples<=10]=0

new_samples[new_samples>10]=1

new_samples

����:

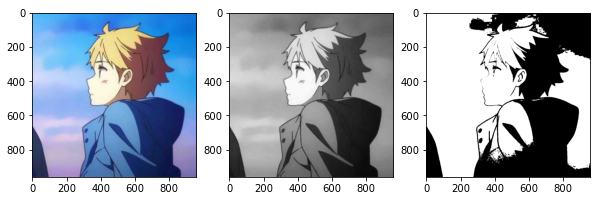

# ��ֵ��ͼƬ

import matplotlib.pyplot as plt

# ����Ԥ������

import sklearn.preprocessing as sp

from skimage import io

from skimage.color import rgb2gray

# ��ȡԭʼRGBͼ

img=io.imread("picture/pic.jpg")

# rgb2gray:ԭʼRGBͼתΪ�Ҷ�ͼ

gray_img=rgb2gray(img)

print(gray_img)

# ������ֵ,��ȡ��ֵ����

bin_img=sp.Binarizer(threshold=0.5)

# ����transform�����ԻҶ�ͼ���ж�ֵ��Ԥ��������

result_img=bin_img.transform(gray_img)

# cmap: ��ɫͼ��(colormap), Ĭ�ϻ���ΪRGB��ɫ�ռ� cmap="gray":��-����ɫ

plt.figure(figsize=(10,6))

# ԭʼRGBͼ

plt.subplot(1,3,1)

plt.imshow(img)

# �Ҷ�ͼ

plt.subplot(1,3,2)

plt.imshow(gray_img,cmap="gray")

# ��ֵ��ͼ

plt.subplot(1,3,3)

plt.imshow(result_img,cmap="gray")

plt.show()

2.5 ���ȱ���(One-Hot Encoding)

���ȱ���:Ϊ����������ÿ��ֵ����һ����һ��1�����ɸ�0��ɵ�����,�ø����ж����е�����ֵ���б���

����:

# �۲�ÿ�в�ͬ������,ȡÿ�в�ͬ�����ֵĸ���=λ�����ж��ȱ���

# 4������(��)3������(��)

# ÿ��

# ������ͬ���� ������ͬ���� �ĸ���ͬ����

1 3 2

7 5 4

1 8 6

7 3 9

# Ϊÿ�еIJ�ͬ���ֽ��ж��ȱ���:

1����10 3����100 2����1000

7����01 5����010 4����0100

8����001 6����0010

9����0001

# ������Ϻ�õ����վ������ȱ�������������:

101001000

010100100

100010010

011000001

ʹ�ó���:�������ƶ�

���ȱ������API:

# ��ʽ1:

import sklearn.preprocessing as sp

# ����һ�����ȱ�����

# sparse:�Ƿ�ʹ�ý�����ʽ(ϡ�����)

# dtype:��������

ohe=sp.OneHotEncoder(sparse=�Ƿ���ý�����ʽ,dtype=��������)

# ��ԭʼ����������д���,���ض��ȱ�������������

result=ohe.fit_transform(ԭʼ��������)

# ��ʽ2:

import sklearn.preprocessing as sp

# ����һ�����ȱ�����

# sparse:�Ƿ�ʹ�ý�����ʽ(ϡ�����)

# dtype:��������

ohe=sp.OneHotEncoder(sparse=�Ƿ���ý�����ʽ,dtype=��������)

# ��ԭʼ�����������ѵ��,�õ������ֵ�

encode_dict=ohe.fit(ԭʼ��������)

# ����encode_dict�ֵ��transform��������������������ж��ȱ���

result=encode_dict.transform(ԭʼ��������)

����:

import numpy as np

# ����Ԥ������

import sklearn.preprocessing as sp

samples=np.array([

[1,3,2],

[7,5,4],

[1,8,6],

[7,3,9]])

# ���ȱ���

# ��ʽ1:

# ����һ�����ȱ�����

# sparse:�Ƿ�ʹ�ý�����ʽ(ϡ�����)

# dtype:��������

ohe=sp.OneHotEncoder(sparse=False,dtype="int32")

# ��ԭʼ����������д���,���ض��ȱ�������������

result=ohe.fit_transform(samples)

print(result,type(result))

# ��ʽ2:

# ����һ�����ȱ�����

# sparse:�Ƿ�ʹ�ý�����ʽ(ϡ�����)

# dtype:��������

ohe=sp.OneHotEncoder(sparse=False,dtype="int32")

# ��ԭʼ�����������ѵ��,�õ������ֵ�

encode_dict=ohe.fit(samples)

# ����encode_dict�ֵ��transform��������������������ж��ȱ���

new_result=encode_dict.transform(samples)

print(new_result,type(new_result))

2.6 ��ǩ����

��ǩ����:�����ַ�����ʽ������ֵ�����������е�λ��,Ϊ��ָ��һ�����ֱ�ǩ,�����ṩ��������ֵ�㷨��ѧϰģ��

��ǩ�������API:

import sklearn.preprocessing as sp

# ��ȡ��ǩ������

lbe=sp.LabelEncoder()

# ���ñ�ǩ��������fit_transform����ѵ������Ϊԭʼ������������(һά����:��)���б�ǩ����

result=lbe.fit_transform(ԭʼ������������)

# ���ݱ�ǩ����Ľ�������ֵ�,����õ�ԭʼ���ݾ���

samples=lbe.inverse_transform(result)

����:

import numpy as np

# ����Ԥ������

import sklearn.preprocessing as sp

samples=np.array(["audi","ford","audi","toyota","ford","bmw","toyota","ford","audi"])

# ��ȡ��ǩ������

lbe=sp.LabelEncoder()

# ���ñ�ǩ��������fit_transform����ѵ������Ϊԭʼ������������(һά����:��)���б�ǩ����

result=lbe.fit_transform(samples)

print(result)

# ���ݱ�ǩ����Ľ�������ֵ�,����õ�ԭʼ���ݾ���

samples=lbe.inverse_transform(result)

print(samples)

# ����ѵ��֮��õ�һ����������Ľ��:

test=[0,0,2,3,1]

print(lbe.inverse_transform(test))