因为做深度学习前期需要处理数据集,想把改进图片质量,把一些亮斑比较多的图片用二值化方法提取出来,并移动至另一文件夹。

所以在今天自己写了一点代码,批量完成这项工作。在此做个小记录。

代码链接

代码完整链接见,大家互相学习交流,多多改进:

我的github/二值化并筛选

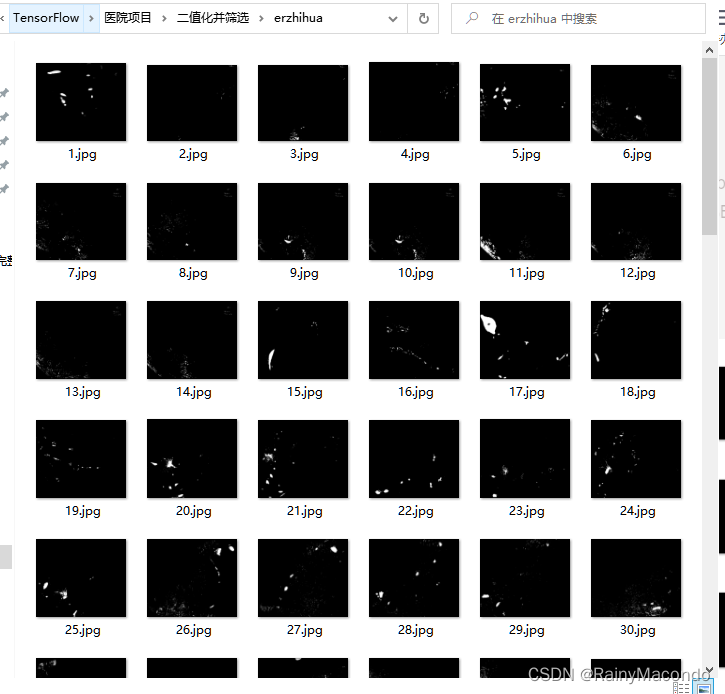

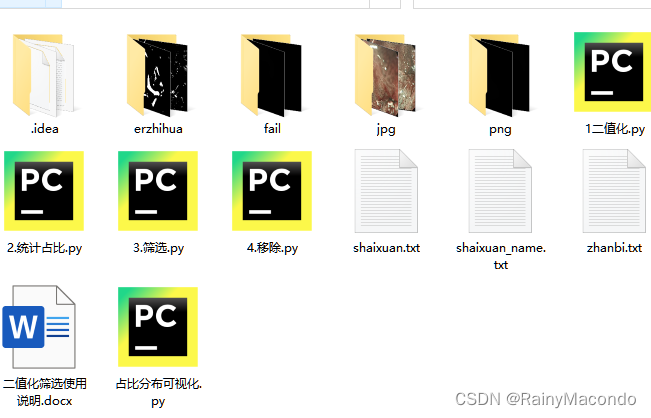

全部按流程完成以后有如下内容:

erzhihua 二值化处理后的黑白图

fail 白色占比超出设定阈值的图

jpg 筛选后保留的图

png 筛选后保留的图的标签

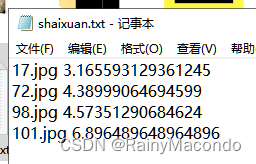

zhanbi.txt 统计出白色占比

shaixuan.txt 要筛选的图片名和占比

shaixuan_name 要筛选的图片名

相关py代码

部分代码解读

OpenCV读取图片比较坑的一点是,IMRED_COLOR方法读出来的为**BGR格式,**这一点一定要注意,避免后续找错浪费时间。所以这里转换为灰度图前,需要做一点小处理。

img0 = cv2.imread(path, cv2.IMREAD_COLOR) # 读取格式为BGR

img = cv2.cvtColor(img0, cv2.COLOR_BGR2RGB) # 转换为RGB

gray = cv2.imread(path, cv2.IMREAD_GRAYSCALE) # 转换为灰度图

这里我用了最简单的二值化方法。

ret, mask = cv2.threshold(gray, 230, 255, 0)

也可以根据自己需要修改 ,例如,随便举几个例子,如自适应阈值、Ostu阈值等,方法非常多,不再赘述,阈值的设定需要自己调试出来

img0 = cv2.imread('test.jpg', cv2.IMREAD_COLOR) #读取格式为BGR

img = cv2.cvtColor(img0, cv2.COLOR_BGR2RGB) #转换为RGB

gray = cv2.imread('test.jpg', cv2.IMREAD_GRAYSCALE) #转换为灰度图

ret, mask = cv2.threshold(gray, 230, 255, 0)

th1 = cv2.adaptiveThreshold(gray, 255, cv2.ADAPTIVE_THRESH_MEAN_C, 0, 11, 2)

th2 = cv2.adaptiveThreshold(gray, 255, cv2.ADAPTIVE_THRESH_GAUSSIAN_C, 0, 11, 2)

ret2, ostu = cv2.threshold(gray, 0, 255, cv2.THRESH_BINARY + cv2.THRESH_OTSU)

统计占比需要用到OpenCV库中现成的方法,也比较方便

def edge_demo(image):

blurred = cv2.GaussianBlur(image, (3, 3), 0) # 高斯模糊降噪

gray = cv2.cvtColor(blurred, cv2.COLOR_BGR2GRAY) # 灰度图

edge_output = cv2.Canny(gray, 50, 150) # 不求梯度也可以

return edge_output

def edge_area(image):

contours, hierarchy = cv2.findContours(image, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE) # 轮廓发现

dst = cv2.cvtColor(image, cv2.COLOR_GRAY2BGR)

cv2.drawContours(dst, contours, -1, (0, 0, 255), 3) # 画出轮廓

area = 0

for c in range(len(contours)):

area += cv2.contourArea(contours[c]) # 面积

# cv2.putText(dst, "area/sum:" + str(area / image.size)*100, (50, 50), cv2.FONT_HERSHEY_SIMPLEX, .7, (255, 0, 0), 2) # 显示

# # cv2.imshow("t3", dst)

# # cv2.waitKey(0)

zhanbi = (area / image.size)*100

return zhanbi

使用时按如下格式,就能返回二值化后白色部分占比的情况

src = cv2.imread(path2)

edge_output = edge_demo(src)

zhanbi = edge_area(edge_output)

详细完整的代码见上文给出的本人github链接,不再介绍了。

此为2022.5.6本人的学习记录,欢迎大家多多交流讨论。