����ѡ���Ծ��������Ĺ����ֵ�ػ�ϸ����ͼ�����

paper��Ŀ:Selective Convolutional Features based Generalized-mean Pooling for Fine-grained Image Retrieval

paper���Ϻ���ͨ��ѧ������VCIP 2018�Ĺ���

paper��ַ:����

Abstract

ʹ�þ���������(CNN)����ͼ������Ѿ�����˺ܶ��ע������רע��һ�������ս�Ե�����:ϸ����ͼ������������һ��ʹ�ù����ֵ��(GeM pooling)�ļ���Ч�������ۺϷ���,�����Ը��õ��������Ծ����������������Ϣ������,�����һ�ּ�����ѡ����ȥ�������ͱ�����ʵ��������,���ĵľۺϷ�����������һ��ͼ�������״̬�ۺϷ���,���Ҵﵽ��������ϸ����ͼ������ۺϷ�����ͬ��ˮƽ,���и����յı�ʾ���ٵ��ڴ�ɱ���

�ؼ��ʡ�������ѡ����ƽ���ػ���ϸ����ͼ�������

I. INTRODUCTION

ϸ����ͼ������ǽ�����������Ӿ�����dz����ŵ��о����⡣ϸ����ͼ������ĸ�����Xie[1]�� 2015 ���״��������ͼ 1 ��ʾ,��һ��ͼ���������ͬ,ϸ����ͼ�����������ѵ�����ϸ��𡣴���,��Ȼͼ������ͬһ���,����������ʽ�����ơ���ɫ�ͱ����Ͽ��ܴ��ںܴ���졣

ͼ 1. ϸ����ͼ�������һ��ͼ�����

�������ѧϰ�����ڼ�����Ӿ������ϵijɹ�,���ڻ��ھ���������(CNN)��һ��ͼ�����,sum-pooling ����Ľ���ʽ�ѱ�֤���� max-pooling(Maximum Activation of Convolutions,MAC ),����SPoC��CroW��R-MAC�� SPoC �Ѿ�֤��,ʹ��Ԥ��ѵ���� CNN ģ�ͽ��м���,�������ϵļռ�ͳػ�����ȫ���Ӳ㡣����,����ͨ��Ӧ�þ�����������ļռ��˹��Ȩ��������ǿ���ֱ�ʾ�����ܡ� CroW���������˿ռ�Ȩ��ȡ����ͼ������,��������ͨ��Ȩ��,����һ�ֱȹ̶��������鷽������Ч�ķ����� R-MAC���û������ڷ���,ͨ����ÿ���ض�������ִ�пռ����ػ�������һ����������,��ͨ���ͳػ�����������������ۺ�Ϊ������ʾ��

SCDA�ǵ�һ������ϸ����ͼ������ľۺϷ�����Ϊ��ȥ������������,SCDA�������ȷ���Ծ�������ͼ ( H �� W �� K ) (H \times W \times K) (H��W��K)���,�õ�һ���ۺ�����ͼ ( H �� W �� 1 ) (H \times W \times 1) (H��W��1)��Ȼ����Լ������� H �� W H \times W H��WԪ�ص�ƽ��ֵ,����ѡ�����������ۺ�����ͼ�д��� m m m��Ԫ��λ�õľ�������������,С�� m m m�ı�����������,SCDA ��ʹ�������ͨ����㷨����Relu5_2��Ľ�������һ��������������������ʣ�����Ⱦֲ��������ֱ�ͨ��averagepooling��max-pooling�ۺ�,Ȼ�������γ����յ�ͼ���ʾ��

����ϸ���ȵ�ͼ���������,��Ȼ SCDA ����������Ϊһ��ͼ������������ƵĻ��� CNN �����Ƚ��������ۺϷ���,������Ȼ����һЩ���⡣����,��ϲ�ͬ�������ͷ�תͼ��,�����յ�ͼ���ʾ���Դﵽ 4096 ά,�������ա���ʹͨ�� PCA �� SVD ���Լ��ٱ�ʾ�����ij���,Ҳ��ð���ͼ������ܵķ��ա����,SCDA ʹ��ȫ�����ػ���ƽ���ػ�,û�г��������ѡ�������������Ϣ��

Ϊ�˽����������,�����һ�ֻ���ѡ���Ծ��������Ĺ���ƽ���ػ�����,��ΪSGeM�� SGeM�����ල,��ʹ��ȫ���Ӳ�֮ǰ�����һ�������������ͼ�� SGeM�ù���ƽ���ػ�������ȫ�����ػ���ƽ���ػ�,�������ػ���ƽ���ػ���һ����ʽ������,�����һ���µ�����ѡ��,ͨ����������ͼ��ÿ��λ�ôﵽ����Ƶ�ʲ������ʵ�����ֵ��ѡ��ֲ������������ĵ���Ҫ�����ܽ�����:(1)����ϸ���ȵ�ͼ���������,ʵ��֤���˹���ƽ���ػ��������ػ���ƽ���ػ�,����һ�־����ԾۺϷ����� (2) �����һ���µ�����ѡ��,���Խ�һ����������ܡ� (3) ����ʵ�����,���ĵķ������Դﵽ�����������Ƚ��ķ���,���и����յı�ʾ (512D)��

II. APPROACH

A. Local CNN features

����һ��û��ȫ���Ӳ��Ԥѵ�� CNN����������ͼ��,������� 3D �����СΪ W �� H �� K W \times H \times K W��H��K,���� K K K������ͼ������, W �� H W \times H W��H������ͼ�Ŀռ�ֱ��ʡ��������Ӧ�� 3D ������Ϊһ�� ( W �� H ) (W \times H) (W��H)�ֲ�������,λ�� ( i , j ) (i, j) (i,j)����ÿ���ֲ������� I i , j I_{i, j} Ii,j?��һ�� K K Kά���������仰˵, ( W �� H ) (W \times H) (W��H)�ռ������ϵ�ÿ��λ�ö��Ǿֲ���������λ�á��� F k \mathscr{F}^{k} Fk��ʾΪ�� k k k������ͼ,���Ĵ�СҲ�� ( W �� H ) (W \times H) (W��H)����ע��,�ڷ�����ѡ�������һ�������㡣

B. Feature Selection Scheme

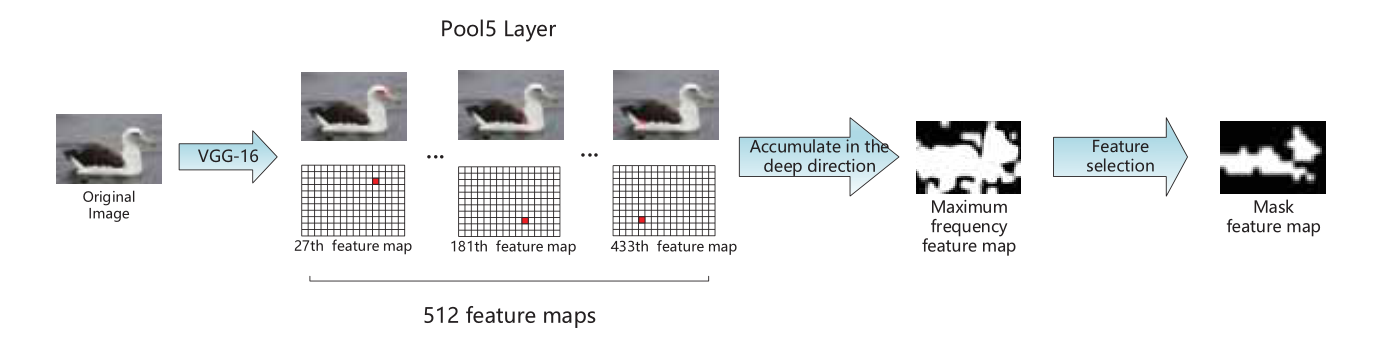

�� CNN ����������,ÿ������ͼ��������Ϊһ���˲��������Ĵ�����������������������ͼ��λ�� ( i , j ) (i, j) (i,j),������Ϊ�����������ԭʼͼ�����Ӧ���������Ȥ����ͼ 2 ���Կ���,�� 27 ������ͼ�����ֵ��Ӧ������۾�,�� 181 ���͵� 433 ������ͼ�����ֵ�ֱ��Ӧ�ڰ�ɫ����ɫ��ë�ı�Ե��

ͼ 2. ���������ѡ���������еĺ�ɫ��������ͼ������λ�á���ͼ���еĺ�ɫ�Ǻ�ɫ��Ķ�Ӧ���֡�

������һ�۲�,�����һ�ּ�����ѡ��,��������ͼÿ��λ�õ����Ƶ�ʡ��������� VGG-16 �����ͼ������ pool5 ������������СΪ 512 �� W �� H 512 \times W \times H 512��W��H���������� ( i , j ) (i, j) (i,j)���Ĵ���Խ��,�ֲ������� I i , j I_{i, j} Ii,j?Խ���á�

Ȼ������ȷ�������е�����ͼ

(

H

��

W

��

K

)

(H \times W \times K)

(H��W��K)���,Ȼ��õ�һ�����Ƶ������ͼ

(

H

��

W

��

1

)

(H \times W \times 1)

(H��W��1)������� 2D map��,ÿ��λ�õ�ƽ�������ִ����ڹ�ʽ 1 �и�����ע��

K

/

(

W

��

H

)

K /(W \times H)

K/(W��H)�Dzο�ֵ,��ʵ���г��Բ�ͬ��ֵ���о���Լ������ܵ�Ӱ�졣

?Threshold?

=

K

/

(

W

��

H

)

(

1

)

\text { Threshold }=K /(W \times H) \quad(1)

?Threshold?=K/(W��H)(1)

�����ֵ��ѡ�������������Ĺؼ�����Ҫ�������Ƶ��ͼ�д��� Threshold ��Ԫ��λ�õľֲ�������,��������������ַ�����ֱ�۽�����ϸ���ȶ����λ���ƺ��Ծ������������Ĵ��������ͼ������Ӧ�����õ�����������ͼ,�繫ʽ 2 ��ʾ����������ѡ����ͼ 2 ��ʾ��

Mask

?

i

,

j

=

{

1

F

r

e

i

,

j

��

?Threshold?

0

?otherwise?

(

2

)

\operatorname{Mask}_{i, j}=\left\{\begin{array}{rr} 1 & F_{r} e_{i, j} \geq \text { Threshold } \\ 0 & \text { otherwise } \end{array}\right. \quad(2)

Maski,j?={10?Fr?ei,j?��?Threshold??otherwise??(2)

C. Generalized-mean Pooling

global max-pooling �� sum-pooling ��������ͼ������Ļ����ۺϷ���,�ֱ��ʾΪ Eq 3 �� Eq 4���� SCDA ���,maxpooling ��Ȼ��һ����Ч�ķ���������,���ػ����ܺͳػ�����ȱ�㡣 Max-pooling ֻ����ÿ������ͼ�����ֵ,���ܻᶪʧ�����������Ϣ�� Sum-pooling �� averagepooling ƽ��ÿ������ͼ�����м���,��Ҳ���������ձ�ʾ���б�����

I

M

a

x

=

[

f

1

(

m

)

��

f

i

(

m

)

��

f

K

(

m

)

]

T

(

3

)

f

k

(

m

)

=

max

?

F

k

I

S

u

m

=

[

f

1

(

s

)

��

f

i

(

s

)

��

f

K

(

s

)

]

T

(

4

)

f

k

(

s

)

=

��

F

k

\begin{array}{r} I_{M a x}=\left[f_{1}^{(m)} \ldots f_{i}^{(m)} \ldots f_{K}^{(m)}\right]^{T}\quad(3) \\ f_{k}^{(m)}=\max \mathscr{F}^{k} \\ I_{S u m}=\left[f_{1}^{(s)} \ldots f_{i}^{(s)} \ldots f_{K}^{(s)}\right]^{T} \quad(4)\\ f_{k}^{(s)}=\sum \mathscr{F}^{k} \end{array}

IMax?=[f1(m)?��fi(m)?��fK(m)?]T(3)fk(m)?=maxFkISum?=[f1(s)?��fi(s)?��fK(s)?]T(4)fk(s)?=��Fk?

���,���ù����ֵ�ػ����������ػ����ܺͳػ����� Eq 5 ���Կ���,maxpooling �� sum-pooling �� GeM pooling ��������

��

p

��

+

��

p \rightarrow+\infty

p��+��ʱ,GeM pooling ��Ϊ max-pooling����

p

=

1

p=1

p=1ʱ,GeM pooling���average-pooling(ע�����е���������������l2-normalization����,����sum-pooling�Ľ������average-pooling���������IJ���,sum-pooling������ sumpooling �� average-pooling)����

p

p

p�� 1 �仯��

+

��

+\infty

+��ʱ,���ܴ�������ֵ�����յ����������ɾ��й����ֵ�����ÿ������ͼ�ĵ���ֵ���,��ά������

K

K

K,��ʹ���Ϊ���յ�ͼ���ʾ��ע��,������ѡ��������Ԫ�ؿ��ǵ� GeM �ػ��ļ����С�

I

G

e

M

=

[

f

1

(

g

)

��

f

i

(

g

)

��

f

K

(

g

)

]

T

f

k

(

g

)

=

(

1

�O

��

F

k

�O

��

x

��

F

k

x

p

)

1

p

(

5

)

\begin{gathered} I_{G e M}=\left[f_{1}^{(g)} \ldots f_{i}^{(g)} \ldots f_{K}^{(g)}\right]^{T} \\ f_{k}^{(g)}=\left(\frac{1}{\left|\sum \mathscr{F}^{k}\right|} \sum_{x \in \mathscr{F}_{k}} x^{p}\right)^{\frac{1}{p}} \end{gathered}\quad(5)

IGeM?=[f1(g)?��fi(g)?��fK(g)?]Tfk(g)?=(�O��Fk�O1?x��Fk?��?xp)p1??(5)

D. Combining different Threshold

Ϊ�˽�һ����ǿ������ʾ�ı����,�����������ͬ��Threshold����������ֵ�ǽӽ�

K

/

(

W

��

H

)

K /(W \times H)

K/(W��H)���������������ǵĹ�ϵ�ڹ�ʽ 6 �и�����

T

h

r

e

s

h

o

l

d

1

<

K

/

(

W

��

H

)

<

T

h

r

e

s

h

o

l

d

2

(

6

)

Threshold 1< K /(W \times H)< Threshold 2 \quad(6)

Threshold1<K/(W��H)<Threshold2(6)

��

I

G

e

M

+

I_{G e M}+

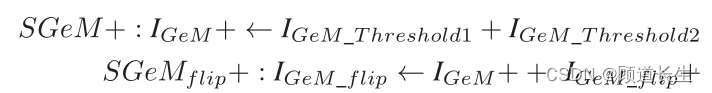

IGeM?+��ʾΪ���Threshold 1��Threshold 2��ȫ�ֱ�ʾ������,�������ԭʼͼ��ˮƽ��ת����һ��

I

G

e

M

+

I_{G e M}+

IGeM?+,��Ϊ

I

G

e

M

?

f

l

i

p

(

512

D

)

.

I

G

e

M

+

I_{G e M_{-} f l i p}(512 D) . I_{G e M}+

IGeM??flip?(512D).IGeM?+ ��

I

G

e

M

?

f

l

i

p

+

I_{G e M_{-} f l i p}+

IGeM??flip?+�ڹ�ʽ 7 �и���������汾�� SGeM ����Ϊ

S

G

e

M

flip?

+

\mathrm{SGeM}_{\text {flip }}+

SGeMflip??+��

�����

[1] L. Xie, J. Wang, B. Zhang, and Q. Tian, ��Fine-grained image search,�� IEEE Transactions on Multimedia, vol. 17, no. 5, pp. 636�C647, 2015.