Pytorch �

0. ��������

����ʹ�� Kaggle ����ѽ����� Notebook

�̳�ʹ��������ʦ�� ����ѧ���ѧϰ ��վ�� ��Ƶ����

С����:������������������ʱ����� Shift+Tab �鿴������⡣

1. �

1.1 ����

Ŀ�����㷨ͨ����������ͼ���в�������������,Ȼ���ж���Щ�������Ƿ�������Ǹ���Ȥ��Ŀ��,����������߽�Ӷ���ȷ��Ԥ��Ŀ�����ʵ�߽��(ground-truth bounding box)�� ��ͬ��ģ��ʹ�õ���������������ܲ�ͬ�����е�һ�ַ���:��ÿ������Ϊ����,���ɶ�����űȺͿ��߱�(aspect ratio)��ͬ�ı߽�� ��Щ�߽��Ϊê��(anchor box)��

һ��Ŀ�����㷨�ǻ���ê���:

- ����������Ϊê�������(��Ե��)

- Ԥ��ÿ��ê�����Ƿ��й�ע������

- �����,Ԥ������ê����ʵ��Ե���ƫ��

1.2 IoU-������

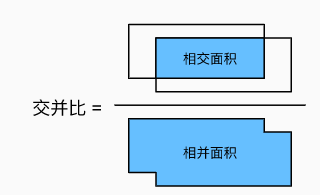

���ǿ��Ժ���ê�����ʵ�߽��֮��������ԡ����������߽��,����ͨ�������ǵĽܿ���ָ��(Jaccard)��Ϊ������(intersection over union,IoU)

-

IoU ��������������֮������ƶ�:

- 0 0 0 ��ʾ���ص�, 1 1 1 ��ʾ�غ�

-

�ܿ���ָ��(Jaccard):

J ( A , B ) = �O A �� B �O �O A �� B �O J(A, B)=\frac{|A \cap B|}{|A \cup B|} J(A,B)=�OA��B�O�OA��B�O?

1.3 �������

- ÿ��ê����һ��ѵ������

- ��ÿ��ê��,Ҫô��ע�ɱ���,Ҫô������һ����ʵ��Ե��

- ���ǿ��ܻ����ɴ�����ê��

- ����ᵼ�´����ĸ�������

����������ͼ����,���ŵ�

4

4

4 ����������ʵ��Ե�������,���ŵ�

9

9

9 �����������ɵ�ê��������

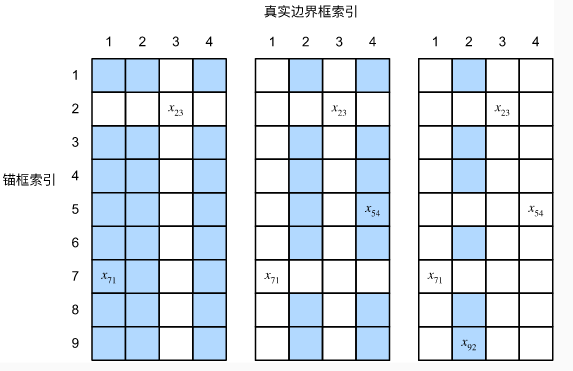

ÿһ��ê���������ʵ��Ե���� IoU,�õ���һ��

9

��

4

9 \times 4

9��4 ����

(��ͼ)�����ҳ����ֵ,�������ֵΪ

x

23

x_{23}

x23?,��ô�Ͱ�ê��

2

2

2 ��Ϊ�߿�

3

3

3 ��Ԥ��,Ȼ����

x

23

x_{23}

x23? ���ڵ��к��С�

(��ͼ)�ҳ�����

x

23

x_{23}

x23? ������������,ʣ��Ԫ�ص����ֵ,����Ϊ

x

71

x_{71}

x71?,��ô�Ͱ�ê��

7

7

7 ��Ϊ�߿�

1

1

1 ��Ԥ��,Ȼ����

x

71

x_{71}

x71? ���ڵ��к��С�

�Դ����ơ�����

1.4 ʹ�÷Ǽ���ֵ����(NMS)���

��������ê��ʱ,���ܻ�����������Ƶľ��������ص���Ԥ��߽��,��Χ����ͬһĿ�ꡣ Ϊ�˼����,���ǿ���ʹ�÷Ǽ���ֵ����(non-maximum suppression,NMS)�ϲ�����ͬһĿ������Ƶ�Ԥ��߽��

NMS ���Ժϲ����Ƶ�Ԥ��(Ԥ���ʱʹ��):

- ѡ���ǷDZ���������Ԥ��ֵ

- ȥ�������������� IoU ֵ���� �� \theta �� ��Ԥ��

- �ظ���������ֱ������Ԥ��Ҫô��ѡ��,Ҫô��ȥ��

2. ����

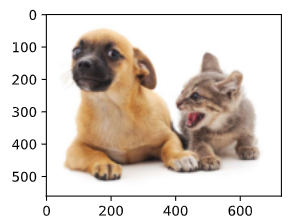

������ʦ�Ĵ���̫ǿ��,���Ѷ�,�ҵö�����������🐕

2.1 ����ͼƬ

!pip install -U d2l

%matplotlib inline

import torch

import os

import request

from d2l import torch as d2l

torch.set_printoptions(2) # �����������

if not os.path.exists('../data'):

os.mkdir('../data')

url = 'https://raw.githubusercontent.com/d2l-ai/d2l-zh/master/img/catdog.jpg'

r = requests.get(url)

with open('../data/catdog.jpg', 'wb') as f:

f.write(r.content)

d2l.set_figsize()

img = d2l.plt.imread('../data/catdog.jpg')

d2l.plt.imshow(img)

2.2 ���ɶ��ê��

��������ͼ��ĸ߶�Ϊ h h h,����Ϊ w w w�� ������ͼ���ÿ������Ϊ�������ɲ�ͬ��״��ê��:���ű�Ϊ s �� ( 0 , 1 ] s\in (0, 1] s��(0,1],���߱�Ϊ r > 0 r > 0 r>0�� ��ôê��Ŀ��Ⱥ߶ȷֱ��� w s r ws\sqrt{r} wsr? �� h s / r hs/\sqrt{r} hs/r?�� ע��,������λ�ø���ʱ,��֪���ߵ�ê����ȷ���ġ�

�����и�����: w s r ws\sqrt{r} wsr? �� h s / r hs/\sqrt{r} hs/r? ����ô�ó�����?��ͷ���Ƶ�һ�¡�

Ҫ���ɶ����ͬ��״��ê��,�����������������ű�(scale)ȡֵ

s

1

,

��

,

s

n

s_1,\ldots, s_n

s1?,��,sn? ��������߱�(aspect ratio)ȡֵ

r

1

,

��

,

r

m

r_1,\ldots, r_m

r1?,��,rm?�� ��ʹ����Щ�����ͳ����ȵ��������ʱ,����ͼ���ܹ���

w

h

n

m

whnm

whnm ��ê�� �����Ļ���Щê��ȷʵ���ܻḲ��������ʵ�߽��,�����㸴���Ժ������ߡ� ʵ����,����ֻ���ǰ���

s

1

s_1

s1? ��

r

1

r_1

r1? �����(��

m

+

n

?

1

m + n - 1

m+n?1 �����):

(

s

1

,

r

1

)

,

(

s

1

,

r

2

)

,

��

,

(

s

1

,

r

m

)

,

(

s

2

,

r

1

)

,

(

s

3

,

r

1

)

,

��

,

(

s

n

,

r

1

)

.

(s_1, r_1), (s_1, r_2), \ldots, (s_1, r_m), (s_2, r_1), (s_3, r_1), \ldots, (s_n, r_1).

(s1?,r1?),(s1?,r2?),��,(s1?,rm?),(s2?,r1?),(s3?,r1?),��,(sn?,r1?).

def multibox_prior(data, sizes, ratios):

"""������ÿ������Ϊ���ľ��в�ͬ��״��ê��"""

in_height, in_width = data.shape[-2:]

device, num_sizes, num_ratios = data.device, len(sizes), len(ratios)

boxes_per_pixel = (num_sizes + num_ratios - 1)

size_tensor = torch.tensor(sizes, device=device)

ratio_tensor = torch.tensor(ratios, device=device)

# Ϊ�˽�ê���ƶ������ص�����,��Ҫ����ƫ������

# ��Ϊһ�����صĵĸ�Ϊ1�ҿ�Ϊ1,����ѡ��ƫ�����ǵ�����0.5

offset_h, offset_w = 0.5, 0.5

steps_h = 1.0 / in_height # ��y�������Ų���

steps_w = 1.0 / in_width # ��x�������Ų���

# ����ê����������ĵ�

center_h = (torch.arange(in_height, device=device) + offset_h) * steps_h

center_w = (torch.arange(in_width, device=device) + offset_w) * steps_w

shift_y, shift_x = torch.meshgrid(center_h, center_w)

shift_y, shift_x = shift_y.reshape(-1), shift_x.reshape(-1)

# ���ɡ�boxes_per_pixel�����ߺͿ�,

# ֮�����ڴ���ê����Ľ�����(xmin,xmax,ymin,ymax)

w = torch.cat((size_tensor * torch.sqrt(ratio_tensor[0]),

sizes[0] * torch.sqrt(ratio_tensor[1:])))\

* in_height / in_width # ������������

h = torch.cat((size_tensor / torch.sqrt(ratio_tensor[0]),

sizes[0] / torch.sqrt(ratio_tensor[1:])))

# ����2����ð�ߺͰ��

anchor_manipulations = torch.stack((-w, -h, w, h)).T.repeat(

in_height * in_width, 1) / 2

# ÿ�����ĵ㶼���С�boxes_per_pixel����ê��,

# �������ɺ�����ê�����ĵ�����,�ظ��ˡ�boxes_per_pixel����

out_grid = torch.stack([shift_x, shift_y, shift_x, shift_y],

dim=1).repeat_interleave(boxes_per_pixel, dim=0)

output = out_grid + anchor_manipulations

return output.unsqueeze(0)

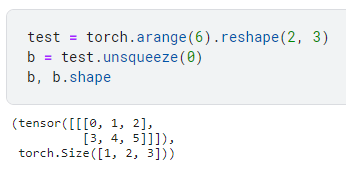

unsqueeze(0) ��ʾ�ڵ�

0

0

0 ά��һ��ά��,��ʵ������ά�ȴ���������С��

�����÷�:

�鿴���ص�ê����� Y ����״(������С,ê�������,4):

h, w = img.shape[:2]

print(h, w)

X = torch.rand(size=(1, 3, h, w))

Y = multibox_prior(X, sizes=[0.75, 0.5, 0.25], ratios=[1, 2, 0.5])

Y.shape

���Կ���������ê����Ϊ

2042040

=

h

��

w

��

(

r

+

s

?

1

)

=

561

��

728

��

5

2042040 = h \times w \times (r+s-1) = 561 \times 728 \times 5

2042040=h��w��(r+s?1)=561��728��5 ��

������(250,250)Ϊ���ĵĵ�һ��ê��(�ֱ�������Ϻ����������һ����Ľ��):

boxes = Y.reshape(h, w, 5, 4)

boxes[250, 250, 0, :]

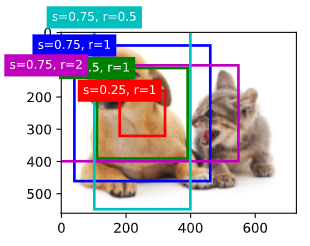

Ϊ����ʾ��ͼ������ij������Ϊ���ĵ�����ê��,���Ƕ���������� show_bboxes ��������ͼ���ϻ��ƶ���߽��:

#@save

def show_bboxes(axes, bboxes, labels=None, colors=None):

"""��ʾ���б߽��"""

def _make_list(obj, default_values=None):

if obj is None:

obj = default_values

elif not isinstance(obj, (list, tuple)):

obj = [obj]

return obj

labels = _make_list(labels)

colors = _make_list(colors, ['b', 'g', 'r', 'm', 'c'])

for i, bbox in enumerate(bboxes):

color = colors[i % len(colors)]

rect = d2l.bbox_to_rect(bbox.detach().numpy(), color)

axes.add_patch(rect)

if labels and len(labels) > i:

text_color = 'k' if color == 'w' else 'w'

axes.text(rect.xy[0], rect.xy[1], labels[i],

va='center', ha='center', fontsize=9, color=text_color,

bbox=dict(facecolor=color, lw=0))

�鿴��(250,250)Ϊ���ĵ�����ê��:

d2l.set_figsize()

bbox_scale = torch.tensor((w, h, w, h))

fig = d2l.plt.imshow(img)

show_bboxes(fig.axes, boxes[250, 250, :, :] * bbox_scale,

['s=0.75, r=1', 's=0.5, r=1', 's=0.25, r=1', 's=0.75, r=2',

's=0.75, r=0.5'])

2.3 ������(IoU)

��ê��ͱ�Ե������Ľ�����:

J

(

A

,

B

)

=

�O

A

��

B

�O

�O

A

��

B

�O

J(A,B) = \frac{| A \cap B|}{|A \cup B|}

J(A,B)=�OA��B�O�OA��B�O?

def box_iou(boxes1, boxes2):

"""��������ê���߽���б��гɶԵĽ�����"""

box_area = lambda boxes: ((boxes[:, 2] - boxes[:, 0]) *

(boxes[:, 3] - boxes[:, 1]))

# boxes1,boxes2,areas1,areas2����״:

# boxes1:(boxes1������,4),

# boxes2:(boxes2������,4),

# areas1:(boxes1������,),

# areas2:(boxes2������,)

areas1 = box_area(boxes1)

areas2 = box_area(boxes2)

# inter_upperlefts,inter_lowerrights,inters����״:

# (boxes1������,boxes2������,2)

inter_upperlefts = torch.max(boxes1[:, None, :2], boxes2[:, :2])

inter_lowerrights = torch.min(boxes1[:, None, 2:], boxes2[:, 2:])

inters = (inter_lowerrights - inter_upperlefts).clamp(min=0)

# inter_areasandunion_areas����״:(boxes1������,boxes2������)

inter_areas = inters[:, :, 0] * inters[:, :, 1]

union_areas = areas1[:, None] + areas2 - inter_areas

return inter_areas / union_areas

2.4 ��ê���ʾ��ʵ�߽��

def assign_anchor_to_bbox(ground_truth, anchors, device, iou_threshold=0.5):

"""����ӽ�����ʵ�߽������ê��"""

num_anchors, num_gt_boxes = anchors.shape[0], ground_truth.shape[0]

# λ�ڵ�i�к͵�j�е�Ԫ��x_ij��ê��i����ʵ�߽��j��IoU

jaccard = box_iou(anchors, ground_truth)

# ����ÿ��ê��,�������ʵ�߽�������

anchors_bbox_map = torch.full((num_anchors,), -1, dtype=torch.long,

device=device)

# ������ֵ,�����Ƿ������ʵ�߽��

max_ious, indices = torch.max(jaccard, dim=1)

anc_i = torch.nonzero(max_ious >= 0.5).reshape(-1)

box_j = indices[max_ious >= 0.5]

anchors_bbox_map[anc_i] = box_j

col_discard = torch.full((num_anchors,), -1)

row_discard = torch.full((num_gt_boxes,), -1)

for _ in range(num_gt_boxes):

max_idx = torch.argmax(jaccard)

box_idx = (max_idx % num_gt_boxes).long()

anc_idx = (max_idx / num_gt_boxes).long()

anchors_bbox_map[anc_idx] = box_idx

jaccard[:, box_idx] = col_discard

jaccard[anc_idx, :] = row_discard

return anchors_bbox_map

2.5 ������ƫ��

Ϊÿ��ê��������ƫ����,����һ��ê�� A A A ��������һ����ʵ�߽�� B B B�� һ����,ê�� A A A ��������Ϊ�� B B B ��ͬ�� ��һ����,ê�� A A A ��ƫ���������� B B B �� A A A ������������λ���Լ������������Դ�С���б�ǡ� �������ݼ��ڲ�ͬ�Ŀ��λ�úʹ�С��ͬ,���ǿ��Զ���Щ���λ�úʹ�СӦ�ñ任,ʹ���÷ֲ���������������ϵ�ƫ������

����һ�ֳ����ı任�� ������ A A A �� B B B,��������ֱ�Ϊ ( x a , y a ) (x_a, y_a) (xa?,ya?) �� ( x b , y b ) (x_b, y_b) (xb?,yb?),���ȷֱ�Ϊ w a w_a wa? �� w b w_b wb?,�߶ȷֱ�Ϊ h a h_a ha? �� h b h_b hb?�� ���ǿ��Խ� A A A ��ƫ�������Ϊ:

( x b ? x a w a ? �� x �� x , y b ? y a h a ? �� y �� y , log ? w b w a ? �� w �� w , log ? h b h a ? �� h �� h ) , \left( \frac{ \frac{x_b - x_a}{w_a} - \mu_x }{\sigma_x}, \frac{ \frac{y_b - y_a}{h_a} - \mu_y }{\sigma_y}, \frac{ \log \frac{w_b}{w_a} - \mu_w }{\sigma_w}, \frac{ \log \frac{h_b}{h_a} - \mu_h }{\sigma_h}\right), (��x?wa?xb??xa???��x??,��y?ha?yb??ya???��y??,��w?logwa?wb???��w??,��h?logha?hb???��h??),

���г�����Ĭ��ֵΪ �� x = �� y = �� w = �� h = 0 , �� x = �� y = 0.1 \mu_x = \mu_y = \mu_w = \mu_h = 0, \sigma_x=\sigma_y=0.1 ��x?=��y?=��w?=��h?=0,��x?=��y?=0.1��

def offset_boxes(anchors, assigned_bb, eps=1e-6):

"""��ê��ƫ������ת��"""

c_anc = d2l.box_corner_to_center(anchors)

c_assigned_bb = d2l.box_corner_to_center(assigned_bb)

offset_xy = 10 * (c_assigned_bb[:, :2] - c_anc[:, :2]) / c_anc[:, 2:]

offset_wh = 5 * torch.log(eps + c_assigned_bb[:, 2:] / c_anc[:, 2:])

offset = torch.cat([offset_xy, offset_wh], axis=1)

return offset

���һ��ê��û�б�������ʵ�߽��,����ֻ�轫ê��������Ϊ��������(background)�� ��������ê��ͨ������Ϊ �����ࡱ ê��,����ı���Ϊ �����ࡱ ê�� ����ʹ����ʵ�߽��(

labels����)ʵ������multibox_target����,�����ê�������ƫ����(anchors����)�� �˺���������������������Ϊ��,Ȼ��������������������һ��

def multibox_target(anchors, labels):

"""ʹ����ʵ�߽����ê��"""

batch_size, anchors = labels.shape[0], anchors.squeeze(0)

batch_offset, batch_mask, batch_class_labels = [], [], []

device, num_anchors = anchors.device, anchors.shape[0]

for i in range(batch_size):

label = labels[i, :, :]

anchors_bbox_map = assign_anchor_to_bbox(

label[:, 1:], anchors, device)

bbox_mask = ((anchors_bbox_map >= 0).float().unsqueeze(-1)).repeat(

1, 4)

# �����ǩ�ͷ���ı߽�������ʼ��Ϊ��

class_labels = torch.zeros(num_anchors, dtype=torch.long,

device=device)

assigned_bb = torch.zeros((num_anchors, 4), dtype=torch.float32,

device=device)

# ʹ����ʵ�߽�������ê������

# ���һ��ê��û�б�����,���DZ����Ϊ����(ֵΪ��)

indices_true = torch.nonzero(anchors_bbox_map >= 0)

bb_idx = anchors_bbox_map[indices_true]

class_labels[indices_true] = label[bb_idx, 0].long() + 1

assigned_bb[indices_true] = label[bb_idx, 1:]

# ƫ����ת��

offset = offset_boxes(anchors, assigned_bb) * bbox_mask

batch_offset.append(offset.reshape(-1))

batch_mask.append(bbox_mask.reshape(-1))

batch_class_labels.append(class_labels)

bbox_offset = torch.stack(batch_offset)

bbox_mask = torch.stack(batch_mask)

class_labels = torch.stack(batch_class_labels)

return (bbox_offset, bbox_mask, class_labels)

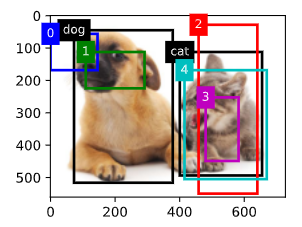

2.6 ������ƫ��ʾ��

ground_truth ��ʾ��ʵ��, anchors ��ʾê��:

ground_truth = torch.tensor([[0, 0.1, 0.08, 0.52, 0.92],

[1, 0.55, 0.2, 0.9, 0.88]])

anchors = torch.tensor([[0, 0.1, 0.2, 0.3], [0.15, 0.2, 0.4, 0.4],

[0.63, 0.05, 0.88, 0.98], [0.66, 0.45, 0.8, 0.8],

[0.57, 0.3, 0.92, 0.9]])

fig = d2l.plt.imshow(img)

show_bboxes(fig.axes, ground_truth[:, 1:] * bbox_scale, ['dog', 'cat'], 'k')

show_bboxes(fig.axes, anchors * bbox_scale, ['0', '1', '2', '3', '4']);

ê�����ʵ�߽����������һ��ά��:

labels = multibox_target(anchors.unsqueeze(dim=0),

ground_truth.unsqueeze(dim=0))

label[2] ��ʾÿ��ê������,����,����è���������ֱ�Ϊ

0

0

0,

1

1

1 ��

2

2

2,����Ϊ

3

3

3 ��ê���Ϊ

0

0

0,����Ϊ IoU û�ﵽ��ֵ:

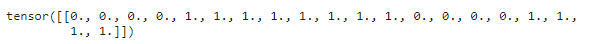

labels[2]

labels[1] ��ʾ����(mask)����,��״Ϊ(������С,ê�������ı�)�� ��������е�Ԫ����ÿ��ê���4��ƫ����һһ��Ӧ�� �������Dz����ĶԱ����ļ��,�����ƫ������ӦӰ��Ŀ�꺯���� ͨ��Ԫ�س˷�,��������е��㽫�ڼ���Ŀ�꺯��֮ǰ���˵�����ƫ����,

1

1

1 ��λ�ô��������,

0

0

0 ��λ�ñ�ʾ����:

labels[1]

labels[0] ������Ϊÿ��ê���ǵ��ĸ�ƫ��ֵ������ê���ƫ���������Ϊ

0

0

0:

labels[0]

2.7 ʹ�÷Ǽ���ֵ����(NMS)Ԥ��߽��

Ӧ����ƫ�Ʊ任������Ԥ��ı߽������:

def offset_inverse(anchors, offset_preds):

"""���ݴ���Ԥ��ƫ������ê����Ԥ��߽��"""

anc = d2l.box_corner_to_center(anchors)

pred_bbox_xy = (offset_preds[:, :2] * anc[:, 2:] / 10) + anc[:, :2]

pred_bbox_wh = torch.exp(offset_preds[:, 2:] / 5) * anc[:, 2:]

pred_bbox = torch.cat((pred_bbox_xy, pred_bbox_wh), axis=1)

predicted_bbox = d2l.box_center_to_corner(pred_bbox)

return predicted_bbox

nms �������ս�������ŶȽ���������������:

def nms(boxes, scores, iou_threshold):

"""��Ԥ��߽������ŶȽ�������"""

B = torch.argsort(scores, dim=-1, descending=True)

keep = [] # ����Ԥ��߽���ָ��

while B.numel() > 0:

i = B[0]

keep.append(i)

if B.numel() == 1: break

iou = box_iou(boxes[i, :].reshape(-1, 4),

boxes[B[1:], :].reshape(-1, 4)).reshape(-1)

inds = torch.nonzero(iou <= iou_threshold).reshape(-1)

B = B[inds + 1]

return torch.tensor(keep, device=boxes.device)

���Ǽ���ֵ����Ӧ����Ԥ��߽��:

def multibox_detection(cls_probs, offset_preds, anchors, nms_threshold=0.5,

pos_threshold=0.009999999):

"""ʹ�÷Ǽ���ֵ������Ԥ��߽��"""

device, batch_size = cls_probs.device, cls_probs.shape[0]

anchors = anchors.squeeze(0)

num_classes, num_anchors = cls_probs.shape[1], cls_probs.shape[2]

out = []

for i in range(batch_size):

cls_prob, offset_pred = cls_probs[i], offset_preds[i].reshape(-1, 4)

conf, class_id = torch.max(cls_prob[1:], 0)

predicted_bb = offset_inverse(anchors, offset_pred)

keep = nms(predicted_bb, conf, nms_threshold)

# �ҵ����е�non_keep����,����������Ϊ����

all_idx = torch.arange(num_anchors, dtype=torch.long, device=device)

combined = torch.cat((keep, all_idx))

uniques, counts = combined.unique(return_counts=True)

non_keep = uniques[counts == 1]

all_id_sorted = torch.cat((keep, non_keep))

class_id[non_keep] = -1

class_id = class_id[all_id_sorted]

conf, predicted_bb = conf[all_id_sorted], predicted_bb[all_id_sorted]

# pos_threshold��һ�����ڷDZ���Ԥ�����ֵ

below_min_idx = (conf < pos_threshold)

class_id[below_min_idx] = -1

conf[below_min_idx] = 1 - conf[below_min_idx]

pred_info = torch.cat((class_id.unsqueeze(1),

conf.unsqueeze(1),

predicted_bb), dim=1)

out.append(pred_info)

return torch.stack(out)

2.8 NMS ʾ��

Ϊ�����,���Ǽ���Ԥ���ƫ����������,����ζ��Ԥ��ı߽����ê�� ���ڱ���������è���е�ÿ����,���ǻ�����������Ԥ�����:

anchors = torch.tensor([[0.1, 0.08, 0.52, 0.92], [0.08, 0.2, 0.56, 0.95],

[0.15, 0.3, 0.62, 0.91], [0.55, 0.2, 0.9, 0.88]])

offset_preds = torch.tensor([0] * anchors.numel())

cls_probs = torch.tensor([[0] * 4, # ������Ԥ�����

[0.9, 0.8, 0.7, 0.1], # ����Ԥ�����

[0.1, 0.2, 0.3, 0.9]]) # è��Ԥ�����

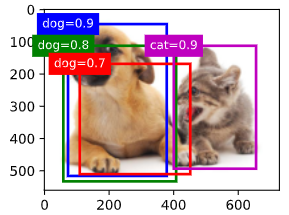

��ͼ���ϻ�����ЩԤ��߽������Ŷ�:

fig = d2l.plt.imshow(img)

show_bboxes(fig.axes, anchors * bbox_scale,

['dog=0.9', 'dog=0.8', 'dog=0.7', 'cat=0.9'])

�������ǿ��Ե��� multibox_detection ������ִ�зǼ���ֵ����,������ֵ����Ϊ

0.5

0.5

0.5�� ע��,��ʾ��������������������ά�ȡ�

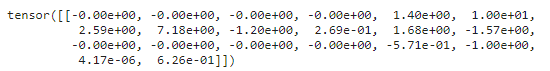

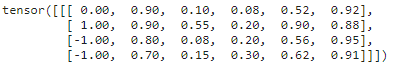

���ǿ��Կ������ؽ������״��(������С,ê�������,6)�� ���ڲ�ά���е�����Ԫ���ṩ��ͬһԤ��߽��������Ϣ�� ��һ��Ԫ����Ԥ���������,�� 0 0 0 ��ʼ( 0 0 0 ������, 1 1 1 ����è),ֵ ? 1 -1 ?1 ��ʾ�������ڷǼ���ֵ�����б��Ƴ��ˡ� �ڶ���Ԫ����Ԥ��ı߽������Ŷȡ� �����ĸ�Ԫ�طֱ���Ԥ��߽�����ϽǺ����½ǵ�������(��Χ���� 0 0 0 �� 1 1 1 ֮��):

output = multibox_detection(cls_probs.unsqueeze(dim=0),

offset_preds.unsqueeze(dim=0),

anchors.unsqueeze(dim=0),

nms_threshold=0.5)

output

ɾ��

?

1

-1

?1 ���(����)��Ԥ��߽���,���ǿ�������ɷǼ���ֵ���Ʊ��������Ԥ��߽��:

fig = d2l.plt.imshow(img)

for i in output[0].detach().numpy():

if i[0] == -1:

continue

label = ('dog=', 'cat=')[int(i[0])] + str(i[1])

show_bboxes(fig.axes, [torch.tensor(i[2:]) * bbox_scale], label)