MeanShift����

�ֳƾ�ֵƯ���㷨,������Ҫһ�������뾶r,������ֵT

��ÿ������,��Ϊһ������,����λ�ð뾶r��,ѡ��������������������,�ŵ�һ�����С�

����������ݵ�λ�þ�ֵ,���ݾ�ֵ,���µ�λ�ú;�ֵ��Ϊ���������,���¼���������������������,���ϵ���ֱ��������

�൱��������������������,һ��λ����������r,һ��������������T��

K-Means����

�÷�������Ϊk��ֵ,������Ҫѡ��k���������ġ�

��ÿ������,���������ľ�������C,�������C��������б���

�õ�ÿ�����������б��е�����,��ȡ���ݾ�ֵ,����ֵ��Ϊ�µ��������ġ����ϵ���ֱ�����IJ��ٱ仯

�������ݷ�Ϊλ������������ֵ,����meanshift�ͺ����ˡ�

������������k-means��,����������ֶ�ȷ����,��mean shift���������ǵ����Զ�ȷ����,��������������ÿ�����ݶ���һ���ࡣ

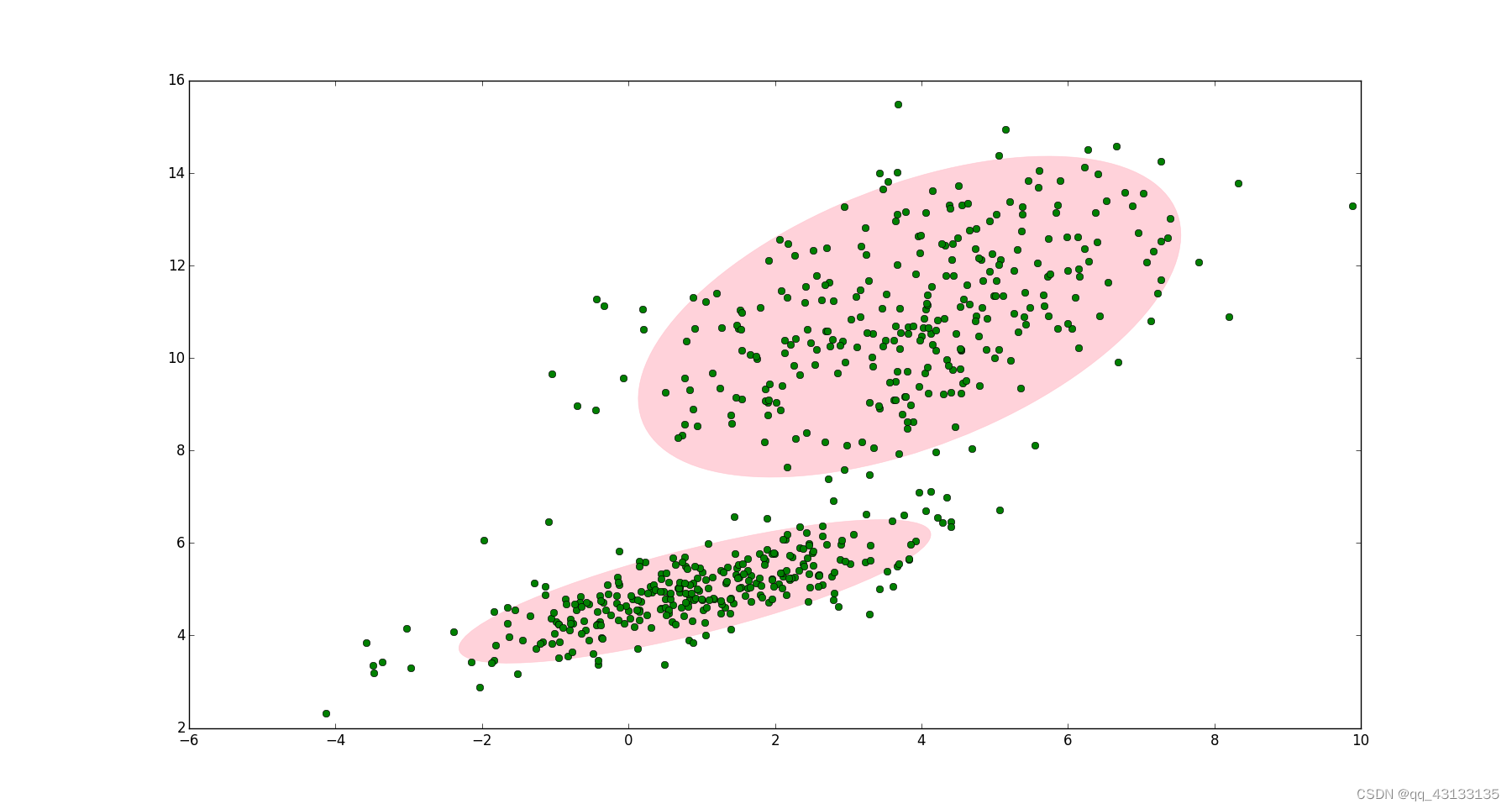

GMM����

ԭ��

����,������������k����˹�ֲ�,���ݵ�ʵ�ʷֲ������������������:

p

(

x

)

=

��

k

=

1

K

��

k

N

(

x

�O

��

k

,

��

k

)

p(\boldsymbol{x}) = \sum_{k=1}^K\pi_k \mathcal{N}(\boldsymbol{x}|\boldsymbol{\mu}_k, \boldsymbol{\Sigma}_k)

p(x)=��k=1K?��k?N(x�O��k?,��k?)

���� N ( x �O �� k , �� k ) \mathcal{N}(\boldsymbol{x}|\boldsymbol{\mu}_k, \boldsymbol{\Sigma}_k) N(x�O��k?,��k?)��Ϊ���ģ���еĵ�k�������� �� k \pi_k ��k? �ǻ��ϵ��(���߽�Ȩ�ء�ѡ�и÷����ĸ���),������:

- �� k = 1 K �� k = 1 \sum_{k=1}^K\pi_k = 1 ��k=1K?��k?=1

- 0 �� �� k �� 1 0\leq \pi_k \leq 1 0����k?��1

���Ҫ�� GMM �ķֲ��������ȡһ����Ļ�,ʵ���Ͽ��Է�Ϊ����:

������������� K ������֮��ѡһ��,ÿ��������ѡ�еĸ���ʵ���Ͼ�������ϵ�� �� k \pi_k ��k?

ѡ��֮��,�ٵ����ؿ��Ǵ���������ĸ�˹�ֲ���ѡȡһ����Ϳ����ˡ�

EM��������

����GMM�е�ÿ������,����������:ѡ�и��� �� k \pi_k ��k?,�ֲ���ֵ �� k {\mu}_k ��k?,�ֲ����� �� k {\Sigma}_k ��k?��������Ǵӷֲ�ѡȡһ����,��ô֪��������������ĸ�������?����˵���ȷ�� �� k \pi_k ��k??EM�㷨�Ϳ��Խ��GMM�������Ƶ����⡣

ͨ��EM�㷨,���ǿ��Ե��������GMM�еIJ���: ( �� k , x k , �� k ) (\pi_k, \boldsymbol{x}_k, \boldsymbol{\Sigma}_k) (��k?,xk?,��k?)��

�������ǿ�������һ���µ�������� z �� { z 1 , z 2 , . . . z k } \boldsymbol{z}��\{z_1,z_2,...z_k\} z��{z1?,z2?,...zk?}

p ( z k ) = �� k p(z_k)=\pi_k p(zk?)=��k?,��ʾ��k��������ѡ�еĸ���,������ÿ��ֻ����һ��������ѡ��,��:

- �� k z k = �� \sum_k{z_k}=\Omega ��k?zk?=��

- p ( z ) = �� k p ( z k ) = �� k �� k = 1 p(z)= \sum_k{p(z_k)}=\sum_k{\pi_k}=1 p(z)=��k?p(zk?)=��k?��k?=1

- p ( x �O z k ) = N ( x �O �� k , �� k ) p(x|z_k)= \mathcal{N}(\boldsymbol{x}|\boldsymbol{\mu}_k, \boldsymbol{\Sigma}_k) p(x�Ozk?)=N(x�O��k?,��k?)

- p ( x ) = �� k p ( x ) p ( x �O z k ) p(x)= \sum_kp(x)p(x|z_k) p(x)=��k?p(x)p(x�Ozk?)

���ݱ�Ҷ˹����, p ( z ) p(z) p(z)���������, p ( x �O z ) p(x�Oz) p(x�Oz)����Ȼ����, p ( z �O x ) p(z�Ox) p(z�Ox)�Ǻ�����ʡ��� x = { x 1 , x 2 , . . . x N } \boldsymbol{x}=\{x_1,x_2,...x_N\} x={x1?,x2?,...xN?},������

- p ( z �O x ) = p ( x �O z ) p ( z ) p(z�Ox)=p(x�Oz)p(z) p(z�Ox)=p(x�Oz)p(z)

- �� k = 1 N k �� n p ( z �O x n ) p ( x n ) ��_k=\frac{1}{N_k}\sum_np(z�Ox_n)p(x_n) ��k?=Nk?1?��n?p(z�Oxn?)p(xn?)

EM�㷨

- ���������Ŀ k k k,��ÿ���������� �� k \pi_k ��k?�� �� k ��_k ��k?�� �� k \boldsymbol{\Sigma}_ k ��k? �ij�ʼֵ,Ȼ����������Ȼ������

l n ?? p ( x �O �� , �� , �� ) = �� n ? l n �� k �� k N ( x n �O �� k , �� k ) ln\ \ p(x|\pi,��,\boldsymbol{\Sigma})= \sum_n\ ln\sum_k\pi_kN(x_n�O��_k,\boldsymbol{\Sigma}_k) ln??p(x�O��,��,��)=��n??ln��k?��k?N(xn?�O��k?,��k?)

- E ��: ���ݵ�ǰ�� �� k \pi_k ��k?�� �� k ��_k ��k?�� �� k \boldsymbol{\Sigma}_ k ��k? ���������� �� ( z n k ) ��(z_{nk}) ��(znk?)

�� ( z n k ) = �� k N ( x n �O �� n , �� n ) �� j = 1 k �� j N ( x n �O �� j , �� j ) ��(z_{nk})=\frac{��_kN(x_n�O��_n,\boldsymbol{\Sigma}_n)} {��_{j=1}^k��_jN(x_n�O��_j,\boldsymbol{\Sigma}_ j)} ��(znk?)=��j=1k?��j?N(xn?�O��j?,��j?)��k?N(xn?�O��n?,��n?)?

- M��:����E���м���� �� ( z n k ) \gamma(z_{nk}) ��(znk?)�ټ����µ� �� k \pi_k ��k?�� �� k ��_k ��k?�� �� k \boldsymbol{\Sigma}_ k ��k?

�� N k = �� n �� ( z n k ) N_k=\sum_n\gamma(z_{nk}) Nk?=��n?��(znk?) ,��:

- �� k = N k N \pi_k=\frac{N_k}{N} ��k?=NNk??

- �� k = 1 N k �� n �� ( z n k ) x n ��_k=\frac{1}{N_k}\sum_n\gamma(z_{nk}) x_n ��k?=Nk?1?��n?��(znk?)xn?

- �� k = 1 N k �� n �� ( z n k ) ( x n ? �� k ) ( x n ? �� k ) T \boldsymbol{\Sigma}_ k=\frac{1}{N_k}\sum_n\gamma(z_{nk})(x_n-��_k)(x_n-��_k)^T ��k?=Nk?1?��n?��(znk?)(xn??��k?)(xn??��k?)T

?

-

���¼��㲽��1�еĶ�����Ȼ����

-

�������Ƿ������������Ȼ�����Ƿ�����,��������,�ص�2����

�����ο�

EM�㷨

���EM�㷨���ϸ�˹ģ��

��˹���ģ��(GMM)����EM�㷨������

��������㷨�ο�����һƪ����:�ල�㷨