Multi-Stage Feature Fusion Network for Video Super-Resolution

用于视频超分辨率的多级特征融合网络

代码:GitHub - open-mmlab/mmediting: OpenMMLab Image and Video Editing Toolbox

本篇笔记主要对整篇论文从头到尾进行阅读分析,本文内容有点多,主要是对不同部分的总结以及图例解释,如果只对模型原理部分有兴趣,可直接观看第四部分。

本文为了详细说明各图、公式在各组件中的情况,所以对原文图片、公式做了切割和拼接,保证该内容是在该组件中生效的。

目录:

(1)摘要

作者提出现有的VSR方法存在一个主要的问题,现有的特征融合是一段式的,也就是进行时间对齐之后,将其进行卷积融合输出作为目标特征数据,但是这种结果会与原始的参考LR帧有视觉偏差(这种偏差主要是因为未完全对齐与遮挡情况),所有作者在本文中提出一种端到端的多阶特征融合网络,首先将目标帧与参考帧进行特征对齐之后,将其结果作为多阶融合网络的输入,与目标帧及逆行逐级融合,保证参考帧的信息可以在融合过程中都被引用,增强特征。

(2)引言

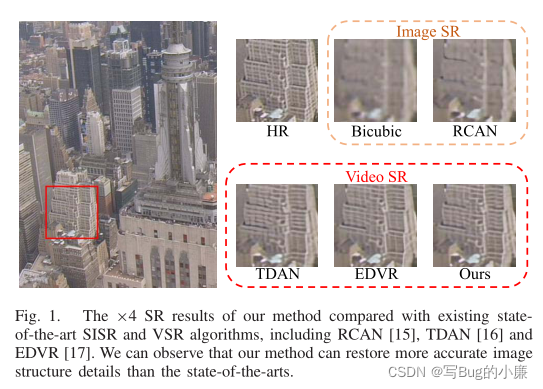

作者提出当前的VSR模型尽管通过DCN进行对齐之后进行特征融合,但是并未考虑到融合之后的特征与原始LR参考帧之间的视觉信息差异,而这种差异可能原词视频中的强烈运动导致的未完全对齐和遮挡模糊,这种情况会导致VSR的效果下降。所以为了解决上述问题,作者提出一种端到端的多阶特征融合网络,将特征的融合过程改为渐进式,原始参考LR帧在融合过程中的多个阶段都可以对目标帧的视觉特征信息进行干预,尽最大保留原有的视觉效果并融合出更细致的特征细节信息用于重建,如下图中本文方法的效果展示。

(本文作者的这种想法实际上与BasicVSR中的传播和聚合相似,双向和网格传播是为了将未来信息和过去信息进行提炼和结合,更好的根据视频的运动信息还原出细节信息,提高信息之间的交互,聚合则是根据对齐的特征进行级联。而本文作者通过对对齐后的特征与原始目标LR帧信息进行逐步融合,通过逐步融合特征信息,来获取最大的视觉特征保留效果和特征细节,实际上也是在这两方面进行优化)。

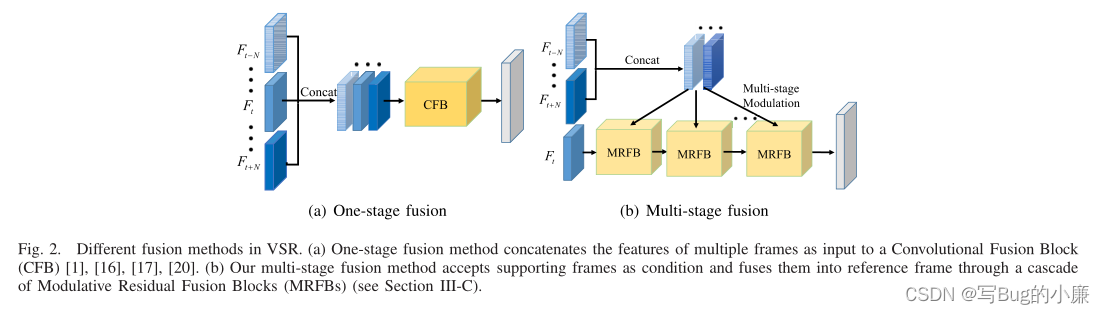

?作者提出的多级特征融合对比的是一步融合,如下图。我们可以看出,目标帧与参考帧信息进行扭曲对齐之后作为输入,输入到卷积融合模块输出为目标特征信息。而本文中使用的多级特征融合,作者将对齐之后的特征信息作为输入,输入到MRFB(多级残差融合块)中,通过与原始的目标LR帧进行逐级融合之后,输出相应的目标特征信息。

(3)相关工作

这一部分主要介绍了,视频超分,条件网络以及可变形卷积的内容。条件网络主要是应用了Conditional Normalization(CN)到多阶融合的各个部分,为什么不用BN,在我前面的的blog中已经说明(超分辨率中为什么不适用BN_写Bug的小廉的博客-CSDN博客)。

(4)本文方法介绍

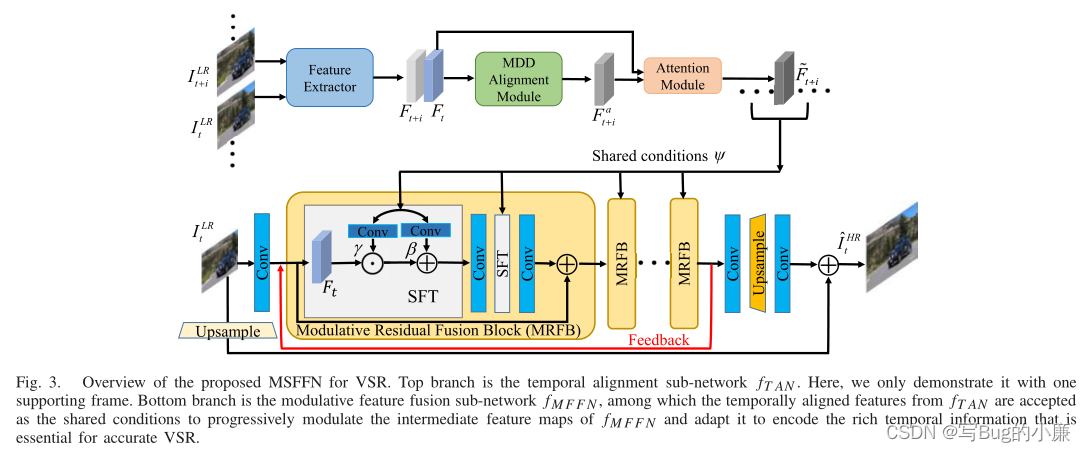

本文提出的![]() 网络是多阶特征融合网络,可以细分为两个子网络,一个是时间对齐网络

网络是多阶特征融合网络,可以细分为两个子网络,一个是时间对齐网络![]() 和调制特征融合网络

和调制特征融合网络![]() ,如下图所示,顶层是

,如下图所示,顶层是![]() ,将对齐之后的信息作为共享条件信息输入下方的融合网络中,进行逐级融合。

,将对齐之后的信息作为共享条件信息输入下方的融合网络中,进行逐级融合。

两个子网络的范式公式如下所示,公式(1),代表着t帧的目标帧经过MSFFN网络还原出的高分辨率图像。公式(2),则是对齐之后的特征。公式(3)则表示对齐之后的特征组合成为一个共享量,而这个共享量则是t-N~t+N的参考帧与目标帧对齐的结果。?公式(4)则是将目标帧与共享变量进行逐级融合,得到最终的高分辨率帧。

(4.1)时间对齐网络TBN

时间对齐模块也可以细分为三个部分:(1)特征提取模块。(2)多尺度扩展变形(MDD)模块。(3)注意力模块。

(4.1.1)特征提取模块

特征提取模块采用一个卷积块和五个残差块进行特征提取,提取![]() 和

和![]() 的特征?

的特征?![]() 和

和![]() ,并将其输入MDD对齐模块。

,并将其输入MDD对齐模块。

(4.1.2)MDD模块

首先说明一下这部分内容中说明的感受视野的问题!我们使用卷积核知道3*3的卷积核获取的视野有限,因为只能在该范围中的图像获得特征,但是这部分对于全局特征而言,就会受到限制。所以本文中使用空洞卷积的方式,也就是通过设置扩张率,扩张率就是3*3的卷积核中是否有间隔,默认的时候是1,也就是没有间隔,本文通过设置不同的扩张率是为了避免错过对象的边界信息,导致信息的估计不准确。

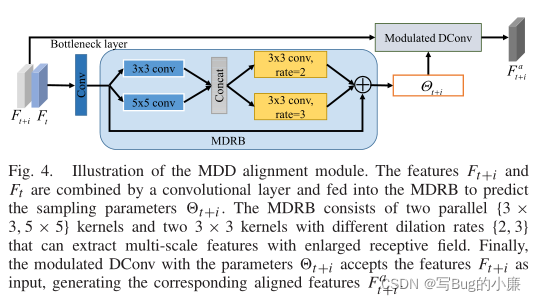

MDD,Multi-scale Dilated Deformable,多尺度扩展可变形对齐模块,如下图所示,MDD模块的架构。本文为了解决上面说的感受视野的问题,所以提出了MDRB模块,来感知帧间的大像素运动,捕获多尺度的上下文信息。

首先将上个阶段的特征做串联输入瓶颈模块,减少特征通道后将其输入到MDRB模块,在该MDRB中进行多尺度的卷积分别使用3*3和5*5卷积和进行卷积,将结果送入级联块中,然后送入空洞卷积方法中,使用不同的扩张率,保证读取到边界信息, 对齐![]() 和

和![]() 。?

。?

(4.1.3)注意力模块

经过MDD模块,虽然可以 对齐![]() 和

和![]() ,但是存在遮挡、视差和模糊区域仍会出现错位问题,所以提出空间注意力mask加权模块来对?

,但是存在遮挡、视差和模糊区域仍会出现错位问题,所以提出空间注意力mask加权模块来对?![]() 进行加权。

进行加权。![]() 为计算?

为计算?![]() 和

和![]() ?之间像素的相似性。

?之间像素的相似性。

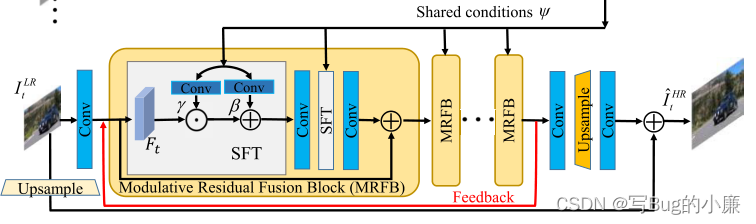

?(4.2)调制特征融合网络MFFN

当前方法进行特征融合的方法是通过串联将目标帧和对齐的参考帧进行特征融合,然后将其送入重建网络中进行高分辨率的重建。但是存在两个局限性的问题:(1)目标帧的参考帧之间在特征级存在大量的相似部分,所以在计算时会引入大量的冗余。(2)融合只是发生在初始阶段,随着重建网络越来越深,参考帧的互补信息就会越来越弱。所以本文提出调制特征融合网络MFFN,如下图所示。

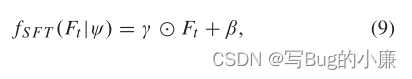

经过TBN模块产生的对齐特征信息ψ,作为共享变量用于MFFN的输入,β和γ分别代表偏移和比例,MFFN中包含多个MRFB模块,其中包含多个SFT和卷积,其中SFT通过做仿射变换,根据β和γ参数对![]() 进行变换,如下面公式所示。

进行变换,如下面公式所示。

?经过上述步骤,使用时间对齐特征对![]() 进行增强视觉特征,经过多级的MRFB增强,将最后的一个MRFB结果送回开始,使用高层次信息对低层次信息进行优化,就可以实现目标帧信息的超分。并且将共享信息对每个MRFB作为输入也解决了深度网络中参考信息越来越弱的问题。

进行增强视觉特征,经过多级的MRFB增强,将最后的一个MRFB结果送回开始,使用高层次信息对低层次信息进行优化,就可以实现目标帧信息的超分。并且将共享信息对每个MRFB作为输入也解决了深度网络中参考信息越来越弱的问题。

(5)实验

训练数据集:Septuplet

测试数据集:Vid4、SPMC-11、Vimeo-90K-T

下采样方法:Bicubic (BI)

迭代优化器:Adam optimizer

学习率:4*10^-4

MFFN中MRFB的数量:16

损失函数:Charbonnier loss

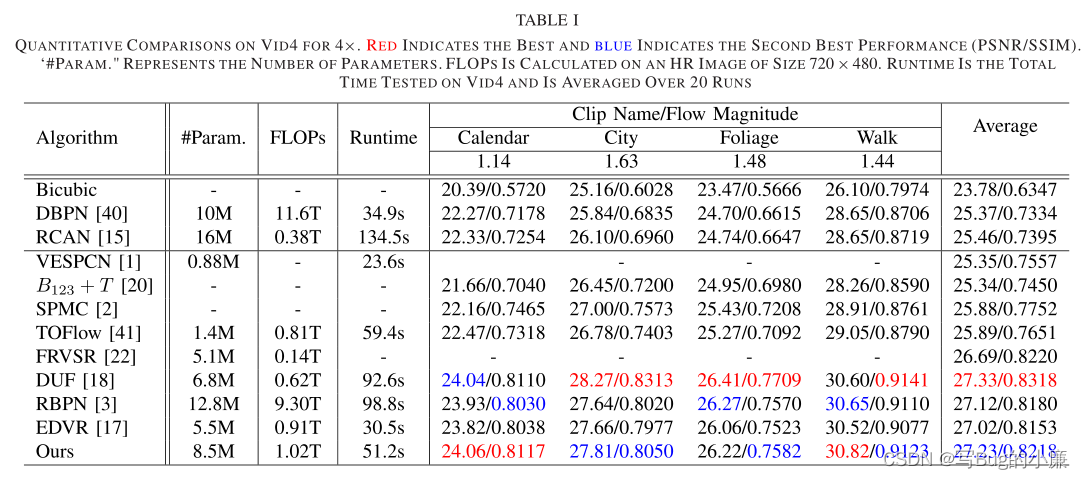

(5.1)相比较其他模型的实验结果:

(5.1.1)从评估标准上分析:

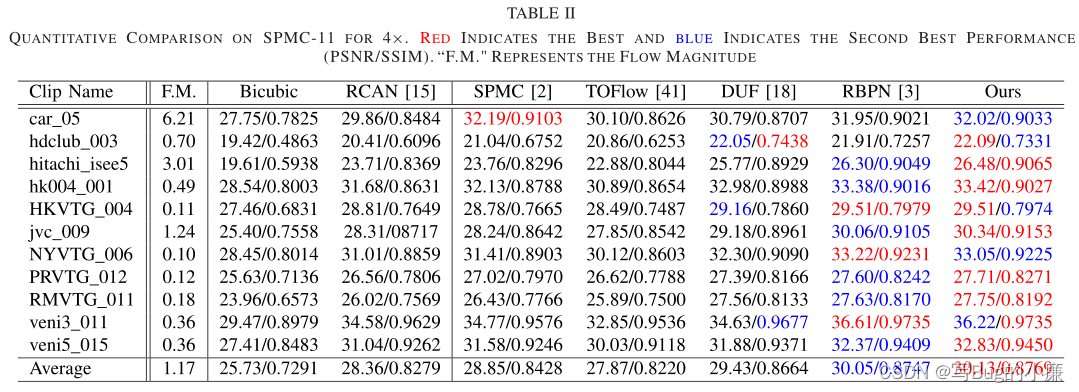

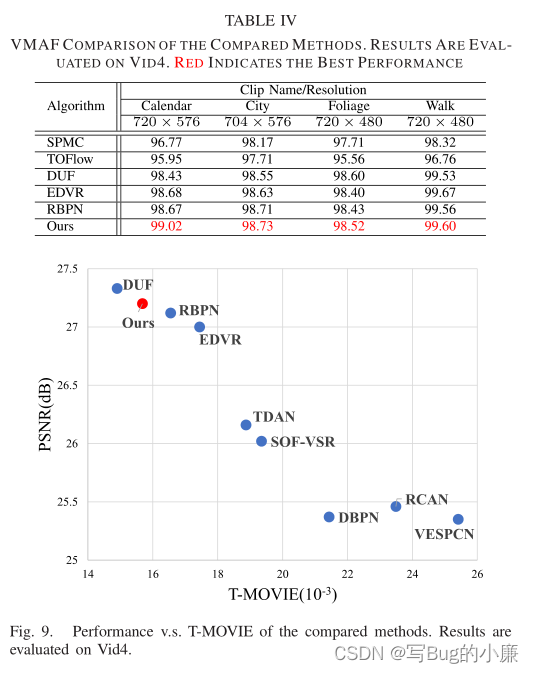

在三种测试数据集上对比其他模型的结果,在Vid4上除了比DUF的PNSR和SSIM上稍微逊色外,在其他数据集上,都要优于其他模型。

?(5.1.2)从模型效果上分析:

(5.1.3)从时间一致性上分析:

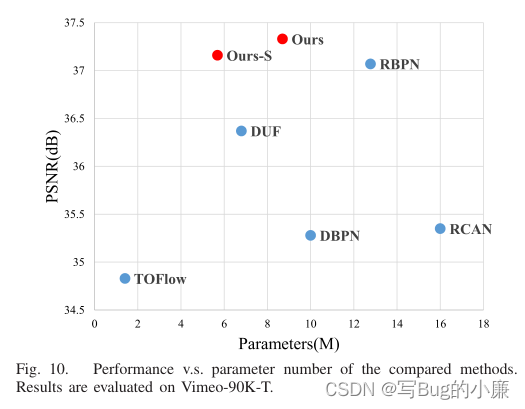

?(5.1.4)从模型效率分析:

本文的模型很好的权衡了参数和性能,DUF虽然与本文模型的参数量差不多,但是PSNR效果要低一点。

?(5.2)消融实验实验结果:

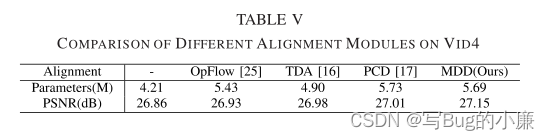

替换MDD模块进行效果对比:

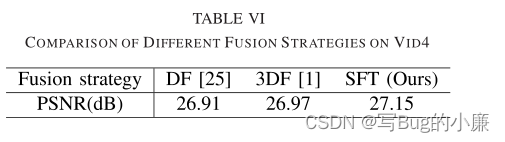

移除多阶段融合中MRFB中的SFT层,然后使用单阶段融合机制进行融合比对?::

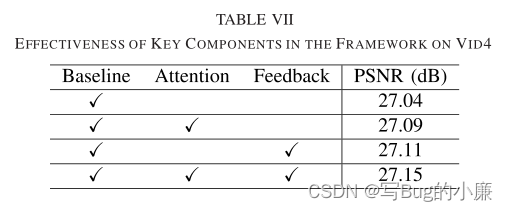

不同组件在本文方法中的有效性:

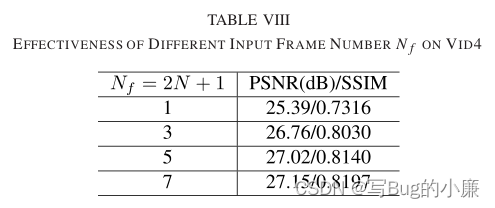

使用不同的输入帧数来训练模型,帧数越高,训练得到的视频细节信息越多,效果越好。?

总结:

本文通过修改输入的帧数的数量,对参考帧对与目标帧的补充修正来提高SR帧的效果。在对齐模块使用空洞卷积对原来的对齐模型进行优化,保证读取到边缘信息的情况下,可以扩大视野,使用注意力模块保证降低模糊、遮挡等情况的影响,实现更大程度上的对齐,从而实现特征级的信息利用。并且本文通过调制多级特征网络,来确保对齐的特征在网络的不同深度仍能对目标帧做到有效的影响,并且通过将一次的结果重新输入来重新细化优化输入的目标帧,从而达到目标帧结果。本文从思想上与BasicVSR有相似点,具有参考性。