ОлРрЪЧвЛжжЛњЦїбЇЯАЫуЗЈ,ЫќЪдЭМАбЪ§ОнМЏЕФЙлВтжЕЗжЮЊВЛЭЌЕФДиЁЃМДЯрЫЦЙлВтжЕОлЮЊДи,ЗДжЎВЛЯрЫЦЕФдкВЛЭЌДижаЁЃОлРрЪєгкЮоМрЖН,ЫќГЂЪдДгЪ§ОнМЏжаЗЂЯжНсЙЙ,ЖјВЛЪЧдЄВтЯьгІБфСПЕФжЕЁЃ

ОлРрЭЈГЃгУгкЪаГЁЗжЮі,Р§ШчФГЙЋЫОгаЯТСааХЯЂ:

- МвЭЅЪеШы

- МвЭЅШЫЪ§

- ЛЇжїжАвЕ

- ОрЪаЧјОрРы

ШчЙћетаЉЪЧгааЇаХЯЂ,ОлРрПЩвдЪЖБ№РрЫЦМвЭЅПЩФмЛсЙКТђвЛЖЈВњЦЗЛђЖдФГРрЙуИцЯьгІНЯКУЁЃОлРрзюГЃгУЫуЗЈЪЧKMeans,ЕЋашвЊдЄЯШЩшЖЈОлРрЪ§СПЁЃ

ЖдгІЕФВуДЮОлРрЫуЗЈВЛашвЊдЄЯШЩшЖЈОлРрЪ§СП,ЫќФмЙЛЩњГЩЪїаЮНсЙЙЁЊЁЊГЦЮЊЯЕЭГЪїЭМЁЃ

НщЩмВуДЮОлРр

гыKMeansРрЫЦ,ЗжВуОлРрЕФФПБъЪЧВњЩњЯрЛЅЗЧГЃЯрЫЦЕФЙлВтНсЙћДи,ЖјВЛЭЌДижаЕФЙлВтНсЙћдђНиШЛВЛЭЌЁЃвЛАуВЩгУвдЯТВНжшНјааЗжВуОлРр:

- ЗжБ№МЦЫуЪ§ОнМЏжаУПСНИіБфСПЕФЯрвьЖШ

- ЪзЯШБиаыШЗЖЈОрРыЖШСПжИБъЁЊЁЊШчХЗЪНОрРы,гУгкМЦЫуЪ§ОнМЏжаУПИіЙлВтжЕжЎМфЕФЯрвьЖШ

- ШчЙћЪ§ОнМЏАќРЈnИіЙлВтжЕ,ФЧУДЙВашвЊМЦЫу

n(n-1)/2ДЮЖдЯрвьЖШ

- НЋЙлВтЪ§ОнШкКЯГЩДи

- АбЩЯвЛВНжаСНИізюЯрЫЦЕФЙлВтжЕШкКЯЕНвЛИіДижаЁЃ

- жиИДетИіЙ§ГЬ,жБЕНЫљгаЙлВтЕНЕФЖМЪЧвЛИіДѓДиЕФГЩдБЁЃзюжеНсЙћЪЧвЛИіЪї,ПЩвдЛцжЦГЩЯЕЭГЪїЭМЁЃ

ЮЊСЫШЗЖЈСНИіДижЎМфЕФОрРы,ЮвУЧПЩвдЪЙгУЯТСаМИжжЗНЗЈ,АќРЈ:

- ЭъШЋСЌНгОлРр: ЧѓЪєгкСНИіВЛЭЌОлРрЕФЕужЎМфЕФзюДѓОрРыЁЃ

- ЕЅСЌНгОлРр: ЧѓЪєгкСНИіВЛЭЌОлРрЕФЕужЎМфЕФзюаЁОрРыЁЃ

- ОљжЕСЌНгОлРр: евГіЫљгаЪєгкСНИіВЛЭЌОлРрЕФЕужЎМфЕФГЩЖдОрРы,ШЛКѓМЦЫуЦНОљжЕЁЃ

- жЪаФСЌНгОлРр: ЧѓУПИіДиЕФжЪаФ,МЦЫуСНИіВЛЭЌДиЕФжЪаФжЎМфЕФОрРыЁЃ

- wardзюаЁЗНВюЗЈ:зюаЁЛЏМЏШКФкЕФзмЗНВю,УПвЛВНЖМНЋДиМфОрРызюаЁЕФвЛЖдДиНјааКЯВЂЁЃ

- Ё

ЖдгкВЛЭЌЪ§ОнМЏ,етаЉЗНЗЈжЎМфЛсгаВювьЁЃЯТУцЭЈЙ§ЪОР§ж№ВНЪЕЯжВуДЮОлРрЫуЗЈЁЃ

МгдиАќМАЪ§Он

етСНИіАќжагаМИИіЪЕЯжОлРрЫуЗЈЕФгагУКЏЪ§:

library(factoextra)

library(cluster)

#load data

df <- USArrests

#remove rows with missing values

df <- na.omit(df)

#scale each variable to have a mean of 0 and sd of 1

df <- scale(df)

#view first six rows of dataset

head(df)

# Murder Assault UrbanPop Rape

# Alabama 1.24256408 0.7828393 -0.5209066 -0.003416473

# Alaska 0.50786248 1.1068225 -1.2117642 2.484202941

# Arizona 0.07163341 1.4788032 0.9989801 1.042878388

# Arkansas 0.23234938 0.2308680 -1.0735927 -0.184916602

# California 0.27826823 1.2628144 1.7589234 2.067820292

# Colorado 0.02571456 0.3988593 0.8608085 1.864967207

ИУЪОР§ЪЙгУR ФкжУ USArrests Ъ§ОнМЏ,АќРЈУРЙњ1973ФъУП10ЭђШЫЕФЗИзяаХЯЂ,АќРЈФБЩБЁЂШЫЩэЯЎЛїЁЂЧПМщЁЂвдМАГЧеђШЫПкТЪ(Murder, Assault, Rape, UrbanPop)ЁЃ

ЩЯУцДњТыЪзЯШМгдиЪ§Он,НгзХЩОГ§ШБЪЇжЕаа,зюКѓЖдБфСПНјааЙщвЛЛЏ,МДЭГвЛЮЊОљжЕЮЊ0,БъзМВюЮЊ1 .

ШЗЖЈСЌНгЗНЗЈ

ЮЊСЫжДааВуДЮОлРрЗНЗЈ,ПЩвдЪЙгУcluster Аќжаagnes()КЏЪ§,гяЗЈШчЯТ:

** agnes(data, method)

- data : Ъ§ОнМЏ

- method:МЦЫуДижЎМфЯрвьЖШЕФЗНЗЈ

вђЮЊЪТЯШВЛСЫНтФЧИіЗНЗЈаЇЙћзюКУ,ЮвУЧЖЈвхКЏЪ§ЪЙгУВЛЭЌЗНЗЈжДааВуДЮОлРрЁЃИУКЏЪ§ФмЙЛМЦЫуУПжжЗНЗЈЕФФ§ОлЯЕЪ§,гУгкЖШСПзхЕФОлМЏГЬЖШ,жЕдННгНќ1,зхФ§ОлЖШдНИп:

#define linkage methods

m <- c( "average", "single", "complete", "ward")

names(m) <- c( "average", "single", "complete", "ward")

#function to compute agglomerative coefficient

ac <- function(x) {

agnes(df, method = x)$ac

}

#calculate agglomerative coefficient for each clustering linkage method

sapply(m, ac)

# average single complete ward

# 0.7379371 0.6276128 0.8531583 0.9346210

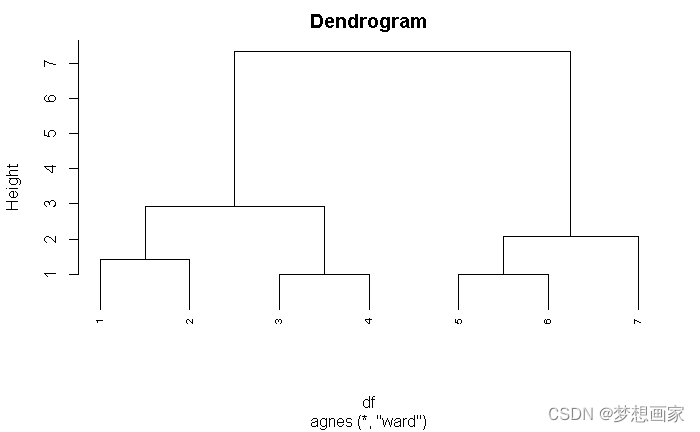

ДгЪфГіПЩвдПДЕНward ЗНЗЈаЇЙћзюКУ,вђДЫЮвУЧНЋЪЙгУИУЗНЗЈЪЕЯжВуДЮОлРр:

#perform hierarchical clustering using Ward's minimum variance

clust <- agnes(df, method = "ward")

#produce dendrogram

pltree(clust, cex = 0.6, hang = -1, main = "Dendrogram")

ЯЕЭГЪїЭМЕФУПИівЖзгБэЪОдЪМЪ§ОнМЏжаЕФЙлВтжЕ,ДгЯТЭљЩЯ,РрЫЦЙлВтжЕШкЮЊжІ,зюКѓШкКЯЮЊвЛПУЪїЁЃ

ШЗЖЈзюМбДиЪ§

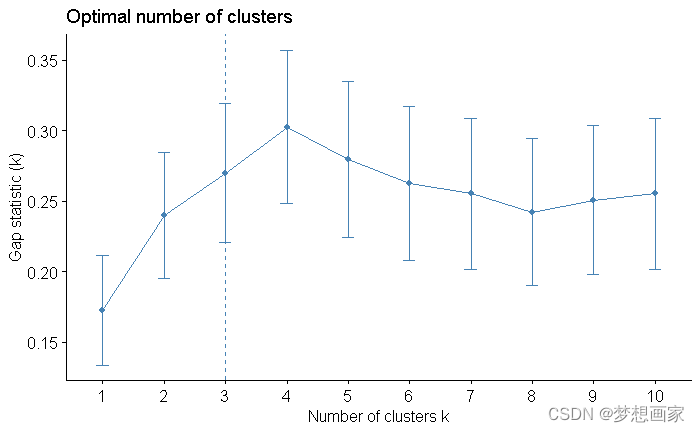

ЮЊСЫОіЖЈЪ§ОнМЏЗжЮЊМИИіДи,ашвЊЪЙгУМфЯЖЭГМЦжИБъ,ЫќБШНЯдкУЛгаОлРрЕФЗжВМжа,kЕФВЛЭЌжЕЕФзмДиФкБфвьгыЫќУЧЕФЦкЭћжЕЁЃЪЙгУclusterАќжаЕФclusGapКЏЪ§МЦЫуМфЯЖЭГМЦжИБъ,fviz_gap_stat()КЏЪ§ФмЙЛвдЭМаЮЗНЪНеЙЪОДиЪ§гыжИБъжЎМфЕФЙиЯЕ:

#calculate gap statistic for each number of clusters (up to 10 clusters)

gap_stat <- clusGap(df, FUN = hcut, nstart = 25, K.max = 10, B = 50)

#produce plot of clusters vs. gap statistic

fviz_gap_stat(gap_stat)

ДгЭМжаЮвУЧПЩвдПДЕН,МфЯЖЭГМЦжИБъдкk = 4МЏШКЪЧзюИпЕФЁЃвђДЫ,ЮвУЧНЋбЁдёНЋЪ§ОнМЏЗжГЩ4ИіВЛЭЌДиЁЃ

ИјдЪМЪ§ОнМЏдіМгЗжРр

ЯТУцЮвУЧАбЪ§ОнЗжРрНсЙћдіМгжСдЪМЪ§ОнМЏжа,ЪЙгУcutree()ЗНЗЈАбЩњГЩЪїЧаЗжЮЊЫФИіДи:

# МЦЫуОиеѓОрРы

d <- dist(df, method = "euclidean")

# ЪЙгУWardЗНЗЈжДааВуДЮОлРр

final_clust <- hclust(d, method = "ward.D2" )

# ЧаЗжЮЊЫФИіДи

groups <- cutree(final_clust, k=4)

# ЭГМЦУПИіДиЕФЪ§СП

table(groups)

#

# 1 2 3 4

# 7 12 19 12

ЯТУцИјдЪМЪ§ОнУПИіжнзЗМгДиБъЧЉ:

# ИјдЪМЪ§ОнзЗМгДиБъЧЉ

final_data <- cbind(USArrests, cluster = groups)

# ЯдЪОЧА6ЬѕЪ§Он

head(final_data)

# Murder Assault UrbanPop Rape cluster

# Alabama 13.2 236 58 21.2 1

# Alaska 10.0 263 48 44.5 2

# Arizona 8.1 294 80 31.0 2

# Arkansas 8.8 190 50 19.5 3

# California 9.0 276 91 40.6 2

# Colorado 7.9 204 78 38.7 2

зюКѓЪЙгУaggregateКЏЪ§МЦЫуУПИіДиЕФБфСПОљжЕ:

# зюКѓМЦЫуУПИізхЕФОљжЕ

aggregate(final_data, by=list(cluster=final_data$cluster), mean)

# cluster Murder Assault UrbanPop Rape cluster

# 1 1 14.671429 251.2857 54.28571 21.68571 1

# 2 2 10.966667 264.0000 76.50000 33.60833 2

# 3 3 6.210526 142.0526 71.26316 19.18421 3

# 4 4 3.091667 76.0000 52.08333 11.83333 4

ДгЪфГіПЩвдПДЕН:

- Ек1зщЕФИїжнжа,УП10ЭђЙЋУёжаЦНОљга14.67ШЫБЛФБЩБЁЃ

- Ек1зщжаЕФИїжн,УП10ЭђЙЋУёжаЦНОљЗЂЩњ251.28Ц№ШЫЩэЯЎЛїЪТМўЁЃ

- Ек1зщЕФИїжнжа,ОгзЁдкГЧЪаЕиЧјЕФОгУёЕФЦНОљАйЗжБШЮЊ54.28%ЁЃ

- Ек1зщЕФИїжнжа,УП10ЭђЙЋУёжаЦНОљЗЂЩњ21.68Ц№ЧПМщАИЁЃ