����Ŀ¼

����:

-ѧ��һ�����µĻ���ѧϰ,����������ŸոսӴ�,��֪����ʵ����Ժ�����,�������������Ϊ����,������һ���ܽ��˼����ϣ���ܵõ���λ���е�ָ����

��֪��(��Ԫ)

�ʺ����ķ�������Է���, ���ж��Dz�������, ���������ӵĶ�ά����

ʵ��:�ο�

�ؼ��ĸ�֪���IJ����Ż�����:

wi = w + n(y- y_pre)xi

bi = b + n(y- y_pre)

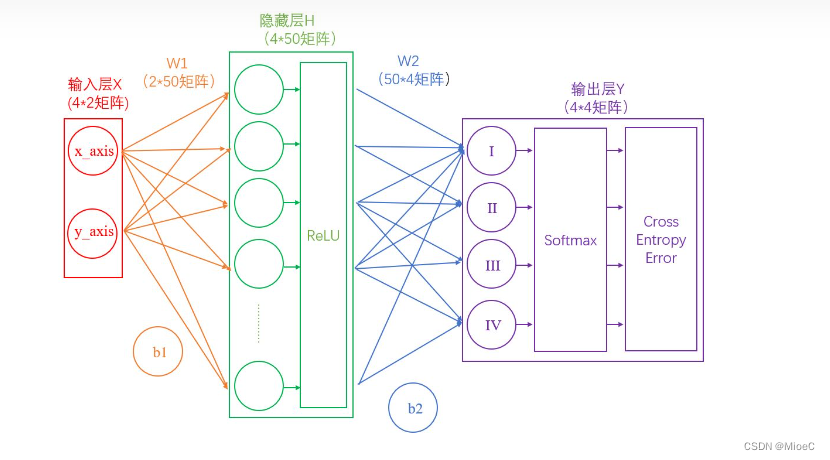

������Ľṹ

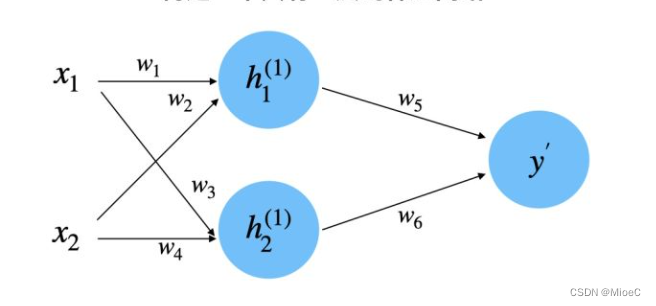

�����Ԫ���

����

h = wi xi + bi

������������Ĵ���ʵ��

def sigmoid(x):

return 1/(1 + np.exp(-x))

def loss_mse(y_true, y_pred):

return ((y_true - y_pred) ** 2).mean()

def re_sigmoid(x):

fx = sigmoid(x)

return fx * (1 - fx)

class Neural(object):

def feed_forwad(self, x):

h1 = sigmoid(w1 * x[0] + w2 * x[1] + b1)

h2 = sigmoid(w2 * x[0] + w4 * x[1] + b2)

o1 = sigmoid(h1 * w5 + h2 * w6 + b3)

return o1

��������ʵ�ֱȽϸ���,������, ����Ҫ�����Loss �������в����ĵ���,��ÿ��������Ӱ�쵽Loss �ı仯��С, Ȼ�ϵ���������С,�ﵽ����loss ��Ч����

����, Ӱ�쵽����������������ߺ��ٶ�,���������һ���㷨, �����ж�ÿ���˵Ĵ������츳,

ͨ�������õ� �������ߵı���Ϊ0.7, �ٶ�Ϊ0.3, ���ϵ�������,ʹ�� ȷ�ȴﵽ��ߡ�

�������ڵ�Ŀ�ľ���������еĵ���,���г����еĹ�ϵ����

Loss = loss_mes = ((y - y') ** 2).mean() #y ��y '�Ǿ�����ʽ

# dL/dy' = -2 (y - y')

# ��ǰ��

y' = f(w5 * h1+ w6 * h2 + b3) # fΪ����� h1, h2 Ϊ�ϸ��ڵ�����

# dy'/dw5 = h1 * f'(x)

# dy'/dw6 = h2 * f'(x)

# dy'/db3 = f'(x)

# dL/dw5 = dL/dy' * dy'/dw5

# dL/dw6 = dL/dy' * dy'/dw6

# dL/db3 = dL/dy' * dy'/db3

��ͬ�� ���Եó�

h1 = f(w1 * x[0] + w2 * x[1] + b1)

h2 = f(w3 * x[0] + w4 * x[1] + b2)

dL/dw1 = dL/dy' * dy'/dh1 * dh1/dw1

dh1/dw1 = x[0] * f'(x)

dh1/dw2 = x[1] * f'(x)

dh1/db1 = * f'(x)

dL/dw2 = dL/dy' * dy'/dh2 * dh2/dw2

dh2/dw3 = x[0] * f'(x)

dh2/dw4 = x[1] * f'(x)

dh1/db2 = * f'(x)

������ ,ֱ�ӽ��и���

wi = wi - rate * dwi

w1 -= rate * dl/dw1

.....

������������:

# Ӗ������������Ա���ж�

import numpy as np

data = np.array([

[-2, -1], # Alice

[25, 6], # Bob

[17, 4], # Charlie

[-15, -6], # Diana

])

all_y_trues = np.array([

1, # Alice

0, # Bob

0, # Charlie

1, # Diana

])

# �����

def sigmoid(x):

return 1/(1+np.exp(-x))

def deriv_sigmoid(x):

fx = sigmoid(x)

return fx * (1 - fx)

def loss_mse(y_true, y_pred):

# ������� ��ʧ����

return ((y_true - y_pred) ** 2).mean()

class Neural(object):

def __init__(self):

self.w1 = np.random.normal()

self.w2 = np.random.normal()

self.w3 = np.random.normal()

self.w4 = np.random.normal()

self.w5 = np.random.normal()

self.w6 = np.random.normal()

# �ؾ���,Biases

self.b1 = np.random.normal()

self.b2 = np.random.normal()

self.b3 = np.random.normal()

self.rate = 0.1

def feed_forward(self, x):

# ����, �������� ��ʧ����

h1 = sigmoid(self.w1 * x[0] + self.w2 * x[1] + self.b1)

h2 = sigmoid(self.w3 * x[0] + self.w4 * x[1] + self.b2)

o1 = sigmoid((self.w5 * h1 + self.w6 * h2 + self.b3))

return o1

def train(self, data, y_labels):

learn_rate = 0.1

epochs = 1000

# ÿ��ѵ��,��������,�ڼ�����ʧ����, Ȼ����,���²���, ,������ Ŀ�ľ���Ϊ�˽�����ʧ������ֵ

for i in range(epochs):

for (x, y_label) in zip(data, y_labels):

#1������

sum_h1 = self.w1 * x[0] + self.w2 * x[1] + self.b1

h1 = sigmoid(sum_h1)

sum_h2 = self.w3 * x[0] + self.w4 * x[1] + self.b2

h2 = sigmoid(sum_h2)

sum_o1 = self.w5 * h1 + self.w6 * h2 + self.b3

o1 = sigmoid(sum_o1)

#2��������ʧ����

# ��ʧ������ 1/n(y_true - y_pred) ** 2 = 0 + (-1) * 2 * (y_true - y_pred)

dL_j = -2 * (y_label - o1)

#3�� ����

#dw1... dw6

#��j ��ֵ

#j = f(w5h1 + w6h2 + b3)

#dj/dw5 = h1 * f' dj/dw6 = h2 * f'

#dL/w5 = dL/j * dj/w5

dl_w5 = dL_j * h1 * deriv_sigmoid(o1)

dl_w6 = dL_j * h2 * deriv_sigmoid(o1)

dl_b3 = dL_j * deriv_sigmoid(o1)

#dl/h1 = dL/dj * dj/dh1 = da_j * w5

dl_h1 = dL_j * self.w5 * deriv_sigmoid(o1)

dl_h2 = dL_j * self.w6 * deriv_sigmoid(o1)

#h1 = f(w1* x1 + w2 * x2 + b1)

#h2 = f(w3 * x1 + w4 * x2 + b2)

#dl/w1 = dl/j * dj/h1 * dh1/dw1

dl_w1 = dL_j * dl_h1 * x[0] * deriv_sigmoid(h1)

dl_w2 = dL_j * dl_h1 * x[1] * deriv_sigmoid(h1)

dl_b1 = dL_j * dl_h1 * deriv_sigmoid(h1)

dl_w3 = dL_j * dl_h2 * x[0] * deriv_sigmoid(h2)

dl_w4 = dL_j * dl_h2 * x[1] * deriv_sigmoid(h2)

dl_b2 = dL_j * dl_h2 * deriv_sigmoid(h2)

#ע: ��Ϊb����Ϊ1 ����ֱ�Ӹ���Ϊrate * b

#4�� ����w, b

self.w1 -= dl_w1 * learn_rate

self.w2 -= dl_w2 * learn_rate

self.w3 -= dl_w3 * learn_rate

self.w4 -= dl_w4 * learn_rate

self.w5 -= dl_w5 * learn_rate

self.w6 -= dl_w6 * learn_rate

self.b1 -= dl_b1 * learn_rate

self.b2 -= dl_b2 * learn_rate

self.b3 -= dl_b3 * learn_rate

if i % 10 == 0:

y_preds = np.apply_along_axis(self.feed_forward, 1, data)

loss = loss_mse(y_labels, y_preds)

print("Epoch %d loss: %.3f" % (i, loss))

# def __str__(self):

# pass

# return 'weights\t:%s\nbias\t:%f\n' % (np.array([self.w1, self.w2, self.w3, self.w4, self.w5, self.w6]), np.array([self.b1, self.b2, self.b3]))

neural = Neural()

neural.train(data, all_y_trues)

print(neural)

emily = np.array([-7, -3]) # 128 pounds, 63 inches

frank = np.array([20, 2]) # 155 pounds, 68 inches

print("Emily: %.3f" % neural.feed_forward(emily)) # 0.951 - F

print("Frank: %.3f" % neural.feed_forward(frank)) # 0.039 - M