С§П°ЧЬҪб

- НЖјцПөНіЕЕРтІҝ·ЦЦРөДЛрК§әҜКэҙуІҝ·Ц¶јКЗ¶ю·ЦАаөДҪ»ІжмШЛрК§әҜКэ,ө«КЗХЩ»ШөДДЈРНәЬ¶а¶јІ»КЗЎЈХЩ»ШДЈРНДЗҝйіЈјыөД»№УРsampled softmaxЛрК§әҜКэ;

- ДЈРНСөБ·Кұ,ФЪseedЙиЦГ№М¶ЁКұДЈРНөДlossІЁ¶ҜәЬҙу,ҝЙДЬКЗФзНЈөДҙОКэМ«ЙЩБЛ,ТІҝЙДЬКЗ

batch_sizeұИҪПРЎ,өјЦВКэҫЭІ»ЖҪәв,»тХЯС§П°ЛЩВКlearning rate№эҙуЎЈ - DINК№УГБЛТ»ёцlocal activation unitҪб№№,АыУГәтСЎЙМЖ·әНАъК·ОКМвЙМЖ·Ц®јдөДПа№ШРФјЖЛгіцИЁЦШ,ХвёцҫНҙъұнБЛ¶ФУЪөұЗ°ЙМЖ·№гёжөДФӨІв,УГ»§АъК·РРОӘөДёчёцЙМЖ·өДЦШТӘіМ¶ИҙуРЎЎЈ

- ФЪrechubПоДҝЦР,ХвёцјӨ»оөҘФӘҫНКЗMLP,attentionұҫЦКҫНКЗјУИЁЖҪҫщ,MLP КЗX@W,ЖдЦРWКЗјУИЁөДИЁЦШ,ІўЗТФЪMLP»щҙЎЙП¶аБЛsoftmaxөДМхјю(ИГИЁЦШЦ®әНОӘ1)ҫНКЗattentionБЛЎЈ

- attentionУРәЬ¶аЦЦРОКҪ,ұИИзtransformer(өг»эРОКҪ)ЎўDIN(MLPРОКҪ),Ц»ТӘЧоәуөГөҪТ»ёцЧўТвБҰПөКэ,ҫНҝЙТФ,НЁ№э·ҙПтҙ«ІҘ»ъЦЖ,ЧЬ»бјЖЛгөГөҪәПККөДИЁЦШЎЈ

ОДХВДҝВј

Т»ЎўКэҫЭМШХчұнКҫ

1.1 МШХчұнКҫ

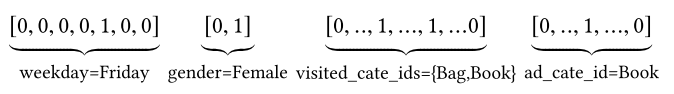

№ӨТөЙПөДCTRФӨІвКэҫЭјҜТ»°г¶јКЗmulti-group categorial formөДРОКҪ,ҫНКЗАаұрРНМШХчЧоОӘіЈјы,ХвЦЦКэҫЭјҜТ»°гіӨХвСщ:

ХвАпөДББөгҫНКЗҝтіцАҙөДДЗёцМШХч,Хвёц°ьә¬ЧЕ·бё»өДУГ»§РЛИӨРЕПўЎЈ

- ¶ФУЪМШХчұаВл,ЧчХЯХвАпҫЩБЛёцАэЧУ:

[weekday=Friday, gender=Female, visited_cate_ids={Bag,Book}, ad_cate_id=Book], ХвЦЦЗйҝцОТГЗЦӘөАТ»°гКЗНЁ№эone-hotөДРОКҪ¶ФЖдұаВл, ЧӘіЙПөКэөД¶юЦөМШХчөДРОКҪЎЈ - ө«КЗХвАпОТГЗ»б·ўПЦТ»ёц

visted_cate_ids, ТІҫНКЗУГ»§өДАъК·ЙМЖ·БРұн, ¶ФУЪДіёцУГ»§АҙҪІ,ХвёцЦөКЗёц¶аЦөРНөДМШХч, ¶шЗТ»№ТӘЦӘөАХвёцМШХчөДіӨ¶ИІ»Т»СщіӨ,ТІҫНКЗУГ»§№әВтөДАъК·ЙМЖ·ёцКэІ»Т»Сщ¶а,ХвёцПФИ»ЎЈХвёцМШХчөД»°,ОТГЗТ»°гКЗУГөҪmulti-hotұаВл,ТІҫНКЗҝЙДЬІ»Ц№1ёц1БЛ,УРДДёцЙМЖ·,¶ФУҰО»ЦГҫНКЗ1, ЛщТФҫӯ№эұаВләуөДКэҫЭИзПВ,ЛНИлДЈРН:

ЙПГжөДМШХчАпГжГ»УРИОәОөДҪ»»ҘЧйәП,ТІҫНКЗГ»УРЧцМШХчҪ»ІжЎЈХвёцҪ»»ҘРЕПўҪ»ёшәуГжөДЙсҫӯНшВзИҘС§П°ЎЈ

DINДЈРНөДКдИлМШХчҙуЦВЙП·ЦОӘБЛИэАа: Dense(Б¬РшРН), Sparse(АлЙўРН), VarlenSparse(ұдіӨАлЙўРН),ТІҫНКЗЦёөДЙПГжөДАъК·РРОӘКэҫЭЎЈ¶шІ»Н¬өДАаРНМШХчТІҫНҫц¶ЁБЛәуГжҙҰАнөД·ҪКҪ»бІ»Н¬:

- DenseРНМШХч:УЙУЪКЗКэЦөРНБЛ,ХвАпОӘГҝёцХвСщөДМШХчҪЁБўInputІгҪУКХХвЦЦКдИл, И»әуЖҙҪУЖрАҙПИ·ЕЧЕ,өИАлЙўөДДЗұЯҙҰАнәГЦ®әу,әНАлЙўөДЖҙҪУЖрАҙҪшDNN

- SparseРНМШХч,ОӘАлЙўРНМШХчҪЁБўInputІгҪУКХКдИл,И»әуРиТӘПИНЁ№эembeddingІгЧӘіЙөНО¬інГЬПтБҝ,И»әуЖҙҪУЖрАҙ·ЕЧЕ,өИұдіӨАлЙўДЗұЯҙҰАнәГЦ®әу, Т»ҝйЖҙЖрАҙҪшDNN, ө«КЗХвАпГжТӘЧўТвУРёцМШХчөДembeddingПтБҝ»№өГДГіцАҙУГ,ҫНКЗәтСЎЙМЖ·өДembeddingПтБҝ,Хвёц»№өГәНәуГжөДјЖЛгПа№ШРФ,¶ФАъК·РРОӘРтБРјУИЁЎЈ

- VarlenSparseРНМШХч:ХвёцТ»°гЦёөДУГ»§өДАъК·РРОӘМШХч,ұдіӨКэҫЭ, КЧПИ»бҪшРРpaddingІЩЧчіЙөИіӨ, И»әуҪЁБўInputІгҪУКХКдИл,И»әуНЁ№эembeddingІгөГөҪёчЧФАъК·РРОӘөДembeddingПтБҝ, ДГЧЕХвР©ПтБҝУлЙПГжөДәтСЎЙМЖ·embeddingПтБҝҪшИлAttentionPoolingLayerИҘ¶ФХвР©АъК·РРОӘМШХчјУИЁәПІў,ЧоәуөГөҪКдіцЎЈ

ФЪtorch rechubПоДҝЦРҫНКЗcreate_seq_featuresҙҰАніц¶ФУҰөДАъК·РтБРЎЈ

¶юЎўЙо¶ИРЛИӨНшВзDIN(addЧўТвБҰ)

DIN ДЈРНөДУҰУГіЎҫ°КЗ°ўАпЧоөдРНөДөзЙМ№гёжНЖјц,УРҙуБҝөДУГ»§АъК·РРОӘРЕПў(АъК·№әВт№эөГЙМЖ·»тАаұрРЕПў)ЎЈ¶ФУЪё¶БЛ№гёж·СөДЙМЖ·,°ўАп»бёщҫЭДЈРНФӨІвөДөг»чВКёЯөН,°СәПККөД№гёжЙМЖ·НЖјцёшәПККөДУГ»§,ЛщТФ DIN ДЈРНұҫЦКЙПКЗТ»ёцөг»чВКФӨ№АДЈРНЎЈ

ПВГжөДНј 1 ҫНКЗ DIN өД»щҙЎДЈРН Base ModelЎЈОТГЗҝЙТФҝҙөҪ,Base Model КЗТ»ёцөдРНөД Embedding MLP өДҪб№№ЎЈЛьөДКдИлМШХчУРУГ»§КфРФМШХч(User Proflie Features)ЎўУГ»§РРОӘМШХч(User Behaviors)ЎўәтСЎ№гёжМШХч(Candidate Ad)әНіЎҫ°МШХч(Context Features)ЎЈ

2.1 УГ»§РРОӘМШХч and әтСЎ№гёжМШХч

УГ»§КфРФМШХчәНіЎҫ°МШХчЦ®З°Мб№э,ХвАпЧўТвЙПНјІКЙ«Іҝ·ЦөДУГ»§РРОӘМШХчәНәтСЎ№гёжМШХч:

(1)УГ»§РРОӘМШХчКЗУЙТ»ПөБРУГ»§№әВт№эөДЙМЖ·ЧйіЙөД,ТІҫНКЗНјЙПөД Goods 1 өҪ Goods N,¶шГҝёцЙМЖ·УЦ°ьә¬БЛИэёцЧУМШХч,ТІҫНКЗНјЦРөДИэёцІКЙ«өг,ЖдЦРәмЙ«ҙъұнЙМЖ· ID,А¶Й«КЗЙМЖМ ID,·ЫЙ«КЗЙМЖ·Ааұр IDЎЈ

(2)әтСЎ№гёжМШХчТІ°ьә¬БЛХвИэёц ID РНөДЧУМШХч,ТтОӘХвАпөДәтСЎ№гёжТІКЗТ»ёц°ўАпЖҪМЁЙПөДЙМЖ·ЎЈ

ФЪЙо¶ИС§П°ЦР,Т»°гЦ»ТӘУцөҪ ID РНМШХч,ОТГЗҫН№№ҪЁЛьөД Embedding,И»әу°С Embedding ёъЖдЛыМШХчБ¬ҪУЖрАҙ,КдИләуРшөД MLPЎЈ

°ўАпөД Base Model ТІКЗХвГҙЧцөД,Ль°СИэёц ID ЧӘ»»іЙБЛ¶ФУҰөД Embedding,И»әу°СХвР© Embedding Б¬ҪУЖрАҙЧйіЙБЛөұЗ°ЙМЖ·өД EmbeddingЎЈ

2.2 АЫјУГҝ¶ОУГ»§РРОӘРтБР

ТтОӘУГ»§өДРРОӘРтБРЖдКөКЗТ»ЧйЙМЖ·өДРтБР,ХвёцРтБРҝЙіӨҝЙ¶М,ө«КЗЙсҫӯНшВзөДКдИлПтБҝөДО¬¶ИұШРлКЗ№М¶ЁөД,ДЗОТГЗУҰёГФхГҙ°СХвТ»ЧйЙМЖ·өД Embedding ҙҰАніЙТ»ёціӨ¶И№М¶ЁөД Embedding ДШ?ИзНј 1 ЦРөД SUM Pooling ІгөДҪб№№,ҫНКЗЦұҪУ°СХвР©ЙМЖ·өД Embedding өюјУЖрАҙ(ПтБҝАЫјУ),И»әуФЩ°СөюјУәуөД Embedding ёъЖдЛыЛщУРМШХчөДБ¬ҪУҪб№ыКдИл MLPЎЈ

ЎҫSUM PoolingөДІ»ЧгЎҝ

SUM Pooling өД Embedding өюјУІЩЧчЖдКөКЗ°СЛщУРАъК·РРОӘТ»КУН¬ИК,Г»УРИОәОЦШөгөШјУЖрАҙ,ХвЖдКөІўІ»·ыәПОТГЗ№әОпөДП°№ЯЎЈ

ҫЩёцАэЧУАҙЛө,әтСЎ№гёж¶ФУҰөДЙМЖ·КЗЎ°јьЕМЎұ,УлҙЛН¬Кұ,УГ»§өДАъК·РРОӘРтБРЦРУРХвСщјёёцЙМЖ· ID,·ЦұрКЗЎ°КуұкЎұЎ°T РфЎұәНЎ°ПҙГжДМЎұЎЈҙУОТГЗөД№әОпіЈК¶іц·ў,Ў°КуұкЎұХвёцАъК·ЙМЖ· ID ¶ФФӨІвЎ°јьЕМЎұ№гёжөг»чВКөДЦШТӘіМ¶ИУҰёГФ¶ҙуУЪәуБҪХЯЎЈҙУЧўТвБҰ»ъЦЖөДҪЗ¶Иіц·ў,ОТГЗФЪ№әВтјьЕМөДКұәт,»б°СЧўТвБҰёь¶аөШН¶Пт№әВтЎ°КуұкЎұХвАаПа№ШЙМЖ·өДАъК·ЙП,ТтОӘХвР©№әВтҫӯСйёьУРАыУЪОТГЗЧціцёьәГөДҫцІЯЎЈ

Ўҫ»щПЯДЈРНёчёцДЈҝйЎҝ

- Embedding layer:°СёЯО¬ПЎКиөДКдИлЧӘіЙөНО¬інГЬПтБҝ, ГҝёцАлЙўМШХчПВГж¶ј»б¶ФУҰЧЕТ»ёцembeddingҙКөд, О¬¶ИКЗ D ЎБ K D\times K DЎБK, ХвАпөД D D DұнКҫөДКЗТюПтБҝөДО¬¶И, ¶ш K K KұнКҫөДКЗөұЗ°АлЙўМШХчөДОЁТ»ИЎЦөёцКэ, ХвАпОӘБЛәГАнҪв,ХвАпҫЩёцАэЧУЛөГч,ҫНұИИзЙПГжөДweekdayМШХч:

јЩЙиДіёцУГ»§өДweekdayМШХчҫНКЗЦЬОе,»ҜіЙone-hotұаВлөДКұәт,ҫНКЗ[0,0,0,0,1,0,0]ұнКҫ,ХвАпИз№ыФЩјЩЙиТюПтБҝО¬¶ИКЗD, ДЗГҙХвёцМШХч¶ФУҰөДembeddingҙКөдКЗТ»ёц D ЎБ 7 D\times7 DЎБ7өДТ»ёцҫШХу(ГҝТ»БРҙъұнТ»ёцembedding,7БРХэәГ7ёцembeddingПтБҝ,¶ФУҰЦЬТ»өҪЦЬИХ),ДЗГҙёГУГ»§Хвёцone-hotПтБҝҫӯ№эembeddingІгЦ®әу»бөГөҪТ»ёц D ЎБ 1 D\times1 DЎБ1өДПтБҝ,ТІҫНКЗЦЬОе¶ФУҰөДДЗёцembedding,ФхГҙЛгөД,ЖдКөҫНКЗ e m b e d d i n g ҫШ Ху ? [ 0 , 0 , 0 , 0 , 1 , 0 , 0 ] T embeddingҫШХу* [0,0,0,0,1,0,0]^T embeddingҫШХу?[0,0,0,0,1,0,0]T ЎЈ

ЖдКөТІҫНКЗЦұҪУ°СembeddingҫШХуЦРone-hotПтБҝОӘ1өДДЗёцО»ЦГөДembeddingПтБҝДГіцАҙЎЈ ХвСщҫНөГөҪБЛПЎКиМШХчөДінГЬПтБҝБЛЎЈЖдЛыАлЙўМШХчТІКЗН¬Ан,Ц»І»№эЙПГжДЗёцmulti-hotұаВлөДДЗёц,»бөГөҪТ»ёцembeddingПтБҝөДБРұн,ТтОӘЛыҝӘКјөДДЗёцmulti-hotПтБҝІ»Ц№УРТ»ёцКЗ1,ХвСщіЛТФembeddingҫШХу,ҫН»бөГөҪТ»ёцБРұнБЛЎЈНЁ№эХвёцІг,ЙПГжөДКдИлМШХч¶јҝЙТФДГөҪПаУҰөДінГЬembeddingПтБҝБЛЎЈ

-

pooling layer and Concat layer:

- poolingІгөДЧчУГКЗҪ«УГ»§өДАъК·РРОӘembeddingХвёцЧоЦХұдіЙТ»ёц¶ЁіӨөДПтБҝ,ТтОӘГҝёцУГ»§АъК·№әВтөДЙМЖ·КэКЗІ»Т»СщөД, ТІҫНКЗГҝёцУГ»§multi-hotЦР1өДёцКэІ»Т»ЦВ,ХвСщҫӯ№эembeddingІг,өГөҪөДУГ»§АъК·РРОӘembeddingөДёцКэІ»Т»Сщ¶а,ТІҫНКЗЙПГжөДembeddingБРұн

t

i

t_i

ti?І»Т»СщіӨ, ДЗГҙХвСщөД»°,ГҝёцУГ»§өДАъК·РРОӘМШХчЖҙЖрАҙҫНІ»Т»СщіӨБЛЎЈ ¶шәуГжИз№ыјУИ«Б¬ҪУНшВзөД»°,ОТГЗЦӘөА,ЛыРиТӘ¶ЁіӨөДМШХчКдИлЎЈ ЛщТФНщНщУГТ»ёцpooling layerПИ°СУГ»§АъК·РРОӘembeddingұдіЙ№М¶ЁіӨ¶И(НіТ»іӨ¶И),ЛщТФУРБЛХвёц№«КҪ:

e i = p o o l i n g ( e i 1 , e i 2 , . . . e i k ) e_i=pooling(e_{i1}, e_{i2}, ...e_{ik}) ei?=pooling(ei1?,ei2?,...eik?)

ХвАпөД e i j e_{ij} eij?КЗУГ»§АъК·РРОӘөДДЗР©embeddingЎЈ e i e_i ei?ҫНұдіЙБЛ¶ЁіӨөДПтБҝ, ХвАпөД i i iұнКҫөЪ i i iёцАъК·МШХчЧй(КЗАъК·РРОӘ,ұИИзАъК·өДЙМЖ·id,АъК·өДЙМЖ·АаұрidөИ), ХвАпөД k k kұнКҫ¶ФУҰАъК·МШЦЦЧйАпГжУГ»§№әВт№эөДЙМЖ·КэБҝ,ТІҫНКЗАъК·embeddingөДКэБҝ,ҝҙЙПГжНјАпГжөДuser behaviorsПөБР,ҫНКЗДЗёц№эіМБЛЎЈ - Concat layerІгөДЧчУГҫНКЗЖҙҪУБЛ,ҫНКЗ°СХвЛщУРөДМШХчembeddingПтБҝ,Из№ыФЩУРБ¬РшМШХчөД»°ТІЛгЙП,ҙУМШХчО¬¶ИЖҙҪУХыәП,ЧчОӘMLPөДКдИлЎЈ

- poolingІгөДЧчУГКЗҪ«УГ»§өДАъК·РРОӘembeddingХвёцЧоЦХұдіЙТ»ёц¶ЁіӨөДПтБҝ,ТтОӘГҝёцУГ»§АъК·№әВтөДЙМЖ·КэКЗІ»Т»СщөД, ТІҫНКЗГҝёцУГ»§multi-hotЦР1өДёцКэІ»Т»ЦВ,ХвСщҫӯ№эembeddingІг,өГөҪөДУГ»§АъК·РРОӘembeddingөДёцКэІ»Т»Сщ¶а,ТІҫНКЗЙПГжөДembeddingБРұн

t

i

t_i

ti?І»Т»СщіӨ, ДЗГҙХвСщөД»°,ГҝёцУГ»§өДАъК·РРОӘМШХчЖҙЖрАҙҫНІ»Т»СщіӨБЛЎЈ ¶шәуГжИз№ыјУИ«Б¬ҪУНшВзөД»°,ОТГЗЦӘөА,ЛыРиТӘ¶ЁіӨөДМШХчКдИлЎЈ ЛщТФНщНщУГТ»ёцpooling layerПИ°СУГ»§АъК·РРОӘembeddingұдіЙ№М¶ЁіӨ¶И(НіТ»іӨ¶И),ЛщТФУРБЛХвёц№«КҪ:

-

MLP:ЖХНЁөДИ«Б¬ҪУ,УГБЛС§П°МШХчЦ®јдөДёчЦЦҪ»»ҘЎЈ

CTR¶ю·ЦАаИООсЦР,Т»°гЛрК§әҜКэУГөДёәөДlog¶ФКэЛЖИ»:

L

=

?

1

N

ЎЖ

(

x

,

y

)

ЎК

S

(

y

log

?

p

(

x

)

+

(

1

?

y

)

log

?

(

1

?

p

(

x

)

)

)

L=-\frac{1}{N} \sum_{(\boldsymbol{x}, y) \in \mathcal{S}}(y \log p(\boldsymbol{x})+(1-y) \log (1-p(\boldsymbol{x})))

L=?N1?(x,y)ЎКSЎЖ?(ylogp(x)+(1?y)log(1?p(x)))

baseДЈРНөДёДҪшөг:

- ХвСщЧЫәПЖрАҙ,ТСҫӯГ»·ЁФЩҝҙіцөҪөЧУГ»§АъК·РРОӘЦРөДДДёцЙМЖ·УлөұЗ°ЙМЖ·ұИҪППа№Ш,ТІҫНКЗ¶ӘК§БЛАъК·РРОӘЦРёчёцЙМЖ·¶ФөұЗ°ФӨІвөДЦШТӘРФіМ¶ИЎЈ

- ЧоәуТ»өгҫНКЗИз№ыЛщУРУГ»§дҜАА№эөДАъК·РРОӘЙМЖ·,Чоәу¶јНЁ№эembeddingәНpoolingЧӘ»»іЙБЛ№М¶ЁіӨ¶ИөДembedding,ХвСщ»бПЮЦЖДЈРНС§П°УГ»§өД¶аСщ»ҜРЛИӨЎЈ

ҫЯМеөДёДҪшЛјВ·:

- јУҙуembeddingөДО¬¶И,ФцјУЦ®З°ёчёцЙМЖ·өДұнҙпДЬБҰ,ХвСщјҙК№ЧЫәПЖрАҙ,embeddingөДұнҙпДЬБҰТІ»бјУЗҝ, ДЬ№»ФМәӯУГ»§өДРЛИӨРЕПў,ө«КЗХвёцФЪҙу№жДЈөДХжКөНЖјціЎҫ°јЖЛгБҝі¬ј¶ҙу,І»ҝЙИЎЎЈ

- јҙDIN,ФЪөұЗ°әтСЎ№гёжәНУГ»§өДАъК·РРОӘЦ®јдТэИлЧўТвБҰөД»ъЦЖ,ХвСщФЪФӨІвөұЗ°№гёжКЗ·сөг»чөДКұәт,ИГДЈРНёь№ШЧўУЪУлөұЗ°№гёжПа№ШөДДЗР©УГ»§АъК·ІъЖ·,ТІҫНКЗЛөУлөұЗ°ЙМЖ·ёьјУПа№ШөДАъК·РРОӘёьДЬҙЩҪшУГ»§өДөг»чРРОӘЎЈ

2.3 ЧўТвБҰ»ъЦЖөДУҰУГЎӘЎӘDIN

(1)ёДҪшөДөШ·Ҫ

ЛщТФ°ўАпҫНФЪbase model»щҙЎЙП,ФЪУГ»§өДАъК·РРОӘРтБРҙҰАнЙПУҰУГЧўТвБҰ»ъЦЖЎЈ

ҫЯМеөДІЩЧчИзПВНј:DIN ОӘГҝёцУГ»§өДАъК·№әВтЙМЖ·јУЙПБЛТ»ёцјӨ»оөҘФӘ(Activation Unit)ЎӘЎӘХвёцјӨ»оөҘФӘЙъіЙБЛТ»ёцИЁЦШ,ХвёцИЁЦШҫНКЗУГ»§¶ФХвёцАъК·ЙМЖ·өДЧўТвБҰөГ·Ц,ИЁЦШөДҙуРЎ¶ФУҰУГ»§ЧўТвБҰөДёЯөНЎЈ

ФЩәНЦ®З°өДbaseДЈРН¶ФұИ:

(2)јӨ»оөҘФӘ(local activation unit)

ҝЙТФҝҙөҪЙПГжНј3өДУТ·ҪөДјӨ»оөҘФӘөДПкПёҪб№№:

input:өұЗ°ХвёцАъК·РРОӘЙМЖ·өД Embedding,ТФј°әтСЎ№гёжЙМЖ·өД EmbeddingЎЈ

Чц·Ё:°СХвБҪёцКдИл Embedding,УлЛьГЗөДНв»эҪб№ыБ¬ҪУЖрАҙРОіЙТ»ёцПтБҝ(ёГПтБҝ·ҪПтКЗХвёцБҪёцПтБҝЧйіЙөДЖҪГжөД·ЁПтБҝ·ҪПт),ФЩКдИлёшјӨ»оөҘФӘөД MLP Іг,ЧоЦХ»бЙъіЙТ»ёцЧўТвБҰИЁЦШЎЈ

(1)јӨ»оөҘФӘҫНПаөұУЪТ»ёцРЎөДЙо¶ИС§П°ДЈРН,ЛьАыУГБҪёцЙМЖ·өД Embedding,ЙъіЙБЛҙъұнЛьГЗ№ШБӘіМ¶ИөДЧўТвБҰИЁЦШЎЈ

(2)SparrowАпГжөДҙъВлЎЈГ»УРСПёсТвТеЙПК№УГНв»эЎЈК№УГөДКЗelement-wise sub&multipyЎЈИ»әуУГХвБҪёцПтБҝИҘЖҙҪУ,ЧйіЙөДactivation_allЎЈ

НхҶҙҙуАРөДКөјщҫӯСй:Нв»эөДЧчУГІ»КЗәЬҙу,¶шЗТҙу·щФцјУІОКэБҝЎЈ

local activation unitДЬёщҫЭУГ»§АъК·РРОӘМШХчәНөұЗ°№гёжөДПа№ШРФёшУГ»§АъК·РРОӘМШХчembeddingҪшРРјУИЁ:АпГжКЗЗ°АЎЙсҫӯНшВз,КдИлКЗУГ»§АъК·РРОӘЙМЖ·әНөұЗ°өДәтСЎЙМЖ·, КдіцКЗЛьБ©Ц®јдөДПа№ШРФ, ХвёцПа№ШРФПаөұУЪГҝёцАъК·ЙМЖ·өДИЁЦШ,°СХвёцИЁЦШУлФӯАҙөДАъК·РРОӘembeddingПаіЛЗуәНҫНөГөҪБЛУГ»§өДРЛИӨұнКҫ

v

U

(

A

)

\boldsymbol{v}_{U}(A)

vU?(A),Ж乫КҪ:

v

U

(

A

)

=

f

(

v

A

,

e

1

,

e

2

,

Ўӯ

,

e

H

)

=

ЎЖ

j

=

1

H

a

(

e

j

,

v

A

)

e

j

=

ЎЖ

j

=

1

H

w

j

e

j

\boldsymbol{v}_{U}(A)=f\left(\boldsymbol{v}_{A}, \boldsymbol{e}_{1}, \boldsymbol{e}_{2}, \ldots, \boldsymbol{e}_{H}\right)=\sum_{j=1}^{H} a\left(\boldsymbol{e}_{j}, \boldsymbol{v}_{A}\right) \boldsymbol{e}_{j}=\sum_{j=1}^{H} \boldsymbol{w}_{j} \boldsymbol{e}_{j}

vU?(A)=f(vA?,e1?,e2?,Ўӯ,eH?)=j=1ЎЖH?a(ej?,vA?)ej?=j=1ЎЖH?wj?ej?

ЙПГ湫КҪөДҫЯМе·ыәЕҪвКН:

- { v A , e 1 , e 2 , Ўӯ , e H } \left\{\boldsymbol{v}_{A}, \boldsymbol{e}_{1}, \boldsymbol{e}_{2}, \ldots, \boldsymbol{e}_{H}\right\} {vA?,e1?,e2?,Ўӯ,eH?} КЗУГ»§ U U U өДАъК·РРОӘМШХчembedding;

- v A v_{A} vA? ұнКҫөДКЗәтСЎ№гёж A A A өДembeddingПтБҝ

- a ( e j , v A ) = w j a\left(e_{j}, v_{A}\right)=w_{j} a(ej?,vA?)=wj? ұнКҫөДИЁЦШ»тХЯАъК·РРОӘЙМЖ·УлөұЗ°№гёж A A A өДПа№ШРФіМ¶ИЎЈ

- a ( ? ) a(\cdot) a(?) ұнКҫөДЙПГжДЗёцЗ°АЎЙсҫӯНшВз, ТІҫНКЗДЗёцЛщОҪөДЧўТвБҰ»ъЦЖ

- КдИліэБЛАъК·РРОӘПтБҝәНәтСЎ№гёжПтБҝНв, »№УРТ»ёцЛьБ©өДНв»эІЩЧч, ЧчХЯЛөХвАпКЗУРАыУЪДЈРНПа№ШРФҪЁДЈөДПФРФЦӘК¶ЎЈ

RecHubЦРөДActivationUnitҙъВл:

class ActivationUnit(torch.nn.Module):

def __init__(self, emb_dim, dims=[36], activation="dice", use_softmax=False):

super(ActivationUnit, self).__init__()

self.emb_dim = emb_dim

self.use_softmax = use_softmax

# Dice(36)

self.attention = MLP(4 * self.emb_dim, dims=dims, activation=activation)

def forward(self, history, target):

seq_length = history.size(1)

target = target.unsqueeze(1).expand(-1, seq_length, -1)

# Concat

att_input = torch.cat([target, history, target - history, target * history], dim=-1)

# Dice(36)

att_weight = self.attention(att_input.view(-1, 4 * self.emb_dim))

# Linear(1)

att_weight = att_weight.view(-1, seq_length)

if self.use_softmax:

att_weight = att_weight.softmax(dim=-1)

# (batch_size,emb_dim)

output = (att_weight.unsqueeze(-1) * history).sum(dim=1)

return output

ЖдЦРҝЙТФҝҙөҪФЪself.attentionёіЦөХвАпКЗУГMLP:

class MLP(nn.Module):

"""Multi Layer Perceptron Module, it is the most widely used module for

learning feature. Note we default add `BatchNorm1d` and `Activation`

`Dropout` for each `Linear` Module.

Args:

input dim (int): input size of the first Linear Layer.

output_layer (bool): whether this MLP module is the output layer. If `True`, then append one Linear(*,1) module.

dims (list): output size of Linear Layer (default=[]).

dropout (float): probability of an element to be zeroed (default = 0.5).

activation (str): the activation function, support `[sigmoid, relu, prelu, dice, softmax]` (default='relu').

Shape:

- Input: `(batch_size, input_dim)`

- Output: `(batch_size, 1)` or `(batch_size, dims[-1])`

"""

def __init__(self, input_dim, output_layer=True, dims=[], dropout=0, activation="relu"):

super().__init__()

layers = list()

for i_dim in dims:

layers.append(nn.Linear(input_dim, i_dim))

layers.append(nn.BatchNorm1d(i_dim))

layers.append(activation_layer(activation))

layers.append(nn.Dropout(p=dropout))

input_dim = i_dim

if output_layer:

layers.append(nn.Linear(input_dim, 1))

self.mlp = nn.Sequential(*layers)

def forward(self, x):

return self.mlp(x)

ИэЎўҙъВлІҝ·Ц

3.1 DINДЈРНІҝ·Ц

import torch

import torch.nn as nn

import numpy as np

from torch.nn.modules.activation import Sigmoid

class DIN(nn.Module):

def __init__(self, candidate_movie_num, recent_rate_num, user_profile_num, context_feature_num, candidate_movie_dict,

recent_rate_dict, user_profile_dict, context_feature_dict, history_num, embed_dim, activation_dim, hidden_dim=[128, 64]):

super().__init__()

self.candidate_vocab_list = list(candidate_movie_dict.values())

self.recent_rate_list = list(recent_rate_dict.values())

self.user_profile_list = list(user_profile_dict.values())

self.context_feature_list = list(context_feature_dict.values())

self.embed_dim = embed_dim

self.history_num = history_num

# candidate_embedding_layer

self.candidate_embedding_list = nn.ModuleList([nn.Embedding(vocab_size, embed_dim) for vocab_size in self.candidate_vocab_list])

# recent_rate_embedding_layer

self.recent_rate_embedding_list = nn.ModuleList([nn.Embedding(vocab_size, embed_dim) for vocab_size in self.recent_rate_list])

# user_profile_embedding_layer

self.user_profile_embedding_list = nn.ModuleList([nn.Embedding(vocab_size, embed_dim) for vocab_size in self.user_profile_list])

# context_embedding_list

self.context_embedding_list = nn.ModuleList([nn.Embedding(vocab_size, embed_dim) for vocab_size in self.context_feature_list])

# activation_unit

self.activation_unit = nn.Sequential(nn.Linear(4*embed_dim, activation_dim),

nn.PReLU(),

nn.Linear(activation_dim, 1),

nn.Sigmoid())

# self.dnn_part

self.dnn_input_dim = len(self.candidate_embedding_list) * embed_dim + candidate_movie_num - len(

self.candidate_embedding_list) + embed_dim + len(self.user_profile_embedding_list) * embed_dim + \

user_profile_num - len(self.user_profile_embedding_list) + len(self.context_embedding_list) * embed_dim \

+ context_feature_num - len(self.context_embedding_list)

self.dnn = nn.Sequential(nn.Linear(self.dnn_input_dim, hidden_dim[0]),

nn.BatchNorm1d(hidden_dim[0]),

nn.PReLU(),

nn.Linear(hidden_dim[0], hidden_dim[1]),

nn.BatchNorm1d(hidden_dim[1]),

nn.PReLU(),

nn.Linear(hidden_dim[1], 1),

nn.Sigmoid())

def forward(self, candidate_features, recent_features, user_features, context_features):

bs = candidate_features.shape[0]

# candidate cate_feat embed

candidate_embed_features = []

for i, embed_layer in enumerate(self.candidate_embedding_list):

candidate_embed_features.append(embed_layer(candidate_features[:, i].long()))

candidate_embed_features = torch.stack(candidate_embed_features, dim=1).reshape(bs, -1).unsqueeze(1)

## add candidate continous feat

candidate_continous_features = candidate_features[:, len(candidate_features):]

candidate_branch_features = torch.cat([candidate_continous_features.unsqueeze(1), candidate_embed_features], dim=2).repeat(1, self.history_num, 1)

# recent_rate cate_feat embed

recent_embed_features = []

for i, embed_layer in enumerate(self.recent_rate_embedding_list):

recent_embed_features.append(embed_layer(recent_features[:, i].long()))

recent_branch_features = torch.stack(recent_embed_features, dim=1)

# user_profile feat embed

user_profile_embed_features = []

for i, embed_layer in enumerate(self.user_profile_embedding_list):

user_profile_embed_features.append(embed_layer(user_features[:, i].long()))

user_profile_embed_features = torch.cat(user_profile_embed_features, dim=1)

## add user_profile continous feat

user_profile_continous_features = user_features[:, len(self.user_profile_list):]

user_profile_branch_features = torch.cat([user_profile_embed_features, user_profile_continous_features], dim=1)

# context embed feat

context_embed_features = []

for i, embed_layer in enumerate(self.context_embedding_list):

context_embed_features.append(embed_layer(context_features[:, i].long()))

context_embed_features = torch.cat(context_embed_features, dim=1)

## add context continous feat

context_continous_features = context_features[:, len(self.context_embedding_list):]

context_branch_features = torch.cat([context_embed_features, context_continous_features], dim=1)

# activation_unit

sub_unit_input = recent_branch_features - candidate_branch_features

product_unit_input = torch.mul(recent_branch_features, candidate_branch_features)

unit_input = torch.cat([recent_branch_features, candidate_branch_features, sub_unit_input, product_unit_input], dim=2)

# weight-pool

activation_unit_out = self.activation_unit(unit_input).repeat(1, 1, self.embed_dim)

recent_branch_pooled_features = torch.mean(torch.mul(activation_unit_out, recent_branch_features), dim=1)

# dnn part

dnn_input = torch.cat([candidate_branch_features[:, 0, :], recent_branch_pooled_features, user_profile_branch_features, context_branch_features], dim=1)

dnn_out = self.dnn(dnn_input)

return dnn_out

3.2 torch rechubөДК№УГ

ұИИзФЪКэҫЭјҜamazon_electronics_sampleЙПЕЬDINДЈРНЎЈФӯКэҫЭКЗjsonёсКҪ,ОТГЗМбИЎЛщРиТӘөДРЕПўФӨҙҰАнОӘТ»ёцҪц°ьә¬user_id, item_id, cate_id, timeЛДёцМШХчБРөДCSVОДјю:

(1)МШХчҙҰАнІҝ·Ц

from torch_rechub.basic.features import DenseFeature, SparseFeature, SequenceFeature

n_users, n_items, n_cates = data["user_id"].max(), data["item_id"].max(), data["cate_id"].max()

# ХвАпЦё¶ЁГҝТ»БРМШХчөДҙҰАн·ҪКҪ,¶ФУЪsparsefeature,РиТӘКдИлembeddingІг,ЛщТФРиТӘЦё¶ЁМШХчҝХјдҙуРЎәНКдіцөДО¬¶И

features = [SparseFeature("target_item", vocab_size=n_items + 2, embed_dim=8),

SparseFeature("target_cate", vocab_size=n_cates + 2, embed_dim=8),

SparseFeature("user_id", vocab_size=n_users + 2, embed_dim=8)]

target_features = features

# ¶ФУЪРтБРМШХч,іэБЛРиТӘәНАаұрМШХчТ»СщҙҰАнТвНв,itemРтБРәНәтСЎitemУҰёГКфУЪН¬Т»ёцҝХјд,ОТГЗПЈНыДЈРН№ІПнЛьГЗөДembedding,ЛщТФҝЙТФНЁ№эshared_withІОКэЦё¶Ё

history_features = [

SequenceFeature("history_item", vocab_size=n_items + 2, embed_dim=8, pooling="concat", shared_with="target_item"),

SequenceFeature("history_cate", vocab_size=n_cates + 2, embed_dim=8, pooling="concat", shared_with="target_cate")

]

(2)ДЈРНҙъВл

- ФЪ»щҙЎКэҫЭјҜЙПТӘҪшРРҙҰАнөГөҪРРОӘМШХч

hist_behavior; - ХвЦЦАъК·РРОӘКэҫЭКЗРтБРМШХч,І»Н¬УГ»§өДАъК·РРОӘМШХчіӨ¶ИІ»Н¬,ЛщТФҪшИлNNЗ°ОТГЗТ»°г»б°ҙХХЧоіӨөДРтБРҪшРРpadding;ҫЯМеІгЙПҪшРРФЛЛгөДКұәт,»бУГmaskСЪВлөД·ҪКҪұкјЗіцХвР©МоідөДО»ЦГ,әГұЈЦӨјЖЛгөДЧјИ·РФЎЈ

class DIN(torch.nn.Module):

def __init__(self, features, history_features, target_features, mlp_params, attention_mlp_params):

super().__init__()

self.features = features

self.history_features = history_features

self.target_features = target_features

# АъК·РРОӘМШХчёцКэ

self.num_history_features = len(history_features)

# јЖЛгЛщУРөДdim

self.all_dims = sum([fea.embed_dim for fea in features + history_features + target_features])

# №№ҪЁEmbedingІг

self.embedding = EmbeddingLayer(features + history_features + target_features)

# №№ҪЁЧўТвБҰІг

self.attention_layers = nn.ModuleList(

[ActivationUnit(fea.embed_dim, **attention_mlp_params) for fea in self.history_features])

self.mlp = MLP(self.all_dims, activation="dice", **mlp_params)

def forward(self, x):

embed_x_features = self.embedding(x, self.features)

embed_x_history = self.embedding(x, self.history_features)

embed_x_target = self.embedding(x, self.target_features)

attention_pooling = []

for i in range(self.num_history_features):

attention_seq = self.attention_layers[i](embed_x_history[:, i, :, :], embed_x_target[:, i, :])

attention_pooling.append(attention_seq.unsqueeze(1))

# SUM Pooling

attention_pooling = torch.cat(attention_pooling, dim=1)

# Concat & Flatten

mlp_in = torch.cat([

attention_pooling.flatten(start_dim=1),

embed_x_target.flatten(start_dim=1),

embed_x_features.flatten(start_dim=1)

], dim=1)

# ҝЙҙ«Ил[80, 200]

y = self.mlp(mlp_in)

# ҙъВлЦРК№УГөДКЗsigmoid(1)+BCELoss,Р§№ыәНВЫОДЦРөДDINДЈРНsoftmax(2)+CELossАаЛЖ

return torch.sigmoid(y.squeeze(1))

ЛДЎўјёёцОКМв

- DINДЈРНФЪ№ӨТөЙПөДУҰУГ»№КЗұИҪП№г·әөД, ҙујТҝЙТФЧФУЙИҘНЁ№эІйЧКБПҝҙТ»ПВҫЯМеКөјщөұЦРХвёцДЈРНКЗФхГҙУГөД?

- ұИИзРРОӘРтБРөДЦЖЧчКЗ·сәПАн, Из№ыКұјдјдёфұИҪПіӨөД»°УҰІ»УҰёГ·ЦТ»ПВ¶О?

- ұИИзЧўТвБҰ»ъЦЖДЗАпДЬІ»ДЬёДіЙұрөДјЖЛгЧўТвБҰөД·ҪКҪ»бәГөг?(ОТГЗТІЦӘөАЧўТвБҰ»ъЦЖөД·ҪКҪҝЙІ»ҪцDNNХвТ»ЦЦ), ФЩұИИзЧўТвБҰИЁЦШДЗАпёГІ»ёГјУsoftmax?

Reference

[1] ЎҫCTRФӨ№АЎҝCTRДЈРНИзәОјУИлінГЬБ¬РшРНәНРтБРРНМШХч?

[2] datawhale rechubПоДҝ

[3] Ў¶Йо¶ИС§П°НЖјцПөНіЎ·НхҶҙ