����

- ������Ȼ����(Maximum likelihood estimation, ���MLE)Ҳ�������Ȼ���ơ���һ�ָ�������ͳ��ѧ��Ӧ��,���Dz������Ƶķ���֮һ��˵������֪ij�������������ij�ָ��ʷֲ�,�������о���IJ��������,�������ƾ���ͨ�����ɴ�����,�۲�����,���ý���Ƴ������Ĵ��ֵ��������Ȼ�����ǽ�����������˼����:��֪ij��������ʹ����������ֵĸ������,���ǵ�Ȼ������ȥѡ������С���ʵ�����,���Ըɴ�Ͱ����������Ϊ���Ƶ���ʵֵ��

- ��������ʹ���(Maximum a posteriori estimation, ���MAP)���ڱ�Ҷ˹ͳ��ѧ��,����������ʹ��ơ��Ǻ�����ʷֲ���������������������ʹ��ƿ��Ի�ö�ʵ����������ֱ�ӹ۲쵽�����ĵ���ơ����������Ȼ�����еľ��䷽�������й�ϵ,������ʹ����һ��������Ż�Ŀ��,��һ�������˱���������������ʷֲ���������������ʹ��ƿ��Կ����ǹ���(regularization)�������Ȼ���ơ�

�����⼸�����ֵ�һ��Ӧ����ѧ,�ڶ���Ӧ��Щ����ʲô��,��Ϊ�����ѧϰ��ͬѧ��Ҳ��һ֪���,��ô�ͻ���ʱ��ú�����������~

�ȳ���������Ԥ��һ�¡�����

��Ҷ˹��ʽ

ѧϰ����ѧϰ��ģʽʶ�����һ����������Ҷ˹��ʽ(Bayes�� Theorem):

P ( A �O B ) = P ( B �O A ) P ( A ) P ( B ) P(A|B) = \frac{P(B|A)P(A)}{P(B)} P(A�OB)=P(B)P(B�OA)P(A)?��ʽ1��

��Ҷ˹��ʽ�������ܼ�,���ǵ��˵��������ʺ����ϸ��ʵĹ�ʽ��

��Bչ��,����д��:

P ( A �O B ) = P ( B �O A ) P ( A ) P ( B �O A ) P ( A ) + P ( B �O �� A ) P ( �� A ) P(A|B) = \frac{P(B|A)P(A)}{P(B|A)P(A) + P(B|\sim A)P(\sim A)} P(A�OB)=P(B�OA)P(A)+P(B�O��A)P(��A)P(B�OA)P(A)?��ʽ2��( �� A \sim A ��A��ʾ"��A")

���ʺ�ͳ����ʲô��˼��?��ʲô����?

���ʺ�ͳ�����������������Ͽ�����һ�����������˼,������,���о������Ͽ��������෴�ġ�

�����о���������,��֪һ��ģ�ͺͲ���,��ôȥԤ�����ģ�Ͳ����Ľ��������(�����ֵ,����,Э����ȵ�)�� �ٸ�����,�����о���ô����(ģ������),��ѡ����������Ʒ�֡�ι����ʽ���������Ƶȵ�(ѡ�����),����֪��������������������ж��,������ô��(Ԥ����)��

**ͳ���о����������෴��ͳ����,��һ������,Ҫ�����������ȥԤ��ģ�ͺͲ�����**������Ϊ��������������һ����,ͨ���۲���ж�,��ȷ����������(���ȷ����ģ�͡���ʵ���о���,Ҳ��ͨ���۲������Ʋ�ģ����/���˹�ֲ��ġ�ָ���ֲ��ġ�������˹�ֲ��ĵȵ�),Ȼ��,���Խ�һ���о�,�ж�������Ʒ�֡�����Ȧ����������ɽ������������,�ȵ�(�Ʋ�ģ�Ͳ���)��

һ�仰�ܽ�:��������֪ģ�ͺͲ���,�����ݡ�ͳ������֪����,��ģ�ͺͲ�����

��Ȼ,����Ҫ˵��MLE��MAP��������ͳ�����������⡣

��ͳ��ѧ��,��Ȼ�������ʺ���������

�����������:

P

(

x

�O

��

)

P(x|\theta)

P(x�O��)

����������:

x

x

x��ʾijһ�����������;

��

\theta

����ʾģ�͵IJ�����

��� �� \theta ������֪ȷ����, x x x�DZ���,��������������ʺ���(probability function),���������ڲ�ͬ�������� x x x,����ָ����Ƕ��١�

��� x x x����֪ȷ����, �� \theta ���DZ���,�������������Ȼ����(likelihood function), ���������ڲ�ͬ��ģ�Ͳ���,���� x x x���������ĸ����Ƕ��١�

֪������������,������Ȼ�����ͺ�������

������Ȼ����

������Ȼ���Ƶĺ���˼����:��Ϊ��ǰ�������¼��Ǹ��������¼�����˾Ϳ��Ը������ݼ�,ʹ�ø����ݼ������ĸ�����������ģ���еIJ�����

�������Ȼ�������,����ͨ��һ���Ż��㷨��SGD���߶����Ż��㷨��Newton��⡣

������Ȼ����ֻ��ע��ǰ������,Ҳ����ֻ��ע��ǰ����������,�����������������������ڼ����,���Ҳ���Ҫ��ע����֪ʶ,����ڻ���ѧϰ�е�Ӧ�÷dz��㡣

�岥----MLE��loss function�Ĺ�ϵ

��ʧ��������Ϊģ�͵��Ż�Ŀ��Ķ�������ʧ�����ȵ����� MLE ��ͨ�á�

MLE ��һ���ض����͵ĸ���ģ����,������ʧ������(����)��Ȼ��MLE ���Ƶ�����ģ����ʧ������һ�ַ���(�����Ԫ�����ؿ��ɲ�Ŭ���ֲ��������Ȼ��ʽ����Ƶ�����,mse�����ɸ�˹�ֲ��������Ȼ��ʽ����Ƶ�����)��

���Ǻ����ʱ��,loss function�ĸ����Ѿ��dz�������,���������ѧϰ�¾ͺ���ʹ��MLE�������Ƶ�,���loss function�Ķ���Ҫ�ȵ�����MLE�Ƶ������IJ���loss function�Ķ���Ҫ����ͨ�á�

�ٸ�����˵һ�¼�����Ȼ����

������һ����ҳ�����ij��Ӳ��,���������õ���һö����Ӳ��,��������Ӳ���Dz��Ǿ��ȵġ�����֪������öӲ��,��������ֵĸ���(��Ϊ �� \theta ��)���Ƕ���?

����һ��ͳ������,����һ��,���ͳ��������Ҫʲô? ����!

������������öӲ������10��,�õ�������( x 0 x_0 x0?)��:�������������������������������������� �� \theta ����ģ�Ͳ���,����Ӳ��ģ�����ǿ��Լ����Ƕ���ֲ���

��ô,����ʵ���� x 0 x_0 x0?(����������������������)����Ȼ�����Ƕ�����?

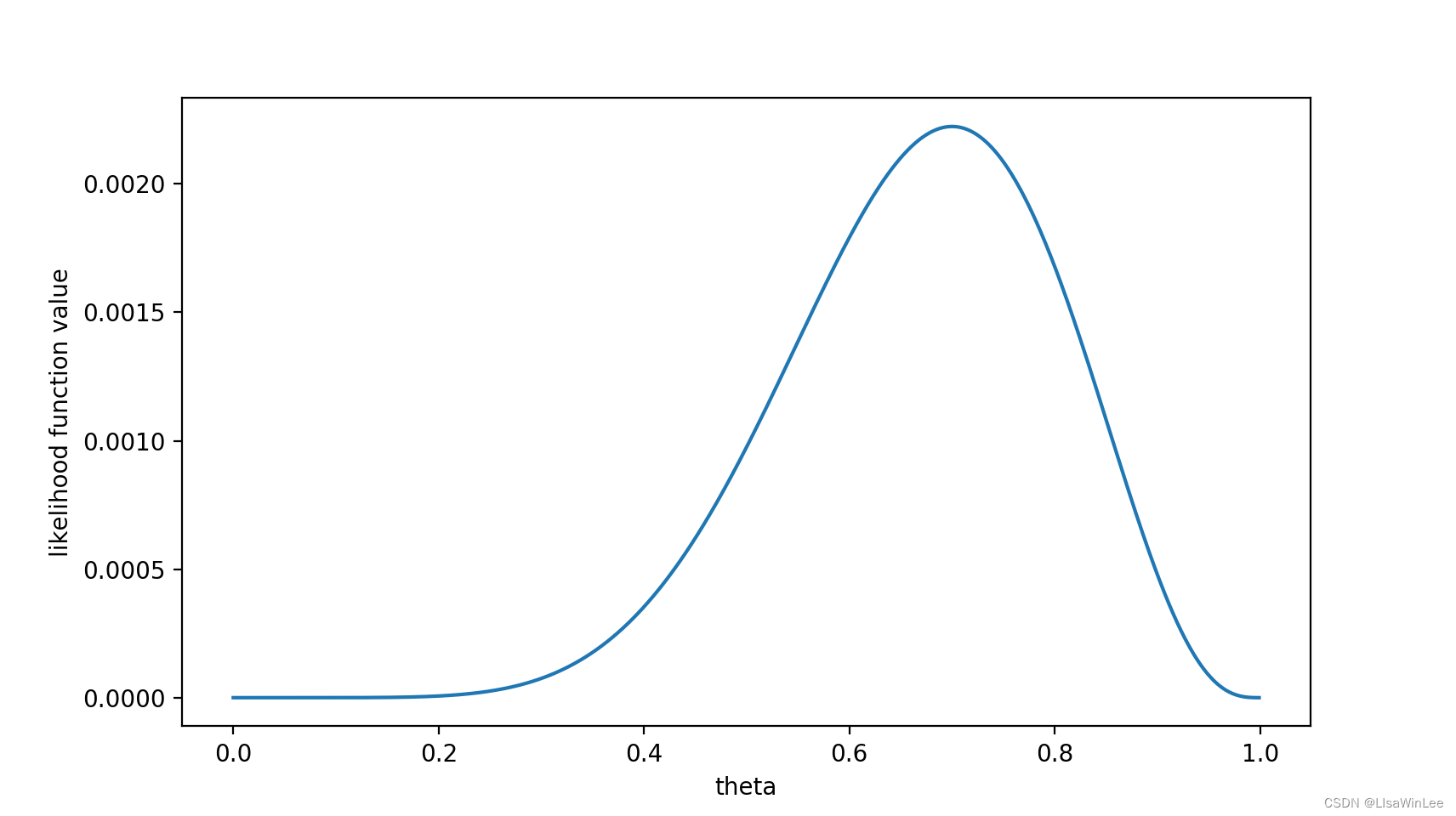

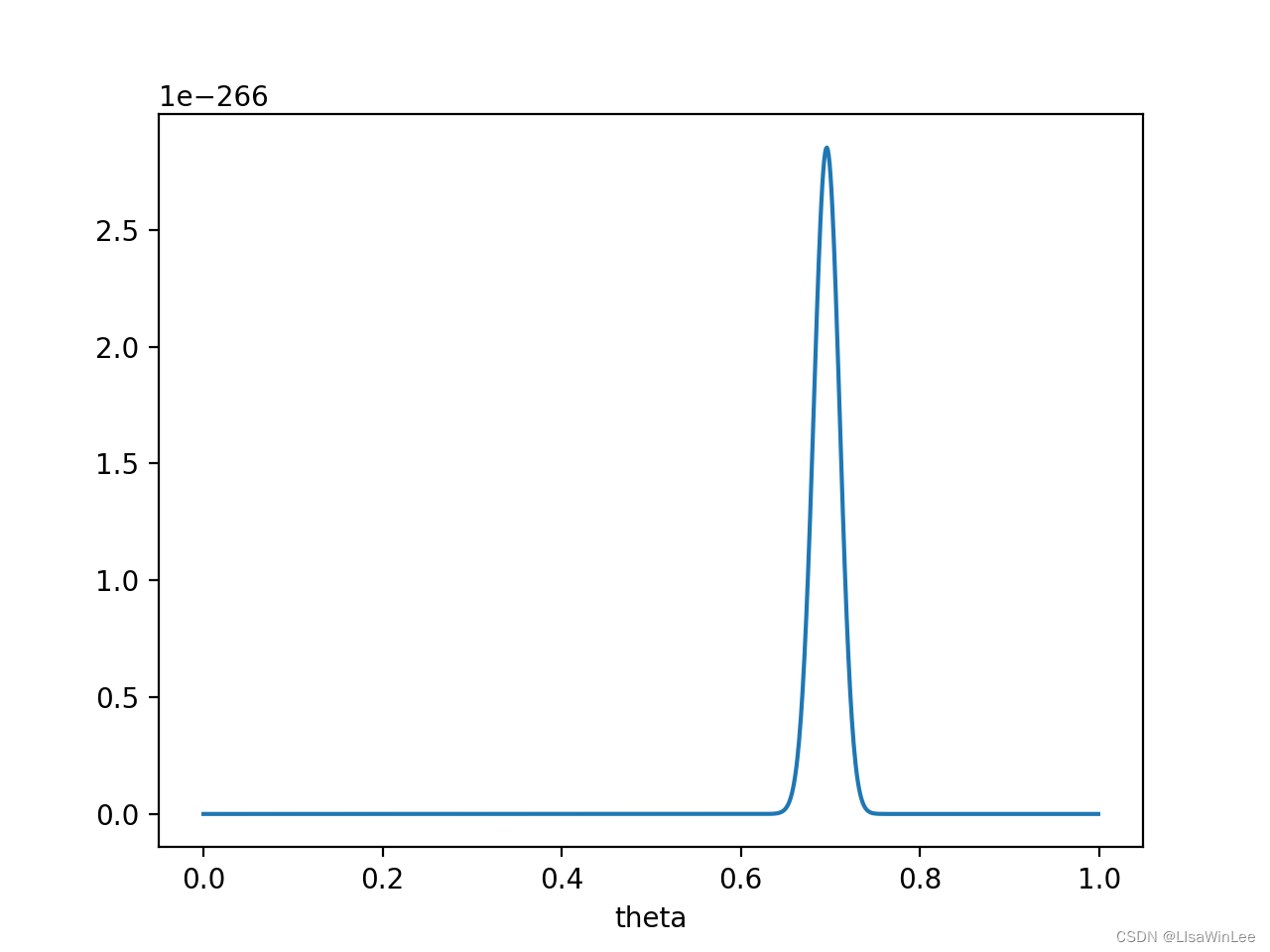

f ( x 0 , �� ) = ( 1 ? �� ) �� �� �� �� �� �� �� �� �� ( 1 ? �� ) �� �� �� �� �� �� �� ( 1 ? �� ) = �� 7 ( 1 ? �� ) 3 = f ( �� ) f(x_0 ,\theta) = (1-\theta)\times\theta\times\theta\times\theta\times\theta\times(1-\theta)\times\theta\times\theta\times\theta\times(1-\theta) = \theta ^ 7(1 - \theta)^3 = f(\theta) f(x0?,��)=(1?��)������������������(1?��)��������������(1?��)=��7(1?��)3=f(��)

ע��,���Ǹ�ֻ����

��

\theta

���ĺ������������Ȼ����,����˼��,����Ҫ���������������ǿ��Ի���

f

(

��

)

f(\theta)

f(��)��ͼ��:

���Կ���,��

��

=

0.7

\theta = 0.7

��=0.7ʱ,��Ȼ����ȡ�����ֵ��

����,�����Ѿ�����˶� �� \theta ���������Ȼ���ơ���,��10��Ӳ��,����7��Ӳ����������,�����Ȼ������Ϊ�������ϵĸ�����0.7��(ummm����dz�ֱ�ۺ���,��?)

����,һЩ�˿��ܻ�˵,Ӳ��һ�㶼�Ǿ��ȵİ�! ��������ʵ�鷢�ֽ���ǡ�����������������������,��Ҳ���� �� = 0.7 \theta = 0.7 ��=0.7��

����Ͱ����˱�Ҷ˹ѧ�ɵ�˼���ˡ���Ҫ����������ʡ� Ϊ��,��������������ʹ��ơ�

�ɼ�,������Ȼ���Ƶ�˼����û�п���������ʵİ�!!!

��������ʹ���

�����Ȼ�����ǵ������ݳ��ֵ��¼������

��

��

��,ʹ��Ȼ����

P

(

x

�O

��

)

P(x|��)

P(x�O��) �������������ʹ����������Ȼ���ƵĻ�����,��õ�

��

��

�� ������������Ȼ�������,Ҳ��

��

��

�� �Լ����ֵĸ���������ǿ��Ի����Ƕ���˼���������,���ڲ�ͬ��

��

��

�� ���Եõ���ͬ����Ȼ������ֵ,����

��

��

�� �������ֵĸ��ʿ�����������Ȼ������������,����Ȼ�������Ӻ���,�������ָ���С��

��

��

�� ������ͷ�,��������Ȼ������ֵ����������ʧ������������һ���üӷ���ͬ,MAP �����ó˷���������ͷ�������

����Ϊ:

P

(

��

�O

x

)

=

P

(

x

�O

��

)

P

(

��

)

P

(

x

)

P(��|x)=\frac{P(x|��)P(��)}{P(x)}

P(���Ox)=P(x)P(x�O��)P(��)?

��Ϊ

x

x

x ��ȷ���Ĺ۲��¼������

P

(

x

)

P(x)

P(x) ����ֵ֪,���Կ���ȥ����ĸ��

���衱Ͷ 10 ��Ӳ�ҡ���һ��ʵ��,ʵ������ 1000 ��,������������������������������ n ��,��P(x)=n/1000����֮,����һ��������ʵ��۲����ݼ��õ���ֵ��

�����Ĺ�ʽ�Dz��Ǻ���Ҷ˹����?��������ʵ���������������� P ( �� �O x ) P(��|x) P(���Ox),����ʵ��һ��������ʡ�����Ȼ���� P ( x �O �� ) P(x|��) P(x�O��) ��ͬ��Ҳ�����dz���������� P ( �� ) P(��) P(��)��

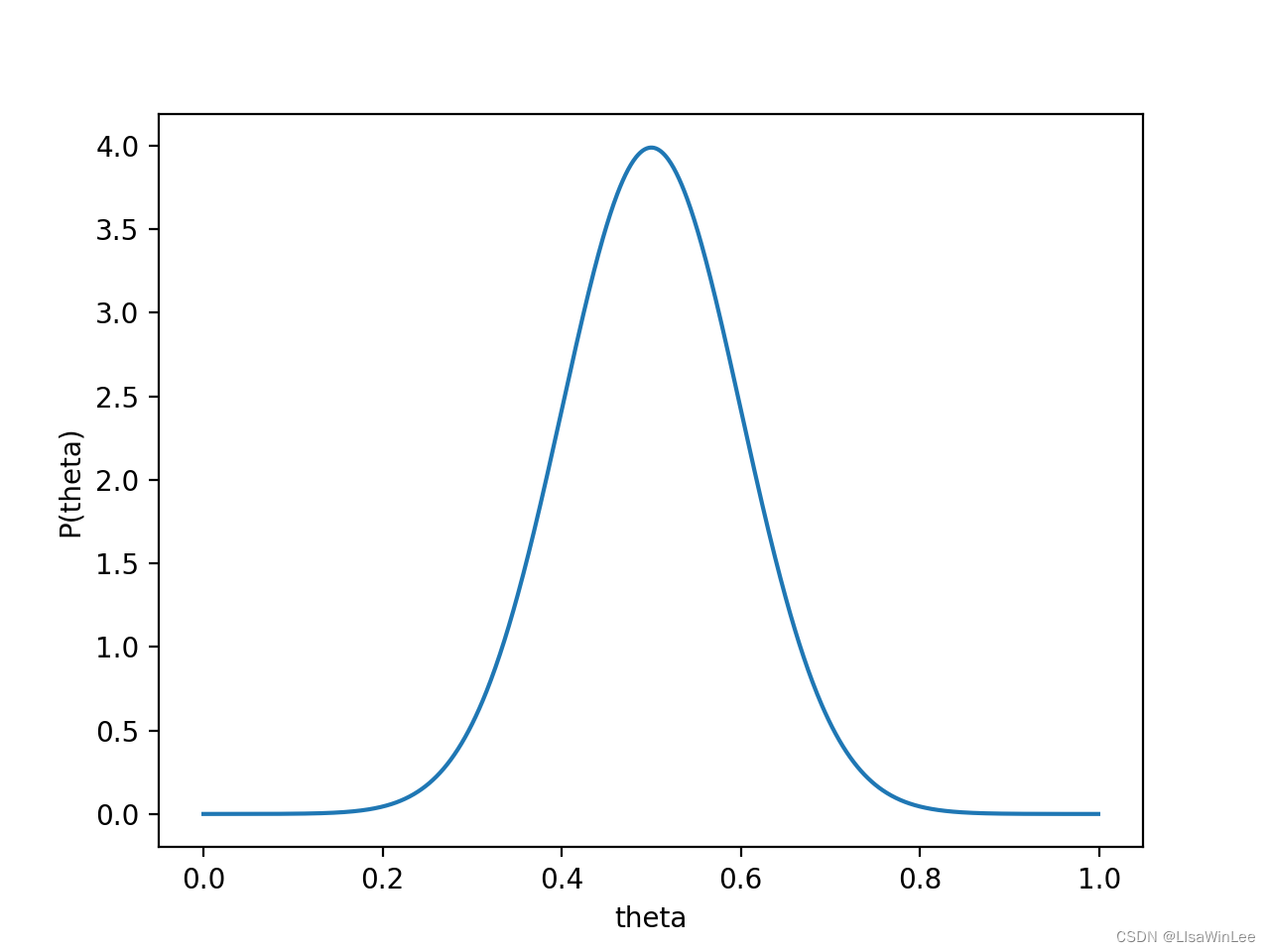

����ͶӲ�ҵ���������,������Ϊ(�������֪����)

��

\theta

��ȡ0.5�ĸ��ʺܴ�,ȡ����ֵ�ĸ���СһЩ��������һ����˹�ֲ������������������յ��������֪ʶ,�������

P

(

��

)

P(\theta)

P(��)Ϊ��ֵ0.5,����0.1�ĸ�˹����,����ͼ:

��

P

(

x

0

�O

��

)

P

(

��

)

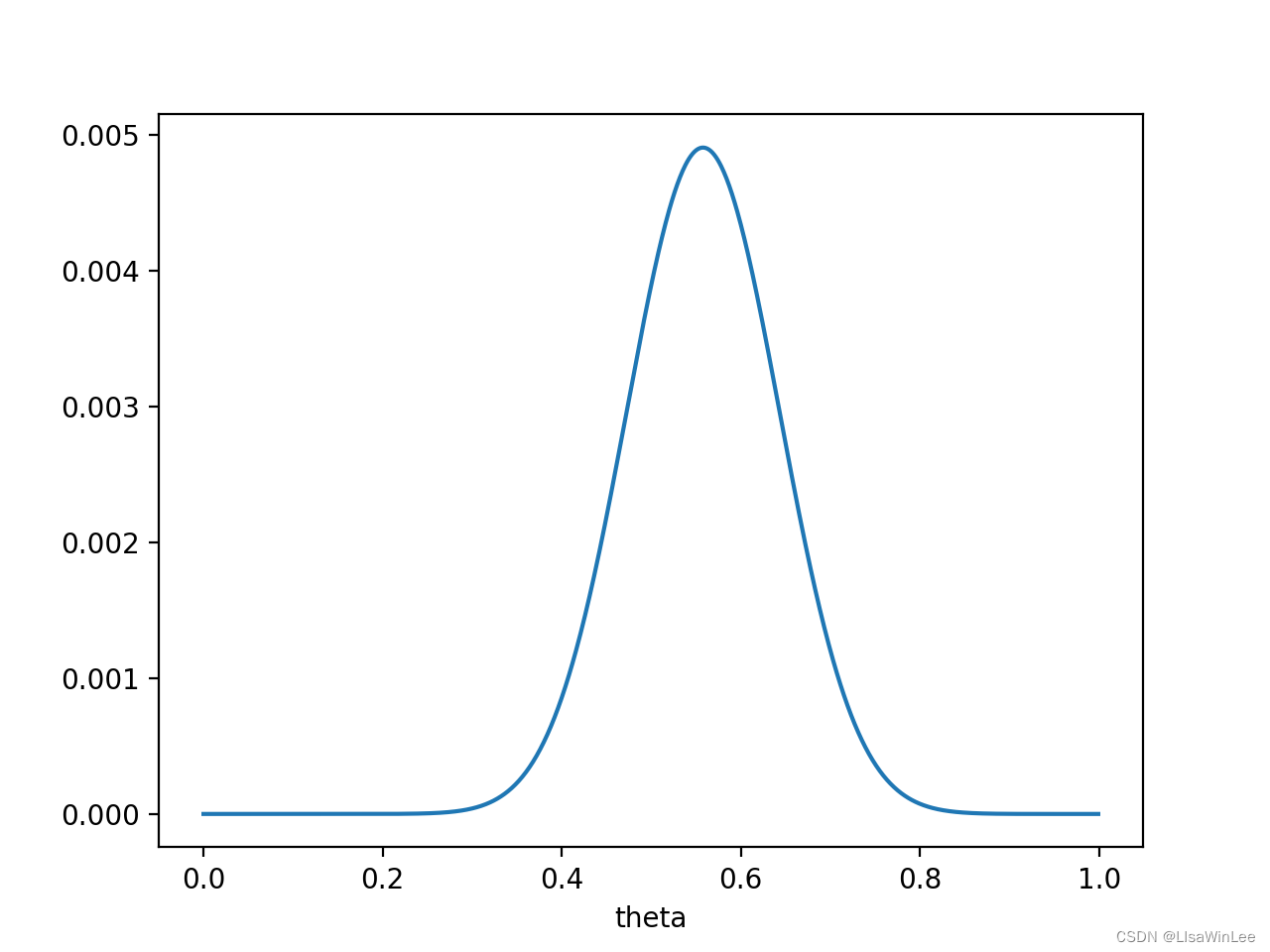

P(x_0 | \theta) P(\theta)

P(x0?�O��)P(��)�ĺ���ͼ��Ϊ:

ע��,��ʱ����ȡ���ֵʱ,

��

\theta

��ȡֵ������ƫ��,������0.7��ʵ����,��

��

=

0.558

\theta = 0.558

��=0.558ʱ����ȡ�������ֵ����,����������ʹ���,�õ�

��

=

0.558

\theta = 0.558

��=0.558.

���,��Ҫ��������˵��һ����Ҷ˹������

��

=

0.7

\theta = 0.7

��=0.7��?��ö�����ʵ�顣����

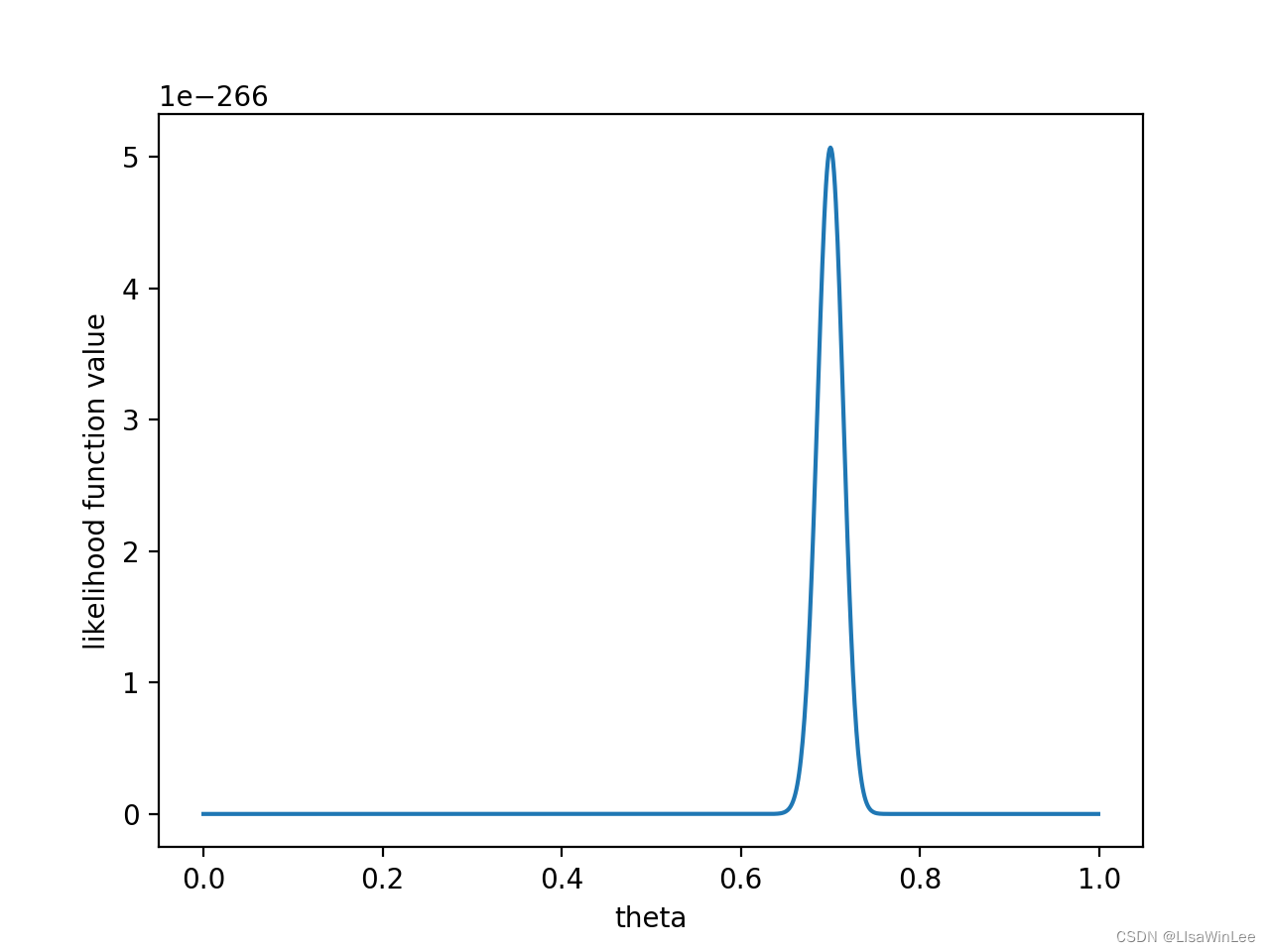

�������1000��ʵ��,����700�ζ�����������,��ʱ��Ȼ����Ϊ:

�����Ȼ����

P

(

��

)

P(\theta)

P(��)Ϊ��ֵ0.5,����0.1�ĸ�˹����,

P

(

x

0

�O

��

)

P

(

��

)

P(x_0 | \theta) P(\theta)

P(x0?�O��)P(��)�ĺ���ͼ��Ϊ:

��

��

=

0.696

\theta = 0.696

��=0.696��,

P

(

x

0

�O

��

)

P

(

��

)

P(x_0 | \theta) P(\theta)

P(x0?�O��)P(��)ȡ�����ֵ��

����,����һ��������������ʵı�Ҷ˹��,Ҳ���ò����ϵð� �� \theta ��������0.7�����ˡ�

PS. Ҫ����������̵ı�Ҷ˹��,��Ϊ P ( �� = 0.5 ) = 1 P(\theta = 0.5) = 1 P(��=0.5)=1,�Ǿ�û�����ˡ����� ������ô��ʵ��,ʹ��MAP���Ƴ������� �� = 0.5 \theta = 0.5 ��=0.5����Ҳ˵��,һ��������������ʼ����Ǻ���Ҫ�ġ�(ͨ��,��������ܴ�������ֱ�ӷ����õ�)

�����Ȼ���ƺ���������ʹ��Ƶ�����

���Ŷ�������,MLE��MAP������Ӧ���Ǻ�������ˡ�MAP���Ƕ����Ϊ���ӵ�������� P ( �� ) P(\theta) P(��)������,Ҳ���Է�����,��ΪMLE�ǰ�������� P ( �� ) P(\theta) P(��)��Ϊ����1,����Ϊ �� \theta ���Ǿ��ȷֲ���

�����

��ָ�л��λǰ�����ܽ������,�����ڴ�,Ҳ��ӭ��λ����!

https://blog.csdn.net/u011508640/article/details/72815981

https://murphypei.github.io/blog/2020/03/mle-map.html

https://zhuanlan.zhihu.com/p/93416473

https://zhuanlan.zhihu.com/p/72370235