ע�����������������뷨��ȡ����ƽ�����

��ƽ�����:

y

?

=

n

?

1

��

i

=

1

n

y

i

y^*=n^{-1}\sum\limits_{i=1}^{n}y_i

y?=n?1i=1��n?yi?

����ع�ģ�ͺ���

x

x

x�ı�ǩ��Ԥ��ֵΪ:

y

?

=

��

i

=

1

n

��

(

x

,

x

i

)

y

i

y^*=\sum\limits_{i=1}^{n}\alpha(x,x_i)y_i

y?=i=1��n?��(x,xi?)yi?

���еļ�ȨΪ:

��

(

x

,

x

i

)

\alpha(x,x_i)

��(x,xi?)��ʾ

x

i

x_i

xi?��

x

x

x�������,

x

i

x_i

xi?����ѵ����������,

y

i

y_i

yi?��ʾѵ�������Ķ�Ӧ��ǩ��

Ȩ�ص�ԭʼ��ʽ֮һ������K�����,�����Ա���Ϊһ���÷ֺ���,��������

x

i

x_i

xi?��

x

x

x������ԡ�Ȩ�ع�ʽ����:

��

(

x

,

x

i

)

=

K

(

x

,

x

i

)

��

j

=

1

n

K

(

x

,

x

j

)

\alpha(x,x_i)=\frac{K(x,x_i)}{\sum_{j=1}^{n} K(x,x_j)}

��(x,xi?)=��j=1n?K(x,xj?)K(x,xi?)?

| ���� | ���� |

|---|---|

| X X X | �� |

| I I I | ʵ�� |

| N N N | ������ |

| m k m_k mk? | �� k k k������ʵ���ĸ��� |

| ( x i , y i ) (x_i,y_i) (xi?,yi?) | �� i i i��ʵ���ڰ��е����� |

| N i ? M \mathcal{N}_i\subset\mathcal{M} Ni??M | �� i i i��С����ھӵ������� |

| P = P 1 , �� , P C \mathcal{P}={P_1,\dots,P_C} P=P1?,��,PC? | ģ��ļ��� |

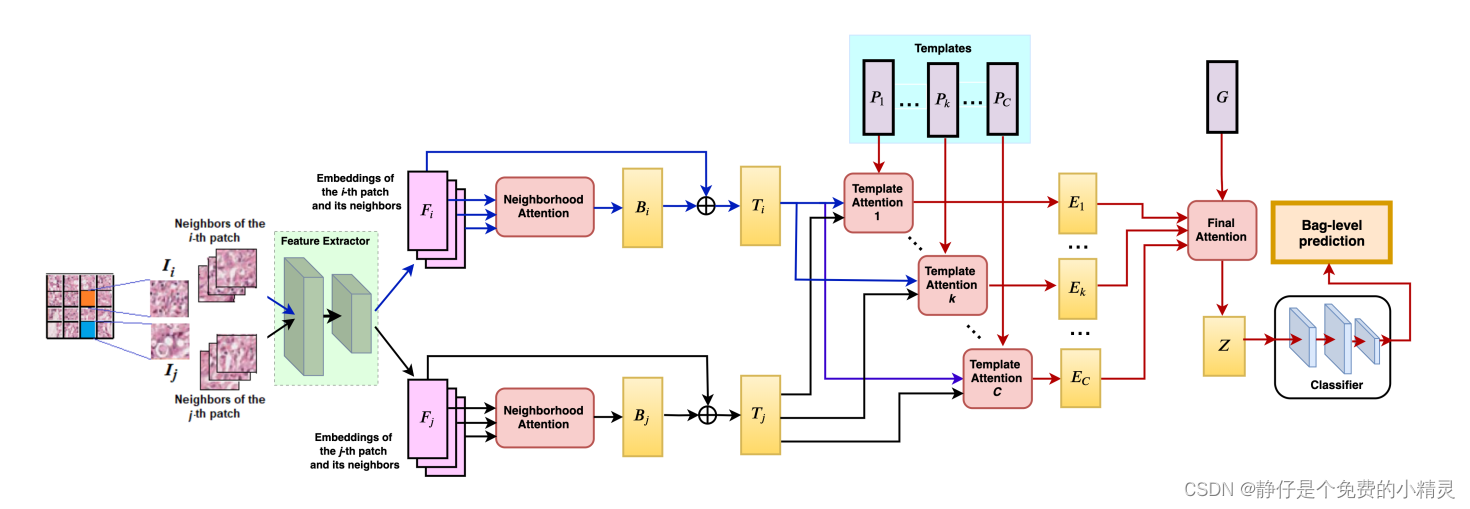

����һ��ͼ

-

����ߵ�ͼƬ��ʾһ����,���е�ÿһ��С���ʾ���е�ÿһ��ʵ��,���������� m m m��ʵ��,ʹ��������ͬ��ɫ�ĸ���ɫ���ʾ�� i i i��ʵ�� I i I_i Ii?�͵� j j j��ʵ�� I j I_j Ij?��

-

����С��(ʵ��)������������ѵ����������,ʹ��һά����������Ƕ�� F i F_i Fi?,Ŀ���ǽ���ʵ�� I i I_i Ii?��ά��:

F i = C o n v ( I i ) , i = 1 , �� , m . F_i=Conv(I_i),i=1,\dots,m. Fi?=Conv(Ii?),i=1,��,m. -

����ʹ�� ( x i , y i ) (x_i,y_i) (xi?,yi?)��ʾ������ͼ���е� i i i��С������ꡣ

ʹ�� M = { 1 , �� , m } \mathcal{M}=\{1,\dots,m\} M={1,��,m}��ʾ����ͼ��������С�����������

�� i i i��С����ھӵ������� N i ? M \mathcal{N}_i\subset\mathcal{M} Ni??MΪ:

N = { j �� M �O 0 < max ? ( �O x i ? x j �O , �O y i ? y j �O ) �� d } \mathcal{N}=\{j\in \mathcal{M}|0<\max(|x_i-x_j|,|y_i-y_j|)\leq d\} N={j��M�O0<max(�Oxi??xj?�O,�Oyi??yj?�O)��d}

d d d����������ֵ,�ڱ�ʵ���� d d d��ȡֵΪ1������ֵ��ע�����,�ھ����ڰ����ҵġ� -

�ھӵ�ʹ�ÿ��Ը��Ʒ�����,������������ע�����,���� I i I_i Ii?���ھ�����Ƕ�� B i B_i Bi?Ϊ:

B i = �� j �� N i �� j ( i ) F j B_i = \sum\limits_{j\in\mathcal{N}_i}\alpha^{(i)}_{j}F_j Bi?=j��Ni?��?��j(i)?Fj? -

���ݵ�ʵ�� I i I_i Ii?�ĵ� j j j���ھӵ�Ȩ�� �� j ( i ) \alpha_j^{(i)} ��j(i)?

�� j ( i ) = s o f t m a x ( s ( i ) ) = e x p ( s j ( i ) ) �� t e x p ( s t ( i ) ) \alpha_j^{(i)}=\mathbf{softmax}(s^{(i)})=\frac{exp(s_j^{(i)})}{\sum_texp(s_t^{(i)})} ��j(i)?=softmax(s(i))=��t?exp(st(i)?)exp(sj(i)?)?

���� s j ( i ) s_j^{(i)} sj(i)?�ǽ��������� F i F_i Fi?�� F j F_j Fj?ӳ�䵽������ע�������ֺ���:

s j ( i ) = s c o r e n b ( F i , F j ) = F T t a n h ( V n b F j ) s_j^{(i)}=\mathbf{score}_{nb}(F_i,F_j)=F^Ttanh(V_{nb}F_j) sj(i)?=scorenb?(Fi?,Fj?)=FTtanh(Vnb?Fj?)

���� V V V�ǿ�ѧϰ�����ľ��� -

��֮,����Ϊÿ�� F i F_i Fi?�õ�һ��Ƕ�� B i B_i Bi?, B i B_i Bi?�а����˹����ھӵ���Ϣ������ i i i��ʵ����Ƕ�������� B i B_i Bi?������Ƕ�봮������,�õ�Ƕ�� T i T_i Ti?:

T i = ( F i , B j ) T_i=(F_i,B_j) Ti?=(Fi?,Bj?)

����������ͼ���÷��Ũ���ʾ. ����ÿ��������һ��Ƕ������ T i T_i Ti?��ʾ��

���㷨�������һ����Ҫ������һ��Ƕ��ģ��,��Щģ�屻��Ϊ��ѧϰ����������,ģ��������

C

C

C,��ֵ��������������ģ����Ա���ΪӦ����Ƕ��

T

i

T_i

Ti?���Ķ��ع�ע��ʵ�֡�����������ij�ʼ������ͬ,�����Dz�ͬ�����硣????

ʹ��

P

=

P

1

,

��

,

P

C

\mathcal{P}={P_1,\dots,P_C}

P=P1?,��,PC?��ʾģ��ļ���,Ȼ��,ÿ��ģ�������Ӧ�ľۺ�Ƕ��

E

k

E_k

Ek?:

E

k

=

��

i

=

1

m

��

k

(

k

)

T

i

,

k

=

1

,

��

,

C

E_k=\sum\limits_{i=1}^{m}\beta_k^{(k)}T_i,k=1,\dots,C

Ek?=i=1��m?��k(k)?Ti?,k=1,��,C

����:�����ʽ����û��˵score����ô���

��

k

(

k

)

=

s

o

f

t

m

a

x

(

?

s

c

o

r

e

(

P

k

,

T

i

)

?

i

)

\beta_k^{(k)}=\mathbf{softmax}(\langle score(P_k,T_i)\rangle_i)

��k(k)?=softmax(?score(Pk?,Ti?)?i?)

��������softmax���й�һ������,�� k k k���ۺ�Ƕ�� E k E_k Ek?��ͼ���о������������С��(ʵ��)Ƕ��ļ�Ȩƽ��ֵ,��Ȩ���ɵ� k k k��ģ�嶨�塣���仰˵,�� k k k���ۼ�Ƕ������ڵ� k k k��ģ�������ͼ�����������������й�������Ƭ����������Ƭ����Ϣ������ C C C������ E 1 , �� , E C E_1,\dots,E_C E1?,��,EC?�С�

- ������

C

C

C��ģ�����Ӧ�ľۺ�Ƕ��

E

k

E_k

Ek?�����鵽������ͼ�����Ӻ�����ģ�����Ӧ��������

Z

Z

Z��,

Z

Z

Z�ǰ����ӳ��Ϊ��������

Z = �� k = 1 C �� k E k Z=\sum\limits_{k=1}^{C}\gamma_kE_k Z=k=1��C?��k?Ek?

����:

�� k = s o f t m a x ( ? s c o r e ( G , E k ) ? k ) \gamma_k=\mathbf{softmax}(\langle score(G,E_k)\rangle_k) ��k?=softmax(?score(G,Ek?)?k?)

G G G��ѵ��������ȫ��ģ�塣

,ģ�� G G G����Ӧ������ע�� final attention��������Щ�ۺ�Ƕ�� E k E_k Ek?��ģ�� P k P_k Pk?����Ҫ��,����,�ڷ�����֮ǰʹ��ע����ƿ���ʹ��ģ�;��пɽ����ԡ�

����ʹ�ô��в��� �� \theta ���ķ���� g �� ( Z ) g_\theta(Z) g��?(Z),�ò��������˰�����(����ͼ��)�Ϸ����ǩΪ1�ĸ��ʡ�

���������˴��� I i I_i Ii?�IJ���,������ʵ�ּ�������ͬ�ķ�ʽ������������ I I I��

����������ʹ������ݶ��½���Adam�Ż������ж˵��˵�ѵ������ÿ��������,��ѵ������ѡ��һ��ͼ��(һ����),Ȼ���仮��Ϊ�����Ƭ����Щ��Ƭ����������������롣ʹ��������Ľ���Ƕ�һ����ʵĹ���,����,����ζ��ͼ���Ƿ��������ϸ�������ݵõ��Ĺ��ƺ�����ͼ���ǩȷ����ʧ������Ϊ�˸���������Ȩ��,ʹ���Զ����㷨Ϊÿ��ѵ������ȷ����ʧ������ƫ����ֵ��Ȼ���Ա���ʽ����ѵ������ֵ��

��ʧ����:

L = 1 N �� k = 1 N B C E ( Y k , f ( X k ) ) + 2 C ( C ? 1 ) �� i < j ( P i T ? P j ) 2 L=\frac{1}{ N}\sum\limits_{k=1}^{N}BCE(Y_k,f(X_k))+\frac{2}{C(C-1)}\sum\limits_{i<j}(P_{i}^{T}\cdot P_j)^2 L=N1?k=1��N?BCE(Yk?,f(Xk?))+C(C?1)2?i<j��?(PiT??Pj?)2

����ĵ�һ�����������ཻ����(BCE)��ʧ����; f ( X k ) f(X_k) f(Xk?)������������������ Y k Y_k Yk?����ʵ��ǩ

BCE��ʧ����: l o s s ( x , y ) = ? [ y log ? x + ( 1 ? y ) log ? ( 1 ? x ) ] loss(x,y)=-[y\log x+(1-y)\log(1-x)] loss(x,y)=?[ylogx+(1?y)log(1?x)] ���� x x x��ģ�����, y y y����ʵ��ǩ��

�ڵڶ�����,�� P i P_i Pi?�� P j P_j Pj?�IJ��Խ��ʱ,��ʧ��ԽС,�����ʧ�����еĵڶ���ּ��ʹ�� P i P_i Pi?�� P j P_j Pj?�����ܲ�ͬ��

�������ʵ������Ҫ��

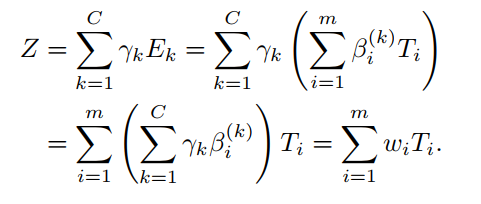

���������IJ���,һ�������ձ�ӳ�����һ�������ı�ʾ:

Z

=

��

k

=

1

C

��

k

E

k

Z=\sum\limits_{k=1}^{C}\gamma_kE_k

Z=k=1��C?��k?Ek?

����ͨ�����¹�ʽ�Ƶ���:

���������

w

i

=

��

k

=

1

C

��

k

��

i

(

k

)

w_i=\sum_{k=1}^C\gamma_k\beta_i^{(k)}

wi?=��k=1C?��k?��i(k)?������ʵ��

I

i

I_i

Ii?�������ھ��е���Ҫ�ԡ�����

��

i

=

1

m

w

i

=

1

\sum_{i=1}^{m}w_i=1

��i=1m?wi?=1,�������е�ʵ������Ҫ��֮��Ϊ

1

1

1��

ע��!ǰ���Ѿ��ᵽ��,��ʵ��

I

i

I_i

Ii?�ĵ�

j

j

j���ھӵ���Ҫ��Ϊ

��

j

(

i

)

\alpha_j^{(i)}

��j(i)?��������ǿ��Կ��ǽ�ʵ���ھ�����Ҫ�Ժ�ʵ����������Ҫ����ϵ������

������Ǽ�������

T

i

T_i

Ti?������Ԫ�ض��ǵȼ۵�,��ô���������ֵ���Ҫ�Զ�������ȵġ�����,���ָ��Ϊ

i

i

i��

j

j

j��ͼ��С�������ڵ�,��

B

i

B_i

Bi?��ֵ���ܻ���

T

j

T_j

Tj?�й�����������Ƕ����

i

i

i��ͼ��С���������Ҫ��

v

i

v_i

vi?Ϊ:

v

i

=

w

i

+

��

j

��

N

i

��

j

(

i

)

w

j

v_i=w_i+\sum\limits_{j\in N_i}\alpha_{j}^{(i)}w_j

vi?=wi?+j��Ni?��?��j(i)?wj?