1.MeanShiftдРэ

(1)бЯИёРДЫЕИУЗНЗЈВЂВЛЪЧгУРДЖдЭМЯёНјааЗжИюЕФ,ЖјЪЧдкВЪЩЋВуУцЕФЦНЛЌТЫВЈ;

(2)ЫќЛсжаКЭЩЋВЪЗжВМЯрНќЕФбеЩЋ,ЦНЛЌЩЋВЪЯИНк,ЧжЪДЕєФЧаЉУцЛ§НЯаЁЕФбеЩЋЧјгђ;

(3)ЫќвдЭМЯёЩЯШЮвЛЕуPЮЊдВаФ,АыОЖЮЊsp,ЩЋВЪЗљжЕЮЊsrНјааВЛЖЯЕФЕќДњ;

pyrMeanShiftFiltering(src, sp, sr, dst=None, maxLevel=None, termcrit=None):

Src:ЪфШыЕФдЪМЭМЯё;

Sp:ЫЋОЋЖШАыОЖ,жЕдНДѓ,ФЃК§ГЬЖШдНДѓ;

Sr:ЩЋВЪЕФЗљжЕБфЛЏЗЖЮЇ,БфЛЏЗЖЮЇдНДѓ,СЌГЩвЛЦЌЧјгђЕФвВОЭЪЧдНДѓЁЃ

Dst:ЪфГіЕФЭМЯё;

maxLevel:ФЌШЯжЕЮЊ1;

Termcrit:жежЙБъзМ:КЮЪБЭЃжЙmeanshiftЕќДњЁЃ

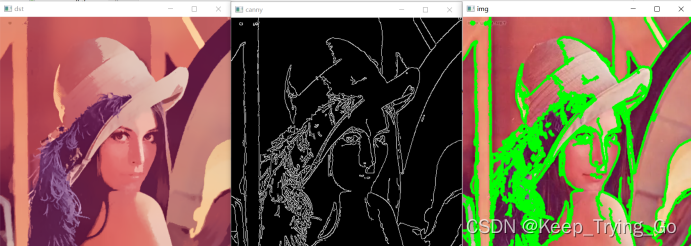

import os

import cv2

import numpy as np

img=cv2.imread('images/lenna.png')

img=cv2.resize(src=img,dsize=(450,450))

#ЭМЯёЗжИю

dst=cv2.pyrMeanShiftFiltering(src=img,sp=20,sr=30)

#ЭМЯёЗжИю(БпдЕЕФДІРэ)

canny=cv2.Canny(image=dst,threshold1=30,threshold2=100)

#ВщевТжРЊ

conturs,hierarchy=cv2.findContours(image=canny,mode=cv2.RETR_EXTERNAL,method=cv2.CHAIN_APPROX_SIMPLE)

#ЛГіТжРЊ

cv2.drawContours(image=img,contours=conturs,contourIdx=-1,color=(0,255,0),thickness=3)

cv2.imshow('img',img)

cv2.imshow('dst',dst)

cv2.imshow('canny',canny)

cv2.waitKey(0)

cv2.destroyAllWindows()

if __name__ == '__main__':

print('Pycharm')

CannyБпдЕМьВтЫуЗЈ:

https://mydreamambitious.blog.csdn.net/article/details/125116318

ЭМЯёВщевfindHomography:

https://mydreamambitious.blog.csdn.net/article/details/125385752

2.ЪгЦЕЧАКѓОАЗжРы

(1)MOG2ШЅГ§БГОА

дкcreateBackgroundSubtractorMOGЕФЛљДЁЩЯНјааСЫИФНј;

ЛьКЯИпЫЙФЃаЭЮЊЛљДЁЕФЧАОАЛђепБГОАЗжИюЫуЗЈ

createBackgroundSubtractorMOG2(history=None, varThreshold=None, detectShadows=None):

History:НјааНЈФЃЕФашвЊЖрГЄЕФВЮПМжЁ,ФЌШЯжЕЮЊ200;

varThreshold:ХаЖЯБГОАФЃаЭЪЧЗёФмКмКУЕиУшЪіЯёЫиЁЃ

detectShadows:вѕгАМьВт;

import os

import cv2

import numpy as np

#ДђПЊЩуЯёЭЗ

cap=cv2.VideoCapture('video/University_Traffic.mp4')

#ДДНЈЧАОАЗжРыЖдЯѓ

bgsegment=cv2.createBackgroundSubtractorMOG2()

while cap.isOpened():

OK,frame=cap.read()

if OK==False:

break

frame=cv2.resize(src=frame,dsize=(500,500))

fgmask=bgsegment.apply(frame)

cv2.imshow('img',fgmask)

if cv2.waitKey(1)&0xFF==27:

break

cap.release()

cv2.destroyAllWindows()

if __name__ == '__main__':

print('Pycharm')

ДгЪгЦЕжЁжаПЩвдПДЕНMOG2ВњЩњСЫКмЖрЕФдыЕу,ЫљвдЖдДЫЬсГіСЫИФНјЕФЗНЗЈ:

GMGШЅГ§БГОАЕФЗНЗЈ:

ОВЬЌБГОАЭМЙРМЦКЭУПИіЯёЫиЕФБДвЖЫЙЗжИюПЙдыадИќЧП;