1.����ʲô��bert��з���

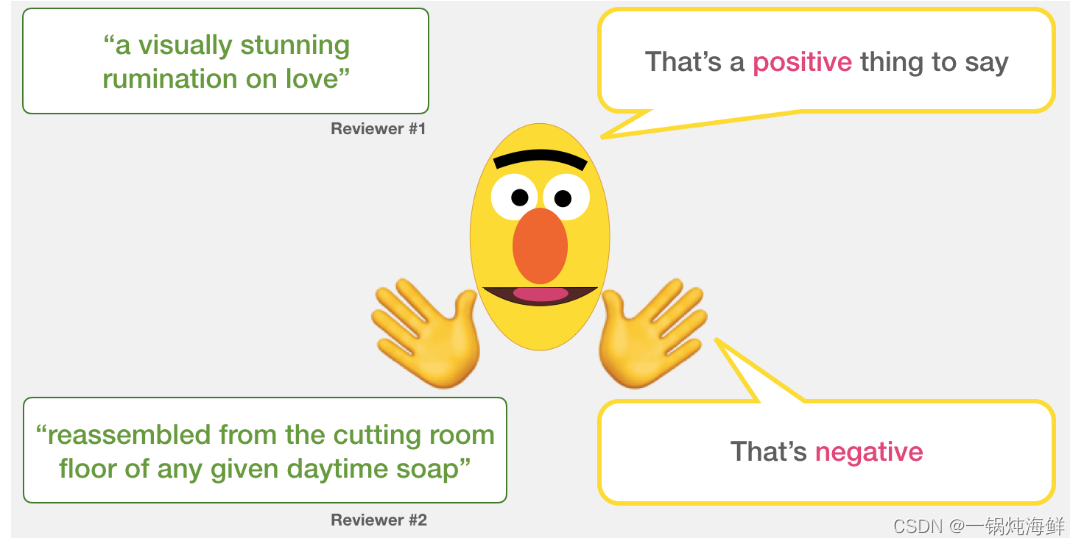

?�����ppt��,���ǽ�ʹ��Ԥ��ѵ���õ����ѧϰģ��������һЩ�ı���Ȼ��,���ǽ�ʹ�ø�ģ�͵�������ı����з��ࡣ��ɫ�������ǵ�Ӱ�����еľ����б������ǻὫÿ�����ӷ�Ϊ�������ء�̸������������ء�̸�����⡣

���ǵ�Ŀ���Ǵ���һ��ģ��,��ģ�Ͳ���һ������(�����������ݼ��еľ���һ��)������1(��ʾ���Ӵ��л�������)��0(��ʾ���Ӵ�����������)�����ǿ��������������:

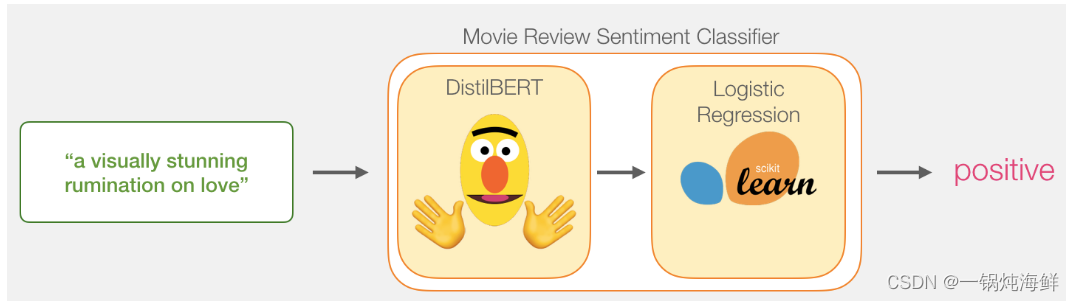

��ʵ��,��ɫ�ķ�����������������ģ�����:

DistilBERT��������,����������ȡ��һЩ��Ϣ���ݸ���һ��ģ�͡�DistilBERT����HuggingFace���Ŷӿ�������Դ��BERT����С�档����һ����������BERT�汾,�����ܴ����൱��

��һ��ģ����scikit learn�Ļ������ع�ģ��,��������DistilBERT�Ĵ������,�������ӷ���Ϊ�϶����(�ֱ�Ϊ1��0)��

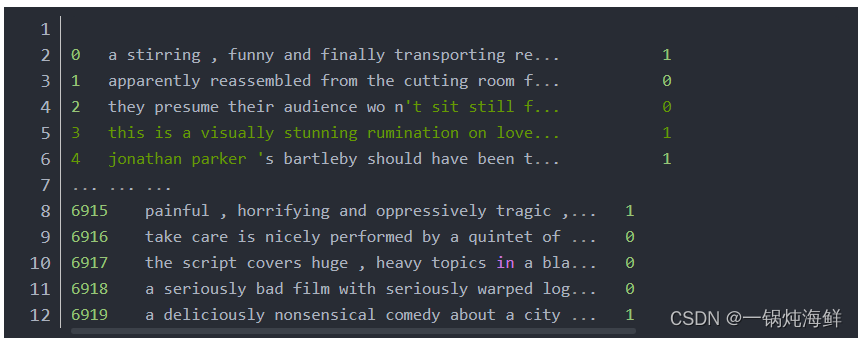

?�����õ���sst��з������ݼ�,��������Ե�Ӱ�����ۡ�

?��ǰ�ڴ�����ͬ��NLP����ͨ����Ҫ��ͬ����ģ��,BERT�������ǿ���Ƕ���ڸ���NLP������,�Դ�Ϊ����fine tune�����������

��LeeMeng - �M���� BERT:NLP ��ľ���֮���c�w�ƌW��?���������ᵽ�����⼸�������Ҿ��ú���Ҫ:

1.��ԭʼ�ı�����

2.��ԭʼ�ı�ת��ΪBERT���ݵ�����ģ��

3.����BERT�������ķ�ʽ������������ģ��

4.ѵ����������ģ��

5.��������������

�������õ���hfl/chinese-bert-wwm-ext �� Hugging Face?�Ŷ��ṩ��BERTģ��,ʮ�ַ��㡣ͬʱҲ��ȱ��,����ͬ�ⱨ�����Ӵ���,���ִ������ԭ�������г���ķ�����û������,ȴʹ����δ���ص�bert-base-casedģ�͡����÷�����û������,��ɽ�bert-base-casedģ��,��huggingface.co�����������������������Ӧ���ļ��м��ɡ�����������:Hugging Face Ԥѵ��ģ�͵����ؼ�ʹ��_cxxx17�IJ���-CSDN����

import numpy as np

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import GridSearchCV

from sklearn.model_selection import cross_val_score

import torch

from torch import optim

import torch.nn as nn

import transformers as tfs

import warnings

from transformers import logging

logging.set_verbosity_error()

warnings.filterwarnings('ignore')

train_df = pd.read_csv('https://github.com/clairett/pytorch-sentiment-classification/raw/master/data/SST2/train.tsv', delimiter='\t', header=None)

train_set = train_df[:3000] #ȡ���е�3000��������Ϊ���ǵ����ݼ�

print("Train set shape:", train_set.shape)

train_set[1].value_counts() #�鿴���ݼ��б�ǩ�ķֲ�

sentences = train_set[0].values

targets = train_set[1].values

train_inputs, test_inputs, train_targets, test_targets = train_test_split(sentences, targets)

batch_size = 64

batch_count = int(len(train_inputs) / batch_size)

batch_train_inputs, batch_train_targets = [], []

for i in range(batch_count):

batch_train_inputs.append(train_inputs[i*batch_size : (i+1)*batch_size])

batch_train_targets.append(train_targets[i*batch_size : (i+1)*batch_size])

class BertClassificationModel(nn.Module):

def __init__(self):

super(BertClassificationModel, self).__init__()

model_class, tokenizer_class= (tfs.BertModel, tfs.BertTokenizer)

self.tokenizer = tokenizer_class.from_pretrained(r"ģ�͵�ַ")

self.bert = model_class.from_pretrained(r"ģ�͵�ַ")

self.dense = nn.Linear(768, 2) # bertĬ�ϵ����ص�Ԫ����768, �����Ԫ��2,��ʾ������

def forward(self, batch_sentences):

batch_tokenized = self.tokenizer.batch_encode_plus(batch_sentences, add_special_tokens=True,

max_len=66,

pad_to_max_length=True) # tokenize��add special token��pad

input_ids = torch.tensor(batch_tokenized['input_ids'])

attention_mask = torch.tensor(batch_tokenized['attention_mask'])

bert_output = self.bert(input_ids, attention_mask=attention_mask)

bert_cls_hidden_state = bert_output[0][:, 0, :] # ��ȡ[CLS]��Ӧ������״̬

linear_output = self.dense(bert_cls_hidden_state)

return linear_output

# train the model

epochs = 3

lr = 0.01

print_every_batch = 5

bert_classifier_model = BertClassificationModel()

optimizer = optim.SGD(bert_classifier_model.parameters(), lr=lr, momentum=0.9)

criterion = nn.CrossEntropyLoss()

for epoch in range(epochs):

print_avg_loss = 0

for i in range(batch_count):

inputs = batch_train_inputs[i]

labels = torch.tensor(batch_train_targets[i])

optimizer.zero_grad()

outputs = bert_classifier_model(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

print_avg_loss += loss.item()

if i % print_every_batch == (print_every_batch - 1):

print("Batch: %d, Loss: %.4f" % ((i + 1), print_avg_loss / print_every_batch))

print_avg_loss = 0

# eval the trained model

total = len(test_inputs)

hit = 0

with torch.no_grad():

for i in range(total):

outputs = bert_classifier_model([test_inputs[i]])

_, predicted = torch.max(outputs, 1)

if predicted == test_targets[i]:

hit += 1

print("Accuracy: %.2f%%" % (hit / total * 100))

���ѵ�����:

![]()

?