一、谱聚类的原理

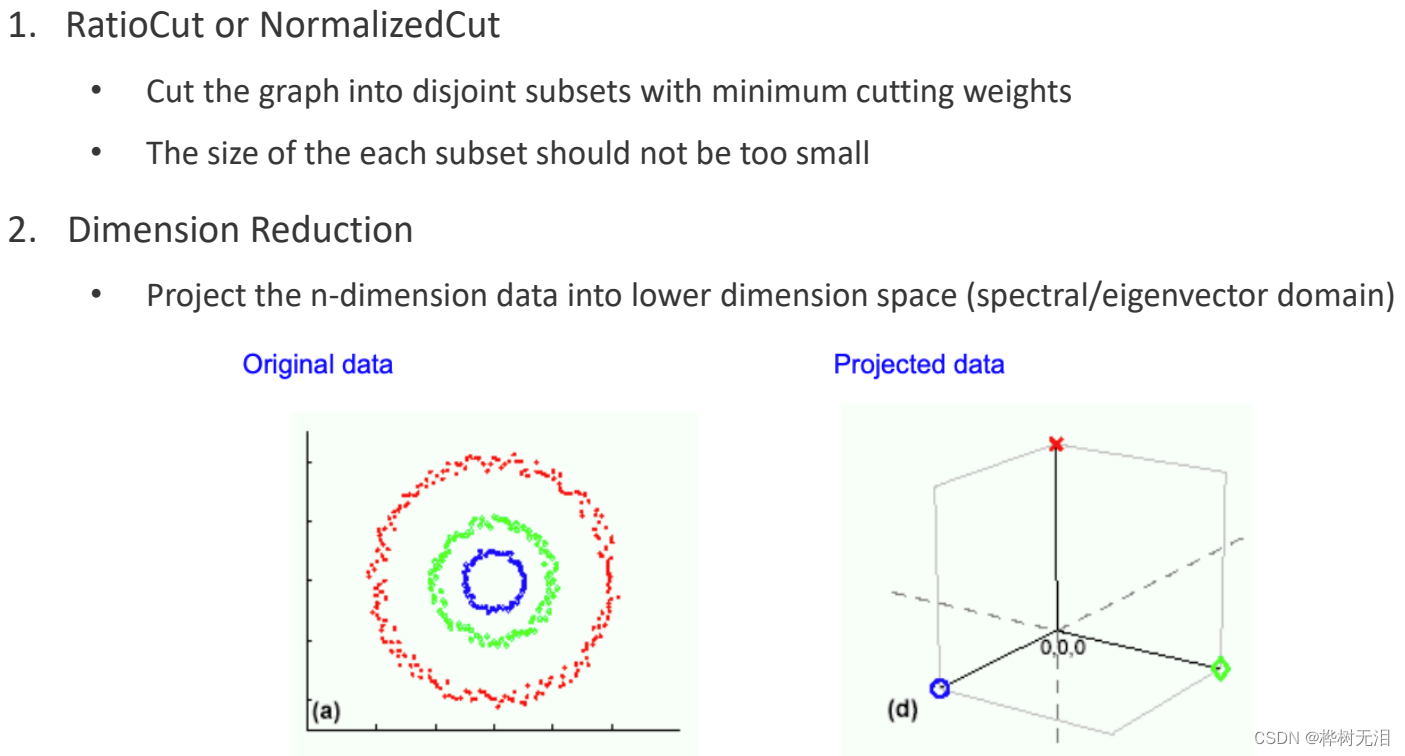

为了避免单个点成一类,加入一些限制条件?

1.1 拉普拉斯矩阵?

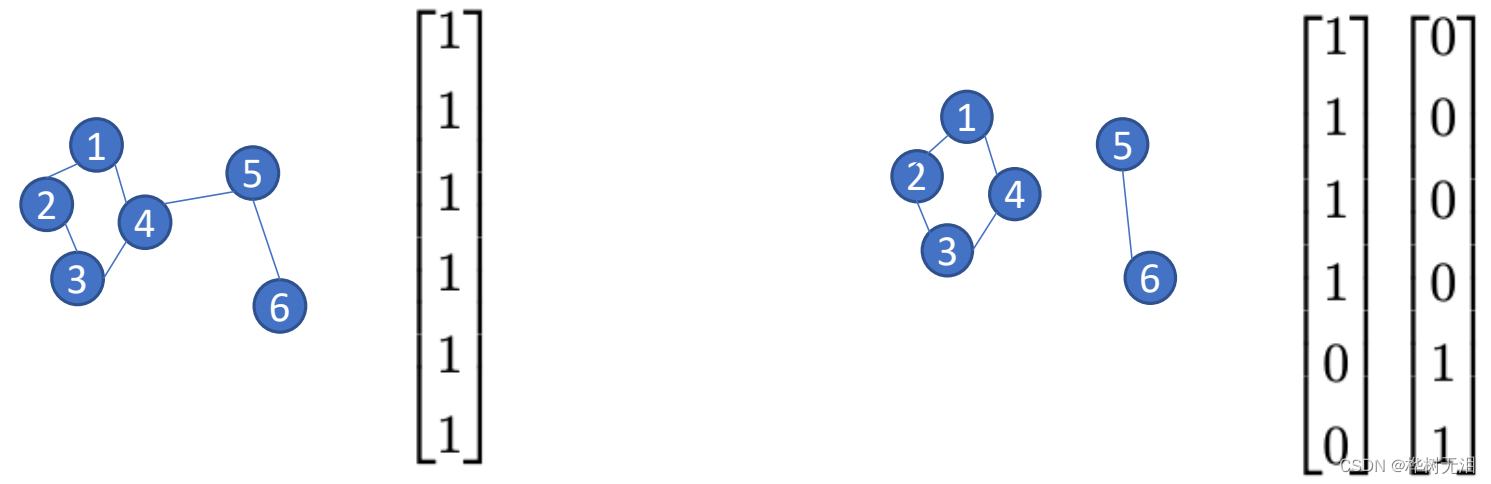

只看特征向量就直到有几个独立分区,有多少个连通域(单独区域)就有多少个0

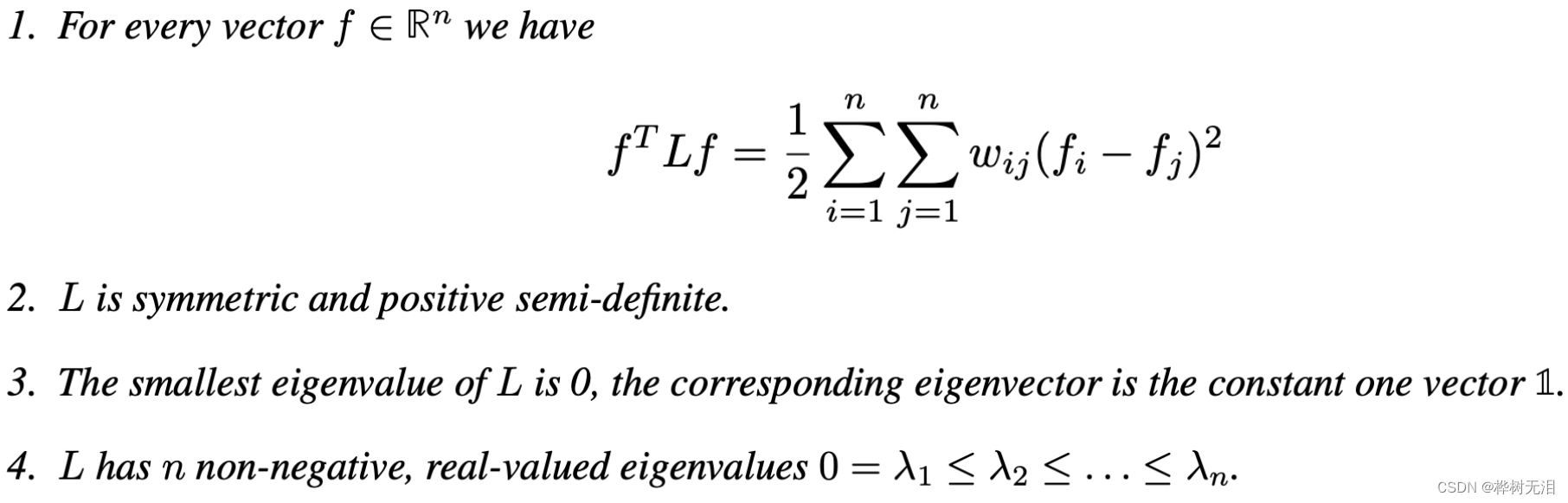

- 拉普拉斯性质?

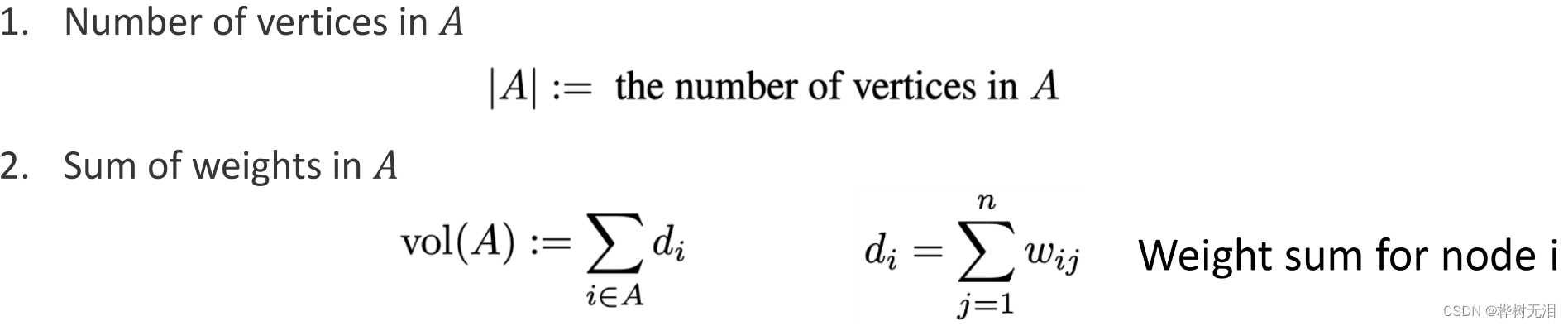

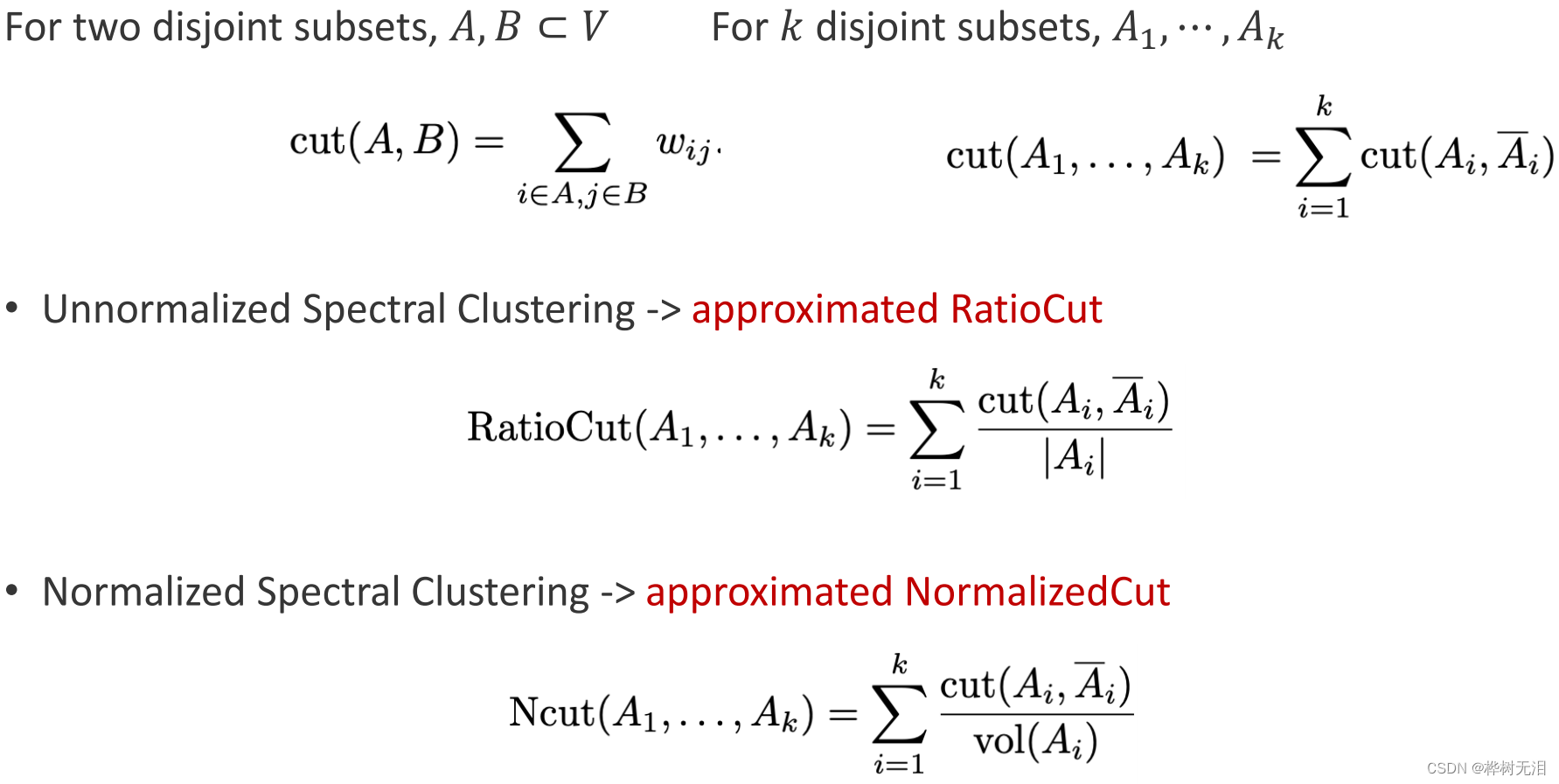

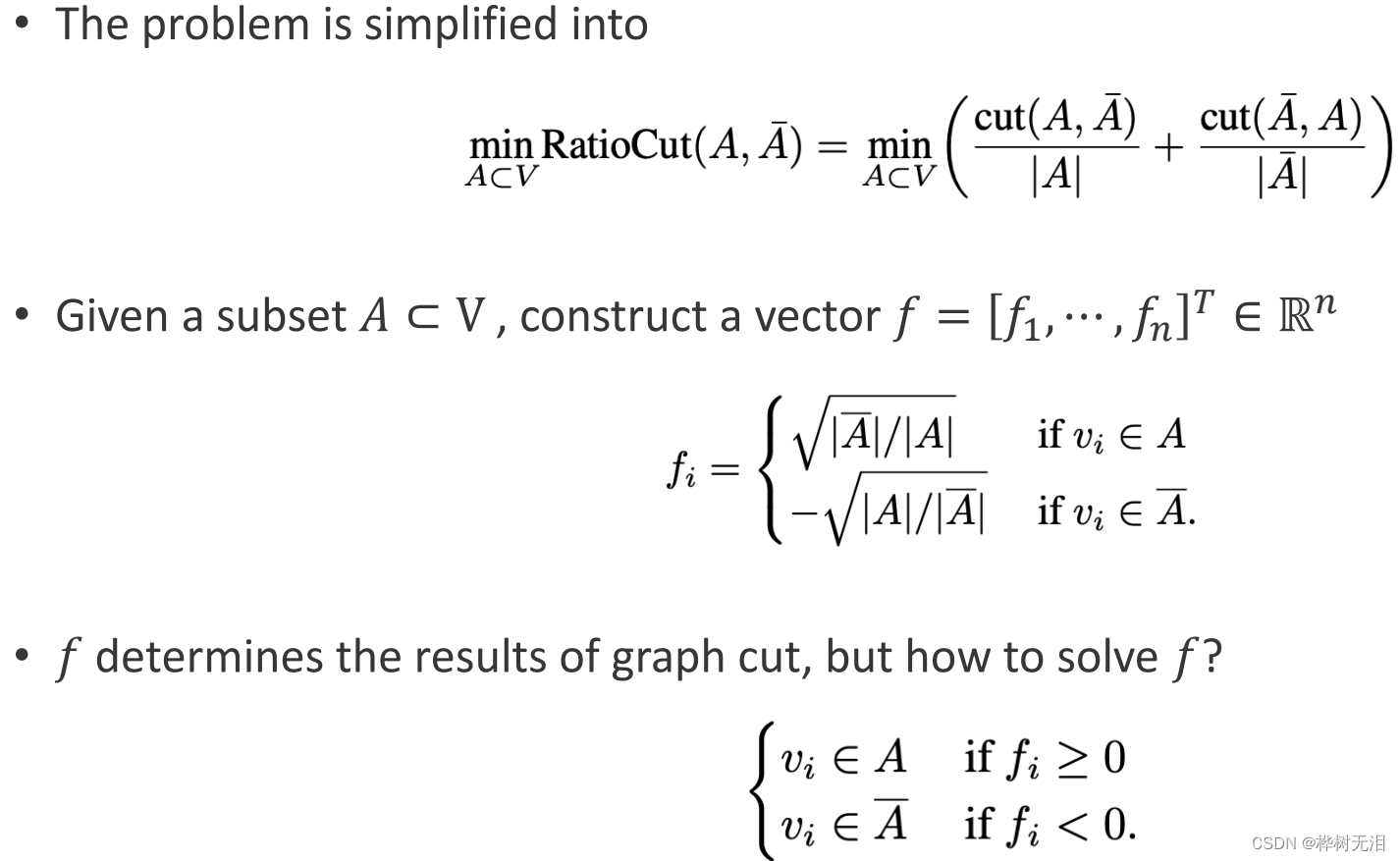

1.2 切区域

使得两区域之间的权重和最小为目标,以最小数量为约束

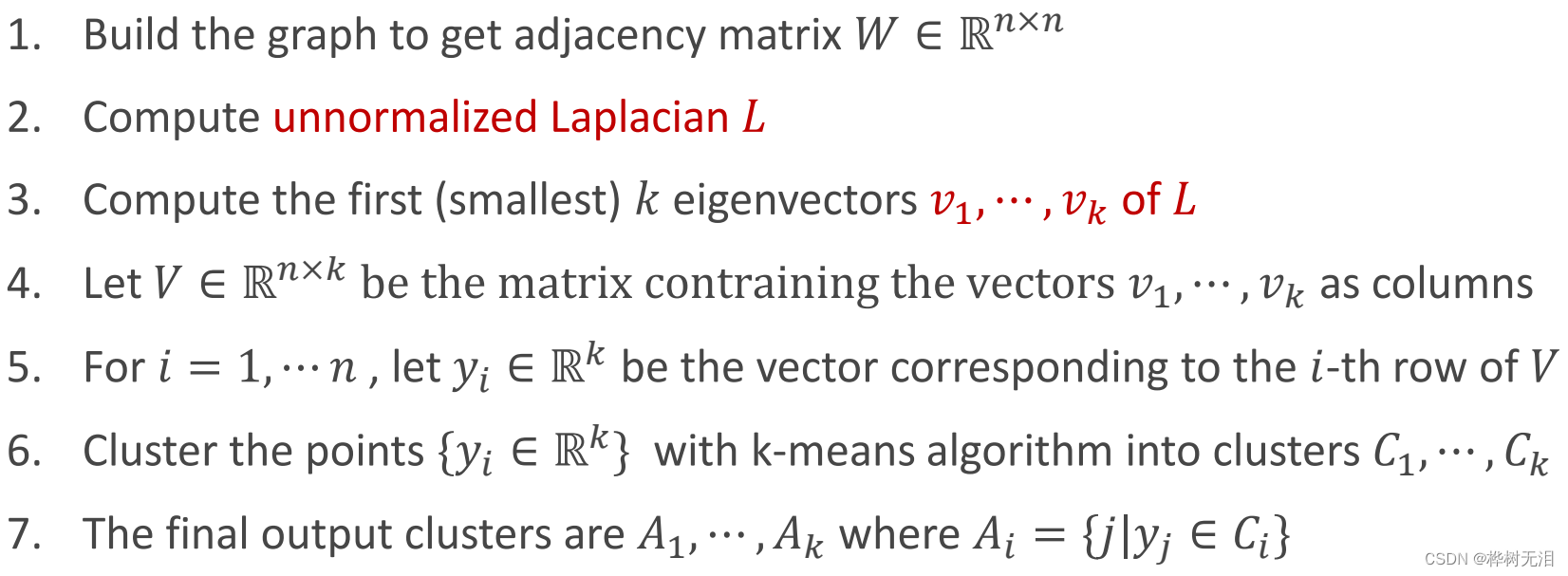

求解出特征向量排序,第一个是连通域信息,第二个是补充信息,利用特征向量组成矩阵来进行K-MEANS聚类。?

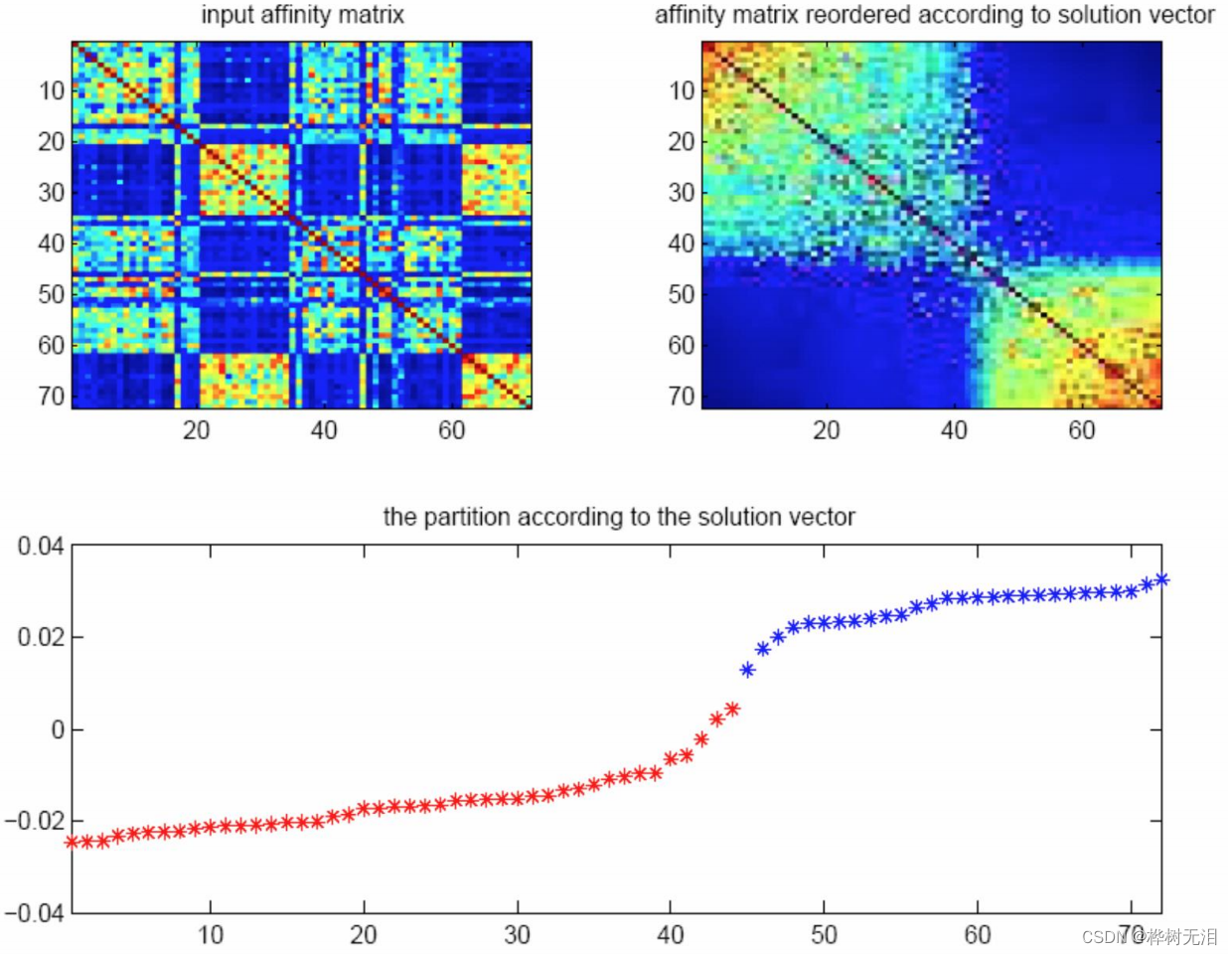

第一个图是W矩阵,第二个是分割后矩阵

?1.3 降维理解

?1.3 降维理解

谱聚类把k*k的矩阵降为了k*n

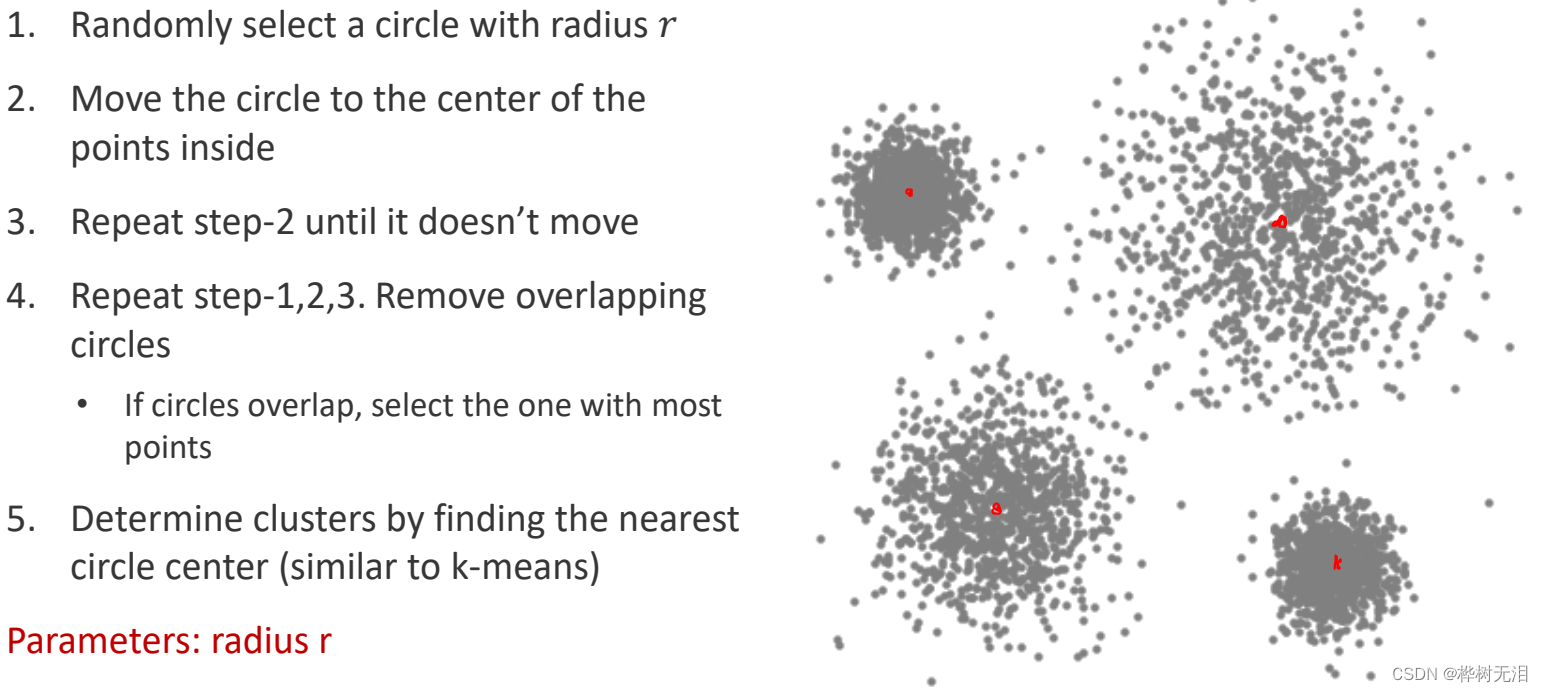

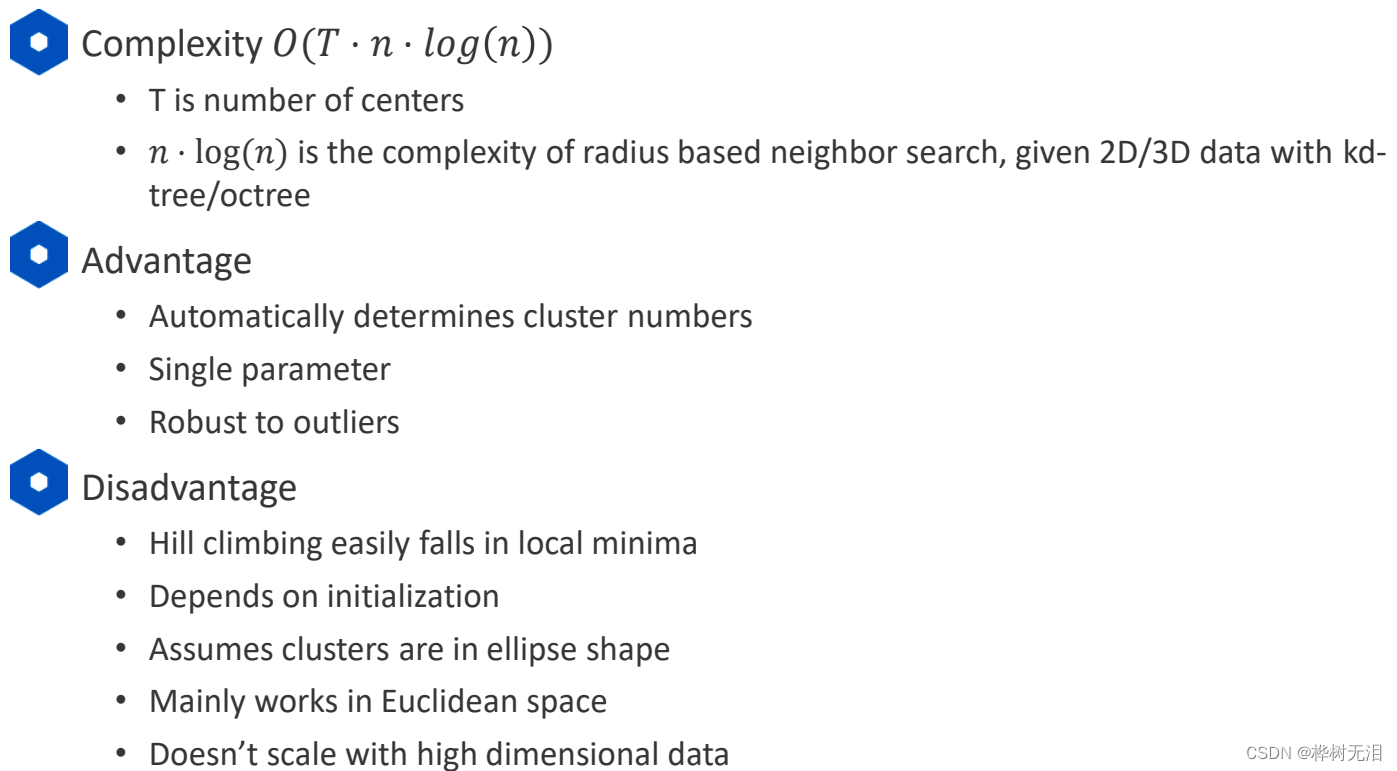

1.4 Mean Shift聚类

核心思想:一堆点,怎样让一个固定半径的圆尽可能的包含较多的点。将圆的中心随便放在一个位置坐标,计算所包含所有点的平均坐标,圆的中心再移动到平均坐标,再次计算包含所有点的平均坐标,如此重复,直到点中心坐标不再改变为止。 其结果并不是最优的。

?

?

- 聚类步骤

输入只需要设定圆的半径,并不需要设定多少类,自动去发现。(爬山思想)

假设分类是椭圆?

?

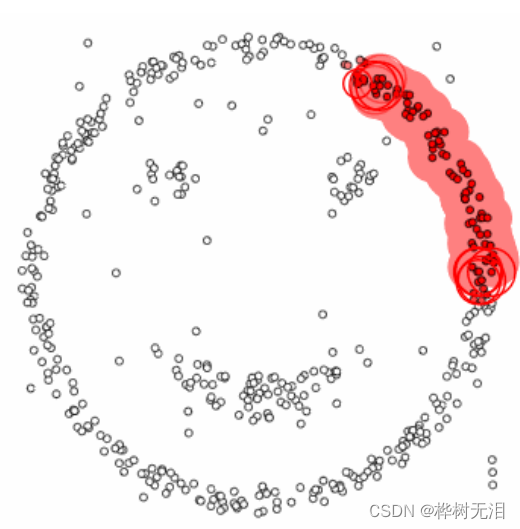

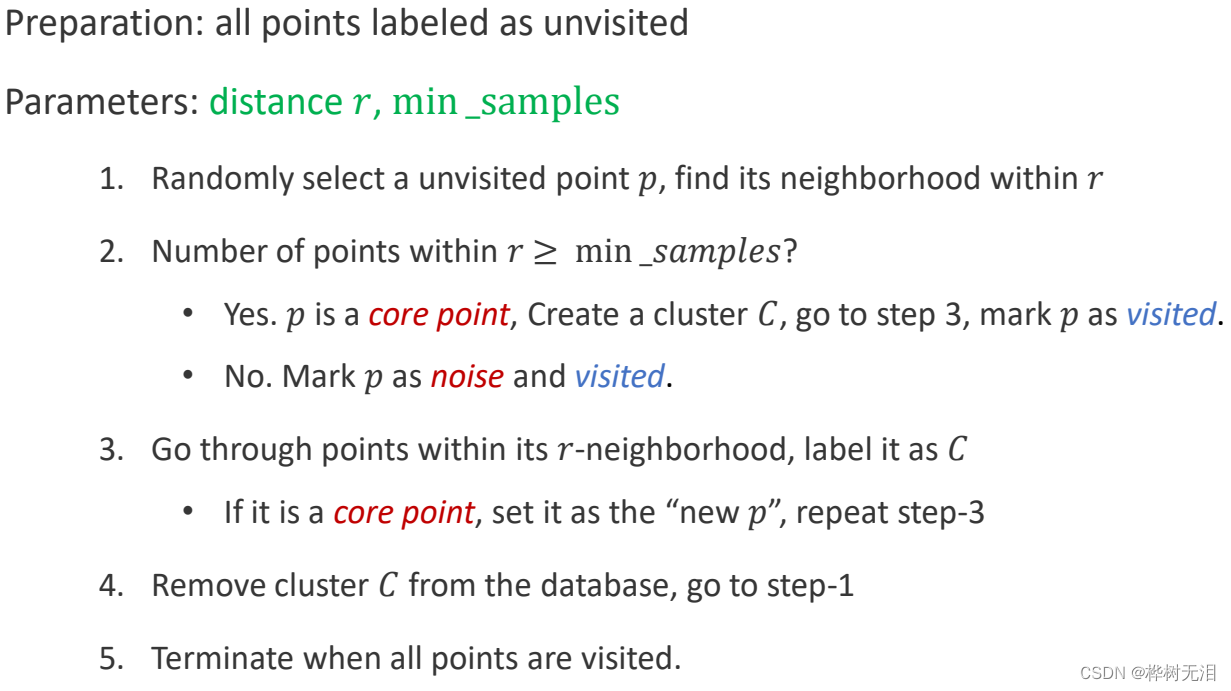

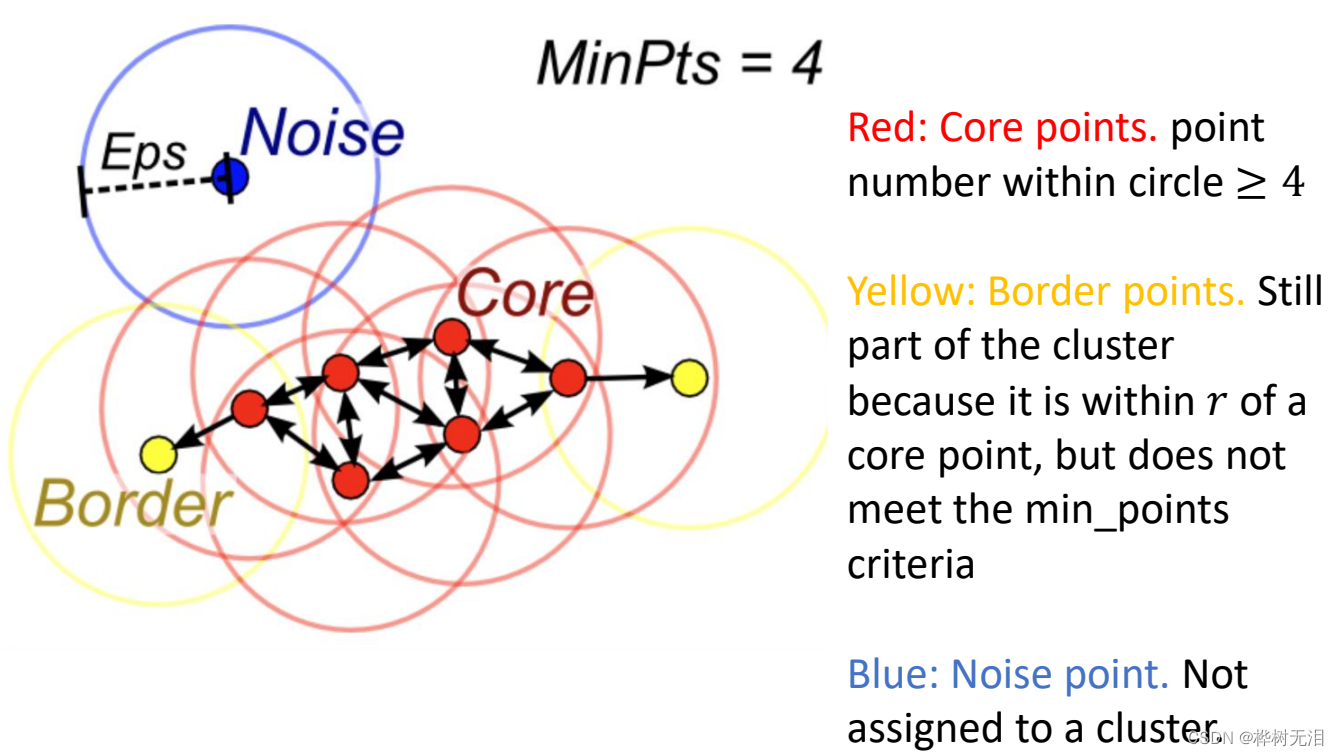

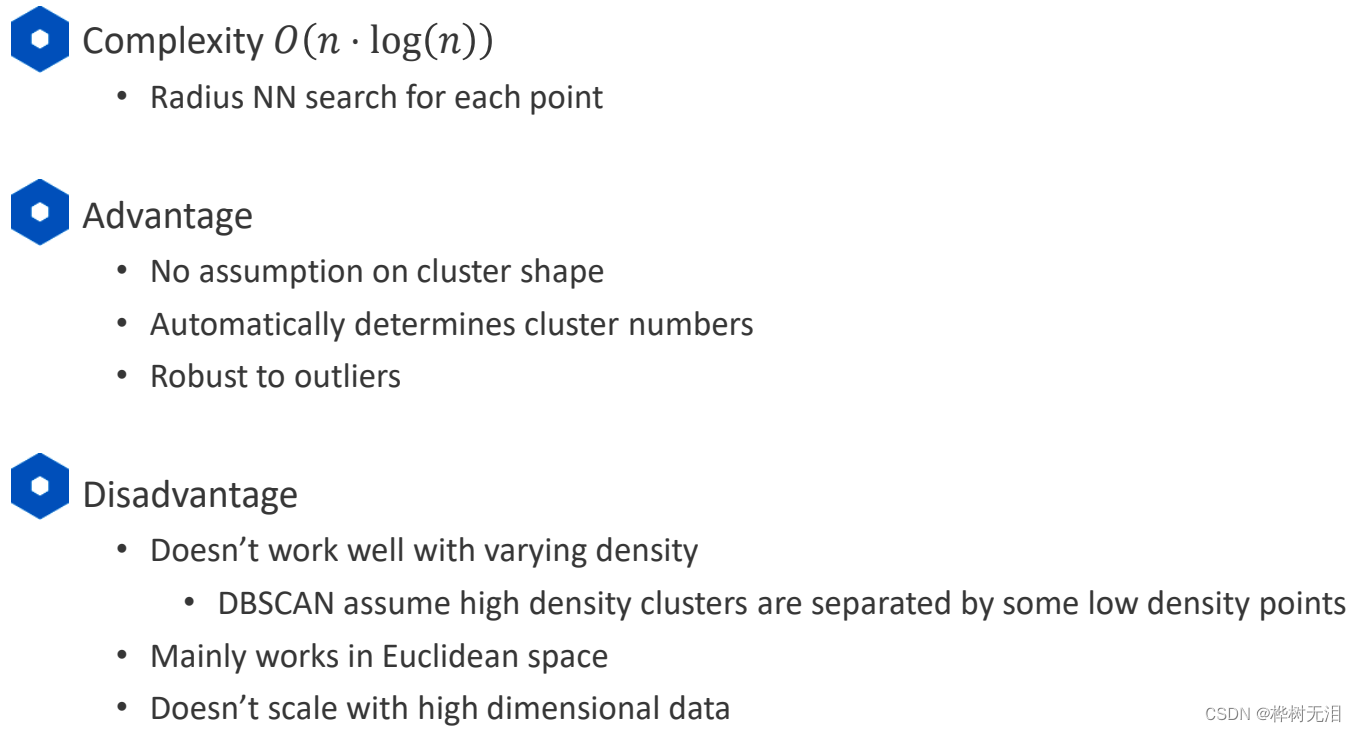

?1.5 DBSCAN

核心思想:水漫金山,基于点与点连接,只要能够连接到就是一类

?

?

?

?

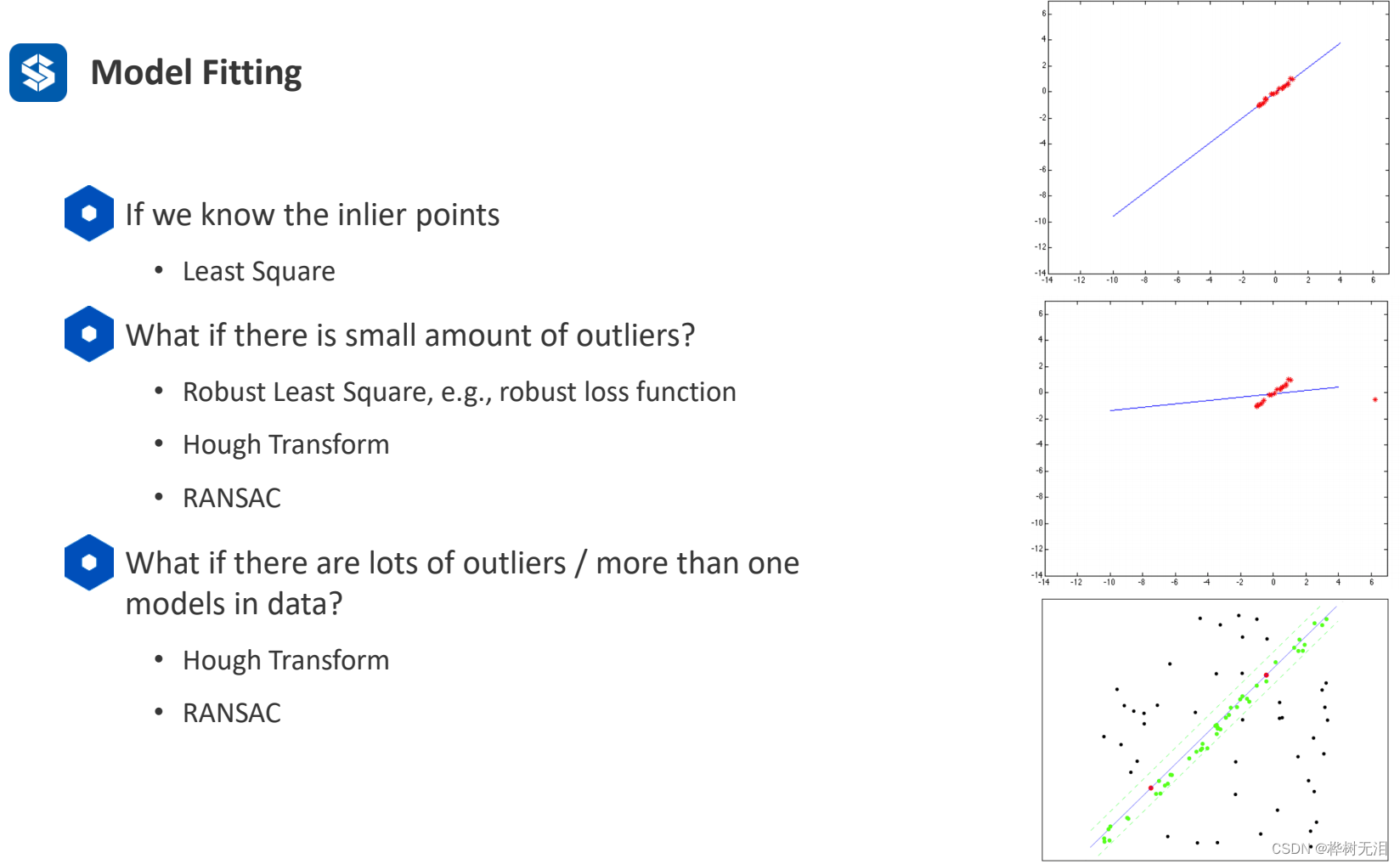

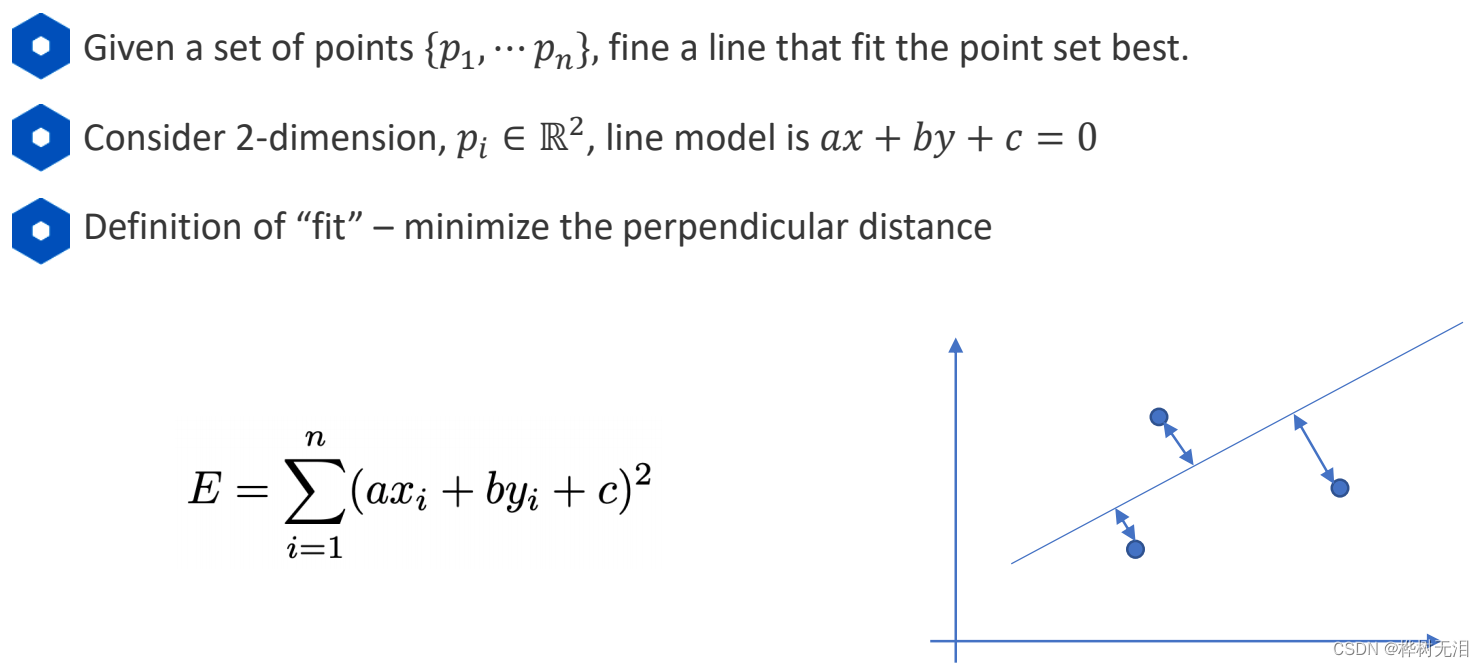

二、模型拟合

适用场景

2.1 最小二乘

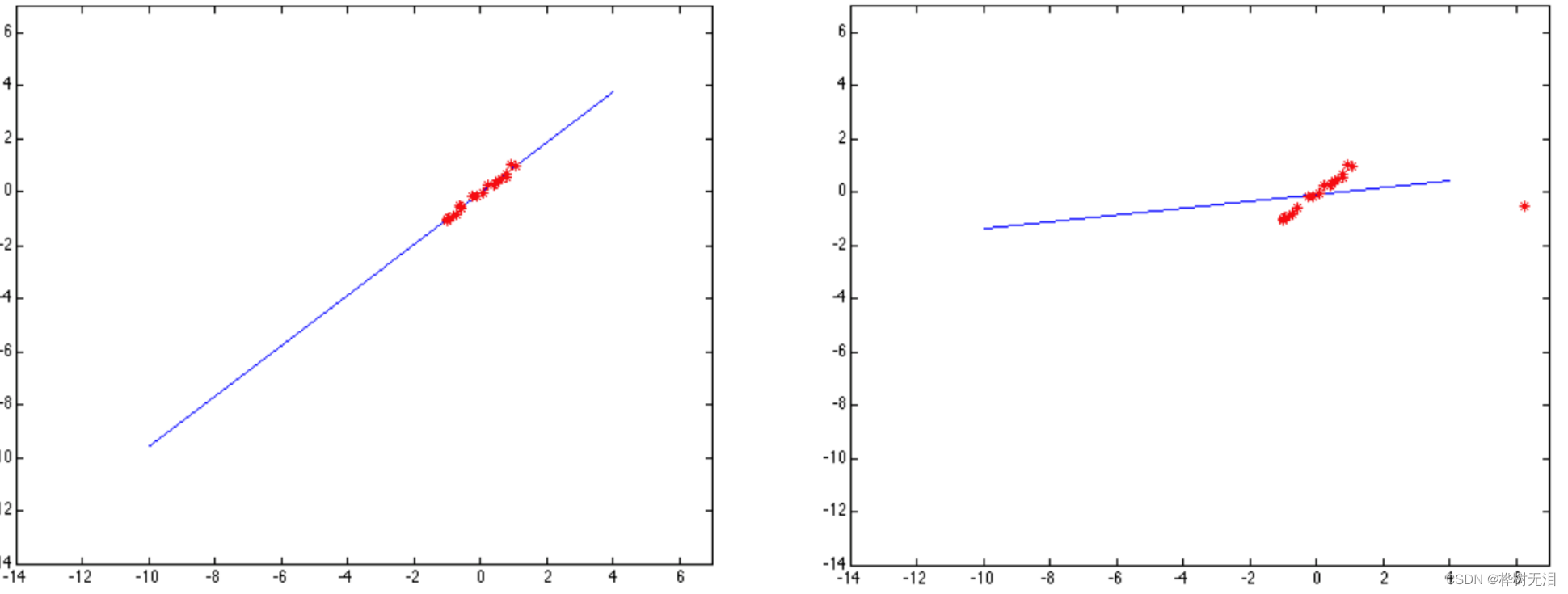

噪点较少

最小二乘对于噪声特别敏感

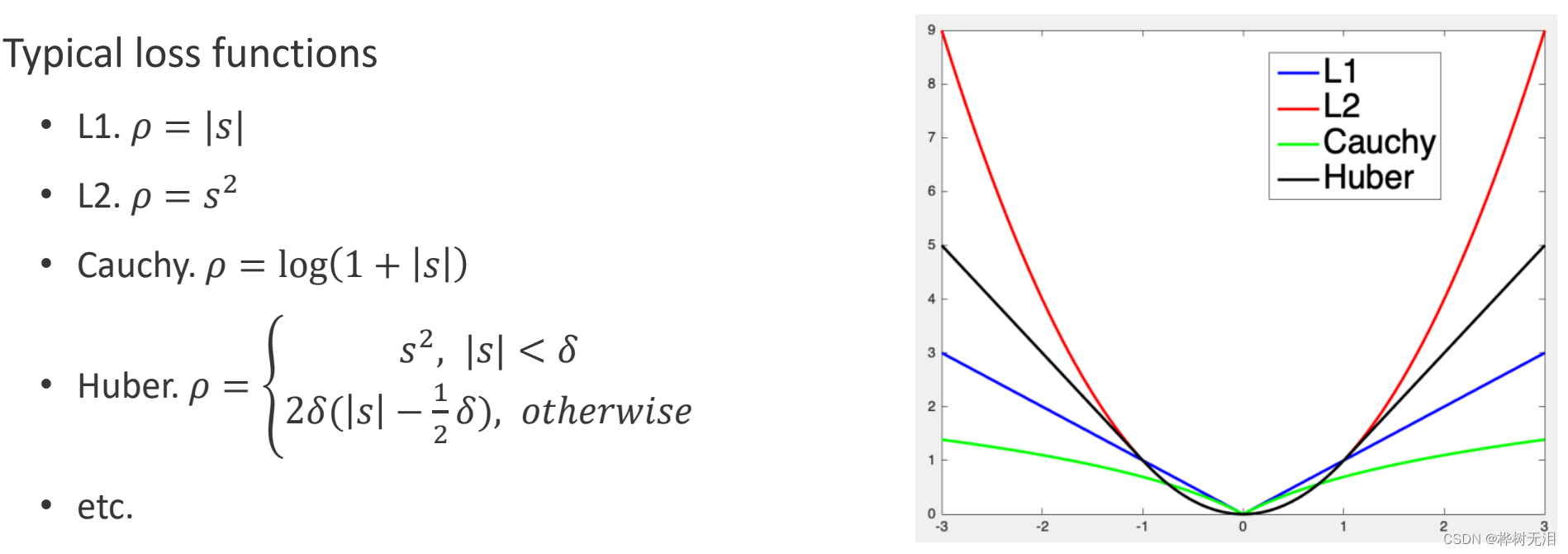

- ?加强版的最小二乘

更换损失函数,不再是线性的

非线性的解法?(类似神经网络)

?

?

?

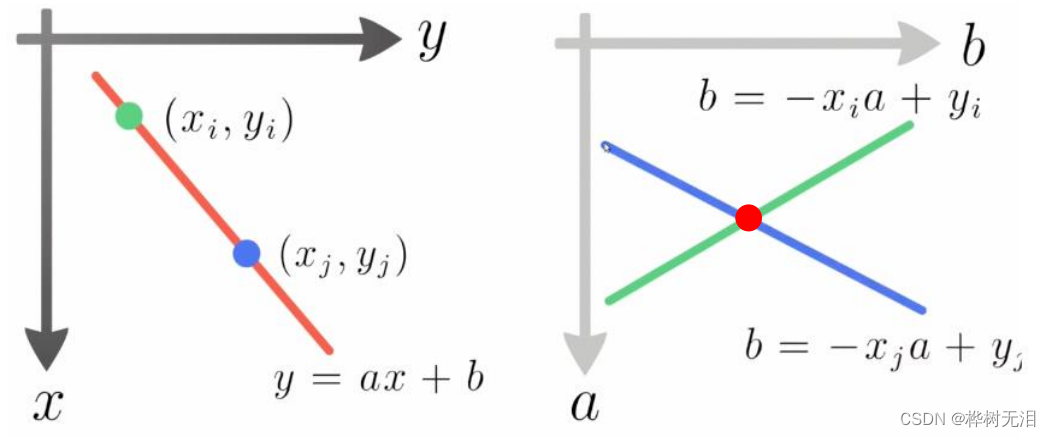

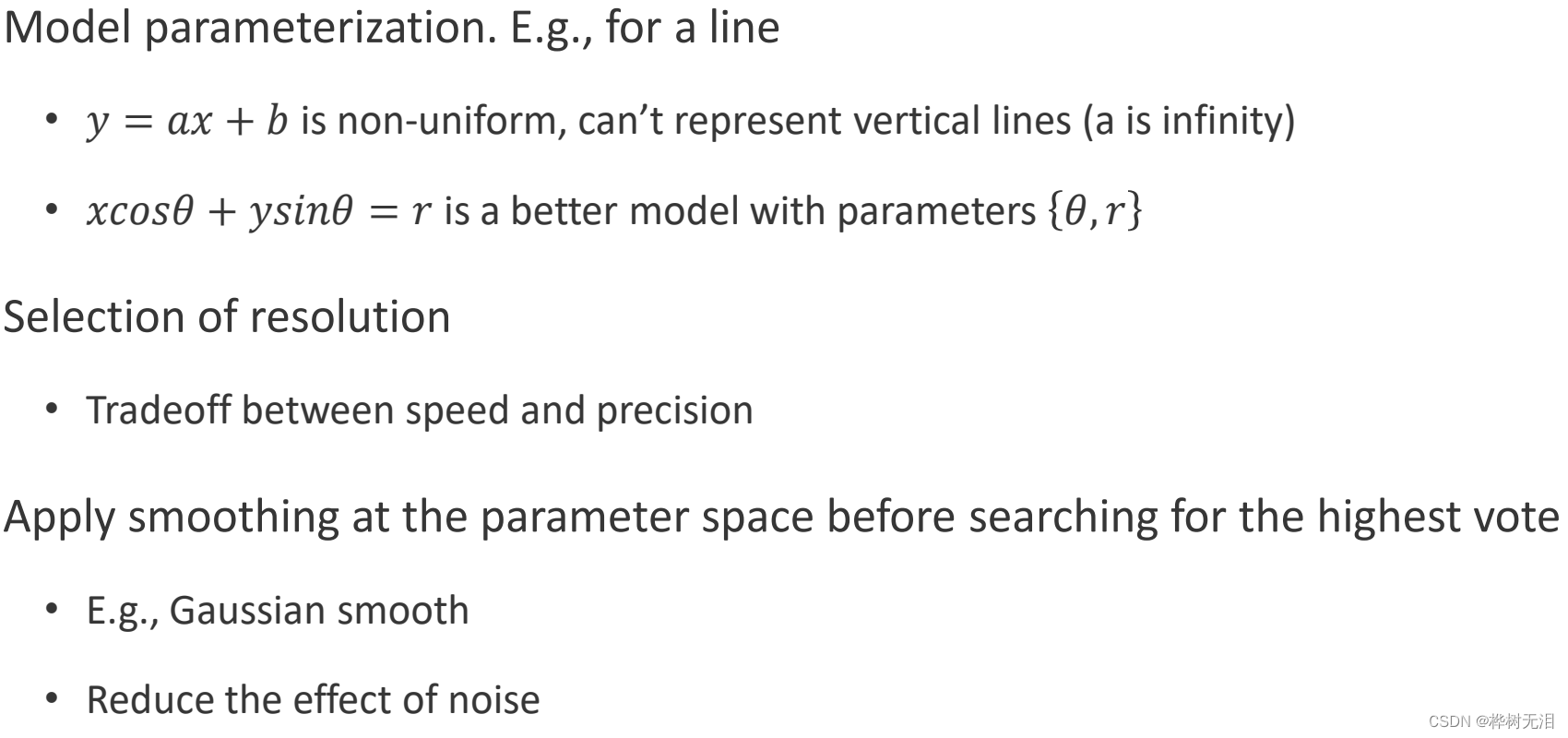

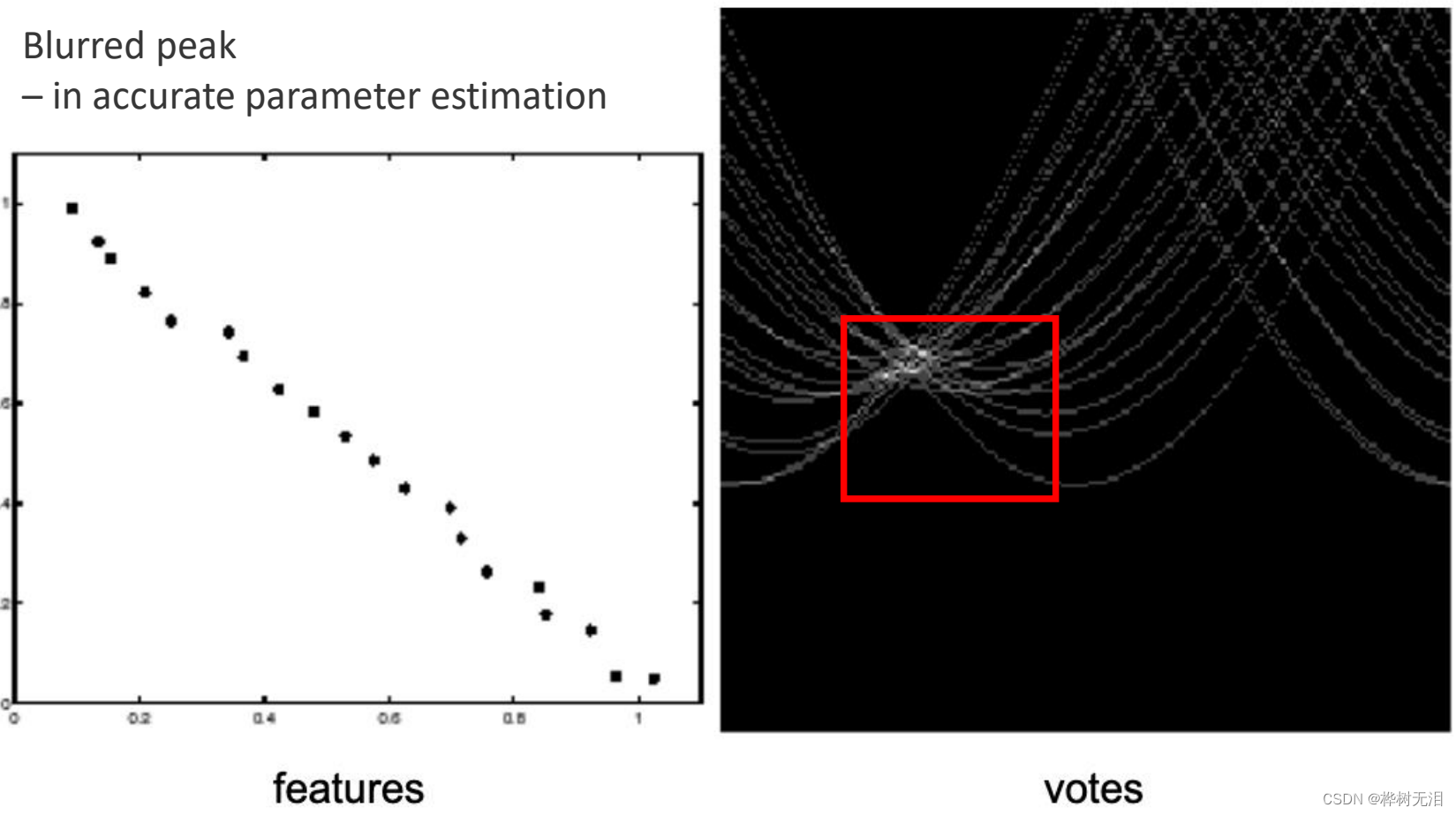

2.2 霍夫变换(Hough Transform)

核心思想:原始空间的点转化为参数空间的线

坐标系变成角度的?

?

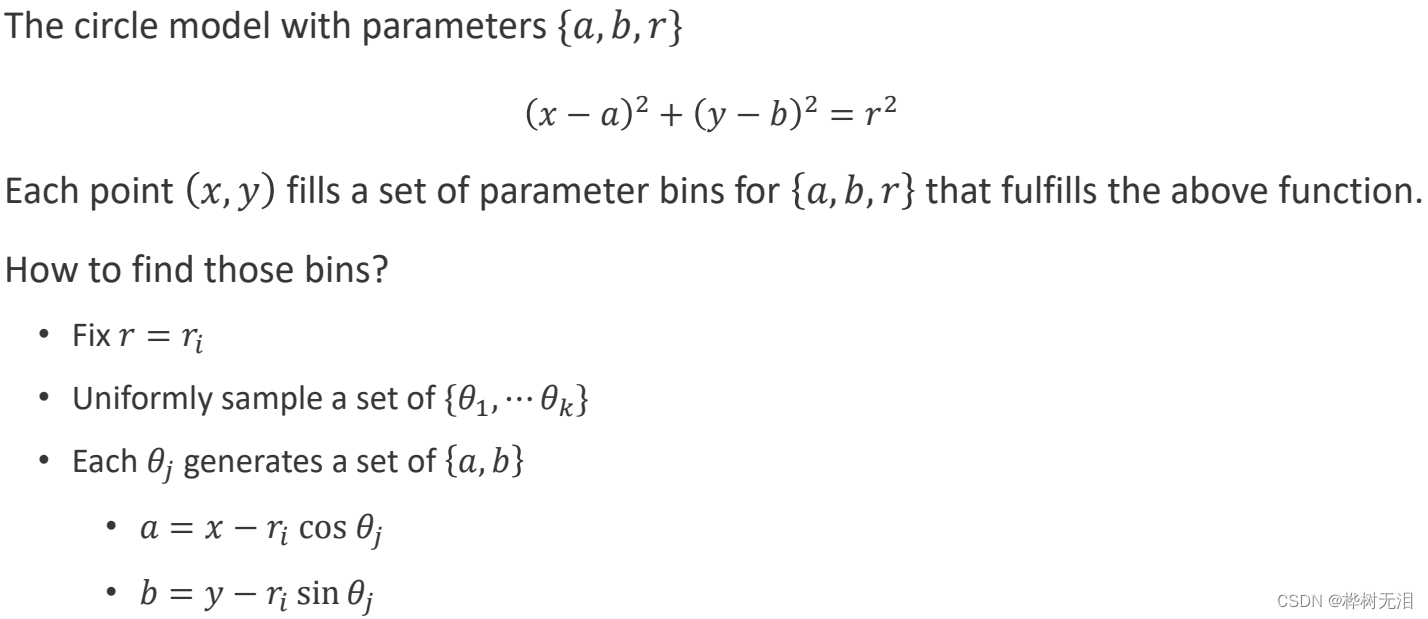

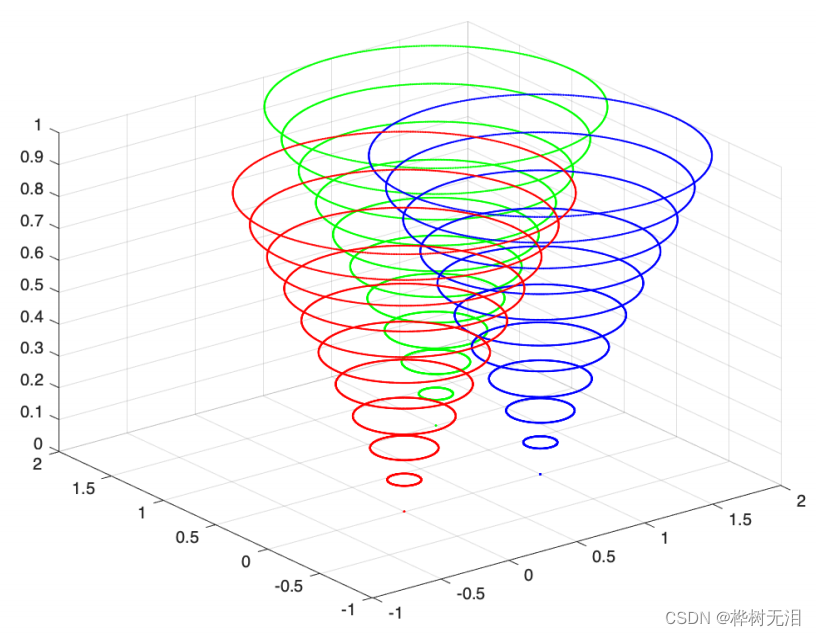

- 三个参数?

?

?

?

?

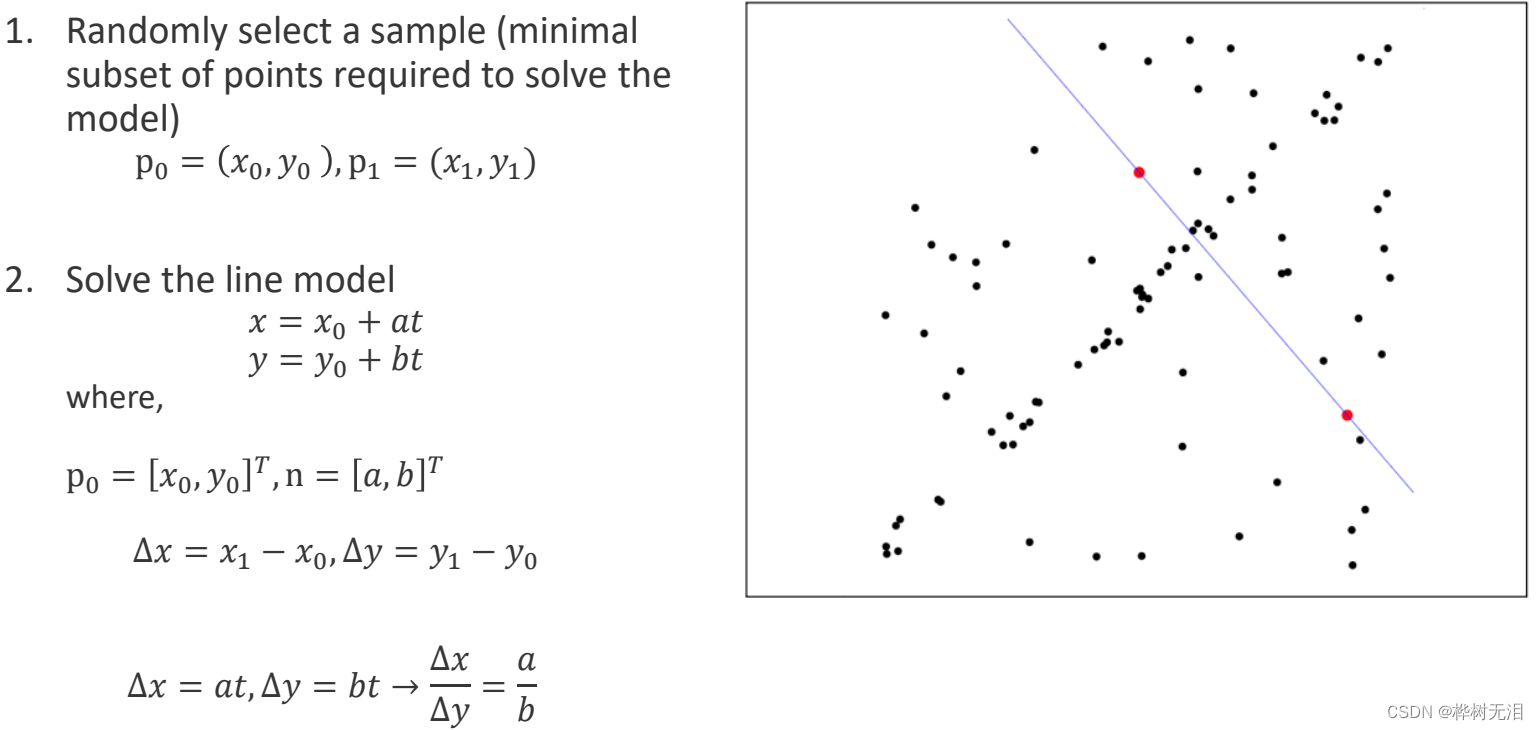

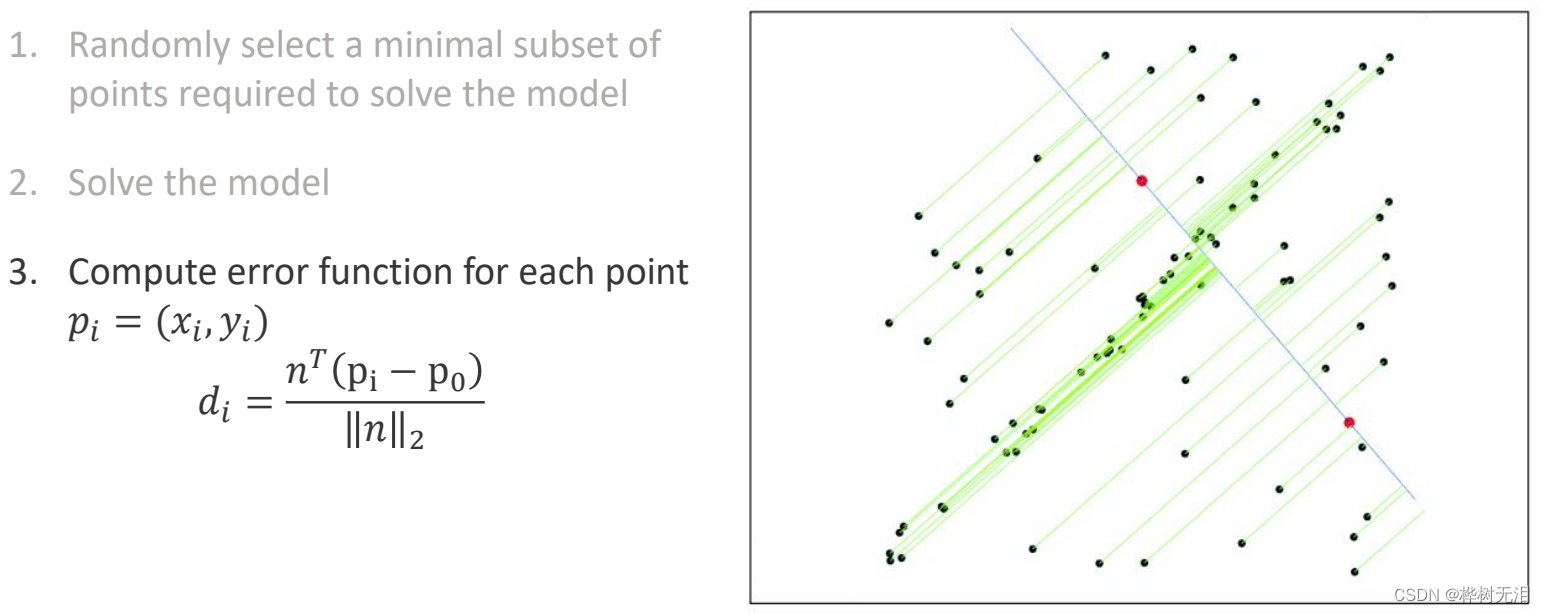

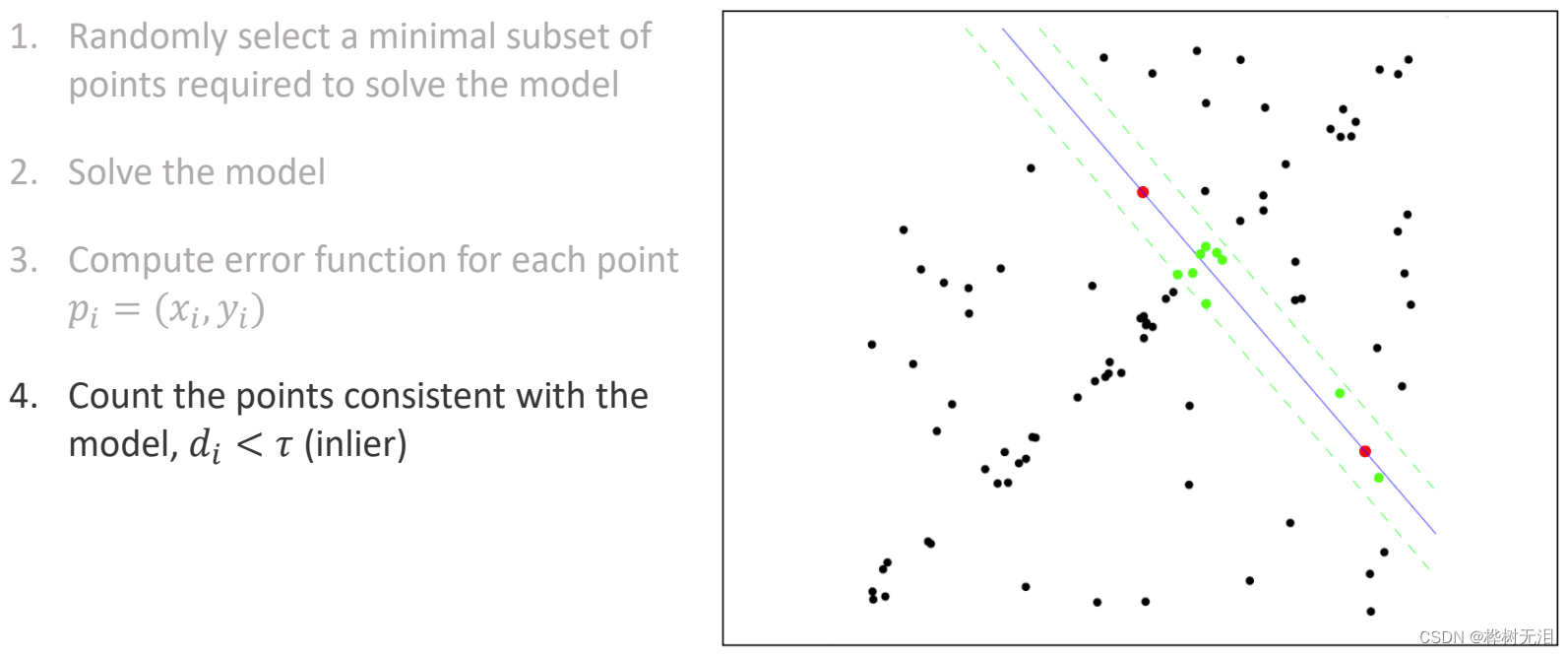

2.3 RANSAC?

每次选两个点计算参数,查看支持者,直到迭代到支持者达到一定的阈值。

每次选两个点计算参数,查看支持者,直到迭代到支持者达到一定的阈值。

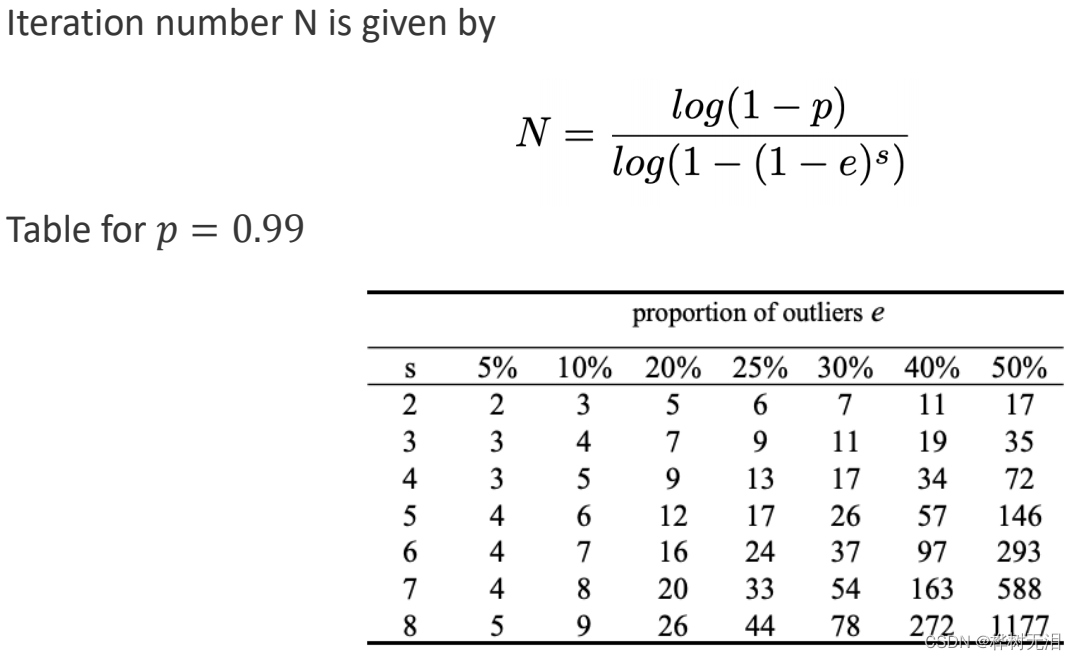

- N:计算迭代多少次能够计算出比较满意的拟合

?一般RANSAC之后可以再用一次最小二乘来优化

?

?

?

?

?