����Ŀ¼

1. ����

LSTM������м���Ĺ���,�������úܳ���������Ϣ������ѧϰģ��,��������������ʱ�����е�Ԥ���������ơ�ʵ�ʲ���������LSTMԤ���������ѵ�:һ��ģ����δ,����ǰ�ڵ�������δ���,�������ν��ܡ�������Ҫ�ο���Դ����ƪ������

2. ģ�ʹ

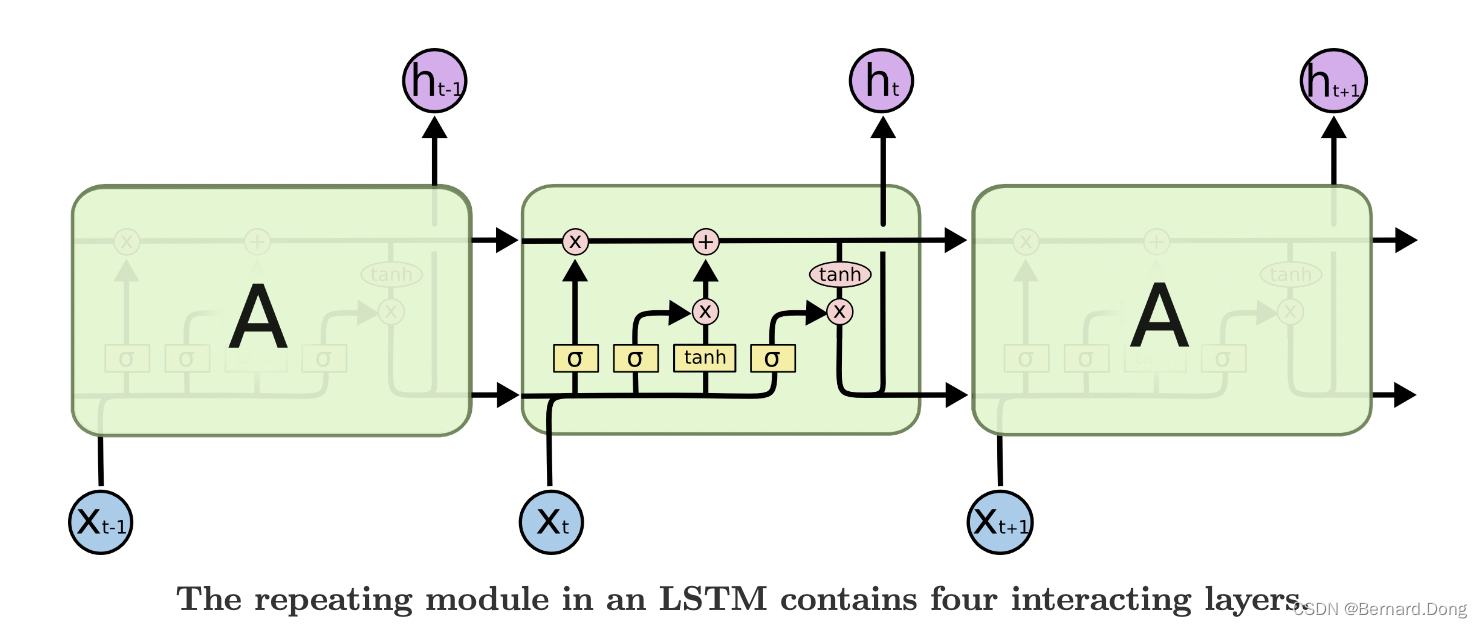

pytorch��������֮ǰ�������ѳ������ܹ�,������ѭ��������,���кܶ���Ҫ����IJ��֡���ͼ��LSTM��Ԫ�Ľṹ,ÿһ�����Ӵ���һ��ʱ�䲽(time-step),�������˽��뿴LSTM��Ԫ����ϸ������

��ô��pytorch�������ʵ�ֵ���?pytorch�е�LSTM�ṹʵ��

2.1 ����LSTM

���������ĺ���Ϊ(�����DZȽϳ��õIJ���):

rnn = nn.LSTM(input_size, hidden_size, num_layers )

- input_size:��������������ݵ�ά��,��������Ϊ����ÿһ�����ݵ�ά�ȡ������������,ÿһ�������е�����ֻ�м۸�,���input_size��1�����ÿһ��������n������,��ôinput_size��n��

- hidden_size:������״̬h����������

- num_layers:����Ҫ�ѵ�����LSTM��,Ĭ��Ϊ1,ʵ��ȡ1��2���ɡ�

- bias �C If False, then the layer does not use bias weights b_ih and b_hh. Default: True

- batch_first �C If True, then the input and output tensors are provided as (batch, seq, feature) instead of (seq, batch, feature). Note that this does not apply to hidden or cell states. See the Inputs/Outputs sections below for details. Default: False

- dropout �C If non-zero, introduces a Dropout layer on the outputs of each LSTM layer except the last layer, with dropout probability equal to dropout. Default: 0

- bidirectional �C If True, becomes a bidirectional LSTM. Default: False

- proj_size �C If > 0, will use LSTM with projections of corresponding size. Default: 0

2.2 LSTM�����������

Inputs: input, (h_0, c_0)

�����������������,һ��input,Ҳ����Ҫ���������,��ṹ�������л���ϸ����,����Ԫ��(h_0, c_0),��������״̬h�͵�Ԫ״̬c�ij�ʼֵ,Ҳ���Բ�д����һ��,��ô��Ĭ��Ϊ0.

Outputs: output, (h_n, c_n)

����ij������ֵoutput,��������(h_n, c_n),����ǰ������״̬�͵�Ԫ״̬��

output, (hn, cn) = rnn(input, (h0, c0))

2.3 ���罨��

�����������һ��,������˾����㻹Ҫ����ȫ���Ӳ�,LSTM��Ҳ�����,��LSTM��ȫ���Ӳ�Ҳ���Կ�����һ���ع���� regression��

LSTM+һ��ȫ���Ӳ�ļ�����:

class RegLSTM(nn.Module):

def __init__(self, inp_dim, out_dim, mid_dim, mid_layers):

super(RegLSTM, self).__init__()

self.rnn = nn.LSTM(inp_dim, mid_dim, mid_layers) # rnn

self.reg = nn.Sequential(

nn.Tanh(),

nn.Linear(mid_dim, out_dim),

) # regression

def forward(self, x):

y = self.rnn(x)[0]

y = self.reg(y)

return y

���ǵ������ڴ˻��������˵���,һ��������һ�����Բ�,������������������ʱ�����˽�ά�ͻָ��IJ���,����������һ��output_y_hc()������

class RegLSTM(nn.Module):

def __init__(self, inp_dim, out_dim, mid_dim, mid_layers):

super(RegLSTM, self).__init__()

self.rnn = nn.LSTM(inp_dim, mid_dim, mid_layers) # rnn

self.reg = nn.Sequential(

nn.Tanh(),

nn.Linear(mid_dim, mid_dim),

nn.Tanh(),

nn.Linear(mid_dim, out_dim)

) # regression

def forward(self, x):

y = self.rnn(x)[0] # y, (h, c) = self.rnn(x)

seq_len, batch_size, hid_dim = y.shape

y = y.view(-1, hid_dim) #��ά

y = self.reg(y)

y = y.view(seq_len, batch_size, -1) #�ָ�ԭ����ά��

return y

def output_y_hc(self, x, hc):

y, hc = self.rnn(x, hc) # y, (h, c) = self.rnn(x)

seq_len, batch_size, hid_dim = y.size()

y = y.view(-1, hid_dim)

y = self.reg(y)

y = y.view(seq_len, batch_size, -1)

return y, hc

����������ǰ�Ľ�ά����������ٶ�,��output_y_hc()������forward()����,����������������ʱ��������(h,c),���������Ҫ����ѵ�����Ԥ��,�������ϸ˵����

3. ʱ�����ݴ���

3.1 ��������ģʽ

ʱ��������δ���,��pytorch��LSTM�������������ʽ�й�,�����ᵽ��input,����������ģʽ,����

- L:���г���,����ʱ�䳤��

- M:��������ݵ�ά��,ͬ����input_size

- N:batch_size������,����ὲ����

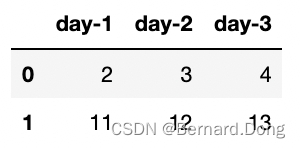

- ����ģʽ:����ά��(L, M)���ٸ�����,����������,ÿ��������ά�ȵ�����,��ôL=3,M=2,���Ҫ�������

tensor([[ 2, 11],[ 3, 12],[ 4, 13]])��

- ����ģʽһ:������

batch_first=Falseʱ(Ĭ��״̬),����ά��Ϊ(L, N, M)��������ͼ�������,ʱ���������,�������뽫���Ϊ��������(day-1, day-2)��(day-1, day-2, day-3),����L=3,N=2,M=2�����Ҫ���������,ע��������pad_sequence�����˲��������

tensor([[[ 2, 11],

[ 3, 12]],

[[ 3, 12],

[ 4, 13]],

[[ 4, 13],

[ 0, 0]]])

- ����ģʽ��:������

batch_first=Trueʱ,����ά��Ϊ(N, L, M,),���Ҫ��������¡�

tensor([[[ 2, 11],

[ 3, 12],

[ 4, 13]],

[[ 3, 12],

[ 4, 13],

[ 0, 0]]])

3.2 ��һ���뷴��һ��

ʵ��֤��,���ѵ��ǰ�������ݵĹ�һ���뷴��һ������,���ܻ��ý�������ϴ�ƫ�������MaxMin��һ������,��Ҫע��һ��,���ǵ�����,Ҳ�������ֵ��СֵҪ��ѵ�����ݱ���һ�¡�

def minmaxscaler(x):#ѵ�����ݹ�һ��

minx = np.amin(x)

maxx = np.amax(x)

return (x - minx)/(maxx - minx), (minx, maxx)

def preminmaxscaler(x, minx, maxx):#��ѵ�����ݵ����ֵ��Сֵ��һ��Ԥ������

return (x - minx)/(maxx - minx)

def unminmaxscaler(x, minx, maxx):#Ԥ����ϵ����ݷ���һ��

return x * (maxx - minx) + minx

3.3 X��Y��ʲô

����ʱ������,���ǻ���һ������,����ѵ��ʱ���������ͱ�ǩ����ʲô,����˵X��Y����ʲô?

���������ǵĴ�����:ǰһ��ʱ����ΪX,��һ��ʱ����ΪY,ȡtime_diff=1���������ǵ�ʱ�䲽��1 2 3 4 5 6 7,����һ��X�Ϳ���ȡ1 2 3 4,��Ӧ��YΪ2 3 4 5��

3.4 ����ģʽ

����ԭʼ����Ϊ[[1,2],[3,4,5],[6,7,8,9]] ,pad_sequence()���Խ���ת��Ϊ����ģʽһ:

tensor([[1, 3, 6],

[2, 4, 7],

[0, 5, 8],

[0, 0, 9]])

pad_sequence(batch_first=False)����ת��Ϊ����ģʽ��:

tensor([[1, 2, 0, 0],

[3, 4, 5, 0],

[6, 7, 8, 9]])

����ģʽ�ǽ�ʱ�������и��С�ν���ѵ��,��Ŀ���dz������ԭ���ݵ���Ϣ,���ǵ���Ŀʹ�õ�Ҳ������ģʽ������ʱ�䲽��150,ѵ������100,ÿһ��ʱ�����Ӧһ��ֵ,���Ƕ���һ������Ϊ40��ʱ�䴰��,ÿ������ʱ��ȡΪһ����,һ����20��,��batch_size=20,Ȼ��ת��Ϊ����ģʽһ��

#����Ԥ���� ��һ��

train_x, train_x_minmax = minmaxscaler(data_x[:train_size])

train_y, train_y_minmax = minmaxscaler(data_y[:train_size])

#ת��Ϊtensor��ʽ

train_x = torch.tensor(train_x, dtype=torch.float32, device=device)

train_y = torch.tensor(train_y, dtype=torch.float32, device=device)

#��ʱ�����ݽ����и����

window_len = 40

batch_x,batch_y=list(),list()

for i in range(len(train_x),window_len,-3):

batch_x.append(train_x[i-window_len:i])

batch_y.append(train_y[i-window_len:i])

#����ģʽһ

batch_x = pad_sequence(batch_x)

batch_y = pad_sequence(batch_y)

���õ���batch_x��batch_y��ά�Ⱦ�Ϊ(40,20,1)��Ӧ������֮ǰ˵��(L, N, M)��

4. ģ��ѵ��

ģ��ѵ������������������һ��,��������:

# ����ģ��

net = RegLSTM(inp_dim=1, out_dim=1, mid_dim=16, mid_layers=2)#����ģ��

loss = nn.MSELoss()#������ʧ����

optimizer = torch.optim.Adam(net.parameters(), lr=1e-2)#�����Ż���

# ��ʼѵ��

print("Training......")

for e in range(1000):

out = net(batch_x)#��ǰ����

Loss = loss(out, batch_y)#������ʧ

optimizer.zero_grad()#�ݶ�����

Loss.backward()#����

optimizer.step()#�ݶȸ���

if e % 10 == 0:

print('Epoch: {:4}, Loss: {:.5f}'.format(e, Loss.item()))

5. Ԥ��

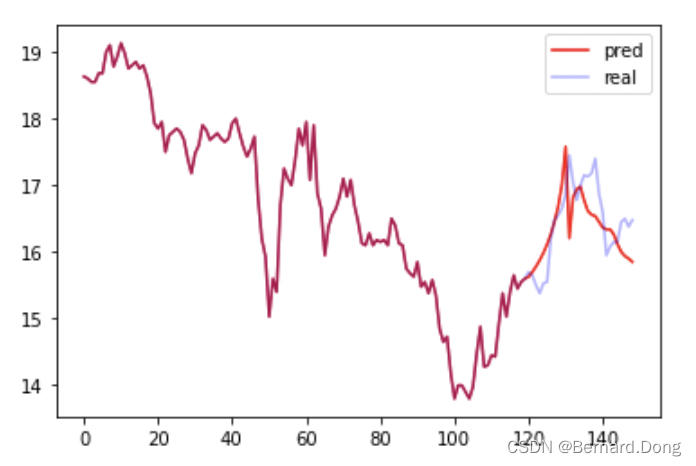

Ԥ���˼·����˵��������ʱ�䲽1 2 3 4 5,��Ԥ���6,Ȼ����1 2 3 4 5 6Ԥ��7,�Դ����ơ����Կ����������ÿһ�ζ���Ҫ������������������,����������ܰ�ÿһ����ǰ����Ϣ(h,c)��������,��һ���Ͳ����ظ�ǰ��IJ����ˡ���������ǰ���ᵽ��output_y_hc()����������ʱ��ʹ�õġ�

#�����ʼ״̬

zero_ten = torch.zeros((mid_layers, eval_size, mid_dim), dtype=torch.float32)

#Ԥ��

test_len = 40

for i in range(train_size, len(new_data_x)): # ҪԤ�����i

test_x = new_data_x[i-test_len:i, np.newaxis, :]

test_x = preminmaxscaler(test_x, train_x_minmax[0], train_x_minmax[1])

batch_test_x = torch.tensor(test_x, dtype=torch.float32, device=device)

if i == train_size:

test_y, hc = net.output_y_hc(batch_test_x, (zero_ten, zero_ten))

else:

test_y, hc = net.output_y_hc(batch_test_x, hc)

# test_y = net(batch_test_x)

predict_y = test_y[-1].item()

predict_y = unminmaxscaler(predict_y, train_x_minmax[0], train_y_minmax[1])

new_data_x[i] = predict_y

ѵ���˼���,ÿ�ν������̫һ��,ȡ��һ����Բ����ġ�����ʹ�õ���ԭ�ͼ۸�,����ԱȽϴ�,����ǹ�����ǿ������Ч����õöࡣ