一、相关的补充知识

1.如何通俗的对深度学习中的语义信息进行理解?

在深度学习中,语义信息可以通俗的理解成是图像的纹理,颜色,或者目标的类别等信息,例如在检测网络中,一个图像输入到网络中,经过一层层的卷积之后,语义信息会越来越明显,但是相对的位置信息会越来越弱,因为越到高层卷积的时候,feature map映射到原图中的感受野越大,这样对局部的位置信息感受就比较差。

二、How much Position Information Do Convolutional Neural Networks Encode

一般来讲,我们的常规认识是:随着卷积层的增多,尤其是使用pooling层,导致图像中目标的位置信息都被丢弃了。

然而,事实上并不是会这样。这篇论文的研究成果告诉我们。位置信息没有丢失,只是跟语义信息共享特征了。我们之所以没有过多的去研究位置信息,只是因为目前的针对CNN的使用并没有迫切的需要使用位置信息。

这篇文章只回答了CNN存储了位置信息,但是并没有给出如何有效提取位置信息,只是告诉我们在图像中为增加zero-padding可以帮助CNN提取位置信息,或者说更关注位置信息。

从原图中提取位置信息是非常困难的。但是经过神经网络的编码,提取到了一致的位置信息。而测试集结果的高性能表达,表明了模型并非是盲目地拟合噪声,而是提取了真实的位置信息。

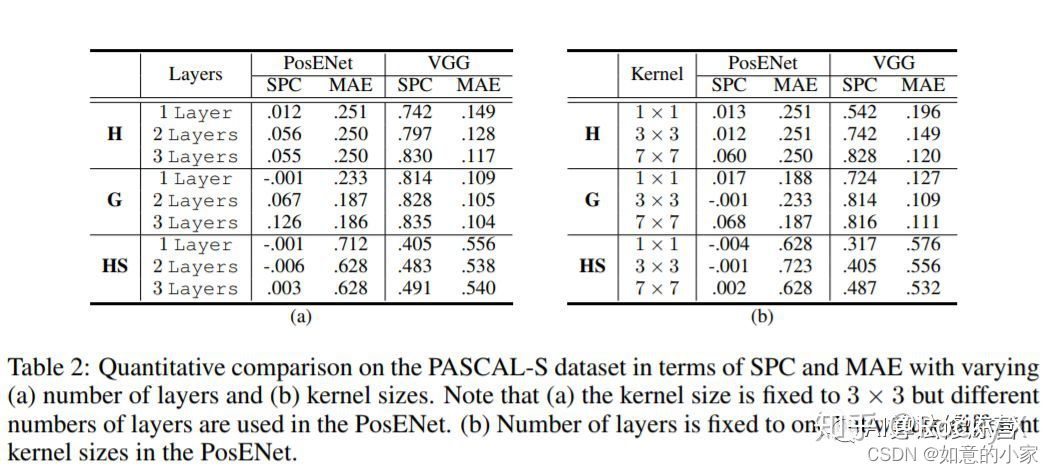

卷积核堆叠层数:如上面(a)结果所示,堆叠多层卷积可以提高网络的位置信息读取。原因可能是多个卷积层堆叠,增加了感受野。

扩大卷积核尺寸:从结果(b)可知更大的核尺寸可能会捕获更多的位置信息,这也和上面堆叠卷积层数相呼应,都是增加了感受野。

特征层的影响:与浅层的特征相比,深层的特征可获得更高的性能。但这里还有一个变量是各个层的空间通道数不一样,因此控制变量,使得具有相同的特征来对比明确了位置信息在网络深层有更强的编码。