CIFAR10Ъ§ОнМЏНщЩм

10Рр,УПвЛРрга6000еХееЦЌ,50000еХtraining,10000еХtestЁЃ

ЪЕР§

ДгdatasetsАќжаМгдиЪ§ОнМЏ,ЪЙгУtransformsАќНјааБфЛЛ,ЭЈЙ§resizeЛёШЁЭМЦЌЮЌЖШ,дйАбЭМЦЌзЊЛЛГЩtensor,вђЮЊpytorchЕФЪ§ОнРраЭЖМЪЧtensorЁЃ

cifar_trainвЛДЮМгдивЛеХ,ЮвУЧашвЊЪЙгУDataLoaderМгдивЛДЮвЛХњЁЃжБНгИВИЧаДМДПЩЁЃ

cifar_train = datasets.CIFAR10('cifar', True, transform=transforms.Compose([

transforms.Resize((32, 32)),

transforms.ToTensor()

]), download=True)

cifar_train = DataLoader(cifar_train, batch_size=batchsz, shuffle=True)

cifar_test = datasets.CIFAR10('cifar', False, transform=transforms.Compose([

transforms.Resize((32, 32)),

transforms.ToTensor()

]), download=True)

cifar_test = DataLoader(cifar_test, batch_size=batchsz, shuffle=True)

ЭЈЙ§iterЗНЗЈЕУЕНDataLoaderЕФЕќДњЦї,дйЪЙгУЕќДњЦїЕФnextЗНЗЈЕУЕНвЛИіbatchЁЃ

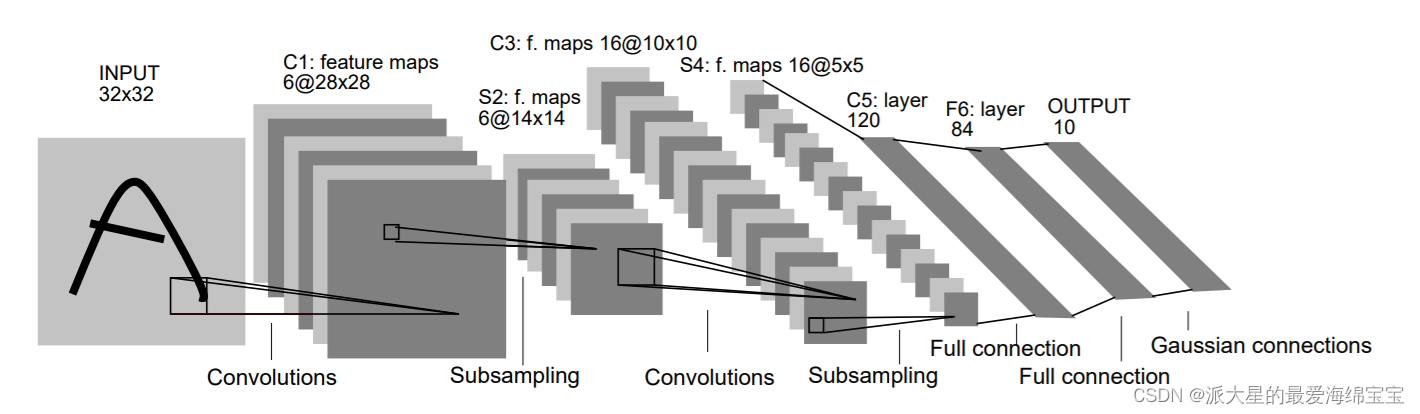

НгЯТРДаТНЈвЛИіРр,lenet5,ОэЛ§ЩёОЭјТчЕФзюМђЕЅЕФвЛИіАцБОЁЃ

ЕквЛВуЪЧОэЛ§Ву,ЕквЛИіОэЛ§ВуЪфШыЮЌЖШЪЧееЦЌЕФЮЌЖШ,cifarЪЧВЪЩЋееЦЌЁЃ

ЕкЖўВуЪЧsubsampling,ЪЧвЛИіpoolingВуЁЃ

гжвЛИіОэЛ§Ву,poolingВЛИФБфchannel,ЪфШывРШЛЪЧ6ЁЃ

ШЋСЌНгВуЪБ,ЪфШыЮЌЖШЪЧ4ЮЌЕФ,ЮвУЧашвЊДђЦН,ЕЋЪЧpytorchжаУЛгаздДјЕФFLattenКЏЪ§,ЕЋЪЧSequentialжаашвЊаДМШгаЕФРр,ЫљвдЮвУЧаДСНИіunitЁЃ

self.conv_unit=nn.Sequential(

# x:[b,3,32,32]->[b,6,]

nn.Conv2d(3,6,kernel_size=5,stride=1,padding=0),

nn.AvgPool2d(kernel_size=2,stride=2,padding=0),

#

nn.Conv2d(6,16,kernel_size=5,stride=1,padding=0),

nn.AvgPool2d(kernel_size=2,stride=2,padding=0),

#

)

ДђЦН

ДђЦНКѓ,ПДНсЙЙЭМЪЧ120Ву,ШЋСЌНгВуЪЧLinearЁЃМЄЛюКЏЪ§вЛАубЁдёsigmodКЭrelu,ЖјsigmodЛсГіЯжЬнЖШРыЩЂЯжЯѓ,ЫљгабЁдёreluЁЃ

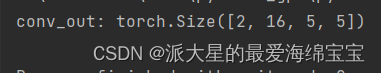

ЮвУЧМЦЫувЛаЉЪфШыЪфГіжЕ,ЪЙгУвЛИіР§згtmp,ЫЭШыЕквЛИіunitдЫааЁЃ

self.fc_unit=nn.Sequential(

nn.Linear(16*5*5,120),

nn.ReLU(),

nn.Linear(120,84),

nn.ReLU(),

nn.Linear(84,10)

)

# x:[b,3,32,32]

tmp=torch.randn(2,3,32,32)

out=self.conv_unit(tmp)

# x:[b,16,5,5]

print('conv_out:',out.shape)

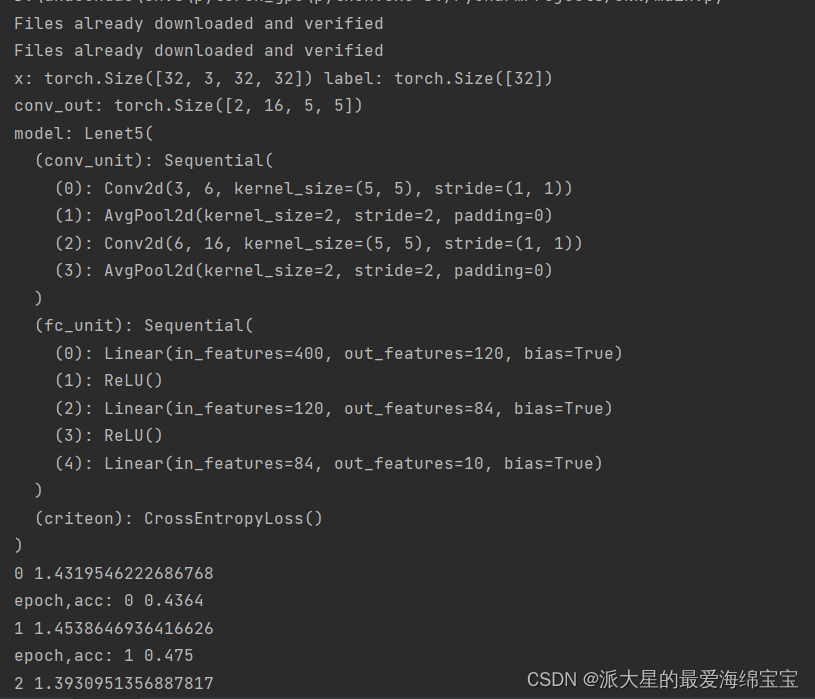

УПвЛИіЭјТчНсЙЙЖМашвЊвЛИіforwardЧАЯђМЦЫу,ЧвВЛашвЊbackward,здЖЏЛсгаЁЃ

def forward(self,x):

batchsz=x.size(0)

# x:[b,3,32,32]->[b,16,5,5]

x=self.conv_unit(x)

# [b,16,5,5]->[b,16*5*5]

x=x.view(batchsz,16*5*5)

# [b,16*5*5]->[b,10]

logits=self.fc_unit(x)

# pred=F.softmax(logits,dim=1)

#yЪЧЮвУЧЕФЪфГі,ашвЊСэЭтв§Шы

# loss=self.criteon(logits,y)

return logits

ЮвУЧШЁУћзжНаlogits,вЛАудкОЙ§softmaxжЎЧАЕФЪ§НаlogitsЁЃpredКЭlogitsЕФЧјБ№дкгкpredЪЧlogitsОЙ§softmaxВйзїЁЃ

ЪЙгУloss,ЮвУЧетЪЧИіЗжРрЮЪЬт,ЭЈГЃЪЙгУcross entropy lossЁЃ

softmaxКЭlossЕФВйзїНазіCELoss

nnЩЯУцЕФРрЪЧДѓаДЕФ,FЩЯУцЕФРрЪЧаЁаД,СНепЕФЧјБ№ЪЧnnЩЯУцЕФРрЯШвЊГѕЪМЛЏвЛЯТ,дйдкforwardРяУцЕїгУ,FРяУцЕФРрЪЧжБНгдЫааЕФКЏЪ§,ЮвУЧПЩвджБНгДњШыЪ§жЕЪЙгУЁЃ

total_correct+=torch.eq(pred,label).float().sum().item()

eqКЏЪ§НјааЖдБШ,[2 1 1 2 1]ЕФзЊжУгы][2 0 0 1 2]ЕФзЊжУНјааЖдБШ,Д№АИЪЧ[1 0 0 0 1]ЕФзЊжУ,floatКѓдйЯрМгПЩЕУ2ЁЃ

ЭъећДњТы

import torch

from torch.utils.data import DataLoader

from torchvision import datasets

from torchvision import transforms

from torch import nn,optim

from lenet5 import Lenet5

def main():

batchsz = 32

cifar_train = datasets.CIFAR10('cifar', True, transform=transforms.Compose([

transforms.Resize((32, 32)),

transforms.ToTensor()

]), download=True)

cifar_train = DataLoader(cifar_train, batch_size=batchsz, shuffle=True)

cifar_test = datasets.CIFAR10('cifar', False, transform=transforms.Compose([

transforms.Resize((32, 32)),

transforms.ToTensor()

]), download=True)

cifar_test = DataLoader(cifar_test, batch_size=batchsz, shuffle=True)

x,label=iter(cifar_train).next()

print('x:',x.shape,'label:',label.shape)

device = torch.device('cuda')

model=Lenet5().to(device)

criteon=nn.CrossEntropyLoss().to(device)

optimizer=optim.Adam(model.parameters(),lr=1e-3)

print('model:',model)

for epoch in range(1000):

model.train()

for batchsz,(x,label) in enumerate(cifar_train):

#x:[b,3,32,32]

#[b]

x,label=x.to(device),label.to(device)

logits=model(x)

#logits:[b,10]ашвЊИјГіИХТЪЁЃ

#label:[b]

#loss:tensor scalar

loss=criteon(logits,label)

#backprop

optimizer.zero_grad()

loss.backward()

optimizer.step()

#

print(epoch,loss.item())

model.eval()

with torch.no_grad():

#test

total_correct=0

total_num=0

for x,label in cifar_test:

x, label = x.to(device), label.to(device)

#[b,10]

logits=model(x)

#ШЁlogitsзюДѓЕФЕузїЮЊpred:[b]

pred=logits.argmax(dim=1)

#[b] vs [b]-> scalar tensor

total_correct+=torch.eq(pred,label).float().sum().item()

total_num+=x.size(0)

acc = total_correct/total_num

print('epoch,acc:',epoch ,acc)

if __name__ == '__main__':

main()

import torch

from torch import nn

from torch.nn import functional as F

class Lenet5(nn.Module):

def __init__(self):

super(Lenet5, self).__init__()

self.conv_unit=nn.Sequential(

# x:[b,3,32,32]->[b,6,]

nn.Conv2d(3,6,kernel_size=5,stride=1,padding=0),

nn.AvgPool2d(kernel_size=2,stride=2,padding=0),

#

nn.Conv2d(6,16,kernel_size=5,stride=1,padding=0),

nn.AvgPool2d(kernel_size=2,stride=2,padding=0),

#

)

# flatten

# fc unit

self.fc_unit=nn.Sequential(

nn.Linear(16*5*5,120),

nn.ReLU(),

nn.Linear(120,84),

nn.ReLU(),

nn.Linear(84,10)

)

# x:[b,3,32,32]

tmp=torch.randn(2,3,32,32)

out=self.conv_unit(tmp)

# x:[b,16,5,5]

print('conv_out:',out.shape)

# use cross entroy loss

# use mean square error:self.criteon=nn.MSELoss()

self.criteon=nn.CrossEntropyLoss()

def forward(self,x):

batchsz=x.size(0)

# x:[b,3,32,32]->[b,16,5,5]

x=self.conv_unit(x)

# [b,16,5,5]->[b,16*5*5]

x=x.view(batchsz,16*5*5)

# [b,16*5*5]->[b,10]

logits=self.fc_unit(x)

# pred=F.softmax(logits,dim=1)

#yЪЧЮвУЧЕФЪфГі,ашвЊСэЭтв§Шы

# loss=self.criteon(logits,y)

return logits

def main():

net=Lenet5()

tmp = torch.randn(2, 3, 32, 32)

out = net(tmp)

print('lenet_out:', out.shape)

if __name__ == '__main__':

main()