���IJ�������Դ������ƽ����,�ڴ˻����Ͻ����ܽ���չ

һ:������ͼ����

����ͼ��ͼ:�����㷨�������ݵ�֮������ƶȽ����ݵ㻮�ֵ���ͬ����,��˽����ݵ�ӳ�䵽����ͼ֮��,����ת��Ϊͼ���ֵ����⡣��������ͼ G G G,��ͼ��Ŀ���ǽ�ͼ G ( V , E ) G(V,E) G(V,E)�зֳɻ��������� k k k����ͼ,����

- ÿ����ͼ��ļ���Ϊ { A 1 , A 2 , . . . , A k } \{A_{1},A_{2},...,A_{k}\} {A1?,A2?,...,Ak?},������ A i �� A j = ? A_{i}\cap A_{j}=\empty Ai?��Aj?=?�� A 1 �� A 2 �� . . . �� A k = V A_{1}\cup A_{2}\cup ... \cup A_{k}=V A1?��A2?��...��Ak?=V

- ��������������ͼ��ļ��� A A A�� B B B,���Ƕ��� A A A�� B B B֮�����ͼȨ��Ϊ W ( A , B ) = �� i �� A , j �� B w i j W(A,B)=\sum\limits_{i\in A,j \in B} w_{ij} W(A,B)=i��A,j��B��?wij?

- ���� k k k����ͼ��ļ��� { A 1 , A 2 , . . . , A k } \{A_{1},A_{2},...,A_{k}\} {A1?,A2?,...,Ak?},������ͼ c u t ( A 1 , A 2 , . . . , A k ) = 1 2 �� i = 1 k W ( A i , A �� i ) cut(A_{1},A_{2},...,A_{k})=\frac{1}{2}\sum\limits_{i=1}^{k}W(A_{i},\bar A_{i}) cut(A1?,A2?,...,Ak?)=21?i=1��k?W(Ai?,A��i?) (���� A �� i \bar A_{i} A��i?Ϊ A i A_{i} Ai?�IJ���)

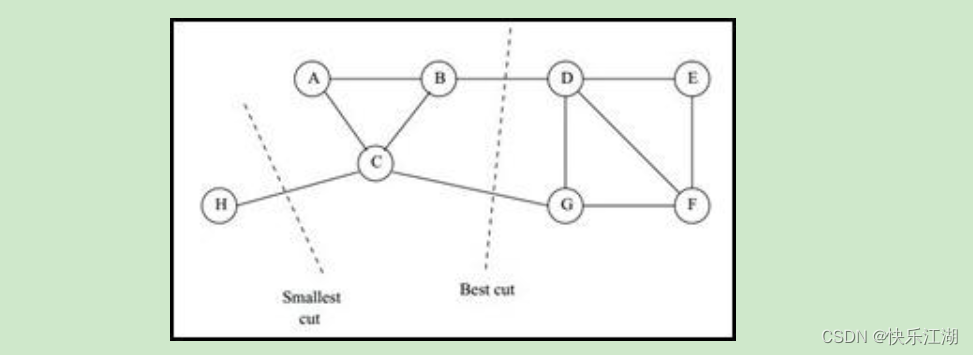

���Կ���, c u t cut cut��������ͼ֮���������, c u t cut cutԽС��ô��ͼ�IJ����Ծ�Խ�������� c u t ( A 1 , A 2 , . . . , A k ) = 1 2 �� i = 1 k W ( A i , A �� i ) cut(A_{1},A_{2},...,A_{k})=\frac{1}{2}\sum\limits_{i=1}^{k}W(A_{i},\bar A_{i}) cut(A1?,A2?,...,Ak?)=21?i=1��k?W(Ai?,A��i?)�ڻ�����ͼʱ��û�п���ÿ����ͼ�нڵ�ĸ�����������ijЩ�����,��С�� c u t ( A 1 , A 2 , . . . , A k ) cut(A_{1},A_{2},...,A_{k}) cut(A1?,A2?,...,Ak?)���ܻ��һ�����ݵ���Ǻ������ݵ㿴��һ����ͼ,������ͼ���ֽ����ƽ��

- ������ͼ,ѡ��һ��Ȩ����С�ı�Ե�ĵ�,���� C C C�� H H H֮����� c u t cut cut,����������С�� c u t ( A 1 , A 2 , . . . , A k ) cut(A_{1},A_{2},...,A_{k}) cut(A1?,A2?,...,Ak?)����ȴ�������ŵ���ͼ

Ϊ�˽���������,������һЩ����������õ����ַ���Ϊ������淶��

- ������: R a t i o c u t ( A 1 , A 2 , . . . , A k ) = 1 2 �� i = 1 k W ( A i , A �� i ) �O A i �O Ratiocut(A_{1},A_{2},...,A_{k})=\frac{1}{2}\sum\limits_{i=1}^{k}\frac{W(A_{i},\bar A_{i})}{|A_{i}|} Ratiocut(A1?,A2?,...,Ak?)=21?i=1��k?�OAi?�OW(Ai?,A��i?)?

- �淶��: N C u t ( A 1 , A 2 , . . . , A k ) = 1 2 �� i = 1 k W ( A i , A �� i ) v o l ( A i ) NCut(A_{1},A_{2},...,A_{k})=\frac{1}{2}\sum\limits_{i=1}^{k}\frac{W(A_{i},\bar A_{i})}{vol(A _{i})} NCut(A1?,A2?,...,Ak?)=21?i=1��k?vol(Ai?)W(Ai?,A��i?)?

(1)������

����ָʾ����(����ɲ鿴ָʾ��������) h j �� { h 1 , h 2 , . . . , h k } h_{j}\in\{h_{1},h_{2},...,h_{k}\} hj?��{h1?,h2?,...,hk?}, j = 1 , 2 , . . . , k j=1,2,...,k j=1,2,...,k����������һ������ h j h_{j} hj?,����һ�� n n nά����( n n n��ʾ������),���� h i j h_{ij} hij?����

h i j = { 0 , v i ? A j �O A j �O , v i �� A j h_{ij}=\begin{cases} 0,v_{i}\notin A_{j}\\ \sqrt{|A_{j}|},v_{i}\in A_{j}\\ \end{cases} hij?={0,vi?��/Aj?�OAj?�O?,vi?��Aj??

����,���� h i T L h i h_{i}^{T}Lh_{i} hiT?Lhi?,����������˹�������ʿ�֪

- ������������ f = ( f 1 , . . . , f n ) T �� R n f=(f_{1},...,f_{n})^{T} \in R^{n} f=(f1?,...,fn?)T��Rn,�� f T L f = 1 2 �� i , j = 1 n w i j ( f i ? f j ) 2 f^{T}Lf=\frac{1}{2}\sum\limits_{i,j=1}^{n}w_{ij}(f_{i}-f_{j})^{2} fTLf=21?i,j=1��n?wij?(fi??fj?)2

h i T L h i = 1 2 �� m = 1 �� n = 1 w m n ( h i m ? h i n ) 2 = c u t ( A i , A �� i ) �O A i �O h_{i}^{T}Lh_{i}=\frac{1}{2}\sum\limits_{m=1}\sum\limits_{n=1}w_{mn}(h_{im}-h_{in})^{2}=\frac{cut(A_{i},\bar A_{i})}{|A_{i}|} hiT?Lhi?=21?m=1��?n=1��?wmn?(him??hin?)2=�OAi?�Ocut(Ai?,A��i?)?

- �ϸ�֤�������뿴����ƽ����:����

���Կ���,����ijһ����ͼ i i i, R a t i o n C u t RationCut RationCut�Ͷ�Ӧ�� h i T L h i h_{i}^{T}Lh_{i} hiT?Lhi?,��ô���� k k k����ͼ

R a t i o C u t ( A 1 , A 2 , . . . , A k ) = �� i = 1 k h i T L h i = �� i = 1 k ( H T L H ) i i = t r ( H T L H ) RatioCut(A_{1},A_{2},...,A_{k})=\sum\limits_{i=1}^{k}h_{i}^{T}Lh_{i}=\sum\limits_{i=1}^{k}(H^{T}LH)_{ii}=tr(H^{T}LH) RatioCut(A1?,A2?,...,Ak?)=i=1��k?hiT?Lhi?=i=1��k?(HTLH)ii?=tr(HTLH)

���, R a t i o n C u t RationCut RationCut��ͼ���ʾ�����С�� t r ( H T L H ) tr(H^{T}LH) tr(HTLH)������Ϊ H T H = I H^{T}H=I HTH=I(��λ����),����ͼ�Ż�Ŀ��Ϊ

a r g m i n ? H t r ( H T L H ) s . t . H T H = I \underbrace{argmin}_{H} tr(H^{T}LH) s.t.H^{T}H=I H argmin??tr(HTLH)s.t.HTH=I

�����Ż�Ŀ�� t r ( H t L H ) tr(H^{t}LH) tr(HtLH)�е�ÿһ���Ż���Ŀ�� h i T L h i h_{i}^{T}Lh_{i} hiT?Lhi?,���е� h h h�ǵ�λ������, L L LΪ�Գƾ���,���Դ�ʱ h i T L h i h_{i}^{T}Lh_{i} hiT?Lhi?�����ֵ��Ϊ L L L���������ֵ����Сֵ��Ϊ L L L����С����ֵ������������,���ǵ�Ŀ�����Ҫ�ҵ�Ŀ�����С����ֵ,�õ���Ӧ����ֵ����,��ʱ��ͼЧ����ѡ����Զ��� h i T L h i h_{i}^{T}Lh_{i} hiT?Lhi?,Ŀ������ҵ� L L L����С����ֵ,������ t r ( H t L H ) = �� i = 1 k h i T L h i tr(H^{t}LH)=\sum\limits_{i=1}^{k}h_{i}^{T}Lh_{i} tr(HtLH)=i=1��k?hiT?Lhi?,��Ŀ�����Ҫ�ҵ� k k k����С������ֵ

���,ͨ���ҵ� L L L����С�� k k k������ֵ,���Եõ���Ӧ�� k k k����������,�� k k k�������������һ�� n n n�� k k kά����,Ҳ�� H H H��һ����Ҫ�Ծ��� H H H����������,����

- һ����˵, k k kԶС�� n n n,Ҳ��˵��������ά

h i j ? = h i j ( �� t = 1 k h i t 2 ) 1 2 h_{ij}^{*}=\frac{h_{ij}}{(\sum\limits_{t=1}^{k}h_{it}^2)^{\frac{1}{2}}} hij??=(t=1��k?hit2?)21?hij??

������Ҫע��,��ά���µõ���ָʾ���� h h h��Ӧ�� H H H���ڲ�������ȫָʾ�������Ĺ���,���һ���ڵõ� n �� k n��k n��kά�ľ��� H H H����Ҫ��ÿһ�н���һ�δ�ͳ�ľ���,����ʹ��K-Means����

(2)�淶��(����)

�淶��ͱ���������,ֻ�ǰѱ�����ķ�ĸ �O A i �O |A_{i}| �OAi?�O������ v o l ( A i ) vol(A_{i}) vol(Ai?),����ָʾ���� h i j h_{ij} hij?����

h i j = { 0 , v i ? A j v o l ( A i ) , v i �� A j h_{ij}=\begin{cases} 0,v_{i}\notin A_{j}\\ \sqrt{vol(A_{i})},v_{i}\in A_{j}\\ \end{cases} hij?={0,vi?��/Aj?vol(Ai?)?,vi?��Aj??

����,���� h i T L h i h_{i}^{T}Lh_{i} hiT?Lhi?,����������˹�������ʿ�֪

- ������������ f = ( f 1 , . . . , f n ) T �� R n f=(f_{1},...,f_{n})^{T} \in R^{n} f=(f1?,...,fn?)T��Rn,�� f T L f = 1 2 �� i , j = 1 n w i j ( f i ? f j ) 2 f^{T}Lf=\frac{1}{2}\sum\limits_{i,j=1}^{n}w_{ij}(f_{i}-f_{j})^{2} fTLf=21?i,j=1��n?wij?(fi??fj?)2

h i T L h i = 1 2 �� m = 1 �� n = 1 w m n ( h i m ? h i n ) 2 = c u t ( A i , A �� i ) v o l ( A i ) h_{i}^{T}Lh_{i}=\frac{1}{2}\sum\limits_{m=1}\sum\limits_{n=1}w_{mn}(h_{im}-h_{in})^{2}=\frac{cut(A_{i},\bar A_{i})}{vol(A_{i})} hiT?Lhi?=21?m=1��?n=1��?wmn?(him??hin?)2=vol(Ai?)cut(Ai?,A��i?)?

- �ϸ�֤�������뿴����ƽ����:����

���Կ���,����ijһ����ͼ i i i, R a t i o n C u t RationCut RationCut�Ͷ�Ӧ�� h i T L h i h_{i}^{T}Lh_{i} hiT?Lhi?,��ô���� k k k����ͼ

N C u t ( A 1 , A 2 , . . . , A k ) = �� i = 1 k h i T L h i = �� i = 1 k ( H T L H ) i i = t r ( H T L H ) NCut(A_{1},A_{2},...,A_{k})=\sum\limits_{i=1}^{k}h_{i}^{T}Lh_{i}=\sum\limits_{i=1}^{k}(H^{T}LH)_{ii}=tr(H^{T}LH) NCut(A1?,A2?,...,Ak?)=i=1��k?hiT?Lhi?=i=1��k?(HTLH)ii?=tr(HTLH)

����ʱ H T H =? I H^{T}H \not=I HTH��=I,���� H T D H = I H^{T}DH =I HTDH=I

- ������Ϊ h i T D h i = �� j = 1 n h i j 2 d j = 1 v o l ( A i ) �� j �� A i d j = 1 v o l ( A i ) v o l ( A i ) = 1 h_{i}^{T}Dh_{i}=\sum\limits_{j=1}^{n}h_{ij}^{2}d_{j}=\frac{1}{vol(A_{i})}\sum\limits_{j\in A_{i}}d_{j}=\frac{1}{vol(A_{i})}vol(A_{i})=1 hiT?Dhi?=j=1��n?hij2?dj?=vol(Ai?)1?j��Ai?��?dj?=vol(Ai?)1?vol(Ai?)=1

���,��ʱ��ͼ�Ż�Ŀ��Ϊ

a r g m i n ? H t r ( H T L H ) s . t . H T D H = I \underbrace{argmin}_{H} tr(H^{T}LH) s.t.H^{T}DH=I H argmin??tr(HTLH)s.t.HTDH=I

�������ھ���

H

H

H�е�ָʾ����

h

h

h�����DZ�������,������Ҫ��

H

H

H��һ��ת������

H

=

D

?

1

2

F

H=D^{-\frac{1}{2}}F

H=D?21?F,��

H

T

L

H

=

F

T

D

?

1

2

L

D

?

1

2

F

H^{T}LH=F^{T}D^{-\frac{1}{2}}LD^{-\frac{1}{2}}F

HTLH=FTD?21?LD?21?F��

H

T

D

H

=

F

T

F

=

I

H^{T}DH=F^{T}F=I

HTDH=FTF=I,�����Ż�Ŀ����Ϊ

a

r

g

m

i

n

?

F

t

r

(

F

T

D

?

1

2

L

D

?

1

2

F

)

s

.

t

.

F

T

F

=

I

\underbrace{argmin}_{F} tr(F^{T}D^{-\frac{1}{2}}LD^{-\frac{1}{2}}F) s.t.F^{T}F=I

F

argmin??tr(FTD?21?LD?21?F)s.t.FTF=I

����,�ͱ�����һ��,ͨ���ҵ� D ? 1 2 L D ? 1 2 D^{-\frac{1}{2}}LD^{-\frac{1}{2}} D?21?LD?21?(����֮ǰ�� L L L)����С�� k k k������ֵ,���Եõ���Ӧ�� k k k����������,�� k k k�����������һ�� n n n�� k k kά����,Ҳ�� F F F,���� F F F���д�ͳ����

- һ����˵, D ? 1 2 L D ? 1 2 D^{-\frac{1}{2}}LD^{-\frac{1}{2}} D?21?LD?21?�൱�ڶ� L L L����һ�α���,Ҳ�� L i j d i ? d j \frac{L_{ij}}{\sqrt{d_{i}*d_{j}}} di??dj??Lij??

��:�����㷨����

�������ݼ� D = { x 1 , x 2 , . . . , x n } D=\{x_{1}, x_{2}, ... , x_{n}\} D={x1?,x2?,...,xn?}

- ������������ƾ������ɷ�ʽ(һ��Ϊ��˹�˺���)�������ƾ��� S S S(AffinityMatrix)

- �������ƾ��� S S S�����ڽӾ��� W W W,�ٹ����Ⱦ��� D D D

- ����������˹���� L = D ? W L=D-W L=D?W

- �õ��������������˹���� D ? 1 2 L D ? 1 2 D^{-\frac{1}{2}}LD^{-\frac{1}{2}} D?21?LD?21?

- ���� D ? 1 2 L D ? 1 2 D^{-\frac{1}{2}}LD^{-\frac{1}{2}} D?21?LD?21?��С�� k k k������ֵ��Ӧ���������� f f f

- ���������� f f f��ɾ����б���,������� n n n�� k k kά���������� F F F

- F F F��ÿһ����Ϊһ�� k k kά������,�� n n n������,����ij�־�������о���,�������ά��Ϊ k �� k^{��} k��

- �õ��ػ���C ( c 1 , c 2 , . . . , c k �� ) (c_{1}, c_{2}, ... , c_{k^{��}}) (c1?,c2?,...,ck��?)

��:Pythonʵ��

import matplotlib.pyplot as plt

import numpy as np

import pandas as pd

from sklearn.cluster import KMeans

from sklearn.metrics.pairwise import rbf_kernel

from sklearn.datasets import make_blobs

from sklearn.preprocessing import normalize

def get_affinity_matrix(data_set):

# ���ø�˹�˺����������ƾ���(ȫ����)

rbf = rbf_kernel(data_set)

for i in range(len(rbf)):

rbf[i, i] = 0

return rbf

def distance(x1, x2):

"""

�������������֮��ľ���

:param x1: ������1

:param x2: ������2

:return:

"""

dist = np.sqrt(np.power(x1-x2,2).sum())

return dist

def get_dist_matrix(data):

"""

��ȡ�������

:param data: ��������

:return: �������

"""

n = len(data) #��������

dist_matrix = np.zeros((n, n)) # ��ʼ���ڽӾ���Ϊn��n��ȫ0����

for i in range(n):

for j in range(i+1, n):

dist_matrix[i][j] = dist_matrix[j][i] = distance(data[i], data[j])

return dist_matrix

def get_W(data, k):

# ��ȡ�ڽӾ���(K�ڽ���)

n = len(data)

dist_matrix = get_dist_matrix(data)

W = np.zeros((n, n))

for idx, item in enumerate(dist_matrix):

idx_array = np.argsort(item) # ÿһ�о����б���������,�õ���Ӧ�������б�

W[idx][idx_array[1:k+1]] = 1

transpW =np.transpose(W)

return (W+transpW)/2

def spectral_clustering(data_set, k):

# �������ƾ���S�õ��ڽӾ���W

W = get_affinity_matrix(data_set) #��˹�˺���(ȫ���ӷ�)

# W = get_W(data_set, k) # K�ڽ���

# ����Ⱦ���D,���õ�����D��1/2�η��������(���ڼ���������˹����)

D_inv = np.diag(np.power(np.sum(W, axis=1), -0.5))

# ����������˹����L=D-W

# ����������˹����l = D_inv*L*D_inv=I-D_inv*W*D_inv

L = np.eye(len(data_set)) - np.dot(np.dot(D_inv, W), D_inv)

# �õ�����ֵ����������

eigvals, eigvecs = np.linalg.eig(L)

# �ҵ�ǰk����С������ֵ(����)

k_smallest_eigvals_index = np.argsort(eigvals)[:k]

# ȡ����kС����ֵ��Ӧ����������,������

k_smallest_eigvecs = normalize(eigvecs[:, k_smallest_eigvals_index])

# ʹ��K_Means����

return KMeans(n_clusters=k).fit_predict(k_smallest_eigvecs)

raw_data = pd.read_csv(r'E:\Postgraduate\Dataset\jain.csv', header=None)

raw_data.columns = ['X', 'Y']

x_axis = 'X'

y_axis = 'Y'

examples_num = raw_data.shape[0]

train_data = raw_data[[x_axis, y_axis]].values.reshape(examples_num, 2)

min_vals = train_data.min(0)

max_vals = train_data.max(0)

ranges = max_vals - min_vals

normal_data = np.zeros(np.shape(train_data))

nums = train_data.shape[0]

normal_data = train_data - np.tile(min_vals, (nums, 1))

normal_data = normal_data / np.tile(ranges, (nums, 1))

labels = spectral_clustering(normal_data, 2)

# ԭ����

fig, (ax0, ax1) = plt.subplots(ncols=2)

ax0.scatter(normal_data[:, 0], normal_data[:, 1], c='black')

ax0.set_title('raw data')

# ������

ax1.scatter(normal_data[:, 0], normal_data[:, 1], c=labels)

ax1.set_title('Spectral Clustering')

plt.show()

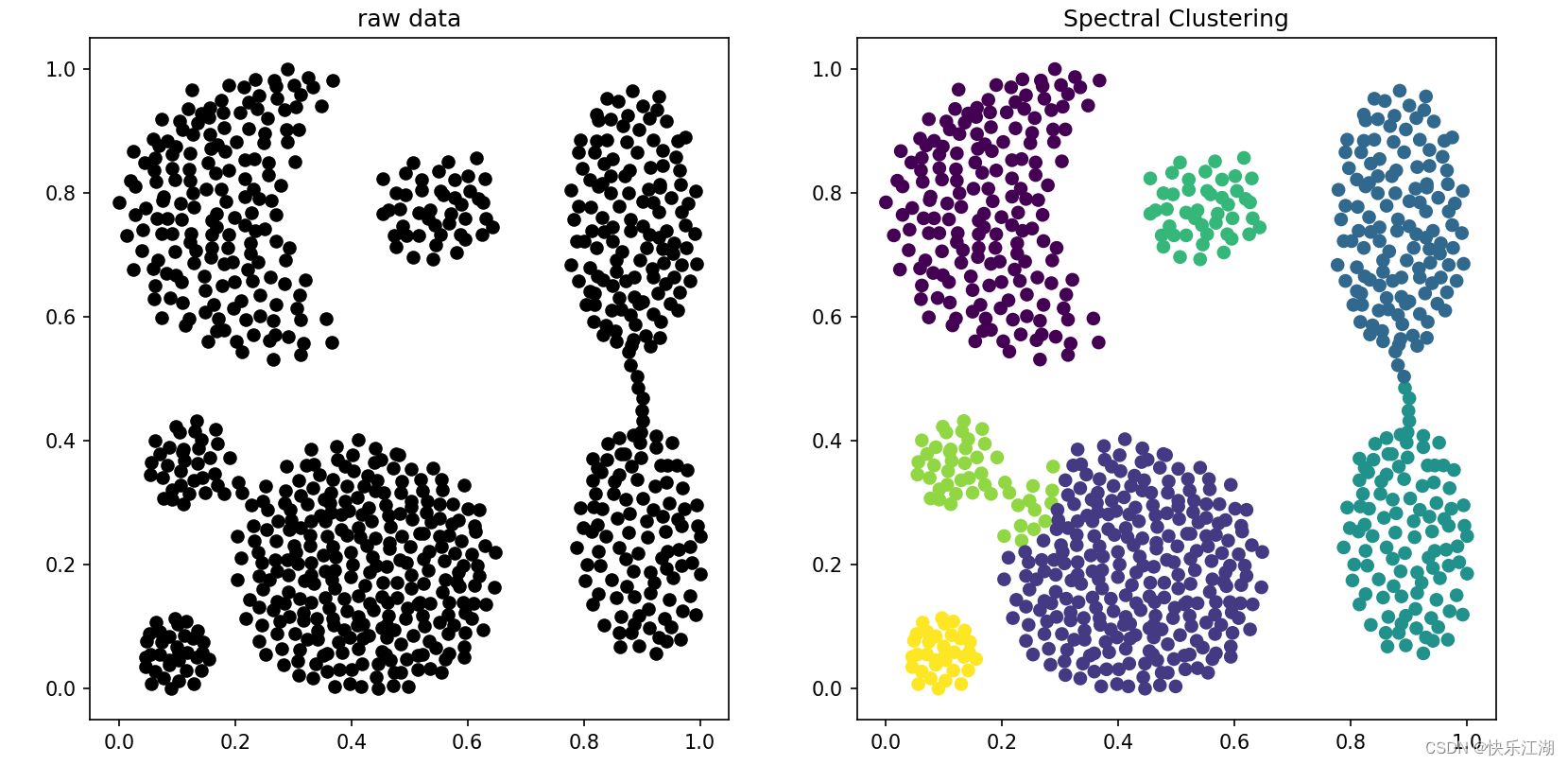

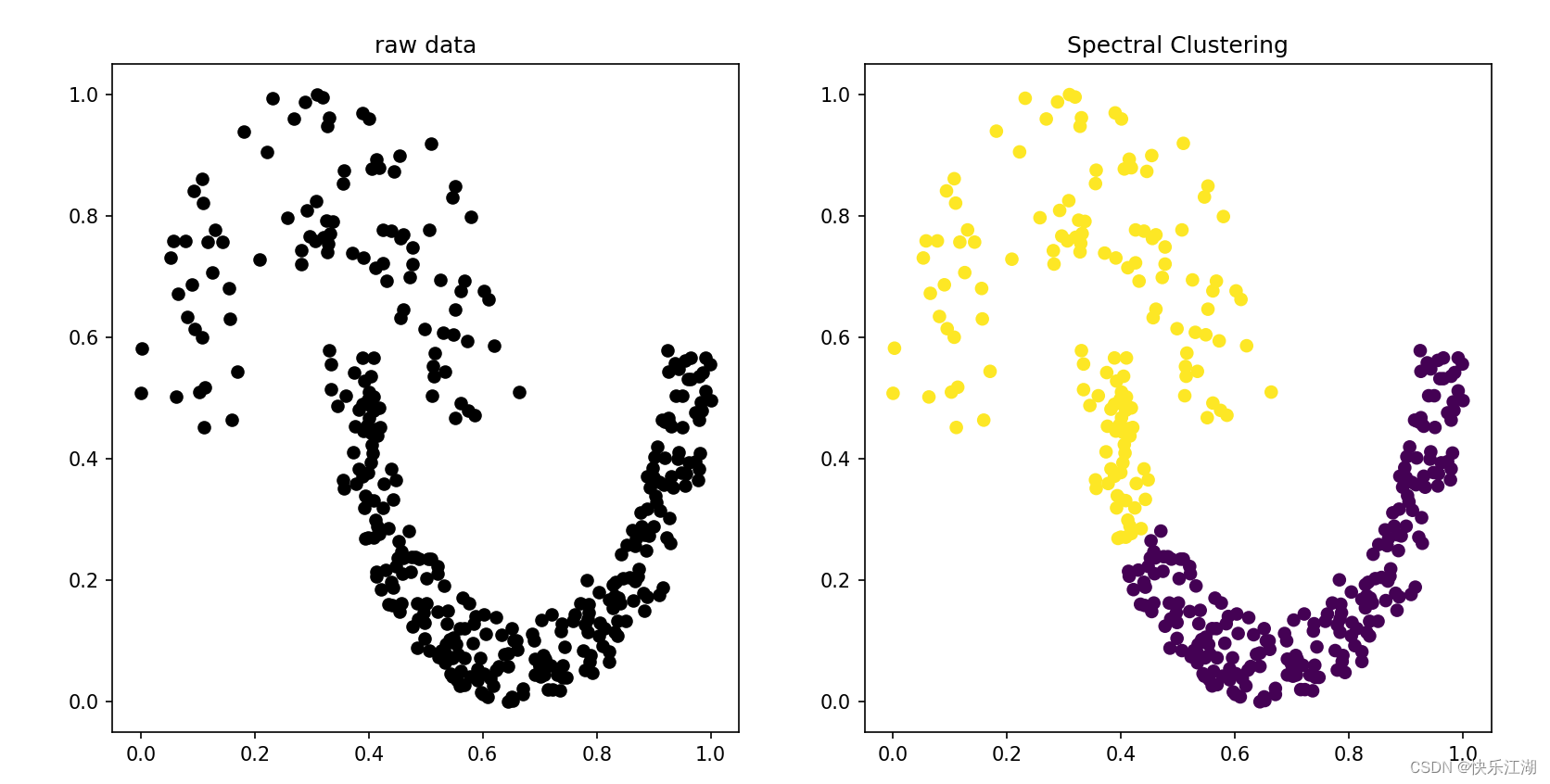

(��˹�˺���)

(K�ڽ���)

��:�����㷨��ȱ��

(1)�ŵ�

- ����ֻ��Ҫ����֮������ƶȾ���,���Զ���ϡ�����ݵľ�������Ч

- ʹ���˽�ά,��˴�����γ���ݾ���ʱ���Ӷ�Ҫ���Ե��ڴ�ͳ�����㷨

- �����㷨��������ͼ���ۻ�����,�봫ͳ�����㷨���,����������������״�������ռ��Ͼ�����������ȫ�����Ž�

(2)ȱ��

- ������վ����ά�ȷdz���,�����ڽ�ά�ķ��Ȳ���,�����㷨�������ٶȺ����Ч�������Ǻܺ�

- ����Ч�����������ƶȾ���,���Բ�ͬ�����ƶȾ���õ������վ���Ч����ͬ��ͬ