Abstract

�Ӵ����ĵ��������п�������Ե�������³�����Ʒָ��㷨���ڸ������ı仯������Ҫ���塣�÷������Բ���������ľ�Ĵ�С��������������,�Ը��ٺ��˽�ɭ��̼����ͱ仯����ͳ�IJ������������ٶ���,�����ͺ�Ϊ�˸��ø���ػ�ȡɭ����Ϣ,�����ص��ע��������:һ���������˻���ȡɭ�ֵĶ��ӵ�ң��Ӱ��,Ȼ������struct from motion�㷨����ɭ��ϡ����ƺ�patch-����MVS�㷨�����ܼ����ơ����������һ��Ŀ��������ѧϰ��������ȡ�������ĵ��ơ��о��������,���ѧϰ�����ĵ������Ʒָ�ȷ����90%����,ȷ��Զ���ڴ�ͳ��ƽ��ͼ��ָ�͵��Ʒָ�������ݲɼ������˻�ң�к͵������ѧϰ�㷨����,����������ҵ����������ɷ���,���ַ�����Ϊһ����ҵ���鹤��,���кܴ���ƹ�ռ��δ����չ�Ŀ��ܡ�

Index Terms:��Ч�����ѧϰ�㷨,��ҵ,ƥ�����,���ָ�,���˻���

I. INTRODUCTION

ɭ����½���Ϸֲ���㡢�ṹ��ӡ���������ḻ����Ȼ��̬��Դ��ɭ�ֱ���Ϊ����֮��,������������̬���ȶ������ž�����á����Ź�ҵ���Ŀ��ٷ�չ,ɭ�ֿ���Ӧ�˶���,ɭ�ֵı�����ɳ�����չ�ѳ�Ϊ��Ҫ����[1 ]���˽�ɭ����Ϣ��ɭ�ֱ����ĵ�һ�������,�˽��������ȷ�ز�����ľ��Ϣ��Ϊ��Ҫ[2]���ر����ڴ����ݺ���Ϣ���ı�����,������Ҫ�ҵ�һ�ֿ��١�ȷ�ػ�ȡ�ֵ���Ϣ�ķ���[3]��[4]�������о������еĸ���ɭ����Դ��ⷽ�����ۺϱȽ��˼��ַ���,���и��IJ��㡣Ŀǰ��ɭ�ֵ��鷽��һ�������¼��֡�

- �˹�����ķ���:���ַ�����ָ������Ա����ɭ�ֽ����˹���Ϣ����,Ȼ�����ľ���б�Dz���¼����[5]�����ַ�������Ч�ʵ�,���ҷ�ʱ������Ҫ����,ɭ���ڲ�����̬�ṹ���ӡ�һЩ���ƶ��ͻ������������ӵ�����������Ա��˵�dz�Σ��,���ʺ����ǽ��롣

- ����ң��[6]:������Ϣ�������ڳ�,���������ֵطָ�ͻ�ȡ�ֵش�С������λ����Ϣ������,�������ľ����ϸ����,�������ߺ��ؾ���

- �����״�ģʽ:�����״��ȡ�ĵ���������Ϣ����,���ӻ�Ч��Ҳ���������,�����ֵ���Ϣ��ȡ�ļ����״�ɷ�Ϊ��������:���ؼ����״�͵��漤���״�[7]��ǰ��ͨ�����˻�ɨ��ɭ���Ͽյ�����,��������ͨ���ֶ����ֵ����Ƴ�ɨ��ɭ���µ�ɭ��[8]��ǰ���ڻ�ȡ�ֵظ߲����Ϣ�����кܴ�����,�����ȡ�ֹ����ĸ߲����Ϣ��������Ϊ����ɭ����ɨ��,���Կ���ֱ�۵ķ�ӳ������Ϣ,��ȡ�ؾ���Ϣ�dz�ȷ������,���ڼ����״���Ȼ��һ�ָ߶��豸,�豸�ĸ߳ɱ����ܱ�������˽���[9]��

- ���˻��ɼ�������[10]��[11]:����һ�������ֵصĵͿ�Ӱ���ȡɭ������Ӱ��,ͨ������Ӱ����Ի�÷ḻ�Ĺڲ���Ϣ[12] .����,��������Ӱ���Ƕ�άƽ��ͼ��,�������Ϣ�����ߺ��ؾ�ֻ��ͨ������ģ�ͻ��[13]��Ȼ��,�������ʵ��,�ڲ���Ϣ�������ؾ�֮��û�����Ե�����ԡ����ھ��ȵ�,���ݵľ��Ȳ�����������[14]��

�������˻��ɼ����豸���еͳɱ����ص�,�о�ͨ�����˻�����ͼƥ���㷨[15]��ȡ�������ݡ�������,����ͼƥ���㷨�ѹ㷺Ӧ���ڳ���3D��ģ�������ݹ���������ķ�չ��״,��б���ļ������ܼ�ƥ�䷽�����о����������չ������[16]��Խ��Խ��Ч��ȷ��ƥ���㷨ʹ���˻���Ϊ����ļ����״��豸��ȡ���Ƶ����Ʒ[17]��

�ܼ����Ƶķָ�һֱ���о������Ż���[18]�����Ʒָ���ǽ�����������ݷָ�ɼ������ཻ���Ӽ���ÿ���Ӽ��е����ݾ�����ͬ������������һЩ������Ϣ[19]��Ŀ�����״���������������Կ��Ժ����شӵ���������ȷ�����������������ݾ��������ض��Ļ���Ŀ���еõ��ĵ������ݵķ��Ѳ������ס��������з����õ��ĵ�������ͨ��������ġ�ϡ���,���Ұ�����������������쳣������ɨ���ǵ��豸������,�������ݵIJ����ܶȲ������ȡ�����,����û��ͳ�Ʒֲ�ģʽ,�������ݵı�����״�ͷֲ�����������ġ��̶��Ļ������ġ����ڸ��Ƶ����ݵ������ԭ���²����ܶȲ���[20]��[21]ȱ�������Ľṹ����,�������ݵķָ�dz����ѡ����,���Ʒָ��㷨һ���Ϊ��Ե�ָ��������ָ��㷨���������Եķָ��㷨������ͼ�ķָ��㷨�ͻ��ڻ�Ϸָ�Ļ���ģ�͵ķָ��㷨[22]��Ȼ��,����������һ�ְ���������Ϣ�Ĵ�����[23],��Щ�㷨��ȷ�Բ����ر�����,��˵���ģ�͵����ѧϰ�㷨Ӧ�˶�������Ե�������ϡ�衢��������������,�����һ�ֵ���ģ�ͶԵ������ݽ��зָ�[24]���ڱ�ʵ����,���Ƕ��㷨��������,ʹ����ʺ�ɭ�������Ʒָ�,�Դﵽ���õľ��ȡ�

II. RESEARCH ON METHOD OF OBTAINING RAW DATA

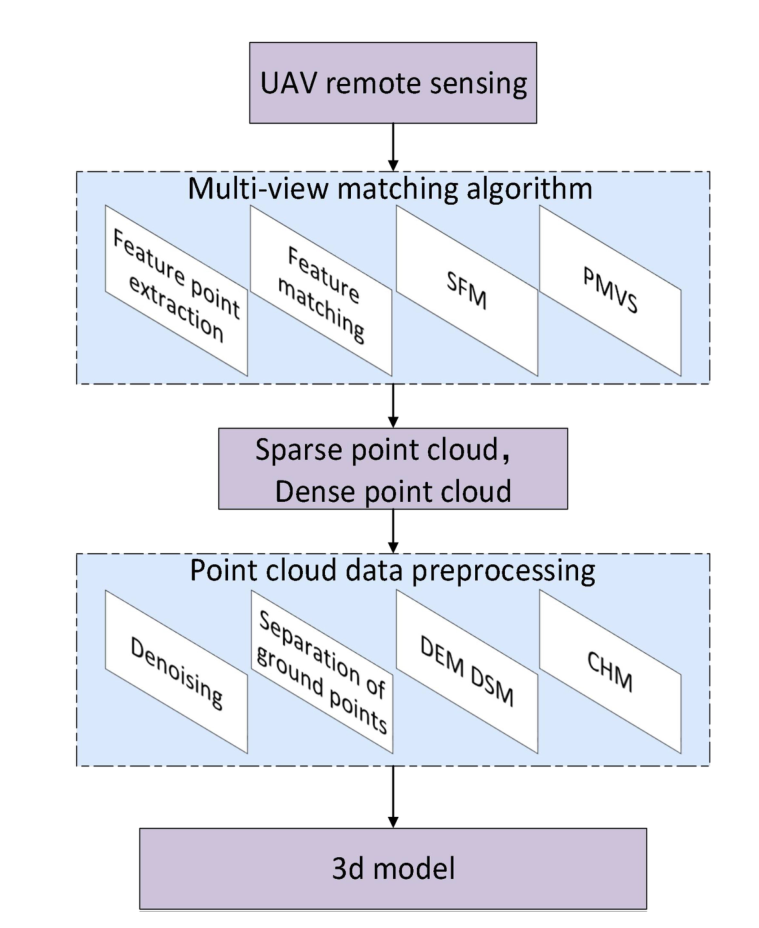

�������о���,ʹ�����˻���ȡ�˶��ӵ�Ϳ�ң��ͼ��ͨ��ƥ���㷨�õ�ϡ����ܼ���������,�õ����ָ߳�ģ�ͺ����ֵ���ģ�͡����Խ�����������õ����ڸ߶�ģ��,��ģ���ǰ������ߵĹ�һ��ģ��[25]��[26]������˼·����ͼ��ʾ��

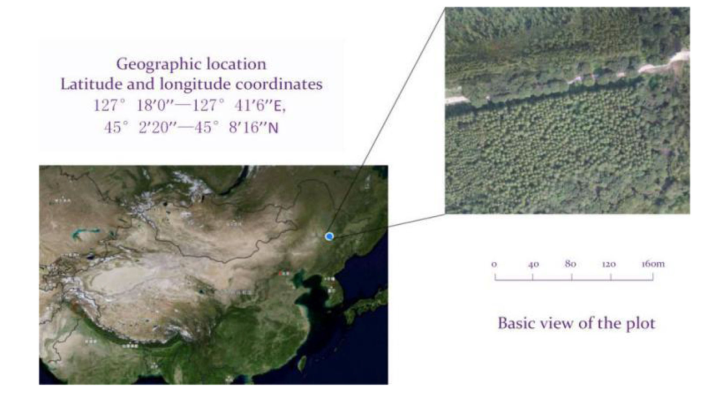

A. Experiment Time and Place

��������ص�Ϊ�й�������ʡ�������ж�����ҵ��ѧñ��ɽ�����ֳ���������ҵ��ѧñ��ɽʵ����λ����־�������������ؾ�����40����,��������Ϊ���� 12 7 �� 1 8 �� 0 �� �� 127^{\circ} 18^{\prime} 0^{\prime \prime} 127��18��0����� 12 7 �� 4 1 �� 6 �� �� 127^{\circ} 41^{\prime} 6^{\prime \prime} 127��41��6���,��γ 4 5 �� 2 �� 2 0 �� �� ? 4 5 �� 1 8 �� 1 6 �� �� 45^{\circ} 2^{\prime} 20^{\prime \prime}-45^{\circ} 18^{\prime} 16^{\prime \prime} 45��2��20���?45��18��16������ֳ��¶Ƚϻ�,���¶���5��~25��֮��,���Ʊ����ϵ�,������200~600m֮�䡣�����´���½�Լ������ش���ֲ���Ժ���Ϊ����ɭ�����130��130m,��Ҷ��1000�ꡣ�ֵعڲ�պ��ʴ�90%����,����ï���ֵء��������ڼ�,��Ҷ��ҶƬδ����,��ȷ���ڲ�պ϶ȵ�������ʵ��Ч������������ܺ�,ȷ����������ȷ��

B. UAV Data Acquisition

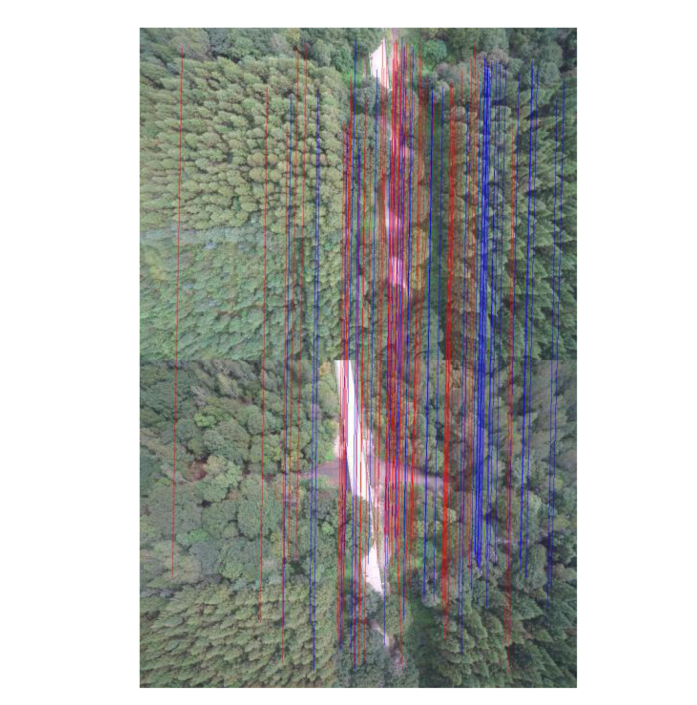

���˻����ݲɼ�ѡ��������������������˻��ͺ�Ϊ��Inspire1רҵ�����˻�,���559-581����,����ʱ��20���ӡ��䱸1240���FC350����ͷ��SONY EXMOR 1/2.3������,�ɽ��е��š���������,���4096��2160p�ֱ��ʸ���¼�ơ���б��Ӱ������һ���������ĸ���б������ִ�С������������,Ϊ�˴ﵽ���Ч��,�����ص�������Ϊ85%�������ص�������Ϊ 85%���ڶ������庽�ߵ����Ϊ45��,�������ٶ�Ϊ6 m/s,���ռ��Ϊ2 s��ÿ�����ߵķ���ʱ��Ϊ7-9����,�ɱ��о���Լ��45���ӡ�

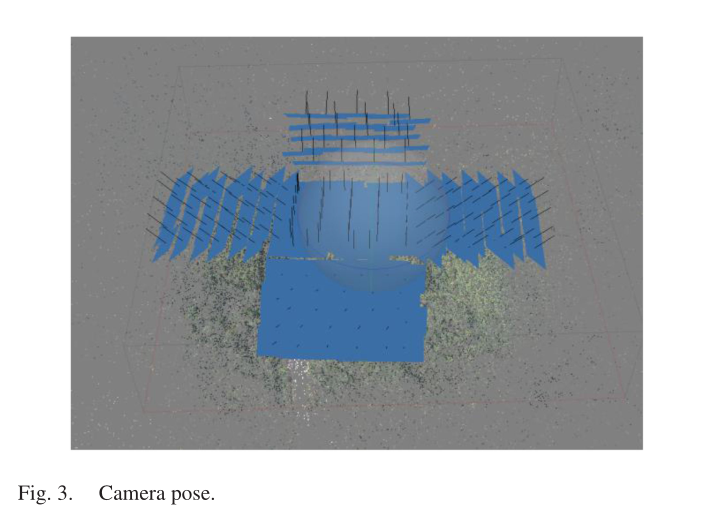

C. Point Cloud Data

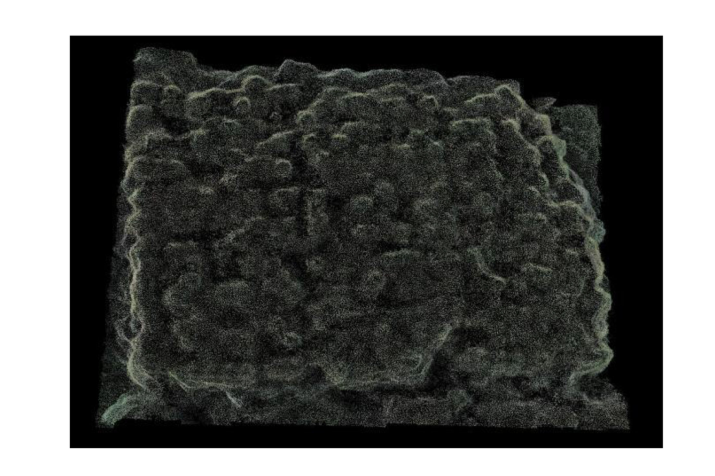

������״ﲻͬ,�������ݿ���ֱ�ӻ�ȡ����ʵ����ڼ�����Ӿ��Ͷ���ͼ[27]�����ӽ���б��Ӱ���ԴӶ���Ƕ������������,���Ի���������ֱ������IJ���������Ϣ,����ȫ�淴ӳ������������ԡ������˶��ṹ(SFM)��MVS�㷨�Զ��ӵ�ͼ�����ƥ��,�õ�ʵ������ϡ����ƺ��ܼ����ơ�����˼·������ʹ���˶��ָ�Ŀ��ṹ(SFM)�㷨������ͼ����п�����������ȡ��ƥ�䡣ͨ������������Եõ�����ij�ʼλ�ò���,�������������õ�����������Ż�������ϡ������������ڻ�ȡ������ܼ��ռ�3D��������[28]��

III. POINT CLOUD GENERATION METHOD

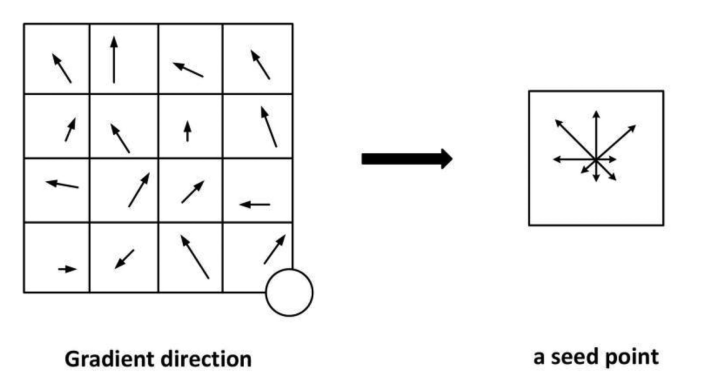

A. Extraction of Feature Points

Harris��DOG[29]��SIFT[30]��һЩ������ͼ����������ȡ�㷨����Щ�㷨��ͼ������������ȡ�еõ��˺ܺõ�Ӧ�á� Harris�㷨�кܴ�ľ�����,�����������ǵ���ҵ���ݡ�һ�ǶԳ߶�����,�����г߶Ȳ����ԡ���ô��ȡ�Ľǵ�ľ���̫����,�����ؼ��ġ�����Ҫ��������Ҫ�ֶ���ƽǵ�ƥ���㷨,���¹��������ӡ�����SIFT�㷨��Ϊ�����ǵ���ѡ�� SIFT�㷨��Lowe������÷�������ת���������š����ȱ仯���ӽDZ仯������任���������ֵȾ���һ�����ȶ��ԡ� SIFT���ӿ��Կ���ȷ��ƥ������������ݡ������������ʽ��������������չ,���ϵõ��Ľ���Ӧ�á��㷨��Ҫ�����������ݡ�

1)�߶ȿռ�ͼ�ֵ���:�߶ȿռ���ͨ��ͼ���˹�����õ���,��2Dͼ���ж�������:

G ( x i , y i , �� ) = 1 2 �� �� 2 e ? ( x i 2 + y i 2 ) 2 �� 2 ( 1 ) G\left(x_i, y_i, \sigma\right)=\frac{1}{2 \pi \sigma^2} e^{\frac{-\left(x_i{ }^2+y_i 2\right)}{2 \sigma^2}} \quad\quad\quad\quad(1) G(xi?,yi?,��)=2����21?e2��2?(xi?2+yi?2)?(1)

L ( x i , y i , �� ) = G ( x i , y i , �� ) ? I ( x i , y i ) ( 2 ) L\left(x_i, y_i, \sigma\right)=G\left(x_i, y_i, \sigma\right) * I\left(x_i, y_i\right) \quad\quad\quad\quad(2) L(xi?,yi?,��)=G(xi?,yi?,��)?I(xi?,yi?)(2)

���� G ( x i , y i , �� ) G\left(x_i, y_i, \sigma\right) G(xi?,yi?,��)�dz߶ȱ�����˹����; ( x i , y i ) \left(x_i, y_i\right) (xi?,yi?)��ʾ������ͼ���ϵ�λ��; L ( x i , y i , �� ) L\left(x_i, y_i, \sigma\right) L(xi?,yi?,��)��ͼ��ij߶ȿռ�; �� \sigma ���dz߶ȿռ����ӡ��߶ȿռ伫ֵ��ļ���ǽ�ÿ������������Χ����бȽ�,�ҵ��߶ȿռ伫ֵ,�õ��ֲ�����ļ�ֵ,ͨ����˹�����õ�ԭʼͼ��

2)�ؼ��㶨λ:����ͨ�����һ����ά���κ�����ɾ���ͶԱȶȵĵ�,��ȷȷ���ؼ����λ��,��ǿƥ����ȶ���,��߿�����������

3)ȷ���ؼ��㷽��:ʹ�ùؼ���ľֲ�ͼ�����������ݶ�,ÿ���ؼ����ݶ����ķ���Ϊ���������ݶ�,����ʹ�����¹�ʽ���м���:

m

(

x

,

y

)

=

L

(

x

+

1

,

y

)

?

L

(

x

?

1

,

y

)

2

+

(

L

(

x

,

y

+

1

)

?

(

L

(

x

,

y

?

1

)

2

(

3

)

\mathrm{m}(x, y)= \sqrt{L(x+1, y)-L(x-1, y)^2+\left(L(x, y+1)-\left(L(x, y-1)^2\right.\right.} \quad\quad\quad\quad(3)

m(x,y)=L(x+1,y)?L(x?1,y)2+(L(x,y+1)?(L(x,y?1)2?(3)

��

(

x

,

y

)

=

tan

?

?

1

[

L

(

x

,

y

+

1

)

?

L

(

x

,

y

?

1

)

L

(

x

+

1

,

y

)

?

L

(

x

?

1

,

y

)

]

(

4

)

\theta(x, y)=\tan ^{-1}\left[\frac{L(x, y+1)-L(x, y-1)}{L(x+1, y)-L(x-1, y)}\right] \quad\quad\quad\quad(4)

��(x,y)=tan?1[L(x+1,y)?L(x?1,y)L(x,y+1)?L(x,y?1)?](4)

���� m ( x , y ) \mathrm{m}(x, y) m(x,y)�Ǹ�˹������ͼ��� ( x , y ) (x, y) (x,y)�����ݶ�ģ��, �� ( x , y ) \theta(x, y) ��(x,y)�Ǹ�˹������ͼ��� ( x , y ) (x, y) (x,y)���ķ���

4 ) �ؼ�������:�ؼ�������������ؼ�����Χ��ͼ��������зָ�,������ڵ��ݶ�ֱ��ͼ,����һ��Ψһ������,����ر���������ͼ����Ϣ��

B. Feature Points Matching

�ڻ��ÿ��ͼ����������,������ڵ���������Ϊƥ�����ƥ��ÿ��ͼ�������[31],[32]�����ǵ��ؼ�����������������Ϊ128ά,ͨ�����뺯�����������㷨����ÿ�������������������㡣����,�������ƥ����ܻ���ִ������,���ɾ����ƥ��ĵ�Ҳ����Ҫ��������Ӱ�������۵Ĺ�ϵ,�����ص�ͼ����ƥ���ͬ������ƽ����м�Լ����ϵ��������ͬͼ���ϵĵ� ( x i , y i ) , ( x j , y j ) \left(x_i, y_i\right),\left(x_j, y_j\right) (xi?,yi?),(xj?,yj?)�������¹�ϵ:

? ( x i y i 1 ] F [ x j y j 1 ] = 0 ( 5 ) \left\lceil\left(\begin{array}{lll} x_i & y_i & 1 \end{array}\right] F\left[\begin{array}{r} x_j \\ y_j \\ 1 \end{array}\right]=0\right. \quad\quad\quad\quad(5) ? ??(xi??yi??1?]F? ??xj?yj?1?? ??=0(5)

���� F F F�Ǽ�����Ӿ��еĻ�������,��ʾ����Ե�ͼ���֮��Ķ�Ӧ��ϵ���ڱ�ʵ����,����ʹ��RANSAC�㷨������F��������,RANSAC�㷨��ͼ��I��ͼ�� J J J��ƥ���� S S S����ȡ������СΪ n n n�����������,������M����ȡ�����ߵ�����ƥ��㲢����������� F F F��ͼ��i�е�����������ͨ��������F���б任,�Ի���� j j j ͼ���ϵ�ͶӰ��Ȼ�����һ����ֵ,������ߵIJ�ֵ������ֵ,��Ӧ�ö��������㡣�� F F F�����ֵ��Ϊ������С����������ս��ִ�в�ͬ�������ɼ���

C. SFM Algorithm for Sparse Point Cloud

�˶��ָ�Ŀ��ṹ�㷨(SFM)��������ϡ�����[33]������,ʹ��SIFT�㷨��ȡͼ���ϵ�������,������ȡ������������ڹ켣�С�Ȼ��,�Ծ�����������������Ĺ켣�����ع�,�õ�ÿ��ͼ������������������3-D������Ϣ�� SFM�Ļ����㷨���¡�

�� R j , c j , f j R_{\mathrm{j}}, \mathrm{c}_j, \mathrm{f}_j Rj?,cj?,fj?Ϊ��� j j j�ķ�������λ�úͽ���,��� X i X_i Xi?��ͼ�� j j j�ϵ�ͶӰ���Լ�Ϊ X i j = f j �� ( R j ( X i ? c j ) ) X_{i j}=f_j \prod\left(R_j\left(X_i-c_j\right)\right) Xij?=fj?��(Rj?(Xi??cj?))�� �� \Pi ����ͶӰ���� �� ( x , y , z ) = ( x z , y z ) \Pi(x, y, z)=\left(\frac{x}{z}, \frac{y}{z}\right) ��(x,y,z)=(zx?,zy?)�� SFMͨ�� X i X_i Xi?�ҵ����ƽ���͵���Сֵ

arg ? min ? �� �� X i j ? f j �� ( R j ( X i ? c j ) ) �� 2 . ( 6 ) \arg \min \sum\left\|X_{i j}-f_j \Pi\left(R_j\left(X_i-c_j\right)\right)\right\|^2 . \quad\quad\quad\quad(6) argmin����Xij??fj?��(Rj?(Xi??cj?))��2.(6)

�����ʽ����Сֵ��ζ�ŵõ��������3-D����[34]��

D. PMVS Algorithm for Dense Point Cloud

SFM�㷨ֻ�ܵõ�ϡ��ĵ������ݡ�Ϊ�˻��ȷ����Ϣ,��Ҫ�ܼ��ĵ���ƥ��[35]������patch��MVS(PMVS)�㷨����ϸ��ͨ��SFM������õ������Խ����ܼ��ؽ��� PMVS��һ�ֵ������ͼ�����Ӿ��㷨;ͨ�����㷨���Եõ�������ܼ���������,�Ӷ�ʹ���ƶԶ����������ȷ�Ⱥ��������϶��кܺõ�Ч�������㷨�������ܼ��� 3-D ���Ʒ�����и��õ�³���ԡ���ԭ�����Ը���Ϊ:����Harris�����Ӻ�DOG(��˹���)���ͼ���е������㡣ϡ�����3-D��ͨ��ͬ��ƥ���ǰ���õ�,���ӿ��ʼ��ΪĿ��㡣��������Ƭ��չ����������õ�һ������patch,Ȼ��Գ���patch���й�����ɾ�������bin�����������չ����,���յõ�ɭ�ֵ��ܼ��������ݡ�

ͼ 1�����Ʋɼ�����

ͼ 2 ʵ��������

ͼ 3. ������ơ�

ͼ 4 ���ӵ����������γɡ�

����,��Harris���Ӻ�DOG������ȡ�������㰴�ռ���Լ����ԭ������ƥ��,�õ������㼯�������� f f fʹ��(1)-(4)���г�ʼ��������patch p�Եõ��� c ( p ) c(p) c(p)�� n ( p ) n(p) n(p)Ϊ����,ͨ�������ݶȷ���С����Ȳ�ֵ,ѡ�����ŵ���Ϊ���ն�Ӧ��patch�����, p p p�����ڿ� p �� p ' p���Ǵ� p p p��ͼ��� C i ( x , y ) C_i(x, y) Ci?(x,y)��չ�����ġ����� p �� p ' p������Ϣ�ɵ��� p p p����Ϣ��ʼ��, C ( p �� ) C\left(p^{\prime}\right) C(p��)�ij�ʼֵΪ C i ( x , y ) C_i(x, y) Ci?(x,y)������ͶӰ���� p p p����ƽ��Ľ���, n ( p �� ) n\left(p^{\prime}\right) n(p��)�ij�ֵΪ n ( p ) n(p) n(p),Ȼ�������Ż������Ż� C ( p �� ) C\left(p^{\prime}\right) C(p��)�� n ( p �� ) n\left(p^{\prime}\right) n(p��)��ȡ��patch��ʹ��չ��һ�༯����ȫ����Ŀ��ı��档չ����ɺ�,�ԻҶ�һ���Ժͼ���һ���Խ����ĵ����������й���ȥ�������õ�Ŀ������ͳ������ܼ��������ݡ�

IV . POINT CLOUD SEGMENTATION ALGORITHM

�����ǵ�����Ҫ�����ݽṹ�������䲻����ĸ�ʽ,������о���Ա����Щ����ת��Ϊ�����3-D���������ͼ��[36]������,���ʹ���ݱ�ò���Ҫ�ش�,������һϵ�����⡣�ڱ�����,ʹ����һ��ֱ�Ӵ������Ƶ����������硣��������������еIJ����Բ�����������[37]��

ͼ 5 ������ƥ����

ͼ 6 �������˻�ƥ�����ģ�͡�

����������ŷ����ÿռ��е���Ӽ������������������ص㡣

����:����������һ������,�����ݵ�˳�����С�����ζ�Ŵ����������ݵ�ģ����Ҫ�����ݵIJ�ͬ���б��ֲ��䡣��ǰ������ʹ�õķ����������������ݽ�����������,ʹ�����ݵ�������������������,Ȼ��ʹ��RNNģ��,�Լ�ʹ�öԳƺ�����ȷ�����в����ԡ����ڵ����ַ�������������ģ����ʵ��,���ѡ������ַ���ʹ�����ػ��ĶԳƺ�������ȡ�������ݵ�����[38]��

��֮��Ŀռ��ϵ:һ������ͨ�������ض��ռ��е�һ�������ĵ������,����Щ����֮����ڿռ��ϵ��Ϊ����Ч�������ֿռ��ϵ,�ֲ�������ȫ���������������Ծۺ���Ϣ��

������:�������ݱ�ʾ��Ŀ��Ӧ�ö�ijЩ�ռ�任���ֲ���,������ת��ƽ��[39]�����,�ڽ���������ȡ֮ǰ,���ȶԵ������ݽ��ж����Ա�֤�����ԡ����������ͨ��ѵ��һ��С������õ��任����������ĵ������������ʵ�ֵġ�

���ڵ���ֻ��һ���,������Ա�����з�ʽ����ı�;�������������Ҫһ���̶ȵĶԳ��ԡ����ǵ���������һ��ͳһ�ļܹ�,��֮ǰ�ķ�����ͬ,��ֱ�ӽ�������Ϊ����,��Ϊ�����ÿ����������ÿ�����/���֡���������Ļ����ܹ��dz���,��Ϊ�ڳ�ʼ��,ÿ���㶼����ͬ�ķ�ʽ�������� [40]���ڻ���������,ÿ�����������������(x��y��z)��ʾ������ͨ�����㷨�ߺ������ֲ���ȫ�����������Ӷ����ά�ȡ����Ƿ����Ĺؼ���ʹ�õ����Գƺ������ػ�����Ч��ϵͳ��ѧϰһ���Ż���������Щ�����ڵ�����ѡ����д����Ե���Ϣ�㲢����ѡ���ԭ����б��롣���������ȫ���Ӳ�ʹ����Щѧϰ��������ֵ��Ԥ��ÿ����ı�ǩ�Խ�����״�ָ�ﵽ�ָ�����ε��Ƶ�Ч��[41]���ڱ�ʵ����,����ʹ�ô�ͳ�������˹��Ӿ�����[42]�����ɵĵ������ݽ��зָ�õ���1000��ֲ�������������ʵ��;���������ѡ��ĵ�ľ����ģ�͡�

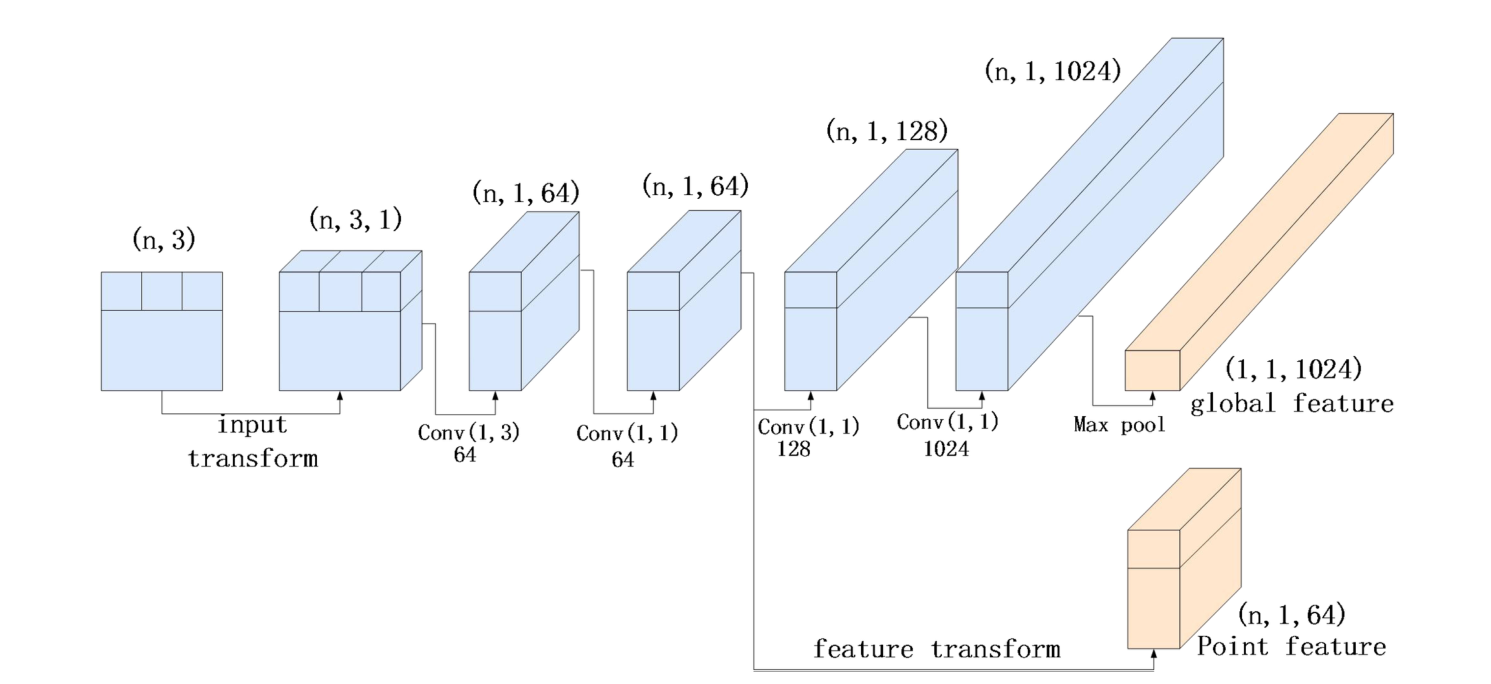

���ǽ��������ĵ��Ʒָ���Ϊһ�����ֶ�,ÿ������������ɭ�ֵ�һ���֡��Ե��ƽ������ػ���ı��������ԭ�е�����,��ɲ���Ҫ�����ݶ�ʧ,���ӹ����������Dz����˶����ĵ������뷨,����ȵر����˵��ƵĿռ�����,�����ղ�����ȡ���˲�����Ч���������˼����Ϊ��������е�ÿ����ѧϰ��Ӧ�Ŀռ����,Ȼ���������е�������õ�ȫ�ֵ������������������ѧϰ��������������������ÿ�����ĵ�����Ϣ,Ȼ��������������ѧϰ�������ݵĹؼ�����,���е��Ʒָ�������ģ�����¡�

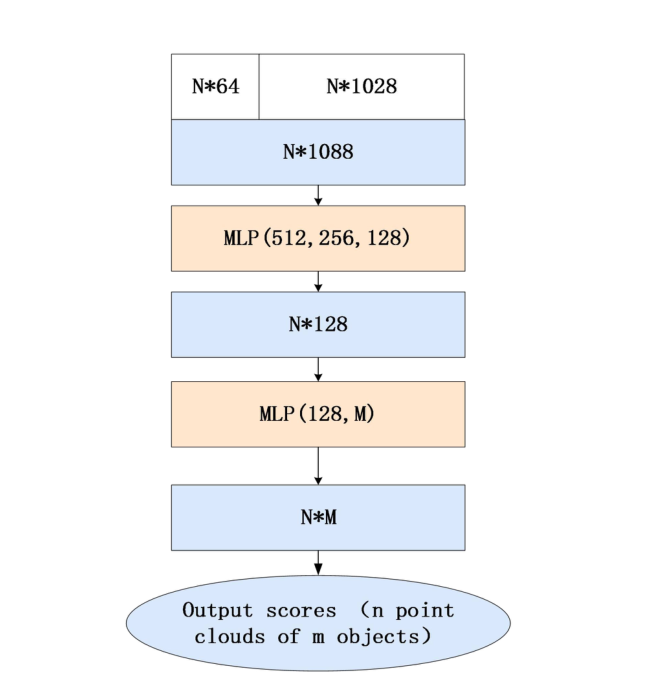

����ͼ��ʾ,����Ϊһ֡���е������ݵļ���,��ʾΪn��3�Ķ�ά����,����n��ʾ���Ƶĸ���,3��Ӧxyz����[43]������,ͨ�������������� T-Net ѧϰ�ı任���������������������,��ȷ��ģ�Ͷ��ض��ռ�任�IJ����ԡ�ͨ����� mlp Ϊÿ������������ȡ������,ʹ�� T-Net ���������ж��롣��������ÿ��ά�Ƚ������ػ�����,�õ����յ�ȫ�����������,ÿ������㶼��õ�һ��1024ά��������ͨ�����ػ�,��n-1024�ںϳ�1024ά���������������������

���ڶԾֲ�������Ҫ��,��Ҫ��n��64���ֲ�������1024άȫ������������������ں�,��64ά����֮�����ÿ�����1024��ȫ�����������γ���һ�� 1088 ά��������Ȼ����һ��mlp(512,512,128)ѧϰn��1088ά������ά��,����һ��n��128������,��(128,m)��֪�������յ��������з���,����n��Ӧn����,m��Ӧ��m������Ӧ�ĵ㡣��Ϊ��ͬһ����,����m����Ϊ1[ 4 4 ]��

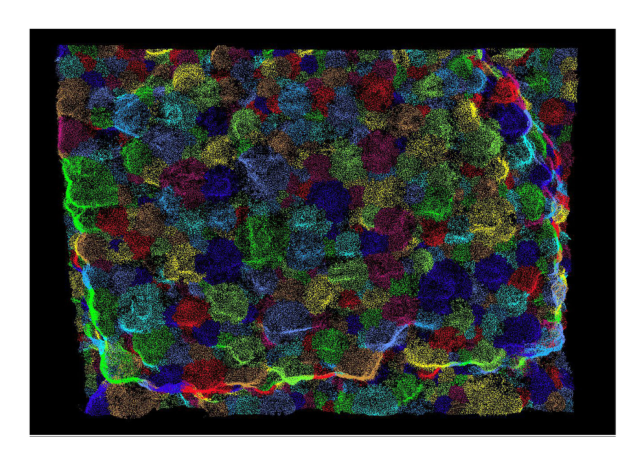

�ָ��������к�,���ǿ��Եõ�n���������ĵ���ģ�͡����ǶԷָ��IJ�ͬ���ƽ��в�ͬ��ɫ����Ⱦ,���Եõ��ָ����Ŀ��ӻ�,ʹ�ָ�һĿ��Ȼ��

���ǽ�������ģ���е���ߵ�����Ϊ�������㡣���Ƕ�ȡ�������ݵ� (x, y, z) 3-D ��Ϣ,Ȼ�����ǿ��Դ� (x, y) ֪�����ĵ���λ��,�� z �õ����ĸ߶ȡ��������ǶԷָ��ĵ���ģ�ͽ����˳������������ǵõ��˻����ֵص�������Ϣ��

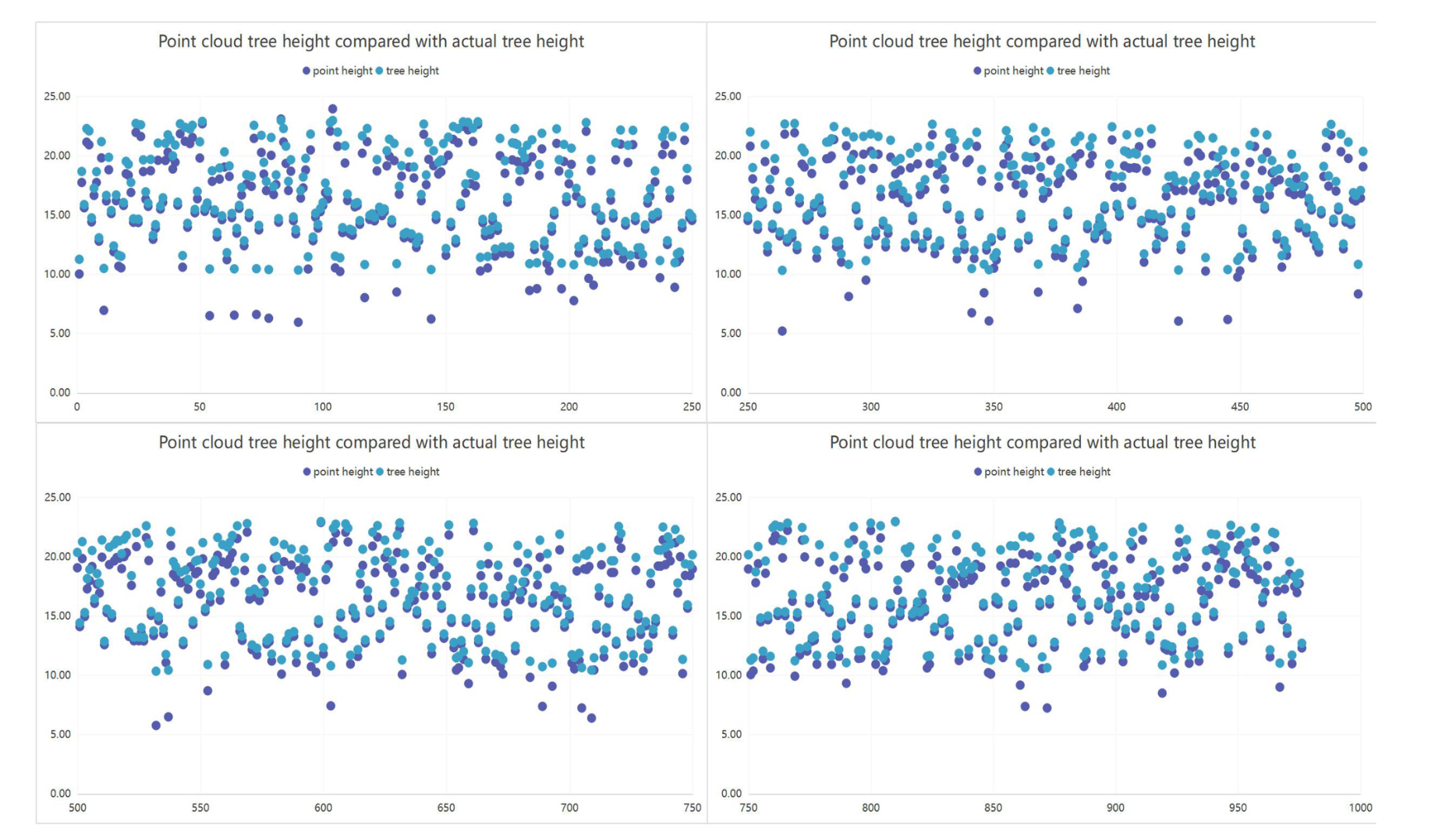

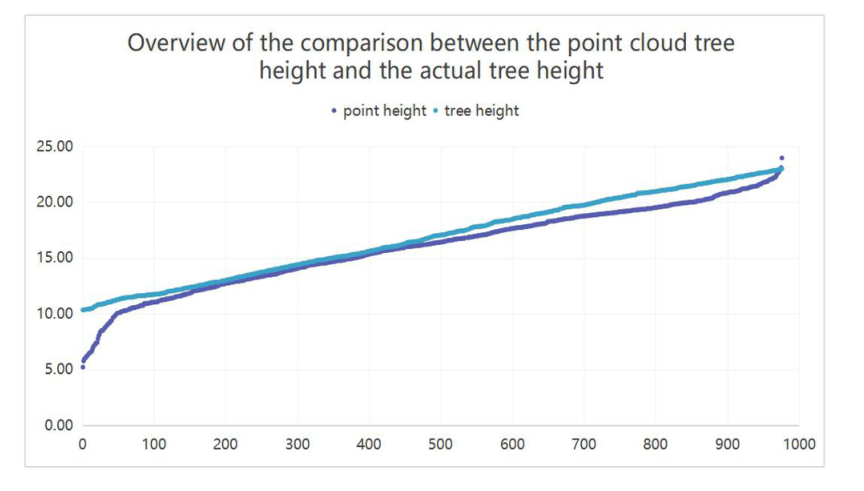

�ָ�����ȷ�Կ���ͨ���������жϡ��������Ƿ���ԭ����1000�������ֳ���977����,Ȼ��������ȡ�˻�����ģ�͵ĸ߶�,ȷ���˶�Ӧ����id��Ȼ�������õ������ݽ�������ʵ���˹����������߽��бȽ�.�������ϴ��ģ��,������Ϊ�ָ�������,�ж�Ϊ����ָ���ǵ�ʵ�ʲ����в��������,������Ϊ���߽����15%���ڵĿɽ�����Χ�ڡ���ͼ��ʾ����ͼ12��13,�������ԶԱȺ��˹��ж�,100�����Ʒָ�1000����,���߲��ϴ������ڽϵ͵����ϡ�������Ϊԭ�������������ֵصĹڲ��ܶȽϸ�,�ϵ͵���ľ���赲,����ģ��ʧȥ�˴�����������������������Ϊ,�ڽϵ͵Ĺڲ�ˮƽ��ɭ���л��и��õ�ʵ����.

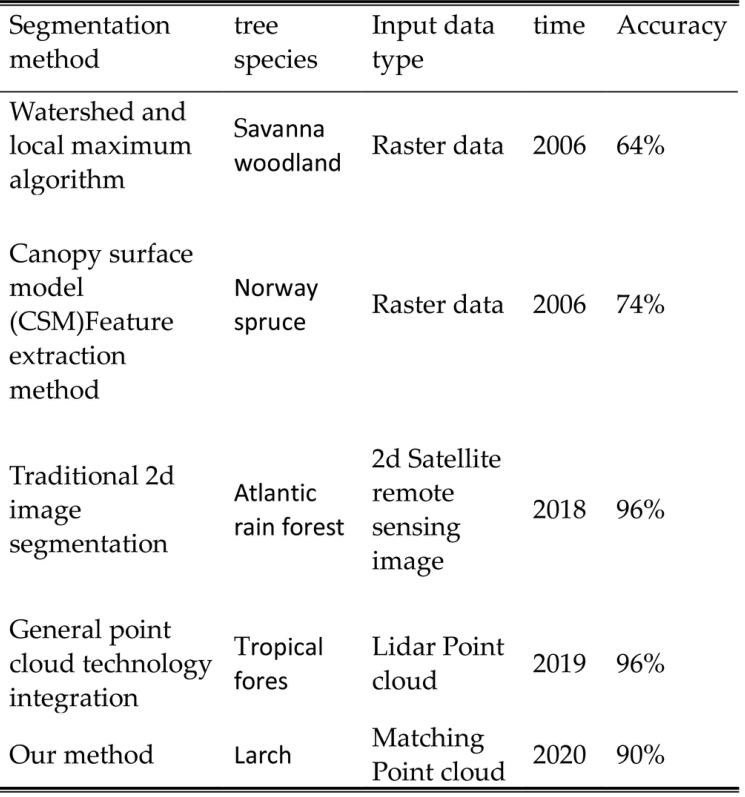

���ǵķָ�����ͼ 11 ��ʾ���õ�ʵ������,���ǽ�ʵ�����뾭���㷨�������㷨�����˱Ƚ�,��ȷ�����㷨�Ƿ���Խ������ѡ������ߴ����ԵĴ�ͳ�㷨������������㷨,������ͳ������Ӱ��ָ��㷨�����ѧϰ���Ʒָ��㷨,��ʹ�����ǵıȽϸ����������˵������

������ѡ���һЩ�������㷨��

-

Chen���������һ�ִӵ�����������ȡ�������ķ������÷�����markcontrol��ˮ��ָ��Ӧ�����ȴ�ϡ����ԭ�ֵصĵ��������롣��������,ͨ�������ֲ����ֵ���������[45]�����ǵ�ʵ������˾���ȷ��Ϊ 64.1% �Ľ����

-

Solberg ���������һ�ֿ������ڶ���״�����ڱ���ģ�� (CSM) �в���������㷨���ָ����ĵ��ơ����㷨��Ų����ɼ���еõ�Ӧ�ú���֤,���Ϊ74% [46]��

-

Wagner ������������ͼ��������ڷָ�,��ͨ��Ԥ������ɭ������ѡ�߽���ǿ�����ڱ߽����ؼ�⡢������ӰУ�������ڷָ�,����Ӧ�����ȴ����������ֵ�������������ԭ��������,ʶ���ʸߴ�96%,��Ҳ֤���˴�ͳ��ά����Ӱ��ĵ�ľ�ָ�ȡ���˲����Ľ�չ,ȷ�����Խ�һ�����[47]��

-

Burt ����ʹ����ͨ�õĵ��ƴ�������,����ŷ����þ��ࡢ���ɷַ�������������ķָ��״��Ϻ���ͨ�Բ��ԡ�ʹ��treeseg��Դ����,�������ȴ�ɭ���е���ľ�ָ���ʵ����96%��ȷ��[48]��

ͼ 9 ���������е����ݴ�����

ͼ 10. Split ���硣

ͼ 11. �ָ�����

�ԱȽ�����һ��ʾ��������һϵ�в�ͬ�㷨�ľ��ȶԱȿ��Կ���,���ǵ��㷨�ھ������Ѿ�ԶԶ�����˴�ͳ�ľ�����Ʒָ��㷨����ͳ�Ķ�ά����Ӱ��ָ�,���������и������Ϣ,���Ʒָ������Ӱ��ָ��������,��Ϊ���ǿ��Եõ�һϵ�ж�ά��Ƭ����õ���Ϣ,�����ߡ��ؾ��ȡ����,�����µĵ��Ʒָ�����,���ǵľ������Բ���,��������ʹ�����˻�ƥ��������ݶ����Ǽ����״�������ݡ����˻�ƥ��������ݵľ���Զ���ڼ����״�����,ֱ�ӵ������ǵķָ�Ȳ����ߡ���һ�ֿ��������ֲ�ͬ���������ȴ�����,���������´���Ҷ�֡���Щ���⽫�����ǽ�һ��������о��м���̽�֡�������Ҳ�����ǵ�����,����С�����˻��ļ۸�ȼ����״�͡���һ����ʹ���ǵ��㷨����ʵ�ú����С�

ͼ 12 ��ȡ������������߱Ƚ�(�������ʾ�� id,�������ʾ�߶�)��

ͼ 13. �ӵ͵���������ľ�õ�������Աȶȡ�

��һ �ָ����Ƚ�

V. CONCLUSION

�����ʵ����,����ʵ��������Ŀ�ꡣ���������˻��ĵ��Ʋɼ������ѧϰ�ĵ��Ʒָ

����,ʹ�����˻������ǰ�����״��豸���ռ��������ݡ���Ȼ�״��豸��ȡ�ĵ�����Ϣ�dz�ȷ,�������״��豸�ɱ��߰�,���������ܹ�ʹ�á�������,�������˻��ķ�չ,�ر��Ƿɿؼ������ȶ��ͳ���,��б��Ӱ�����õ��˷�չ�㷺Ӧ�á������о��˴��ܼ�ƥ��Ķ���ͼͼ���л�ȡ���ƵIJ�����㷨�������˶��ָ��ṹ(SFM)��PMVS�㷨��õ������ݡ����ݵ����˲�ȥ���,ͨ���Ե������з���,�ɹ��������ڸ߶�ģ��(CHM);���,���߿���ֱ�Ӵ�����CHM��ÿ��������Ϣ�����еõ���

���,�봫ͳ��ʹ�û���ѧϰ�㷨��ȡ������ľ������Ϣ�ĵ������ĵ�����Ϣ�ķ������,��ȷ��������ͻ�ơ����,����ȷ�ؽ��յ�ɭ�ֵ���Ҫ��Ϣ,����ľ�ĵ������͵���������,����ζ�����ǿ��Ը�����Щ���ݽ�һ������õ���Ҫ����Ϣ,����ɭ�ֵ�̼����,����������ҵ��Դ��Ϣ������ҵ�ɳ�����չ��

�ڱ�ʵ��Ĺ�����,��Ȼ����ȡ���˽Ϻõķָ�Ч����ȷ��,����Ȼ���ںܶ�㡣����,�����������о�����Ե��ǵ�һ���֡����ͨ�������Զ�ʶ��ͬ���ֺͲ�ͬ����(�����˹��콻�ֺ���Ȼ�ֵ�ʶ��)����һ���о��Ĺؼ�������,�о��������,���㷨�ڵ����ָ�ߵ����ܶȷ����ȷ�������½����������ڽϸ��ܶȵ�������֤�㷨��ȷ�Գ�Ϊ����ؽ����������⡣

���,��Ȼ���ǵ�ʵ�黹����һЩ����,��ʵ�����������˻���������ľ��Ϣ��ȡ����ķ�չDZ������Ϊ�������˻���ȡ��ҵ��Ϣ�ṩ��һ���ܺõ�����,Ϊδ��������ʱ�����о��ṩ�˿��еķ�������ϣ����δ��,���ǿ��������ʵ���Ͽ��Ǹ���Ĺ���,�Լ�����ڲ�ͬ�Ļ�����Ӧ��ɭ������������о���

ԭ������:https://ieeexplore.ieee.org/abstract/document/9140300

REFERENCES

[1] J. Hyyppa, O. Kelle, M. Lehikoinen, and M. Inkinen, ��A segmentationbased method to retrieve stem volume estimates from 3-D tree height models produced by laser scanners,�� IEEE Trans. Geosci. Remote Sens., vol. 39, no. 5, pp. 969�C975, May 2001.

[2] J. Rasmussen, G. Ntakos, J. Nielsen, J. Svensgaard, R. N. Poulsen, and S. Christensen, ��Are vegetation indices derived from consumer-grade cameras mounted on UA Vs sufficiently reliable for assessing experimental plots?,�� Eur . J. Agronomy, vol. 74, pp. 75�C92, 2016.

[3] Z. Lv, H. Song, P . Basanta-V al, A. Steed, and M. Jo, ��Next-generation big data analytics: State-of-the-art, challenges, and future research topics,�� IEEE Trans. Ind. Inform., vol. 13, no. 4, pp. 1891�C1899, Aug. 2017.

[4] Y . Sun, H. Song, A. J. Jara, and R. Bie, ��Internet of things and big data analytics for smart and connected communities,�� IEEE Access, v o l . 4 , pp. 766�C773, 2016, doi: 10.1109/ACCESS.2016.2529723.

[5] L. Wallace, A. Lucieer, C. Watson, and D. Turner, ��Development of a UA V -LiDAR system with application to forest inventory,�� Remote Sens., vol. 4, no. 6, pp. 1519�C1543, 2012.

[6] J. Heiskanen, ��Estimating aboveground tree biomass and leaf area index in a mountain birch forest using ASTER satellite data,�� Int. J. Remote Sens., vol. 27, no. 6, pp. 1135�C1158, 2006.

[7] Z. Huang et al., ��Retrieval of aerodynamic parameters in rubber tree forests based on the computer simulation technique and terrestrial laser scanning data,�� Remote Sens., vol. 12, no. 8, 2020, Art. no. 1318.

[8] K. E. Fankhauser, N. S. Strigul, and D. Gatziolis, ��Augmentation of traditional forest inventory and airborne laser scanning with unmanned aerial systems and photogrammetry for forest monitoring,�� Remote Sens., vol. 10, no. 10, 2018, Art. no. 1562.

[9] T. Y un et al., ��Simulation of multi-platform LiDAR for assessing total leaf area in tree crowns,�� Agricultural F orest Meteorol., vol. 276�C277, 2019, Art. no. 107610.

[10] B. T. Fraser and R. G. Congalton, ��Issues in unmanned aerial systems (UAS) data collection of complex forest environments,�� Remote Sens., vol. 10, no. 6, 2018, Art. no. 908.

[11] Q. Feng, J. Liu, and J. Gong, ��UA V remote sensing for urban vegetation mapping using random forest and texture analysis,�� Remote Sens. v o l . 7 , no. 1, pp. 1074�C1094, 2015.

[12] J.-C. Padr��, F.-J. Mu?oz, J. Planas, and X. Pons, ��Comparison of four UA V georeferencing methods for environmental monitoring purposes focusing on the combined use with airborne and satellite remote sensing platforms,�� Int. J. Appl. Earth Observ. Geoinformation, vol. 75, pp. 130�C140, 2019.

[13] J. Lin, M. Wang, M. Ma, and Y . Lin, ��Aboveground tree biomass estimation of sparse subalpine coniferous forest with UA V oblique photography,�� Remote Sens., vol. 10, no. 11, 2018, Art. no. 1849.

[14] J. Goetz, A. Brenning, M. Marcer, and X. Bodin, ��Modeling the precision of structure-from-motion multi-view stereo digital elevation models from repeated close-range aerial surveys,�� Remote Sens. Environ., vol. 210, pp. 208�C216, 2018.

[15] J. Toma?t��k, M. Mokro?, ?. Salo��n, F. Chudy, and D. Tun��k, ��Accuracy of photogrammetric UA V -based point clouds under conditions of partiallyopen forest canopy,�� F orests, vol. 8, no. 5, 2017, Art. no. 151.

[16] J. Liu et al., ��Extraction of sample plot parameters from 3D point cloud reconstruction based on combined RTK and CCD continuous photography,�� Remote Sens., vol. 10, no. 8, 2018, Art. no. 1299.

[17] F. Cao, F. Liu, H. Guo, W. Kong, C. Zhang, and Y . He, ��Fast detection of Sclerotinia sclerotiorum on oilseed rape leaves using lowaltitude remote sensing technology,�� Sensors, vol. 18, no. 12, 2018, Art. no. 4464.

[18] R. B. Rusu and S. Cousins, ��3d is here: Point cloud library (pcl),�� in Proc.

IEEE Int. Conf. Robot. Automat., 2011, pp. 1�C4.

[19] L. Windrim and M. Bryson, ��Forest tree detection and segmentation using high resolution airborne LiDAR,�� 2018, arXiv:1810.12536.

[20] X.-C. Zhang, J.-T. Xi, and J.-Q. Y an, ��A methodology for smoothing of point cloud data based on anisotropic heat conduction theory,�� Int. J. Adv.

Manuf. Technol., vol. 30, no. 1�C2, pp. 70�C75, 2006.

[21] A. J. Mathews and J. L. R. Jensen, ��Visualizing and quantifying vineyard canopy LAI using an unmanned aerial vehicle (UA V) collected high density structure from motion point cloud,�� Remote Sens., vol. 5, no. 5, pp. 2164�C2183, 2013.

[22] L. P . Tchapmi, C. B. Choy, I. Armeni, J. Gwak, and S. Savarese, ��Systems and methods for semantic segmentation of 3D point clouds,�� U.S. Patent Application, vol. 155, no. 16, p. 843, 2019.

[23] G. Dartmann, H. Song, and A. Schmeink, Big Data Analytics F or CyberPhysical Systems: Machine Learning F or the Internet of Things. N e w Y o r k , NY , USA: Elsevier, 2019.

[24] W. Lin, Y . Meng, Z. Qiu, S. Zhang, and J. Wu, ��Measurement and calculation of crown projection area and crown volume of individual trees based on 3D laser-scanned point-cloud data,�� Int. J. Remote Sens., vol. 38, no. 4, pp. 1083�C1100, 2017.

[25] J. Ren, X. Chen, and Z. Zheng, ��Future prospects of UA V tilt photogrammetry technology,�� IOP Conf. Series: Mater . Sci. Eng., vol. 612, no. 3, 2019, Art. no. 032023.

[26] R. S. Shih et al., ��UA V 3D modeling with multi-spectral imaging: an example of wax apple tree,�� Proc. SPIE 11130 Imaging Spectrometry XXIII: Appl. Sens. Process., vol. 11130, 2019, Art. no. 1113008.

[27] T. Urayama et al., ��UA V -based structure from motion�CMulti-view stereo (SfM-MVS): Mapping cliff face of central crater of Mt. Miharayama, Izu Oshima, Central Japan,�� in Unmanned Aerial V ehicle: Applications in Agriculture and Environment. Berlin, Germany: Springer, 2020, pp. 119�C129.

[28] C. Guo, G. Liu, W. Zhang, and J. Feng, ��Apple tree canopy leaf spatial location automated extraction based on point cloud data,�� Comput. Electron.

Agriculture, vol. 166, 2019, Art. no. 104975.

[29] Y . Duan, T. Peng, and X. Qi, ��Active contour model based on LIF model and optimal DoG operator energy for image segmentation,�� Optik, vol. 202, 2020, Art. no. 163667.

[30] A. Gardezi, U. Malik, S. Rehman, R. Y oung, P . Birch, and C. Chatwin, ��Enhanced target recognition employing spatial correlation filters and affine scale invariant feature transform,�� Proc. SPIE 10995 Pattern Recognit.

Tracking XXX, vol. 10995, 2019, Art. no. 109950.

[31] F. Hu, Y . Li, and M. Feng, ��Continuous point cloud stitch based on image feature matching constraint and score,�� IEEE Trans. Intell. V eh., v o l . 4 , no. 3, pp. 363�C374, Sep. 2019.

[32] J. Ma, J. Jiang, H. Zhou, J. Zhao, and X. Guo, ��Guided locality preserving feature matching for remote sensing image registration,�� IEEE Trans.

Geosc. Remote Sens., vol. 56, no. 8, pp. 4435�C4447, Aug. 2018.

[33] F. Pittaluga, S. J. Koppal, S. B. Kang, and S. N. Sinha, ��Revealing scenes by inverting structure from motion reconstructions,�� in Proc. IEEE Conf.

Computer Vision Pattern Recognit., 2019, pp. 145�C154.

[34] A. Alfonso-Torre?o, ��. G��mez-Guti��rrez, S. Schnabel, J. F. L. Contador, J. J. de Sanjos�� Blasco, and M. S. Fern��ndez, ��sUAS, SfM-MVS photogrammetry and a topographic algorithm method to quantify the volume of sediments retained in check-dams,�� Sci. Total Environ., vol. 678, pp. 369�C382, 2019.

[35] J. Hata, K. Ito, and T. Aoki, ��A 3D reconstruction method using PMVS for a limited number of view points,�� Proc. SPIE 11049 Int. Workshop Adv.

Image Technol., vol. 11049, 2019, Art. no. 1104942.

[36] B. Bhowmick, S. Agarwal, S. Sinha, B. Purushothaman, and A. Mallik, ��Methods and systems for surface fitting based change detection in 3D point-cloud,�� U.S. Patent, 2019.

[37] I. L. Sari, R. Maulana, H. S. Dyatmika, A. Suprijanto, R. Arief, and S.

Ali, ��Study of digital elevation model (DEM) extraction using stereo radargrammetry TerraSAR-X in Madiun area��Elevation accuracy improvement,�� in E3S Web of Conf., EDP Sciences, vol. 94, 2019.

[38] T. Tian, D. Wang, and X. Zhao, ��Impacts of the land surface slope on forest spatial distributions,�� in Proc. 8th Int. Conf. Agro-Geoinformatics (Agro-Geoinformatics), 2019, pp. 1�C4.

[39] Z. Zheng, P . Kirchner, and R. J. Bales, ��Topographic and vegetation effects on snow accumulation in the southern Sierra Nevada: A statistical summary from lidar data,�� Cryosphere, vol. 10, no. 1, pp. 257�C269, 2016.

[40] M.-S. Fradette, A. Leboeuf, M. Riopel, and J. B��gin, ��Method to reduce the bias on digital terrain model and canopy height model from LiDAR data,�� Remote Sens., vol. 11, no. 7, 2019, Art. no. 863.

[41] J. Lisein, M. Pierrot-Deseilligny, S. Bonnet, and P . Lejeune, ��A photogrammetric workflow for the creation of a forest canopy height model from small unmanned aerial system imagery,�� Fo re s t s, vol. 4, no. 4, pp. 922�C944, 2013.

[42] K. Ogura, Y . Y amada, S. Kajita, H. Y amaguchi, T. Higashino, and M. Takai, ��Ground object recognition and segmentation from aerial image-based 3D point cloud,�� Comput. Intell., vol. 35, no. 3, pp. 625�C642, 2019.

[43] C. R. Qi, H. Su, K. Mo, and L. J. Guibas, ��Pointnet: Deep learning on point sets for 3d classification and segmentation,�� in Proc. IEEE Conf. Comput.Vision Pattern Recognit., 2017, pp. 652�C660.

[44] T. Tsujibayashi, K. Inoue, and M. Y oshioka, ��Normal estimation of surface in pointcloud data for 3D parts segmentation,�� in Proc. IEEE Int. Conf.Artificial Intell. Eng. Technol., 2018, pp. 1�C5.

[45] Q. Chen, D. Baldocchi, P . Gong, and M. Kelly, ��Isolating individual trees in a Savanna Woodland using small footprint lidar data,�� Photogrammetric Eng. Remote Sens., vol. 72, no. 8, pp. 923�C932, 2006.

[46] S. Solberg, E. Naesset, and O. M. Bollandsas, ��Single tree segmentation using airborne laser scanner data in a structurally heterogeneous spruce forest,�� Photogrammetric Eng. Remote Sens., vol. 72, no. 12, pp. 1369�C1378, 2006.

[47] F. H. Wagner et al., ��Individual tree crown delineation in a highly diverse tropical forest using very high resolution satellite images,�� ISPRS J.Photogrammetry Remote Sens., vol. 145, pp. 362�C377, 2018.

[48] A. Burt, M. Disney, and K. Calders, ��Extracting individual trees from lidar point clouds using treeseg,�� Methods Ecol. Evol. vol. 10, no. 3, pp. 438�C445, 2018.