Cross-spatiotemporal land-cover classification from VHR remote sensing images with deep learning based domain adaptation基于深度学习域适应的VHR遥感影像跨时空土地覆盖分类

0.摘要

利用超高分辨率(VHR)遥感影像进行土地利用/土地覆盖(LULC)自动分类,可以使我们快速、大规模和细粒度地了解地球表面的城市化和生态系统过程。尽管深度学习技术的迅速应用促进了VHR图像的土地覆盖分类,但其中一个关键挑战尚未得到深入研究,即当前数据驱动的深度学习模型严重依赖于标记训练数据(即源数据)与未标记数据(即目标数据)分布之间的高度相似性。然而,在实践中,这个条件很少满足,并且每次为目标数据手动准备标签是不现实的。本文综合评价了现代深度学习分类模型的领域自适应方法。域自适应的目的是缩小标记源数据和未标记目标数据之间的域偏移,为基于深度学习的模型充分利用历史训练数据,摆脱持续人工工作的需要提供了一种实用的方法。在此基础上,提出了一种新的两阶段域自适应跨时空分类方法DACST,该方法的输入源数据为有标记的,目标数据为无标记的。它由图像级适应阶段和特征级适应阶段组成,前者对齐源数据和目标数据的外观并生成目标程式化的源图像,后者进一步缩小深度特征空间中的域偏移。DACST显著提高了嵌入在特征级自适应阶段的分类模型的时空可移植性,从而输出令人满意的分类地图。在本研究中,我们还对传统的和基于深度学习的图像级和特征级领域适应方法进行了VHR LULC分类的综合性能评估。对来自世界各地的5个大型数据集的跨时空场景进行了二元和多类分类。该方法具有较高的性能和较好的鲁棒性,预示着深度学习时代跨域VHR土地覆盖分类的新基线正在形成。实验还表明,传统的和基于深度学习的图像级域适应方法在不同的情况下都能发挥作用,但几乎所有的特征级方法在不同的数据上都是高度不稳定的。

1.概述

土地利用/土地覆盖(LULC)的模式和变化与人类活动密切相关,并对地球生态系统的功能产生深远影响(Foley et al., 2005;Li和Myint, 2021年;Yan et al., 2015)。对人与自然关系的深入研究,可以深刻理解和正确处理人与自然的关系。遥感影像分类现在是获取大规模和细粒度土地覆盖或LULC地图的主要方法。然而,许多土地覆盖分类研究基于低分辨率遥感图像,例如中分辨率成像光谱仪(MODIS) (Santos等人,2021年;Zhou等人,2013年),或中分辨率遥感图像,如陆地卫星(Carneiro等人,2021年;魏曼和刘,2015;张等人,2021);然而,这些数据不能提供关于地球表面的详细信息,也不能用于在精细尺度上探索LULC的模式和过程。随着极高空间分辨率(VHR)光学遥感图像的日益普及,越来越多的研究人员开始利用VHR图像实现更有效、更细粒度的土地覆盖分类。

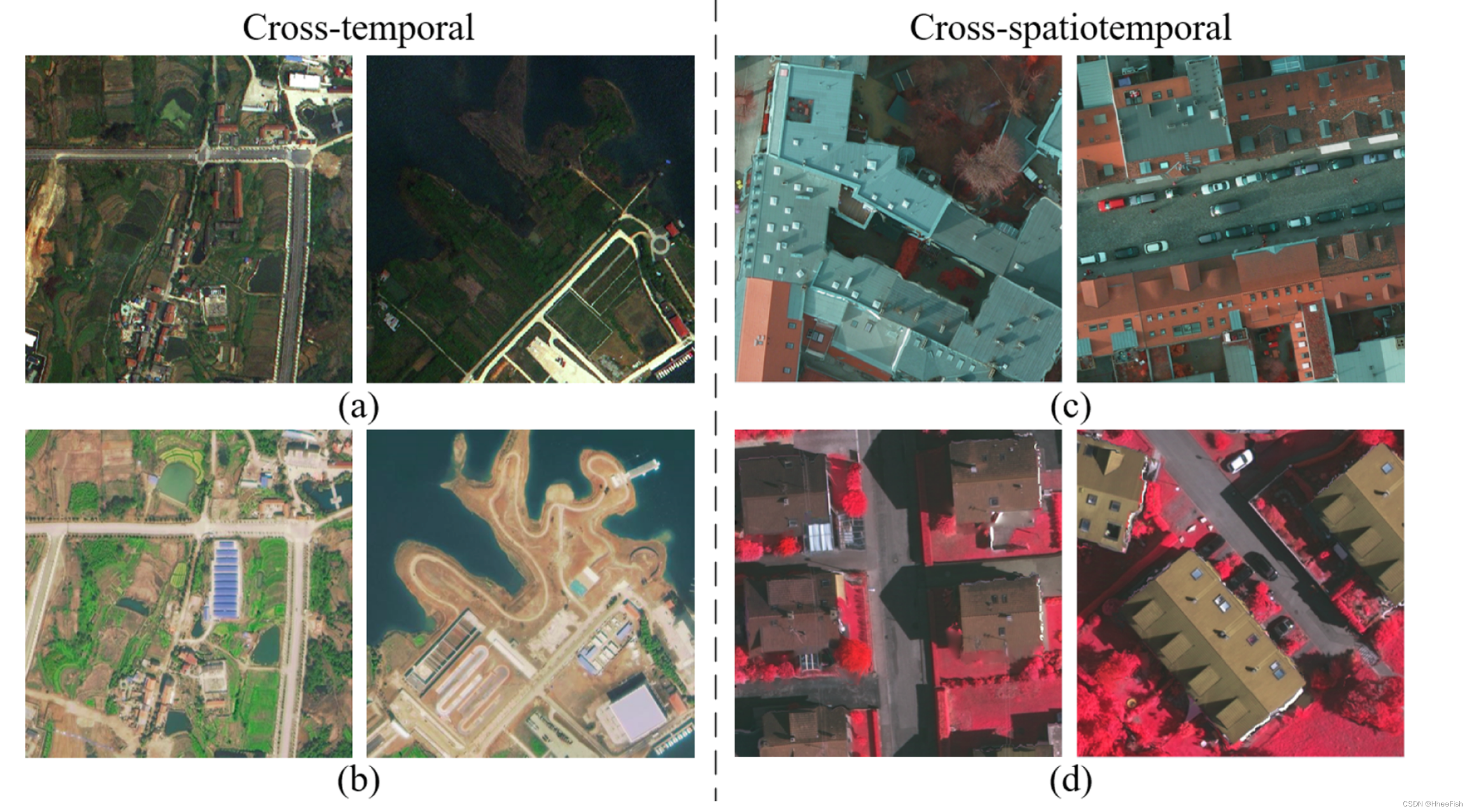

图1 (a)和(b)为同一位置的双时间图像。?和(d)为跨时空图像。在(A)或?图像上预训练的模型很难很好地在(b)或(d)图像上工作,因为外观差异很大

然而,利用VHR遥感影像进行土地覆盖分类面临着巨大的挑战,主要有以下典型问题:第一个问题来自VHR成像,即VHR遥感图像极好的空间分辨率是以牺牲光谱波段的数量为代价的(Guo et al., 2020),这可能导致不同类别之间的模糊和混淆,导致难以进行土地覆盖分类(Lv et al., 2021)。此外,丰富的细节提供了相当多关于复杂和异质景观的信息,这对统计学习算法构成了挑战,例如最大似然估计(Fisher, 1922)和k-means聚类(macquarie, 1967),它们基于物体均质和亮度值具有单峰分布的假设(Carbonneau et al., 2020;Tseng等人,2008)。第二个问题是,在不同时间或地点获得的VHR遥感图像中,物体的外观可能存在很大差异。一方面,不同的大气条件、季节、太阳海拔和采集传感器的差异(如光谱波段和拍摄角度)改变了物体的光谱特征,增加了类内变异性(Tasar等人,2021年;Yan等,2020),如图1(a) - (b)所示;另一方面,不同地方的建筑风格和城市布局也可能不同(图1? - (d)),这两者都造成了跨时间或跨时空分类的困难。分类任务中的第二个问题通常被称为领域转移(Ben-David等人,2010;Tuia等人,2016),其中每个获得的VHR遥感图像都可以被视为一个域。利用VHR遥感影像进行长期、大规模LULC研究的主要障碍是时间图像或不同地点图像之间的大域偏移。在本文中,我们主要考虑了区域移位问题,这是在VHR图像的土地覆盖分类中比第一个问题较少涉及的问题。在本节的以下部分中,我们简要回顾了VHR土地覆盖或LULC分类方法的发展,其中大多数方法缺乏处理领域转移的能力。我们还回顾了以缩小图像间的区域偏移为重点的区域自适应方法的发展,最后介绍了所提出的方法

遥感界在利用VHR遥感影像进行土地覆盖分类方面做了许多尝试。例如,基于光谱空间特征的分类方法将形状等空间特征耦合在一起(Huang et al., 2007;张等,2006),纹理(Agüera等,2008;Kabir等,2010;Pacifici et al., 2009)和结构(Wang et al., 2021),利用光谱信息减少光谱混淆的影响,获得更强的特征,以改进VHR遥感图像分类。基于对象的图像分析(OBIA)方法也通过将分类单位从像素改为对象而得到发展(Ma et al., 2017)。最近,由于深度学习技术在计算机视觉领域的重大突破(Chen et al., 2018;任等,2017;Shelhamer et al., 2017),许多遥感研究人员已经将注意力转向了基于深度学习的LULC分类。与传统方法中手动设计浅层特征不同,深度学习模型通过使用卷积神经网络(CNN)架构(Zhu et al., 2017b),自动从局部到全局范围学习深度特征,以捕获图像中最具特征的信息。一些早期的研究通过CNN获得深度特征,然后使用传统的分类器,如逻辑回归(Zhao和Du, 2016)、支持向量机(SVM) (Wan和Ma, 2020)和随机森林(Dong等人,2020)对特征进行分类。最近,基于端到端cnn的方法,如全卷积网络(FCNs) (Shelhamer等人,2017年)、U-Net (Ronneberger等人,2015年)和DeepLabv3+(Chen等人,2018年)已被用于执行土地覆盖分类,而不需要额外的分类器或后处理(Tong等人,2020年)。基于端到端的cnn方法由于其高效、准确的特点,已成为VHR土地覆盖分类中应用最广泛的方法。

上述方法,特别是基于深度学习的方法,虽然能够帮助解决VHR遥感影像土地覆盖分类的第一个问题,但无法直接处理VHR影像跨时间或跨时空的严重区域漂移问题。这是因为基于监督深度学习的方法严重依赖于训练和测试数据之间的相似性,并假设它们的特征空间分布相同。因此,基于深度学习的分类模型使用现有的标记VHR图像(称为源集)训练,在新的未标记VHR图像(称为目标集)上的表现会显著下降,这取决于两个集合的相似程度。为了对现有模型进行微调或训练新模型,再次需要手工标记新图像。显然,这种劳动密集型和耗时的工作流程是不切实际的。此外,现有图像中的知识财富没有得到充分利用。因此,开发有效和高效的基于深度学习的方法来解决VHR遥感图像的领域转移问题,对于跨越不同传感器、时间、空间和动态大气条件的自动和快速土地覆盖分类至关重要。

用于缩小图像之间的域移的方法称为域适应。一般来说,领域自适应方法可分为图像级方法和特征级方法。图像级方法试图通过最小化外观差异来对齐源图像和目标图像之间的颜色或光谱分布。颜色转移代表了一种直观和容易理解的图像级解决方案。例如,沃利斯滤波器(Li et al., 2006)、线性monke - kantorovich (LMK)解(pittie and Kokaram, 2007)和迭代分布转移(IDT)算法(pittie et al., 2005)利用图像的统计数据,从目标图像到源图像进行全局颜色映射。此外,最优传输方法针对给定的转换度量或成本寻求最小的最优转换,以将源图像传输到目标域(court等人,2017;塔迪等人,2019年)。

近年来,图像间翻译和逼真风格转换方法为图像级域自适应提供了更有前途的方法。“风格”一词最初用来描述不同艺术家的绘画风格,在最近的一些机器学习文献中,它被用来描述图像的不同外观(Hsu et al., 2020)。I2I翻译方法采用生成对抗网络(GAN)训练源域和目标域之间的图像级域适应模型,以生成目标程式化的源图像。然而,在I2I翻译中应用GAN会导致图像内容发生无例外的变化。在训练阶段可以添加一些约束条件,以保持翻译图像与原始图像之间的语义信息。例如,CycleGAN使用循环一致性约束来确保映射到另一个域的图像可以倒转到原始域(Zhu等人,2017a)。无监督图像间翻译(UNIT)网络通过共享潜在空间的约束来加强翻译后的图像与原始图像之间语义信息的一致性(Liu et al., 2017)。与I2I翻译方法不同,逼真风格转换方法更通用,大多数都不需要对处理过的源图像和目标图像进行训练(An et al., 2020;李等,2018;Luan等,2017;Yoo等人,2019)。逼真风格的传输模型通常包含三个结构:(1)在非常大的开源数据集(如MS_COCO)上预训练的自动编码器(Lin et al., 2014);(2)风格转移模块,如增白和着色变换(WCT) (Li et al., 2017)和AdaIN (Huang and Belongie, 2017);(3)对目标图像进行一些可选的处理,以更好地保存空间和上下文信息。这种样式转换模型在有限的计算资源下更容易实现。

另一方面,特征级的域适应是指使源域的深度特征分布适应于目标域的深度特征分布。在文献中,大多数特征级域适应方法都是基于GANs,如野外FCNs (Hoffman等人,2016)、AdaptSegNet (Tsai等人,2018)、显著性感知信息瓶颈(SIB) (Luo等人,2019)和物物差异处理(DTST) (Wang等人,2020)。基于GAN的方法在不同的特征级别上进行对抗训练,以获得域不变的特征。例如,AdaptSegNet在输出特征空间中对齐源域和目标域(Tsai et al., 2018), SIB在深度特征空间中对齐两个域(Luo et al., 2019)。然而,基于gan的方法通常需要较大的GPU内存,并且由于训练最优鉴别器和最优生成器之间的矛盾,有时不稳定。其他研究将自我训练应用于特征级领域适应。基于自训练的方法,如类平衡自训练(CBST) (Zou et al., 2018)和Zheng和Yang(2021)提出的方法,通过自训练为目标图像生成伪标签,然后使用这些伪标签对训练在源域上的分类模型进行再训练。然后利用该模型对目标图像进行分类。然而,生成的伪标签的质量是决定分类结果的最重要因素。第三种被称为自集成的方法是在半监督学习领域提出的,它已被引入到特征级别的域适应中,并提供了一种学习域不变特征的不同方式(Choi等人,2019;法国等,2018;徐等人,2019)。自集成模型通常由学生模型和教师模型组成(Tar-vainen和Valpola, 2017)。自集成方法通过在输入小扰动的情况下,使学生模型对未标记目标图像的预测结果与教师模型的预测结果一致来减小域移。例如,Xu等人(2019)提出了自集成注意网络(SEAN)方法,以指导对未标记目标图像的注意感知预测的一致性。然而,当源域和目标域之间的域漂移较大时,一致性约束往往不能很好地监督域不变特征的学习,从而导致负迁移问题。

在自然图像的计算机视觉领域,已经提出了上述的图像级或特征级的域适应方法。然而,由于遥感影像的成像过程受到复杂多变的大气环境以及不同季节、不同传感器等因素的影响,遥感影像的移动比自然影像大。因此,这些方法在直接应用于VHR土地覆盖分类问题时可能并不成功。

在遥感领域,现有的大部分域适应方法都是常规方法(Bruzzone and Persello, 2009;布鲁佐和普列托,2001;Deng等人,2018),少数是基于学习的方法(Lucas等人,2021),设计用于低/中分辨率和超/多光谱遥感图像。然而,对于光谱波段较少的VHR图像,以及参数复杂且庞大的基于深度学习的分类方法,这些方法可能无法提取有效的域不变信息。

到目前为止,很少有研究涉及VHR遥感影像领域的适应。然而,一些研究人员受到计算机视觉领域自适应的启发,提出了VHR遥感图像的领域自适应方法。例如,Benjdira等人(2019)将CycleGAN (Zhu等人,2017a)应用到LULC分类模型中进行领域自适应。Tasar等人(2020)遵循了图像级域适应的思想,提出了一种名为ColorMapGAN的I2I翻译模型。然而,ColorMapGAN的生成器非常简单,因为它只包含一个元素级矩阵乘法操作和一个矩阵加法操作,导致处理复杂领域适应场景的能力有限。Yan等人(2020)提出了一种利用域相似鉴别器的三元对抗性域适应(TriADA)方法,在输出特征空间中对齐VHR图像。显然,有益的图像级和特征信息并没有得到充分的开发。Ji等(2021)提出了一种土地覆盖分类的全空间域适应方法(FSDAN)。然而,FSDAN模型非常复杂,需要非常大的GPU内存(对于一个大小为256 ×256的小图像补丁,需要超过24 GB的内存)和非常长的训练时间。总体而言,到目前为止,我们还缺乏深度学习时代有效的领域适应方法来解决VHR土地覆盖分类的领域转移问题。

本文针对VHR遥感影像的域间特征移动问题,提出了一种针对遥感影像新的解决方案。提出了一种新的两阶段区域自适应方法,逐步提高分类模型对未标记目标VHR遥感图像的自适应能力。这个想法来自于这样一种想法,即深度特征域适应更接近输出空间,这表明性能更好,但相对不稳定,需要鲁棒的图像级域适应作为先决条件。首先,考虑到源图像和目标图像的外观差异,采用超快逼真风格传输方法将目标图像的外观转移到源图像上,减小图像级的域移;这样,目标风格化的源图像就像来自目标域一样产生,同时保持其语义信息与真实源图像的语义信息一致。其次,我们利用目标风格化的源图像和目标图像联合训练一个简单而高效的自集成网络,进一步缩小源域和目标域在特征层面的差距。值得注意的是,我们在训练阶段创新地将跨分支一致性约束应用到目标图像的预测中,克服了以往自集成网络中遇到的负迁移问题。然后,从经过训练的自集成网络的教师模型中得到目标图像的最终分类图。利用这两个阶段及其协同效应,该方法大大增强了分类模型的可移植性,具有较高的效率

综上所述,本文的主要贡献可以概括为:

(1)提出了一种新的VHR遥感影像分类的两阶段域自适应方法,该方法由风格转移模型和自集成模型组成,从图像层面和特征层面上逐步减小了不同VHR影像的域移,提高了土地覆盖分类模型的跨时空可转移性。

(2)首次对计算机视觉和遥感领域提出的用于不同场景VHR土地覆盖分类的典型图像级和特征级领域自适应方法进行了综合性能评价。我们还表明,局部案例研究远远不足以有效地评估单个方法的实际性能,因为它们可能对不同的数据非常敏感。相反,在5个大型VHR数据集上进行的分类实验,共对约88亿像素进行了分类,几乎涵盖了所有的领域适应情况,包括跨时间和跨时空场景下的二进制和多类分类。

(3)提出的区域自适应方法在五次实验中表现出最佳的性能和稳定性,且效率较高,可视为建立了跨区域VHR土地覆盖分类的新基线。

2.方法

我们提出了一个两阶段的跨域适配框架以解决跨时空VHR影像的分割问题,提高基于深度学习的分类模型在未标记目标数据和标记源数据情况下的适应性。提高基于深度学习的分类模型在未标记目标数据和标记源数据情况下的适应性。第一阶段的目的是缩小源域和目标域之间的图像级别差异,第二阶段的目的在于减少特征级别的域偏移,并建立一个适应域的分类模型。

形式上,源域图像xs∈?H×W×B与标签ys∈?H×W×C对的集合记为{(Xs, Ys)}。不带标签的目标域图像集xt∈?H×W×B记为{Xt}。H、W、B、C分别表示标签的高度、宽度、光谱频带数和类别号。为了保持一致性,当源图像和目标图像的地面分辨率相差较大时,可以重新采样使其接近。对于{(Xs, Ys)}中的图像和标签对,我们将它们分成Ns对补丁Us={{xis,yis}}.{Xt}中的图像也分为Nt补丁Ut={xit}Nti=1。

我们将在第2.1节中介绍所提出的领域自适应方法的整个框架。然后,我们在第2.2节中描述图像级域适应过程的实现细节。最后,我们在2.3节中介绍了提出的使用自集成网络的特征级域自适应方法。

2.1.整体框架

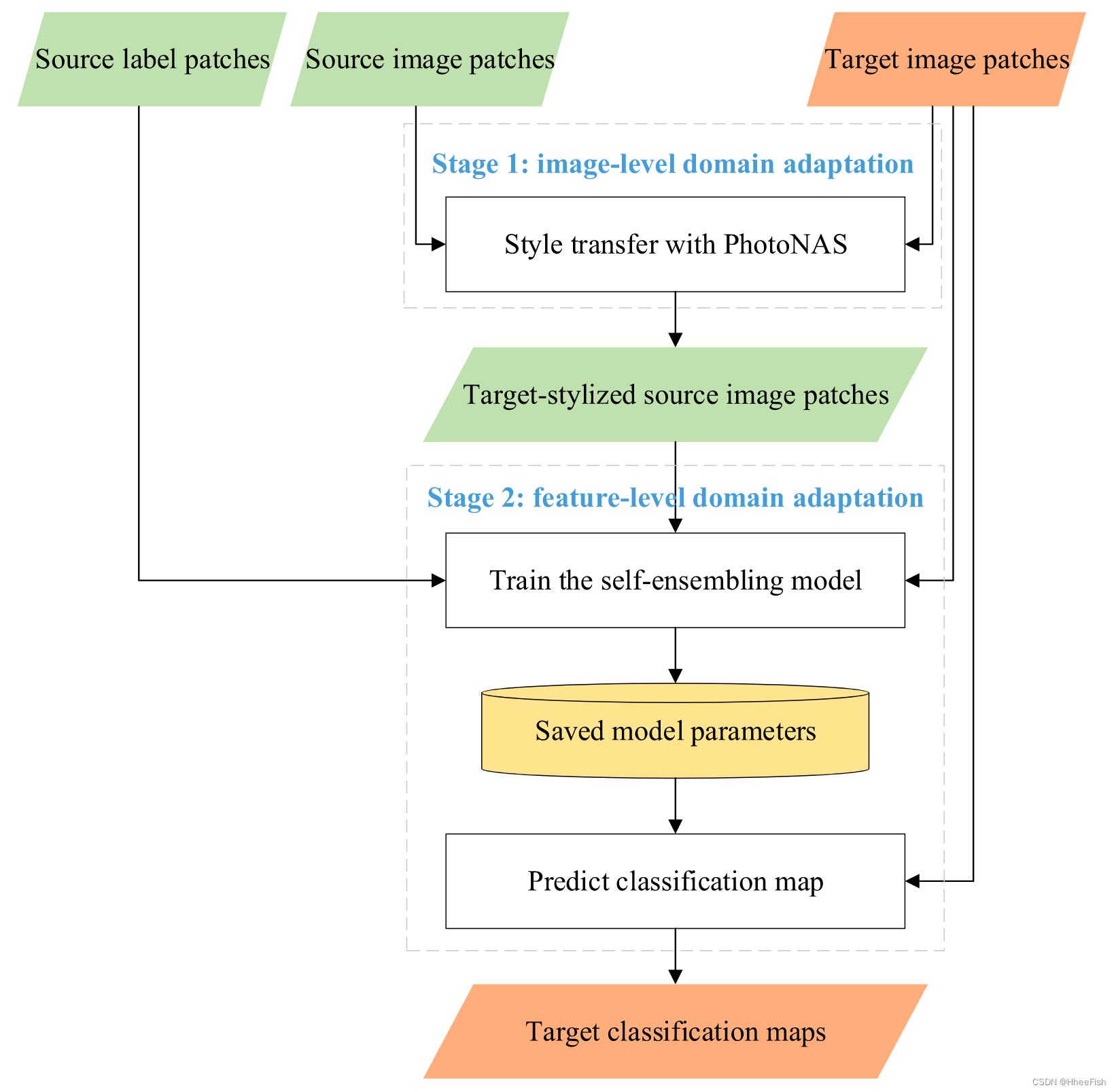

图2所示。所提方法的框架

我们提出了一种新的领域适应框架,专门针对主流的基于深度学习的分类(或所谓的语义分割)问题,通过缩小具有可用标签的源图像和未标记的目标图像之间的领域偏移,在图像级别和CNN特征级别。图像级域适应阶段和特征级域适应阶段两个阶段如图2所示。在完成领域自适应的同时,分类图也同时生成。在第一阶段,我们在图像级处理域转移问题,采用一种逼真的风格转移方法进行源到目标的风格转移,实现图像级源和目标域之间的域适应。具体来说,将每个源图像补丁与一个目标图像补丁配对,并将配对后的补丁输入到真实感风格转移模型中,生成目标程式化的源图像补丁x’s,其中x’s与其在Us中的对应标签构成一个新的模拟训练集U’s={(y’is,yis)}Nsi=1。然而,xs’和未标记Ut之间的差异并没有完全消除。

在第二阶段,我们引入特征级域自适应,利用一个特别设计的自集成网络进一步缩小源域和目标域之间的差异。自集成网络包含一个学生模型S和一个教师模型T。T是学生模型的变体的集成模型,也是最终的分类模型。在训练阶段,将U’s中的目标程式化图像补丁输入到学生模型S中进行监督分类训练。同时,将Ut中的图像块分别送入S和T,并加入不同的小高斯噪声,以提高模型的鲁棒性。S和T预测之间的一致性约束也指导学生模型的优化。通过上述训练过程,得到了最优的自集成网络。在测试阶段,我们将Ut中的目标图像patch输入到最优T中,得到分类图。然后可以将这些分类映射拼接到{Xt}的最终分类映射上。

2.2.生成目标风格化图像

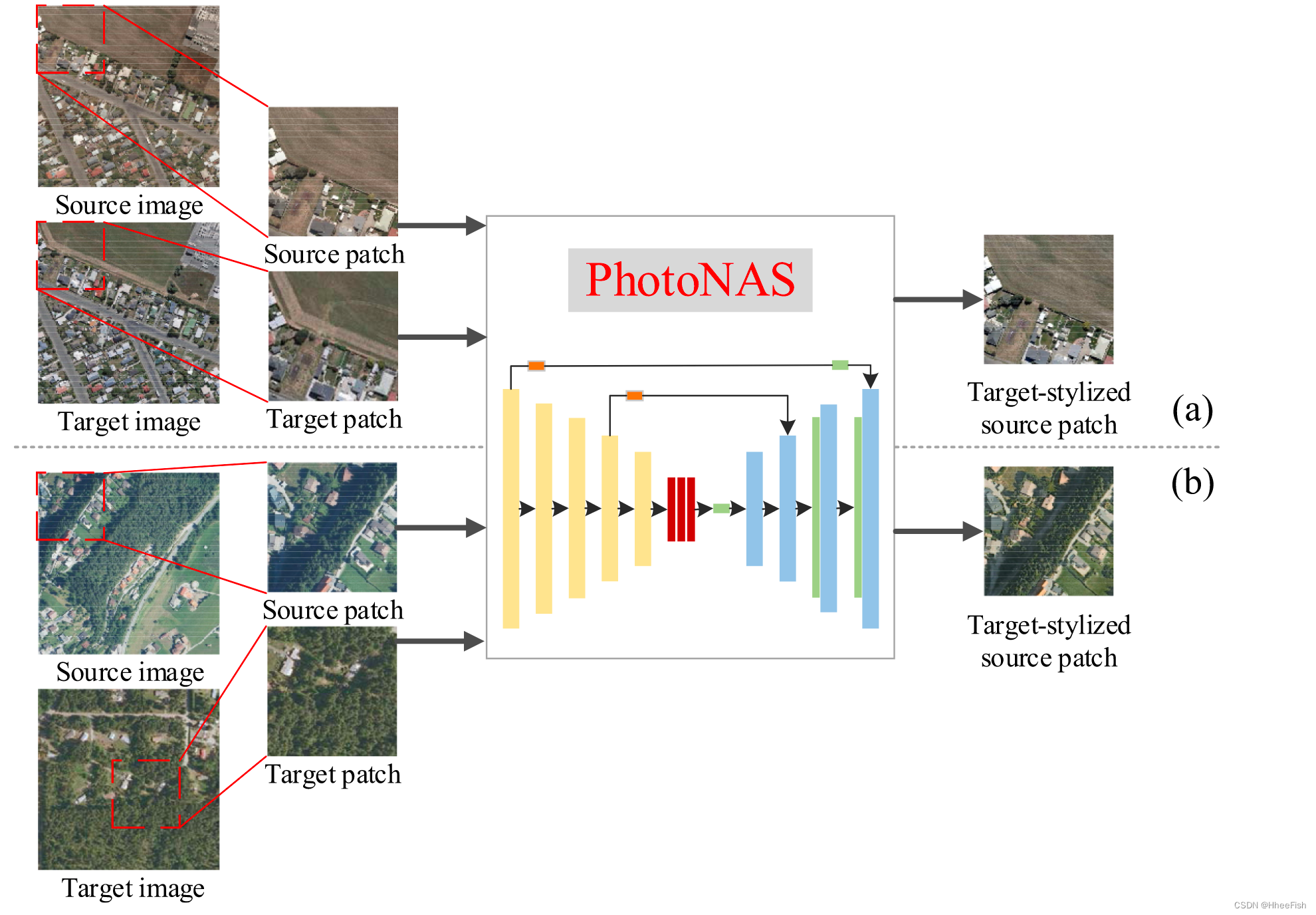

图3所示。生成目标风格图像的过程,其中(a)表示从同一区域捕获的图像的情况,(b)表示从不同区域捕获的图像的情况。

照片级真实感风格转换方法在图像之间的外观转换方面表现出比基于GAN的I2I转换方法更好的泛化能力(An et al.,2020)。泛化能力非常重要,因为我们可以将预处理在大量现有自然图像数据集上的真实感风格的传输模型直接应用于VHR遥感图像。我们使用了一个名为PhotoNAS(An et al.,2020)的风格转换模型,与其他最先进的风格转换方法相比,该模型在风格转换和语义保存方面表现出了优越的能力,例如PhotoWCT(Li et al.2018)和WCT2(Yoo et al.12019),将源图像的外观转换为目标图像。PhotoNAS在两个非常大的数据集(即ImageNet(Deng等人,2009)和MS_COCO(Lin等人,2014)上进行了完全预处理,并允许对任何两个遥感图像(源图像和目标图像)进行直接风格的传输,无需再训练。

如果我们将Us中的图像块作为内容图像,将Ut中的图像片作为样式图像,那么在遥感图像样式转换中有两种常见的情况。第一种情况是源图像和目标图像在不同时间从同一区域捕获,这与变化检测和地图更新任务密切相关。本文称之为跨时间案例。第二种情况,我们称之为跨时空情况,是源图像和目标图像来自不同的区域和时间。在第一种情况下,我们可以将源图像和目标图像的地理对齐补丁输入PhotoNAS,以输出目标样式化源补丁集{x’s},如图3(a)所示。在第二种情况下,我们将Us中的xs与Ut中的xt随机配对,如图3(b)所示。在这两种情况下,PhotoNAS都可以将外观从目标图像补丁转移到源图像补丁,并忠实地保留源图像补丁的语义内容

2.3.使用自集成学习时空可转换模型

2.3.1.自集成模型

与遥感图像域自适应中常用的单一学习模型不同,该框架的第二部分是自集成模型,该模型实现了特征级域对齐,并产生了最终的分类结果(Ji等人,2021;Yan等人,2020)。基于自集成的方法通常采用平均教师框架(Tarvainen和Valpola,2017),将基本模型(即学生模型)聚合为集成模型(即教师模型),从而获得比单个模型生成的结果更可靠、更稳健的结果,这有利于VHR遥感数据的处理。通过遵循平均教师框架,自我整合模型包括两个主要部分:学生模型S和教师模型T

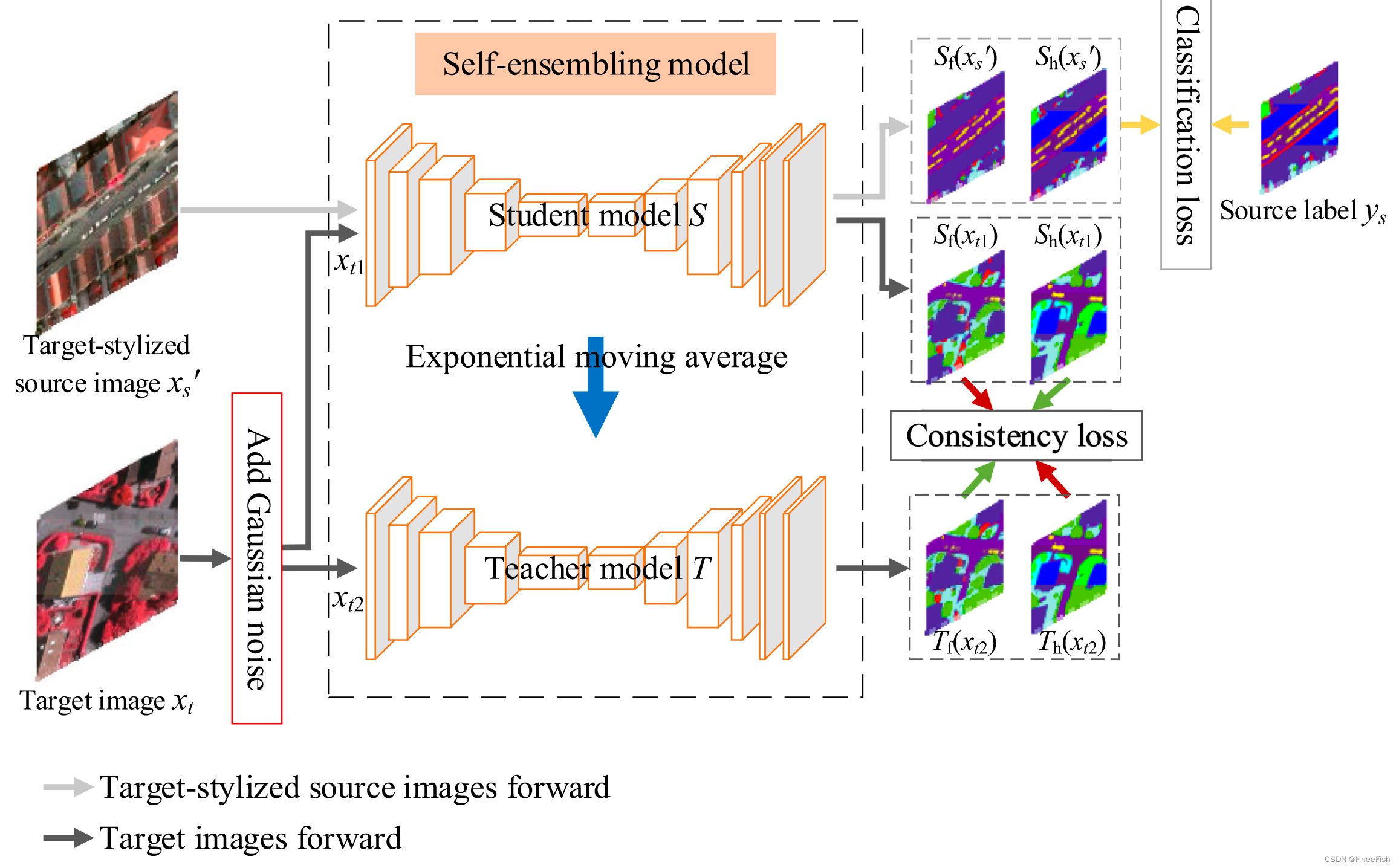

图4所示。提出的自集成模型综述

自集成模型的工作流程如图4所示。共有三个数据/特征流。

- 第一个由浅灰色箭头表示。从框架的第一部分生成的目标风格化源图像通过学生模型生成分类图,分类图由相应的源标签完全监督。

- 第二个和第三个数据/特征流由深灰色箭头表示,分别是通过学生模型和教师模型的目标图像,用于预测两组分类图,这两组图受一致性约束的监督

自集成模型的工作流程如图4所示。共有三个数据/特征流。第一个由浅灰色箭头表示。从框架的第一部分生成的目标风格化源图像通过学生模型生成分类图,分类图由相应的源标签完全监督。第二个和第三个数据/特征流由深灰色箭头表示,分别是通过学生模型和教师模型的目标图像,用于预测两组分类图,这两组图受一致性约束的监督。

在训练阶段,教师模型在第 i 个训练循环中的参数 θiT 被动态计算并使用学生模型的参数 θiS 和教师模型的参数 θi-1T 进行更新,如式(1)所示。

其中α是一个指数移动平均衰减,它控制了自集成的速度

通过跨分支约束进行训练

在以前的基于自我集成的方法中(例如,Choi等人,2019;Xu等人,2018),学生模型和教师模型针对每个目标图像块只生成一个预测图。它们定义了一致性损失,以迫使S生成与T生成的目标补丁一致的预测,这有助于S从目标域学习并生成域不变特征。然而,在之前的研究中(例如,Tarvainen和Valpola,2017;Xu et al.,2019),由于S受源域像素级分类损失的监督,S通常偏向源域,特别是当域间隙较大时。因此,S倾向于为目标补丁生成不准确的预测,这种偏差累积在T中,这使得优化过程在S和T模型的错误预测之间造成一致性损失时朝错误的方向前进。为了缓解这个问题,我们引入了一种基于联合训练策略的新思想(Zhou和Li,2005),这种思想基于这样一种信念,即具有不同参数的分类器可以提供输入数据的不同视图,并且可以将差异较小的结果组合成更稳健的结果。我们为S/T模型引入了一个额外的输出分支,它从半比例特征输出预测图,确保该输出与全尺寸特征生成的原始输出之间只有很小的差异。然后,我们将跨分支约束添加到输出。通过这种交叉分支约束,可以更好地监督没有真实标签的目标图像的输出,以防止负传输

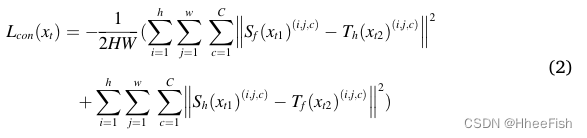

具体来说,对于Ut中的目标域补丁xt,我们首先通过向目标补丁xt添加平均值为零、标准偏差为0.1的不同水平高斯噪声来执行数据增强,并获得两个增强补丁xt1和xt2。数据增强是为了提高自融合网络对噪声的鲁棒性,并产生更准确的分类结果。S从目标补丁的全比例和半比例特征中输出两个预测图Sf(xt1)和Sh(xt1)(Sf和Sh的实现细节见第2.3.2节)。类似地,T输出的预测图表示为Tf(xt2)和Th(xt2)。如图4右侧所示,红色箭头表示S的第一个输出(即Sf(xt1))和T的第二个输出(如Th(xt2))的损耗,蓝色箭头表示S第二个输入(即Sh(xt1))和T的第一个输入(如Tf(xt2))之间的损耗。我们使用均方误差计算一致性损失,公式如式(2)所示

使用标记源域数据进行训练。对于Us中具有对应标签ys的目标程式化源补丁x’s,我们将其输入到学生模型S中,分别从第一输出分支和第二输出分支获得两个预测映射Sf(x’s)和Sh(x’s)。利用源域上具有交叉熵的像素级分类损失来监督S,其表达式如式(3)所示。

总损失函数Ltotal由未标记目标数据的一致性损失和标记源数据的分类损失组成,可表示为:

其中λ为一致性损失的权重。

2.3.2.学生和教师模型的实现

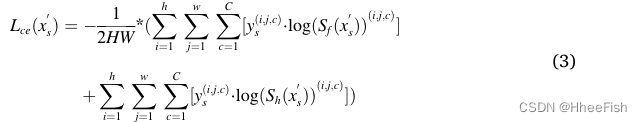

如图4所示,S和T采用相同的基于cnn的语义分割架构。在我们的实现中,我们采用了广泛使用的U-Net (Ronneberger et al., 2015)和轻量级VGG-16 (Simonyan and Zisserman, 2015)骨干网作为S和T的网络结构

图5所示。学生模型和教师模型的体系结构:一种改进的U- Net体系结构。

U-Net架构如图5所示。以三波段(Red, Green, Blue)的图像为例,则U- Net的输入尺寸为h ×w ×3,其中h和w为图像的宽度和高度。通过分层叠加卷积和最大池化运算,得到编码器中大小为h/16 ×w/16 ×512的深度特征图。该解码器由卷积层和反卷积层组成,用于将特征图上采样到图像的原始分辨率。编码器和解码器之间的跳跃式连接也添加在所有上采样阶段

如前所述,为了对目标图像patch的S和T模型的输出施加适当的约束,我们设置了两个不同的分支来输出差异较小的分类图。第一个分支输出来自解码器中最后一个特征的分类映射,大小为h ×w ×C,其中C是类的数量(这里是6)。新添加的第二个分支输出来自特征的另一个分类映射,大小为h/2 ×w/2 ×C,大小为2 ×up-sampled。

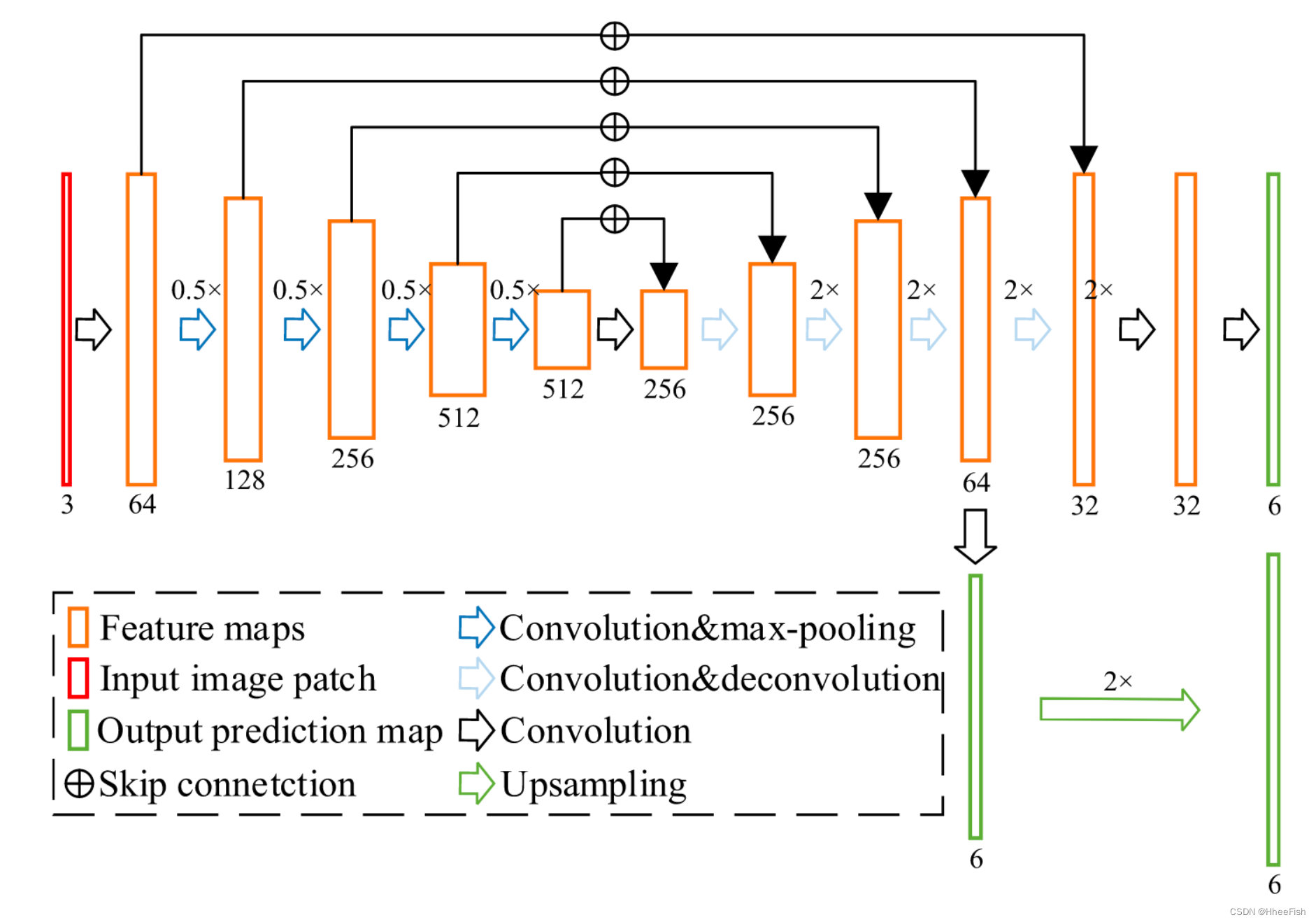

2.3.3.使用训练好的自集成模型生成分类图

图6所示。为目标图像生成分类图的过程

利用经过训练的自集成网络,可以生成目标集Ut中xt的分类映射。测试阶段如图6所示。将目标图像补丁xt输入到训练的T中,通过对两个输出分支的结果进行数值平均得到分类映射。在得到Ut的所有分类图后,如果需要,我们可以对其进行拼接,恢复目标图像的原始大小

3.实验分析

虽然所提出的两阶段域自适应方法在大多数情况下可以对未标记的目标图像产生令人满意的分类结果,但在更广泛的视角下,该方法仍有改进的空间。

我们发现多类分类比二元分类更具挑战性,数据集III中的沙漠和裸地类和数据集v中的簇/背景类IoU得分极低。这主要有两个原因。首先,严重的班级不平衡使得在监督训练过程中各个班级的学习不同步,导致分类模型偏向优势班级。在领域自适应过程中,监督学生模型存在这一问题,导致对非优势班级的自适应失败。其次,某一类的条件分布通常与其他类的条件分布不同,导致不同类的畴移可能不同。但该方法与主流的基于深度学习的域自适应方法一样,都是通过计算预测图中所有像素的均方误差等权值来对齐源域和目标域在输出空间中的分布,并且没有考虑类级的域自适应。

为了处理第一个问题,我们试图用focal损失(Lin et al., 2020)替换Eq.(3)中的交叉熵损失,这是解决类不平衡问题的一个众所周知的损失。不幸的是,这个简单的策略并没有提高模型的性能,如附录a中的表A1和表A2所示,仍需探索更有效的方法。例如,少数镜头学习方法(Li et al., 2021;Shaban et al., 2017)适用于人类的学习,因为我们只需要一些对象实例就可以概括某些知识。对于第二个问题,可以考虑更好地利用类信息,并在适应过程中启用更细粒度的对齐(例如,类级别)。

此外,所提出的方法不是端到端执行的方式,第一和第二阶段是解耦的。第一阶段产生一个中间结果,即目标程式化的源图像,作为第二阶段的输入。缺点是我们不仅要关注分类结果,还要关注中间结果。可能值得将第一和第二阶段进一步结合在一起,以创建更容易使用的端到端方法。然而,我们想强调的是,两阶段解耦框架的合理性和优势。第一个阶段,即图像级别的域适应阶段,不是特定于任务的(在这里进行分类),它可以很容易地用于处理一个新的任务,如遥感对象检测。在这种情况下,我们只需要关注第二阶段,即使用嵌入式对象检测模式的特征级域适应

4.结论

主流的深度学习方法基本上是数据驱动的,将这些方法应用到遥感任务中,需要充分利用丰富的历史样本,最大限度地减少人工准备新样本的工作量。这启发了我们在深度学习时代研究和开发领域适应技术。

本文利用源区域已有的标记VHR遥感影像,提出了目标区域未标记VHR遥感影像土地覆盖分类的两阶段域自适应框架。第一个阶段是基于逼真风格转移技术的图像级域适应阶段,用于缩小源图像和目标图像的外观差异,生成目标程式化的源图像。第二阶段是基于自集成神经网络的特征级域自适应阶段,在深度特征空间中对源域与目标域进行进一步的自适应,并采用嵌入式分类模型输出最终结果。在不同领域自适应情况下的实验结果表明,该方法在所有测试场景下都能取得令人满意的分类结果,且具有良好的鲁棒性。

我们相信,这项工作是对VHR土地覆盖分类领域适应方法的首次综合评价,也为跨时空领域适应引入了一个新的最先进的基线,将促进实际的VHR土地覆盖或LULC分类、地图制作和长期监测。