NLP�ʹ�Ƕ��

˼ά��ͼ

�ʻ����

��ǰ���ѧϰ������,����������һ���ʻ���ֱ��ʹ��Ӣ�ĵ��������б�����,���Ƕ��ڼ���Ͷ���,����ֱ��ʶ�ʵ�,Ϊ���ü�����ܸ��õ�������������,�������õ�����ģ��,������Ҫ�Դʻ���б���,�����Ǽ��ֲ�ͬ�Ĵʻ������ʽ

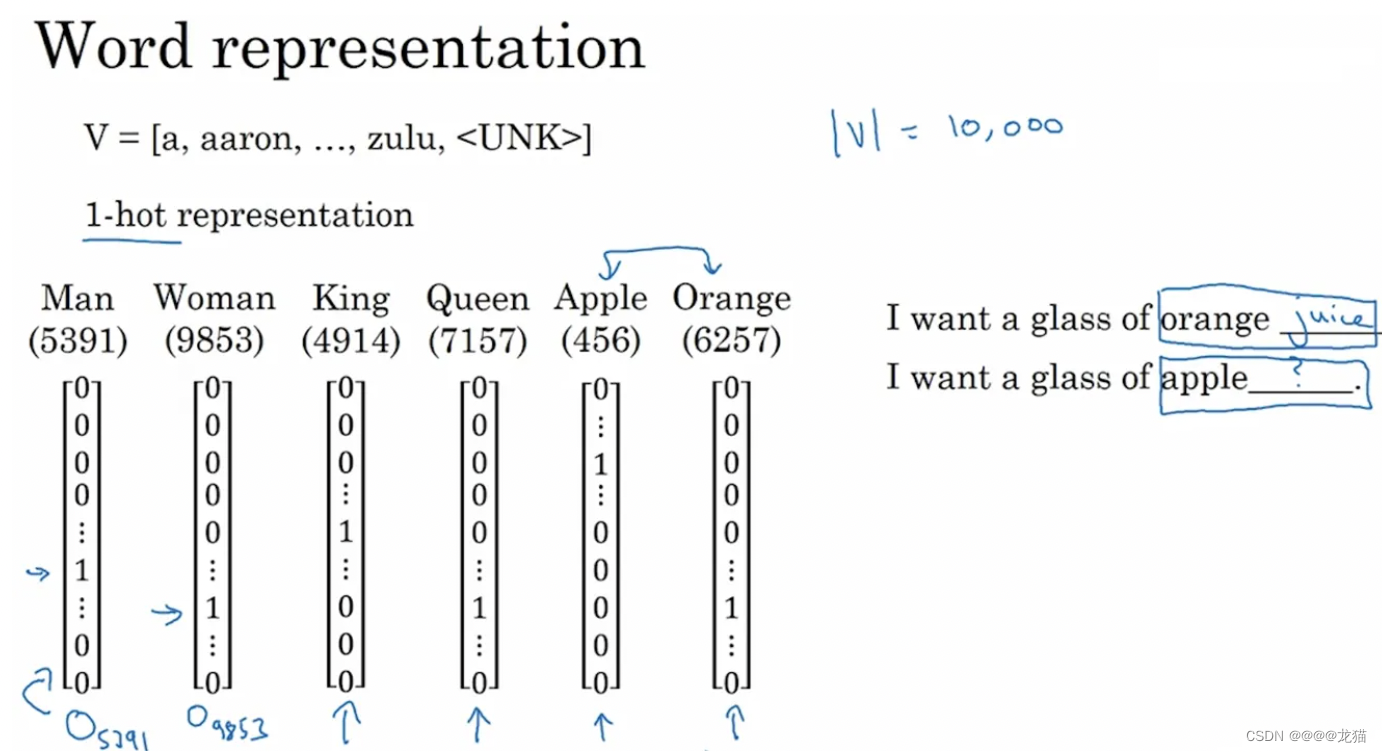

one-hot����

������one-hot�����ķ�ʽ��ģ���ֵ��еĵ��ʽ��б���,��Ӧ�ĵ��ʵ�λ����1��ʾ,����λ����0ȥ��ʾ,����ͼ��ʾ:

ȱ��:

��10000����Ϊ��,ÿ��������Ҫ��10000ά����ʾ,����ֻ��һ������0,����ά�ȶ���1,����dz�����,�洢����

ÿ���ʱ�ʾ��������˶�Ϊ0,����û�ܹ���ʾ���ʻ�֮�����ϵ,����orange��appleӦ������ϵ���ܵ�,����������Ĵʵ��ʾ�����ֳ���һ��

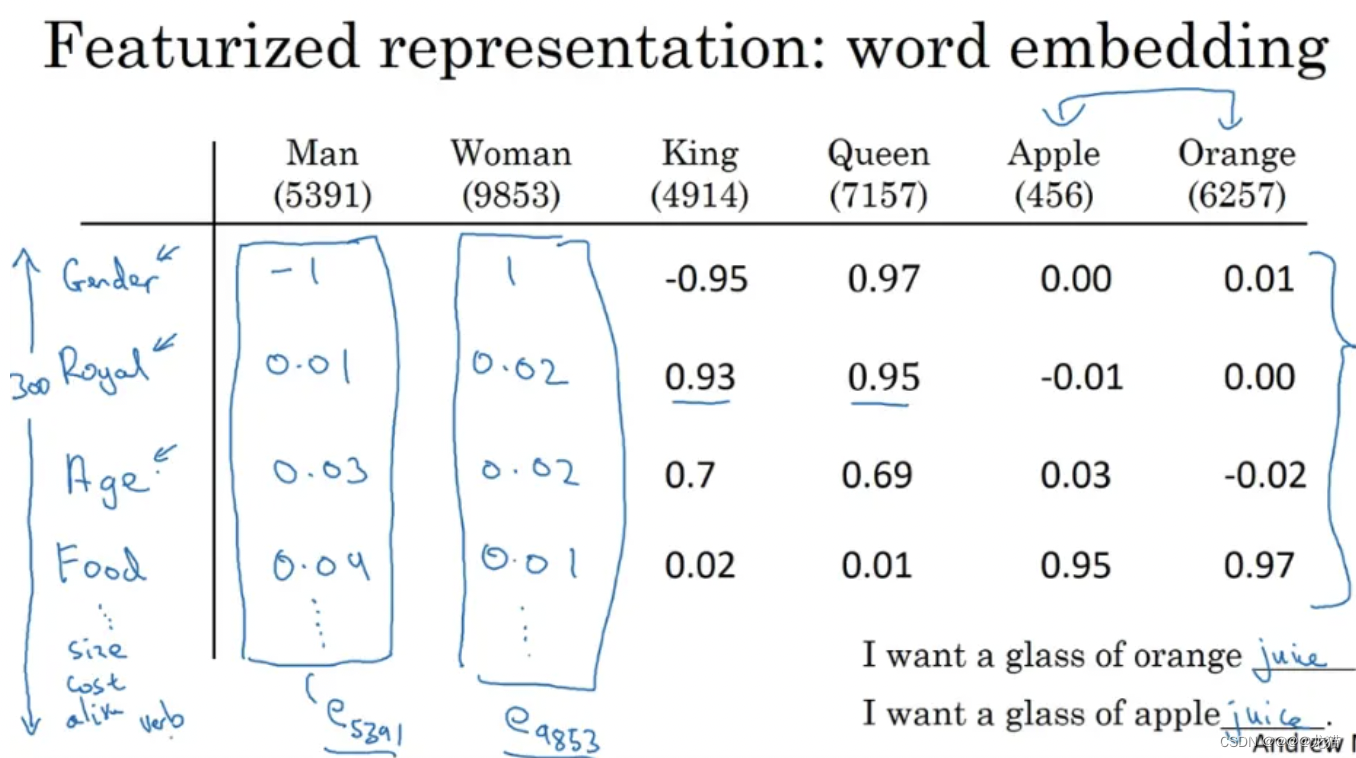

��������:��Ƕ��

����ͬ���������Ը����ʻ���б���,����ڲ�ͬ������,��ͬ�ĵ��ʾ��в�ͬ��ֵ

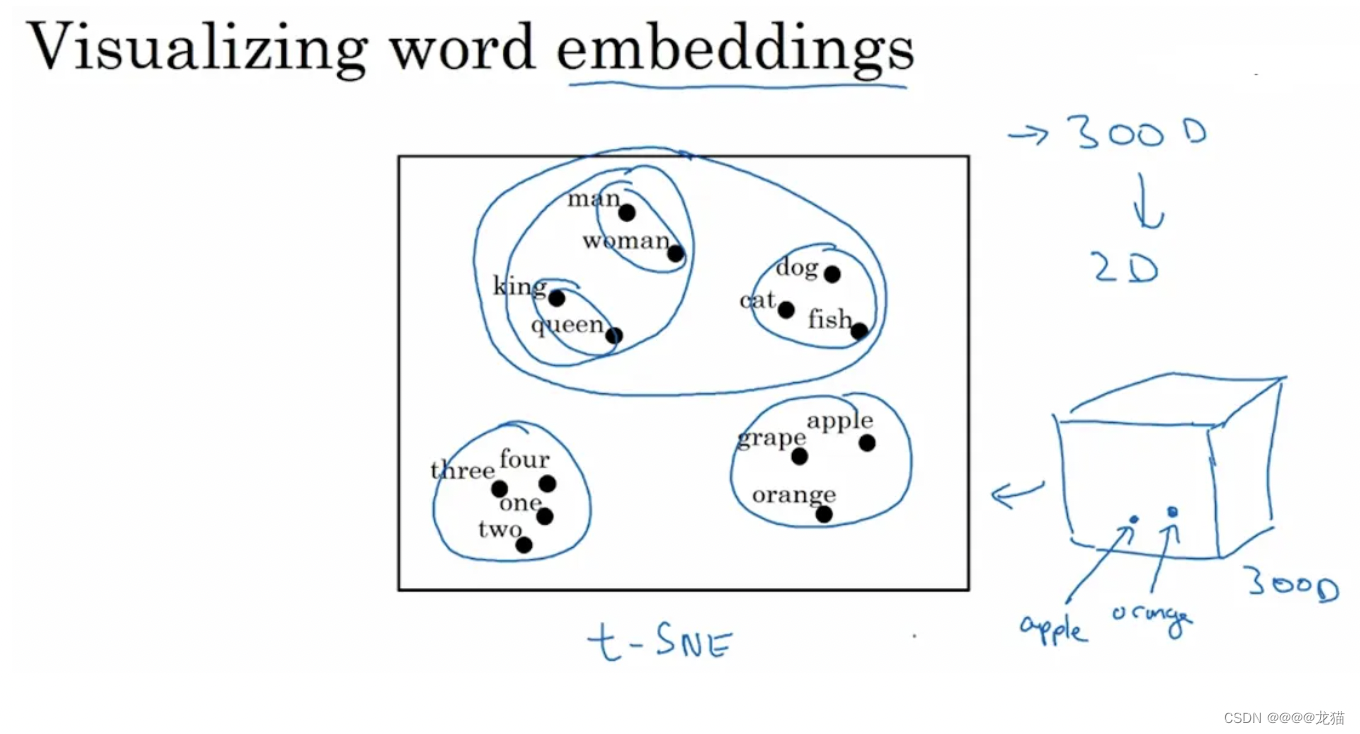

���ֱ�����ʽʹ�ô����֮��������Ժ����ױ�������,�������ڲ�ͬ�ĵ���,ģ�͵ķ������ܻ�úܶ�,����ʹ��t-SNE�㷨����ά�Ĵ�����ӳ�䵽2ά�ռ�,�����Դ��������п��ӻ�,�����Կ��Կ����������ƵĴ����Ǿۼ���һ��

ʹ��word Embeddings

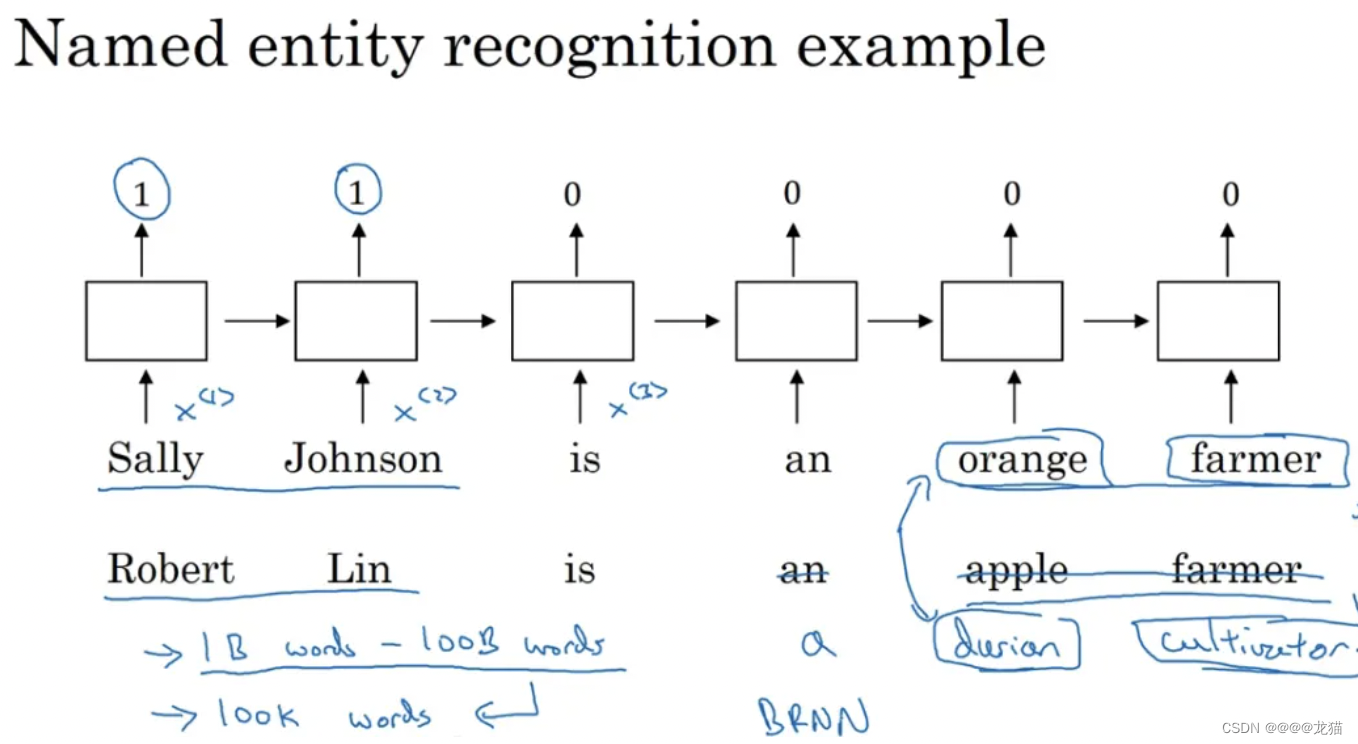

Word Embeddings�Բ�ͬ���ʽ������������ı�ʾ,����ν����ֱ�ʾ����Ӧ�õ���Ȼ���Դ�����Ӧ������?

����ʵ��ʶ�������:

�������һ������������ʵ��Ķ�λʶ������,����������һ���Ƚ�С�����ݼ�,���ܲ�����durain(����)��cultivator(������)�����Ĵʻ�,��ô���Ǿͺ��ѴӰ����������ʻ�ľ�����ʶ������ʵ�塣����������Ǵ����ϵ������ط���ȡ��һ��ѧϰ�õ�word Embedding,������������������һ��ˮ��,���������Һ�ũ������,��ô���Ǿ��п��ܴ�����������ѵ������,���ɳ�û�м����Ĵʻ��е�����ʵ�塣

��Ƕ���Ǩ��ѧϰ:

���˴�Ƕ��,���ǾͿ���ʹ��Ǩ��ѧϰ,ͨ�����ϴ������ޱ�ǩ���ı���ѧϰ��֪ʶ,Ӧ�õ����������ı�ѵ������������,��������Ǩ��ѧϰ�IJ���:

��һ��:�ȴ������ı�������ѧϰ��Ƕ��(��Ƕ�������һЩ��������ʾһ���ʻ�,������ͨ��one-hot��ʾ),��ȻҲ����ֱ��ʹ�ñ���Ԥѵ���õĴ�Ƕ��ģ��

�ڶ���:����Ƕ��ģ��Ǩ�Ƶ�����Сѵ������������

������:������������������������Ƿ�Ҫ������Щ��Ƕ��,������������ٵĻ�,ֱ��ʹ��֮ǰ�Ĵ�Ƕ��,���ݶ�Ļ�����ʹ���µı�����ݶԴ�Ƕ��ģ�ͼ���������

��Ƕ�����������

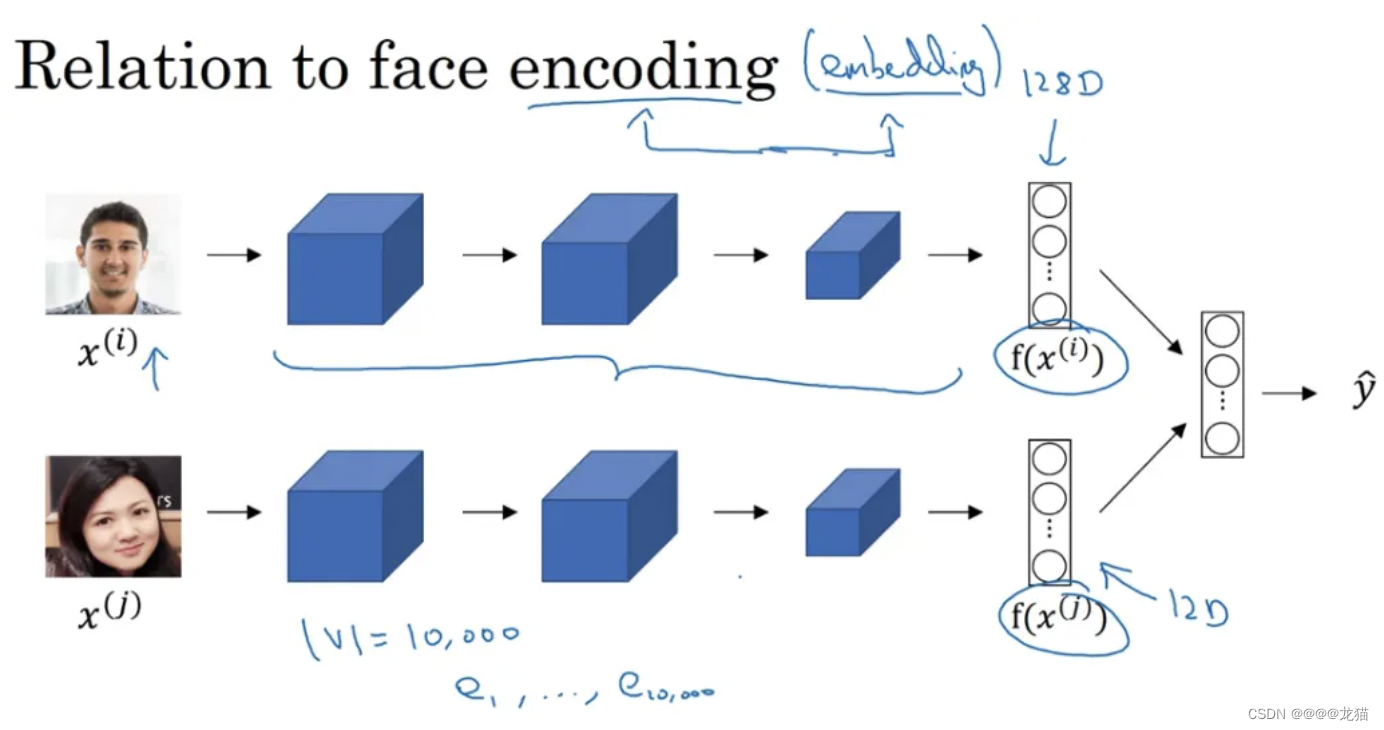

��Ƕ�����������֮���к��������ϵ,������ʶ������,���ǻὫ����ͼƬԤ����ɲ�ͬ�ı�������,�Ա�ʾ��ͬ������,������ʶ��Ĺ�����ʹ�ñ��������бȶ�ʶ����Ƕ���������������һ����������

����:

��������ʶ��,���ǿ��Խ�����һ��û�м�����������Ƭ���뵽���ǵ����ǹ�����������,������һ����Ӧ����������,���ڴ�Ƕ��ģ����,���дʻ�ı�������һ���̶��Ĵʻ���н���ѧϰ���ʵı����Լ���֮��Ĺ�ϵ

��Ƕ�������

�������������

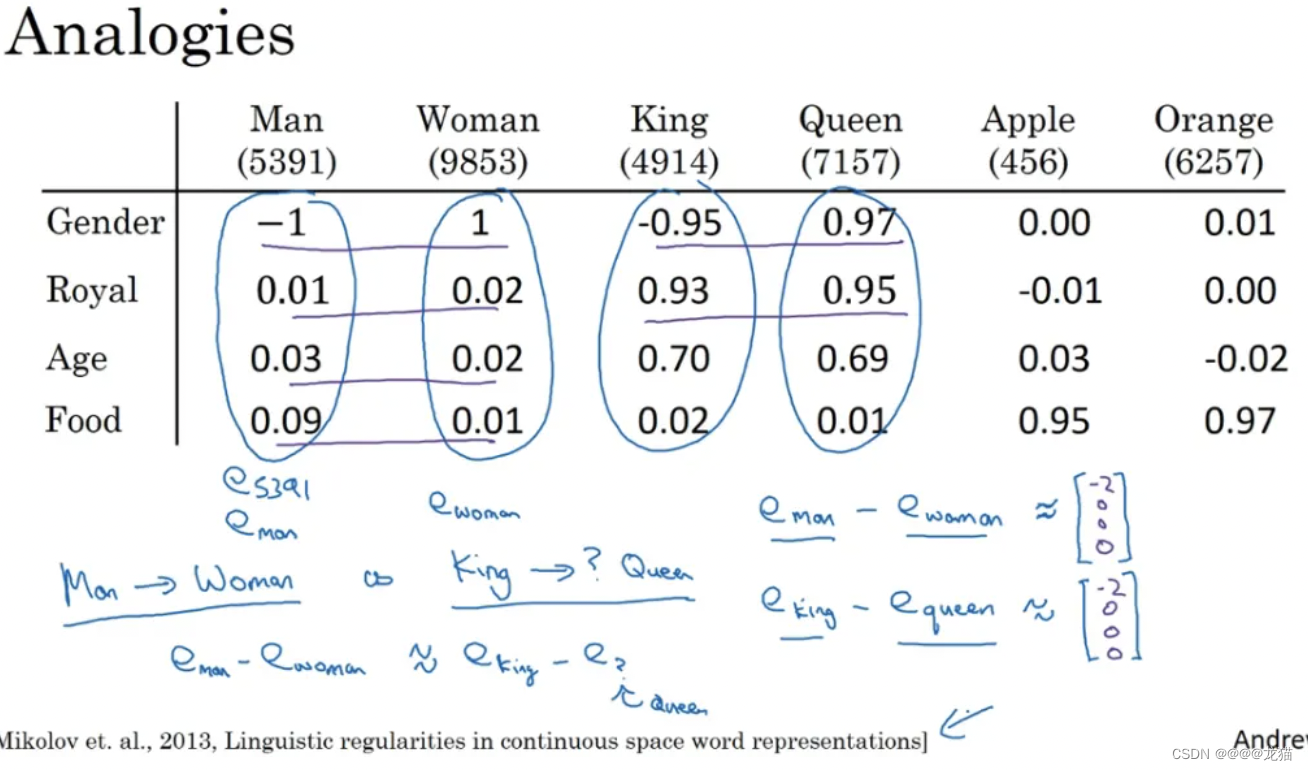

��Ƕ�뻹��һ����Ҫ������,���ܹ�����ʵ���������,�������������,ͨ����ͬ������֮����������,���Է��ֲ�ͬ��֮�����ȹ�ϵ,man-woman,king-queen,����ͼ��ʾ:

����˼������о����ǶԴ�Ƕ�뽨��������̵��������ʶ

��������֮������ƶ�,ʵ�����ڶ�ά�ռ���,Ѱ�Ҵ�����֮�����ά�ȵľ������ƶȡ�

������ĵ���:

e

m

a

n

?

e

w

o

m

a

n

��

e

k

i

n

g

?

e

?

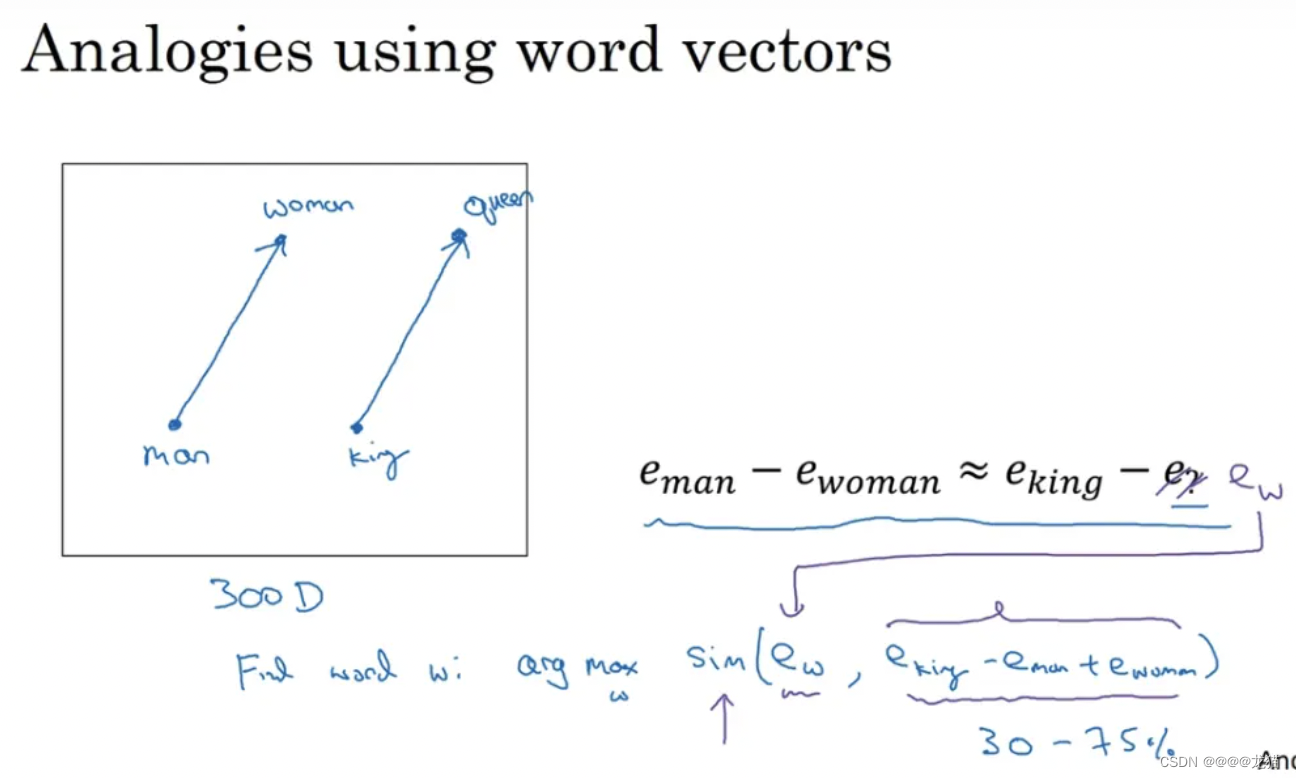

e_{man}-e_{woman} \approx e_{king}-e_?

eman??ewoman?��eking??e??

���������ʽ��,����Ѱ��

e

?

e_?

e??,���൱��Ѱ�������������������֮���������ƶ�:

a

r

g

m

a

x

s

i

m

(

e

?

,

e

k

i

n

g

?

e

m

a

n

+

e

w

o

m

a

n

)

argmax sim(e_?,e_{king}-e_{man}+e_{woman})

argmaxsim(e??,eking??eman?+ewoman?)

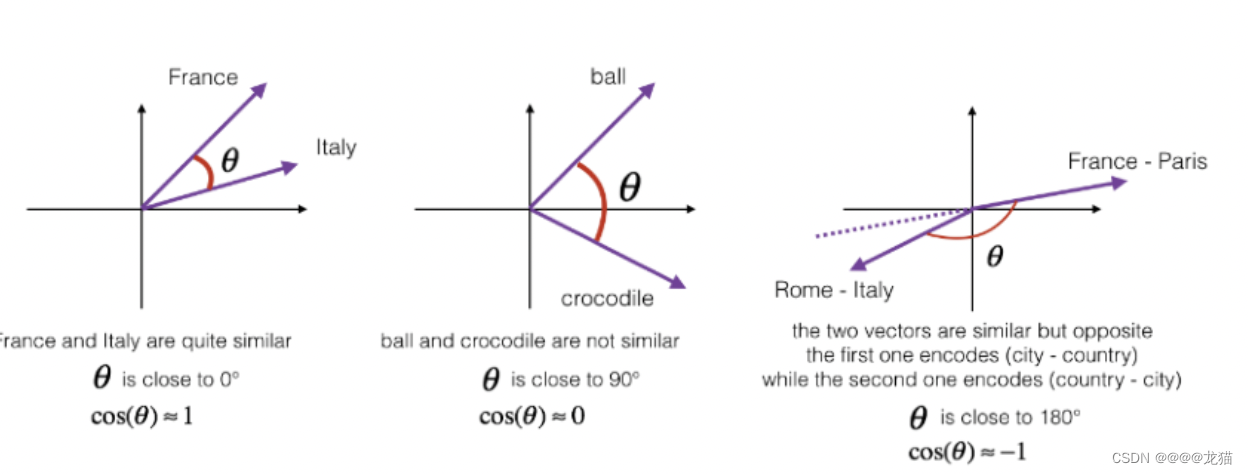

���ƶȺ���:

�������ƶȺ���:Ҳ��������

u

u

u��

v

v

v���ڻ�

s

i

m

(

u

,

v

)

=

u

T

v

�O

�O

u

�O

�O

2

�O

�O

v

�O

�O

2

sim(u,v)=\frac{u^{T}v }{||u||_{2}||v||_2 }

sim(u,v)=�O�Ou�O�O2?�O�Ov�O�O2?uTv?

ŷʽ����:

�O

�O

u

?

v

�O

�O

2

||u-v||^2

�O�Ou?v�O�O2

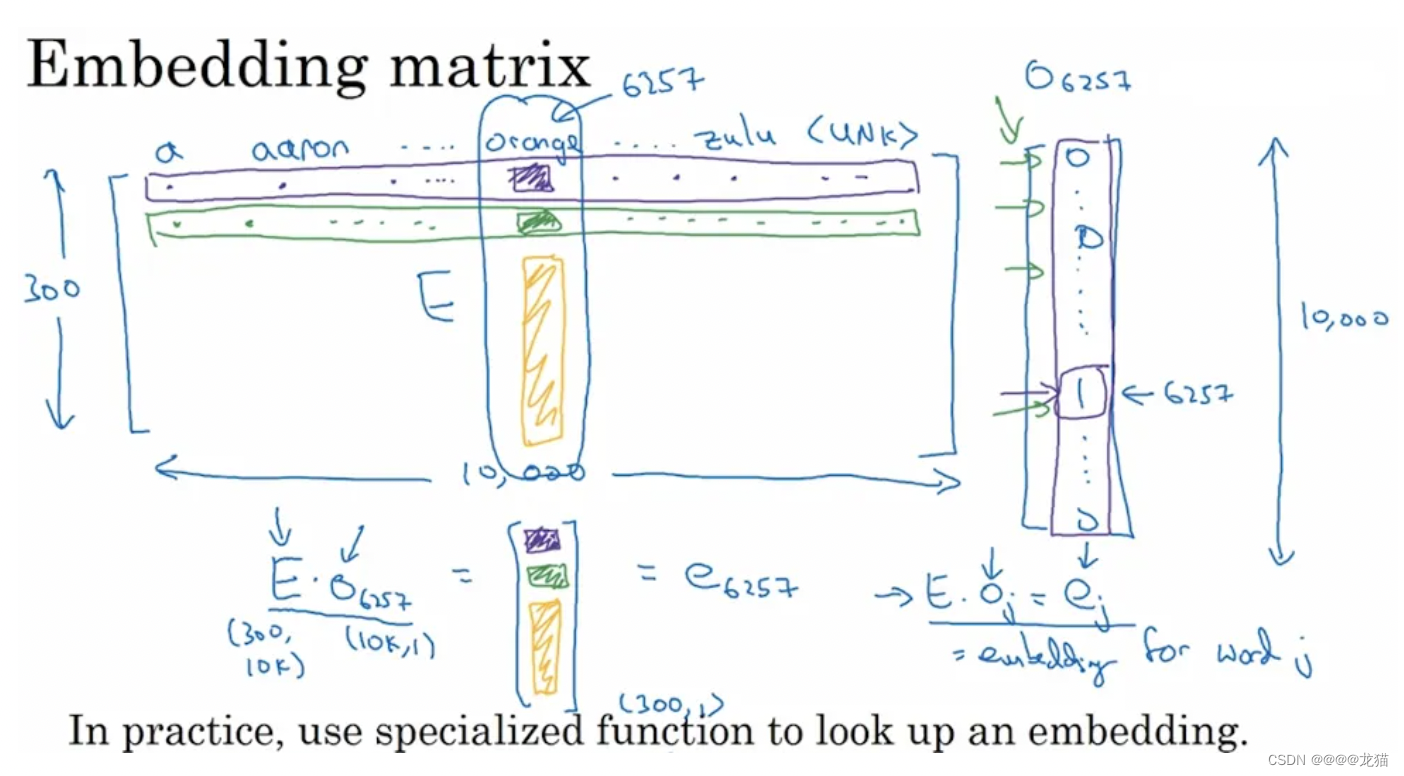

Ƕ�����

����ʻ�����10000,ÿ���ʻ���300��������ʾ,��ôǶ��������һ��300*10000�ľ���,Ƕ�������ij���ʻ��one-hot��ʾ��������˻�õ��ôʻ��Ƕ���ʾ(��300ά��ʾ)

������������one-hotֻ���ض���ֵ��1,������˵ı�����ȡ���ôʻ���Ƕ������λ�õ���һ��,ʵ���в��������ô���ӵľ���˷�����,��������������ֱ��ȡ����һ��

ѧϰ��Ƕ��

��Ƕ���ѧϰ�㷨����ʱ��Ľ������Խ��Խ��

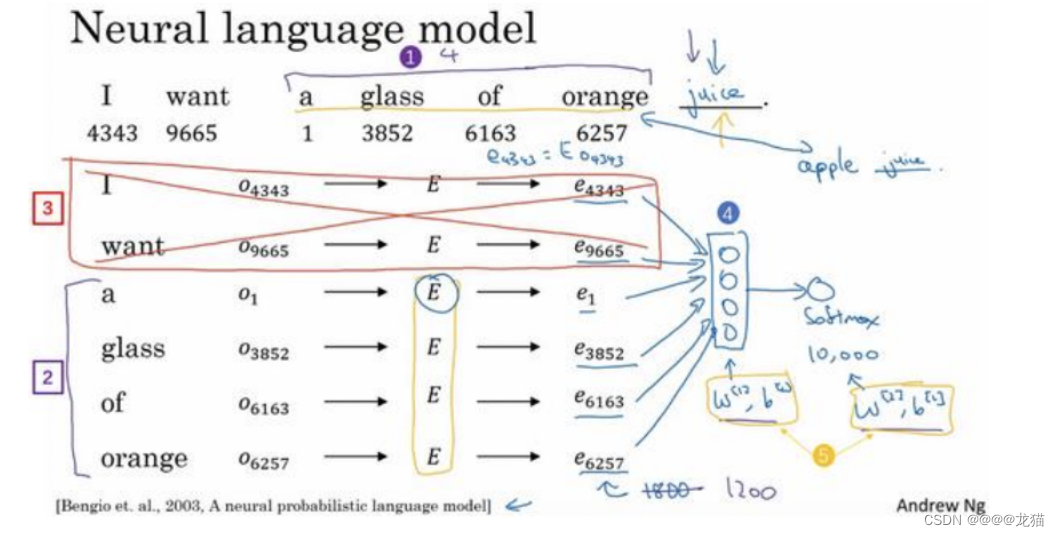

���ڵ�ѧϰ�㷨:

- ͨ����ÿ�����ʵ�one-hot������Ƕ��������,�õ���Ӧ��Embedding

- ���ô��ڿ���Ӱ��Ԥ�����ĵ�������,���������ڵĵ���Embedding�ѵ�����,���뵽��������

- ���ͨ��softmax����������ʻ���������ʵĸ���

- ����,���ز��softmax�㶼���Լ��IJ���,����ʻ���Ĵ�СΪ10000,ÿ�����ʵ�Embedding�Ĵ�С��300,��ʷ���ڵĴ�С��4,��ô����Ĵ�С����1200,softmax�������С���Ǵʻ���Ĵ�С

- ����ģ�͵IJ�������Ƕ�����E,�Լ����ز��softmax��IJ��� w [ 1 ] , b [ 1 ] , w [ 2 ] , b [ 2 ] w^{[1]},b^{[1]},w^{[2]},b^{[2]} w[1],b[1],w[2],b[2]

- �������÷����㷨�����ݶ��½�,���ѵ��������Ȼ����,���ϵش����Ͽ���Ԥ�����һ���ʵ����

�ڲ���ѵ���Ĺ�����,�㷨�ᷢ����Ҫ������ѵ����,��Ҫʹ��һЩ�������ƵĴʻ�������Ƶ���������,�Ӷ��õ����Ĵ�Ƕ�����E

�����������ĺ�Ŀ��ʶ�

���ǰѽ�ҪԤ��ĵ��ʳ�ΪĿ���,ͨ���������Ʋ������,���ڲ�ͬ������,�����ĵĴ�С�ͳ����Լ�ѡ��ķ���������ͬ

ѡȡĿ���֮ǰ�ļ�����;

ѡȡĿ���ǰ��ļ�����;

ѡȡĿ���ǰ��һ����;

ѡȡĿ��ʸ�����һ����,(һ��Skip-Gramģ�͵�˼��)

Word2Vec

Word2Vec�㷨��һ�ּļ���,���Ը��Ӹ�Ч�ķ�ʽʵ�ֶԴ�Ƕ���ѧϰ

Skip-grams:

��Skip-gramsģ����,������Ҫ��ȡ�����ĺ�Ŀ������,������һ���ලѧϰ����

�����IJ�һ����ҪĿ���ǰ����ߺ����������ļ�������,�������ѡ��һ������Ϊ������,ͬʱ�������ĵ�һ�����뷶Χ�����ѡ������һ������ΪĿ��ʡ�

��������һ���ලѧϰ�����Ŀ��,��������Ҫ����ලѧϰ����ı���,������Ҫʹ�����������ѧϰһ���õĴ�Ƕ��ģ��

ģ������

- ʹ��һ�����д����ʻ�Ĵʻ��,��Vocab size =10000k;

- ���������ļලѧϰ����,Ҳ���ǹ���������(C)��Ŀ���(T)��ӳ���ϵ:C����T

- o c o_c oc?(one-hot)����E(��Ƕ�����)���� e c = E ? o c e_c=E*o_c ec?=E?oc?(��Ƕ��)����Softmax�㡪��y^

- s o f t m a x : p ( t �O c ) = e �� t T e c �� j = 1 10000 e �� t T e c softmax:p(t|c)=\frac{e^{\Theta _{t}^{T}e_c } }{\sum_{j=1}^{10000}e^{\Theta _{t}^{T}e_c } } softmax:p(t�Oc)=��j=110000?e��tT?ec?e��tT?ec??,���� �� t \Theta _{t} ��t?�������t�йصIJ���

- ��ʧ����: L ( y ^ , y ) = ? �� i = 1 10000 y i l o g y i ^ L(\hat{y} ,y)=-\sum_{i=1}^{10000} y_ilog\hat{y_i} L(y^?,y)=?��i=110000?yi?logyi?^?,������Ŀ���y��ʾΪone-hot����ʱ,���õ�softmax��ʧ����

- ͨ�������ݶ��½�ѵ������,���Եõ�ģ�͵IJ���E��softmax�IJ���

���ڵ�����

����������㷨��һ��������Ǽ������dz���,����������softmax��Ԫ��,������Ҫ��10000�������ʻ���Ĵ�����ͼ���,�������Ӵ�,�����ٶ���,����ķ����зּ���softmax������������

�ּ���˼·��(��10000���ʻ�Ϊ��),��һ���������ȸ�����Ŀ�����ǰ5000���Ǻ�5000,Ȼ��ڶ�����������������ǰ2500���Ǻ�2500,�������㸴�Ӷ��Ǵʻ���ȡ����,���������Եġ��������γɵ���һ�㳣���Ĵ��ڱȽ�dz�ĵط�,�ټ��Ĵ��ڸ���ĵط�,����һ��ƽ�������

����������

1.�����Ͽ����������ز���:ʹ����the��of��a��������һЩ�ʻ���ֵ��൱Ƶ��,���������ĺ�Ŀ��ʶԾ�����������ʻ�,��������Ҫ��Ŀ���ȴ���ٳ��֡�

2.���ò�ͬ��������ƽ�ⳣ���Ͳ������Ĵʽ��в��������ַ�����ʵ��ʹ�õķ�����