���·�����2016��

��������:

1������

�������������Ŀ��������ķ�չ,��������ܺ�ȷ�ʶ��ڲ������������Ǵ��ڵ�һ������,�����������ױ�һЩͼƬ(�������û������)����ƭ,��ʹ���Ǿ��ø�ͼ������ijһ���,����������绹�ǻ��Ը����ŶȽ����Ϊ���ࡣ����ԭ��,������Ϊ����ѵ������ʱ,ʹ�õ��Ƿ�յ����ݼ�(�ж�������Ѿ���ǰ�涨��,������������ѡ��ֻ������Щ�ض������ȥѡ��)��

�����ڴ�ǿ�������Ӧ����:ģ��Ӧ�þܾ�δ֪��,�������Ը����ŶȽ������Ϊ��֪�ࡣ

��������ʵ������,�������������ǿ��ŵ�,�ڶ�̬�Ͳ��ϱ仯����ʵ�����в���ʶ��ϵͳʱ,���������ʶ��ϵͳ��Ϊ��̬���������Ƶ�,������Ҫ�ļ����������������֪�ġ��������,�������ྭ��Ļ���ѧϰ����һ��,���������ִ�з�ռ�ʶ��������Ϊ�������Ӧ�þ���ʶ����֪���δ֪���������������������һ���µķ����C����ʹ�������ʶ�����ݼ�,ͨ������һ���µ�ģ�Ͳ�COpenMax,�����Թ���һ����������δ֪��ĸ��ʡ�������δ֪���һ���ؼ����ǽ�Ԫʶ��(Meta-Recognition)����Ӧ�������絹���ڶ���ļ���ģʽ�����ڴ˷���,���������Ծܾ���ƭ�Ե�ͼƬ�Լ���ϵͳ����ص�ͼ��OpenMax�������������������ɵ����Դ����������֤����OpenMax�����ṩ���н翪�ռ����,�Ӷ���ʽ�ṩ��һ������ʶ����������

�ܽ�:

(1)��ǰ��ģ�ʹ��ڴ���ʶ������,�������������ݼ�

(2)�����openmax����,����ʹģ�;ܾ���ƭ���Լ��������ͼ��,�Ӷ����ʹ�����

(3)��OWOD�������,������û�н����ôʶ����������⡣

2����ǰ�����������(2016��)

--------Ϊ���������ʶ��������Ȼ��һ�������������?

��Ҫ�����������softmax����,�ڴ����������,���һ��ȫ���Ӳ����������뵽softmax����,�Ӷ���N����֪����в���һ�����ʷֲ�,���������ڸ���һ��δ֪����Ϊ����ʱ,�����ܻ��ҵ�һ�����п��ܵ���֪�ࡣ����ʵ����,����ϣ����������Ϊδ֪��,��ô�����������֪����ʶ��ܵ�,��������ͨ��һ����ֵ���ܾ����δ֪�ࡣͬʱ��Ϊsoftmax��ķ����,����û�취����ѧϰ�µ�����������ѵ�������,��������������⡣

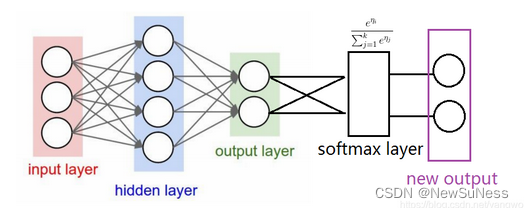

3�������ĵĴ��µ㡪OpenMax��(��չsoftmax��ʹ�����Ԥ��δ֪���)

ͨ����չsoftmax��,ʹ�����Ԥ�������������δ֪��Ŀ����ԡ�ͬʱ,��Ԫѧϰ�ĸ���������������,ʹ�����絹���ڶ���(Softmax��ǰ���ȫ���Ӳ�)�ķ�����������ǰ�������Ƿ�Զ����֪��𡣸ò�ķ�����Ϊ�C��������(activation vector(AV))��

��Ҫ����:

*���ü��������Ķ���Ԫʶ�����������������ϵĸ���

*����Ԫʶ���OpenMax�γɿ��ż��������,��֤����������ķ������Թ����������Ŀ��ſռ����

*���ż���������ڱ��ֲ���ͼ��ȷ�Ե�ͬʱ,�ܾ�δ֪�ࡢ��ƭͼ�Կ�ͼ�����Դ������Ч��

4������activation vector

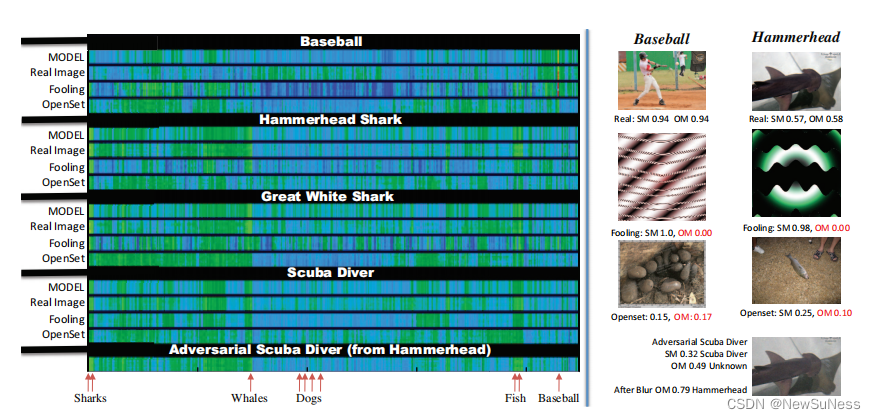

��ͼչʾ�˼�������ģ�����ΪԪʶ�����������OpenMax��չ�ṩ�㹻����Ϣ,��֧�ֿ��ż�ʶ��OpenMax�㷨��������ļ�������(AV)��ǰ�������ģ������֮��ľ���,�����������ṩδ֪���ʵĹ��ơ�ͼƬ�е���߲���չʾ�˲�ͬͼƬ�ļ�������,��ͬ������֮���ú��߸�����ÿ�������Ӧһ����������,��ֱ�����ϱ�ʾ(��黹û�㶮),ˮƽ�����ʾ��ImageNet��ǰ450��������Ӧ��

��ߵIJ���չʾ����ʵͼƬ����ƭͼƬ�Ϳ��ż�ͼƬ֮�������,��OMΪ��ɫ����ʾ������Ϊ������δ֪�ࡣ

5�����ż��������

��һ�����ģ�ͱ�Ϊ��ʶ�ż�,�����뵽�ľ��Ƕ�����ĸ���Ӧ��һ����ֵ�����й���,���ַ������Ծܾ���ȷ����Ԥ��(����Ԥ���������������������),������һ���̶���ʹģ�Ϳ��Ծܾ�δ֪��𡣵��Ǹ÷���ֻ�ʺ���С�������ݼ���ʹ�ö������з���������Scheirer���˽����ſռ���ն���Ϊ������������֪ѵ����������Զ����صķ��ա������ֻ�ṩ��һ��һ��Ķ���,��û�й涨��β�������,Ҳû�й涨Ҫ�������־���Ŀռ䡣Ϊ��ʹ��������ܹ��������ż�ʶ��,���DZ���ȷ�������ܹ�����/��С���俪�ſռ����,�����оܾ�δ֪�����������

�ڴ˻�����,���߳���Ѱ��ijһ������(�ֳ�Ϊ�����ռ�)������һ�����յļ�������ģ��,����ͨ����ֵ�����ƿ��ſռ���ա�ģ��ͨ��������֪ѵ�����ݾ���Ŀռ��Ԫʶ��,Ȼ�����־����������������ߺ��������߳Ƹ÷���ΪOpenMax,��ΪSoftMax���ܵ����Ʒ������֤��������ģ����һ�����µļ�������ģ��,���,������һ������ʶ��Ķ��塣

6������Ԫʶ��(Multi-class Meta-Recognition)

����,��Ҫȷ��ģ�͵������Ƿ�������һ��δ֪���,�����ڴ�ʹ����Ԫʶ��ķ���������ϵͳ�������ķ����Ƿ���ȷ����ǰ�Ĺ�����ʹ�������յ�ϵͳ����,���ڼ�ֵ����(EVT)���������ǵķֲ�,������Щ�ֲ���ѭ�������ֲ�����Ȼ���ǿ��Զ���ʹ��ÿ����ķ�����ʹ��EVT�������ǵķֲ�,���ⲻ�����һ�����յļ�������,��Ϊ��ƭͼ����ʾ����������������һ�����������֪����ѵ�����ݵĽ��տռ䡣����,SoftMax�������ֱ��EVT��϶����������û������,��Ϊ���յ�SoftMax�㱻�������������ѭ���ֲ������,���Ƿ��������ڶ���,��ͨ������Ϊÿ��Ĺ��ơ����ÿ��Ĺ��Ʊ�SoftMax����ת��Ϊ���յ�������ʡ�

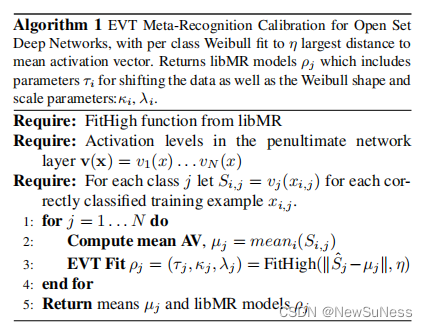

(1)EVT������Ԫʶ���㷨

(2)OpenMax�㹤��ԭ��

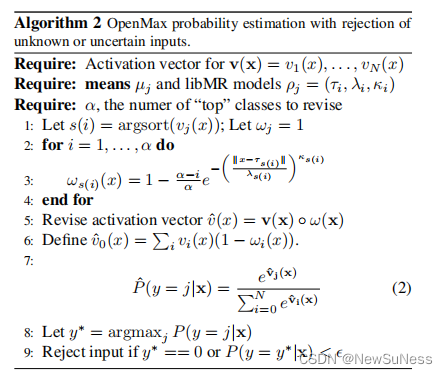

��EVT�����ɺ�,OpenMax�㹤����������: