ʹ��MMDetectionѵ���Լ������ݼ�

ǰ��

������Ҫ�������ʹ��mmdetectionѵ���Լ�������,���������ļ�����,ѵ��ʱ��������ǿ,����Ԥѵ��Ȩ���Լ�������ʧ����ͼ�ȡ�����н���һƪ����,Ĭ���Ѿ�������COCO��ʽ���ݼ����Ѱ�װmmdetection,����Ҳ�Ѿ�������ɡ�

1�������ļ���

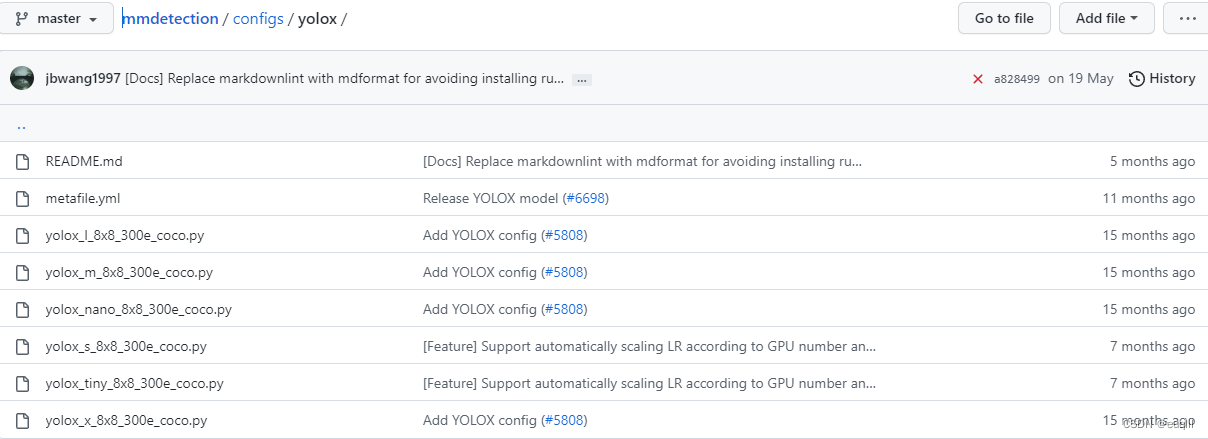

���Ⱦ��Ǹ�������ѡ��һ��ѵ��ģ��,������ѡ��yolox-s��Ϊ�ҵ�ѵ��ģ��,����mmdetection/configs/yolox�ļ���,���Կ����������ļ�:

������Կ�����yolox-s�������ļ�yolox_s_8x8_300e_coco.py,������ע��:��Ҫ��Ĭ�ϵ������ļ���������,��ý�Ҫ�ĵ������ļ�����һ��,�ڸ����ļ���������!!! ����һ�������ļ�֮��,�Ϳ��Ը�����Ҫ��������!

1.1 model����

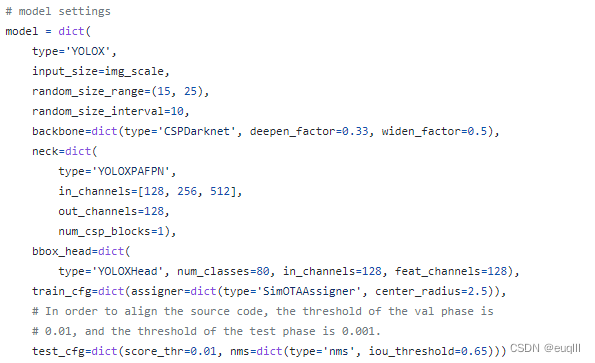

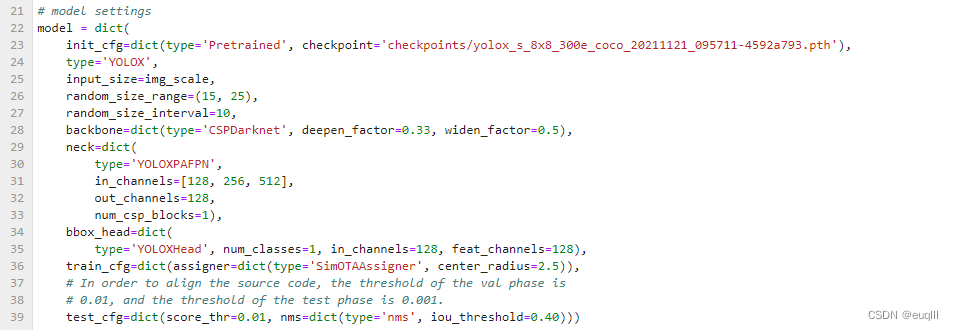

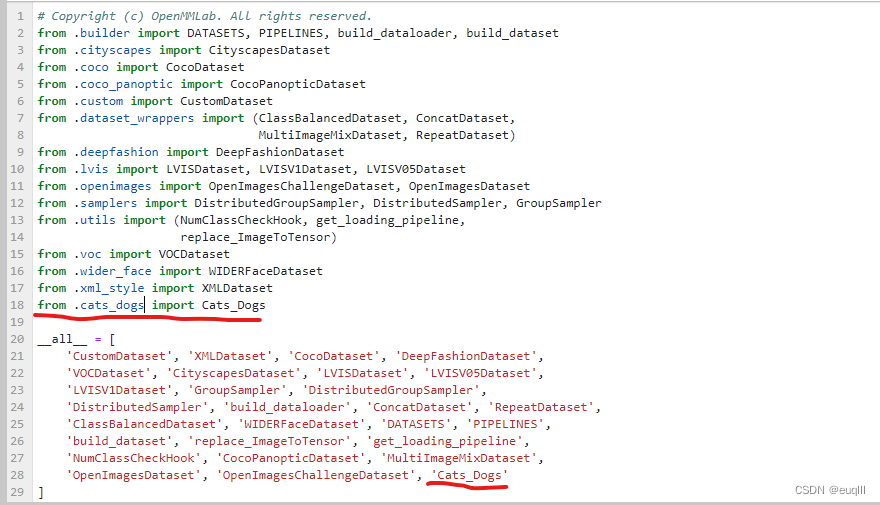

����ֲ�����������Ĭ�ϵ�,�������ĵ���bbox_head�е�num_classes=80,����������,COCO���ݼ���80��,����Կ��Լ����ݼ��Ƕ������,Ȼ��ijɶ�Ӧ��,�����ҵ����ݼ���2��,��ô�ij�num_classes=2��

�������test_cfg�µ�nms=dict(type='nms', iou_threshold=0.65),iou_threshold=0.65������,�����iou��ֵ�ij�����Ҫ��,����iou_threshold=0.40��

�����ʹ��Ԥѵ��Ȩ��,��ô������������,������model�ֵ俪ͷ,����init_cfg=dict(type='Pretrained', checkpoint='�����������Ԥѵ��Ȩ���ļ�·��')

һЩ����ͷ��FPN���ĺ�BackBone���滻�����ڱ���֮�ڡ�

1.2 dataset����

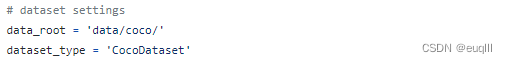

��mmdetection�ļ����д���data�ļ���,�����ѵ������֤���������ݵ������С�Ȼ������������������ݼ�·��:

����:

data_root = 'data/cats_dogs'

dataset_type = 'Cats_Dogs'

������и�dataset_type,Ҳ�������ݼ�����,����Լ�����һЩ�ȽϷ���,�����������:

- ����

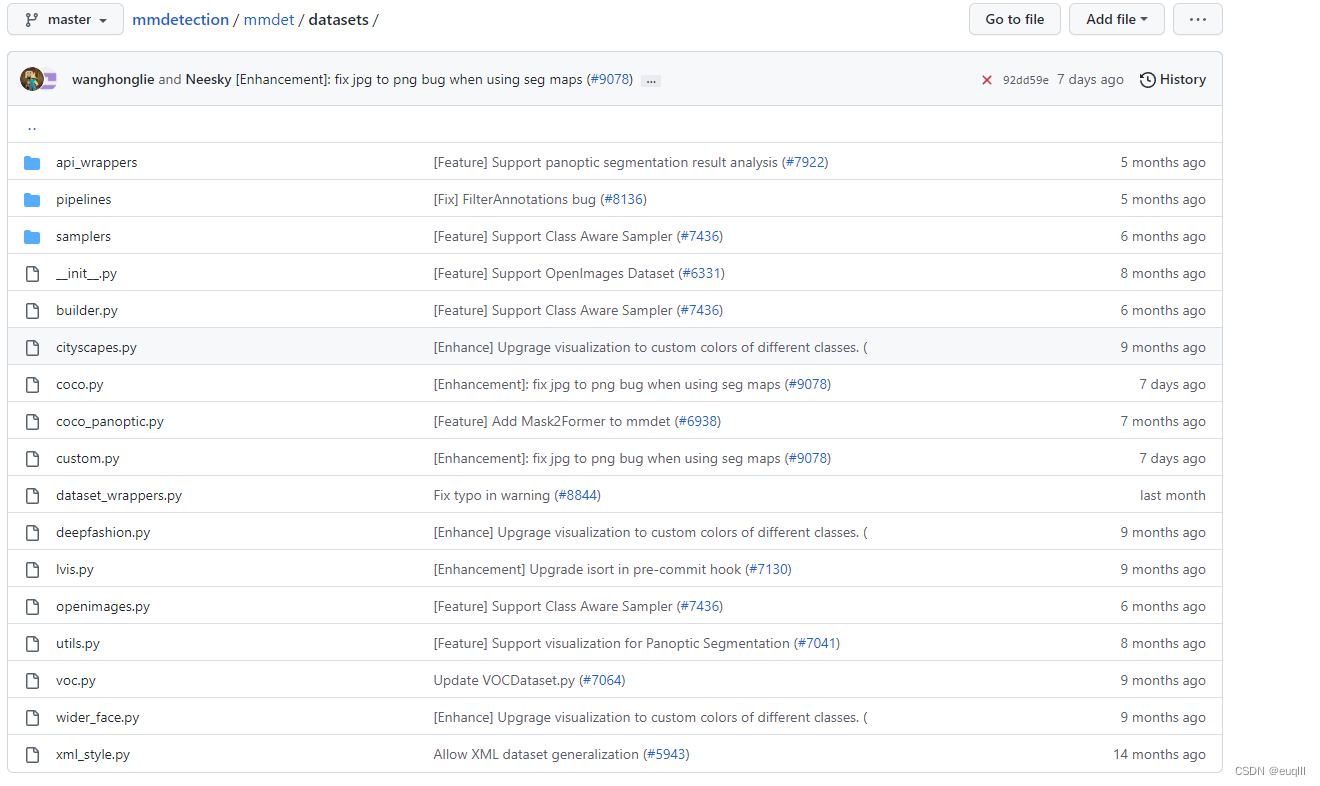

mmdetection/mmdet/datasets,��֮ǰһ��,��coco.py����һ��,����Ҫ��������(��������Ĭ�����ݼ���ʽ��COCO)

- ���Ƶ�

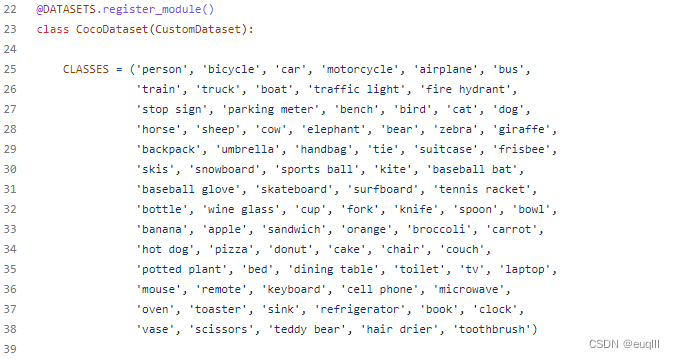

coco.py�ҽ�������Ϊcats_dogs.py,Ȼ��ֻ���23�е�COcoDataset(CustomDataset)�ij�Cats_Dogs(CustomDataset),Ȼ���25��CLASSES�ij����Լ������,�ҵ����ݼ���è��,���Ҿij���CLASSES = ('cat', 'dog')����ע��:�����������ֵú����ͼƬĿ���ǩ����һ��,����ı�ǩ�� Cat��Dog,Ȼ������������ cat��dog!!! �����ĵط�������Ҫ��!!!

- �Ѷ���õ�

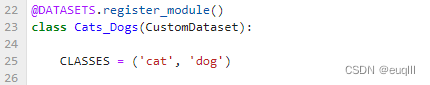

cats_dogs.py�ӵ�ע���ļ�mmdetection/mmdet/datasets/__init__.py��,���ӷ�ʽ��ο��һ����߲��֡�

����dataset�����������,�������train dataset������

1.2.1 train dataset����

ѵ������������ǿ

˵��train dataset�϶��벻��������ǿ,������û��ʹ��mmdetection���õ�������ǿ,������뿴��������Щ��ǿ,������mmdetection/mmdet/datasets/pipelines/transforms.py�в鿴��������ʹ��albumentations�����������ǿ(��Ҫ�ǹ�����ĺ�ǿ��,̫����),�����Ҳ��ʹ�������Դ��,��ô���Ȱ�װ��:

pip install -U albumentations

Ȼ����train_pipelines���ӻ��������ǿ���ԡ�������Բο��ҵĴ���:

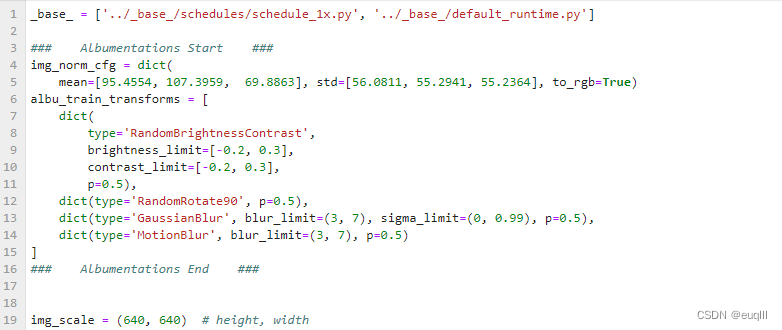

- �����������ļ���ͷ�������´���:

### Albumentations Start ###

img_norm_cfg = dict(

mean=[95.4554, 107.3959, 69.8863], std=[56.0811, 55.2941, 55.2364], to_rgb=True)

albu_train_transforms = [

dict(

type='RandomBrightnessContrast',

brightness_limit=[-0.2, 0.3],

contrast_limit=[-0.2, 0.3],

p=0.5),

dict(type='RandomRotate90', p=0.5),

dict(type='GaussianBlur', blur_limit=(3, 7), sigma_limit=(0, 0.99), p=0.5),

dict(type='MotionBlur', blur_limit=(3, 7), p=0.5)

]

### Albumentations End ###

type='RandomBrightnessContrast',type='RandomRotate90' ������ǿ����,������Բ鿴albumentations�ٷ��ĵ�,�����Լ���������,���Ӹ�ʽ��������Ĵ���һ����

Ȼ�� mean=[95.4554, 107.3959, 69.8863], std=[56.0811, 55.2941, 55.2364] ,����������ݼ��ľ�ֵ�ͱ���,�����Լ���дһ��Python�����Զ�����һ��,��������ñ�д,��ô���Բο��ҵ����,���Ǽ����������е�����

import torch

from torch.utils.data import DataLoader, Dataset

import os

from pathlib import Path

import numpy as np

from PIL import Image

def cal_mean_std(path: str):

channels_sum, channels_squared_sum, nums = 0, 0, 0

path_list = os.listdir(path)

for img_path in path_list:

image_path = os.path.join(path, img_path)

# image = torch.from_numpy(np.array(Image.open(image_path)) / 255).permute([2, 0, 1]).float()

image = torch.from_numpy(np.array(Image.open(image_path))).permute([2, 0, 1]).float()

channels_sum += torch.mean(image, dim=[1, 2])

channels_squared_sum += torch.mean(image**2, dim=[1, 2])

nums += 1

mean = channels_sum / nums

std = (channels_squared_sum / nums - mean**2)**0.5

return mean, std

if __name__ == '__main__':

path = os.path.abspath("F:/VOC2012/VOCdevkit/VOC2012/JPEGImages")

mean, std = cal_mean_std(path=path)

print(f'mean : {mean}, std : {std}')

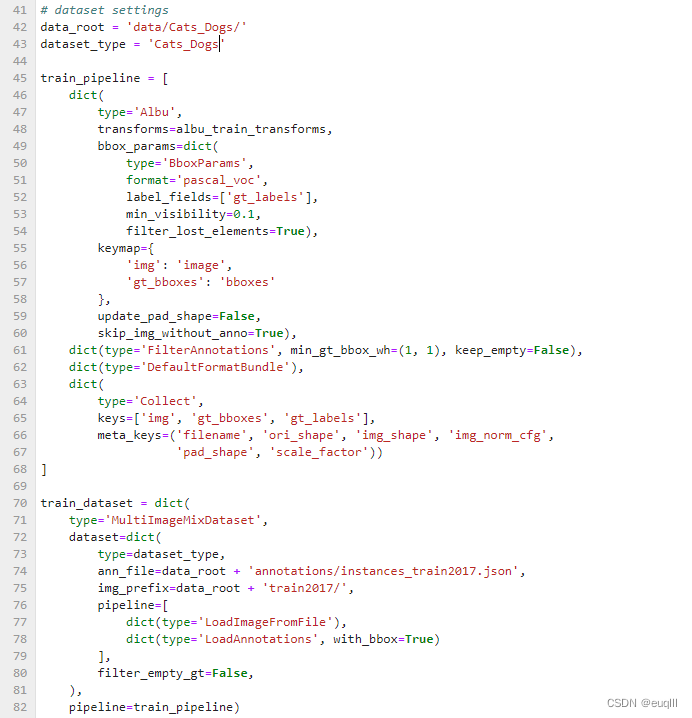

������train_pipelines�������

train dataset����

����������ǿ���Ӧ�ý������ӵ�train_dataset����,�����������Ӿͺ���:

train_pipeline = [

dict(

type='Albu',

transforms=albu_train_transforms,

bbox_params=dict(

type='BboxParams',

format='pascal_voc',

label_fields=['gt_labels'],

min_visibility=0.1,

filter_lost_elements=True),

keymap={

'img': 'image',

'gt_bboxes': 'bboxes'

},

update_pad_shape=False,

skip_img_without_anno=True),

dict(type='FilterAnnotations', min_gt_bbox_wh=(1, 1), keep_empty=False),

dict(type='DefaultFormatBundle'),

dict(

type='Collect',

keys=['img', 'gt_bboxes', 'gt_labels'],

meta_keys=('filename', 'ori_shape', 'img_shape', 'img_norm_cfg',

'pad_shape', 'scale_factor'))

]

train_dataset = dict(

type='MultiImageMixDataset',

dataset=dict(

type=dataset_type,

ann_file=data_root + 'annotations/instances_train2017.json',

img_prefix=data_root + 'train2017/',

pipeline=[

dict(type='LoadImageFromFile'),

dict(type='LoadAnnotations', with_bbox=True)

],

filter_empty_gt=False,

),

pipeline=train_pipeline)

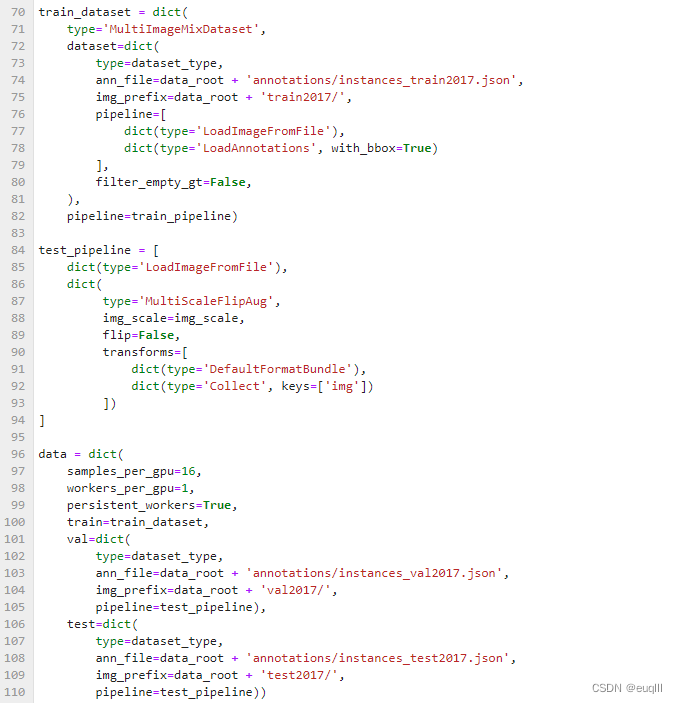

1.2.2 dataset����

dataset����������������ʾ,�ĵĵط�������,samples_per_gpu=16˵���ǵ���GPU��batch size,�������GPU�Դ��С��,��ֵ��ռ�Դ�Ͷ�,��ֵ��С��ѵ������;worker_per_gpu=1��ʾ�߳���,�������CPU��������,��Ҫ����15��,�Ǿ���15,ե�ɷ��������ܡ�

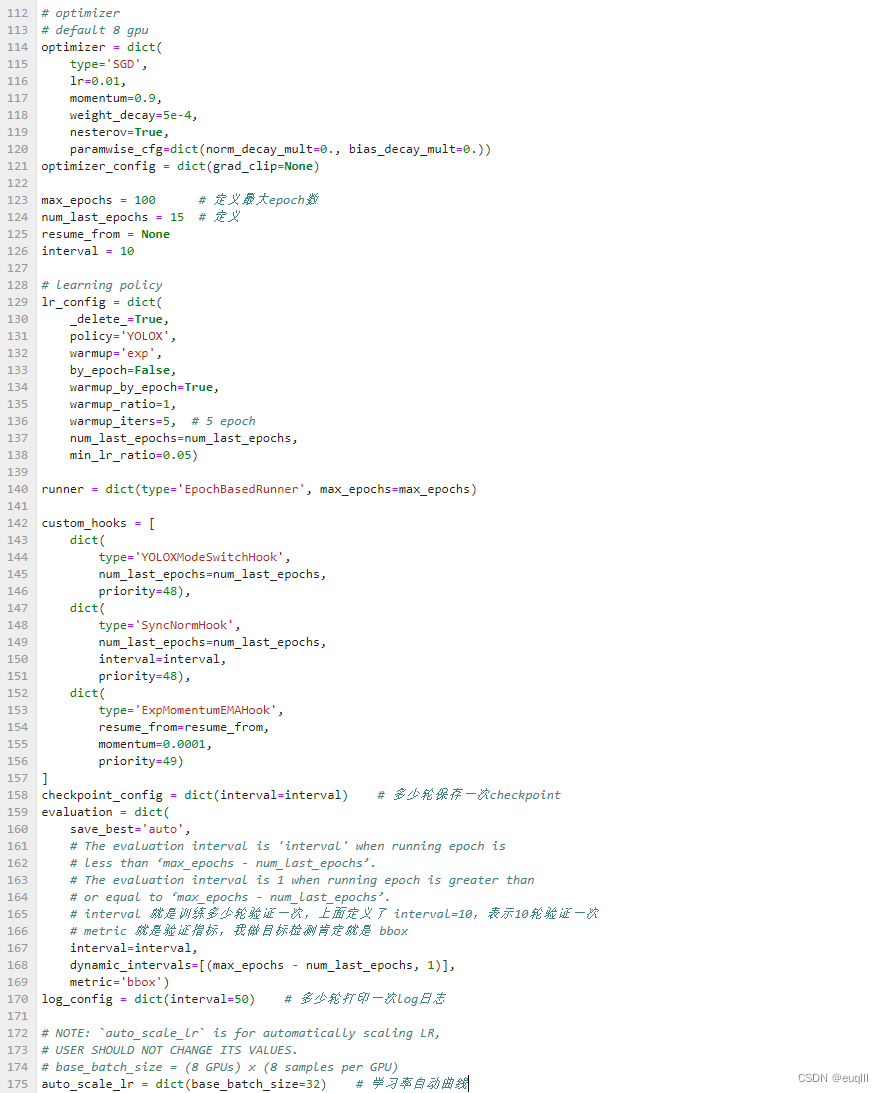

1.3 ��������

�����������������ѧϰ�ʡ��Ż�������������,��������֤һ�εȵ�

����ȫ��Ū��֮��,���ܿ�ʼѵ����

python tools/train.py configs/yolox/yolox_s_peach_coco.py --auto-scale-lr

2������ѵ����ʧͼ

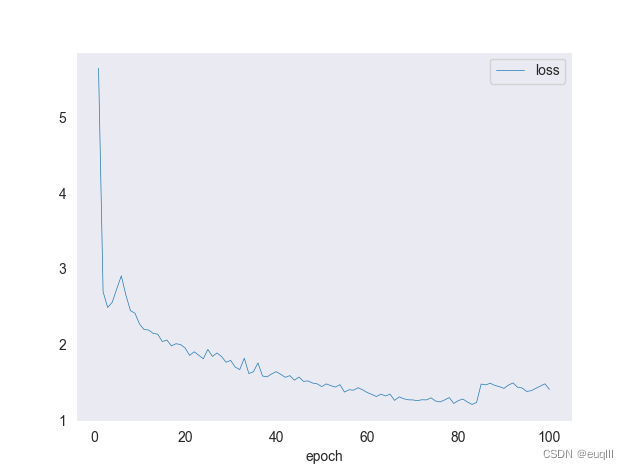

��������ѵ�����֮��,����mmdetection�ļ���������һ������work_dirs���ļ���,��������ѵ����־��ѵ��ģ�͵�Ȩ�ء������ļ�������train lossͼ�Ļ�,�����õ�������.log.json��β���ļ���

������������:

python tools\analysis_tools\analyze_logs.py plot_curve yolox.log.json --keys loss --start-epoch 1 --eval-interval 10 --legend loss

�Ceval-interval �Ƕ�������֤һ��,���ѵ�������ļ�����һ��

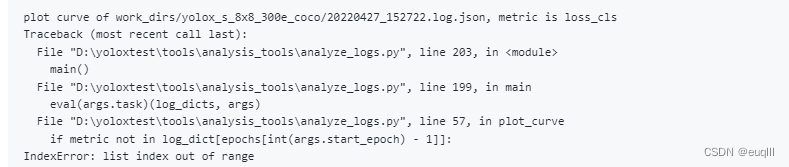

����֮�������õ��������Ĵ�����Ϣ,list index out of range,�б�Խ������

��Ҫ����,�밴������Ĵ��롣�滻analyze_loss.py�е�def plot_curve(log_dicts, arg)����:

def plot_curve(log_dicts, args):

if args.backend is not None:

plt.switch_backend(args.backend)

sns.set_style(args.style)

# if legend is None, use {filename}_{key} as legend

legend = args.legend

if legend is None:

legend = []

for json_log in args.json_logs:

for metric in args.keys:

legend.append(f'{json_log}_{metric}')

assert len(legend) == (len(args.json_logs) * len(args.keys))

metrics = args.keys

num_metrics = len(metrics)

for i, log_dict in enumerate(log_dicts):

epochs = list(log_dict.keys())

for j, metric in enumerate(metrics):

print(f'plot curve of {args.json_logs[i]}, metric is {metric}')

if metric not in log_dict[epochs[int(args.eval_interval) - 1]]:

if 'mAP' in metric:

raise KeyError(

f'{args.json_logs[i]} does not contain metric '

f'{metric}. Please check if "--no-validate" is '

'specified when you trained the model.')

raise KeyError(

f'{args.json_logs[i]} does not contain metric {metric}. '

'Please reduce the log interval in the config so that '

'interval is less than iterations of one epoch.')

if 'mAP' in metric:

xs = []

ys = []

for epoch in epochs:

ys += log_dict[epoch][metric]

if 'val' in log_dict[epoch]['mode']:

xs.append(epoch)

plt.xlabel('epoch')

plt.plot(xs, ys, label=legend[i * num_metrics + j], marker='o')

else:

xs = []

ys = []

num_iters_per_epoch = log_dict[epochs[0]]['iter'][-1]

for epoch in epochs:

iters = log_dict[epoch]['iter']

if log_dict[epoch]['mode'][-1] == 'val':

iters = iters[:-1]

# xs.append(

# np.array(iters) + (epoch - 1) * num_iters_per_epoch)

xs.append(np.array([epoch]))

ys.append(np.array(log_dict[epoch][metric][:len(iters)]))

xs = np.concatenate(xs)

ys = np.concatenate(ys)

# plt.xlabel('iter')

plt.xlabel('epoch')

plt.plot(

xs, ys, label=legend[i * num_metrics + j], linewidth=0.5)

plt.legend()

if args.title is not None:

plt.title(args.title)

if args.out is None:

plt.show()

else:

print(f'save curve to: {args.out}')

plt.savefig(args.out)

plt.cla()

��������ܻ�������������ѵ����ʧ����ͼ��!

�ܽ�

���Ľ����������ļ����ĺ�������ǿ������,����Ի�����ʧ����ͼ����ֵ�һ����������˽��,��ӭ����ṩ��ͬ���,��ͬѧϰ!