Sqoop�İ�װ������ʹ��

1��Sqoop�İ�װ

��ѹsqoop��װ��

tar -zxvf /opt/download/sqoop-1.4.6.bin__hadoop-2.0.4-alpha.tar.gz -C /opt/software/

����

mv /opt/software/sqoop-1.4.6.bin__hadoop-2.0.4-alpha/ /opt/software/sqoop146/

���Ƴ������ļ�����,������

cp /opt/software/sqoop146/conf/sqoop-env-template.sh /opt/software/sqoop146/conf/sqoop-env.sh

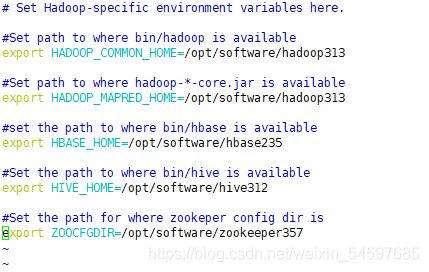

�������ļ�

vim /opt/software/sqoop146/conf/sqoop-env.sh

����������Ϣ

export HADOOP_COMMON_HOME=/opt/software/hadoop313

export HADOOP_MAPRED_HOME=/opt/software/hadoop313

export HBASE_HOME=/opt/software/hbase235

export HIVE_HOME=/opt/software/hive312

export ZOOCFGDIR=/opt/software/zookeeper357

��mysql��hadoop����������libĿ¼��

cp /opt/software/hive312/lib/mysql-connector-java-5.1.47.jar /opt/software/sqoop146/lib/ ./

cp /opt/software/hadoop/hadoop313/share/hadoop/common/hadoop-common-3.1.3.jar ./

cp /opt/software/hadoop/hadoop313/share/hadoop/hdfs/hadoop-hdfs-3.1.3.jar ./

cp /opt/software/hadoop/hadoop313/share/hadoop/mapreduce/hadoop-mapreduce-client-core-3.1.3.jar ./

����ȫ�ֻ�������

vim /etc/profile.d/myenv.sh#sqoop

################################

export SQOOP_HOME=/opt/software/sqoop146

export PATH=$PATH:$SQOOP_HOME/bin

export LOGDIR=$SQOOP_HOME/logs/

###############################

#���������

source /etc/profile

�����ܷ�ɹ�

sqoop list-databases --connect jdbc:mysql://���ip��ַ:3306 --username �û��� --password ����

sqoop list-databases --connect jdbc:mysql://192.168.158.202:3306 --username root --password 12345678

2��Sqoop��ʹ��

1.Sqoop�ij�������

| ���� | �� | ˵�� | |

|---|---|---|---|

| 1 | import | ImportTool | �����ݵ��뵽��Ⱥ |

| 2 | export | ExportTool | ����Ⱥ���ݵ��� |

| 3 | codegen | CodeGenTool | ��ȡ���ݿ���ij�ű���������Java�����Jar |

| 4 | create-hive-table | CreateHiveTableTool | ����Hive�� |

| 5 | eval | EvalSqlTool | �鿴SQLִ�н�� |

| 6 | import-all-tables | ImportAllTablesTool | ����ij�����ݿ������б���HDFS�� |

| 7 | job | JobTool | ��������һ��sqoop������,���ɺ�,������ִ��,����ʹ������ִ�и����� |

| 8 | list-databases | ListDatabasesTool | �г��������ݿ��� |

| 9 | list-tables | ListTablesTool | �г�ij�����ݿ������б� |

| 10 | merge | MergeTool | ��HDFS�в�ͬĿ¼��������ݺ���һ��,�������ָ����Ŀ¼�� |

| 11 | metastore | MetastoreTool | ��¼sqoop job��Ԫ������Ϣ,���������metastoreʵ��,��Ĭ�ϵ�Ԫ���ݴ洢Ŀ¼Ϊ:~/.sqoop,���Ҫ���Ĵ洢Ŀ¼,�����������ļ�sqoop-site.xml�н��и��ġ� |

| 12 | help | HelpTool | ��ӡsqoop������Ϣ |

| 13 | version | VersionTool | ��ӡsqoop�汾��Ϣ |

2.�����Ӧ��������

2.1���ݿ����Ӳ���

| ���� | ˵�� | |

|---|---|---|

| 1 | �Cconnect | ���ӹ�ϵ�����ݿ��URL |

| 2 | �Cconnection-manager | ָ��Ҫʹ�õ����ӹ����� |

| 3 | �Cdriver | Hadoop��Ŀ¼ |

| 4 | �Chelp | ��ӡ������Ϣ |

| 5 | �Cpassword | �������ݿ������ |

| 6 | �Cusername | �������ݿ���û��� |

| 7 | �Cverbose | �ڿ���̨��ӡ����ϸ��Ϣ |

2.2 import����

| ���� | ˵�� | |

|---|---|---|

| 1 | �Cenclosed-by | ���ֶ�ֵǰ����ָ�����ַ� |

| 2 | �Cescaped-by | ���ֶ��е�˫���ż�ת��� |

| 3 | �Cfields-terminated-by | �趨ÿ���ֶ�����ʲô������Ϊ����,Ĭ��Ϊ���� |

| 4 | �Clines-terminated-by | �趨ÿ�м�¼֮��ķָ���,Ĭ����\n |

| 5 | �Cmysql-delimiters | MysqlĬ�ϵķָ�������,�ֶ�֮���Զ��ŷָ�,��֮����\n�ָ�,Ĭ��ת�����\,�ֶ�ֵ�Ե����Ű����� |

| 6 | �Coptionally-enclosed-by | ������˫���Ż����ŵ��ֶ�ֵǰ�����ָ���ַ��� |

�����

| ���� | ˵�� | |

|---|---|---|

| 1 | �Cappend | �������ӵ�HDFS���Ѿ����ڵ�DataSet��,���ʹ�øò���,sqoop��������ȵ��뵽��ʱ�ļ�Ŀ¼,�ٺϲ��� |

| 2 | �Cas-avrodatafile | �����ݵ��뵽һ��Avro�����ļ��� |

| 3 | �Cas-sequencefile | �����ݵ��뵽һ��sequence�ļ��� |

| 4 | �Cas-textfile | �����ݵ��뵽һ����ͨ�ı��ļ��� |

| 5 | �Cboundary-query | �߽��ѯ,���������Ϊ�ò�����ֵ(һ��sql���)��ִ�еĽ�������ڵ����ݡ� |

| 6 | �Ccolumns <col1, col2, col3> | ָ��Ҫ������ֶ� |

| 7 | �Cdirect | ֱ�ӵ���ģʽ,ʹ�õ��ǹ�ϵ���ݿ��Դ��ĵ��뵼������,�Ա�ӿ쵼�뵼�����̡� |

| 8 | �Cdirect-split-size | ��ʹ������directֱ�ӵ���Ļ�����,�Ե���������ֽڷֿ�,���ﵽ����ֵ�Ͳ���һ���µ��ļ� |

| 9 | �Cinline-lob-limit | �趨������������͵����ֵ |

| 10 | �Cm��Cnum-mappers | ����N��map�����е�������,Ĭ��4���� |

| 11 | �Cquery��Ce | ����ѯ��������ݵ���,ʹ��ʱ�������ΨCtarget-dir,�Chive-table,�����ѯ����where����,��������������$CONDITIONS�ؼ��� |

| 12 | �Csplit-by | ����ijһ�����зֱ��Ĺ�����Ԫ,������Cautoreset-to-one-mapper����(��ο��ٷ��ĵ�) |

| 13 | �Ctable | ��ϵ���ݿ�ı��� |

| 14 | �Ctarget-dir

| ָ��HDFS·�� |

| 15 | �Cwarehouse-dir

| ��14��������ͬʱʹ��,�������ݵ�HDFSʱָ����Ŀ¼ |

| 16 | �Cwhere | �ӹ�ϵ���ݿ������ʱ�IJ�ѯ���� |

| 17 | �Cz��Ccompress | ����ѹ�� |

| 18 | �Ccompression-codec | ָ��hadoopѹ��������,Ĭ��Ϊgzip(Use Hadoop codec default gzip) |

| 19 | �Cnull-string | string���͵������null,�滻Ϊָ���ַ��� |

| 20 | �Cnull-non-string | ��string���͵������null,�滻Ϊָ���ַ��� |

| 21 | �Ccheck-column < col > | ��Ϊ���������жϵ����� |

| 22 | �Cincremental | mode:append��lastmodified |

| 23 | �Clast-value | ָ��ijһ��ֵ,���ڱ�����������λ�� |

2.3 export����

| ���� | ˵�� | |

|---|---|---|

| 1 | �Cinput-enclosed-by | ���ֶ�ֵǰ�����ָ���ַ� |

| 2 | �Cinput-escaped-by | �Ժ���ת�Ʒ����ֶ���ת�崦�� |

| 3 | �Cinput-fields-terminated-by | �ֶ�֮��ķָ��� |

| 4 | �Cinput-lines-terminated-by | ��֮��ķָ��� |

| 5 | �Cinput-optionally-enclosed-by | ������˫���Ż����ŵ��ֶ�ǰ�����ָ���ַ� |

�����

| ���� | ˵�� | |

|---|---|---|

| 1 | �Cdirect | �������ݿ��Դ��ĵ��뵼������,�Ա������Ч�� |

| 2 | �Cexport-dir

| ������ݵ�HDFS��ԴĿ¼ |

| 3 | -m��Cnum-mappers | ����N��map�����е�������,Ĭ��4�� |

| 4 | �Ctable | ָ���������ĸ�RDBMS�еı� |

| 5 | �Cupdate-key | ��ijһ�е��ֶν��и��²��� |

| 6 | �Cupdate-mode | updateonlyallowinsert(Ĭ��) |

| 7 | �Cinput-null-string | ��ο�import�����Ʋ���˵�� |

| 8 | �Cinput-null-non-string | ��ο�import�����Ʋ���˵�� |

| 9 | �Cstaging-table | ����һ����ʱ��,���ڴ����������Ľ��,Ȼ������������һ���Ե��뵽Ŀ�����,��ֹ���� |

| 10 | �Cclear-staging-table | �����9�������ǿ�,������ڵ�������ִ��ǰ,�����ʱ�������� |

2.4 Hive����

| ���� | ˵�� | |

|---|---|---|

| 1 | �Chive-delims-replacement | ���Զ�����ַ����滻�������е�\r\n��\013 \010���ַ� |

| 2 | �Chive-drop-import-delims | �ڵ������ݵ�hiveʱ,ȥ�������е�\r\n\013\010�������ַ� |

| 3 | �Cmap-column-hive | ����hive��ʱ,���Ը��������ֶε��������� |

| 4 | �Chive-partition-key | ��������,����ֱ�Ӹ�������,�����ֶε�Ĭ������Ϊstring |

| 5 | �Chive-partition-value | ��������ʱ,ָ��ij��������ֵ |

| 6 | �Chive-home

| hive�İ�װĿ¼,����ͨ���ò�������֮ǰĬ�����õ�Ŀ¼ |

| 7 | �Chive-import | �����ݴӹ�ϵ���ݿ��е��뵽hive���� |

| 8 | �Chive-overwrite | ���ǵ���hive�����Ѿ����ڵ����� |

| 9 | �Ccreate-hive-table | Ĭ����false,��,���Ŀ����Ѿ�������,��ô��������ʧ�ܡ� |

| 10 | �Chive-table | �����Ҫ������hive��,Ĭ��ʹ��MySQL�ı��� |

| 11 | �Ctable | ָ����ϵ���ݿ�ı��� |

�����

| ���� | ˵�� | |

|---|---|---|

| 1 | �Chive-home

| Hive�İ�װĿ¼,����ͨ���ò������ǵ�Ĭ�ϵ�HiveĿ¼ |

| 2 | �Chive-overwrite | ���ǵ���Hive�����Ѿ����ڵ����� |

| 3 | �Ccreate-hive-table | Ĭ����false,���Ŀ����Ѿ�������,��ô���������ʧ�� |

| 4 | �Chive-table | �����Ҫ������hive�� |

| 5 | �Ctable | ָ����ϵ���ݿ�ı��� |

2.5 Job����

| ���� | ˵�� | |

|---|---|---|

| 1 | �Ccreate | ����job���� |

| 2 | �Cdelete | ɾ��һ��job |

| 3 | �Cexec | ִ��һ��job |

| 4 | �Chelp | ��ʾjob���� |

| 5 | �Clist | ��ʾjob�б� |

| 6 | �Cmeta-connect | ��������metastore���� |

| 7 | �Cshow | ��ʾһ��job����Ϣ |

| 8 | �Cverbose | ��ӡ��������ʱ����ϸ��Ϣ |

3��Sqoop����

1.hdfs���뵽mysql

#mysql

#--������

create table sqp_order(

create_date date,

user_name varchar(20),

total_volume decimal(10,2)

);

#--�����ļ��ϴ���hdfs

--orderinfo.log

-----------------------

2021-06-29,uzi,56.34

2021-06-29,ming,78.25

2021-06-29,xiaohu,67.09

2021-06-29,mlxg,23.67

2021-06-29,letme,21.45

-----------------------

#ʹ��sqoop��hdfs���ݵ��뵽mysql

sqoop export \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--table sqp_order \

-m 1 \

--export-dir /sqooptest/orderinfo \

--fields-terminated-by ',' \

--lines-terminated-by '\n'

2.mysql���뵽hdfs

ȫ������

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--table sqp_order \

-m 1 \

--delete-target-dir \

--target-dir /sqooptest/mysql2hdfs \

--fields-terminated-by '\t' \

--lines-terminated-by '\n'

���

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--table sqp_order \

--columns user_name,total_volume \

-m 1 \

--delete-target-dir \

--target-dir /sqooptest/mysql2hdfsbyrow \

--fields-terminated-by '\t' \

--lines-terminated-by '\n'

�вü�+���reducer

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--table sqp_order \

--columns user_name,total_volume \

--where "total_volume<50" \

-m 2 \

--split-by user_name \

--delete-target-dir \

--target-dir /sqooptest/m2hbylinesplit \

--fields-terminated-by '\t' \

--lines-terminated-by '\n'

#����һ��д��

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--query "select user_name,total_volume from sqp_order where total_volume<50 and \$CONDITIONS" \

-m 2 \

--split-by user_name \

--delete-target-dir \

--target-dir /sqooptest/m2hbylinesplit2 \

--fields-terminated-by '\t' \

--lines-terminated-by '\n'

��������|append

#���ݳ�ʼ

create table add_test(

id int(4) not null,

name varchar(10) not null,

age int(3)

);

insert into add_test(id,name,age) values

(1,'xiaohu','18'),

(2,'wei','19'),

(3,'cryin','20'),

(4,'gala8','21'),

(5,'ming','22');

### ��һ�ε��� ###

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--query "select * from add_test where \$CONDITIONS" \

-m 1 \

--target-dir /sqooptest/m2hadd \

--fields-terminated-by '\t' \

--lines-terminated-by '\n' \

--check-column id \

--incremental append \

--last-value 0

---------------------

#����

INFO tool.ImportTool: --last-value 5

---------------------

insert into add_test(id,name,age) values

(6,'xiaohu1','18'),

(7,'wei1','19'),

(8,'cryin1','20'),

(9,'gala81','21'),

(10,'ming1','22');

### �������� ###

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--query "select * from add_test where \$CONDITIONS" \

-m 1 \

--target-dir /sqooptest/m2hadd \

--fields-terminated-by '\t' \

--lines-terminated-by '\n' \

--check-column id \

--incremental append \

--last-value 5

---------------------

#����

INFO tool.ImportTool: --last-value 10

---------------------

��������|lastmodified

ʹ��lastmodified��ʽ��������Ҫָ������������Ҫ�Cappend(��)����Ҫ�Cmerge-key(�ϲ�)

#���ݳ�ʼ

create table add_test2(

Name varchar(20),

Times timestamp

);

insert into add_test2(Name,Times) values

('xiaohu','2021-06-29 13:23:31.0'),

('uzi','2021-06-29 14:23:31.0'),

('zzt','2021-06-29 15:23:31.0'),

('xlb','2021-06-29 16:23:31.0'),

('ming','2021-06-29 17:23:31.0');

### ��һ�ε��� ###

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--query "select * from add_test2 where \$CONDITIONS" \

-m 1 \

--target-dir /sqooptest/m2hadd2 \

--fields-terminated-by '\t' \

--lines-terminated-by '\n' \

--check-column Times \

--incremental lastmodified \

--last-value '0000-00-00 00:00:00'

---------------------

#����

INFO tool.ImportTool: --last-value 2021-07-04 16:59:35.0

---------------------

insert into add_test2(Name,Times) values

('xiaohu1','2021-07-04 17:01:31.0'),

('uzi1','2021-07-04 17:01:33.0'),

('zzt1','2021-07-04 17:02:35.0'),

('xlb1','2021-07-04 17:02:37.0'),

('ming1','2021-07-04 17:01:36.0');

### �������� ###

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--query "select * from add_test2 where \$CONDITIONS" \

-m 1 \

--target-dir /sqooptest/m2hadd2 \

--fields-terminated-by '\t' \

--lines-terminated-by '\n' \

--check-column Times \

--incremental lastmodified \

--append \

--last-value '2021-07-04 16:59:35.0'

3.mysql���뵽hive��

ȫ������

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--table add_test2 \

-m 1 \

--hive-import \

--hive-table sqooptest.sqptest \

--create-hive-table

-----------------------------

insert into add_test2(Name,Times) values

('xiaohu2','2021-07-03 17:01:31.0'),

('uzi2','2021-07-03 17:01:33.0'),

('zzt3','2021-07-03 17:02:35.0'),

('xlb4','2021-07-03 17:02:37.0'),

('ming5','2021-07-03 17:01:36.0');

-----------------------------

#��

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--table add_test2 \

--where "cast(Times as date)='2021-07-03'" \

-m 1 \

--hive-import \

--hive-table sqooptest.sqptest

��ӵ���

��ʽһ

#hive�����

create table sqp_par(

Name varchar(20),

Times date

)

partitioned by (dates date)

row format delimited

fields terminated by ','

lines terminated by '\n'

stored as textfile;

#Ǩ������

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--table add_test2 \

--where "cast(Times as date)='2021-06-29'" \

-m 1 \

--delete-target-dir \

--target-dir /user/hive/warehouse/sqooptest.db/sqp_par/dates=2021-06-29 \

--fields-terminated-by ',' \

--lines-terminated-by '\n'

#���ӷ���

alter table sqp_par add partition(dates='2021-06-29');

#��

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--table add_test2 \

--where "cast(Times as date)='2021-07-04'" \

-m 1 \

--delete-target-dir \

--target-dir /user/hive/warehouse/sqooptest.db/sqp_par/dates=2021-07-04 \

--fields-terminated-by ',' \

--lines-terminated-by '\n'

alter table sqp_par add partition(dates='2021-07-04');

��ʽ��

create table sqp_par2(

Name varchar(20),

Times date

)

partitioned by (dates date)

row format delimited

fields terminated by ','

lines terminated by '\n'

stored as textfile;

sqoop import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--table add_test2 \

--where "cast(Times as date)='2021-06-29'" \

-m 1 \

--hive-import \

--hive-table sqooptest.sqp_par2 \

--hive-partition-key dates \

--hive-partition-value '2021-06-29' \

--fields-terminated-by ',' \

--lines-terminated-by '\n'

4.job

#����job

sqoop job \

--create job_m2hdfs \

-- import \

--connect jdbc:mysql://wantest03:3306/sqooptest \

--username root \

--password 12345678 \

--query "select * from add_test2 where \$CONDITIONS" \

-m 1 \

--target-dir /sqooptest/jobm2hadd2 \

--fields-terminated-by '\t' \

--lines-terminated-by '\n' \

--check-column Times \

--incremental lastmodified \

--append \

--last-value '0000-00-00 00:00:00.0'

#�鿴job�б�

sqoop job --list

#ɾ��job

sqoop job --delete job_m2hdfs

#�鿴job����

sqoop job --show job_m2hdfs

#ִ��job

sqoop job -exec job_m2hdfs