Ŀ¼

2��SparkCore

2.1. Partition

2.1.1. ���� Spark

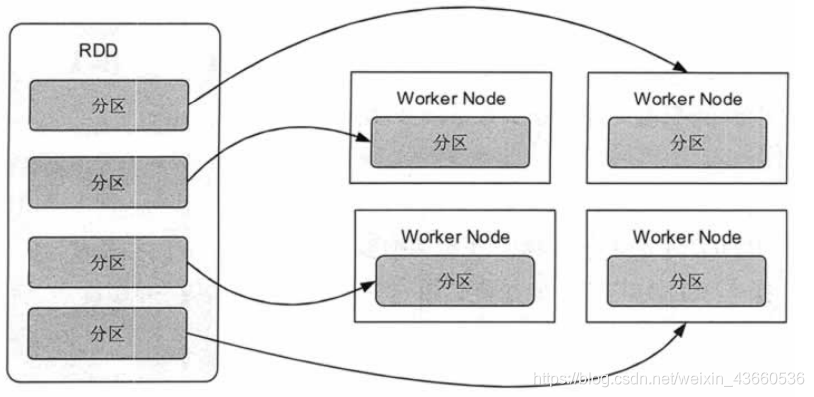

- RDD ��һ�ֲַ�ʽ�����ݼ�,�����������ܴ�,���Ҫ�����зֲ��洢�ڸ������ķ���������

- Spark��,RDD(Resilient Distributed Dataset)����������ij������ݼ�,����ÿ��RDD������ �ɸ�Partition�����

- RDD1������5��Partition,RDD2������3��Partition,��ЩPartition�ֲ���4���ڵ��С�

2.1.2. ������ʽ

-

Spark�����������ݷ�����ʽ:HashPartitioner(��ϣ����)��RangePartitioner(��Χ����)��

-

HashPartitioner

- Hash����

- HashPartitioner���ù�ϣ�ķ�ʽ�Լ�ֵ�����ݽ��з����� �����ݷ�������Ϊ partitionId = Key.hashCode % numPartitions

- partitionId������Key��Ӧ�ļ�ֵ������Ӧ�����䵽��Partition��ʶ

- Key.hashCode��ʾ��Key�Ĺ�ϣֵ

- numPartitions��ʾ������Partition������

-

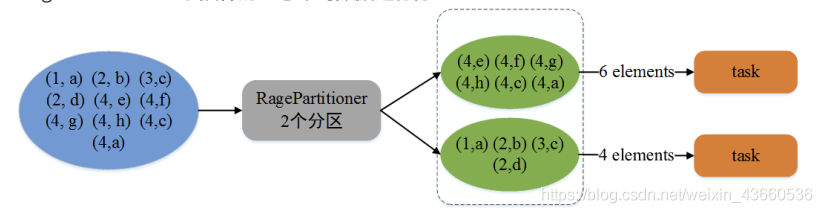

RangePartitioner

- ������

- Spark����RangePartitioner��Ŀ����Ϊ�����HashPartitioner�������ķ�����б����,Ҳ�������а��������������������⡣

- HashPartitioner���ù�ϣ�ķ�ʽ��ͬһ���͵�Key���䵽ͬһ��Partition��,��ij���������������϶�ʱ,�ͻ��������Partition�а��������ݹ���

- ��Jobִ�й�����,һ��Partition��Ӧһ��Task,��ʱ�ͻ�ʹ��ij����Task���й�����

- RangePartitioner���ڳ�����˼���������ݽ��з���

2.1.3. HDFS��Partition

? hdfs�е�block�Ƿֲ�ʽ�洢����С��Ԫ,������ʢ���ļ��ĺ���,һ���ļ�����Ҫռ�������, ��һ�������������ֻ��������ͬһ���ļ�������block����Ϊ128M,����ļ���260M,��ô�� ���ļ�ռ3��block(128+128+4)�������������Ȼ����һ���ִ��̿ռ���˷�,��������� block��С,���ڿ����ҵ�����ȡ��Ӧ�����ݡ�(p.s. ���ǵ�hdfs�������,Ĭ�����ݿ���,ʵ�� ��3*3=9��block�������ռ䡣)

? spark�е�partition �ǵ��Էֲ�ʽ���ݼ�RDD����С��Ԫ,RDD���ɷֲ��ڸ����ڵ��ϵ�partition ��ɵ���partition ��ָ��spark�ڼ��������,���ɵ������ڼ���ռ�����С��Ԫ,ͬһ������ (RDD)��partition ��С��һ,��������,�Ǹ���application������Ӻ������������ݷֿ�����������

-

blockλ�ڴ洢�ռ䡢partition λ�ڼ���ռ�,

-

block�Ĵ�С�ǹ̶��ġ�partition ��С�Dz��̶���,

-

block��������ġ���������ʧ,partition(RDD)û��������ơ���ʧ֮�����¼���õ���

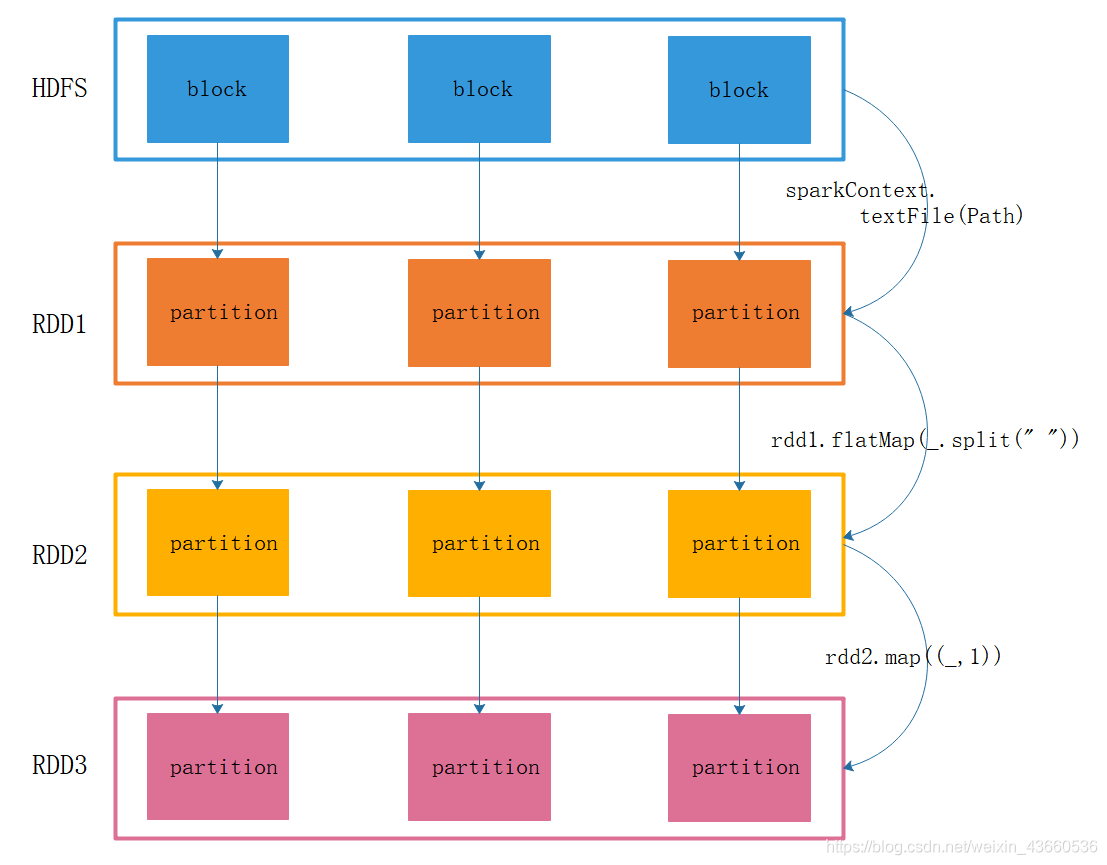

? Spark��HDFS�����ļ��ķ�����Ĭ�ϵ���HDFS�ļ��Ŀ���(blocks),HDFS�е�block�Ƿֲ�ʽ�洢����С��Ԫ����������ϴ�һ��30GB�ķ�ѹ�����ļ���HDFS,HDFSĬ�ϵĿ�������С128MB, ��˸��ļ���HDFS�ϻᱻ��Ϊ235��(30GB/128MB);Spark��ȡSparkContext.textFile()��ȡ���ļ�,Ĭ�Ϸ��������ڿ�����235��

2.2. RDD

- RDD(Resilient Distributed Dataset) ���Էֲ�ʽ���ݼ���

2.2.1. RDD���������

RDD����һϵ�е�partition��ɵġ�- ������������ÿһ��

partition(split)�ϵġ� RDD֮����һϵ�е�������ϵ��- ��������������

(K,V)��ʽ��RDD�ϡ� RDD�ṩһϵ����ѵļ���λ�á�

2.2.2. RDD����ͼ

ע��:

-

textFile�����ײ��װ����MR��ȡ�ļ��ķ�ʽ,��ȡ�ļ�֮ǰ�Ƚ���split��Ƭ,Ĭ��split��С��һ��block��С�� -

RDDʵ���ϲ��洢����,���﷽������,��ʱ����Ϊ�洢������ -

ʲô��

K,V��ʽ��RDD?- ���

RDD����洢�����ݶ��Ƕ�Ԫ�����,��ô���RDD���Ǿͽ���K,V��ʽ��RDD��

- ���

-

��������

RDD�ĵ���(�ݴ�)?partition����,��Сû������,������RDD��������RDD֮��������ϵ,����������һ��RDD���¼����RDD��

-

��������

RDD�ķֲ�ʽ?RDD����Partition���,partition�Ƿֲ��ڲ�ͬ�ڵ��ϵ���RDD�ṩ�������λ��,���������ݱ��ػ��������˴������С������ƶ����ݲ��ƶ��������

2.2.3. LineageѪͳ

? RDD ������Ҫ������֮һ����ѪԵ��ϵ(Lineage ),��������һ�� RDD ����δӸ� RDD ����� ���ġ����ij�� RDD ��ʧ��,����Ը���ѪԵ��ϵ,�Ӹ� RDD ���������

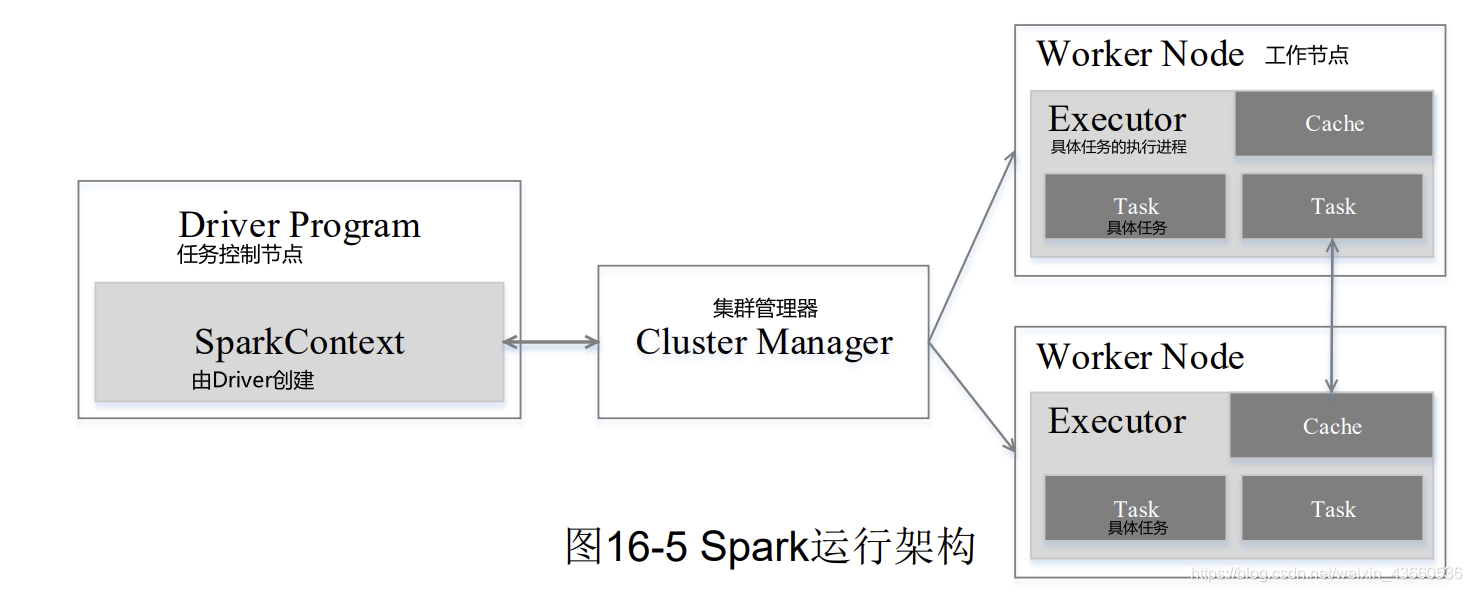

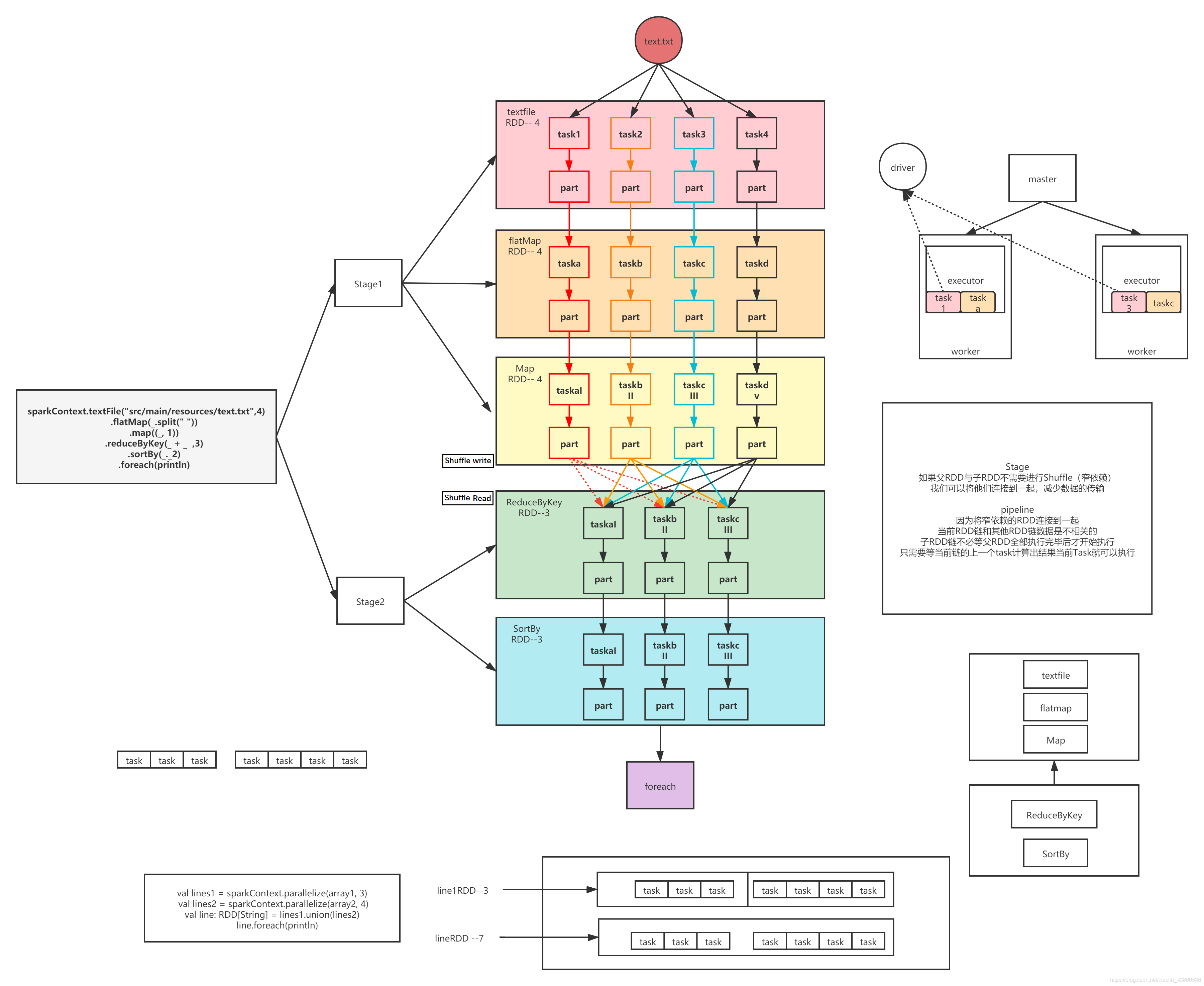

2.3. ϵͳ�ܹ�

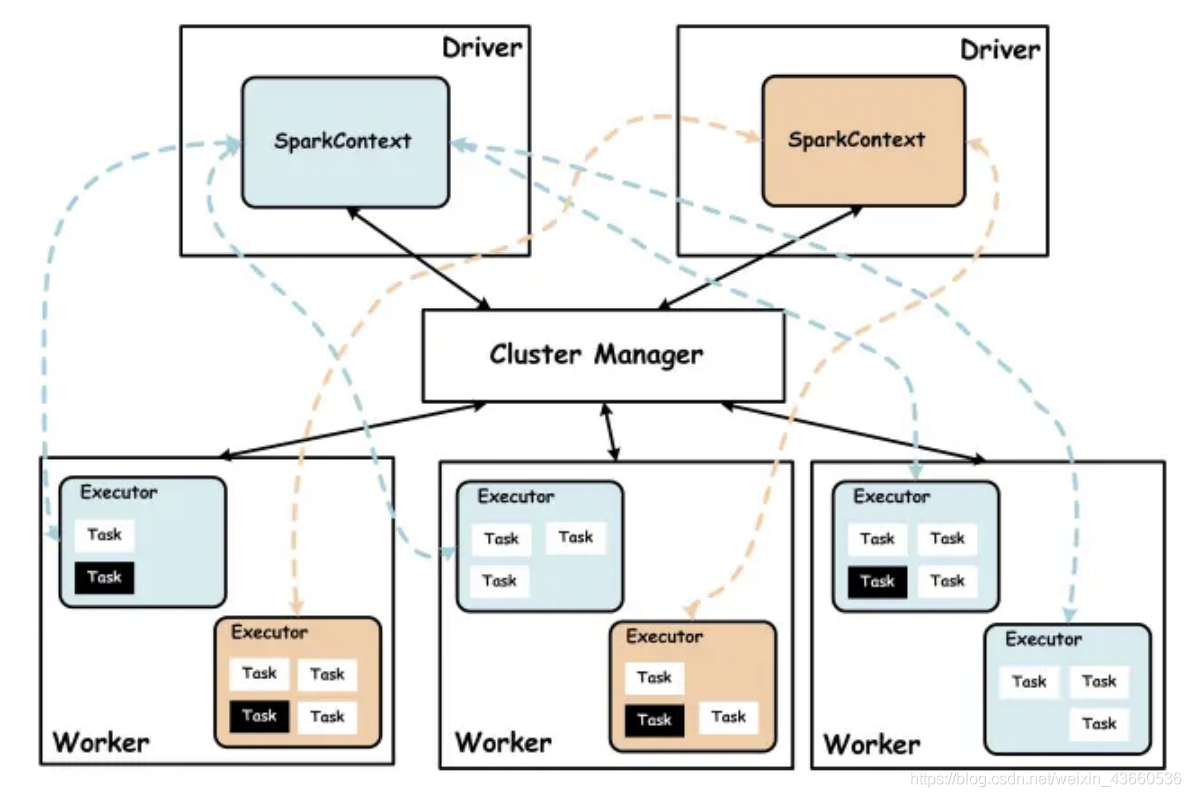

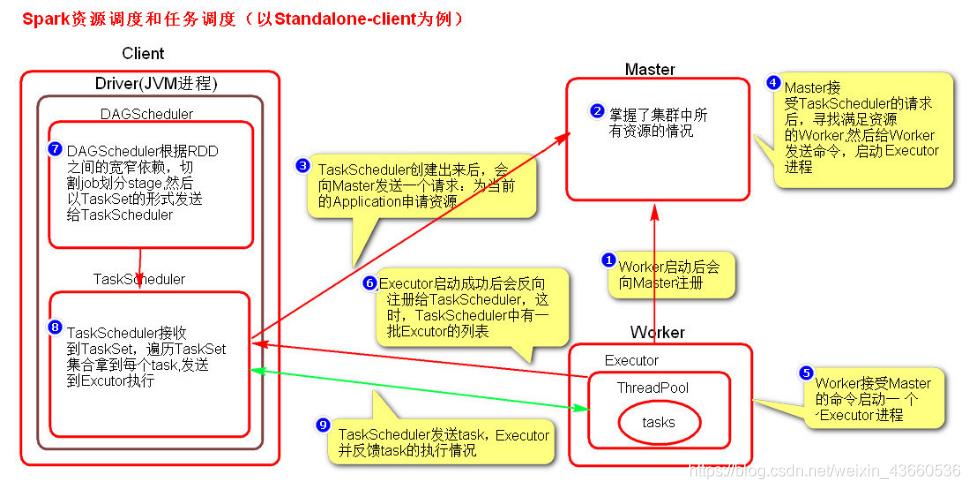

Master(standaloneģʽ):��Դ���������ڵ�(����)��Cluster Manager:����Ⱥ����ȡ��Դ���ⲿ����(����:standalone;yarn;mesos)��Worker(standaloneģʽ):��Դ�������ӽڵ�(����)����˵��������������Դ�Ľ�����Dirver(program):�������ӹ�������(worker)������ ��Executor:����һ��worker�����������Ľڵ���ΪijApplication������һ��������,������̸�����������,���Ҹ������ݴ����ڴ���ߴ�����,ÿ��Ӧ��֮�䶼�и��Զ�����executors��

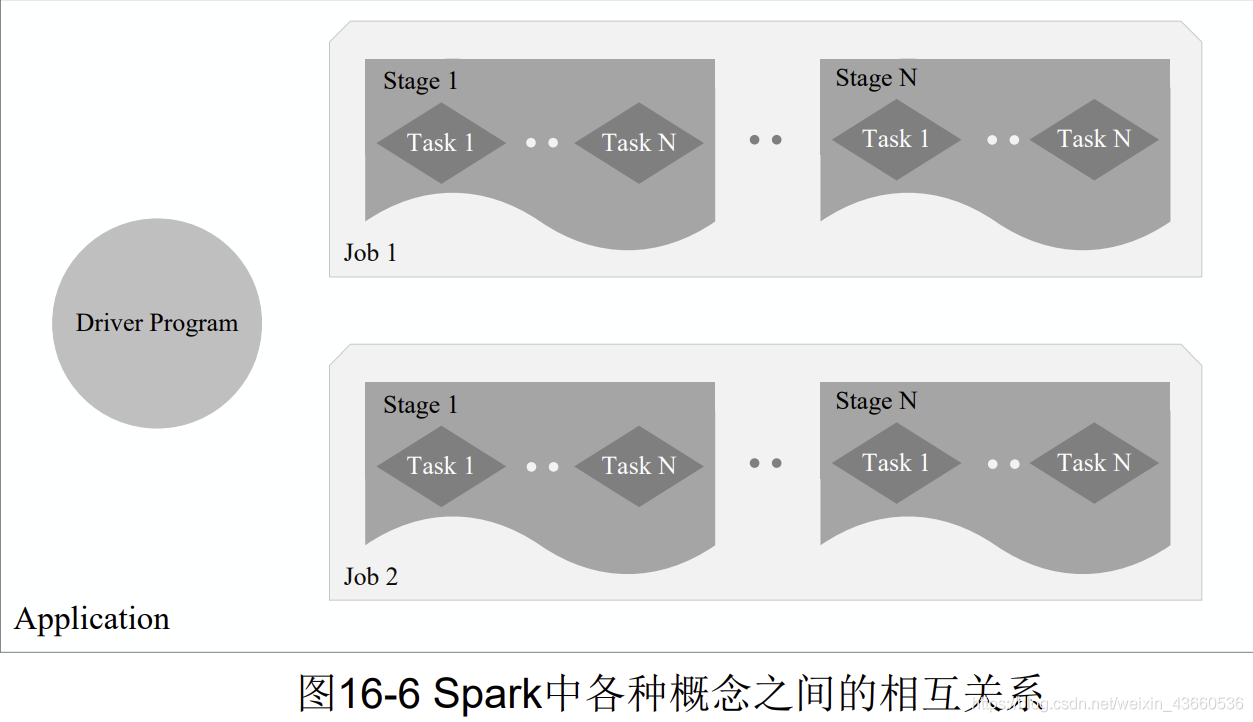

Application:����Spark���û�����,����driver����������ڼ�Ⱥ�ϵ�executor����,��һ��������sparkӦ�� ��Task:�����͵�**executor�ϵĹ�����Ԫ**��Job:�����ܶ�����(Task)�IJ��м���,��action���Ӷ�Ӧ��Stage:һ��job�ᱻ��ֳɺܶ�������,ÿ������ΪStage(����MapReduce��ΪMapTask��ReduceTaskһ��)��

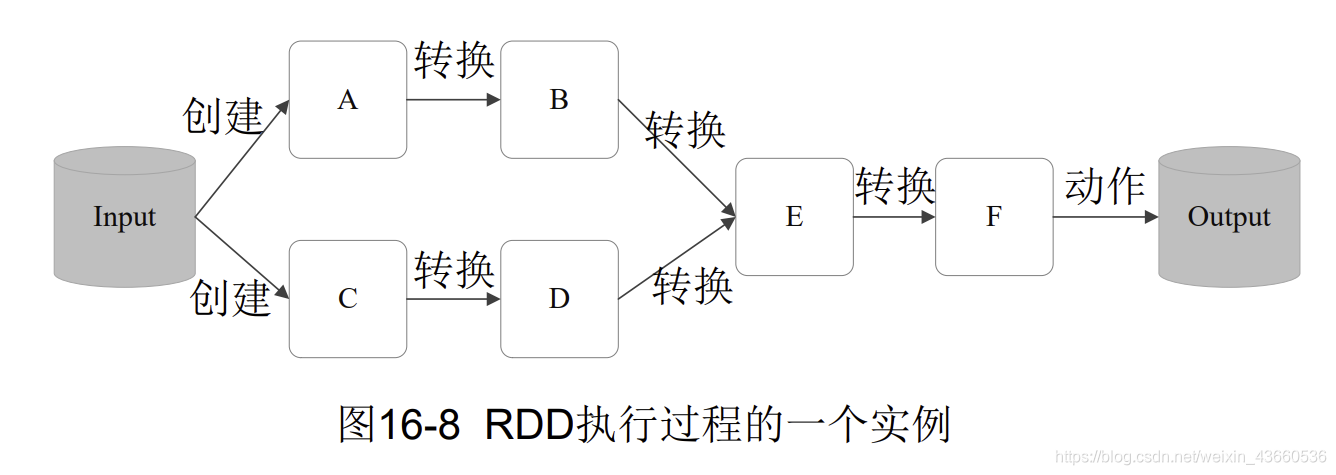

3������(���ļ�)

- Spark ��¼�� RDD ֮������ɺ�������ϵ������ֻ�е� F �����ж�����ʱ,Spark �Ż���� RDD ��������ϵ���� DAG,������㿪ʼ�����ļ�����

��������������ͼ��ʾ,��ҪҲ��Ϊ���¼���:

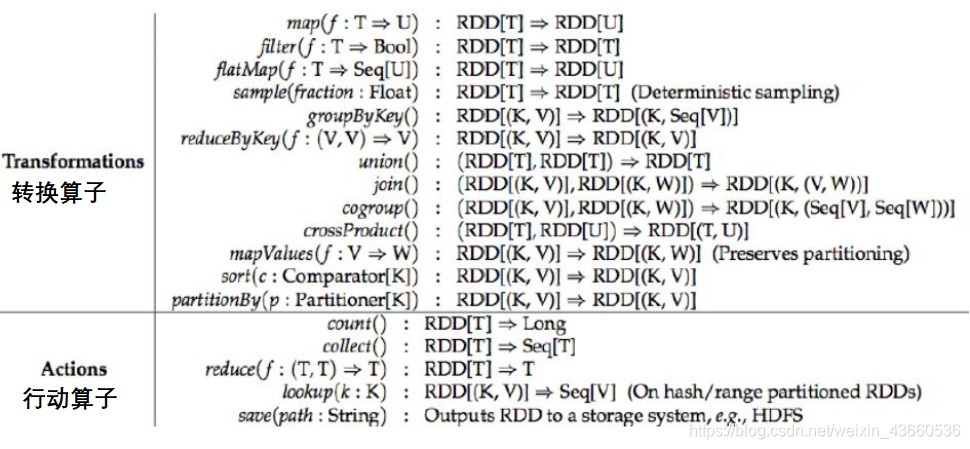

- Transformations ת������

- Actions �����

3.1. Transformationsת������

Transformations��������һ������(���ʾ�������)����ת������,��map,flatMap,reduceByKey�ȡ�Transformations�������ӳ�ִ��,Ҳ��������ִ�С�

3.1.2. ����Transformation������

filter:���˷��������ļ�¼��,true����,false���˵���map:��һ��RDD�е�ÿ��������,ͨ��map�еĺ���ӳ����Ϊһ���µ�Ԫ�ء��ص�:����һ��,���һ��������flatMap:��map��flat����map����,ÿ�����������ӳ��Ϊ0������������sample�����������,���ݴ���ȥ��С�������������зŻػ����Żصij�����reduceByKey����ͬ��Key������Ӧ�������д�����sortByKey/sortBy������K,V��ʽ��RDD��,��key�����������߽�������

3.1.3. ���䲿������(���ļ������)

-

ת������

joinleftOuterJoinrightOuterJoinfullOuterJoin- ��Щ

join����������**K,V��ʽ��RDD�ϡ�����keyֵ��������**,����:(K,V)join(K,W)����(K,(V,W)) - ע��:

join�������������RDD������������һ����ͬ��

-

union- �ϲ��������ݼ����������ݼ�������Ҫһ����

- �����µ�

RDD�ķ������Ǻϲ�RDD���������ܺ���

-

intersection: ȡ�������ݼ��Ľ����� -

subtract: ȡ�������ݼ��IJ�� -

mapPartitions- mapPartition��

map����,��λ��ÿ��partition�ϵ����ݡ�

- mapPartition��

-

distinct(map+reduceByKey+map)��RDD������ȥ���� -

cogroup- ����������

(K,V)��(K,W)��������ʱ,����һ�����ݼ�(K,(Iterable<V>,Iterable<W>))��

- ����������

-

mapPartitionsWithIndex:������mapPartitions,����֮���Я������������ֵ�� -

repartition:���ӻ���ٷ����������ӻ����shuffle�� -

coalesce:���ٷ���-

coalesce���������ٷ���,�������ڶ��������Ǽ��ٷ����Ĺ������Ƿ����shuffle�� -

trueΪ����shuffle,false������shuffle��Ĭ����false�� -

���

coalesce���õķ�������ԭ����RDD�ķ���������Ļ�,�ڶ�����������Ϊfalse����������(ת��֮�����������֮ǰ),������ó�true,Ч����repartitionһ���� -

repartition(numPartitions) = coalesce(numPartitions,true)

-

-

groupByKey- ������

K,V��ʽ��RDD�ϡ�����Key���з��顣������(K,V),����(K,Iterable <V>)��

- ������

-

zip- ������

RDD�е�Ԫ��(KV��ʽ/��KV��ʽ)���һ��KV��ʽ��RDD,����RDD������������ͬ��

- ������

-

zipWithIndex- �ú�����

RDD�е�Ԫ�غ����Ԫ����RDD�е�������(��0��ʼ)��ϳ�(K,V)�ԡ�

- �ú�����

3.2. Action�����

? Action������Ҳ��һ�����ӽ����ж�����,��foreach,collect,count�ȡ�Transformations���������ӳ�ִ��,Action������������ִ����һ��applicationӦ�ó������м���Action������ִ��,���м���job���С�

3.2.2. ����Action������

-

count:�������ݼ��е�Ԫ���������ڽ��������ɺ���յ�Driver�ˡ� -

take(n):����һ���������ݼ�ǰn��Ԫ�صļ����� -

first:Ч����ͬ��take(1),�������ݼ��еĵ�һ��Ԫ�ء� -

foreach:ѭ���������ݼ��е�ÿ��Ԫ��,������Ӧ������ -

collect:�����������յ�Driver�ˡ� -

foreachPartition:������������ÿ��partition�������� -

countByKey- ���õ�

K,V��ʽ��RDD��,����Key������ͬKey�����ݼ�Ԫ�ء�

- ���õ�

-

countByValue- �������ݼ�ÿ��Ԫ����ͬ��������������������ͬ���ݵ�Ԫ�ض�Ӧ��������

-

reduce- ���ݾۺ����ۺ����ݼ��е�ÿ��Ԫ�ء�

3.3. ��������

��RDD�־û�,�־û��ĵ�λ��partition��

- ��������������,

cache,persist,checkpoint�� cache��persist������ִ�еġ�������һ��**action�����Ӵ���ִ��**��checkpoint���������ܽ�RDD�־û�������,�����ж�RDD֮���������ϵ��

3.3.1. cache

Ĭ�Ͻ�RDD�����ݳ־û����ڴ�����cache����ִ�С�

cache() = persist() = persist(StorageLevel.Memory_Only)

���Դ���:

SparkConf conf = new SparkConf();

conf.setMaster("local").setAppName("CacheTest");

JavaSparkContext jsc = new JavaSparkContext(conf);

JavaRDD<String> lines = jsc.textFile("./NASA_access_log_Aug95");

//lines = lines.cache();

long startTime = System.currentTimeMillis();

long count = lines.count();

long endTime = System.currentTimeMillis();

System.out.println("��"+count+ "������,"+"��ʼ��ʱ��+cacheʱ��+����ʱ��="+ (endTime-startTime));

long countStartTime = System.currentTimeMillis();

long countrResult = lines.count();

long countEndTime = System.currentTimeMillis();

System.out.println("��"+countrResult+ "������,"+"����ʱ��="+ (countEndTime - countStartTime));

jsc.stop();

3.3.2. persist

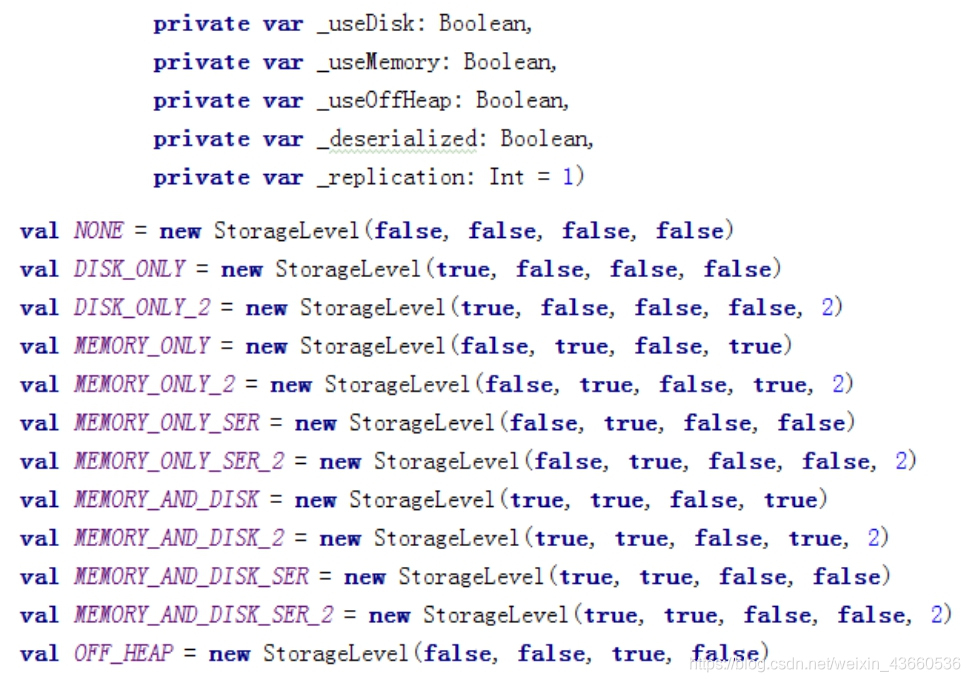

����ָ���־û��ļ�����õ���MEMORY_ONLY��MEMORY_AND_DISK��

�־û���������:

������Щ����_2�ı�ʾ�и���replication��

cache��persist��ע������:

persist��ִ��,������һ��action�����Ӵ���ִ����cache��persist���ӵķ���ֵ���Ը�ֵ��һ������,������job��ֱ��ʹ�������������ʹ�ó־û��������ˡ��־û��ĵ�λ��partition(RDD�����)��cache��persist���Ӻ�����������action������

3.3.3. checkpoint

checkpoint��RDD�־û�������,�������ж�RDD֮���������ϵ,Ҳ����ִ����

ִ��ԭ��:

- ��

RDD��jobִ����Ϻ�,���final RDD�Ӻ���ǰ������ - �����ݵ�ijһ��

RDD������checkpoint����,��Ե�ǰ��RDD��һ������� Spark��ܻ��Զ�����һ���µ�job,���¼������RDD������,�����ݳ־û���HDFS����

? ʹ��checkpointʱ�����Ż��ֶ�:��RDDִ��checkpoint֮ǰ,��ö����RDD��ִ��cache,������������jobֻ��Ҫ���ڴ��е����ݿ�����HDFS�ϾͿ���,ʡȥ�����¼�����һ����

demoʾ������:

SparkConf conf = new SparkConf();

conf.setMaster("local").setAppName("checkpoint");

JavaSparkContext sc = new JavaSparkContext(conf);

sc.setCheckpointDir("./checkpoint");

JavaRDD<String> lines = sc.textFile("./NASA_access_log_Aug95");

lines.checkpoint();

lines.count();

jsc.stop();

4��Spark��Ⱥ�

Spark��Ⱥ� :https://blog.csdn.net/weixin_43660536/article/details/119522431

.

5�������ύ��ʽ

5.1. Standalone-client

-

spark-submit --master spark://node01:7077 --deploy-mode client --class org.apache.spark.examples.SparkPi $SPARK_HOME/examples/jars/sparkexamples_2.12-2.4.6.jar 10 -

ִ������

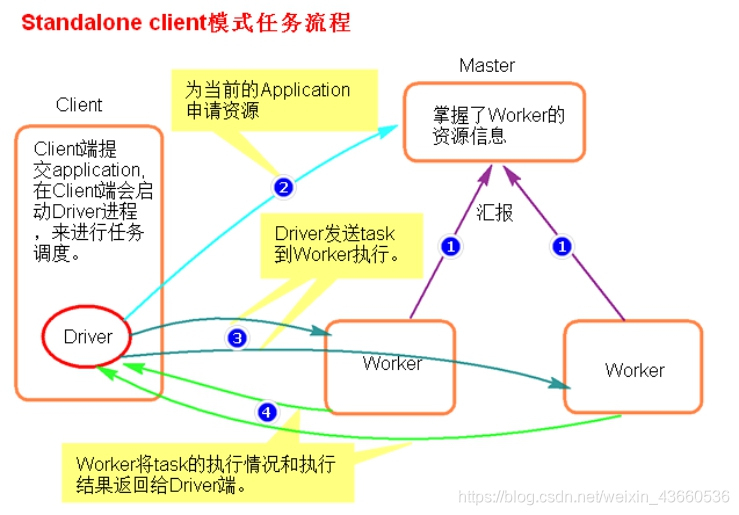

5.1.2. ִ������:

-

clientģʽ�ύ�����,���ڿͻ�������Driver������ -

Driver����Master��������Application��������Դ�� -

��Դ����ɹ�,

Driver�˽�task�ַ���worker��ִ��,����executor����(����ķַ�)�� -

Worker��(exectuor����)��taskִ�н�����ص�Driver��(�������Ļ���)��

�ܽ�:

clientģʽ���������Ե��Գ�����Driver���������ͻ���������,����Ŀͻ��˾���ָ�ύӦ�ó���ĵ�ǰ�ڵ�����Driver�˿��Կ���taskִ�е������- ���������²���ʹ��

clientģʽ,����Ϊ:����Ҫ�ύ100��application����Ⱥ����,Driverÿ�ζ�����client������,��ô�ͻᵼ�¿ͻ���100�������������������⡣

5.2. Standalone-cluster�ύ����ʽ

-

spark-submit --master spark://node01:7077 --deploy-mode cluster --class org.apache.spark.examples.SparkPi $SPARK_HOME/examples/jars/sparkexamples_2.12-2.4.6.jar 10 -

ִ������

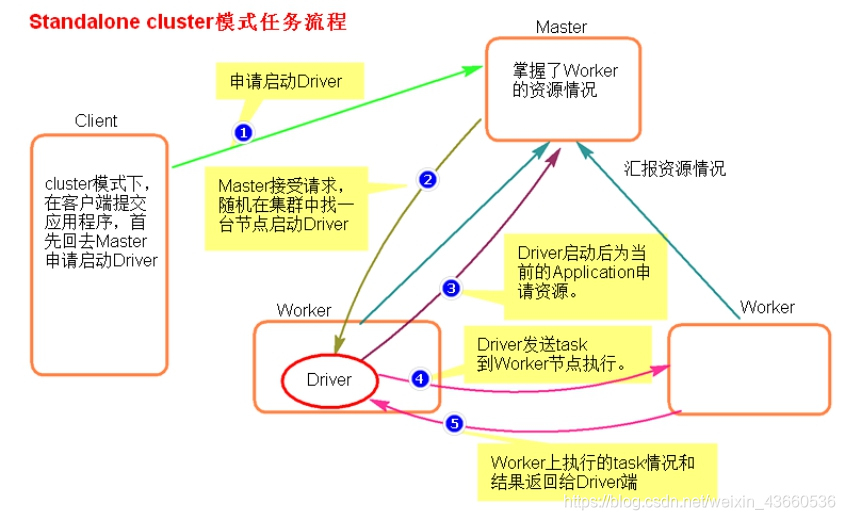

5.2.2. ִ������:

clusterģʽ�ύӦ�ó����,����Master��������Driver��Master��������,����ڼ�Ⱥһ̨�ڵ�����Driver������Driver������Ϊ��ǰ��Ӧ�ó���������Դ��Driver�˷���task��worker�ڵ���ִ��(����ķַ�)��worker�ϵ�executor���̽�ִ�������ִ�н�����ظ�Driver��(�������Ļ���)��

ע��:

Driver�������ڼ�Ⱥijһ̨Worker��������,���ύapplicaition���ͻ��������鿴task��ִ������ġ�

5.3. Standalone�ܽ�

-

Standalone-cluster �ύ��ʽ,Ӧ�ó���ʹ�õ����� jar �����ļ�,���뱣֤���е� worker �ڵ㶼Ҫ��,��Ϊ���ַ�ʽ, spark �����Զ��ϴ�����

- �����е����������ļ���ͬһ������,Ȼ����� hdfs �ϡ�

- �����е����������ļ�����һ���� worker �ڵ��ϡ�

-

Standalone���ַ�ʽ�ύ����,Driver�뼯Ⱥ��ͨ��(����ν����)����:

-1. Ӧ�ó�����Դ��������

-2. ����ķַ���

-3. ����Ļ�����

-4. ���taskִ�������

5.4. yarn-client

�ύ����,�������ַ�ʽ�Կɽ��������ύ��

./spark-submit --master yarn --class org.apache.spark.examples.SparkPi ../examples/jars/spark-examples_2.12-2.4.6.jar 10

./spark-submit --master yarn�Cclient --class org.apache.spark.examples.SparkPi ../examples/jars/spark-examples_2.12-2.4.6.jar 10

./spark-submit --master yarn --deploy-mode client --class org.apache.spark.examples.SparkPi ../examples/jars/spark-examples_2.12-2.4.6.jar 10

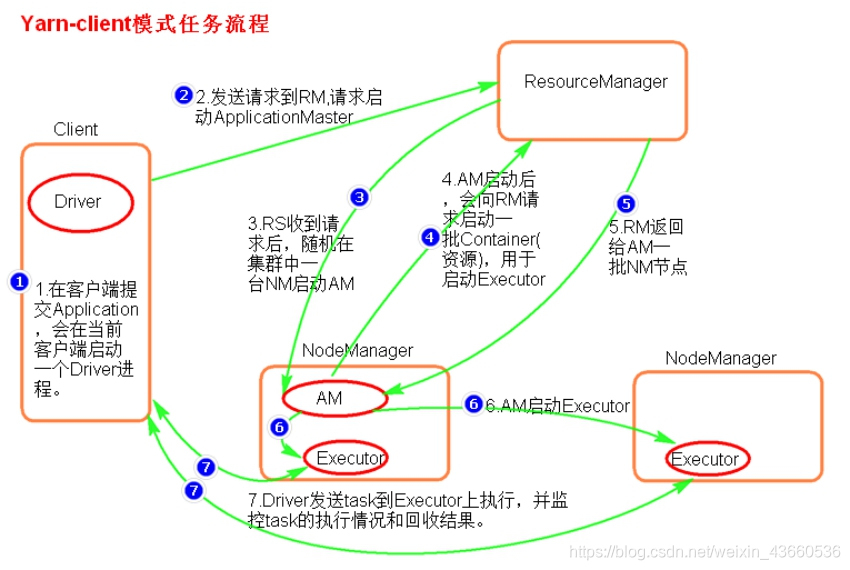

ִ��ԭ��ͼ��:

5.4.2. ִ������:

-

�ͻ����ύһ��

Application,�ڿͻ�������һ��Driver������ -

Ӧ�ó������������

RS(ResourceManager)(�൱��standaloneģʽ�µ�master����)��������,����AM(ApplicationMaster)�� -

RS�յ�����,���ѡ��һ̨NM(NodeManager)����AM�������NM�൱��Standalone�е�Worker������ -

AM������,����RS����һ��container��Դ,��������Executor�� -

RS���ҵ�һ��NM(����container)���ظ�AM,��������Executor�� -

AM����NM������������Executor�� -

Executor������,�ᷴ��ע���Driver,Driver����task��Executor,ִ������ͽ�����ظ�Driver�ˡ�

�ܽ�:

Yarn-clientģʽͬ���������ڲ��ԡ�ԭ��ͬStandalone-clusterԭ��һ����

ApplicationMaster(executorLauncher)���ڴ�ģʽ�е�����:

-

Ϊ��ǰ��

Application������Դ -

��

NodeManager������Ϣ����Executor��

ע��:ApplicationMaster�ڴ���ģʽ����launchExecutor��������Դ�Ĺ���,��û����ҵ�����Ĺ��ܡ�

5.5. yarn-cluster�ύ����ʽ

�ύ����:

./spark-submit --master yarn --deploy-mode cluster --class org.apache.spark.examples.SparkPi ../examples/jars/spark-examples_2.12-2.4.6.jar 10

����

./spark-submit --master yarn-cluster --class org.apache.spark.examples.SparkPi ../examples/jars/spark-examples_2.12-2.4.6.jar 10

ִ��ԭ��ͼ��

5.5.2. ִ������:

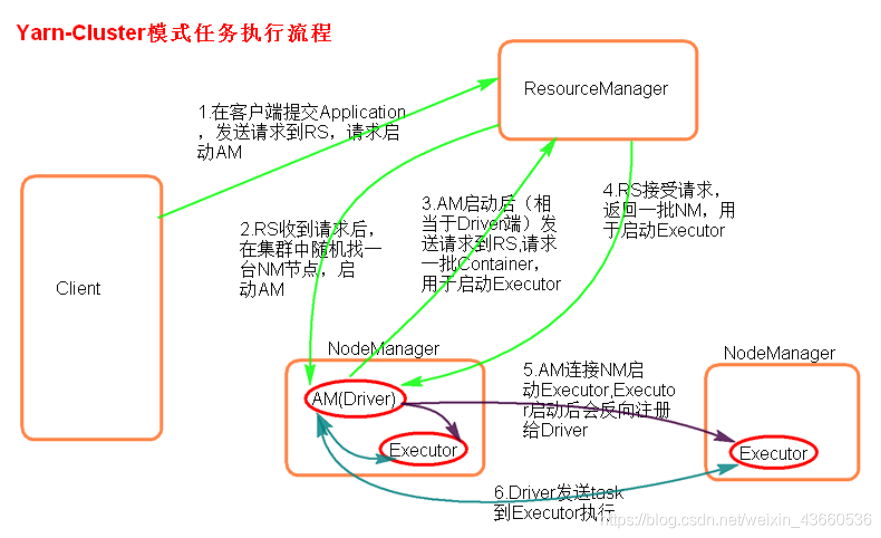

-

�ͻ����ύ

ApplicationӦ�ó���,��������RS(ResourceManager),��������AM(ApplicationMaster)�� -

RS�յ�����������һ̨NM(NodeManager)������AM(�൱��Driver��)�� -

AM����,AM��������RS,����һ��container��������Excutor�� -

RS����һ��NM�ڵ��AM�� -

AM���ӵ�NM,��������NM����Excutor�� -

Excutor����ע�ᵽAM���ڵĽڵ��Driver��Driver����task��Excutor��

�ܽ�:

Yarn-Cluster��Ҫ��������������,��ΪDriver������Yarn��Ⱥ��ijһ̨nodeManager��,ÿ���ύ�����Driver���ڵĻ������Dz������ύ����Ŀͻ��˻���,���Ƕ��NM�ڵ��е�һ̨,�������ijһ̨����������������������,��ͬ��Ҳ��ȱ��,�����ύ���ܿ�����־��ֻ��ͨ��yarn�鿴��־��

ApplicationMaster�ڴ�ģʽ�еĵ�����:

-

Ϊ��ǰ��

Application������Դ -

��

NodeManger������Ϣ����Executor�� -

���������

ֹͣ��Ⱥ��������:yarn application -kill applicationID

6��RDD֮խ�����Ϳ�����

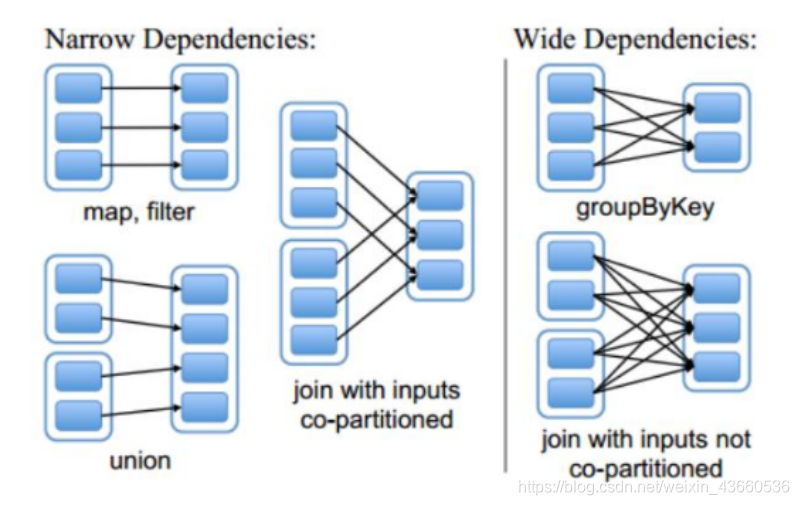

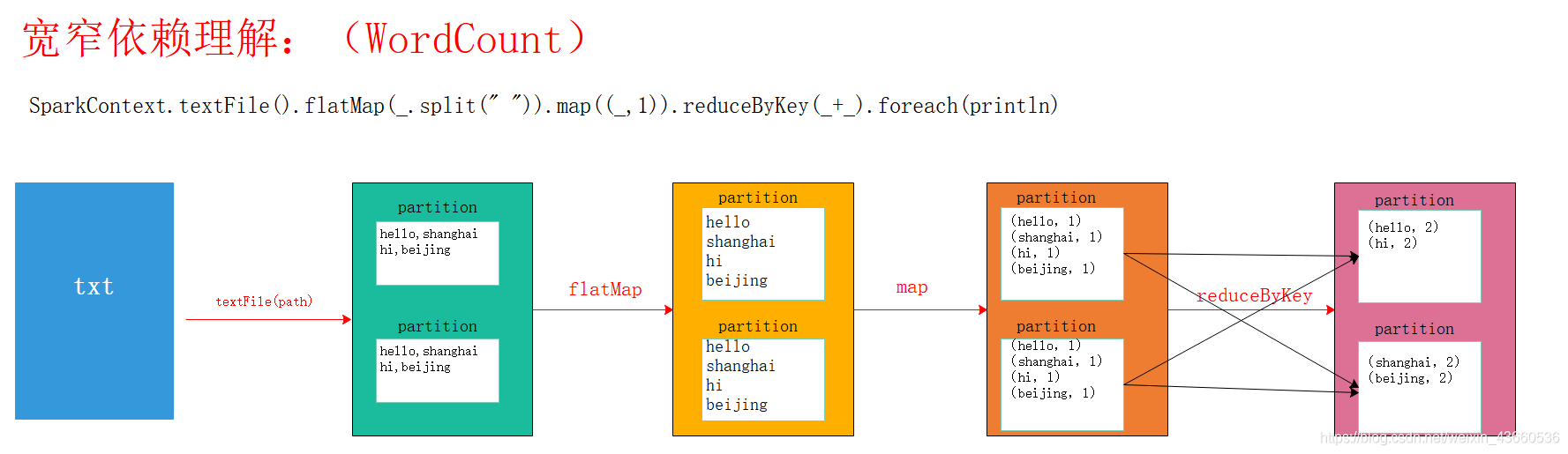

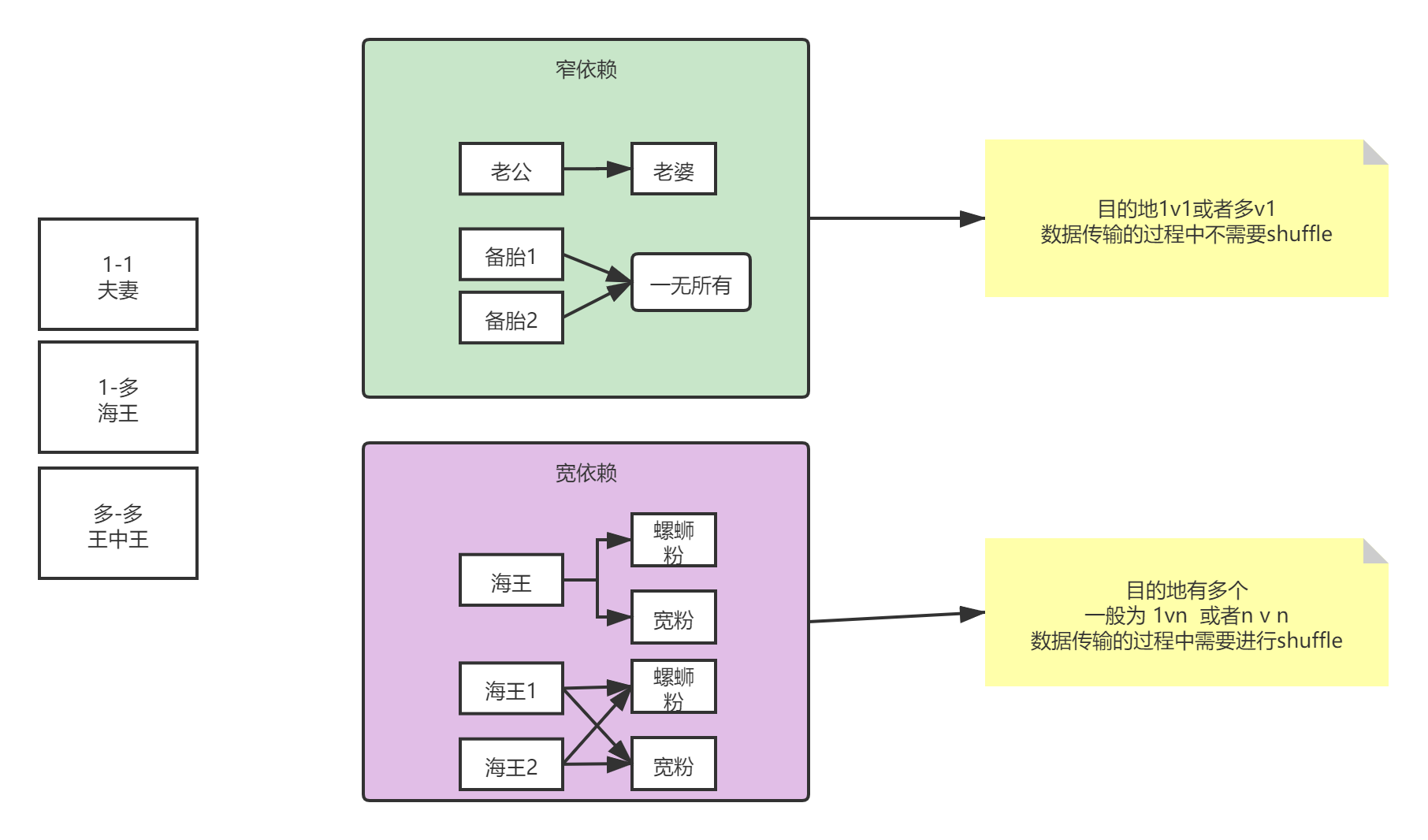

RDD֮����һϵ�е�������ϵ,������ϵ�ַ�Ϊխ��������������

6.1. խ����

- ? ��

RDD����RDD��partition֮��Ĺ�ϵ��һ��һ�������߸�RDD����RDD��partition��ϵ�����һ�ġ�������shuffle�IJ�����

6.2. ������

��RDD����RDD��partition֮��Ĺ�ϵ��һ�Զ�������**shuffle�IJ���**��

6.3. ��խ����ͼ����

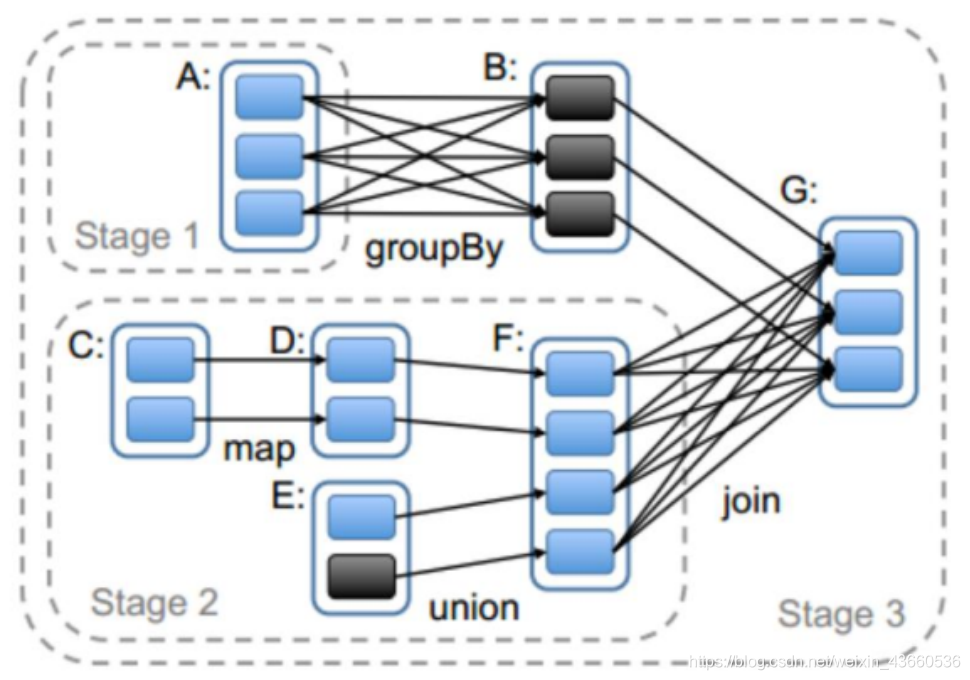

7��Stage

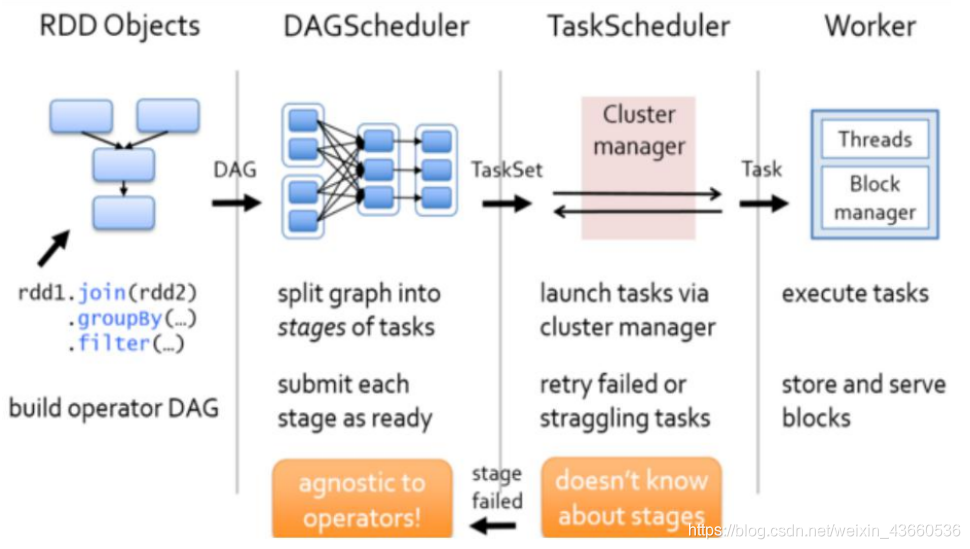

Spark��������RDD֮���������ϵ,�γ�һ��**DAG������ͼ**,DAG���ύ��DAGScheduler,DAGScheduler���DAG���ֳ�������Ķ��stage,- ����

stage�����ݾ���**RDD֮��Ŀ�խ����**������***������***�ͻ���stage,ÿ��stage����һ������task���� - Ȼ����Щ

task��taskSet����ʽ�ύ��TaskScheduler���С� stage����һ�鲢�е�task�����

7.1. stage����

-

�и����:�Ӻ���ǰ,�������������и�

stage��1.�Ӻ���ǰ����,�����������ͶϿ�,����խ�����Ͱѵ�ǰ��RDD���뵽Stage��;

2.ÿ��Stage�����Task���������ɸ�Stage�����һ��RDD��Partition����������;

3.���һ��Stage����������������ResultTask,ǰ����������Stage������������Ͷ��� ShuffleMapTask;

4.������ǰStage������һ���Ǹ�Stage�����һ�����㲽��;

-

����spark��stage�Ļ����Ǹ���shuffle�����ֵ�,����������Ȼ��shuffle����,��˿���˵spark�Ǹ��ݿ�խ����������stage�ġ�

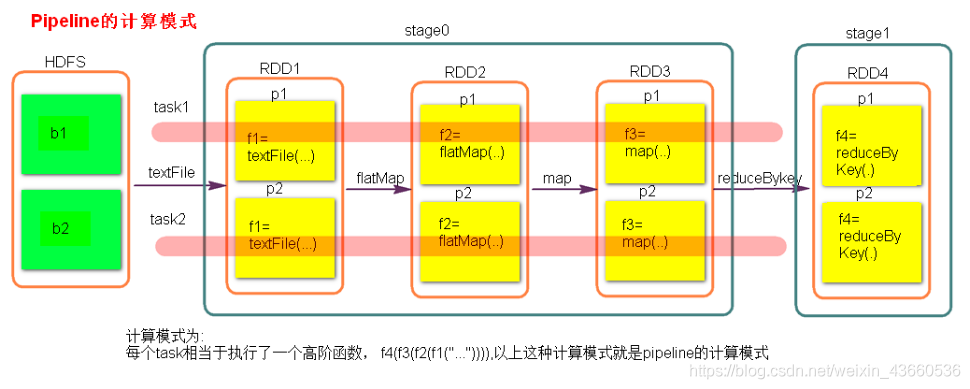

stage����ģʽ�Cpipeline

pipeline�ܵ�����ģʽ,pipelineֻ��һ�ּ���˼�롢ģʽ��

ע���:

1.�����ڹܵ������?

-

��

RDD�����־û�(cache,persist)�� -

shuffle write��ʱ��

2.Stage��task���ж�����stage�����һ��RDD���������������� ��

3.��θı�RDD��������?

- reduceByKey(XXX,3)

- GroupByKey(4)

- sc.textFile(path,numpartition)

ʹ������ʱ��������num�������Ƿ���partition��������

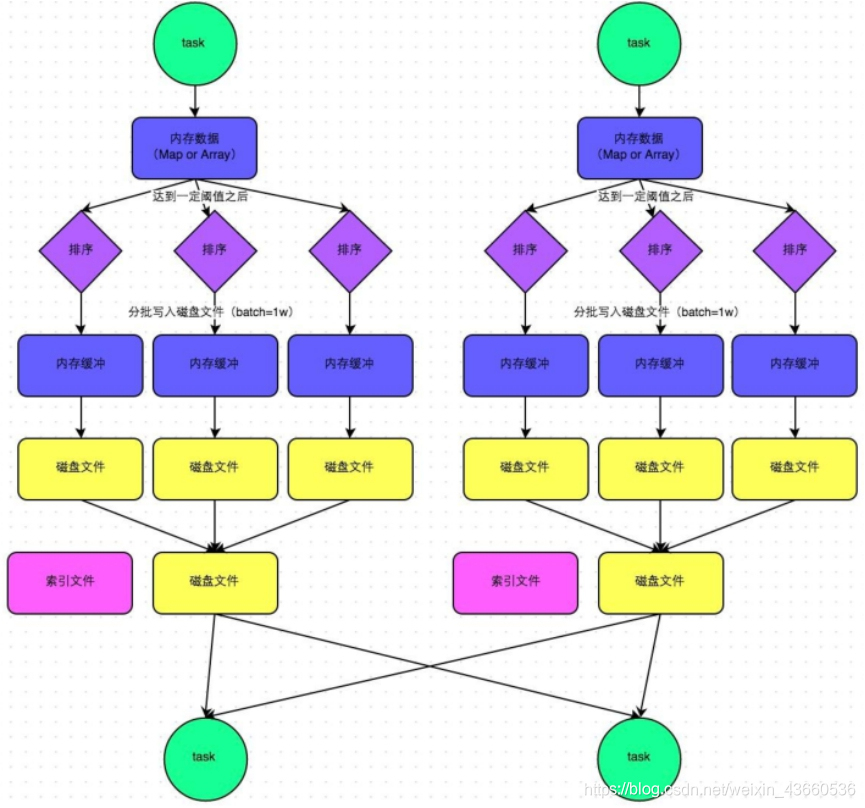

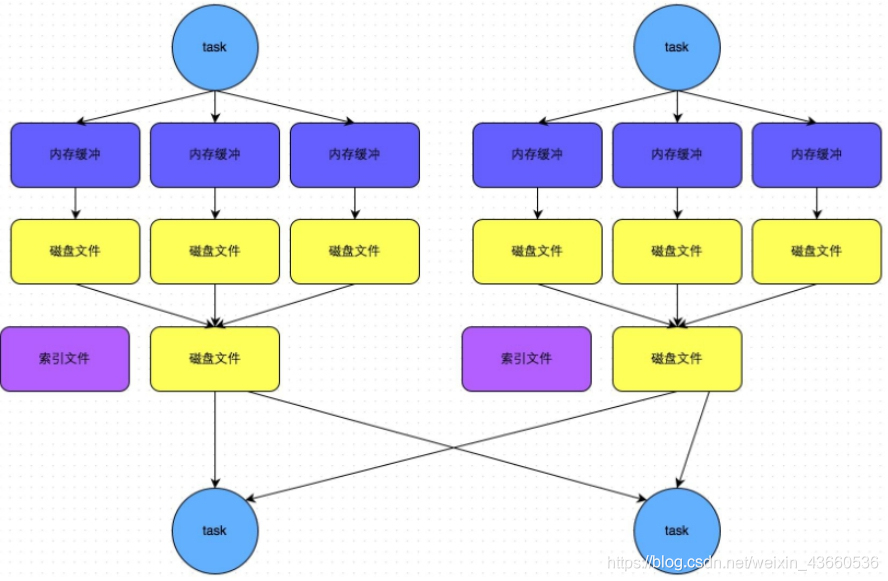

8��SparkShuffle

8.1. SparkShuffle����

- RDD֮����ݿ�����������stage,����shuffle��

- ��Spark Shuffle����,����ΪShuffle Write�κ�Shuffle Read����

Shuffle Write:Shuffle Map Task��Task�������м����ݽ��в���,���������ݷ�����ʽ���м����ݽ��з�����Shuffle Read:Shuffle Read Task����ȡShuffle Write���в����IJ��Ѿ��ֺ������м����ݡ�

Spark��������Shuffle����,HashShuffle��SortShuffle��

Spark1.2֮ǰ��HashShuffle,Spark1.2����SortShuffle��spark1.2-spark1.6֮������HashShuffle��SortShuffle�ġ�spark2.0��ֻ��sortshuffle��

��Щspark���ӻ���shuffle?

-

- ȥ��,distinct

- ����,groupByKey,reduceByKey��

- �ط���,repartition,coalesce

- ���ϻ��߱�����,interection,join

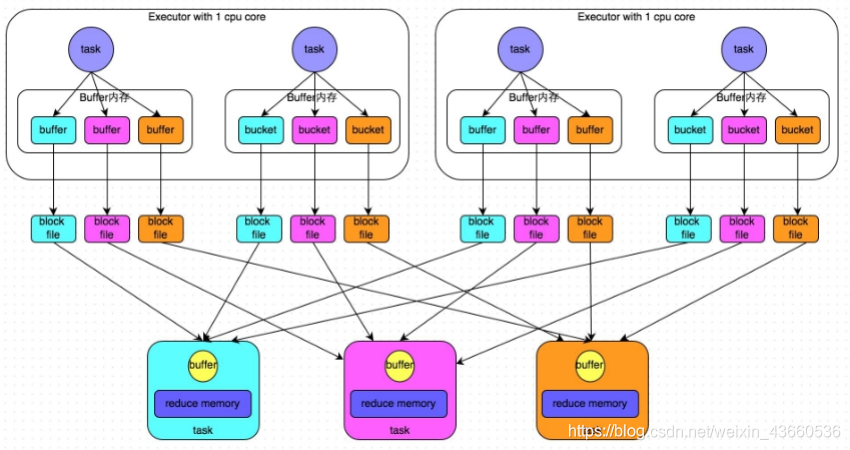

8.2. HashShuffle

8.2.1. ��ͨ����

ִ������:

1)ÿһ��map task����ͬ���д����ͬ��buffer��,ÿ��buffer�Ĵ�СΪ32K��buffer�����ݻ��������á�

2)ÿ��buffer�ļ�����Ӧһ������С�ļ���

3)reduce task����ȡ��Ӧ�Ĵ���С�ļ���

�ܽ�:

1)map task�ļ�����������¸�������(Ĭ����hashPartitioner)������д�뵽��һ������С�ļ���ȥ��ReduceTask��ȥMap����ȡ��Ӧ�Ĵ���С�ļ���

2)�����Ĵ���С�ļ��ĸ���: M(map task�ĸ���)*R(reduce task�ĸ���)��

�����Ĵ���С�ļ�����,�ᵼ����������:

-

��

Shuffle Write�����л�����ܶ�д����С�ļ��Ķ��� -

��

Shuffle Read�����л�����ܶ��ȡ����С�ļ��Ķ��� -

��

JVM���ڴ���������������Ƶ����gc,gc���������������Ҫ���ڴ�Ļ�,�ͻ�OOM�� -

�����ݴ�������л���Ƶ��������ͨ��,Ƶ��������ͨ�ų���ͨ�Ź��ϵĿ����Դ������,һ������ͨ�ų����˹��ϻᵼ��

shuffle file cannot find������������µ�taskʧ��,TaskScheduler����������,��DAGScheduler��������Stage��

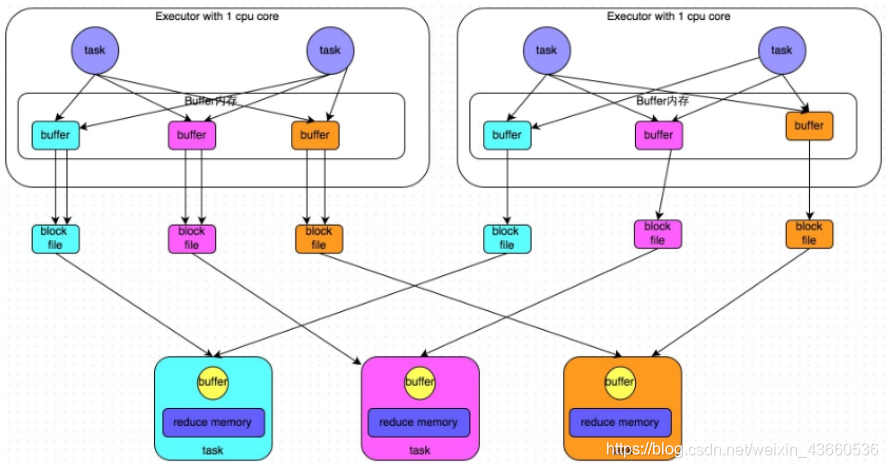

8.2.2. �ϲ�����

ִ������:

- �ϲ����ƾ��Ǹ���buffer,�����ϲ����Ƶ�������spark.shuffle.consolidateFiles���ò���Ĭ��ֵΪfalse,��������Ϊtrue���ɿ����Ż����ơ�

- ��shuffle write������,task�Ͳ���Ϊ����stage��ÿ��task����һ�������ļ��ˡ���ʱ�����shuffleFileGroup�ĸ���,ÿ��shuffleFileGroup���Ӧһ�������ļ�,�����ļ�������������stage��task��������ͬ����һ��Executor���ж��ٸ�CPU core,�Ϳ��Բ���ִ�ж��ٸ�task������һ������ִ�е�ÿ��task���ᴴ��һ��shuffleFileGroup,��������д���Ӧ�Ĵ����ļ��ڡ�

�ܽ�

- ��������С�ļ��ĸ���:

C(core�ĸ���)*R(reduce�ĸ���)��

8.3. SortShuffle

8.3.1. ��ͨ����

ִ������

-

map task�ļ�������д�뵽һ���ڴ����ݽṹ����,�ڴ����ݽṹĬ����5M�� -

��

shuffle��ʱ�����һ����ʱ��,�����ڵ�ȥ��������ڴ�ṹ�Ĵ�С,���ڴ�ṹ�е����ݳ���5Mʱ,���������ڴ�ṹ�е�����Ϊ5.01M,��ô��������5.01*2-5=5.02M�ڴ���ڴ����ݽṹ�� -

�������ɹ����������д,������벻�ɹ�,��ʱ��ᷢ����д������

-

����д֮ǰ�ڴ�ṹ�е����ݻ�����������

-

Ȼ��ʼ��д����,д��������

batch����ʽȥд(����),һ��batch��1���������� -

map taskִ����ɺ�,�Ὣ��Щ����С�ļ��ϲ���һ����Ĵ����ļ�,ͬʱ����һ�������ļ��� -

reduce taskȥmap����ȡ���ݵ�ʱ��,���Ƚ��������ļ�,���������ļ���ȥ��ȡ��Ӧ�����ݡ�

�ܽ�

- ��������С�ļ��ĸ���:

2*M(map task�ĸ���)

8.3.2. bypass����

bypass����ʾ��ͼ

�ܽ�

-

bypass���л��ƵĴ�����������:shuffle reduce task������С��spark.shuffle.sort.bypassMergeThreshold�IJ���ֵ�����ֵĬ����200��

-

����Ҫ����

map�˵�Ԥ�ۺ�,����groupBykey,join�� -

�����Ĵ���С�ļ�Ϊ:

2*M(map task�ĸ���)��

8.4. Shuffle�ļ�Ѱַ

-

MapOutputTrackerMapOutputTracker��Spark�ܹ��е�һ��ģ��,��һ�����Ӽܹ�����������С�ļ��ĵ�ַ��MapOutputTrackerMaster��������,������Driver����MapOutputTrackerWorker�ǴӶ���,������Excutor����

-

BlockManager-

BlockManager:�������,��Spark�ܹ��е�һ��ģ��,Ҳ��һ�����Ӽܹ��� -

BlockManagerMaster,������,������Driver���� -

BlockManagerWorker,�Ӷ���,������Excutor����BlockManagerMaster���ڼ�Ⱥ�����õ��㲥�����ͻ������ݻ���ɾ���������ݵ�ʱ��,֪ͨBlockManagerSlave�������ɾ������BlockManagerWorker,�Ӷ���,������Excutor�С�BlockManagerWorker����BlockManagerWorker֮��ͨ�š�

-

������

Driver�˵�BlockManager������Excutor�˵�BlockManager�������ĸ�����:DiskStore:������̵Ĺ�����MemoryStore:�����ڴ�Ĺ�����ConnectionManager:��������������BlockManagerWorker��BlockTransferService:�������ݵĴ��䡣

-

Shuffle�ļ�Ѱַͼ

-

Shuffle�ļ�Ѱַ���� -

��

map taskִ����ɺ�,�Ὣtask��ִ������ʹ���С�ļ��ĵ�ַ��װ��MapStatus������,ͨ��MapOutputTrackerWorker������Driver�е�MapOutputTrackerMaster�㱨�� -

�����е�

map taskִ����Ϻ�,Driver�о����������еĴ���С�ļ��ĵ�ַ�� -

��

reduce taskִ��֮ǰ,��ͨ��Excutor��MapOutPutTrackerWorker��Driver�˵�MapOutputTrackerMaster��ȡ����С�ļ��ĵ�ַ�� -

��ȡ������С�ļ��ĵ�ַ��,��ͨ��

BlockManager�е�ConnectionManager�����������ڽڵ��ϵ�ConnectionManager,Ȼ��ͨ��BlockTransferService�������ݵĴ��䡣 -

BlockTransferServiceĬ������5��taskȥ�ڵ���ȡ���ݡ�Ĭ�������,5��task��ȡ���������ܳ���48M��

8.5. Shuffle����

- �ڴ�����,���Ƽ�ʹ��,Ӳ���롣

new SparkConf().set("spark.shuffle.file.buffer","64")

- ���ύspark�����ʱ��,�Ƽ�ʹ�á�

spark-submit --conf spark.shuffle.file.buffer=64 �C-conf ��.

- ��

conf�µ�spark-default.conf�����ļ���,���Ƽ�,��Ϊ��д��������Ӧ�ó���Ҫ�á�

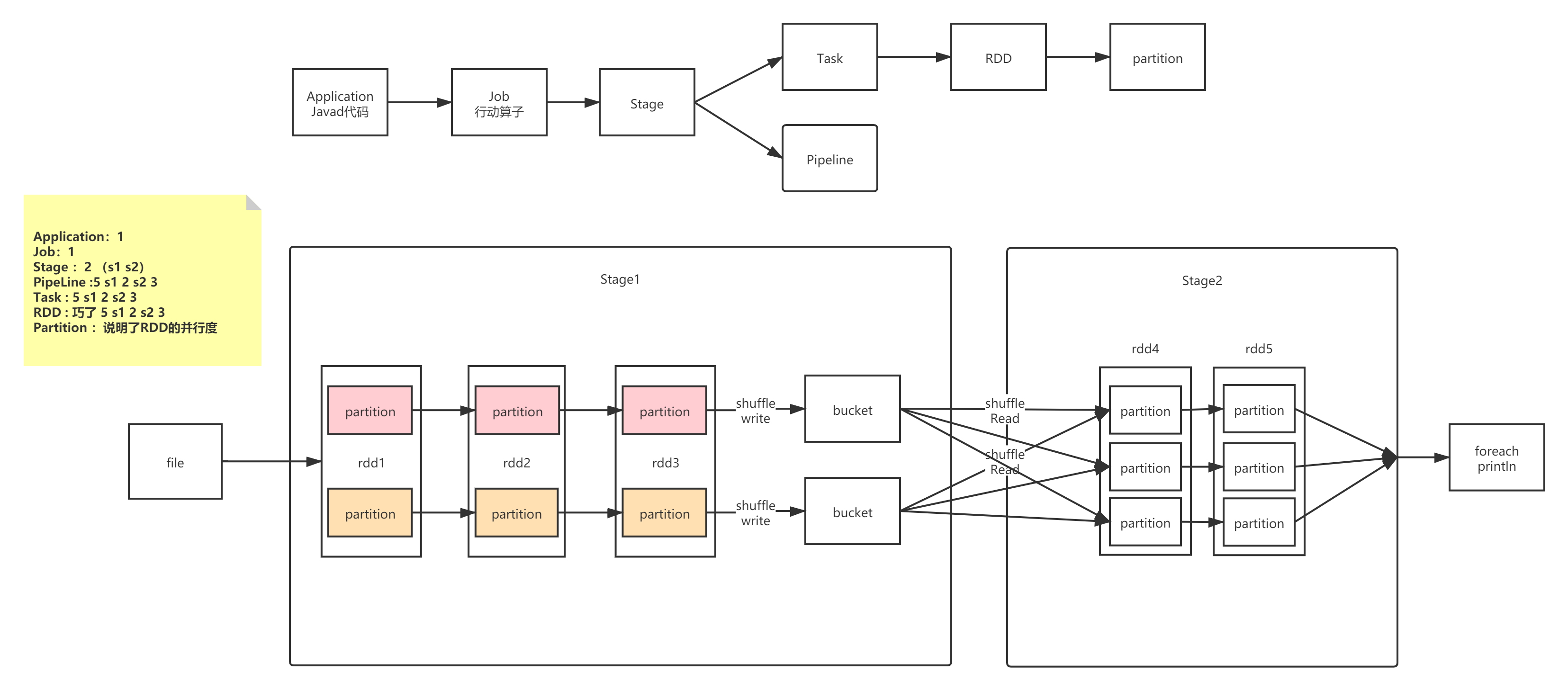

9��Spark RDD��

9.1. Spark application������

Application:����Spark���û�����,����driver����������ڼ�Ⱥ�ϵ�executor����,��һ��������sparkӦ�� ��- һ��application�������Job(��ҵ)��

Job:�������Stage(��),��action����һ һ��Ӧ��Stage:һ��job�ᱻ��ֳɺܶ�������Stage(����MapReduce��ΪMapTask��ReduceTaskһ��)��- Task:һ�������͵�executor�ϵĹ�����Ԫ��һ��stage�ɶ��Task���(��partition����)��

- pipline:һ��Pipeline��Ӧһ��Task��һ��stage�ɶ��pipeline���(��task����)��

Task:�����͵�**executor�ϵĹ�����Ԫ**��- RDD:һ��RDD�����˶��Partition

- partition:���Partition�Dz��в�����(���ж�)

9.2. Spark ���� ��������

10��Spark��Դ���Ⱥ��������

10.1. ��������

-

������Ⱥ��,

Worker�ڵ����Master�ڵ�㱨��Դ���,Master�����˼�Ⱥ��Դ����� -

��

Spark�ύһ��Application��,����RDD֮���������ϵ��Application�γ�һ��DAG������ͼ�� -

�����ύ��,

Spark����Driver�˴�����������:DAGScheduler��TaskScheduler,DAGScheduler������������߲�������,��һ������ -

DAGScheduler����Ҫ����������DAG����RDD֮��Ŀ�խ������ϵ����Ϊһ������Stage,Ȼ����ЩStage��TaskSet����ʽ�ύ��TaskScheduler(TaskScheduler��������ȵ��Ͳ�������,����TaskSet��ʵ����һ������,�����װ�ľ���һ������task����,Ҳ����stage�еIJ��е�task����)�� -

TaskSchedule�����TaskSet����,�õ�ÿ��task��Ὣtask���͵�Executor��ȥִ��(��ʵ���Ƿ��͵�Executor�е��̳߳�ThreadPoolȥִ��)�� -

task��Executor�̳߳��е������������TaskScheduler����,��taskִ��ʧ��ʱ,����TaskScheduler��������,��task���·�����Executorȥִ��,Ĭ������3�Ρ��������3����Ȼʧ��,��ô���task���ڵ�stage��ʧ���ˡ� -

stageʧ��������DAGScheduler����������,���·���TaskSet��TaskScheduler,StageĬ������4�Ρ��������4���Ժ���Ȼʧ��,��ô���job��ʧ���ˡ�jobʧ����,Application��ʧ���ˡ� -

TaskScheduler����������ʧ�ܵ�task,��������straggling(���,����)task(Ҳ����ִ���ٶȱ�����task��̫���task)����������л�����task��ôTaskScheduler������һ���µ�task����������л�����taskִ����ͬ�Ĵ�����������task�ĸ���ִ����,�����ĸ�task��ִ�н��Ϊ�������Spark���Ʋ�ִ�л�������Spark���Ʋ�ִ��Ĭ���ǹر��ġ��Ʋ�ִ�п���ͨ��spark.speculation���������á� -

ע��:

-

-

����

ETL����Ҫ�����ݿ���ҵ��Ҫ�ر��Ʋ�ִ�л���,�����Ͳ������ظ������������ -

�������������б�����,�����Ʋ�ִ�����п��ܵ���һֱ����

task��������������ͬ����,�������һֱ���ڴ��������״̬��

-

10.2. ����ͼ��

10.3. ��ϸ������Դ����

10.3.1. ��������Դ����(Spark)

-

��

Applicationִ��֮ǰ,�����е���Դ�������,����Դ����ɹ���,�Ż��������ĵ���,�����е�taskִ����ɺ�,�Ż��ͷ��ⲿ����Դ�� -

�ŵ�:��

Applicationִ��֮ǰ,���е���Դ���������,ÿһ��taskֱ��ʹ����Դ�Ϳ�����,����Ҫtask��ִ��ǰ�Լ�ȥ������Դ,task�����Ϳ���,taskִ�п���,stageִ�оͿ���,job�Ϳ���,applicationִ�оͿ����� -

ȱ��:ֱ�����һ��

taskִ����ɲŻ��ͷ���Դ,��Ⱥ����Դ�����������

10.3.2. ϸ������Դ����(MR)

Applicationִ��֮ǰ����Ҫ��ȥ������Դ,����ֱ��ִ��,��**job�е�ÿһ��task��ִ��ǰ�Լ�ȥ������Դ,taskִ����ɾ��ͷ���Դ**��- �ŵ�:��Ⱥ����Դ���Գ��������

- ȱ��:

task�Լ�ȥ������Դ,task��������,Application�����о���Ӧ�ı�������

11���������

- spark����

spark����.https://blog.csdn.net/weixin_43660536/article/details/119610731

12���㲥�������ۼ���

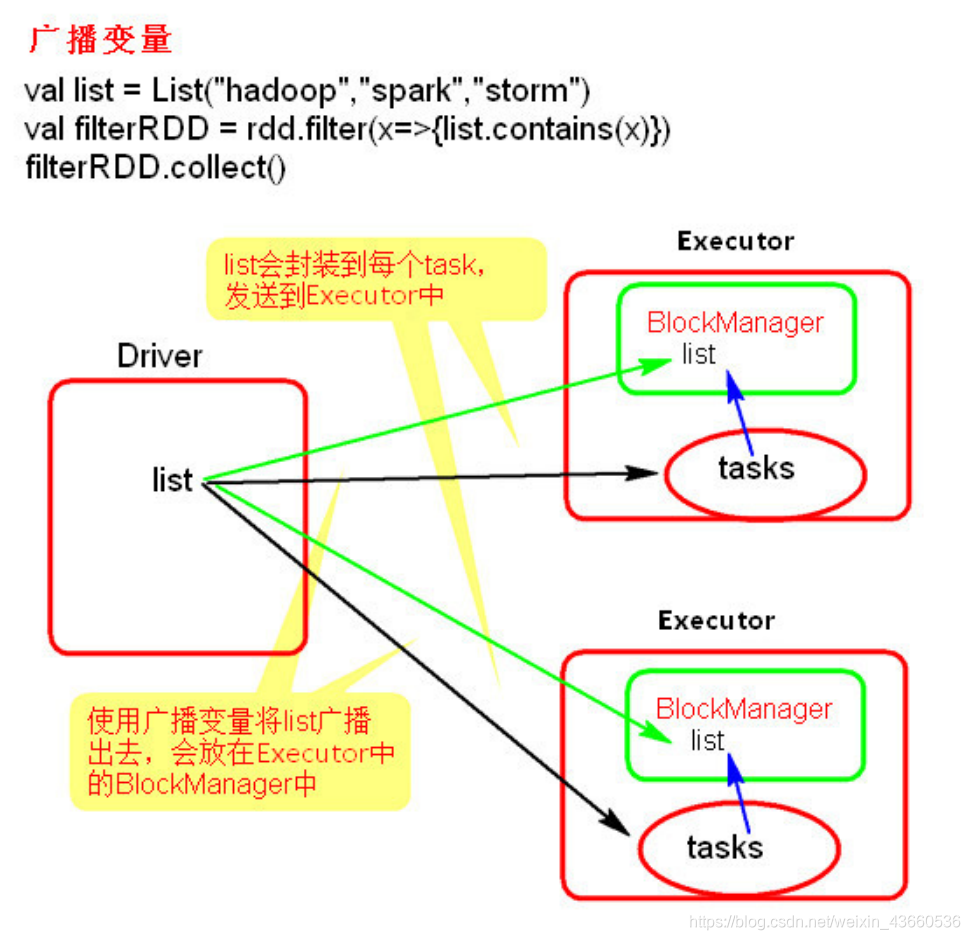

12.1. �㲥����

-

sparkScontext.broadcast()������������㲥���� -

�㲥����ֻ����

Driver�˶�������,������Executor�˶������ġ� -

�Ὣ�㲥������װ���͵�Executor��BlockManage�С�

-

ͬ��Executor��Task����BlockManage�����ݡ�

val conf = new SparkConf()

conf.setMaster("local").setAppName("brocast")

val sc = new SparkContext(conf)

val list = List("hello yjx")

val broadCast = sc.broadcast(list)

val lineRDD = sc.textFile("./words.txt")

lineRDD.filter { x => broadCast.value.contains(x) }.foreach {println}

sc.stop()

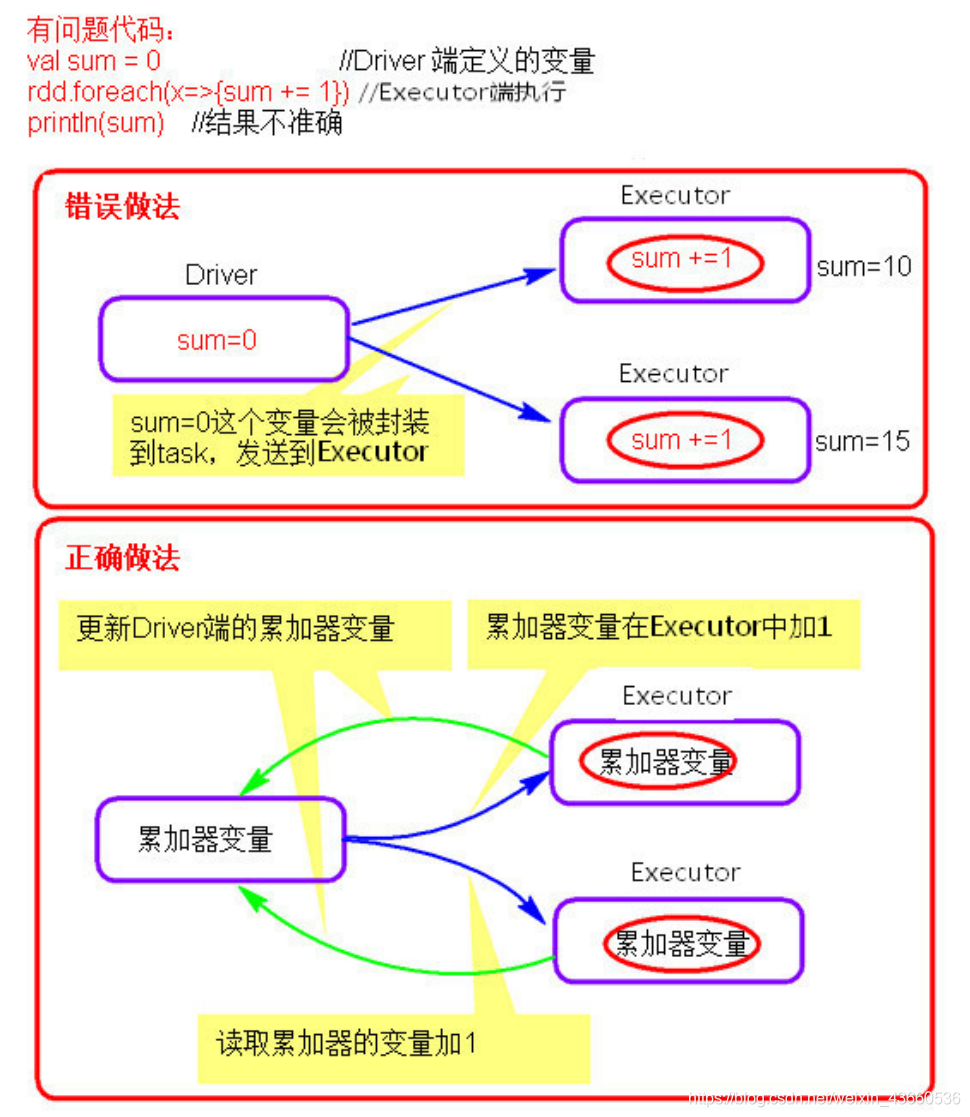

12.2. �ۼ���

val accumulator = sparkContext.longAccumulator�����ۼ���- �ۼ�����

Driver�˶��帳��ʼֵ,�ۼ���ֻ����Driver�˶�ȡ,��Excutor�˸��¡�

val conf = new SparkConf()

conf.setMaster("local").setAppName("accumulator")

val sc = new SparkContext(conf)

val accumulator = sc.longAccumulator

sc.textFile("./words.txt").foreach { x =>{accumulator.add(1)}}

println(accumulator.value)

sc.stop()

13��spark����Դ�����

- spark����Դ�����

spark����Դ�����.https://blog.csdn.net/weixin_43660536/article/details/119610936

14��Spark�ڴ����

Sparkִ��Ӧ�ó���ʱ,Spark��Ⱥ������Driver��Executor����JVM����,Driver����SparkContext������,�ύ����,task�ķַ�����Executor����task�ļ�������,����������ظ�Driver��ͬʱ��ҪΪ��Ҫ�־û���RDD�ṩ���档Driver�˵��ڴ�����Ƚϼ�,������˵��Spark�ڴ�������Executor�˵��ڴ������

Spark�ڴ������Ϊ��̬�ڴ������ͳһ�ڴ����,Spark1.6֮ǰ(������)ʹ�õ�����̬�ڴ����,Spark1.6֮��������ͳһ�ڴ������

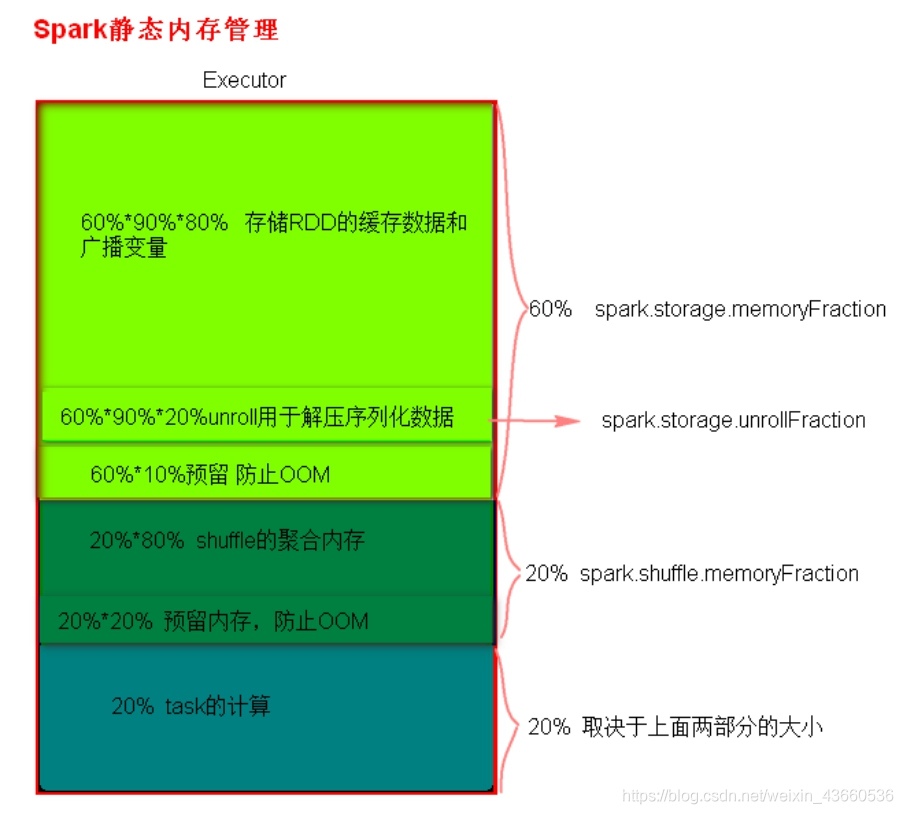

��̬�ڴ�����д洢�ڴ桢ִ���ڴ�������ڴ�Ĵ�С�� Spark Ӧ�ó��������ڼ��Ϊ�̶���,���û�����Ӧ�ó�������ǰ�������á�

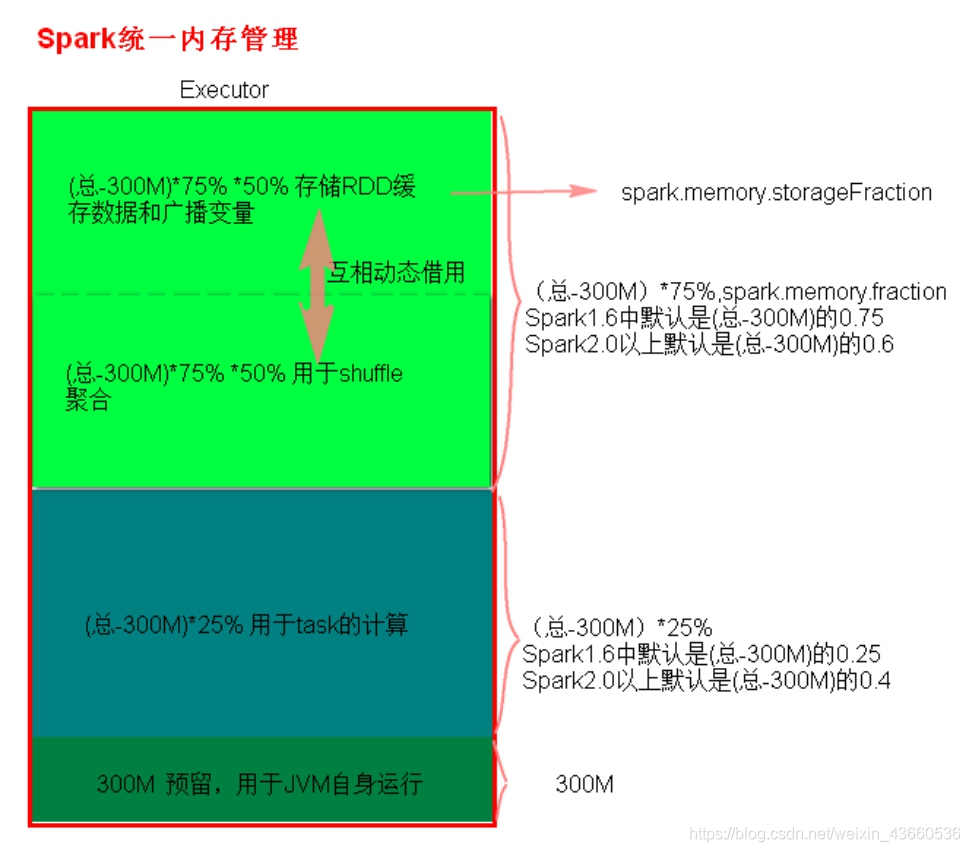

ͳһ�ڴ�����뾲̬�ڴ�������������������ڴ���ִ���ڴ�����ͬһ��ռ�,���Ի�����öԷ��Ŀռ䡣

Spark1.6��1.6�汾֮��İ汾Ĭ��ʹ�õ���ͳһ�ڴ������

Ҫ��ʹ�þ�̬�ڴ����ͨ������spark.memory.useLegacyMode

? ����Ϊtrue(Ĭ��Ϊfalse)ʹ�þ�̬�ڴ������

��̬�ڴ�����ֲ�ͼ

ͳһ�ڴ�����ֲ�ͼ

reduce ��OOM����?

-

����ÿ����ȡ����������

-

���

shuffle�ۺϵ��ڴ������ -

���

Excutor�����ڴ档