ElasticSearch

ElasticSearch�ĵ���ֵ_score����ײ�ԭ��

�����û���query����,�ȹ��˳�����ָ��term��doc

query "hello world" �\�\> hello / world / hello & world

bool �\�\> must/must not/should �\�\> ���� �\�\> ���� / ������ / ���ܰ���

doc �\�\> ������� �\�\> ���� true or false �\�\> Ϊ�˼��ٺ���Ҫ�����doc������,��������

- relevance score�㷨,����˵,���Ǽ����,һ�������е��ı�,�������ı�,����֮��Ĺ���ƥ��̶�

- Elasticsearchʹ�õ��� term frequency/inverse document frequency�㷨,���Ϊ

TF/IDF�㷨 - Term frequency:�����ı��еĸ���������field�ı��г����˶��ٴ�,���ִ���Խ��,��Խ��ء�

��������:hello world

doc1:hello you, and world is very good

doc2:hello, how are you

Inverse document frequency:�����ı��еĸ������������������������ĵ��г����˶��ٴ�,���ֵĴ���Խ��,��Խ����ء�

��������:hello world

doc1:hello, tuling is very good

doc2:hi world, how are you

����˵,��index����1����document,hello������������е�document��,һ��������1000��;world������������е�document��,һ��������100��

Field-length norm:field����,fieldԽ��,��ض�Խ��;

��������:hello world

doc1:{ "title": "hello article", "content": "...... N������" }

doc2:{ "title": "my article", "content": "...... N������,hi world" }

hello world������index�г��ֵĴ�����һ�����

doc1�����,title field����

�ռ�����ģ��

- ���term��һ��doc���ܷ���;

hello world --> es�����hello world������doc�е��������,�����һ��query vector,query����;

hello���term,���Ļ�������doc��һ�����־���2;

world���term,���Ļ�������doc��һ�����־���5;�ۺϾ���[2, 5]; - �ĵ�����:doc vector,3��doc,һ������1��term,һ��������һ��term,һ������2��term;

3��doc

doc1:����hello --> [2, 0];

doc2:����world --> [0, 5];

doc3:����hello, world --> [2, 5];

- ���ÿһ��doc,��ÿ��term�����һ��������,hello��һ������,world��һ������,��������term�ķ������һ��doc vector

- ����һ��ͼ��,ȡÿ��doc vector��query vector�Ļ���,����ÿ��doc�Զ��term���ܷ���

- ÿ��doc vector�������query vector�Ļ���,������������ȸ���һ��doc�����query�ж��term���ܷ���,����Խ��,�����µ�; ����ԽС,����Խ��

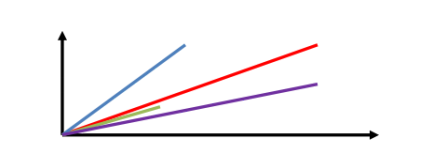

����Ƕ��term,��ô�������Դ���������,����ͼ��ʾ

es��Ⱥ����������ר�Ŷ��Ƶ���Ҫ����

- ��ν��������,����ͬһ����Ⱥ�еIJ�ͬ�ڵ�,���ڼ�Ⱥ��״̬���˲�һ��������,

���缯Ⱥ�д�������master�� - �����Ϊ����Ĺ���,����һ����Ⱥ�����ֳ�����Ƭ,ÿƬ���ж��node,�Լ�һ��master,��ô��Ⱥ�оͳ���������master�ˡ�

- ������Ϊmaster�Ǽ�Ⱥ�зdz���Ҫ��һ����ɫ,�����˼�Ⱥ״̬��ά��,�Լ�shard�ķ���,������������master,���ܻᵼ���ƻ����ݡ�

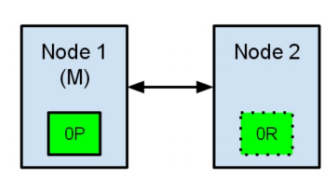

�ڵ�1������ʱ��ѡ��Ϊ���ڵ㲢��������Ƭ���Ϊ0P,���ڵ�2���渴�Ʒ�Ƭ���Ϊ

0R������,����������ڵ�֮���ͨѶ�ж���,�������������ֻ����Ϊ����һ���ڵ�����Ӧ,�����п��ܷ����ġ�

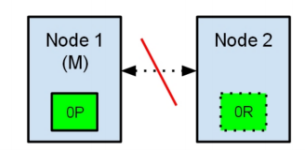

�����ڵ㶼���ŶԷ��Ѿ����ˡ��ڵ�1����Ҫ��ʲô,��Ϊ�������ͱ�ѡ��Ϊ���ڵ㡣���ǽڵ�2���Զ�ѡ�����Լ�Ϊ���ڵ�,��Ϊ�����ż�Ⱥ��һ����û�����ڵ��ˡ�

��elasticsearch��Ⱥ,�������ڵ�����������Ƭƽ���ķֲ����ڵ��ϵġ��ڵ�2������Ǹ��Ʒ�Ƭ,�����������ڵ㲻�����ˡ����������Զ��������ƽڵ�Ϊ���ڵ�

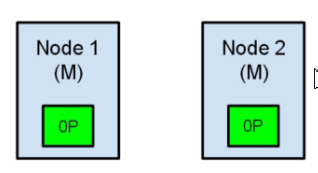

�������ǵļ�Ⱥ��һ����һ�µ�״̬�ˡ����ڽڵ�1�ϵ���������Ὣ�������ݷ��������ڵ�,ͬʱ���ڽڵ�2������Ὣ�������ݷ��ڷ�Ƭ�ϡ������������,��Ƭ���������ݷֿ���,�������һ��ȫ�������������Ѷ����ǽ���������

�ڸ����������,һ���Լ�Ⱥ��֪�������ͻ���(����,ʹ��REST�ӿڵ�),�������dz������Է���,�����ĸ��ڵ㱻��������������Ȼ��ÿ�ζ���ɹ���ɡ�����ֻ������������ʱ�Żᱻ��Լ����:ȡ�������������������ĸ��ڵ�,������ͬ��

����������

-

���Ǹ���esֱ�����㹻��master��ѡ�ڵ�ʱ,�ſ���ѡ�ٳ�һ��master,����Ͳ�Ҫѡ�ٳ�һ��master������������뱻����Ϊ��Ⱥ��master��ѡ�ڵ��quorum����,Ҳ���Ǵ����������quorum���㷨,����:master��ѡ�ڵ����� / 2 + 1��

-

����������10���ڵ�,����ά������,Ҳ������master��ѡ�ڵ�,��ôquorum����10/ 2+ 1 = 6���������������master��ѡ�ڵ�,����100�����ݽڵ�,��ôquorum����3 / 2 + 1 = 2

-

���������2���ڵ�,��������master��ѡ�ڵ�,��ôquorum��2 / 2 + 1 = 2����ʱ����������,��Ϊ���һ��node�ҵ���,��ôʣ��һ��master��ѡ�ڵ�,��������quorum������,Ҳ����ѡ�ٳ��µ�master,��Ⱥ�ͳ��ҵ��ˡ���ʱ��ֻ�ܽ������������Ϊ1,�����������ֹ���ѵķ����ˡ�

-

2���ڵ�,discovery.zen.minimum_master_nodes�ֱ����ó�2��1����ô��?

���Ϊ2,2̨��������ΪijЩԭ�����ͨѶ�ն�,��ô�ͻᷢ��Ⱥѡ��,��ΪֵΪ1,ÿ̨������ֻ�ܸ��Լ�ͶһƱ,������̨���������������ڵ㡣

���Ϊ1,2̨��������ΪijЩԭ�����ͨѶ�ն�,��ô�ͻᷢ��Ⱥѡ��,��ΪֵΪ1,ÿ̨������ֻ�ܸ��Լ�ͶһƱ,������̨�������������ڵ㡣 -

��������,һ������������es��Ⱥ,����Ҫ��3���ڵ�,ͬʱ�������������Ϊquorum,Ҳ����2��discovery.zen.minimum_master_nodes����Ϊ2,��α���������?

��ô����Dz�������α�����������IJ�������?����������3���ڵ�,quorum��2.�����������,1���ڵ���һ����������,����2���ڵ�������һ����������,��ͬ��������������ͨ�š����ʱ��������������:

(1)���master�ǵ������Ǹ��ڵ�,����2���ڵ���master��ѡ�ڵ�,��ô��ʱ�Ǹ�������master�ڵ���Ϊû��ָ�������ĺ�ѡmaster node���Լ���ǰ���ڵļ�Ⱥ��,��˾ͻ�ȡ����ǰmaster�Ľ�ɫ,��������ѡ��,������ѡ�ٳɹ���Ȼ������һ�����������ڵ�node��Ϊ�����ӵ�master,�ͻᷢ������ѡ��,��Ϊ������master��ѡ�ڵ�,������quorum,��˿��Գɹ�ѡ�ٳ�һ��master����ʱ��Ⱥ�оͻỹ��ֻ��һ��master��

(2)���master������һ��node��һ������������,Ȼ��һ��node������һ�����������ڡ���ô��ʱ�Ǹ�������node��Ϊ���Ӳ���master,�᳢�Է���ѡ��,������Ϊmaster��ѡ�ڵ���������quorum,�����ѡ�ٳ�master��������һ������������,ԭ�ȵ��Ǹ�master���������������Ҳ���Ա�֤��Ⱥ��ֻ��һ��master�ڵ㡣

��������,��Ⱥ��master�ڵ����������3̨,��̨���ڵ�ͨ����elasticsearch.yml������discovery.zen.minimum_master_nodes: 2,�Ϳ��Ա�����������IJ�����

���ݽ�ģ

����:���һ���û�document��������,���а���һ����ַ���ݵ�����,������Ʒ�ʽ

��Ը���,�����ڹ�������ʱ,���ӵ���

PUT /user_index

{

"mappings": {

"properties": {

"login_name": {

"type": "keyword"

},

"age ": {

"type": "short"

},

"address": {

"properties": {

"province": {

"type": "keyword"

},

"city": {

"type": "keyword"

},

"street": {

"type": "keyword"

}

}

}

}

}

}

�������������ݽ�ģ�������Ե�ȱ��,������Ե�ַ����������������ʱ��,����������������Ҫ������,��:���������ݻ�����,����һ��provinceΪ����,cityΪ�����û���

PUT /user_index/_doc/1

{

"login_name": "jack",

"age": 25,

"address": [

{

"province": "����",

"city": "����",

"street": "������·"

},

{

"province": "���",

"city": "���",

"street": "����·"

}

]

}

//1�û��ϼ�ס����ʡ����������·;������ַס�����,����Ҳ�����

PUT /user_index/_doc/2

{

"login_name": "rose",

"age": 21,

"address": [

{

"province": "�ӱ�",

"city": "�ȷ�",

"street": "�ོ���ÿ�����"

},

{

"province": "���",

"city": "���",

"street": "����·"

}

]

}

//1�û��ϼ�ס�ӱ�ʡ�ȷ��ོ���ÿ�����;������ַס�����,����Ҳ�����

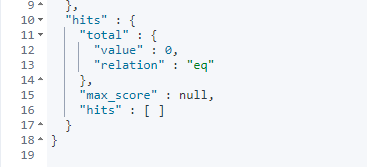

ִ�е�����Ӧ������:

GET /user_index/_search

{

"query": {

"bool": {

"must": [

{

"match": {

"address.province": "����"

}

},

{

"match": {

"address.city": "���"

}

}

]

}

}

}

//������Ҫ���ϼ�ס������,����ס�����û�

��ѯ������ʵ�鷳;

nested object

ʹ��nested object��Ϊ��ַ����ļ�������,���Խ����������,documentģ������:

PUT /user_index

{

"mappings": {

"properties": {

"login_name": {

"type": "keyword"

},

"age": {

"type": "short"

},

"address": {

"type": "nested",

"properties": {

"province": {

"type": "keyword"

},

"city": {

"type": "keyword"

},

"street": {

"type": "keyword"

}

}

}

}

}

}

���ʱ�����Ҫʹ��nested��Ӧ���������ִ��������,�����:

GET /user_index/_search

{

"query": {

"bool": {

"must": [

{

"nested": {

"path": "address",

"query": {

"bool": {

"must": [

{

"match": {

"address.province": "����"

}

},

{

"match": {

"address.city": "���"

}

}

]

}

}

}

}

]

}

}

}

��ԭ����:

��ͨ������������ES�лᱻ��ƽ������,������ʽ����:(����ֶ���Ҫ�ִ�,�Ὣ�ִ����ݱ����ڶ�Ӧ���ֶ�λ��,��ȻӦ����һ����������,����ֻ��һ��ֱ�۵İ���)

{

"login_name" : "jack",

"address.province" : [ "����", "���" ],

"address.city" : [ "����", "���" ]

"address.street" : [ "�����춫·", "���Ļ���" ]

}

��ônested object��������ES�ڱ����ʱ���б�ƽ������,���淽ʽ����:������������ʱ��һ��������Ҫ�����������

{

"login_name" : "jack"

}

{

"address.province" : "����",

"address.city" : "����",

"address.street" : "�����춫·"

}

{

"address.province" : "����",

"address.city" : "����",

"address.street" : "�����춫·",

}

���ӹ�ϵ���ݽ�ģ

-

nested object�Ľ�ģ,�и����õĵط�,���Dz�ȡ���������������ݵķ�ʽ,��������ݶ�����һ����,ά���ɱ��ͱȽϸߡ�ÿ�θ���,��Ҫ����������������(�����������Ƕ����)

-

ES �ṩ�����ƹ�ϵ�����ݿ��� Join ��ʵ�֡�ʹ�� Join ��������ʵ��,����ͨ��

Parent / Child �Ĺ�ϵ,�Ӷ������������� -

���ĵ������ĵ��������������ĵ�,���¸��ĵ��������������������ĵ������ĵ�������,���ĺ�ɾ��Ҳ����Ӱ�쵽���ĵ����������ĵ�

-

Ҫ��:���ӹ�ϵԪ����ӳ��,����ȷ����ѯʱ��ĸ�����,������һ������,���Ǹ������ݱ��������һ��shard�и��ӹ�ϵ���ݴ���һ��shard��,���һ���ӳ���������ϵ��Ԫ����,��ô�������ӹ�ϵ���ݵ�ʱ��,���ÿ��Ƭ,һ����Ƭ�����Լ��㶨��,���ܵ�Ȼ��

���ӹ�ϵ���常�ӹ�ϵ�ļ�������

- ���������� Mapping

- �������ĵ�

- �������ĵ�

- �����ѯ�ĵ�

���� Mapping

PUT my_blogs

{

"mappings": {

"properties": {

"blog_comments_relation": {

"type": "join",

"relations": {

"blog": "comment"

}

},

"content": {

"type": "text"

},

"title": {

"type": "keyword"

}

}

}

}

�������ĵ�

PUT my_blogs/_doc/blog1

{

"title": "Learning Elasticsearch",

"content": "learning ELK is happy",

"blog_comments_relation": {

"name": "blog"

}

}

PUT my_blogs/_doc/blog2

{

"title": "Learning Hadoop",

"content": "learning Hadoop",

"blog_comments_relation": {

"name": "blog"

}

}

�������ĵ�

���ĵ������ĵ��������ͬ����Ƭ��,ȷ��Join������;

��ָ���ĵ���ʱ��,����ָ�����ĵ�ID,ʹ��route������֤������ͬ����Ƭ��;

PUT my_blogs/_doc/comment1?routing=blog1

{

"comment":"I am learning ELK",

"username":"Jack",

"blog_comments_relation":{

"name":"comment",

"parent":"blog1"

}

}

PUT my_blogs/_doc/comment2?routing=blog2

{

"comment":"I like Hadoop!!!!!",

"username":"Jack",

"blog_comments_relation":{

"name":"comment",

"parent":"blog2"

}

}

PUT my_blogs/_doc/comment3?routing=blog2

{

"comment":"Hello Hadoop",

"username":"Bob",

"blog_comments_relation":{

"name":"comment",

"parent":"blog2"

}

}

Parent / Child ��֧�ֵIJ�ѯ

- ��ѯ�����ĵ�

- Parent Id ��ѯ

- Has Child ��ѯ

- Has Parent ��ѯ

//��ѯ�����ĵ�

POST my_blogs/_search

{}

//���ݸ��ĵ�ID�鿴

GET my_blogs/_doc/blog2

//���ݸ�ID�����ĵ�

POST my_blogs/_search

{

"query": {

"parent_id": {

"type": "comment",

"id": "blog2"

}

}

}

//��ѯ���ĵ����û� ��Ϊjack�ĸ��ĵ�;

POST my_blogs/_search

{

"query": {

"has_child": {

"type": "comment",

"query" : {

"match": {

"username" : "Jack"

}

}

}

}

}

//��ѯ���ı�����Learning Hadoop�йصĸ��ĵ������ĵ�;

POST my_blogs/_search

{

"query": {

"has_parent": {

"parent_type": "blog",

"query" : {

"match": {

"title" : "Learning Hadoop"

}

}

}

}

}

ʹ�� has_child ��ѯ

- ���ظ��ĵ�

- ͨ�������ĵ����в�ѯ

- ���ؾ���������ĵ��ĸ��ĵ�

- �����ĵ�����ͬ�ķ�Ƭ��,��� Join Ч�ʸ�

ʹ�� has_parent ��ѯ

- ��������Ե����ĵ�

- ͨ���Ը��ĵ����в�ѯ,������ص����ĵ�

ʹ�� parent_id ��ѯ

- ��������������ĵ�

- ͨ���Ը��ĵ� Id ���в�ѯ,����������ص����ĵ�

�������ĵ�

��ָ�����ĵ� routing ����

GET my_blogs/_doc/comment3?routing=blog2

�������ĵ�

�������ĵ�����Ӱ�쵽���ĵ�

PUT my_blogs/_doc/comment3?routing=blog2

{

"comment": "Hello Hadoop??",

"blog_comments_relation": {

"name": "comment",

"parent": "blog2"

}

}

Ƕ���� v.s �����ĵ�

Nested Object Parent / Child

�ŵ�:�ĵ��洢��һ��,��ȡ���ܸߡ������ĵ����Զ�������

ȱ��:����Ƕ�����ĵ�ʱ,��Ҫ���������ĵ�����Ҫ������ڴ�ȥά����ϵ����ȡ������Բ�;���ó������ĵ�ż������,�Բ�ѯΪ�������ĵ�����Ƶ��;

�ļ�ϵͳ���ݽ�ģ

github�п���ʹ�ô���Ƭ����ʵ������������

��github��Ҳʹ����ES��ʵ�����ݵ�ȫ����������ES����һ����¼�������ݵ�����,����������������:

{

"fileName" : "HelloWorld.java",

"authName" : "baiqi",

"authID" : 110,

"productName" : "first�\java",

"path" : "/com/baiqi/first",

"content" : "package com.baiqi.first; public class HelloWorld { //code... }"

}

���ǿ�����github��ͨ�������Ƭ����ʵ�����ݵ�������Ҳ����ʹ����������ʵ����������������,�����Ҫʹ���ļ�·����������Ӧ�����ʵ��?���ʱ����ҪΪ���е��ֶ�path����һ������ķִ�������������:

PUT /codes

{

"settings": {

"analysis": {

"analyzer": {

"path_analyzer": {

"tokenizer": "path_hierarchy"

}

}

}

},

"mappings": {

"properties": {

"fileName": {

"type": "keyword"

},

"authName": {

"type": "text",

"analyzer": "standard",

"fields": {

"keyword": {

"type": "keyword"

}

}

},

"authID": {

"type": "long"

},

"productName": {

"type": "text",

"analyzer": "standard",

"fields": {

"keyword": {

"type": "keyword"

}

}

},

"path": {

"type": "text",

"analyzer": "path_analyzer",

"fields": {

"keyword": {

"type": "keyword"

}

}

},

"content": {

"type": "text",

"analyzer": "standard"

}

}

}

}

PUT /codes/_doc/1

{

"fileName": "HelloWorld.java",

"authName": "baiqi",

"authID": 110,

"productName": "first�\java",

"path": "/com/baiqi/first",

"content": "package com.baiqi.first; public class HelloWorld { // some code... }"

}

GET /codes/_search

{

"query": {

"match": {

"path": "/com"

}

}

}

GET /codes/_analyze

{

"text": "/a/b/c/d",

"field": "path"

}

���:

{

"tokens" : [

{

"token" : "/a",

"start_offset" : 0,

"end_offset" : 2,

"type" : "word",

"position" : 0

},

{

"token" : "/a/b",

"start_offset" : 0,

"end_offset" : 4,

"type" : "word",

"position" : 0

},

{

"token" : "/a/b/c",

"start_offset" : 0,

"end_offset" : 6,

"type" : "word",

"position" : 0

},

{

"token" : "/a/b/c/d",

"start_offset" : 0,

"end_offset" : 8,

"type" : "word",

"position" : 0

}

]

}

������/b/c�Dz��Ҳ���,û�ж�Ӧ����������;

�����Ҫʵ����������,��

PUT /codes

{

"settings": {

"analysis": {

"analyzer": {

"path_analyzer": {

"tokenizer": "path_hierarchy"

}

}

}

},

"mappings": {

"properties": {

"fileName": {

"type": "keyword"

},

"authName": {

"type": "text",

"analyzer": "standard",

"fields": {

"keyword": {

"type": "keyword"

}

}

},

"authID": {

"type": "long"

},

"productName": {

"type": "text",

"analyzer": "standard",

"fields": {

"keyword": {

"type": "keyword"

}

}

},

"path": {

"type": "text",

"analyzer": "path_analyzer",

"fields": {

"keyword": {

"type": "text",

"analyzer": "standard"

}

}

},

"content": {

"type": "text",

"analyzer": "standard"

}

}

}

}

GET /codes/_search

{

"query": {

"match": {

"path.keyword": "/com"

}

}

}

GET /codes/_search

{

"query": {

"bool": {

"should": [

{

"match": {

"path": "/com"

}

},

{

"match": {

"path.keyword": "/com/baiqi"

}

}

]

}

}

}

��������/baiqi/firstҲ��������������,�������ʹ����text���е�������;

���ݹؼ��ַ�ҳ����

�ڴ��ڴ�������ʱ,һ�����ǽ��в�ѯ����Ҫ���з�ҳ��ѯ������:����ָ��ҳ�롢��ָ��ÿҳ��ʾ����������,Ȼ��Elasticsearch���ض�Ӧҳ������ݡ�

ʹ��from��size�����з�ҳ

��ִ�в�ѯʱ,����ָ��from(�ӵڼ������ݿ�ʼ����)��size(ÿҳ���ض�����)��

��,�Ϳ���������ɷ�ҳ��

from = (page �C 1) * size

POST /es_db/_doc/_search

{

"from": 0,

"size": 2,

"query": {

"match": {

"address": "�������"

}

}

ʹ��scroll��ʽ���з�ҳ

ǰ��ʹ��from��size��ʽ,��ѯ��1W-5W���������ڶ���OK��,��������ݱȽ϶��ʱ��,������������⡣Elasticsearch����һ������,��������ѯ����10000���Ժ�����ݡ����Ҫ��ѯ1W���Ժ������,��Ҫʹ��Elasticsearch���ṩ��scroll�α�����ѯ��

**�ڽ��д�����ҳʱ,ÿ�η�ҳ����Ҫ��Ҫ��ѯ�����ݽ�����������,�����dz��˷����ܡ�ʹ��scroll�ǽ�Ҫ�õ�����һ���������,Ȼ�����ȡ����**����Ҫ��from + size�õöࡣʹ��scroll��ѯ��,���������ݻᱣ��һ����ʱ��,�����ķ�ҳ��ѯ���Ӹÿ���ȡ���ݼ��ɡ�

��һ��ʹ��scroll��ҳ��ѯ

�˴�,��������������ݱ���1����,��������scrollΪ1m

GET /es_db/_search?scroll=1m

{

"query": {

"multi_match": {

"query": "���ݳ�ɳ����",

"fields": [

"address",

"name"

]

}

},

"size": 100

}

ִ�к�,����ע�,����Ӧ�������һ��:_scroll_id

����,������Ҫ�������_scroll_id�����в�ѯ

GET _search/scroll?scroll=1m

{

"scroll_id": "FGluY2x1ZGVfY29udGV4dF91dWlkDXF1ZXJ5QW5kRmV0Y2gBFkxRbEw1QW9tU3JxLVhDekpDQl9JM3cAAAAAAAAs-BYxTS1kbGNvdVNXU1BkUy01eVJydWx3"

}