使用export/import进行数据迁移

由于线上服务器底层虚拟机要从VMWare切换为ZStack,需要对线上的HBASE集群数据进行离线迁移。使用HBase自带的Export/Import实现,这种方法可以支持网络不通的集群之间的数据迁移。迁移步骤是先利用Export将需要数据迁出的HBase表数据转换成文件存入HDFS中,然后通过get命令将HDFS上的文件下载到本地文件中,在将文件拷贝到需要数据迁入的集群上,通过put把拷贝的本地文件上传至目标集群的HDFS中,最后利用Import命令将目标集群HDFS中的数据导入到HBase表。以上过程需要MapReduce的支持,所以需要启动yarn。

迁移数据量:

迁移步骤

导出hbase表数据到HDFS中

使用export命令将源HBase集群中的表的数据以文件的形式存储到HDFS中。

# 命令格式:hbase org.apache.hadoop.hbase.mapreduce.Export <tableName> <hdfsPath>

# 参数详解:

# tableName: 需要导出的hbase表名

# hdfsPath: hbase表数据备份到hdfs上的文件路径

hbase org.apache.hadoop.hbase.mapreduce.Export detection_video_file_chunk /detection_video_file_chunk

运行上面的命令后就能在命令行周看到map/reduce的进度如下:

我是在3个数据节点上同时导出3张表的数据,通过Cloudera Manager管理平台上查看导出时的服务器运行状况如下:

登录yarn管理平台http://ip:8088/。YARN管理平台上可以看到当前有3个正在运行的Map/Reduce任务

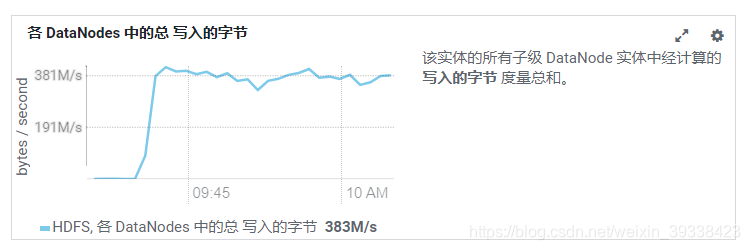

Cloudera Manager管理平台上查看HDFS写入的速度大概是383M/s。实测下来导出一张表和并发导出多张表HDFS的写入速度是差不多的。

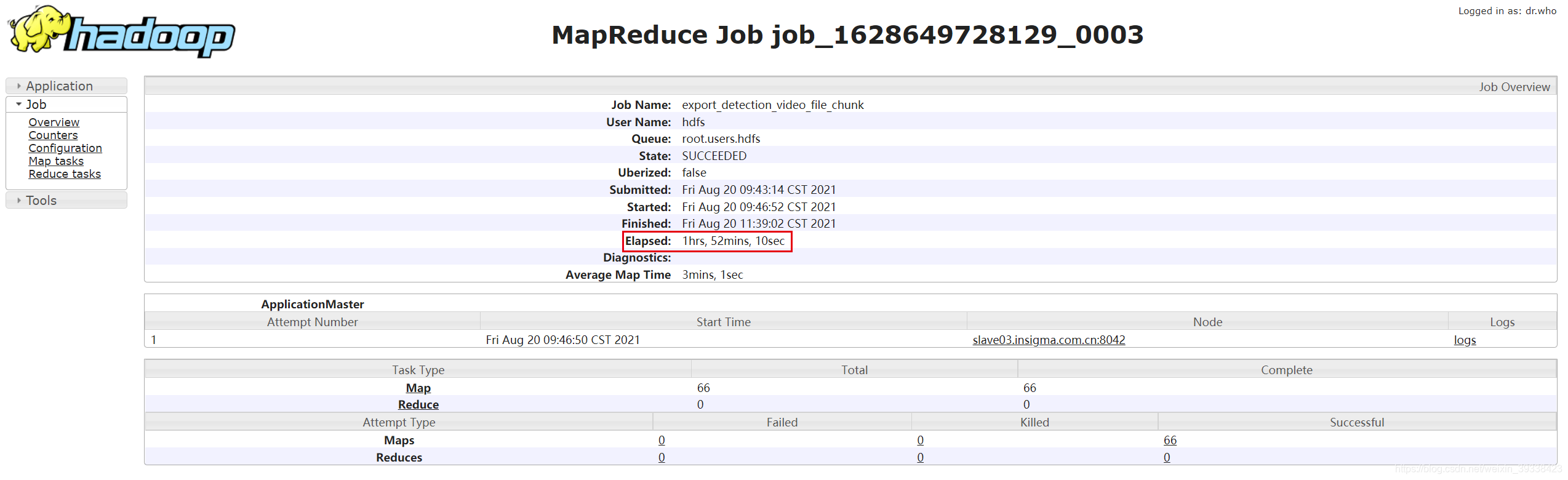

成功导出后显示如下,一张表导出334G的数据

从yarn管理平台上可以看到,数据导出到HDFS中耗时1小时55分48秒(导出数据334G),我是3张表同时导出的,一次导出一张表速度应该会快很多。

将HDFS上的数据下载到本地

使用get命令将上一步HDFS上的数据下载到本地磁盘(get命令会在本地文件夹中自动创建于HDFS同目录的表名),该步骤要注意本地文件夹读写权限问题,读写权限不足可能会导致导出数据到本地文件夹失败。

# 命令格式:hadoop fs -get <hdfsPath> <localFilePath>

# 参数详解:

# hdfsPath: hdfs上需要导出数据的文件路径

# localFilePath: hdfs上的数据导出到服务器本地的文件路径

hadoop fs -get /detection_video_file_chunk /home/hdfsdata/exportdata/

单任务下载hdfs的数据时,DataNode的读取速度大概是67.9M/s,实测多个任务并发下载时DataNode的读取速度都差不多,没有明显提升。

将本地的数据导入到HDFS中

将从HDFS上下载到服务器上的数据通过scp命令发送到目标服务器,在目标服务器上通过put命令将数据导入到HDFS对应目录中,如果HDFS的目录不存在需要先创建相关目录。

# 使用scp将源集群的数据文件传送到目标集群服务器上

scp -r <sourceFilePath> <destIp>:<destFilePath>

# 在目标hbase集群上创建对应的HDFS文件目录

# 命令格式:hdfs dfs -mkdir <hdfsDir>

# 参数详解:

# hdfsDir: 需要创建的hdfs目录

hdfs dfs -mkdir /detection_video_file_chunk

# 在目标hbase集群上,将源集群拷贝过来的本地数据文件上传到目标集群的HDFS指定目录上

# 命令格式:hadoop fs -put <localFilePath> <hdfsDir>

# 参数详解:

# localFilePath: 本地需要导入到hdfs中的数据所在的目录

# hdfsDir: 本地数据导入到hdfs中的目录

hadoop fs -put /home/hadoop/exportdata/detection_video_file_chunk/ /detection_video_file_chunk/

# 查看HDFS目录下的文件是否上传成功

# 命令格式:hadoop fs -ls <hdfsDir>

hdfs dfs -ls /detection_video_file_chunk

将HDFS中的数据导入到HBASE表中

将HDFS上的数据导入到HBase对应的表中,需要提前在HBase集群中创建目标表。而且Import数据到HBase表的过程是append(累加)而不是overwrite(覆盖)。

# 将HDFS的数据导入到hbase对应的表中,要注意先查看数据put进HDFS中的实际文件目录,目录不一致会导致写入失败

# 命令格式:hbase org.apache.hadoop.hbase.mapreduce.Import <tableName> <hdfsPath>

hbase org.apache.hadoop.hbase.mapreduce.Import detection_video_file_chunk /detection_video_file_chunk