系列文章

前言

本篇博客根据往年全国大学生大数据技能竞赛资料搭建,每一个步骤都有相应的执行的截图。以下博客仅作为个人搭建过程的记录~如有不足之处欢迎指出,共同学习进步。附上资料链接。

资料链接

青椒课堂(红亚)网站链接:

https://www.qingjiaoclass.com/login

所有环境工具百度网盘链接:

https://pan.baidu.com/s/1oOW7WqHK4fiqv4Xja5f7gQ

提取码:vvi7

Spark on Yarn安装

3.1安装Scala

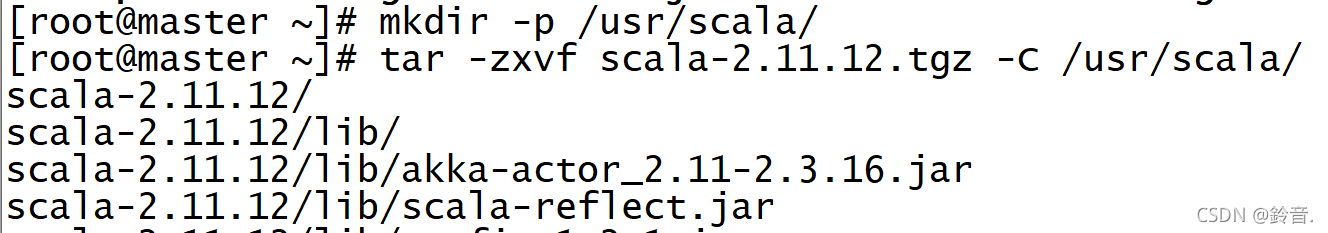

1.把Scala的jar包上传到master的目录下,创建工作路径并解压Scala到工作路径下

mkdir -p /usr/scala/

tar -zxvf scala-2.11.12.tgz -C /usr/scala/

等待执行完毕

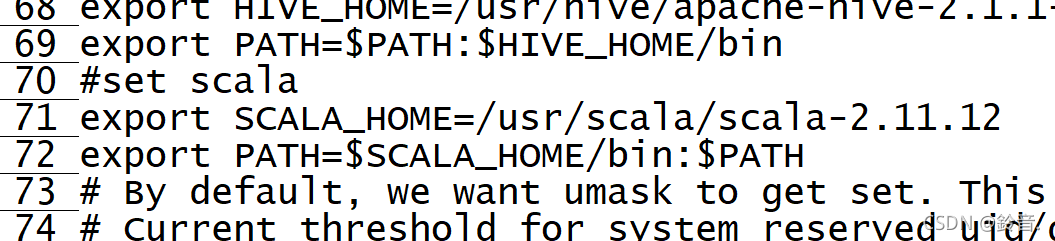

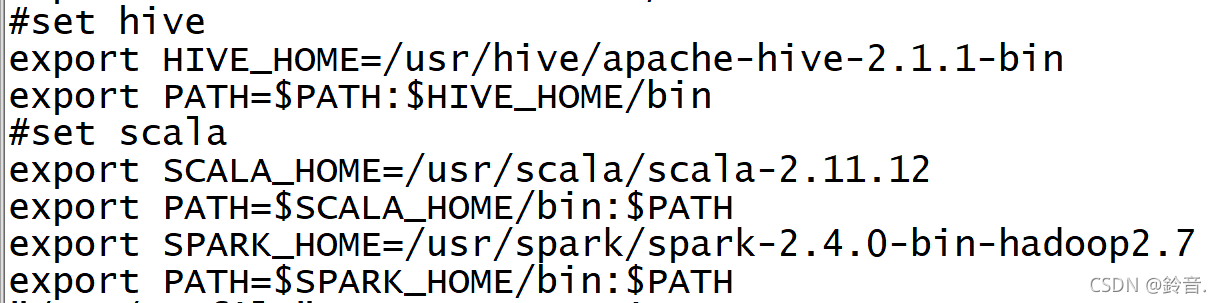

2.配置环境变量(三台虚拟机)

vi /etc/profile

添加

#set scala

export SCALA_HOME=/usr/scala/scala-2.11.12

export PATH=$SCALA_HOME/bin:$PATH

source /etc/profile

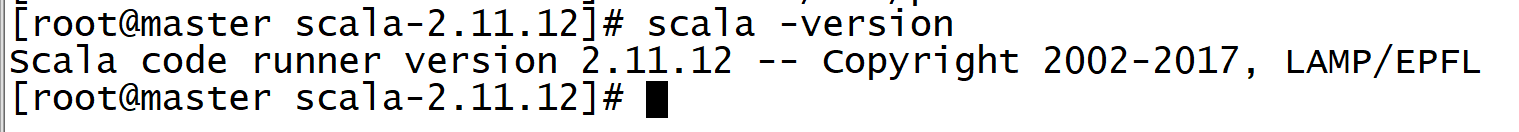

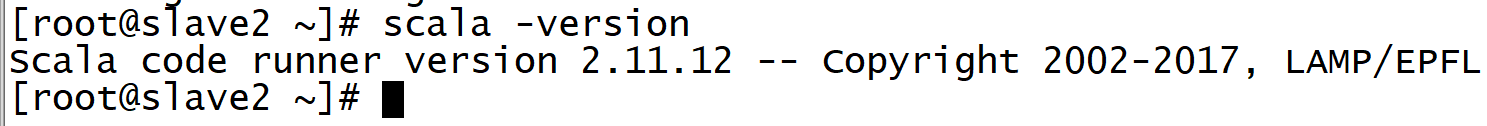

3.查看是否安装成功

scala -version

4.复制 scala 到子节点

scp -r /usr/scala root@slave1:/usr/

scp -r /usr/scala root@slave2:/usr/

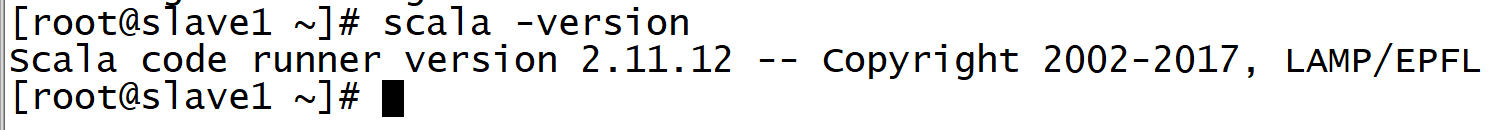

5.分别切换 slave1 和 slave2 节点,检测 scala 环境是否安装成功

scala -version

3.2安装Spark

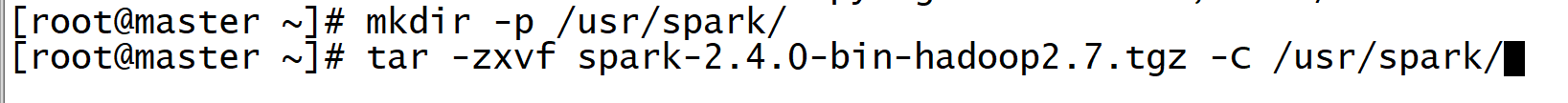

1.把spark的jar包上传到master的目录下,创建工作路径并解压spark到工作路径下

mkdir -p /usr/spark/

tar -zxvf spark-2.4.0-bin-hadoop2.7.tgz -C /usr/spark/

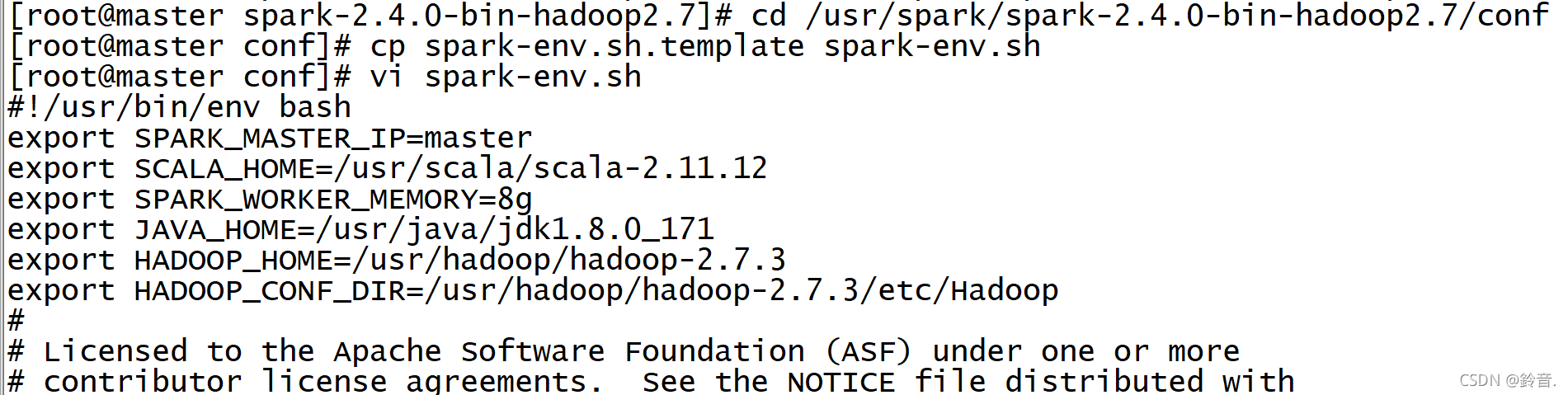

2.编辑spark-env.sh

cd /usr/spark/spark-2.4.0-bin-hadoop2.7/conf

cp spark-env.sh.template spark-env.sh

vi spark-env.sh

添加

export SPARK_MASTER_IP=master

export SCALA_HOME=/usr/scala/scala-2.11.12

export SPARK_WORKER_MEMORY=8g

export JAVA_HOME=/usr/java/jdk1.8.0_171

export HADOOP_HOME=/usr/hadoop/hadoop-2.7.3

export HADOOP_CONF_DIR=/usr/hadoop/hadoop-2.7.3/etc/Hadoop

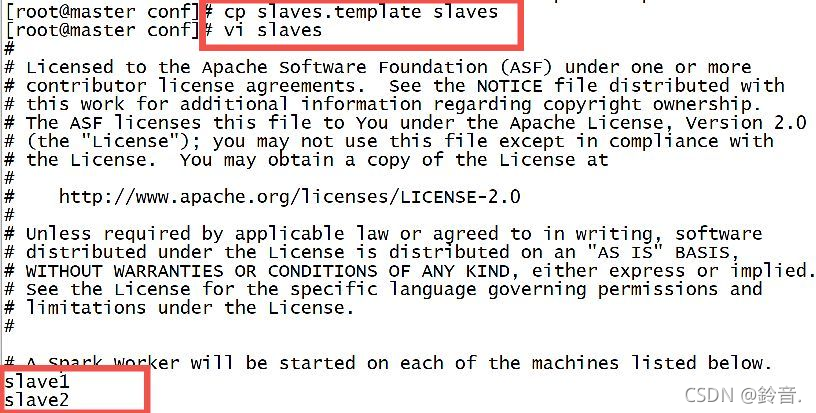

3.配置spark从节点,修改slaves文件

cp slaves.template slaves

vi slaves

修改最后一行

slave1

slave2

4.配置环境变量(三台虚拟机)

vi /etc/profile

添加

export SPARK_HOME=/usr/spark/spark-2.4.0-bin-hadoop2.7

export PATH=$SPARK_HOME/bin:$PATH

然后

source /etc/profile

5.分发子节点

scp -r /usr/spark root@slave1:/usr/

scp -r /usr/spark root@slave2:/usr/

6.测试运行环境(只在master节点执行)

开启Hadoop

/usr/hadoop/hadoop-2.7.3/sbin/start-all.sh

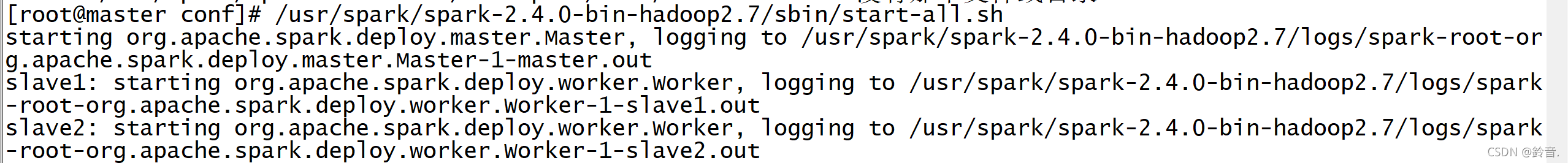

开启spark集群

/usr/spark/spark-2.4.0-bin-hadoop2.7/sbin/start-all.sh

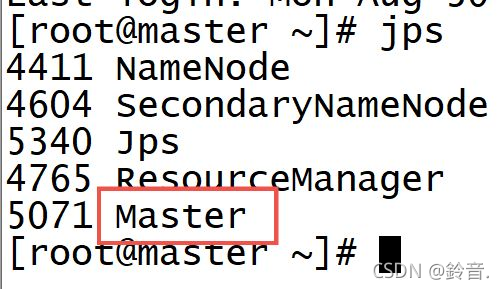

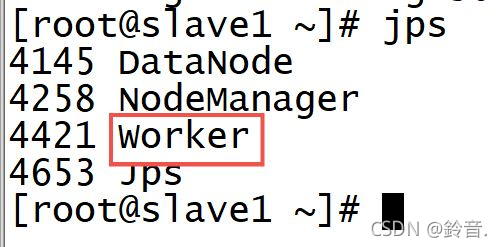

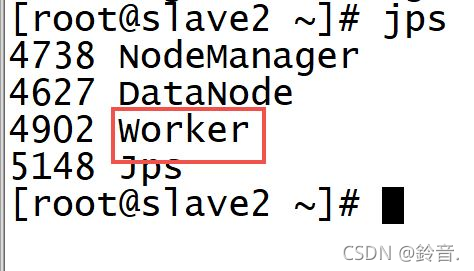

7.三个节点分别输入jps查看进程

jps

三个节点分别出现以下标志即成功

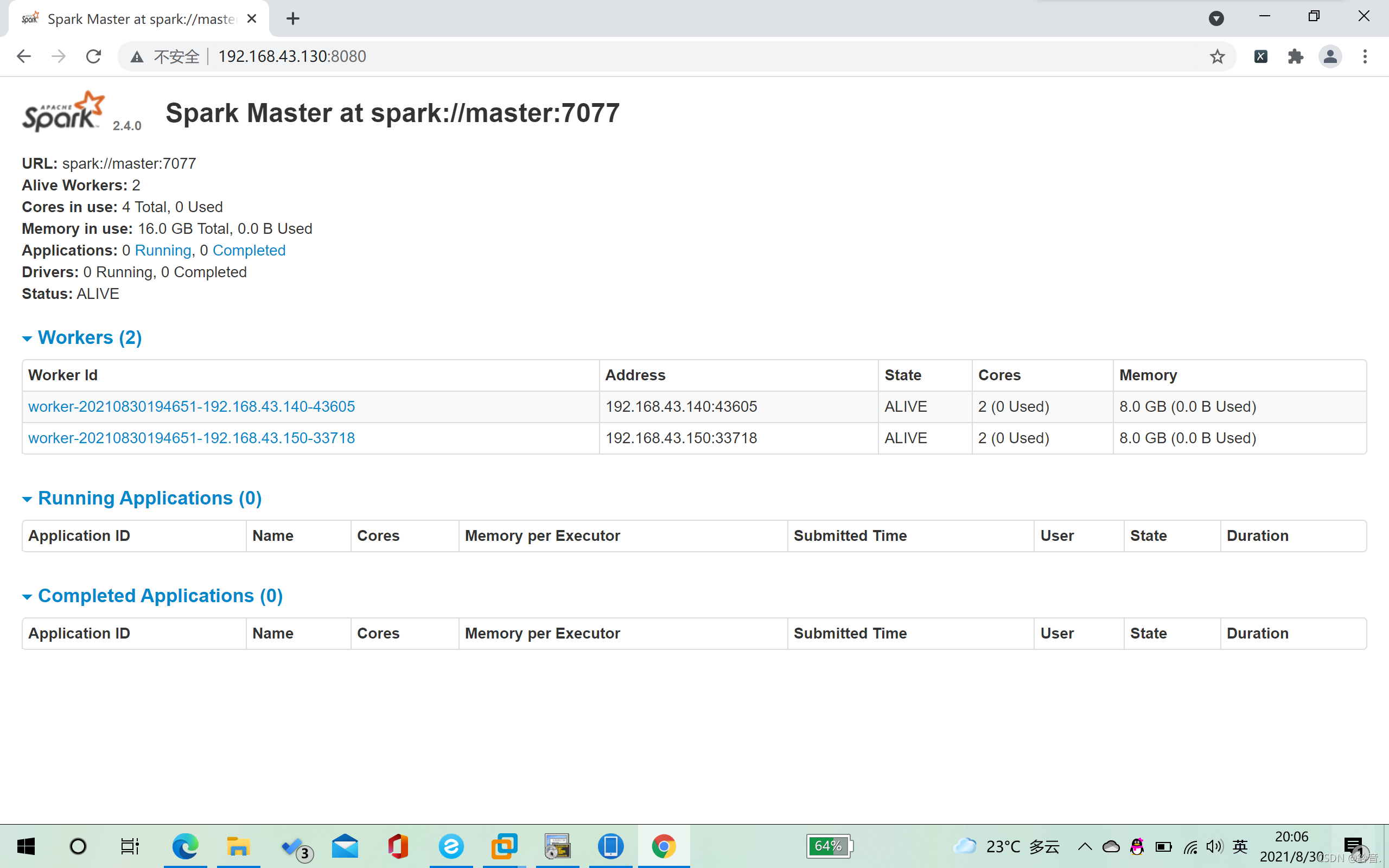

8.访问spark web界面

浏览器输入

master节点IP:8080

出现以下界面即成功

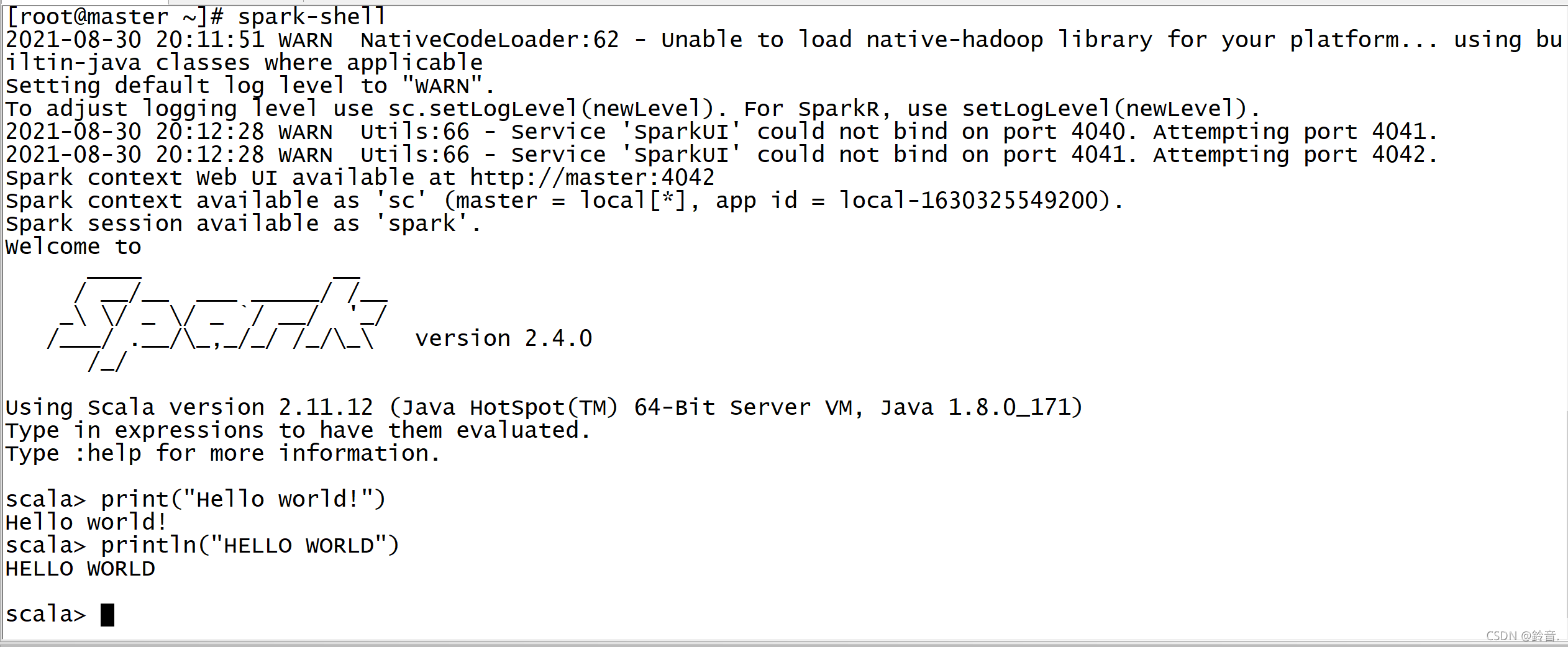

9.开启spark-shell

spark-shell

可输入命令测试

println("Hello world")

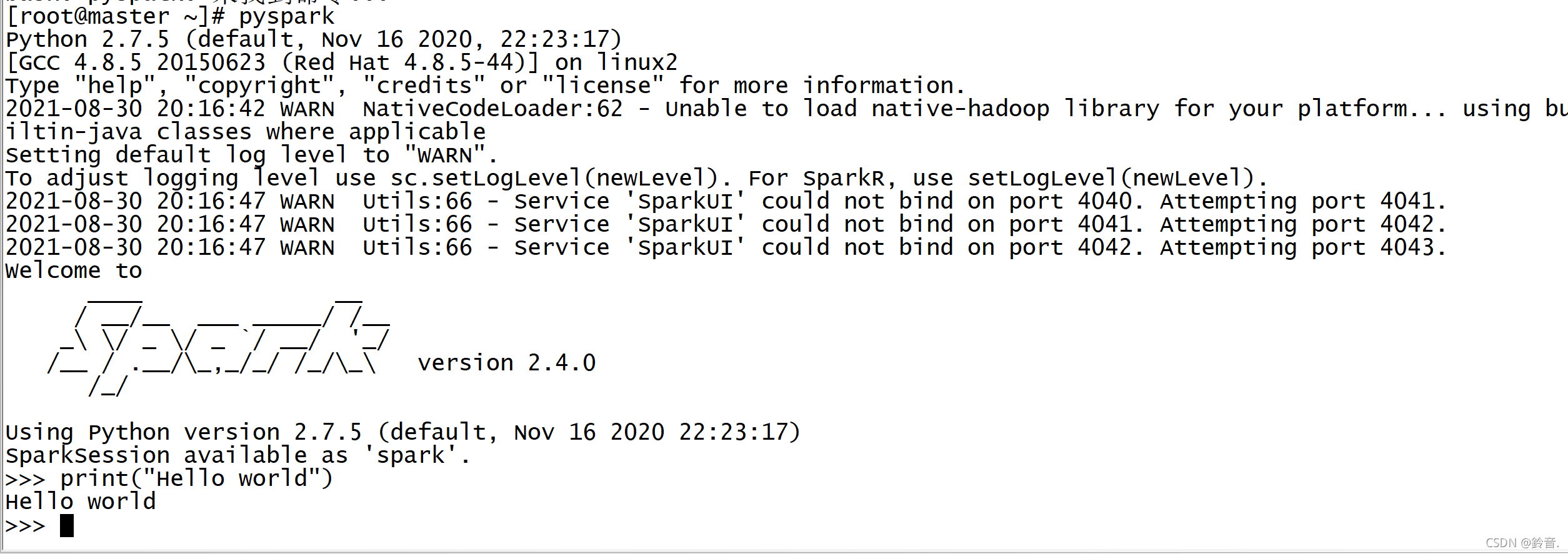

10.输入pyspark测试python环境spark交互模式

pyspark

输入quit()可退出

结束结束结束~~