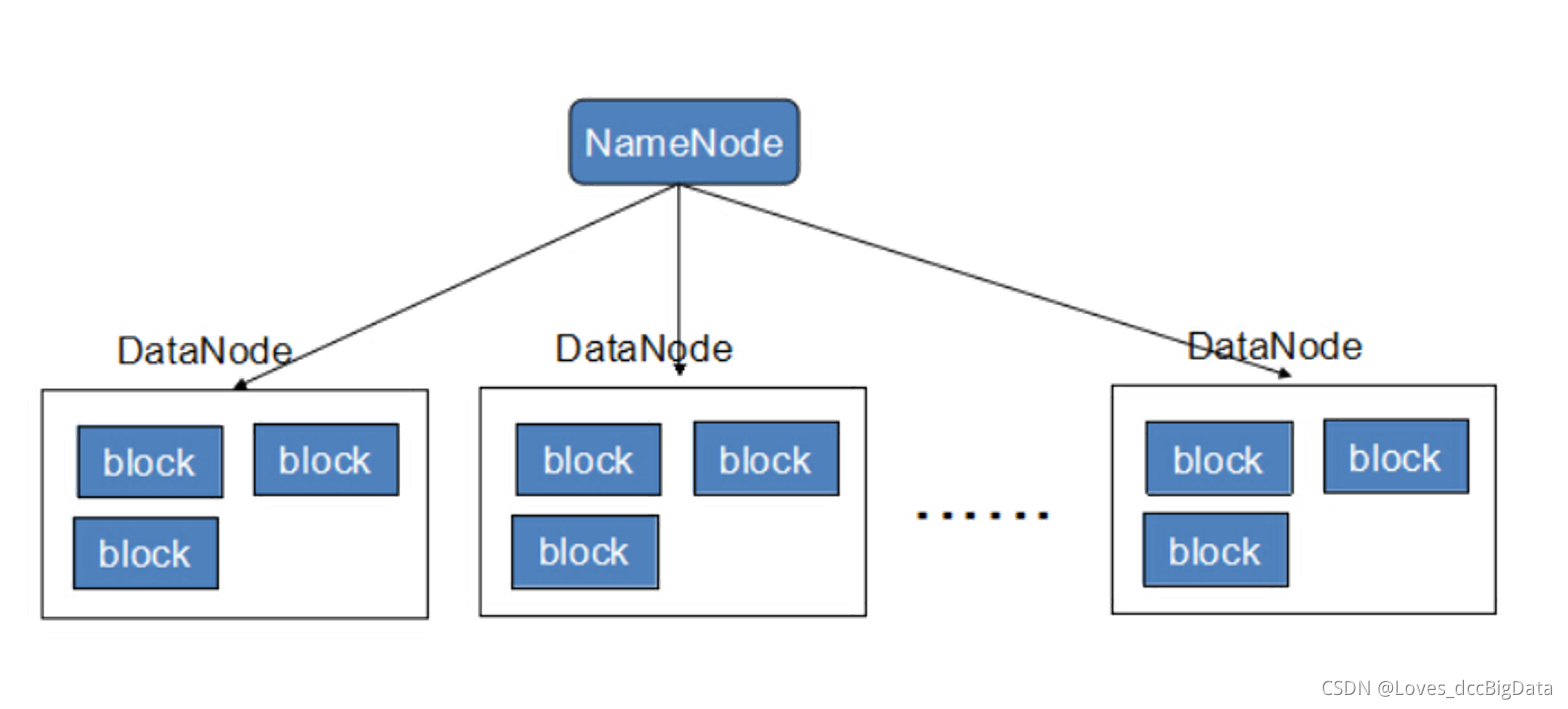

1��HDFS���ӽṹ

hdfs�ֲ�ʽ�洢:->namenode(�鿴���ݶ��,�ֶ��ٿ�,�з�,��datanode�ĸ��ڴ��)->����datanode->���ݱ��ݸ���

2�����ڵ�,�ӽڵ�

���������ռ�ְ��Ľڵ��Ϊ���ڵ�(master node)->namenode

�洢λ��:/usr/local/soft/hadoop-2.7.6/tmp/dfs/name/current

������������ְ��Ľڵ��Ϊ�ӽڵ�(slave node)->datanode

�洢λ��:/usr/local/soft/hadoop-2.7.6/tmp/dfs/data/current/BP-1463616091-192.168.163.110-1631865349165/

current/finalized/subdir0/subdir0

���ڵ㸺������ļ�ϵͳ���ļ��ṹ,�ӽڵ㸺��洢��ʵ������,��Ϊ����ʽ�ṹ(master-slaves)

3��hdfs�ܹ�����

���ӽṹ

���ڵ�:������2��,namenode

�ӽڵ�:�ж��,datanode

namenode:

�����û���������,���û����������

ά���ļ�ϵͳ��Ŀ¼�ṹ,�����ռ�

datanode:

�洢����

4��Yarn�ṹ

��Դ���Ⱥ���ƽ̨

���ӽṹ:

���ڵ�:������2��,ResourceManager

�ӽڵ�:���,NodeManager

ResourceManager:

��Ⱥ��Դ�ķ��������

mapReduce,Store,Spark��Ӧ��,����ʵ��ApplicationMaster�ӿ�,���ܱ�RM����

5��mapreduce

��������io������������ģ��

���ӽṹ:

���ڵ�:ֻ��һ��MRAppMaster

�ӽڵ�:task����

MRAppMaster:

����ͻ����ύ�ļ�������

������ָ�NodeManager��Container��ִ��,���������

Container��YARN����Դ�ij���,����װ��ij���ڵ���һ��������Դ(CPU���ڴ�������Դ)

Container��ApplicationMaster��ResourceManager�����,��ResouceManager�е���Դ�������첽�����ApplicationMaster

Container����������ApplicationMaster����Դ���ڵ�NodeManager�����

���Container��Task��ִ�����

Task����:

��������

6��hadoop�ص�

(1)��������(Scalable):�ܿɿ�(reliably)�ش洢�ʹ���PB��������ݡ��������������,�洢������,�����ӽڵ�Ϳ����ˡ�

(2)�ɱ���(Economical):����ͨ����ͨ������ɵķ�������Ⱥ���ַ��Լ���������.��Щ��������Ⱥ�ɴ���ǧ���ڵ㡣

(3)��Ч��(Efficient):ͨ���ַ��������,hadoop�������������ڽڵ���(����)���е�(parallel)��������,��ʹ�ô����dz���Ѹ��

(4)�ɿ���(Reliable):hadoop�ܹ��Զ���ά�����ݵĶ�ݸ���,����������ʧ�ܺ��ܹ��Զ������²���(redeploy)��������

7��hdfs�ṹ

8��hadoop�����ݳ־û���ԭ��

NameNode�������ļ�ϵͳ�Ĺ����ڵ㡣��ά���������ļ�ϵͳ���ļ�Ŀ¼��,�ļ�/Ŀ¼��Ԫ��Ϣ��ÿ���ļ���Ӧ�����ݿ��б��������û��IJ�������

�ļ�����:

fsimage:Ԫ���ݾ����ļ����洢ijһʱ��NameNode�ڴ�Ԫ������Ϣ��(����֮�������)

edits:������־�ļ�,namenode������һЩ����Ԫ��Ϣ��־��(��������)

fstime:�������һ��checkpoint��ʱ��

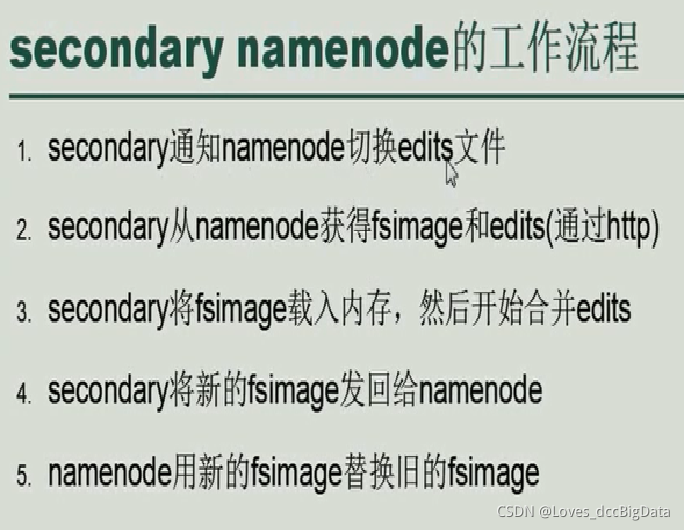

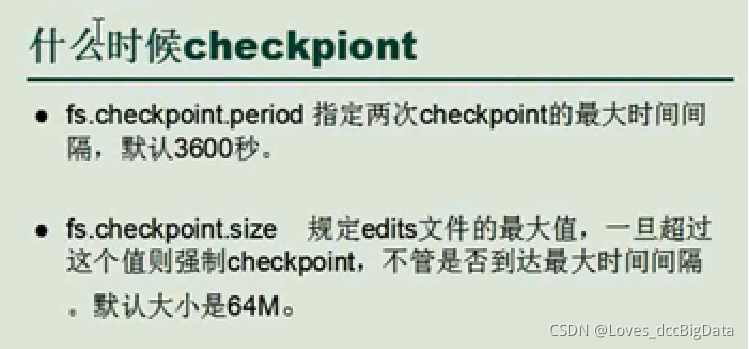

9��secondarynamenode�������,����Ԫ����

ÿ�ν��������µ�edits������ԭ����fsimage�ϲ��滻ԭ����fsimage

�ϲ���������

64M�������ָ���С��64M,���DZ�����ļ����ݴ�С

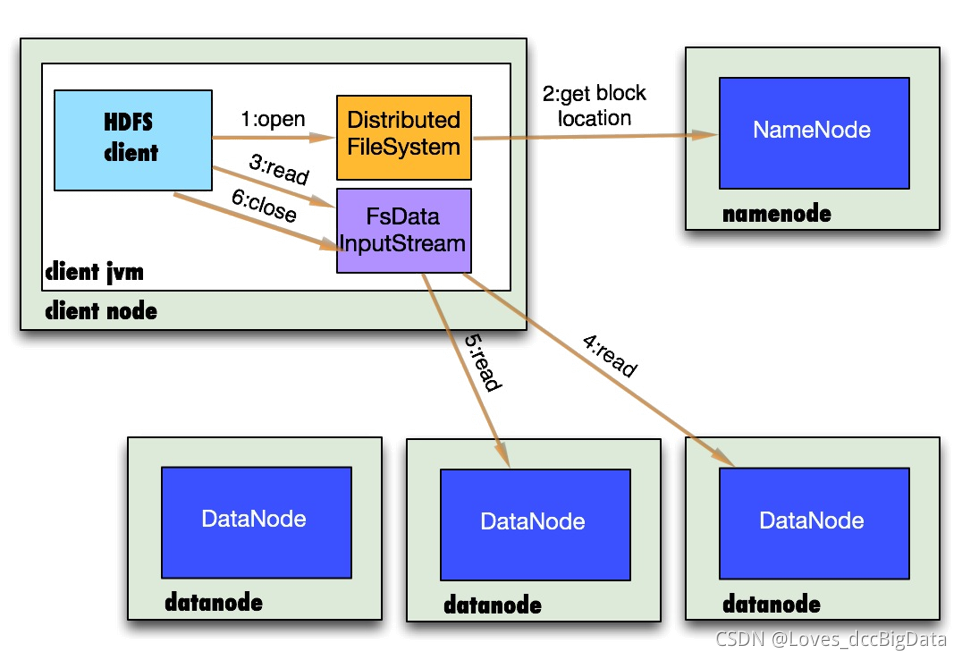

10����ȡ�ั���ļ�����

�ͽ�ԭ��

11��RPC-Զ�̹��̵���Э��

ʹ��Java����Hadoop,����ͨ��Э��

12�����ݴ洢�C>���ļ�

�ͽ�ԭ�� Ҳ��Ҫ������datanode�ĸ���

(1)���ȵ���FileSystem�����open����,��ʵ��һ��DistributedFileSystem��ʵ��

(2)DistributedFileSystemͨ��rpc����ļ��ĵ�һ��block��locations,ͬһblock���ո������᷵�ض��locations,��Щlocations����hadoop���˽ṹ����(Զ��),����ͻ��˽�������ǰ��.

(3)ǰ�����᷵��һ��FSDataInputStream����,�ö���ᱻ��װ��FSInputStream����,FSInputStream���Է���Ĺ���datanode��namenode���������ͻ��˵���read��DFSInputStream ����ҳ���ͻ��������datanode�����ӡ�

(4)���ݴ�datanodeԴԴ���ϵ�����ͻ��ˡ�

(5)�����һ������ݶ�����,�ͻ�ر�ָ���һ���datanode����,���Ŷ�ȡ��һ�顣��Щ�����Կͻ�����˵������,�ͻ��˵ĽǶȿ���ֻ�Ƕ�һ���������ϵ�����

(6)�����һ��block��������,FSInputStream�ͻ�ȥnamenode����һ��blocks��location,Ȼ�������,������еĿ鶼����,��ʱ�ͻ�رյ����е�����

����ڶ����ݵ�ʱ��,FSInputStream��datanode��ͨѶ�����쳣,�ͻ᳢�����ڶ���block���ŵڶ�����datanode,���һ��¼�ĸ�datanode��������,ʣ���blocks����ʱ��ͻ�ֱ��������datanode��FSInputStreamҲ����block����У���,�������һ������block,�ͻ��ȱ��浽namenode�ڵ�,Ȼ��FSInputStream��������datanode�϶���block�ľ���

����Ƶķ�����ǿͻ���ֱ������datanode���������ݲ���namenode������Ϊÿһ��block�ṩ���ŵ�datanode,namenode��������block location������,��Щ��Ϣ��������namenode���ڴ���,hdfsͨ��datanode��Ⱥ���Գ��ܴ����ͻ��˵IJ������ʡ�

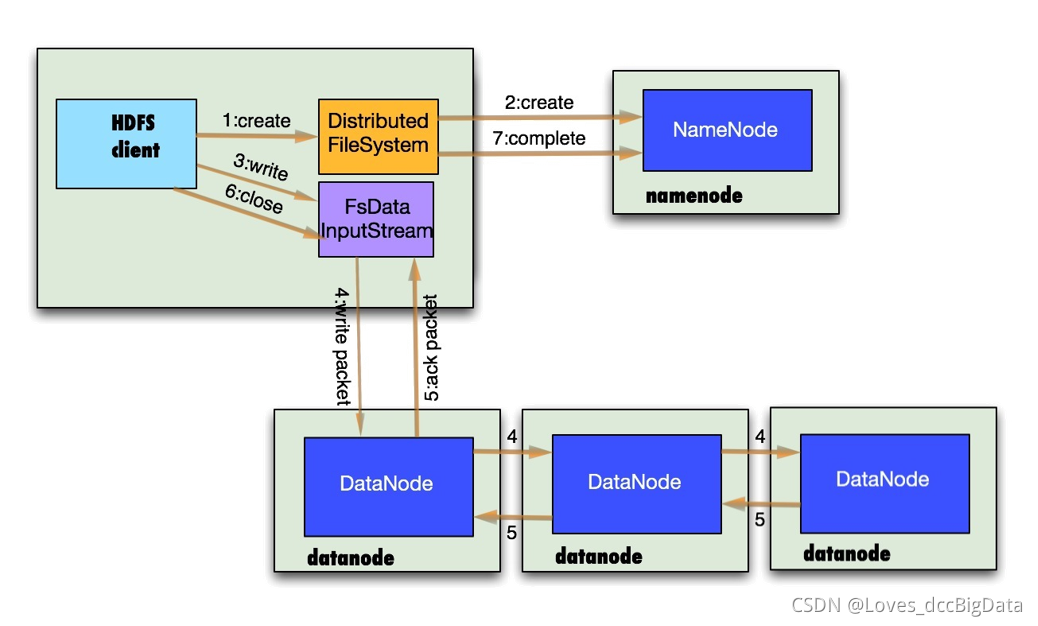

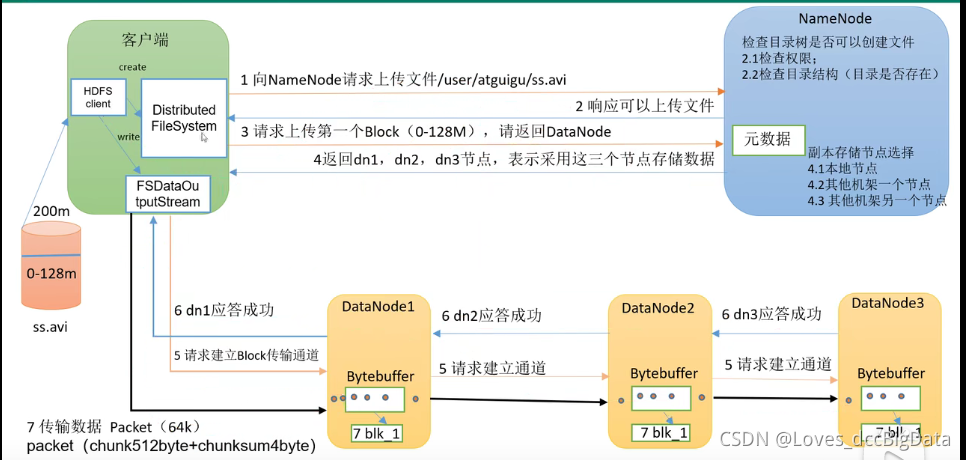

13�����ݴ洢�C>д�ļ�

��д��һ���������,(������� ����д��datanode��ʱ���ݻ���д��һ��ack�����б���,һ�����ݶ�ʧ���б���)

(1)�ͻ���ͨ������DistributedFileSystem��create�����������ļ�

(2)DistributedFileSystemͨ��RPC����namenodeȥ����һ��û��blocks���������ļ�,����ǰ,namenode��������У��,�����ļ��Ƿ����,�ͻ�������Ȩ��ȥ�����ȡ����У��ͨ��,namenode�ͻ��¼�����ļ�,����ͻ��׳�IO�쳣.

(3)ǰ����������᷵��FSDataOutputStream�Ķ���,����ļ���ʱ������,FSDataOutputStream����װ��FSOutputStream.DFSOutputStream����Э��namenode��datanode���ͻ��˿�ʼд���ݵ�FSOutputStream,FSOutputStream��������г�һ����Сpacket,Ȼ���ųɶ���data quene(����,�����з�128)

(4)DataStreamer��ȥ��������data queue,������ѯnamenode����µ�block���ʺϴ洢�����ļ���datanode��,���縱������3,��ô���ҵ�3�����ʺϵ�datanode,�������ų�һ��pipeline.DataStreamer��packet������������ܵ��ĵ�һ��datanode��,��һ��datanode�ְ�packet������ڶ���datanode��,�Դ����ơ�

(5)FSOutputStream����һ�����н�ack queue(���Ƽ��,��֤),Ҳ����packet���,�ȴ�datanode���յ���Ӧ,��pipeline�е�����datanode����ʾ�Ѿ��յ���ʱ��,��ʱakc queue�Ż�Ѷ�Ӧ��packet���Ƴ�����

�����д�Ĺ�����ij��datanode��������,���ȡ���¼���:

- pipeline���رյ�;

- Ϊ�˷�ֹ����ack queue���packet��ͬ����data queue��;

- �Ѳ��������datanode�ϵ�ǰ��д��δ��ɵ�blockɾ��;

4)blockʣ�µIJ��ֱ�д��ʣ�µ�����������datanode��;

5)namenode�ҵ������datanodeȥ���������ĸ��ơ���Ȼ,��Щ�����Կͻ�����˵����֪�ġ�

(6)�ͻ������д���ݺ����close�����ر�д����

(7)DataStreamer��ʣ��ð���ˢ��pipeline��Ȼ��ȴ�ack��Ϣ,�յ����һ��ack��,֪ͨnamenode���ļ���ʾΪ����ɡ�

14���������˨C�ڵ�������

�����ڵ㵽������� ��ͬ���ȵľ����ܺ�

15�������ڵ��ѡ��

��һ����client�����Ľڵ���

�ڶ�����������һ�����ܵ����һ���ڵ�

�����������ڵڶ��������������ܵ�����ڵ�

16��HDFS�ļ���Ĵ�С(����)

Ӳ�̶�д�ٶ�(һ��128,��˾256)

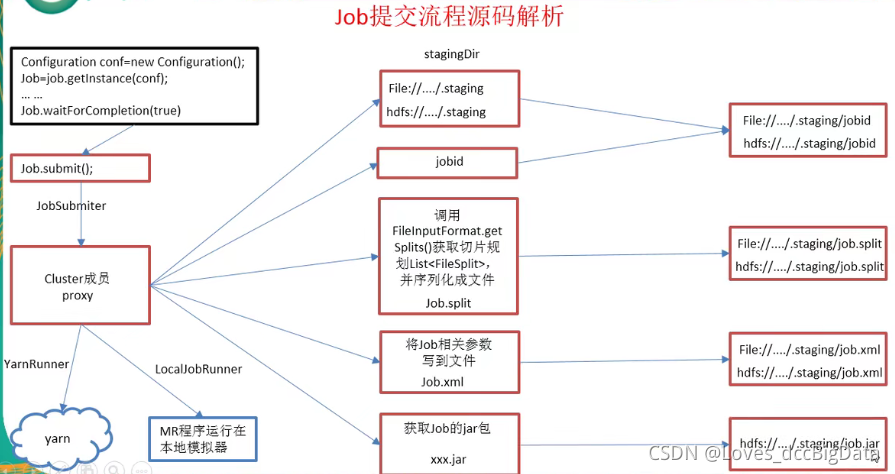

17��Job�ύ���������