Spark搭建

1.停止hadoop集群

#在master上执行

stop-all.sh

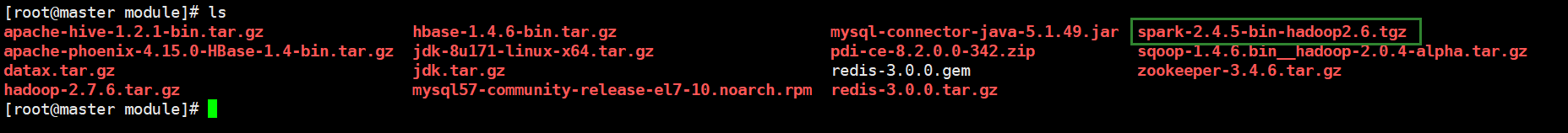

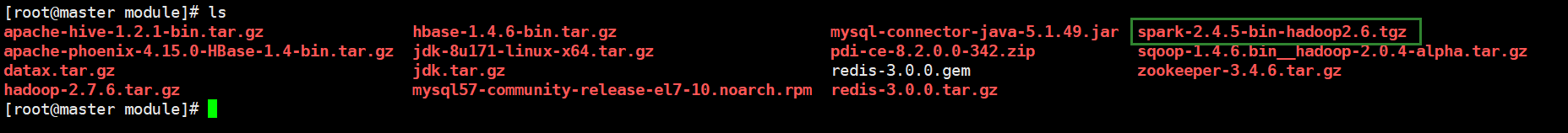

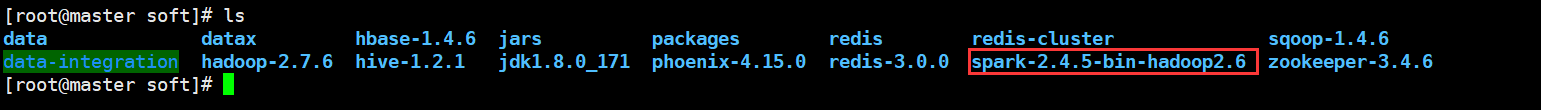

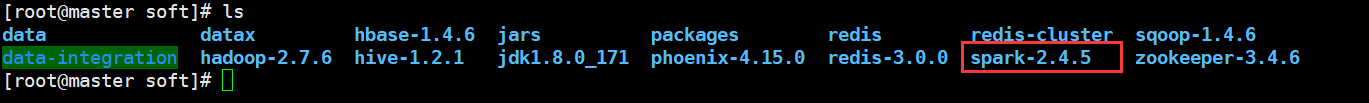

2.上传saprk安装包

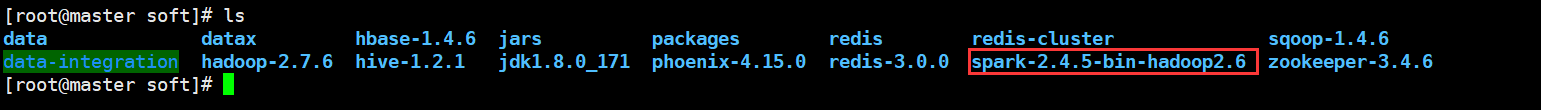

3.解压至soft目录

#解压

tar -zxvf spark-2.4.5-bin-hadoop2.6.tgz -C /usr/local/soft/

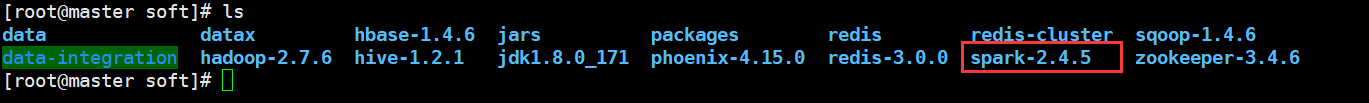

#重命名

mv spark-2.4.5-bin-hadoop2.6 spark-2.4.5

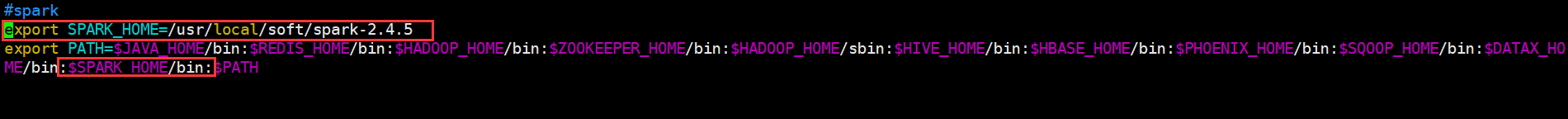

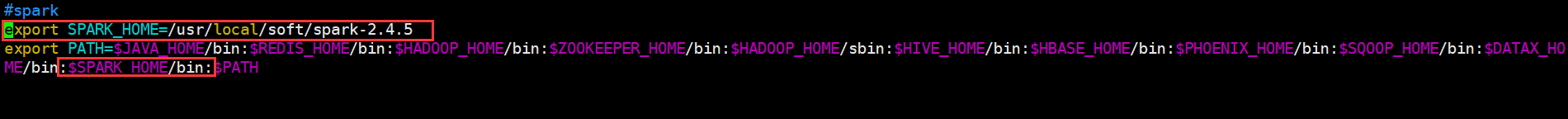

4.配置环境变量

#spark

export SPARK_HOME=/usr/local/soft/spark-2.4.5

export PATH=$SPARK_HOME/bin:$PATH

#刷新

scoure /etc/profile

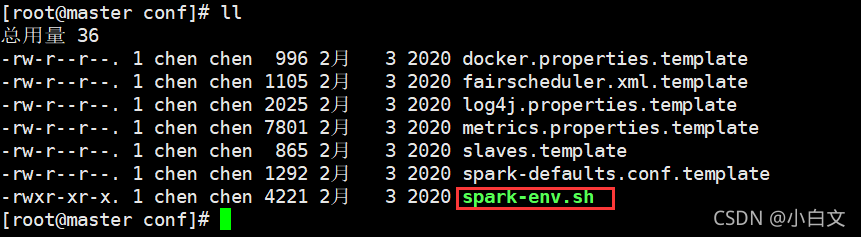

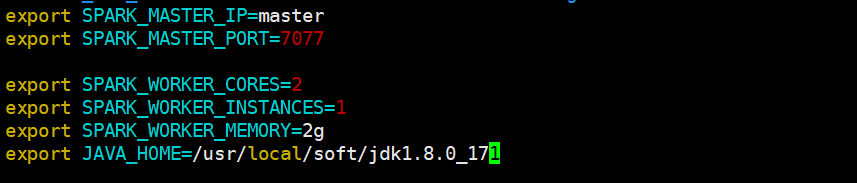

5.修改配置文件

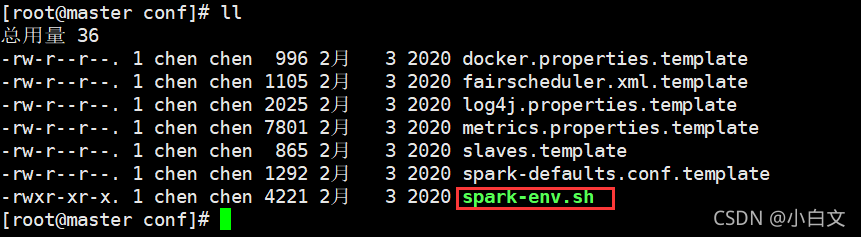

#重命名spark-env.sh.template文件为spark-env.sh

mv spark-env.sh.template spark-env.sh

vim spark-env.sh

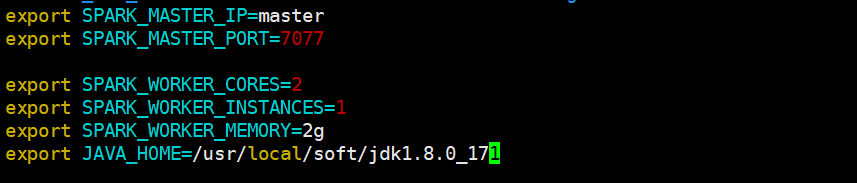

#追加一下内容

export SPARK_MASTER_IP=master

export SPARK_MASTER_PORT=7077

export SPARK_WORKER_CORES=2

export SPARK_WORKER_INSTANCES=1

export SPARK_WORKER_MEMORY=2g

export JAVA_HOME=/usr/local/soft/jdk1.8.0_171

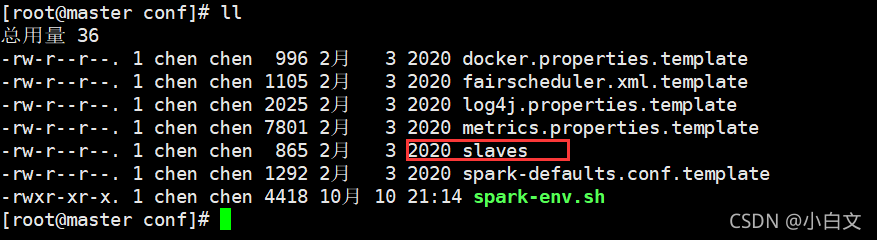

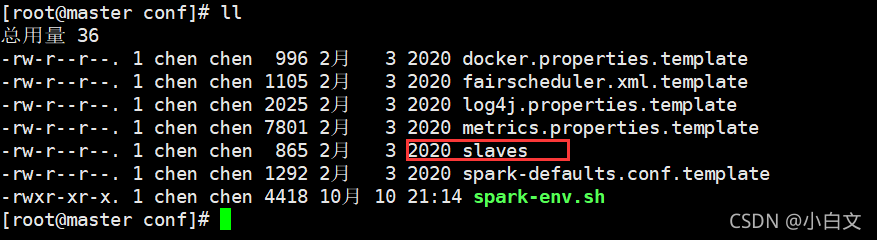

#重命名slaves.template为slaves

mv slaves.template slaves

vim slaves

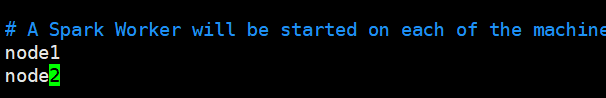

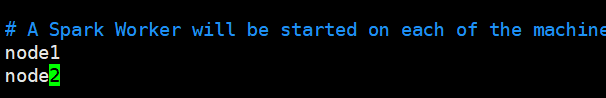

#追加一下内容

node1

node2

6.同步到从节点

#node1

scp -r spark-2.4.5/ node1:`pwd`

#node2

scp -r spark-2.4.5/ node2:`pwd`

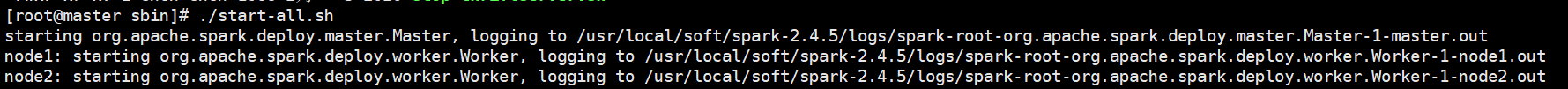

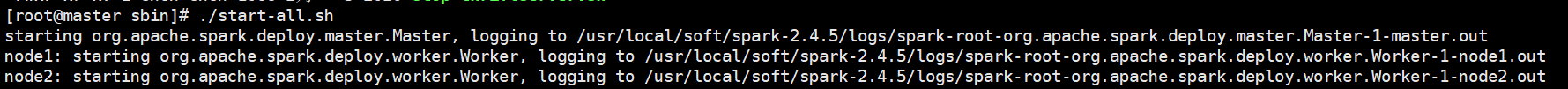

7.启动spark集群

#进入spark的sbin目录

cd /usr/local/soft/spark-2.4.5/sbin/

#启动集群

./start-all.sh

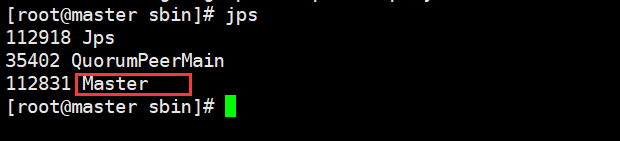

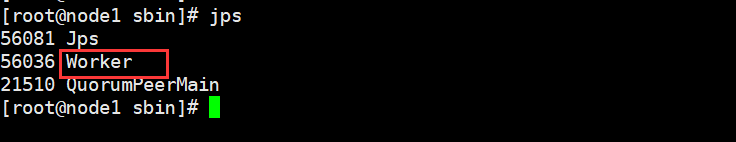

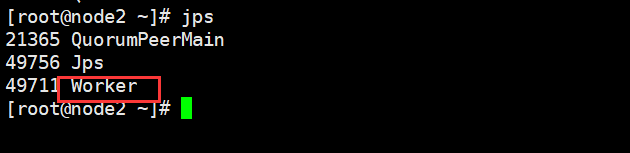

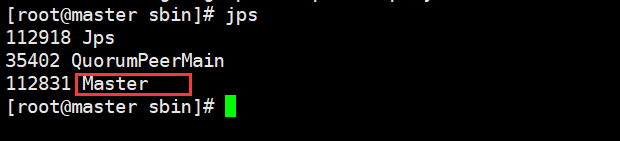

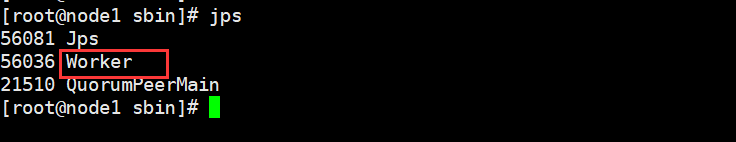

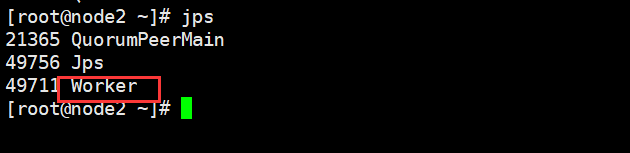

8.查看进程

master

node1

node2

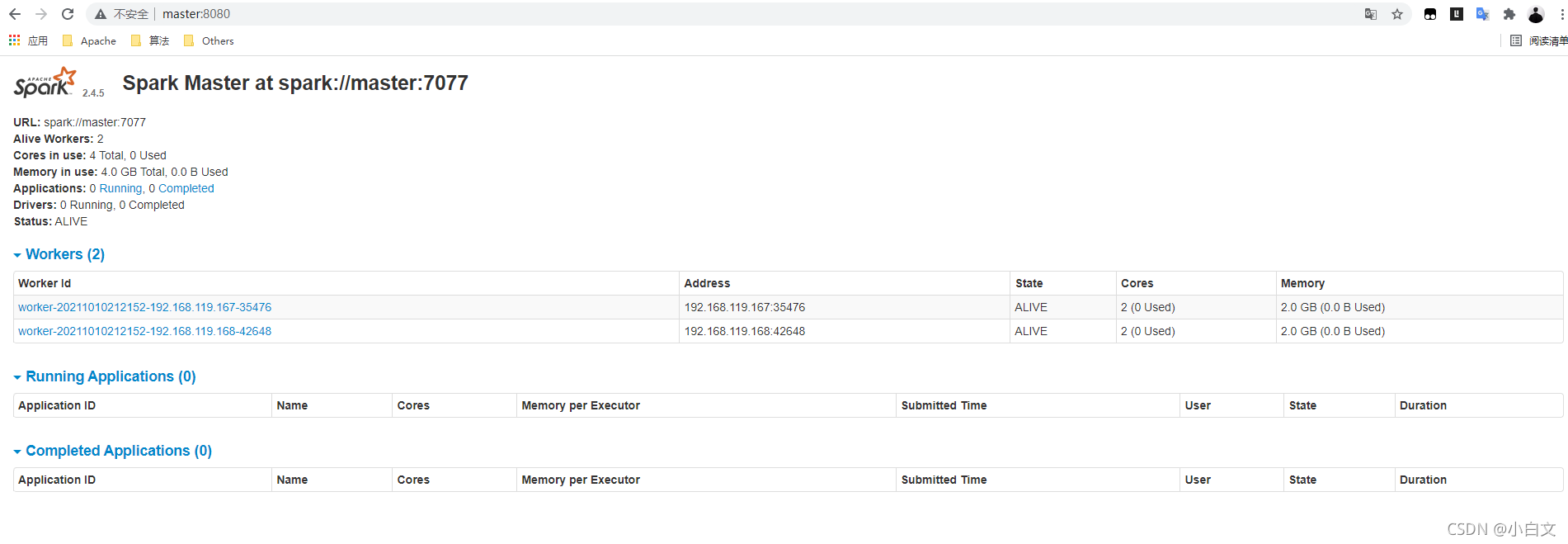

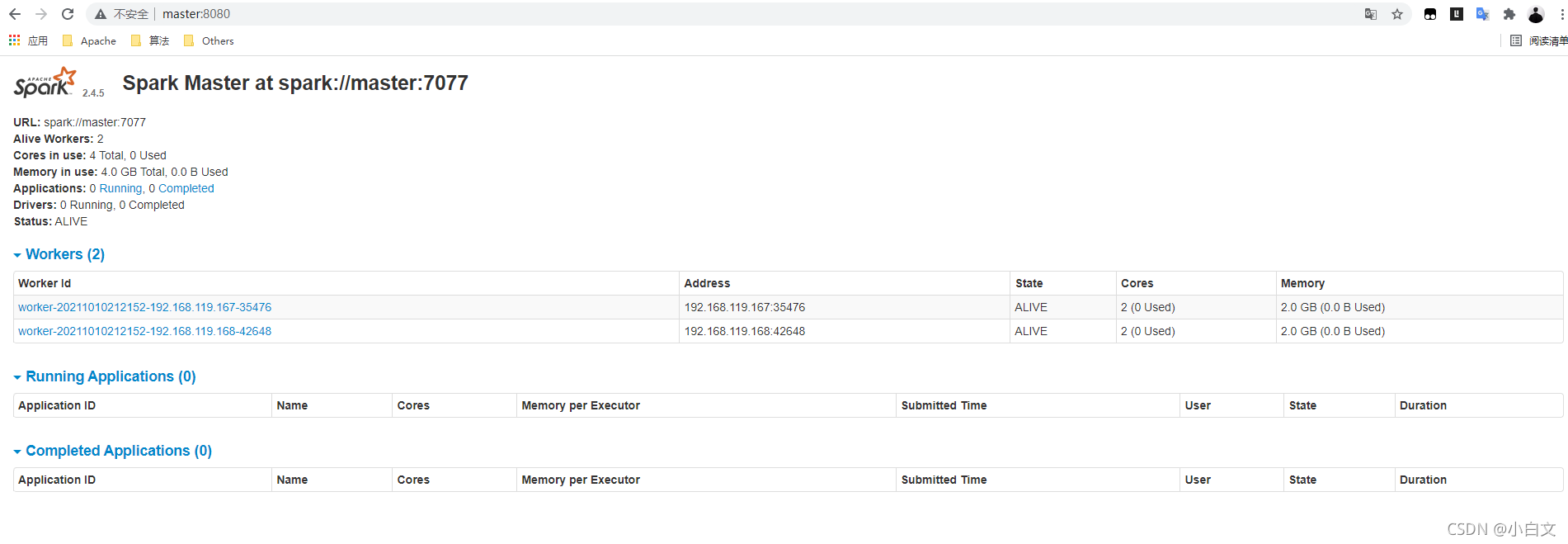

9.spark ui

http://master:8080/

10.测试

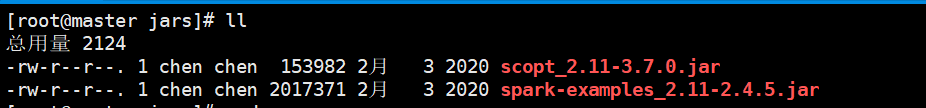

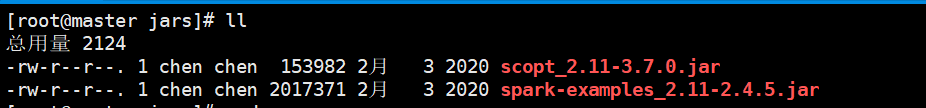

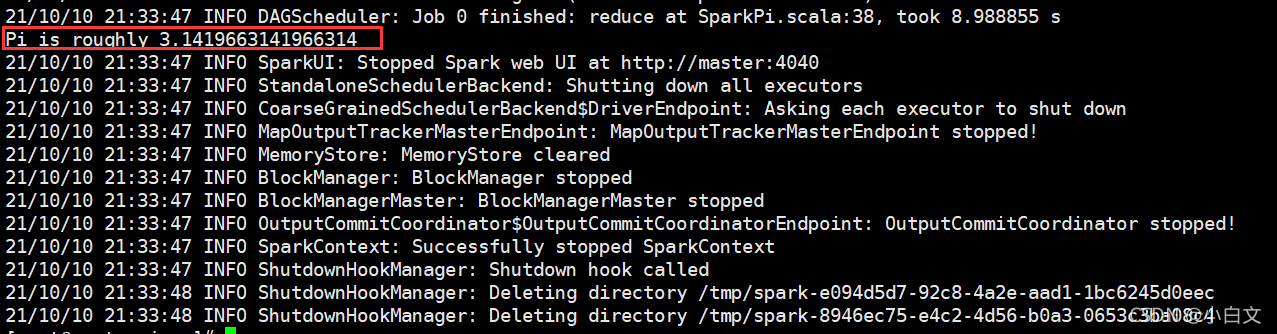

#进入jars目录

cd /usr/local/soft/spark-2.4.5/examples/jars

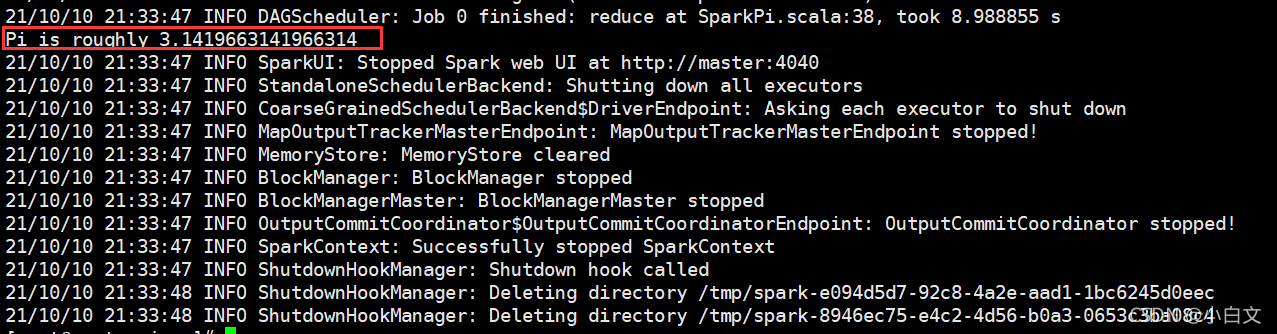

spark-submit --class org.apache.spark.examples.SparkPi --master spark://master:7077 --executor-memory 512m --total-executor-cores 1 spark-examples_2.11-2.4.5.jar 100

|