Sqoop�����뵼������

1��Sqoop����

��������:hadoop��ȫ�ֲ�ʽ��Ⱥ��hive��zookeeper��hbase

1.1�����ذ�װ��

�������ذ�װ��:�������ӵ�ַ

�����غõİ�װ���ϴ���Linux,��ѹ��������

1.2���������ļ�

����Sqoop��confĿ¼��

�����ļ���������

cp sqoop-env-template.sh sqoop-env.sh

��sqoop-env.sh�ļ�,��������������,����·��Ӧ�����

export HADOOP_COMMON_HOME=/usr/local/soft/hadoop-2.7.6

export HADOOP_MAPRED_HOME=/usr/local/soft/hadoop-2.7.6/share/hadoop/mapreduce

export HBASE_HOME=/usr/local/soft/hbase-1.4.6

export HIVE_HOME=/usr/local/soft/hive-1.2.1

export ZOOCFGDIR=/usr/local/soft/zookeeper-3.4.6/conf

export ZOOKEEPER_HOME=/usr/local/soft/zookeeper-3.4.6

����Sqoop��binĿ¼��

vim configure-sqoop �������ļ�,ע�͵�û�õ�����(����Ϊ��ȥ��������Ϣ)

ע�͵���������

1.3����Sqoop���ӻ�������

vim /etc/profile

��sqoop��Ŀ¼���뻷������

1.4������mysql��������

��mysql�����������Ƶ�Sqoop��libĿ¼��

cp /usr/local/soft/hive-1.2.1/lib/mysql-connector-java-5.1.49.jar /usr/local/soft/sqoop-1.4.7/lib/

����

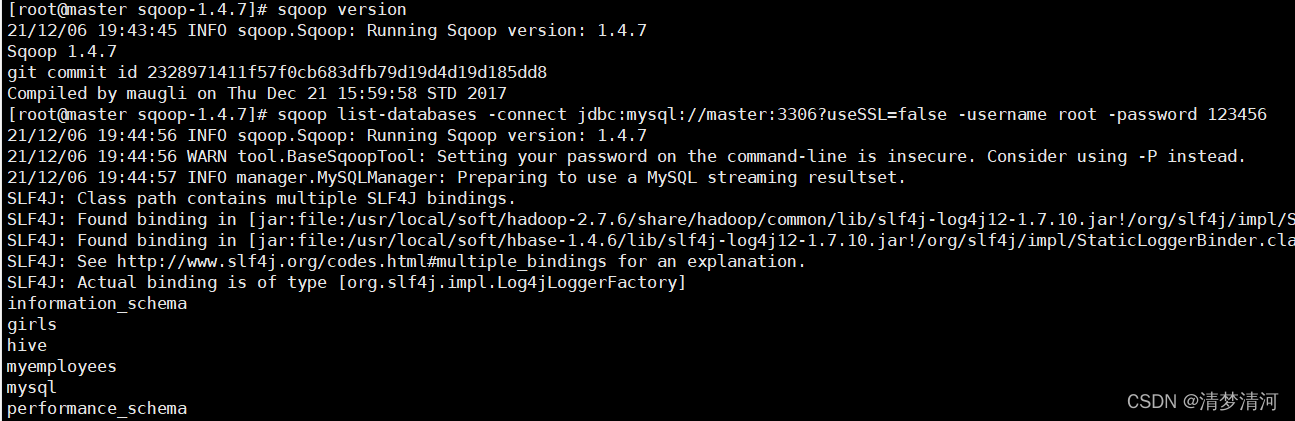

- ��ӡSqoop�汾

- ����MySQL��ͨ��

sqoop list-databases -connect jdbc:mysql://master:3306?useSSL=false -username root -password 123456

������ͼ�����ʾ���Գɹ�

2����������

�Ӵ�ͳ�Ĺ�ϵ�����ݿ�뵽HDFS��Hive��HBASE

2.1����MySQL�����ݵ���HDFS

2.1.1��������:

��MySQL�д���student���ݿ�,��ִ��student.sql�ű���������

ִ��source /root/data/student.sql����student����

2.1.2����д�ű�

��д�ű��ļ�����ΪMySQLToHDFS.conf

�Cm ָ��map������

�Ctarget-dir ָ��HDFS�Ĵ洢λ��

�Cfields-terminated-by ָ��HDFS�ϴ洢�ļ����ֶηָ��

import

--connect

jdbc:mysql://master:3306/student?useSSL=false

--username

root

--password

123456

--table

student

--m

2

--split-by

age

--target-dir

/sqoop/data/student

--fields-terminated-by

','

2.1.3��ִ�нű�

����д�Ľű�λ��ִ��

sqoop --options-file MySQLToHDFS.conf

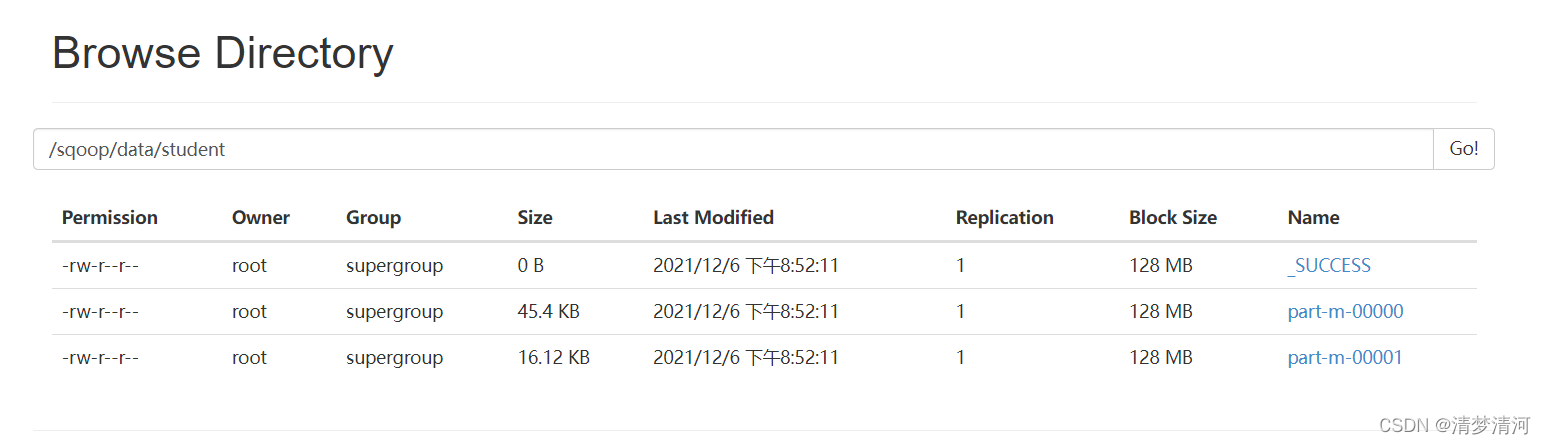

�鿴HDFS�е�����,����ɹ�

ע������:

1���Cm ��ʾָ�����ɶ��ٸ�Map����,����Խ��Խ��,��ΪMySQL Server�ij�����������

2����ָ����Map������>1,��ô��Ҫ���--split-by����,ָ���ָ��,��ȷ��ÿ��map����ȡ��һ��������,���ָ����ֵ�͵���,���ָ������(���߷ֲ����ȵ���=>����ÿ��map��������������������)

3�����ָ���ķָ�����ݷֲ�����,���ܵ���Map�ˡ�������б������

4���ָ�ļ����ָ����ֵ�͵�,�����ֶε�����Ϊint��bigint��������ֵ��

5����д�ű���ʱ��,ע��:����:--username����,����ֵ���ܺͲ�����ͬһ��

6�����е�ʱ��ᱨ��InterruptedException,hadoop2.7.6�Դ�������,���Լ���

7��ʵ����sqoop�ڶ�ȡmysql���ݵ�ʱ��,�õ���JDBC�ķ�ʽ,���Ե����������ʱ��,Ч�ʲ��Ǻܸ�

8��sqoop�ײ�ͨ��MapReduce������ݵ��뵼��,ֻ��ҪMap����,����ҪReduce����

9��ÿ��Map���������һ���ļ�

2.2����MySQL���ݵ��뵽Hive

��ִ��MapReduce�����ʱ��

�ȻὫMySQL�����ݵ���������HDFS���Ҹ�Ŀ¼��ʱ���,Ĭ��Ϊ:/user/�û���/����

Ȼ���ٽ����ݼ��ص�Hive��,������ɺ�,�Ὣ��ʱ��ŵ�Ŀ¼ɾ��

2.2.1��������

��MySQL������student���ݿ���,ִ��score.sql�ű���������

ִ��source /root/data/score.sql����score����

2.2.2����д�ű�

��д�ű��ļ�,������ΪMySQLToHive.conf

�Cfields-terminated-by �ֶηָ��

�Clines-terminated-by �зָ���

�Chive-import ��������Hive

�Chive-overwrite ������

�Cdelete-target-dir �������Ŀ���ļ��о�ɾ��

--hive-database ָ��Hive�е����ݿ�,Hive����Ҫ���������ݿ�,������ܻ����

import

--connect

jdbc:mysql://master:3306/student?useSSL=false

--username

root

--password

123456

--table

score

--fields-terminated-by

"\t"

--lines-terminated-by

"\n"

--m

3

--split-by

student_id

--hive-import

--hive-overwrite

--create-hive-table

--hive-database

testsqoop

--hive-table

score

--delete-target-dir

2.2.3��ִ�нű�

ִ�нű�ǰ��

-

��HADOOP_CLASSPATH���뻷��������

������������

export HADOOP_CLASSPATH=$HADOOP_HOME/lib:$HIVE_HOME/lib/*

��source /etc/profile -

��hive-site.xml����SQOOP_HOME/conf/

cp /usr/local/soft/hive-1.2.1/conf/hive-site.xml /usr/local/soft/sqoop-1.4.7/conf/

ִ�нű�

sqoop --options-file MySQLToHive.conf

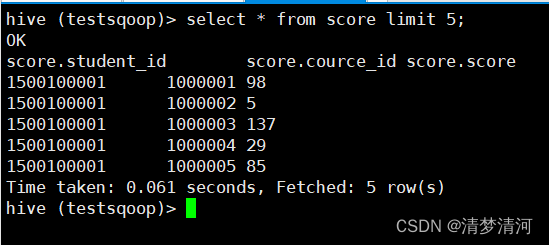

����hive�鿴����ı�����,����ɹ���ͼ

2.3����MySQL���ݵ���HBASE

2.3.1��������

��MySQL�е�student���ݵ���hbase��

2.3.2����д�ű�

���ű�����ΪMySQLToHBase.conf

�Chbase-row-key ָ��hbase���м�

�Ccolumn-family ָ��hbase���д�

�Chbase-table ָ��hbase�ı�,hbase�ϵı������,��������ָ�����д�

import

--connect

jdbc:mysql://master:3306/student?useSSL=false

--username

root

--password

123456

--table

student

--hbase-table

stu

--hbase-row-key

id

--m

1

--column-family

cf

2.3.3��ִ�нű�

sqoop --options-file MySQLToHBase.conf

����Hbase�鿴���,�ɹ�����ͼ

3����������

3.1����HDFS�ϵ����ݵ���MySQL

3.1.1��������

sqoop��MySQL���������

3.1.2����д�ű�

��д�ű�������ΪHDFSToMySQL.conf

&characterEncoding=utf8���HDFS�ϵ����ݵ���MySQL��������jdbc�������ַ���

�Ccolumns ָ������

�Cexport-dir ָ��HDFS�ϵ�(��Ҫ������λ��)�洢λ��

export

--connect

jdbc:mysql://master:3306/student?useSSL=false&characterEncoding=utf8

--username

root

--password

123456

--table

student

-m

1

--columns

id,name,age,gender,clazz

--export-dir

/sqoop/data/student/

--fields-terminated-by

','

3.1.3��ִ�нű�

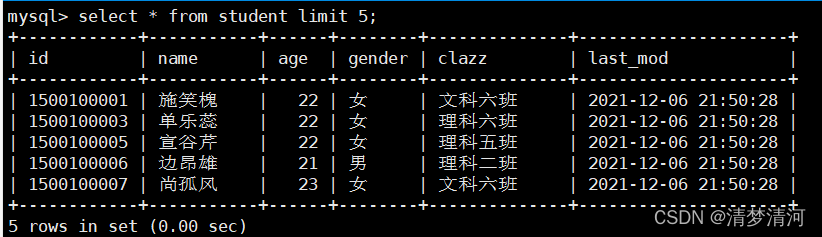

�������MySQL�����

ִ�нű�

sqoop --options-file HDFSToMySQL.conf

�ɹ�����ͼ

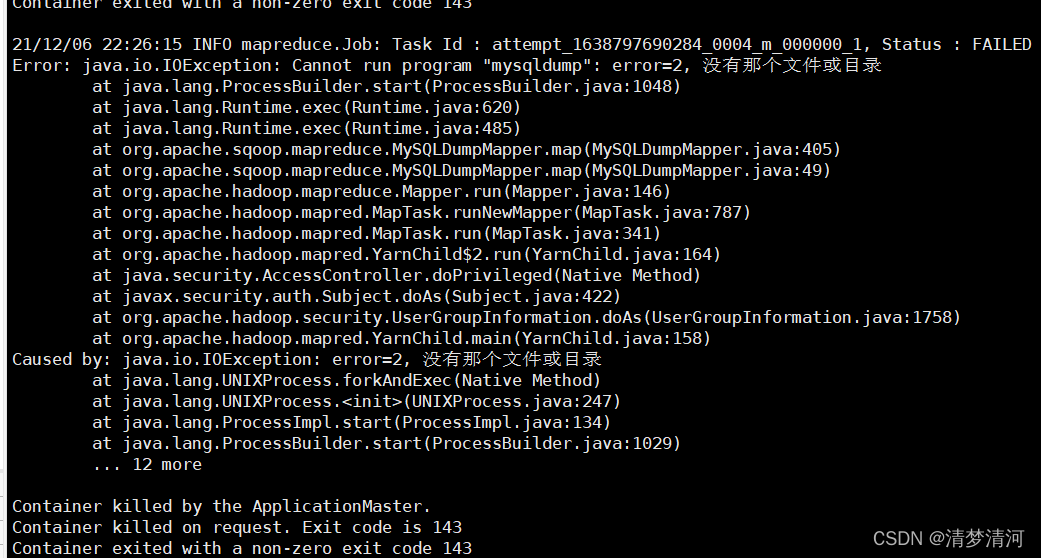

4���Cdirect����

�����������,�����ڵ���MySQL���ݵ�ʱ��,ʹ��MySQL�ṩ�ĵ�������mysqldump,�ӿ쵼���ٶ�,���Ч��

������Ҫ��master�ϵ�/usr/bin/mysqldump�ַ��� node1��node2��/usr/binĿ¼��

���������������,����������´���

��master��ִ��

scp /usr/bin/mysqldump node1:/usr/bin/

scp /usr/bin/mysqldump node2:/usr/bin/

�ٴ�ִ�нű��Ͳ��������

4.1��e������ʹ��ʾ��

import

--connect

jdbc:mysql://master:3306/student

--username

root

--password

123456

--fields-terminated-by

"\t"

--lines-terminated-by

"\n"

--m

2

--split-by

student_id

--e

"select * from score where student_id=1500100011 and $CONDITIONS"

--target-dir

/testQ

--hive-import

--hive-overwrite

--create-hive-table

--hive-database

testsqoop

--hive-table

score2