- Hive��������:�ڱ�֤ҵ���������ǰ����,������Դ��ʹ����,���������ִ��ʱ�䡣

1��������֪

(1)���ڴ����ݼ���������˵:��������������,������б�Ǹ����⡣

(2)Hive�ĸ���HQL�ײ��ת���ɶ��MapReduce Job���л��ߴ���ִ��,Job���Ƚ϶����ҵ����Ч ����ԱȽϵ�,���缴ʹֻ�м��������ݵı�,�����ι�����λ���,����ʮ����Job,��ʱ�ܳ��� ԭ���� MapReduce ��ҵ��ʼ����ʱ���DZȽϳ��ġ�

(3)�ڽ���Hive�����ݷ���ʱ,�����ľۺϲ�������sum,count,max,min,UDAF�� ,����������б����**,MapReduce �� Mappe�� ��Ԥ�ۺϲ���,ʹ������б��������**�� (4)�õ��������,ģ������°빦����

(5)���ú����� MapReduce �� Task ���ж�,����Ч����������(����,10w+������ ����ļ���,�� 100 �� reduceTask,�����൱���˷�,1���㹻,��������� �ڼ����������,��ô1��Task���Ե� �����)

(6)�˽����ݷֲ�,�Լ����ֽ��������б�����Ǹ�������ѡ��������ͨ�õ��㷨�Ż�,���㷨�Ż��� ʱ������Ӧ�ض�ҵ��,������Ա�˽�ҵ��,�˽�����,����ͨ��ҵ������ȷ��Ч�Ľ��������б ���⡣

(7)��С�ļ����кϲ�,����֮��Ч����ߵ���Ч�ʵķ���,�������е���ҵ���ú������ļ���,��������������Ч��Ҳ���������������Ӱ��

(8)�Ż�ʱ��������,������ҵ���Ų�������������

2��Hive�Ľ�����Ʋ���

2.1���������� - ����VS��Ͱ

(1)������

? ��һ�� Hive ���IJ�ѯ����������,�����ijһ���ֶν���ɸѡʱ,��ô�dz��ʺϴ���Ϊ ������,���ֶμ�Ϊ�����ֶΡ�

- Ӧ�ó���:���ݻ�����ֻ�������������,�������ȫ������,��Ӧ�ð���ʱ��������

(2)��Ͱ��

? ָ��������ָ���е�ֵΪ key ���� hash,hash ��ָ����Ŀ��Ͱ��,�������� Ŀ�ĺͷ���������,ʹ��ɸѡʱ����ȫ�ֱ������е�����,ֻ��Ҫ��������Ͱ�Ϳ�����

- Ӧ�ó���:AB�������ݲ�����Join������б

2.2��ѡ����ʵ��ļ��洢��ʽ

- �Ż�����:�������ļ��洢��ʽ��������Parquet��ORC,�������ʹ洢��,���Ż��˲�ѯ,ѹ��,������������

(1)TextFile : ÿһ�ж���һ����¼,ÿ�ж��Ի��з�(\ n)��β�����ݲ���ѹ��,���̿�����,���ݽ��������ɽ��Gzip��Bzip2ʹ��(ϵͳ�Զ����,ִ�в�ѯʱ�Զ���ѹ),��ʹ�����ַ�ʽ,hive��������ݽ����з�,�Ӷ��������ݽ��в��в�����

(2)SequenceFile : ��Hadoop API�ṩ��һ�ֶ������ļ�֧��,�����ʹ�÷��㡢�ɷָ��ѹ�����ص㡣֧������ѹ��ѡ��:NONE, RECORD, BLOCK�� Recordѹ���ʵ�,һ�㽨��ʹ��BLOCKѹ����

(3)RCFile : ��һ�����д洢���ϵĴ洢��ʽ������,�佫���ݰ��зֿ�,��֤ͬһ��record��һ������,�����һ����¼��Ҫ��ȡ���block�����,��������ʽ�洢,����������ѹ���Ϳ��ٵ��д�ȡ��

ORCFile : ORC�ļ���ʽ�ṩ��һ�ֽ����ݴ洢��Hive���еĸ�Ч����������ļ�ϵͳʵ��(4)����Ϊ�˿˷�����Hive�ļ���ʽ�����ƶ���Ƶġ�Hive�Ӵ��ͱ���ȡ,д��ʹ�������ʱ,ʹ��ORC�ļ�����������ܡ�

(5)Parquet : һ�������еĶ������ļ���ʽ��Parquet���ڴ��Ͳ�ѯ�������Ǹ�Ч�ġ�����ɨ���ض������е��ض��еIJ�ѯ,Parquet�ر����á�

| �洢��ʽ | �洢��ʽ | �ص� |

|---|---|---|

| TextFile | �д洢 | �洢�ռ����ıȽϴ�,����ѹ����text ���ָ�ͺϲ� ��ѯ��Ч�����,����ֱ�Ӵ洢,�������ݵ��ٶ���� |

| SequenceFile | �д洢 | �洢�ռ��������,ѹ�����ļ����Էָ�ͺ� ,��ѯЧ�ʸ�,��Ҫͨ��text�ļ�ת��������,�ʺ�ȫ�����Ķ�ȡ |

| RCFile | ���ݰ��зֿ� ÿ�鰴���д洢 | �洢�ռ���С,��ѯ��Ч����� ,��Ҫͨ��text�ļ�ת��������,���ص��ٶ���͡�ѹ���� �����д�ȡ������¼�����漰����block����,��ȡ��Ҫ����ֻ��Ҫ��ȡÿ��row group ��ͷ�����塣 ��ȡȫ�����ݵIJ��� ���ܿ��ܱ�sequencefileû�����Ե����� |

| ORCFile | ���ݰ��зֿ� ÿ�鰴���д洢 | ORC File�������д�������,����ѯ��ʱ���ܿ� |

| Parquet | �д洢 | �����ORC,Parquetѹ���Ƚϵ�,��ѯЧ�ʽϵ�,��֧��update��insert��ACID.����Parquet֧��Impala��ѯ���� |

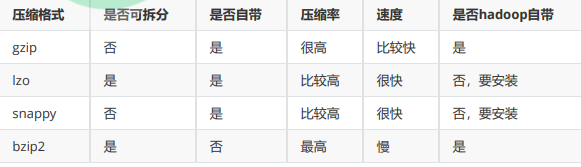

2.3��ѡ����ʵ��ļ�ѹ����ʽ

- ����:Hive ���������ת��Ϊ MapReduce ������ִ�е�,�� MapReduce ������ƿ������ ����IO �� ���� IO,Ҫ�������ƿ��,����Ҫ���Ǽ���������,�����ݽ���ѹ���Ǹ��÷�ʽ��

(1)ѹ����:ѹ����Խ��,ѹ�����ļ�ԽС,����ѹ����Խ��Խ��

(2)ѹ��ʱ��:Խ��Խ��

(3)�Ѿ�ѹ���ĸ�ʽ�ļ��Ƿ�����ٷָ�:���Էָ�ĸ�ʽ������һ�ļ��ɶ��Mapper������,���Ը��õIJ��л�

- �Ƿ�ѹ����ǰ��

1�������ܼ���,��ѹ��,�����һ��������CPU�ĸ���

2�������ܼ���,�Ƽ�ѹ��,��С�������ݴ���

3��HiveSQL����Ż�

3.1���вü�

- ����: Hive �ڶ����ݵ�ʱ��,����ֻ��ȡ��ѯ������Ҫ�õ�����,�����������С����ü�����Ӧ�IJ�����Ϊ:hive.optimize.cp=true(Ĭ��ֵΪ��)��

set hive.optimize.cp = true; ## �вü�,ȡ��ֻȡ��ѯ����Ҫ�õ�����,Ĭ����true

- ��Ҫ����:��ʡ�˶�ȡ����,�м���洢�������������Ͽ����������ٴ��̶�д����������IO������

3.2�������

- ����:�� SQL ����е� where ν��������������ǰִ��,�������δ���������������Ӧ���Ż����� PredicatePushDown��

set hive.optimize.ppd=true; ## Ĭ����true

select a.*, b.* from a join b on a.id = b.id where b.age > 20;

#�Ż���

select a.*, c.* from a join (select * from b where age > 20) c on a.id = c.id

3.3�������ü�

- ����: �����ڲ�ѯ�Ĺ����м��ٲ���Ҫ�ķ���������������Ϊ:hive.optimize.pruner=true(Ĭ��ֵΪ��)��

set hive.optimize.pruner=true; ## Ĭ����true

- ��Ҫ����:���ٶ�ȡ�����Լ��м���洢�������������Ͽ���,���ٴ���IO������IO

3.4���ϲ�С�ļ�

- ����:��������map����,map���ֺ��ļ��������й�,һ���ļ����Ӧһ��map,С�ļ������Ʊ��������map����ͳ�ʼ����ʱ��ԶԶ����������ʱ��,������mapִ��ǰ�ϲ�С�ļ�,����map��

# 1���� map only ���������ʱ�ϲ�С�ļ�

set hive.merge.mapfiles = true

# 2��true ʱ�� MapReduce ���������ʱ�ϲ�С�ļ�

set hive.merge.mapredfiles = false

# 3���ϲ��ļ��Ĵ�С

set hive.merge.size.per.task = 256*1000*1000

# 4��ÿ�� Map ���ָ��С

set mapred.max.split.size=256000000;

# 5��һ���ڵ��� split ������ֵ

set mapred.min.split.size.per.node=1;

# 6��ִ��Mapǰ����С�ļ��ϲ�

set hive.input.format=org.apache.hadoop.hive.ql.io.CombineHiveInputFormat;

- ע������:

- ��Ĭ������Ȱ�����ڵ��ϵ��������ݽ��кϲ�,����ϲ����Ǹ��ļ��Ĵ�С������256M�Ϳ�������һ���� �������ϲ�

- �������ǰ����ڵ��ϵ����ݲ���256M,��ô�Ͷ��ϲ���һ������Ƭ��

3.5����������MapTask���ж�

3.6����������ReduceTask���ж�

3.7��Join�Ż�

3.8��Group By�Ż�

- ����:Map�˲��־ۺ�:��ʵ�ϲ��������еľۺϲ�������Ҫ�� Reduce ���ֽ���,�ܶ�ۺϲ������������� Map �˽��в��� �ۺ�,Ȼ���� Reduce �˵ĵó����ս����

## ����Map�˾ۺϲ�������

set hive.map.aggr=true;

# ����map��Ԥ�ۺϵ�������ֵ,������ֵ�ͻ�ֲ�job,Ĭ��ֵ100000

set hive.groupby.mapaggr.checkinterval=100000

3.9��Order By�Ż�

-

����:order by ֻ������һ�� reduce �����н���,���������һ�������ݼ����� order by ,�ᵼ��һ�� reduce �����д����������൱��,��ɲ�ѯִ�л�����

-

�������:��Ͱ�������������

? �����ȡ������ǰN������,����ʹ��distribute by��sort by�ڸ���reduce�Ͻ��������ǰN ��,Ȼ���ٶԸ���reduce�Ľ�����Ϻϲ�����һ��reduce��ȫ������,��ȡǰN��,��Ϊ����ȫ������� order by�������������reduce���� * N,����ִ��Ч�ʻ��кܴ�������

4��Hive���ò���(Hive�ܹ�����)

4.1��Fetchץȡ

Fetchץȡ:Hive�ж�ijЩ����IJ�ѯ���Բ���ʹ��MapReduce����,��ȫ�ֲ��ҡ��ֶβ��ҡ�limit�����ȶ�����mapreduce��

(1)��hive.fetch.task.conversion���ó�none,Ȼ��ִ�в�ѯ���,����ִ��mapreduce������

hive (default)> **set hive.fetch.task.conversion=none;**

hive (default)> select * from emp;

hive (default)> select ename from emp;

hive (default)> select ename from emp limit 3;

(2)��hive.fetch.task.conversion���ó�more,���²�ѯ��ʽ������ִ��mapreduce������

hive (default)> **set hive.fetch.task.conversion=more;**

hive (default)> select * from emp;

hive (default)> select ename from emp;

hive (default)> select ename from emp limit 3;

4.2������ִ���Ż�

? ����С���ݼ�,����ͨ������ģʽ,�ڵ�̨�����ϴ�����������,ִ��ʱ�����Ա����̡�

## ��hive�Զ��ж��Ƿ���������ģʽ�Ŀ���

set hive.exec.mode.local.auto=true;

## map���������ֵ,�����ñ���ģʽ��task������

set hive.exec.mode.local.auto.input.files.max=4;

## map�����ļ�����С,����������ģʽ����������ļ���С

set hive.exec.mode.local.auto.inputbytes.max=134217728;

4.3��JVM����

? �������ʱ��ܶ�,��Ҫ������� JVM �������,JVM ������ʱ�����һ���Ƚϴ������,��ʱ,����ͨ������ JVM �������

set mapred.job.reuse.jvm.num.tasks=5;

- ע������:JVMҲ����ȱ���,����JVM���û�һֱռ��ʹ�õ��� task �IJ��,�Ա��������,ֱ��������ɺ�� ���ͷš�

4.4�����ж��Ż�

- ����:**Hive�Ὣһ����ѯת����һ�����߶����,MapReduce�Ρ������Ρ��ϲ��Ρ�limit��,Ĭ�����hiveһ��ֻ��ִ��һ���Ρ�**����Щ�ο��ܲ�����ȫ����������,Ҳ����˵��Щ���ǿ��Բ���ִ�е�,��������ʹ������job��ִ��ʱ�����̡�

set hive.exec.parallel=true; #��������ִ��

set hive.exec.parallel.thread.number=16; #ͬһ��sql��������ж�,Ĭ��Ϊ8��

4.5���Ʋ�ִ��

? Hadoop�������Ʋ�ִ��(Speculative Execution)����,�� ����һ���ķ����Ʋ�����Ϻ��ȡ�������,��Ϊ��������������һ����������,�ø�������ԭʼ����ͬʱ����ͬһ������,������ѡ�����ȳɹ������������ļ�������Ϊ���ս����

# ����mapper�ε��Ʋ�ִ�л���

set mapreduce.map.speculative=true;

# ����reducer�ε��Ʋ�ִ�л���

set mapreduce.reduce.speculative=true;

- ע������:����û���Ϊ�����������ܴ����Ҫִ�г�ʱ��� mapTask ���� reduceTask �Ļ�,��ô�����Ʋ�ִ����ɵ��˷��Ƿdz�����

5��Hive������б

5.1�����������

? ���ݷֲ�����,��ɴ������ݼ��е�һ��,��������ȵ㡣

5.2��������б�ı���

(1)��ִ�������ʱ��,������ȳ�ʱ��ά����99%����;

(2)�鿴stage��ִ�����ʱ,�������1-2��task��ʱ�䲻��,�鿴task���ҳ��,����ij����ij������task���е�ʱ��ԶԶ��������task������ʱ��,��Щtask������������ҲԶԶ��������task��

- ע������:����Hive On Spark,һ��spark���������ʱ���������һ��ִ�гɹ���task������,���ij��task������������б,����������spark����ִ��Ч��,��������û����б��task�Ѿ�ִ�����,�����ᵼ��OOM

3���鿴������б����

��yarn����鿴�Ƿ����������б:

��ͼ��yarn����task�ļ��ҳ��,����ͼ���Կ�����task��ִ��ʱ����25s,������¼��Ϊ����ʮ��(������������Ϊ������ʮ��),������һ��task����ʱ��Ϊ1Сʱ�����������ߴ�72G�һ�ûִ����,��ʱ�����ƶ����ݷ�������б,����ͨ��group by���߳����ҳ���бkey��

4�����������

���ݼ���ʱ������shuffle,�������ݽ��������·�����

| �ؼ��� | ���� | ��� |

|---|---|---|

| join | ij����ij����key�Ƚϼ���,���ߴ��ڴ���null key | �ַ���ijһ������ij����Reduce�ϵ�����Զ����ƽ��ֵ |

| group by | ά�ȹ�С,ijֵ���������� | ij��ά�Ȼ���ij����ά������Щά�ȵ��������ر��,������һ��reduce |

5��������б�Ľ������

5.1�����������

��ͬ��������������������б

-

����:�����û�����user_id�ֶ�Ϊint,log����user_id�ֶ�string���͡�������user_id������������Join����ʱ��

-

�����ʽ:����������ת�����ַ�������

select * from users a

left outer join logs b

on a.usr_id = cast(b.user_id as string)

��null key���������

select

a.*

from(

select

*

from log

where user_id is not null

) a

join

users b on a.user_id = b.user_id

union all

select

*

from log where user_id is null

�����ݼ���:����nullֵ���ֵ

1. select *

2. from log a

3. left outer join users b

4. on case when a.user_id is null then concat('hive',rand() ) else a.user_id end = b.user_id;

- ���ַ�ʽ��ȱ��Ƚ�

����2�ȷ���1Ч�ʸ���,����io����,������ҵ��Ҳ���ˡ�

�������1�� log��ȡ����,jobs��2���������2 job����1 ;

����Ż��ʺ���Ч id (���� -99 , ����, null ��) ��������б���⡣

�ѿ�ֵ�� key ���һ���ַ������������,���ܰ���б�����ݷֵ���ͬ��reduce�� ,���������б���⡣

�����reduce���ж�

����reduce����:set mapred.reduce.tasks=15,����ͨ���IJ������reduce�˲��ж�,�Ӷ�����������б�������

��δ�Ż�ǰ,����key1��key2��key3��key4������������50w,key5��10w,��ʱkey1��key3shuffle����һ��reduce,key2��key4shuffle����һ��reduce,����������reduce task��Ҫ����100w����,����һ��taskֻ��Ҫ����10w����,��ʱ���ݳ�����10������б��

���Ż���,��ͼ��ʾ,Ϊ�Ż�ǰreduce�IJ��ж�Ϊ3,����task���������������Ϊ100w,���ڽ����ж���ߵ�5,����task���������������Ϊ50w,���֮ǰ������5������б�̶ȡ��˷����ʺ���б�ij̶Ȳ��Ǻ�����,�����������ϵ���бkey��shuffle����ͬһ��reduce��

5.2��group by���µ�������б

(1)�������ؾ���

- ����:��������б��ʱ����и��ؾ���(Ĭ����false)

set hive.groupby.skewindata = true

- ��ѡ���趨Ϊ true,���ɵIJ�ѯ�ƻ���������MR Job��

�ٵ�һ��MR Job:Map��������������ֲ���Reduce��,ÿ��Reduce�����־ۺϲ���,��������,���������Ľ������ͬ��Group By Key�п��ܱ��ַ�����ͬ��Reduce��,�Ӷ��ﵽ���ؾ����Ŀ��;

�ڵڶ���MR Job:����Ԥ���������ݽ������Group By Key�ֲ���Reduce��(������̿��Ա�֤��ͬ��Group By Key���ֲ���ͬһ��Reduce��),���������յľۺϲ�����

(2)group by ˫�ؾۺ�

��ʹ��group by���оۺ�ͳ��ʱ,�������ij����ij����key��������б,�ᵼ��ij����бkey shuffle��һ��reduce��

select

split(sp_app_id,'_')[0] sp_app_id

,sum(pv)

from

(

select

sp_app_id||'_'||CAST(CAST(MOD(rand() * 10000,10) AS BIGINT) AS STRING) sp_app_id

,sum(nvl(op_cnt, 1)) pv

from t1

group by sp_app_id||'_'||CAST(CAST(MOD(rand() * 10000,10) AS BIGINT) AS STRING)

) group by split(sp_app_id,'_')[0]

5.3��join���µ�������б

(1)reduce join ת���� map join(�˷����ʺ�С��join�����ʱ��)

select /+ mapjoin(t2)/ column from table

(2)������бjoin��������join(�˷����ʺϴ���������)

�����������бkey���˳�������ȥjoin,�����бkey�ͻ��ɢ�����taskȥ����join����,���union all��

select

*

from

(

select

*

from t1

where rowkey <> '123456789'

) a1 join a2 on a1.rowkey = a2.rowkey

union all

select

*

from

(

select

*

from t1

where rowkey = '123456789'

)a1 join a2 on a1.rowkey = a2.rowkey

��md5+��Ͱ�������й���(PB�������ݹ���PB��������,��Ч100��+)

- �ȵ����ݴ�����ʽ:�ȵ�����ֱ�ӹ��˳����ֿ�Join,md5(key1,Key2)���Ͱ����

5.4����ҵʵս����֮��־�����û���������

- ҵ��:��ʵ����ά�ȱ�������,���������С��,���Dz���ֱ��ʹ��mapJoin

(1)ʵ��ҵ������

? users ���� 600w+ (������5G)�ļ�¼,�� users �ַ������е� map ��Ҳ�Ǹ���С�Ŀ���,���� MapJoin ��֧����ô���С�����������ͨ�� join,�ֻ�����������б�����⡣

(2)�������

- ԭ��:��ǰ�ų�user���е�û�õ�ID,����С���������� ==�����Էֱ����û���ȫ����/�켶ȫ����

���ȵõ����˵�userid

select distinct user_id from log ==�� a

���ٻ�ȡ����־��¼�����û�����Ϣ

select b.* from a join users b on a.user_id = b.user_id; ==��b

����C����log��������

select /*+mapjoin(x)*/ * from log c left outer join d

on a.user_id = x.user_id;

5.5����ҵʵս����֮λͼ�����������������Ȧ�û�

- ҵ��:��ʵ������ʵ��������,������������

(1)ʵ��ҵ������

ÿ�춼Ҫ�� ������Ȧ ��ȥ����7�춼��������Ȧ��С�������Щ? ����ÿ���û�ÿ��һ������Ȧ����¼��һ����־��ÿһ������Ȧ����������:

����,�û�ID,����Ȧ����.....

dt, userid, content, .....

��� ������Ȧ�� ��־����,�����������˷�����

2020-07-06 file1.log(���ܻ�dz���)

2020-07-05 file2.log

.......

(2)��Q����

- ԭ��:λͼ��BitMaps,��ά��һ��λ����

��������10E�û�,����ÿ������һ������Ϊ10E�Ķ���������,ÿ��λ��Ҫô��0,Ҫô��1,���Ϊ1,��

�����û����췢������Ȧ�����Ϊ0,����û�з�����Ȧ��

Ȼ��ÿ��:10E / 8 / 1024 / 1024 = 119M����

��Joinʵ��:���������� ���ҡ���������������

5.6����ҵʵս����֮�û�����

- ҵ��:��ʵ����ʵʱ��������,������������

(1)ʵ��ҵ������

? һ������Ӫ����BI��������,���������û�����ʱ,�û������Ǹ�����ȱ�ٵĹ���,Ҳ��ҵ��������û������Ƚϳ�����жϱ�,��Ҫָ��,���������û����ա�3�ա�7�ա�30�졢90��ȵ������ʡ�

- ָ��˵��:�û������� -����������100���û�,�ڶ����½��50��,�����������Ϊ50/100=50%,�������¼��30��,��ڶ���������Ϊ30/100=30%

(2)�������

- ԭ��:�����켶ȫ���û���

����һ:�����ݿ�����ȡuser_id��login_time, ������ first_day, ���ڴ洢ÿ���û�ID�����¼����(��С����);

�����:�õ�¼����-�����¼����,�õ�ÿ����¼���ھ��������¼���ڵ�ʱ����,����������;

������:�Բ�ͬ�������ڵ�user_id���л��ܾ�����������,�������յ�¼����,�͵õ��˲�ͬ����ʱ��������ʡ�

select

a.dt

,count(distinct a.id) as `�ջ�Ծ�û�`

,count(distinct b.id) as `����������`

,count(distinct c.id) as `����������`

,count(distinct d.id) as `����������`

,concat(round(count(distinct b.id) / count(distinct a.id) * 100, 2), '%') as `����������`

,concat(round(count(distinct c.id) / count(distinct a.id) * 100, 2), '%') as `����������`

,concat(round(count(distinct d.id) / count(distinct a.id) * 100, 2), '%') as `����������`

-- select *

from yhlc a

LEFT join yhlc b on a.id=b.id and b.dt=a.dt+1

LEFT join yhlc c on a.id=c.id and c.dt=a.dt+3

LEFT join yhlc d on a.id=d.id and d.dt=a.dt+7

group by a.dt;

6���ռ�����

- ���ϰ�ҪǮ�������Դ