Hadoop ����

1.Hadoop��ʲô?

����:Hadoop��̬Ȧ�Ĵ�����

����:Apache �������������Java ���Կ�����һ����Դ�ֲ�ʽ����ƽ̨

2.Hadoop��չ��ʷ

��Դ:2005��,Hadoop��ΪLucene����ĿNutch��һ������ʽ������Apache�����,����ִ�Nutch�а���,��Ϊһ����������������,����ΪHadoop��

Lucene �� Doug Cutting ʹ�� Java ��д��Դ����,Lucene ��ʵ��һ���������档

2003-2004 ��,Google �����˲��� GFS(Google File System) �� MapReduce ˼���ϸ��,��ʵ������ƪ���� ��

Doug Cutting ������ 2 ���ҵ��ʱ��ʵ���� DFS(Distributed File System) �� MapReduce ���ơ�

����:������������ҵ��Ժ������ݵĴ洢�ͼ����������ƿ��

����ԴȪ:�ȸ�����Ĵ���������

3.Hadoop�İ汾��չ

ѧϰ��:�ص�����Apache�Ļ����汾

��������һ��ʹ����ҵ���������(CDH�汾)

4. Hadoop������(4��)

�߿ɿ���:Hadoop��λ�洢�ʹ������ݵ�����ֵ������������

����չ��:Hadoop���ڿ��õļ�������ؼ�������ݲ���ɼ��������,��Щ���ؿ��Է������չ������ǧ�ƵĽڵ��С�

��Ч��:Hadoop�ܹ��ڽڵ�֮�䶯̬���ƶ�����,����֤�����ڵ�Ķ�̬ƽ��,��˴����ٶȷdz��졣

���ݴ���:Hadoop�ܹ��Զ��������ݵĶ������,�����ܹ��Զ���ʧ�ܵ��������·��䡣

5. Hadoop����ɲ���

-- HDFS (hadoop����ɲ���-���������ݵĴ洢)

-- NameNode(nn):������ʵ���ݵ�Ԫ���ݵ�(hdfs��Ⱥ�е��ϴ�)

-- DataNode(dn):��Ҫ�������ʵ���ݿ�洢(hdfs��Ⱥ�е�С��)

-- SecondaryNameNode(2nn):��ҪΪNameNode����һЩ���ݱ���,

һ��ָ����ݵ�ʱ��Ż��õ���,��Ҳ���ܱ�֤��ȫ���ݻָ���

-- YARN (hadoop����ɲ���,��Ҫ������Դ����)

-- ResourceManager(rm):ͳ�����ÿһ̨�����ϵ���Դ,���Ҹ�����մ����ͻ���

��ҵ����

-- NodeManager(nm):����ÿһ̨��������Դ����,ʵʱ��֤�ʹ��

(ResourceManager)ͨ�š�

-- ApplicationMaster:���ÿ������job�ij����װ

-- Container:����������YARN�ϵ�ÿһ��������������Դ,

Container���ǵ�ǰ����������Դ�ij����װ

-- MapReduce(hadoop����ɲ���,��Ҫ�������ݵļ������)

-- Map��:���ǰ���Ҫ��������ݰ�������ֳɶ��MapTask������ִ��

-- Reduce��: ��Map�δ�����Ľ��������������������л��ܼ���

Hadoop�����

ģ���������

1)��һ̨ģ������� hadoop100

ע:����Linuxϵͳ����ȫ����CentOS-7.5-x86-1804Ϊ��˵��

ģ�������:�ڴ�4G,Ӳ��50G

��װ��Ҫ����,Ϊ��װhadoop����

[root@hadoop100 ~]# yum install -y epel-release

[root@hadoop100 ~]# yum install -y psmisc nc net-tools rsync vim lrzsz ntp libzstd openssl-static tree iotop git

epel ����Ǻܳ�������Դ,���� python3, zabbix ����Ҫ�õ� epel

2)�رշ���ǽ,�رշ���ǽ��������

[root@hadoop100 ~]# systemctl stop firewalld

[root@hadoop100 ~]# systemctl disable firewalld

3)�����û�,�����û�������

[root@hadoop100 ~]# useradd yls

[root@hadoop100 ~]# passwd yls

4)�����û�����rootȨ��,������ڼ�sudoִ��rootȨ������

[root@hadoop100 ~]# vim /etc/sudoers

��/etc/sudoers�ļ�,�ҵ�����һ��(91��),��root��������һ��

## Allow root to run any commands anywhere

root ALL=(ALL) ALL

yls ALL=(ALL) NOPASSWD:ALL

5)��/optĿ¼�´����ļ���,������������������

(1)��/optĿ¼�´���module��software�ļ���

[root@hadoop100 ~]# mkdir /opt/module

[root@hadoop100 ~]# mkdir /opt/software

(2)��module��software�ļ��е������ߺ��������Ϊatguigu�û�

[root@hadoop100 ~]# chown yls:yls /opt/module

[root@hadoop100 ~]# chown yls:yls /opt/software

(3)�鿴module��software�ļ��е������ߺ�������

[root@hadoop100 ~]# cd /opt/

[root@hadoop100 opt]# ll

������ 12

drwxr-xr-x. 2 yls yls 4096 5�� 28 17:18 module

drwxr-xr-x. 2 yls yls 4096 5�� 28 17:18 software

6)ж��������Դ���open JDK

[root@hadoop100 ~]# rpm -qa | grep -i java | xargs -n1 rpm -e --nodeps

��ѯ��ж��

7)���������

[root@hadoop100 ~]# reboot

�������¡

1)����ģ���hadoop100,��¡��̨�����:hadoop102 hadoop103 hadoop104

2)�Ŀ�¡��IP,������hadoop102����˵��

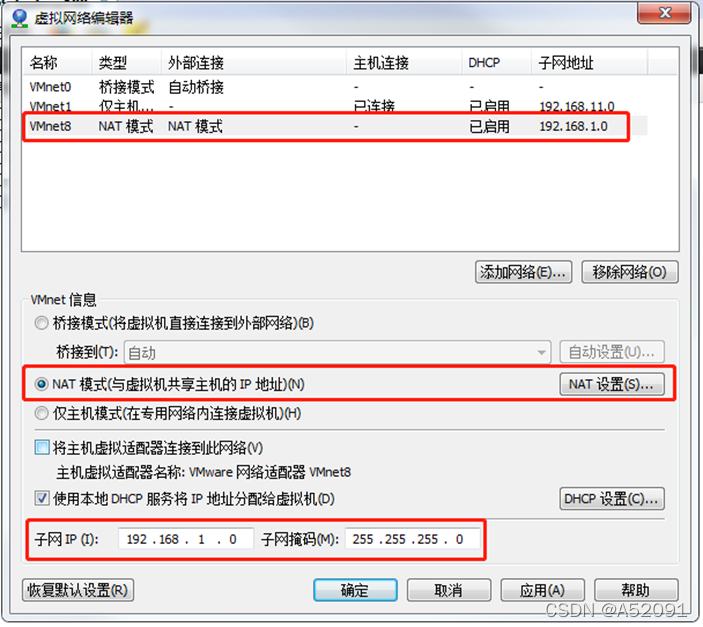

(1)�鿴Linux���������������༭��,�༭->��������༭��->VMnet8

(2)�鿴Windowsϵͳ������VMware Network Adapter VMnet8��IP��ַ

(3)�Ŀ�¡������ľ�̬IP

[root@hadoop100 ~]# vim /etc/sysconfig/network-scripts/ifcfg-ens33

�ij�

DEVICE=ens33

TYPE=Ethernet

ONBOOT=yes

BOOTPROTO=static

NAME=��ens33��

IPADDR=192.168.1.102 //��̬ip��ַ �����Լ�����

PREFIX=24

GATEWAY=192.168.1.2 /����

DNS1=192.168.1.2

��֤Linuxϵͳifcfg-ens33�ļ���IP��ַ����������༭����ַ��WindowsϵͳVM8����IP��ַ

3)�Ŀ�¡��������,������hadoop102����˵��

(1)����������,���ַ�����ѡһ

[root@hadoop100 ~]# hostnamectl --static set-hostname hadoop102

������/etc/hostname�ļ�

[root@hadoop100 ~]# vim /etc/hostname

hadoop102

(2)����linux��¡����������ӳ��hosts�ļ�,��/etc/hosts

[root@hadoop100 ~]# vim /etc/hosts

������������

192.168.1.100 hadoop100

192.168.1.101 hadoop101

192.168.1.102 hadoop102

192.168.1.103 hadoop103

192.168.1.104 hadoop104

4)������¡��hadoop102

[root@hadoop100 ~]# reboot

5)��windows������ӳ���ļ�(hosts�ļ�)

(1)�������ϵͳ��window7,����ֱ����

(a)����C:\Windows\System32\drivers\etc·��

(b)��hosts�ļ���������������,Ȼ��

192.168.1.100 hadoop100

192.168.1.101 hadoop101

192.168.1.102 hadoop102

192.168.1.103 hadoop103

192.168.1.104 hadoop104

(2)�������ϵͳ��window10,�ȿ�������,�ı����Ժ�,�ٸ��Ǽ���

(a)����C:\Windows\System32\drivers\etc·��

(b)����hosts�ļ�������

(c)������hosts�ļ���������������

192.168.1.100 hadoop100

192.168.1.101 hadoop101

192.168.1.102 hadoop102

192.168.1.103 hadoop103

192.168.1.104 hadoop104

(d)������hosts�ļ�����C:\Windows\System32\drivers\etc·��hosts�ļ�

��װJDK Hadoop

1)�����JDK

[yls@hadoop102 ~]$ rpm -qa | grep -i java | xargs -n1 sudo rpm -e --nodeps

2)����JDK,��JDK���뵽optĿ¼�����software�ļ�������

����Hadoop,��JDK���뵽optĿ¼�����software�ļ�������

3)��Linuxϵͳ�µ�optĿ¼�в鿴�������Ƿ���ɹ�

[yls@hadoop102 ~]$ ls /opt/software/

�������½��:

hadoop-3.1.3.tar.gz jdk-8u212-linux-x64.tar.gz

6)��ѹJDK��/opt/moduleĿ¼��

[yls@hadoop102 software]$ tar -zxvf jdk-8u212-linux-x64.tar.gz -C /opt/module/

��ѹHadoop��װ�ļ���/opt/module����

[yls@hadoop102 software]$ tar -zxvf hadoop-3.1.3.tar.gz -C /opt/module/

8)����JDK�Ƿ�װ�ɹ�

[yls@hadoop102 ~]$ java -version

����ܿ������½��,�����Java��װ�ɹ���

java version ��1.8.0_212��

��Hadoop���ӵ���������

��ȡHadoop��װ·��

[yls@hadoop102 hadoop-3.1.3]$ pwd

/opt/module/hadoop-3.1.3

��/etc/profile.d/my_env.sh�ļ�

sudo vim /etc/profile.d/my_env.sh

��my_env.sh�ļ�ĩβ������������:(shift+g)

#HADOOP_HOME

export HADOOP_HOME=/opt/module/hadoop-3.1.3

export PATH= P A T H : PATH: PATH:HADOOP_HOME/bin

export PATH= P A T H : PATH: PATH:HADOOP_HOME/sbin

������˳�

:wq

���ĺ���ļ���Ч

[yls@hadoop102 hadoop-3.1.3]$ source /etc/profile

�����Ƿ�װ�ɹ�

[yls@hadoop102 hadoop-3.1.3]$ hadoop version

Hadoop 3.1.3

HadoopĿ¼�ṹ

1)�鿴HadoopĿ¼�ṹ

[yls@hadoop102 hadoop-3.1.3]$ ll

������ 52

drwxr-xr-x. 2 yls yls 4096 5�� 22 2019 bin

drwxr-xr-x. 3 yls yls 4096 5�� 22 2019 etc

drwxr-xr-x. 2 yls yls 4096 5�� 22 2019 include

drwxr-xr-x. 3 yls yls 4096 5�� 22 2019 lib

drwxr-xr-x. 2 yls yls 4096 5�� 22 2019 libexec

-rw-r�Cr�C. 1 yls yls 15429 5�� 22 2019 LICENSE.txt

-rw-r�Cr�C. 1 yls yls 101 5�� 22 2019 NOTICE.txt

-rw-r�Cr�C. 1 yls yls 1366 5�� 22 2019 README.txt

drwxr-xr-x. 2 yls yls4 096 5�� 22 2019 sbin

drwxr-xr-x. 4 yls yls 4096 5�� 22 2019 share

2)��ҪĿ¼

(1)binĿ¼:��Ŷ�Hadoop��ط���(HDFS,YARN)���в����Ľű�

(2)etcĿ¼:Hadoop�������ļ�Ŀ¼,���Hadoop�������ļ�

(3)libĿ¼:���Hadoop�ı��ؿ�(�����ݽ���ѹ����ѹ������)

(4)sbinĿ¼:���������ֹͣHadoop��ط���Ľű�

(5)shareĿ¼:���Hadoop������jar�����ĵ����ٷ�����

��ȫ�ֲ�ʽ���Ƽ�����

��д��Ⱥ�ַ��ű�xsync

1)scp(secure copy)��ȫ����

(1)scp����:

scp����ʵ�ַ������������֮������ݿ�����(from server1 to server2)

(2)�����

scp -r $pdir/$fname $user@hadoop$host:$pdir/$fname

���� �ݹ� Ҫ�������ļ�·��/���� Ŀ���û�@����:Ŀ��·��/����

(3)����ʵ��

ǰ��:�� hadoop102 hadoop103 hadoop104 ���Ѿ������õ� /opt/module /opt/software ����Ŀ¼, �����Ѿ���������Ŀ¼��Ϊyls:yls sudo chown yls:yls -R /opt/module

(a)��hadoop102��,��hadoop102��/opt/module/jdk1.8.0_212Ŀ¼������hadoop103�ϡ�

[yls@hadoop102 ~]$ scp -r /opt/module/jdk1.8.0_212 yls@hadoop103:/opt/module

(b)��hadoop103��,��hadoop102��/opt/module/hadoop-3.1.3Ŀ¼������hadoop103�ϡ�

[yls@hadoop103 ~]$ scp -r yls@hadoop102:/opt/module/hadoop-3.1.3 /opt/module/

(c)��hadoop103�ϲ���,��hadoop102��/opt/moduleĿ¼������Ŀ¼������hadoop104�ϡ�

[yls@hadoop103 opt]$ scp -r yls@hadoop102:/opt/module/* yls@hadoop104:/opt/module

rsyncԶ��ͬ������

rsync��Ҫ���ڱ��ݺ;������ٶȿ졢���⸴����ͬ���ݺ�֧�ַ������ӵ��ŵ㡣

rsync��scp����:��rsync���ļ��ĸ���Ҫ��scp���ٶȿ�,rsyncֻ�Բ����ļ������¡�scp�ǰ������ļ������ƹ�ȥ��

���������:

$ rsync -r source destination

-r��ʾ�ݹ�,��������Ŀ¼��ע��,-r�DZ����,���� rsync ���в���ɹ���sourceĿ¼��ʾԴĿ¼,destination��ʾĿ��Ŀ¼��

����ж���ļ���Ŀ¼��Ҫͬ��,����д������������

$ rsync -r source1 source2 destination

����������,source1��source2���ᱻͬ����destinationĿ¼

-a�����������-r,���˿��Եݹ�ͬ������,������ͬ��Ԫ��Ϣ(������ʱ�䡢Ȩ��)������ rsync Ĭ��ʹ���ļ���С����ʱ������ļ��Ƿ���Ҫ����,����-a��-r�����á�������÷����dz�����д����

$ rsync -a source destination

rsync ����֧�ֱ�������Ŀ¼֮���ͬ��,Ҳ֧��Զ��ͬ���������Խ���������,ͬ����Զ�̷�������

$ rsync -av source/ username@remote_host:destination

-v�������ǽ����������ն�,�����Ϳ��Կ�����Щ���ݻᱻͬ����

����ʵ��

��hadoop102�����ϵ�/opt/softwareĿ¼ͬ����hadoop103��������/opt/softwareĿ¼��

[yls@hadoop102 opt]$ rsync -av /opt/software/* yls@hadoop103:/opt/software

xsync��Ⱥ�ַ��ű�

(1)����:ѭ�������ļ������нڵ����ͬĿ¼��

(2)�������:

(a)rsync����ԭʼ����:

rsync -av /opt/module root@hadoop103:/opt/

(b)�����ű�:

xsyncҪͬ�����ļ�����

(c)˵��:��/home/yls/bin���Ŀ¼�´�ŵĽű�,yls�û�������ϵͳ�κεط�ֱ��ִ�С�

(3)�ű�ʵ��

(a)��/home/yls/binĿ¼�´���xsync�ļ�

[yls@hadoop102 opt]$ cd /home/yls

[yls@hadoop102 ~]$ mkdir bin

[yls@hadoop102 ~]$ cd bin

[yls@hadoop102 bin]$ vim xsync

�ڸ��ļ��б�д���´���

#!/bin/bash

#1. �жϲ�������

if [ $# -lt 1 ]

then

echo Not Enough Arguement!

exit;

fi

#2. ������Ⱥ���л���

for host in hadoop102 hadoop103 hadoop104

do

echo ==================== $host ====================

#3. ��������Ŀ¼,��������

for file in $@

do

#4. �ж��ļ��Ƿ����

if [ -e $file ]

then

#5. ��ȡ��Ŀ¼

pdir=$(cd -P $(dirname $file); pwd)

#6. ��ȡ��ǰ�ļ�������

fname=$(basename $file)

ssh $host "mkdir -p $pdir"

rsync -av $pdir/$fname $host:$pdir

else

echo $file does not exists!

fi

done

done

(b)�Ľű� xsync ����ִ��Ȩ��

[yls@hadoop102 bin]$ chmod +x xsync

(c)���ű����Ƶ�/bin��,�Ա�ȫ�ֵ���

[yls@hadoop102 bin]$ sudo cp xsync /bin/

(d)���Խű�

[yls@hadoop102 ~]$ xsync /home/yls/bin

[yls@hadoop102 bin]$ sudo xsync /bin/xsync

SSH���ܵ�¼����

SSH ������һ����Կ,�ֱ��ǹ�Կ��˽Կ,��Կ��˽Կ�ǿ��Ի�����н���,���Dz����Լ����Լ�����

.ssh�ļ�����(~/.ssh)���ļ����ܽ���

| name | ���� |

|---|---|

| known_hosts | ��¼ssh���ʹ�������Ĺ�Կ(public key)(��֪�������б�) |

| id_rsa | ���ɵ�˽Կ |

| id_rsa.pub | ���ɵĹ�Կ |

| authorized_keys | �����Ȩ�������ܵ�¼��������Կ(��Կ����֤�б�) |

# ��װ SSH ����

yum install -y openssh-server openssh-clients

���ɹ�˽Կ:ssh-keygen -t rsa

�������Ĺ�Կ���͵�Ŀ���������֤�б� (authorized_keys) ��

���²���ÿ���ڵ㶼��һ��

ssh-copy-id hadoop102

ssh-copy-id hadoop103

ssh-copy-id hadoop104

ע��:

����Ҫ��hadoop103�ϲ���yls�˺�����һ�����ܵ�¼��hadoop102��hadoop103��hadoop104�������ϡ�

����Ҫ��hadoop104�ϲ���yls�˺�����һ�����ܵ�¼��hadoop102��hadoop103��hadoop104�������ϡ�

����Ҫ��hadoop102�ϲ���root�˺�,����һ�����ܵ�¼��hadoop102��hadoop103��hadoop104;

��Ⱥ�滮

| - | hadoop102 | hadoop103 | hadoop104 |

|---|---|---|---|

| HDFS | NameNode DataNode | DataNode | SecondaryNameNode DataNode |

| YARN | NodeManager | ResourceManager NodeManager | NodeManager |

ע��:NameNode��SecondaryNameNode��Ҫ��װ��ͬһ̨������

ע��:ResourceManagerҲ�������ڴ�,��Ҫ��NameNode��SecondaryNameNode������ͬһ̨�����ϡ�

���ö˿ں�˵��

| Daemon | App | Hadoop2 | Hadoop3 |

|---|---|---|---|

| NameNode Port | Hadoop HDFS NameNode | 8020 / 9000 | 9820 |

| ` | Hadoop HDFS NameNode HTTP UI | 50070 | 9870 |

| Secondary NameNode Port | Secondary NameNode | 50091 | 9869 |

| - | Secondary NameNode HTTP UI | 50090 | 9868 |

| DataNode Port | Hadoop HDFS DataNode IPC | 50020 | 9867 |

| - | Hadoop HDFS DataNode | 50010 | 9866 |

| - | Hadoop HDFS DataNode HTTP UI | 50075 | 9864 |

��Ⱥ����

����core-site.xml

[yls@hadoop102 ~]$ cd $HADOOP_HOME/etc/hadoop

[yls@hadoop102 hadoop]$ vim core-site.xml

����Ϊ

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- ָ��NameNode�ĵ�ַ -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop102:9820</value>

</property>

<!-- ָ��hadoop���ݵĴ洢Ŀ¼ -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/module/hadoop-3.1.3/data</value>

</property>

<!-- ����HDFS��ҳ��¼ʹ�õľ�̬�û�Ϊatguigu -->

<property>

<name>hadoop.http.staticuser.user</name>

<value>atguigu</value>

</property>

<!-- ���ø�atguigu(superUser)����ͨ���������ʵ������ڵ� -->

<property>

<name>hadoop.proxyuser.atguigu.hosts</name>

<value>*</value>

</property>

<!-- ���ø�atguigu(superUser)����ͨ�������û������� -->

<property>

<name>hadoop.proxyuser.atguigu.groups</name>

<value>*</value>

</property>

<!-- ���ø�atguigu(superUser)����ͨ���������û�-->

<property>

<name>hadoop.proxyuser.atguigu.groups</name>

<value>*</value>

</property>

</configuration>

����hdfs-site.xml

����hdfs-site.xml

[yls@hadoop102 hadoop]$ vim hdfs-site.xml

�ļ���������:

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- nn web�˷��ʵ�ַ-->

<property>

<name>dfs.namenode.http-address</name>

<value>hadoop102:9870</value>

</property>

<!-- 2nn web�˷��ʵ�ַ-->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop104:9868</value>

</property>

</configuration>

����yarn-site.xml

[yls@hadoop102 hadoop]$ vim yarn-site.xml

�ļ���������:

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- ָ��MR��shuffle -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- ָ��ResourceManager�ĵ�ַ-->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop103</value>

</property>

<!-- ���������ļ̳� -->

<property>

<name>yarn.nodemanager.env-whitelist</name>

<value>JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CONF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_MAPRED_HOME</value>

</property>

<!-- yarn������������������С�ڴ� -->

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>512</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>4096</value>

</property>

<!-- yarn�������������������ڴ��С -->

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>4096</value>

</property>

<!-- �ر�yarn�������ڴ�������ڴ�����Ƽ�� -->

<property>

<name>yarn.nodemanager.pmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

</configuration>

MapReduce�����ļ�

����mapred-site.xml

[yls@hadoop102 hadoop]$ vim mapred-site.xml

��������

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- ָ��MapReduce����������Yarn�� -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

�ڼ�Ⱥ�Ϸַ����úõ�Hadoop�����ļ�

[yls@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.1.3/etc/hadoop/

ȥ103��104�ϲ鿴�ļ��ַ����

[yls@hadoop103 ~]$ cat /opt/module/hadoop-3.1.3/etc/hadoop/core-site.xml

[yls@hadoop104 ~]$ cat /opt/module/hadoop-3.1.3/etc/hadoop/core-site.xml

Ⱥ��Ⱥ

����workers

[yls@hadoop102 hadoop]$ vim /opt/module/hadoop-3.1.3/etc/hadoop/workers

�ڸ��ļ���������������:

hadoop102

hadoop103

hadoop104

ע��:���ļ������ӵ����ݽ�β�������пո�,�ļ��в������п��С�

ͬ�����нڵ������ļ�

[yls@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.1.3/etc

������Ⱥ

�����Ⱥ�ǵ�һ������,��Ҫ��hadoop102�ڵ��ʽ��NameNode(ע���ʽ��NameNode,������µļ�Ⱥid,����NameNode��DataNode�ļ�Ⱥid��һ��,��Ⱥ�Ҳ����������ݡ������Ⱥ�����й����б���,��Ҫ���¸�ʽ��NameNode�Ļ�,һ��Ҫ��ֹͣnamenode��datanode����,����Ҫɾ�����л�����data��logsĿ¼,Ȼ���ٽ��и�ʽ����)

��Ⱥ��������ʽ������,һ���ǵ�����������,����һ�������� Hadoop �ٷ��������ṩ�Ľű���ģ������

�����Ⱥ�ǵ�һ������,��Ҫ��ʽ�� NameNode,NameNode ����ֻ��ʽ��һ��!!!

�� Hadoop ��Ⱥ����ʧ��,������Ҫ���¸�ʽ��,�����������������:

��ÿ��������� /opt/module/hadoop-3.1.3/logs�� /opt/module/hadoop-3.1.3/data�� /opt/module/hadoop-3.1.3/pid ɾ��

���ֲ���ÿ���ڵ㶼��Ҫ

��ʽ�� NameNode

hadoop namenode -format

����

�������������ֹͣ

# ���߱�ʾ��ѡ 1

hadoop-daemon.sh start|stop namenode|datanode|secondarynamenode

# yarn ��صķ���

yarn-daemon.sh start|stop resourcemanager|nodemanager

ģ�黯�Ľű�������ֹͣ

# �˽ű������� namenode ���еĻ�����ִ��

start-dfs.sh

stop-dfs.sh

# �˽ű������� resourcemanager ���еĻ�����ִ��

start-yarn.sh

stop-yarn.sh

Web�˲鿴HDFS��NameNode

(a)�����������:http://hadoop102:9870

(b)�鿴HDFS�ϴ洢��������Ϣ

Web�˲鿴YARN��ResourceManager

(a)�����������:http://hadoop103:8088

(b)�鿴YARN�����е�Job��Ϣ