����

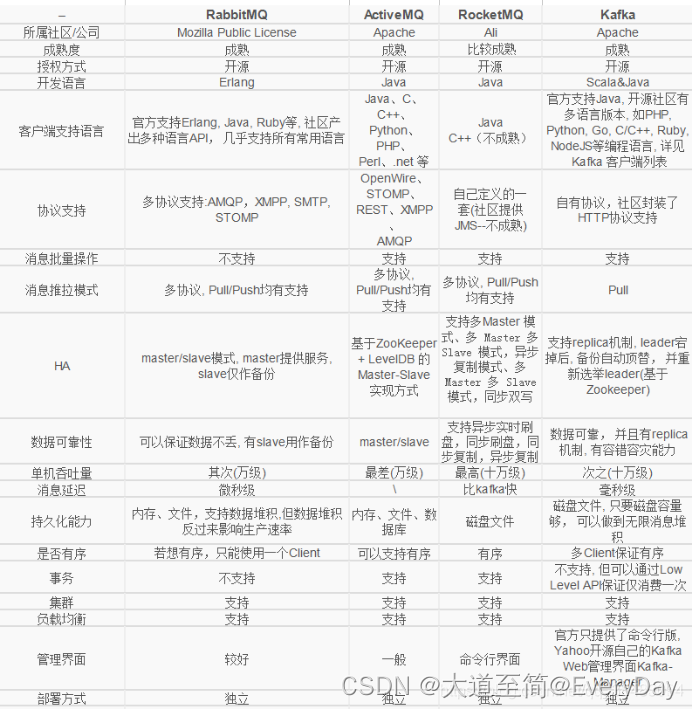

��ͳ����:Kafka��һ���ֲ�ʽ�Ļ�����������ģʽ����Ϣ����,��Ҫ���ڴ�����ʵʱ��������

���¶���: Kafka��һ����Դ�ķֲ�ʽ�¼���ƽ̨,��Ҫ���ڸ����ܵ�����ͨ��,������,���ݼ��ɺؼ�����Ӧ�á�

��Ϣ����

Ӧ�ó���

1,�첽����

2,ϵͳ����

3,��������

4,��־����

5,��ϢͨѶ

����ģʽ

��Ե�ģʽ: ������������ȡ����,��Ϣ�յ��������Ϣ

����/����ģʽ:

- ��������topic����

- ��������������֮��,��ɾ������

- ÿ�������߶���,��������������

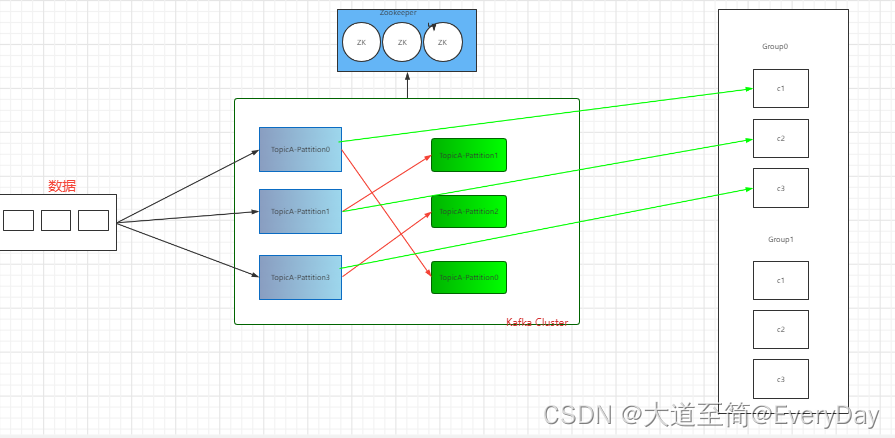

kafka�ܹ�

1)Producer: ��Ϣ������,������kafka broker ����Ϣ�Ŀͻ���

2)Consumer: ��Ϣ������,��Kafka brokerȡ��Ϣ�Ŀͻ���

3)Consumer Group: ��������,�ɶ����������ɡ�ÿ�������߸������Ѳ�ͬ����������,һ������ֻ����һ����������������;��������֮�����Ӱ�졣

4)Broker:һ̨kafka����������һ��broker��һ����Ⱥ�ж��broker��ɡ�һ��broker�������ɶ��topic��

5)Topic:��������Ϊһ������,�����ߺ�������������һ��Topic��

6)Partition:Ϊ��ʵ����չ��,һ���dz����topic���Էֲ������broker��,һ��topic���Է�Ϊ���partition,ÿ��partition��һ������Ķ��С�

7)Replica:����,һ��topic��ÿ�������������ɸ�����,һ��leader�����ɸ�Follwoer��

8)Leader:ÿ�������Ķ����������,�����߷������ݵĶ����������������ݵĶ�����Leader��

9)Follwower: ÿ��������������Ĵ�,ʵʱ�Ĵ�Leader��ͬ������,���ֺ�Leader������ͬ����Leader�������ϵ�ʱ��,ij��Follower���Ϊ�µ�Leader��

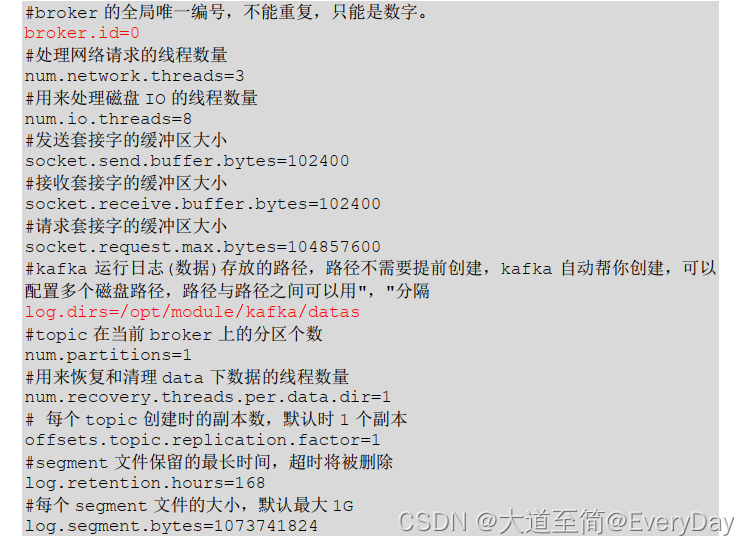

��Ⱥ����

1 �ٷ����ص�ַ

2 ����

#����Ŀ¼

mkdir /opt/module/

#��ѹ

tar -zxvf kafka_2.12-3.0.0.tgz -C /opt/module/

# ����moduleĿ¼����Ŀ¼����

cd /opt/module/

mv kafka_2.12-3.0.0/ kafka

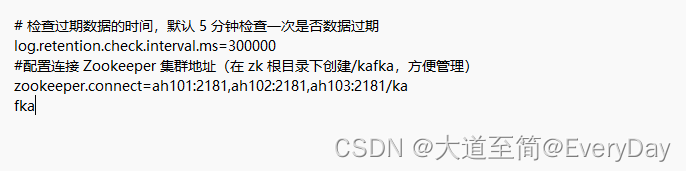

#�������ļ�

cd config/

vim server.properties

����һ������

3 �ֱ��� ah102��ah103 ���������ļ�/opt/module/kafka/config/server.properties

�е� broker.id=1�� broker.id=2

ע: broker.id �����ظ�,������Ⱥ��Ψһ��

4 ������Ⱥ

4.1 ����zk��Ⱥ

4.2 ����kafka��Ⱥ

./bin/kafka-server-start.sh -daemon config/server.properties

��Ⱥ��ͣ�ű�

vi kf.sh

#! /bin/bash

case $1 in

"start"){

for i in hadoop102 hadoop103 hadoop104

do

echo " --------���� $i Kafka-------"

ssh $i "/opt/module/kafka/bin/kafka-server-start.sh -

daemon /opt/module/kafka/config/server.properties"

done

};;

"stop"){

for i in ah101 ah102 ah103

do

echo " --------ֹͣ $i Kafka-------"

ssh $i "/opt/module/kafka/bin/kafka-server-stop.sh "

done

};;

esac

# ����Ȩ��

chmod -x kf.sh

#��������

kf.sh start

#ֹͣ����

kf.sh stop

ע��: ֹͣ Kafka ��Ⱥʱ,һ��Ҫ�� Kafka ���нڵ����ȫ��ֹͣ����ֹͣ Zookeeper

��Ⱥ����Ϊ Zookeeper ��Ⱥ���м�¼�� Kafka ��Ⱥ�����Ϣ, Zookeeper ��Ⱥһ����ֹͣ,

Kafka ��Ⱥ��û�а취�ٻ�ȡֹͣ���̵���Ϣ,ֻ���ֶ�ɱ�� Kafka ������

kafka�������

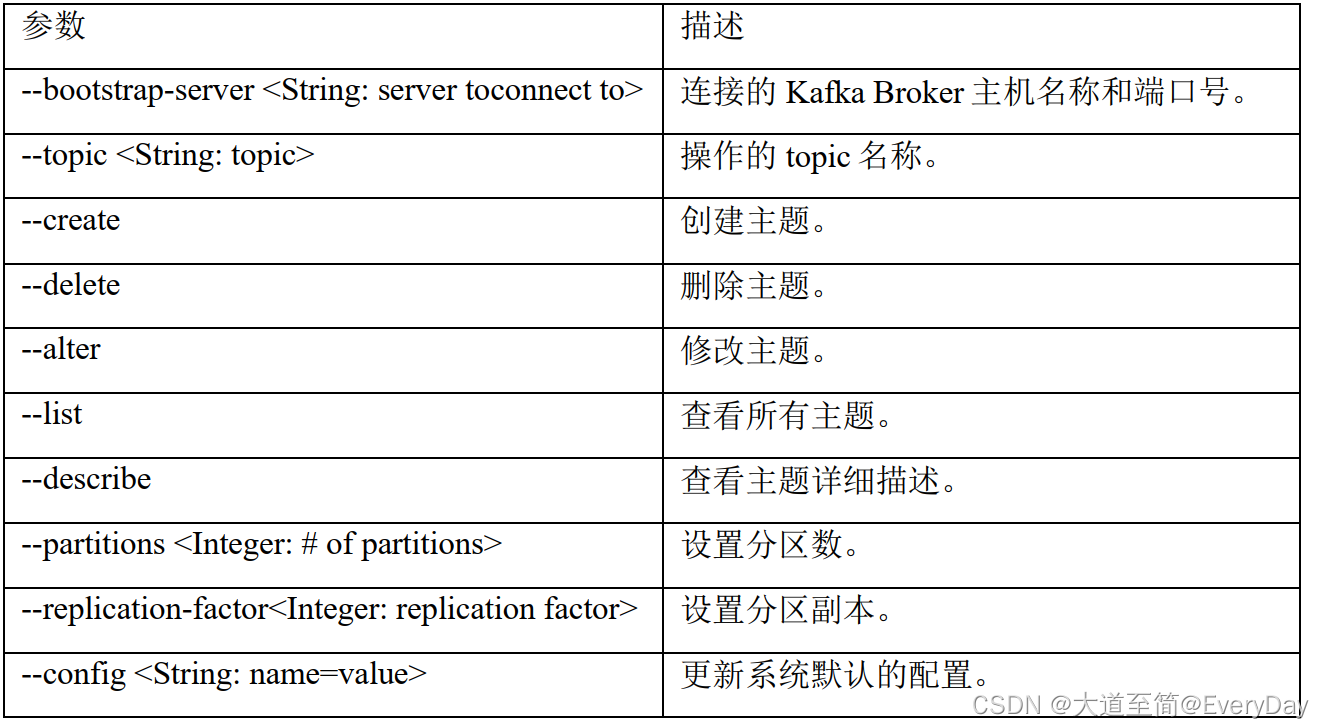

1) �����������(kafka-topic.sh)

1 �鿴��ǰ�������е����� topic

bin/kafka-topics.sh --bootstrap-server ah101:9092 --list

2 ���� test topic

bin/kafka-topics.sh --bootstrap-server ah101:9092 --create --partitions 1 --replication-factor 3 --topic test

ѡ��˵��:

�Ctopic ���� topic ��

�Creplication-factor ���帱����

�Cpartitions ���������

3 �鿴��������

bin/kafka-topic.sh --bootstrap-server ah101:9092 --describe --topic test

4 �ķ�����(ע�������ֻ������,���ܼ���)

bin/kafka-topics.sh --bootstrap-server ah101:9092 --alter --topic test --partiton 3

4 ɾ��topic

bin/kafka-topics.sh --bootstrap-server ah101:9092 --delete --topic test

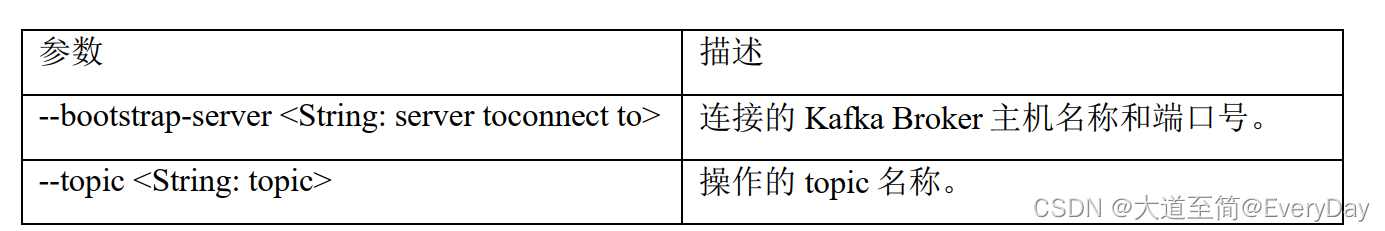

2) �������������(kafka-console-producer.sh)

1 ������Ϣ

bin/kafka-console-producer.sh --bootstrap-server ah101:9092 --topic test

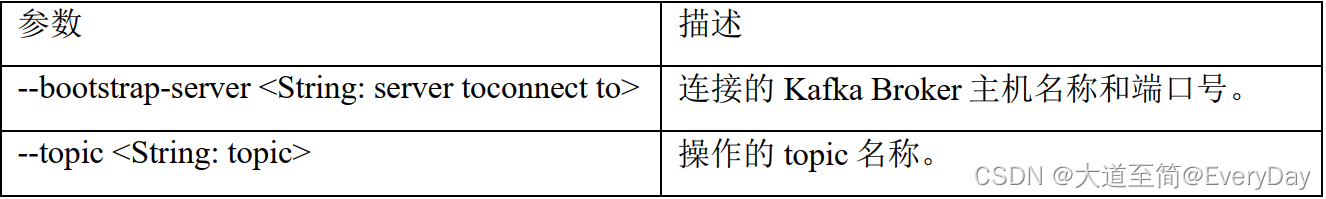

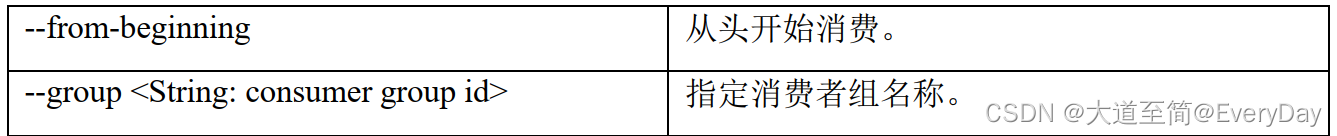

3) �������������(kafka-console-consumer.sh)

1 ����test���������

bin/kafka-console-consumer.sh --bootstrap-server ah101:9092 --topic test

2 ����test������������

bin/kafka-console-consumer.sh --bootstrap-server ah101:9092 --from-beginning --topic test

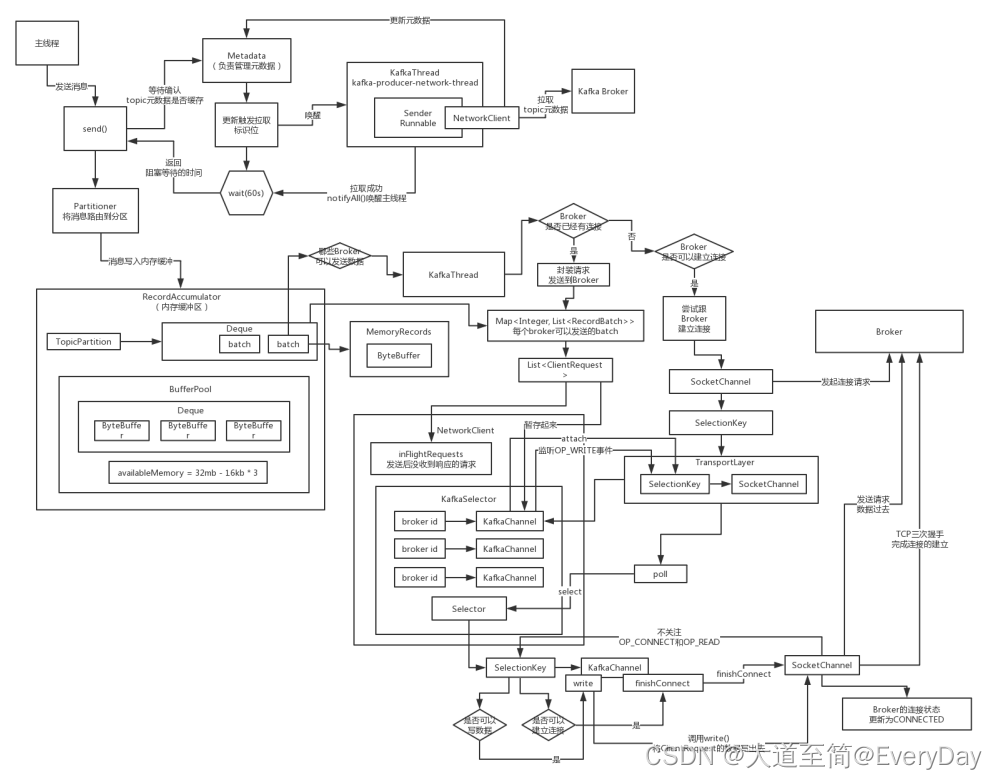

kafka������

һ ����ԭ��

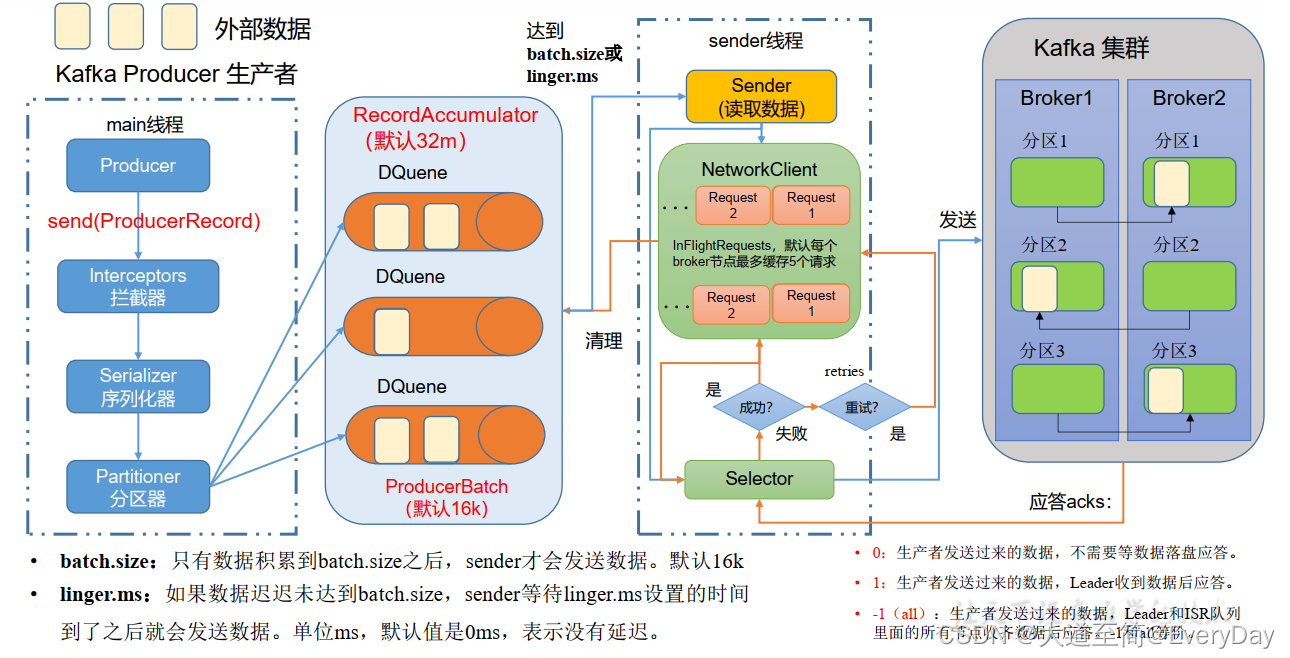

��Ϣ��������,�漰�������߳� main�̺߳�Sender�̡߳�main�̴߳���һ��˫�˶���RecordAccumulator��main�߳̽���Ϣ����RecordAcuumulator,sender�̲߳��ϴ�RecordAccumulator����ȡ��Ϣ��Kafka Broker��

�� ��Ҫ�IJ����б�

| �������� | ���� |

|---|---|

| bootstrap.servers | ���������Ӽ�Ⱥ�����broker��ַ�嵥������:ah101:9092,ah102:9092,ah103:9092,��������һ�����߶��,�м��ö��Ÿ�����ע�����ﲢ�Ǹ����е�broker��ַ,��Ϊ�����߿��ԴӸ�����broker�ҵ�������broker��Ϣ |

| key.serializer��value.serilizer | ָ��������Ϣ��key��value�����л����͡�һ��Ҫдȫ���� |

| buffer.memory | RecordAccumulator�������ܴ�С,Ĭ��32M |

| batch.size | ������һ�����ݵ����ֵ,Ĭ��16k���ʵ����Ӹ�ֵ,�������������,���������ֵ����̫��,�ᵼ�����ݵĴ����ӳ����� |

| linger.ms | r������ݳٳ�δ�ﵽbatch.size,sender�̵߳ȴ�linger.msʱ���ͻᷢ�����ݡ���λms,Ĭ��ֵ0ms,��ʾû���ӳ�,�����߽����ֵ��С����5-100ms |

| acks | 0:�����߷�����������,����Ҫ����������Ӧ��;1:�����߷�����������,Leader�յ����ݺ�Ӧ��;-1(all):�����߷�����������,Leader��ISR���������е������������ݺ�Ӧ��Ĭ��-1 |

| max.in.flight.requests.per.connection | �������û�з���ack�Ĵ���,Ĭ��5,�����ݵ���Ҫ��֤��ֵ��1-5������ |

| retries | ����Ϣ���ʹ����ʱ��,ϵͳ���ط���Ϣ��retries��ʾ���Դ���,Ĭ��int�����ֵ 2147483467.�������������,���뱣֤��Ϣ�������ԡ���Ҫ����MAX-IN-FLIGHT-REQUESTS-PER-CONNECTION=1,�������Դ�ʧ����Ϣ��ʱ��,������Ϣ���ܷ��ͳɹ� |

| retry.backoff.ms | l��������֮��ļ��,Ĭ��100ms |

| enable.idempotence | �Ƿ����ݵ���,Ĭ��true |

| compression.type | �����߷������е����ݵ�ѹ����ʽ��Ĭ��none��ѹ�� ֧������: none,gzip,snappy,lz4,zstd |

pom

<dependency>

<groupId>org.apache.kafka</groupId>

<artifactId>kafka_2.13</artifactId>

<version>3.0.0</version>

</dependency>

�� �첽����API

1 ��ͨ�첽����

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import java.util.Properties;

/**

* @date 2022/05/07 21:38:10

*/

public class CustomProducer {

public static void main(String[] args) {

//1.����kafk���ö���

Properties properties = new Properties();

//2. ����������Ϣ

properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "ah101:9092,ah102:9092");

//key value�������л�

properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

//3.����Kafka�����߶���

KafkaProducer<Object, Object> kafkaProducer = new KafkaProducer<>(properties);

//4.����send����������Ϣ

kafkaProducer.send(new ProducerRecord<>("test", "hello kafka"));

//5.g�ر���Դ

kafkaProducer.close();

}

}

2 ���ص��첽����

import org.apache.kafka.clients.producer.*;

import java.util.Objects;

import java.util.Properties;

/**

* @author gusteau.qin@dbappsecurity.com.cn

* @date 2022/05/07 21:38:10

*/

public class CustomCallbackProducer {

public static void main(String[] args) {

//1.����kafk���ö���

Properties properties = new Properties();

//2. ����������Ϣ

properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "ah101:9092,ah102:9092");

//key value�������л�

properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

//3.����Kafka�����߶���

KafkaProducer<Object, Object> kafkaProducer = new KafkaProducer<>(properties);

//4.����send����������Ϣ

kafkaProducer.send(new ProducerRecord<>("test", "hello kafka"), new Callback() {

@Override

public void onCompletion(RecordMetadata metadata, Exception exception) {

if(Objects.isNull(exception)){

//���쳣 ע����Ϣ����ʧ�ܺ���Զ�����,����Ҫ�����ڻص��������ֶ�����

System.out.println("����: "+metadata.topic()+"-------->>>>>����:"+metadata.partition());

}else{

//��ӡ�쳣

exception.printStackTrace();

}

}

});

//5.g�ر���Դ

kafkaProducer.close();

}

}

�� ͬ������API

ֻ��Ҫ���첽���͵Ļ�����,�ڵ�����get()����

import org.apache.kafka.clients.producer.*;

import java.util.Objects;

import java.util.Properties;

import java.util.concurrent.ExecutionException;

/**

* @author gusteau.qin@dbappsecurity.com.cn

* @date 2022/05/07 21:38:10

*/

public class CustomCallbackProducer {

public static void main(String[] args) throws ExecutionException, InterruptedException {

//1.����kafk���ö���

Properties properties = new Properties();

//2. ����������Ϣ

properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "ah101:9092,ah102:9092");

//key value�������л�

properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

//3.����Kafka�����߶���

KafkaProducer<Object, Object> kafkaProducer = new KafkaProducer<>(properties);

//4.����send����������Ϣ

kafkaProducer.send(new ProducerRecord<>("test", "hello kafka"), new Callback() {

@Override

public void onCompletion(RecordMetadata metadata, Exception exception) {

if(Objects.isNull(exception)){

//���쳣 ע����Ϣ����ʧ�ܺ���Զ�����,����Ҫ�����ڻص��������ֶ�����

System.out.println("����: "+metadata.topic()+"-------->>>>>����:"+metadata.partition());

}else{

//��ӡ�쳣

exception.printStackTrace();

}

}

}).get();

//5.�ر���Դ

kafkaProducer.close();

}

}

�� �����߷����ĺô�

(1)���ں���ʹ����Դ��ÿ��partition��һ��broker�洢,���Ѻ������ݰ��շ����и��һ��һ�����ݴ洢�ڶ�̨broker�ϡ������Ŀ��Ʒ�������,����ʵ�ָ��ؾ����Ч����

(2)��߲��ж�,�����߿����Է���Ϊ��λ��������,�����߿����Է���Ϊ��λ�������ݡ�

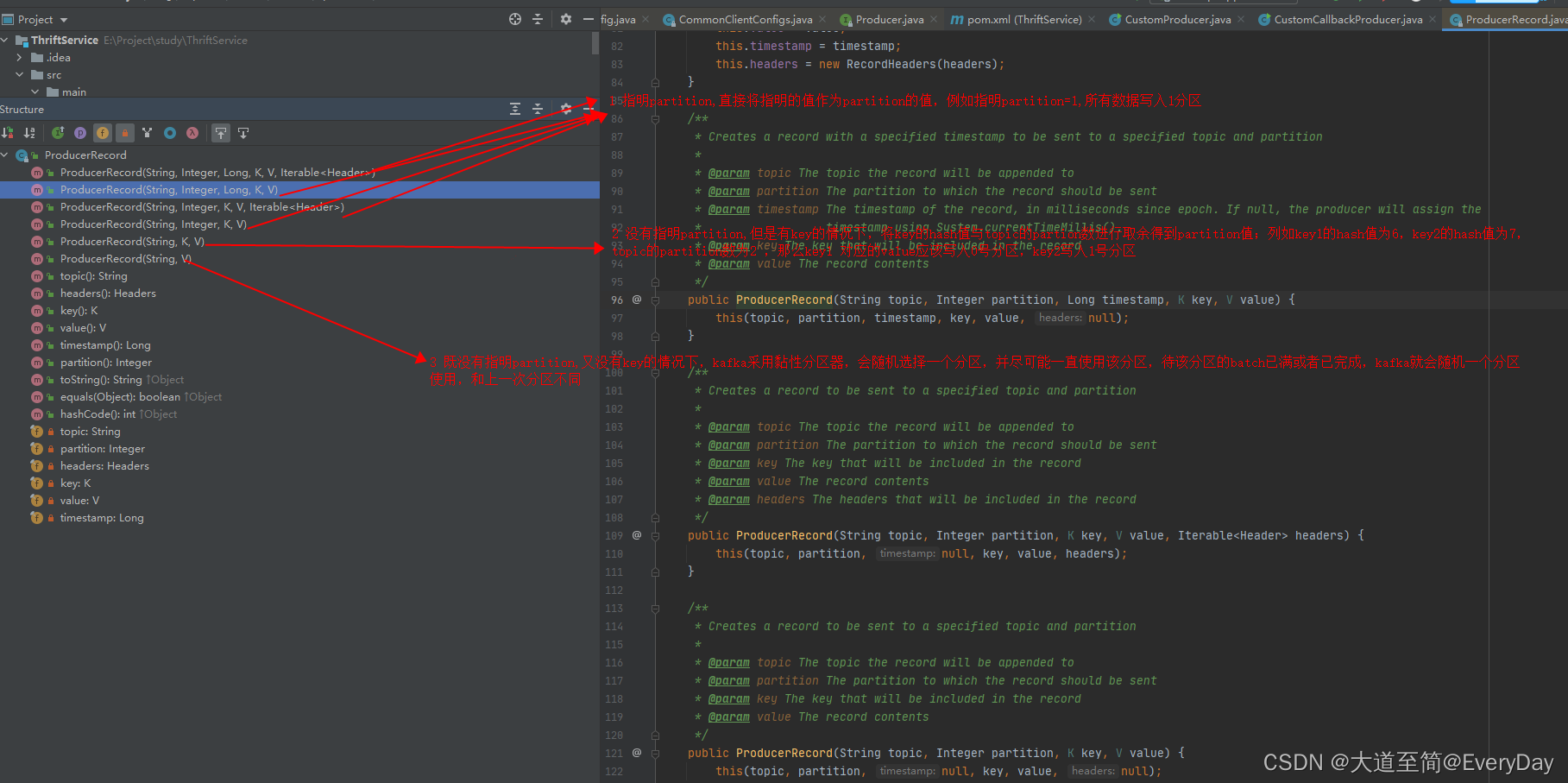

�� �����߷�����Ϣ�ķ�������

�Զ��������

1)����

��������ʵ��һ��������ʵ��, ��������������������� atguigu,�ͷ��� 0 �ŷ���,������ hello,�ͷ��� 1 �ŷ�����

2)ʵ�ֲ���

(1)������ʵ�� Partitioner �ӿڡ�

(2)��д partition()������

�Զ��������

import org.apache.kafka.clients.producer.Partitioner;

import org.apache.kafka.common.Cluster;

import java.util.Map;

/**

* @author gusteau.qin@dbappsecurity.com.cn

* @date 2022/05/07 22:08:52

*/

public class MyPatitioner implements Partitioner {

@Override

public int partition(String topic, Object key, byte[] keyBytes, Object value, byte[] valueBytes, Cluster cluster) {

//��ȡ��Ϣ

String msg = value.toString();

//partition

int partition;

if (msg.contains("hello")) {

partition = 0;

} else {

partition = 1;

}

//���ط�����

return partition;

}

//�ر�

@Override

public void close() {

}

//���÷���

@Override

public void configure(Map<String, ?> configs) {

}

}

ʹ��

import org.apache.kafka.clients.producer.*;

import java.util.Objects;

import java.util.Properties;

import java.util.concurrent.ExecutionException;

/**

* @author gusteau.qin@dbappsecurity.com.cn

* @date 2022/05/07 21:38:10

*/

public class CustomPartitionerProducer {

public static void main(String[] args) throws ExecutionException, InterruptedException {

//1.����kafk���ö���

Properties properties = new Properties();

//2. ����������Ϣ

properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "ah101:9092,ah102:9092");

//key value�������л�

properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

//�����Զ������

properties.put(ProducerConfig.PARTITIONER_CLASS_CONFIG,"org.apache.kafka.clients.producer.Partitioner.MyPatitioner");

//3.����Kafka�����߶���

KafkaProducer<Object, Object> kafkaProducer = new KafkaProducer<>(properties);

//4.����send����������Ϣ

kafkaProducer.send(new ProducerRecord<>("test", "hello kafka"), new Callback() {

@Override

public void onCompletion(RecordMetadata metadata, Exception exception) {

if(Objects.isNull(exception)){

//���쳣 ע����Ϣ����ʧ�ܺ���Զ�����,����Ҫ�����ڻص��������ֶ�����

System.out.println("����: "+metadata.topic()+"-------->>>>>����:"+metadata.partition());

}else{

//��ӡ�쳣

exception.printStackTrace();

}

}

}).get();

//5.�ر���Դ

kafkaProducer.close();

}

}

�� ������������������

���ݻ����ĵ���һ�²�������:

batch.size:���δ�С,Ĭ��16k

linger.ms: �ȴ�ʱ��,��5-100ms

compression.type :ѹ������

RecordAccumulator: ��������С

�� ��������

1,���ݿɿ���

ACKӦ��ԭ��(0,1,-1)

ע��: ������������ acks=0����ʹ��,acks=1һ�����ڴ�����ͨ��־,������ʧ��������,acks=1 һ���û������Ǯ��ص�����,�Կɿ���Ҫ��Ƚϸߵij�����

���ݿɿ�������=ACK��������Ϊ-1+�����������ڵ���2+ISR��Ӧ�����С�����������ڵ���2

˼��:Leader�յ����ݺ�,���е�Follower����ʼͬ������,������һ��Follower��Ϊij�ֹ���,�ٳٲ�����Leaderͬ��,��ô���?

Leaderά����һ����̬��in-sync replica set(ISR)�б�,���Leader����ͬ����Leader��Follower�ļ��ϡ����Follower��ʱ��δ��Leader����ͨ�������ͬ������,���Follower�ᱻ�߳�ISR�б�����ʱ����ֵ��replica.lag.time.max.ms�����趨,Ĭ��30s

//acks��������

properties.put(ProducerConfig.ACKS_CONFIG,"all");

//���Բ�������

properties.put(ProducerConfig.RETRIES_CONFIG,3);

2,���ݴ�������

- ����һ��(At Least Once):ack��������Ϊ-1+�����������ڵ���2+ISR��Ӧ�����С�������ڵ���2

- ���һ��(At Most Once):ack��������Ϊ0

- ��ȷһ��(Exactly Once):�ݵ���+����һ��

- 32

�ܽ�:

At Least Once:���Ա�֤���ݲ���ʧ,���Dz��ܱ�֤�����ظ���

At Most Once:���Ա�֤���ݲ��ظ�,���Dz��ܱ�֤���ݲ���ʧ��

Exactly Once:���ݼ����ظ�Ҳ���ᶪʧ��kafka0.11�汾�����ش����� �ݵ��Ժ�����

3,�ݵ���

�ݵ���ԭ��:

�ݵ���: Producer������broker���Ͷ����ظ�����,Broker�˶���־û�һ��,��֤���ظ���

�ظ������жϵı�:����<PID,Partition,seqNumber>��ͬ�����ύʱ,Brokerֻ��־û�һ��,����PID ʱkafkaÿ�������������һ���µ�,Partition��ʾ������,sequence number�ǵ��������ġ�

�����ݵ��� ֻ�ܱ�֤�ڵ��������Ự�ڲ��ظ���

�ݵ���ʹ��:��������enable.idempotence,Ĭ��Ϊtrue,false�رա�

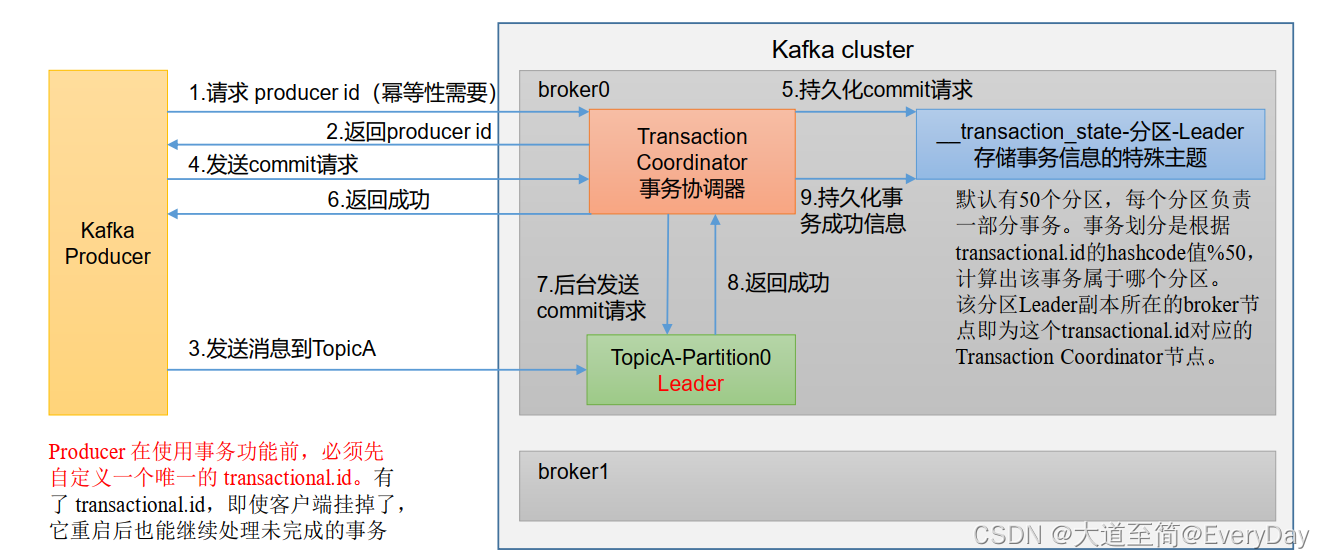

4,����������

Kafka����ԭ��:

˵��: ��������,���뿪���ݵ��ԡ�Producer��ʹ������֮ǰ,�����Զ���һ��Ψһ������id,����,��ʹ�ͻ��˹ҵ�,������Ҳ�ܼ������δ��ɵ�����

/**

*

* @date 2022/05/07 21:38:10

* ����Producer,ʹ������֤��Ϣ��һ�η���

*/

public class CustomTransactionProducer {

public static void main(String[] args) throws ExecutionException, InterruptedException {

//1.����kafk���ö���

Properties properties = new Properties();

//2. ����������Ϣ

properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "ah101:9092,ah102:9092");

//key value�������л�

properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerializer");

//��������id

properties.put(ProducerConfig.TRANSACTIONAL_ID_CONFIG,"transaction_id_0000");

//3.����Kafka�����߶���

KafkaProducer<Object, Object> kafkaProducer = new KafkaProducer<>(properties);

//��ʼ������

kafkaProducer.initTransactions();

//��������

kafkaProducer.beginTransaction();

//4.����send����������Ϣ

try {

kafkaProducer.send(new ProducerRecord<>("test", "hello kafka"));

//�ύ����

kafkaProducer.commitTransaction();

} catch (Exception e) {

e.printStackTrace();

//��ֹ����

kafkaProducer.abortTransaction();

} finally {

//�ر���Դ

kafkaProducer.close();

}

}

}

5,��������

��������,����;

�����,���������֮������;

- kafka��1.x�汾֮ǰ��֤���ݵ���������,��������:

max.in.flight.requests.per.connection=1

2)kafka��1.x�汾�Ժ�汾��֤���ݵ���������,��������:

- δ�����ݵ���, max.in.flight.requests.per.connection=1

- �����ݵ���, max.in.flight.requests.per.connection����С�ڵ���5,

ԭ��:1.x֮��,�����ݵ��Ժ�,kafka����˻Ỻ��producer���������5��request��Ԫ����,���������,�����Ա�֤���5��request��������ġ�

������������ Kafkaʵս��ԭ��2��