ElasticSearch

һ�� ȫ�ļ�������

-

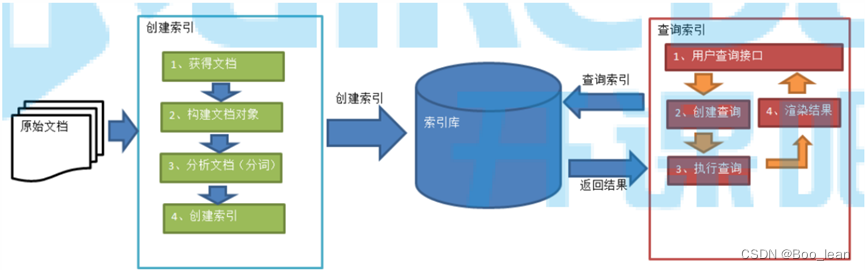

ȫ�ļ�������

���ǽṹ�������е�һ������Ϣ��ȡ����,������֯,ʹ������һ���ṹ,Ȼ��Դ���һ���ṹ�����ݽ�������,�Ӷ��ﵽ������ԽϿ��Ŀ�ġ��ⲿ�ִӷǽṹ����������ȡ����Ȼ��������֯����Ϣ,���dz�֮������

����:�ֵ䡣�ֵ��ƴ�����Ͳ����ֱ����൱���ֵ������,��ÿһ���ֵĽ����Ƿǽṹ����,����ֵ�û�����ڱ��Ͳ����ֱ�,��ãã�Ǻ�����һ����ֻ��˳��ɨ�衣Ȼ���ֵ�ijЩ��Ϣ������ȡ�������нṹ������,�������,�ͱȽϽṹ��,����ĸ����ĸ,�ֱ�ֻ�м�����һһ�о�,���ǽ������ó�����һ����˳������,ÿһ�������ָ����ֵ���ϸ���͵�ҳ������������ʱ���ṹ����ƴ���ѵ�����,Ȼ����ָ���ҳ��,����ҵ����ǵķǽṹ�����ݨC�����ֵĽ��͡�

�����Ƚ�������,�ٶ��������������Ĺ��̾ͽ�ȫ�ļ���(Full-text Search)��

��Ȼ���������Ĺ���Ҳ�Ƿdz���ʱ��,��������һ�������Ϳ��Զ��ʹ��,ȫ�ļ�����Ҫ�������Dz�ѯ,���Ժ�ʱ�䴴��������ֵ�õġ� -

ȫ�ļ�������

-

��ظ���

- ������

��������Ǵ洢�����ı����ڴ����ϵ�һϵ�е��ļ�������洢�˽����õ�������Ϣ�Լ��ĵ�����

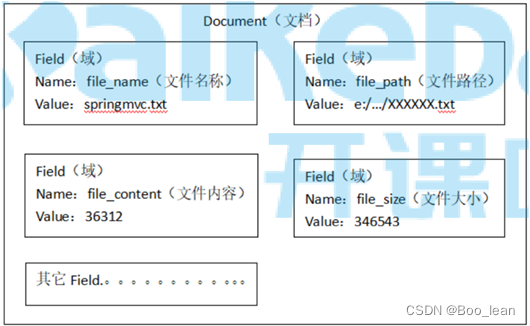

һ���������൱�����ݿ��е�һ�ű��� - document����

��ȡԭʼ���ݵ�Ŀ����Ϊ������,������ǰ��Ҫ��ԭʼ���ݴ������ĵ�(Document),�ĵ��а���һ��һ������(Field),���д洢���ݡ�ÿ���ĵ�����һ��Ψһ�ı��,�����ĵ�id��

document�����൱�ڱ��е�һ����¼��

3) field����

������ǰ�document���������ݿ���һ����¼�Ļ�,field�൱���Ǽ�¼�е��ֶΡ�field���������д洢���ݵ���С��λ��field���������ʹ��¿��Է�Ϊ��ֵ���ͺ��ı�����,һ����Ҫ��ѯ���ֶζ����ı����͵�,field�Ļ�����������:- �Ƿ�ִ�:�Ƿ��������ݽ��зִʴ�����ǰ��������Ҫ��������ݽ��в�ѯ��

- �Ƿ�����:��Field������Ĵʻ�����Fieldֵ��������,ֻ����������������������:��Ʒ���ơ���Ʒ���������������,�����š�����֤�Ų��÷ִʵ�ҲҪ����,��Щ������Ҫ��Ϊ��ѯ������

- �Ƿ�洢:��Fieldֵ�洢���ĵ���,�洢���ĵ��е�Field�ſ��Դ�Document�л�ȡ ����:��Ʒ���ơ�������,���ǽ���Ҫ��Document�л�ȡ��Field��Ҫ�洢��

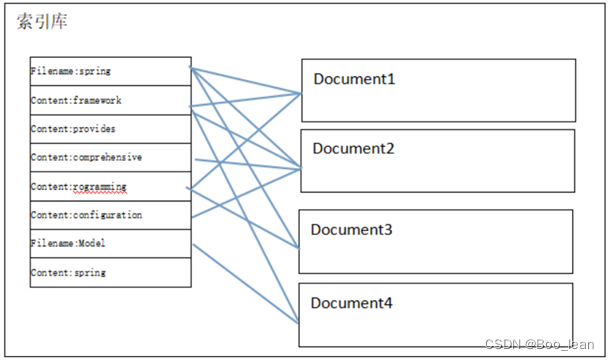

- term����

���ĵ������в�ֳ�����ÿ�����ʽ���һ��Term,��ͬ�����в�ֳ�������ͬ�ĵ����Dz�ͬ�� term��term�а���������һ�������ĵ�������,��һ���������ʵ�������term�Ǵ��������Ĺؼ��ʶ���

- ������

���� ElasticSearch���

-

ElasticSearch�ĸ���

Elaticsearch,���Ϊes,es��һ����Դ������չ�ķֲ�ʽȫ�ļ�������,�����Խ���ʵʱ�Ĵ洢����������;������չ�Ժܺ�,������չ���ϰ�̨������,����PB��������ݡ�esҲʹ��Java������ʹ�� Lucene��Ϊ�������ʵ�����������������Ĺ���,��������Ŀ����ͨ����RESTful API������ Lucene�ĸ�����,�Ӷ���ȫ��������ü� -

ElasticSearch��ʹ�ð���

- 2013���,GitHub������Solr,��ȡElasticSearch ����PB���������� ��GitHubʹ��ElasticSearch����20TB������,����13���ļ���1300���д��롱

- ά���ٿ�:������elasticsearchΪ�����ĺ��������ܹ�

- SoundCloud:��SoundCloudʹ��ElasticSearchΪ1.8���û��ṩ��ʱ������������������

- �ٶ�:�ٶ�Ŀǰ�㷺ʹ��ElasticSearch��Ϊ�ı����ݷ���,�ɼ��ٶ����з������ϵĸ���ָ�����ݼ��û��Զ�������,ͨ���Ը������ݽ��ж�ά����չʾ,������λ����ʵ���쳣��ҵ������쳣��Ŀǰ���ǰٶ��ڲ�20���ҵ����(����casio���Ʒ��������ˡ�Ԥ�⡢�Ŀ⡢ֱ��š�Ǯ������ص�), ����Ⱥ���100̨����,200��ES�ڵ�,ÿ�쵼��30TB+����

- ����ʹ��ES ��������32����ʵʱ��־

- ����ʹ��ES �����ڲ��Լ�����־�ɼ��ͷ�����ϵ

-

ElasticSearch�Ա�Solr

- Solr ���� Zookeeper ���зֲ�ʽ����,�� Elasticsearch �������зֲ�ʽЭ����������;

- Solr ֧�ָ����ʽ������,�� Elasticsearch ��֧��json�ļ���ʽ;

- Solr �ٷ��ṩ�Ĺ��ܸ���,�� Elasticsearch ������ע���ں��Ĺ���,�����ܶ��ɵ���������ṩ;

- Solr �ڴ�ͳ������Ӧ���б��ֺ��� Elasticsearch,���ڴ���ʵʱ����Ӧ��ʱЧ�����Ե��� Elasticsearch

���� ElasticSearch��ظ���(����)

1. ����

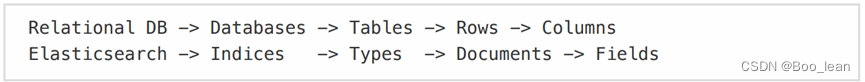

Elasticsearch�������ĵ�(document oriented)��,����ζ�������Դ洢���������ĵ�(document)��Ȼ�����������Ǵ洢,��������(index)ÿ���ĵ�������ʹ֮���Ա���������Elasticsearch��,����Զ��ĵ�(���dz��г��е�����)���������������������ˡ�Elasticsearch�ȴ�ͳ��ϵ�����ݿ�����:

2. ElasticSearch���ĸ���

-

����index

һ����������һ��ӵ�л��������������ĵ��ļ��ϡ�����˵,�������һ���ͻ����ݵ�����,��һ����ƷĿ¼������,����һ���������ݵ�������һ��������һ����������ʶ(����ȫ����Сд��ĸ��),���ҵ�����Ҫ�Զ�Ӧ����������е��ĵ��������������������º�ɾ����ʱ��,��Ҫʹ�õ�������֡���һ����Ⱥ��,���Զ���������������

-

����type

��һ��������,����Զ���һ�ֻ�������͡�һ�����������������һ�����ϵķ���/����,��������ȫ����������ͨ��,��Ϊ����һ�鹲ͬ�ֶε��ĵ�����һ�����͡�����˵,���Ǽ�������Ӫһ������ƽ̨���ҽ������е����ݴ洢��һ�������С������������,�����Ϊ�û����ݶ���һ������,Ϊ�������ݶ�����һ������,��Ȼ,Ҳ����Ϊ�������ݶ�����һ�����͡�

-

�ֶ�Field

�൱�������ݱ����ֶ�,���ĵ����ݸ��ݲ�ͬ���Խ��еķ����ʶ

-

ӳ��mapping

mapping�Ǵ������ݵķ�ʽ��������һЩ����,��ij���ֶε��������͡�Ĭ��ֵ�����������Ƿ������ȵ�,��Щ����ӳ������������õ�,�������Ǵ���es�������ݵ�һЩʹ�ù�������Ҳ����ӳ��,�������Ź��������ݶ�������ߺܴ�,��˲���Ҫ����ӳ��,������Ҫ˼����ν���ӳ����ܶ����ܸ��á�

-

�ĵ�document

һ���ĵ���һ���ɱ������Ļ�����Ϣ��Ԫ������,�����ӵ��ijһ���ͻ����ĵ�,ijһ����Ʒ��һ���ĵ�,��Ȼ,Ҳ����ӵ��ij��������һ���ĵ����ĵ���JSON(Javascript Object Notation)��ʽ����ʾ,��JSON��һ���������ڵĻ��������ݽ�����ʽ��

��һ��index/type����,����Դ洢�������ĵ���ע��,����һ���ĵ�,�����ϴ�����һ������֮��,�ĵ����뱻����/����һ��������type�� -

�ӽ�ʵʱNRT

Elasticsearch��һ���ӽ�ʵʱ������ƽ̨������ζ��,������һ���ĵ�ֱ������ĵ��ܹ�����������һ�������ӳ�(ͨ����1������)

-

��Ⱥcluster

һ����Ⱥ������һ�������ڵ���֯��һ��,���ǹ�ͬ��������������,��һ���ṩ�������������ܡ�һ����Ⱥ��һ��Ψһ�����ֱ�ʶ,�������Ĭ�Ͼ��ǡ�elasticsearch���������������Ҫ��,��Ϊһ���ڵ�ֻ��ͨ��ָ��ij����Ⱥ������,�����������Ⱥ

-

�ڵ�node

һ���ڵ��Ǽ�Ⱥ�е�һ��������,��Ϊ��Ⱥ��һ����,���洢����,���뼯Ⱥ���������������ܡ��ͼ�Ⱥ����,һ���ڵ�Ҳ����һ����������ʶ��,Ĭ�������,���������һ�����������������ɫ������,������ֻ���������ʱ����ڵ㡣������ֶ��ڹ���������˵ͦ��Ҫ��,��Ϊ���������������,���ȥȷ�������е���Щ��������Ӧ��Elasticsearch��Ⱥ�е���Щ�ڵ㡣

һ���ڵ����ͨ�����ü�Ⱥ���Ƶķ�ʽ������һ��ָ���ļ�Ⱥ��Ĭ�������,ÿ���ڵ㶼�ᱻ���ż��뵽һ��������elasticsearch���ļ�Ⱥ��,����ζ��,�������������������������ɸ��ڵ�,���ٶ������ܹ�����ֱ˴�,���ǽ����Զ����γɲ����뵽һ��������elasticsearch���ļ�Ⱥ�С�

��һ����Ⱥ��,ֻҪ����,����ӵ���������ڵ㡣����,�����ǰ���������û�������κ� Elasticsearch�ڵ�,��ʱ����һ���ڵ�,��Ĭ�ϴ���������һ��������elasticsearch���ļ�Ⱥ�� -

��Ƭ����shards&replicas

һ���������Դ洢�����������Ӳ�����ƵĴ������ݡ�����,һ������10���ĵ�������ռ��1TB�Ĵ��̿ռ�,����һ�ڵ㶼û��������Ĵ��̿ռ�;���ߵ����ڵ㴦����������,��Ӧ̫����Ϊ�˽���������,Elasticsearch�ṩ�˽��������ֳɶ�ݵ�����,��Щ�ݾͽ�����Ƭ�����㴴��һ��������ʱ��,�����ָ������Ҫ�ķ�Ƭ��������ÿ����Ƭ����Ҳ��һ���������Ʋ��Ҷ����ġ�������,��������������Ա����õ���Ⱥ�е��κνڵ��ϡ���Ƭ����Ҫ,��Ҫ���������ԭ��:

1)������ˮƽ�ָ�/��չ�������������

2)�������ڷ�Ƭ(DZ�ڵ�λ�ڶ���ڵ���)֮�Ͻ��зֲ�ʽ�ġ����еIJ���,�����������/������������һ����Ƭ�����ֲ�,�����ĵ������ۺϻ���������,����ȫ��Elasticsearch������,������Ϊ�û�������˵,��Щ�������ġ�

��һ������/�ƵĻ�����,ʧ����ʱ�����ܷ���,��ij����Ƭ/�ڵ㲻֪��ô�ľʹ�������״̬,���������κ�ԭ����ʧ��,���������,��һ������ת�ƻ����Ƿdz����ò�����ǿ���Ƽ��ġ�Ϊ��Ŀ��, Elasticsearch�����㴴����Ƭ��һ�ݻ��ݿ���,��Щ�����������Ʒ�Ƭ,����ֱ�ӽи��ơ�

����֮������Ҫ,��������Ҫԭ��: �ڷ�Ƭ/�ڵ�ʧ�ܵ������,�ṩ�˸߿����ԡ���Ϊ���ԭ��,ע����Ʒ�Ƭ�Ӳ���ԭ/��Ҫ(original/primary)��Ƭ����ͬһ�ڵ����Ƿdz���Ҫ������չ���������/������,��Ϊ�������������еĸ����ϲ������С���֮,ÿ���������Ա��ֳɶ����Ƭ��һ������Ҳ���Ա�����0��(��˼��û�и���)���Ρ�һ��������,ÿ����������������Ƭ(��Ϊ����Դ��ԭ���ķ�Ƭ)���Ʒ�Ƭ(����Ƭ�Ŀ���)֮�𡣷�Ƭ���Ƶ���������������������ʱ��ָ��������������֮��,��������κ�ʱ��̬�ظı临�Ƶ�����,�������º��ܸı��Ƭ��������

Ĭ�������,Elasticsearch�е�ÿ����������Ƭ5������Ƭ��1������,����ζ��,�����ļ�Ⱥ�������������ڵ�,�������������5������Ƭ������5�����Ʒ�Ƭ(1����ȫ����),�����Ļ�ÿ�������ܹ�����10����Ƭ��

�ġ� ElasticSearch��װ

���½ڽ�����Docker��װ,����windows��װes�dz���,���ﲻ���ظ�

1. docker��������

docker pull elasticsearch:5.6.8

2. ��װes����

docker run -di --name=c_es -p 9200:9200 -p 9300:9300 elasticsearch:5.6.8

9200�˿�(Web����ƽ̨�˿�) 9300(����Ĭ�϶˿�)

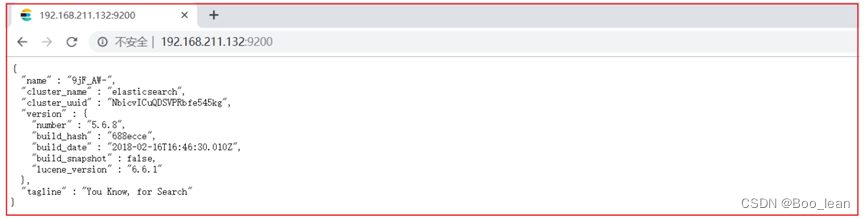

����������ַ����:http://192.168.211.132:9200/

3. ����Զ������

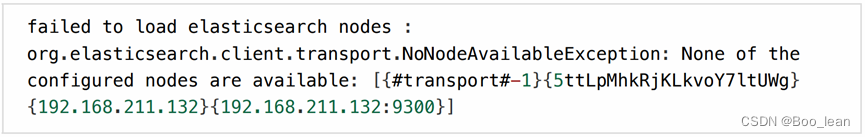

������ɰ�װ��,es����������ʹ��,elasticsearch��5�汾�Ժ�Ĭ�ϲ�����Զ������,����ֱ�����ӻᱨ���´���:

������Ҫ��es���ÿ���Զ������,��������:

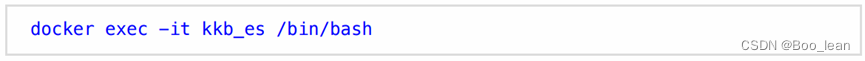

��¼����

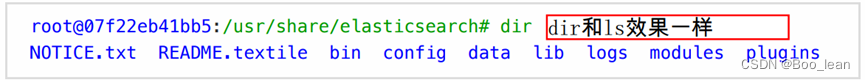

�鿴Ŀ¼�ṹ����: dir

����configĿ¼

�鿴�ļ�

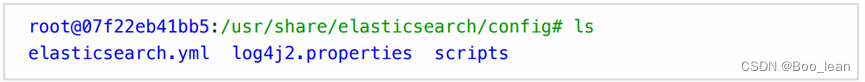

��elasticsearch.yml�ļ�

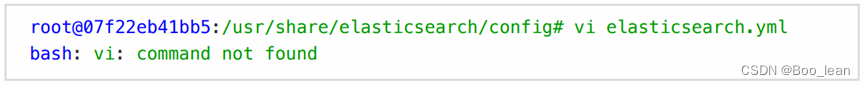

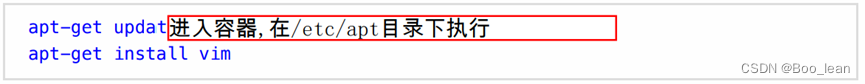

vi������ʶ��,��Ϊdocker��������û�и�����,���ǿ���װ�ñ༭����

����apt����Դ

docker cp ~/sources.list c_es:/etc/apt/sources.list

��װvim�༭��

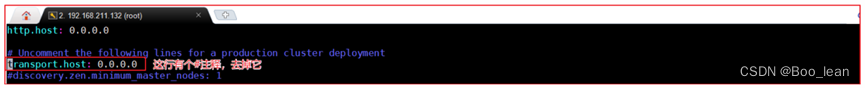

��װ���˺�,��elasticsearch.yml����,����ͼ:

������ͼ:

ͬʱ��������һ�д���:

����docker

docker restart c_es

4. ϵͳ��������

����������������ʧ����,����ʲôԭ����?�������Ǹղ��ĵ������й�,��Ϊelasticsearch��������ʱ������һЩ���,���������ļ��ĸ����Լ������ڴ����������ȵ�,�����ſ��˴�����,��ζ����Ҫ������ļ��Լ������ڴ�,�������ǻ���Ҫϵͳ����

��vi /etc/security/limits.conf ,������ (nofile�ǵ�����������������ļ����� soft nofile �� ������ hard nofile��Ӳ���� )(�ӵ����,ע���������·��,����������)

��vi /etc/sysctl.conf,������ (����һ�����̿���ӵ�е�VMA(�����ڴ�����)������ )

ִ���������� ���ں˲���������Ч

�������������,�ٴ���������,�����Ѿ�����������Զ�̷���

�������������,�ٴ���������,�����Ѿ�����������Զ�̷���

5. ��������

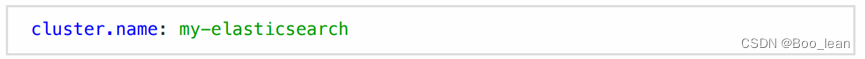

��elasticsearch/config�µ������ļ�:elasticsearch.yml,����������������,������:

ע��:����ֱ�ӷ���ip+9300,���ú�Ҳ������,�������к��沽��,�ſ�������ʹ��!

����:

- http.cors.enabled: true:�˲�Ϊ����elasticsearch�������,Ĭ����false��

- http.cors.allow-origin: ����:��ʾ�������������������ַ(��ʾ����)��

����

docker restart c_es

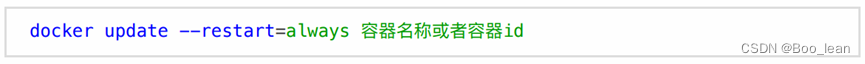

С��ʾ:�������������������,����ִ����������

�塢 ElasticSearch�Ŀͻ��˲���

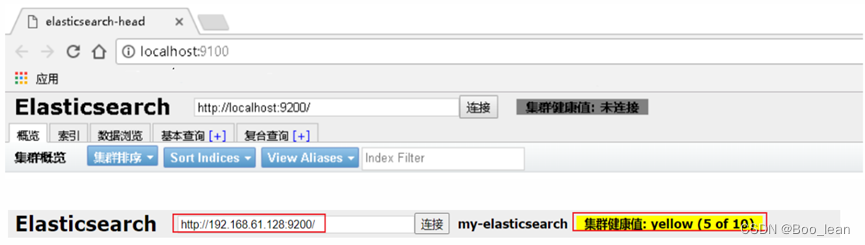

(һ) elasticsearch-head

ElasticSearch��ͬ��Solr�Դ�ͼ�λ�����,���ǿ���ͨ����װElasticSearch��head���,���ͼ�λ������Ч��,����������ݵIJ鿴����װ����ķ�ʽ������,���߰�װ�ͱ��ذ�װ�����ĵ����ñ��ذ�װ��ʽ����head����İ�װ��elasticsearch-5-*���ϰ汾��װhead��Ҫ��װnode��grunt

1) ����head���:https://github.com/mobz/elasticsearch-head

2) ��elasticsearch-head-masterѹ������ѹ������Ŀ¼(window��),����Ҫ��elasticsearch�İ�װĿ¼����

3) ����nodejs:https://nodejs.org/en/download/

���������Ѿ��ṩ��nodejs��װ����:

˫����װ����,�����ͼ����:

��װ���,����ͨ��cmd����̨����:node -v �鿴�汾��

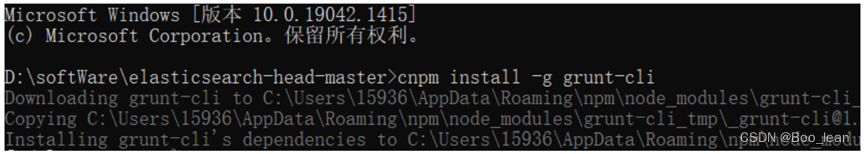

4) ��grunt��װΪȫ������,Grunt�ǻ���Node.js����Ŀ��������

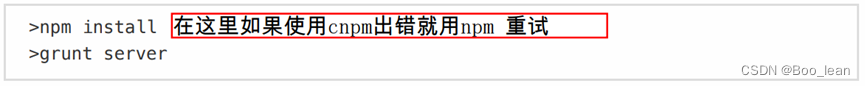

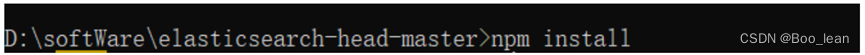

����elasticsearch-head-masterĿ¼,cmd,����̨����������ִ������:

ִ�н������ͼ:

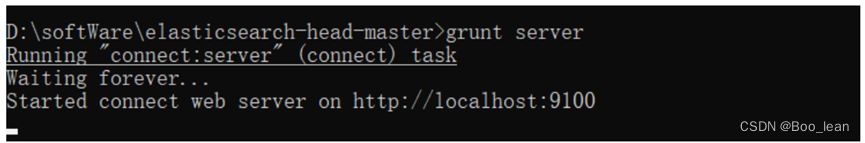

5) ����elasticsearch-head-masterĿ¼����head,��������ʶ������������:

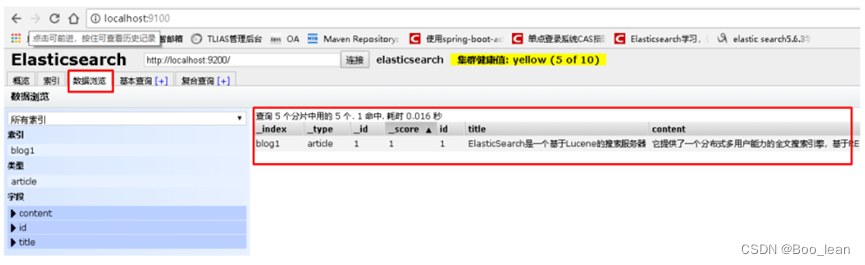

6) �������,���� http://localhost:9100,��������ҳ��:

������ܳɹ����ӵ�es����,��Ҫ��ElasticSearch��configĿ¼�µ������ļ�: config/elasticsearch.yml,����������������:

Ȼ����������ElasticSearch����

(��) ʹ��Postman���߽���Restful�ӿڷ���

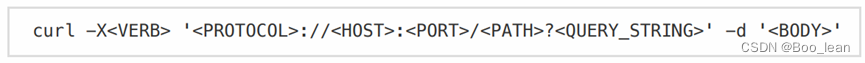

- ElasticSearch�Ľӿ��

����:

| ���� | ���� |

|---|---|

| VERB | �ʵ��� HTTP ���� �� ν�� : GET�� POST�� PUT�� HEAD ���� DELETE�� |

| PROTOCOL | http ���� https(������� Elasticsearch ǰ����һ�� https ����) |

| HOST | Elasticsearch ��Ⱥ������ڵ��������,������ localhost �������ػ����ϵĽ� �㡣 |

| PORT | ���� Elasticsearch HTTP ����Ķ˿ں�,Ĭ���� 9200 �� |

| PATH | API ���ն�·��(���� _count �����ؼ�Ⱥ���ĵ�����)�� |

| Path | ���ܰ�������� ��,����:_cluster/stats �� _nodes/stats/jvm �� |

| QUERY_STRING | �����ѡ�IJ�ѯ�ַ������� (���� ?pretty ����ʽ������� JSON ����ֵ,ʹ��� �����Ķ�) |

| BODY | һ�� JSON ��ʽ�������� (���������Ҫ�Ļ�) |

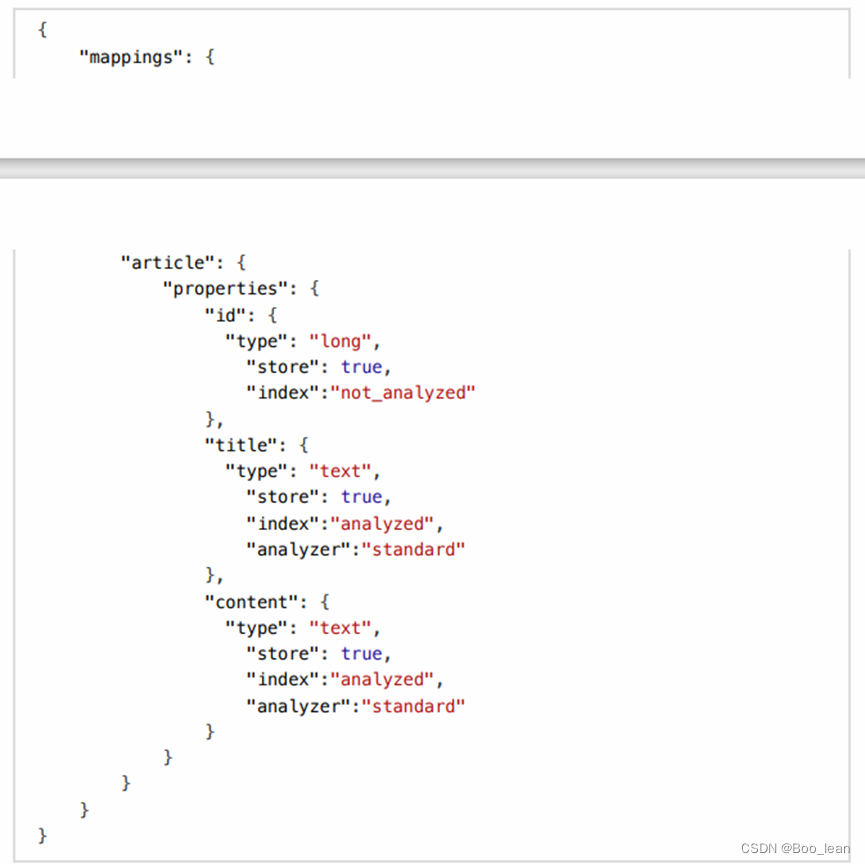

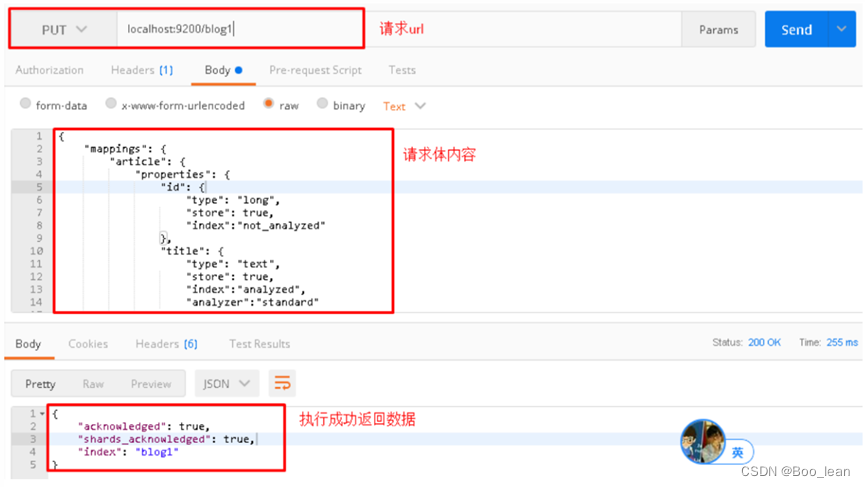

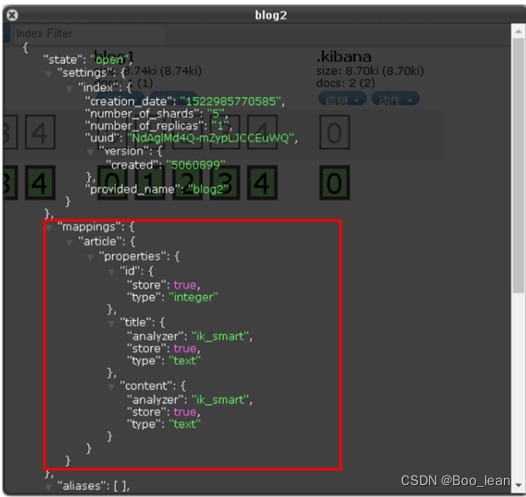

- ��������index��ӳ��mapping

����url:

������:

����:

��article��:�Զ����types

��properties��:documents������

��id������title������content��:�Զ����fields

��type��:����ָ��fields�Ĵ洢����

��store��:���������Ƿ�洢

��index��:�Ƿ���Ҫ�ִ�

��analyzer��:����ָ���ִ���

��standard��:es�ı��ִ���,�Ὣ��Ӣ����ȷ�ִ�,�����������ִʡ�

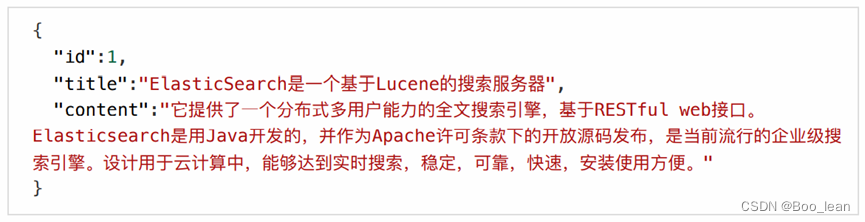

post man ��ͼ:

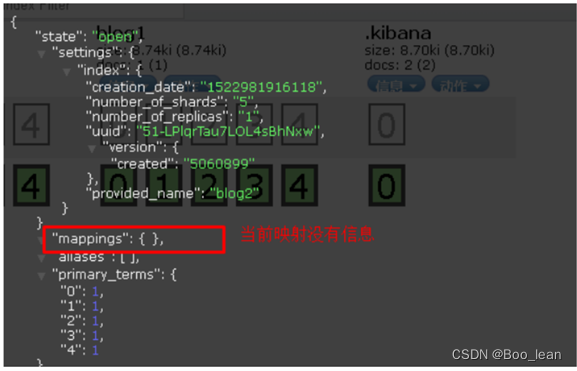

elasticsearch-head�鿴:

-

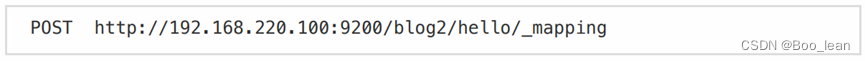

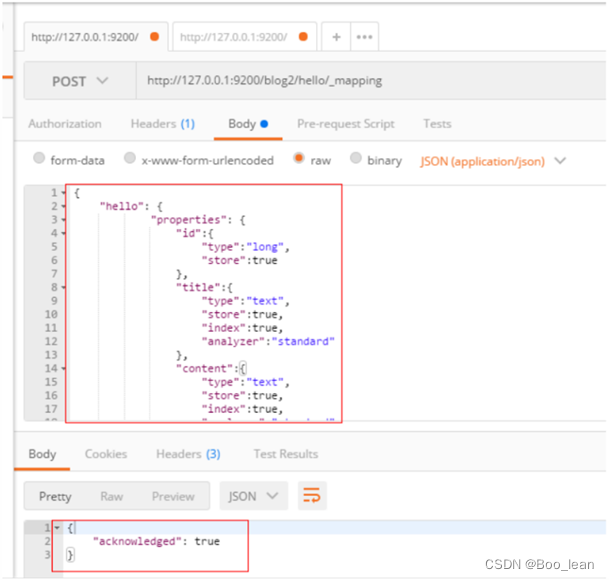

��������������mapping

���ǿ����ڴ�������ʱ����mapping��Ϣ,��ȻҲ�����ȴ�������Ȼ��������mapping�� ����һ�������в�����maping��Ϣ,ֱ��ʹ��put��������һ������,Ȼ������mapping��Ϣ�� �����url:(_mapping��ʾ����mapping,��es��api)

������:

�ο��ĵ�:https://www.cnblogs.com/wangzhuxing/p/9527151.html

-

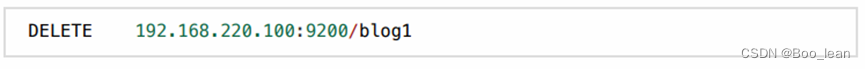

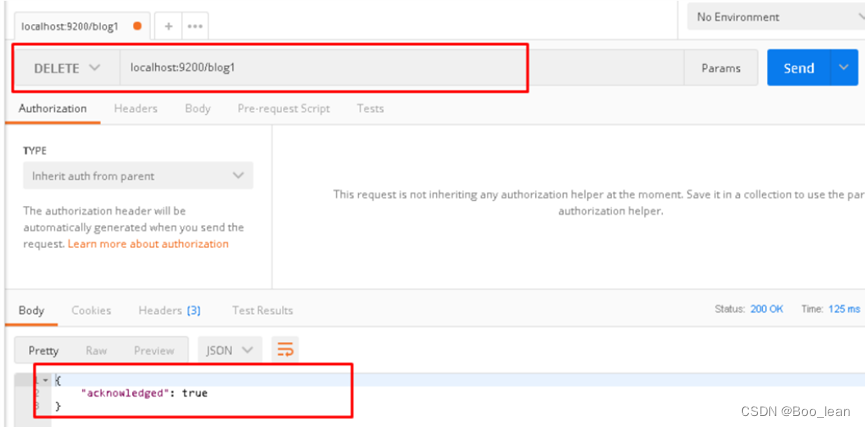

ɾ������index

����url:

-

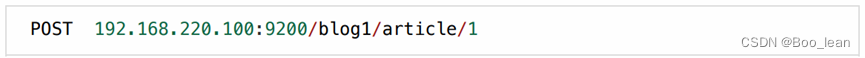

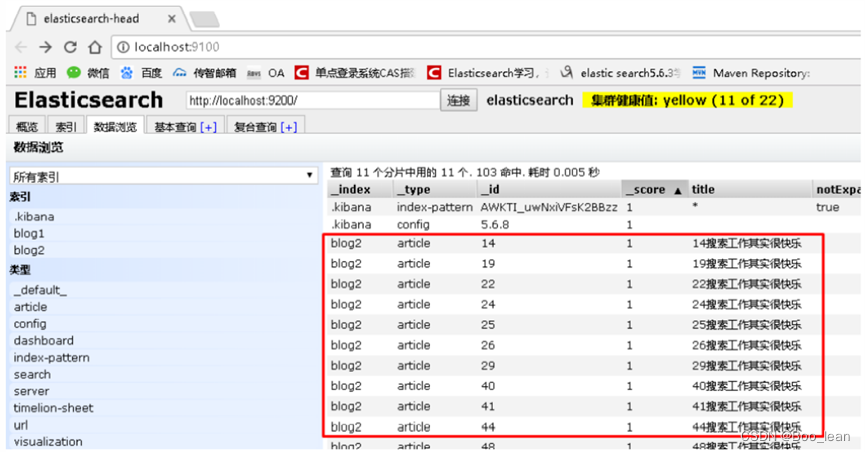

�����ĵ�document

����url:

������:

-

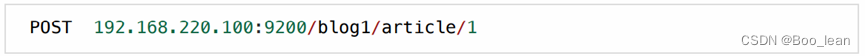

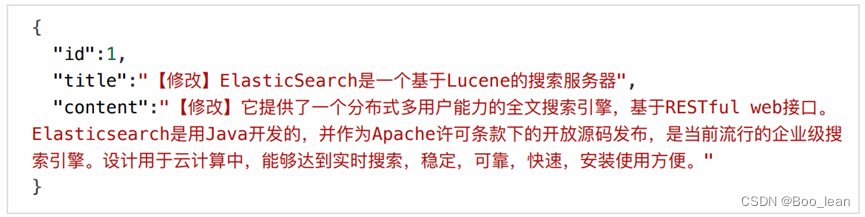

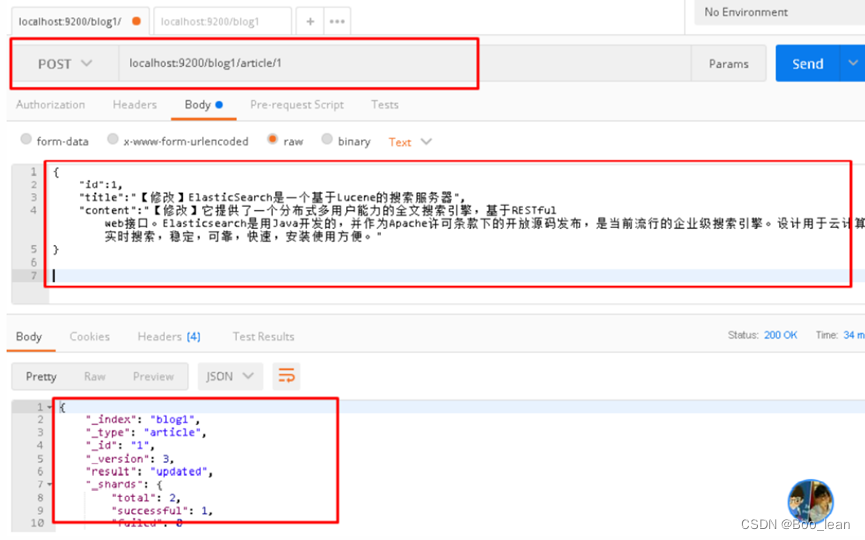

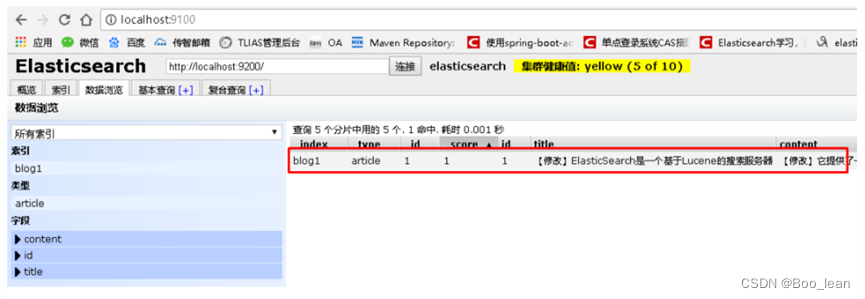

���ĵ�document

-

ɾ���ĵ�document

-

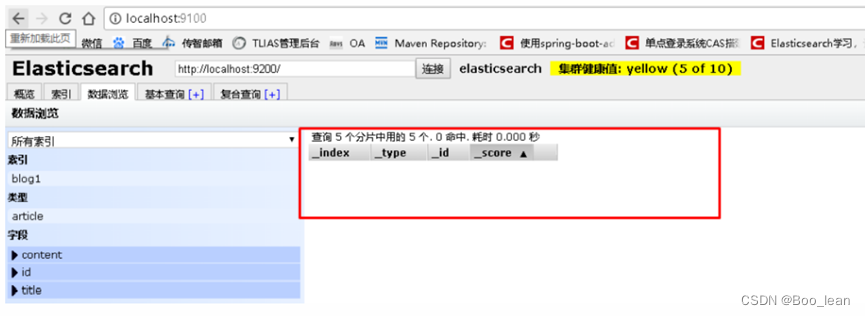

��ѯ�ĵ�-����id��ѯ

-

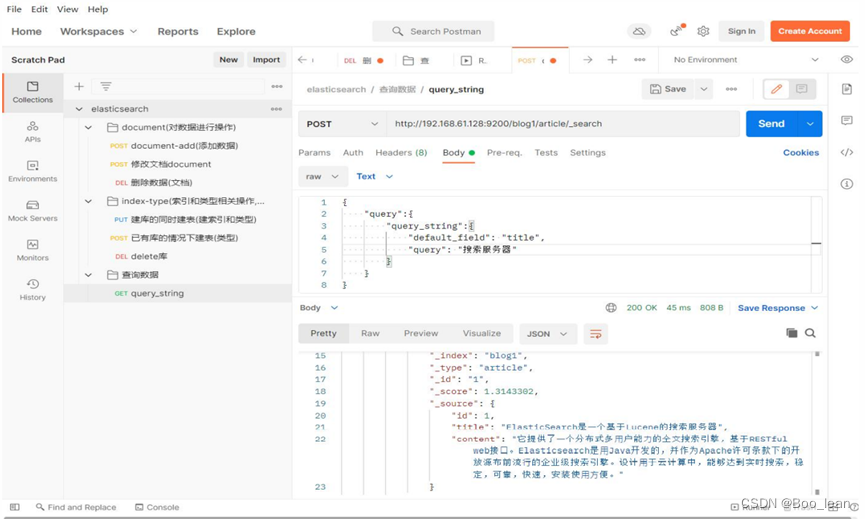

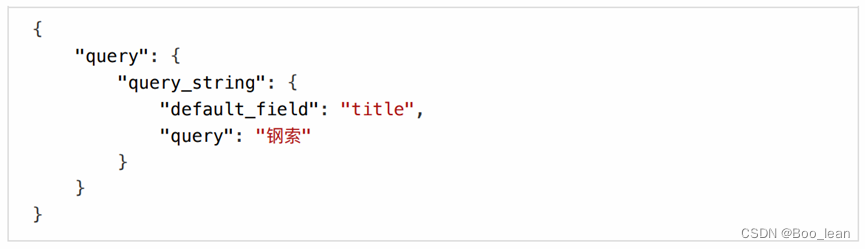

��ѯ�ĵ�-querystring��ѯ

(_search��ʾ����,��es��api)

ע��:����������"����������"��Ϊ"����",ͬ��Ҳ���������ĵ�,��ԭ��������潲���еõ���

���� -> ���֡�, ������,�����Ƿֳ�������,ע��Standard���ִ���,��Ѻ���ÿ����һ���ʴ浽�������е�tilte,Ҳ�ǰ���Standard���еķִ�,���������������ѵ����document -

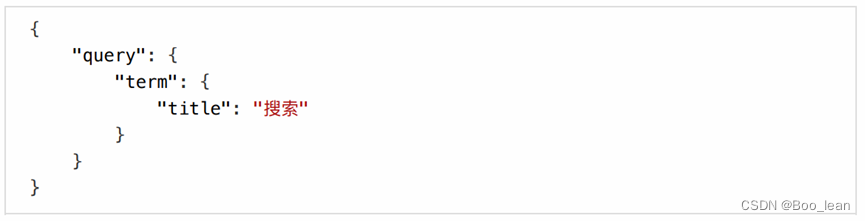

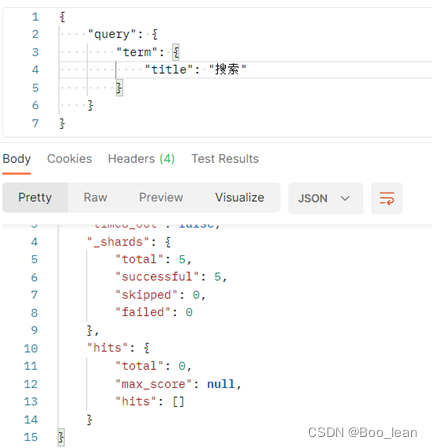

��ѯ�ĵ�-term��ѯ

�������ȡ���ڷִ���

�ĵ�����ʱ��mappingָ���˷ִ���standard(������Ľ���ÿ���ֵķִ�,�������������ɡ�title:�ѡ��͡�title:����)

query_string:����֮ǰ�������Ĺؼ��ʷִ�(��������title:�ѡ��͡�title:����)

term:�������Ĺؼ��ʲ��ִ�(��������title:������)

���� IK�ִ���

1. IK�ִ������

IKAnalyzer��һ����Դ��,����java���Կ����������������ķִʹ��߰�����2006��12���Ƴ�1.0�濪 ʼ,IKAnalyzer�Ѿ��Ƴ� ��3����汾�����,�����Կ�Դ��ĿLuceneΪӦ�������,��ϴʵ�ִʺ��ķ������㷨�����ķִ�������°汾��IKAnalyzer3.0��չΪ����Java�Ĺ��÷ִ����,������ Lucene��Ŀ,ͬʱ�ṩ�˶�Lucene��Ĭ���Ż�ʵ�֡�

IK�ִ���3.0����������:

1)���������еġ����������ϸ�����з��㷨��,����60����/��ĸ��ٴ���������

2)�����˶��Ӵ���������ģʽ,֧��:Ӣ����ĸ(IP��ַ��Email��URL)������(����,���������� ����,��������,��ѧ������),���Ĵʻ�(��������������)�ȷִʴ�����

3)����Ӣ����֧�ֲ��Ǻܺ�,���ⷽ��Ĵ����Ƚ��鷳.������һ�β�ѯ,ͬʱ��֧�ָ��˴������Ż��Ĵʵ�洢,��С���ڴ�ռ�á�

4)֧���û��ʵ���չ���塣

5)���Luceneȫ�ļ����Ż��IJ�ѯ������IKQueryParser;������������㷨�Ż���ѯ�ؼ��ֵ������������,�ܼ�������Lucene�����������ʡ�

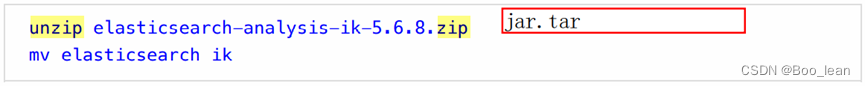

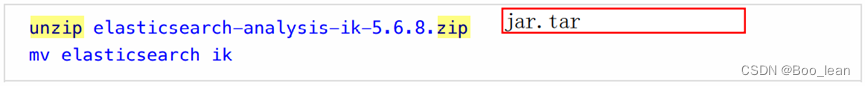

2. IK�ִ�����װ

-

��װik�ִ���

ע��:���밲װ��ElasticSearch�汾һ����IK������5.6.8,����ᱨ��,��������

IK�ִ������ص�ַhttps://github.com/medcl/elasticsearch-analysis-ik/releases

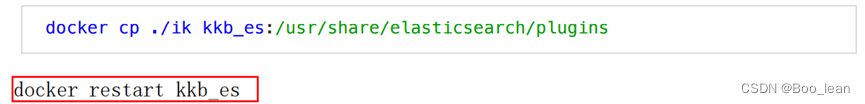

��ik�ִ����ϴ�����������,Ȼ���ѹ,��������Ϊik

��ikĿ¼������docker������pluginsĿ¼��

-

IK�ִ�������

����:http://192.168.211.132:9200/_analyze?analyzer=ik_smart&pretty=true&text=���dz���Ա

����:http://192.168.211.132:9200/_analyze?analyzer=ik_max_word&pretty=true&text=���dz���Ա

pretty=true:�Ż�չʾ�ִʽ��

text:�ִ�����

_analyze:esʹ�÷ִ�����api

analyzer:ָ���ִ���- ik_max_word:�Ὣ�ı�����ϸ���ȵIJ��

����Ὣ���л������������á����Ϊ���л��������л������л������ˡ�������������������á���ᡢ���õȴ�� - ik_smart:����������ȵIJ��

����Ὣ���л������������á����Ϊ�л��������������á�

- ik_max_word:�Ὣ�ı�����ϸ���ȵIJ��

�ߡ� Kibanaʹ��-����DSL���

��������ʹ�õ���elasticsearch-head���ʵ�����ݲ��ҵ�,����elasticsearch-head�Ĺ��ܱȽϵ�һ,����������Ҫһ����רҵ�Ĺ���ʵ�ֶ���־��ʵʱ����,Ҳ�������ǽ�����Ҫ����kibana��

Kibana ��һ�Դ�����ݷ����Ϳ��ӻ�ƽ̨,���� Elastic Stack ��Ա֮һ,������ں� Elasticsearch Э����������ʹ�� Kibana �� Elasticsearch �����е����ݽ����������鿴�����������������Ժܷ��������ͼ��������ͼ�����ݽ��ж�Ԫ���ķ����ͳ��֡�

Kibana ����ʹ������ͨ���������ܼ�,����������Ľ�����������ٴ����ͷ�����̬�����DZ����� Elasticsearch ��ʵʱ���ݱ仯��

� Kibana �dz��������Էַ������ Kibana �İ�װ����ʼ̽�� Elasticsearch ���������ݨCû�д��롢����Ҫ����Ļ�����ʩ��

(һ) Kibana���ذ�װ

-

��������

-

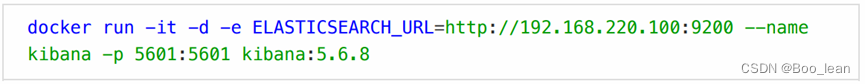

��װkibana����

ִ����������,��ʼ��װkibana����

ELASTICSEARCH_URL=http://192.168.220.100:9200:��ָ���ӵ�ES��ַ

restart=always:ÿ�η�������,Ҳ���ǿ�������

5601:5601:�˿ں�

��ݼ�

-

���ʲ���

����http://192.168.220.100:5601

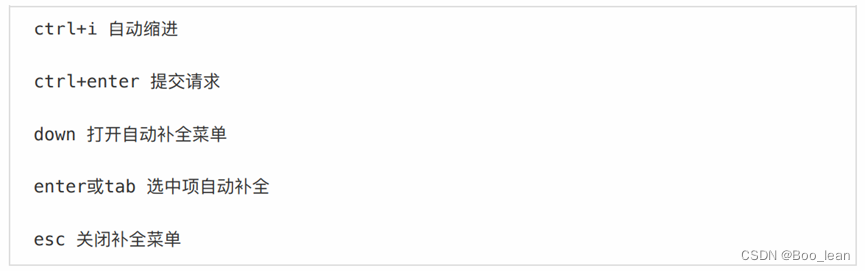

(��) Kibanaʹ��

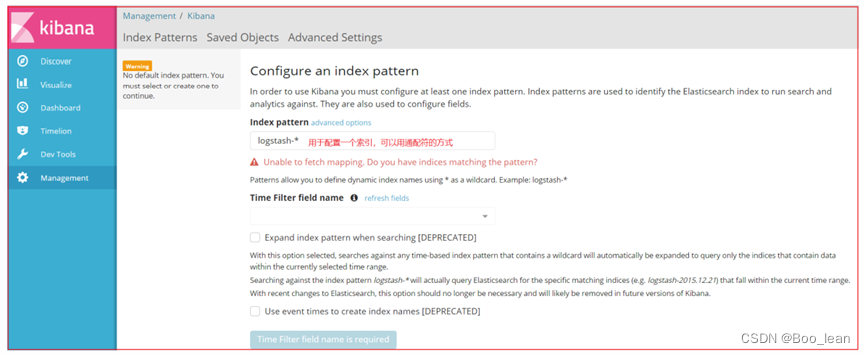

1. ��������

Ҫʹ��Kibana,��������������һ���������������ڱ�ʶElasticsearch���������������ͷ��������ǻ����������ֶΡ�

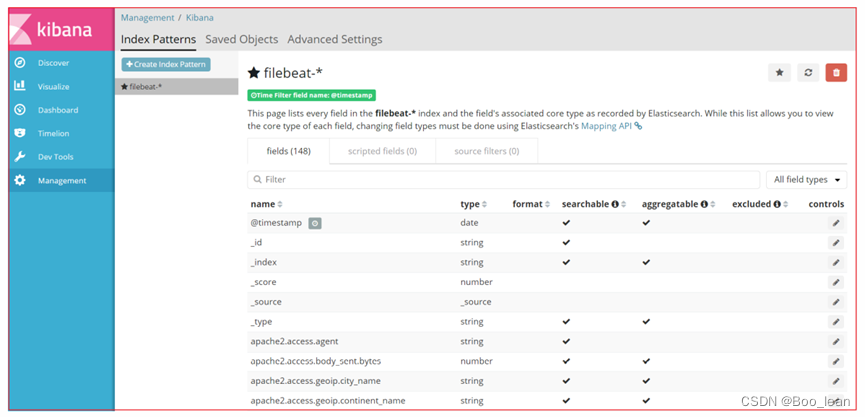

�������������Ƶ�ƥ�䷽ʽ����,����2��ѡ��ù�ѡ�����create,��չʾ����ǰ���õ�����������Ϣ,����ͼ:

���ÿ������ѡ��ֱ����������˼:

2. ��������

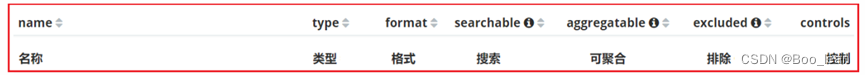

DiscoverΪ������������,���Զ���־��Ϣ��������������

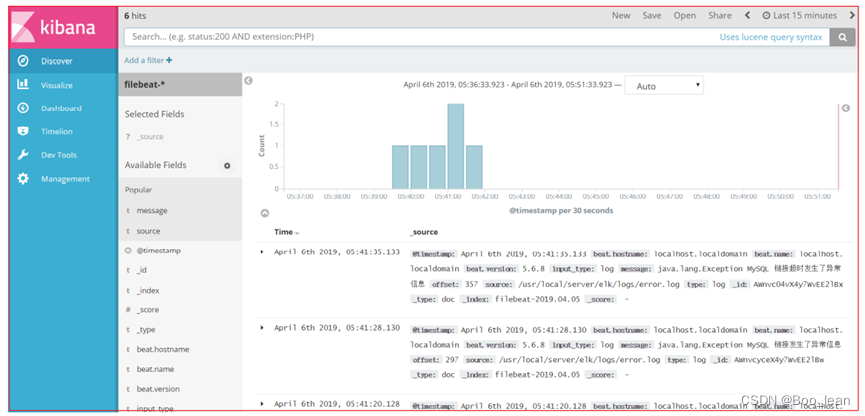

����ʹ��Discoverʵ�������������˺�����������ʾ�Լ��ؼ�������,����ͼ:

3. DSL���ʹ��

-

Query DSL�ṹ����ѯ����

Query DSL��һ��Java��Դ������ڹ������Ͱ�ȫ��SQL��ѯ��䡣����API���洫ͳ��ƴ���ַ����������ѯ��䡣ĿǰQuerydsl֧�ֵ�ƽ̨����JPA,JDO,SQL,Java Collections,RDF,Lucene, Hibernate Search��elasticsearch�ṩ��һ������JSON��DSL�����������ѯ�� -

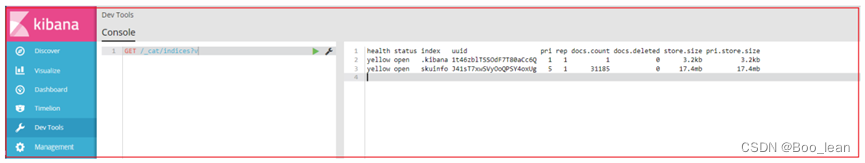

��������

1�� ��ѯ��������

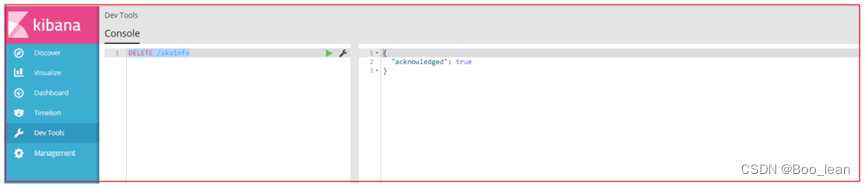

2�� ɾ��ij������

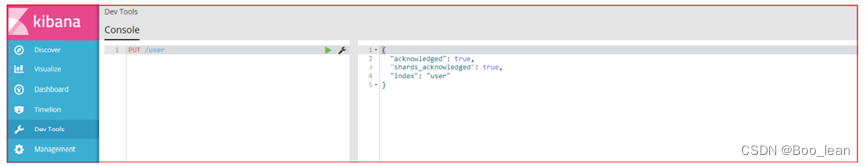

3�� ��������

4�� ����ӳ��

search_analyzer����ָ�������ṩ����ѯʱ�ķִ���

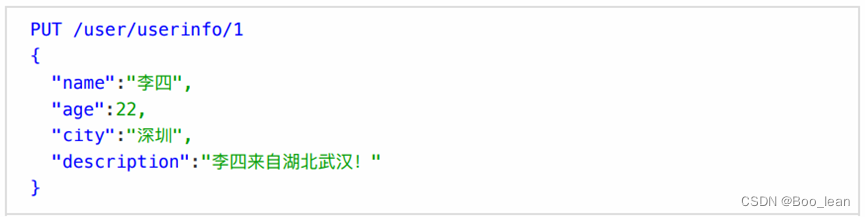

5�� �����ĵ�����

����������3����¼:#�����ĵ����� id=2 PUT /user/userinfo/2 { "name":"����", "age":35, "city":"����", "description":"�����ס������!" } #�����ĵ����� id=3 PUT /user/userinfo/3 { "name":"����", "age":19, "city":"����", "description":"�����ڴ�,���Ժ����人" } #�����ĵ����� id=4 PUT /user/userinfo/4 { "name":"������", "age":66, "city":"�人", "description":"���人����,�����人!" } #�����ĵ����� id=5 PUT /user/userinfo/5 { "name":"������", "age":77, "city":"����", "description":"�������������ڱ���,�����ڹ��ݹ���!", "address":"�㶫ʡï����" } #�����ĵ����� id=6 PUT /user/userinfo/6 { "name":"����", "age":55, "city":"����", "description":"�������Թ��ݰ�����,���µ�������8��!" } #�����ĵ����� id=7 PUT /user/userinfo/7 { "name":"�Թ���", "age":57, "city":"�人", "description":"�人�Թ���,�����ڴ����а�����,��н7500!" }6�� ������

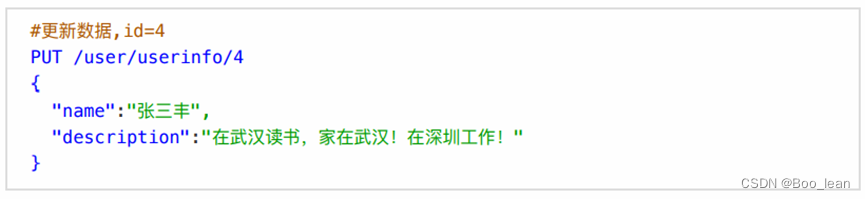

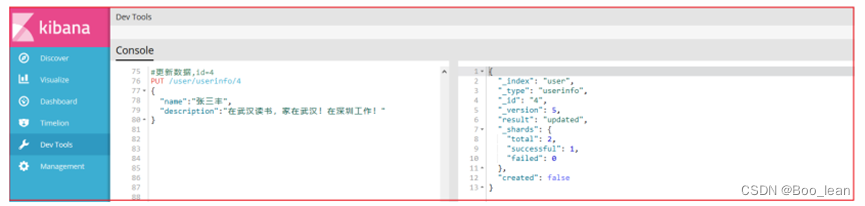

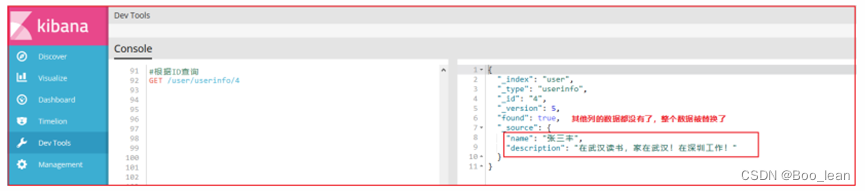

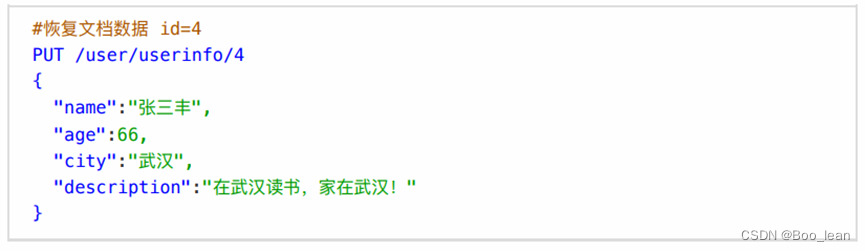

a�� �滻����

�������ݿ���ʹ��֮ǰ�����Ӳ���,���ֲ����Ὣ���������滻��,��������:

b�� ���²���

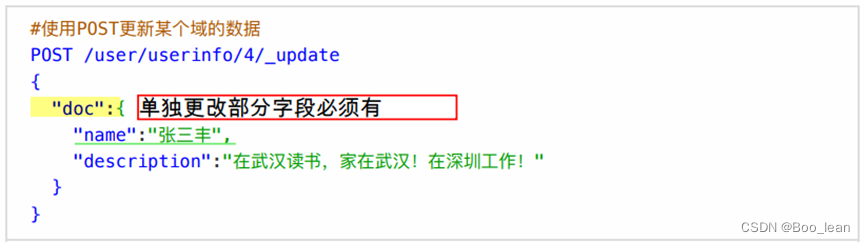

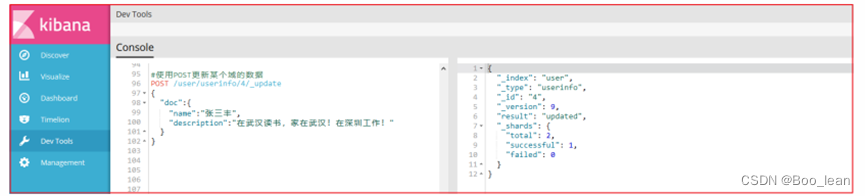

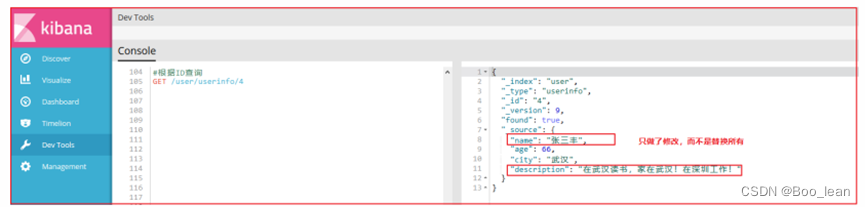

������ʹ����������ָ�����:

ʹ��POST����ij���е�����

7�� ɾ��Document

-

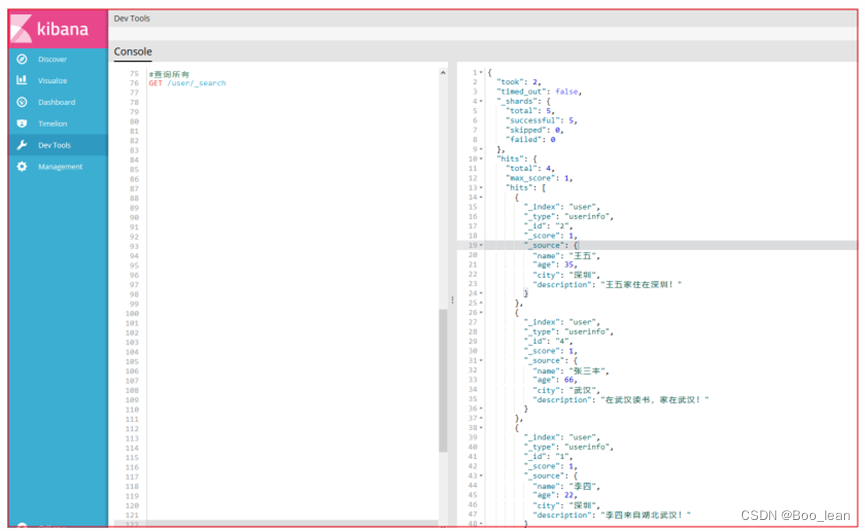

���ݲ�ѯ

1�� ��ѯ��������

2�� ����ID��ѯ

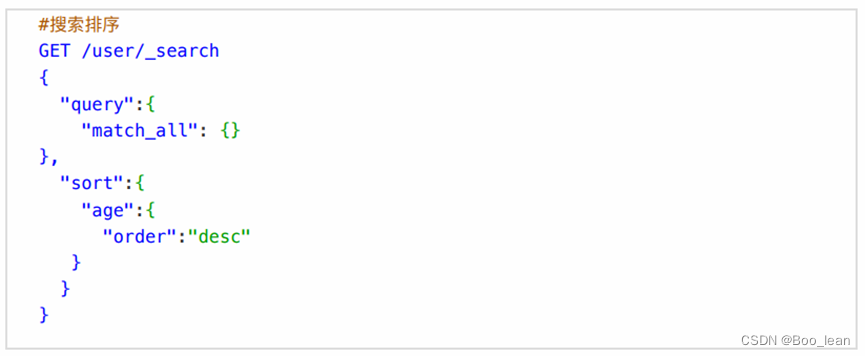

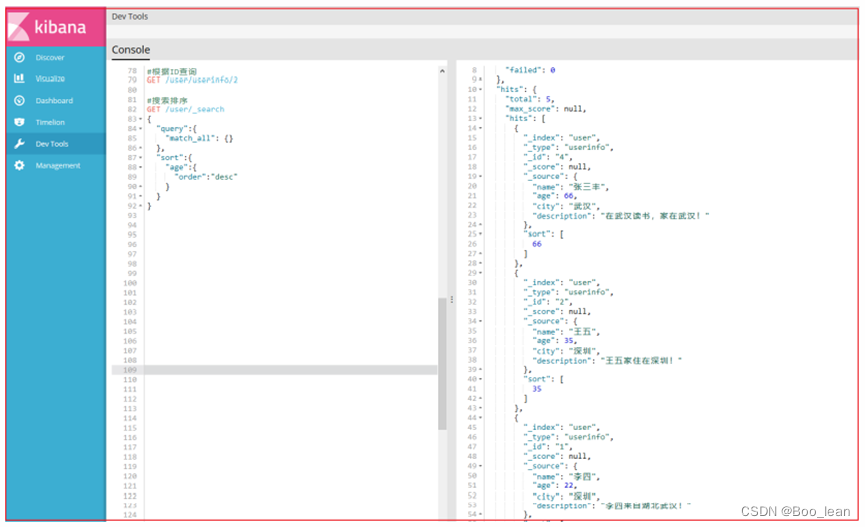

3�� Sort����

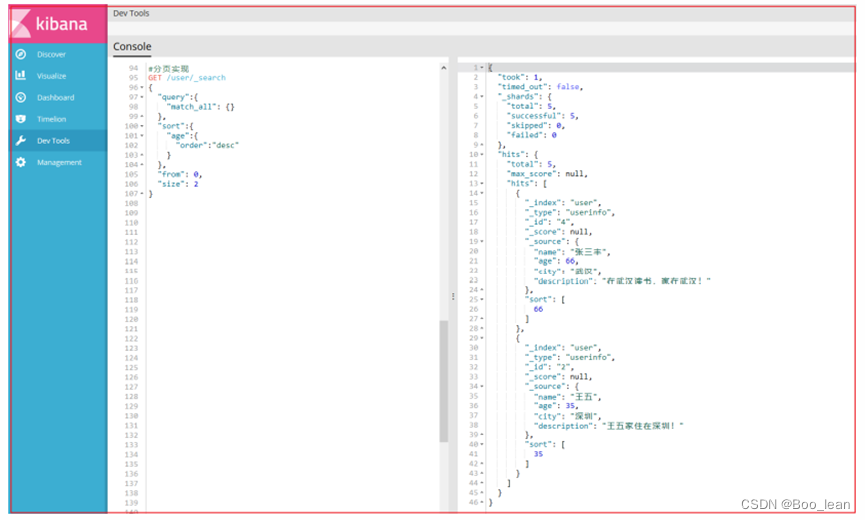

4�� ��ҳ

����:

from:����N�ļ�¼��ʼ��ѯ

size:ÿҳ��ʾ����

������:

-

��ѯģʽ

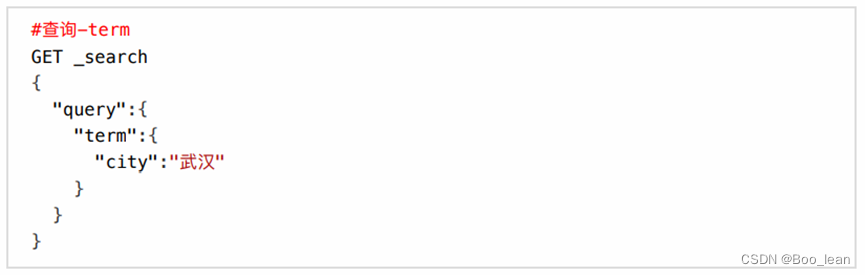

1�� term���ִʲ�ѯ

term��Ҫ���ڷִʾ�ȷƥ��,���ַ�������ֵ�����ڵ�(���ʺ����:1.���г�Ӣ���ַ���������ֵ 2. �ַ���ֵ����ð�Ż����� 3.ϵͳ�Դ�������_version)

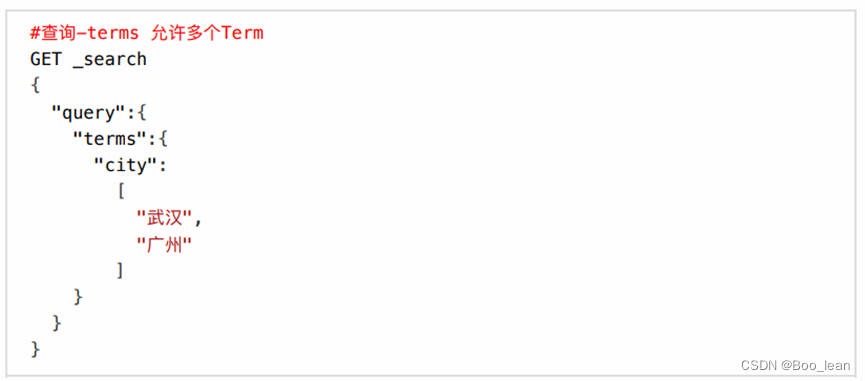

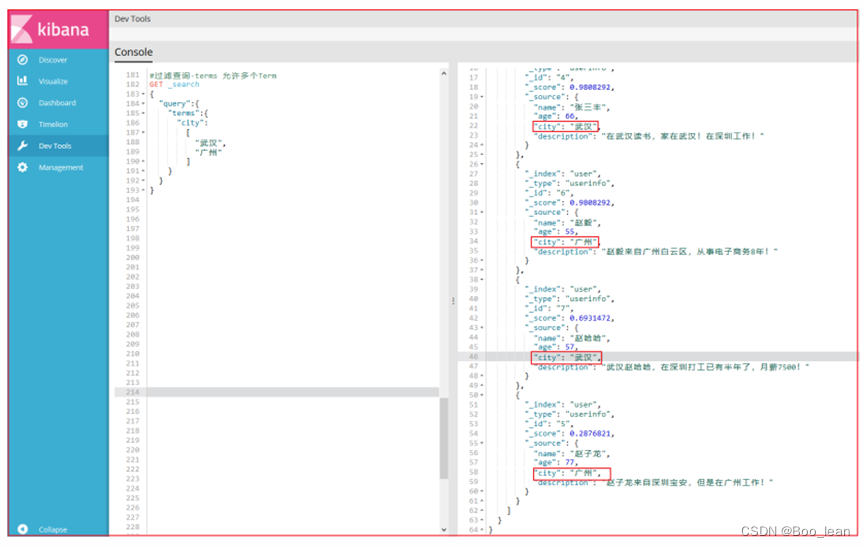

2�� terms ���ѯ

termΪ���ִʲ�ѯ

terms �� term �е�����,�� terms ����ָ�����ƥ�������� ���ij���ֶ�ָ���˶��ֵ,��ô�ĵ���Ҫһ��ȥ��ƥ�䡣

��������:

3�� match�ִʲ�ѯ

matchΪ�ִʲ�ѯ

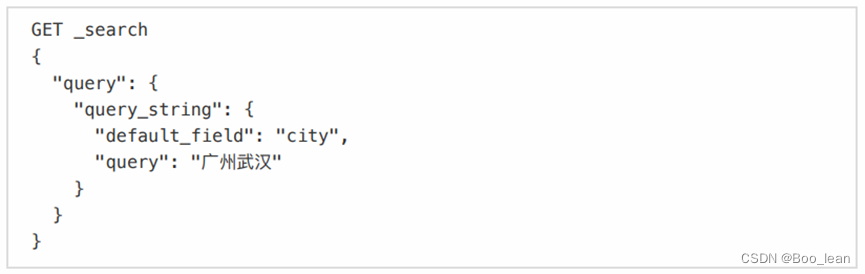

4�� query_string�ִʲ�ѯ

query_stringΪ�ִʲ�ѯ

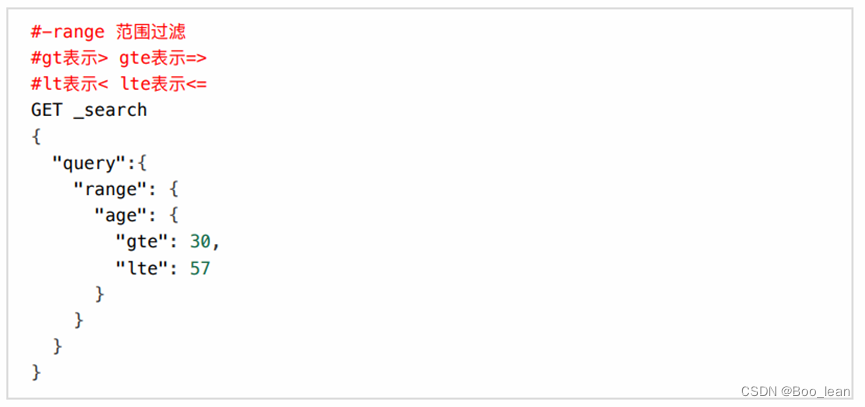

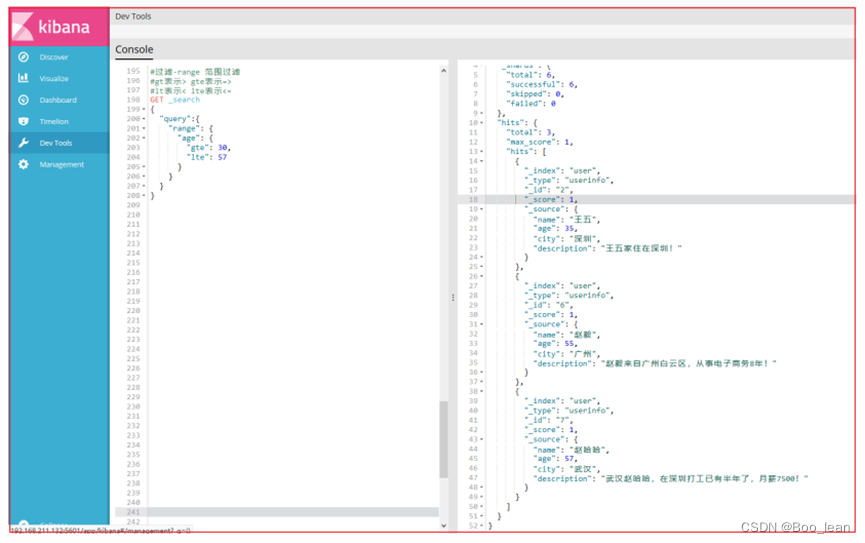

5�� range ��Χ��ѯ

range����������������ָ����Χ����һ���������������Dz�ѯ���䷶Χ

��������:

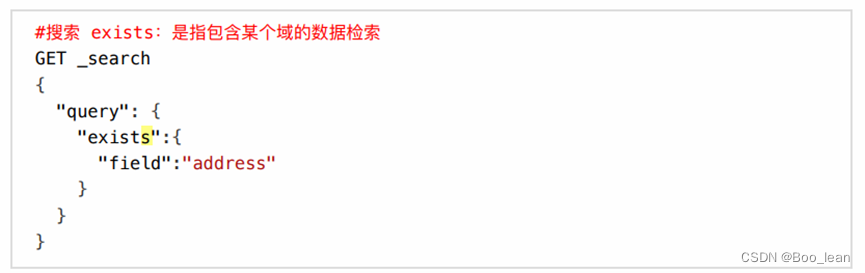

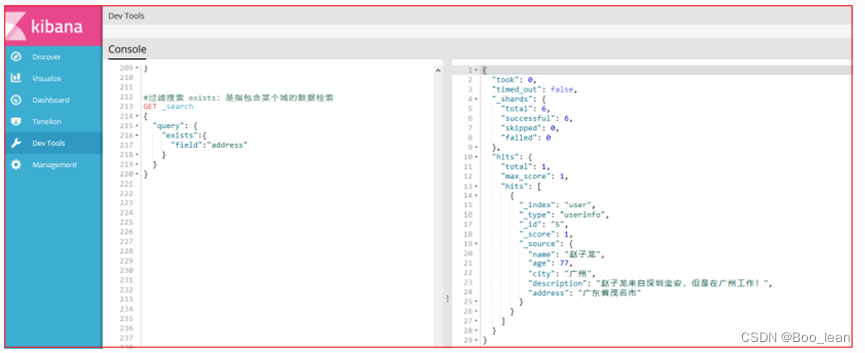

6�� exists����ڲ�ѯ

exists ���˿�����������ӵ��ij���������

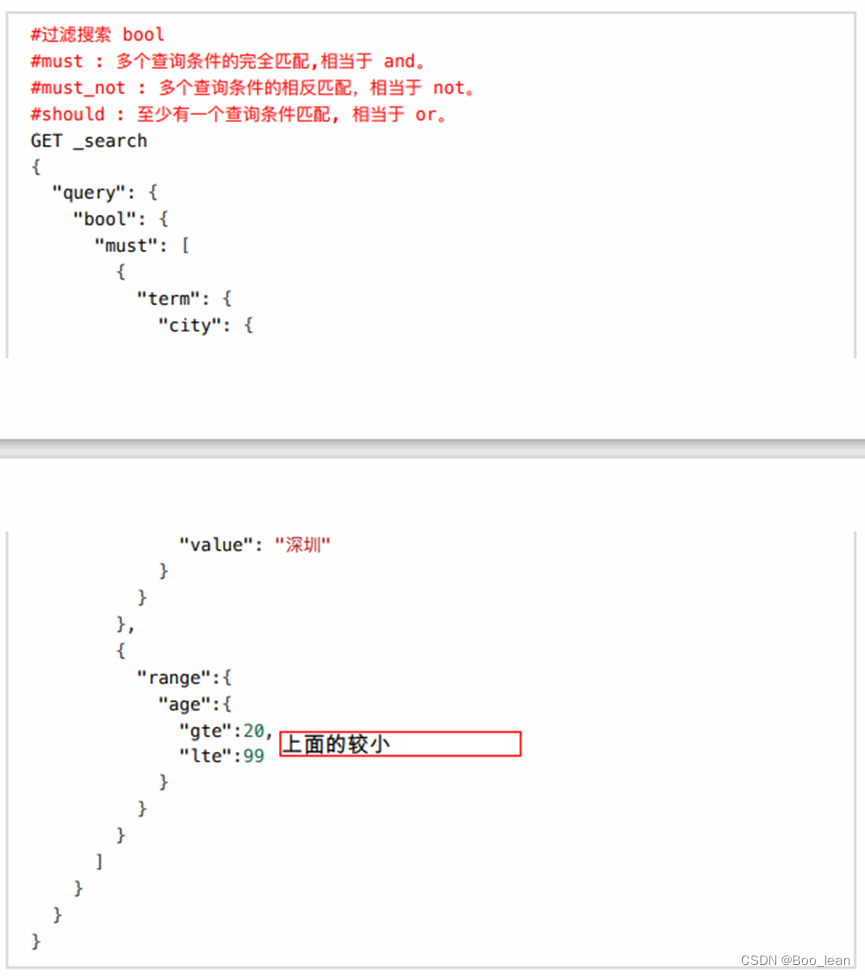

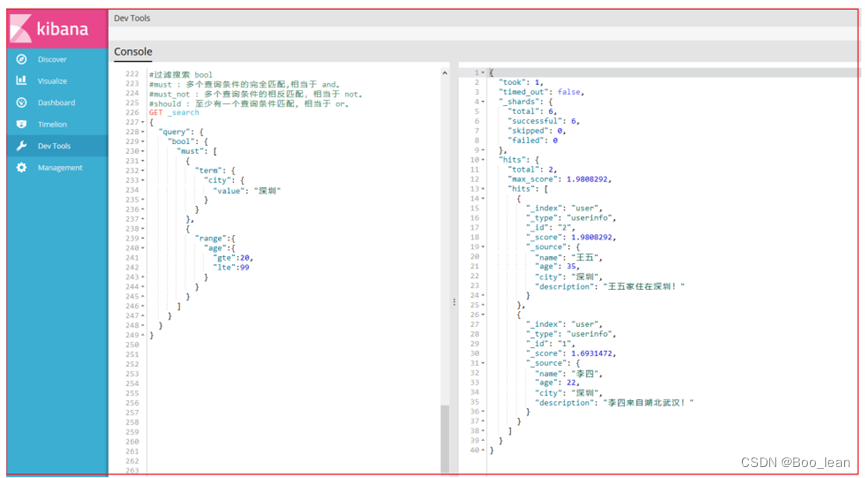

7�� bool ��������ѯ

bool ���������ϲ����������ѯ����IJ�����,������һ�²�����:- must : �����ѯ��������ȫƥ��,�൱�� and��

- must_not : �����ѯ�������෴ƥ��,�൱�� not��

- should : ������һ����ѯ����ƥ��, �൱�� or��

��Щ�������Էֱ�̳�һ��������������һ����������������:

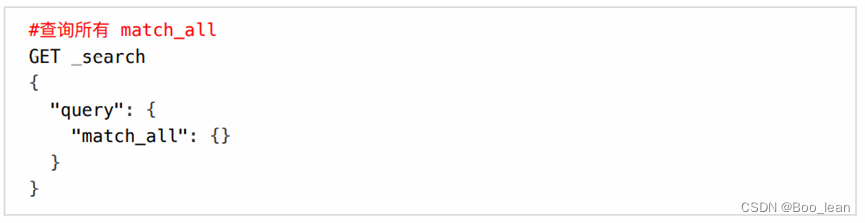

8�� match_all ���в�ѯ

���Բ�ѯ�������ĵ�,��û�в�ѯ�����µ�Ĭ����䡣

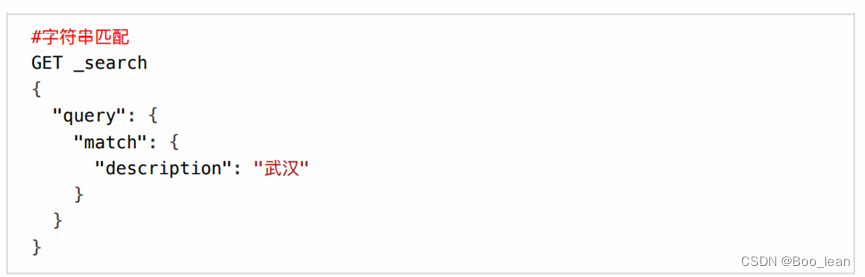

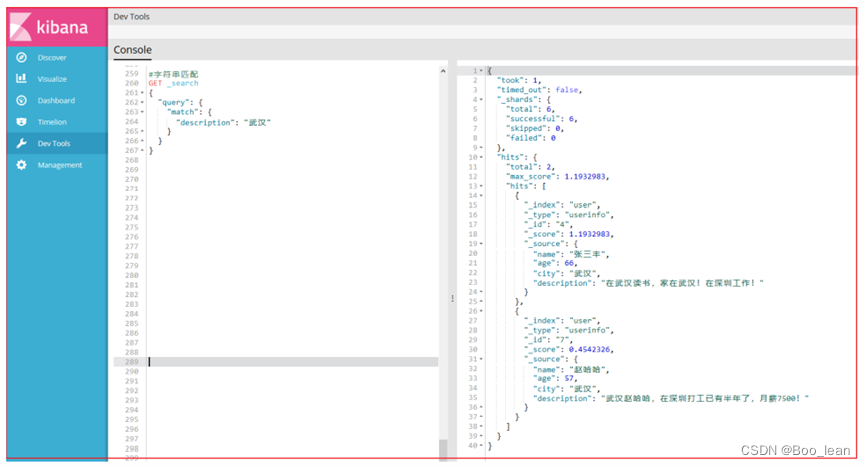

9�� match ����ѯ

match��ѯ��һ������ѯ,��������Ҫȫ�ı���ѯ���Ǿ�ȷ��ѯ�����϶�Ҫ�õ�����

�����ʹ�� match ��ѯһ��ȫ�ı��ֶ�,������������ѯ֮ǰ�÷������ȷ���matchһ�²�ѯ�ַ�:

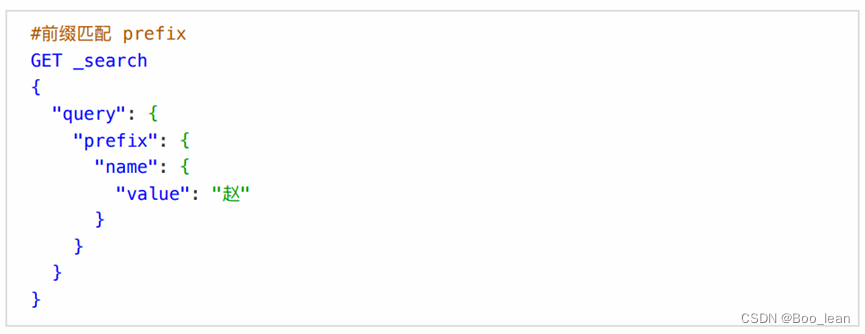

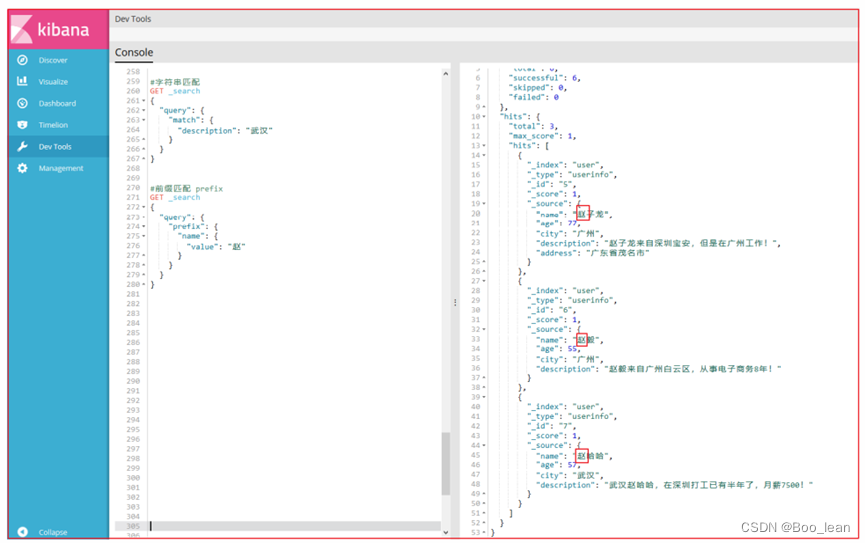

10�� prefix ��ѯ

��ʲô�ַ���ͷ��,���Ը����� prefix ,�����ѯ�������ſ�ʼ���û�����

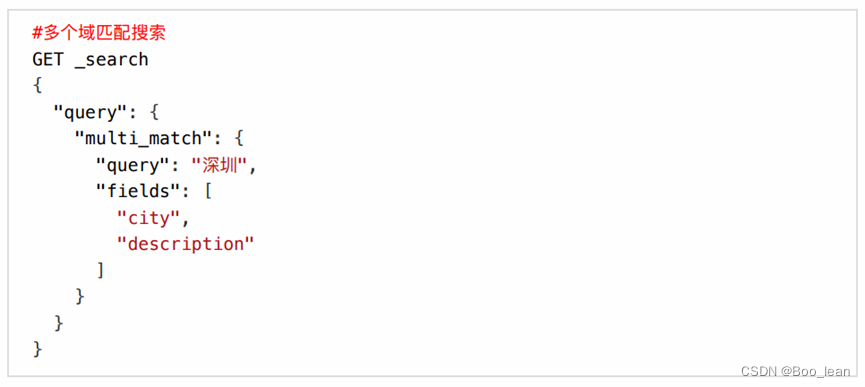

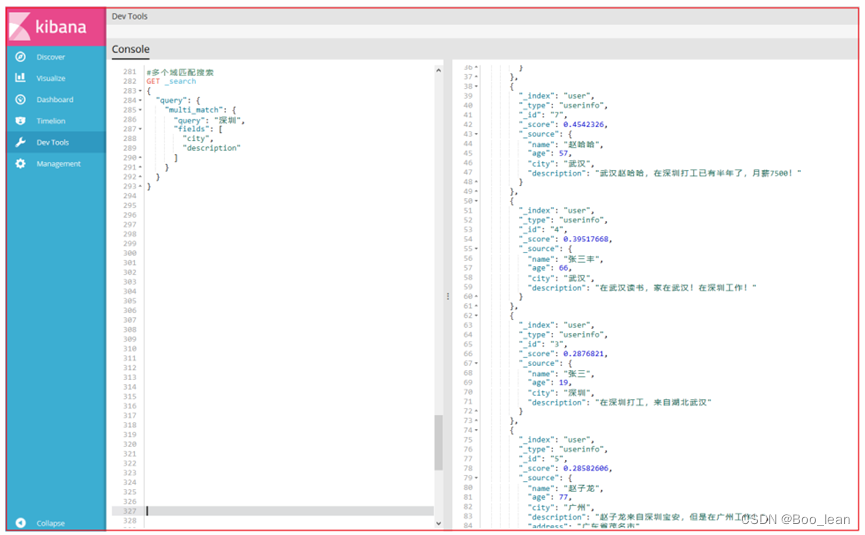

11�� multi_match ���ֶβ�ѯ

multi_match��ѯ��������match��ѯ�Ļ�����ͬʱ��������ֶ�,�ڶ���ֶ���ͬʱ��һ��

�ˡ� ElasticSearch��̲���

(һ) ��̲���

1. ��������,��������

pom.xml����

<dependencies>

<dependency>

<groupId>org.elasticsearch</groupId>

<artifactId>elasticsearch</artifactId>

<version>5.6.8</version>

</dependency>

<dependency>

<groupId>org.elasticsearch.client</groupId>

<artifactId>transport</artifactId>

<version>5.6.8</version>

</dependency>

<dependency>

<groupId>org.apache.logging.log4j</groupId>

<artifactId>log4j-to-slf4j</artifactId>

<version>2.9.1</version>

</dependency>

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-api</artifactId>

<version>1.7.24</version>

</dependency>

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-simple</artifactId>

<version>1.7.21</version>

</dependency>

<dependency>

<groupId>log4j</groupId>

<artifactId>log4j</artifactId>

<version>1.2.12</version>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

</dependency>

</dependencies>

2. ��������index

/**

* ��������

*/

@Test

public void createIndex() throws UnknownHostException {

// 1. ���ü���ļ�Ⱥ

Settings settings = Settings.builder().put("cluster.name", "my-elasticsearch").build();

// 2. ����Client���Ӷ���

TransportClient client = new PreBuiltTransportClient(settings)

.addTransportAddress(

new InetSocketTransportAddress(InetAddress.getByName("192.168.174.128"), 9300)

);

// 3. ������Ϊdemo������

client.admin().indices().prepareCreate("demo").get();

// 4. �ͷ���Դ

client.close();

}

3. ����ӳ��mapping

/**

* ����ӳ��

*/

@Test

public void createMappings() throws IOException, ExecutionException, InterruptedException {

// 1. ���ü���ļ�Ⱥ

Settings settings = Settings.builder().put("cluster.name", "my-elasticsearch").build();

// 2. ����Client���Ӷ���

TransportClient client = new PreBuiltTransportClient(settings)

.addTransportAddress(

new InetSocketTransportAddress(InetAddress.getByName("192.168.174.128"), 9300)

);

// 3. ����ӳ��

/**

��ʽ:

"mappings" : {

"article" : {

"properties" : {

"id" : { "type" : "integer" },

"content" : { "type" : "string" },

"author" : { "type" : "string" }

}

}

}

*/

XContentBuilder builder = XContentFactory.jsonBuilder()

.startObject()

.startObject("article")

.startObject("properties")

.startObject("id")

.field("type", "integer")

.field("store", "yes")

.endObject()

.startObject("title")

.field("type", "string")

.field("store", "yes")

.field("analyzer", "ik_smart")

.endObject()

.startObject("content")

.field("type", "string")

.field("store", "yes")

.field("analyzer", "ik_smart")

.endObject()

.endObject()

.endObject()

.endObject();

// 4. ����ӳ��

PutMappingRequest mapping = Requests.putMappingRequest("demo").type("article").source(builder);

client.admin().indices().putMapping(mapping).get();

// 5. �ر���Դ

client.close();

}

4. ����ӳ��mapping

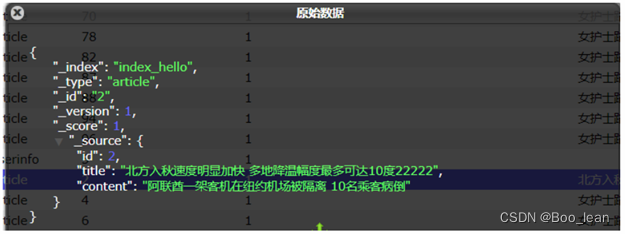

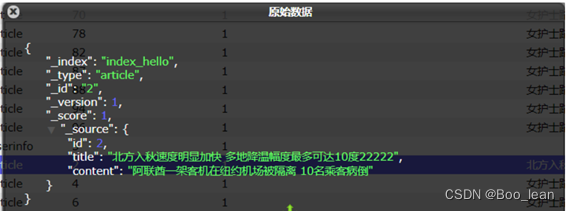

- �����ĵ�(ͨ��XContentBuilder)

/**

* �����ĵ�(ͨ��XContentBuilder�ķ�ʽ)

*/

@Test

public void createDocument1() throws IOException {

// 1. ���ü���ļ�Ⱥ

Settings settings = Settings.builder().put("cluster.name", "my-elasticsearch").build();

// 2. ����Client���Ӷ���

TransportClient client = new PreBuiltTransportClient(settings)

.addTransportAddress(

new InetSocketTransportAddress(InetAddress.getByName("192.168.174.128"), 9300)

);

// 3. ����һ���ĵ�����

XContentBuilder builder = XContentFactory.jsonBuilder()

.startObject()

.field("id", 1)

.field("title", "���������ٶ����Լӿ�,��ؽ��·������ɴ�10��22222")

.field("content", "������һ�ܿͻ���ŦԼ����������,10���˿Ͳ���")

.endObject();

// 4. ���ĵ��������ӵ�������

client.prepareIndex()

// ������������

.setIndex("demo")

// ����type

.setType("article")

// �����ĵ���id,��������õĻ����Զ�����һ��id

.setId("2")

// �����ĵ���Ϣ

.setSource(builder)

// ִ�в���

.get();

// 5. �ͷ���Դ

client.close();

}

-

�����ĵ�(ʹ��Jacksonת��ʵ��)

1�� ����Articleʵ��public class Article { private Integer id; private String title; private String content; getter/setter... }2�� ����jackson����

<dependency> <groupId>com.fasterxml.jackson.core</groupId> <artifactId>jackson-core</artifactId> <version>2.8.1</version> </dependency> <dependency> <groupId>com.fasterxml.jackson.core</groupId> <artifactId>jackson-databind</artifactId> <version>2.8.1</version> </dependency> <dependency> <groupId>com.fasterxml.jackson.core</groupId> <artifactId>jackson-annotations</artifactId> <version>2.8.1</version> </dependency>3�� ����ʵ��

/** * �����ĵ�(ͨ��Jacksonת��ʵ��ķ�ʽ) */ @Test public void createDocument2() throws IOException { // 1. ���ü���ļ�Ⱥ Settings settings = Settings.builder().put("cluster.name", "my-elasticsearch").build(); // 2. ����Client���Ӷ��� TransportClient client = new PreBuiltTransportClient(settings) .addTransportAddress( new InetSocketTransportAddress(InetAddress.getByName("192.168.174.128"), 9300) ); // 3. ����һ��Article���� Article article = new Article(2,"MH370���ڼ���կ����?�й�һ��˾��ʮ������ȥ����","������Ƶ�������Ϸ!��15�����������Ϸ���õ����ɱ"); // 4. ��article����ת����json��ʽ���ַ��� ObjectMapper objectMapper = new ObjectMapper(); String jsonDocument = objectMapper.writeValueAsString(article); // 5. ʹ��client������ĵ�д�������� client.prepareIndex("demo","article","3") .setSource(jsonDocument, XContentType.JSON) .get(); // 6. �ͷ���Դ client.close(); }

5. ��ѯ�ĵ�����

���²�ѯ��������ֻ����QueryBuilder�Ĵ�����ͬ��

Ctrl+Alt+Shift+T:��ȡ�����Ϊ�ع������Ŀ�ݼ�

1)��ȡ����

1�� ���Ӷ���

```java

TransportClient client;

@Before

public void init() throws UnknownHostException {

// 1. ���ü���ļ�Ⱥ

Settings settings = Settings.builder().put("cluster.name", "my-elasticsearch").build();

// 2. ����Client���Ӷ���

client = new PreBuiltTransportClient(settings)

.addTransportAddress(

new InetSocketTransportAddress(InetAddress.getByName("192.168.174.128"), 9300)

);

}

```

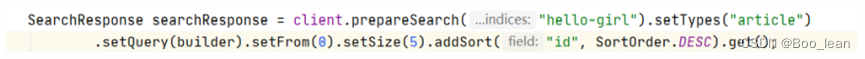

2�� ��ѯ����(������ҳ����)

public void search(QueryBuilder queryBuilder) {

SearchResponse searchResponse = client.prepareSearch("demo")

.setTypes("article")

.setQuery(queryBuilder)

// ���÷�ҳ��Ϣ

.setFrom(0)

// úÿҳ��ʾ������

.setSize(5)

.get();

// ȡ��ѯ���

SearchHits searchHits = searchResponse.getHits();

// ȡ��ѯ����ܼ�¼��

System.out.println("��ѯ����ܼ�¼��"+searchHits.getTotalHits());

// ��ѯ����б�

Iterator<SearchHit> iterator = searchHits.iterator();

while(iterator.hasNext()){

SearchHit searchHit = iterator.next();

// ��ӡ�ĵ�����,��json��ʽ���

System.out.println(searchHit.getSourceAsString());

// ȡ�ĵ�������

System.out.println("---�ĵ�����---");

Map<String, Object> document = searchHit.getSource();

System.out.println("id:"+document.get("id"));

System.out.println("title:"+document.get("title"));

System.out.println("content:"+document.get("content"));

}

// �ر���Դ

client.close();

}

- termQuery

@Test

public void QueryByTerm() {

/**

* ����1:Ҫ�������ֶ�

* ����2:Ҫ�����Ĺؼ���

*/

// 3. ����һ����ѯ����

QueryBuilder queryBuilder = QueryBuilders.termQuery("title", "����");

// 4. ִ�в�ѯ

search(queryBuilder);

}

- QueryString

@Test

public void QueryByQueryString() {

/**

* ����1:Ҫ�������ֶ�

* ����2:Ҫ�����Ĺؼ���

*/

// 3. ����һ����ѯ����

QueryBuilder queryBuilder = QueryBuilders.queryStringQuery("��������").defaultField("title");

// 4. ִ�в�ѯ

search(queryBuilder);

}

- MatchQuery

@Test

public void QueryByMatchString() {

/**

* ����1:Ҫ�������ֶ�

* ����2:Ҫ�����Ĺؼ���

*/

// 3. ����һ����ѯ����

QueryBuilder queryBuilder = QueryBuilders.matchQuery("title","��������");

// 4. ִ�в�ѯ

search(queryBuilder);

}

- ʹ���ĵ�ID��ѯ�ĵ�

@Test

public void QueryById() {

// 3. ����һ����ѯ����

QueryBuilder queryBuilder = QueryBuilders.idsQuery().addIds("2","3");

// 4. ִ�в�ѯ

search(queryBuilder);

}

- ��ѯ�ĵ���ҳ����

�鿴�Ϸ���ȡ�IJ�ѯ����

(��) ��ѯ�ṹ��������

-

������ʾ�ĸ���

�����̳�����"�ʼDZ�"

-

������ʾ��html����

ͨ�������߹��߲鿴�������ݵ�html����ʵ��:

ElasticSearch���ԶԲ�ѯ���������йؼ��ֲ��ֽ��б�ǩ����ʽ������,��������Ҫ����ElasticSearch ʹ��ʲô��ǩ�Ը����ؼ��ֽ��а��� -

������ʾ����ʵ��

@Test

public void highLightSearch() {

QueryBuilder queryBuilder = QueryBuilders.multiMatchQuery("����","title","content");

HighlightBuilder highlightBuilder = new HighlightBuilder();

highlightBuilder.field("title").field("content");

highlightBuilder.preTags("<em>");

highlightBuilder.postTags("</em>");

// ִ�в�ѯ

SearchResponse searchResponse = client.prepareSearch("demo")

.setTypes("article")

.setQuery(queryBuilder)

// ���ø�����Ϣ

.highlighter(highlightBuilder)

.get();

// ȡ��ѯ���

SearchHits searchHits = searchResponse.getHits();

// ȡ��ѯ����ܼ�¼��

System.out.println("��ѯ����ܼ�¼��"+searchHits.getTotalHits());

// ��ѯ����б�

Iterator<SearchHit> iterator = searchHits.iterator();

while(iterator.hasNext()){

SearchHit searchHit = iterator.next();

// ��ӡ�ĵ�����,��json��ʽ���

System.out.println(searchHit.getSourceAsString());

// ȡ�ĵ�������

System.out.println("---�ĵ�����---");

Map<String, Object> document = searchHit.getSource();

System.out.println("id:"+document.get("id"));

System.out.println("title:"+document.get("title"));

System.out.println("content:"+document.get("content"));

// �������

System.out.println("---�������---");

Map<String, HighlightField> highlightFields = searchHit.getHighlightFields();

if (highlightFields.size()>0){

for (Map.Entry<String,HighlightField> entry:highlightFields.entrySet()) {

System.out.println(entry.getKey()+":"+Arrays.toString(entry.getValue().getFragments()));

}

}

}

// �ر���Դ

client.close();

}

ע��:���������,��᷵�ظ������,ǰ���õ���ֱ���ø���������ַ��������滻,�еĽ����ʾΪ������

�š� Spring Data ElasticSearch

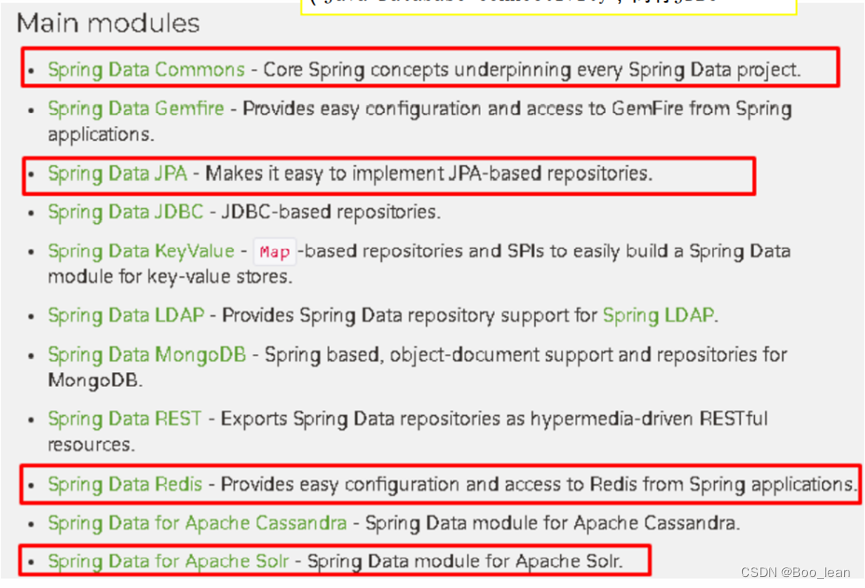

1. ���

-

Spring Data

Spring Data��һ��Ա�����ڼ����ݿ����,��֧���Ʒ���Ŀ�Դ��ܡ�����ҪĿ����ʹ�ö����ݵķ��ʱ�÷�����,��֧��map-reduce��ܺ��Ƽ������ݷ��� Spring Data���Լ���ļ�JPA��д��,�����ڼ�������дʵ�ֵ������,ʵ�ֶ����ݵķ��ʺͲ���������CRUD��,���������ҳ�������һЩ ���õĹ��ܡ�

Spring Data����:http://projects.spring.io/spring-data/

Spring Data���õĹ���ģ������:

-

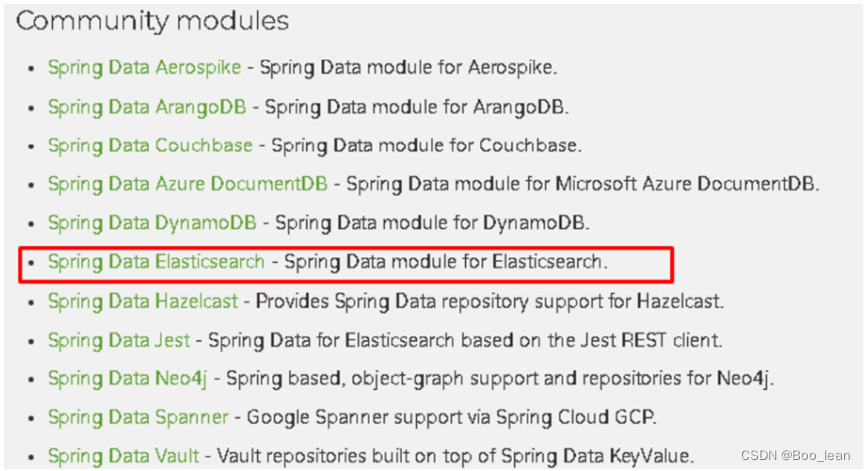

Spring Data ElasticSearch

Spring Data ElasticSearch ���� spring data API �� elasticSearch����,��ԭʼ����elasticSearch�Ŀͻ���API ���з�װ ��Spring DataΪElasticsearch��Ŀ�ṩ�����������档Spring Data Elasticsearch POJO�Ĺؼ���������Ϊ���ĵ�ģ����Elastichsearch�����ĵ������ɵر�дһ���洢�����ݷ��ʲ㡣

�ٷ���վ:http://projects.spring.io/spring-data-elasticsearch/

2. ������

- ����Spring Data ElasticSearch����

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.lbl</groupId>

<artifactId>SpringDataElasticSearch</artifactId>

<version>1.0-SNAPSHOT</version>

<parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>2.0.0.RELEASE</version>

<relativePath/> <!-- lookup parent from repository -->

</parent>

<properties>

<java.version>1.8</java.version>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-elasticsearch</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>

</project>

- ������

package com.lbl.demo;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

@SpringBootApplication

public class DemoApplication {

public static void main(String[] args) {

SpringApplication.run(DemoApplication.class,args);

}

}

- �����ļ�

spring:

data:

elasticsearch:

cluster-name: my-elasticsearch

cluster-nodes: 192.168.174.128:9300

- ��дʵ��Article

@Document(indexName = "data-demo", type = "article")

public class Article {

@Id

@Field(type = FieldType.Integer,store = true)

private Integer id;

@Field(type = FieldType.text,store = true, analyzer = "ik_smart")

private String title;

@Field(type = FieldType.text,store = true, analyzer = "ik_smart")

private String content;

������

}

- ��дDao

�������������ѯ�Ļ����findBy + ���� + �ؼ��� + ���ӷ�

| �ؼ��� | �������� | ���� | ʾ�� |

|---|---|---|---|

| and | findByField1AndField2 | ����Field1��Field2������� | findByTitleAndContent |

| or | findByField1OrField2 | ����Field1��Field2������� | findByTitleOrContent |

| is | findByField | ����Field������� | findByTitle |

| not | findByFieldNot | ����Field������� | findByTitleNot |

| between | findByFieldBetween | ���ָ����Χ������ | findByPriceBetween |

| lessThanEqual | findByFieldLessThan | ���С�ڵ���ָ��ֵ������ | findByPriceLessThan |

| like | findByFieldLike | ���ݸ���Field�������(�зִ�,û��Like��Ϊ�ִ�) | findByTitleLike |

��Dao�м������������������Ľӿڷ���,����ӳ���ļ�,�����ڷ����е��á�

package com.lbl.demo.dao;

import com.lbl.demo.pojo.Article;

import org.springframework.data.domain.Pageable;

import org.springframework.data.elasticsearch.repository.ElasticsearchRepository;

import java.util.List;

public interface ArticleDao extends ElasticsearchRepository<Article,Integer> {

List<Article> findByTitle(String title);

List<Article> findByTitleOrContent(String field, String str, Pageable pageable);

}

- ����������

package com.lbl.demo;

import com.lbl.demo.dao.ArticleDao;

import com.lbl.demo.pojo.Article;

import org.elasticsearch.index.query.QueryBuilders;

import org.junit.Test;

import org.junit.runner.RunWith;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.boot.test.context.SpringBootTest;

import org.springframework.data.domain.PageRequest;

import org.springframework.data.domain.Pageable;

import org.springframework.data.elasticsearch.core.ElasticsearchTemplate;

import org.springframework.data.elasticsearch.core.query.NativeSearchQuery;

import org.springframework.data.elasticsearch.core.query.NativeSearchQueryBuilder;

import org.springframework.test.context.junit4.SpringRunner;

import java.util.List;

import java.util.Optional;

@RunWith(SpringRunner.class)

@SpringBootTest

public class DemoApplicationTests {

@Autowired

private ArticleDao articleDao;

@Autowired

private ElasticsearchTemplate template;

/**

* ��������������ӳ��

*/

@Test

public void createIndex(){

// ��������,������ӳ���ϵ

template.createIndex(Article.class);

// ����ӳ���ϵ(����ʵ�������Ѿ�ʹ��ע���ӳ���ϵ��������,�����ڴ������ٴ�����)

// template.putMapping(Article.class);

}

/**

* �����ĵ�

*/

@Test

public void addDocument(){

for (int i = 10; i <= 20; i++) {

Article article = new Article();

article.setId(i);

article.setTitle("Ů��ʿ·���������ӹ������:������ְ����DZ���"+i);

article.setContent("����һ��������Ů��ʿ����"+i);

// ���ĵ�д��������

articleDao.save(article);

}

}

/**

* ��idɾ���ĵ�/ɾ��ȫ���ĵ�

*/

@Test

public void deleteDocumentByIdOrAll(){

// ��idɾ��

articleDao.deleteById(20);

// ȫ��ɾ��

// articleDao.deleteAll();

}

/**

* ��id�����ĵ�/����ȫ���ĵ�

*/

@Test

public void findByIdOrAll(){

// ��id����

Optional<Article> optional = articleDao.findById(10);

Article article = optional.get();

System.out.println(article);

// ����ȫ��

Iterable<Article> articles = articleDao.findAll();

articles.forEach(a -> System.out.println(a));

}

/**

* ���Զ�����(�ֶ�)����ƥ�����

*/

@Test

public void findByOneField(){

List<Article> list = articleDao.findByTitle("Ů��ʿ");

list.forEach(a -> System.out.println(a));

}

/**

* ������һ���Զ�����(�ֶ�)����ƥ�����(��ҳ)

*/

@Test

public void findByTitleOrContent() {

Pageable pageable = PageRequest.of(1, 5);

articleDao.findByTitleOrContent("title","Ů��ʿ",pageable)

.forEach(a -> System.out.println(a));

}

/**

* ���ز�ѯ(�����ڱȽϸ��ӵ����)

*/

@Test

public void nativeSearchQuery(){

// ������ѯ����

NativeSearchQuery query = new NativeSearchQueryBuilder()

.withQuery(QueryBuilders.queryStringQuery("Ů��ʿ").defaultField("title"))

.withPageable(PageRequest.of(0, 15))

.build();

// ִ�в�ѯ

List<Article> articleList = template.queryForList(query, Article.class);

articleList.forEach(a -> System.out.println(a));

}

}

3. �ۺϲ�ѯ

�ۺϲ�ѯ�ο�https://www.cnblogs.com/wshcn/p/8150511.html

- ʵ����

Ҫ�ۺϵ��ֶ���Ҫ�����洢��fielddata��,����fielddata=true

@Document(indexName = "car",type = "carInfo")

public class Car {

@Id

@Field(type = FieldType.Long,store = true)

private Long id;

@Field(type = FieldType.text,store = true, analyzer = "ik_smart")

private String name;

@Field(type = FieldType.text,store = true, analyzer = "ik_smart",fielddata = true)

private String color;

@Field(type = FieldType.text,store = true, analyzer = "ik_smart",fielddata = true)

private String brand;

@Field(type = FieldType.Double,store = true)

private Double price;

������

}

- Dao

package com.lxs.esdemo2.dao;

import com.lxs.esdemo2.domain.Article;

import com.lxs.esdemo2.domain.Car;

import org.springframework.data.elasticsearch.repository.ElasticsearchRepository;

public interface CarDao extends ElasticsearchRepository<Car, Long> {

}

- ��ʼ��������

@RunWith(SpringRunner.class)

@SpringBootTest

public class Demo2ApplicationTests {

@Autowired

private CarDao carDao;

@Autowired

private ElasticsearchTemplate template;

/**

* ��ʼ��������

*/

@Test

public void initIndex() {

template.createIndex(Car.class);

carDao.save(new Car(1l, "���ǵ�A1", "��ɫ","���ǵ�", 50000d));

carDao.save(new Car(2l, "���ǵ�A2", "��ɫ", "���ǵ�", 70000d));

carDao.save(new Car(3l, "���ǵ�A3", "��ɫ", "���ǵ�", 80000d));

carDao.save(new Car(4l, "���ǵ�A4", "��ɫ","���ǵ�", 60000d));

carDao.save(new Car(5l, "���ǵ�A5", "��ɫ","���ǵ�", 90000d));

carDao.save(new Car(6l, "����A1", "��ɫ", "����", 10000d));

carDao.save(new Car(7l, "����A2", "��ɫ", "����", 20000d));

carDao.save(new Car(8l, "����A3", "��ɫ", "����", 30000d));

carDao.save(new Car(9l, "����A4", "��ɫ", "����", 40000d));

carDao.save(new Car(10l, "����A5", "��ɫ", "����", 50000d));

carDao.save(new Car(11l, "����A1", "��ɫ", "����", 10000d));

carDao.save(new Car(12l, "����A2", "��ɫ", "����", 20000d));

carDao.save(new Car(13l, "����A3", "��ɫ", "����", 30000d));

carDao.save(new Car(14l, "����A4", "��ɫ", "����", 40000d));

carDao.save(new Car(15l, "����A5", "��ɫ", "����", 50000d));

}

}

- ����Ͱ

����color������

��aggs��Ϊ�ۺϹؼ���

��group_by_price��Ϊ�Զ���ۺ�����

GET /car_index/car/_search

{

"query": {

"bool": {

"should": [

{

"match_all": {}

}

]

}

},

"aggs": {

"group_by_bland": {

"terms": {

"field": "color"

}

}

}

}

- Ͱ�ڶ���

Ͱ����ƽ��ֵ

��avg_price��Ϊ�Զ���ۺ�����

��avg��Ϊ��ƽ��ֵ�ļ��Ϲؼ���

GET /car_index/car/_search

{

"query": {

"bool": {

"should": [

{

"match_all": {}

}

]

}

},

"aggs": {

"group_by_bland": {

"terms": {

"field": "color"

},

"aggs": {

"avg_price": {

"avg": {

"field": "price"

}

}

}

}

}

}

4. Spring Data ElasticSearch����ʵ��

- ����Ͱ

/**

* ����Ͱ

*/

@Test

public void querySelfAggs(){

// ��ѯ�����Ĺ�����

NativeSearchQueryBuilder queryBuilder = new NativeSearchQueryBuilder()

.withQuery(QueryBuilders.matchAllQuery());

// �ų����е��ֶβ�ѯ

queryBuilder.withSourceFilter(new FetchSourceFilter(new String[]{},null));

// ���Ӿۺ�����

queryBuilder.addAggregation(AggregationBuilders.terms("group_by_color").field("color"));

// ִ�в�ѯ,���Ѳ�ѯ���ֱ��תΪ�ۺ�page

AggregatedPage<Car> aggPage = (AggregatedPage<Car>)carDao.search(queryBuilder.build());

// �����еľۺ��л�ȡ��Ӧ���Ƶľۺ�

StringTerms agg = (StringTerms)aggPage.getAggregation("group_by_color");

// �ӾۺϵĽ���л�ȡ���е�Ͱ��Ϣ

List<StringTerms.Bucket> buckets = agg.getBuckets();

for (StringTerms.Bucket bucket : buckets) {

String color = bucket.getKeyAsString();

long docCount = bucket.getDocCount();

System.out.println("color="+color+"����="+docCount);

}

}

- Ͱ�ڶ���

��Ƕ�ۺ�

/**

* Ͱ�ڶ���

*/

@Test

public void querySelfSubAggs(){

// ��ѯ�����Ĺ�����

NativeSearchQueryBuilder queryBuilder = new NativeSearchQueryBuilder()

.withQuery(QueryBuilders.matchAllQuery());

// �ų����е��ֶβ�ѯ

queryBuilder.withSourceFilter(new FetchSourceFilter(new String[]{},null));

// ���Ӿۺ�����

queryBuilder.addAggregation(

AggregationBuilders.terms("group_by_color").field("color")

.subAggregation(AggregationBuilders.avg("avg_price").field("price"))

);

// ִ�в�ѯ,���Ѳ�ѯ���ֱ��תΪ�ۺ�page

AggregatedPage<Car> aggPage = (AggregatedPage<Car>)carDao.search(queryBuilder.build());

// �����еľۺ��л�ȡ��Ӧ���Ƶľۺ�

StringTerms agg = (StringTerms)aggPage.getAggregation("group_by_color");

// �ӾۺϵĽ���л�ȡ���е�Ͱ��Ϣ

List<StringTerms.Bucket> buckets = agg.getBuckets();

for (StringTerms.Bucket bucket : buckets) {

String color = bucket.getKeyAsString();

long docCount = bucket.getDocCount();

// ��ȡ�ڲ��ۺ�

InternalAvg avgPrice = (InternalAvg)bucket.getAggregations().asMap().get("avg_price");

System.out.println("color="+color+"����="+docCount+"ƽ���۸�="+avgPrice.getValue());

}

}