1、问题一:内存空间不足

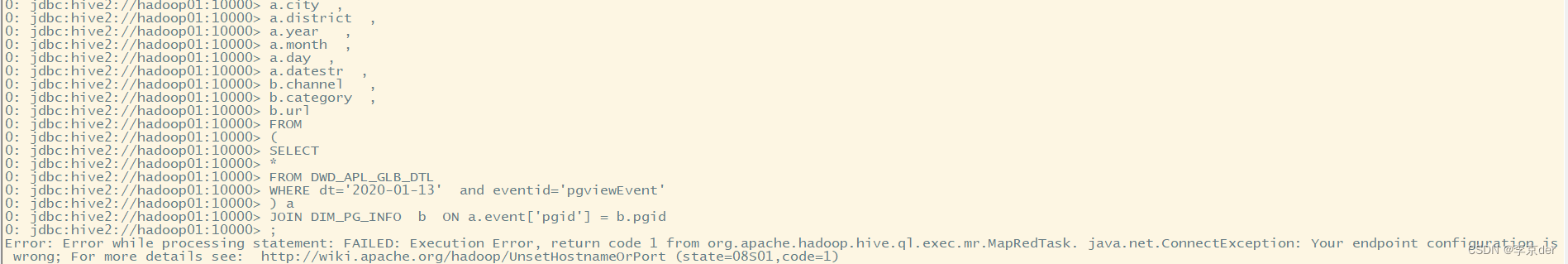

报错:Error: Error while processing statement: FAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.exec.mr.MapRedTask. java.net.ConnectException: Your endpoint configuration is wrong; For more details see: http://wiki.apache.org/hadoop/UnsetHostnameOrPort (state=08S01,code=1)

分析:本报错在进行hive计算过程中出现的,原因可能为内存不足的提示,但计算准确完成,可以计算出结果

解决方法:处理一下内存空间,也可以不进行处理。

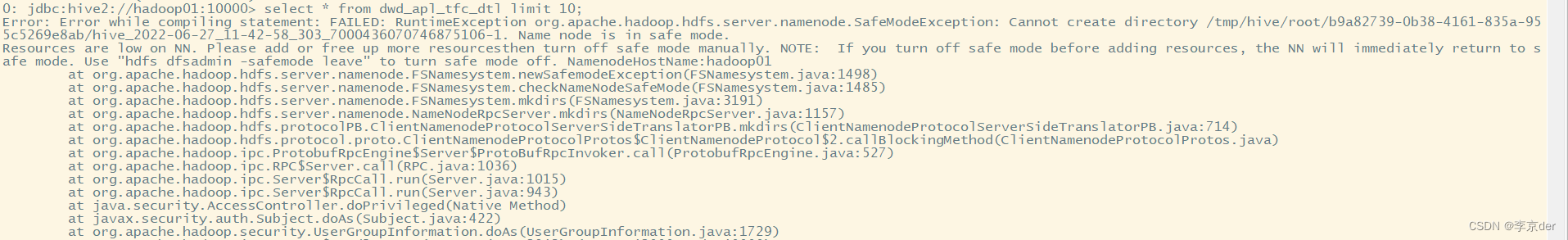

2、问题二:namenode安全模式

报错:Error: Error while compiling statement: FAILED: RuntimeException org.apache.hadoop.hdfs.server.namenode.SafeModeException: Cannot create directory /tmp/hive/root/b9a82739-0b38-4161-835a-955c5269e8ab/hive_2022-06-27_11-42-58_303_7000436070746875106-1. Name node is in safe mode.

Resources are low on NN. Please add or free up more resourcesthen turn off safe mode manually. NOTE: If you turn off safe mode before adding resources, the NN will immediately return to safe mode. Use “hdfs dfsadmin -safemode leave” to turn safe mode off. NamenodeHostName:hadoop01

at org.apache.hadoop.hdfs.server.namenode.FSNamesystem.newSafemodeException(FSNamesystem.java:1498)

at org.apache.hadoop.hdfs.server.namenode.FSNamesystem.checkNameNodeSafeMode(FSNamesystem.java:1485)

at org.apache.hadoop.hdfs.server.namenode.FSNamesystem.mkdirs(FSNamesystem.java:3191)

at org.apache.hadoop.hdfs.server.namenode.NameNodeRpcServer.mkdirs(NameNodeRpcServer.java:1157)

at org.apache.hadoop.hdfs.protocolPB.ClientNamenodeProtocolServerSideTranslatorPB.mkdirs(ClientNamenodeProtocolServerSideTranslatorPB.java:714)

at org.apache.hadoop.hdfs.protocol.proto.ClientNamenodeProtocolProtos$ClientNamenodeProtocol

2.

c

a

l

l

B

l

o

c

k

i

n

g

M

e

t

h

o

d

(

C

l

i

e

n

t

N

a

m

e

n

o

d

e

P

r

o

t

o

c

o

l

P

r

o

t

o

s

.

j

a

v

a

)

a

t

o

r

g

.

a

p

a

c

h

e

.

h

a

d

o

o

p

.

i

p

c

.

P

r

o

t

o

b

u

f

R

p

c

E

n

g

i

n

e

2.callBlockingMethod(ClientNamenodeProtocolProtos.java) at org.apache.hadoop.ipc.ProtobufRpcEngine

2.callBlockingMethod(ClientNamenodeProtocolProtos.java)atorg.apache.hadoop.ipc.ProtobufRpcEngineServer

P

r

o

t

o

B

u

f

R

p

c

I

n

v

o

k

e

r

.

c

a

l

l

(

P

r

o

t

o

b

u

f

R

p

c

E

n

g

i

n

e

.

j

a

v

a

:

527

)

a

t

o

r

g

.

a

p

a

c

h

e

.

h

a

d

o

o

p

.

i

p

c

.

R

P

C

ProtoBufRpcInvoker.call(ProtobufRpcEngine.java:527) at org.apache.hadoop.ipc.RPC

ProtoBufRpcInvoker.call(ProtobufRpcEngine.java:527)atorg.apache.hadoop.ipc.RPCServer.call(RPC.java:1036)

at org.apache.hadoop.ipc.Server

R

p

c

C

a

l

l

.

r

u

n

(

S

e

r

v

e

r

.

j

a

v

a

:

1015

)

a

t

o

r

g

.

a

p

a

c

h

e

.

h

a

d

o

o

p

.

i

p

c

.

S

e

r

v

e

r

RpcCall.run(Server.java:1015) at org.apache.hadoop.ipc.Server

RpcCall.run(Server.java:1015)atorg.apache.hadoop.ipc.ServerRpcCall.run(Server.java:943)

at java.security.AccessController.doPrivileged(Native Method)

at javax.security.auth.Subject.doAs(Subject.java:422)

at org.apache.hadoop.security.UserGroupInformation.doAs(UserGroupInformation.java:1729)

at org.apache.hadoop.ipc.Server$Handler.run(Server.java:2943) (state=42000,code=40000)

分析:需要退出安全模式

解决方法:

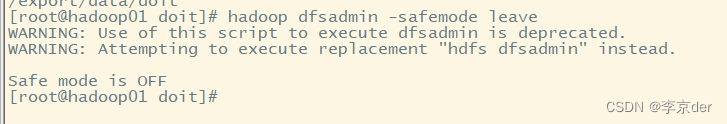

// 退出安全模式

hdfs dfsadmin -safemode leave

// 开启安全模式

hdfs dfsadmin -safemode get

退出安全模式之后重新运行即可。(建议停掉服务重新启动)

如果还是不能解决问题可尝试进行以下操作

方法参考

https://www.cnblogs.com/chang09/p/15904790.html

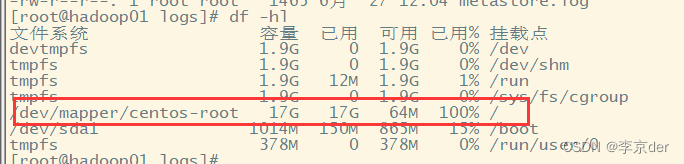

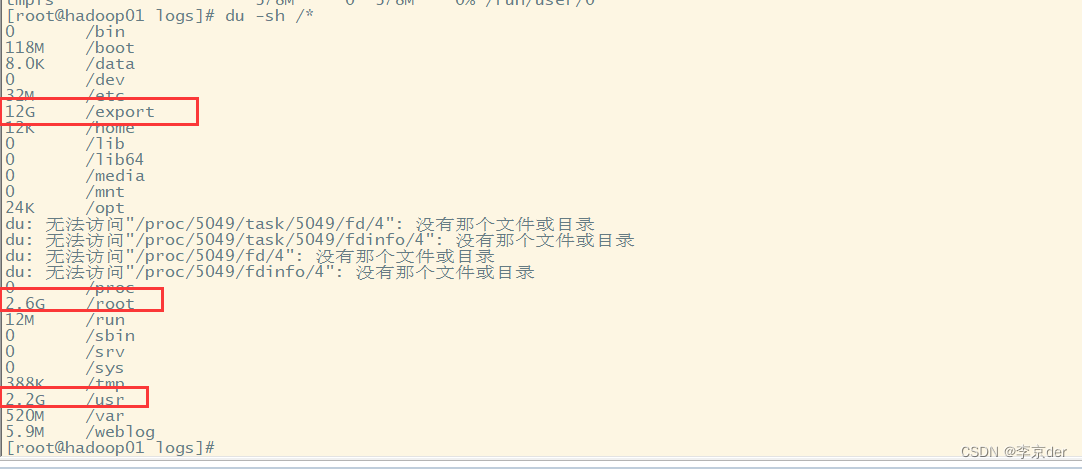

查看集群空间的使用情况

df -hl

可以看到资源使用情况已经100%了

查看是因为哪些大文件占用了空间

du -sh /*

将这些大文件处理一下,重新提交任务即可。

总结,以上两个报错可能是成对出现,主要原因在于磁盘空间已满,需要我们清理内存空间,如果不清理内存空间,他一直会强制让你进入安全模式,推出安全模式后他也会自动再进入安全模式。