Redis

NoSQL (not only sql)

���ִ��ļ���ϵͳ��ÿ�������϶�������Ӵ����������

��Щ�����кܴ�һ�������ɹ�ϵ���ݿ����ϵͳ(RDBMS)�������� 1970�� E.F.Codd��s����Ĺ�ϵģ�͵����� ��A relational model of data for large shared data banks��,��ʹ�����ݽ�ģ��Ӧ�ó����̸��Ӽ�

ͨ��Ӧ��ʵ��֤��,��ϵģ���Ƿdz��ʺ��ڿͻ����������,ԶԶ����Ԥ�ڵ�����,�������ǽṹ�����ݴ洢�����������Ӧ�õ�����������

NoSQL ��һ��ȫ�µ����ݿ�������˶�,���ھ��������,��չ��2009������Խ�����ǡ�NoSQL��ӵ�������ᳫ���÷ǹ�ϵ�͵����ݴ洢,���������ǵصĹ�ϵ�����ݿ�����,��һ����������һ��ȫ�µ�˼ά��ע�롣

ʲô��NoSQL?

NoSQL,ָ���Ƿǹ�ϵ�͵����ݿ⡣NoSQL��ʱҲ����Not Only SQL����д,�ǶԲ�ͬ�ڴ�ͳ�Ĺ�ϵ�����ݿ�����ݿ����ϵͳ��ͳ�ơ�

NoSQL���ڳ����ģ���ݵĴ洢��(����ȸ��Facebookÿ��Ϊ���ǵ��û��ռ����ڱ��ص�����)����Щ���͵����ݴ洢����Ҫ�̶���ģʽ,�����������Ϳ��Ժ�����չ��

����NoSQL��û��һ����ȷ�ķ�Χ�Ͷ���,�������Ƕ��ձ��������һЩ��ͬ����:

����չ

NoSQL���ݿ������,����һ����ͬ���ص㶼��ȥ����ϵ���ݿ�Ĺ�ϵ�����ԡ�����֮����ϵ,�����ͷdz�������չ������֮��,�ڼܹ��IJ����ϴ����˿���չ��������

��������,������

NoSQL���ݿⶼ���зdz��ߵĶ�д����,�����ڴ���������,ͬ���������㡣�������������ϵ��,���ݿ�Ľṹ��һ��MySQLʹ��Query Cache��NoSQL��Cache�Ǽ�¼����,��һ��ϸ���ȵ�Cache,����NoSQL�������������˵���ܾ�Ҫ�ߺܶࡣ

��������ģ��

NoSQL��������ΪҪ�洢�����ݽ����ֶ�,��ʱ���Դ洢�Զ�������ݸ�ʽ�����ڹ�ϵ���ݿ���,��ɾ�ֶ���һ���dz��鷳�����顣����Ƿdz����������ı�,�����ֶμ�ֱ���ǡ�����ج�Ρ�����ڴ���������Web 2.0ʱ���������ԡ�

�߿���

NoSQL�ڲ�̫Ӱ�����ܵ����,�Ϳ��Է����ʵ�ָ߿��õļܹ�������Cassandra��HBaseģ��,ͨ������ģ��Ҳ��ʵ�ָ߿��á�

NoSQL���ŵ�/ȱ��

�ŵ�:

- - �߿���չ��

- - �ֲ�ʽ����

- - �ͳɱ�

- - �ܹ��������,��ṹ������

- - û�и��ӵĹ�ϵ

ȱ��:

- - û�б���

- - ���IJ�ѯ����(��ĿǰΪֹ)

- - ����һ���Dz�ֱ�۵ij���

NoSQL ���ݿ����

��ֵ(Key-Value)�洢���ݿ�

��һ�����ݿ���Ҫ��ʹ�õ�һ����ϣ��,���������һ���ض��ļ���һ��ָ��ָ���ض������ݡ�Key/valueģ�Ͷ���ITϵͳ��˵���������ڼ��ײ��𡣵���������ݿ����Ա(DBA)ֻ�Բ���ֵ���в�ѯ����µ�ʱ��,Key/value���Ե�Ч�ʵ����ˡ�������:Tokyo Cabinet/Tyrant, Redis, Voldemort, Oracle BDB��

�д洢���ݿ�

�ⲿ�����ݿ�ͨ��������Ӧ�Էֲ�ʽ�洢�ĺ������ݡ�����Ȼ����,�������ǵ��ص���ָ���˶���С���Щ�������м��������ŵġ���:Cassandra, HBase, Riak.

�ĵ������ݿ�

�ĵ������ݿ�������������Lotus Notes�칫������,������ͬ��һ�ּ�ֵ�洢�����ơ������͵�����ģ���ǰ汾�����ĵ�,��ṹ�����ĵ����ض��ĸ�ʽ�洢,����JSON���ĵ������ݿ���Կ����Ǽ�ֵ���ݿ��������,����֮��Ƕ��ֵ,�ڴ�����ҳ�ȸ�������ʱ,�ĵ������ݿ�ȴ�ͳ��ֵ���ݿ�IJ�ѯЧ�ʸ��ߡ���:CouchDB, MongoDb. ����Ҳ���ĵ������ݿ�SequoiaDB,�Ѿ���Դ��

ͼ��(Graph)���ݿ�

ͼ�νṹ�����ݿ�ͬ���������Լ����Խṹ��SQL���ݿⲻͬ,����ʹ������ͼ��ģ��,�����ܹ���չ������������ϡ�NoSQL���ݿ�û�б��IJ�ѯ����(SQL),��˽������ݿ��ѯ��Ҫ�ƶ�����ģ�͡�����NoSQL���ݿⶼ��RESTʽ�����ݽӿڻ��߲�ѯAPI����:Neo4J, InfoGrid, Infinite Graph��

| ���� | ���ִ��� | �ص� |

|---|---|---|

| �д洢 | HbaseCassandraHypertable | ����˼��,�ǰ��д洢���ݵġ������ص��Ƿ���洢�ṹ���Ͱ�ṹ������,����������ѹ��,�����ijһ�л���ij���еIJ�ѯ�зdz����IO���ơ� |

| �ĵ��洢 | MongoDBCouchDB | �ĵ��洢һ��������json�ĸ�ʽ�洢,�洢���������ĵ��͵ġ�����Ҳ���л����ijЩ�ֶν�������,ʵ�ֹ�ϵ���ݿ��ijЩ���ܡ� |

| key-value�洢 | Tokyo Cabinet / TyrantBerkeley DBMemcacheDBRedis | ����ͨ��key���ٲ�ѯ����value��һ����˵,�洢����value�ĸ�ʽ,�յ�ȫ�ա�(Redis��������������) |

| ͼ�洢 | Neo4JFlockDB | ͼ�ι�ϵ����Ѵ洢��ʹ�ô�ͳ��ϵ���ݿ�������Ļ����ܵ���,�������ʹ�ò����㡣 |

| ����洢 | db4oVersant | ͨ����������������Ե���������ݿ�,ͨ������ķ�ʽ��ȡ���ݡ� |

| xml���ݿ� | Berkeley DB XMLBaseX | ��Ч�Ĵ洢XML����,��֧��XML���ڲ���ѯ�,����XQuery,Xpath�� |

Redis����

REmote DIctionary Server(Redis) ��Զ���ֵ����,��һ���� Salvatore Sanfilippo д�� key-value �洢ϵͳ,�ǿ�ƽ̨�ķǹ�ϵ�����ݿ�,Ҳ�����dz�Ϊ�ṹ�����ݿ⡣

Redis ��һ����Դ��ʹ�� ANSI C ���Ա�д������ BSD Э�顢֧�����硢�ɻ����ڴ桢�ֲ�ʽ����ѡ�־��Եļ�ֵ��(Key-Value)�洢���ݿ�,���ṩ�������Ե� API��

Redis ͨ������Ϊ���ݽṹ������,��Ϊֵ(value)�������ַ���(String)����ϣ(Hash)���б�(list)������(sets)������(sorted sets)�����͡�

Redis ��һ����Դ(BSD����)��,�ڴ��е����ݽṹ�洢ϵͳ,�������������ݿ⡢�������Ϣ�м���� ��֧�ֶ������͵����ݽṹ,�� �ַ���(strings), ɢ��(hashes), �б�(lists), ����(sets), ����(sorted sets) �뷶Χ��ѯ, bitmaps, hyperloglogs �� �����ռ�(geospatial) �����뾶��ѯ�� Redis ������ ����(replication),LUA�ű�(Lua scripting), LRU�����¼�(LRU eviction),����(transactions) �Ͳ�ͬ����� ���̳־û�(persistence), ��ͨ�� Redis�ڱ�(Sentinel)���Զ� ����(Cluster)�ṩ�߿�����(high availability)��

�ص�

- ���ܼ��� �C Redis�ܶ����ٶ���110000��/s,д���ٶ���81000��/s ��

- �ḻ���������� �C Redis֧�ֶ����ư����� Strings, Lists, Hashes, Sets �� Ordered Sets �������Ͳ�����

- ԭ�� �C Redis�����в�������ԭ���Ե�,��˼����Ҫô�ɹ�ִ��Ҫôʧ����ȫ��ִ�С�����������ԭ���Եġ��������Ҳ֧������,��ԭ����,ͨ��MULTI��EXECָ���������

- �ḻ������ �C Redis��֧�� publish/subscribe, ֪ͨ, key ���ڵȵ����ԡ�

Redis�ܸ���

1���ڴ�洢���־û�,�ڴ���ʱ�ϵ缴ʧ,����˵�־û�����Ҫ(rdb��aof)

2��Ч�ʸ�,�������ڸ��ٻ���

3����������ϵͳ

4����ͼ��Ϣ����

5����ʱ����������(�����)

6��������

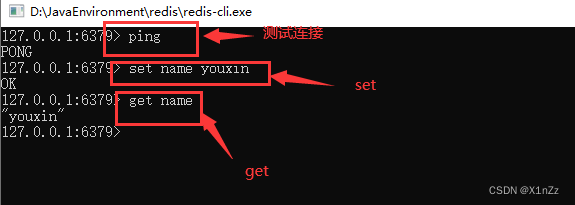

Windows��װredis

1��github����ѹ����https://github.com/microsoftarchive/redis/releases/tag/win-3.2.100

2��ֱ�ӽ�ѹ

3�������

4���ͻ��˲���

���� redis-server.exe redis.windows.conf ���˫����������

Linux��װredis:

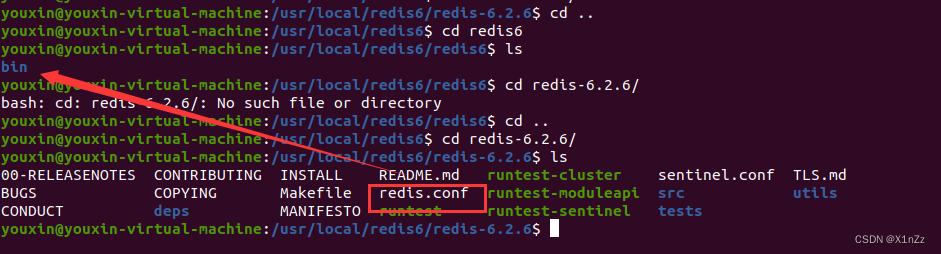

����redisѹ����:

wget https://download.redis.io/releases/redis-6.2.6.tar.gz

��ѹ����Ӧ��װĿ¼:

mkdir /usr/local/redis6

sudo tar -zxvf ~/redis-6.2.6.tar.gz -C /usr/local/redis6

����

cd��/usr/local/redis6Ŀ¼,��������makeִ�б�������,����������̨��������ֱ����������������ݡ�

make -version �鿴make�Ƿ�װ

���û�а�װmake����ʹ��

sudo apt install -y make

���밲װĿ¼:��װ��Ҫ������:

sudo apt install -y gcc

sudo apt install -y tcl

**ע��:**�����������ʧ�ܲ���ʾ����,ʹ��:

sudo apt-get update

ִ������:

youxin@youxin-virtual-machine:/usr/local/redis6/redis-6.2.6$ sudo make MALLOC=libc

ִ������:

make test

�������ȫ��ͨ��,��֤����һ����make����ȷ����

ִ�а�װ����:

sudo make PREFIX=/usr/local/redis6/redis6/ install

��redis�ĸ�Ŀ¼����һ�������ļ�redis.conf,������������װ��redisĿ¼,Ҳ��������ָ����PREFIX�ļ���:

sudo cp redis.conf ��/redis6/

���û�������:

sudo vim /etc/profile

���ļ�������:

export REDIS_HOME=/usr/local/redis6/redis6/

export PATH= P A T H : PATH: PATH:REDIS_HOME/bin

Ȼ��ִ��:source /etc/profileʹ֮��Ч

����redis����:

redis-server /usr/local/redis6/redis6/redis.conf #���û��ָ�������ļ�,�����Ĭ�ϵ������ļ�

����redis�ͻ���

redis-cli -p 6379 --raw

�ر�redis����:

shutdown

�鿴redis�˿�:

ps -ef |grep redis

ǿ�йرն˿�:

kill -9 PID

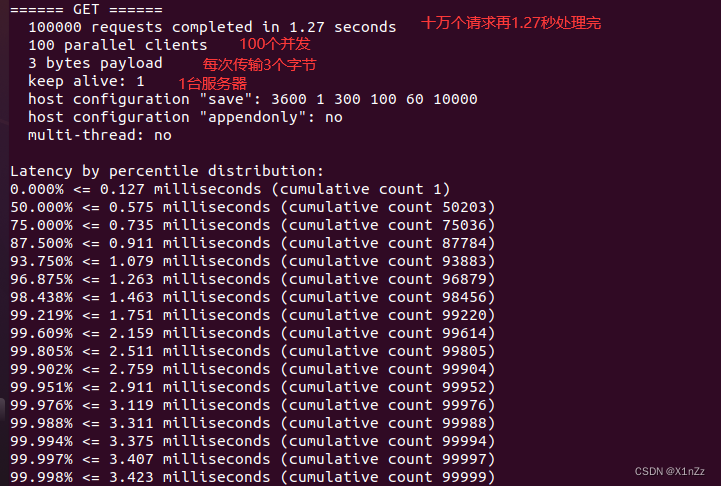

���ܲ���

redis-benchmark��һ���ٷ��Դ���ѹ�����Թ���

redis-benchmark�����������:

redis ���ܲ��Թ��߿�ѡ����������ʾ:

| ��� | ѡ�� | ���� | Ĭ��ֵ |

|---|---|---|---|

| 1 | -h | ָ�������������� | 127.0.0.1 |

| 2 | -p | ָ���������˿� | 6379 |

| 3 | -s | ָ�������� socket | |

| 4 | -c | ָ������������ | 50 |

| 5 | -n | ָ�������� | 10000 |

| 6 | -d | ���ֽڵ���ʽָ�� SET/GET ֵ�����ݴ�С | 2 |

| 7 | -k | 1=keep alive 0=reconnect | 1 |

| 8 | -r | SET/GET/INCR ʹ����� key, SADD ʹ�����ֵ | |

| 9 | -P | ͨ���ܵ����� ���� | 1 |

| 10 | -q | ǿ���˳� redis������ʾ query/sec ֵ | |

| 11 | �Ccsv | �� CSV ��ʽ��� | |

| 12 | *-l*(L ��Сд��ĸ) | ����ѭ��,����ִ�в��� | |

| 13 | -t | �������Զ��ŷָ��IJ��������б��� | |

| 14 | *-I*(i �Ĵ�д��ĸ) | Idle ģʽ������ N �� idle ���Ӳ��ȴ��� |

����:

redis-benchmark -h localhost -p 6379 -c 100 -n 100000 ���ز���,�˿�6379,100����������,100000�������ܹ�

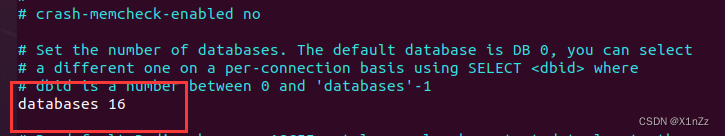

����֪ʶ

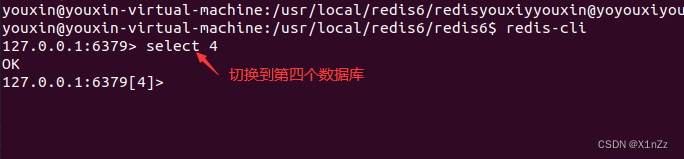

redisĬ����16�����ݿ�

Ĭ��ʹ�õ��ǵ�0��

����ʹ��select�����л����ݿ�

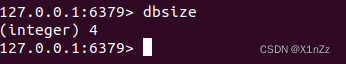

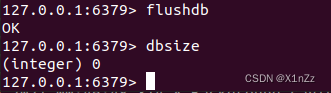

dbsize �鿴���ݿ��С

keys * �鿴���ݿ������е�key

flushall ���ȫ�����ݿ�

flushdb �����ǰ���ݿ�

ע��:redis�ǵ��̵߳�:redis�ǻ����ڴ����,CPU������Redis������ƿ��,redis��ƿ���Ǹ����ڴ���������,��Ȼ����ʹ�õ��߳���ʵ��,��ʹ�õ��߳���

redis��c����д��,�ٷ�������Ϊ10W+��QPS,�������Memcache��!

Ϊʲôredis���̻߳���ô��:�����ܷ�������һ���Ƕ��̵߳�,���̵߳�Ч�ʲ�һ�������߳�Ч�ʸ�,redis�ǽ���������ȫ�������ڴ��е�,����˵ʹ�õ��̲߳���Ч�ʾ�����ߵ�,���߳�(CPU���������л�:�dz���ʱ),�����ڴ�ϵͳ��˵,���û���������л�����Ч����ߵ�~��ζ�д������һ��CPU�ϵ�,���ڴ������,���������ѷ�����

�����������

Redis ��һ����Դ(BSD����)��,�ڴ��е����ݽṹ�洢ϵͳ,�������������ݿ⡢�������Ϣ�м���� ��֧�ֶ������͵����ݽṹ,�� �ַ���(strings), ɢ��(hashes), �б�(lists), ����(sets), ����(sorted sets) �뷶Χ��ѯ, bitmaps, hyperloglogs �� �����ռ�(geospatial)�����뾶��ѯ�� Redis ������ ����(replication),LUA�ű�(Lua scripting), LRU�����¼�(LRU eviction),����(transactions)�Ͳ�ͬ����� ���̳־û�(persistence), ��ͨ�� Redis�ڱ�(Sentinel)���Զ� ����(Cluster)�ṩ�߿�����(high availability)��

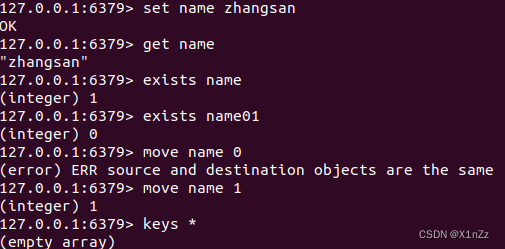

Redis-Key

exists key �ж��Ƿ���ڸ�key

move key 1�Ƴ�key,1�����Ƴ������ݿ�

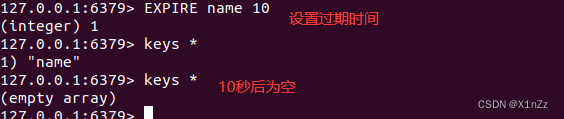

EXPIRE name 10 ���ù���ʱ��Ϊ10��

ttl name �鿴ʣ��ʱ��

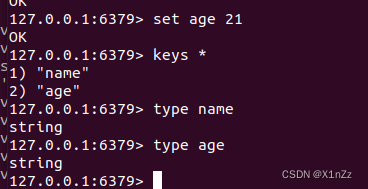

type key �鿴key������

String(�ַ�������)

#############################################################

127.0.0.1:6379> set key1 "hello" # ����ֵ

OK

127.0.0.1:6379> get key1 #��ȡֵ

"hello"

127.0.0.1:6379> append key1 " world" # ��ֵ,�����key���������½�һ���ַ����൱��set key

(integer) 11

127.0.0.1:6379> get key1

"hello world"

127.0.0.1:6379> strlen key1 # ��ȡֵ�ij���

(integer) 11

##############################################################

127.0.0.1:6379> set views 0 #����views��ʼֵΪ0

OK

127.0.0.1:6379> get views

"0"

127.0.0.1:6379> INCR views # ��������1

(integer) 1

127.0.0.1:6379> get views

"1"

127.0.0.1:6379> incr views

(integer) 2

127.0.0.1:6379> get views

"2"

127.0.0.1:6379> decr views # �Լ�1

(integer) 1

127.0.0.1:6379> DECR views

(integer) 0

127.0.0.1:6379> get views

"0"

# ���� i+=

127.0.0.1:6379> incrby views 10 #���ò���Ϊ10������

(integer) 10

127.0.0.1:6379> get views

"10"

##############################################################

# �ַ�����Χrange

127.0.0.1:6379> getrange key1 1 4 #��ȡ�ַ���1-4

"ello"

127.0.0.1:6379> getrange key1 0 -1 # ��ȡȫ�����ַ���

"hello world"

# �滻setrange

127.0.0.1:6379> setrange key1 0 nihao #��0λ�ÿ�ʼ�滻

(integer) 11

127.0.0.1:6379> get key1

"nihao world��

##############################################################

#setex(set with expire) # ���ù���ʱ��

#setnx(set if not exist) # ������������(�ڷֲ�ʽ���л᳣��ʹ��)

127.0.0.1:6379> setex key2 30 youxin #����key2����30������

OK

127.0.0.1:6379> ttl key2

(integer) 26

127.0.0.1:6379> ttl key2 #�鿴ʣ��ʱ��

(integer) 21

127.0.0.1:6379> setnx key3 cloud # ���key3�����ھʹ���,������ھʹ���ʧ��

(integer) 1

127.0.0.1:6379> get key3

"cloud"

127.0.0.1:6379> setnx key3 rain

(integer) 0 # �ٴδ���ʧ��

127.0.0.1:6379> keys *

1) "key3"

2) "views"

3) "key1"

127.0.0.1:6379> get key3 # ֵû�иı�

"cloud"

##############################################################

# mset ͬʱ���ö��ֵ

# mget ͬʱ��ȡ���ֵ

127.0.0.1:6379> mset k1 v1 k2 v2 k3 v3 # ͬʱ���ö��ֵ

OK

127.0.0.1:6379> keys *

1) "k2"

2) "k3"

3) "k1"

127.0.0.1:6379> mget k1 k2 k3 # ͬʱ��ȡ���ֵ

1) "v1"

2) "v2"

3) "v3"

127.0.0.1:6379> msetnx k3 v3 k5 v5 #����������ھ����ö��ֵ, msetnx��һ��ԭ���ԵIJ���,Ҫôһ��ɹ�,Ҫôһ��ʧ��

(integer) 0

127.0.0.1:6379> keys *

1) "k2"

2) "k3"

3) "k1"

##############################################################

# ����

set user:1 {name:zhangsan,age=20} # ����һ��user:1����,ֵΪjson�ַ�������һ������

# �����key��һ����������:user:{id}:{filed}

127.0.0.1:6379> mset user:1:name zhangsan user:1:age 22

OK

127.0.0.1:6379> mget user:1:name user:1:age

1) "zhangsan"

2) "22"

##############################################################

getset #��get��set

127.0.0.1:6379> getset db mysql #���������,��nil

(nil)

127.0.0.1:6379> get db

"mysql"

127.0.0.1:6379> getset db oracle #����Ѿ�����,����ԭ����ֵ�������µ�ֵ

"mysql"

127.0.0.1:6379> get db

"oracle"

##############################################################

String���Ƶ�ʹ�ó���:value�������ַ���������������

- ������

- ͳ�ƶλ����

- ��˿��

- ����洢!

List

��redis����list���ջ,����,��������

���е�List�������l��ͷ��

##############################################################

127.0.0.1:6379> lpush list1 one # ����ֵ,����ͷ������

(integer) 1

127.0.0.1:6379> lpush list1 two

(integer) 2

127.0.0.1:6379> lpush list1 three

(integer) 3

127.0.0.1:6379> lrange list1 0 -1 # ��������

1) "three"

2) "two"

3) "one"

127.0.0.1:6379> lrange list1 0 1 # ͨ�����������õ�ֵ

1) "three"

2) "two"

127.0.0.1:6379> rpush list1 four #�Ӷ��е�β������

(integer) 4

127.0.0.1:6379> lrange list1 0 -1

1) "three"

2) "two"

3) "one"

4) "four"

##############################################################

#LPOP

#RPOP

127.0.0.1:6379> lpop list1 1 #����List1�ĵ�һ��Ԫ��

1) "three"

127.0.0.1:6379> rpop list1 #����list1�����һ��Ԫ��

"four"

127.0.0.1:6379> lrange list1 0 -1

1) "two"

2) "one"

##############################################################

# Lindex

127.0.0.1:6379> lindex list1 0 #��ȡ�±�Ϊ0��ֵ

"two"

127.0.0.1:6379> lindex list1 1

"one"

127.0.0.1:6379> lpop list1

"two"

127.0.0.1:6379> lpop list1

"one"

127.0.0.1:6379> lindex list1 0 #������Ϊ��ʱ����nil

(nil)

##############################################################

#Llen��ȡ���г���

127.0.0.1:6379> lpush list2 one

(integer) 1

127.0.0.1:6379> lpush list2 two

(integer) 2

127.0.0.1:6379> lpush list2 three

(integer) 3

127.0.0.1:6379> llen list2 #���������

(integer) 3

##############################################################

#Lrem �Ƴ�ָ����ֵ,��ȷƥ��

127.0.0.1:6379> lpush list2 three

(integer) 4

127.0.0.1:6379> lrem list2 1 one #�Ƴ�1��one

(integer) 1

127.0.0.1:6379> lrem list2 2 three #�Ƴ�����three

(integer) 2

127.0.0.1:6379> lrange list2 0 -1

1) "two"

##############################################################

# trim ��:list �ض�

127.0.0.1:6379> lpush list3 value1

(integer) 1

127.0.0.1:6379> lpush list3 value2

(integer) 2

127.0.0.1:6379> lpush list3 value3

(integer) 3

127.0.0.1:6379> lpush list3 value4

(integer) 4

127.0.0.1:6379> ltrim list3 1 2 # ��ȡ�±�Ϊ1��2��ֵ

OK

127.0.0.1:6379> LRANGE list3 0 -1 #���list3

1) "value3"

2) "value2"

##############################################################

#rpoplpush �Ƴ��б����һ��Ԫ�ز����ӵ���һ��Ԫ��

127.0.0.1:6379> RPOPLPUSH list3 list4

"value2"

127.0.0.1:6379> lrange list3 0 -1 #�鿴ԭ�����б�

1) "value3"

127.0.0.1:6379> lrange list4 0 -1 #�鿴�µ��б�ȷʵ���ڵ�������ֵ

1) "value2"

##############################################################

#lset ָ���±��滻ֵ,����±겻������ᱨ��

127.0.0.1:6379> exists list3 #�ж��Ƿ����list3

(integer) 1

127.0.0.1:6379> lset list3 0 value4 #�滻list3���±�Ϊ0��ֵΪvalue4

OK

127.0.0.1:6379> lrange list3 0 -1

1) "value4"

##############################################################

# Linsert key after|before pivot value��ָ��λ��֮ǰ��֮�����

127.0.0.1:6379> lrange list3 0 -1

1) "value4"

127.0.0.1:6379> LINSERT list3 before value4 value5 #��value4ǰ�����

(integer) 2

127.0.0.1:6379> lrange list3 0 -1

1) "value5"

2) "value4"

127.0.0.1:6379> LINSERT list3 after value4 value6 #��value4�������

(integer) 3

127.0.0.1:6379> lrange list3 0 -1

1) "value5"

2) "value4"

3) "value6"

##############################################################

��:

- ��ʵ������һ������,before node after,left ,right�����Բ���ֵ

- ���key������,���µ�����

- ���key����,��������

- ����Ƴ�������ֵ,������,Ҳ����������

- �����߲�����߸Ķ�ֵ,Ч�����!�м�Ԫ�ظĶ�,�����˵Ч�ʻ��һ��

��Ϣ����:(LPUSH RPOP)ջ:(LPUSH LPOP)

Set(����)

set�е�ֵ�Dz����ظ���,���������

##############################################################

# sadd����Ԫ��

# smember��ȡ����Ԫ��

# sismember�ж��Ƿ����Ԫ��

127.0.0.1:6379> sadd set1 hello #set����������Ԫ��

(integer) 1

127.0.0.1:6379> sadd set1 " world"

(integer) 1

127.0.0.1:6379> SMEMBERS set1

1) "hello"

2) " world"

127.0.0.1:6379> SISMEMBER set1 "hello" #�ж�Ԫ���Ƿ���set��,���ڷ���1,�����ڷ���0

(integer) 1

127.0.0.1:6379> sismember set1 "he"

(integer) 0

##############################################################

#scard��ȡset������Ԫ�ظ���

127.0.0.1:6379> scard set1

(integer) 2

127.0.0.1:6379> sadd set1 nihao

(integer) 1

127.0.0.1:6379> scard set1

(integer) 3

##############################################################

#srem�Ƴ�ָ��Ԫ��

127.0.0.1:6379> srem set1 nihao

(integer) 1

127.0.0.1:6379> scard set1

(integer) 2

127.0.0.1:6379> SMEMBERS set1

1) "hello"

2) " world"

127.0.0.1:6379> sadd set1 nihao

(integer) 1

127.0.0.1:6379> sadd set1 shijie

(integer) 1

127.0.0.1:6379> srem set1 nihao shijie #����һ���Ƴ����Ԫ��

(integer) 2

127.0.0.1:6379> SMEMBERS set1

1) "hello"

2) " world"

##############################################################

#srandmember �����ȡָ����Ԫ��

127.0.0.1:6379> SRANDMEMBER set1

"hello"

127.0.0.1:6379> SRANDMEMBER set1

" world"

127.0.0.1:6379> SRANDMEMBER set1

" world"

127.0.0.1:6379> SRANDMEMBER set1 2

1) "hello"

2) " world"

##############################################################

#spop���ɾ��Key

127.0.0.1:6379> sadd set1 youxin

(integer) 1

127.0.0.1:6379> spop set1

"youxin"

127.0.0.1:6379> SMEMBERS set1

1) "hello"

2) " world"

##############################################################

#smove��һ��ָ����ֵ�ƶ�������һ��������

127.0.0.1:6379> smove set1 set2 hello

(integer) 1

127.0.0.1:6379> SMEMBERS set1

1) " world"

127.0.0.1:6379> SMEMBERS set2

1) "youxin"

2) "hello"

##############################################################

#sdiff �

#sinter ����

#sunion ����

127.0.0.1:6379> sadd set3 a

(integer) 1

127.0.0.1:6379> sadd set3 b

(integer) 1

127.0.0.1:6379> sadd set3 c

(integer) 1

127.0.0.1:6379> sadd set4 c

(integer) 1

127.0.0.1:6379> sadd set4 d

(integer) 1

127.0.0.1:6379> sadd set4 f\

(integer) 1

127.0.0.1:6379> sdiff set3 set4

1) "b"

2) "a"

127.0.0.1:6379> SINTER set3 set4

1) "c"

127.0.0.1:6379> sunion set3 set4

1) "b"

2) "a"

3) "c"

4) "d"

5) "f\\"

Ӧ�ó���:��ͬ��ע��

##############################################################

Hash(Map����)

Map����,key-map! ��ʱ���ֵ��һ��map����!���ʺ�string����û��̫�������,����һ����key-value

set hash field value

##############################################################

127.0.0.1:6379> hset hash1 field1 youxin

(integer) 1

127.0.0.1:6379> hget hash1 field1

"youxin"

##############################################################

#hmset���ö��ֵ

#hmget��ȡ���ֵ

#hgetall��ȡ���е�ֵ

127.0.0.1:6379> hmset hash1 field1 hello field2 world #����Ѿ�������ԭ����ֵ

OK

127.0.0.1:6379> hmget hash1 field1 field2

1) "hello"

2) "world"

127.0.0.1:6379> HGETALL hash1

1) "field1"

2) "hello"

3) "field2"

4) "world"

##############################################################

#hdelɾ��ijһ��ֵ,��Ӧ��valueֵҲɾ����

127.0.0.1:6379> hdel hash1 field1

(integer) 1

127.0.0.1:6379> HGETALL hash1

1) "field2"

2) "world"

##############################################################

# hlen ��ȡ��ǰhash�ij���

127.0.0.1:6379> hlen hash1

(integer) 1

127.0.0.1:6379> hset hash1 field3 value3

(integer) 1

127.0.0.1:6379> hlen hash1

(integer) 2

##############################################################

#hexists�ж϶�Ӧ��field��value�Ƿ����

127.0.0.1:6379> HEXISTS hash1 field1

(integer) 0 #0����������

127.0.0.1:6379> HEXISTS hash1 field3

(integer) 1 #1��������

##############################################################

#hkeys ֻ������е�field

#hvals ֻ������е�value

127.0.0.1:6379> hkeys hash1

1) "field2"

2) "field3"

127.0.0.1:6379> hvals hash1

1) "world"

2) "value3"

##############################################################

# huncrby ������Ӧ�IJ���,��������Ϊ����(����)

127.0.0.1:6379> HINCRBY hash1 field4 10

(integer) 16

127.0.0.1:6379> hget hash1 field4

"16"

127.0.0.1:6379> HINCRBY hash1 field4 -5

(integer) 11

127.0.0.1:6379> hget hash1 field4

"11"

##############################################################

# hsetnx ���������������,�������������ʧ��

127.0.0.1:6379> hsetnx hash1 field5 nihao

(integer) 1

127.0.0.1:6379> hsetnx hash1 field5 nihao

(integer) 0

##############################################################

hashӦ�ó���:���������hset user:1 name zhangsan; hset user:1 age 12���������û���Ϣ֮���,�����䶯����Ϣ!hash���ʺ��ڶ���Ĵ洢,String�����ʺ��ַ����Ĵ洢��

Zset(����)

��set�Ļ�����,������һ��ֵ,set:set k1 v1,zset: zset k1 score1 v1

##############################################################

127.0.0.1:6379> zadd zset1 1 one #����һ��ֵ

(integer) 1

127.0.0.1:6379> zadd zset1 2 two 3 four #�������ֵ

(integer) 2

127.0.0.1:6379> zrange zset1 0 -1 #�������ȫ��,��С����

1) "one"

2) "two"

3) "four"

127.0.0.1:6379> ZREVRANGE salary 0 -1 #�������ȫ��,�Ӵ�С

1) "lisi"

2) "wanger"

##############################################################

#zrangebyscore ����Ĭ��Ϊ����

#zrevrangebyscore ��������

127.0.0.1:6379> zadd salary 8000 zhangsan 9000 lisi 5000 wanger

(integer) 3

127.0.0.1:6379> ZRANGEBYSCORE salary -inf +inf ����������,����ΧΪ��������������

1) "wanger"

2) "zhangsan"

3) "lisi"

127.0.0.1:6379> ZRANGEBYSCORE salary -inf +inf withscores #�����ɼ�

1) "wanger"

2) "5000"

3) "zhangsan"

4) "8000"

5) "lisi"

6) "9000"

127.0.0.1:6379> ZREVRANGEBYSCORE salary +inf -inf withscores limit 0 3#����,limitΪ��ҳ

1) "lisi"

2) "9000"

3) "zhangsan"

4) "8000"

5) "wanger"

6) "5000"

##############################################################

# zrem �Ƴ�Ԫ��

127.0.0.1:6379> zrem salary zhangsan

(integer) 1

127.0.0.1:6379> zrange salary 0 -1

1) "wanger"

2) "lisi"

##############################################################

# zcard ��ȡ����Ԫ�ظ���

127.0.0.1:6379> zcard salary

(integer) 2 #����Ԫ�ظ���

##############################################################

# zcount �ж����������ֵ�м���

127.0.0.1:6379> zcount salary 2000 7000

(integer) 1

127.0.0.1:6379> zcount salary 2000 20000

(integer) 2

##############################################################

Ӧ�ó���:top ��

����������������

bitmap(λͼ)

λ�洢:����:ͳ���û���Ϣ,��Ծ,����Ծ,��½,δ��¼,������ֻ������״̬��

���Dz���������Ϊ�����м�¼,��ֻ��0��1����״̬!

#����һ�ܵĴ���Ϣ,��һ:1,��,�ܶ�:1.��,����:1,��,����:0,δ������

127.0.0.1:6379> setbit sign 0 1

(integer) 0

127.0.0.1:6379> setbit sign 1 1

(integer) 0

127.0.0.1:6379> setbit sign 2 1

(integer) 0

127.0.0.1:6379> setbit sign 3 0

(integer) 0

127.0.0.1:6379> setbit sign 4 1

(integer) 0

127.0.0.1:6379> setbit sign 5 0

(integer) 0

127.0.0.1:6379> setbit sign 6 0

(integer) 0

#��ȡijһ�����Ϣ

127.0.0.1:6379> getbit sign 1

(integer) 1

127.0.0.1:6379> getbit sign 3

(integer) 0

#ͳ�Ʋ���:ͳ�ƴ�����

127.0.0.1:6379> BITCOUNT sign

(integer) 4 #����4��

hyperloglog(����ͳ��)

ʲô�ǻ���:

A{1,3,4,5,6,8} B{1,3,5,6,8,9} ����:���ظ���Ԫ�� = 4,9���ҿ��Խ������

Redis Hyperloglogs ���ڻ���ͳ�Ƶ��㷨,�ŵ�:ռ�õ��ڴ��ǹ̶���,2^64����ͬ��Ԫ��,ֻ��Ҫ12KB�ڴ�,���Ҫ���ڴ�ǶȱȽϵĻ�,hyperloglogs��ѡ��

����:һ���˷���һ����վ���,����������һ���ˡ�

����:

127.0.0.1:6379> PFADD key1 a b c d e f g g i j k l m n # ����key1

(integer) 1

127.0.0.1:6379> PFCOUNT key1 # ���key1���ظ��ĸ���

(integer) 13

127.0.0.1:6379> PFADD key2 a b c d e f g , f h # ����key2

(integer) 1

127.0.0.1:6379> PFCOUNT key2 # ���key2���ظ��ĸ���

(integer) 9

127.0.0.1:6379> PFMERGE key1 key2 # ��key2�ϲ���key1��

OK

127.0.0.1:6379> PFCOUNT key1

(integer) 15

127.0.0.1:6379> PFCOUNT key2

(integer) 9

127.0.0.1:6379> PFMERGE key3 key1 key2 #��key1 �� key2һ��ϲ��������ڵ�key3��

OK

127.0.0.1:6379> PFCOUNT key3

(integer) 15

geospatial(�����)

��������,��������

redis��Geo��redis3.2�汾���Ƴ���!������ܿ����������λ�õ���Ϣ,����֮��ľ���,��Բ�뾶���˵ȡ�

ֻ����������:

geoadd

#����λ�� ע��:���������Dz���ֱ�����ӵ�

# ����:key ���� � ������

127.0.0.1:6379> geoadd china:city 106.5 29.5 chongqin

(integer) 1

127.0.0.1:6379> geoadd china:city 104.0 30.6 chengdu

(integer) 1

127.0.0.1:6379> geoadd china:city 116.40 39.90 beijing 121.47 31.23 shanghai

(integer) 2

geopos ��ѯ����λ�õ�ֵ

��ȡָ���ij��еľ��Ⱥ�γ��

127.0.0.1:6379> geopos china:city chengdu

1) 1) "104.00000184774398804"

2) "30.59999916504646222"

127.0.0.1:6379> geopos china:city beijing

1) 1) "116.39999896287918091"

2) "39.90000009167092543"

127.0.0.1:6379> geopos china:city chongqin

1) 1) "106.49999767541885376"

2) "29.50000115408581536"

geodist ��������֮��ľ���

�������λ��֮�������һ��������, ��ô����ؿ�ֵ��

ָ����λ�IJ��� unit ���������µ�λ������һ��:

- m ��ʾ��λΪ�ס�

- km ��ʾ��λΪǧ�ס�

- mi ��ʾ��λΪӢ�

- ft ��ʾ��λΪӢ�ߡ�

127.0.0.1:6379> geodist china:city chongqin chengdu

"269990.9228"

127.0.0.1:6379> geodist china:city chongqin chengdu km

"269.9909"

127.0.0.1:6379> geodist china:city beijing shanghai km

"1067.3788"

georadius �Ը����ľ�γ��Ϊ����, ���ؼ�������λ��Ԫ�ص���, �����ĵľ��벻�������������������λ��Ԫ�ء�

�Ҹ�������:(������и������˵Ķ�λ!),һ��ͨ���뾶����ѯ

��Χ����ʹ����������һ����λ:

- m ��ʾ��λΪ�ס�

- km ��ʾ��λΪǧ�ס�

- mi ��ʾ��λΪӢ�

- ft ��ʾ��λΪӢ�ߡ�

�ڸ������¿�ѡ��ʱ, ����᷵�ض������Ϣ:

WITHDIST: �ڷ���λ��Ԫ�ص�ͬʱ, ��λ��Ԫ��������֮��ľ���Ҳһ�����ء� ����ĵ�λ���û������ķ�Χ��λ����һ�¡�WITHCOORD: ��λ��Ԫ�صľ��Ⱥ�ά��Ҳһ�����ء�WITHHASH: �� 52 λ�з�����������ʽ, ����λ��Ԫ�ؾ���ԭʼ geohash ��������Ϸ�ֵ�� ���ѡ����Ҫ���ڵײ�Ӧ�û��ߵ���, ʵ���е����ò�����

����Ĭ�Ϸ���δ�����λ��Ԫ�ء� ͨ��������������, �û�����ָ��������λ��Ԫ�ص�����ʽ:

ASC: �������ĵ�λ��, ���մӽ���Զ�ķ�ʽ����λ��Ԫ�ء�DESC: �������ĵ�λ��, ���մ�Զ�����ķ�ʽ����λ��Ԫ�ء�

��Ĭ�������, GEORADIUS ����᷵������ƥ���λ��Ԫ�ء� ��Ȼ�û�����ʹ�� COUNT <count> ѡ��ȥ��ȡǰ N ��ƥ��Ԫ��, ������Ϊ�������ڲ����ܻ���Ҫ�����б�ƥ���Ԫ�ؽ��д���, �����ڶ�һ���dz���������������ʱ, ��ʹֻʹ�� COUNT ѡ��ȥ��ȡ����Ԫ��, �����ִ���ٶ�Ҳ���ܻ�dz����� ���Ǵ���һ������˵, ʹ�� COUNT ѡ��ȥ������Ҫ���ص�Ԫ������, ���ڼ��ٴ�����˵��Ȼ�Ƿdz����õġ�

127.0.0.1:6379> GEORADIUS china:city 110 30 1000 km # ��110 30Ϊ����,1000Km��Χ�ڵij���

1) "chengdu"

2) "chongqin"

127.0.0.1:6379> GEORADIUS china:city 110 30 1000 km withcoord count 1 #��ֻ����һ��,����ʾ��γ��

1) 1) "chongqin"

2) 1) "106.49999767541885376"

2) "29.50000115408581536"

127.0.0.1:6379> GEORADIUS china:city 110 30 1000 km withdist count 1 #����ʾֱ�߾���

1) 1) "chongqin"

2) "342.5131"

georadiusbymember

�������� GEORADIUS ����һ��, �������ҳ�λ��ָ����Χ�ڵ�Ԫ��, ���� GEORADIUSBYMEMBER �����ĵ����ɸ�����λ��Ԫ�ؾ�����, �������� GEORADIUS ����, ʹ������ľ��Ⱥ�γ�����������ĵ�

ָ����Ա��λ�ñ�������ѯ�����ġ�

127.0.0.1:6379> GEORADIUSBYMEMBER china:city beijing 3000 km #����3000km�뾶�ڵij���

1) "chengdu"

2) "chongqin"

3) "shanghai"

4) "beijing"

geohash

����һ������λ��Ԫ�ص� Geohash ��ʾ��

ͨ��ʹ�ñ�ʾλ�õ�Ԫ��ʹ�ò�ͬ�ļ���,ʹ��Geohashλ��52���������롣���ڱ���ͽ����������ʹ�õij�ʼ��С��������겻ͬ,����ı���Ҳ��ͬ�ڱ����������һ������Geohash,��ά���ٿ���geohash.org��վ�����������

���������11���ַ���Geohash�ַ���,����û�о���Geohash,��ʧ���,ʹ���ڲ�52λ��ʾ�����ص�geohashes������������:

- ���ǿ������̴��ұߵ��ַ�������ʧȥ����,���Խ�ָ��ͬһ������

- ��������

geohash.org��վʹ��,��ַhttp://geohash.org/<geohash-string>����ѯ����:http://geohash.org/sqdtr74hyu0. - �����Ƶ�ǰ�ַ����Ǹ���,���෴���Dz���ȷ��,���ǿ��ܵ�,�ò�ͬ��ǰ�ַ���������

127.0.0.1:6379> GEOHASH china:city beijing chongqin #����ά�ľ�γ��ת��Ϊһά���ַ���,��������ַ���Խ����Խ�ӽ�

1) "wx4fbxxfke0"

2) "wm5xz6qcvy0"

127.0.0.1:6379> GEOHASH china:city beijing chongqin shanghai

1) "wx4fbxxfke0"

2) "wm5xz6qcvy0"

3) "wtw3sj5zbj0"

geospatial�ĵײ����һ��Zset����

127.0.0.1:6379> zrange china:city 0 -1 #����

1) "chengdu"

2) "chongqin"

3) "shanghai"

4) "beijing"

����

����(ACID)�ı���:һ������ļ��ϡ���һ���������������ᱻ���л�,�������ִ�й�����,�ᰴ��˳��ִ�С�

һ����,ԭ����,������,�־��ԡ�

redis�������֤ԭ����,����redis�������Dz���֤ԭ���Եġ�

redis����û�и��뼶��ĸ���,���е�������������,��û��ֱ�ӱ�ִ��,ֻ�з���ִ�������ʱ��Żᱻִ��!

redis�����:

- ��������(multi)

- �������(��)

- ִ������(exec)

����ִ������

127.0.0.1:6379> multi #��������

OK

#�������

127.0.0.1:6379(TX)> set k1 v1

QUEUED

127.0.0.1:6379(TX)> set k2 v2

QUEUED

127.0.0.1:6379(TX)> get k2

QUEUED

127.0.0.1:6379(TX)> set k3 v3

QUEUED

127.0.0.1:6379(TX)> exec #ִ������

1) OK

2) OK

3) "v2"

4) OK

�������� discard

127.0.0.1:6379> multi #��������

OK

127.0.0.1:6379(TX)> set k4 v4

QUEUED

127.0.0.1:6379(TX)> set k5 v5

QUEUED

127.0.0.1:6379(TX)> DISCARD # ��������,��������е������ִ��

OK

127.0.0.1:6379> get k4

(nil)

�������쳣(�����д�,���ܱ���,�����������ִ��)

127.0.0.1:6379> multi

OK

127.0.0.1:6379(TX)> set k1 v1

QUEUED

127.0.0.1:6379(TX)> set k2 v2

QUEUED

127.0.0.1:6379(TX)> getset k2 # ���������,ֱ�ӱ���

(error) ERR wrong number of arguments for 'getset' command

127.0.0.1:6379(TX)> set k3 v3

QUEUED

127.0.0.1:6379(TX)> exec #ִ������Ҳ�DZ�����

(error) EXECABORT Transaction discarded because of previous errors.

127.0.0.1:6379> get k3 #���е��������ִ��

(nil)

����ʱ�쳣(��д�,���������ǿ�������ִ��,�����������׳��쳣)

127.0.0.1:6379> multi

OK

127.0.0.1:6379(TX)> set k1 v1

QUEUED

127.0.0.1:6379(TX)> INCR k1 #�����

QUEUED

127.0.0.1:6379(TX)> set k2 v2

QUEUED

127.0.0.1:6379(TX)> set v3 k3

QUEUED

127.0.0.1:6379(TX)> exec

1) OK

2) (error) ERR value is not an integer or out of range #��������ᱨ��,��������ִ�гɹ���

3) OK

4) OK

127.0.0.1:6379> get k2 #�������ִ�гɹ���

"v2"

127.0.0.1:6379> get v3

"k3"

���:watch

������:

- �ܱ���,��Ϊʲôʱ�������,������ʲô�������!

�ֹ���:

- ���ֹ�,��Ϊʲôʱ�����������,���Բ������!�������ݵ�ʱ��ȥ�ж�һ��,�ڴ��ڼ��Ƿ������Ĺ�����,

- ��ȡversion

- ���µ�ʱ��Ƚ�version

Redis���Ӳ���

127.0.0.1:6379> set money 100

OK

127.0.0.1:6379> set out 0

OK

127.0.0.1:6379> watch money

OK

127.0.0.1:6379> multi

OK

127.0.0.1:6379(TX)> DECRBY money 30

QUEUED

127.0.0.1:6379(TX)> INCRBY out 30

QUEUED

127.0.0.1:6379(TX)> exec

1) (integer) 70

2) (integer) 30

127.0.0.1:6379> watch money #����money����,�൱���ֹ���

OK

127.0.0.1:6379> multi

OK

127.0.0.1:6379(TX)> DECRBY money 10

QUEUED

127.0.0.1:6379(TX)> INCRBY out 10

QUEUED

127.0.0.1:6379(TX)> exec # ����һ������û��ִ�����,��һ�����ִ����,������һ������������,������һ�������ִ��ʧ�ܡ�

(nil)

#######################################################################

��exec֮ǰִ��:

127.0.0.1:6379> get money

"70"

127.0.0.1:6379> INCRBY money 100

(integer) 170

unwatch �����������ִ��ʧ��,���Ƚ���,Ȼ���ٴ�����

Jedis

ʹ��java������redis

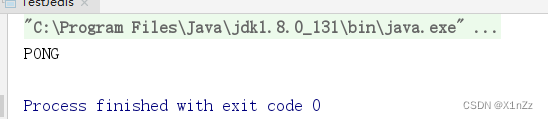

ʲô��Jedis

Jedis�ǹٷ��Ƽ���java���ӿ�������,ʹ��java����redis�м����

1�������Ӧ������:

<!-- ����Jedis�� -->

<dependency>

<groupId>redis.clients</groupId>

<artifactId>jedis</artifactId>

<version>3.6.0</version>

</dependency>

<!-- ����fastjson -->

<dependency>

<groupId>com.alibaba</groupId>

<artifactId>fastjson</artifactId>

<version>1.2.72</version>

</dependency>

2���������

- �������ݿ�

- ��������

- �Ͽ�����

public class TestJedis {

public static void main(String[] args) {

//1��new jedis����

Jedis jedis = new Jedis("192.168.147.129",6379);

//2��jedis�����з�������֮ǰѧ������

System.out.println(jedis.ping());

//3���ر�����

jedis.close();

}

}

��ҪԶ������redis��Ҫ���ܱ���ģʽѡ������Ϊ��no��,Ϊ���÷�������ʼ���ⲿ��������:

redis-cli������:config set protected-mode ��no��

���:

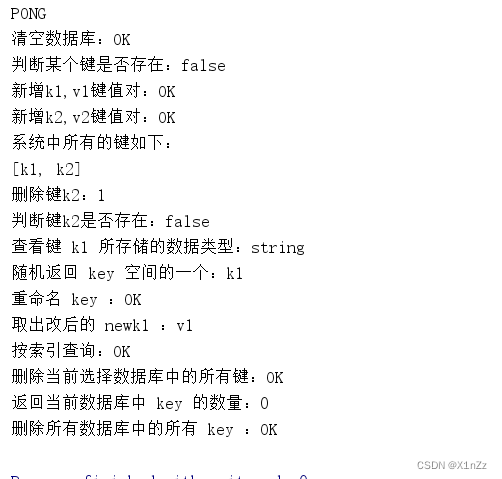

����:

System.out.println("������ݿ�:"+jedis.flushDB());

System.out.println("�ж�ij�����Ƿ����:"+jedis.exists("k1"));

System.out.println("����k1,v1��ֵ��:"+jedis.set("k1","v1"));

System.out.println("����k2,v2��ֵ��:"+jedis.set("k2","v2"));

System.out.println("ϵͳ�����еļ�����:");

Set<String> keys = jedis.keys("*");

System.out.println(keys);

System.out.println("ɾ����k2:"+jedis.del("k2"));

System.out.println("�жϼ�k2�Ƿ����:"+jedis.exists("k2"));

System.out.println("�鿴�� k1 ���洢����������:"+jedis.type("k1"));

System.out.println("������� key �ռ��һ��:"+jedis.randomKey());

System.out.println("������ key :"+jedis.rename("k1","newk1"));

System.out.println("ȡ���ĺ�� newk1 :"+jedis.get("newk1"));

System.out.println("��������ѯ:"+jedis.select(0));

System.out.println("ɾ����ǰѡ�����ݿ��е����м�:"+jedis.flushDB());

System.out.println("���ص�ǰ���ݿ��� key ������:"+jedis.dbSize());

System.out.println("ɾ���������ݿ��е����� key :"+jedis.flushAll());

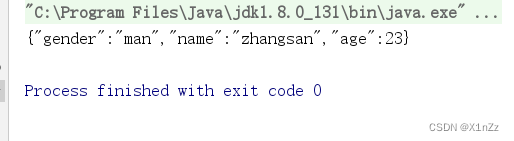

��������

package com.youxin;

import com.alibaba.fastjson.JSONObject;

import redis.clients.jedis.Jedis;

import redis.clients.jedis.Transaction;

/**

* @author youxin

* @program redis-study

* @description ��������

* @date 2021-11-21 17:10

*/

public class TestTX {

public static void main(String[] args) {

Jedis jedis = new Jedis("192.168.147.129", 6379);

JSONObject jsonObject = new JSONObject();

jsonObject.put("name","zhangsan");

jsonObject.put("age",23);

jsonObject.put("gender","man");

//��������

Transaction multi = jedis.multi();

String string = jsonObject.toJSONString();

try {

multi.set("key1",string);

multi.exec();

}catch (Exception e) {

//���ʧ�ܷ�������

multi.discard();

e.printStackTrace();

}finally {

//�ر�����

System.out.println(jedis.get("key1"));

jedis.close();

}

}

}

SpringBoot����Redis

SpringBoot��������:spring-data jpa jdbc mongodb redis

SpringDataҲ�Ǻ�SpringBoot��������Ŀ

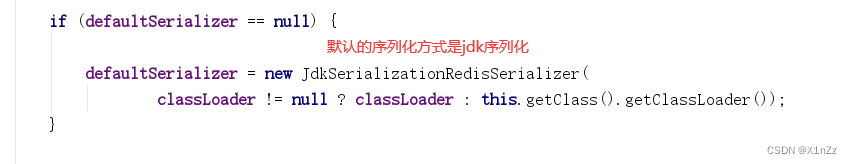

˵��:��SpringBoot2.x֮��,ԭ��ʹ�õ�jedis���滻����lettuce

jedis:���õ�ֱ��,����̲߳����Ļ�,�Dz���ȫ��,�����Ҫ���ⲻ��ȫ��,ʹ��jedis pool���ӳء�����BIOģʽ��

lettuce:����netty,ʵ�������ڶ���߳��й���,�������̲߳���ȫ�����������NIOģʽ��

Դ�����:

@Bean

@ConditionalOnMissingBean(name = "redisTemplate")//�����Զ���redisTemplate���滻Ĭ�ϵ�

@ConditionalOnSingleCandidate(RedisConnectionFactory.class)

public RedisTemplate<Object, Object> redisTemplate(RedisConnectionFactory redisConnectionFactory) {

//Ĭ�ϵ�redisTemplateû�й��������,redis��������Ҫ���л�

//�������Ͷ���Object, Object������,ʹ����Ҫǿ��ת��<Strin, Object>����

RedisTemplate<Object, Object> template = new RedisTemplate<>();

template.setConnectionFactory(redisConnectionFactory);

return template;

}

@Bean

@ConditionalOnMissingBean //����String������redis���ʹ�õ�����,���Ե����г���

@ConditionalOnSingleCandidate(RedisConnectionFactory.class)

public StringRedisTemplate stringRedisTemplate(RedisConnectionFactory redisConnectionFactory) {

return new StringRedisTemplate(redisConnectionFactory);

}

���ϲ���

1����������

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-redis</artifactId>

</dependency>

2����������

#redis����

spring:

redis:

host: 192.168.147.129

port: 6379

database: 0

3������

@SpringBootTest

class Redis02SpringbootApplicationTests {

@Autowired

RedisTemplate redisTemplate;

@Test

void contextLoads() {

//redisTemplate ������ͬ����������,apiָ����һ����

// redisTemplate.opsForValue(); //�����ַ���String

// redisTemplate.opsForList(); //����List����

// redisTemplate.opsForHash();

// redisTemplate.opsForSet();

// redisTemplate.opsForZSet();

//���˻����IJ���,���õķ�������ֱ��ͨ��redisTemplate����,��������,�ͻ�����CRUD

//��ȡredis���Ӷ���

/*RedisConnection connection = redisTemplate.getConnectionFactory().getConnection();

connection.flushDb();

connection.flushAll();*/

redisTemplate.opsForValue().set("mykey1","hello world");

Object mykey1 = redisTemplate.opsForValue().get("mykey1");

System.out.println(mykey1);

}

@Test

public void test01() throws JsonProcessingException {

Person user = new Person(1, "����");

//����һ��ʹ��json�����ݶ���

ObjectMapper objectMapper = new ObjectMapper();

//ת��Ϊjson�ַ���

String jsonUser = objectMapper.writeValueAsString(user);

redisTemplate.opsForValue().set("user",jsonUser);

System.out.println(redisTemplate.opsForValue().get("user"));

}

}

�Զ���RedisTemplate

package com.youxin.config;

import com.fasterxml.jackson.annotation.JsonAutoDetect;

import com.fasterxml.jackson.annotation.PropertyAccessor;

import com.fasterxml.jackson.databind.ObjectMapper;

import org.springframework.boot.autoconfigure.condition.ConditionalOnMissingBean;

import org.springframework.boot.autoconfigure.condition.ConditionalOnSingleCandidate;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import org.springframework.data.redis.connection.RedisConnectionFactory;

import org.springframework.data.redis.core.RedisTemplate;

import org.springframework.data.redis.serializer.Jackson2JsonRedisSerializer;

import org.springframework.data.redis.serializer.StringRedisSerializer;

/**

* @author youxin

* @program redis-study

* @description

* @date 2021-11-22 17:02

*/

@Configuration

public class RedisConfig {

//�Զ����RedisTemplate

@Bean

@SuppressWarnings("all")

public RedisTemplate<String, Object> redisTemplate(RedisConnectionFactory redisConnectionFactory) {

RedisTemplate<String, Object> template = new RedisTemplate<String, Object>();

template.setConnectionFactory(redisConnectionFactory);

// �������

Jackson2JsonRedisSerializer jackson2JsonRedisSerializer = new Jackson2JsonRedisSerializer(Object.class);

ObjectMapper om = new ObjectMapper();

om.setVisibility(PropertyAccessor.ALL, JsonAutoDetect.Visibility.ANY);

om.enableDefaultTyping(ObjectMapper.DefaultTyping.NON_FINAL);

jackson2JsonRedisSerializer.setObjectMapper(om);

StringRedisSerializer stringRedisSerializer = new StringRedisSerializer();

// key����String�����л���ʽ

template.setKeySerializer(stringRedisSerializer);

//hash��keyҲ����String�����л���ʽ

template.setHashKeySerializer(stringRedisSerializer);

//value����jackson���л�

template.setValueSerializer(jackson2JsonRedisSerializer);

template.setHashValueSerializer(jackson2JsonRedisSerializer);

template.afterPropertiesSet();

return template;

}

}

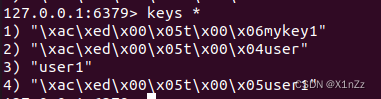

�ٴ�ִ��test02:

@Test

public void test02() {

Person user1 = new Person(2, "����");

redisTemplate.opsForValue().set("user1",user1);

System.out.println(redisTemplate.opsForValue().get("user1"));

}

�ٲ鿴redis������key:

���Կ������صĽ����һ����,������redis�б����л��ˡ�

��������get�����ʱ��������û��ת��:

127.0.0.1:6379> get user1

"[\"com.youxin.pojo.Person\",{\"id\":2,\"name\":\"\xe6\x9d\x8e\xe5\x9b\x9b\"}]"

��ʱ�����ڴ�redis-cliʱ��:redis-cli --raw

�ٴλ�ȡ����������:

youxin@youxin-virtual-machine:~$ redis-cli --raw

127.0.0.1:6379> get user1

["com.youxin.pojo.Person",{"id":2,"name":"����"}]

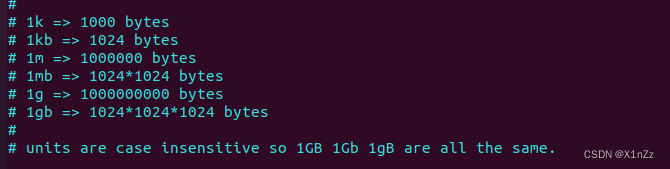

redis.conf

�����

includes���������������ļ�

���� NERWORK

bind 127.0.0.1 -::1 #�˿�Ϊ127.0.0.1

protected-mode yes #����ģʽ,Ĭ��Ϊ����

port 6379 #�˿�Ĭ��Ϊ6379

tcp-backlog 511 #�������ҿͻ����ٶȻ�����ʱ��,������ֵ����511��

GENERAL ͨ������

daemonize yes #��̨�ػ�ģʽ��Ĭ��Ϊ�ر�,һ������Ϊ����

pidfile /var/run/redis_6379.pid #����Ժ�̨�ķ�ʽ����,����Ҫָ��һ��pid�ļ�

loglevel notice # ��־Ĭ��Ϊnotice����

#��������

# Specify the server verbosity level.

# This can be one of:

# debug (a lot of information, useful for development/testing)

# verbose (many rarely useful info, but not a mess like the debug level)

# notice (moderately verbose, what you want in production probably)

# warning (only very important / critical messages are logged)

logfile /usr/local/redis6/redis6/log-redis.log #ָ����־�ļ�λ��

always-show-logo no #�Ƿ�������ʾlogo

SNAPSHOTTING ����

�־û�,�ڹ涨��ʱ����,ִ���˶��ٴβ���,���־û����ļ�.rdb

#�����3600s��,���������һ��key��������,�ͼ�ʱ�����ݿ���г־û�����

# save 3600 1

# save 300 100

# save 60 10000

stop-writes-on-bgsave-error yes #�־û��������,�Ƿ�����־û�

rdbcompression yes #�Ƿ�ѹ��rdb�ļ�,��Ҫ����һЩcpu��Դ

rdbchecksum yes #����rdb�ļ���ʱ��,���д���ļ��У��

dbfilename dump.rdb #rdb�ļ���Ĭ��Ϊdump.rdb

rdb-del-sync-files no # ��û�г־��Ե������ɾ��������ʹ�õ�RDB�ļ�,ͨ������±���Ĭ�ϼ���

dir /usr/local/redis6/redis6/redis_dbfiles/ #rdb�ļ������Ŀ¼,Ĭ���ǵ�ǰĿ¼

REPLICATION ���Ӹ���

SECURITY ��ȫ

acllog-max-len 128 #ACL��־�����,Ĭ����128M������acl,���:https://redis.io/topics/acl

# aclfile /etc/redis/users.acl #ACL�ⲿ�����ļ�����λ��

# requirepass foobared #��ǰredis����ķ�������,Ĭ���Dz���Ҫ����

CLIENTS �ͻ���

�ͻ����������������Ĭ����10000��

# maxclients 10000

MEMORY MANAGEMENT �ڴ����

ָ��Redis����ڴ����ơ��ﵽ�ڴ�����ʱ,Redis������ɾ���ѵ��ڻ����ڵ�Key��

# maxmemory <bytes>

# volatile-lru -> �������˹���ʱ���keys����LRU��̭����

# allkeys-lru -> ������keys����LRU��̭����

# volatile-lfu -> �������˹���ʱ���keys����LFU��̭����

# allkeys-lfu -> ������keys����LFU��̭����

# volatile-random -> �������˹���ʱ���keys���������̭����

# allkeys-random -> ������keys���������̭����

# volatile-ttl -> ��̭�����ʱ�������keys

# noeviction -> ����̭�κ�key,����д���������һ������

�ڴ����,Ĭ����noeviction

# maxmemory-policy noeviction

#����5�з�ʽ

#volatile-lru:ֻ�������˹���ʱ���key����LRU(Ĭ��ֵ)

#allkeys-lru : ɾ��lru�㷨��key

#volatile-random:���ɾ����������key

#allkeys-random:���ɾ��

#volatile-ttl : ɾ���������ڵ�

#noeviction : ��������,���ش���

LRU,LFU,minimal TTL �㷨�����Ǿ����㷨,�������ó�����������,Ĭ����5��������

# maxmemory-samples 5

�� Redis 5 ��ʼ,Ĭ�������,replica �ڵ����� maxmemory ����(�����ڷ��� failover ��,

�˽ڵ㱻����Ϊ master �ڵ�)�� ����ζ��ֻ�� master �Ż�ִ�й���ɾ������,���� master ��

ɾ����֮���� replica ���� DEL ���

# replica-ignore-maxmemory yes

���ù���keys��Ȼפ�����ڴ��еı���,Ĭ����Ϊ1,��ʾ���ֻ����10%�Ĺ���keyפ�����ڴ���,

��ֵ���õ�ԽС,��ô��һ����̭������,���ĵ�CPU��ԴҲ����,��Ϊ��Ҫʵʱɾ������Ĺ���key��

���Ը�ֵ����������Ҫ�ۺ�Ȩ��ġ�

# active-expire-effort 1

Redis�־û�

Redis���ڴ����ݿ�,��������ڴ��е����ݿ�״̬���浽����,��ôһ�������������˳�,�������е����ݿ�״̬Ҳ����ʧ,����Redis�ṩ�˳־û�����!

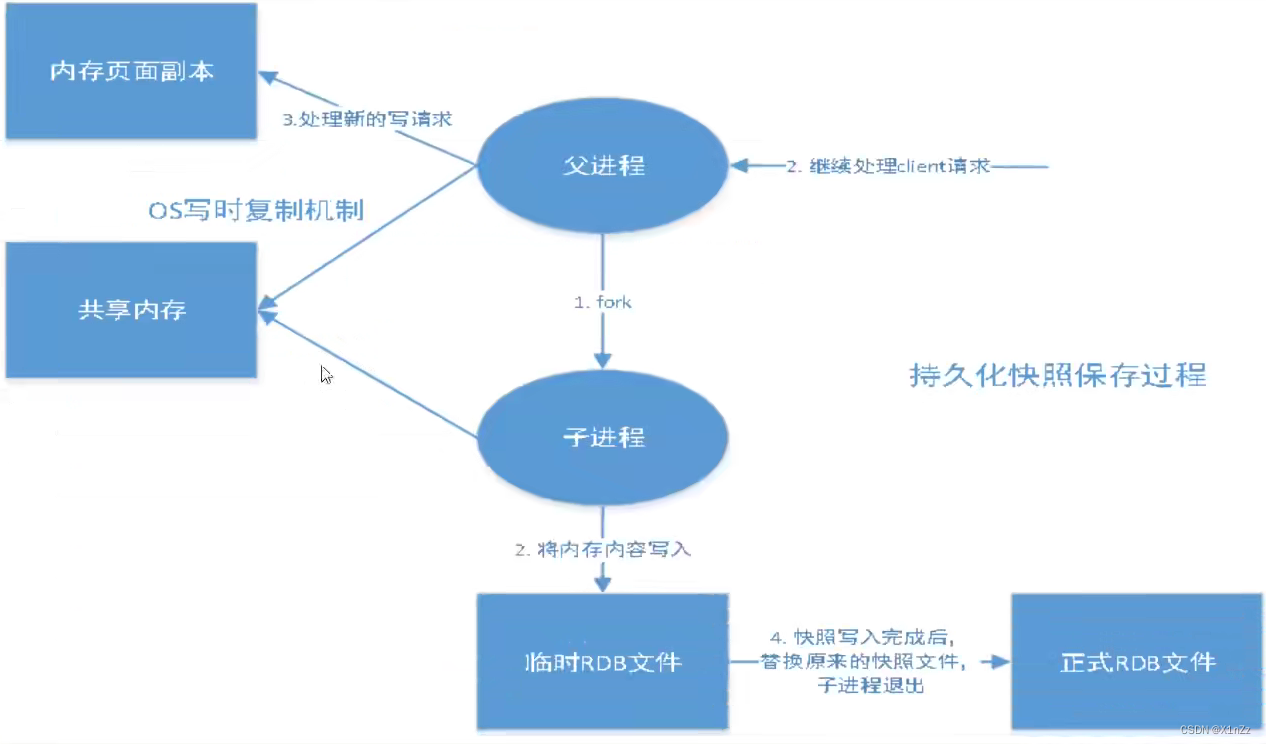

RDB(Redis DataBase)

��ָ����ʱ�����ڽ��ڴ��е����ݼ�����д�����,Ҳ�����л�����Snapshot����,���ָ�ʱ�ǽ������ļ�ֱ�Ӷ����ڴ��

Redis�ᵥ������ ( fork)һ���ӽ��������г־û�,���Ƚ�����д�뵽һ����ʱ�ļ���,���־û����̶�������,���������ʱ�ļ��滻�ϴγ־û��õ��ļ�������������,�������Dz������κ�IO�����ġ����ȷ���˼��ߵ����ܡ������Ҫ���д��ģ���ݵĻָ�,�Ҷ������ݻָ��������Բ��Ƿdz�����,��RDB��ʽҪ��AOF��ʽ���ӵĸ�Ч��RDB��ȱ�������һ�γ־û�������ݿ��ܶ�ʧ��

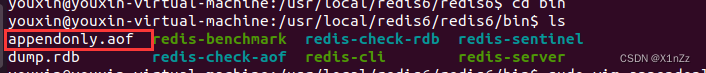

rdb������ļ���dump.rdb

��������

1��save�Ĺ�������������,���Զ�����rdb����

2��ִ��flushall����,Ҳ�ᴥ��rdb����

3���˳�redis,Ҳ�����һ��rdb�ļ�

���ݾ��Զ�����һ��dump.rdb

��rdb����:

# save 3600 1

# save 300 100

# save 60 10000

save 60 3 #60������3�����ݾͻ�save

ɾ��ԭ����sump.rdb : sudo rm -rf dump.rdb

60s�ڱ�����������:

127.0.0.1:6379> set k1 vq

OK

127.0.0.1:6379> set k2 v2

OK

127.0.0.1:6379> set k3 v3

OK

��dirĬ�ϵ�Ŀ¼������dump.rdb�ļ�

��λָ�rdb�ļ�

1��ֻ��Ҫ��rdb�ļ�����redis����Ŀ¼�Ϳ���,redis������ʱ����Զ����dump.rdb�ָ����е�����

2���鿴��Ҫ���ڵ�λ��

127.0.0.1:6379> config get dir

1) "dir"

2) "/usr/local/redis6/redis6/bin" #��������Ŀ¼�´���dump.rdb�ļ�,�����ͻ��Զ��ָ����е�����

�ŵ�:

- �ʺϴ��ģ�����ݻָ�

- ��������ݵ�������Ҫ��

ȱ��:

- ��Ҫһ����ʱ�������̲���,���redis����崻���,���һ���ĵ����ݾ�û����

- fork���̵�ʱ�� ,��ռ��һ���Ŀռ�

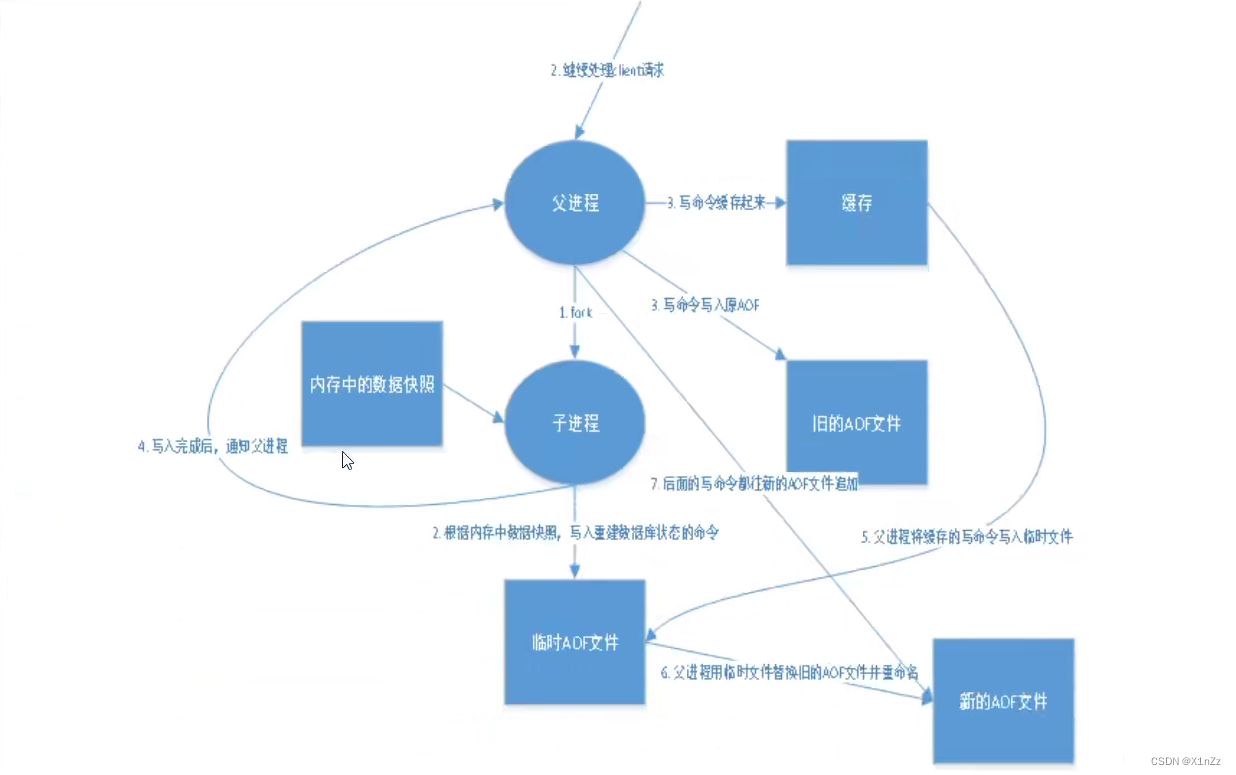

AOF(Append Only File)

�����е������¼����,�ָ���ʱ��Ͱ�����ļ�ȫ��������ִ��һ�顣

����־����ʽ����¼ÿ��д����,��Redisִ�й�������ָ���¼����(����������¼),ֻ�����ļ��������Ը�д�ļ�,redis����֮�����ȡ���ļ����¹�������,����֮,redis�����Ļ�������־�ļ������ݽ�дָ���ǰ����ִ��һ����������ݵĻָ�����

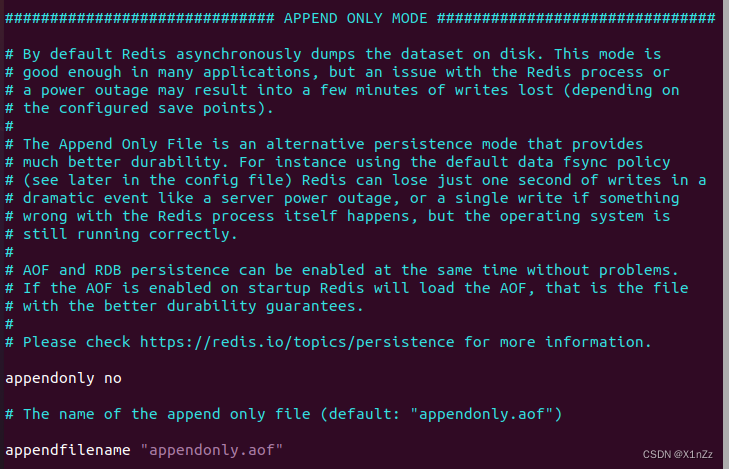

AOF�������appendonly.aof�ļ�

����,Ĭ���Dz�������:

ֻ��Ҫ��appendonly����Ϊyes�Ϳ��Կ���aof

����redis�Ϳ�����Ч:

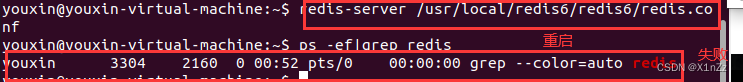

redis-server /usr/local/redis6/redis6/redis.conf

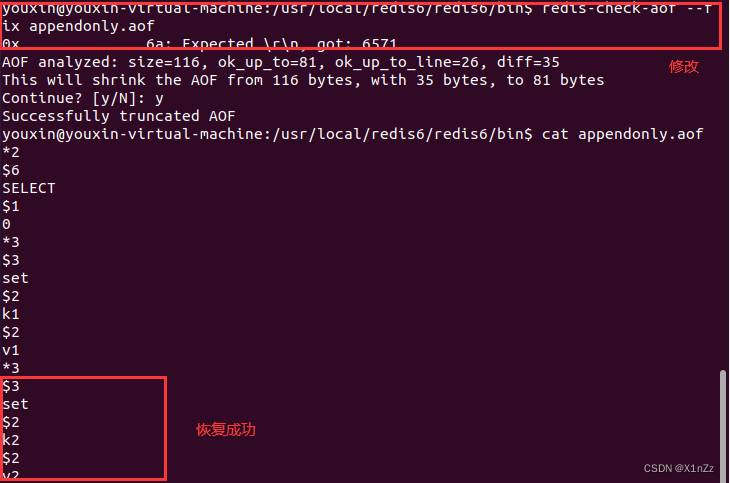

���aof�ļ��д���,��ʱ��redis��������������,������Ҫ��aof�����ļ�,redis�ṩ��������,redis-check-aof --fix appendonly.aofλ��

�����appendonly.aof�ļ����ݲ�ɾ��dump.rdb�ļ�,������redis��ʧ��:

��ʱ��appendonly.aof�ļ�:

redis-check-aof --fix appendon

�ٴ������������ɹ�:

�ŵ�:

1��ÿһ���Ķ���ͬ��,�ļ��������Ի���Ӻ�

2��Ĭ��Ϊÿ��ͬ��һ��,���ܻᶪʧһ�������

3�������������ͬ��,�ᶪʧ����

ȱ��:

1������������ļ���˵,aof���Ǵ���rdb�ļ�,���ٶ�Ҳ��rdb��

2��aof����Ч��Ҳ��rdb��,����redisĬ��Ϊrdb

Redis��������

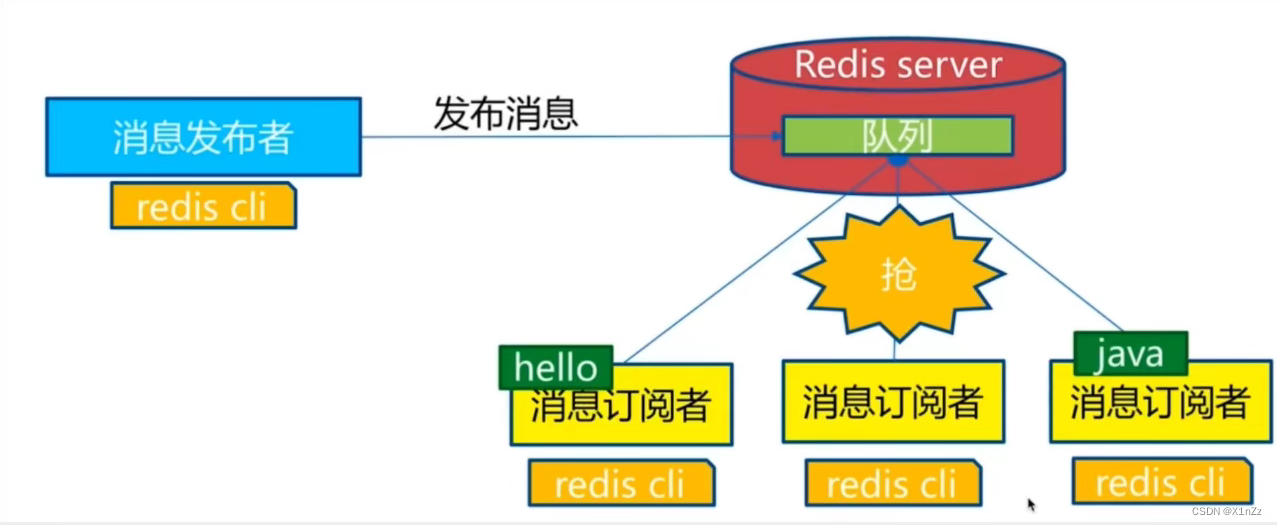

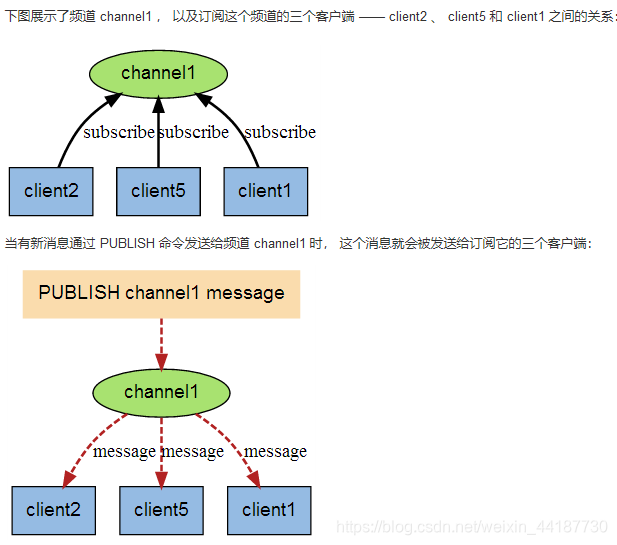

Redis��������(pub/sub)��һ����Ϣͨ��ģʽ:������(pub)������Ϣ,������(sub)������Ϣ��

Redis�ͻ�����Զ�������������Ƶ����

��ɫ1:��Ϣ������ ��ɫ2:Ƶ�� ��ɫ3:��Ϣ������

����/������Ϣͼ:

����

Redis ������������

�±��г��� redis �������ij�������:

| ��� | ������� |

|---|---|

| 1 | [PSUBSCRIBE pattern pattern ��] ����һ���������ϸ���ģʽ��Ƶ���� |

| 2 | [PUBSUB subcommand argument [argument ��]] �鿴�����뷢��ϵͳ״̬�� |

| 3 | PUBLISH channel message ����Ϣ���͵�ָ����Ƶ���� |

| 4 | [PUNSUBSCRIBE pattern [pattern ��]] �˶����и���ģʽ��Ƶ���� |

| 5 | [SUBSCRIBE channel channel ��] ���ĸ�����һ������Ƶ������Ϣ�� |

| 6 | [UNSUBSCRIBE channel [channel ��]] ָ�˶�������Ƶ���� |

����:

#������

127.0.0.1:6379> SUBSCRIBE youxin #���Ķ���

subscribe

youxin

1

message

youxin

this is my first test

#������

127.0.0.1:6379> PUBLISH youxin "this is my first test" #����,��������,������Ϣ

1

ԭ��

Redis��ʹ��Cʵ�ֵ�,ͨ������RedisԴ�������pubsub.c�ļ�,�˽ⷢ���Ͷ��Ļ��Ƶĵײ�ʵ��,���˼����Redis�����⡣

Redisͨ�� PUBLISH��SUBSCRIBE �� PSUBSCRIBE ������ʵ�ַ����Ͷ��Ĺ��ܡ�

ͨ�� SUBSCRIBE �����ijƵ����,redis-server ��ά��һ���ֵ�,�ֵ�ļ�����һ����channel,���ֵ��ֵ����һ������,�����б��������ж������channel�Ŀͻ��ˡ�SUBSCRIBE����Ĺؼ�,���ǽ��ͻ������ӵ����� channel �Ķ��������С�

ͨ�� PUBLISH ���������߷�����Ϣ,redis-server ��ʹ�ø�����Ƶ����Ϊ��,������ά���� channel �ֵ��в��Ҽ�¼�˶������Ƶ�������пͻ��˵�����,�����������,����Ϣ���������ж����ߡ�

Pub/Sub ��������������Ƿ���(Publish)�붩��(Subscribe),��Redis��,������趨��ijһ��keyֵ������Ϣ��������Ϣ����,��һ��keyֵ�Ͻ�������Ϣ������,���ж������Ŀͻ��˶����յ���Ӧ����Ϣ����һ���������Ե��÷���������ʵʱ��Ϣϵͳ,������ͨ�ļ�ʱ����,Ⱥ�ĵȹ��ܡ�

Redis���Ӹ���

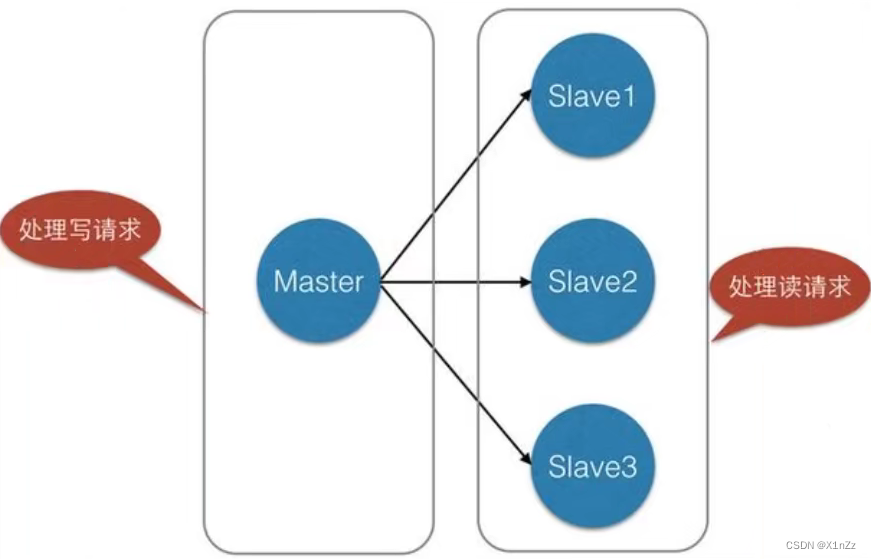

����

���Ӹ���,��ָ��һ̨Redis������������,���Ƶ�������Redis��������ǰ�߳�Ϊ���ڵ�(master/leader),���߳�Ϊ�ӽڵ�(slave/follower);���ݵĸ����ǵ����,ֻ�������ڵ㵽�ӽڵ㡣Master��дΪ��,Slave�Զ�Ϊ����

Ĭ�������,ÿ̨Redis�������������ڵ�;��һ�����ڵ�����ж���ӽڵ�(��û�дӽڵ�),��һ���ӽڵ�ֻ����һ�����ڵ㡣

���Ӹ��Ƶ�������Ҫ����:

1����������:���Ӹ���ʵ�������ݵ��ȱ���,�dz־û�֮���һ���������ʽ��

2�����ϻָ��õ����ڵ��������ʱ,�����ɴӽڵ��ṩ����,ʵ�ֿ��ٵĹ��ϻָ�;ʵ������һ�ַ�������ࡣ

3�����ؾ���������Ӹ��ƵĻ�����,��϶�д����,���������ڵ��ṩд����,�ɴӽڵ��ṩ������(��дRedis����ʱӦ���������ڵ�,��Redis����ʱӦ�����Ӵӽڵ�),�ֵ����������ةr��������д�ٶ���ij�����,ͨ������ӽڵ�ֵ�������,���Դ�����Redis�������IJ�������

4���߿��û�ʯ(��Ⱥ)�ó���������������,���Ӹ��ƻ����ڱ��ͼ�Ⱥ�ܹ�ʵʩ�Ļ���,���˵���Ӹ�����Redis�߿��õĻ�����

һ����˵,Ҫ��redis�����ڹ�����Ŀ��,ֻ��һ̨Redis�������ܵ�,ԭ������:

1���ӽṹ��,����Redis�������ᷢ���������,����һ̨��������Ҫ�������е�������,ѹ���ϴ�;

2����������,����Redis�������ڴ���������,����һ̨����������Ϊ256G,Ҳ���ܽ������ڴ�����Redis�洢�ڴ�,һ����˵,����Redis���ʹ���ڴ治Ӧ�ó���20G��

������վ�ϵ���Ʒ,һ�㶼��һ���ϴ�,�����������,Ҳ���ǡ������д��

��������

ֻ���ôӿ�,������������!

1����������redis.conf

2����ÿһ���е����ö˿ں��ļ�·����

3������ÿһ��redis

4���鿴:

youxin@youxin-virtual-machine:/usr/local/redis6/redis6$ ps -ef|grep redis

youxin 7696 1544 0 00:07 ? 00:00:00 redis-server *:6379

youxin 7738 1544 0 00:08 ? 00:00:00 redis-server *:6380

youxin 7762 1544 0 00:08 ? 00:00:00 redis-server *:6381

youxin 7768 2114 0 00:08 pts/0 00:00:00 grep --color=auto redis

�鿴���ÿ�:

127.0.0.1:6379> info replication #�鿴��ǰ�����Ϣ

# Replication

role:master #��ɫ,master

connected_slaves:0 # �ӻ�Ϊ0

master_failover_state:no-failover

master_replid:ca8f4258cac7d719392e4cc50624b0b3bde24501

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:0

second_repl_offset:-1

repl_backlog_active:0

repl_backlog_size:1048576

repl_backlog_first_byte_offset:0

repl_backlog_histlen:0

һ������

һ�������ֻ�����ôӻ��ͺ���

# slaveof

slaveof 127.0.0.1 6379

127.0.0.1:6380> SLAVEOF 127.0.0.1 6379

OK

127.0.0.1:6380> info replication

# Replication

role:slave #��ɫ�ӻ�

master_host:127.0.0.1 #����ip

master_port:6379 #�����˿�

master_link_status:up

master_last_io_seconds_ago:4

master_sync_in_progress:0

slave_read_repl_offset:14

slave_repl_offset:14

slave_priority:100

slave_read_only:1

replica_announced:1

connected_slaves:0

master_failover_state:no-failover

master_replid:f127714752509e305e3727cb77567ccacb87a57e

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:14

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:1

repl_backlog_histlen:14

# �鿴����������Ϣ

127.0.0.1:6379> info replication

# Replication

role:master #��ɫ����

connected_slaves:1 #�ӻ�һ̨

slave0:ip=127.0.0.1,port=6380,state=online,offset=56,lag=0 #��ַ,�˿�,״̬����

master_failover_state:no-failover

master_replid:f127714752509e305e3727cb77567ccacb87a57e

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:56

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:1

repl_backlog_histlen:56

��̨�ӻ�����6379�˿ڵ�redis��Ϊ����

�ٴβ鿴����������Ϣ:

127.0.0.1:6379> info replication

# Replication

role:master

connected_slaves:2

slave0:ip=127.0.0.1,port=6381,state=online,offset=42,lag=1

slave1:ip=127.0.0.1,port=6380,state=online,offset=42,lag=1

master_failover_state:no-failover

master_replid:e7646763fdca473309caf87775fbc20b537fd110

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:42

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:1

repl_backlog_histlen:42

������ʵ�Ĺ���������,�ǽ��������������������ļ��е�,�����������ļ���:

################################# REPLICATION #################################

# replicaof <masterip> <masterport> #����������ip�Ͷ˿�

# If the master is password protected (using the "requirepass" configuration

# directive below) it is possible to tell the replica to authenticate before

# starting the replication synchronization process, otherwise the master will

# refuse the replica request.

#

# masterauth <master-password> #�����������������������������

ϸ��

��������д,�ӻ�����д,ֻ�ܶ�����!�����е�������Ϣ������,�����Զ����ӻ����档

��������д�Ͷ�:

127.0.0.1:6379> set mykey hello

OK

127.0.0.1:6379> keys *

mykey

127.0.0.1:6379> get mykey

hello

�ӻ�ֻ�ܶ�:

127.0.0.1:6380> set k2 v2

READONLY You can't write against a read only replica. #���ܹ�д��

127.0.0.1:6380> get mykey

hello

����:�����Ͽ�����,�ӻ���Ȼ���ӵ�����,����û��д����,��ʱ���������������,�ӻ����ɿ���ֱ�ӻ�ȡ��������Ϣ!

�����ʹ����������������������Ϣ,���ʱ����������˴ӻ�,�ӻ��ͻ�������������������������ļ���������������Ϣ,�����ӻ������ɻ��Ǵӻ�,���ǿ��Դ������л�ȡֵ,��ֻҪ��������һ�������ͻᱻִ��һ��ȫ�����ơ�

����ԭ��

slave�����ɹ����ӵ�master��ᷢ��һ��syncͬ������

master�ӵ�����,������̨�Ĵ��̽���,ͬʱ�ռ����н��յ������������ݼ�����,�ں�̨����ִ�����֮��,master���������������ļ���slave,�����һ����ȫͬ����

ȫ������:slave�����ٽ��յ����ݿ��ļ����ݺ�,������̲����ص��ڴ��С�

��������:master�������µ������ռ�����������һ�δ���slave,���ͬ����

����ֻҪ����������master,һ����ȫͬ��(ȫ������)�����Զ�ִ�С�

���������ӻ�������һ������,�����Խ�һ���ӻ�����һ������,����һ���ӻ�����������Ϊǰһ���ӻ�,������Ч����ǰ����һ����,Ҳ����������Ӹ���

��������Ͽ���,�ܲ�������ѡһ��������

slaveof no one #��������Ͽ�������,����ʹ�Լ��������,�����Ľڵ�Ϳ����ֶ�����������ڵ�,����ԭ���������������Ӻ�Ҳû������,�ôӻ�������Ϊ�����ˡ�

###############�Ͽ�����#######################

127.0.0.1:6379> SHUTDOWN

################�鿴�ӻ�������Ϣ#################

127.0.0.1:6380> info replication

# Replication

role:slave

master_host:127.0.0.1

master_port:6379

master_link_status:down

master_last_io_seconds_ago:-1

master_sync_in_progress:0

slave_read_repl_offset:4035

slave_repl_offset:4035

master_link_down_since_seconds:19

slave_priority:100

slave_read_only:1

replica_announced:1

connected_slaves:0

master_failover_state:no-failover

master_replid:e7646763fdca473309caf87775fbc20b537fd110

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:4035

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:2523

repl_backlog_histlen:1513

#��ʱû������

#############��6380�˿���Ϊ����################

127.0.0.1:6380> info replication

# Replication

role:master

connected_slaves:0

master_failover_state:no-failover

master_replid:44fb1472c499cb87860cd64c34ac4be7eb0473ab

master_replid2:e7646763fdca473309caf87775fbc20b537fd110

master_repl_offset:4035

second_repl_offset:4036

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:2523

repl_backlog_histlen:1513

############����6379�˿�####################

#��ʱ6380�˿ڻ�����Ϊ������

redis-server /usr/local/redis6/redis6/redis-79.conf

127.0.0.1:6379> info replication

# Replication

role:master

connected_slaves:1

slave0:ip=127.0.0.1,port=6381,state=online,offset=14,lag=1

master_failover_state:no-failover

master_replid:96c10b1f28db707d87af81c2c654f77adeae87ab

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:14

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:1

repl_backlog_histlen:14

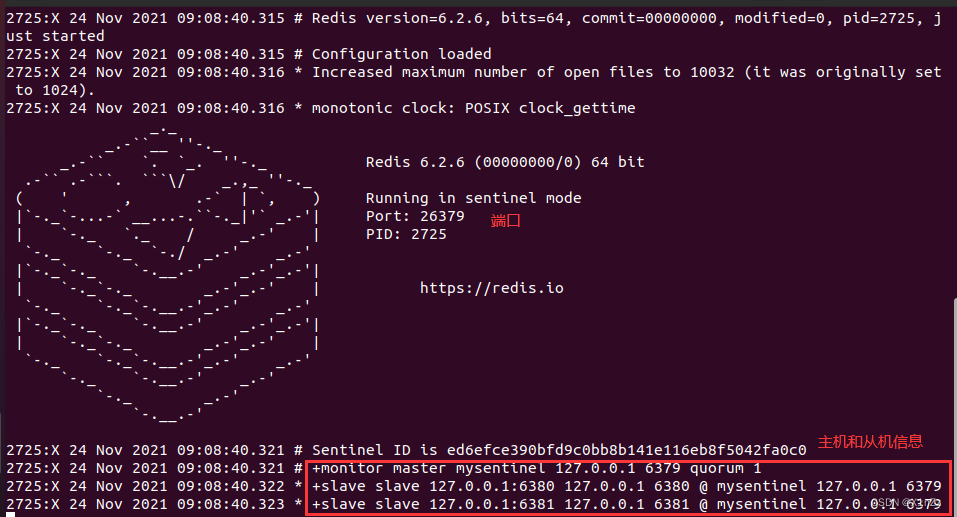

�ڱ�ģʽ(�Զ�ѡȡ����ģʽ)

����

�����л������ķ����ǩU����������崻���,��Ҫ�ֶ���һ̨�ӷ������л�Ϊ��������,�����Ҫ�˹���Ԥ,���·���,�������һ��ʱ���ڷ����á��ⲻ��һ���Ƽ��ķ�ʽ,����ʱ��,�������ȿ����ڱ�ģʽ��Redis��2.8��ʼ��ʽ�ṩ��Sentinel (�ڱ�)�ܹ������������⡣

ı����λ���Զ���,�ܹ���̨��������Ƿ����,��������˸���ͶƱ���Զ����ӿ�ת��Ϊ���⡣

�ڱ�ģʽ��һ�������ģʽ,����Redis�ṩ���ڱ�������,�ڱ���һ�������Ľ���,��Ϊ����,����������С���ԭ�����ڱ�ͨ����������,�ȴ�Redis��������Ӧ,�Ӷ�������еĶ��Redisʵ����

�ڱ�����������:

- ͨ����������,��redis���������ؼ��������״̬,�������������ʹӷ�����

- ���ڱ���master崻�,���Զ���slave�л���master,Ȼ��ͨ����������ģʽ֪ͨ�����Ĵӷ�����,�������ļ�,�������л�������

��һ���ڱ����̶�redis���������м��,���ܻ��������,Ϊ�˿���ʹ�ö���ڱ����,�����ڱ�֮�仹����м��,�������γ��˶��ڱ�ģʽ��

������������崻�,�ڱ�1�ȼ�������,ϵͳ���������Ͻ���failover����,�������ڱ�1���۵���Ϊ��������������,��������Ϊ�������ߡ���������ڱ�Ҳ����������������,���������ﵽһ��ֵʱ,��ô�ڱ�֮��ͻ����һ��ͶƱ,ͶƱ�Ľ����һ���ڱ�����,����failover[����ת��]�������л��ɹ���,�ͻ�ͨ����������ģʽ,�ø����ڱ����Լ���صĴӷ�����ʵ���л�����,������̳�Ϊ�����ߡ�

����

1�������ڱ������ļ�sentinel.conf

#sentinel monitor ����ص����� host port 1

sentinel monitor mysentinel 127.0.0.1 6379 1 #���������1���������������,slaveͶƱ��˭��������,Ʊ������,�ͱ��������

2�������ڱ�:

sudo ./redis-sentinel /usr/local/redis6/redis6/sentinel.conf

3���Ͽ�����:

127.0.0.1:6379> shutdown

#�ӻ���Ϣ:

127.0.0.1:6380> info replication

# Replication

role:master #80�˿��Լ���Ϊ����

connected_slaves:1

slave0:ip=127.0.0.1,port=6381,state=online,offset=22558,lag=0

master_failover_state:no-failover

master_replid:cba5caf39b0469a035959af3625fae5b2defea90

master_replid2:9ba967781e0852c3ece92b2a659e8b10f5913bc4

master_repl_offset:22558

second_repl_offset:10958

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:1

repl_backlog_histlen:22558

127.0.0.1:6381> info replication

# Replication

role:slave

master_host:127.0.0.1

master_port:6380 #81�˿ڽ�80�˿���Ϊ����

master_link_status:up

master_last_io_seconds_ago:1

master_sync_in_progress:0

slave_read_repl_offset:23936

slave_repl_offset:23936

slave_priority:100

slave_read_only:1

replica_announced:1

connected_slaves:0

master_failover_state:no-failover

master_replid:cba5caf39b0469a035959af3625fae5b2defea90

master_replid2:9ba967781e0852c3ece92b2a659e8b10f5913bc4

master_repl_offset:23936

second_repl_offset:10958

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:15

repl_backlog_histlen:23922

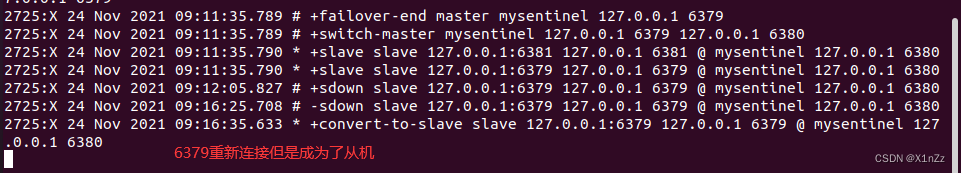

�۲��ڱ���־:

4���ָ�ԭ��������:

youxin@youxin-virtual-machine:~$ redis-server /usr/local/redis6/redis6/redis-79.conf

#�鿴6379������Ϣ:

127.0.0.1:6379> info replication

# Replication

role:slave

master_host:127.0.0.1

master_port:6380

master_link_status:up

master_last_io_seconds_ago:1

master_sync_in_progress:0

slave_read_repl_offset:35132

slave_repl_offset:35132

slave_priority:100

slave_read_only:1

replica_announced:1

connected_slaves:0

master_failover_state:no-failover

master_replid:cba5caf39b0469a035959af3625fae5b2defea90

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:35132

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:31381

repl_backlog_histlen:3752

�ŵ�:

1���ڱ���Ⱥһ��������Ӹ���ģʽ,���е����������ŵ�,��ȫ��

2�����ӿ����л�,���Ͽ���ת��,ϵͳ�Ŀ����Ծͻ����

3���ڱ�ģʽ��������ģʽ������,�ֶ����Զ�,���ӽ�׳!

ȱ��:

1��redis������������,��Ⱥ����һ���ﵽ����,�������ݾ�ʮ���鷳!

2��ʵ���ڱ�ģʽ��������ʵ�Ǻ��鷳��,�����кܶ�ѡ��!

�ڱ������ļ�:

# Example sentinel.conf

# �ڱ�sentinelʵ�����еĶ˿� Ĭ��26379

port 26379

# �ڱ�sentinel�Ĺ���Ŀ¼

dir /tmp

# �ڱ�sentinel��ص�redis���ڵ�� ip port

# master-name �����Լ����������ڵ����� ֻ������ĸA-z������0-9 ���������ַ�".-_"��ɡ�

# quorum ����Щquorum����sentinel�ڱ���Ϊmaster���ڵ�ʧ�� ��ô��ʱ ������Ϊ���ڵ�ʧ����

# sentinel monitor <master-name> <ip> <redis-port> <quorum>

sentinel monitor mymaster 127.0.0.1 6379 2

# ����Redisʵ���п�����requirepass foobared ��Ȩ���� ������������Redisʵ���Ŀͻ��˶�Ҫ�ṩ����

# �����ڱ�sentinel �������ӵ����� ע�����Ϊ��������һ������֤����

# sentinel auth-pass <master-name> <password>

sentinel auth-pass mymaster MySUPER--secret-0123passw0rd

# ָ�����ٺ���֮�� ���ڵ�û��Ӧ���ڱ�sentinel ��ʱ �ڱ���������Ϊ���ڵ����� Ĭ��30��

# sentinel down-after-milliseconds <master-name> <milliseconds>

sentinel down-after-milliseconds mymaster 30000

# ���������ָ�����ڷ���failover�����л�ʱ�������ж��ٸ�slaveͬʱ���µ�master���� ͬ��,

�������ԽС,���failover�����ʱ���Խ��,

��������������Խ��,����ζ��Խ ���slave��Ϊreplication�������á�

����ͨ�������ֵ��Ϊ 1 ����֤ÿ��ֻ��һ��slave ���ڲ��ܴ������������״̬��

# sentinel parallel-syncs <master-name> <numslaves>

sentinel parallel-syncs mymaster 1

# ����ת�Ƶij�ʱʱ�� failover-timeout ��������������Щ����:

#1. ͬһ��sentinel��ͬһ��master����failover֮��ļ��ʱ�䡣

#2. ��һ��slave��һ�������master����ͬ�����ݿ�ʼ����ʱ�䡣ֱ��slave������Ϊ����ȷ��master����ͬ������ʱ��

#3.����Ҫȡ��һ�����ڽ��е�failover����Ҫ��ʱ�䡣

#4.������failoverʱ,��������slavesָ���µ�master��������ʱ�䡣����,��ʹ���������ʱ,slaves��Ȼ�ᱻ��ȷ����Ϊָ��master,���ǾͲ���parallel-syncs�����õĹ�������

# Ĭ��������

# sentinel failover-timeout <master-name> <milliseconds>

sentinel failover-timeout mymaster 180000

# SCRIPTS EXECUTION

#���õ�ijһ�¼�����ʱ����Ҫִ�еĽű�,����ͨ���ű���֪ͨ����Ա,���統ϵͳ���в�����ʱ���ʼ�֪ͨ�����Ա��

#���ڽű������н�������¹���:

#���ű�ִ�к�1,��ô�ýű��Ժᱻ�ٴ�ִ��,�ظ�����ĿǰĬ��Ϊ10

#���ű�ִ�к�2,���߱�2���ߵ�һ������ֵ,�ű��������ظ�ִ�С�

#����ű���ִ�й����������յ�ϵͳ�ж��źű���ֹ��,��ͬ����ֵΪ1ʱ����Ϊ��ͬ��

#һ���ű������ִ��ʱ��Ϊ60s,����������ʱ��,�ű����ᱻһ��SIGKILL�ź���ֹ,֮������ִ�С�

#֪ͨ�ͽű�:��sentinel���κξ��漶����¼�����ʱ(����˵redisʵ��������ʧЧ�Ϳ�ʧЧ�ȵ�),����ȥ��������ű�,

#��ʱ����ű�Ӧ��ͨ���ʼ�,SMS�ȷ�ʽȥ֪ͨϵͳ����Ա����ϵͳ���������е���Ϣ�����øýű�ʱ,�������ű���������,

#һ�����¼�������,

#һ�����¼���������

#���sentinel.conf�����ļ�������������ű�·��,��ô���뱣֤����ű����������·��,�����ǿ�ִ�е�,����sentinel�����������ɹ���

#֪ͨ�ű�

# sentinel notification-script <master-name> <script-path>

sentinel notification-script mymaster /var/redis/notify.sh

# �ͻ��������������ڵ�����ű�

# ��һ��master����failover�������ı�ʱ,����ű����ᱻ����,֪ͨ��صĿͻ��˹���master��ַ�Ѿ������ı����Ϣ��

# ���²��������ڵ��ýű�ʱ�����ű�:

# <master-name> <role> <state> <from-ip> <from-port> <to-ip> <to-port>

# Ŀǰ<state>���ǡ�failover��,

# <role>�ǡ�leader�����ߡ�observer���е�һ����

# ���� from-ip, from-port, to-ip, to-port�������;ɵ�master���µ�master(���ɵ�slave)ͨ�ŵ�

# ����ű�Ӧ����ͨ�õ�,�ܱ���ε���,��������Եġ�

# sentinel client-reconfig-script <master-name> <script-path>

sentinel client-reconfig-script mymaster /var/redis/reconfig.sh

Redis���洩��ѩ��

Redis�����ʹ��,�����������Ӧ�ó�������ܺ�Ч��,�ر������ݲ�ѯ���档��ͬʱ,��Ҳ������һЩ���⡣����,��Ҫ��������,�������ݵ�һ��������,���ϸ������Ͻ�,��������⡣��������ݵ�һ����Ҫ��ܸ�,��ô�Ͳ���ʹ�û��档

�����һЩ�����������,���洩������ѩ���ͻ��������Ŀǰ,ҵ��Ҳ���бȽ����еĽ��������

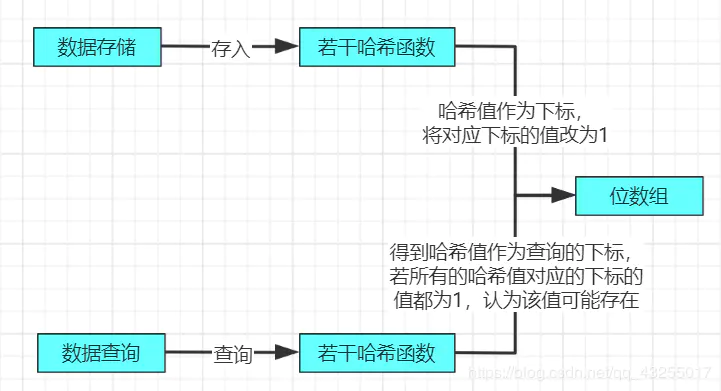

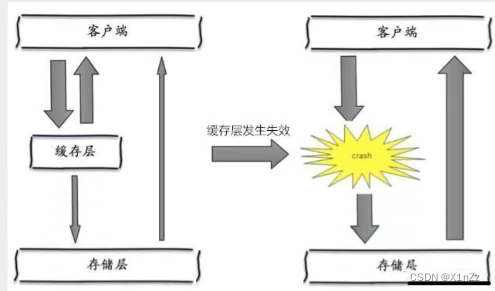

���洩

����

���洩�ĸ���ܼ�,�û���Ҫ��ѯһ������,����redis�ڴ����ݿ�û��,Ҳ���ǻ���û������,������־ò����ݿ��ѯ������Ҳû��,���DZ��β�ѯʧ�ܡ����û��ܶ��ʱ��,���涼û������,���Ƕ�ȥ�����˳־ò����ݿ⡣�����־ò����ݿ���ɺܴ��ѹ��,��ʱ����൱�ڳ����˻��洩��

�������

��¡������

��¡��������һ�����ݽṹ,�����п��ܲ�ѯ�IJ�����hash��ʽ�洢,�ڿ��Ʋ��Ƚ���У��,����������,�Ӷ������˶Եײ�洢ϵͳ�IJ�ѯѹ��;

����ն���

���洢�㲻���к�,��ʹ���صĿն���Ҳ���仺������,ͬʱ������һ������ʱ��,֮���ٷ���������ݽ���ӻ����л�ȡ,�����˺������Դ�r

�������ַ����������������:

1�������ֵ�ܹ�����������,�����ζ�Ż�����Ҫ����Ŀռ�洢����ļ�,��Ϊ��п��ܻ��кܶ�Ŀ�ֵ�ļ�;

2����ʹ�Կ�ֵ�����˹���ʱ��,���ǻ���ڻ����ʹ洢������ݻ���һ��ʱ�䴰�ڵIJ�һ��,�������Ҫ����һ���Ե�ҵ�����Ӱ�졣

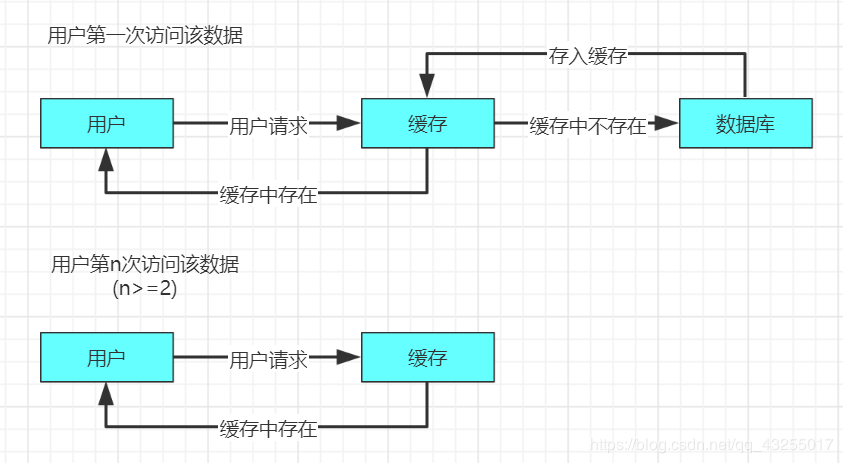

�������

����

������Ҫע��ͻ������������,�������,��ָһ��key�dz��ȵ�,�ڲ�ͣ�Ŀ��Ŵ�,�����ж���һ������з���,�����key��ʧЧ��˲��,�����Ĵ��ʹ��ƻ���,ֱ���������ݿ�,������һ���������俪��һ������

��ij��key�ڹ��ڵ�˲��,�д�������������,��������һ�����ȵ�����,���ڻ������,��ͬʱ�������ݿ�����ѯ�������ݩo���һ�д����,�ᵼʹ���ݿ�˲��ѹ������

�������

�����ȵ�������������

�ӻ����������,û�����ù���ʱ��,���Բ�������ȵ� key���ں���������⡣

�ӻ�����

�ֲ�ʽ����ʹ�÷ֲ�ʽ��,��֤����ÿ��keyͬʱֻ��һ���߳�ȥ��ѯ��˷���,�����߳�û�л�÷ֲ�ʽ����Ȩ��,���ֻ��Ҫ�ȴ����ɡ����ַ�ʽ���߲�����ѹ��ת�Ƶ��˷ֲ�ʽ��,��˶Էֲ�ʽ���Ŀ���ܴ�

����ѩ��

����

����ѩ��,��ָ��ijһ��ʱ���,���漯�й���ʧЧ��

����ѩ����ԭ��֮һ,������д���ĵ�ʱ��,���Ͼ�Ҫ��˫ʮ�����,�ܿ�ͻ�ӭ��һ������,�Ⲩ��Ʒʱ��Ƚϼ��еķ����˻���,���軺��һ��Сʱ����ô�����賿һ���ӵ�ʱ��,������Ʒ�Ļ���Ͷ������ˡ�����������Ʒ�ķ��ʲ�ѯ,���䵽�����ݿ���,�������ݿ����,�ͻ���������Ե�ѹ�����塣�������е�����ﵽ�洢��,�洢��ĵ������ᱩ��,��ɴ洢��Ҳ��ҵ��������

��ʵ���й���,�����Ƿdz�����,�Ƚ������Ļ���ѩ��,�ǻ���������˸��ڵ�崻����������Ϊ��Ȼ�γɵĻ���ѩ��,һ������ij��ʱ��μ��д�������,���ʱ��,���ݿ�Ҳ�ǿ��Զ�סѹ���ġ��Ǿ��Ƕ����ݿ���������Ե�ѹ�����ѡ����������ڵ��崻�,�����ݿ��������ɵ�ѹ���Dz���Ԥ֪��,���п���˲��Ͱ����ݿ�ѹ�塣

�������

redis�߿���

���˼��ĺ�����,��Ȼredis�п��ܹҵ�,���Ҷ����輸̨redis,����һ̨�ҵ�֮�������Ļ����Լ�������,��ʵ���Ǵ�ļ�Ⱥ��

��������

������������˼����,�ڻ���ʧЧ��,ͨ���������߶��������ƶ����ݿ�д������߳������������ij��keyֻ����һ���̲߳�ѯ���ݺ�д����,�����̵߳ȴ���

����Ԥ��

���ݼ��ȵĺ����������ʽ����֮ǰ,���Ȱѿ��ܵ�������Ԥ�ȷ���һ��,�������ֿ��ܴ������ʵ����ݾͻ���ص������С��ڼ�������������ǰ�ֶ��������ػ��治ͬ��key,���ò�ͬ�Ĺ���ʱ��,�û���ʧЧ��ʱ��㾡�����ȡ�

Java����С��,����Ϊ����Redisѧϰ��¼,����Ϊ������ѧϰ,��������!