Maxwell ����

1.1 Maxwell ����

? Maxwell �������� Zendesk ��Դ,�� Java ��д�� MySQL ʵʱץȡ������ ʵʱ��ȡ

MySQL ��������־ Binlog,������ JSON ��ʽ����Ϣ,��Ϊ�����߷��� Kafka,Kinesis��

RabbitMQ��Redis��Google Cloud Pub/Sub���ļ�������ƽ̨��Ӧ�ó���

������ַ:http://maxwells-daemon.io/

1.2 Maxwell����ԭ��

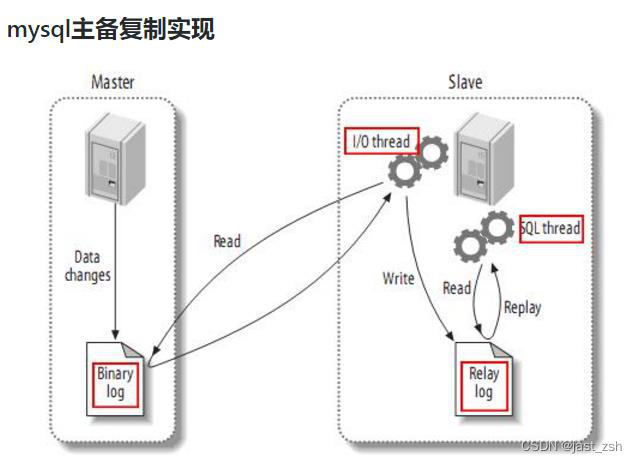

1.2.1 MySQL���Ӹ��ƹ���

-

Master ���⽫�ı��¼,д����������־(binary log)��

-

Slave �ӿ��� mysql master ���� dump Э��,�� master ����� binary log events ����

�������м���־(relay log);

- Slave �ӿ��ȡ�������м���־�е��¼�,���ı������ͬ�����Լ������ݿ⡣

1.2.2 Maxwell�Ĺ���ԭ��

? Maxwell �Ĺ���ԭ���ܼ�,�������Լ�αװ�� MySQL ��һ�� slave,Ȼ���� slave

�����ݼ�װ�� MySQL(master)�������ݡ�

1.2.3 MySQL �� binlog

-

ʲô�� binlog

? MySQL �Ķ�������־����˵ MySQL ����Ҫ����־��,����¼�����е� DDL �� DML(��

�����ݲ�ѯ���)���,���¼���ʽ��¼,�����������ִ�е����ĵ�ʱ��,MySQL �Ķ���

����־������ȫ�͵ġ�

һ����˵������������־��Ż��� 1%��������ġ�����������������Ҫ��ʹ�ó���:

- ��һ:MySQL Replication �� Master �˿��� binlog,Master �����Ķ�������־����

�� slaves ���ﵽ master-slave ����һ�µ�Ŀ�ġ�

- ���:��Ȼ�������ݻָ���,ͨ��ʹ�� mysqlbinlog ������ʹ�ָ����ݡ�

��������־���������ļ�:��������־�����ļ�(�ļ�����Ϊ.index)���ڼ�¼����

�Ķ������ļ�,��������־�ļ�(�ļ�����Ϊ.00000*)��¼���ݿ����е� DDL �� DML(��

�����ݲ�ѯ���)����¼���

-

binlog �Ŀ���

-

�ҵ� MySQL �����ļ���λ��

-

Linux: /etc/my.cnf

���/etc Ŀ¼��û��,����ͨ�� locate my.cnf ����λ��

-

Windows: \my.ini

�� mysql �������ļ���,������

��[mysqld] ����,����/���� log-bin=mysql-bin

�����ʾ binlog ��־��ǰ�� mysql-bin,�Ժ����ɵ���־�ļ����� mysql-bin.000001

���ļ���������ְ�˳������,ÿ�� mysql �������ߵ��ﵥ���ļ���С����ֵʱ,����һ��

�ļ�,��˳���š�

-

-

binlog �ķ�������

mysql binlog �ĸ�ʽ������,�ֱ��� STATEMENT,MIXED,ROW��

�������ļ��п���ѡ������ binlog_format= statement|mixed|row

-

���ָ�ʽ������:

-

statement

��伶,binlog ���¼ÿ��һִ��д��������䡣

��� row ģʽ��ʡ�ռ�,���ǿ��ܲ�����һ����,����

update test set create_date=now();

����� binlog ��־���лָ�,����ִ��ʱ�䲻ͬ���ܲ��������ݾͲ�ͬ��

�ŵ�: ��ʡ�ռ�

ȱ��: �п���������ݲ�һ�¡�

-

row

�м�, binlog ���¼ÿ�β�����ÿ�м�¼�ı仯��

�ŵ�:�������ݵľ���һ���ԡ���Ϊ���� sql ��ʲô,������ʲô����,��ֻ��¼

ִ�к��Ч����

ȱ��:ռ�ýϴ�ռ䡣

-

mixed

��ϼ���,statement ��������,һ���̶��Ͻ���� statement ģʽ��ΪһЩ���

����ɵ����ݲ�һ�����⡣

Ĭ�ϻ��� statement,��ijЩ�����,Ʃ��:

�������а��� UUID() ʱ;

���� AUTO_INCREMENT �ֶεı�������ʱ;

ִ�� INSERT DELAYED ���ʱ;

�� UDF ʱ;

�ᰴ�� ROW �ķ�ʽ���д���

�ŵ�:��ʡ�ռ�,ͬʱ�����һ����һ���ԡ�

ȱ��:����Щ������������ɻ���ɲ�һ��,���� statement �� mixed ������Ҫ��

binlog ��ص�����������㡣

-

�ۺ�����Ա�,Maxwell ������ط���,ѡ�� row ��ʽ�ȽϺ���

-

-

1.3 Maxwell��Canal�ĶԱ�

| �Ա� | Canal | Maxwell |

|---|---|---|

| ���� | java | Java |

| ���ݸ�ʽ | ��ʽ���� | json |

| ���ݲɼ�ģʽ | ���� | ����/ȫ�� |

| ������� | ���� | ֧��Kafka�ȶ���ƽ̨ |

| HA | ֧�� | ֧�� |

Maxwellʹ��

2.1 Maxwell��װ

2.1.1 ��װ��ַ

Maxwell ������ַ:http://maxwells-daemon.io/

�ĵ���ַ:https://maxwells-daemon.io/quickstart/

2.1.2 ��װ����

-

��������ѡ��1.29.2�汾���н���,�ð汾ʹ��jdk1.8�汾,֮��Ķ���11

-

�ϴ� maxwell-1.29.2.tar.gz ��/opt/software ��

-

��ѹ maxwell-1.29.2.tar.gz �İ�װ����/opt/module ��

[atguigu@hadoop102 software]$ tar -zxvf maxwell-1.29.2.tar.gz - C /opt/module/

2.1.3 MySQL������

-

�� mysql �������ļ�,���� MySQL Binlog ����

atguigu@hadoop102 software]$ sudo vim /etc/my.cnf ��[mysqld]ģ��������һ������ [mysqld] server_id=1 log-bin=mysql-bin binlog_format=row #���ö�����ݿ���,����ʹ�ö��ŷָ�,���ƶ��м��� #binlog-do-db=test_maxwell ������ Mysql ���� [atguigu@hadoop102 software]$ sudo systemctl restart mysqld ��¼ mysql ���鿴�Ƿ������ [atguigu@hadoop102 ~]$ mysql -uroot -p123456 mysql> show variables like '%binlog%'; �鿴�������� binlog_format | ROW -

����/var/lib/mysql Ŀ¼,�鿴 MySQL ���ɵ� binlog �ļ�

[atguigu@hadoop102 ~]$ cd /var/lib/mysql [atguigu@hadoop102 mysql]$ sudo ls -l ������ 188500 -rw-r-----. 1 mysql mysql 154 11 �� 17 16:30 mysqlbin.000001 -rw-r-----. 1 mysql mysql 19 11 �� 17 16:30 mysqlbin.indexע:MySQL ���ɵ� binlog �ļ���ʼ��Сһ���� 154 �ֽ�,Ȼ��ǰ�� log-bin ������

�õ�,����Ĭ�ϴ�.000001,Ȼ�����ε��������� binlog �ļ��ļ�����,MySQL �������

����һ��.index �����ļ�������¼��ǰʹ�õ� binlog �ļ���

2.1.4 ��ʼ��MaxwellԪ���ݿ�

-

�� MySQL �н���һ�� maxwell �����ڴ洢 Maxwell ��Ԫ����

[atguigu@hadoop102 module]$ mysql -uroot -p123456 mysql> CREATE DATABASE maxwell; -

���� mysql �û����밲ȫ����

mysql> set global validate_password_length=4; mysql> set global validate_password_policy=0; -

����һ���˺ſ��Բ��������ݿ�

mysql> GRANT ALL ON maxwell.* TO 'maxwell'@'%' IDENTIFIED BY '123456'; -

��������˺ſ��Լ���������ݿ��Ȩ��

mysql> GRANT SELECT ,REPLICATION SLAVE , REPLICATION CLIENT ON *.* TO maxwell@'%'; -

ˢ�� mysql ��Ȩ��

mysql> flush privileges;

MySQL 8

#�����˻� create user 'root'@'172.16.10.203' identified by 'password' #����Ȩ��,with grant option���ѡ���ʾ���û����Խ��Լ�ӵ�е�Ȩ����Ȩ������ grant all privileges on *.* to 'root'@'172.16.10.203' with grant option #������&��Ȩ���û�,flush privileges ������ϵ������ǽ���ǰuser��privilige���е��û���Ϣ/Ȩ�����ô�mysql��(MySQL���ݿ�����ÿ�)����ȡ���ڴ��� flush privileges; ------- CREATE DATABASE maxwell; create user 'maxwell'@'%' identified by '123456' grant all privileges on *.* to 'maxwell'@'%' with grant option flush privileges;

2.1.5 Maxwell��������

Maxwell ����������ʽ����������:

ʹ�������в������� Maxwell ����

[atguigu@hadoop102 maxwell-1.29.2]$ bin/maxwell --

user='maxwell' --password='123456' --host='hadoop102' --

producer=stdout

�Cuser ���� mysql ���û�

�Cpassword ���� mysql ���û�������

�Chost mysql ��װ��������/IP

�Cproducer ������ģʽ(stdout:����̨ kafka:kafka ��Ⱥ)

�������ļ�,���ƻ����� Maxwell ����

[atguigu@hadoop102 maxwell-1.29.2]$ cp

config.properties.example config.properties

[atguigu@hadoop102 maxwell-1.29.2]$ vim config.properties

[atguigu@hadoop102 maxwell-1.29.2]$ bin/maxwell --

config ./config.properties

2.2 Maxwell������

2.2.1 ��� Mysql ���ݲ��ڿ���̨��ӡ

-

���� maxwell ����� mysql ���ݸ���

[atguigu@hadoop102 maxwell-1.29.2]$ bin/maxwell -- user='maxwell' --password='123456' --host='hadoop102' -- producer=stdout -

�� mysql �� test_maxwell ��� test ������һ������,�鿴 maxwell �Ŀ���̨���

mysql> insert into test values(1,'aaa'); { "database": "test_maxwell", --���� "table": "test", --���� "type": "insert", --���ݸ������� "ts": 1637244821, --����ʱ�� "xid": 8714, --���� id "commit": true, --�ύ�ɹ� "data": { --���� "id": 1, "name": "aaa" } } -

�� mysql �� test_maxwell ��� test ��ͬʱ���� 3 ������,����̨������ 3 �� json

��־,˵�� maxwell ����������Ϊ��λ������־�IJɼ��ġ�

mysql> INSERT INTO test VALUES(2,'bbb'),(3,'ccc'),(4,'ddd'); {"database":"test_maxwell","table":"test","type":"insert","ts" :1637245127,"xid":9129,"xoffset":0,"data":{"id":2,"name":"bbb" }} {"database":"test_maxwell","table":"test","type":"insert","ts" :1637245127,"xid":9129,"xoffset":1,"data":{"id":3,"name":"ccc" }} {"database":"test_maxwell","table":"test","type":"insert","ts" :1637245127,"xid":9129,"commit":true,"data":{"id":4,"name":"dd d"}} mysql> update test set name='zaijian' where id =1; {"database":"test_maxwell","table":"test","type":"update","ts" :1631618614,"xid":535,"commit":true,"data":{"id":1,"name":"zai jian"},"old":{"name":"nihao"}} -

�� test_maxwell ��� test ����һ������,�鿴 maxwell �Ŀ���̨���

mysql> update test set name='abc' where id =1; { "database": "test_maxwell", "table": "test", "type": "update", "ts": 1637245338, "xid": 9418, "commit": true, "data": { --�ĺ������ "id": 1, "name": "abc" }, "old": { --��ǰ������ "name": "aaa" } } -

ɾ�� test_maxwell ��� test ����һ������,�鿴 maxwell �Ŀ���̨���

mysql> DELETE FROM test WHERE id =1; { "database": "test_maxwell", "table": "test", "type": "delete", "ts": 1637245630, "xid": 9816, "commit": true, "data": { "id": 1, "name": "abc" } }

2.2.2 ��� Mysql ��������� kafka

ʵ�ֲ���

-

���� zookeeper �� kafka

[atguigu@hadoop102 bin]$ jpsall =============== hadoop102 =============== 3511 QuorumPeerMain 4127 Kafka =============== hadoop103 =============== 1885 Kafka 1342 QuorumPeerMain =============== hadoop104 =============== 1345 QuorumPeerMain 1886 Kafka -

���� Maxwell ��� binlog

atguigu@hadoop102 maxwell-1.29.2]$ bin/maxwell --user='maxwell' --password='123456' --host='hadoop102' --producer=kafka -- kafka.bootstrap.servers=hadoop102:9092 --kafka_topic=maxwell -

�� kafka �Ŀ���̨������������ maxwell ����

[atguigu@hadoop102 ~]$ kafka-console-consumer.sh --bootstrapserver hadoop102:9092 --topic maxwell (4)�� test_maxwell ��� test ���ٴβ���һ������ -

�� test_maxwell ��� test ���ٴβ���һ������

mysql> insert into test values (5,'eee'); -

ͨ�� kafka ���������鿴��������,˵�����ݳɹ����� kafka

{"database":"test_maxwell","table":"test","type":"insert","ts" :1637245889,"xid":10155,"commit":true,"data":{"id":5,"name":"e ee"}}

kafka �������ݵķ�������

? �ڹ�˾����������,����һ�㶼���� maxwell ��ض�� mysql �������,Ȼ����

Щ���ݷ��� kafka ��һ������ Topic,�����������Ҳ�϶��Ƕ������,Ϊ����߲����ȡ�

��ô��ο�����Щ���ݵķ�������,�ͱ��������Ҫ,ʵ�ֲ�������:

-

�� maxwell �������ļ�,���ƻ����� maxwell ����

[atguigu@hadoop102 maxwell-1.29.2]$ vim config.properties # tl;dr config log_level=info producer=kafka kafka.bootstrap.servers=hadoop102:9092 # mysql login info host=hadoop102 user=maxwell password=123456 # *** kafka *** # list of kafka brokers #kafka.bootstrap.servers=hosta:9092,hostb:9092 # kafka topic to write to # this can be static, e.g. 'maxwell', or dynamic, e.g. namespace_%{database}_%{table} # in the latter case 'database' and 'table' will be replaced with the values for the row being processed kafka_topic=maxwell3 # *** partitioning *** # What part of the data do we partition by? #producer_partition_by=database # [database, table, primary_key, transaction_id, column] producer_partition_by=database �������ݷ���ģʽ,��ѡģʽ�� ����,����,����,���� # specify what fields to partition by when using producer_partition_by=column # column separated list. #producer_partition_columns=name # when using producer_partition_by=column, partition by this when # the specified column(s) don't exist. #producer_partition_by_fallback=database -

�ֶ�����һ�� 3 �������� topic,���־ͽ��� maxwell3

[atguigu@hadoop102 maxwell-1.29.2]$ kafka-topics.sh --zookeeper hadoop102:2181,hadoop103:2181,hadoop104:2181/kafka --create -- replication-factor 2 --partitions 3 --topic maxwell3 -

���������ļ����� Maxwell ����

[atguigu@hadoop102 maxwell-1.29.2]$ bin/maxwell -- config ./config.properties -

�� test_maxwell ��� test ���ٴβ���һ������

mysql> insert into test_maxwell.test values (6,'fff'); -

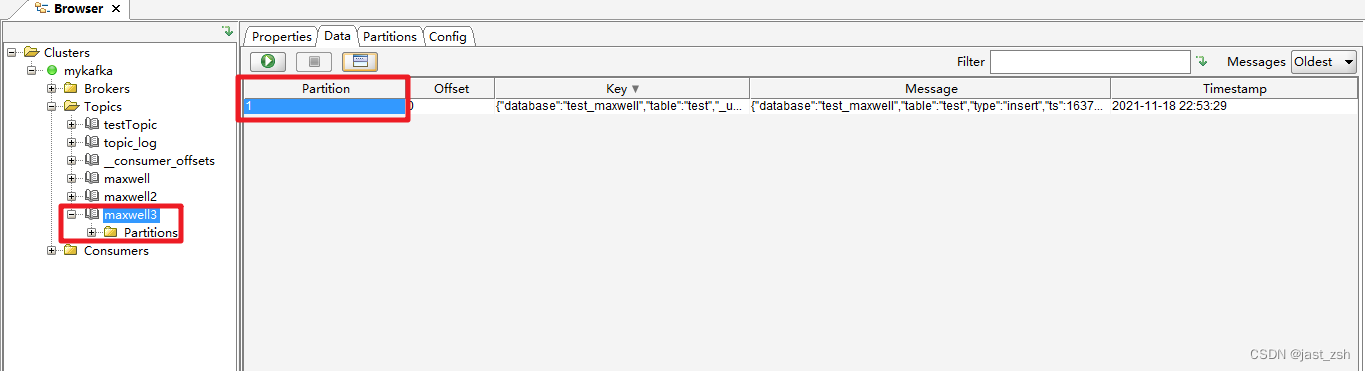

ͨ�� kafka tool ���߲鿴,�������ݽ����� maxwell3 ����� 1 �ŷ���

-

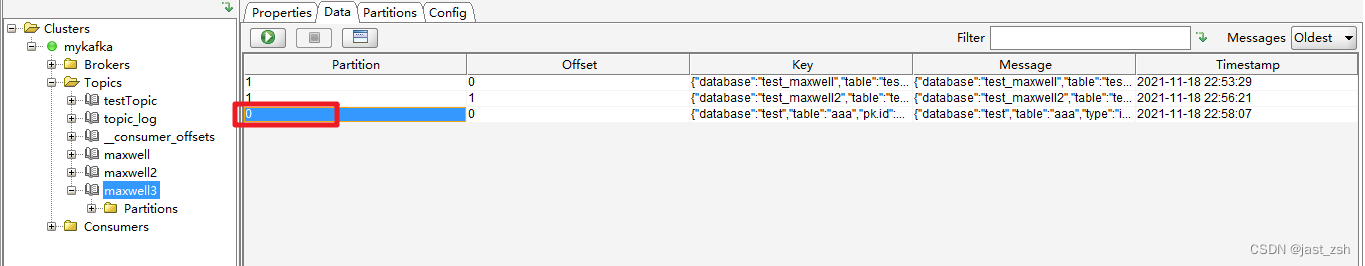

�� test ��� aaa ������һ������

mysql> insert into test_maxwell2.test values (23,'dd'); -

ͨ�� kafka tool ���߲鿴,�������ݽ����� maxwell3 ����� 0 �ŷ���,˵������

������ݽ���ķ������Ӱ�졣

2.2.3 ��� Mysql ָ���������������̨

-

���� maxwell ����� mysql ָ�������ݸ���

[atguigu@hadoop102 maxwell-1.29.2]$ bin/maxwell -- user='maxwell' --password='123456' --host='hadoop102' --filter 'exclude: *.*, include:test_maxwell.test' --producer=stdout -

�� test_maxwell.test ������һ������,�鿴 maxwell �ļ��

mysql> insert into test_maxwell.test values(7,'ggg'); {"database":"test_maxwell","table":"test","type":"insert","ts" :1637247760,"xid":11818,"commit":true,"data":{"id":7,"name":"g gg"}} -

�� test_maxwell.test2 ������һ������,�鿴 maxwell �ļ��

mysql> insert into test1 values(1,'nihao'); ����û���յ��κ���Ϣ ˵�� include ������Ч,ֻ�ܼ��ָ���� mysql ������Ϣע:���������� include:test_maxwell.*,ͨ�����ַ�ʽ����� mysql ij���������

��,Ҳ����˵���������⡣���߿������в��ԡ�

2.2.4 ��� Mysql ָ����ȫ�������������̨,���ݳ�ʼ��

? Maxwell ����Ĭ��ֻ�ܼ�� mysql �� binlog ��־���������仯������,����Maxwell ��֧�����ݳ�ʼ����,����ͨ���� Maxwell ��Ԫ����,���� MySQL ��ij�ű��������ݳ�ʼ��,Ҳ�������dz�˵��ȫ��ͬ�������������������:

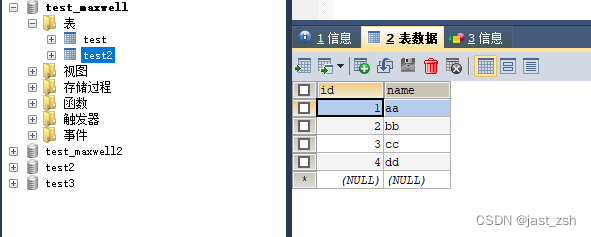

����:�� test_maxwell ���µ� test2 ������������,ȫ�����뵽 maxwell ����̨���д�ӡ��

-

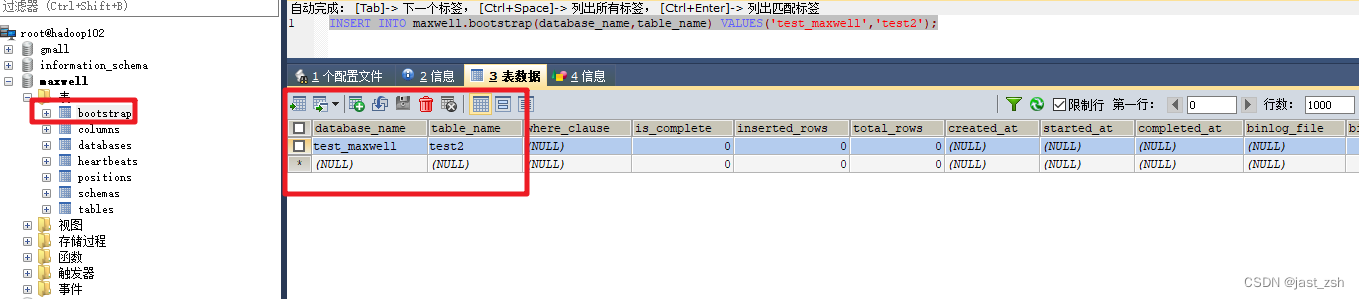

�� Maxwell ��Ԫ����,�������ݳ�ʼ������,�� mysql �� maxwell ���� bootstrap���в���һ������,д����Ҫȫ�����ݵĿ����ͱ�����

mysql> insert into maxwell.bootstrap(database_name,table_name) values('test_maxwell','test2');

-

���� maxwell ����,��ʱ��ʼ�������ֱ�Ӵ�ӡ test2 ������������

[atguigu@hadoop102 maxwell-1.29.2]$ bin/maxwell -- user='maxwell' --password='123456' --host='hadoop102' -- producer=stdout Using kafka version: 1.0.0 23:15:38,841 WARN MaxwellMetrics - Metrics will not be exposed: metricsReportingType not configured. 23:15:39,110 INFO Maxwell - Maxwell v1.22.0 is booting (StdoutProducer), starting at Position[BinlogPosition[mysqlbin.000004:611096], lastHeartbeat=1637248429242] 23:15:39,194 INFO MysqlSavedSchema - Restoring schema id 6 (last modified at Position[BinlogPosition[mysqlbin.000004:517625], lastHeartbeat=1637246435111]) 23:15:39,299 INFO MysqlSavedSchema - Restoring schema id 1 (last modified at Position[BinlogPosition[mysqlbin.000004:158612], lastHeartbeat=0]) 23:15:39,342 INFO MysqlSavedSchema - beginning to play deltas... 23:15:39,343 INFO MysqlSavedSchema - played 5 deltas in 1ms {"database":"test_maxwell","table":"test2","type":"bootstrapstart","ts":1637248539,"data":{}} 23:15:39,367 INFO SynchronousBootstrapper - bootstrapping started for test_maxwell.test2 23:15:39,369 INFO BinlogConnectorReplicator - Setting initial binlog pos to: mysql-bin.000004:611096 {"database":"test_maxwell","table":"test2","type":"bootstrapinsert","ts":1637248539,"data":{"id":1,"name":"aa"}} {"database":"test_maxwell","table":"test2","type":"bootstrapinsert","ts":1637248539,"data":{"id":2,"name":"bb"}} {"database":"test_maxwell","table":"test2","type":"bootstrapinsert","ts":1637248539,"data":{"id":3,"name":"cc"}} {"database":"test_maxwell","table":"test2","type":"bootstrapinsert","ts":1637248539,"data":{"id":4,"name":"dd"}} {"database":"test_maxwell","table":"test2","type":"bootstrapcomplete","ts":1637248539,"data":{}} 23:15:39,387 INFO SynchronousBootstrapper - bootstrapping ended for #8 test_maxwell.test2 23:15:39,465 INFO BinaryLogClient - Connected to hadoop102:3306 at mysql-bin.000004/611096 (sid:6379, cid:108) 23:15:39,465 INFO BinlogConnectorLifecycleListener - Binlog connected. -

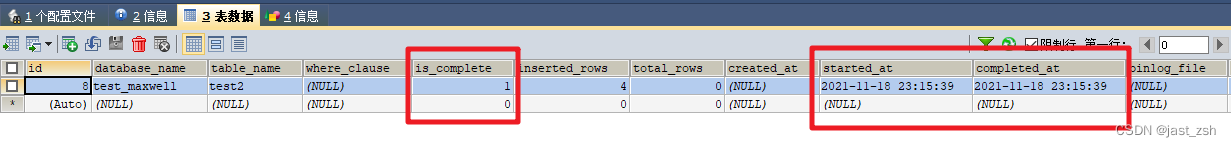

������ȫ����ʼ������Ժ�,Maxwell ��Ԫ���ݻ�仯

is_complete �ֶδ� 0 ��Ϊ 1

start_at �ֶδ� null ��Ϊ����ʱ��(����ͬ����ʼʱ��)

complete_at �ֶδ� null ��Ϊ����ʱ��(����ͬ������ʱ��)