����Ŀ¼

ϵ������

����ѧϰ�㷨 01 ���� K-�����㷨(���ݼ����֡���һ��������)

����ѧϰ�㷨 02 ���� ���Իع��㷨(���淽�̡��ݶ��½���ģ�ͱ���)

����ѧϰ�㷨 03 ���� ���ع��㷨(��ȷ�ʺ��ٻ��ʡ�ROC���ߺ�AUCָ�ꡢ��������Ƿ����)

����ѧϰ�㷨 04 ���� ������(ID3��C4.5��CART,��֦,������ȡ,�ع������)

������

ѧϰĿ��:

- ���վ�����ʵ�ֹ���

- ֪����Ϣ�صĹ�ʽ�Լ���?

- ֪����Ϣ���桢��Ϣ�����ʺͻ���ָ������?

- ֪��ID3,C4.5,Cart�㷨������

- �˽�cart��֦����?

- ֪��������ȡ����?

- Ӧ?DecisionTreeClassifierʵ�־���������

??

?

1 �������㷨���

������˼�����Դ?������,��������е�if-else�ṹ�������ھ����������ָ����ݵ�?�ַ���ѧϰ?����

- ��?�����νṹ,������?���ɶ���жϽڵ���ɵ���

- ����ÿ���ڲ��ڵ��ʾ?�������ϵ��ж�

- ÿ����?����?���жϽ�������

- ���ÿ��Ҷ�ڵ����?�ַ�����

��һ��������˵��:

Ϊʲô���??�������������?�����ж���?��ΪŮ�����������ѵ�����������Ҫ��,����??ͨ�����Ե�������ʶ�����ľ��á���ô�����Ҫ����?���̽�?����,����δ�����? ��ʱ��Ҫ?����Ϣ���е�֪ʶ:��Ϣ��,��Ϣ���档

?

?

2 �����������ԭ��

��˵��ԭ��ǰ,��Ҫ���˽�һЩ�����������Ļ�������,���Ǵ��㷨�ĽǶ���˵��,���ѡ���֧�ڵ㡣

2.1 ��Ϣ��

������ѧ��,���DZ�ʾ�����ҡ��ij̶ȡ�һ��ϵͳԽ����,��ֵԽ��;ϵͳԽ���һ��߷�ɢ,��ֵԽ�ߡ�

1948��,��ũ����ˡ���Ϣ�ء��ĸ������Ϣ�ء��Ƕ����������ϴ�����õ�һ��ָ�ꡣ����Ϣ�����ԽǶ���˵,��ϵͳ������״̬һ��ʱ,����Խ���еĵط�,��ֵԽС,����Խ��ɢ�ĵط�,��ֵԽ��

��Ϣ�صļ��㹫ʽ:

E

n

t

(

D

)

=

?

��

k

=

1

n

C

k

D

log

?

2

C

k

D

=

?

��

k

=

1

n

p

k

log

?

2

p

k

=

?

p

1

log

?

2

p

1

?

p

2

log

?

2

p

2

.

.

.

?

p

n

l

o

g

2

p

n

Ent(D)=-\sum\limits_{k=1}^n \frac{C^k}{D} \log_2 \frac{C^k}{D}=-\sum\limits_{k=1}^n p_k \log_2 p_k=-p_1\log_2p_1 -p_2\log_2p_2...-p_nlog_2p_n

Ent(D)=?k=1��n?DCk?log2?DCk?=?k=1��n?pk?log2?pk?=?p1?log2?p1??p2?log2?p2?...?pn?log2?pn?

����,D��������������,

C

k

C^k

Ck?�ǵ�K������������,

p

k

p_k

pk?����������D�е�K��������ռ������Ent(D)ԽС,��D�Ĵ���Խ�ߡ�

�������������:

-

����������16�����,ÿ����ӻ�ùھ��ĸ�����ͬ,��������Ҫ�¼��β���ȷ�³���ӻ��ùھ�?

ͨ�������������ö��ַ�,�Ȳ¹ھ��Ƿ���1-8�ż�,����Ǿͼ������Ƿ���1-4֮��,��������,����ֻ��Ҫ��4��,��ô��Ϣ�ؾ���4��

���ͨ�����湫ʽ���м���: E n t ( D ) = 16 ? ( ? 1 16 log ? 2 1 16 ) = 4 Ent(D)=16\cdot(-\frac{1}{16} \log_2 \frac{1}{16})=4 Ent(D)=16?(?161?log2?161?)=4?

-

������4�������,���ǻ�ʤ�ĸ��ʷֱ���{1/2, 1/4, 1/8, 1/8},���ݹ�ʽ�����Ϣ�ء�

?

?

2.2 �������������ݡ���Ϣ����(ID3)

��Ϣ����:��ij�������������ݼ�ǰ���صIJ�ֵ��

�����ؿ��Ա�ʾ�������ϵIJ�ȷ����,��Խ��,�����IJ�ȷ���Ծ�Խ�����,���ǿ���ͨ��������ij���������������ݼ�֮ǰ���غ�֮����صIJ�ֵ,���ж���������������ݼ���Ч����

����,ij������a����ɢ����,��V������ȡֵ: a 1 , a 2 , . . . , a V a^1,a^2,...,a^V a1,a2,...,aV??????,����������a�����л���,�Ϳ��ܲ���V����֧�ڵ�,���ǵ���ͬ�ķ�֧�ڵ����������ͬ,����ÿ����֧�ڵ��Ȩ��Ϊ �O D v D �O \mid \frac{D^v}{D} \mid �ODDv?�O?��

�����Ϣ����Ĺ�ʽΪ:

G

a

i

n

(

D

,

a

)

=

E

n

t

(

D

)

?

E

n

t

(

D

�O

a

)

=

E

n

t

(

D

)

?

��

v

=

1

V

D

v

D

E

n

t

(

D

v

)

Gain(D, a)=Ent(D)-Ent(D|a)=Ent(D)- \sum\limits_{v=1}^V \frac{D^v}{D} Ent(D^v)

Gain(D,a)=Ent(D)?Ent(D�Oa)=Ent(D)?v=1��V?DDv?Ent(Dv)

����,

G

a

i

n

(

D

,

a

)

Gain(D,a)

Gain(D,a)��ʾ����a�����ݼ�D����Ϣ����,

E

n

t

(

D

)

Ent(D)

Ent(D)?��ʾ���ݼ�D����Ϣ��,

E

n

t

(

D

�O

a

)

Ent(D|a)

Ent(D�Oa)��ʾ��������a������D����Ϣ������,

D

v

D^v

Dv?������a�е�v����֧�ڵ������������,

E

n

t

(

D

v

)

Ent(D^v)

Ent(Dv)?��ʾ���ݼ�D�е�v����֧�ڵ������������Ϣ�ء�

һ�����,��Ϣ����Խ��,��ζ��ʹ������a�����л�������õġ�����������Խ��,������ID3������ѧϰ�㷨��������Ϣ����Ϊ��ġ�

?

������ô����ʽ���Ǻ�������,����ٸ�����������˵����

��������������(��ͼ,��š��Ա𡢻�Ծ�ȡ��û��Ƿ���ʧ),�ұ�ͳ��ͼ(positive��ʾ������,�û�����ʧ,negative������,�û�δ��ʧ)������������֪��,�Ա�ͻ�Ծ�������������ĸ����û���ʧ��Ӱ�����

?

-

����������Ϣ��:

-

���������Ϣ��-�Ա�:

-

������Ϣ����-�Ա�:

-

���������Ϣ��-��Ծ��:

-

������Ϣ����-��Ծ��:

-

�ó�����:��Ծ�ȵ���Ϣ����ԶԶ�����Ա�,˵����Ծ�ȶ��û���ʧ��Ӱ����Ա����������ѡ��������ݷ���ʱ,�����ص㿼���Ծ�����ָ�ꡣ

?

?

2.3 �������������ݡ���Ϣ������(C4.5)

��ǰ��һ����ʵ���ǹ�������ˡ���š���һ��,����Ա��Ҳ���м���,���Եó�����Ϣ����Ϊ0.9182,Զ���ڻ�Ծ��,������Ȼ���ǻ������ݼ�������ѡ���š�

ʵ����,��Ϣ������Կ�ȡֵ��?�϶����������ƫ��(�����),Ϊ��������ƫ�ÿ��ܴ����IJ���Ӱ��,��Ҳ�� C4.5 �������㷨����ȡ�ġ�

��Ϣ������:��������?ǰ?����Ϣ���������a��Ӧ��**������ֵ��(intrinsic value) ��?ֵ����ͬ����ġ�

G

a

i

n

_

r

a

t

i

o

(

D

,

a

)

=

G

a

i

n

(

D

,

a

)

I

V

(

a

)

,

��

��

I

V

(

a

)

=

?

��

v

=

1

V

D

v

D

log

?

2

D

v

D

Gain\_ratio(D, a) = \frac{Gain(D,a)}{IV(a)},����IV(a)=- \sum\limits_{v=1}^V \frac{D^v}{D} \log_2 \frac{D^v}{D}

Gain_ratio(D,a)=IV(a)Gain(D,a)?,����IV(a)=?v=1��V?DDv?log2?DDv?

I

V

(

a

)

IV(a)

IV(a)Ҳ��Ϊ������Ϣ����**,����������ij�����Խ��з���ʱ��֧��������Ϣ�ͳߴ���Ϣ��,���ǰ���Щ��ϢҲ��Ϊ������Ϣ��

������Ϣ������=��Ϣ����/������Ϣ,������Ե���Ϣ������������������Ϣ����??��?(Ҳ����˵,���������Ա�����ȷ���Ծͺ�?,���Ҿ�Խ��������ѡȡ��),�������ǶԵ���?��Ϣ����IJ�����

����a�Ŀ���ȡֵ��ĿԽ��(��VԽ��),�� I V ( a ) IV(a) IV(a)��ֵҲ��Խ��,������Ϣ�����ʾͻ�ԽС,��һ���̶��ϼ����˶Կ�ȡֵ��Ŀ�϶�����Ե�ƫ�á�

ʹ��C4.5�ĺô�:

-

?��Ϣ��������ѡ������:�˷���?��Ϣ������ѡ������ʱƫ��ѡ��ֵ������ԵIJ�?��

-

��?��?�ֺ��֦?��:��������?��?���Ƶ���?,�������������ݡ�

-

����ȱʧֵ�Ĵ���:

?�ֲ����Ǹ��������n����Ӧ��ѵ��ʵ���и����Ե��?ֵ,����?�ָ����ӵIJ�����Ϊȱʧֵ�����е�ÿ������ֵ����?�����ʡ� ����,����?����������A,������n����6����֪A=1��4��A=0��ʵ��,��ôA(x)=1�ĸ�����0.6,?A(x)=0�ĸ�����0.4������,ʵ��x��60%�����䵽A=1�ķ�?,40%�����䵽��?����?�� C4.5���Dz�ȡ���ַ�ʽ��

�ص���һ�ڵ�����,����֮ǰ��������:

- ���������Ϣ��

- �����Ա����Ե���Ϣ��(�Ա𡢻�Ծ��)

- �����Ծ�ȵ���Ϣ����(�Ա𡢻�Ծ��)

��������һ������,������Ϣ�����ʡ�

- ���������Ϣ����,�� I V ( a ) IV(a) IV(a)��

-

������Ϣ������

-

�ó�����:��Ծ�ȵ���Ϣ�����ʸ�??Щ,�����ڹ�����������ʱ��,����ѡ��ͨ������?ʽ,��ѡȡ�ڵ�Ĺ�����,���ǿ��Խ���ȡֵ�϶�����Ե�ѡȡƫ�á�

����Դ˻��е�ģ��,���Կ�����ڶ������ӡ�

����ͼ,��?��Ϊ��?,��?��Ϊ�¶�,������Ϊʪ��,������Ϊ?��,���?�иû�Ƿ��?�� ����Ҫ���:������?��������,�ж��ڶ�Ӧ��?��,��Ƿ���??

?

������ĸ����������Խ�������,���Լ���A={ ��?,�¶�,ʪ��,?��}, ����ǩ������,���L={��?,ȡ��}��

����,���ղ�����м�����Ϣ�����ʡ�

- �������(����)��Ϣ��:�����Ϣ�ر�ʾ�������������и��������ֵIJ�ȷ����֮�͡������صĸ���,��Խ?,��ȷ���Ծ�Խ?,��������������Ҫ����Ϣ����Խ�ࡣ

-

����������Ե���Ϣ��:ÿ�����Ե���Ϣ���൱��?�������ء���ʾ������ij�����Ե�������,���������ֵIJ�ȷ����֮�͡����Ե���Ϣ��Խ?,��ʾ���������ӵ�е��������Խ����������

-

������Ϣ����:��Ϣ���� = �� - ������,����?���� �����Ϣ�� - ������Ϣ�ء�����ʾ������Ϣ��ȷ���Լ��ٵij̶ȡ����?�����Ե���Ϣ����Խ?,����ʾ?������Խ�?�������ֿ��Ը��õļ��ٻ��ֺ������IJ�ȷ����,ѡ������ԾͿ��Ը�����õ�������ǵķ���?�ꡣ��Ϣ�������ID3�㷨������ѡ��ָ�ꡣ����������������Ҳ�б����,1-14,����������Ϣ����Ϊ0.940,��Ȼ�������⡿

-

���������Ϣ����:

-

������Ϣ������:�������������б����,1-14,����������Ϣ������Ϊ 0.940 log ? 2 14 �� 0.247 \frac{0.940}{\log_214} \approx 0.247 log2?140.940?��0.247��

-

�ó�����:��?����Ϣ��������?,ѡ����?Ϊ�������ԡ����ַ�����֮��,��?�ǡ�������������,ȫ�ǡ����С�(��ͽ�"��"),����������ΪҶ?�ڵ�,ѡ�������Ľ��������ѡ���ʣ���?��㵱���ظ�����1~5,ֱ�����е�Ҷ?���?��"��"��

while(��ǰ�ڵ�"����"): 1.���㵱ǰ�ڵ�������(�����ȡֵ����) 2.���㵱ǰ�ε�������(��������ȡֵ�ŵ����ȡֵ����) 3.������Ϣ���� 4.����������Եķ�����Ϣ���� 5.����������Ե���Ϣ������ end while ��ǰ������ΪҶ?�ڵ�

?

?

2.4 �������������ݡ�����ֵ�ͻ���ָ��(CART)

CART������ʹ�û���ָ������������,���ݼ� D �Ĵ��ȿ�������ֵ��������

CART��Classification and Regression Tree�ļ��,����?�������ľ�����ѧϰ�㷨,����ͻع�����? ��

�����ݼ�D�������ȡ��������,����ֵ

G

i

n

i

(

D

)

Gini(D)

Gini(D)������������������Dz�?�µĸ��������,����ֵԽ?,���ݼ�D�Ĵ���Խ?��

G

i

n

i

(

D

)

=

��

k

=

1

�O

y

�O

��

k

��

��

k

p

k

p

k

��

=

1

?

��

k

=

1

�O

y

�O

p

k

2

Gini(D)= \sum\limits_{k=1}^{|y|} \sum\limits_{k'\neq k}p_kp_{k'}=1 - \sum\limits_{k=1}^{|y|}p^2_k

Gini(D)=k=1���Oy�O?k����?=k��?pk?pk��?=1?k=1���Oy�O?pk2?

����,

p

k

=

D

k

D

p_k=\frac{D^k}{D}

pk?=DDk?,

D

D

D��ʾ������������,

D

k

D^k

Dk��ʾ��k��������������

ͨ��,���������û���ֵ���������ָ��

G

i

n

i

_

i

n

d

e

x

(

x

)

Gini\_index(x)

Gini_index(x),Ȼ����ݻ���ָ�����������ݼ���

G

i

n

i

_

i

n

d

e

x

(

D

,

a

)

=

��

k

=

1

k

D

k

D

G

i

n

i

(

D

k

)

Gini\_index(D,a)=\sum\limits_{k=1}^k \frac{D^k}{D} Gini(D^k)

Gini_index(D,a)=k=1��k?DDk?Gini(Dk)

����,���ǻ���ͨ��һ��������˵��������̡�������һ�ű�,�ֱ������������(�Ƿ��з�������״����������)�Ļ���ָ����

?

��������:

while(��ǰ�ڵ�"����"):

1.����ÿ��������ÿ?�ַָ�?ʽ,�ҵ���õķָ��

2.�ָ�������ڵ�N1��N2

end while ÿ���ڵ�?��������Ϊ?

?

-

�����ݼ���Ϊ����,��������Ǹ��ݡ��Ƿ���Ƿ��������ֵġ�

-

�����Ƿ��з��Ļ���ָ��:

-

�������״���Ļ���ָ��:

���ڻ���ֵ���������,������״���������������,������ǰѻ���״�������һ�¡������Ϊ����,{(�ѻ�,����),(����,����),(���,����)},�ֱ�������ǵĻ���ָ��,Ȼ��ȡ����ָ����С��������Ϊ����״���Ļ���ָ������,ѡ(�ѻ�,����)��

?

-

�������������ָ��:

������������һ����ֵ����,������ɢ����,���Ҳ��Ҫ�����һ�¡�?�ȶ������밴��������,Ȼ���?��?����?����ֵ���м�ֵ��Ϊ�ָ�����������Ϊ���顣���統?������?Ϊ60��70������ֵʱ,����������м�ֵΪ65,���м�ֵ65��Ϊ�ָ���������ָ�������,ѡ����Щ�м�ֵ�л���ָ����С��,��Ϊ������Ļ���ָ������,ѡ0.3��

-

����״����������Ļ���ָ������0.3,��ѡ��һ������ľ���,����<����״��>��Ϊ���������ڵ㡣

-

�������ظ���������,���¶��Ƿ��з���������������ָ����(ע��:��Ϊ����״���Ѿ���Ϊ���ڵ�,�����ѻ�������Ͱ���������,�Ӷ��������¼���ʱ��ȥ���ѻ������������)

-

�ڶ��μ���,�Ƿ��з��Ļ���ָ��:

-

�ڶ��μ���,������Ļ���ָ��:

-

���չ��������������:

?

?

2.5 ��

������������ʽ

��Ϣ��

E

n

t

(

D

)

=

?

��

k

?

1

n

p

k

log

?

2

p

k

Ent(D)=-\sum\limits_{k-1}^n p_k \log_2 p_k

Ent(D)=?k?1��n?pk?log2?pk?

��Ϣ���桪ID3������

G

a

i

n

(

D

,

a

)

=

E

n

t

(

D

)

?

E

n

t

(

D

�O

a

)

=

E

n

t

(

D

)

?

��

v

=

1

V

D

v

D

E

n

t

(

D

v

)

Gain(D,a)=Ent(D)-Ent(D|a)=Ent(D)-\sum\limits_{v=1}^V \frac{D^v}{D} Ent(D^v)

Gain(D,a)=Ent(D)?Ent(D�Oa)=Ent(D)?v=1��V?DDv?Ent(Dv)

��Ϣ�����ʡ�C4.5������

G

a

i

n

_

i

n

d

e

x

=

(

D

,

a

)

=

G

a

i

n

(

D

,

a

)

I

V

(

a

)

Gain\_index=(D,a) = \frac{Gain(D,a)}{IV(a)}

Gain_index=(D,a)=IV(a)Gain(D,a)?

����ֵ

G

i

n

i

(

D

)

=

��

k

=

1

�O

y

�O

��

k

��

��

k

p

k

p

k

��

=

1

?

��

k

=

1

�O

y

�O

p

k

2

Gini(D)= \sum\limits_{k=1}^{|y|} \sum\limits_{k'\neq k}p_kp_{k'}=1 - \sum\limits_{k=1}^{|y|}p^2_k

Gini(D)=k=1���Oy�O?k����?=k��?pk?pk��?=1?k=1���Oy�O?pk2?

����ָ����CART������

G

i

n

i

_

i

n

d

e

x

(

D

,

a

)

=

��

v

=

1

V

D

v

D

G

i

n

i

(

D

v

)

Gini\_index(D,a)=\sum\limits_{v=1}^V \frac{D^v}{D} Gini(D^v)

Gini_index(D,a)=v=1��V?DDv?Gini(Dv)

| ���� | ���ʱ�� | ��֧��ʽ | ��ע |

|---|---|---|---|

| ID3 | 1975 | ��Ϣ���� | ID3ֻ�ܶ���ɢ���Ե����ݼ����ɾ����� |

| C4.5 | 1993 | ��Ϣ������ | �Ż���ID3��֧������ϲ��ƫ����ȡ��ֵ���������� |

| CART | 1984 | Giniϵ�� | ���Խ��з���ͻع�,�ȿ��Դ�����ɢ����,Ҳ���Դ����������� |

?

?

���㷨��ȱ��

ID3:

-

ID3�㷨��ѡ����ڵ���ڲ��ڵ��еķ�?����ʱ,��?��Ϣ������Ϊ���۱�����Ϣ�����ȱ����������ѡ��ȡֵ�϶������,����Щ������������Կ��ܲ����ṩ̫���м�ֵ����Ϣ.

-

ID3�㷨ֻ�ܶ���������Ϊ��ɢ�����Ե����ݼ������������

?

C4.5:

-

��?�ķ��������������,ȷ�ʽ�?��

-

�ڹ������Ĺ�����,��Ҫ�����ݼ���?��ε�˳��ɨ�������,��?�����㷨����Ч��

-

����,C4.5ֻ�ʺ����ܹ�פ�����ڴ�����ݼ�,��ѵ����?��?�����ڴ�����ʱ����?����?��

?

CART:

- CART�㷨��?C4.5�㷨�ķ���?��,��?�˼�?����ģ��,ͬʱ����ѡ���?�˽��ƵĻ���ϵ�������㡣

- C4.5��?����?����,��CART?����?������

ʲô�Ƕ����������?

?����ID3, C4.5����CART,��������ѡ���ʱ����ѡ�����ŵ�?�����������������,����?����,������߲�Ӧ������ij?������������,?��Ӧ����?�����������ġ��������ߵõ��ľ���������ȷ��������������������������(multi-variate decision tree)����ѡ������������ʱ��,���������������ѡ��ij?����������,?��ѡ�����ŵ�?��������������������ߡ�����㷨�Ĵ�����OC1,��?������ܡ�

���������??���ĸĶ�,�ͻᵼ�����ṹ�ľ��Ҹı䡣�������ͨ������ѧϰ??�����ɭ��֮���?�������

?

��������ָ��ĺû�?

���?���ָ����Խ���ǰ�����нڵ��Ϊ����,ʹ��ÿ?��ܡ�����,Ҳ����ͬ?��ļ�¼�϶�,��ô����?���÷ָ�㡣

?����һ�ڵ���?,��ӵ�з�����,���Խ���¼�ֳ�������,���ǡ��Ľڵ�ȫ����û����Ƿ����,?��������;�����Ľڵ�,���Գ��������?�����������?����,���Ǻܡ�����,���������ڵ�������Ĵ���֮����ԭʼ�ڵ�Ĵ���֮����?,����������?���ָ

������������?̰?�㷨,ֻ���ǵ�ǰ���Ȳ���?�������Ϊ�ָ�㡣

?

��������������������

-

������(Numeric):������������������,��ǰ?��?�еġ�����?����?��>=��,��>��,��<����<=����Ϊ�ָ�����(�����,��?���еķָ����,�����Ż��ָ��㷨��ʱ�临�Ӷ�)��

-

������(Nominal):���Ʊ����?�е�ö������,����ֻ�ܴ�����ѡ����ѡȡ,?��ǰ?��?�еġ����������,ֻ���ǡ�������,���ѻ顱����顱,ʹ?��=�����ָ

?

?

3 CART��֦

3.1 Ϊʲô��Ҫ��֦?

�뿴��ͼ,���ž�����������,��ѵ�����ϵ�Ԥ������ǵ���������,Ȼ���ڲ����ϵľ��������������½���

Ϊʲô���������������(��������Ҳ�������)?

- ����������������ͻ,���д������������

- ����(���߽�����)��������ȫ��Ϊ�����

- �ɺϵĹ�����,������������

?

��֦(pruning)�Ǿ������н��"�����"����Ҫ�ֶΡ�

�ھ�����ѧϰ��,Ϊ�˾�������ȷ����ѵ������,��㻮�ֹ��̽������ظ�,��ʱ����ɾ�������?����,��ʱ�Ϳ�����ѵ������ѧ��"̫��"��,�����ڰ�ѵ����?����?Щ�ص㵱���������ݶ����е�?������?���¹���ϡ����,��ͨ������ȥ��?Щ��?��������ϵ�?����

?

3.2 ���õļ�֦����

��������֦�Ļ���������"Ԥ��֦" (pre-pruning)��"���֦"(post- pruning) ��

-

Ԥ��֦��ָ�ھ�����?�ɹ�����,��ÿ������ڻ���ǰ�Ƚ�?����,����ǰ���Ļ��ֲ��ܴ���������������������,��ͣ?���ֲ�����ǰ�����ΪҶ��㡣

-

���֦�����ȴ�ѵ����?��?�������ľ�����,Ȼ��?�������ض�?Ҷ����?����,�����ý���Ӧ��?���滻ΪҶ����ܴ���������������������,��?���滻ΪҶ��㡣

������������־����ʦ�ġ�����ѧϰ�����а�������˵������ͼ�Ľ����沿����Ϊѵ����,���沿����Ϊ���Լ�,����ID3�������Ի���ѡ��,���ɾ�������

?

?

Ԥ��֦

?��,������Ϣ������,���ǻ�ѡȡ����"�겿"����ѵ������?����,����? 3 ����?,����ͼ��ʾ��Ȼ?,�Ƿ�Ӧ�ý�?���������?Ԥ��֦Ҫ�Ի���ǰ��ķ������ܽ�?���ơ�

- �ڻ���֮ǰ,�������������ڸ���㡣

- ������?����,�ý�㽫�����ΪҶ���,�������Ϊѵ���������������,�������ǽ����Ҷ�����Ϊ"��?"��

- ?ǰ?���IJ��Լ������������������?����������Ϊ {4,5,8} ��������������ȷ������ 4�������������,���Dz��Լ�����Ϊ 3 7 ? 100 % = 42.9 % \frac{3}{7} ? 100\% = 42.9\% 73??100%=42.9%

- ��?����"�겿"����֮��,��ͼ�еĽ��2��3��4�ֱ�������Ϊ {1,2,3, 14}�� {6,7, 15, 17}�� {10, 16} ��ѵ������,����� 3 �����ֱ𱻱��ΪҶ���"��?"�� ����?���� ����?����

- ��ʱ,���Լ��б��Ϊ {4, 5, 8,11, 12} ��������������ȷ,���Լ�����Ϊ 5 7 ? 100 % = 71.4 % > 42.9 % \frac{5}{7} ? 100\% = 71.4\% > 42.9\% 75??100%=71.4%>42.9%������,?"�겿"��?���ֵ���ȷ����

- Ȼ��,�������㷨Ӧ�öԽ��2��?����,������Ϣ��������ѡ����������"?��"��Ȼ?,��ʹ?"?��"���ֺ�,���Ϊ {5} �IJ��Լ�����������������ȷתΪ����,ʹ�ò��Լ������½�Ϊ 57.1%������,Ԥ��֦���Խ��� ?���2�����֡�

- �Խ��3,���Ż�������Ϊ"����",���ֺ���Լ�������Ϊ 71.4%. ��� ���ֲ����������Լ�����,����,Ԥ��֦���Խ�?���3�����֡�

- �Խ��4,������ѵ������?����ͬ?��,���ٽ�?���֡�

����,����Ԥ��֦���Դ��ϱ�������?�ɵľ���������ͼ��ʾ,����Լ�����Ϊ 71.4%������?�ý���?�㻮�ֵľ�����,���"������" (decision stump).

?

���֦

���֦�ȴ�ѵ����?��?������������,����ʹ?��?�İ���,��ǰ?����,����֪ǰ?����ľ������IJ��Լ�����Ϊ42.9%��

-

���֦?�ȿ�����6,���������εķ�?�������൱�ڰ�6�滻ΪҶ��㡣�滻���Ҷ���������Ϊ {7, 15} ��ѵ������,���Ǹ�Ҷ���������Ϊ"��?",��ʱ�������IJ��Լ�������?? 57.1%������,���֦���Ծ�����֦,����ͼ��ʾ��

-

Ȼ����5,���������ε�?���滻ΪҶ���,���滻���Ҷ���������Ϊ {6,7,15}��ѵ������,Ҷ��������Ϊ"��?��,��ʱ���������Լ�������Ϊ 57.1%������,���Բ���?��֦��

-

�Խ��2,���������ε�?���滻ΪҶ���,���滻���Ҷ��������� Ϊ {1, 2, 3, 14} ��ѵ������,Ҷ�����Ϊ"��?"��ʱ�������IJ��Լ�������?? 71.4%. ����,���֦���Ծ�����֦��

-

�Խ��3��1,���������ε�?���滻ΪҶ���,�����þ������IJ��Լ� ���ȷֱ�Ϊ 71.4% �� 42.9%,��δ�õ���?,�������DZ�������

-

����,���ں��֦������?�ɵľ�����������ͼ��ʾ,����Լ�����Ϊ 71.4%��

?

С��-Ԥ��֦�ͺ��֦��ȱ��

-

Ԥ��֦�ļ�֦����:���ƽڵ���?��������ָ������?�ȡ�ָ����ֵ����?ֵ��

-

���֦������ͨ��?Ԥ��֦�����������˸���ķ�?��

-

?��������,���֦��������?���?�պ�?,����������������Ԥ��֦��������

-

�����֦��������?����ȫ������֮���?�ġ� ����Ҫ?�����ϵض����е�����?Ҷ����?��?����,�����ѵ��ʱ�俪��?δ��֦��������Ԥ��֦��������Ҫ?�öࡣ

?

?

4 �������̡�������ȡ

��ǰ�漸ƪ������,�õ����������� ����Ԥ�������ֶ����õĹ�һ��������,�ھ���������������ȡ��

Ϊ�˱��ڼ������������,����ͨ�������������ȡ,��������ͼƬ���ǽ�һ���ı�ת��Ϊ���֡�

������ȡ���ǽ���������(�����ı���ͼ��)ת��Ϊ�����ڻ���ѧϰ����������,���¿��Է�Ϊ����:

- �ֵ�������ȡ

- �ı�������ȡ

- ͼ��������ȡ(���ѧϰ�л����)

?

4.1 �ֵ�������ȡ

���ֵ����ݽ�������ֵ��,ͨ���ǽ���ת��ΪOne-Hot���롣(û��,����Pandas���ᵽ��)

- �ȵ���

sklearn.feature_extraction.DictVectorizer(sparse=True,��),����ʵ������������sparse��ʾ�Ƿ���ϡ����� - ������ʵ�����Ķ������

fit_transform(X),X���Ǵ�����ֵ����ݡ� - ��ͨ��ʵ�����Ķ����ȡ��������

get_feature_names()

��˵����,������ͽ�������⡣

from sklearn.feature_extraction import DictVectorizer

def dictionary_demo():

# 1. ��ȡ�ֵ�����

data = [{'city': '����', 'temperature': 100},

{'city': '�Ϻ�', 'temperature': 60},

{'city': '����', 'temperature': 30}]

# 2. ʵ����ת��������

transfer = DictVectorizer(sparse=False)

# 3. ��ʼת��,ʹ�� One-Hot����

new_data = transfer.fit_transform(data)

# 4. �鿴����

# 4.1 ��ӡ��������

print("��������:\n", transfer.get_feature_names())

# 4.2 ��ӡ��ȡ������

print("One-Hot����\n", new_data)

if __name__ == '__main__':

dictionary_demo()

sparse=False�Ľ��:

sparse=True�Ľ��:

sparse=True���Խ�Լ�ռ䡣������100��100��,��ʵ����One-Hot�����,ÿһ��ֻ��һ��1,�����0���������˷ѿռ�,������������ʽ�洢��

?

?

4.2 �ı�������ȡ

Ӣ���ı�

-

�ȵ���

sklearn.feature_extraction.text.CountVectorizer(stop_words=[])��ȡת��������,����stop_words��ʾͣ�ô�,�����ᱻͳ�ƵĴʡ� -

�ٵ���

fit_transform(data)��ʼ��ȡ,data��Ӣ���ı����ݡ����ص���Ӣ�ĵ��ʵĴ�Ƶͳ��,����one-hot���롣 -

�ɵ���ת���������

get_feature_names()����,��ȡ�����б���

from sklearn.feature_extraction.text import CountVectorizer

def english_count_demo():

"""

Ӣ���ı�������ȡ

:return:

"""

# 1. ��ȡ�ı�����

data = ["life is short,i like python",

"life is too long,i dislike python"]

# 2. ʵ����ת��������

transfer = CountVectorizer() # ע�� û��sparse����

# 3. ��ʼת��,�õ�����Ƶ��ͳ��

new_data = transfer.fit_transform(data)

# 4. �鿴����

# 4.1 ��ӡ��������

print("��������:\n", transfer.get_feature_names())

# 4.2 ��ӡ��ȡ������

print("Ƶ��ͳ��(�����)\n", new_data.toarray())

print("Ƶ��ͳ��(ϡ������)\n", new_data) # ֱ�Ӿ���sparse�Ľ��

if __name__ == '__main__':

english_demo()

?

?

�����ı�

ʵ����CountVectorizer()ͳ�Ƶ�ԭ�������ݿո�������,Ӣ�ĵ�ÿ�����ʶ��пո�ָ�,��������Ȼ���ǡ�����������Ҫ����һ����jieba�������ı����пո�ִʡ�

from sklearn.feature_extraction.text import CountVectorizer

import jieba

def cut_word(text):

"""

���ķִ�

:param text:�ַ����ı�,����"�Ұ������찲��"

:return: �ո�ָ����ַ���,����"�� �� ���� �찲��"

"""

# jieba.cut() ����һ������

# list() ������תΪһ���ַ�������,����["��", "��", "����", "�찲��"]

# " ".join() ���ַ��������ÿո�ƴ��,���� "�� �� ���� �찲��"

text = " ".join(list(jieba.cut(text)))

return text

def chinese_count_demo():

"""

�����ı�������ȡ

:return:

"""

# 1. ��ȡ�ı�����

data = ["?�ֻ���?�ֽ���ܲп�,������п�,���������,������?������������������,����ÿ��?��Ҫ�������졣",

"���ǿ����ĴӺ�Զ��ϵ���Ĺ�����?������֮ǰ������,���������ǿ�������ʱ,�������ڿ����Ĺ�ȥ��"]

# 2. ʵ����ת��������

transfer = CountVectorizer() # ע�� û��sparse����

# 3. ��ʼת��,�õ�����Ƶ��ͳ��

list = []

for str in data:

list.append(cut_word(str))

new_data = transfer.fit_transform(list)

# 4. �鿴����

# 4.1 ��ӡ��������

print("��������:\n", transfer.get_feature_names())

# 4.2 ��ӡ��ȡ������

print("Ƶ��ͳ��(�����)\n", new_data.toarray())

# print("Ƶ��ͳ��(ϡ������)\n", new_data) # ֱ�Ӿ���sparse�Ľ��

if __name__ == '__main__':

chinese_demo()

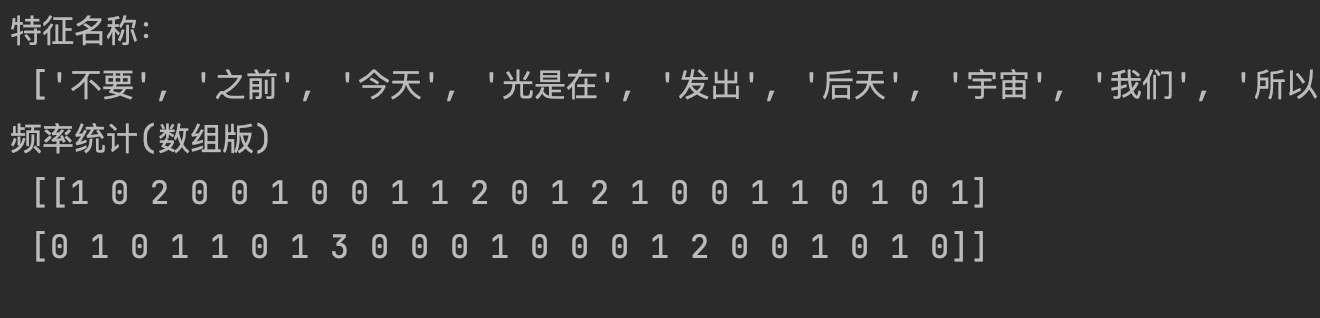

������:

?

?

TF-IDF

ǰ��������Ӣ���ı����������ı�,��������CountVectorizer()��ͳ�ƴ�Ƶ,��Ȼֻ�ǵõ���Ƶ����������������,һ���ʲ�����ֱ�ӻ���һ����������,��ô����δ�����?

TF-IDF����Ҫ˼����:���ij���ʻ������һƪ�����г��ֵĸ��ʸ�,�������������г��ָ��ʵ�,����Ϊ����ʻ������������������¡�

��Ƶ(TF,Term Frequency):ָһ����������ƪ�����г��ֵ�Ƶ�ʡ�����һƪ�����й���100����,����"ϲ��"������5��,��ô��ϲ�����Ĵ�Ƶ����5/100=0.05��

�����ĵ�Ƶ��(IDF,Inverse Document Frequency):��һ�������ձ���Ҫ�ԵĶ���,��ֵ����������������������ڶ���ƪ��������ֹ��Ĵ���,��ȡ��10Ϊ�Ķ���������������10,000,000ƪ����,����10000����ֹ���ϲ���������,��ô I D F = lg ? 10 , 000 , 000 10000 = 3 IDF=\lg\frac{10,000,000}{10000}=3 IDF=lg1000010,000,000?=3

��ʽ: T F ? I D F = T F ? I D F TF-IDF=TF \cdot IDF TF?IDF=TF?IDF,���ԡ�ϲ����������ƪ���µ�TF-IDF�ķ���Ϊ 0.05 ? 3 = 0.15 0.05 \cdot 3=0.15 0.05?3=0.15

����,TF-IDF����,���ǿ����ж�����ʶ���һƪ���µ���Ҫ�̶ȡ�

?

API�÷���CountVectorizer(stop_words=[])һ��,����TfidfVectorizer(stop_words=[])���С�

from sklearn.feature_extraction.text import TfidfVectorizer

import jieba

def cut_word(text):

"""

���ķִ�

:param text:�ַ����ı�,����"�Ұ������찲��"

:return: �ո�ָ����ַ���,����"�� �� ���� �찲��"

"""

# jieba.cut() ����һ������

# list() ������תΪһ���ַ�������,����["��", "��", "����", "�찲��"]

# " ".join() ���ַ��������ÿո�ƴ��,���� "�� �� ���� �찲��"

text = " ".join(list(jieba.cut(text)))

return text

def chinese_tfidf_demo():

"""

�����ı�������ȡ

:return:

"""

# 1. ��ȡ�ı�����

data = ["??���,��ϲ��Python", "?�����,�Ҳ�ϲ��Python"]

# 2. ʵ����ת��������

transfer = TfidfVectorizer() # ������stop_words��ͳ��ijЩ��

# 3. ��ʼת��,�õ�����Ƶ��ͳ��

list = []

for str in data:

list.append(cut_word(str))

new_data = transfer.fit_transform(list)

# 4. �鿴����

# 4.1 ��ӡ��������

print("��������:\n", transfer.get_feature_names())

# 4.2 ��ӡ��ȡ������

print("TF-IDF(�����)\n", new_data.toarray())

if __name__ == '__main__':

chinese_tfidf_demo()

���:

?

?

5 �������㷨API

sklearn.tree.DecisionTreeClassifier(criterion=��gini��, max_depth=None,random_state=None)

-

criterion:�������������ݵ�ѡ��ѡ"gini"������ָ��(Ĭ��),����"entropy"����Ϣ���档

-

min_samples_split:�ڲ��ڵ��ڻ�������Ҫ����С��������

���ֵ������?���������ֵ�����,���ij�ڵ������������min_samples_split,������ٳ���ѡ�� ������������?���֡� Ĭ����2�������������?,����Ҫ�����ֵ�����������������?��?,���Ƽ���?���ֵ��(���10�������,���ø�10�Ͳ����)

-

min_samples_leaf:Ҷ�ӽڵ�����������

���ֵ������Ҷ?�ڵ����ٵ�������,���ijҶ?�ڵ���??��������,�����ֵܽڵ�?�𱻼�֦��Ĭ����1,������?���ٵ�������������,��������������ռ���������İٷ�?�������������?,����Ҫ�����ֵ�����������������?��?,���Ƽ���?���ֵ��(���10�������,���ø�5�Ͳ����)

-

max_depth:������������

����������?���,Ĭ�Ͽ��Բ���?,�������?�Ļ�,�������ڽ�??����ʱ������?������ȡ�?����˵,�����ٻ��������ٵ�ʱ����Բ������ֵ�����ģ����������,����Ҳ��������,�Ƽ����������?���,�����ȡֵȡ�������ݵķֲ�����?�Ŀ���ȡֵ10-100֮�䡣

-

random_state:���������

?

?

6 ����:̩̹��˺ų˿�����Ԥ��

6.1 ��������

̩̹��˺ų�û����ʷ����������ŵij���֮?��1912��4?15?,�����Ĵ�?����,̩̹��˺������?��ײ���û,��2224���˿ͺͻ���?Ա�����1502?�������ⳡ��?���ŵı������˹������,��Ϊ�����ƶ��˸��õİ�ȫ�涨����ɺ���ʧ�µ�ԭ��֮?�dz˿ͺͻ���?Աû��?���ľ�?ͧ�������Ҵ��³���?Щ��?����,����Щ??����?������?��,���績?,?ͯ��������ᡣ �����������,����Ҫ������ɶ���Щ?���ܴ��ķ������ر���,����Ҫ������?����ѧϰ?����Ԥ����Щ�˿������ڱ��硣

��������Kaggle:https://www.kaggle.com/c/titanic/overview

���ݼ�����:https://download.csdn.net/download/qq_39763246/21108566

?

6.2 ����ʵ��

����ѧϰ����:

- ��ȡ����

- ���ݴ���

- ��������

- ����ѧϰ

- ģ������

���水��������һʵ�֡�

-

��ȡ����:ͬʱ����Age�д�������ȱʧ

import pandas as pd import numpy as np from sklearn.model_selection import train_test_split from sklearn.feature_extraction import DictVectorizer from sklearn.tree import DecisionTreeClassifier, export_graphviz # 1. ��ȡ���� titanic = pd.read_csv("./data/titanic_train.csv")

?

-

���ݻ�������:ȷ������ֵ��Ŀ��ֵ��ȱʧֵ���������ݼ�����

# 2. ���ݻ������� # 2.1 ȷ������ֵ��Ŀ��ֵ x = titanic[["Pclass", "Age", "Sex"]] # ¥�㡢���䡢�Ա�(������˵Ů�˺�С������ô) y = titanic["Survived"] # �Ƿ����� # 2.2 ȱʧֵ���� x["Age"].fillna(x["Age"].mean(), inplace=True) # ����Age���д���ȱʧֵ,���Բ���ɾ��NaN,������ƽ��ֵ�滻 # 2.3 ���ݼ����� x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.2, random_state=22)

?

-

��������:�����ǶԽ����ֵ���ȡ

# 3. �������� - ������ȡ �ֵ���ȡ(one-hot����)# ������x��yת�����ֵ����� x.to_dict(orient="records"),������ȡ # [{"Pclass": "1", "Age": 29.00, "Sex": "female"}]transfer = DictVectorizer(sparse=False) x_train = transfer.fit_transform(x_train.to_dict(orient="records"))x_test = transfer.fit_transform(x_test.to_dict(orient="records"))

?

-

����ѧϰ

# 4. ����ѧϰ - ������# 4.1 ���ɹ���������estimator = DecisionTreeClassifier()# 4.2 ģ��ѵ��estimator.fit(x_train, y_train)

?

-

ģ������

# 5. ģ������print("��ȷ��:", estimator.score(x_test, y_test))print("Ԥ��ֵ:\n", estimator.predict(x_test))

?

?

7 ���������ӻ�

- ����ģ��

from sklearn.tree import export_graphviz - ִ��

tree.export_graphviz(estimator,out_file='tree.dot��,feature_names=[����,����]),����feature_names����������,��������ȡ����ͬ��ֵҲҪ����ȥ�� - �����ɵ��ļ�

tree.dot�������ճ������վhttp://webgraphviz.com/��

���������ʾ:

import pandas as pd

import numpy as np

from sklearn.model_selection import train_test_split

from sklearn.feature_extraction import DictVectorizer

from sklearn.tree import DecisionTreeClassifier, export_graphviz

# 1. ��ȡ����

titanic = pd.read_csv("./data/titanic_train.csv")

# 2. ���ݻ�������

x = titanic[["Pclass", "Age", "Sex"]]

y = titanic["Survived"]

x["Age"].fillna(x["Age"].mean(), inplace=True)

x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.2, random_state=22)

# 3. �������� - ������ȡ �ֵ���ȡ(one-hot����)

transfer = DictVectorizer(sparse=False)

x_train = transfer.fit_transform(x_train.to_dict(orient="records"))

x_test = transfer.fit_transform(x_test.to_dict(orient="records"))

# 4. ����ѧϰ - ������

estimator = DecisionTreeClassifier(max_depth=6)

estimator.fit(x_train, y_train)

# 5. ���������ӻ�

export_graphviz(estimator, "./data/tree.dot", feature_names=['Age','Pclass', 'Sex=male','Sex=female'])

�ļ���������:

�����ݸ���ճ������վ,���ɵľ���������:

?

?

8 �ع������

��С��ο���CSDN:https://blog.csdn.net/Albert201605/article/details/81865261

֮ǰ�������ᵽ��,�������Ϳ��Է�Ϊ����:���������ݺ���ɢ������(���������Ա�,��ȡֵ���к�Ů,�������,�������̲���������ȡ,�����DZ���)����Բ�ͬ���͵�����ʱ,������Ҳ���Ϊ����:

- ����������ͻع������

- ǰ����Ҫ���ڴ�����ɢ������,������Ҫ���ڴ������������ݡ�

��ν�ع�,���Ǹ�������������������Ӧ�����ֵ���ع������ǽ������ռ仮�ֳ����ɵ�Ԫ,ÿһ�����ֵ�Ԫ��һ���ض����������Ϊÿ����㶼�ǡ��ǡ��͡����ж�,���Ի��ֵı߽���ƽ����������ġ����ڲ�������,����ֻҪ������������鵽ij����Ԫ,��õ���Ӧ�����ֵ��

�ٸ�����,���Ϊ�Զ�άƽ�滮�ֵľ�����,�ұ�Ϊ��Ӧ�Ļ���ʾ��ͼ,����c1,c2,c3,c4,c5�Ƕ�Ӧÿ�����ֵ�Ԫ�������

�����ڶ�һ���µ�����(6,6)��������Ӧ���������һά����6����5��8֮��,�ڶ�ά����6С��8,���ݴ˾������������ж�(6,6)���ڵĻ��ֵ�Ԫ,���Ӧ�����ֵΪc3.

?

8.1 ԭ������

�����ǻع���������Ƿ��������,�������������?����:

-

���ѡ�ֵ�?

-

��ξ���Ҷ�ڵ�����ֵ?

����������n������,ÿ��������

s

i

(

i

��

(

1

,

n

)

)

s_i(i \in (1, n))

si?(i��(1,n))��ȡֵ,�����DZ�����������, ���Ը���������ȡֵ,�Կռ��?����,ֱ��ȡ������ j ��ȡֵ s,ʹ����ʧ������?,�����͵õ���?�����ֵ㡣�ù�ʽ����������:

m

i

n

j

,

s

[

m

i

n

c

1

L

o

s

s

(

y

i

,

c

1

)

+

m

i

n

c

2

L

o

s

s

(

y

i

,

c

2

)

]

min_{j,s}[min_{c_1} Loss(y_i, c_1) + min_{c_2} Loss(y_i, c_2)]

minj,s?[minc1??Loss(yi?,c1?)+minc2??Loss(yi?,c2?)]

����,

L

o

s

s

(

y

i

,

c

1

)

Loss(y_i, c_1)

Loss(yi?,c1?)��ʾ��ʧ������

���罫����ռ仮��ΪM����Ԫ( R 1 , R 2 . . . R m R_1,R_2...R_m R1?,R2?...Rm?),��ôÿ����������ֵ���� c m = a v g ( y i �O x i �� R m ) c_m=avg(y_i|x_i \in R_m) cm?=avg(yi?�Oxi?��Rm?),Ҳ���Ǹ����������е�yֵ��ƽ������

��仰���ܲ�������,���Ǿٸ����ӡ�

����ͼ��ʾ,����������Ҫ��¥�ھ����������лع�,���ǽ�¥����Ϊ3������( R 1 , R 2 , R 3 R_1,R_2,R_3 R1?,R2?,R3?)��

���� R 1 R_1 R1?����� c 1 c_1 c1?���ǵ�һ���ĸ�����������ƽ��ֵ������ R 2 R_2 R2?����� c 2 c_2 c2?���ǵڶ����ĸ����������ƽ��ֵ������ R 3 R_3 R3?����� c 3 c_3 c3?���ǵ������а˸����������ƽ��ֵ��

?

8.2 �㷨����

-

����:ѵ����D

-

���:�ع������ f ( x ) f(x) f(x)

��ѵ�����ݼ����ڵ�����ռ���,�ݹ�Ľ�ÿ������Ϊ������������ÿ���������ϵ����ֵ,���������������

-

ѡ�������з�����j���зֵ�s,���:

m i n j , s [ m i n c 1 �� x i �� R 1 ( j , s ) ( y i ? c 1 ) 2 + m i n c 2 �� x i �� R 2 ( j , s ) ( y i ? c 2 ) 2 ] min_{j,s}[min_{c_1} \sum\limits_{x_i \in R_1(j, s)}(y_i-c_1)^2 + min_{c_2} \sum\limits_{x_i \in R_2(j, s)}(y_i - c_2)^2] minj,s?[minc1??xi?��R1?(j,s)��?(yi??c1?)2+minc2??xi?��R2?(j,s)��?(yi??c2?)2]

��������j,�Թ̶����з�����jɨ���зֵ�,ѡ����ʹ��ʽ�ﵽ��С��һ�� ( j , s ) (j, s) (j,s) -

����ѡ���� ( j , s ) (j,s) (j,s)��������,��������Ӧ�����ֵ:

R 1 ( j , s ) = x �O x ( j ) �� s , R 2 ( j , s ) = x �O x ( j ) > c m = 1 N �� x 1 �� R m ( j , s ) y i , x �� R m , m = 1 , 2 R_1(j, s)=x|x^{(j)} \le s, R_2(j,s)=x|x^{(j)} \gt \\ c_m=\frac{1}{N} \sum\limits_{x_1 \in R_m(j,s)} y_i, x \in R_m, m=1,2 R1?(j,s)=x�Ox(j)��s,R2?(j,s)=x�Ox(j)>cm?=N1?x1?��Rm?(j,s)��?yi?,x��Rm?,m=1,2 -

������������������� 1��2,ֱ������������

-

������ռ仮��ΪM������ R 1 , R 2 , . . . R M R_1, R_2, ... R_M R1?,R2?,...RM?,���ɾ�����:

f ( x ) = �� m = 1 M c m I ( x �� R m ) f(x)=\sum\limits_{m=1}^M c_mI(x \in R_m) f(x)=m=1��M?cm?I(x��Rm?)

?

8.3 ������

Ϊ�˸�������ع�������㷨,����ٸ������������ӡ�

ѵ���������±���

| x | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 |

|---|---|---|---|---|---|---|---|---|---|---|

| y | 5.56 | 5.7 | 5.91 | 6.4 | 6.8 | 7.05 | 8.9 | 8.7 | 9 | 9.05 |

(1)��ѡ�����ŵ��з�����j�������зֵ�s

�ڱ����ݼ���ֻ��һ������x,���������з���������x��

���ǿ���9���зֵ�[1.5, 2.5, 3.5, 4.5, 5.5, 6.5, 7.5, 8.5, 9.5],��ʧ��������Ϊƽ����ʧ���� L o s s ( y , f ( x ) ) = ( f ( x ) ? y ) 2 Loss(y,f(x))=(f(x)-y)^2 Loss(y,f(x))=(f(x)?y)2,��ǰ��9���зֵ��쳣�������湫ʽ,���� c m = a v g ( y i �O x i �� R m ) c_m=avg(y_i|x_i \in R_m) cm?=avg(yi?�Oxi?��Rm?)��

?

-

�������������ֵ

����,ȡs=1.5,��ʱ R 1 = 1 , R 2 = 2 , 3 , 4 , 5 , 6 , 7 , 8 , 9 , 10 R_1=1,R_2=2,3,4,5,6,7,8,9,10 R1?=1,R2?=2,3,4,5,6,7,8,9,10,��������������ֵ�ֱ�Ϊ:c1=5.56, c2=(5.7 + 5.91 + 6.4 + 6.8 + 7.05 + 8.9 + 8.7 + 9 + 9.05)/9=7.50��

ͬ��,�õ��������зֵ�����������ֵ,���±�:

s 1.5 2.5 3.5 4.5 5.5 6.5 7.5 8.5 9.5 c1 5.56 5.63 5.73 5.89 6.07 6.24 6.62 6.88 7.11 c2 7.5 7.73 7.99 8.25 8.54 8.91 8.92 9.03 9.05 -

������ʧ����,�ҵ������зֵ�

��c1,c2��ֵ���뵽ƽ����ʧ���� L o s s ( y , f ( x ) ) = ( f ( x ) ? y ) 2 Loss(y, f(x))=(f(x)-y)^2 Loss(y,f(x))=(f(x)?y)2��

��s=1.5ʱ, L ( 1.5 ) = ( 5.56 ? 5.56 ) 2 + [ ( 5.7 ? 7.5 ) 2 + ( 5.91 ? 7.5 ) 2 + . . . + ( 9.05 ? 7.5 ) 2 ] = 15.72 L(1.5)=(5.56-5.56)^2+[(5.7-7.5)^2+(5.91-7.5)^2+...+(9.05-7.5)^2]=15.72 L(1.5)=(5.56?5.56)2+[(5.7?7.5)2+(5.91?7.5)2+...+(9.05?7.5)2]=15.72

ͬ��,�õ������зֵ����ʧ����,���±�:

s 1.5 2.5 3.5 4.5 5.5 6.5 7.5 8.5 9.5 m(s) 15.72 12.07 8.36 5.78 3.91 1.93 8.07 11.73 15.74 ��Ȼȡs=6.5ʱ,��ʧ����m(s)��С,���Ե�һ�����ֱ����� ( j = x , s = 6.5 ) (j=x,s=6.5) (j=x,s=6.5)

?

(2)��ѡ���� ( j , s ) (j,s) (j,s)��������,���������ֵ:

- ��������ֱ���: R 1 = { 1 , 2 , 3 , 4 , 5 , 6 } , R 2 = { 7 , 8 , 9 , 10 } R_1=\lbrace1,2,3,4,5,6\rbrace,R_2=\lbrace 7, 8, 9, 10 \rbrace R1?={1,2,3,4,5,6},R2?={7,8,9,10}

- ���ֵ c m = a v g ( y i �O x i �� R m ) c_m=avg(y_i|x_i \in R_m) cm?=avg(yi?�Oxi?��Rm?),c1=6.24,c2=8.91

(3)��(1)��(2)��������:

? ��R1��������

| x | 1 | 2 | 3 | 4 | 5 | 6 |

|---|---|---|---|---|---|---|

| y | 5.56 | 5.7 | 5.91 | 6.4 | 6.8 | 7.05 |

? ȡ�зֵ�[1.5, 2.5, 3.5, 4.5, 5.5],�����������ֵ c m c_m cm?���±�

| s | 1.5 | 2.5 | 3.5 | 4.5 | 5.5 |

|---|---|---|---|---|---|

| c1 | 5.56 | 5.63 | 5.72 | 5.89 | 6.07 |

| c2 | 6.37 | 6.54 | 6.75 | 6.93 | 7.05 |

? ������ʧ����m(s)

| s | 1.5 | 2.5 | 3.5 | 4.5 | 5.5 |

|---|---|---|---|---|---|

| m(s) | 1.3087 | 0.754 | 0.2771 | 0.4368 | 1.0644 |

(4)���ɻع������������������������ֹͣ����,��ô���յõ��Ļع�����ʽ����:

?

8.4 �������ع������Իع�ĶԱ�

# -*- coding = utf-8 -*-

# @Time : 2021/8/16 11:11 ����

# @Author : zcy

# @File : DecisionTreeRegressor.py

# @Software : PyCharm

import numpy as np

import matplotlib.pyplot as plt

from sklearn.tree import DecisionTreeRegressor

from sklearn import linear_model

# ?������

# ����reshape,��ȡ�������Ǵ�1��10��һά�б�,reshape(-1,1)����תΪ1��10�Ķ�ά�б���(-1��ʾ�Զ�������,1��ʾÿ�н�1��)

x = np.array(list(range(1, 11))).reshape(-1, 1) # ����Ҫ��ά���ܽ���ѵ��

y = np.array([5.56, 5.70, 5.91, 6.40, 6.80, 7.05, 8.90, 8.70, 9.00, 9.05])

# ѵ��ģ�� (������ ���ж���)

model1 = DecisionTreeRegressor(max_depth=1) # ������Ϊ1�Ļع������

model2 = DecisionTreeRegressor(max_depth=3) # ������Ϊ3�Ļع������

model3 = linear_model.LinearRegression() # ���Իع�

model1.fit(x, y)

model2.fit(x, y)

model3.fit(x, y)

# ģ��Ԥ��

# ?��1000������Ϊ���Լ�,?��Ԥ��ģ��

X_test = np.arange(0.0, 10.0, 0.01).reshape(-1, 1) # ��0��ʼ,��10Ϊֹ,����Ϊ0.01�Ķ�ά�б���

y_1 = model1.predict(X_test)

y_2 = model2.predict(X_test)

y_3 = model3.predict(X_test)

# ������ӻ�

plt.figure(figsize=(10, 6), dpi=100)

plt.scatter(x, y, label="data")

plt.plot(X_test, y_1, label="max_depth=1")

plt.plot(X_test, y_2, label="max_depth=3")

plt.plot(X_test, y_3, label='liner regression')

plt.xlabel("data")

plt.ylabel("target")

plt.title("Decision Tree Regression")

plt.legend()

plt.show()