����EM�㷨�����������̫��,��ϸ��ʽ��֤�����Բο���ĩ���ӵIJο�����

EM�㷨

1 ���������Ŀ

K

K

K,��ÿ������

k

k

k����

��

k

,

��

k

,

��

k

\pi_k,\boldsymbol{\mu}_{k},\boldsymbol{\Sigma}_{k}

��k?,��k?,��k?�ij�ʼֵ��

2 E step

���ݵ�ǰ��

��

k

,

��

k

,

��

k

\pi_k,\boldsymbol{\mu}_{k},\boldsymbol{\Sigma}_{k}

��k?,��k?,��k?����������

��

(

z

n

k

)

\gamma(z_{nk})

��(znk?)��

��

(

z

n

k

)

=

��

k

N

(

x

n

�O

��

n

,

��

n

)

��

j

=

1

K

��

j

N

(

x

n

�O

��

j

,

��

j

)

\gamma\left(z_{n k}\right)=\frac{\pi_{k} \mathcal{N}\left(\boldsymbol{x}_{n} \mid \boldsymbol{\mu}_{n}, \boldsymbol{\Sigma}_{n}\right)}{\sum_{j=1}^{K} \pi_{j} \mathcal{N}\left(\boldsymbol{x}_{n} \mid \boldsymbol{\mu}_{j}, \boldsymbol{\Sigma}_{j}\right)}

��(znk?)=��j=1K?��j?N(xn?�O��j?,��j?)��k?N(xn?�O��n?,��n?)?

3 M step

���� E step ����

��

(

z

n

k

)

\gamma(z_{nk})

��(znk?)�ټ����µ�

��

k

,

��

k

,

��

k

\pi_k,\boldsymbol{\mu}_{k},\boldsymbol{\Sigma}_{k}

��k?,��k?,��k?:

��

k

n

e

w

=

1

N

k

��

n

=

1

N

��

(

z

n

k

)

x

n

��

k

n

e

w

=

1

N

k

��

n

=

1

N

��

(

z

n

k

)

(

x

n

?

��

k

n

e

w

)

(

x

n

?

��

k

n

e

w

)

T

��

k

n

e

w

=

N

k

N

\begin{aligned} \boldsymbol{\mu}_{k}^{n e w} &=\frac{1}{N_{k}} \sum_{n=1}^{N} \gamma\left(z_{n k}\right) \boldsymbol{x}_{n} \\ \boldsymbol{\Sigma}_{k}^{n e w} &=\frac{1}{N_{k}} \sum_{n=1}^{N} \gamma\left(z_{n k}\right)\left(\boldsymbol{x}_{n}-\boldsymbol{\mu}_{k}^{n e w}\right)\left(\boldsymbol{x}_{n}-\boldsymbol{\mu}_{k}^{n e w}\right)^{T} \\ \pi_{k}^{n e w} &=\frac{N_{k}}{N} \end{aligned}

��knew?��knew?��knew??=Nk?1?n=1��N?��(znk?)xn?=Nk?1?n=1��N?��(znk?)(xn??��knew?)(xn??��knew?)T=NNk???

����:

N

k

=

��

n

=

1

N

��

(

z

n

k

)

N_{k}=\sum_{n=1}^{N} \gamma\left(z_{n k}\right)

Nk?=n=1��N?��(znk?)

4 �������Ƿ������������Ȼ�����Ƿ�����,��������,�ص�2����

������Ȼ����:

ln

?

p

(

x

�O

��

,

��

,

��

)

=

��

n

=

1

N

ln

?

{

��

k

=

1

K

��

k

N

(

x

k

�O

��

k

,

��

k

)

}

\ln p(\boldsymbol{x} \mid \boldsymbol{\pi}, \boldsymbol{\mu}, \boldsymbol{\Sigma})=\sum_{n=1}^{N} \ln \left\{\sum_{k=1}^{K} \pi_{k} \mathcal{N}\left(\boldsymbol{x}_{k} \mid \boldsymbol{\mu}_{k}, \boldsymbol{\Sigma}_{k}\right)\right\}

lnp(x�O��,��,��)=n=1��N?ln{k=1��K?��k?N(xk?�O��k?,��k?)}

EM�㷨MATLABʵ��(������ϸע��)

��EM�㷨�������ô�����������,�ͷ���ת��,��С���м�����Ĵ�С,�������Ч�ʡ�

function [Mu,Sigma,Pi,Class]=gaussKMeans(pntSet,K,initM)

% @author:slandarer

% ===============================================================

% pntSet | NxD���� | �����꼯 |

% K | ��ֵ | ���ֶ����� |

% --------+-----------+-----------------------------------------+

% Mu | KxD���� | ÿһ��Ϊһ����������� |

% Sigma | DxDxK���� | ÿһ��Ϊһ���Э������� |

% Pi | Kx1������ | ÿһ����ֵΪһ���Ȩ��(ռ��) |

% Class | Nx1������ | ÿһ����ֵΪÿһ��Ԫ�صı�ǩ(������һ��)|

% --------+-----------+-----------------------------------------+

[N,D]=size(pntSet); % N:Ԫ�ظ��� | D:ά��

% ��ʼ������===============================================================

if nargin<3

initM='random';

end

switch initM

case 'random' % ���ȡ��ʼֵ

[~,tIndex]=sort(rand(N,1));tIndex=tIndex(1:K);

Mu=pntSet(tIndex,:);

case 'dis' % ���ݸ�ά�ȵ������Сֵ������������

% �����ݸ÷�����������ȡ����Ϊ��ʼ����

tMin=min(pntSet);

tMax=max(pntSet);

Mu=linspace(0,1,K)'*(tMax-tMin)+repmat(tMin,K,1);

% case '���ݸ���������������'

% ... ...

% ... ...

end

% һ��ʼ����ÿһ������ͬЭ��������Ȩ��

Sigma(:,:,1:K)=repmat(cov(pntSet),[1,1,K]);

Pi(1:K,1)=(1/K);

% latest coefficient:��һ�ֵIJ���

LMu=Mu;

LPi=Pi;

LSigma=Sigma;

turn=0; %�ִ�

% GMM/gauss_k_means��Ҫ����================================================

while true

% �������е���Ϊ��k���Աʱ���ʼ����ʺ�(����Ȩ��)

% �˴����˶��ת�ñ����NxN��С�м��������

% ���������й�������������С��NxD,���������ڴ�����

Psi=zeros(N,K);

for k=1:K

Y=pntSet-repmat(Mu(k,:),N,1);

Psi(:,k)=((2*pi)^(-D/2))*(det(Sigma(:,:,k))^(-1/2))*...

exp(-1/2*sum((Y/Sigma(:,:,k)).*Y,2))';

end

% ����Ȩ�ؼ���������ڸ���������

Gamma=Psi.*Pi'./sum(Psi.*Pi',2);

% ����ʹ�þ����������ѭ��,�������Ч��

Mu=Gamma'*pntSet./sum(Gamma,1)';

for k=1:K

Y=pntSet-repmat(Mu(k,:),N,1);

Sigma(:,:,k)=(Y'*(Gamma(:,k).*Y))./sum(Gamma(:,k));

end

Pi=(sum(Gamma)/N)';

[~,Class]=max(Gamma,[],2);

% ������������

R_Mu=sum((LMu-Mu).^2,'all');

R_Sigma=sum((LSigma-Sigma).^2,'all');

R_Pi=sum((LPi-Pi).^2,'all');

R=sqrt((R_Mu+R_Sigma+R_Pi)/(K*D+D*D*K+K));

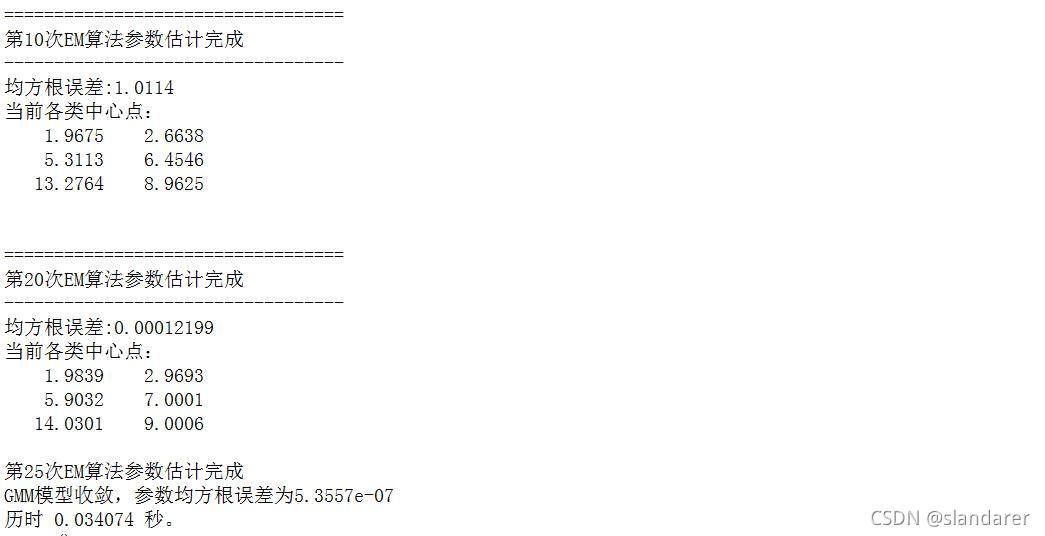

% ÿ��10�������ǰ�������

turn=turn+1;

if mod(turn,10)==0

disp(' ')

disp('==================================')

disp(['��',num2str(turn),'��EM�㷨�����������'])

disp('----------------------------------')

disp(['���������:',num2str(R)])

disp('��ǰ�������ĵ�:')

disp(Mu)

end

% ѭ������

if (R<1e-6)||isnan(R)

disp(['��',num2str(turn),'��EM�㷨�����������'])

if turn>=1e4||isnan(R)

disp('GMMģ�Ͳ�����')

else

disp(['GMMģ������,�������������Ϊ',num2str(R)])

end

break;

end

LMu=Mu;

LSigma=Sigma;

LPi=Pi;

end

end

����ʹ��:

% �����������ϸ�˹�ֲ��ĵ㼯���ϲ�

PntSet1=mvnrnd([2 3],[1 0;0 2],500);

PntSet2=mvnrnd([6 7],[1 0;0 2],500);

PntSet3=mvnrnd([14 9],[1 0;0 1],500);

PntSet=[PntSet1;PntSet2;PntSet3];

% ����GMMģ��

tic

[Mu,Sigma,Pi,Class]=gaussKMeans(PntSet,3,'dis');

toc

����1500�����ݴ�����ʱ0.034s

��ά��˹���ģ���ܶȷֲ��������

��ά��˹�ֲ�����:

N

(

x

�O

u

��

,

��

)

=

1

(

2

��

)

D

/

2

1

�O

��

�O

1

/

2

exp

?

[

?

1

2

(

x

?

��

)

T

��

?

1

(

x

?

��

)

]

\begin{gathered}\mathcal{N}(\boldsymbol{x} \mid \bar{u}, \Sigma)=\frac{1}{(2 \pi)^{D / 2}} \frac{1}{|\boldsymbol{\Sigma}|^{1 / 2}} \exp \left[-\frac{1}{2}(\boldsymbol{x}- \boldsymbol{\mu})^{T} \boldsymbol{\Sigma}^{-1}(\boldsymbol{x}- \boldsymbol{\mu})\right]\end{gathered}

N(x�Ou��,��)=(2��)D/21?�O���O1/21?exp[?21?(x?��)T��?1(x?��)]?

��ά��Ϸֲ�����:

p

(

x

)

=

��

k

=

1

K

��

k

N

(

x

�O

��

k

,

��

k

)

p(\boldsymbol{x})=\sum_{k=1}^{K} \pi_{k} \mathcal{N}\left(\boldsymbol{x} \mid \boldsymbol{\mu}_{k}, \boldsymbol{\Sigma}_{k}\right)

p(x)=k=1��K?��k?N(x�O��k?,��k?)

��ά��Ϸֲ��������ɺ���:

function func=getGaussFunc(Mu,Sigma,Pi)

[K,D]=size(Mu);

X{D}=[];

for d=1:D

X{d}=['x',num2str(d)];

end

X=sym(X);

func=0;

for k=1:K

tMu=Mu(k,:);

tSigma=Sigma(:,:,k);

tPi=Pi(k);

tX=X-tMu;

func=func+tPi*(1/(2*pi)^(D/2))*(1/det(tSigma)^(1/2))*exp((-1/2)*(tX/tSigma*tX.'));

end

func=matlabFunction(func);

end

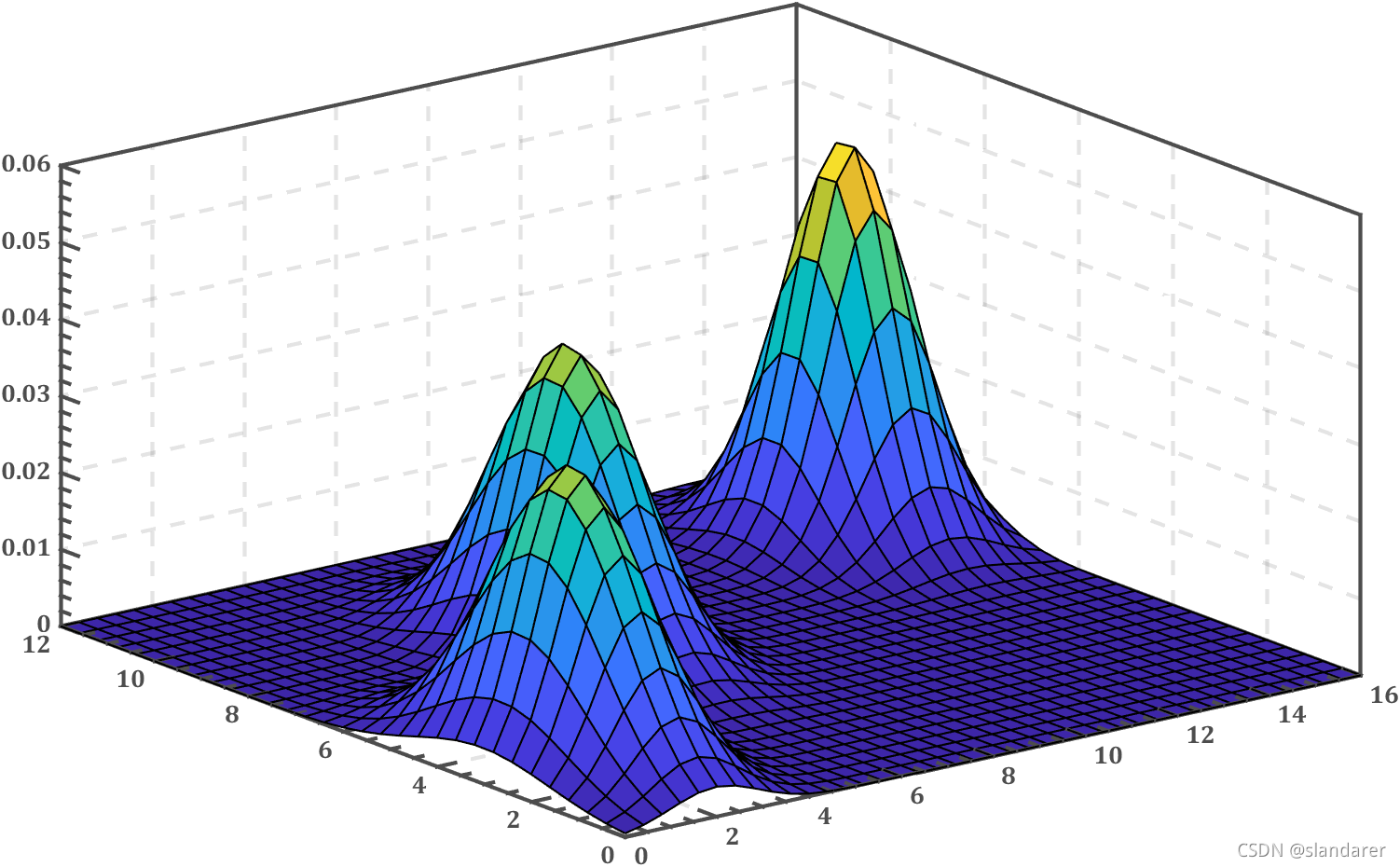

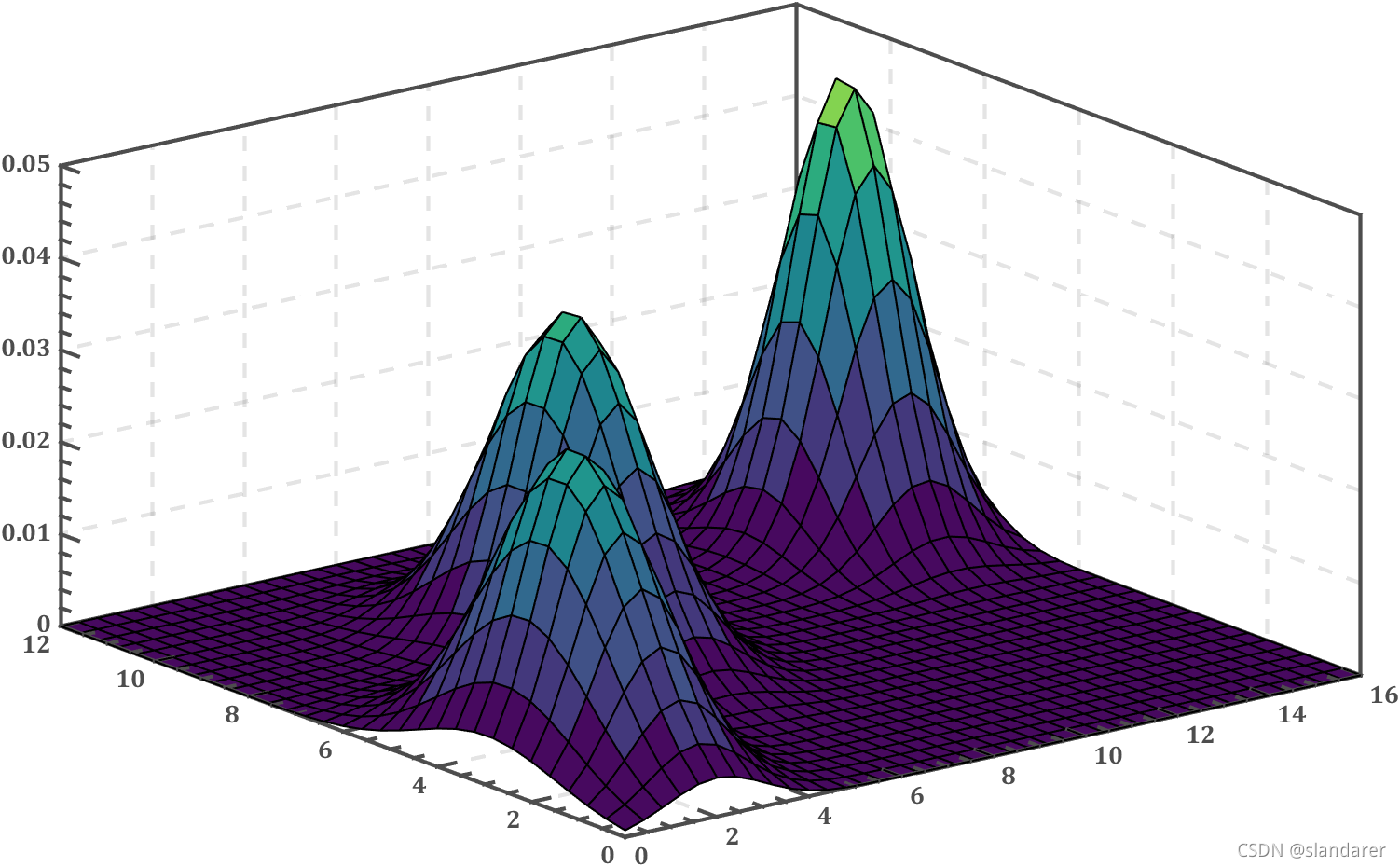

���ò���ͼ

�˶δ���н����Ļ���ʹ�ô�����,��ʹ����EM�㷨���ɵ�����

% ��������ܶȺ���

func=getGaussFunc(Mu,Sigma,Pi);

% ���Ƹ����ܶ�ͼ��

figure('Units','normalized','Position',[.3,.2,.6,.65])

[X1,X2]=meshgrid(0:.4:16,0:.4:12);

surf(X1,X2,func(X1,X2),'LineWidth',1)

%����һ��

ax=gca;hold(ax,'on');

ax.XLim=[0,16];

ax.YLim=[0,12];

ax.LineWidth=2;

ax.Box='on';

ax.TickDir='in';

ax.XMinorTick='on';

ax.YMinorTick='on';

ax.ZMinorTick='on';

ax.XColor=[.3,.3,.3];

ax.YColor=[.3,.3,.3];

ax.ZColor=[.3,.3,.3];

ax.FontWeight='bold';

ax.FontName='Cambria';

ax.FontSize=13;

ax.GridLineStyle='--';

������ɫ:

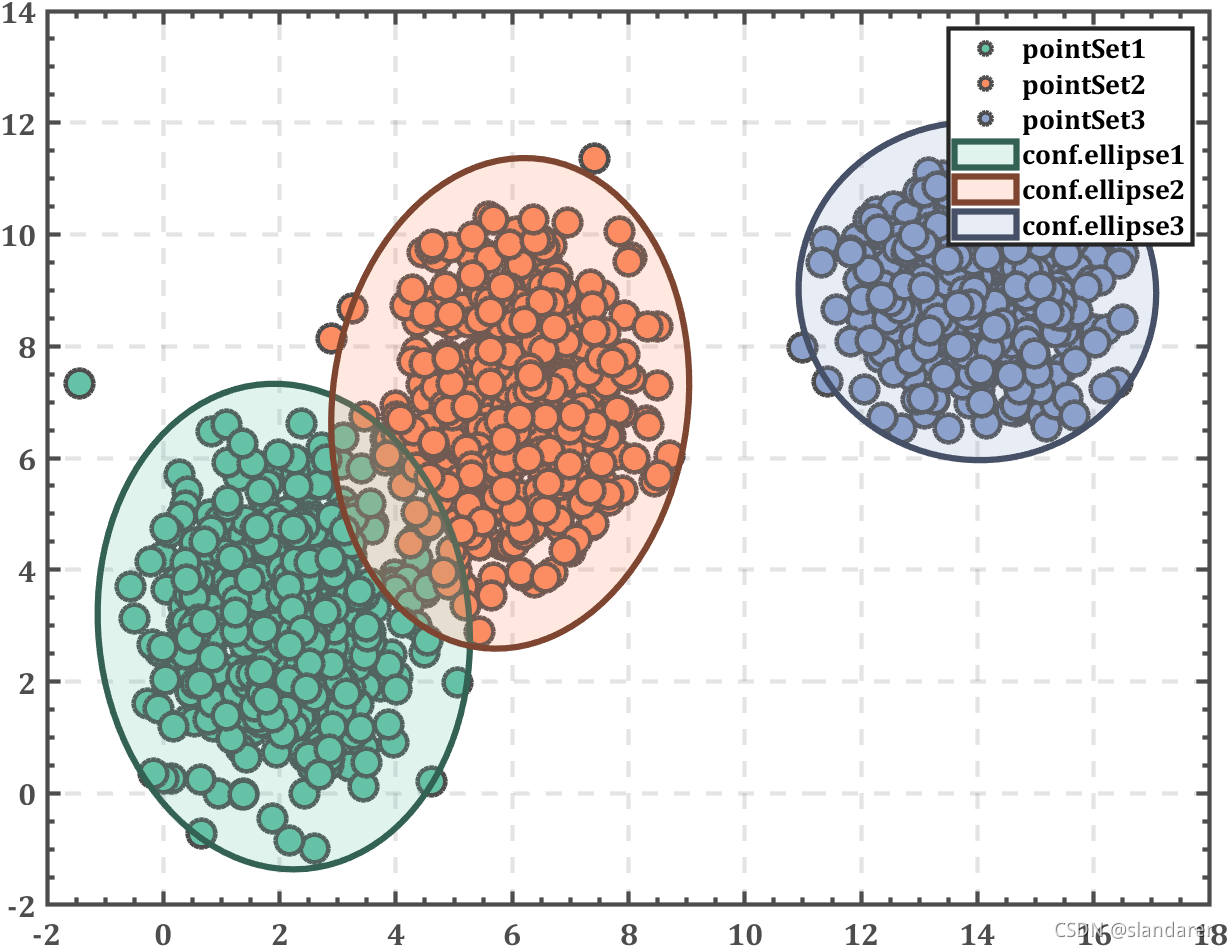

ɢ����������������Բ����

���ǹ۲쵽,��ÿһ����ά��˹�ֲ�,���Ա���������exp()��

N

(

x

�O

u

��

,

��

)

=

1

(

2

��

)

D

/

2

1

�O

��

�O

1

/

2

exp

?

[

?

1

2

(

x

?

��

)

T

��

?

1

(

x

?

��

)

]

\begin{gathered}\mathcal{N}(\boldsymbol{x} \mid \bar{u}, \Sigma)=\frac{1}{(2 \pi)^{D / 2}} \frac{1}{|\boldsymbol{\Sigma}|^{1 / 2}} \exp \left[-\frac{1}{2}(\boldsymbol{x}- \boldsymbol{\mu})^{T} \boldsymbol{\Sigma}^{-1}(\boldsymbol{x}- \boldsymbol{\mu})\right]\end{gathered}

N(x�Ou��,��)=(2��)D/21?�O���O1/21?exp[?21?(x?��)T��?1(x?��)]?

Ҳ����˵������ֵ��ȫ������������ֵ�ı仯���仯,

��

(

x

?

��

)

T

��

?

1

(

x

?

��

)

=

S

\begin{gathered}(\boldsymbol{x}- \boldsymbol{\mu})^{T} \boldsymbol{\Sigma}^{-1}(\boldsymbol{x}- \boldsymbol{\mu})\end{gathered}=S

(x?��)T��?1(x?��)?=S

ʵ��Ϊ�����ܶȺ�����һ���ȸ���,�����ڵ�ʽ������ʽ�����˴˱���ʽ��һ����Բ���̱���ʽ,���ڸ�ά��˹�ֲ����ֽ�Ϊ����,���Ǵ�ʱ���ڲ����ȷ���Ҳ�Sֵ:95%:5.991,99%:9.21,90%:4.605

��Բ�������ɺ���:

function [X,Y]=getEllipse(Mu,Sigma,S,pntNum)

% �������� | 95%:5.991 99%:9.21 90%:4.605

% (X-Mu)*inv(Sigma)*(X-Mu)=S

invSig=inv(Sigma);

[V,D]=eig(invSig);

aa=sqrt(S/D(1));

bb=sqrt(S/D(4));

t=linspace(0,2*pi,pntNum);

XY=V*[aa*cos(t);bb*sin(t)];

X=(XY(1,:)+Mu(1))';

Y=(XY(2,:)+Mu(2))';

end

���Ʒ���ɢ��ͼ��������Բ:

����ݷ�������ı�colorList��ѭ����iֵ

% ����ɢ��ͼ

figure('Units','normalized','Position',[.3,.2,.5,.65])

ax=gca;hold(ax,'on');

colorList=[0.4 0.76 0.65

0.99 0.55 0.38

0.55 0.63 0.80];

for i=1:3

scatter(PntSet(Class==i,1),PntSet(Class==i,2),180,'filled',...

'LineWidth',2.2,'MarkerEdgeColor',[1 1 1]*.3,'MarkerFaceColor',colorList(i,:));

end

% ����������Բ

for i=1:3

[X,Y]=getEllipse(Mu(i,:),Sigma(:,:,i),9.21,100);

fill(X,Y,colorList(i,:),'EdgeColor',colorList(i,:).*.5,...

'LineWidth',3,'FaceAlpha',.2)

end

legend('pointSet1','pointSet2','pointSet3','conf.ellipse1','conf.ellipse2','conf.ellipse3')

%����һ��

ax.XLim=[-2,18];

ax.YLim=[-2,14];

ax.LineWidth=2;

ax.Box='on';

ax.TickDir='in';

ax.XMinorTick='on';

ax.YMinorTick='on';

ax.XGrid='on';

ax.YGrid='on';

ax.GridLineStyle='--';

ax.XColor=[.3,.3,.3];

ax.YColor=[.3,.3,.3];

ax.FontWeight='bold';

ax.FontName='Cambria';

ax.FontSize=15;

%ax.Color=[0.9,0.9,0.9];

�����

EM�㷨����:��˹���ģ��(GMM)����EM�㷨������

��ά��˹��ʽ�Ƶ�����Ҷ˹����:

����:PRML���İ�_ģʽʶ�������ѧϰ.pdf

��ȡ��:pd78