ǰ��

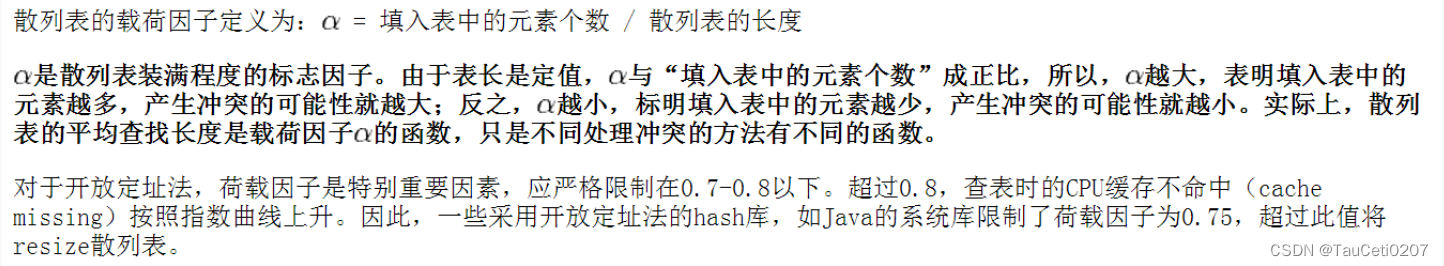

unordered_set&unordered_map�ĵײ��ǹ�ϣ,���Ҫ��ģ��ʵ�ֻ�������ϸ�˽��¹�ϣ��

1.��ϣ����

˳��ṹ�Լ�ƽ������,Ԫ�عؼ�������洢λ��֮��û�ж�Ӧ�Ĺ�ϵ,����ڲ���һ��Ԫ��ʱ,����Ҫ�����ؼ���Ķ�αȽϡ�

˳�����ʱ�临�Ӷ�Ϊ O(N)��

ƽ������Ϊ���ĸ߶�,��

O

(

l

o

g

2

N

)

O(log_2 N)

O(log2?N),������Ч��ȡ��������������Ԫ�صıȽϴ�����

�������������:���Բ������καȽ�,һ��ֱ�Ӵӱ��еõ�Ҫ������Ԫ�ء�

�������һ�ִ洢�ṹ,ͨ��ij�ֺ���(hashFunc)ʹԪ�صĴ洢λ�������Ĺؼ���֮���ܹ�����һһӳ��Ĺ�ϵ,��ô�ڲ���ʱͨ���ú������Ժܿ��ҵ���Ԫ�ء�

����ýṹ��:

- ����Ԫ��ʱ:

���ݴ�����Ԫ�صĹؼ���,�Դ˺����������Ԫ�صĴ洢λ�ò�����λ�ý��д�š� - ����Ԫ��ʱ:

��Ԫ�صĹؼ������ͬ���ļ���,����õĺ���ֵ����Ԫ�صĴ洢λ��,

�ڽṹ�а���λ��ȡԪ�رȽ�,���ؼ������,�������ɹ���

�÷�ʽ��Ϊ��ϣ(ɢ��)����,��ϣ������ʹ�õ�ת��������Ϊ��ϣ(ɢ��)����,��������Ľṹ��Ϊ��ϣ��(Hash Table)(���߳�ɢ�б�)

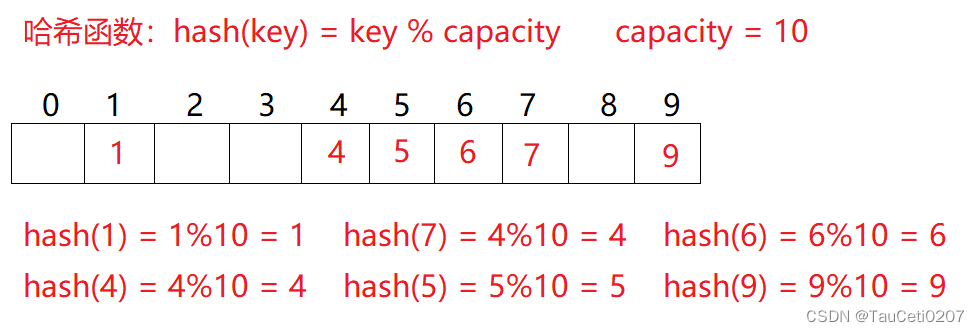

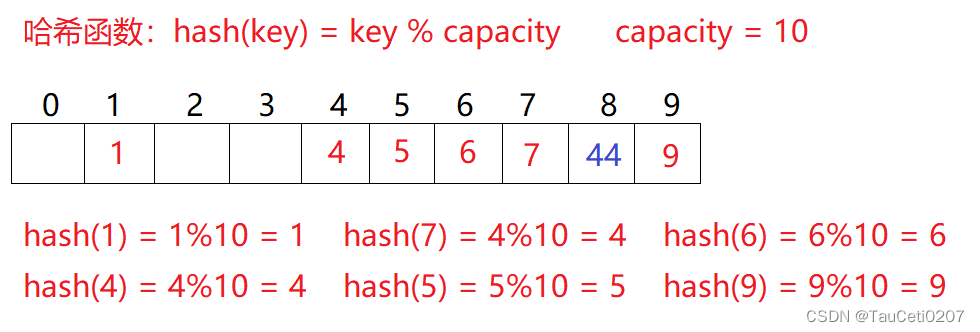

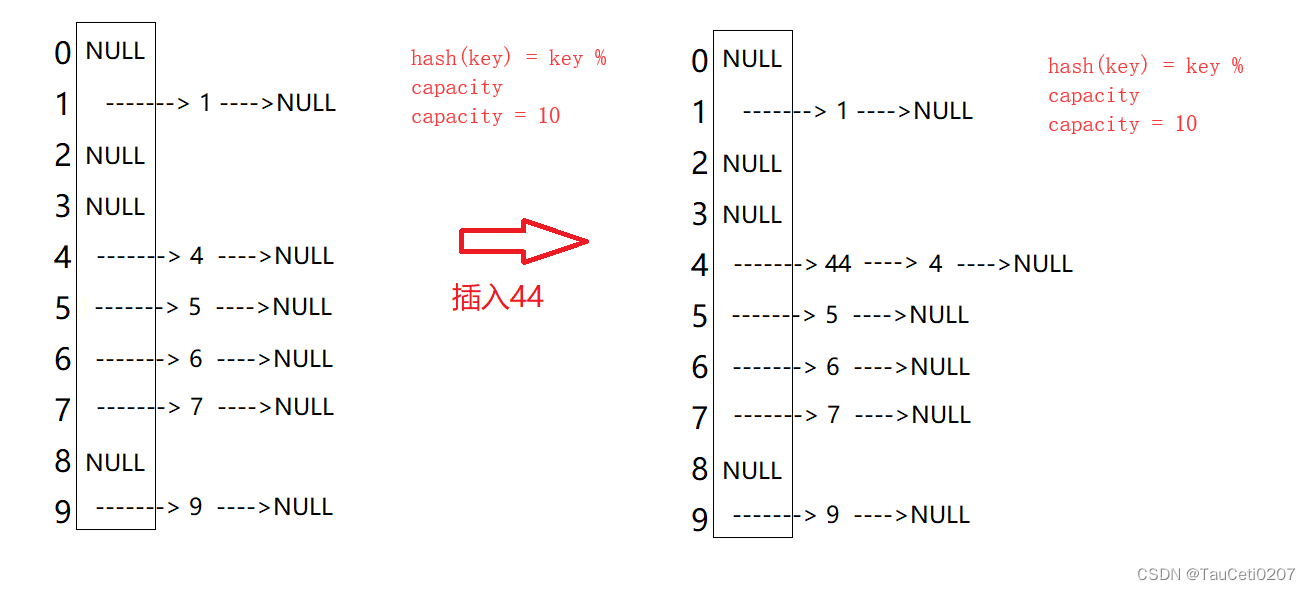

����:���ݼ���{1,7,6,4,5,9};

��ϣ��������Ϊ:hash(key) = key % capacity; capacity Ϊ�洢Ԫ�صײ�ռ��ܵĴ�С��

�ø÷��������������ؽ��ж�ιؼ���ıȽ�,����������ٶȱȽϿ졣

����˵,��ϣ/ɢ�о���һ��ӳ��

�洢�ؼ��ֺʹ洢λ�ý���������ϵ

����ֱ�ӽ���ӳ��Ҳ�����һЩ����:

1�����ݷ�Χ�ֲ��ܹ㡢���ݲ�������ô��

2��key �����ݲ�������,�� stirng ����,���Զ������Ͷ�����ô��

2.��ϣ��ͻ

������������Ԫ�صĹؼ���

k

i

k_i

ki?��

k

j

k_j

kj?(i != j),��

k

i

k_i

ki? !=

k

j

k_j

kj?,����:Hash(

k

i

k_i

ki?) == Hash(

k

j

k_j

kj?),��:��ͬ�ؼ���ͨ����ͬ��ϣ�����������ͬ�Ĺ�ϣ��ַ,

�������Ϊ��ϣ��ͻ���ϣ��ײ��

�Ѿ��в�ͬ�ؼ����������ͬ��ϣ��ַ������Ԫ�س�Ϊ��ͬ��ʡ���

3.��ϣ����

�����ϣ��ͻ��һ��ԭ�������:��ϣ������Ʋ���������

��ϣ�������ԭ��:

- ��ϣ�����Ķ�������������Ҫ�洢��ȫ���ؼ���,�����ɢ�б������� m ����ַʱ,��ֵ������� 0 �� m-1 ֮�䡣

- ��ϣ������������ĵ�ַ�ܾ��ȷֲ��������ռ��С�

- ��ϣ����Ӧ�ñȽϼ�

������ϣ����:

1��ֱ�Ӷ�ַ�� �C (����)

ȡ�ؼ��ֵ�ij�����Ժ���Ϊɢ�е�ַ:Hash(Key)= A * Key + B

�ŵ�:������

ȱ��:��Ҫ����֪���ؼ��ֵķֲ����

ʹ�ó���:�ʺϲ��ұȽ�С�����������

2������������ �C (����)

��ɢ�б��������ĵ�ַ��Ϊ m ,ȡһ�������� m ,����ӽ����ߵ��� m ������ p ��Ϊ����,���չ�ϣ����:Hash(key) = key% p(p<=m),���ؼ���ת���ɹ�ϣ��ַ

ͨ�� p ѡ����������Ĵ�С

3��ƽ��ȡ�з� �C (�˽�)

����ؼ���Ϊ 1234 ,ƽ������ 1522756 ,��ȡ�м�� 3 λ 227 ��Ϊ��ϣ��ַ;

�ٱ���ؼ���Ϊ 4321 ,ƽ������ 18671041 ,��ȡ�м�� 3 λ 671 (�� 710 )��Ϊ��ϣ��ַ��

ƽ��ȡ�з��Ƚ��ʺ�:��֪���ؼ��ֵķֲ�,��λ���ֲ��Ǻܴ�������

4���۵��� �C (�˽�)

�۵����ǽ��ؼ��ִ����ҷָ��λ����ȵļ�����(���һ����λ�����Զ�Щ),Ȼ���⼸���ֵ������,����ɢ�б�����,ȡ��λ��Ϊɢ�е�ַ��

�۵����ʺ����Ȳ���Ҫ֪���ؼ��ֵķֲ�,�ʺϹؼ���λ���Ƚ϶�����

5��������� �C (�˽�)

ѡ��һ���������,ȡ�ؼ��ֵ��������ֵΪ���Ĺ�ϣ��ַ,�� H(key) = random(key),���� random Ϊ�����������

ͨ��Ӧ���ڹؼ��ֳ��Ȳ���ʱ���ô˷�

6����ѧ�������C(�˽�)

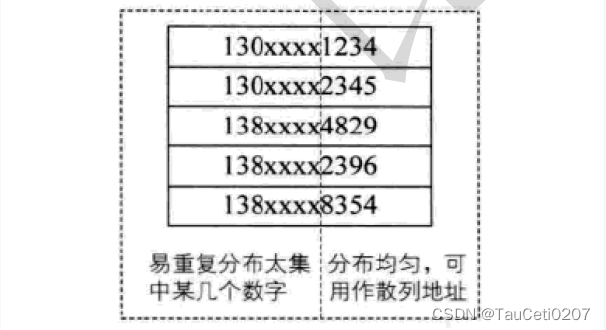

���� n �� d λ��,ÿһλ������ r �ֲ�ͬ�ķ���,�� r �ֲ�ͬ�ķ����ڸ�λ�ϳ��ֵ�Ƶ�ʲ�һ����ͬ,������ijЩλ�Ϸֲ��ȽϾ���,ÿ�ַ��ų��ֵĻ������,��ijЩλ�Ϸֲ�������ֻ��ij���ַ��ž������֡��ɸ���ɢ�б��Ĵ�С,ѡ�����и��ַ��ŷֲ����ȵ�����λ��Ϊɢ�е�ַ��

����:

����Ҫ�洢ij�ҹ�˾Ա���ǼDZ�,������ֻ�����Ϊ�ؼ���,��ô���п���ǰ 7 λ���� ��ͬ��,��ô���ǿ���ѡ��������λ��Ϊɢ�е�ַ,��������ij�ȡ���������׳��� ��ͻ,�����ԶԳ�ȡ���������ֽ��з�ת(�� 1234 �ij� 4321 )���һ�λ��

(�� 1234 �ij� 4123 )������λ��ǰ���������������(�� 1234 �ij� 12+34=46 )�ȷ�����

���ַ�����ͨ���ʺϴ����ؼ���λ���Ƚϴ�����,�������֪���ؼ��ֵķֲ��ҹؼ��ֵ�����λ�ֲ��Ͼ��ȵ����

ע��:

��ϣ������Ƶ�Խ����,������ϣ��ͻ�Ŀ����Ծ�Խ��,�����������ϣ��ͻ��

�����ϣ��ͻ���ֳ����ķ�����:��ɢ�кͿ�ɢ�С�

4.��ɢ��

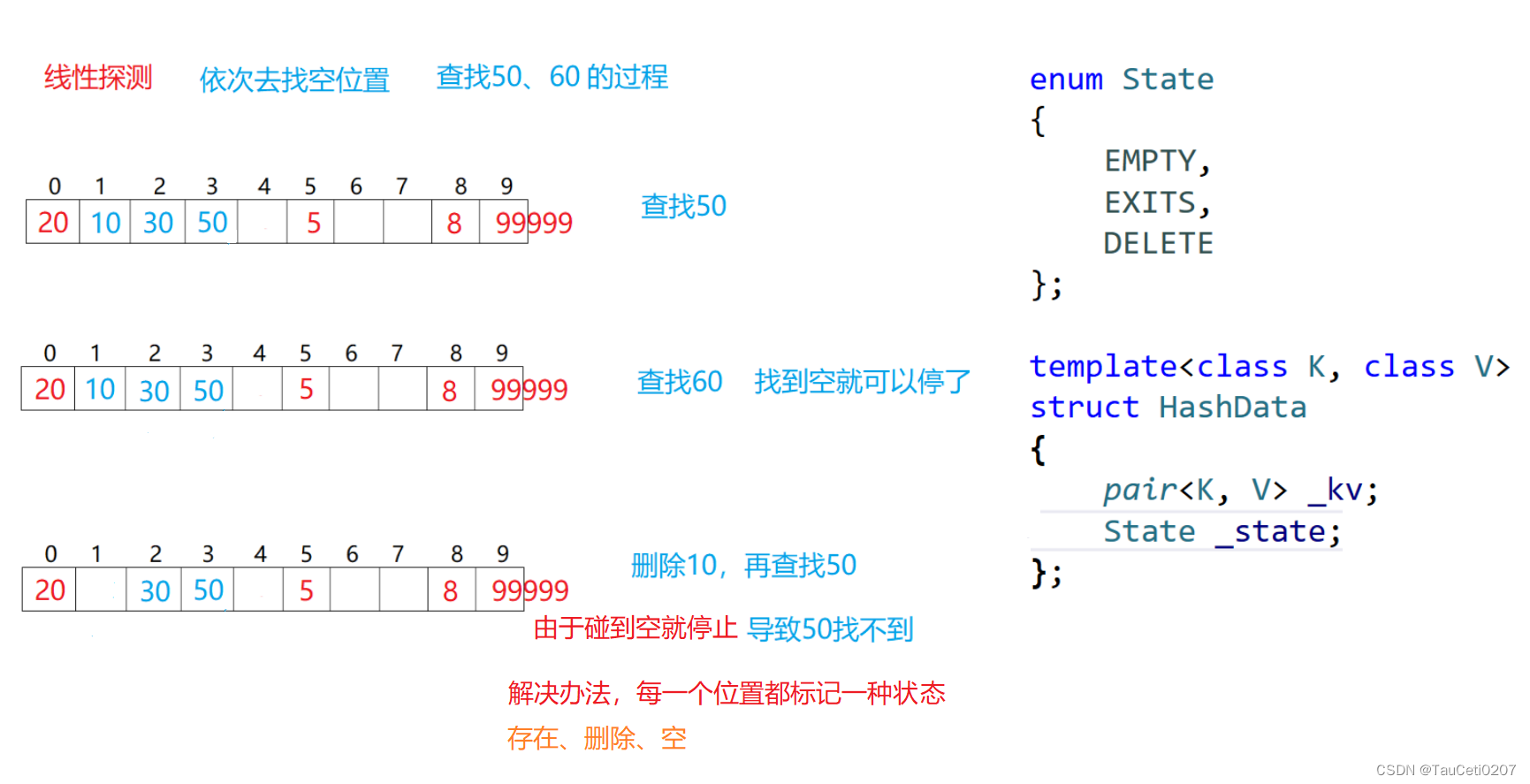

��ɢ��Ҳ�п��Ŷ�ַ��,��������ϣ��ͻʱ,�����ϣ��δ��װ��,˵���ڹ�ϣ���б�Ȼ���п�λ��,��ô���� key ��ŵ���ͻλ���еġ���һ���� ��λ����ȥ��

����ͨ������̽������̽��Ѱ����һ����λ�á�

����̽��

��Ҫɾ����ɢ����ij��Ԫ��ʱ,����ֱ������ɾ��,���ֱ������ɾ����(�ÿ�ɶ��),��Ӱ�����,�Ҳ���������ֵ��

����:

���ɾ���� 10,��ȥ���� 50,���� 10 �� 50 ǰ��,��˻��� 10 ��λ�þ�ͣ����,���Ҳ��� 50 �ˡ�

����̽��ʵ�������Ƚϼ�,����ȱ��Ҳ�Ƚ����ԡ�

����̽��ȱ��:һ��������ϣ��ͻ,���еij�ͻ����һ��,���ײ������ݡ��ѻ���,��:��ͬ�ؼ���ռ���˿����õĿ�λ��,��������,ʹ��Ѱ��ij�ؼ����λ����Ҫ����αȽ�,��������Ч�ʽ��͡�

����̽��

����̽���ҿ�λ�õķ�ʽ���ǰ����������ȥ��,������̽��Ϊ�˱�������̽�����ӵ�µ�����,����һ����λ�õķ���Ϊ:

H

i

H_i

Hi? = (

H

0

H_0

H0? +

i

2

i^2

i2 ) % m , ����

H

i

H_i

Hi? = (

H

0

H_0

H0? -

i

2

i^2

i2 ) % m������:i = 1,2,3��

H

0

H_0

H0?��ͨ��ɢ�к��� Hash(x) ��Ԫ�صĹؼ��� key ���м���õ���λ��,m �DZ��Ĵ�С��

�����:

�����ij���Ϊ�����ұ�װ������ a ������ 0.5 ʱ,�µı���һ���ܹ�����,�����κ�һ��λ�ö����ᱻ̽�����Ρ����ֻҪ������һ��Ŀ�λ��,�Ͳ�����ڱ��������⡣������ʱ���Բ����DZ�װ�������,���ڲ���ʱ����ȷ������װ������ a ������ 0.5,����������뿼�����ݡ�

��������Ҳ�͵��±�ɢ�еĿռ������ʱȽϵ͡�

insert

bool Insert(const pair<K, V>& kv)

{

size_t starti = kv.first;

starti %= _tables.size(); // �������size������capacity,��Ϊ���ģcapacity,

// ���starti���ܳ���size�ķ�Χ,������

size_t hashi = starti;

size_t i = 1;

while (_tables[hashi]._state == EXITS) // ����ɾ��ʱҲ�ü�������

{

hasi = starti + i; // ����̽��,����i*i�ͱ�ɶ���̽��

i++;

hashi %= _tables.size(); // һֱ++�����ܳ���size�Ľ���

}

_tables[hashi]._kv = kv; // ����ʱ�ͱ�ʾ�ҵ��յ�λ�� EMPTY����DELETE

_tables[hashi]._state = EXITS;

}

����������Ѿ�����,�ͻ�һֱѭ����ȥ�ҡ�

���߱��ӽ�����,���Һܾ�,Ч�ʼ��͡�

�������������ӵĸ���:

��Ҫ���ǵ��ų��������ݡ�

bool Insert(const pair<K, V>& kv)

{

if (Find(kv.first) != nullptr) // �ų�����ֵ

return false;

// ��������>0.7������

if (_tables.size() == 0 || _n * 10 / _tables.size() >= 7)

{

size_t newSize = _tables.size() == 0 ? 10 : _tables.size() * 2;

// �����Ժ� ӳ���ϵ�ᷢ���仯�� ����ԭ��10ӳ�䵽0,���ݵ�20���ռ��,10Ӧ��ӳ�䵽10

// �������֮����Ҫ����ӳ��

// �����ִ�д�� ����insertȻ����swap

HashTable<K, V> newHT;

newHT._tables.resize(newSize);

// �����ɱ�����newHT

for (auto& e : _tables)

if (e._state == EXITS)

newHT.Insert(e._kv);

newHT._tables.swap(_tables);

}

size_t starti = kv.first;

starti %= _tables.size(); // �������size������capacity,��Ϊ���ģcapacity,

// ���starti���ܳ���size�ķ�Χ,������

size_t hashi = starti;

size_t i = 1;

while (_tables[hashi]._state == EXITS) // ����ɾ��ʱҲ�ü�������

{

hashi = starti + i; // ����̽��,����i*i�ͱ�ɶ���̽��

i++;

hashi %= _tables.size(); // һֱ++�����ܳ���size�Ľ���

}

_tables[hashi]._kv = kv; // ����ʱ�ͱ�ʾ�ҵ��յ�λ�� EMPTY����DELETE

_tables[hashi]._state = EXITS;

_n++;

return true;

}

Find&Erase

Find ��ʱ��Ҫ���ǿձ�,����Ԫ���Ѿ��� delete

Erase ֮��ע��Ҫ�� _n

Data* Find(const K& key)

{

if (_tables.size() == 0) // �ձ����ؿ�

return nullptr;

size_t starti = key;

starti %= _tables.size();

size_t hashi = starti;

size_t i = 1;

while (_tables[hashi]._state != EMPTY)

{

// �Ѿ�delete��ֵ����ȥ��

if (_tables[hashi]._state != DELETE && _tables[hashi]._kv.first == key)

return &_tables[hashi]; // �ҵ��ص���Data*

hashi = starti + i;

i++;

hashi %= _tables.size();

}

return nullptr;

}

bool Erase(const K& key)

{

Data* ret = Find(key);

if (ret != nullptr)

{

ret->_state = DELETE;

--_n;

return true;

}

else

return false;

}

void TestHT1()

{

int a[] = { 20, 5, 8, 99999, 10, 30, 50 };

//HashTable<int, int, DefaultHash<int>> ht;

HashTable<int, int> ht;

for (auto e : a)

{

ht.Insert(make_pair(e, e));

}

��������

//ht.Insert(make_pair(15, 15));

//ht.Insert(make_pair(5, 5));

//ht.Insert(make_pair(15, 15));

if (ht.Find(50))

{

cout << "�ҵ���50" << endl;

}

if (ht.Find(10))

{

cout << "�ҵ���10" << endl;

}

ht.Erase(10);

ht.Erase(10);

if (ht.Find(50))

{

cout << "�ҵ���50" << endl;

}

if (ht.Find(10))

{

cout << "�ҵ���10" << endl;

}

//�ҵ���50

//�ҵ���10

//�ҵ���50

}

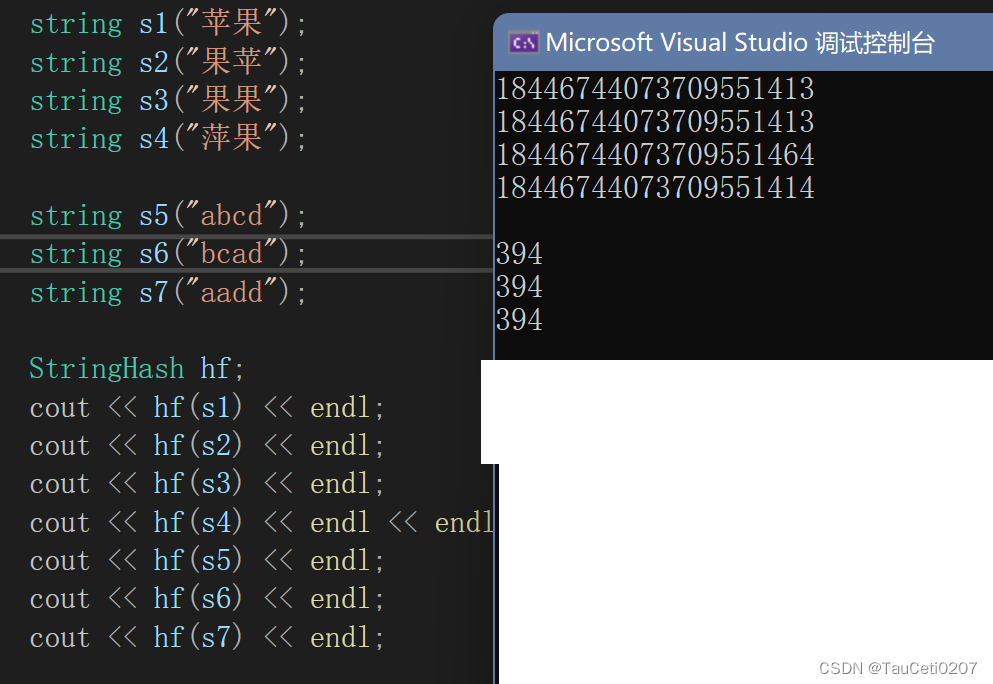

key �� sting���Զ������

��� key �� string ʱ,��ֱ��ǿת������,Ҳ����ӳ���ˡ�

�����º�����ɲ���,ȡ string ��һ���ַ�ǿת�� size_t ��

����ֱ�ӽ� string �����һ���ַ�ǿת������������ӳ�䡣

�����������ظ���,������ϣ��ͻ��

���� ��abcd�� ��aabd�� ��ƻ�� 1�� ��ƻ�� 2��

�Ż�һ��,��ÿһ���ַ�����������ת���� size_t

struct StringHash

{

size_t operator()(const string& key)

{

//return key[0]; // ���׳�ͻ

size_t hash = 0;

for (auto ch : key)

hash += ch;

return hash;

}

};

�������������������,ÿ���ַ��������� ascii ��Ҳ���п�����ͬ��,��Ȼ˵��ͻ���ɱ���,�����ֳ�ͻ���Ǿ����ܼ��ٱȽϺá�

���� ��abba�� ��baba�� ����abcd�� ��aadd�� �����ͻ

Ϊ��,ר�������о��� �ַ�����ϣ�㷨

����,C ����֮�������Ľ����ʽ��:

struct StringHash

{

size_t operator()(const string& key)

{

//return key[0]; // ���׳�ͻ

/*size_t hash = 0;

for (auto ch : key)

hash += ch;

return hash;*/ // ���ǻ��г�ͻ

// BKDR ���ַ�����ϣ�㷨

size_t hash = 0;

for (auto ch : key)

hash = hash * 131 + ch;

return hash;

}

};

�����������ǽ�� key ���ַ���������,������Զ���� Student��Date ������,ͬ��ȥ�Լ�д�и� StudentHash��DateHash,���ú�Ψһ��ʶ��,����ѧ�š�����֤�Ż���ƴ�Ӷ����ʶ��,����רҵ+�༶+�����ȵȡ�

// ��Ӧ������һ���º���,�º�������ʵ�ְ�key����ת����ӳ�������

HashTable<Date, int, DateHash> countHT;

HashTable<Student, int, StudentHash> countHT;

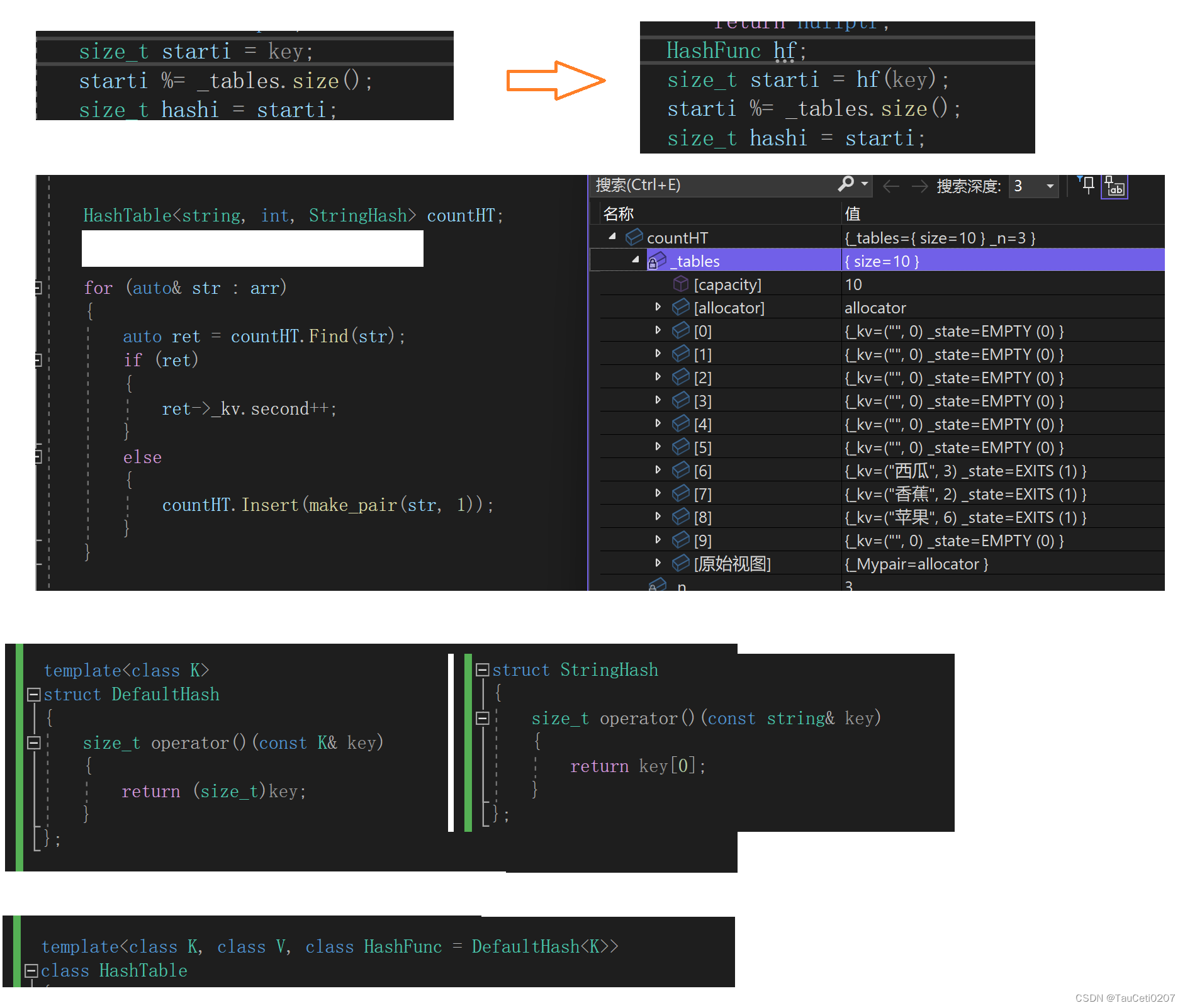

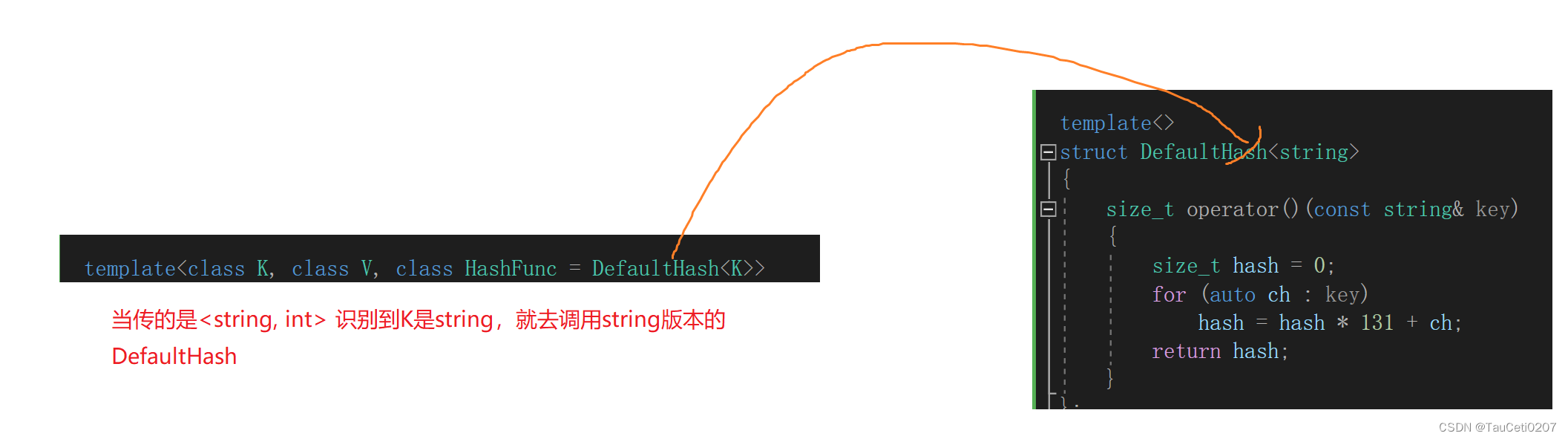

�������ÿ�ε��û�������ȥ����Ӧ�� Hash ������?

����ģ���ػ�!��� string,���� string �汾�� DefaultHash ��

template<class K>

struct DefaultHash

{

size_t operator()(const K& key)

{

return (size_t)key;

}

};

template<>

struct DefaultHash<string>

{

size_t operator()(const string& key)

{

size_t hash = 0;

for (auto ch : key)

hash = hash * 131 + ch;

return hash;

}

};

void TestHT2()

{

string arr[] = { "ƻ��", "����", "ƻ��", "����", "ƻ��", "ƻ��", "����", "ƻ��", "�㽶", "ƻ��", "�㽶" };

string s1("ƻ��");

string s2("��ƻ");

string s3("����");

string s4("Ƽ��");

string s5("abcd");

string s6("bcad");

string s7("aadd");

StringHash hf;

cout << hf(s1) << endl;

cout << hf(s2) << endl;

cout << hf(s3) << endl;

cout << hf(s4) << endl << endl;

cout << hf(s5) << endl;

cout << hf(s6) << endl;

cout << hf(s7) << endl;

//HashTable<string, int, StringHash> countHT;

HashTable<string, int> countHT; // ȱʡ

for (auto& str : arr)

{

auto ret = countHT.Find(str);

if (ret)

{

ret->_kv.second++;

}

else

{

countHT.Insert(make_pair(str, 1));

}

}

// ��Ӧ������һ���º���,�º�������ʵ�ְ�key����ת����ӳ�������

//HashTable<Date, int, DateHash> countHT;

//HashTable<Student, int, StudentHash> countHT;

//HashTable<string, int> copy(countHT);

}

ע��,���Dz���Ҫȥд HashTable �Ĺ��졢��������������,���Զ������Զ�������Ĭ�ϳ�Ա���������Ӧ������

Դ����

#pragma once

#include <vector>

#include<iostream>

#include <set>

#include <map>

#include <unordered_set>

#include <unordered_map>

#include <time.h>

using namespace std;

namespace closeHash // ��ɢ��

{

enum State

{

EMPTY,

EXITS,

DELETE

};

template<class K, class V>

struct HashData

{

pair<K, V> _kv;

State _state = EMPTY;

};

template<class K>

struct DefaultHash

{

size_t operator()(const K& key)

{

return (size_t)key;

}

};

template<>

struct DefaultHash<string>

{

size_t operator()(const string& key)

{

size_t hash = 0;

for (auto ch : key)

hash = hash * 131 + ch;

return hash;

}

};

struct StringHash

{

size_t operator()(const string& key)

{

//return key[0]; // ���׳�ͻ

/*size_t hash = 0;

for (auto ch : key)

hash += ch;

return hash;*/ // ���ǻ��г�ͻ

// BKDR ���ַ�����ϣ�㷨

size_t hash = 0;

for (auto ch : key)

hash = hash * 131 + ch;

return hash;

}

};

template<class K, class V, class HashFunc = DefaultHash<K>>

class HashTable

{

typedef HashData<K, V> Data;

public:

bool Insert(const pair<K, V>& kv)

{

if (Find(kv.first) != nullptr) // �ų�����ֵ

return false;

// ��������>0.7������

if (_tables.size() == 0 || _n * 10 / _tables.size() >= 7)

{

size_t newSize = _tables.size() == 0 ? 10 : _tables.size() * 2;

// �����Ժ� ӳ���ϵ�ᷢ���仯�� ����ԭ��10ӳ�䵽0,���ݵ�20���ռ��,10Ӧ��ӳ�䵽10

// �������֮����Ҫ����ӳ��

// �����ִ�д�� ����insertȻ����swap

HashTable<K, V, HashFunc> newHT;

newHT._tables.resize(newSize);

// �����ɱ�����newHT

for (auto& e : _tables)

if (e._state == EXITS)

newHT.Insert(e._kv);

newHT._tables.swap(_tables);

}

HashFunc hf;

size_t starti = hf(kv.first);

starti %= _tables.size(); // �������size������capacity,��Ϊ���ģcapacity,

// ���starti���ܳ���size�ķ�Χ,������

size_t hashi = starti;

size_t i = 1;

while (_tables[hashi]._state == EXITS) // ����ɾ��ʱҲ�ü�������

{

hashi = starti + i; // ����̽��,����i*i�ͱ�ɶ���̽��

i++;

hashi %= _tables.size(); // һֱ++�����ܳ���size�Ľ���

}

_tables[hashi]._kv = kv; // ����ʱ�ͱ�ʾ�ҵ��յ�λ�� EMPTY����DELETE

_tables[hashi]._state = EXITS;

_n++;

return true;

}

Data* Find(const K& key)

{

if (_tables.size() == 0) // �ձ����ؿ�

return nullptr;

HashFunc hf;

size_t starti = hf(key);

starti %= _tables.size();

size_t hashi = starti;

size_t i = 1;

while (_tables[hashi]._state != EMPTY)

{

// �Ѿ�delete��ֵ����ȥ��

if (_tables[hashi]._state != DELETE && _tables[hashi]._kv.first == key)

return &_tables[hashi]; // �ҵ��ص���Data*

hashi = starti + i;

i++;

hashi %= _tables.size();

}

return nullptr;

}

bool Erase(const K& key)

{

Data* ret = Find(key);

if (ret != nullptr)

{

ret->_state = DELETE;

--_n;

return true;

}

else

return false;

}

private:

// ע��,hashTable����Ҫ�����Լ�д���졢��������������,����ȥ����vector�Լ��������Ӧ����

vector<Data> _tables;

size_t _n = 0; // �洢����Ч�ؼ��ָ��� ����ȱʡ�����Ͳ���Ҫ��д��Ĭ�Ϲ�����

};

void TestHT1()

{

int a[] = { 20, 5, 8, 99999, 10, 30, 50 };

//HashTable<int, int, DefaultHash<int>> ht;

HashTable<int, int> ht;

for (auto e : a)

{

ht.Insert(make_pair(e, e));

}

��������

//ht.Insert(make_pair(15, 15));

//ht.Insert(make_pair(5, 5));

//ht.Insert(make_pair(15, 15));

if (ht.Find(50))

{

cout << "�ҵ���50" << endl;

}

if (ht.Find(10))

{

cout << "�ҵ���10" << endl;

}

ht.Erase(10);

ht.Erase(10);

if (ht.Find(50))

{

cout << "�ҵ���50" << endl;

}

if (ht.Find(10))

{

cout << "�ҵ���10" << endl;

}

//�ҵ���50

//�ҵ���10

//�ҵ���50

}

void TestHT2()

{

string arr[] = { "ƻ��", "����", "ƻ��", "����", "ƻ��", "ƻ��", "����", "ƻ��", "�㽶", "ƻ��", "�㽶" };

string s1("ƻ��");

string s2("��ƻ");

string s3("����");

string s4("Ƽ��");

string s5("abcd");

string s6("bcad");

string s7("aadd");

StringHash hf;

cout << hf(s1) << endl;

cout << hf(s2) << endl;

cout << hf(s3) << endl;

cout << hf(s4) << endl << endl;

cout << hf(s5) << endl;

cout << hf(s6) << endl;

cout << hf(s7) << endl;

//HashTable<string, int, StringHash> countHT;

HashTable<string, int> countHT; // ȱʡ

for (auto& str : arr)

{

auto ret = countHT.Find(str);

if (ret)

{

ret->_kv.second++;

}

else

{

countHT.Insert(make_pair(str, 1));

}

}

// ��Ӧ������һ���º���,�º�������ʵ�ְ�key����ת����ӳ�������

//HashTable<Date, int, DateHash> countHT;

//HashTable<Student, int, StudentHash> countHT;

HashTable<string, int> copy(countHT); // ��ɵ������,����vector��������

}

}

5.��ɢ��

��ɢ�з��ֽ�����ַ��(������),���ȶԹؼ��뼯����ɢ�к�������ɢ�е�ַ,������ͬ��ַ�Ĺؼ������ͬһ�Ӽ���,ÿһ���Ӽ��ϳ�Ϊһ��Ͱ,����Ͱ�е�Ԫ��ͨ��һ����������������,��������ͷ���洢�ڹ�ϣ���С�

��ʵ������ϣͰ��

��ɢ����ÿ��Ͱ�зŵĶ��Ƿ�����ϣ��ͻ��Ԫ�ء�

insert

bool Insert(const pair<K, V>& kv)

{

if (Find(kv.first)) // Eliminate redundant

return false;

// load factor == 1,expand capacity.

// that is,one node per bucket on average

/*if (_tables.size() == _n)

{

size_t newSize = _tables.size() == 0 ? 10 : _tables.size() * 2;

HashTable<K, V> newHT;

newHT._tables.resize(newSize, nullptr);

// traverse old table,insert into new table

for (size_t i = 0; i < _tables.size(); ++i)

{

Node* cur = _tables[i];

while (cur)

{

newHT.Insert(cur->_kv);

cur = cur->_next;

}

}

// contemporary writing method

newHT._tables.swap(_tables); // swap the vector

}*/

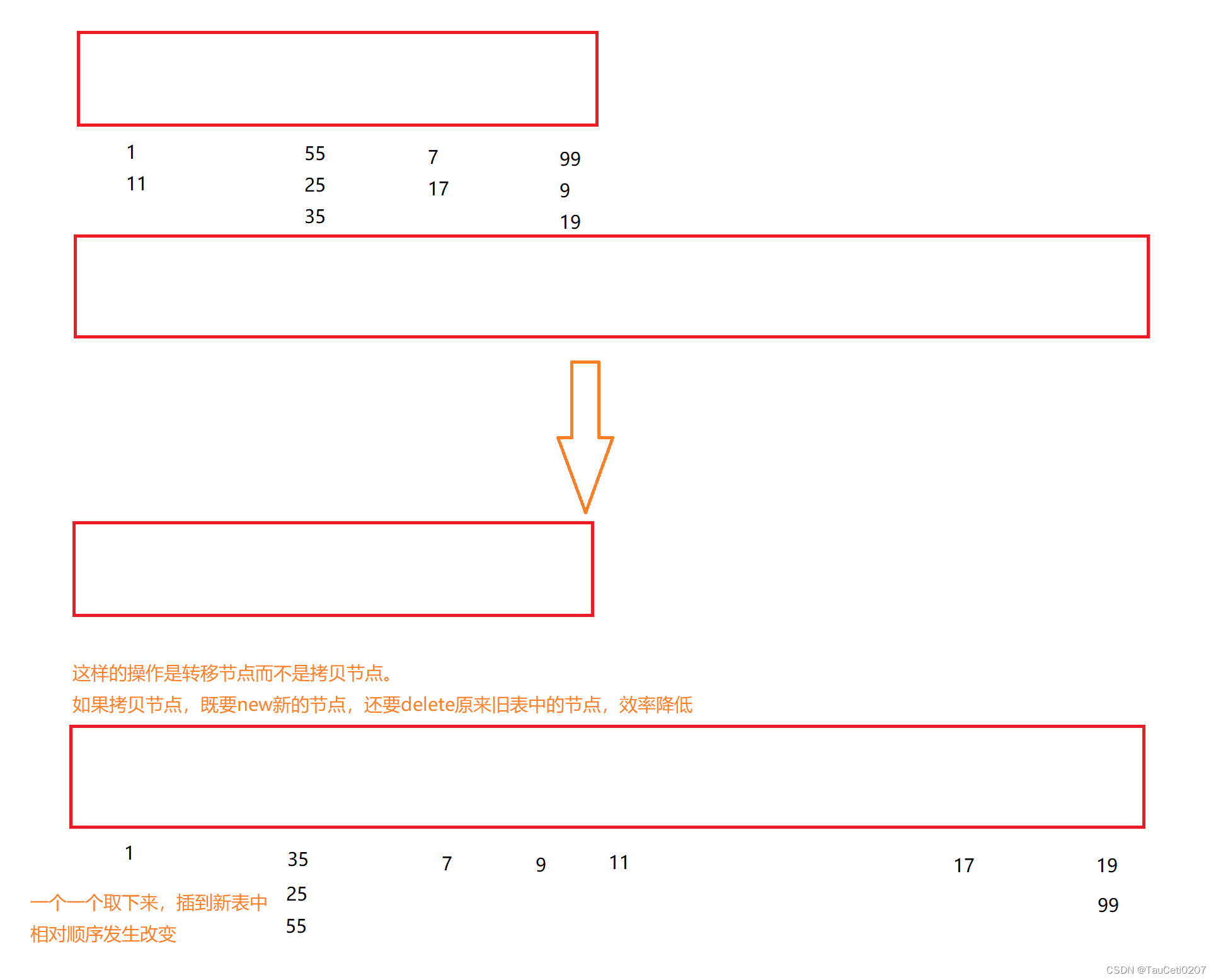

// above implement of expand capacity is copy nodes,

// New nodes are created and old nodes are deleted --> decrease efficiency

if (_tables.size() == _n)

{

size_t newSize = _tables.size() == 0 ? 10 : _tables.size() * 2;

vector<Node*> newTables;

newTables.resize(newSize, nullptr);

for (size_t i = 0; i < _tables.size(); ++i)

{

Node* cur = _tables[i];

while (cur) // head-insert

{

Node* next = cur->_next;

size_t hashi = cur->_kv.first % newSize;

cur->_next = newTables[hashi];

newTables[hashi] = cur;

cur = next; // update cur

}

_tables[i] = nullptr;

}

newTables.swap(_tables);

}

size_t hashi = kv.first;

hashi %= _tables.size();

// head-insert to the bucket counterpart

Node* newNode = new Node(kv);

newNode->_next = _tables[hashi];

_tables[hashi] = newNode;

++_n; // increase size

return true;

}

erase

bool Erase(const K& key)

{

if (_tables.size() == 0)

return false;

size_t hashi = key;

hashi %= _tables.size();

Node* prev = nullptr;

Node* cur = _tables[hashi];

while (cur)

{

if (cur->_kv.first == key)

{

// prev cur cur->next

if (prev == nullptr)

_tables[hashi] = cur->_next;

else

prev->_next = cur->_next;

delete cur;

--_n;

return true;

}

prev = cur;

cur = cur->_next;

}

return false;

}

��������� prev ��� delete ��?

���ǵ�����,�������滻��ɾ����

Ҳ������һ���ڵ��ֵ���� cur,Ȼ��ɾ�� cur��

��������

���� vector �е������� Node*,��������,���������ʱ����Ҫ�ֶ��ͷ�,���������ʱ��Ҳ��Ҫ�ֶ����һ���ڵ�һ���ڵ���������

HashTable(const HashTable<K, V, HashFunc>& ht)

{

_tables.resize(ht._tables.size());

for (int i = 0; i < ht._tables.size(); i++)

{

Node* cur = ht._tables[i];

while (cur)

{

Node* tmp = new Node(cur->_kv);

tmp->_next = _tables[i];

_tables[i] = tmp;

_n++;

cur = cur->_next;

}

}

}

Դ����

namespace HashBucket

{

template<class K, class V>

struct HashNode

{

pair<K, V> _kv;

HashNode<K, V>* _next;

HashNode(const pair<K, V>& kv)

:_kv(kv)

, _next(nullptr)

{}

};

template<class K>

struct DefaultHash

{

size_t operator()(const K& key)

{

return (size_t)key;

}

};

template<>

struct DefaultHash<string>

{

size_t operator()(const string& key)

{

size_t hash = 0;

for (auto ch : key)

hash = hash * 131 + ch;

return hash;

}

};

template<class K, class V, class HashFunc = DefaultHash<K>>

class HashTable

{

typedef HashNode<K, V> Node;

public:

// vector free itself,but the node in the vector need free mannually

// these nodes are pointer , built-in type

~HashTable()

{

for (size_t i = 0; i < _tables.size(); ++i)

{

// delete every bucket

Node* cur = _tables[i];

while (cur)

{

Node* next = cur->_next;

delete cur;

cur = next;

}

_tables[i] = nullptr;

}

}

HashTable()

:_tables(0, nullptr)

, _n(0)

{}

HashTable(const HashTable<K, V, HashFunc>& ht)

{

_tables.resize(ht._tables.size());

for (int i = 0; i < ht._tables.size(); i++)

{

Node* cur = ht._tables[i];

while (cur)

{

Node* tmp = new Node(cur->_kv);

tmp->_next = _tables[i];

_tables[i] = tmp;

_n++;

cur = cur->_next;

}

}

}

HashTable<K, V, HashFunc> operator=(HashTable<K, V, HashFunc> ht)

{

if (this != &ht)

{

swap(_tables, ht._tables);

swap(_n, ht._n);

}

return *this;

}

bool Insert(const pair<K, V>& kv)

{

if (Find(kv.first)) // Eliminate redundant

return false;

// load factor == 1,expand capacity.

// that is,one node per bucket on average

/*if (_tables.size() == _n)

{

size_t newSize = _tables.size() == 0 ? 10 : _tables.size() * 2;

HashTable<K, V> newHT;

newHT._tables.resize(newSize, nullptr);

// traverse old table,insert into new table

for (size_t i = 0; i < _tables.size(); ++i)

{

Node* cur = _tables[i];

while (cur)

{

newHT.Insert(cur->_kv);

cur = cur->_next;

}

}

// contemporary writing method

newHT._tables.swap(_tables); // swap the vector

}*/

// above implement of expand capacity is copy nodes,

// New nodes are created and old nodes are deleted --> decrease efficiency

HashFunc hf;

if (_tables.size() == _n)

{

size_t newSize = _tables.size() == 0 ? 10 : _tables.size() * 2;

vector<Node*> newTables;

newTables.resize(newSize, nullptr);

for (size_t i = 0; i < _tables.size(); ++i)

{

Node* cur = _tables[i];

while (cur) // head-insert

{

Node* next = cur->_next;

size_t hashi = hf(cur->_kv.first) % newSize;

cur->_next = newTables[hashi];

newTables[hashi] = cur;

cur = next; // update cur

}

_tables[i] = nullptr;

}

newTables.swap(_tables);

}

size_t hashi = hf(kv.first);

hashi %= _tables.size();

// head-insert to the bucket counterpart

Node* newNode = new Node(kv);

newNode->_next = _tables[hashi];

_tables[hashi] = newNode;

++_n; // increase size

return true;

}

Node* Find(const K& key)

{

if (_tables.size() == 0)

return nullptr;

HashFunc hf;

size_t hashi = hf(key);

// size_t hashi = HashFunc()(key); // anonymous object

hashi %= _tables.size();

Node* cur = _tables[hashi];

while (cur)

{

if (cur->_kv.first == key)

return cur;

cur = cur->_next;

}

return nullptr;

}

bool Erase(const K& key)

{

if (_tables.size() == 0)

return false;

HashFunc hf;

size_t hashi = hf(key);

hashi %= _tables.size();

Node* prev = nullptr;

Node* cur = _tables[hashi];

while (cur)

{

if (cur->_kv.first == key)

{

// prev cur cur->next

if (prev == nullptr)

_tables[hashi] = cur->_next;

else

prev->_next = cur->_next;

delete cur;

--_n;

return true;

}

prev = cur;

cur = cur->_next;

}

return false;

}

private:

vector<Node*> _tables;

size_t _n = 0;

};

void TestHashBucket1()

{

int a[] = { 20, 5, 8, 99999, 10, 30, 50 };

HashTable<int, int> ht;

if (ht.Find(10))

{

cout << "�ҵ���10" << endl;

}

for (auto e : a)

{

ht.Insert(make_pair(e, e));

}

// test expand capacity

ht.Insert(make_pair(15, 15));

ht.Insert(make_pair(5, 5));

ht.Insert(make_pair(15, 15));

ht.Insert(make_pair(25, 15));

ht.Insert(make_pair(35, 15));

ht.Insert(make_pair(45, 15));

}

void TestHashBucket2()

{

string arr[] = { "ƻ��", "����", "ƻ��", "����", "ƻ��", "ƻ��", "����", "ƻ��", "�㽶", "ƻ��", "�㽶" };

//HashTable<string, int, StringHash> countHT;

HashTable<string, int> countHT; // ȱʡ

for (auto& str : arr)

{

auto ret = countHT.Find(str);

if (ret)

{

ret->_kv.second++;

}

else

{

countHT.Insert(make_pair(str, 1));

}

}

// ��Ӧ������һ���º���,�º�������ʵ�ְ�key����ת����ӳ�������

//HashTable<Date, int, DateHash> countHT;

//HashTable<Student, int, StudentHash> countHT;

// ��Ҫ�ֶ�ʵ�����

HashTable<string, int> copy(countHT);

HashTable<string, int> copy2;

copy2.Insert(make_pair("abcd", 1234));

copy2.Insert(make_pair("acd", 1234));

copy2.Insert(make_pair("cd", 1234));

copy2 = copy; // ��ֵ���ر�������Ѿ��еĶ�����ܽи�ֵ����

}

}

�

🌹🌹🌹

д�IJ���,����а�����������~ 👍👍👍

Thanks?(・��・)ノ🌹🌹🌹

😘😘😘

👀👀���ڱ���ˮƽ����,�ڽ��IJ������������ִ���֮��,���˷dz�ϣ����������ִ���,����������������,ϣ���ʹ��һ��ѧϰ,һ������c( ̄�� ̄( ̄�� ̄��)�f,�ڴ������������ۡ�

��GitHub�ֿ�����