robots.txt��

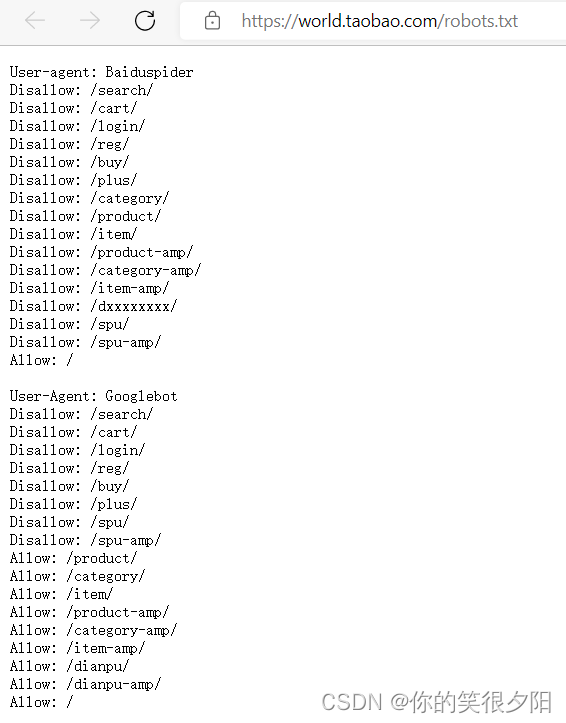

- robots.txt,��֮Ϊ����Э��,����涨����Щ��Ϣ������ȡ,��Щ��Ϣ��������ȡ.�������Ա�Ϊ��,����չʾ.

�C

��������������� www.taobao.com/robots.txt �����ַ,���ȥ�Ϳ��Բ�ѯ�����txt�ļ�������,����չʾ����txt����.

http��

-

����

�����������û�֮���һ�ֽ������ݽ�����ʽ -

��������ͷ��Ϣ

�CUse-Agent ----�����������ݱ�ʶ

�CConnection ----�������֮���ǶϿ����ӻ��DZ������� -

������Ӧͷ��Ϣ

�CContent-Type ---- ��������Ӧ�ؿͻ��˵���������

https��

- ����

�C��ȫ��httpЭ��,�������ݽ��м���. - ���ܷ�ʽ

�C�Գ���Կ����

�C�ǶԳ���Կ����

�C֤����Կ����

| �˽������ϵĻ�����Ϣ,��Ҫ������벿����|

requestsģ��

-����python����������ģ��,����ǿ��,���,Ч�ʸ�!!!

- ���ʹ��

�Cָ��url

�C��������

�C��ȡ��Ӧ����

�C�־û��洢 - ������װ

�Cpip install requests - ʵս����

�C����1:��ȡ�ѹ���ҳ������ www.sougou.com

# 1��ָ��url

url = 'https://www.sogou.com/'

# 2����������,get�������Ӧ����

response = requests.get(url=url)

# 3����ȡ��Ӧ����

page_text=response.text

print(page_text)

# 4���־û��洢

with open('./sougou.html','w',encoding='utf-8') as fh:

fh.write(page_text)

print('��ȡ���ݽ���!!!')

�C����2:��ҳ�ɼ���

�CUA���������,����һ��heads,�÷�������Ϊ�����������������

# UAαװ

#UA---Use-Agent

import requests

url='https://www.sogou.com/web'

# UAαװ

headers={'User-Agent': 'Mozilla/5.0 (iPhone; CPU iPhone OS 7_0_4 like Mac OS X) AppleWebKit/537.51.1 (KHTML, like Gecko) CriOS/31.0.1650.18 Mobile/11B554a Safari/8536.25'}

# ����urlЯ���IJ���:��װ���ֵ���

kw = input('enter a word:')

params={

'query':kw

}

# ��ָ����url��������

response = requests.get(url=url,params=params,headers=headers)

fileName=kw+'.html'

page_text = response.text

with open(fileName,'w',encoding='utf-8') as fp:

fp.write(page_text)

print(fileName,'��ȡ�ɹ�!!')

- ������:�ƽ�ٶȷ���

�Cpost����(������)

�C��Ӧ������һ��json����

"""

import requests

import json

# 1��ָ��URL

post_url ='https://miao.baidu.com/abdr?_o=https%3A%2F%2Ffanyi.baidu.com'

# 2��post�����������

wd=input('enter a word :')

data = {

'kw':'wd'

}

#3������UAαװ

headers = {"User-Agent":'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/101.0.4951.54 Safari/537.36 Edg/101.0.1210.39'}

# 4��������

response = requests.post(url=post_url,data=data,headers=headers)

# 5����ȡ��Ӧ����

dic_obj=response.json()

#6���־û�����

fp=open('./dog.json','w',encoding='utf-8')

json.dump(obj=dic_obj,fp=fp,ensure_ascii=False)

print('over!!!')

-������:�����Ӱ���а�

import json

import requests

url = 'https://movie.douban.com/j/chart/top_list?'

params = {

'type': '24',

'interval_id': '100:90',

'action': '',

'start': '0', # �ӿ��еĵڼ�����Ӱ��ʼȡ

'limit': '20' # ÿ��ȡ���ٸ�

}

headers = {

"User-Agent": 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/101.0.4951.54 Safari/537.36 Edg/101.0.1210.39'

}

response = requests.get(url=url,params=params,headers=headers)

list_data=response.json()

fp=open('./douban.json','w',encoding='utf-8')

json.dump(obj=list_data,fp=fp,ensure_ascii=False)

print('over!!!')

�CȻ������ҳ������json,���Ի��json������,���Ʊ���õ�json�ļ��Ĵ���,�Ϳ��Կ�����������չʾ���·���

�C��һ����Ӱ����������,һ����ȡ20����Ӱ,�ı���ȡ��Ӱ�Ķ���,���Ը��ݴ��������limit���������ڡ�

�C��ȡ����������ҳ����һ��.