Http���

����Э�����֪ʶ��ο��������

����Ϊ����ʱ�䡶��HTTPЭ�顷ѧϰ�ʼ�,������Ҫ��֧��ԭ��

�㡢����Ŀ¼

���µ�ַ

- ���˲���-CSDN��ַ:https://blog.csdn.net/liyou123456789

- ���˲���-GiteePages:https://bluecusliyou.gitee.io/techlearn

����ֿ��ַ

һ������

1������

? HTTP�dz��ı�����Э��(Ӣ��:HyperText Transfer Protocol)��HTTP �ǹ�������������Ҫ��������,��û��ʵ��,�������������ļ�����ʵ��,��ͬʱ���༼��Ҳ������������

- Э��:HTTP ��һ�����ڼ�����������Э�顣��ʹ�ü�����ܹ����������ȷ����һ�ּ����֮�佻��ͨ�ŵĹ淶,�Լ���صĸ��ֿ��ƺʹ�������ʽ��

- ����:HTTP ר������������֮�䴫������,�������ڹ㲥��Ѱַ��·�ɡ�

- ���ı�:HTTP ����������֡�ͼƬ����Ƶ����Ƶ�ȳ��ı����ݡ�

2����ʷ

(1)HTTP����

? 1989 ��,��ְ��ŷ�����о�����(CERN)�ĵ�ķ������˹ - ��(Tim Berners-Lee)������һƪ����,������ڻ������Ϲ����������ĵ�ϵͳ�Ĺ��롣��ƪ��������ȷ��������ؼ�������

- URI:��ͳһ��Դ��ʶ��,��Ϊ����������Դ��Ψһ����;

- HTML:�����ı��������,�������ı��ĵ�;

- HTTP:�����ı�����Э��,�������䳬�ı���

(2)HTTP/0.9

? ����汾��1991�귢����0.9�档�ð汾�����,ֻ��һ������GET��

? TCP ����(connection)������,�ͻ��������������(request)��ҳ,Э��涨,������ֻ�ܻ�ӦHTML��ʽ���ַ���,���ܻ�Ӧ��ĸ�ʽ���������������,�ر�TCP���ӡ�

(3)HTTP/1.0

? 1996��5��,HTTP/1.0 �汾����,���ݴ�����ӡ��� HTTP/1.0 ������һ��������,ֻ�Ǽ�¼����ʵ����ģʽ��һ�ݲο��ĵ�,������ʵ�ʵ�Լ����,�൱��һ��������¼����

-

������ HEAD��POST ���·���;

-

��������Ӧ״̬��,��ǿ��ܵĴ���ԭ��;

-

������Э��汾�Ÿ���;

-

������ HTTP Header(ͷ��)�ĸ���,�� HTTP �����������Ӧ�������;

-

��������ݲ��ٽ������ı���

(4)HTTP/1.1

? 1997��1��,HTTP/1.1 �汾����,ֻ�� 1.0 �汾���˰��ꡣ����һ�������� HTTP Э��,һֱ�õ���20���Ľ���,ֱ�����ڻ��������еİ汾��HTTP/1.1 �Ƕ� HTTP/1.0 ��С��������,������һ������ʽ�ı���,������һ�ݿ��п��ġ��ο��ĵ�����

- ������ PUT��DELETE ���µķ���;

- �����˻�������Ϳ���;

- ��ȷ�����ӹ���,�����־�����;

- ������Ӧ���ݷֿ�(chunked),���ڴ�����ļ�;

- ǿ��Ҫ�� Host ͷ,�û����������йܳ�Ϊ���ܡ�

(5)SPDY ��

? 2009��,�ȸ蹫���������з��� SPDY Э��,��Ҫ��� HTTP/1.1 Ч�ʲ��ߵ����⡣

? ���Э����Chrome�������֤�������Ժ�,�ͱ����� HTTP/2 �Ļ���,��Ҫ���Զ��� HTTP/2 ֮�еõ��̳С�

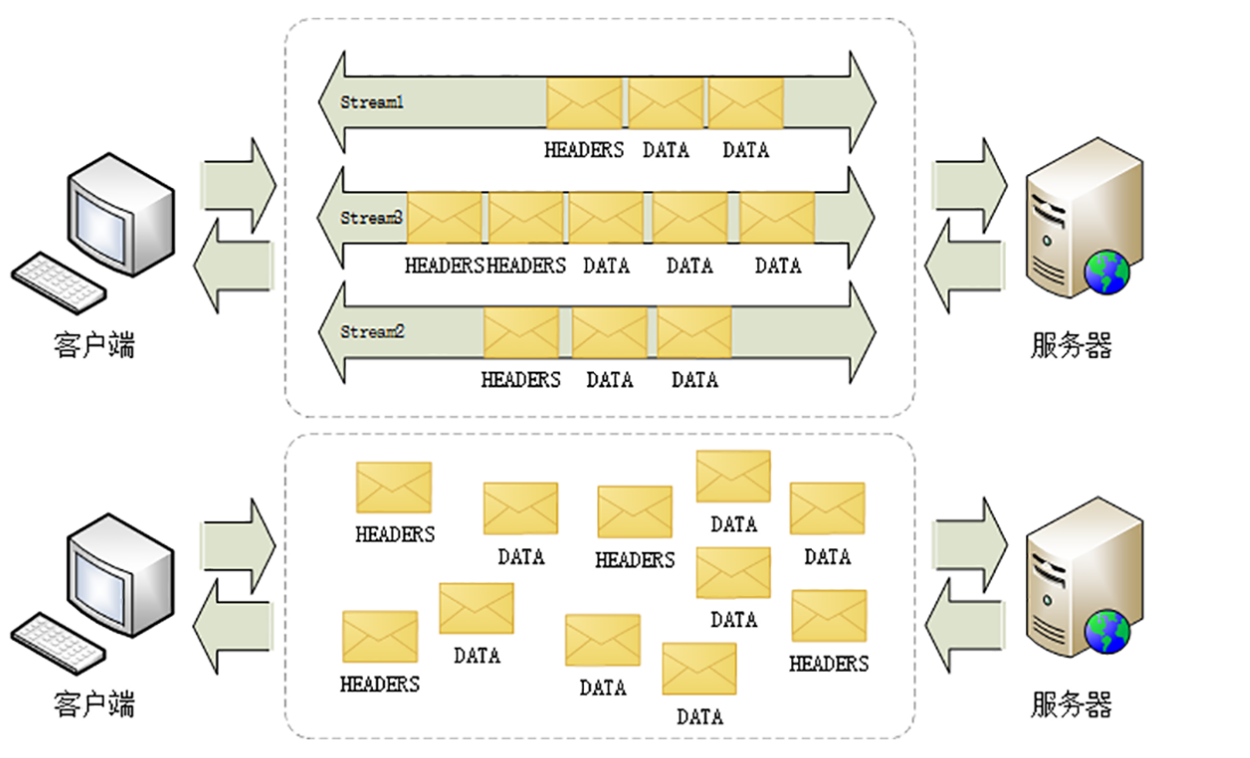

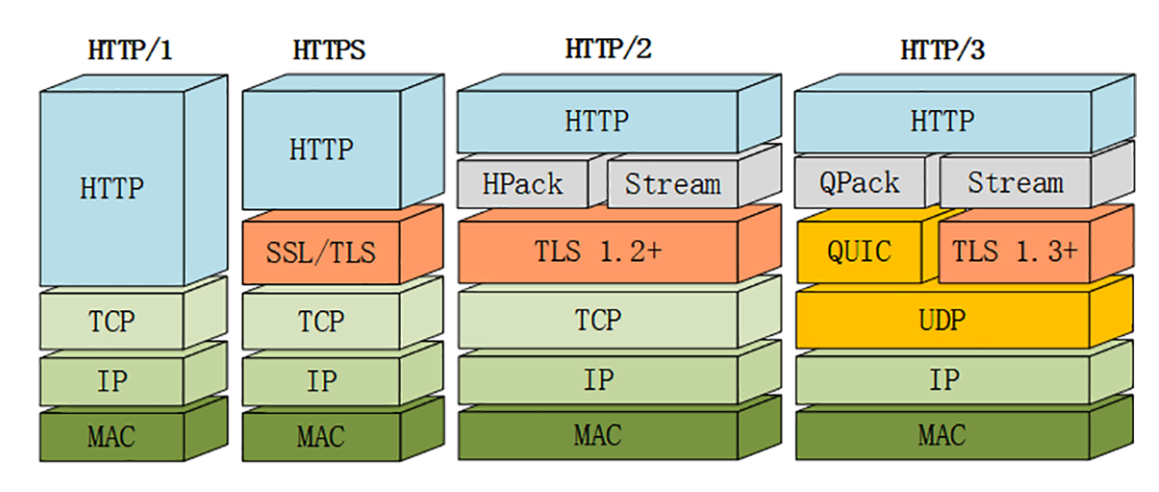

(6)HTTP/2

? 2015��,HTTP/2 ������������ HTTP/2.0,����Ϊ��ίԱ������ٷ����Ӱ汾��,��һ���°汾���� HTTP/3��HTTP/2 ���ƶ���ֿ������ֽ���������״:�������ƶ�������ȫ,�ڸ߶ȼ���HTTP/1.1 ��ͬʱ�����ܸ��Ʒ������˺ܴ�Ŭ��,��Ҫ���ص���:

- ������Э��,�����Ǵ��ı�;

- �ɷ���������,������ 1.1 ��Ĺܵ�;

- ʹ��ר���㷨ѹ��ͷ��,�������ݴ�����;

- ����������������ͻ�����������;

- ��ǿ�˰�ȫ��,����ʵ�ϡ�Ҫ�����ͨ�š�

? ��Ȼ HTTP/2 �Ѿ������ü���,Ҳ�������� gRPC ����Э��,������ HTTP/1.1 ʵ����̫�������ǿ��,Ŀǰ�����ռ��ʻ��Ƚϵ�,�������վʹ�õ���Ȼ���� 20 ��ǰ��HTTP/1.1��

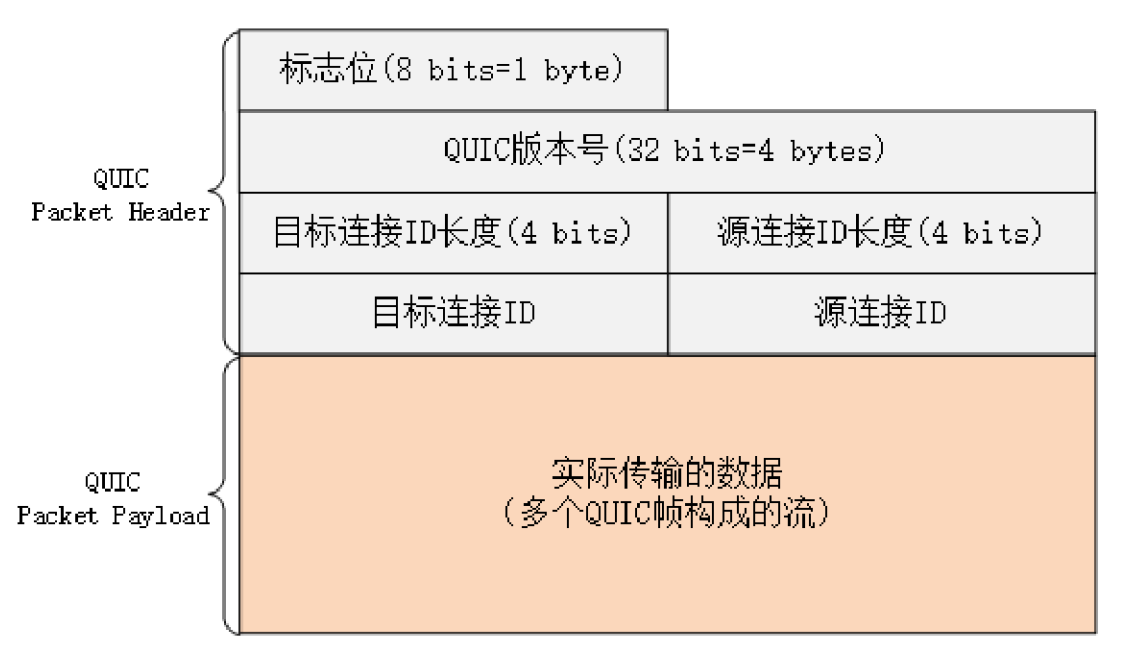

(7)HTTP/3

? 2022��6��6��,IETF (��������������С��) ��ʽ������ HTTP/3 �� RFC��

? �� HTTP/2 �����ڲݰ�֮ʱ,Google �ַ�����һ���µ�Э��,���� QUIC,���һ�����ͬ�ġ���·��,������ Chrome ���Լҷ������������š��桱,���������Ӵ��û�����������,�������ƶ� QUIC Э���Ϊ�������ϵġ��ȳ���ʵ����

? Ҳ���� 2018 ��,������������֯ IETF ���齫��HTTP over QUIC������ Ϊ��HTTP/3���������,HTTP/3 ��ʽ�����˱����ƶ��Ρ�

(8)�ܽ�

- HTTP Э��ʼ����ʮ��ǰ��ķ������˹ - ���һƪ����;

- HTTP/0.9 �Ǹ����ı�Э��,ֻ�ܻ�ȡ�ı���Դ;

- HTTP/1.0 ȷ���˴�����ʹ�õļ���,����������ʽ��;

- HTTP/1.1 ��Ŀǰ��������ʹ����㷺��Э��,����Ҳ�dz�����;

- HTTP/2 ���� Google �� SPDY Э��,ע�����ܸ���,����δ�ռ�;

- HTTP/3 ���� Google �� QUIC Э��,�ǽ����ķ�չ����

3����������

(1)��������

? ����������ʽ������ Internet,����洢������������Ϣ��Դ,����ͨ����˵�ġ��� ����ʵ���Ϸ��ʵ�ֻ�ǻ�������һ���Ӽ�����ά����(World Wide Web),������ HTTP Э��,���� HTML �ȳ��ı���Դ,����Ҳ�ͱ������� HTTP Э��֮�ڡ����ڵĻ����� 90% ���ϵIJ��ֶ�����ά��,Ҳ���� HTTP �����ǡ�

(2)�����

? ���������ʽ���ֽС�Web Browser��,����˼��,���Ǽ������鿴����������ҳ��Դ�� Ӧ�ó���,������� Web,ʵ����ָ�ľ��ǡ�World Wide Web��,Ҳ������ά����

? �������������һ�� HTTP Э���е�����,ʹ�� HTTP Э���ȡ�����ϵĸ�����Դ��

(3)Web ������

? Web ��������һ���ܴ�Ҳ����Ҫ�ĸ���,���� HTTP Э������Ӧ���������,ͨ����������Ӳ�����㺬��,Ӳ�������ṩweb�����Ӳ������,���������ṩ Web �����Ӧ�ó���,���õ���Apache��Nginx��

(4)CDN

? CDN,ȫ���ǡ�Content Delivery Network��,����������ǡ����ݷַ����硱����Ӧ�� �� HTTP Э����Ļ���ʹ�������,����Դվ��Ӧ�ͻ��˵����������Ի���Դվ������,�����������Ӧʱ�䡣

? ���˻��������������,���ṩ���ؾ��⡢ ��ȫ��������Ե���㡢����Ӫ������ȹ���,�ܹ��ɱ��ء��Ŵ�Դվ�������ķ���������

(5)����

? ����ʵ������һ�ֿ����Զ�����Web��Դ��Ӧ�ó�����������ɸ����������桰�š�������,ץȡ��ҳ�����Ӵ�����ݿ�,�ٽ����ؼ����� ��,�������Dz��ܹ������������п��ٵ��������������������ҳ�档

? ����Ҳ�в��õ�һ��,�����������������Դ,ռ�÷������ʹ���,Ӱ����վ����ʵ���ݵ� ����,��������������Ϣй©������,�ֳ����ˡ������桱����,ͨ�������ֶ��������� �档����һ����ǡ�����Э����robots.txt,Լ����Щ����,��Щ��������

(6)DNS

? �� TCP/IP Э����ʹ�� IP ��ַ����ʶ�����,������ʽ�ĵ�ַ���ڼ������˵�Ƿ�����, ������������˵ȴ�����Լ������������롣 ���ǡ�����ϵͳ��(Domain Name System)������,�����������������Ϊ IP ��ַ�� �ȼ������

? �����á�.���ָ��ɶ������,���������������,���ұߵı���Ϊ��������������

? ����Ҫʹ�� TCP/IP Э����ͨ����ȻҪʹ�� IP ��ַ,������Ҫ��������һ��ת��,��ӳ �䡱��������ʵ IP,�������ν�ġ�������������

(7)URI/URL

? URI(Uniform Resource Identifier),����������ͳһ��Դ��ʶ��,ʹ�������ܹ�Ψһ�ر�ǻ���������Դ��

? URI ��һ�������õı�����ʽ�� URL(Uniform Resource Locator), ͳһ��Դ��λ��,Ҳ���������׳Ƶġ���ַ��,��ʵ������ URI ��һ���Ӽ�,������Ϊ������������ͬ��,���첻��,����ͨ���������ϸ�����֡�

? URN:Uniform Resource Name,ͳһ��Դ����,Ҳ��URI��һ���Ӽ���

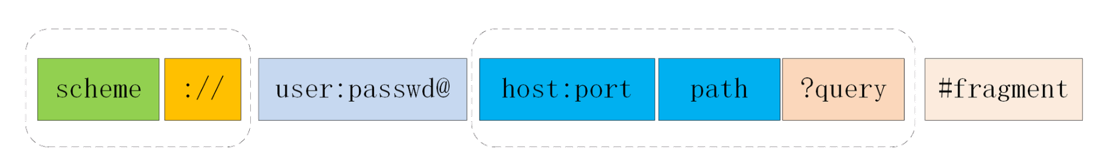

? URI ��Ҫ�����������IJ��ֹ���:Э����,�����ʸ���ԴӦ��ʹ�õ�Э��;������,���������������ı��,������������ IP ��ַ;·��,����Դ�������ϵ�λ��,ʹ�á�/���ָ��༶Ŀ¼��

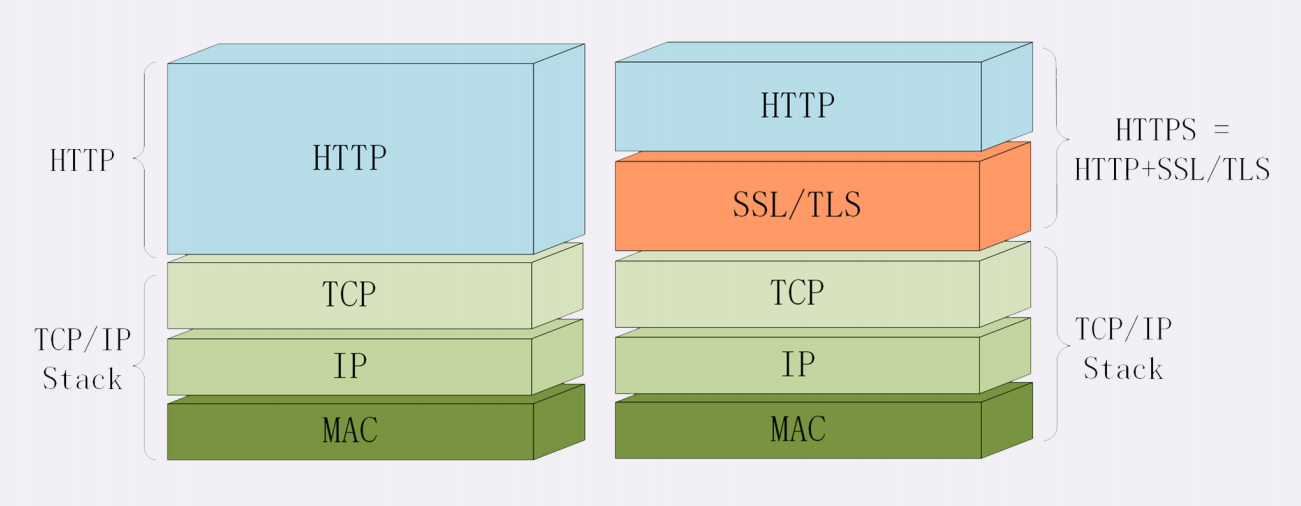

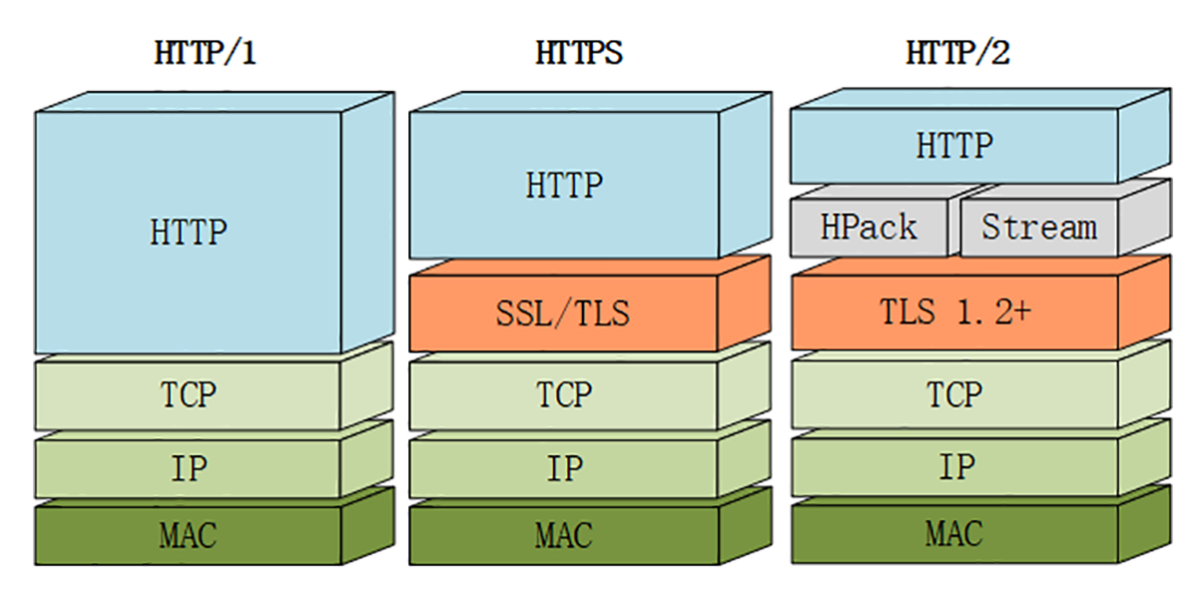

(8)HTTPS

? HTTPSȫ���ǡ�HTTP over SSL/TLS��,Ҳ���� ������ SSL/TLS Э���ϵ� HTTP,����һ���������ͨ�ŵİ�ȫЭ��,�� ���� TCP/IP ֮��,����Ҳ�Ǹ��ɿ��Ĵ���Э��,���Ա����� HTTP ���²㡣

? SSL ��ȫ���ǡ�Secure Socket Layer��,��������˾����,����չ�� 3.0 ʱ������,�� ��Ϊ TLS,����Transport Layer Security��,��������ʷ��ԭ�����кܶ��˳�֮Ϊ SSL/TLS,����ֱ�Ӽ��Ϊ SSL��

? SSL ʹ������������ѧ���Ƚ����о��ɹ�,�ۺ��˶ԳƼ��ܡ��ǶԳƼ��ܡ�ժҪ�㷨������ ǩ��������֤��ȼ���,�ܹ��ڲ���ȫ�Ļ�����Ϊͨ�ŵ�˫��������һ�����ܵġ���ȫ�Ĵ���ͨ����

(9)����

? ����(Proxy)�� HTTP Э��������Ӧ���м��һ������,��Ϊ����תվ��,�ȿ��� ת���ͻ��˵�����,Ҳ����ת����������Ӧ��

? �����кܶ������,��������:

- ��������:��ȫ�����䡱�˱������Ļ���,��翴����ֻ�Ǵ���������;

- ������:����˼��,���ڴ���������ǡ������š���,����֪������,Ҳ֪���� ����;

- �������:�����ͻ���,�����ͻ������������������;

- �������:������������,������������Ӧ�ͻ��˵�����;

? ���ڴ����ڴ�������в�����һ�����м�㡱,���Կ���������������ܶ�����˼������, ����:

- ���ؾ���:�ѷ���������ȷ�ɢ����̨����,ʵ�ַ��ʼ�Ⱥ��;

- ���ݻ���:�ݴ������е�����,�����˵�ѹ��;

- ��ȫ����:���� IP, ʹ�� WAF �ȹ��ߵ������繥��,�����������Ļ���;

- ���ݴ���:�ṩѹ�������ܵȶ���Ĺ��ܡ�

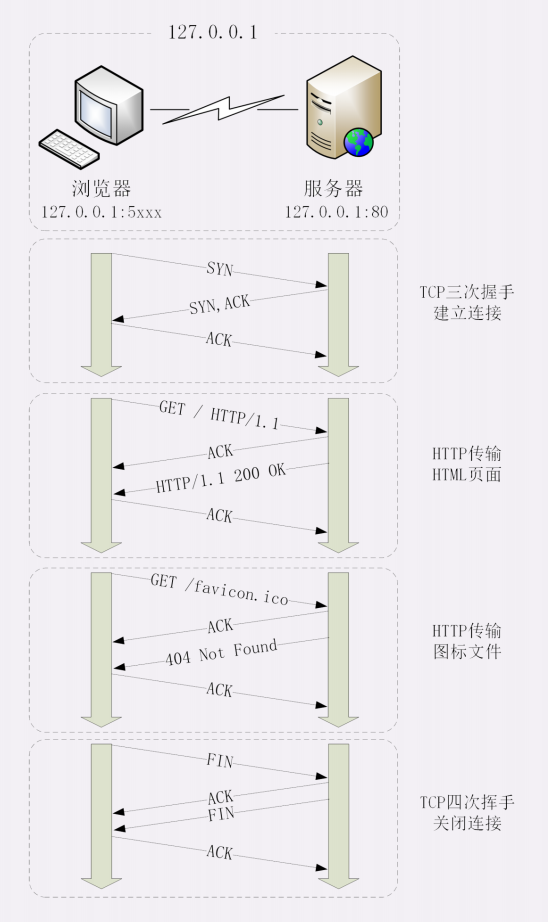

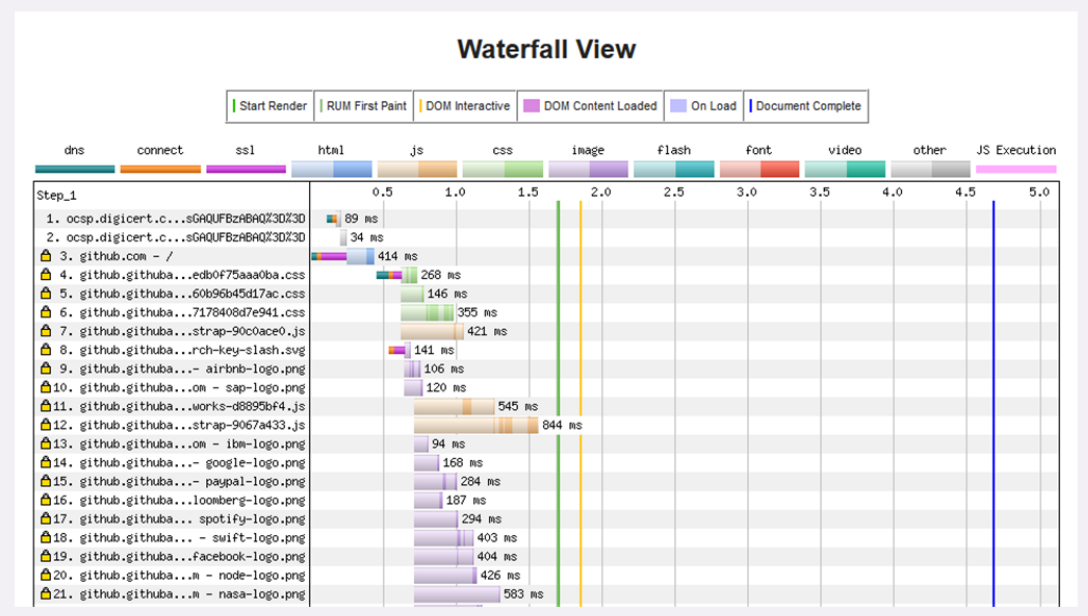

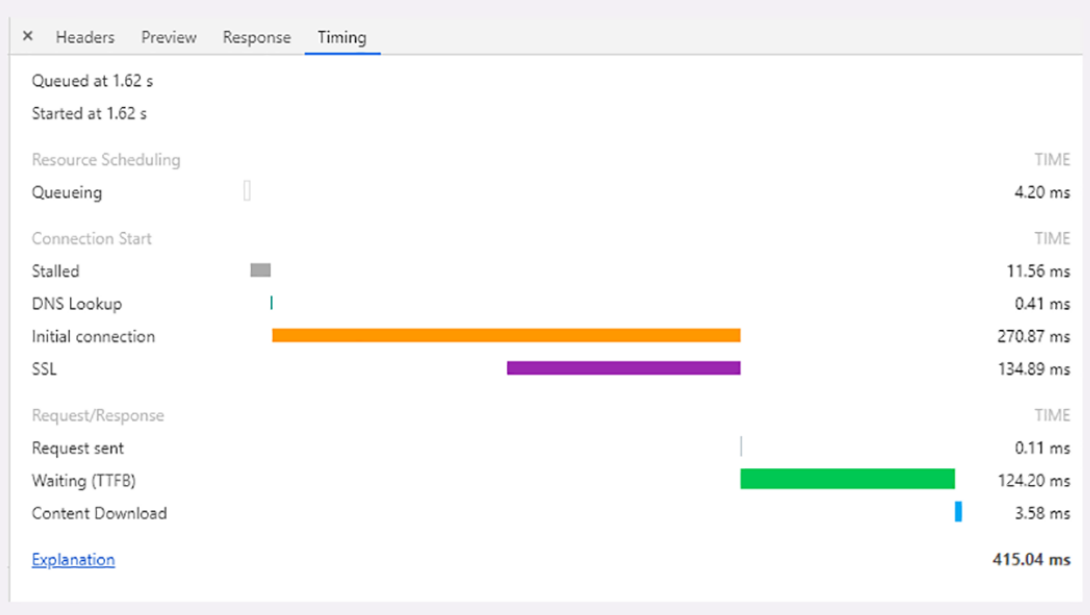

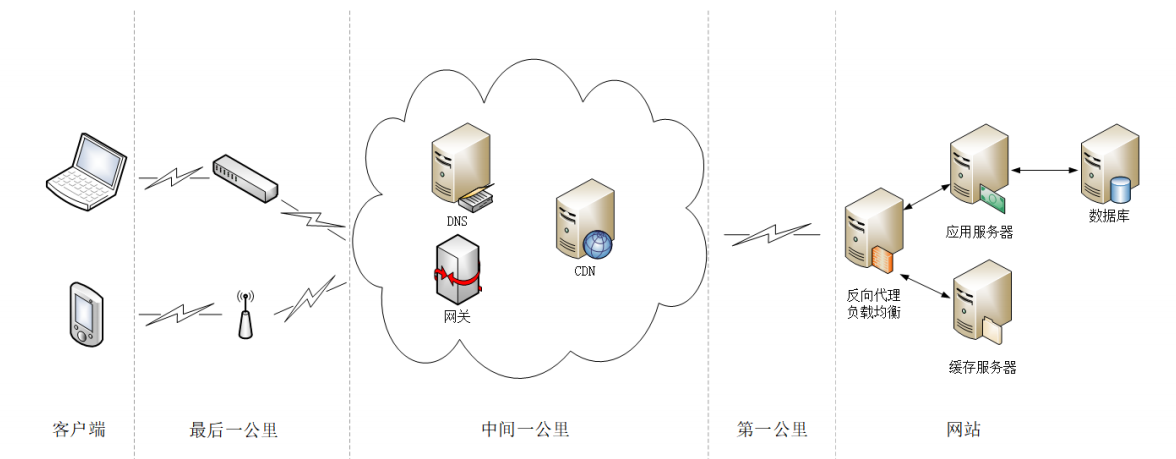

4������Web������

(1)IP��ַ����Web������

��Ҫ������������ HTTP �������:

-

������ӵ�ַ���������л�÷������� IP ��ַ�Ͷ˿ں�;

-

������� TCP �������������������������;

-

����������������ƴ�õı���;

-

�������յ����ĺ�������,ͬ��ƴ�ñ����ٷ��������;

-

�������������,��Ⱦ���ҳ�档

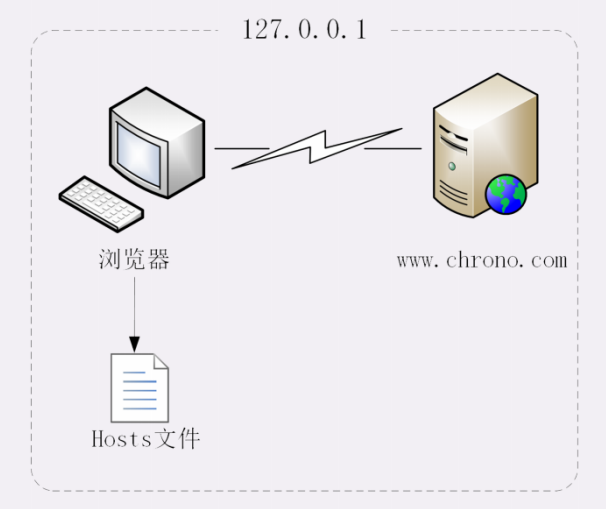

(2)ʹ����������Web������

? ���������ַ����ֱ������ IP ��ַ���Է��ʷ�����,��������������,�����Dz�֪��������IP ��ַ��,ʹ�õ����������������������ַ�������,����������������,�������������� TCP/IP Э����� IP ��ַ��

? ������Ϊ����������ȫ����ʵ����̫������,���ÿһ��������Ҫ������۵�ȥ���ϲ�һ��,�����������϶��������ܲ��ˡ�����,�����������Ĺ����л��ж༶�Ļ���,��������ȿ�һ���Լ��Ļ�������û��,���û�о������ϵͳ�Ļ���Ҫ,��û�оͼ�鱾�����������ļ� hosts,Ҳ������һ���������ĵġ�C:\WINDOWS\system32\drivers\etc\hosts����

? �պ�,������һ��ӳ���ϵ��127.0.0.1 www.chrono.com��,�����������֪����������Ӧ�� IP ��ַ,�Ϳ������ؽ��� TCP ���ӷ��� HTTP �����ˡ�

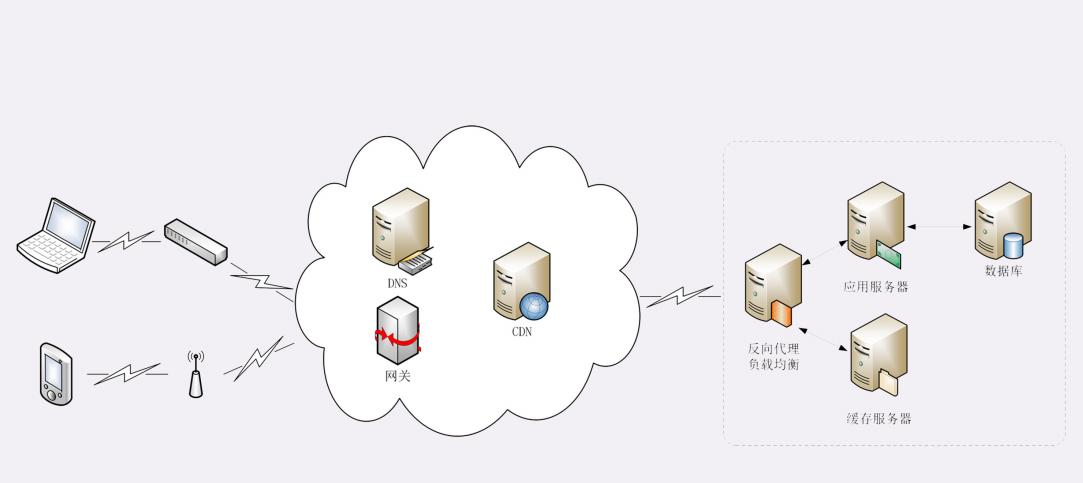

(3)��ʵ����������

? ������õ��ǵ���̨ʽ��,��ô����ܻ�ʹ�ô�ˮ��ͷ��˫������������,�ɽ���������̶����硣������õ����ֻ���ƽ�����,��ô����ܻ�ͨ���������硢WiFi,�ɵ��Ż�վ�������ȵ�����ƶ����硣���������ͬʱ,���������̻������豸����һ�� IP ��ַ,�����ַ�����Ǿ�̬�����,Ҳ�����Ƕ�̬����ġ���̬ IP ��ʼ�ղ���,����̬ IP �������´������ͱ��ˡ�

? ������Ҫ���ʵ��� Apple ��վ,��Ȼ���Dz�֪��������ʵ IP ��ַ��,���������ֻ��ʹ��������www.apple.com������,��ô������Ҫ���ı�Ȼ���������������Ҫ�� DNS Э�鿪ʼ�Ӳ���ϵͳ������ DNS���� DNS������ DNS��Ȩ�� DNS �IJ�����,��Ȼ���м��л���,���ܲ����̫��ʱ������õ������

? DNS �������ܻ���� CDN �������� IP ��ַ,�������õ��ľͻ��� CDN ������������Ŀ����վ��ʵ�ʵ�ַ����Ϊ CDN �Ỻ����վ�Ĵ���Դ,����ͼƬ��CSS ��ʽ��,�����е� HTTP ����Ͳ���Ҫ�ٷ��� Apple,CDN �Ϳ���ֱ����Ӧ�������,�����ݷ����㡣

? �� PHP��Java �Ⱥ�̨����̬���ɵ�ҳ�����ڡ���̬��Դ��,CDN ������,ֻ�ܴ�Ŀ����վ��ȡ�������㷢���� HTTP �����Ҫ��ʼ�ڻ������ϵġ��������桱,����������·���������ء�����,���Ŀ�ĵء�

? Ŀ����վ�ķ�����������ֵ���һ�� IP ��ַ,��Ϊ���ܹ���ס�߲���,���ڲ�Ҳ��һ���ӵļܹ���ͨ��������Ǹ��ؾ����豸,�����IJ�� LVS �����߲�� Nginx,�ں���������ķ�����,����һ����ǿ���ȶ��ļ�Ⱥ��

? ���ؾ����豸���ȷ���ϵͳ��Ļ��������,ͨ���� memory ������ Redis �� disk ������ Varnish,���ǵ������� CDN ����,�����ǹ������ڲ�������,����Ƶ�����ʵ����ݻ��漸���ӻ���,������Ӧ�÷�������ѹ����

? ��������������Ҳû��,��ô���ؾ����豸��Ҫ������ת����Ӧ�÷������ˡ�������Ǹ��ֿ�����ܴ�����ͨ�ĵط���,���� Java �� Tomcat/Netty/Jetty,Python �� Django,���� PHP��Node.js��Golang �ȵȡ������ֻ��ٷ��ʺ���� MySQL��PostgreSQL��MongoDB �����ݿ����,ʵ���û���¼����Ʒ��ѯ�������µ����ۿ�֧����ҵ�����,Ȼ���ִ�еĽ�����ظ����ؾ����豸,ͬʱҲ���ܸ������������Ҳ��һ�ݡ�

? Ӧ�÷�������������˸��ؾ����豸����,����Ĵ��������������,��Ҫ����ԭ·����ȥ,����Ҫ���������·���������ء���������������Դ��������,��ô���� CDN ��ʱ����Ҳ��������,�����´�ͬ��������Ͳ��ᵽ��Դվ�ˡ�

? �����վ����Ӧ���ݻص�������豸,�������� HTML��JSON��ͼƬ����������ʽ������,��Ҫ���������������������ʾ����,����������滹�г�����,ָ������Դ,��ô����Ҫ����һ����������,ֱ�����е���Դ�������ꡣ

��������

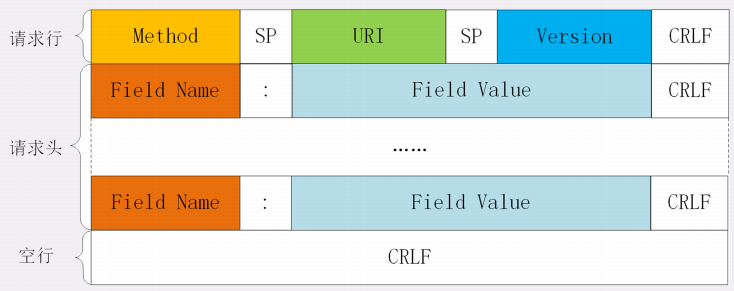

1�����Ľṹ

HTTP Э��������ĺ���Ӧ���ĵĽṹ������ͬ,���������:

- ��ʼ��(start line):�����������Ӧ�Ļ�����Ϣ;

- ͷ���ֶμ���(header):ʹ�� key-value ��ʽ����ϸ��˵������;

- ��Ϣ����(entity):ʵ�ʴ��������,����һ���Ǵ��ı�,������ͼƬ����Ƶ�ȶ��������ݡ�

? ������ǰ��������ʼ�к�ͷ���ֶξ����ֺϳ�Ϊ������ͷ������Ӧͷ��,��Ϣ�����ֳ�Ϊ��ʵ����,���롰header����Ӧ,�ܶ�ʱ���ֱ�ӳ�Ϊ��body����

? HTTP Э��涨���ı����� header,������û�� body,������ header ֮�����Ҫ��һ�������С�,Ҳ���ǡ�CRLF��,ʮ�����Ƶġ�0D0A����

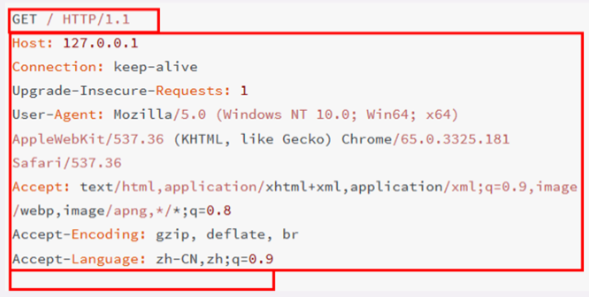

������һ��http����ʵ��

? ������������������������,��һ�С�GET /HTTP/1.1������������,������ġ�Host����Connection���ȵȶ����� header,���ĵ������һ���հ��н���,û�� body���ܶ�ʱ��,�ر������������ GET �����ʱ��������,HTTP ���ľ�����ֻ�� header ��û body��

2��������

? ������,Ҳ���������������ʼ��,����Ҫ���������ͻ�����Ҫ��β����������˵���Դ���������������ֹ���:

- ����:��һ������,�� GET/POST,��ʾ����Դ�IJ���;

- ����Ŀ��:ͨ����һ�� URI,���������Ҫ��������Դ;

- �汾��:��ʾ����ʹ�õ� HTTP Э��汾��

? ����������ͨ��ʹ�ÿո�(space)���ָ�,���Ҫ��CRLF ���б�ʾ������

? �����µ���������,��GET��������,��/��������Ŀ��,��HTTP/1.1���ǰ汾�š�

GET / HTTP/1.1

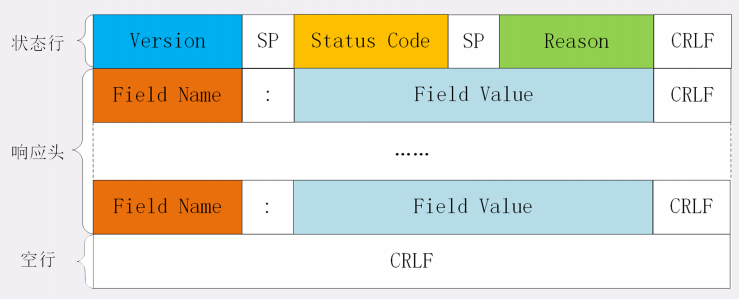

4��״̬��

? ״̬��,Ҳ������Ӧ���������ʼ��,��˼����������Ӧ��״̬��״̬��Ҳ�������ֹ���:

- �汾��:��ʾ����ʹ�õ� HTTP Э��汾;

- ״̬��:һ����λ��,�ô������ʽ��ʾ�����Ľ��,���� 200 �dzɹ�,500 �Ƿ���������;

- ԭ��:��Ϊ����״̬�벹��,�Ǹ���ϸ�Ľ�������,����������ԭ��

? �����µ�״̬����,�������ʹ�õ�Э��汾���� 1.1,״̬���� 200,һ��OK��

HTTP/1.1 200 OK

5��ͷ���ֶ�

? �����л�״̬���ټ���ͷ���ֶμ��Ͼ����� HTTP ����������������ͷ����Ӧͷ,����:

? ͷ���ֶ��� key-value ����ʽ,key �� value ֮�� �á�:���ָ�,����� CRLF ���б�ʾ�ֶν�����HTTP ͷ�ֶηdz����,��������ʹ�ñ���� Host�� Connection ������ͷ,Ҳ�������������Զ���ͷ,��� HTTP Э�������������չ���ܡ�����ʹ��ͷ�ֶ���Ҫע�����漸��:

- �ֶ��������ִ�Сд,���硰Host��Ҳ����д �ɡ�host��,������ĸ��д�Ŀɶ��Ը���;

- �ֶ����ﲻ�������ֿո�,����ʹ�����ַ���-��,���� ��ʹ���»��ߡ�_��������,��test-name���ǺϷ����� ����,����test name����test_name���Dz���ȷ���ֶ� ��;

- �ֶ��������������š�:��,�����пո�,����:����� �ֶ�ֵǰ�����ж���ո�;

- �ֶε�˳����û�������,�����������в�Ӱ������;

- �ֶ�ԭ���ϲ����ظ�,��������ֶα�������������,�� �� Set-Cookie��

6������ͷ�ֶ�

HTTP Э��涨�˷dz����ͷ���ֶ�,ʵ�ָ��ָ����Ĺ���,�������Ͽ��Է�Ϊ�Ĵ���:

- ͨ���ֶ�:������ͷ����Ӧͷ�ﶼ���Գ���;

- �����ֶ�:���ܳ���������ͷ��,��һ��˵��������Ϣ���߶���ĸ�������;

- ��Ӧ�ֶ�:���ܳ�������Ӧͷ��,����˵����Ӧ���ĵ��� Ϣ;

- ʵ���ֶ�:��ʵ��������ͨ���ֶ�,��ר������ body �� ������Ϣ��

(1)Host(�����ֶ�)(�����ֶ�)

? �����ֶ�,ֻ�ܳ���������ͷ��,��ͬʱҲ��Ψһһ�� HTTP/1.1 �淶��Ҫ������������ֶ�,Ҳ����˵,�������ͷ��û�� Host,������� һ������ı��ġ�

? Host �ֶθ��߷������������Ӧ�����ĸ�����������,�� һ̨��������й��˶������������ʱ��,�������˾���Ҫ �� Host �ֶ���ѡ��,�е�����һ���ġ�·���ض� ��

? ������ 127.0.0.1 ����������������,��ô��ʹ�������ķ�ʽ����ʱ,�ͱ���Ҫ�� Host �ֶ������������� IP ��ͬ��������ͬ����վ,��������� �ͻ��Ҳ������ʵ���������,��������

(2)User-Agent(�����ֶ�)

? �����ֶ�,ֻ����������ͷ���ʹ��һ���ַ������������� HTTP ����Ŀͻ���,��������������������������ʴ��������ʾ��ҳ�档

? ������ʷ��ԭ��,User-Agent �dz�����,ÿ����������Գ��ǡ�Mozilla����Chrome����Safari��,��ͼʹ����� �ֶ������ࡰαװ��,���� User-Agent���Խ��Խ��,���ձ�ú������塣

? �����еıȽϡ���ʵ����������� User-Agent ���á�spider�������Լ�������,���Կ�����������ֶ�ʵ�ּķ�������ԡ�

(3)Date(ͨ���ֶ�)

? ͨ���ֶ�,��ͨ����������Ӧͷ��,��ʾ HTTP ���Ĵ�����ʱ��,�ͻ��˿���ʹ�����ʱ���ٴ����� ���ֶξ���������ԡ�

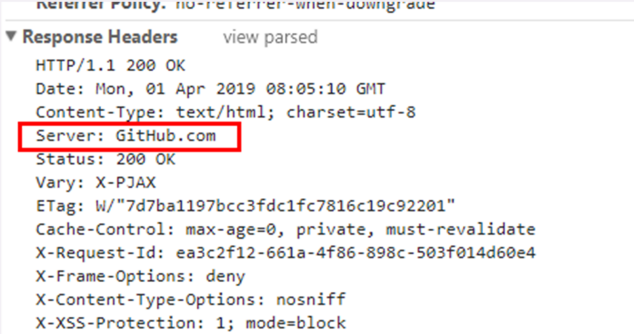

(4)Server(��Ӧ�ֶ�)

? ��Ӧ�ֶ�,ֻ�ܳ�������Ӧͷ������߿ͻ� �˵�ǰ�����ṩ Web ������������ƺͰ汾��,���硰Server: openresty/1.15.8.1��, ��ʹ�õ��� OpenResty 1.15.8.1��

? Server �ֶ�Ҳ���DZ���Ҫ���ֵ�,��Ϊ��ᱩ¶��������Ϣ,�������汾ǡ�ô���bug,��ô�ڿ;��п�������bug���ݷ�����������,�е���վ��Ӧͷ��Ҫôû������ֶ�,Ҫô����һ����ȫ�ص�������Ϣ������ GitHub,���� Server �ֶ���ֻ����ʾΪ��GitHub.com����

(5)Content-Length(ʵ���ֶ�)

? ����ʾ������body �ij���,Ҳ��������ͷ����Ӧͷ���к������ݵij��ȡ���������������ֶ�,��֪���˺����ж�������,����ֱ�ӽ��ա����û������ֶ�,��ô body ���Dz�������,��Ҫʹ�� chunked ��ʽ�ֶδ��䡣

7������

(1)������

? URIֻ�ܶ�λ��Դ,������ô������Դ,��Ҫ��ij�ֶ���ָ��,����,����ô�����ˡ�������������ʵ�ʺ���� �ǿͻ��˷�����һ��������ָ�,Ҫ��������˶� URI �� λ����Դִ�����������

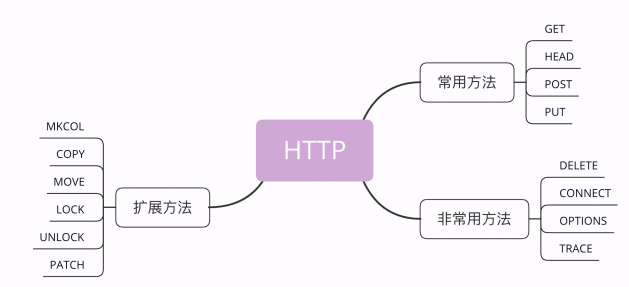

? Ŀǰ HTTP/1.1 �涨�˰��ַ���,���ʶ������Ǵ�д���� ʽ,���ȼ��а������г���,��������ϸ���⡣

- GET:��ȡ��Դ,��������Ϊ��ȡ������������;

- HEAD:��ȡ��Դ��Ԫ��Ϣ;

- POST:����Դ�ύ����,�൱��д����ϴ�����;

- PUT:���� POST;

- DELETE:ɾ����Դ;

- CONNECT:�����������������;

- OPTIONS:�г��ɶ���Դʵ�еķ���;

- TRACE:������ - ��Ӧ�Ĵ���·����

? ��Ȼ�ͻ��˷�������Щ��ȷ�IJ���ָ��,����ִ�е����ջ��Ƿ�����,��������һ�����տͻ��˵�Ҫ����в�����Դ,����,DELETE��һ��ɾ����Դ,Ҳ�����ύ���ݡ�

(2)���èCGet(�ӷ�������ȡ��Դ)

? ���ĺ���������ӷ�������ȡ��Դ,�����Դ�ȿ����Ǿ�̬ ���ı���ҳ�桢ͼƬ����Ƶ,Ҳ�������� PHP��Java ��̬ ���ɵ�ҳ�����������ʽ�����ݡ�

? GET ������Ȼ���������Ƚϼ�,������ URI ������ͷ�� �ξ���ʵ�ֶ���Դ����ϸ�IJ���������,�� URI ��ʹ�á�#��,�Ϳ����ڻ�ȡҳ���ֱ�Ӷ�λ ��ij����ǩ���ڵ�λ��;ʹ�� If-Modified-Since �ֶξͱ� ���ˡ�������������,������Դ����ʱ�Ż�ִ�л�ȡ����;ʹ�� Range �ֶξ��ǡ���Χ����,ֻ��ȡ��Դ��һ �������ݡ�

(3)���èCHEAD(�ӷ�������ȡ��Դ)

? HEAD������ GET ��������,Ҳ������ӷ�������ȡ��Դ,�������Ĵ�������Ҳ��һ����,�����������᷵������ ��ʵ������,ֻ�ᴫ����Ӧͷ,Ҳ������Դ�ġ�Ԫ��Ϣ����

? HEAD �������Կ����� GET ������һ�����桱�� �ߡ������桱����Ϊ������Ӧͷ�� GET ��ȫ��ͬ,���Կ������ںܶಢ��������Ҫ��Դ�ij���,�����body���ݵ��˷ѡ�

? ����,��Ҫ���һ���ļ��Ƿ����,ֻҪ���� HEAD ���� �Ϳ�����,û�б�Ҫ�� GET �������ļ���ȡ�������ٱ� ��,Ҫ����ļ��Ƿ������°汾,ͬ��ҲӦ���� HEAD,�� ����������Ӧͷ����ļ�����ʱ�䴫������

(4)���èCPOST(����������ύ����)

? �� URI ָ������Դ�ύ����,���ݾͷ��ڱ��ĵ� body �POSTӦ�õij���Ҳ�dz���,ֻҪ���������������,�õĴ�������� POST��

? ����,������̳��ˮ,����һ���ֺ�������������ť,�������ִ����һ�� POST ����,��������ַŽ����ĵ� body ��,Ȼ��ƴ�� POST ����ͷ,ͨ�� TCP Э�鷢���� ������

(5)���èCPUT(����������ύ����)

? PUT �������� POST ����,Ҳ������������ύ����,�� �� POST ������IJ�ͬ,ͨ�� POST ��ʾ���ǡ��½�����create���ĺ���,�� PUT ���ǡ��� �ġ���update���ĺ��塣

? ��ʵ��Ӧ����,PUT �õ��ıȽ��١�����,��Ϊ���� POST �����塢����̫������,�еķ�����������ֱ�ӽ�ֹʹ�� PUT ����,ֻ�� POST �����ϴ����ݡ�

(6)�dz��èCDELETE(ɾ����Դ)

? DELETE����ָʾ������ɾ����Դ,��Ϊ�������Σ����̫ ��,����ͨ������������ִ��������ɾ������,���Ƕ���Դ ��һ��ɾ����ǡ���Ȼ,�����ʱ���������ֱ�Ӳ����� DELETE ����

(7)�dz��èCCONNECT(�����������������)

? CONNECT��һ���Ƚ�����ķ���,Ҫ�������Ϊ�ͻ��˺� ��һ̨Զ�̷���������һ���������������,��ʱ Web �� �������м�䵱�˴����Ľ�ɫ��

(8)�dz��èCOPTIONS(�г��ɶ���Դʵ�еķ���)

? OPTIONS����Ҫ��������г��ɶ���Դʵ�еIJ�������, ����Ӧͷ�� Allow �ֶ��ﷵ�ء����Ĺ��ܺ�����,�ô�Ҳ�� ��,�еķ�����(���� Nginx)�ɴ��û��ʵ�ֶ�����֧�֡�

(9)�dz��èCTRACE(������ - ��Ӧ�Ĵ���·��)

? TRACE���������ڶ� HTTP ��·�IJ��Ի����,������ʾ ������ - ��Ӧ�Ĵ���·�������ı����Ǻõ�,������©��, ��й©��վ����Ϣ,���� Web ������ͨ��Ҳ�ǽ�ֹʹ�á�

(10)��չ����

? ��Ȼ HTTP/1.1 ��涨�˰�������,������û�������� ��ֻ��������ַ���,��Ҳ������ HTTP Э�����õ���չ ��,���ǿ�����������������,ֻҪ������Ӧ������ ������С�

? ��һЩ�õ���ʵ��Ӧ�õ����� (WebDAV),���� MKCOL��COPY��MOVE��LOCK�� UNLOCK��PATCH �ȡ�����к��ʵij���,��Ҳ������ ��Ӧ�õ��Լ���ϵͳ��,������ LOCK ����������Դ��ʱ�� ������,����ʹ�� PATCH ��������Դ���С����,���ָ������ݡ�����Ϊ��Щ�����ǷDZ���,������ҪΪ�ͻ��� �ͷ�������д����Ĵ����������֧�֡���Ҳ��ȫ���Ը���ʵ������,�Լ������µķ�����

(11)��ȫ���ݵ�

? ��ν�ġ���ȫ����ָ�������ᡰ�� �����������ϵ���Դ,������Է������ϵ���Դ���ʵ�ʵ��ġ������������,ֻ�� GET �� HEAD �����ǡ���ȫ����, POST/PUT/DELETE �������ķ������ϵ���Դ,���� ��ɾ������,�����ǡ�����ȫ���ġ�

? ��ν�ġ��ݵ���ʵ������һ����ѧ����,��˼�Ƕ��ִ����ͬ�IJ���,���Ҳ������ͬ��, ����Ρ��ݡ���������ȡ���GET �� HEAD ���ǰ�ȫ��Ҳ���ݵȵ�,DELETE ���Զ��ɾ��ͬһ����Դ,Ч�����ǡ���Դ�����ڡ�,���� Ҳ���ݵȵġ�POST �ǡ��������ύ���ݡ�,��� �ύ���ݻᴴ�������Դ,���Բ����ݵȵ�;�� PUT �ǡ��滻��������ݡ�,��θ���һ����Դ,��Դ���ǻ�� һ�θ��µ�״̬,�������ݵȵġ�

8��URI

(1)URI�ĸ�ʽ

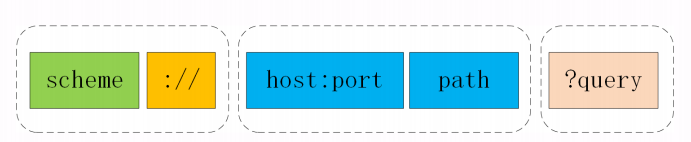

? URI ��������һ���ַ���,����ַ�����������Ψһ�ر����Դ��λ�û������֡�

? ���������ͼ��ʾ�� URI ��õ���ʽ,�� scheme�� host:port��path �� query �ĸ��������,���еIJ��ֿ��� �����ʡ�ԡ�

(2)URI�Ļ������

- **scheme:**��������ĽС������������ߡ�Э������,��ʾ��ԴӦ��ʹ������Э�������ʡ�����ǡ�http��,����С�https��,��ʾ�������ܡ���ȫ�� HTTPSЭ�顣 �����������,���� ftp��ldap�� file��news �ȡ����һ�� URI û���ṩ scheme,���������ġ�

- ��😕/��:�� scheme ֮��,�����������ض����ַ���😕/��,���� scheme �ͺ���IJ��ַ��뿪��

- **authority:**��ʾ��Դ ���ڵ�������,ͨ������ʽ�ǡ�host:port��,���������Ӷ˿ںš������������� IP ��ַ������������ʽ,����Ҫ��,����������ͻ��Ҳ��������������˿ں���ʱ����ʡ��,������ȿͻ��˻����� scheme ʹ��Ĭ�ϵĶ˿ں�,���� HTTP �� Ĭ�϶˿ں��� 80,HTTPS ��Ĭ�϶˿ں��� 443��

- **path:**�����Դ����λ��,����Э������������ַ���˿ں��ټ���path,������Ϳ������ӷ�����������Դ�ˡ�URI �� path �����������ļ�ϵͳ��Ŀ¼����·�����ı�ʾ ��ʽ,��Ϊ���ڻ������ϵļ�������� UNIX ϵͳ,���Բ����� UNIX �ġ�/�����

- **query:**��ʾ����Դ���ӵĶ���Ҫ��,���� path ֮��,��һ����?����ʼ,����������?������ѯ���� query ��һ���Լ��ĸ�ʽ,�Ƕ� ����key=value�����ַ���,��Щ KV ֵ���ַ���&������,������Ϳͻ��˶������������ʽ�ѳ����IJ�ѯ���� �����ɿ�������ֵ�����������ʽ��

? �����Ǽ���ʵ��:

http://nginx.org

http://www.chrono.com:8080/11-1

https://tools.ietf.org/html/rfc7230

file:///D:/http_study/www/

? ���һ�� URI Ҫע����,����Э�������ǡ�http��,���ǡ�file��,��ʾ���DZ����ļ�,�������Ȼ������б��,����б�����ǰ�������� URI ����ָ�����😕/��,Ȼ�����ġ�/D:/http_study/www/����·��,���м������������ʡ�ԡ��ˡ���ʵ������ file ���� URI �ġ�������,������ʡ��������,Ĭ���DZ��� localhost��

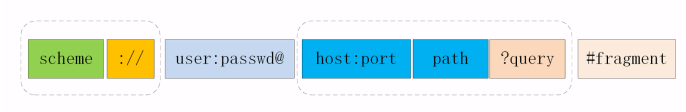

(3)URI ��������ʽ

? URI ����һ������������������̬,����ͼ��ʾ,�������������̬�Ȼ�����̬���������֡�

? **user:passwd@:**��ʾ��¼����ʱ���û���������, �������Ѿ����Ƽ�ʹ��������ʽ��(RFC7230),��Ϊ���� ������Ϣ��������ʽ��¶����,�������صİ�ȫ������

? **#fragment:**���� URI ����λ����Դ�ڲ���һ ����ê�㡱����˵�ǡ���ǩ��,����������ڻ�ȡ��Դ��ֱ����ת����ָʾ��λ�á�

(4)URI �ı���

? �� URI ��ֻ��ʹ�� ASCII ��,Ϊ����URI�б�ʾASCII ��������ַ����͡�@&/���������ַ�,URI �����˱������,������ת������ URI ���岻�� ͻ����ʽ������ RFC �淶��� Ϊ��escape���͡�unescape��,�׳ơ�ת�塱��

? URI ת��Ĺ����е㡰�ֱ���,ֱ�Ӱѷ� ASCII ��������ַ�ת����ʮ�������ֽ�ֵ,Ȼ��ǰ���ټ���һ ����%����

? ����,�ո�ת��ɡ�%20��,��?����ת��ɡ�%3F���� �����ġ����ĵ���ͨ��ʹ�� UTF-8 �������ת��,���硰���ӡ��ᱻת��ɡ�%E9%93%B6%E6%B2%B3���� ���������������,URI ����������,����֧������� �ַ������κ������������Դ��

9����Ӧ״̬��

(1)״̬���λ��

? �������յ�������,��������Ҫ���д���,�����ҵ�������ֶ���,�����ض���ƴ��һ����Ӧ���ķ��ؿͻ��ˡ���Ӧ��������Ӧͷ����Ӧ���������,��Ӧͷ����״̬�к�ͷ�ֶι��ɡ�״̬�еĽṹ����:

- **Version:**�� HTTP Э��İ汾��,ͨ����HTTP/1.1,�ô����Ǻܴ�

- **Reason:**��ԭ�����,��״̬��ļ����������,���硰OK����Not Found���ȵ�,Ҳ�����Զ��塣����ֻ��Ϊ�˼������ڵ��ı��ͻ��˶�����,�ṩ����Ϣ������,Ŀǰ�Ĵ�����ͻ��˶����������

- **Status Code:**״̬��,����һ��ʮ��������,�Դ������ʽ��ʾ������������Ĵ������,��������ͨ����д����ʱ�������صĴ�����һ�����������ڱ���HTTP ���ݴ����ġ�״̬��,�ͻ��˿������ݴ�����ʱת������״̬,����������������л�Э��,�ض�����ת�ȡ�

(2)״̬��

? Ŀǰ RFC ����涨��״̬������λ��,����ȡֵ��Χ���Ǵ� 000 �� 999��RFC ����״̬��ֳ�������,�����ֵĵ�һλ��ʾ����,�� 0~99 ����,����״̬���ʵ�ʿ��÷�Χ�ʹ����С��,��000~999 ����� 100~599��������ľ��庬����:

- **1����:**��ʾ��Ϣ,��ʾĿǰ��Э�鴦�����м�״̬,����Ҫ�����IJ���;ż���ܹ���������101;

- **2����:**�ɹ�,�����Ѿ��յ�������ȷ����,���õ��� 200��204��206;

- **3����:**�ض���,��Դλ�÷����䶯,��Ҫ�ͻ������·�������,���õ��� 301��302��304;

- **4����:**�ͻ��˴���,����������,������������,���õ��� 400��403�� 404;

- **5����:**����������,�������ڴ�������ʱ�ڲ������˴���,���õ��� 500��501�� 502��503;

? Ŀǰ RFC �����ܹ��� 41 ��״̬��,��״̬��Ķ����ǿ��ŵ�,����������չ������ Apache��Nginx �� Web ��������������һЩר�е�״̬�롣������Լ����� Web Ӧ��,Ҳ��ȫ�����ڲ���ͻ��ǰ���¶����µĴ��롣

| ״̬�� | ˵�� |

|---|---|

| 100 Continue | �����������յ���������,���Ƿ�������û�оܾ�������,�ͻ���Ӧ�ü���������������� |

| 101 Switching Protocols | ������˼�ǿͻ���ʹ�� Upgrade ͷ�ֶ�,Ҫ���� HTTP Э��Ļ����ϸij�������Э�����ͨ��,���� WebSocket�������������Ҳͬ����Э��,�ͻᷢ��״̬�� 101,����֮������ݴ���Ͳ�����ʹ�� HTTP �ˡ� |

| 103 Checkpoint | ���� PUT ���� POST ����ָ�ʧ��ʱ�Ļָ������顣 |

| 200 OK | ������ijɹ�״̬��,��ʾһ������,��������ͻ��������������������˴������,����Ƿ� HEAD����,ͨ������Ӧͷ���� body ���ݡ� |

| 201 Created | ���������,ͬʱ�µ���Դ�������� |

| 202 Accepted | �������������ѱ�����,���Ǵ���δ��ɡ� |

| 203 Non-Authoritative Information | �����Ѿ����ɹ�����,����һЩӦ��ͷ���ܲ���ȷ,��Ϊʹ�õ��������ĵ��Ŀ����� |

| 204 No Content | �����Ѿ����ɹ�����,����û�з������ĵ��������Ӧ�ü�����ʾԭ�����ĵ�������û����ڵ�ˢ��ҳ��,��Servlet����ȷ���û��ĵ��㹻��,���״̬�����Ǻ����õġ� |

| 205 Reset Content | �����Ѿ����ɹ�����,����û�з������ĵ����������Ӧ������������ʾ�����ݡ�����ǿ���������������������ݡ� |

| 206 Partial Content | �� HTTP �ֿ����ػ�ϵ������Ļ���,�ڿͻ��˷��͡���Χ����Ҫ���ȡ��Դ�IJ�������ʱ����,���� 200 һ��,Ҳ�Ƿ������ɹ�����������,�� body ������ݲ�����Դ��ȫ��,�������е�һ���֡�״̬�� 206 ͨ�����������ͷ�ֶΡ�Content-Range��,��ʾ��Ӧ������ body ���ݵľ��巶Χ,���ͻ���ȷ��,���硰Content-Range: bytes 0-99/2000��,��˼�Ǵ˴λ�ȡ�����ܼ� 2000 ���ֽڵ�ǰ 100 ���ֽڡ� |

| 300 Multiple Choices | ����ѡ�������б����û�����ѡ��ij���ӵ���Ŀ�ĵء�������������ַ�� |

| 301 Moved Permanently | �׳ơ������ض���,�����Ǵ˴��������Դ�Ѿ���������,��Ҫ���ø����µ� URI�ٴη��ʡ� |

| 302 Found | �׳ơ���ʱ�ض���,��˼���������Դ����,����Ҫ��ʱ����һ�� URI �����ʡ�301 �� 302 ��������Ӧͷ��ʹ���ֶ�Locationָ������Ҫ��ת�� URI,���յ�Ч��������,����������ض����µ�URI�����ߵĸ���������������,һ���ǡ����á�,һ���ǡ���ʱ��,�����ڳ������÷��ϲ��ܴ���,�����վ�������� HTTPS,ԭ���� HTTP ����������,����ǡ����á���,����Ҫ���� 301 ��ת,�����е�HTTP �������л��� HTTPS���ٱ���,����ҹ����վ��̨Ҫϵͳά��,������ʱ������,������ڡ���ʱ����,�������ó� 302 ��ת,��������ʱ�л���һ����̬֪ͨҳ��,������������ 302 ��֪����ֻ����ʱ�����,�����������Ż�,�ڶ��컹�����ԭ���ĵ�ַ�� |

| 303 See Other | �������ҳ����ڱ�� URL �±��ҵ��� |

| 304 Not Modified | δ��Ԥ�����ĵ����ͻ����л�����ĵ���������һ�������Ե�����(һ�����ṩIf-Modified-Sinceͷ��ʾ�ͻ�ֻ���ָ�����ڸ��µ��ĵ�)�����������߿ͻ�,ԭ��������ĵ������Լ���ʹ�á� |

| 305 Use Proxy | �ͻ�������ĵ�Ӧ��ͨ��Locationͷ��ָ���Ĵ�����������ȡ�� |

| 306 Switch Proxy | Ŀǰ�Ѳ���ʹ��,���Ǵ�����Ȼ�������� |

| 307 Temporary Redirect | �������ҳ���Ѿ���ʱ�����µ� URL �� |

| 308 Resume Incomplete | ���� PUT ���� POST ����ָ�ʧ��ʱ�Ļָ������顣 |

| 400 Bad Request | ��һ��ͨ�õĴ�����,��ʾ�������д���,�����������ݸ�ʽ����ȱ������ͷ���� URI ������û����ȷ˵,ֻ��һ����ͳ�Ĵ���,�ͻ��˿��� 400ֻ���ǡ�һͷ��ˮ������֪���롱������,�ڿ��� Web Ӧ��ʱӦ������������ͻ��˷��� 400,����Ҫ������������ȷ�����״̬�롣 |

| 401 Unauthorized | �Ϸ�����,���Ա�����ҳ��ķ��ʱ���ֹ����Ϊ�������ҳ����Ҫ������֤,�ͻ���û���ṩ����������֤ʧ�ܡ� |

| 402 Payment Required | �˴�������ʹ�á� |

| 403 Forbidden | ʵ���ϲ��ǿͻ��˵��������,���DZ�ʾ��������ֹ������Դ��ԭ����ܶ��ֶ���,������Ϣ���С����ɽ�ֹ��,����������Ѻ�һ��,������ body ����ϸ˵���ܾ������ԭ��,������ʵ��ͨ������ֱ�Ӹ�һ�������Ÿ����� |

| 404 Not Found | ���������������Ҳ���Ը�⿴����һ��״̬��,����ԭ������Դ�ڱ���������δ�ҵ�,�������ṩ���ͻ��ˡ��������Ѿ����������ˡ�,ֻҪ�������������ˡ��Ϳ��Ը����� 404,������Ҳ�ӵ�֪���浽�������δ�ҵ�,������ʲô���ԭ��,ij�̶ֳ�������403 ��Ҫ�������ᡣ |

| 405 Method Not Allowed | ������ʹ��ijЩ����������Դ,���粻���� POST ֻ�� GET; |

| 406 Not Acceptable | ��Դ������ͻ������������,�����������ĵ�ֻ��Ӣ��; |

| 407 Proxy Authentication Required | �û���������ʹ�ô���������������֤,��������Żᱻ������ |

| 408 Request Timeout | �����˷������ĵȴ�ʱ�䡣 |

| 409 Conflict | ����������˳�ͻ,��������Ϊ���̲߳���ʱ�ľ�̬; |

| 410 Gone | �������ҳ�治���á� |

| 411 Length Required | ��Content-Length�� δ�����塣���������,����������������� |

| 412 Precondition Failed | �����е�ǰ������������������Ϊʧ�ܡ� |

| 413 Request Entity Too Large | �����������ʵ��̫��,����������������� |

| 414 Request-URI Too Long | ���� URL ̫��,����������������� POST ����ת��Ϊ���кܳ��IJ�ѯ��Ϣ�� GET ����ʱ,�ͻᷢ����������� |

| 415 Unsupported Media Type | ����ý�����Ͳ���֧��,����������������� |

| 416 Requested Range Not Satisfiable | �ͻ��������ĵ�,���Ƿ����������ṩ������IJ��֡� |

| 417 Expectation Failed | ��������������ͻ���������ָ��������ͷ�� |

| 429 Too Many Requests | �ͻ��˷�����̫�������,ͨ�������ڷ���������������; |

| 431 Request Header Fields Too Large | ����ͷij���ֶλ�����̫��; |

| 500 Internal Server Error | �� 400 ����,Ҳ��һ��ͨ�õĴ�����,����������������ʲô���������Dz�֪���ġ��������ڷ�������˵��Ӧ�����Ǻ���,ͨ����Ӧ�ðѷ������ڲ�����ϸ��Ϣ,��������ĺ�������ջ������硣��Ȼ�����ڵ���,���ܹ���ֹ�ڿ͵Ŀ�̽���߷����� |

| 501 Not Implemented | ��ʾ�ͻ�������Ĺ��ܻ���֧��,���������� 500 Ҫ���º͡�һЩ,�͡�������ҵ,�����ڴ�������˼���,��������ʲôʱ��ҵ���Ͳ���˵�ˡ� |

| 502 Bad Gateway | ͨ���Ƿ�������Ϊ���ػ��ߴ���ʱ���صĴ�����,��ʾ������������������,���ʺ�˷�����ʱ�����˴���,������Ĵ���ԭ��Ҳ�Dz�֪���ġ� |

| 503 Service Unavailable | ��ʾ��������ǰ��æ,��ʱ����Ӧ����,��������ʱ��ʱ�������ġ����������æ,���Ժ����ԡ�����ʾ��Ϣ����״̬�� 503��503 ��һ������ʱ����״̬,�ܿ��ܹ������Ӻ�������Ͳ���ôæ��,���Լ����ṩ����,���� 503 ��Ӧ������ͨ��������һ����Retry-After���ֶ�,ָʾ�ͻ��˿����ڶ���Ժ��ٴγ��Է������� |

| 504 Gateway Timeout | ���س�ʱ���������䵱���ػ��ߴ����Ľ�ɫʱ,δ�ܴ����η������յ�һ����ʱ����Ӧ�� |

| 505 HTTP Version Not Supported | ��������֧��������ָ����HTTPЭ��汾�� |

| 511 Network Authentication Required | �û���Ҫ�ṩ������֤����ȡ���������ڡ� |

10���ص��ܽ�

- HTTP ��������չ��,������������ͷ�ֶ�ʵ�������;

- HTTP �ǿɿ�����Э��,���� TCP/IP Э�顰��������֤���ݵ��ʹ�;

- HTTP ��Ӧ�ò�Э��,�� FTP��SSH �ȸ�ͨ�ù��ܸ���,�ܹ�������������;

- HTTP ʹ�������� - Ӧ��ģʽ,�ͻ���������������,�����������ظ�����;

- HTTP ����������״̬��,ÿ�������ǻ����������������,Э�鲻Ҫ��ͻ��˻� ��������¼������ص���Ϣ��

11����ȱ���ܽ�

-

HTTP �����ŵ��Ǽ�����������չ;

-

HTTP ӵ�г������Ӳ������,Ӧ�õķdz��㷺,�ǻ������Ļ�����ʩ;

-

HTTP ����״̬��,��������ʵ�ּ�Ⱥ��,��չ����,����ʱҲ��Ҫ�� Cookie ������ʵ�֡���״̬��;

-

HTTP �����Ĵ���,������ȫ���ۿɼ�,�ܹ�������о�����,��Ҳ���ױ�����;

-

HTTP �Dz���ȫ��,����֤ͨ��˫��������,Ҳ�����жϱ����Ƿܸ�;

-

HTTP �����ܲ����,������ȫ��Ӧ���ڵĻ�����,���кܴ�������ռ䡣

��������

1��ʵ������

(1)��������MIME type

? HTTP��Ӧ�ò��Э��,���ݵ���ͻ���֮��,����Ҫ�����ϲ�Ӧ����ʲô�������ݲ��ܴ�����

? ���� HTTP Э�鵮��֮ǰ���Ѿ����������������Ľ������,�����������ڵ����ʼ�ϵͳ���,�õ����ʼ����Է��� ASCII ���������������,���������ֽ���������;�������ʼ���չ��(Multipurpose Internet Mail Extensions),���Ϊ MIME��

? MIME ��һ���ܴ�ı��淶,�� HTTP ֻȡ������һ����,������� body ����������,���������ƽ�����������ġ�MIME type����

? MIME �����ݷֳ��˰˴���,ÿ����������ϸ�ֳ������ ��,��ʽ�ǡ�type/subtype�����ַ�����������о�һ���� HTTP �ᆳ�������ļ������:

- **text:**���ı���ʽ�Ŀɶ�����,��������Ϥ��Ӧ�þ��� text/html ��,��ʾ���ı��ĵ�,����д��ı� text/plain����ʽ�� text/css �ȡ�

- **image:**��ͼ���ļ�,�� image/gif��image/jpeg�� image/png �ȡ�

- **audio/video:**��Ƶ����Ƶ����,���� audio/mpeg�� video/mp4 �ȡ�

- **application:**���ݸ�ʽ���̶�,�������ı�Ҳ�����Ƕ�����,�������ϲ�Ӧ�ó��������͡��������� application/json,application/javascript�� application/pdf ��,����,���ʵ���Dz�֪��������ʲô����,��ղ�˵�ġ��ںС�,�ͻ��� application/octet-stream,�������Ķ��������ݡ�

(2)����Encoding type

? ���� MIME type ������,��Ϊ HTTP �ڴ���ʱΪ�˽�Լ����,��ʱ��ѹ������,����Ҫ��һ����Encoding type��,�����������õ�ʲô�����ʽ,�����Է�������ȷ��ѹ��,��ԭ��ԭʼ�����ݡ����õ�Encoding typeֻ����������:

- **gzip:**GNU zip ѹ����ʽ,Ҳ�ǻ������������е�ѹ�� ��ʽ;

- **deflate:**zlib(deflate)ѹ����ʽ,���г̶Ƚ����� gzip;

- **br:**һ��ר��Ϊ HTTP �Ż�����ѹ���㷨(Brotli)��

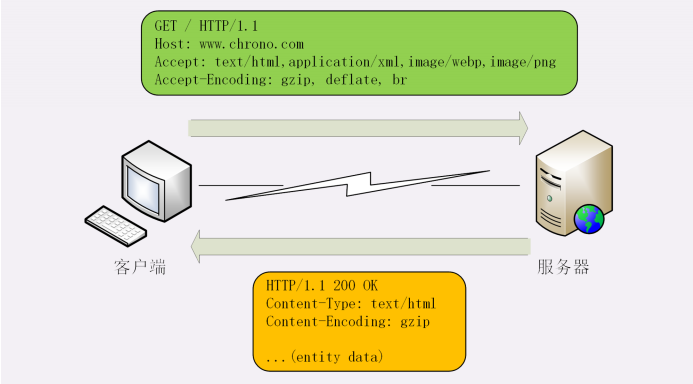

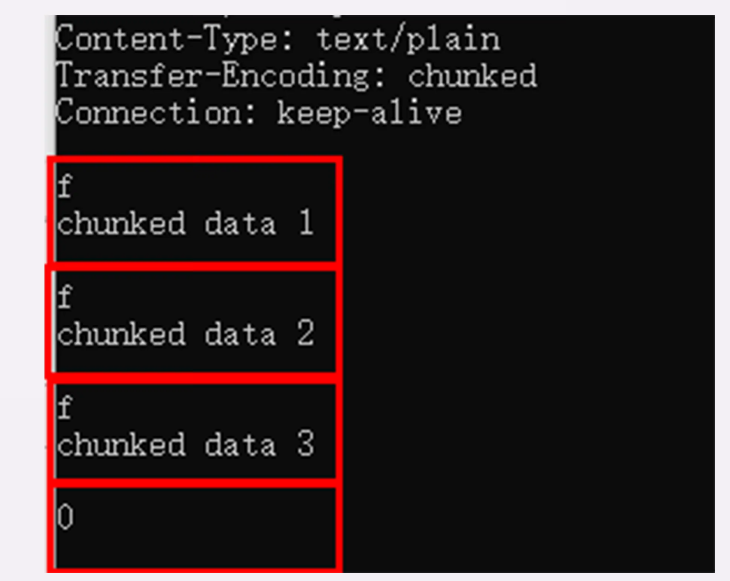

(3)�������͵�ͷ�ֶ�Accept&Content

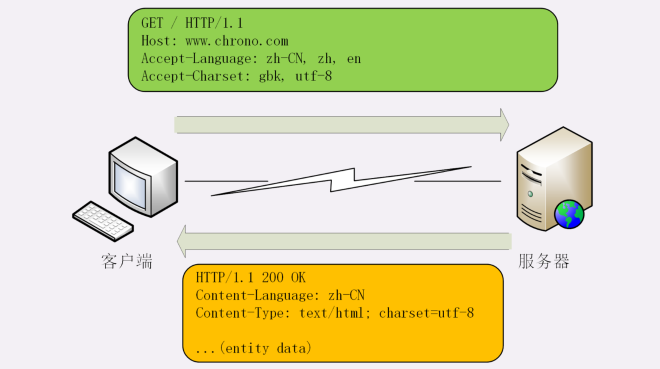

? HTTP Э�鶨�������� Accept ����ͷ�ֶκ����� Content ʵ��ͷ�ֶ�,���ڿͻ��˺ͷ��������С�����Э�������ͻ����� Accept ͷ���߷�����ϣ������ʲô��������,���������� Content ͷ���߿ͻ���ʵ�ʷ�����ʲô�������ݡ�

? **Accept:**��ǵ��ǿͻ��˿������ MIME type,�����á�,�����ָ����г��������,�÷������и����ѡ�����,������������ͷ��

Accept: text/html,application/xml,image/webp,image/png

? **Content-Type:**����ʵ�����ݵ���ʵ����,��������������ǡ�text/html����֪���� HTML �ļ�,������Ű�������Ⱦ��ҳ��,������image/png����֪����һ�� PNG �ļ�,�ͻ���ҳ������ʾ��ͼ��

Content-Type: text/html

Content-Type: image/png

(4)�����ͷ�ֶ�Accept-Encoding&Content-Encoding

? **Accept-Encoding:**�ǿͻ���֧�ֵ�ѹ����ʽ, ��������˵�� gzip��deflate ��,ͬ��Ҳ�����á�,���г��� ����

? Content-Encoding:����������ѡ������һ����ѹ������,ʵ��ʹ�õ�ѹ����ʽ������Ӧͷ�ֶ�Content-Encoding�

Accept-Encoding: gzip, deflate, br

Content-Encoding: gzip

? �������ֶ��ǿ���ʡ�Ե�,�����������û�� Accept-Encoding �ֶ�,�ͱ�ʾ�ͻ��˲�֧��ѹ������; �����Ӧ������û�� Content-Encoding �ֶ�,�ͱ�ʾ��Ӧ����û�б�ѹ����

(5)��������

? �������鲼ȫ��,��ͬ���Ҳ�ͬ��������ʹ���˺ܶͬ������,��Ȼ���� text/html,������������ʾ��ÿ���˶���������Ķ�����������,���ǹ��ʻ�����,HTTP ����������������:�����������ַ�����

? ����������������ʹ�õ���Ȼ����,����Ӣ� ��������,����Щ��Ȼ���Կ��ܻ��������ĵ����Է���,��������Ҫ��ȷ���ֵ�ʱ��ҲҪʹ�á�type-subtype������ʽ,��������ĸ�ʽ���������Ͳ�ͬ,�ָ������ǡ�/��,���ǡ�-����

? �ټ�������:en ��ʾ�����Ӣ��,en-US ��ʾ��ʽӢ��, en-GB ��ʾӢʽӢ��,�� zh-CN �ͱ�ʾ�����ʹ�õĺ��

(6)�ַ���

? �ڼ������չ������,�������Һ͵��������ǡ�����Ϊ����,�����������ַ����뷽ʽ����������,����Ӣ�������õ� ASCII�����������õ� GBK��BIG5,���������õ�Shift_JIS �ȡ�ͬ����һ������,��һ�ֱ�����ʾ����,����һ�ֱ������ܾͻ���һ���㡣

? ���Ժ����ͳ����� Unicode �� UTF-8,�����������е����Զ�������һ�ֱ��뷽����,UTF-8 Ҳ��Ϊ�˻������ϵı��ַ�����

(7)�������͵�ͷ�ֶ�Accept-Language&Content-Language

? **Accept-Language:**����˿ͻ��˿��������Ȼ����,Ҳ�����á�,�����ָ����г��������,����,�������ͷ����߷�����:����ø��� zh-CN �ĺ�������,���û�о��������ĺ��﷽��,�����û�о�Ӣ�ġ���

Accept-Language: zh-CN, zh, en

? Content-Language:����������Ӧ��������ͷ�ֶ�Content-Language���߿ͻ���ʵ������ʹ�õ�ʵ����������:

Content-Language: zh-CN

(8)�ַ�����ͷ�ֶ�Accept-Charset&Content-Type

? **Accept-Charset:**������ַ�����HTTP��ʹ�õ�����ͷ�ֶΡ�

? Content-Type:��Ӧͷ��ȴû�ж�Ӧ�� Content-Charset,������Content-Type�ֶ��á�charset=xxx������ʾ,�����Ҫ�ر�ע�⡣

Accept-Charset: gbk, utf-8

Content-Type: text/html; charset=utf-8

? �������ڵ��������֧�ֶ����ַ���,ͨ�����ᷢ��Accept-Charset,��������Ҳ���ᷢ�� Content-Language,��Ϊʹ�õ�������ȫ�������ַ����ƶϳ���,����������ͷ��һ��ֻ���� Accept-Language �ֶ�,��Ӧͷ��ֻ���� Content-Type �ֶΡ�

(9)����Э�̵�����ֵq

? �� HTTP Э������ Accept��Accept-Encoding��Accept-Language ������ͷ�ֶν�������Э�̵�ʱ��,��������һ������ġ�q��������ʾȨ�����趨���ȼ�,����ġ�q���ǡ�quality factor������˼��

? Ȩ�ص����ֵ�� 1,��Сֵ�� 0.01,Ĭ��ֵ�� 1,���ֵ��0 �ͱ�ʾ�ܾ����������ʽ�����������ͻ����Դ�������һ����;��,Ȼ���ǡ�q=value����

? ����Ҫ���ѵ��ǡ�;�����÷�,�ڴ������������;���ĶϾ�����Ҫǿ�ڡ�,��,���� HTTP ������Э����ȴǡ�÷��˹���,��;����������С�ڡ�,���ġ�

? ��������� Accept �ֶ�,����ʾ�������ϣ��ʹ�õ��� HTML �ļ�,Ȩ���� 1,����� XML �ļ�,Ȩ���� 0.9,�����������������,Ȩ���� 0.8���������յ�����ͷ��,�ͻ����Ȩ��,�ٸ����Լ���ʵ������������ HTML ���� XML��

Accept: text/html,application/xml;q=0.9,*/*;q=0.8

(10)����Э�̵Ľ��Vary

? Vary:����Э�̵Ĺ����Dz�����,ÿ�� Web ������ʹ�õ��㷨����һ�������е�ʱ��,������������Ӧͷ����һ��Vary�ֶ�,��¼������������Э��ʱ�ο�������ͷ�ֶΡ�

? ����,��� Vary �ֶα�ʾ������������ Accept-Encoding��User-Agent �� Accept ������ͷ�ֶ�,Ȼ������˷��ص���Ӧ���ġ�

Vary: Accept-Encoding,User-Agent,Accept

? Vary �ֶο�����Ϊ����Ӧ���ĵ�һ������ġ��汾��ǡ���ÿ�� Accept ������ͷ�仯ʱ,Vary Ҳ��������Ӧ����һ��仯��Ҳ����˵,ͬһ�� URI ���ܻ��ж����ͬ�ġ��汾��,��Ҫ���ڴ�����·�м�Ĵ���������ʵ�ֻ������

2��������ļ�

? ���ڻ������ϴ���Ļ����϶���ֻ�м� K ��С���ı���СͼƬ,���ڵ��������в�ͬ����ҳ���������Ϣʵ����̫����,������һ����ҳ HTML ���п����ϰ� K,��������ͼƬ���� M ��,����Ҫ˵��Щ��Ӱ�����Ӿ���,�� G����ʮ G ���п��ܡ�httpЭ������˺ܶ���Ч�ֶ�����ʵ�������Ĵ����¸�Ч��ݵش�����Щ���ļ���

(1)����ѹ��

? **Accept-Encoding:**ͨ��������ڷ�������ʱ������š�Accept-Encoding��ͷ�ֶ�,�����������֧�ֵ�ѹ����ʽ�б�,���� gzip��deflate��br �ȡ�

? **Content-Encoding:**�������Ϳ��Դ���ѡ��һ��ѹ���㷨,�Ž���Content-Encoding����Ӧͷ��,�ٰ�ԭ����ѹ�����������

? **ȱ��:**gzip ��ѹ���㷨ͨ��ֻ���ı��ļ��нϺõ�ѹ����,��ͼƬ����Ƶ��Ƶ�ȶ�ý�����ݱ������Ѿ��Ǹ߶�ѹ����,���� gzip ����Ҳ�����С,��������ʧЧ�ˡ�

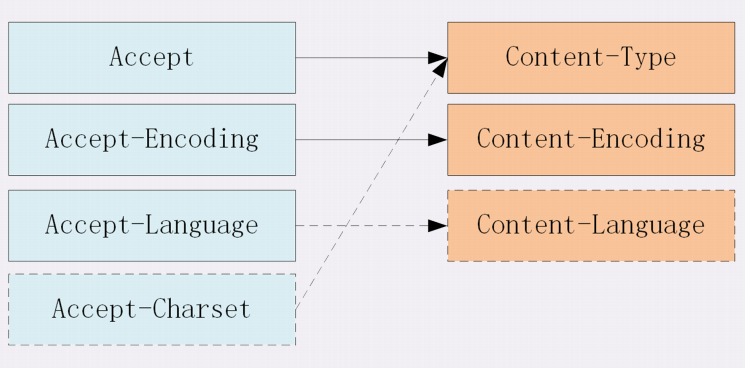

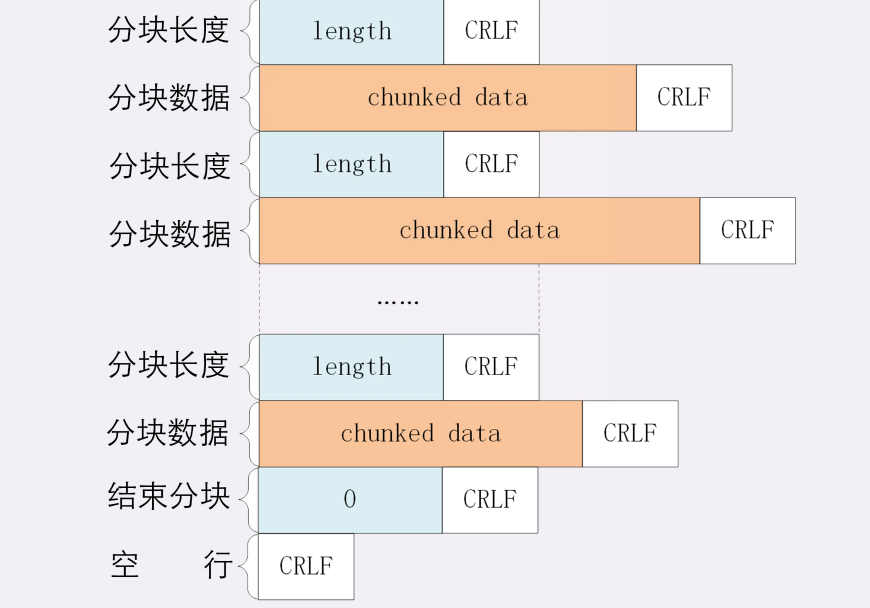

(2)�ֿ鴫��

? **����Ϊ��:**������ļ����岻�ܱ�С,�ǾͰ�������,�ֽ�ɶ��С��,����ЩС��������������,������յ�������װ��ԭ���������Խ�ʡ�ڴ�ʹ�������Դ��

? **Transfer-Encoding:chunked:**��˼�DZ������ body ���ֲ���һ���Է�������,���Ƿֳ�������Ŀ�(chunk)������͡�

? **��ʽ����:**���������ݿ̬���ɵı���ҳ��,��������� body ���ݵij�����δ֪��,����ͷ�ֶΡ�Content-Length�������ȷ�еij���,����Ҳֻ���� chunked ��ʽ�ֿ鷢�͡�

? **����:**����Ӧ�����Transfer-Encoding: chunked���͡�Content-Length���������ֶβ���ͬʱ����,һ����Ӧ���ĵĴ���Ҫô�dz�����֪,Ҫô�dz���δ֪(chunked)��

? ������������һ�·ֿ鴫��ı������,��ʵҲ�ܼ�,ͬ�����������ĵķ�ʽ,��������Ӧͷ��

- ÿ���ֿ������������,����ͷ�����ݿ�;

- ����ͷ���� CRLF(�س�����,��\r\n)��β��һ������,�� 16 �������ֱ�ʾ����;

- ���ݿ�����ڳ���ͷ��,���Ҳ�� CRLF ��β,�����ݲ����� CRLF;

- �����һ������Ϊ 0 �Ŀ��ʾ����,����0\r\n\r\n����

? ������������յ��ֿ鴫������ݺ���Զ����չ���ȥ���ֿ����,������װ������,������Ҫ����������������ԭʼ������̬�͵��� Telnet �ֹ���������,��Ϊ Telnet ֻ���յ���Ӧ���ľ�������,��������ֿ�����,���Կ��Ժ�����ؿ�����Ӧ������� chunked ���ݸ�ʽ:����һ�� 16 ���Ƴ���,Ȼ��������,Ȼ������ 16 ���Ƴ��Ⱥ�����,����ظ�,����� 0 ���ȷֿ������

(3)������

? **��Χ����:**���˷ֿ鴫�����,�������Ϳ������ɵ��շ����ļ���,�������� G �ij����ļ�,����һЩ������Ҫ���ǡ�����,���ڿ��������Ȳ���ij��Խ��,������Ƭͷ,ֱ�ӿ���Ƭ,��ʵ���������ȡһ�����ļ����е�Ƭ�����ݡ���Χ���������ͻ���������ͷ��ʹ��ר���ֶ�ֻ��ȡ�ļ���һ���֡�

? **Accept-Ranges:**��Χ������ Web �������ر��Ĺ���,��������������Ӧͷ��ʹ�á�Accept-Ranges: bytes����ʾ֧�ַ�Χ����,ʹ�á�Accept-Ranges: none��,���߸ɴ���͡�Accept-Ranges���ֶ�,��ʾ��֧�ַ�Χ����

? **Range:**�� HTTP ��Χ�����ר���ֶ�,��ʽ�ǡ�Range:bytes=x-y��, x �� y ��λ���ֽ�,��Χ����� 0 ����������ǰ 10 ���ֽڱ�ʾΪ��0-9����

? Range �ĸ�ʽ�����,��� x ���յ� y ����ʡ��,�ܹ��ܷ���ر�ʾ�������ߵ����ķ�Χ�������ļ��� 100 ���ֽ�,��ô:

- ��0-����ʾ���ĵ���㵽�ĵ��յ�,�൱�ڡ�0-99��;

- ��10-���Ǵӵ� 10 ���ֽڿ�ʼ���ĵ�ĩβ,�൱�ڡ�10-99��;

- ��-1�����ĵ������һ���ֽ�,�൱�ڡ�99-99��;

- ��-10���Ǵ��ĵ�ĩβ���� 10 ���ֽ�,�൱�ڡ�90-99����

? �������յ� Range �ֶκ�,��Ҫ���ļ���:

- ��鷶Χ�Ƿ�Ϸ�:�����ļ�ֻ�� 100 ���ֽ�,������200-300��,����Ƿ�ΧԽ���ˡ��������ͻ᷵��״̬��416,��˼�ǡ���ķ�Χ��������,��������,���ټ��һ�¡���

- **��ȡ�ļ�:**�����Χ��ȷ,�������Ϳ��Ը��� Range ͷ����ƫ����,��ȡ�ļ���Ƭ����,����״̬�롰206 PartialContent��,�� 200 ����˼���,����ʾ body ֻ��ԭ���ݵ�һ���֡�

- **������Ӧͷ�ֶ�Content-Range:**����Ƭ�ε�ʵ��ƫ��������Դ���ܴ�С,��ʽ�ǡ�bytes x-y/length��,�� Range ͷ������û�С�=��,��Χ������ܳ��ȡ�����,���ڡ�0-10���ķ�Χ����,ֵ���ǡ�bytes0-10/100����

- **��������:**ֱ�Ӱ�Ƭ���� TCP �����ͻ���,һ����Χ��������Ǵ������ˡ�

? ����������������ʹ�� Range �ֶλ�ȡ���ļ���ǰ 32���ֽ�:

GET /16-2 HTTP/1.1

Host: www.chrono.com

Range: bytes=0-31

? ���ص�������(ȥ���˼������ֶ�):

HTTP/1.1 206 Partial Content

Content-Length: 32

Accept-Ranges: bytes

Content-Range: bytes 0-31/96

// this is a plain text json doc

(4)�������

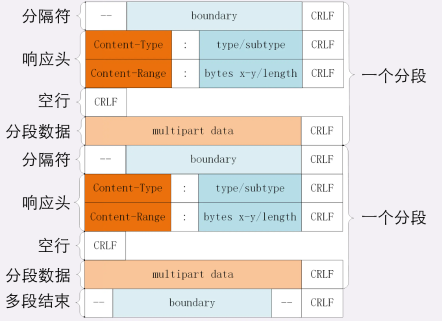

? �ղ�˵�ķ�Χ����һ��ֻ��ȡһ��Ƭ��,��ʵ����֧����һ���Ի�ȡ���Ƭ������,��Ҫʹ�á�Content-Type: multipart/byteranges��,��ʾ���ĵ� body ���ɶ���ֽ�������ɵ�,���һ�Ҫ��һ��������boundary=xxx��������֮��ķָ���ǡ�

? ������ݵĸ�ʽ��ֿ鴫��Ҳ�Ƚ�����,������Ҫ�÷ָ���� boundary �����ֲ�ͬ��Ƭ��,����ͨ��ͼ���Ա�һ�¡�

? ÿһ���ֶα����ԡ�- -boundary����ʼ,֮��Ҫ�á�Content-Type���͡�Content-Range�����������ݵ����ͺ����ڷ�Χ,Ȼ�������ͨ����Ӧͷһ���Իس����н���,�ټ��Ϸֶ�����,�����һ����- -boundary- -����ʾ���еķֶν�����

����,���Ƿ�����������Χ������:

GET /16-2 HTTP/1.1

Host: www.chrono.com

Range: bytes=0-9, 20-29

�õ��ľͻ�����������:

HTTP/1.1 206 Partial Content

Content-Type: multipart/byteranges; boundary=0000000000

Content-Length: 189

Connection: keep-alive

Accept-Ranges: bytes

--00000000001

Content-Type: text/plain

Content-Range: bytes 0-9/96

// this is

--00000000001

Content-Type: text/plain

Content-Range: bytes 20-29/96

ext json d

--00000000001--

������ġ�- -00000000001�����Ƕ�εķָ���,ʹ�����ͻ��˾Ϳ��Ժ��������ֳ���� Range ���ݡ�

3�����ӹ���

(1)������

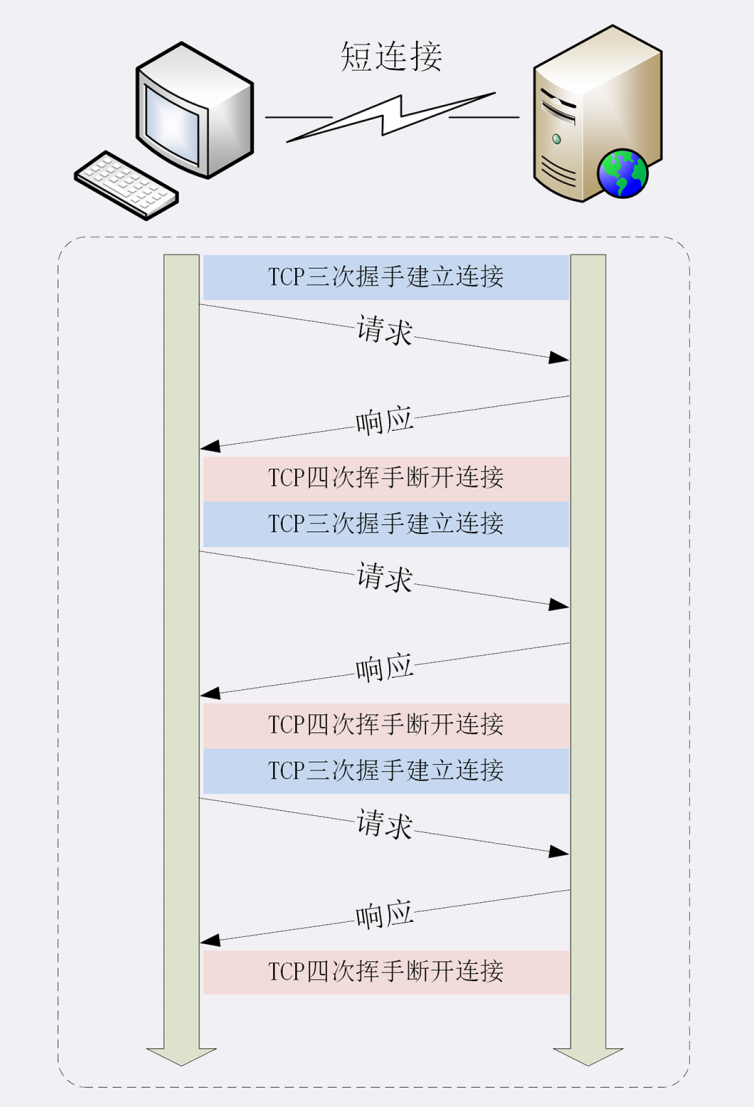

? HTTP Э�����(0.9/1.0)�Ǹ��dz���Э��,ͨ�Ź���Ҳ�����˼ġ����� - Ӧ�𡱷�ʽ�����ײ�����ݴ������ TCP/IP,ÿ�η�������ǰ��Ҫ�����������������,�յ���Ӧ���ĺ�������ر����ӡ���Ϊ�ͻ�������������������ӹ��̺ܶ���,��������������ֳ�ʱ�������״̬,���Ծͱ���Ϊ����������(shortlived connections)��

? �����ӵ�ȱ���൱����,��Ϊ�� TCP Э����,�������Ӻر����Ӷ��Ƿdz������IJ�����TCP ��������Ҫ�С��������֡�,���� 3 �����ݰ�,��Ҫ 1 �� RTT;�ر������ǡ��Ĵλ��֡�,4 �����ݰ���Ҫ 2 �� RTT���� HTTP ��һ�μ����� - ��Ӧ��ͨ��ֻ��Ҫ 4 ����,�������������ڲ��Ĵ���ʱ��,����� 2 �� RTT����ô������,�˷ѵ�ʱ����ǡ�3��5=60%��,������֮����ʱ�䱻�˷ѵ���,����Ч�ʵ͵þ��ˡ�

(2)������

? ��Զ����ӱ�¶����ȱ��,HTTP Э�������ˡ�����������ͨ�ŷ�ʽ,Ҳ�С��־����ӡ�(persistentconnections)�������ӱ��(keep alive)�������Ӹ��á�(connection reuse)��

? ��ʵ����취Ҳ�ܼ�,�õľ��ǡ��ɱ���̯����˼·,��Ȼ TCP �����Ӻرշdz���ʱ��,��ô�Ͱ����ʱ��ɱ���ԭ����һ�������� - Ӧ�𡱾�̯����������� - Ӧ���ϡ�

? �������볤���ӵĶԱ�ʾ��ͼ����,�ڶ�������������� HTTP������ - Ӧ��,ÿ�ζ����˷� 60% �� RTT ʱ�䡣���ڳ����ӵ������,ͬ��������������,��Ϊֻ�ڵ�һ��ʱ��������,�����һ��ʱ�ر�����,�����˷��ʾ��ǡ�3��9��33%��,�����˲��һ���ʱ����ġ���Ȼ,���������������Ϸ��͵�����Խ��,��ĸ��Խ��,������Ҳ��Խ�ߡ�

(3)����ͷ�ֶ�

? **Ĭ�����ó�����:**���ڳ����Ӷ����ܵĸ���Ч���dz�����,������ HTTP/1.1�е����Ӷ���Ĭ�����ó����ӡ�����Ҫ��ʲô�����ͷ�ֶ�ָ��,ֻҪ������������˵�һ������,�����������ظ����õ�һ�δ� TCP ����,Ҳ���dz�����,������������շ����ݡ�

? **Connection: keep-alive:**��ʾ������ͷ����ȷ��Ҫ��ʹ�ó����ӻ��ơ����ܿͻ����Ƿ���ʽҪ������,���������֧�ֳ�����,���ܻ�����Ӧ�������һ����Connection: keep-alive���ֶ�,���߿ͻ�����֧�ֳ����ӡ�

? **������ȱ��:**��Ϊ TCP ���ӳ�ʱ�䲻�ر�,�������������ڴ��ﱣ������״̬,ռ���˷���������Դ������д����Ŀ��г�����ֻ������,�ͻ�ܿ�ľ�����������Դ,���·����á�����,������Ҳ��Ҫ��ǡ����ʱ��ر�,������Զ�����������������,���ڿͻ��˻��߷�����������������

? **Connection: close:**�ڿͻ���,������ͷ��������ͷ�ֶα�ʾ���ͨ�ź�ر����ӡ���������������ֶ�,��֪���ͻ���Ҫ�����ر�����,��������Ӧ������Ҳ��������ֶ�,����֮��͵��� Socket API �ر� TCP���ӡ�

? ��������ͨ�����������ر�����,��Ҳ����ʹ��һЩ���ԡ��� Nginx ������,�������ַ�ʽ:

-

ʹ�á�keepalive_timeout��ָ��,���ó����ӵij�ʱʱ��,�����һ��ʱ����������û���κ������շ��������Ͽ�����,�����������ռ��ϵͳ��Դ��

-

ʹ�á�keepalive_requests��ָ��,���ó������Ͽɷ��͵��������������������ó� 1000,��ô�� Nginx ����������ϴ����� 1000 �������,Ҳ�������Ͽ����ӡ�

? **Keep-Alive: timeout=value:**�ͻ��˺ͷ������������ڱ�����������ͷ�ֶ��������ӵij�ʱʱ�䡣������ֶε�Լ��������ǿ,ͨ�ŵ�˫�����ܲ���������,���Բ�̫������

(4)��ͷ����

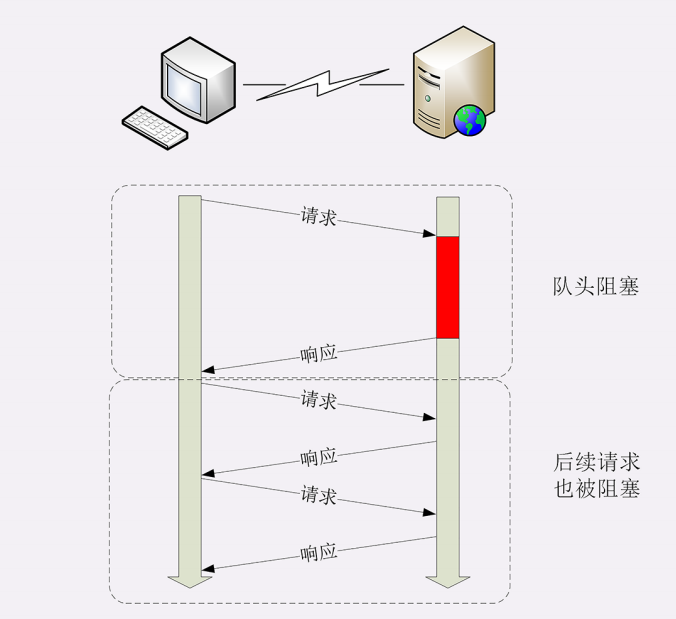

? ����ͷ������������Ӻͳ�������,������ HTTP �����ġ����� - Ӧ��ģ�������µġ���Ϊ HTTP �涨���ı����ǡ�һ��һ�ա�,����γ���һ���Ƚ��ȳ��ġ����С����С������������û�����ػ��������ȼ�,ֻ����ӵ��Ⱥ�˳��,������ǰ������������ȴ������������������Ϊ������̫��������ʱ��,��ô������������������Ҳ���ò�����һ��ȴ���

(5)�����Ż�

? **��������:**��Ϊ������ - Ӧ��ģ�Ͳ��ܱ�,���ԡ���ͷ������������HTTP/1.1 �������,ֻ�ܻ���,HTTP ������˲�������(concurrentconnections),Ҳ����ͬʱ��һ������������������,��������������������⡣

? **��������ȱ��:**���ÿ���ͻ��˶����Լ���,�����ܶ������,�û������������ͻ��Ǹ��������֡�����������Դ�����Ϳ���ס,���߱���������Ϊ�Ƕ����,��������ɡ��ܾ���������,HTTP Э�齨��ͻ���ʹ�ò���,�����ܡ����á�������RFC2616 ����ȷ����ÿ���ͻ�����ಢ�� 2 �����ӡ�����ʵ��֤���������ʵ����̫С��,�ڶ�����������ӡ���,�����������ߵ��� 6~8����������RFC7230 Ҳ�͡�˳ˮ���ۡ�,ȡ���������2�������ơ�

? **������Ƭ:**�����������ӡ���ѹե��������Ҳ�����ϸ��ٷ�չ�Ļ�������ֹ��������,���dz�����������Ƭ(domain sharding)����,���������������������˼·�����������,���� shard1.baidu.com��shard2.baidu.com,����Щ������ָ��ͬһ̨������,����ʵ�ʳ����ӵ�����������ȥ�ˡ�

4���ض������ת

? ���ҳ�桰���ӡ�ʱ����תʱ,���������Ҫ��������������� URI��������� URI ����һ���µ� HTTP ����,��ȡ��Ӧ���ĺ�ͻ��л���ʾ����,��Ⱦ���� URI ָ���ҳ�档

? **�ض���:**��ת���������������ʹ�������������,���Գ�Ϊ��������ת��,������һ����ת���ɷ������������,�����ʹ����������,��ԵؾͿ��Գ�Ϊ��������ת��,���� HTTP Э�����и�ר�ŵ�����,�����ض���(Redirection)��

(1)�ض���Ĺ���

? Location:������Ӧ�ֶ�,��ֻ����� 301/302 ״̬���������,������˷�����Ҫ���ض���� URI��

? ������յ� 301/302 ����,������Ӧͷ����û��Location�������,�ʹ��ֶ�ֵ����ȡ�� URI,�����µ� HTTP ����,�൱���Զ������ǵ����������ӡ�

? ע��,���ض���ʱ���ֻ����վ����ת,����Է��ĵ�ʹ����� URI�������Ҫ��ת��վ��,�ͱ����þ��� URI,��дȫ�Ļ�������ᵱ�����URIȥ������

(2)�ض���״̬��

? ������ض���״̬����� 301 �� 302,����м�����̫������,���� 303��307��308 ������״̬��Ľ��̶ܳȽϵ�,�е�������ͷ��������ܲ�֧��,����ʱӦ������,����ȷ���������ʵ��Ч�������ʹ�á��������յ�Ч�������,���������ת���µ� URI,����������һЩϸ�IJ��,ʹ�õ�ʱ��Ҫ�ر�ע�⡣

? **301:**�׳ơ������ض���(Moved Permanently),��˼��ԭ URI �Ѿ������á��Եز�������,������������������µ� URI����������� 301,��֪��ԭ���� URI����ʱ����,�ͻ����ʵ����Ż���������ʷ��¼��������ǩ,�´ο��ܾͻ�ֱ�����µ� URI ����,ʡȥ���ٴ���ת�ijɱ���������������濴�� 301,Ҳ�����������,����ʹ���ϵ� URI��

? **302:**�׳ơ���ʱ�ض���(��Moved Temporarily��),��˼��ԭ URI ���ڡ���ʱά����״̬,�µ� URI ���𡰶��������õġ���ʱ������������������濴�� 302,����Ϊԭ���� URI ��Ȼ��Ч,����ʱ������,����ֻ��ִ�м���תҳ��,����¼�µ�URI,Ҳ�����������Ķ��ද��,�´η��ʻ�����ԭ URI��

? 303 See Other:���� 302,��Ҫ���ض����������ΪGET ����,����һ�����ҳ��,���� POST/PUT �ظ�����;

? 307 Temporary Redirect:���� 302,���ض����������ķ�����ʵ�岻�����䶯,����� 302 ����ȷ;

? 308 Permanent Redirect:���� 307,�������ض���������䶯,������ 301�������ض��ĺ��塣

(3)�ض����Ӧ�ó���

? �ض���:һ�������ԭ����ǡ���Դ��������,��Ҫ����һ���µ�URI �����档�����õ�ԭ��ܶ�,��������������������������վ�İ桢ϵͳά��,��Щ���ᵼ��ԭ URI ָ�����Դ������,Ϊ�˱������ 404,����Ҫ���ض�����ת���µ�URI,����Ϊ�����ṩ������һ��ԭ����ǡ������ظ���,�ö����ַ����ת��һ��URI,���ӷ�����ڵ�ͬʱ���������Ӷ���Ĺ�������

? ����:301 �ĺ����ǡ��������ġ��������������������վ�ܹ������˴���ȵĸı�,�������������������������л������»�������վĿ¼����ع�,��Щ�����ǡ������ԡ��ĸı䡣ԭ���� URI �Ѿ���������,������ 301�������ض���,֪ͨ�����������������µ��µ�ַ,��Ҳ�����������Ż�(SEO)Ҫ���ǵ�����֮һ��

? **��ʱ:**302 �ĺ����ǡ���ʱ���ġ�ԭ���� URI �ڽ�����ij��ʱ��㻹��ָ�����,������Ӧ�ó�������ϵͳά��,����վ�ض���һ��֪ͨҳ��,�����û���һ����������ʡ���һ���÷����ǡ�������,������˫ʮһ������ʱ��,�Ѷ�����ѯ������ֵȲ���Ҫ�Ĺ��������ʱ�ر�,��֤���ķ����ܹ��������С�

(4)�ض�����������

? **�������:**������,�ض���Ļ��ƾ�����һ����ת������������ - Ӧ��,�������ķ��ʶ���һ�Ρ���Ȼ 301/302 ���ĺ�С,����������ת�Է�������Ӱ��Ҳ�Dz��ɺ��ӵġ�վ���ض���˵,���Գ����Ӹ���,վ���ض����Ҫ����������,�����������������,�dzɱ��ɾ߶���,������Ӱ���û������顣�����ض���Ӧ���ʶ�ʹ��,���������á�

? **ѭ����ת:**����ض���IJ�������Ƿ����,���ܻ���֡�A=>B=>C=>A��������ѭ��,��ͣ���������·��תȦȦ,��������֪������ HTTP Э���ر�涨,�����������м�⡰ѭ����ת��������,�ڷ����������ʱӦ��ֹͣ����������������ʾ��

5��Cookie����

? HTTP �ǡ���״̬����,������ŵ�Ҳ��ȱ�㡣�ŵ��Ƿ�����û��״̬����,���Ժ�������ɼ�Ⱥ,��ȱ�������֧����Ҫ��¼״̬��������������� HTTP Э���ǿ���չ��,���������� Cookie ����,�� HTTP �����ˡ�������������

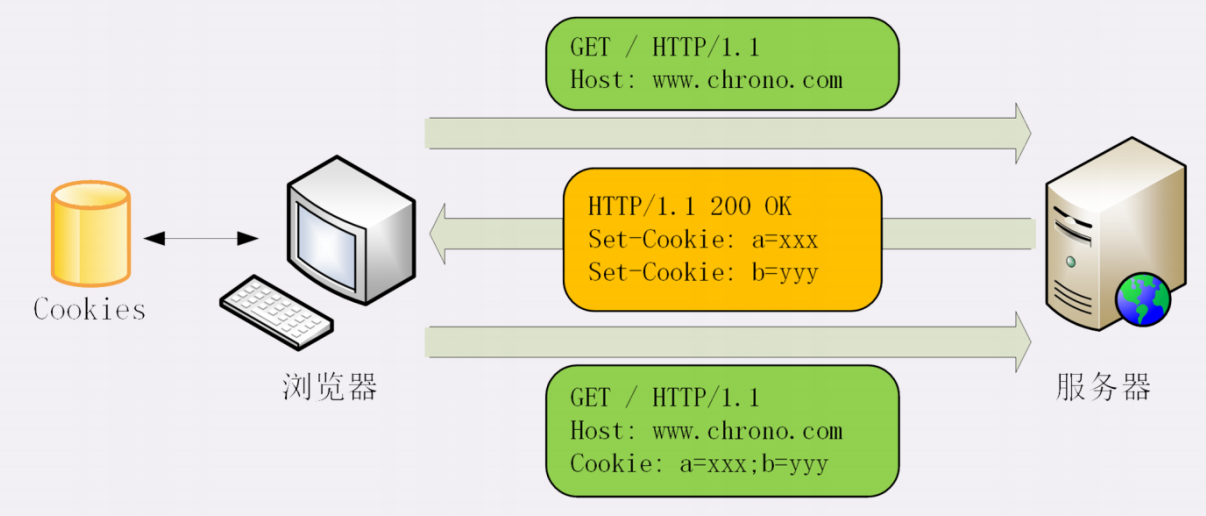

(1)ʲô�� Cookie

? HTTP �� Cookie �����൱���Ƿ�������ÿ���ͻ��˶�����һ��Сֽ��,����д��һЩֻ�з������������������,��Ҫ��ʱ��ͻ��˰���Щ��Ϣ����������,���������� Cookie,���ܹ��ϳ����ĸ��ͻ��ˡ�

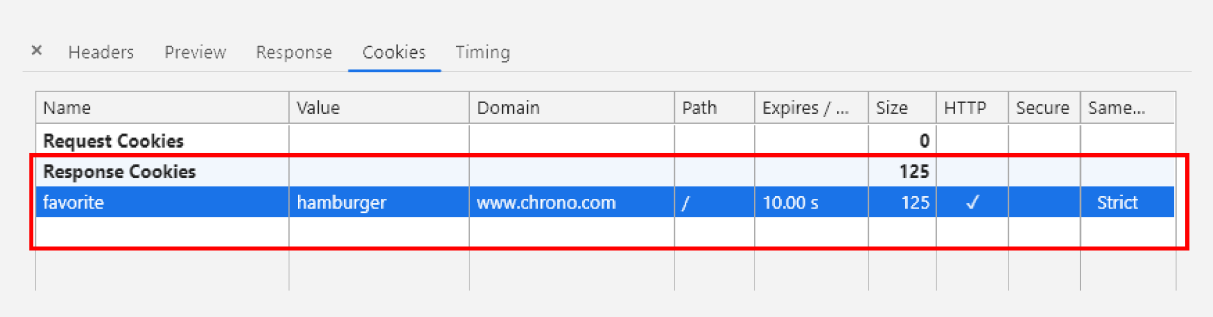

(2)Cookie ��������

? Cookie�Ĵ����õ������ֶ�:��Ӧͷ�ֶ�Set-Cookie������ͷ�ֶ�Cookie��

? **�������һ�η��ʷ�����:**�������϶��Dz�֪���������ݵġ�����,��Ҫ����һ�����ص����ݱ�ʶ����,��ʽ�ǡ�key=value��,Ȼ��Ž� Set-Cookie �ֶ���,������Ӧ����һͬ�����������

? **������յ���Ӧ����:**���������� Set-Cookie,֪�����Ƿ������������ݱ�ʶ,���Ǿͱ�������,�´��������ʱ����Զ������ֵ�Ž� Cookie �ֶ������������

? **������ڶ������������:**�������� Cookie �ֶ�,��������֪������û���������,�Ϳ����ó� Cookie ���ֵ,ʶ����û�������,Ȼ���ṩ���Ի��ķ���

? ������Ϊ�������ġ�����������ʵ����̫��,��������ʱ������Ӧͷ�����Ӷ�� Set-Cookie,�洢�����key=value�������������߷���ʱ����Ҫ�ö�� Cookie �ֶ�,ֻҪ��һ�����á�;���������С�

? ������ͼ������Ҳ�ܹ�����,Cookie �������������洢��,�����Ƿ�����������㻻�������,�µ��������û�з�������Ӧ�� Cookie,������Ҳ���ϲ�������,ֻ������һ�� Set-Cookie ���̡�

(3)Cookie ������

? **Cookie ������:**Cookie ���Ƿ�����ί��������洢�ڿͻ������һЩ����,����Щ����ͨ�������¼�û��Ĺؼ�ʶ����Ϣ������,����Ҫ�ڡ�key=value��������һЩ�ֶ�������,��ֹ��й����ȡ,��Щ�ֶξ��� Cookie �����ԡ�

? Cookie ����������:Ҳ����������Ч��,����ֻ����һ��ʱ���ڿ���,һ����������������������Ϊ��CookieʧЧ,�ڴ洢��ɾ��,Ҳ���ᷢ����������Cookie ����Ч�ڿ���ʹ�� Expires �� Max-Age ������������������Expires���׳ơ�����ʱ�䡱,�õ��Ǿ���ʱ���,��������Ϊ����ֹ���ڡ�(deadline)����Max-Age���õ������ʱ��,��λ����,��������յ����ĵ�ʱ����ټ��� Max-Age,�Ϳ��Եõ�ʧЧ�ľ���ʱ�䡣Expires �� Max-Age ����ͬʱ����,���ߵ�ʧЧʱ�����һ��,Ҳ���Բ�һ��,������������Ȳ��� Max-Age ����ʧЧ�ڡ�

? **Cookie ��������:**��������������ض��ķ������� URI,���ⱻ������վ���á�����������ñȽϼ�,��Domain���͡�Path��ָ���� Cookie ������������·��,������ڷ��� Cookie ǰ��� URI ����ȡ�� host �� path ����,�Ա� Cookie �����ԡ��������������,�Ͳ���������ͷ��� Cookie��

(4)Cookie �İ�ȫ��

? д��ǰ�˵�ͬѧһ��֪��,�� JS �ű�������� document.cookie ����д Cookie ����,��ʹ����˰�ȫ����,�п��ܻᵼ�¡���վ�ű���(XSS)������ȡ���ݡ�

? **HttpOnly����:**����������,�� Cookie ֻ��ͨ������� HTTP Э�鴫��,��ֹ������ʽ����,������� JS ����ͻ���� document.cookie ��һ����ص� API,�ű�����Ҳ����̸���ˡ�

? SameSite����:���Է�������վ����α�족(XSRF)����,���óɡ�SameSite=Strict�������ϸ��� Cookie ����������ת���ӿ�վ����,����SameSite=Lax�����Կ���һ��,���� GET/HEAD �Ȱ�ȫ����,����ֹ POST ��վ���͡�

? **Secure����:**��ʾ��� Cookie ������ HTTPS Э����ܴ���,���ĵ�HTTP Э����ֹ���͡��� Cookie �������Ǽ��ܵ�,������ﻹ�������ĵ���ʽ���ڡ�

(5)Cookie ��Ӧ��

? **����ʶ��:**Cookie �������һ����;,�����û��ĵ�¼��Ϣ,�����˺ź������¼��վ,��¼�ɹ������������ͻᷢ�������һ��Cookie,֮�������վ,����������Զ������� Cookie ����������,����������֪���������,ʵ�֡�״̬���֡���

? **������:**��������ʱ��,�������վ�������� Cookie ,������������վ��ʱ��,��Ĺ������� Cookie�����������,Ȼ������Ϊ����,���Ƹ����档�������������ܴ�,��浽������,��ô�ͱȽϡ��ֲ�����,�������ߵ�����������ͨ�� Cookie �ϳ�����,ʵ�ֹ�桰���������Ϊ�˷�ֹ���� Cookie �Ѽ��û���˽,��������֯�������� DNT(Do Not Track)��P3P(Platform for Privacy Preferences Project),��ʵ�����ò���

(6)Chrome �����߹���

? Chrome �����߹����Dz鿴 Cookie ����������,�ڡ�Network-Cookies������Կ�������ҳ�� Cookie �ĸ�������,��һ����Application����������ܹ�����ؿ���ȫվ������Cookie��

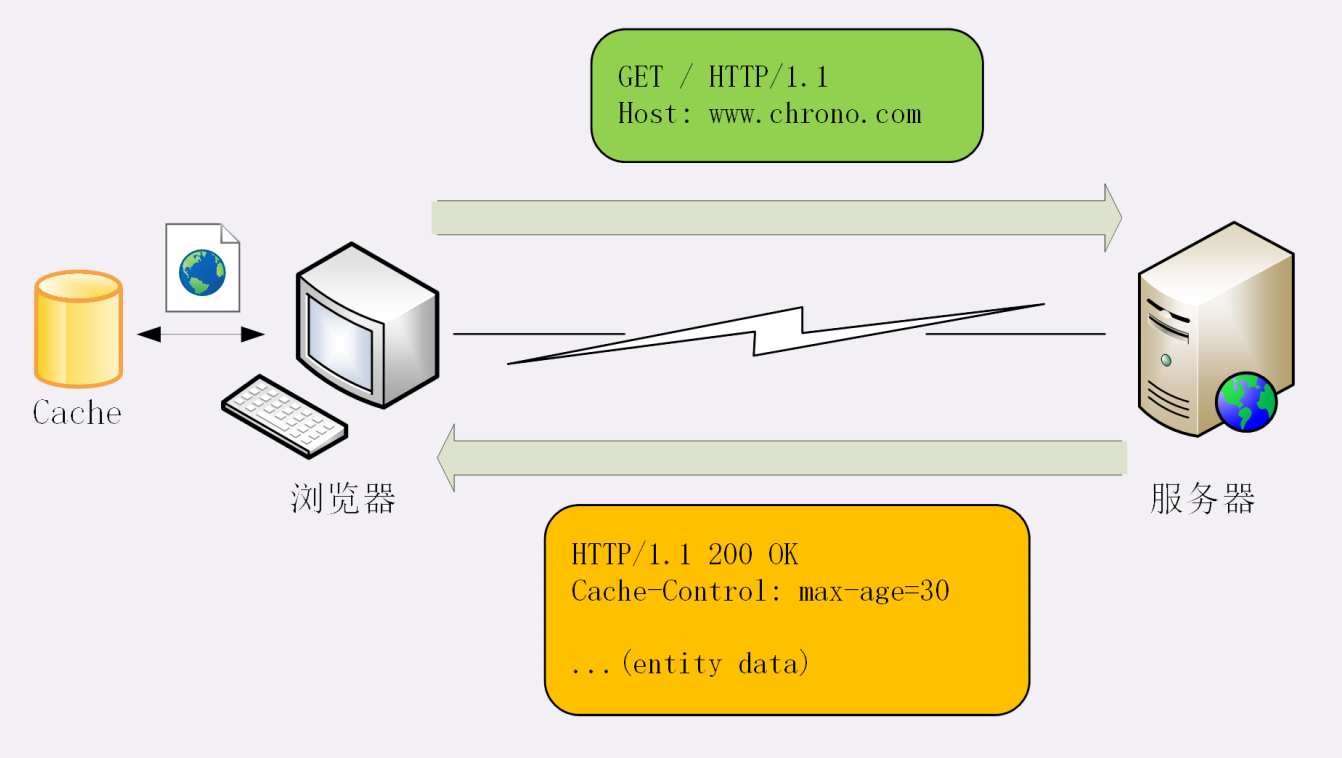

6���������

? ����(Cache)�Ǽ�����������һ����Ҫ����,���Ż�ϵͳ���ܵ�������������·����,����ʱ�Ӳ��ɿ�,�����ʹ�� HTTP ��ȡ��Դ�ijɱ��ϸߡ���������,�´��������ʱ���ܵظ��á�����,�Ϳ��Ա��������� - Ӧ���ͨ�ųɱ�,��Լ�������,Ҳ���Լӿ���Ӧ�ٶȡ�

? ���ڡ����� - Ӧ��ģʽ���ص�,���Դ��·�Ϊ�ͻ��˻���ͷ������˻��档

(1)�������Ļ������

? ���������������:

-

��������ֻ���������,���Ƿ�������,���������ȡ��Դ;

-

��������Ӧ����,������Դ,ͬʱ�����Դ����Ч��;

-

�����������Դ,�ȴ��´����á�

? **Cache-Control:**�Ƿ����������Դ��Ч��ʹ�õ�ͷ�ֶ�,�����ֵ��max-age=30��������Դ����Чʱ��,�൱�ڸ��������,���ҳ��ֻ�ܻ��� 30 ��,֮������ǹ���,�����á�

? **max-age:**�ǡ�����ʱ����(�ֽС����ʶȡ�������������,���� TTL,Time-To-Live),ʱ��ļ����������Ӧ���ĵĴ���ʱ��(�� Date �ֶ�,Ҳ�����뿪��������ʱ��),�����ǿͻ����յ����ĵ�ʱ��,Ҳ����˵����������·������������нڵ���ͣ����ʱ�䡣����,�������趨��max-age=5��,����Ϊ�������������,��������յ���Ӧ�����Ѿ���ȥ�� 4 ��,��ô�����Դ�ڿͻ��˾�����ܹ��ٴ� 1 ����,֮��ͻ�ʧЧ��

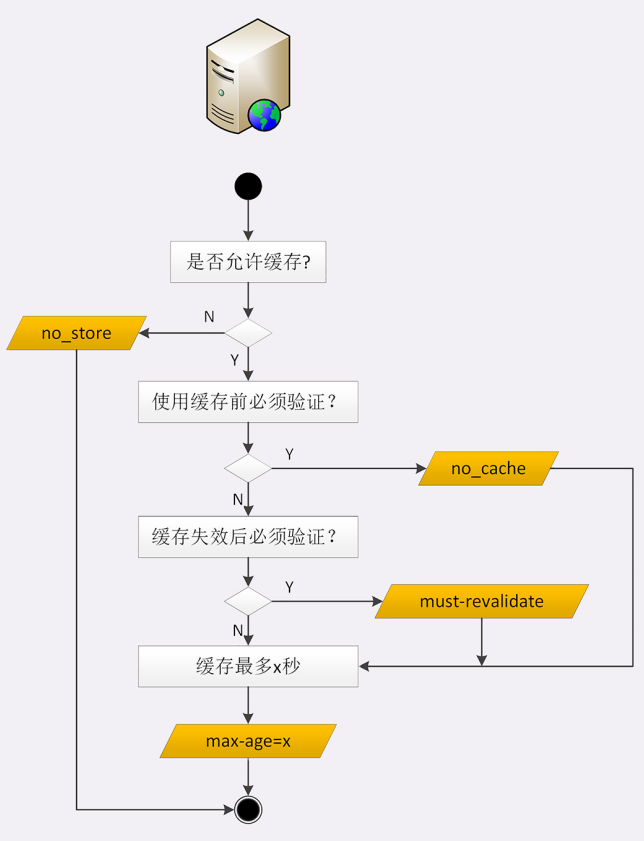

? ��������Ӧ�����ﻹ����������������������ȷ��ָʾ�����Ӧ�����ʹ�û���:

- no_store:����������,����ijЩ�仯�dz�Ƶ��������,������ɱҳ��;

- no_cache:�������溬�������� no_store ���,ʵ�ʵ���˼�����Dz���������,�������Ի���,����ʹ��֮ǰ����Ҫȥ��������֤�Ƿ����,�Ƿ������µİ汾;

- must-revalidate:����һ���� no_cache ���ƵĴ�,������˼��������治���ھͿ��Լ���ʹ��,����������������þͱ���ȥ��������֤��

? ������Ƶ�����ͼ����:

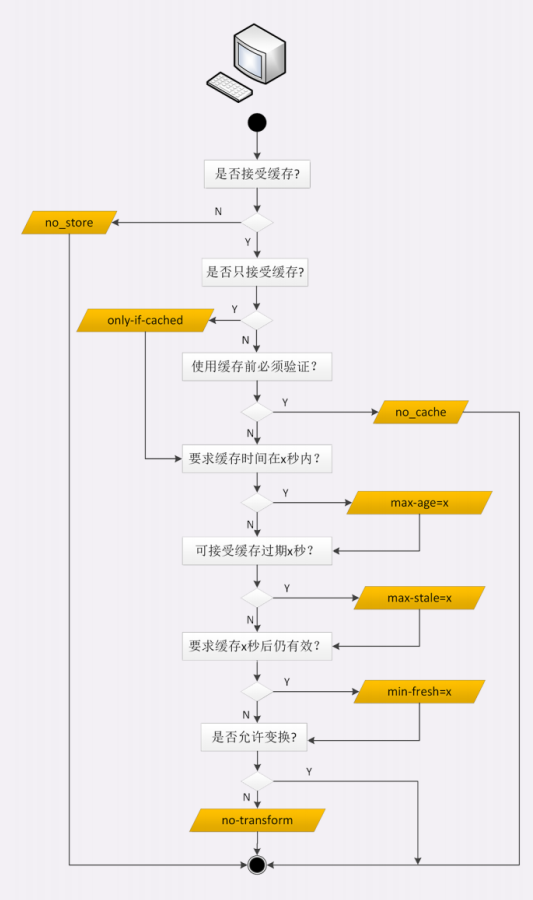

(2)�ͻ��˵Ļ������

? **Cache-Control:**�����Ҳ���Է���Cache-Control��,Ҳ����˵���� - Ӧ���˫��������������ֶν��л������,����Э�̻����ʹ�ò��ԡ�

? ˢ�°�ť:�������������ͷ���һ����Cache-Control: max-age=0��������������Ͳ���ʹ�û���,������������������������� max-age=0,Ҳ�ͻ���һ���������ɵı��Ļ�Ӧ�������

? Ctrl+F5 ��ǿ��ˢ��:����ʵ�Ƿ���һ����Cache-Control: no-cache��,����͡�max-age=0������һ��,�Ϳ���̨�ķ�������ô����,ͨ�����ߵ�Ч������ͬ�ġ�

? **ǰ��,����:**��ͻᾪϲ�ط��֡�from disk cache��������,��˼��û�з�����������,���Ƕ�ȡ�Ĵ����ϵĻ��档�ڡ�ǰ���������ˡ�����ת����Щ�ض������������ֻ�������������ͷ,û�С�Cache-Control��,���Ծͻ��黺��,ֱ������֮ǰ����Դ,���ٽ�������ͨ�š�

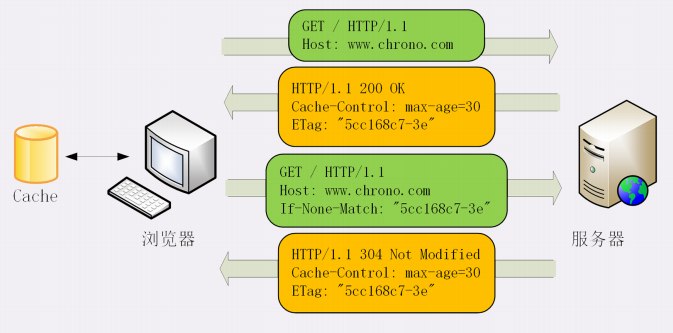

(3)��������

? ���������������������������ɡ���֤������:����һ�� HEAD,��ȡ��Դ����ʱ���Ԫ��Ϣ,Ȼ���뻺�����ݱȽ�,���û�иĶ���ʹ�û���,��ʡ��������,������ٷ�һ�� GET ����,��ȡ���µİ汾��

? **��������:**��������������������ɱ�̫����,���� HTTP Э��Ͷ�����һϵ�С�If����ͷ�ġ������������ֶ�,ר�����������֤��Դ�Ƿ����,���������������ɵĹ����ϲ���һ����������������,��֤������Ҳ����������,�����ֻ�衰������ɡ���

? **��������ͷ�ֶ�:**һ���� 5 ��ͷ�ֶ�,��õ��ǡ�if-Modified-Since���͡�If-None-Match��������,��������ͷ�ֶ��ǡ�If-Unmodified-Since����If-Match���͡�If-Range������Ҫ��һ�ε���Ӧ����Ԥ���ṩ��Last-modified���͡�ETag��,Ȼ��ڶ�������ʱ�Ϳ��Դ��ϻ������ԭֵ,��֤��Դ�Ƿ������µġ������Դû�б�,�������ͻ�Ӧһ����304 Not Modified��,��ʾ������Ȼ��Ч,������Ϳ��Ը���һ����Ч��,Ȼ����Ĵ�ʹ�û����ˡ�

? **Last-modified:**�����ļ��������ʱ�䡣**ETag:**�ǡ�ʵ���ǩ��(Entity Tag)����д,����Դ��һ��Ψһ��ʶ,��Ҫ�����������ʱ����ȷ�����ļ��仯�����⡣����,һ���ļ���һ�������˶��,����Ϊ��ʱ�����뼶,������һ���ڵ��°汾�����֡��ٱ���,һ���ļ����ڸ���,����ʱ����ͬ��������,ʵ����û�б仯,����ʱ��ͻ�����Ϊ�����˱仯,����������ͻ��˷Ѵ�����ʹ�� ETag �Ϳ��Ծ�ȷ��ʶ����Դ�ı䶯���,��������ܹ�����Ч�����û��档

? ETag ���С�ǿ��������֮�֡�ǿ ETag Ҫ����Դ���ֽڼ��������ȫ���,�� ETag ��ֵǰ�и���W/�����,ֻҪ����Դ��������û�б仯,���ڲ����ܻ��в��ַ����˸ı�(���� HTML ��ı�ǩ˳�����,���߶��˼����ո�)��

7����������

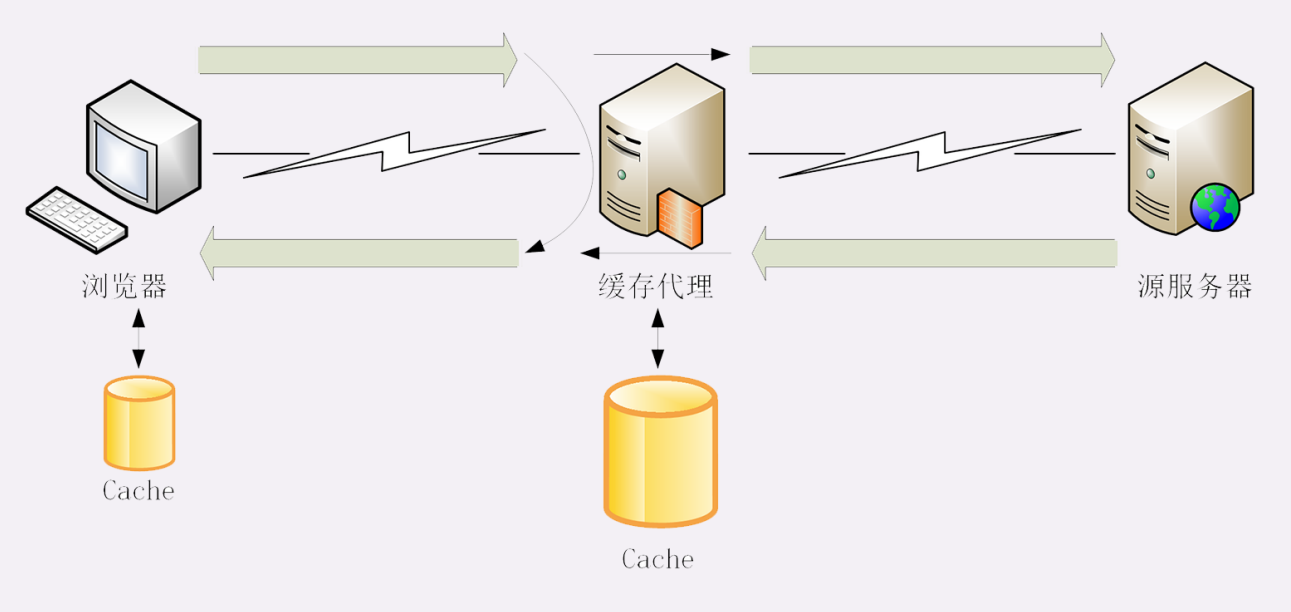

? HTTP �ġ����� - Ӧ��ģ����ֻ����������ͨ�ŵĽ�ɫ,�ֱ��ǡ����������(�ͻ���)�͡�Ӧ�������������������ģ��������һ���µĽ�ɫ,�Ǿ���HTTP ����������������,����һ����˳���ϵ������,�������������ڵ�������ɫ��Ȼ�Ǽ�һ��һͨ��,�������Խ���������

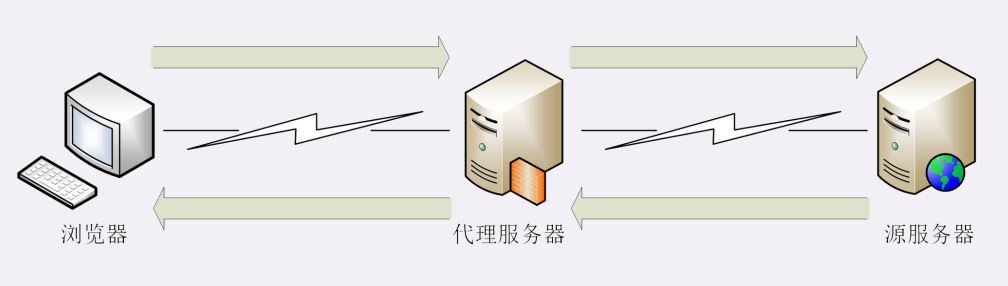

? ��������㻹�ǿͻ���(Ҳ���������),�м�Ľ�ɫ����Ϊ����������(proxy server),�������յ㱻��ΪԴ������(origin server),��˼�����ݵġ�Դͷ������Դ����

(1)��������

? **��������:**�����ڿͻ��˺ͷ�����ԭ����ͨ����·�в����һ���м价��,Ҳ��һ̨������,���ṩ���ǡ�������������������������,���Ǵ����м�λ��ת�������ε��������Ӧ,����˫������,�������ε��û�ʱ,����Ϊ������,����Դ��������Ӧ�ͻ��˵�����;���������ε�Դ������ʱ,�ֱ���Ϊ�ͻ���,�����ͻ��˷�������

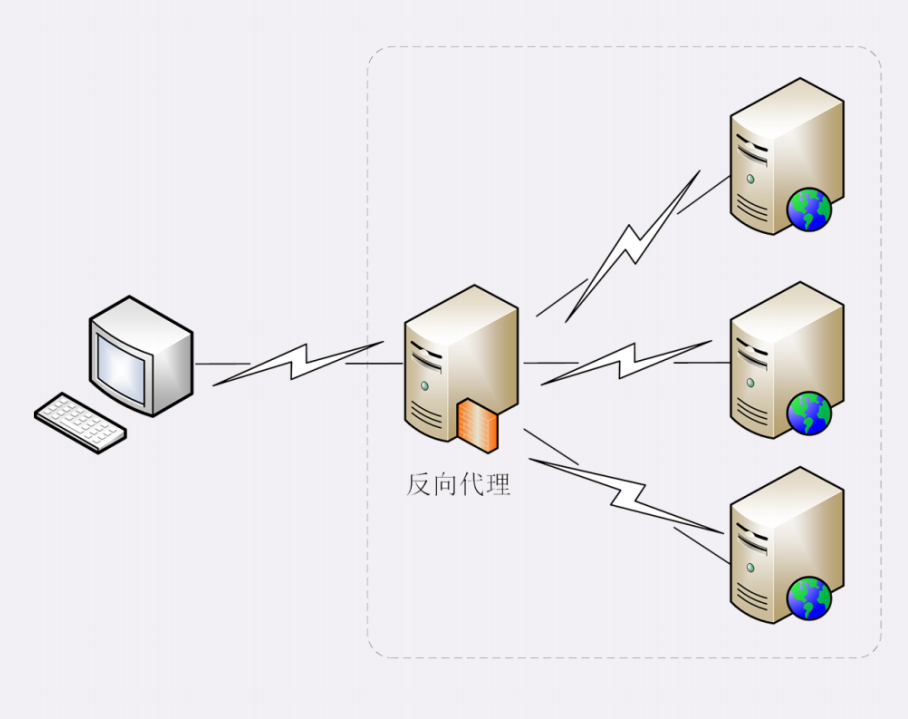

(2)����������

- **���ؾ���:**��Ϊ������ͻ���ʱ������Դ������,�ͻ��˿�����ֻ�Ǵ���������,�����������Ϳ��Ծ����ɺ������̨����������Ӧ�����õĸ��ؾ����㷨������ѯ��һ���Թ�ϣ�ȵ�,��Щ�㷨��Ŀ�궼�Ǿ������ⲿ�����������ط�ɢ����̨Դ������,���ϵͳ��������Դ�����ʺ����ܡ�

-

�������:ʹ�á��������Ȼ��Ƽ�غ�˷�����,�����й��Ͼͼ�ʱ���߳�����Ⱥ,��֤����߿���;

-

��ȫ����:�����������ĺ�˷�����,���� IP ��ַ������,�������繥������;

-

����ж��:������ʹ�� SSL/TLS ����ͨ����֤,���ڰ�ȫ������������,�����ӽ��ܳɱ�;

-

���ݹ���:���������е�����,����ָ�����������������Ӧ;

-

���ݻ���:�ݴ桢���÷�������Ӧ��

(3)�������ͷ�ֶ�

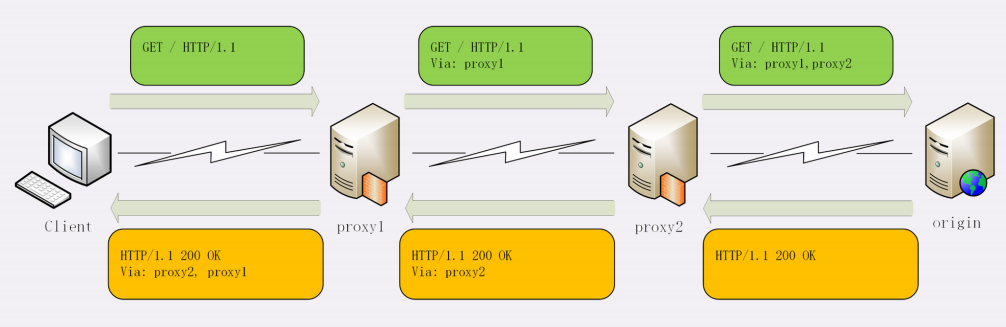

? **Via:**������������Ҫ���ֶ�Via�������������ݡ�Via���Գ���������ͷ����Ӧͷ�ÿ�����ľ���һ�������ڵ�,�����������ͻ����������Ϣ�ӵ��ֶε�ĩβ,�����Ϳ���֪�����ľ��������˶��ٸ������������ŵ�����Ŀ�ĵء�

? ������ͼ������������:proxy1 �� proxy2,�ͻ��˷�������ᾭ������������,�������Ӿ��ǡ�Via: proxy1, proxy2��,�ȵ�������������Ӧ���ĵ�ʱ���Ҫ��������,ͷ�ֶξ��ǡ�Via: proxy2, proxy1����

? Via �ֶ�ֻ����˿ͻ��˺�Դ�������ж��Ƿ���ڴ���������,������֪���Է�����ʵ��Ϣ���������� IP ��ַӦ���DZ��ܵ�,��ϵ����ҵ��������ȫ,����һ�㲻���ÿͻ���֪��������������,ͨ����������Ҫ֪���ͻ��˵���ʵ IP ��ַ,���������ʿ��ơ��û�����ͳ�Ʒ�����HTTP ���ﲢû��Ϊ�˶���ͷ�ֶ�,���Ѿ������˺ܶ���ʵ�ϵı�,��õ�����ͷ�ֶ��ǡ�X-Forwarded-For���͡�X-Real-IP����

? **X-Forwarded-For:**��������˼�ǡ�Ϊ˭��ת����,��ʽ�Ϻ͡�Via�����,Ҳ��ÿ����һ�������ڵ�ͻ����ֶ�����һ����Ϣ������Via���ӵ��Ǵ���������(��������),����X-Forwarded-For���ӵ������� IP ��ַ������,���ֶ�������ߵ� IP��ַ�Ϳͻ��˵ĵ�ַ��

? **X-Real-IP:**����һ�ֻ�ȡ�ͻ�����ʵ IP ���ֶ�,�������úܼ�,���Ǽ�¼�ͻ��� IP��ַ,û���м�Ĵ�����Ϣ,�൱���ǡ�X-Forwarded-For���ļ档����ͻ��˺�Դ������֮��ֻ��һ������,��ô�������ֶε�ֵ������ͬ�ġ�

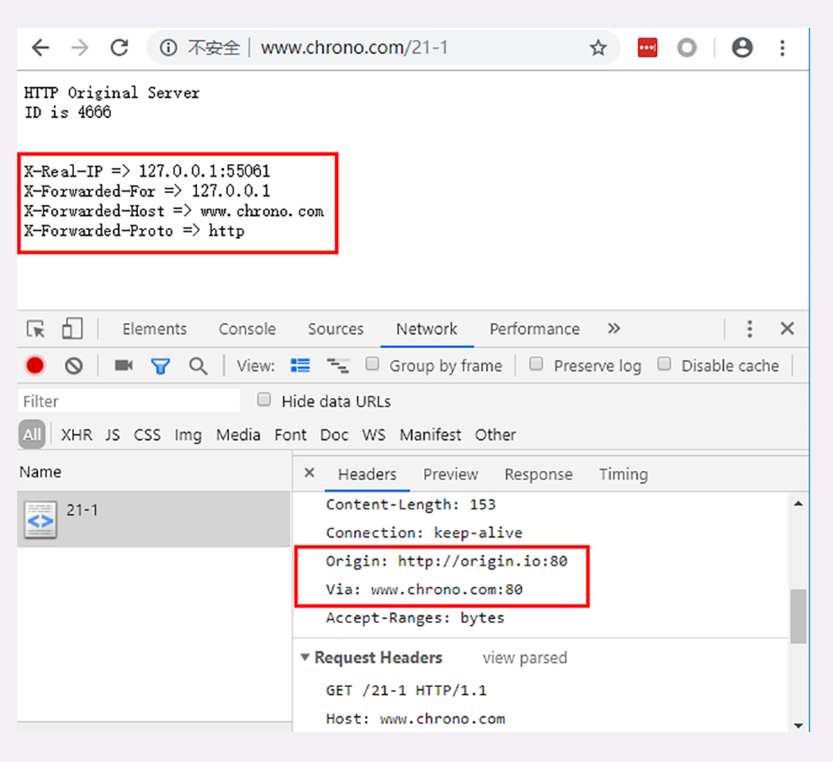

? ���ǵ�ʵ�黷��ʵ����һ���������,���ʡ�http://www.chrono.com/21-1��,����ת�����ʡ�http://origin.io��������ġ�origin.io������Դվ,��������Ӧ�����������Via����X-Forwarded-For���ȴ���ͷ�ֶ���Ϣ:

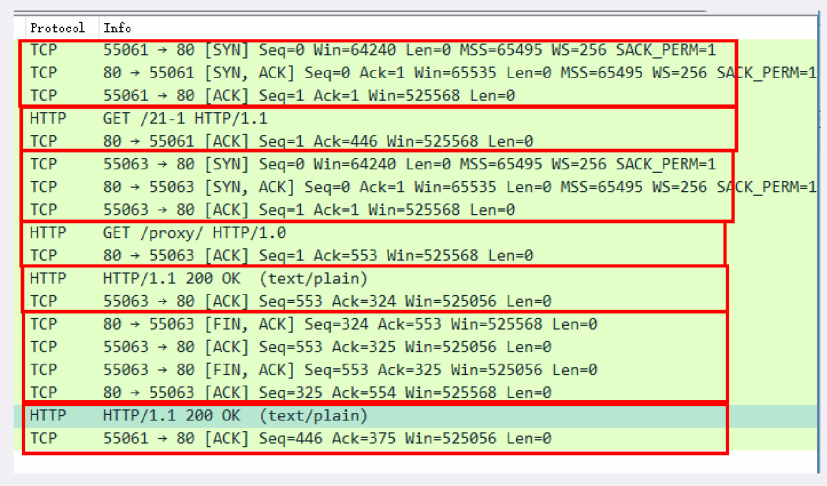

? �����������ҳ���Ϻ��ѿ�������������Щ����,��Ϊ������ת�����ں�̨���ɼ�,�����Ұ���������� Wireshark ץ��һ����:

��ץ����Ϳ��������ؿ���������ͻ��ˡ�Դ��������ͨ�Ź���:

-

�ͻ��� 55061 ���������������ӵ������� 80 �˿�,Ȼ���� GET ����;

-

������ֱ����������,���Ծʹ����ͻ���,�� 55063 �˿����ӵ�Դ������,Ҳ����������;

-

�����ɹ�����Դ��������,������һ�� HTTP/1.0 �� GET ����;

-

��Ϊ HTTP/1.0 Ĭ���Ƕ�����,����Դ������������Ӧ���ĺ��������Ĵλ��ֹر�����;

-

�����õ���Ӧ���ĺ��ٷ��ظ��ͻ���,�����һ�δ�������

? �����ʵ����,����Կ������ˡ�X-Forwarded-For���͡�X-Real-IP��,�������������ֶ�:��X-Forwarded-Host���͡�X-Forwarded-Proto��,���ǵ������롰X-Real-IP������,ֻ��¼�ͻ��˵���Ϣ,�ֱ��ǿͻ��������ԭʼ������ԭʼЭ������

(4)������

? **����Э��:**��Ȼ�����������õ��ͻ�����Ϣ�������ڴ�����������˵��������һ����ѵĽ����������Ϊͨ����X-Forwarded-For������������Ϣ����Ҫ����������������,�ή�ʹ�����ת�����ܡ�����ʹ�� HTTPS ͨ���Dz����������ݵ�,������ʹ�á����Ծͳ�����һ��ר�ŵĴ���Э��(The PROXY protocol),����֪���Ĵ�������HAProxy ������,Ҳ��һ������ʵ����,���㷺����(ע�Ⲣ���� RFC)��

? **����Э��汾:**�� v1 �� v2 �����汾,v1 �� HTTP ���,Ҳ������,�� v2 �Ƕ����Ƹ�ʽ������ֻ���ܱȽϺ������ v1,���� HTTP ����ǰ������һ�� ASCII ���ı�,�൱���ֶ���һ��ͷ����һ���ı���ʵ�dz���,��ͷ�����ǡ�PROXY�������д��ĸ,Ȼ���ǡ�TCP4�����ߡ�TCP6��,��ʾ�ͻ��˵� IP ��ַ����,�ٺ���������ַ��Ӧ��ַ�����˿ںš�Ӧ�˿ں�,�����һ���س�����(\r\n)������

? ����������������,�� GET ������ǰ����� PROXY ��Ϣ��,�ͻ��˵���ʵ IP ��ַ�ǡ�1.1.1.1��,�˿ں��� 55555��

PROXY TCP4 1.1.1.1 2.2.2.2 55555 80\r\n

GET / HTTP/1.1\r\n

Host: www.xxx.com\r\n

\r\n

? ���������������ı���,ֻҪ������һ�оͿ����õ��ͻ��˵�ַ,����Ҫ��ȥ��������HTTP ����,ʡ�˺ܶ����顣��������Э�鲢��֧�֡�X-Forwarded-For������ʽ��ַ��ʽ,�����õ��ͻ��˵�ַ������δ�������Ҫ������������������Լ����

8���������

(1)�����������

? û�л����ʱ��,����������ֻ�������ת���ܡ����뻺���,�����������ȿ�����ת����,�����Ի�������,��һ��������ͬ������,�����������Ϳ���ֱ�ӷ��� 304 ���������ݡ������ͽ����˿ͻ��˵ĵȴ�ʱ��,ͬʱ��Լ��Դ�����������������

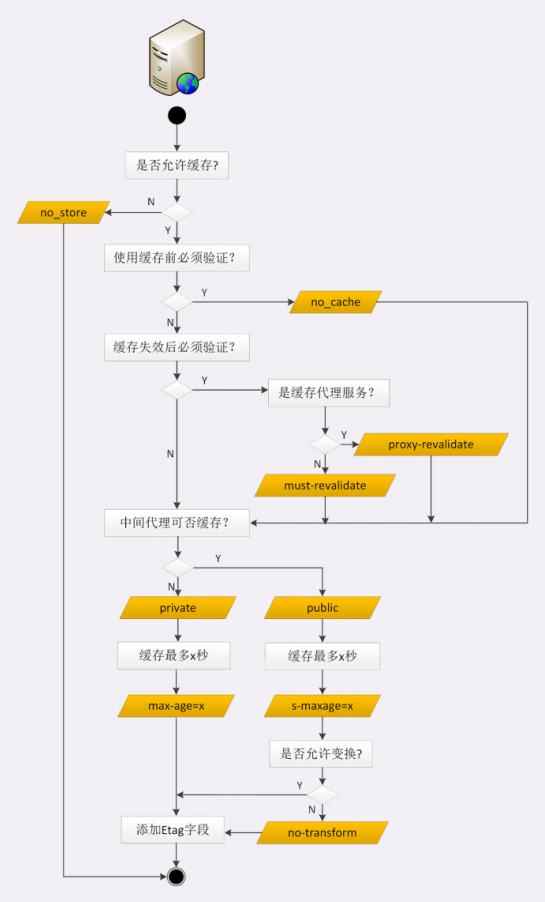

�� HTTP �Ļ�����ϵ��,�������ʮ������,�����ǿͻ���,���Ƿ�����,�������ÿͻ��˵Ļ�����Ʋ���Ҳ�����÷������˵Ļ�����Ʋ���,������ͬʱʹ�ø��֡�Cache-Control�����ԡ��������������������������ߺ�������,���Ի���Ҫ��һЩ�µġ�Cache-Control���������������ر��Լ����

(2)Դ�������������

? ǰ������� 4 �ַ������˵ġ�Cache-Control������:max-age��no_store��no_cache �� must-revalidate,�� 4 �ֻ������Կ���Լ���ͻ���,Ҳ����Լ�����������ͻ��˺ʹ����Dz�һ����,�ͻ��˵Ļ���ֻ���û��Լ�ʹ��,�������Ļ�����ܻ�Ϊ�dz���Ŀͻ����ṩ��������,��Ҫ�����Ļ����ٶ�һЩ����������

? **���ֿͻ����ϵĻ���ʹ����ϵĻ���:**����ʹ�����������ԡ�private���͡�public����

- **private:**��ʾ����ֻ���ڿͻ��˱���,���û���˽�С���,���ܷ��ڴ���������˹�����

- **public:**��ʾ������ȫ����,˭�����Դ�,˭�������á�

? �������¼��̳,���ص���Ӧ�������á�Set-Cookie����������̳ ID,�������˽������,���ܴ��ڴ����ϡ���Ȼ,���˷��ʴ�����ȡ�˱��������Ӧ���鷳�ˡ�

? ���ֻ���ʧЧ���������֤:��must-revalidate����ֻҪ���ھͱ����Դ��������֤,���µġ�proxy-revalidate��ֻҪ������Ļ�����ں������֤,�ͻ��˲��ػ�Դ,ֻ��֤������������ھ����ˡ�

? **���������ʱ��:**ʹ���µġ�s-maxage��(s �� share ����˼),ֻ���ڴ������ܹ�����,���ͻ�����Ȼʹ�á�max_age����

? **no-transform:**����һ������ר�õ����ԡ�������ʱ���Ի���������������һЩ�Ż�,�����ͼƬ���� png��webp �ȼ��ָ�ʽ,�������������,����no-transform���ͻ��ֹ��������

? ���������ͼ�������ķ������˻�����Ʋ���,����ͬʱ���ƿͻ��˺ʹ���:

? Դ�������������ꡰCache-Control�������ҪΪ���ļ��ϡ�Last-modified����ETag���ֶΡ�����,�ͻ��˺ʹ����������ʹ��������������֤�����Ƿ���Ч,Ҳ�Ͳ����� 304 �����ض���

(3)�ͻ��˻������

? �ͻ����� HTTP ������ϵ��Ҫ��Ե��Ǵ�����Դ������,����ͼ:

? **��������ʱ��:**�������������ԡ�max-stale���͡�min-fresh����

- **max-stale:**��˼����������ϵĻ��������Ҳ���Խ���,�����ܹ���̫��,���� x ��Ҳ�Ҫ��

- **min-fresh:**��˼�ǻ��������Ч,���ұ����� x �����Ȼ��Ч��

? ����,��ݮ�����ű�ǩ��max-age=5��,�����Ѿ��ڱ�������� 7 �졣���������max-stale=2��,��˼�ǹ�������Ҳ�ܽ���,���Ըպ�������ȥ����Ҫ�ǡ�min-fresh=1��,���Ǿ��Բ��������ڵ�,�Ͳ������ߡ���ʱ���������һ�������ǡ�max-age=10��,��ô��7+1<10��,��һ��֮�������ʵ�,���Ծ�������ȥ��

- **only-if-cached:**��ʾֻ���ܴ������������,������Դ����������Ӧ�����������û�л�����������,��Ӧ�ø��ͻ��˷���һ��504(Gateway Timeout)��

(4)��������

? **Vary:**ͬһ������,��������Э�̺���ܻ��в�ͬ���ַ��������롢������Ȱ汾������,��Vary: Accept-Encoding����Vary: User-Agent��,�����������Ҫ�洢��Щ��ͬ�İ汾�������յ���ͬ������ʱ,�����Ͷ�ȡ������ġ�Vary��,�Ա�����ͷ����Ӧ�ġ� Accept-Encoding����User-Agent�����ֶ�,�������һ���������ȫƥ��,���綼�ǡ�gzip����Chrome��,�ͱ�ʾ�汾һ��,���Է��ػ�������ݡ�

? **Purge:**���ǡ�����������,�����ڴ���Ҳ�Ƿdz���Ҫ�Ĺ���,���ڵ�����Ӧ�ü�ʱ��̭,����ռ�ÿռ�;Դվ����Դ�и���,��Ҫɾ���ɰ汾,�����������°�(��ˢ��);��ʱ��Ỻ����һЩ�����ô洢����Ϣ,��������ҥ�Ի���Σ������,���뾡�������ɾ������������ķ����кܶ�,�Ƚϳ��õ�һ��������ʹ���Զ���������PURGE��,��������������,Ҫ��ɾ�� URI ��Ӧ�Ļ������ݡ�

�ġ���ȫ

1��TLS��ʲô

(1)ΪʲôҪ��HTTPS

? �Ļش��ǡ���Ϊ HTTP ����ȫ�������� HTTP ���������ġ����ص�,�������������ȫ��,�κ��˶��ܹ�����·�нػ��Ļ���α������ / ��Ӧ����,���ݲ����п����ԡ�

? ����,ǰ������˵���ġ�������������Ϊ HTTP ͨ�ŵ��м���,�����������е�ʱ��������ӻ�ɾ������ͷ�ֶ�,Ҳ����ʹ�úڰ��������� body ��Ĺؼ���,����ֱ�ӷ�����ٵ�������Ӧ,���������Դ��������û�а취�жϱ��ĵ���α��

? ��������繺��������С�֤ȯ������Ҫ�߶����ε�Ӧ�ó�����˵�Ƿdz������ġ����û�л����İ�ȫ����,ʹ�û��������и��ֵ������������������̸��

? ���ڰ�ȫ��Ҫ����ô�ߵ����š���Ƶ����������վ��˵,���ڻ������ϵĶ����û����������Խ��Խ��,Ҳ��������������ٳ֡��Ĺ���,��ҳ����ǿ��Ƕ����,���߷����û�,���¸���������ʧ��

? ����������������ͨ������˵,HTTP ����ȫ������������,�����ļ�¼�ᱻ���ػ�,��վ�Ƿ���ʵҲ����֤,�ڿͿ���αװ��������վ,��ȡ��ʵ���������롢���п���������Ϣ,��в������ȫ�ͲƲ���ȫ��

(2)ʲô�ǰ�ȫ

? ͨ����Ϊ,���ͨ�Ź��̾߱����ĸ�����,�Ϳ�����Ϊ�ǡ���ȫ����,���ĸ�������:�����ԡ�������,������֤�Ͳ��ɷ�����

- ������(Secrecy/Confidentiality)��ָ�����ݵġ����ܡ�,ֻ���ɿ��ŵ��˷���,���������Dz��ɼ��ġ����ܡ�,����˵���Dz����ò���ص��˿������ÿ��Ķ�����

- ������(Integrity,Ҳ��һ����)��ָ�����ڴ��������û�б��ܸ�,����Ҳ����,�������������ر�����ԭ״��

- ������֤(Authentication)��ָȷ�϶Է�����ʵ����,Ҳ���ǡ�֤����������㡱,��֤��Ϣֻ�ܷ������ŵ��ˡ�

- ���ɷ���(Non-repudiation/Undeniable),Ҳ�в��ɵ���,��˼�Dz��ܷ����Ѿ�����������Ϊ,���ܡ�˵������������ˣ��Ƥ����

(3)ʲô��HTTPS

? HTTPSΪ HTTP �������Ĵ�ȫ���ԡ�HTTPS ��ʵ��һ�����dz�����Э��,RFC �ĵ���С,ֻ�ж̶̵� 7 ҳ,����涨���µ�Э������https��,Ĭ�϶˿ں� 443,����������ʲô���� - Ӧ��ģʽ�����Ľṹ��������URI��ͷ�ֶΡ����ӹ����ȵȶ���ȫ���� HTTP,û���κ��µĶ�����

? HTTPS �� HTTP �²�Ĵ���Э���� TCP/IP ������SSL/TLS,�ɡ�HTTP over TCP/IP������ˡ�HTTP over SSL/TLS��,�� HTTP �������˰�ȫ�� SSL/TLS Э����,�շ����IJ���ʹ�� Socket API,���ǵ���ר�ŵİ�ȫ�ӿڡ�

? ����˵,HTTPS ������û��ʲô�ر�,ȫ�ǿ��²��SSL/TLS��

(4)SSL/TLS

? SSL ����ȫ�Ӳ�(Secure Sockets Layer),�� OSI ģ���д��ڵ� 5 ��(�Ự��),��������˾�� 1994 �귢��,�� v2 �� v3 �����汾,�� v1 ��Ϊ�����ص�ȱ�ݴ�δ��������

? SSL ��չ�� v3 ʱ�Ѿ�֤������������һ���dz��õİ�ȫͨ��Э��,���ǻ����������� IETF�� 1999 ���������Ϊ TLS(����㰲ȫ,Transport Layer Security),��ʽ����,�汾�Ŵ� 1.0 ��������,���� TLS1.0 ʵ���Ͼ��� SSLv3.1��

? ������ TLS �Ѿ���չ���������汾,�ֱ��� 2006 ��� 1.1��2008 ��� 1.2 ��ȥ��(2018)�� 1.3,ÿ���°汾����������ѧ�ķ�չ�ͻ���������״,����ǿ����ȫ������,�Ѿ���Ϊ����Ϣ��ȫ�����е�Ȩ������

? ĿǰӦ�õ���㷺�� TLS �� 1.2,��֮ǰ��Э��(TLS1.1/1.0��SSLv3/v2)���Ѿ�����Ϊ�Dz���ȫ��,��������������� 2020 ������ֹ֧ͣ��,���Խ������Ľ��ⶼ��Ե���TLS1.2��

? TLS �ɼ�¼Э�顢����Э�顢����Э�顢�������淶Э�顢��չЭ��ȼ�����Э�����,�ۺ�ʹ���˶ԳƼ��ܡ��ǶԳƼ��ܡ�������֤����������ѧǰ�ؼ�����

? ������ͷ�������ʹ�� TLS ��������ʱ��Ҫѡ��һ��ǡ���ļ����㷨��ʵ�ְ�ȫͨ��,��Щ�㷨����ϱ���Ϊ����������(cipher suite,Ҳ�м�����)��

? TLS �������������dz��淶,��ʽ�̶ܹ�����������ʽ�ǡ���Կ�����㷨 + ǩ���㷨 + �ԳƼ����㷨 + ժҪ�㷨��,����ECDHE-RSA-AES256-GCM-SHA384����˼����:������ʱʹ�� ECDHE �㷨������Կ����,�� RSA ǩ����������֤,���ֺ��ͨ��ʹ��AES �Գ��㷨,��Կ���� 256 λ,����ģʽ�� GCM,ժҪ�㷨 SHA384 ������Ϣ��֤�Ͳ������������

(5)OpenSSL

? OpenSSL,����һ�������Ŀ�Դ����ѧ�������߰�,����֧�����й����ļ����㷨��Э��,�Ѿ���Ϊ����ʵ�ϵı�,����Ӧ����������ʹ������Ϊ�ײ����ʵ�� TLS ����,�������õ� Web ������ Apache��Nginx �ȡ�

? OpenSSL �Ǵ���һ����Դ�� SSLeay ��չ������,������������Ϊ��OpenTLS��,����ʱ(1998 ��)TLS ��δ��ʽȷ��,�� SSL ���ѹ�Ϊ��֪,��������ʹ���ˡ�OpenSSL�������֡�

? ���� OpenSSL �ǿ�Դ��,����������һЩ�����֧,���� Google �� BoringSSL��OpenBSD �� LibreSSL,��Щ��֧�� OpenSSL �Ļ�����ɾ����һЩ�Ͼɴ���,Ҳ������һЩ������,��Ȼ�����С��������,����ȡ�� OpenSSL ����ú�Զ��

2���ԳƼ�����ǶԳƼ���

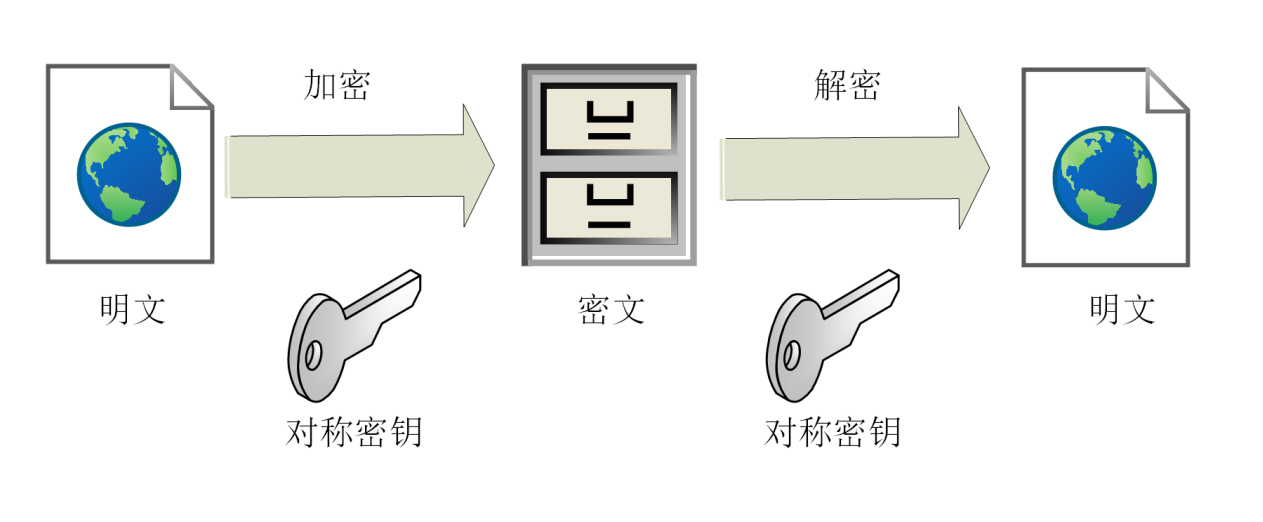

? **����:**ʵ�ֻ�������õ��ֶ��Ǽ���(encrypt),���ǰ���Ϣ��ij�ַ�ʽת����˭Ҳ������������,ֻ���������⡰Կ�ס����˲�����ת����ԭʼ�ı���

? ����ġ�Կ�ס��ͽ�������Կ��(key),����ǰ����Ϣ�С�������(plain text/clear text),���ܺ������С�������(cipher text),����Կ��ԭ���ĵĹ��̽С�������(decrypt),�Ǽ��ܵķ�����,���ܽ��ܵIJ������̾��ǡ������㷨����

? ���еļ����㷨���ǹ�����,�κ��˶�����ȥ�����о�,���㷨ʹ�õġ���Կ������뱣�ܡ�

? ���� HTTPS��TLS �������ڼ������,���ԡ���Կ������һ����������,��Լ���׳ɵĶ�����λ�ǡ�λ��(bit),�����ǡ��ֽڡ�(byte)������,˵��Կ������ 128,���� 16�ֽڵĶ����ƴ�,��Կ���� 1024,���� 128 �ֽڵĶ����ƴ���

? ������Կ��ʹ�÷�ʽ,���ܿ��Է�Ϊ������:�ԳƼ��ܺͷǶԳƼ�����

(1)�ԳƼ���

? **�ԳƼ���:**����ָ���ܺͽ���ʱʹ�õ���Կ����ͬһ��,�ǡ��Գơ��ġ�ֻҪ��֤����Կ�İ�ȫ,������ͨ�Ź��̾Ϳ���˵�����˻����ԡ�

? �ٸ�����,����Ҫ��¼ij��վ,ֻҪ���Ⱥ���Լ����ʹ��һ���Գ�����,ͨ�Ź����д����ȫ������Կ���ܺ������,ֻ�������վ���ܽ��ܡ��ڿͼ�ʹ�ܹ�����,������Ҳֻ������,��Ϊû����Կ���������,���Ծ�ʵ���˻����ԡ�

? TLS ���зdz���ĶԳƼ����㷨�ɹ�ѡ��,���� RC4��DES��3DES��AES��ChaCha20��,��ǰ�����㷨������Ϊ�Dz���ȫ��,ͨ������ֹʹ��,Ŀǰ���õ�ֻ�� AES ��ChaCha20��

? **AES :**��˼�ǡ������ܱ���(Advanced Encryption Standard),��Կ���ȿ�����128��192 �� 256������ DES �㷨�������,��ȫǿ�Ⱥܸ�,����Ҳ�ܺ�,�����е�Ӳ�������������Ż�,���Էdz�����,��Ӧ����㷺�ĶԳƼ����㷨��

? **ChaCha20:**�� Google ��Ƶ���һ�ּ����㷨,��Կ���ȹ̶�Ϊ 256 λ,��������������Ҫ���� AES,�������ƶ��ͻ����ϱȽ�����,�� ARMv8 ֮��Ҳ������ AES Ӳ���Ż�,�������ڲ��پ������Ե�����,����Ȼ�������һ�������㷨��

(2)���ܷ���ģʽ

? **����ģʽ:**�Գ��㷨����һ������ģʽ����,���������㷨�ù̶����ȵ���Կ�������ⳤ�ȵ�����,��С����(����Կ)ת��Ϊ������(������)��

? ������ ECB��CBC��CFB��OFB �ȼ��ַ���ģʽ,����½���������а�ȫ©��,�������ڻ���������ô���ˡ����µķ���ģʽ����Ϊ AEAD(Authenticated Encryption with Associated Data),�ڼ��ܵ�ͬʱ��������֤�Ĺ���,���õ��� GCM��CCM ��Poly1305��

? ��������Щ�������,�Ϳ��Եõ� TLS �������ж���ĶԳƼ����㷨������,AES128-GCM,��˼����Կ����Ϊ 128 λ�� AES �㷨,ʹ�õķ���ģʽ�� GCM;ChaCha20-Poly1305 ����˼�� ChaCha20 �㷨,ʹ�õķ���ģʽ�� Poly1305��

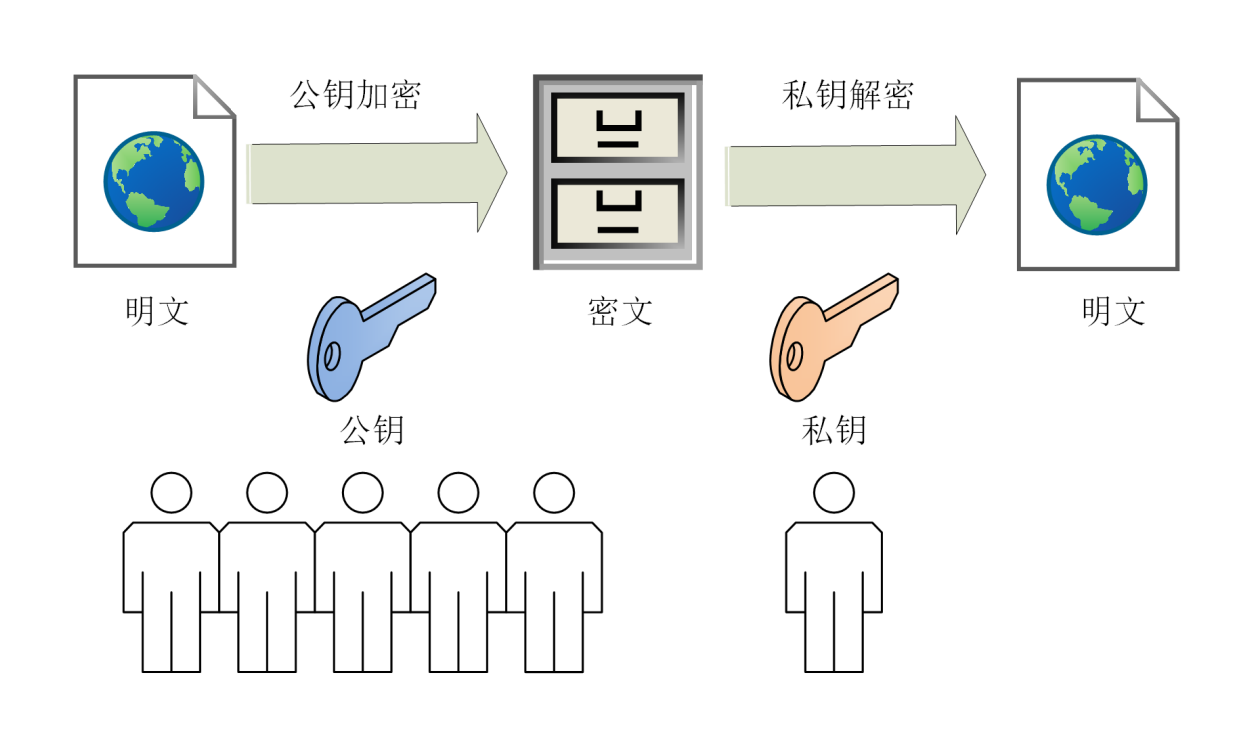

(3)�ǶԳƼ���

? **��Կ����:**�ԳƼ��ܿ���ȥ����������ʵ���˻�����,��������һ���ܴ������,��ΰ���Կ��ȫ�ش��ݸ��Է�,�������Կ��������Ϊ�ڶԳƼ����㷨��ֻҪ������Կ�Ϳ��Խ��ܡ������Կ�ڴ���;�б��ڿ���ȡ,�����Ϳ�����������շ�������,ͨ�Ź���Ҳ��û�л����Կ����ˡ�����,�ͳ����˷ǶԳƼ��ܡ�

? **�ǶԳƼ���:**Ҳ�й�Կ�����㷨������������Կ,һ���С���Կ��(public key),һ���С�˽Կ��(private key)��������Կ�Dz�ͬ��,�����Գơ�,��Կ���Թ������κ���ʹ��,��˽Կ�����ϸ��ܡ��ǶԳƼ��ܿ��Խ������Կ�����������⡣��վ���ܱ���˽Կ,����������ַ���Կ,����Ҫ��¼��վֻҪ�ù�Կ���ܾ�����,����ֻ����˽Կ�����߲��ܽ��ܡ����ڿ���Ϊû��˽Կ,���Ծ����ƽ����ġ�

? **������:**��Կ���ܺ�ֻ����˽Կ����,������,˽Կ���ܺ�Ҳֻ���ù�Կ���ܡ�

? �ǶԳƼ����㷨�����Ҫ�ȶԳ��㷨�ѵö�,�� TLS ��ֻ�к��ٵļ���,���� DH��DSA��RSA��ECC �ȡ�

? **RSA:**������������������һ��,��������˵�ǷǶԳƼ��ܵĴ�����,���İ�ȫ�Ի��ڡ������ֽ�������ѧ����,ʹ���������������ij˻���Ϊ������Կ�IJ���,��Ҫ�ӹ�Կ�����˽Կ�Ƿdz����ѵġ�10 ��ǰ RSA ��Կ���Ƽ������� 1024,�����ż�����������������,���� 1024 �Ѿ�����ȫ,�ձ���Ϊ����Ҫ 2048 λ��

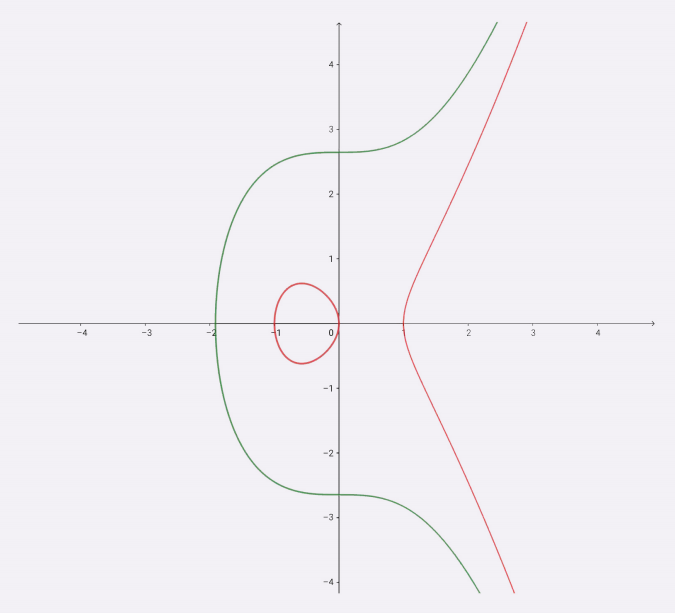

? ECC:(Elliptic Curve Cryptography)�ǷǶԳƼ�����ġ�����֮�㡱,�����ڡ���Բ������ɢ����������ѧ����,ʹ���ض������߷��̺ͻ������ɹ�Կ��˽Կ,���㷨 ECDHE ������Կ����,ECDSA ��������ǩ����Ŀǰ�Ƚϳ��õ����������� P-256(secp256r1,�� OpenSSL ��Ϊ prime256v1)��x25519��P-256 �� NIST(�������ұ������о���)�� NSA(�������Ұ�ȫ��)�Ƽ�ʹ�õ�����,�� x25519 ����Ϊ���ȫ������ٵ����ߡ�ECC ������ġ���Բ���������������,��ʵ�������߲�������Բ��,ֻ����Ϊ���̺����Ƽ�����Բ�ܳ��Ĺ�ʽ,ʵ�ʵ���״����������,���������ͼ��չʾ����������Բ���ߡ�

? **RSA vs ECC:**���� RSA,ECC �ڰ�ȫǿ�Ⱥ������϶������Ե����ơ�160 λ�� ECC �൱�� 1024 λ��RSA,�� 224 λ�� ECC ���൱�� 2048 λ�� RSA����Ϊ��Կ��,������Ӧ�ļ����������ĵ��ڴ�ʹ���Ҳ����,���ܽ��ܵ����ܾ���ȥ��,�������ڵ��ƶ��������dz�����������

(4)��ϼ���

? **��������:**��Ȼ�ǶԳƼ���û�С���Կ������������,����Ϊ���Ƕ��ǻ��ڸ��ӵ���ѧ����,�����ٶȺ���,��ʹ�� ECC ҲҪ�� AES ���Ϻü�����������������÷ǶԳƼ���,��Ȼ��֤�˰�ȫ,��ͨ���ٶ������ڹꡢ��ţ,ʵ���Ծͱ�����㡣

? �Ա��� AES �� RSA �������㷨������,�����г���һ�β��ԵĽ��:

aes_128_cbc enc/dec 1000 times : 0.97ms, 13.11MB/s

rsa_1024 enc/dec 1000 times : 138.59ms, 93.80KB/s

rsa_1024/aes ratio = 143.17

rsa_2048 enc/dec 1000 times : 840.35ms, 15.47KB/s

rsa_2048/aes ratio = 868.13

? ���Կ���,RSA �������ٶ��Ƿdz�����,2048 λ�ļӽ��ܴ�Լ�� 15KB/S(�����뼶),�� AES128 ���� 13MB/S(���뼶),���˼��ٱ���

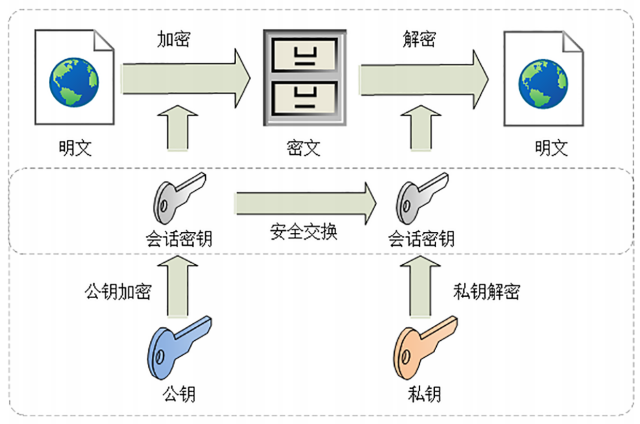

? **��ϼ���:**�Dz����ܹ��ѶԳƼ��ܺͷǶԳƼ��ܽ��������,������ȡ������,���ܸ�Ч�ؼ��ܽ���,���ܰ�ȫ����Կ��������������� TLS ��ʹ�õĻ�ϼ��ܷ�ʽ,��ʵ˵����Ҳ�ܼ�:��ͨ�Ÿտ�ʼ��ʱ��ʹ�÷ǶԳ��㷨,���� RSA��ECDHE,���Ƚ����Կ���������⡣Ȼ��������������Գ��㷨ʹ�õġ��Ự��Կ��(session key),���ù�Կ���ܡ���Ϊ�Ự��Կ�ܶ�,ͨ��ֻ�� 16 �ֽڻ� 32 �ֽ�,������һ��Ҳ����ν���Է��õ����ĺ���˽Կ����,ȡ���Ự��Կ������,˫����ʵ���˶Գ���Կ�İ�ȫ����,�����Ͳ���ʹ�÷ǶԳƼ���,ȫ��ʹ�öԳƼ��ܡ�

3������ǩ����֤��

? **û��������:**�ڿ���Ȼ�ò����Ự��Կ,���ƽ�����,������ͨ�������ռ����㹻�������,�ٳ������ġ��������վ����Ϊû�������Ա�֤,������ֻ�ܡ��յ�ȫ�ա�,Ȼ�����Ϳ���ͨ������������Ӧ��ȡ��һ��������,���վͻ��ƽ�����ġ�

? **α�칫Կ:**�ڿ�Ҳ����α�����ݷ�����Կ��������õ��˼ٵĹ�Կ,��ϼ��ܾ���ȫʧЧ�ˡ�����Ϊ�Լ����ں͡�ij����ͨ��,ʵ�������ߵ���һ��ȴ�Ǻڿ�,���п��š������������Ϣ���ڡ���ȫ����ͨ�Ź����б���ȡ�ˡ�

? ����,�ڻ����ԵĻ����ϻ�������������ԡ�������֤������,����ʵ�������İ�ȫ��

(1)ժҪ�㷨

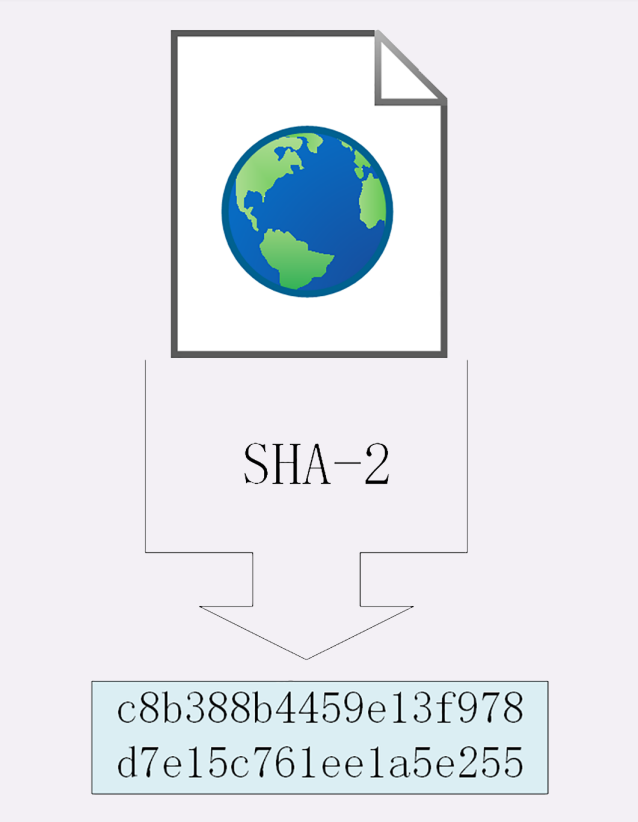

? ժҪ�㷨:ʵ�����������ֶ���Ҫ��ժҪ�㷨(Digest Algorithm),Ҳ���dz�˵��ɢ�к�������ϣ����(Hash Function)�����ܹ������ⳤ�ȵ�����ת���ɹ̶����ȡ����Ҷ�һ���ġ�ժҪ���ַ���,���ܴ�ժҪ���Ƴ�ԭ�ġ�

? ժҪ�㷨ʵ�����ǰ����ݴ�һ������ռ䡱ӳ�䵽�ˡ�С�ռ䡱,���Ծʹ��ڡ���ͻ��(collision,Ҳ����ײ)�Ŀ�����,���ܻ������ݲ�ͬ��ԭ�Ķ�Ӧ��ͬ��ժҪ���õ�ժҪ�㷨�����ܹ����ֿ���ͻ��,�����ֿ����Ծ�����С��

? ��ΪժҪ�㷨��������С������ԡ��͡�ѩ��ЧӦ��,�����С��ͬ�ᵼ������ľ��ұ仯,����Ҳ�� TLS ��������α�����(PRF,pseudo random function)��

? ��һ�����ճ������������������ù� MD5(Message-Digest 5)��SHA-1(Secure Hash Algorithm 1),���Ǿ�����õ�����ժҪ�㷨,�ܹ����� 16 �ֽں� 20 �ֽڳ��ȵ�����ժҪ�����������㷨�İ�ȫǿ�ȱȽϵ�,������ȫ,�� TLS ���Ѿ�����ֹʹ���ˡ�

? Ŀǰ TLS �Ƽ�ʹ�õ��� SHA-1 �ĺ����:SHA-2��SHA-2 ʵ������һϵ��ժҪ�㷨��ͳ��,�ܹ��� 6 ��,���õ��� SHA224��SHA256��SHA384,�ֱ��ܹ����� 28 �ֽڡ�32 �ֽڡ�48 �ֽڵ�ժҪ��

(2)������

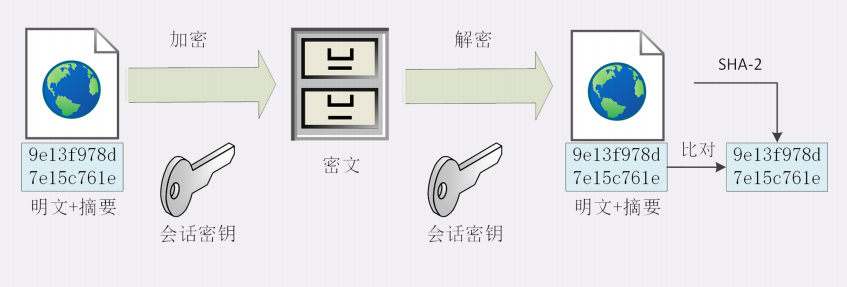

? **������:**ժҪ�㷨��֤�ˡ�����ժҪ����ԭ������ȫ�ȼ۵ġ�����,����ֻҪ��ԭ�ĺ�������ժҪ,���ܹ���֤���ݵ������ԡ�����ڿ����м����¸Ķ���һ��������,ժҪҲ����ȫ��ͬ,��վ����ȶԾͻᷢ����Ϣ���ܸ�,�Dz����ŵġ�

? **��ϣ��Ϣ��֤��:**����ժҪ�㷨�����л�����,������Ĵ���,��ô�ڿͿ�������Ϣ���ժҪҲһ�����,��վ���Ǽ��������ԡ�����,�����������Ա���Ҫ�����ڻ�����֮��,�ڻ�ϼ���ϵͳ���ûỰ��Կ������Ϣ��ժҪ,�����ڿ�����֪����,Ҳ��û�а취���ֽ��ˡ����и�����,�й�ϣ��Ϣ��֤��(HMAC)��

(3)����ǩ��

? �˵㰲ȫ:�����㷨���ժҪ�㷨,���ǵ�ͨ�Ź��̿���˵�DZȽϰ�ȫ�ˡ������ﻹ��©��,����ͨ�ŵ������˵�(endpoint)���ڿͿ���αװ����վ����ȡ��Ϣ����������,��Ҳ����αװ����,����վ����֧����ת�˵���Ϣ,��վû�а취ȷ���������,Ǯ���ܾ���ô��͵���ˡ�

? ����ǩ��:˽Կ+ժҪ�㷨=����ǩ��,ͬʱʵ�֡�������֤���͡����ɷ��ϡ�������ǩ����ԭ�����ǰѹ�Կ˽Կ�÷�������,˽Կ���ܡ���Կ���ܡ�������Ϊ�ǶԳƼ���Ч��̫��,����˽Կֻ����ԭ�ĵ�ժҪ,������������С�Ķ�,���ҵõ�������ǩ��Ҳ��С,���㱣�ܺʹ��䡣ǩ����Կһ����ȫ����,�κ��˶����Ի�ȡ�������ǩ��ֻ����˽Կ��Ӧ�Ĺ�Կ���ܽ,�õ�ժҪ��,�ٱȶ�ԭ����֤������,�Ϳ�����ǩ���ļ�һ��֤����Ϣȷʵ���㷢�ġ�

? **ǩ������ǩ:**�ղŵ���������ΪҲ��ר������,������ǩ�����͡���ǩ����ֻҪ�����վ���ཻ����Կ,�Ϳ����á�ǩ�����͡���ǩ����ȷ����Ϣ����ʵ��,��Ϊ˽Կ����,�ڿͲ���α��ǩ��,���ܹ���֤ͨ��˫�������ݡ�

(4)����֤���CA

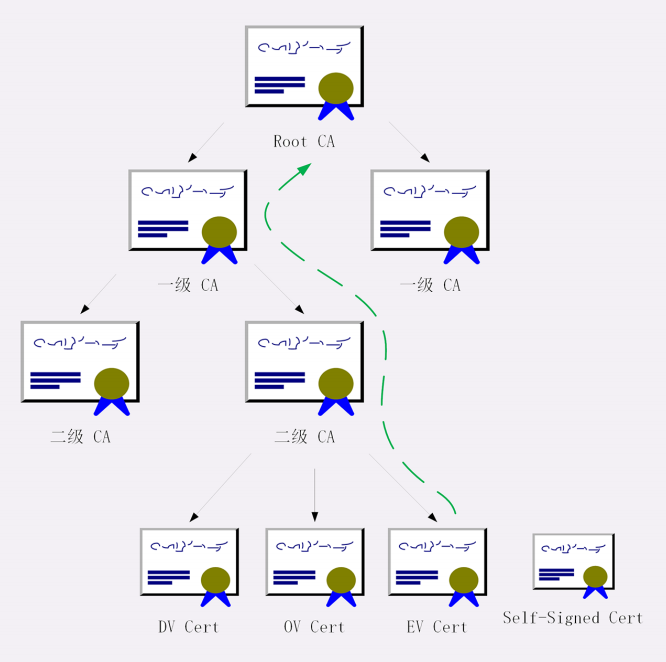

? ��Կ��������:��Ϊ˭�����Է�����Կ,���ǻ�ȱ�ٷ�ֹ�ڿ�α�칫Կ���ֶΡ����ǿ����ñ��˽Կ������Կǩ��,��Ȼ,���ֻ����롰����ݹ顱��Ҫ�ս��������ѭ����,�ͱ������롰������,��һ�����ϵĿ��ŵ�������

? CA:(Certificate Authority,֤����֤����),����������������dz�˵��CA������������������Ĺ����֡�����������֤����,���м��ߵĿ��Ŷ�,��������������Կǩ��,����������������֤��Կ��α��,�ǿ��ŵġ�֪���� CA ȫ�������ô����,���� DigiCert��VeriSign��Entrust��Let��s Encrypt ��,����ǩ����֤��� DV��OV��EV ����,�������ڿ��ų̶ȡ�DVֻ����������Ŀ���,������˭��֪����EV ����ߵ�,�����˷��ɺ���Ƶ��ϸ�˲�,����֤����վӵ���ߵ�����(���������ַ������ʾ����˾������,����Apple��GitHub ����վ)��

? **CA �Թ�Կ��ǩ����֤��ʽ:**���Ǽذѹ�Կ���ڳ����������Ͼ�������,��Ҫ�������кš���;���䷢�ߡ���Чʱ��ȵ�,����Щ���һ������ǩ��,������֤����Կ�����ĸ�����Ϣ,�γ�����֤�顣

? ��ǩ��֤��:Сһ��� CA �����ô� CA ǩ����֤,�����������,Ҳ����Root CA,��ֻ���Լ�֤���Լ���,����ͽС���ǩ��֤����(Self-Signed Certificate)���ߡ���֤����(Root Certificate)�����������,��������֤�����������߲���ȥ�ˡ�

? �������֤����ϵ,����ϵͳ��������������˸��� CA �ĸ�֤��,������ʱ��ֻҪ����������������֤��,�Ϳ�����֤֤�����ǩ��,˳��֤����(Certificate Chain)һ������֤,ֱ���ҵ���֤��,���ܹ�ȷ��֤���ǿ��ŵ�,�Ӷ�����Ĺ�ԿҲ�ǿ��ŵġ�

? ���ǵ�ʵ�黷����ʹ�õ�֤���ǡ�Ұ·�ӡ�����ǩ��֤��(�� Linux ���� OpenSSL ������ǩ��),�϶��Dz��ᱻ����������ε�,������ Chrome ����ʱ�ͻ���ʾ�ɺ�ɫ,���Ϊ����ȫ������ֻҪ������װ��ϵͳ�ĸ�֤��洢����,������Ϊ�������ĸ�,�Ͳ�������Σ�վ��档

(5)֤����ϵ������

? ֤����ϵ(PKI,Public Key Infrastructure)��Ȼ��Ŀǰ������������İ�ȫ������ʩ,�����Եİ�ȫ�Dz����ڵ�,��Ҳ������,���ǹؼ��ġ����������֡�

? **ǩ���˴����֤��:**��� CA ʧ����߱���ƭ,ǩ���˴����֤��,��Ȼ֤�������,������������վȴ�Ǽٵġ�����������,�������� CRL(֤������б�,Certificate revocation list)�� OCSP(����֤��״̬Э��,Online Certificate Status Protocol),��ʱ��ֹ�������֤����

? **CA ���ڿ���:**���� CA �ж���,��Ϊ��(����֤��)�����ε�Դͷ,�����������������֤��Ҳ�Ͷ��������ˡ�����������,��ֻ�ܲ���ϵͳ����������Ӹ��ϡ��º��֡���,������ CA ������,���롰��������,�������䷢������֤��Ͷ��ᱻ��Ϊ�Dz���ȫ�ġ�

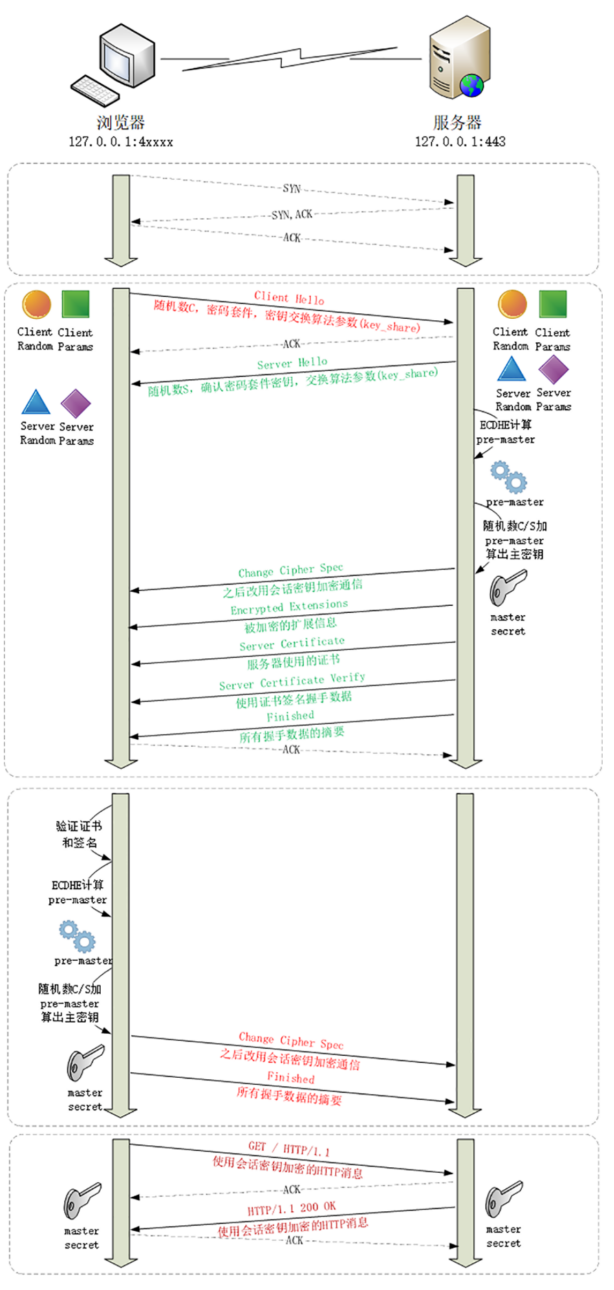

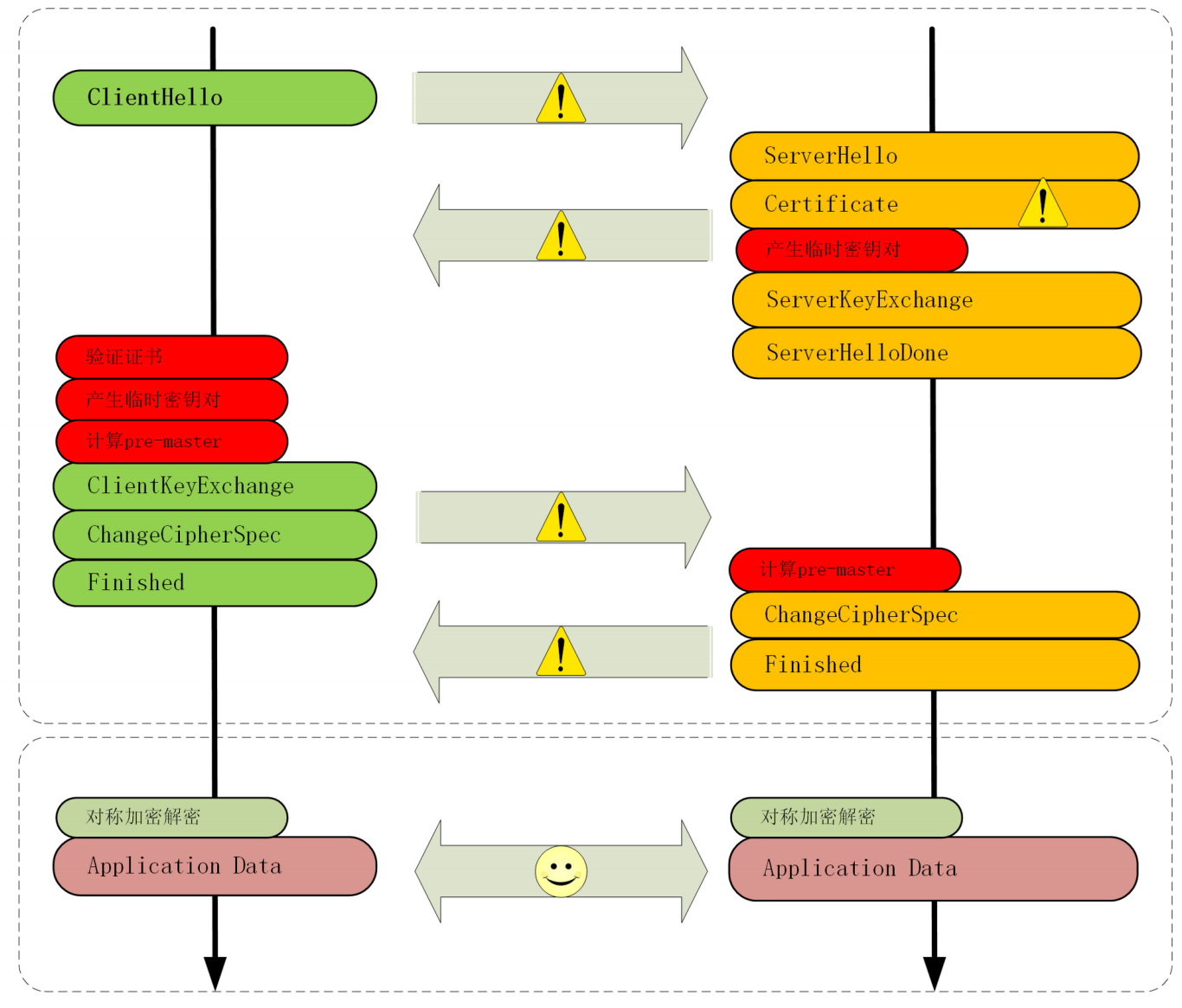

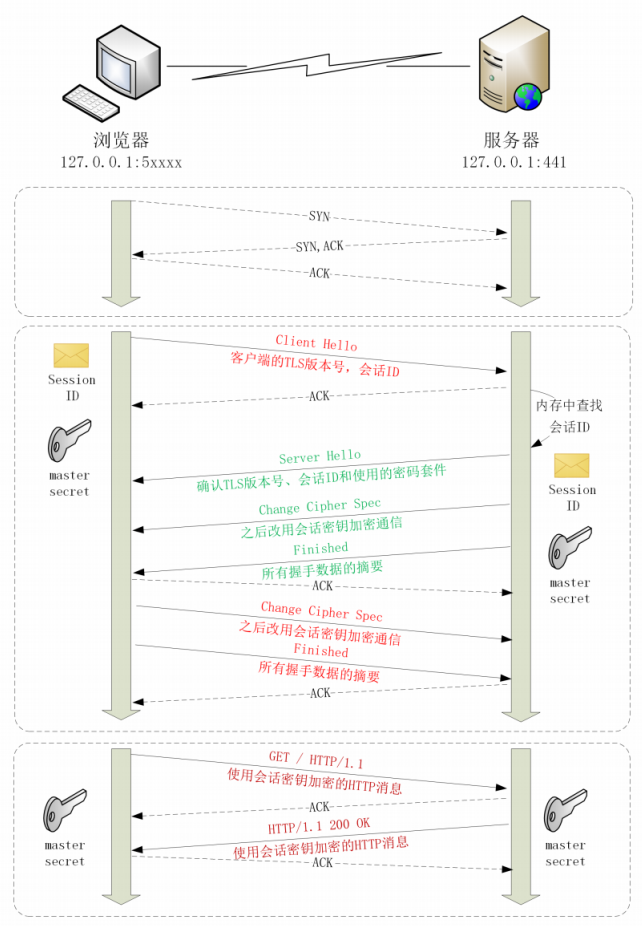

4��TLS1.2���ӹ��̽���

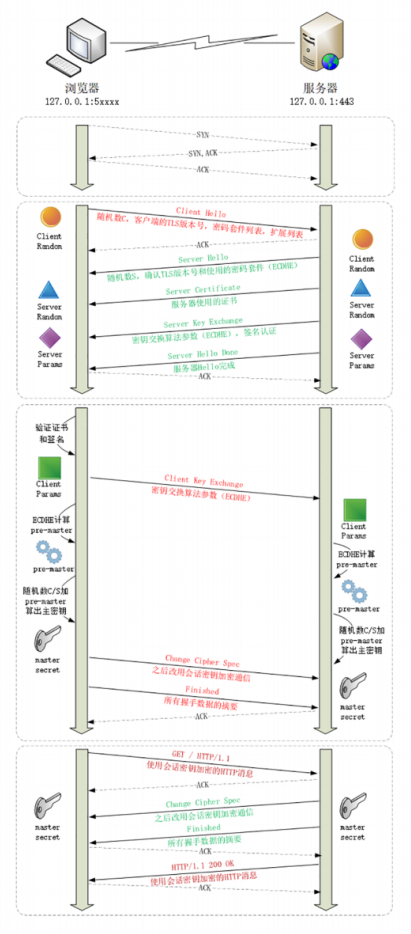

(1)HTTPS��������

? �������������ַ������롰https����ͷ�� URI,�ٰ��»س�,���������Ҫ�� URI ����ȡ��Э��������������ΪЭ�����ǡ�https��,�����������֪���˶˿ں���Ĭ�ϵ� 443,������ DNS ��������,�õ�Ŀ��� IP ��ַ,Ȼ��Ϳ���ʹ��������������վ���� TCP �����ˡ�

? �� HTTP Э����,�������Ӻ�,��������������������ġ��������� HTTPS Э��,����Ҫ��������һ�������֡�����,�� TCP �Ͻ�����ȫ����,֮������շ� HTTP ���ġ���������֡������� TCP ��Щ����,�� HTTPS �� TLS Э��������Ҫ������ĵIJ��֡�

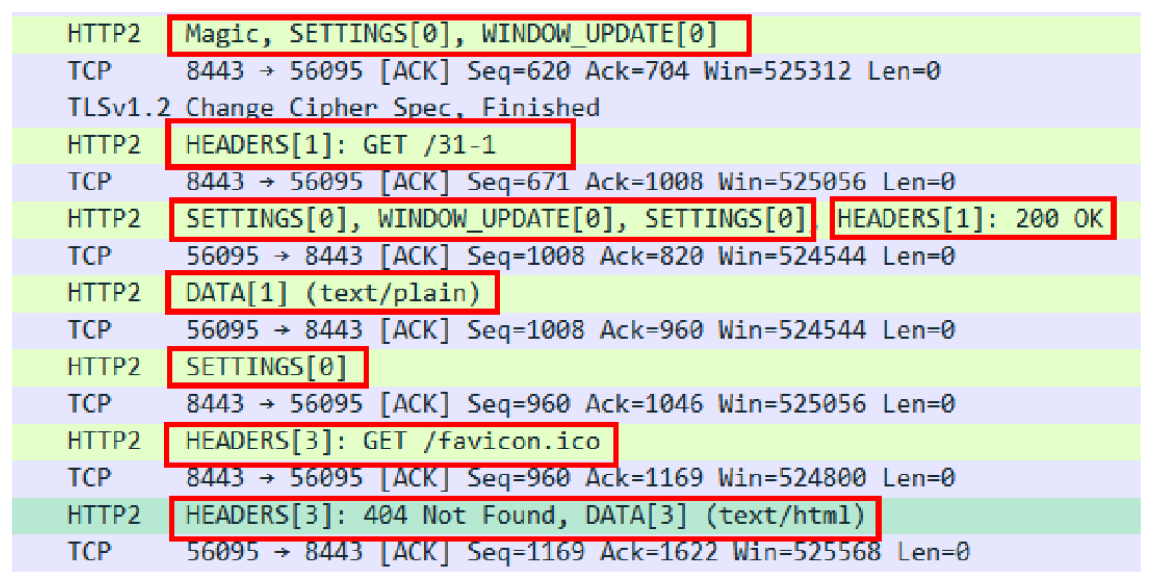

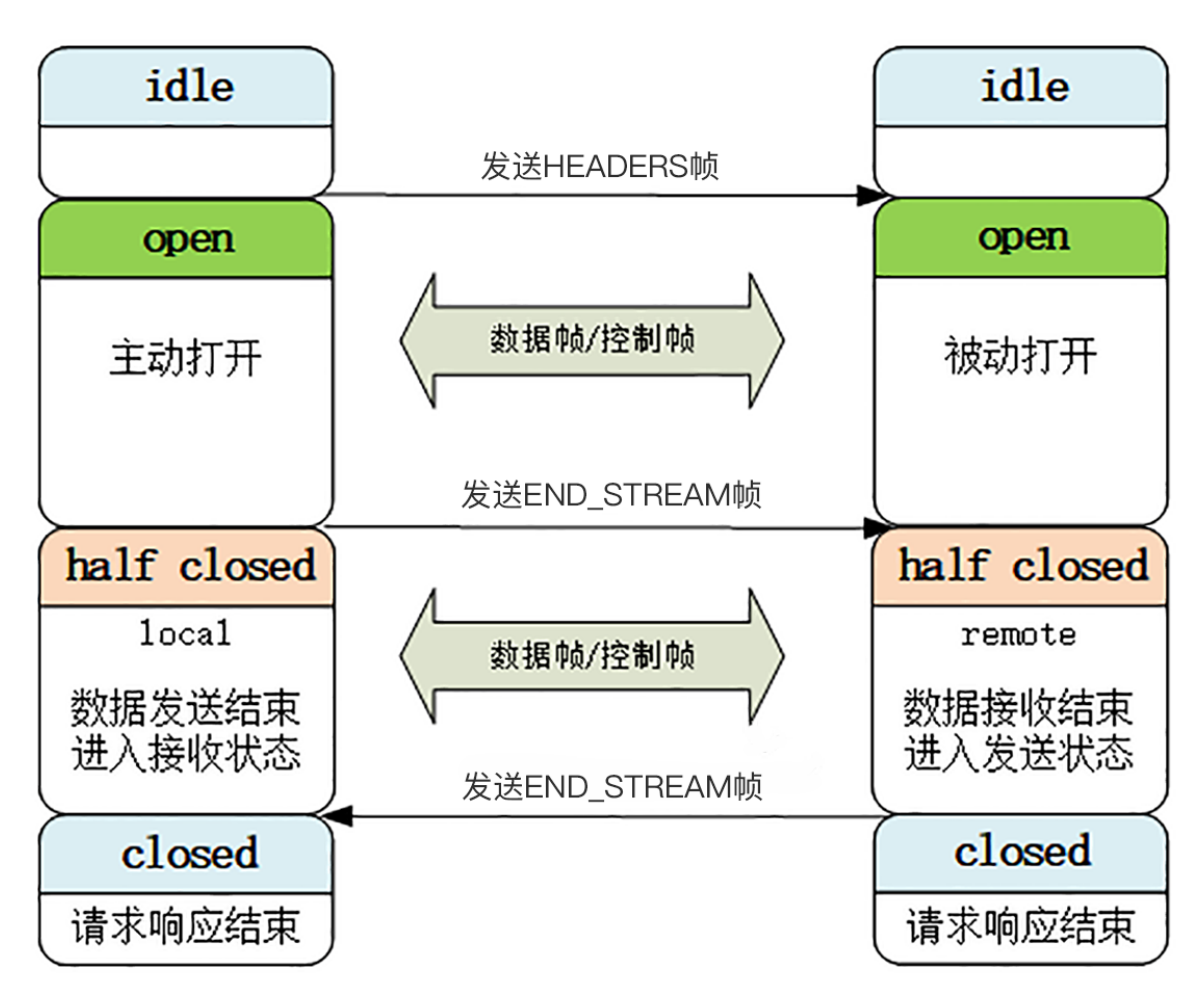

(2)TLS������

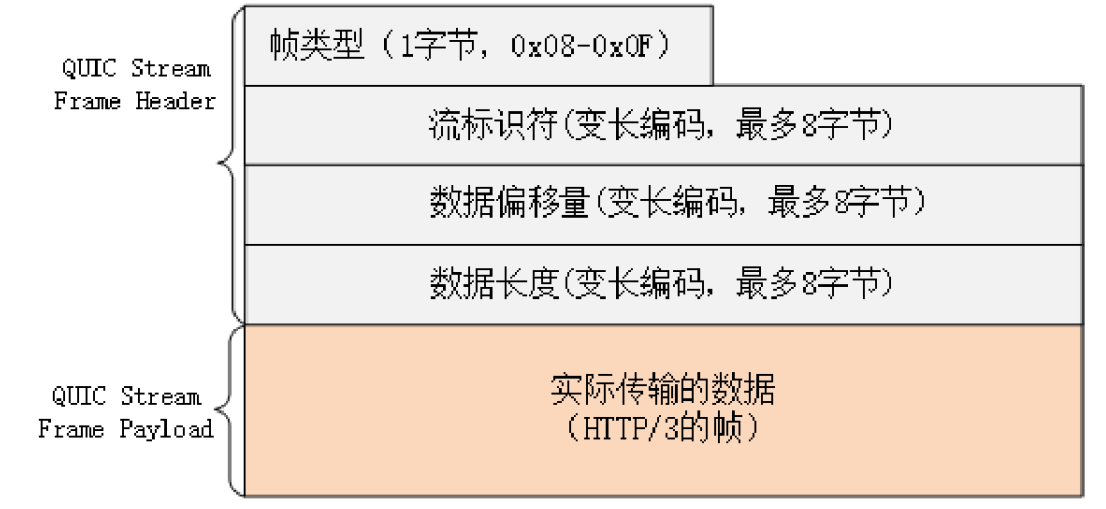

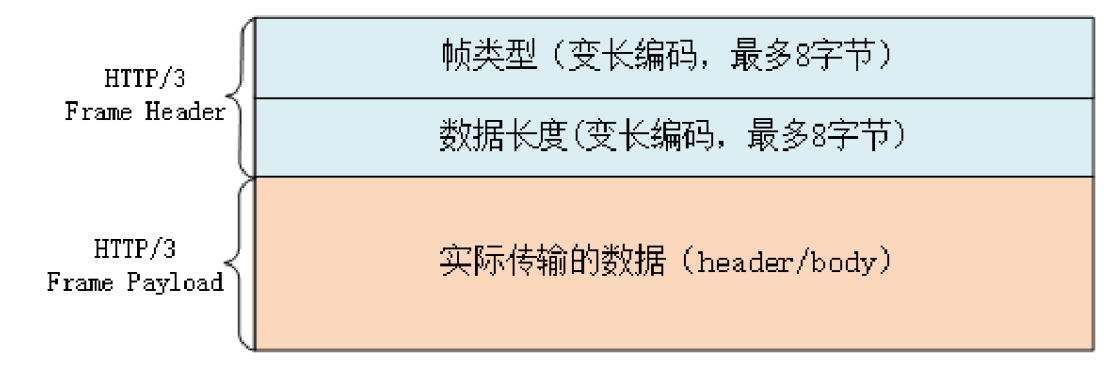

? TLS ����������Э��,��Ҳ��������Ϊ�����ɼ�����ְͬ���ģ�����,�Ƚϳ��õ��м�¼Э�顢����Э�顢����Э�顢�������淶Э��ȡ�

- ��¼Э��(Record Protocol)�涨�� TLS �շ����ݵĻ�����λ:��¼(record)�����е����� TCP ��� segment,���е�������Э�鶼��Ҫͨ����¼Э�鷢�����������¼���ݿ�����һ�� TCP ����һ���Է���,Ҳ������Ҫ�� TCP �������� ACK��

- ����Э��(Alert Protocol)��ְ������Է�����������Ϣ,�е����� HTTP Э�����״̬�롣����,protocol_version ���Dz�֧�־ɰ汾,bad_certificate ����֤��������,�յ���������һ������ѡ�����,Ҳ����������ֹ���ӡ�

- ����Э��(Handshake Protocol)�� TLS ����ӵ���Э��,Ҫ�� TCP �� SYN/ACK ���ӵĶ�,������ͷ������������ֹ�����Э�� TLS �汾�š������������������Ϣ,Ȼ��֤�����Կ����,����˫��Э�̵õ��Ự��Կ,���ں����Ļ�ϼ���ϵͳ��

- �������淶Э��(Change Cipher Spec Protocol),���dz���,����һ����֪ͨ��,���߶Է�,���������ݶ���ʹ�ü��ܱ�������ô������,����֮ǰ,���ݶ������ĵġ�

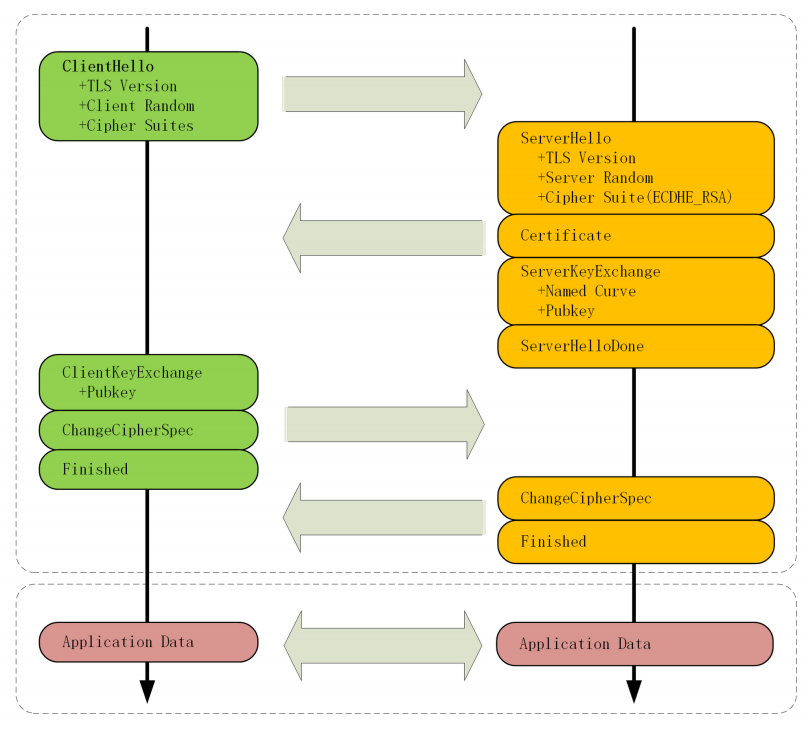

? ���������ͼ��Ҫ�������� TLS �����ֹ���,����ÿһ��������һ����¼,�����¼��ϳ�һ�� TCP �����͡�����,��ྭ��������Ϣ����(4 ����Ϣ)�Ϳ����������,Ȼ��Ϳ����ڰ�ȫ��ͨ�Ż������ HTTP ����,ʵ�� HTTPS Э�顣

(3)ECDHE���ֹ���

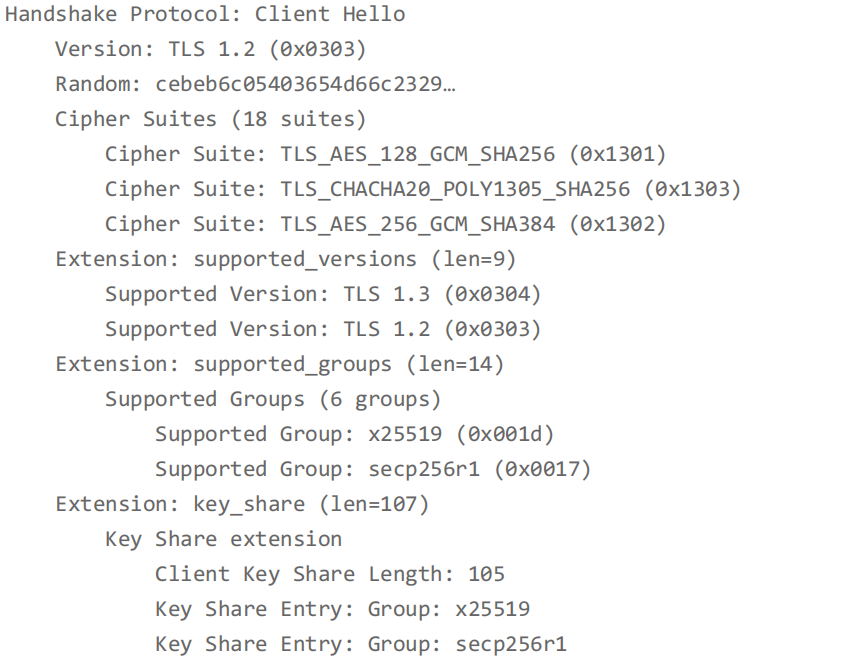

? �ղ��㿴���������ֹ��̵ļ�Ҫͼ,���ֻ���һ����ϸͼ,�����Ҿ������ͼ����ϸ���� TLS �����ֹ��̡�

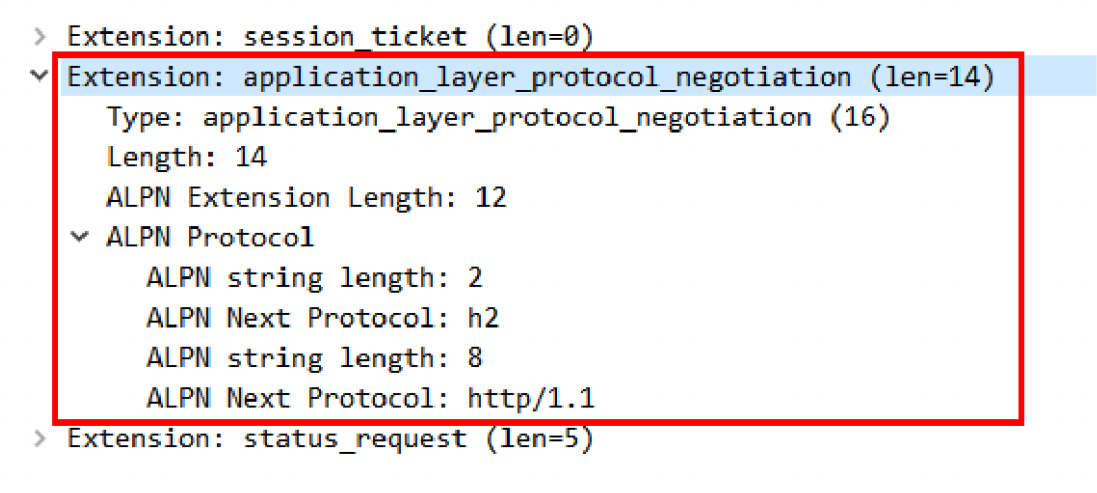

? �� TCP ��������֮��,����������ȷ�һ����Client Hello����Ϣ,Ҳ���Ǹ������������к����������пͻ��˵İ汾�š�֧�ֵ�������,����һ�������(Client Random),���ں������ɻỰ��Կ��

Handshake Protocol: Client Hello

Version: TLS 1.2 (0x0303)

Random: 1cbf803321fd2623408dfe��

Cipher Suites (17 suites)

Cipher Suite: TLS_ECDHE_RSA_WITH_AES_128_GCM_SHA256 (0xc02f)

Cipher Suite: TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384 (0xc030)

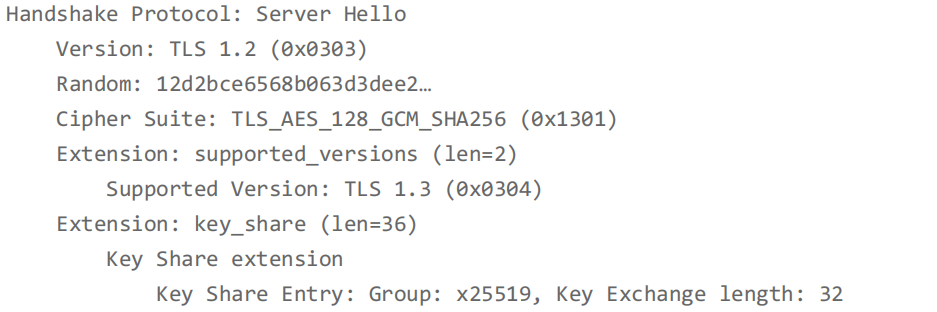

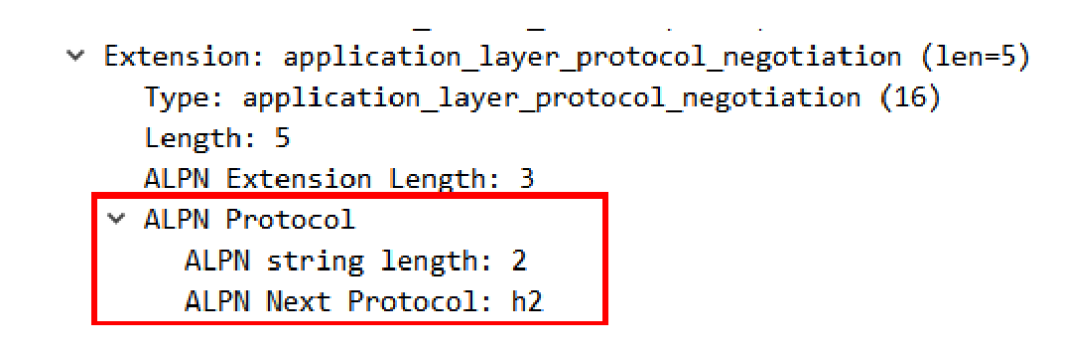

? �������յ���Client Hello����,�᷵��һ����Server Hello����Ϣ���Ѱ汾�Ŷ�һ��,Ҳ����һ�������(Server Random),Ȼ��ӿͻ��˵��б���ѡһ����Ϊ����ͨ��ʹ�õ�������,��������ѡ���ˡ�TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384����

Handshake Protocol: Server Hello

Version: TLS 1.2 (0x0303)

Random: 0e6320f21bae50842e96��

Cipher Suite: TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384 (0xc030)

? �������˼����:���汾�Ŷ�����,���Լ���,���������ͦ��,��ѡһ������ʵİ�,����Բ���� RSA��AES��SHA384����Ҳ����һ�������,��Ҳ�����š���

? Ȼ��,������Ϊ��֤���Լ�������,�Ͱ�֤��Ҳ�����˿ͻ���(Server Certificate)��

? ��������һ���ؼ��IJ���,��Ϊ������ѡ���� ECDHE �㷨,����������֤����͡�Server Key Exchange����Ϣ,��������Բ���ߵĹ�Կ(Server Params),����ʵ����Կ�����㷨,�ټ����Լ���˽Կǩ����֤��

Handshake Protocol: Server Key Exchange

EC Diffie-Hellman Server Params

Curve Type: named_curve (0x03)

Named Curve: x25519 (0x001d)

Pubkey: 3b39deaf00217894e...

Signature Algorithm: rsa_pkcs1_sha512 (0x0601)

Signature: 37141adac38ea4...

? ���൱��˵:���ղ���ѡ���������е㸴��,�����ٸ�����㷨�IJ���,�ղŵ������һ������,���ˡ�Ϊ�˷�ֹ����ð��,���ָ��˸��¡���

? ������һ����Ϣ�����ͽ�����(���� TCP ��),����ǿͻ��˺ͷ�����ͨ�����Ĺ�����������Ϣ:Client Random��Server Random �� Server Params��

? �ͻ�����ʱҲ�õ��˷�������֤��,��ʼ��֤��������֤,ȷ��֤�����ʵ��,����֤�鹫Կ��֤ǩ��,��ȷ���˷����������ݡ�

? Ȼ��,�ͻ��˰�����������Ҫ��,Ҳ����һ����Բ���ߵĹ�Կ(Client Params),�á�Client Key Exchange����Ϣ������������

Handshake Protocol: Client Key Exchange

EC Diffie-Hellman Client Params

Pubkey: 8c674d0e08dc27b5eaa��

? ���ڿͻ��˺ͷ��������ﶼ�õ�����Կ�����㷨����������(Client Params��Server Params),���� ECDHE �㷨�����һ���µĶ���,�С�Pre-Master��,��ʵҲ��һ����������㷨���Ա�֤��ʹ�ڿͽػ���֮ǰ�IJ���,Ҳ�Ǿ����㲻�����������ġ�

? ���ڿͻ��˺ͷ����������������������:Client Random��Server Random �� Pre-Master������������Ϊԭʼ����,�Ϳ����������ڼ��ܻỰ������Կ,�С�Master Secret�������ڿ���Ϊ�ò�����Pre-Master��,����Ҳ�͵ò�������Կ��

? ��ͱ���˵ TLS ������߿��ǵ÷dz��ܵ���,���Dz����οͻ��˻������α������Ŀɿ���,Ϊ�˱�֤�����ġ���ȫ�����������Ԥ�⡱,���������ɿ���������������,��ô��������ij̶Ⱦͷdz�����,�㹻�úڿ����Բ²⡣

? ��Master Secret����������ô������İ�,��һ�� RFC ��Ĺ�ʽ:

master_secret = PRF(pre_master_secret, "master secret",

ClientHello.random + ServerHello.random)

? ����ġ�PRF������α���������,������������������һ������,������ε�SHA384,ͨ��ժҪ�㷨����һ��ǿ����Master Secret��������ԡ�

? ����Կ�� 48 �ֽ�,����Ҳ������������ͨ�ŵĻỰ��Կ,�������� PRF ��չ���������Կ,����ͻ��˷����õĻỰ��Կ(client_write_key)�������������õĻỰ��Կ(server_write_key)�ȵ�,����ֻ��һ����Կ�����İ�ȫ������

? ��������Կ�������ĻỰ��Կ,���־Ϳ�����ˡ��ͻ��˷�һ����Change Cipher Spec��,Ȼ���ٷ�һ����Finished����Ϣ,��֮ǰ���з��͵���������ժҪ,�ټ���һ��,�÷�����������֤��

? ��˼���Ǹ��߷�����:�����涼���öԳ��㷨����ͨ���˰�,�õľ��Ǵ��к�ʱ˵��AES,���ܶԲ��Ի������һ�¡���

? ������Ҳ��ͬ���IJ���,����Change Cipher Spec���͡�Finished����Ϣ,˫������֤���ܽ��� OK,������ʽ����,������շ������ܵ� HTTP �������Ӧ�ˡ�

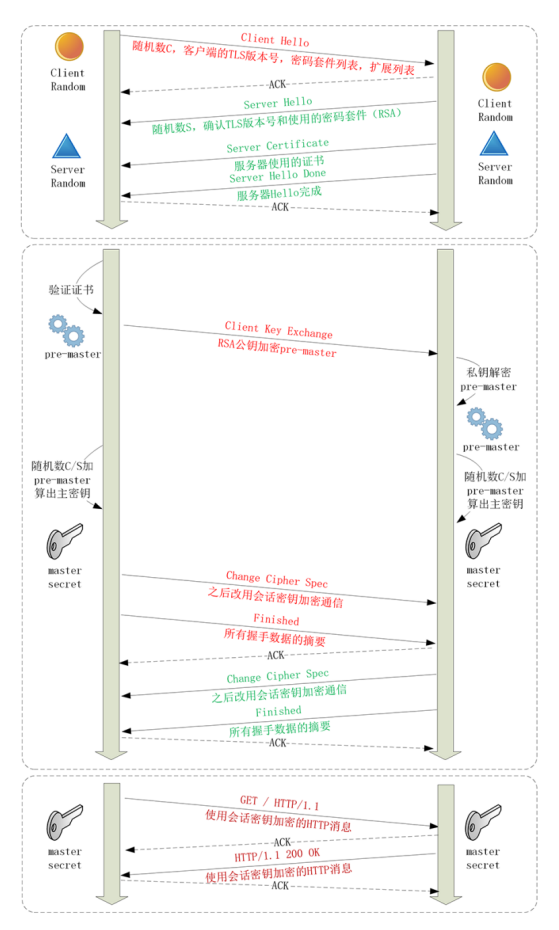

(4)RSA���ֹ���

? ������ TLS ���ֹ����봫ͳ�����������㲻ͬ��

? ��һ��,ʹ�� ECDHE ʵ����Կ����,������ RSA,���Ի��ڷ������˷�����Server Key Exchange����Ϣ��

? �ڶ���,��Ϊʹ���� ECDHE,�ͻ��˿��Բ��õȵ����������ء�Finished��ȷ���������,�����ͷ��� HTTP ����,ʡȥ��һ����Ϣ������ʱ���˷ѡ�����С�TLS False Start��,��˼���ǡ����ܡ�,�͡�TCP Fast Open���е���,���Dz���������ȫ��������ǰ��Ӧ������,��ߴ����Ч�ʡ�

? ���������û�б�,ֻ�ǡ�Pre-Master��������Ҫ���㷨����,���ǿͻ���ֱ�����������,Ȼ���÷������Ĺ�Կ����,ͨ����Client Key Exchange����Ϣ����������������������˽Կ����,����˫��Ҳʵ���˹������������,�Ϳ�����������Կ��

(5)˫����֤

? ��������˵���ǡ�������֤�����ֹ���,ֻ��֤�˷�����������,��û����֤�ͻ��˵����ݡ�������Ϊͨ��������֤ͨ�����Ѿ������˰�ȫͨ��,���˺š�����ȼ��ֶξ��ܹ�ȷ���û�����ʵ���ݡ�

? ��Ϊ�˷�ֹ�˺š����뱻��,�е�ʱ��(������������)����ʹ�� U �ܸ��û��䷢�ͻ���֤��,ʵ�֡�˫����֤��,��������Ӱ�ȫ��

? ˫����֤������Ҳû��̫��仯,ֻ���ڡ�Server Hello Done��֮��,��Client Key Exchange��֮ǰ,�ͻ���Ҫ���͡�Client Certificate����Ϣ,�������յ���Ҳ��֤������һ��,��֤�ͻ��˵����ݡ�

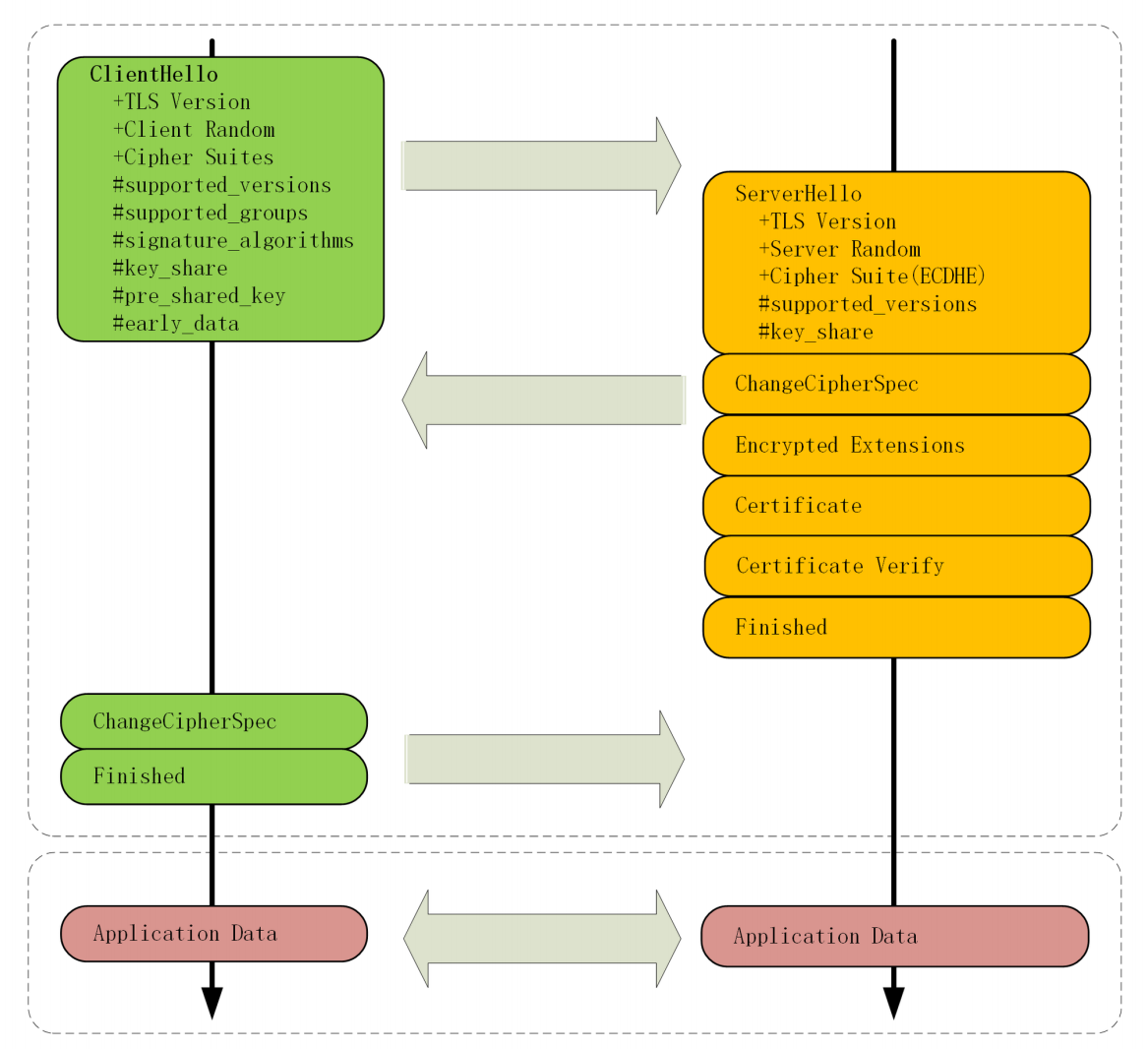

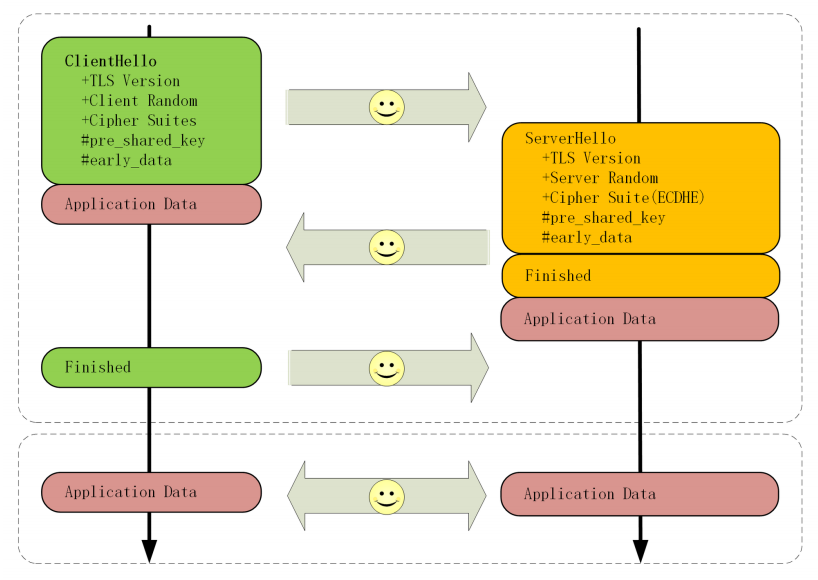

5��TLS1.3���Խ���

? TLS1.2 �Ѿ��� 10����ǰ(2008 ��)�ġ��ϡ�Э����,��Ȼ��������,���Ͼ������²����ˡ�,�ڰ�ȫ�����ܵȷ����Ѿ����������Ļ������ˡ�

? ���Ǿ������ꡢ�� 30 ���ݰ��ķ�����ĥ,TLS1.3 ������2018 �ꡰ��ī�dz���,�ٴ�ȷ������Ϣ��ȫ������±���

? TLS1.3 ��������Ҫ�Ľ�Ŀ��:��������ȫ��������

(1)�������

? ���� 1.1��1.2 ��Э���Ѿ������˺ܶ���,�ܶ�Ӧ���������м����(�ٷ���Ϊ��MiddleBox��)ֻ���ϵļ�¼Э���ʽ,���¸��������,�����Dz�����(�豸����)��

? Ϊ�˱�֤��Щ���㷺����ġ����豸���ܹ�����ʹ��,������Э������ġ������,TLS1.3 ���ò�������Э,�������еļ�¼��ʽ����,ͨ����αװ����ʵ�ּ���,ʹ��TLS1.3 ����ȥ�����ǡ�TLS1.2��

? ��Ҫ�õ�һ���µ���չЭ��(Extension Protocol),���е㡰�����������˼,ͨ���ڼ�¼ĩβ����һϵ�еġ���չ�ֶΡ��������µĹ���,�ϰ汾�� TLS ����ʶ������ֱ�Ӻ���,���ʵ���ˡ�������ݡ���

? �ڼ�¼ͷ�� Version �ֶα������ԡ��̶����������,ֻҪ�� TLS1.3 Э��,���ֵġ�Hello����Ϣ����ͱ����С�supported_versions����չ,������� TLS �İ汾��,ʹ�������������¾�Э�顣

Handshake Protocol: Client Hello

Version: TLS 1.2 (0x0303)

Extension: supported_versions (len=11)

Supported Version: TLS 1.3 (0x0304)

Supported Version: TLS 1.2 (0x0303)

? TLS1.3 ������չʵ����������Ҫ�Ĺ���,���硰supported_groups����key_share����signature_algorithms����server_name����

(2)ǿ����ȫ

? TLS1.2 ��ʮ�����Ӧ���л�������౦��ľ���,½�������˺ܶ��©���ͼ����㷨������,���� TLS1.3 ����Э����������Щ����ȫ���ء�

- α����������� PRF ����Ϊ HKDF(HMAC-based Extract-and-Expand Key

- Derivation Function);

- ��ȷ��ֹ�ڼ�¼Э����ʹ��ѹ��;

- �ϳ��� RC4��DES �ԳƼ����㷨;

- �ϳ��� ECB��CBC �ȴ�ͳ����ģʽ;

- �ϳ��� MD5��SHA1��SHA-224 ժҪ�㷨;

- �ϳ��� RSA��DH ��Կ�����㷨�������������ߡ�

? ������һ��������������֮��,TLS1.3 ��ֻ������ AES��ChaCha20 �ԳƼ����㷨,����ģʽֻ���� AEAD �� GCM��CCM �� Poly1305,ժҪ�㷨ֻ���� SHA256��SHA384,��Կ�����㷨ֻ�� ECDHE �� DHE,��Բ����Ҳ����������ֻʣ P-256 �� x25519 �� 5�֡�

? �㷨����������һ������֮�еĺô�:ԭ���ڶ���㷨��������ϵ����������dz�����,����ѡ��,�����ڵ� TLS1.3 ��ֻ�� 5 ����,�����ǿͻ��˻��Ƿ������������ٷ���ѡ������֢���ˡ�

? ���ﻹҪ�ر�˵һ�·ϳ� RSA �� DH ��Կ�����㷨��ԭ�������Ĭ�ϻ�ʹ�� ECDHE ������ RSA ����Կ����,������Ϊ�������С�ǰ��ȫ��(Forward Secrecy)��

? ��������ôһ���������ĵĺڿ�,һֱ�ڳ����ռ���ϼ���ϵͳ�շ������б��ġ��������ϵͳʹ�÷�����֤����� RSA ����Կ����,һ��˽Կй¶���ƽ�(ʹ����Ṥ��ѧ���߾��ͼ����),��ô�ڿ;��ܹ�ʹ��˽Կ���ܳ�֮ǰ���б��ĵġ�Pre-Master��,������Ự��Կ,�ƽ��������ġ�

? �� ECDHE �㷨��ÿ������ʱ��������һ����ʱ�Ĺ�Կ��˽Կ,ÿ��ͨ�ŵ���Կ�Զ��Dz�ͬ��,Ҳ���ǡ�һ��һ�ܡ�,��ʹ�ڿͻ��������ƽ�����һ�εĻỰ��Կ,Ҳֻ�����ͨ�ű�����,֮ǰ����ʷ��Ϣ�����ܵ�Ӱ��,��Ȼ�ǰ�ȫ�ġ�

(3)��������

? HTTPS ��������ʱ����Ҫ�� TCP ����,��Ҫ�� TLS ����,�� 1.2 �л�������Ϣ����(2-RTT),���ܵ��¼�ʮ���������ϰٺ�����ӳ�,���ƶ��������ӳٻ�������ء�

? ������Ϊ����������ȼ�,Ҳ��û�б�Ҫ������ǰ�����߸��ӵ�Э�������ˡ�TLS1.3ѹ������ǰ�ġ�Hello��Э�̹���,ɾ���ˡ�Key Exchange����Ϣ,������ʱ����ٵ��ˡ�1-RTT��,Ч�������һ����

? ��ʵ���������������������չ���ͻ����ڡ�Client Hello����Ϣ��ֱ���á�supported_groups������֧�ֵ�����,���� P-256��x25519,�á�key_share���������߶�Ӧ�Ŀͻ��˹�Կ����,�á�signature_algorithms������ǩ���㷨��

? �������յ�������Щ��չ��ѡ��һ�����ߺͲ���,���á�key_share����չ���ط�������ߵĹ�Կ����,��ʵ����˫������Կ����,��������̾ͺ� 1.2 ����һ���ˡ�

? ���˱��ġ�1-RTT������,TLS1.3 �������ˡ�0-RTT������,�á�pre_shared_key���͡�early_data����չ,�� TCP ���Ӻ������ͽ�����ȫ���ӷ��ͼ�����Ϣ��

(4)���ַ���

? �� TCP ��������֮��,��������Ȼ��Ƿ�һ����Client Hello������Ϊ 1.3 ����Ϣ���� 1.2,���Կ�ͷ�İ汾�š�֧�ֵ��������������(Client Random)�ṹ����һ����(������ʱ��������� 32 ���ֽ�)��

? ע�⡰Client Hello�������չ,��supported_versions����ʾ����TLS1.3,��supported_groups����֧�ֵ�����,��key_share�������߶�Ӧ�IJ�����

? �������յ���Client Hello��ͬ�����ء�Server Hello����Ϣ,����Ҫ����һ��**�����(Server Random)**��ѡ����������

? �����Ͽ��� TLS1.2 ��һ����,�ص��Ǻ������չ����supported_versions����ȷ��ʹ�õ��� TLS1.3,Ȼ���ڡ�key_share����չ�������ߺͶ�Ӧ�Ĺ�Կ������

? ��ʱֻ������������Ϣ,�ͻ��˺ͷ��������õ����ĸ�������Ϣ:Client Random��Server Random��Client Params��Server Params,���߾Ϳ��Ը����� ECDHE �����Pre-Master��,���� HKDF ��������Կ��Master Secret��,Ч�ʱ� TLS1.2 �����һ��ء�

? ���������Կ��,���������̷�����Change Cipher Spec����Ϣ,�� TLS1.2 ����������ͨ��,�����֤��ȾͶ��Ǽ��ܵ���,����������ʱ��������Ϣй¶��