Kubernetes����+����Kubernetes��Ⱥ

Kubernetes����

1.1 Ӧ�ò���ʽ�ݱ�

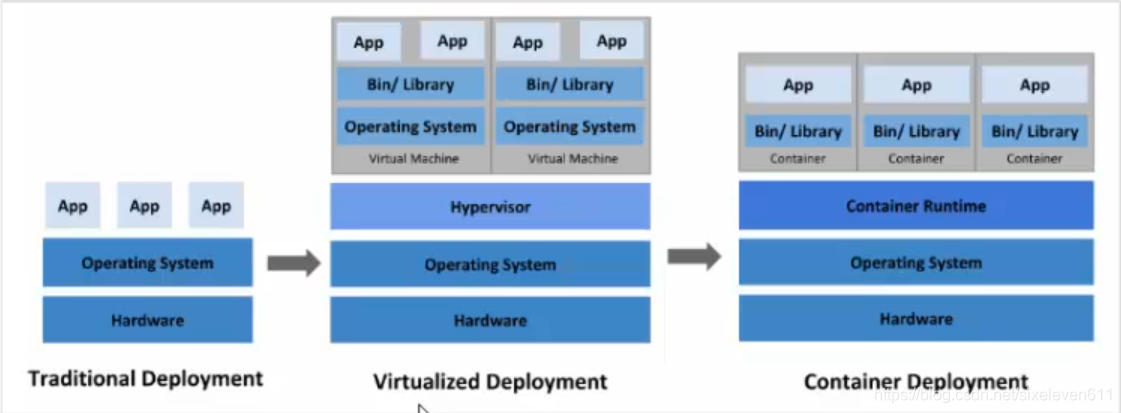

�ڲ���Ӧ�ó���ķ�ʽ��,��Ҫ����������ʱ��:

- ��ͳ����:����������,��ֱ�ӽ�Ӧ�ó���������������

�ŵ�:��,����Ҫ���������IJ���

ȱ��:����ΪӦ�ó�������Դʹ�ñ߽�,���Ѻ����ط��������Դ,���ҳ���֮�����ײ���Ӱ��

- ���⻯����:������һ̨�����������ж�������,ÿ����������Ƕ�����һ������

�ŵ�:�������������Ӱ��,�ṩ��һ���̶ȵİ�ȫ��

ȱ��:�����˲���ϵͳ,�˷��˲�����Դ

- ����������:�����⻯����,���ǹ����˲���ϵͳ

�ŵ�:

���Ա�֤ÿ������ӵ���Լ����ļ�ϵͳ��CPU���ڴ桢���̿ռ��

����Ӧ�ó�������Ҫ����Դ����������װ,���͵ײ�����ܹ�����

��������Ӧ�ó�����Կ��Ʒ����̡���Linux����ϵͳ���а���в���

- ����������ʽ�������ܶ�ı���,����Ҳ�����һЩ����,����˵:

- һ����������ͣ����,��ô��������һ��������������ȥ�油ͣ��������

- ����������������ʱ��,��ô������������չ��������

- ��Щ��������������ͳ��Ϊ������������,Ϊ�˽����Щ������������,�Ͳ�����һЩ�������ŵ�����:

Swarm: Docker�Լ����������Ź���Mesos: Apache��һ����Դͳ���ܿصĹ���,��Ҫ��Marathon���ʹ��- Kubernetes : Google��Դ�ĵ��������Ź���

1.2 Kubernetes���

- kubernetes,��һ��ȫ�µĻ������������ķֲ�ʽ�ܹ����ȷ���,�ǹȸ��ϸ���ʮ��������������C

Borgϵͳ��һ����Դ�汾,��2014��9�·�����һ���汾,2015��7�·�����һ����ʽ�汾�� - kubernetes�ı�����һ���������Ⱥ,�������ڼ�Ⱥ��ÿ���ڵ��������ض��ij���,���Խڵ��е��������й���������Ŀ�ľ�����ʵ����Դ�������Զ���,��Ҫ�ṩ�����µ���Ҫ����:

- ������:һ��ijһ����������,�ܹ���1��������Ѹ�������µ�����

- ��������:���Ը�����Ҫ,�Զ��Լ�Ⱥ���������е����������е���

- ������:�������ͨ���Զ����ֵ���ʽ�ҵ����������ķ���

- ���ؾ���:���һ���������˶������,�ܹ��Զ�ʵ������ĸ��ؾ���

- �汾����:��������·����ij���汾�����⡣�����������˵�ԭ���İ汾

- �洢����:���Ը������������������Զ������洢��

1.3 Kubernetes���

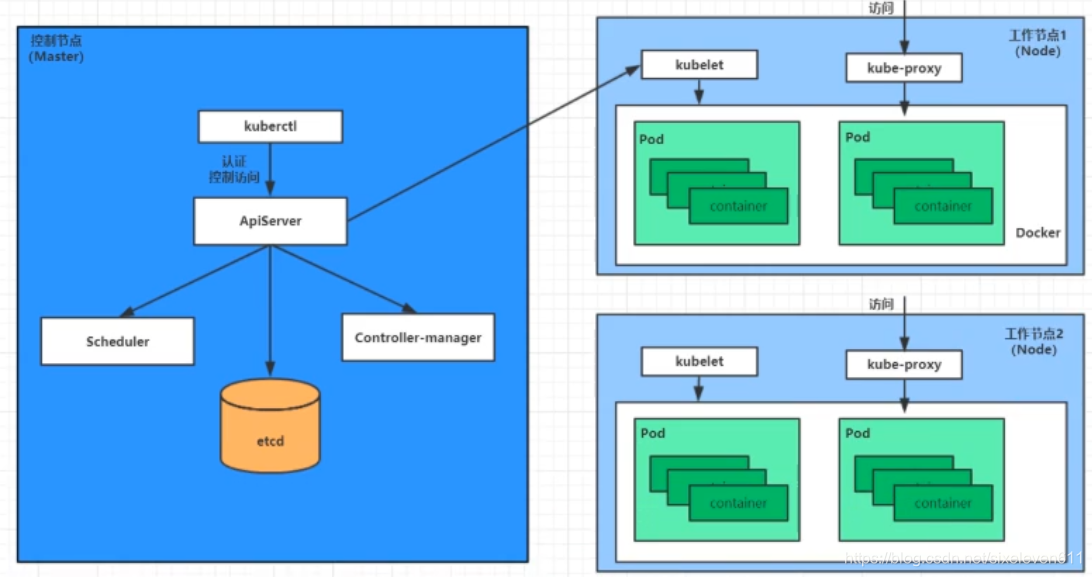

һ��kubernetes��Ⱥ��Ҫ�������ƽڵ�(master)�������ڵ�(node)����,ÿ���ڵ��϶��ᰲװ��ͬ�������

- Master:��Ⱥ�Ŀ���ƽ��,����Ⱥ�ľ���

ApiServer:��Դ������Ψһ���,�����û����������,�ṩ��֤����Ȩ��APIע��ͷ��ֵȻ���

Scheduler:����Ⱥ��Դ����,����Ԥ���ĵ��Ȳ��Խ�Pod���ȵ���Ӧ��node�ڵ���

ControllerManager:����ά����Ⱥ��״̬,����������š����ϼ�⡢�Զ���չ���������µ�

Etcd:����洢��Ⱥ�и�����Դ�������Ϣ

- Node:��Ⱥ������ƽ��,����Ϊ�����ṩ���л���

Kubelet:����ά����������������,��ͨ������docker,�����������¡���������

KubeProxy:�����ṩ��Ⱥ�ڲ��ķ����ֺ��ؾ���

Docker:����ڵ��������ĸ��ֲ���

- ����һ��nginx������˵��kubernetesϵͳ����������ù�ϵ:

- ����Ҫ��ȷ,һ��kubernetes��������֮��,master��node���Ὣ��������Ϣ�洢��

etcd���ݿ��� - һ��nginx����İ�װ��������ȱ����͵�

master�ڵ��apiServer��� apiServer��������scheduler�������������Ӧ�ð��������װ���ĸ�node�ڵ���,�ڴ�ʱ,������etcd�ж�ȡ����node�ڵ����Ϣ,Ȼ����һ�����㷨����ѡ��,���������֪apiServerapiServer����controller-managerȥ����Node�ڵ㰲װnginx����kubelet���յ�ָ���,��֪ͨdocker,Ȼ����docker������һ��nginx��pod,pod��kubernetes����С������Ԫ,������������pod������- һ��nginx�����������,�����Ҫ����nginx,����Ҫͨ��

kube-proxy����pod�������ʵĴ���,����,����û��Ϳ��Է��ʼ�Ⱥ�е�nginx������

- ����Ҫ��ȷ,һ��kubernetes��������֮��,master��node���Ὣ��������Ϣ�洢��

1.4 Kubernetes����

- Master:��Ⱥ���ƽڵ�,ÿ����Ⱥ��Ҫ����һ��master�ڵ㸺��Ⱥ�Ĺܿ�

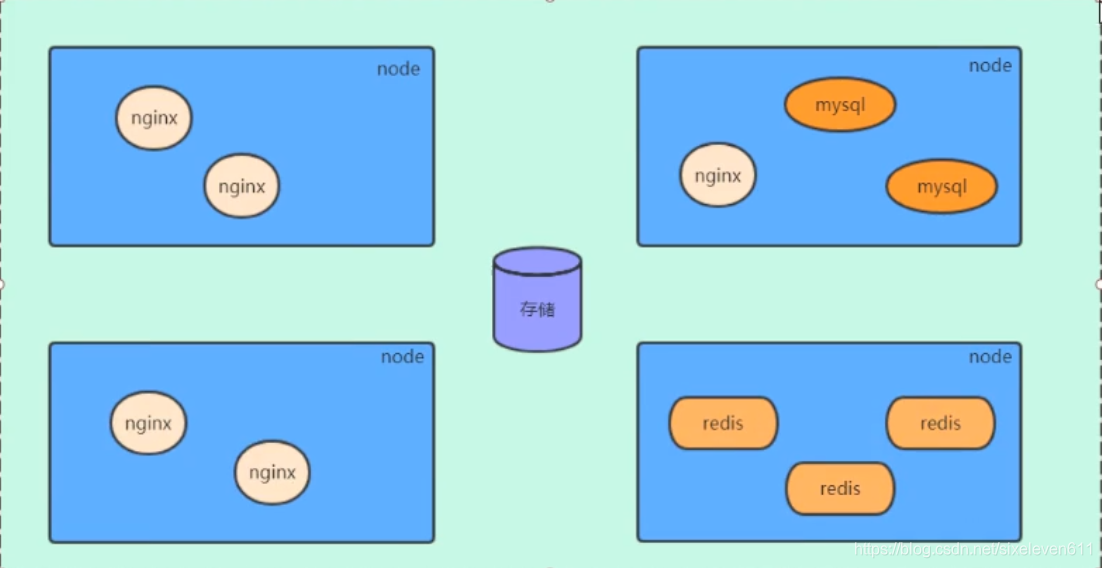

- Node:�������ؽڵ�,��master������������Щnode�����ڵ���,Ȼ��node�ڵ��ϵ�docker��������������

- Pod:kubernetes����С���Ƶ�Ԫ,��������������pod�е�,һ��pod�п�����1�����߶������(������� > ���� > pod)

- Controller:������,ͨ������ʵ�ֶ�pod�Ĺ���,��������pod��ֹͣpod������pod�������ȵ�

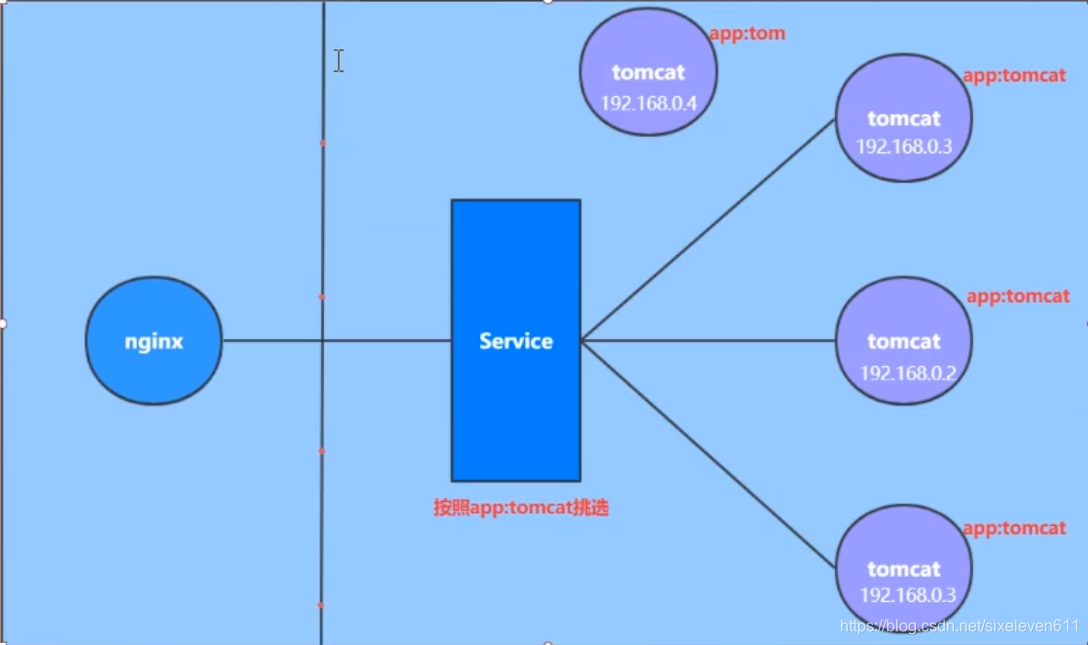

- Service:pod��������ͳһ���,�������ά����ͬһ��Ķ��pod

- Label:��ǩ,���ڶ�pod���з���,ͬһ��pod��ӵ����ͬ�ı�ǩ

- NameSpace:�����ռ�,��������pod�����л���

��Ⱥ�����

2.1 �����滮

2.1.1 ��Ⱥ����

kubernetes��Ⱥ�����Ϸ�Ϊ����:һ��������������- һ�����:һ̨Master�ڵ�Ͷ�̨Node�ڵ�,���,�����е������Ϸ���,�ʺ����ڲ��Ի���

- �������:��̨Master�ڵ�Ͷ�̨Node�ڵ�,��鷳,��ȫ�Ը�,�ʺ�������������

˵��:Ϊ�˲��Լ�,���δ����һ���������͵ļ�Ⱥ

2.1.2 ��װ��ʽ

Kubernetes�ж��ֲ���ʽ,Ŀǰ�����ķ�ʽ��kubeadm��minikube�������ư�Minikube:һ�����ڿ��ٴ���ڵ�kubernetes�Ĺ���Kubeadm:һ�����ڿ��ٴkubernetes��Ⱥ�Ĺ��������ư��ôӹ�������ÿ������Ķ����ư�,����ȥ��װ,�˷�ʽ��������kubernetes���������Ч

˵��:������Ҫ��װkubernetes�ļ�Ⱥ����,�����ֲ�������鷳,����ѡ��ʹ��kubeadm��ʽ

2.1.3 �����滮

| ���� | IP��ַ | ����ϵͳ | ���� |

|---|---|---|---|

| k8s-master | 192.168.100.20 | CentOS 7.5 ������ʩ������ | 2��CPU 2G�ڴ� |

| Node1 | 192.168.100.30 | CentOS 7.5 ������ʩ������ | 2��CPU 2G�ڴ� |

| Node2 | 192.168.100.31 | CentOS 7.5 ������ʩ������ | 2��CPU 2G�ڴ� |

2.2 ������ʼ��

- ������ϵͳ�汾

#�˷�ʽ�°�װkubernetes��ȺҪ��centos�汾Ҫ��7.5��֮��

[root@k8s-master ~]# cat /etc/redhat-release

CentOS Linux release 7.5.1804 (Core)

- ����������

- Ϊ�˷�����漯Ⱥ�ڵ���ֱ�ӵ���,��������һ������������,��ҵ���Ƽ�ʹ���ڲ�DNS������

#�������ɽ����༭��̨��������/etc/hosts�ļ�,������������

#ʹ��Xsell���ͼ������лỰ

[root@k8s-master ~]# vim /etc/hosts

192.168.100.20 k8s-master

192.168.100.30 k8s-node1

192.168.100.31 k8s-node2

- ʱ��ͬ��

- kubernetesҪ��Ⱥ�еĽڵ�ʱ����뾫ȷһ��,����ֱ��ʹ��chronyd���������ͬ��ʱ�䡣

- ��ҵ�н��������ڲ���ʱ��ͬ��������

#�鿴�Ƿ�װ

rpm -qa |grep chrony

#��װ,ʹ��Xshell���ͼ������лỰ

yum install -y chrony

#����chrony�������ÿ�������

systemctl start chronyd && systemctl enable chronyd

#������ɺ�鿴ʱ���Ƿ�ͬ��

[root@k8s-master ~]# date

- ����iptables��firewalld����

- kubernetes��docker�������л����������iptables����,Ϊ�˲���ϵͳ��������ǻ���,ֱ�ӹر�ϵͳ�Ĺ���

#�رշ���ǽ�����ÿ���������

systemctl stop firewalld && systemctl disable firewalld

#��ǰ�汾û��iptables,��һ���������

- ����Selinux

- selinux��linuxϵͳ�µ�һ����ȫ����,������ر���,�ڰ�װ��Ⱥ�л�������ָ�������������

sed -i 's/SELINUX=enforcing/SELINUX=disabled/g' /etc/selinux/config

setenforce 0

getenforce

- ����swap��������

- swap����ָ���������ڴ����,�����������������ڴ�ʹ����֮��,�����̿ռ�������ڴ���ʹ��

- ����swap�豸���ϵͳ�����ܲ����dz������Ӱ��,���kubernetesҪ��ÿ���ڵ㶼Ҫ����swap�豸

- ���������ΪijЩԭ��ȷʵ���ܹر�swap����,����Ҫ�ڼ�Ⱥ��װ������ͨ����ȷ�IJ�����������˵��

#�༭���������ļ�/etc/fstab,ע�͵�swap����һ��

#�����֮����Ҫ����linux����

vim /etc/fstab

#/dev/mapper/centos-swap swap swap defaults 0 0

- ��Linux�ں˲���

#��linux���ں˲���,�������Ź��˺͵�ַת������

#�༭/etc/sysctl.d/kubernetes.conf�ļ�,������������:

vim /etc/sysctl.d/kubernetes.conf

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

net.ipv4.ip_forward = 1

#���¼�������

[root@k8s-master ~]# sysctl -p

#�������Ź���ģ��

[root@k8s-master ~]# modprobe br_netfilter

#�鿴���Ź���ģ���Ƿ���سɹ�

[root@k8s-master ~]# lsmod | grep br_netfilter

br_netfilter 22256 0

- ����ipvs����

- ��kubernetes��service�����ִ���ģ��,һ���ǻ���iptables��,һ���ǻ���ipvs��

- ���߱ȽϵĻ�,

ipvs����������Ҫ��һЩ,�������Ҫʹ����,��Ҫ�ֶ�����ipvsģ��

#��װipset��ipvsadm

[root@k8s-master ~]# yum -y install ipset ipvsadmin

#������Ҫ���ص�ģ��д��ű��ļ�

cat <<EOF > /etc/sysconfig/modules/ipvs.modules

#!/bin/bash

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

modprobe -- nf_conntrack_ipv4

EOF

#Ϊ�ű�����ִ��Ȩ��

chmod +x /etc/sysconfig/modules/ipvs.modules

#ִ�нű��ļ�

/bin/bash /etc/sysconfig/modules/ipvs.modules

#�鿴��Ӧģ���Ƿ���سɹ�

lsmod | grep -e ip_vs -e nf_conntrack_ipv4

- ����������

#����

shutdown -r now

#������鿴���������Ƿ�رճɹ�

free -h

2.2.1 ��װDocker

#�л�����Դ

wget https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo -O /etc/yum.repos.d/docker-ce.repo

#�鿴��ǰ����Դ��֧�ֵ�docker�汾

yum list docker-ce --showduplicates

#��װ�ض��汾��docker-ce

#����ָ��--setopt=obsoletes=0,����yum���Զ���װ���߰汾,�ȶ�

yum install --setopt=obsoletes=0 docker-ce-18.06.3.ce-3.el7 -y

#����һ�������ļ�

# Docker��Ĭ�������ʹ�õ�Cgroup DriverΪcgroupfs,��kubernetes�Ƽ�ʹ��systemd������cgroupfs

[root@k8s-master ~]# mkdir /etc/docker

[root@k8s-master ~]# cat <<EOF > /etc/docker/daemon.json

{

"exec-opts": ["native.cgroupdriver=systemd"],

"registry-mirrors":["https://kn0t2bca.mirror.aliyuncs.com"]

}

EOF

#���������ÿ�������docker

[root@k8s-master ~]# systemctl enable docker --now

#���docker�汾��״̬

[root@k8s-master ~]# docker version

2.2.2 ��װkubernetes���

#����kubernetes�ľ���Դ�ڹ���,�ٶȱȽ���,�����л��ɹ��ڵľ���Դ

#�༭/etc/yum.repos.d/kubernetes.repo,�������������

[root@k8s-master ~]# vim /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=http://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=http://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg

http://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

#��װkubeadm��kubelet��kubectl

[root@k8s-master ~]# yum install --setopt=obsoletes=0 kubeadm-1.17.4-0 kubelet-1.17.4-0 kubectl-1.17.4-0 -y

#����kubelet��cgroup

#�༭/etc/sysconfig/kubelet,�������������

[root@k8s-master ~]# vim /etc/sysconfig/kubelet

KUBELET_EXTRA_ARGS="--cgroup-driver=systemd"

KUBE_PROXY_MODE="ipvs"

#����kubelet��������,�����ֶ�����,�ڼ�Ⱥ�����л��Զ�����

[root@k8s-master ~]# systemctl enable kubelet

2.2.3 ����Ⱥ����

#�ڰ�װkubernetes��Ⱥ֮ǰ,����Ҫ��ǰ���ü�Ⱥ��Ҫ�ľ���,���辵�����ͨ����������鿴

[root@k8s-master ~]# kubeadm config images list

#���ؾ���

#�������ؾ�����б�,��̨����ͬʱ����

[root@k8s-master ~]# images=(

kube-apiserver:v1.17.4

kube-controller-manager:v1.17.4

kube-scheduler:v1.17.4

kube-proxy:v1.17.4

pause:3.1

etcd:3.4.3-0

coredns:1.6.5

)

[root@k8s-master ~]# for imageName in ${images[@]} ;do

#�Ӱ����Ʋֿ���ȡ����

docker pull registry.cn-hangzhou.aliyuncs.com/google_containers/$imageName

#��ȡ���֮���Ϊk8s�ٷ��ֿ������

docker tag registry.cn-hangzhou.aliyuncs.com/google_containers/$imageName k8s.gcr.io/$imageName

#�����֮�����Ƴ����↑ͷ�ľ���

docker rmi registry.cn-hangzhou.aliyuncs.com/google_containers/$imageName

done

#������ɺ�鿴���صľ���

[root@k8s-master ~]# docker images

2.2.4 ��Ⱥ��ʼ��

- �Լ�Ⱥ���г�ʼ��,����node�ڵ���뵽��Ⱥ��

����IJ���ֻ��Ҫ��

master�ڵ���ִ�м���

#������Ⱥ

[root@k8s-master ~]# kubeadm init \

--kubernetes-version=v1.17.4 \

--pod-network-cidr=10.244.0.0/16 \

--service-cidr=10.96.0.0/12 \

--apiserver-advertise-address=192.168.100.20 #����master�ڵ�IP��ַ

#���Kubernetes����ƽ���ѳɹ���ʼ��!

Your Kubernetes control-plane has initialized successfully!

#������ʾ������Ҫ�ļ�

[root@k8s-master ~]# mkdir -p $HOME/.kube

[root@k8s-master ~]# sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

[root@k8s-master ~]# sudo chown $(id -u):$(id -g) $HOME/.kube/config

����IJ���ֻ��Ҫ��

node�ڵ���ִ�м���

#��node�ڵ���뼯Ⱥ

#ͨ����ÿ�����ڵ���������������,���Լ������������Ĺ����ڵ�

Then you can join any number of worker nodes by running the following on each as root:

[root@k8s-node1 ~]# kubeadm join 192.168.100.20:6443 --token djgeak.55d6k3ukq74yi7bp \

--discovery-token-ca-cert-hash sha256:d0eff06868f22d0214eeab738166e26e85d0ce31d47e4c8effe4c84279ba2fcc

[root@k8s-node2 ~]# kubeadm join 192.168.100.20:6443 --token djgeak.55d6k3ukq74yi7bp \

--discovery-token-ca-cert-hash sha256:d0eff06868f22d0214eeab738166e26e85d0ce31d47e4c8effe4c84279ba2fcc

#�ڿ���ƽ��������"kubectl get nodes"�Բ鿴�˽ڵ��Ƿ���뼯Ⱥ

Run 'kubectl get nodes' on the control-plane to see this node join the cluster.

#��master�ڵ�鿴,��ʱ״̬ΪNotReady,��Ҫ��װ������

[root@k8s-master ~]# kubectl get nodes

NAME STATUS ROLES AGE VERSION

k8s-master NotReady master 4m30s v1.17.4

k8s-node1 NotReady <none> 110s v1.17.4

k8s-node2 NotReady <none> 106s v1.17.4

2.2.5 ��װ������

- kubernetes֧�ֶ���������,����flannel��calico��canal�ȵ�,��ѡһ��ʹ�ü���,����ѡ��

flannel

�����������ֻ��

master�ڵ�ִ�м���,���ʹ�õ���DaemonSet�Ŀ�����,������ÿ���ڵ��϶�����

#��ȡfannel�������ļ�

[root@k8s-master ~]# wget https://github.com/mrlxxx/kube-flannel.yml/archive/refs/heads/master.zip

[root@k8s-master ~]# unzip master.zip

[root@k8s-master ~]# find kube-flannel.yml-master/ -name kube-flannel.yml -exec mv {} . \;

[root@k8s-master ~]# rm -rf kube-flannel.yml-master master.zip

[root@k8s-master ~]# vim kube-flannel.yml

#���ļ��е�quay.io�ֿ�Ϊquay-mirror.qiniu.com

#ÿ���ڵ㶼��Ҫ��ȡ����

[root@k8s-master ~]# docker pull lwolf/flannel:v0.12.0

# ΪʲôҪ��tag,��Ϊkube-flannel.yaml�ļ�����ľ������ƾ���quay.io/coreos/flannel:v0.12.0-amd64

[root@k8s-master ~]# docker tag lwolf/flannel:v0.12.0 quay-mirror.qiniu.com/coreos/flannel:v0.12.0-amd64

#ʹ�������ļ�����fannel

[root@k8s-master ~]# kubectl apply -f kube-flannel.yml

#�ٴβ鿴��Ⱥ�ڵ��״̬

[root@k8s-master ~]# kubectl get nodes

NAME STATUS ROLES AGE VERSION

k8s-master Ready master 12m v1.17.4

k8s-node1 Ready <none> 13m v1.17.4

k8s-node2 Ready <none> 13m v1.17.4

#����,kubernetes�ļ�Ⱥ��������

2.3 ������

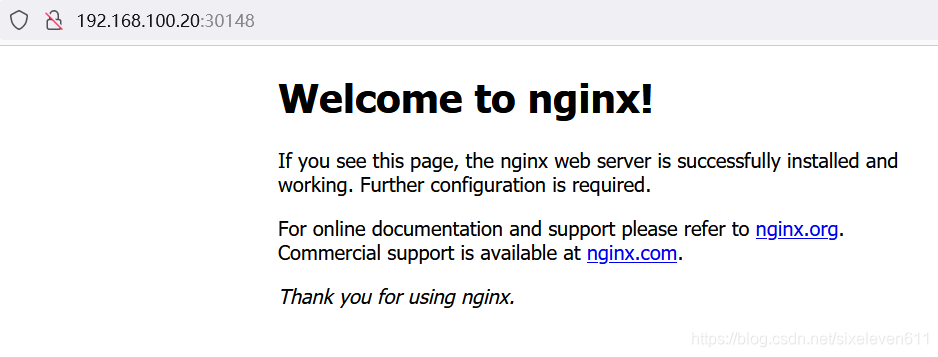

- ��������kubernetes��Ⱥ�в���һ��nginx����,�����¼�Ⱥ�Ƿ�������������

�����������ֻ��

master�ڵ�ִ�м���

#����nginx

[root@k8s-master ~]# kubectl create deployment nginx --image=nginx:1.14-alpine

deployment.apps/nginx created

#��¶�˿�,NodePort:�ü�Ⱥ֮����˷���

[root@k8s-master ~]# kubectl expose deployment nginx --port=80 --type=NodePort

service/nginx exposed

#�鿴����״̬

[root@k8s-master ~]# kubectl get pods,service

NAME READY STATUS RESTARTS AGE

pod/nginx-6867cdf567-z57cw 1/1 Running 0 2m59s

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service/kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 133m

service/nginx NodePort 10.100.110.227 <none> 80:32461/TCP 32s

#����ڵ����Ϸ��ʲ����nginx����