ЮФеТФПТМ

вЛЁЂгХЛЏУќСюаа

yum install -y -completion

source /usr/share/-completion/_completion

source <(kubectl completion )

echo "source <(kubectl completion )" >> ~/.rc

ЖўЁЂkubernetesДјРДЕФБфИя

k8sгыdockerЕФЙиЯЕ:

k8sЪЧвЛИіШнЦїЛЏЙмРэЦНЬЈ,dockerЪЧШнЦї

1.ЖдгкПЊЗЂШЫдБ

гЩгкЙЋЫОвЕЮёЖр,ПЊЗЂЛЗОГЁЂВтЪдЛЗОГЁЂдЄЩњВњЛЗОГКЭЩњВњЛЗОГЖМЪЧИєРыЕФ,ЖјЧвГ§СЫЩњВњЛЗОГ,ЮЊСЫНкЪЁГЩБО,ЦфЫћЛЗОГПЩФмЪЧУЛгаШежОЪеМЏЕФ,дкУЛгагУ k8s ЕФЪБКђ,ВщПДЯпЯТВтЪдЕФШежО,ашвЊПЊЗЂЛђепВтЪдШЫдБ,евЕНЖдгІЕФЛњЦї,дкевЕНЖдгІЕФШнЦї,ШЛКѓВХФмВщПДШежО,дкгУСЫ k8s жЎКѓ,ПЊЗЂКЭВтЪдПЩвджБНгдк k8s ЕФdashboard ЕНЖдгІЕФ namespace,МДПЩЖЈЮЛЕНвЕЮёЕФШнЦї,ШЛКѓПЩвджБНгЭЈЙ§ПижЦЬЈВщПДЕНЖдгІЕФШежО,ДѓДѓНЕЕЭСЫВйзїЪБМфЁЃ

ФПЧАЮвУЧЪЙгУ jenkinsЁЂgitrunner НјааЗЂАцЛђепЛиЙіЕШ,ДгПЊЗЂЛЗОГЕНВтЪдЛЗОГ,ЕНЩњВњЛЗОГ,ЭъШЋзёЪивЛДЮЙЙНЈ,ЖрМЏШКЁЂЖрЛЗОГВПЪ№,ЭЈЙ§ВЛЭЌЕФЦєЖЏВЮЪ§ЁЂВЛЭЌЕФЛЗОГБфСПЁЂВЛЭЌЕФХфжУЮФМўЪЕЯжЧјЗжВЛЭЌЕФЛЗОГЁЃФПЧАвбОЪЕЯж PythonЁЂJavaЁЂPHPЁЂNodeJSЁЂGoЁЂ.NET CoreЁЂPythonЕШЖржжгябдЕФвЛМќЪНЗЂАцЁЂвЛМќЪНЛиЙі,ДѓДѓЬсИпСЫПЊЗЂШЫдБЕФПЊЗЂаЇТЪЁЃ

2.ЖдгкдЫЮЌШЫдБ

ШчЙћФуЪЧвЛУћдЫЮЌШЫдБ,ПЩФмОГЃвђЮЊвЛаЉжиИДЁЂЗБЫіЕФЙЄзїИаОѕбсОыЁЃБШШч:етИіашвЊвЛЬзаТЕФВтЪдЛЗОГ,ФЧИіашвЊвЛЬзаТЕФВтЪдЛЗОГ,жЎЧАПЩФмашвЊзАЯЕЭГЁЂзАвРРЕЛЗОГЁЂПЊЭЈШЈЯоЕШЕШЁЃЖјШчНё,ПЩвджБНггУОЕЯёжБНгВПЪ№вЛЬзаТЕФВтЪдЛЗОГ,ЩѕжСШЋГЬЮоашздМКИЩдЄ,ПЊЗЂШЫдБЭЈЙ§ jenkins ЛђепздЖЏЛЏдЫЮЌЦНЬЈМДПЩвЛМќЪНДДНЈ,ДѓДѓНЕЕЭСЫдЫЮЌГЩБОЁЃ

вЛПЊЪМ,ЙЋЫОвЕЮёЙЪеЯ,ПЩФмЪЧвђЮЊЛљДЁЛЗОГВЛвЛжТЁЂвРРЕВЛвЛжТЁЂЖЫПкГхЭЛЕШЕШЮЪЬт,ЯждкЪЕЯж DockerОЕЯёВПЪ№,k8s БрХХ,ЫљгаЕФвРРЕЁЂЛљДЁЖМЪЧвЛбљЕФ,ВЂЧвЛЗОГЕФздЖЏЛЏРЉШнЁЂНЁПЕМьВщЁЂШнджЁЂЛжИДЖМЪЧШЋздЖЏЕФ,ДѓДѓМѕЩйСЫвђЮЊетРрЛљДЁЮЪЬтв§ЗЂЕФЙЪеЯЁЃвВгаПЩФмЙЋЫОвЕЮёЪЧгЩгкЗўЮёЦїхДЛњЁЂЭјТчЕШЮЪЬт,дьГЩЗўЮёВЛПЩгУ,ДЫРрЧщПіОљашвЊдЫЮЌШЫдБМАЪБШЅаоИД,ЖјШчНё,ПЩФмдкФуЪеЕНИцОЏаХЯЂЕФЪБКђ,k8s вбОАяФуЛжИДСЫЁЃ

дкУЛгаЪЙгУ k8s ЪБ,вЕЮёгІгУЕФРЉШнКЭЫѕШн,ЖМашвЊШЫЙЄШЅДІРэ,ДгВЩЙКЗўЮёЦїЁЂЩЯМмЁЂЕНВПЪ№вРРЕЛЗОГ,ВЛНіашвЊДѓСПЕФШЫСІЮяСІ,ЖјЧвЗЧГЃШнвздкжаМфЙ§ГЬГіЯжЮЪЬт,гжвЊЛЈЗбДѓСПЕФЪБМфШЅВщевЮЪЬтЁЃГЩЙІЩЯМмКѓ,ЛЙашвЊдкЧАЖЫЗДДњЖЫЬэМгЛђИУЗўЮёЦї,ЖјШчНё,ПЩвдРћгУ k8s ЕФЕЏадМЦЫу,вЛМќЪННјааРЉШнКЭЫѕШн,ВЛНіДѓДѓЬсИпСЫдЫЮЌаЇТЪ,ЖјЧвЛЙНкЪЁСЫВЛЩйЕФЗўЮёЦїзЪдД,ЬсИпСЫзЪдДРћгУТЪЁЃ

- ЖдгкЗДДњХфжУЗНУц,БШШчПЩФмФуВЂВЛЛс,ЛђепЖд nginx ЕФХфжУЙцдђВЂВЛЪьЯЄ,вЛаЉИпМЖЕФЙІФмФувВВЛЛсЪЕЯж,ЖјШчНё,РћгУ k8s ЕФ ingress МДПЩМђЕЅЕФЪЕЯжФЧаЉИДдгЕФТпМЁЃВЂЧввВВЛЛсдкгіЕН nginx ЩйМгвЛИіаБИмКЭЖрМгвЛИіаБИмЕФЮЪЬтЁЃ

- ЖдгкИКдиОљКтЗНУц,жЎЧАИКдиОљКтПЩФмЪЧ NginxЁЂLVSЁЂHAProxyЁЂF5 ЕШ,дЦЩЯПЩФмЪЧдЦЗўЮёЩЬЬсЙЉЕФВЛдкОљКтЛњжЦЁЃУПДЮЬэМгЩОГ§НкЕуЪБ,ЖМашвЊЪжЖЏШЅХфжУЧАЖЫИКдиОљКт,ЪжЖЏШЅЦЅХфКѓЖЫНкЕу,ЖјШчНё,ЪЙгУ k8sФкВПЕФ service ПЩвдЖЏЬЌЗЂЯжЪЕЯжздЖЏЙмРэНкЕу,ВЂЧвжЇГжздЖЏРЉШнЫѕШнЁЃжЎЧАгіЕНИпЗхСїСПЪБ,ОГЃЗўЮёЦїадФмВЛЙЛ,ашвЊСйЪБМгЗўЮёЦїУцЖдИпЗхСїСП,ЖјШчНёЖдгкИпадФм k8s МЏШКМгЩЯ serverless,ЛљБОЪЕЯжЮоашЙмРэ,здЖЏРЉШнЁЃ

- ЖдгкИпПЩгУЗНУц,k8s ЬьЩњЕФИпПЩгУЙІФм,ГЙЕзЪЭЗХСЫЫЋЪж,ЮоашдйШЅДДНЈИїРрИпПЩгУЙЄОпЁЂМьВтМьВщНХБОЁЃk8s жЇГжНјГЬНгПкМЖБ№ЕФНЁПЕМьВщ,ШчЗЂЯжНгПкГЌЪБЛђепЗЕЛижЕВЛе§ШЗ,ЛсздЖЏДІРэИУЮЪЬтЁЃ

- ЖдгкжаМфМўДюНЈЗНУц,ИљОнЖЈвхКУЕФзЪдДЮФМў,ПЩвдЪЕЯжУыМЖДюНЈИїРржаМфМўИпПЩгУМЏШК,ВЂЧвжЇГжвЛМќЪНРЉЫѕШн,Шч RedisЁЂRabbitMQЁЂZookeeper ЕШ,ВЂЧвДѓДѓМѕЩйСЫГіДэЕФИХТЪЁЃ

- ЖдгкгІгУЖЫПкЗНУц,ДЋЭГаавЕжа,вЛИіЗўЮёЦїПЩФмХмСЫКмЖрНјГЬ,УПИіНјГЬЖМгавЛИіЖЫПк,ашвЊШЫЮЊЕФШЅХфжУЖЫПк,ВЂЧвЛЙашвЊПМТЧЖЫПкГхЭЛЕФЮЪЬт,ШчЙћгаЗРЛ№ЧНЕФЛА,ЛЙашвЊХфжУЗРЛ№ЧН,дк k8s жа,ЖЫПкЭГвЛЙмРэЭГвЛХфжУ,УПИігІгУЕФЖЫПкЖМПЩЩшжУГЩвЛбљЕФ,жЎКѓЭЈЙ§ service НјааИКдиОљКт,ДѓДѓНЕЕЭСЫЖЫПкЙмРэЕФИДдгЖШКЭЖЫПкГхЭЛЁЃ

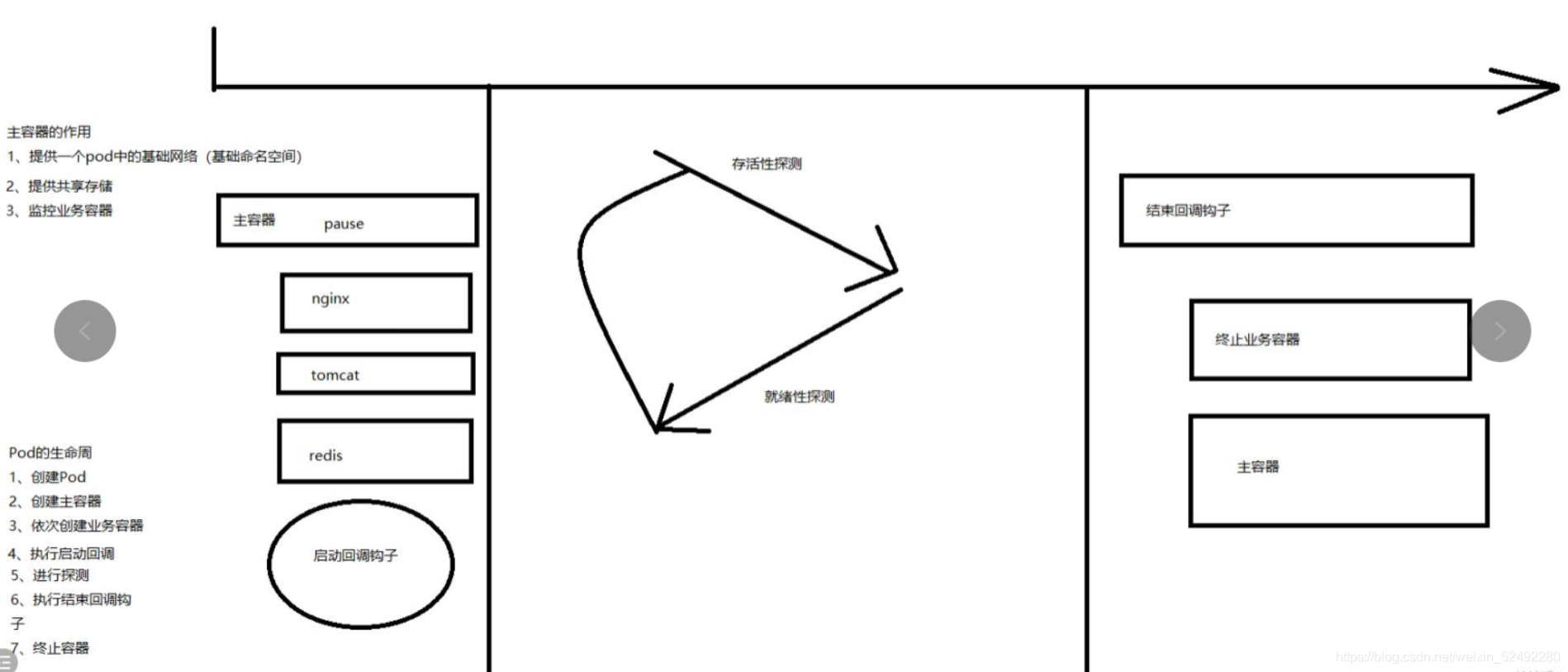

3.Pod

1ЁЂk8sМЏШКжаВПЪ№ЕФзюаЁЕЅдЊЁЃPodзюжївЊЕФЙІФмЙмРэЪЧНЋвЛИівЕЮёЛђепвЛИіЕїгУСДЕФЫљгаЗўЮё(ШнЦї)

2ЁЂpodЪЧk8sжазюаЁВПЪ№ЕЅдЊ,гУРДЙмРэвЛИіЕїгУСДЕФШнЦї,ЫќжЎжаЕФжїШнЦї(pause)ЮЊећИіЕїгУСДЕФШнЦїЬсЙЉЛљДЁЭјТч,ЙВЯэДцДЂ,МрПивЕЮёШнЦїЕФдЫаазДЬЌЁЃ

PodЪЧдкМЏШКжадЫааВПЪ№гІгУЛђЗўЮёЕФзюаЁЕЅдЊ,ЫћЪЧПЩвджЇГжКмЖрШнЦїЕФЁЃPodЕФЩшМЦРэФюЪЧжЇГжЖрИіШнЦїдквЛИіPodжаЙВЯэЭјТчЕижЗКЭЮФМўЯЕЭГ,ПЩвдЭЈЙ§НјГЬМфЭЈаХКЭЮФМўЙВЯэетжжМђЕЅИпаЇЕФЗНЪНзщКЯЭъГЩЗўЮёЁЃ

БШШч:ФудЫаавЛИіВйзїЯЕЭГЗЂааАцЕФШэМўВжПт,вЛИіnginxШнЦїгУРДЗЂВМШэМў,СэвЛИіШнЦїзЈУХгУРДДгдДВжПтзіЭЌВН,етСНИіШнЦїЕФОЕЯёВЛЬЋПЩФмЪЧвЛИіЭХЖгПЊЗЂЕФ,ЕЋЪЧЫћУЧвЛПщЙЄзїВХФмЬсЙЉвЛИіЮЂЗўЮё,етжжЧщПіЯТ,ВЛЭЌЕФЭХЖгИїздПЊЗЂЙЙНЈздМКЕФШнЦїОЕЯё,дкВПЪ№ЕФЪБКђзщКЯГЩвЛИіЮЂЗўЮёЖдЭтЬсЙЉЗўЮёЁЃетОЭЪЧk8sжаЕФPodЁЃ

# ФПЧАk8sжавЕЮёжївЊПЩвдЗжЮЊГЄЦкЫХЗўаЭ(long-running)ЁЂХњДІРэаЭ(batch)ЁЂНкЕуКѓЬЈжЇГХаЭ(node-daemon)КЭгазДЬЌгІгУаЭ(stateful application);ЗжБ№ЖдгІЕФаЁЛњЦїШЫПижЦЦїЮЊDeploymentЁЂJobЁЂDaemonSet КЭ StatefulSetЁЃ

1>PodЩњУќжмЦк

2>PodЪЧШчКЮЙмРэЖрИіШнЦїЕФ

PodжаПЩвдЭЌЪБдЫааЖрИіНјГЬ(зїЮЊШнЦїдЫаа)аЭЌЙЄзїЁЃ

ЭЌвЛИі Pod жаЕФШнЦїЛсздЖЏЕФЗжХфЕНЭЌвЛИі nodeЩЯЁЃЭЌвЛИі Pod жаЕФШнЦїЙВЯэзЪдДЁЂЭјТчЛЗОГКЭвРРЕ,ЫљвдЫќУЧзмЪЧБЛЭЌЪБЕїЖШЁЃдквЛИі Pod жаЭЌЪБдЫааЖрИіШнЦїЪЧвЛжжБШНЯИпМЖЕФгУЗЈЁЃжЛгаЕБФуЕФШнЦїашвЊНєУмХфКЯазїЕФЪБКђВХПМТЧгУетжжФЃЪНЁЃ

3>PodжаЪ§ОнГжОУад

Pod дкЩшМЦ?ГжОЭВЛЪЧзїЮЊГжОУЛЏЪЕЬхЕФЁЃдкЕїЖШЪЇАмЁЂНкЕуЙЪеЯЁЂШБЩйзЪдДЛђепНкЕуЮЌЛЄЕФзДЬЌЯТЖМЛсЫР

ЕєЛсБЛЧ§ж№ЁЃЭЈГЃ,ЮвУЧЪЧашвЊНшжњРрЫЦгк Docker ДцДЂОэетбљЕФзЪдДРДзі Pod ЕФЪ§ОнГжОУ

4>PodЕФзДЬЌ

# 1ЁЂЙвЦ№(Pending):

API Server ДДНЈСЫ pod зЪдДЖдЯѓвбДцШы etcd жа,ЕЋЫќЩаЮДБЛЕїЖШЭъГЩ,ЛђепШдДІгкДгВжПтЯТдиОЕЯёЕФЙ§ГЬжаЁЃ

# 2ЁЂдЫаажа(Running):

Pod вбОБЛЕїЖШжСФГНкЕу,ВЂЧвЫљгаШнЦїЖМвбОБЛ kubelet ДДНЈЭъГЩ

# 3ЁЂГЩЙІ(Succeeded):

Pod жаЕФЫљгаШнЦїЖМвбОГЩЙІжежЙВЂЧвВЛЛсБЛжиЦєЁЃ

# 4ЁЂЪЇАм(Failed):

Pod жаЕФЫљгаШнЦїЖМвбжежЙСЫ,ВЂЧвжСЩйгавЛИіШнЦїЪЧвђЮЊЪЇАмжежЙЁЃМДШнЦївдЗЧ 0 зДЬЌЭЫГіЛђепБЛЯЕЭГНћжЙЁЃ

# 5ЁЂЮДжЊ(Unknown):

Api Server ЮоЗЈе§ГЃЛёШЁЕН Pod ЖдЯѓЕФзДЬЌаХЯЂ,ЭЈГЃЪЧгЩгкЮоЗЈгыЫљдкЙЄзїНкЕуЕФkubelet ЭЈаХЫљжТЁЃ

# 6ЁЂImgPullErr :

ОЕЯёРШЁЪЇАм

# 7ЁЂContainerCreating :

ШнЦїДДНЈжа

5>PodЕФзЪдДЧхЕЅЯъНт

apiVersion:v1 #БибЁ,жИЖЈK8sВПЪ№ЕФAPIЕФАцБОКХ

kind:Pod #БибЁ,зЪдДРраЭPod

metadata: # БибЁ,МЧТМВПЪ№гІгУЕФдЊЪ§Он

name: nginx # БибЁ,ЗћКЯ RFC 1035 ЙцЗЖЕФ Pod УћГЦ

namespace: web-testing # ПЩбЁ,ВЛжИЖЈФЌШЯЮЊ default,Pod ЫљдкЕФУќУћПеМф

labels: # ПЩбЁ,БъЧЉбЁдёЦї,вЛАугУгк Selector

- app: nginx

annotations: # ПЩбЁ,зЂЪЭСаБэ

- app: nginx

spec: # БибЁ,гУгкВПЪ№ШнЦїЕФЯъЯИаХЯЂ

containers: # БибЁ,ШнЦїСаБэ

- name: nginx # БибЁ,ЗћКЯ RFC 1035 ЙцЗЖЕФШнЦїУћГЦ

image: nginx:v1 # БибЁ,ШнЦїЫљгУЕФОЕЯёЕФЕижЗ

imagePullPolicy: Always # ПЩбЁ,ОЕЯёРШЁВпТд

workingDir: /usr/share/nginx/html # ПЩбЁ,ШнЦїЕФЙЄзїФПТМ

volumeMounts: # ПЩбЁ,ДцДЂОэХфжУ

- name: webroot # ДцДЂОэУћГЦ

mountPath: /usr/share/nginx/html # ЙвдиФПТМ

readOnly: true # жЛЖС

ports: # ПЩбЁ,ШнЦїашвЊБЉТЖЕФЖЫПкКХСаБэ

- name: http # ЖЫПкУћГЦ

containerPort: 80 # ЖЫПкКХ

protocol: TCP # ЖЫПкавщ,ФЌШЯ TCP

env: # ПЩбЁ,ЛЗОГБфСПХфжУ

- name: TZ # БфСПУћ

value: Asia/Shanghai

- name: LANG

value: en_US.utf8

resources: # ПЩбЁ,зЪдДЯожЦКЭзЪдДЧыЧѓЯожЦ

limits: # зюДѓЯожЦЩшжУ

cpu: 1000m

memory: 1024MiB

requests: # ЦєЖЏЫљашЕФзЪдД

cpu: 100m

memory: 512MiB

readinessProbe: # ПЩбЁ,ШнЦїзДЬЌМьВщ

httpGet: # МьВтЗНЪН

path: / # МьВщТЗОЖ

port: 80 # МрПиЖЫПк

timeoutSeconds: 2 # ГЌЪБЪБМф

initialDelaySeconds: 60 # ГѕЪМЛЏЪБМф

livenessProbe: # ПЩбЁ,МрПизДЬЌМьВщ

exec: # МьВтЗНЪН

command:

- cat

- /health

httpGet: # МьВтЗНЪН

path: /_health

port: 8080

httpHeaders:

- name: end-user

value: jason

tcpSocket: # МьВтЗНЪН

port: 80

initialDelaySeconds: 60 # ГѕЪМЛЏЪБМф

timeoutSeconds: 2 # ГЌЪБЪБМф

periodSeconds: 5 # МьВтМфИє

successThreshold: 2 # МьВщГЩЙІЮЊ 2 ДЮБэЪООЭаї

failureThreshold: 1 # МьВтЪЇАм 1 ДЮБэЪОЮДОЭаї

securityContext: # ПЩбЁ,ЯожЦШнЦїВЛПЩаХЕФааЮЊ

provoleged: false

restartPolicy: Always # ПЩбЁ,ФЌШЯЮЊ Always

nodeSelector: # ПЩбЁ,жИЖЈ Node НкЕу

region: subnet7

imagePullSecrets: # ПЩбЁ,РШЁОЕЯёЪЙгУЕФ secret

- name: default-dockercfg-86258

hostNetwork: false # ПЩбЁ,ЪЧЗёЮЊжїЛњФЃЪН,ШчЪЧ,ЛсеМгУжїЛњЖЫПк

volumes: # ЙВЯэДцДЂОэСаБэ

- name: webroot # УћГЦ,гыЩЯЪіЖдгІ

emptyDir: {} # ЙВЯэОэРраЭ,Пе

hostPath: # ЙВЯэОэРраЭ,БОЛњФПТМ

path: /etc/hosts

secret: # ЙВЯэОэРраЭ,secret ФЃЪН,вЛАугУгкУмТы

secretName: default-token-tf2jp # УћГЦ

defaultMode: 420 # ШЈЯо

configMap: # вЛАугУгкХфжУЮФМў

name: nginx-conf

defaultMode: 420

================================================================================================

[root@k8s-m-01 ~]# kubectl explain pod.spec #ВщПДВЮЪ§

string : ИњзжЗћДЎ

Object :

[]Object :

- name

АИР§:

# ЪЕР§1:ВПЪ№nginxЁЂtomcatШнЦї

# kubectl explain Pod #ВщapiVersionАцБОКХ v1

[root@k8s-m-01 ~]# cat pod.yaml

apiVersion: v1

kind: Pod

metadata:

name: test-pod

spec:

containers:

- name: nginx

image: nginx

- name: tomcat

image: tomcat

# ЪЕР§2:ВПЪ№wordpress

# 1ЁЂnginx PHP MySQL

# 2ЁЂ жЦзїОЕЯё

# 3ЁЂДДНЈnginxХфжУЮФМў,ШЛКѓЙЙНЈОЕЯё

# 4ЁЂБраДХфжУЧхЕЅ,ВПЪ№

[root@k8s-m-01 ~]# vim wordpress.yaml

apiVersion: v1

kind: Pod

metadata:

name: wordpress

spec:

containers:

- name: nginx

image: nginx

- name: php

image: alvinos/php:v2-fpm-mysql

- name: mysql

image: mysql:5.7

env:

- name: MYSQL_ROOT_PASSWORD

value: "123"

# k8sВПЪ№вЛИіyamlЕФгІгУ:kubectl apply -f [ХфжУЧхЕЅ]

[root@k8s-m-01 ~]# kubectl apply -f pod.yaml

pod/test-pod create

ImgPullErr : ОЕЯёРШЁЪЇАм

ContainerCreating : ШнЦїДДНЈжа

6>PodЕФжиЦєВпТд

Pod жиЦєВпТд( RestartPolicy )гІгУгк Pod ФкЕФЫљгаШнЦї,ОЎЧвНідк Pod ЫљДІЕФ Node ЩЯгЩ kubelet НјааХаЖЯКЭжиЦєВйзїЁЃ

ЕБФГИіШнЦївьГЃЭЫГіЛђепНЁПЕМьВщЪЇАмЪБ, kubelet НЋИљОн RestartPolicy ЩшжУРДНјааЯргІЕФВйзїЁЃPod ЕФжиЦєВпТдАќРЈ:AlwaysЁЂOnFailure КЭ Never,ФЌШЯжЕЮЊ Always

# 1. Always: (ФЌШЯ)

ЕБШнЦїЪЇаЇЪБ,гЩ kubelet здЖЏжиЦєИУШнЦїЁЃ

# 2. OnFailure:

ЕБШнЦїжежЙдЫааЧвЭЫГіТыВЛЮЊ 0 ЪБ,гЩ kubelet здЖЏжиЦєИУШнЦї

# 3. Never:

ВЛТлШнЦїдЫаазДЬЌШчКЮ,kubelet ЖМВЛЛсжиЦєИУШнЦїЁЃ

kubelet жиЦєЪЇаЇШнЦїЕФЪБМфМфИєвд sync-frequency ГЫвд 2n РДМЦЫу;Р§Шч 1ЁЂ2ЁЂ4ЁЂ8 БЖЕШ,зюГЄбгЪБ5min ,ВЂЧвдкГЩЙІжиЦєКѓЕФ 10 min КѓжижУИУЪБМфЁЃ

Pod ЕФжиЦєВпТдгыПижЦЗНЪНЯЂЯЂЯрЙи,ЕБЧАПЩгУгкЙмРэ Pod ЕФПижЦЦїАќРЈ ReplicationControllerЁЂJobЁЂDaemonSet МАжБНгЭЈЙ§ kubelet ЙмРэ(ОВЬЌ Pod)ЁЃУПжжПижЦЦїЖд Pod ЕФжиЦєВпТдвЊЧѓШчЯТ:

# 1.RC КЭ DaemonSet:БиаыЩшжУЮЊ Always,ашвЊБЃжЄИУШнЦїГжајдЫааЁЃ

# 2.Job КЭ CronJob:OnFailure Лђ Never,ШЗБЃШнЦїжДааЭъГЩКѓВЛдйжиЦєЁЃ

# 3.kubelet:дк Pod ЪЇаЇЪБздЖЏжиЦєЫќ,ВЛТлНЋ RestartPolicy ЩшжУЮЊЪВУДжЕ,вВВЛЛсЖд Pod НјааНЁПЕМьВщЁЃ

Ш§ЁЂУћДЪНщЩм

1.k8sжаЕФУћГЦПеМф

k8sжаУћГЦПеМфЪЧгУРДИєРыМЏШКзЪдД,Жјk8sжаЕФзЪдДвВЗжЮЊУћГЦПеМфМЖзЪдДвдМАМЏШКМЖзЪдДЁЃ

mysql ПЭЛЇЖЫ kubectl

mysqld ЗўЮёЖЫ kubernetes

# kubectlЪЧk8sПЭЛЇЖЫ,ЫќИњk8sУЛгаШЮКЮЙиЯЕЁЃ

# kubectl get [зЪдДУћГЦ] ЛёШЁМЏШКзЪдДЕФУќСю

# 1ЁЂЛёШЁУћГЦПеМф

[root@k8s-m-01 ~]# kubectl get namespaces

NAME STATUS AGE

default Active 8d

kube-node-lease Active 8d

kube-public Active 8d

kube-system Active 8d

[root@k8s-m-01 ~]# kubectl get ns #МђаД

NAME STATUS AGE

default Active 8d

kube-node-lease Active 8d

kube-public Active 8d

kube-system Active 8d

# зЂ:ВПЪ№гІгУвЛАуЪЧВПЪ№дкздМКЕФУћГЦПеМфжЎФк

# 2ЁЂk8sжаЕФУќУћЙцЗЖ

1ЁЂБиаыаЁаД

2ЁЂБиаывдзжФИПЊЭЗ

3ЁЂУћГЦЕБжажЛФмЙЛАќКЌзжФИЁЂЪ§зжКЭжаЛЎЯп(-)

[root@k8s-m-01 ~]# kubectl create namespace wordpress # ДДНЈУќУћПеМф

namespace/wordpress created

2ЁЂnamespace

namespaceЪЧУќУћПеМф,гУРДзіМЏШКзЪдДИєРыЕФ(вЕФкФЌШЯЕФБъзМ,вЛИіЮЂЗўЮёвЛИіnamespace)

k8sМЏШКжа:

1ЁЂМЏШКМЖзЪдД:ЫљгаУќУћПеМфЖМФмЙЛЪЙгУ

2ЁЂУќУћПеМфМЖзЪдД:жЛФмдкЭЌвЛИіУќУћПеМфФкЪЙгУ

3ЁЂLabelБъЧЉ

БъЧЉПЩвдГЦжЎЮЊзЪдДЕФБъЪО,вЛАугУгкЗЂЯжзЪдД

вЛИіLabelЪЧвЛИіkey=valueЕФМќжЕЖд,ЦфжаkeyгыvalueгЩгУЛЇздМКжИЖЈЁЃ

LabelПЩвдИНМгЕНИїжжзЪдДЖдЯѓЩЯ,Р§ШчNodeЁЂPodЁЂServiceЁЂRC ЕШ,вЛИізЪдДЖдЯѓПЩвдЖЈвхШЮвтЪ§СПЕФ Label,ЭЌвЛИі Label вВПЩвдБЛЬэМгЕНШЮвтЪ§СПЕФзЪдДЖдЯѓЩЯШЅ,Label ЭЈГЃдкзЪдДЖдЯѓЖЈвхЪБШЗЖЈ,вВПЩвддкЖдЯѓДДНЈКѓЖЏЬЌЬэМгЛђепЩОГ§ЁЃ

- 1ЁЂАцБОБъЧЉ:ЁАreleaseЁБ : ЁАstableЁБ , ЁАreleaseЁБ : ЁАcanaryЁБ

- 2ЁЂЛЗОГБъЧЉ:ЁАenvironmentЁБ : ЁАdevЁБ , ЁАenvironmentЁБ : ЁАproductionЁБ

- 3ЁЂМмЙЙБъЧЉ:ЁАtierЁБ : ЁАfrontendЁБ , ЁАtierЁБ : ЁАbackendЁБ , ЁАtierЁБ : ЁАmiddlewareЁБ

- 4ЁЂЗжЧјБъЧЉ:ЁАpartitionЁБ : ЁАcustomerAЁБ , ЁАpartitionЁБ : ЁАcustomerBЁБ

- 5ЁЂжЪСПЙмПиБъЧЉ:ЁАtrackЁБ : ЁАdailyЁБ , ЁАtrackЁБ : ЁАweeklyЁБ

# dockerжаЕФTAG = ВжПтURL/УћГЦПеМф/ВжПтУћГЦ:АцБОКХ

# k8sЕБзіБъЧЉЪЧгУРДЙмРэ(ЪЖБ№вЛЯЕСа)ШнЦї,ЗНБугыЙмРэКЭМрПигЕгаЭЌвЛБъЧЉЕФЫљгаШнЦї #БъЧЉЪЧжИpod,ЕЋЪЧpodЪЧЙмРэШнЦїЕФ

[root@k8s-m-01 ~]# vim tag.yaml

apiVersion: v1

kind: Pod

metadata:

name: test-tag

labels:

release: stable

spec:

containers:

- name: nginx

image: nginx

# 1ЁЂВщПДlabel

[root@k8s-m-01 ~]# kubectl get pod --show-labels

NAME READY STATUS RESTARTS AGE LABELS

test-tag 1/1 Running 0 67s release=stable

# 2ЁЂдіМгБъЧЉ

kubectl label pod(зЪдДРраЭ) test-tag app=tag

[root@k8s-m-01 ~]# kubectl label pod test-tag app=tag

pod/test-tag labeled

[root@k8s-m-01 ~]# kubectl get pod --show-labels

NAME READY STATUS RESTARTS AGE LABELS

test-tag 0/1 ImagePullBackOff 0 2m15s app=tag,release=stable

# 3ЁЂЩОГ§БъЧЉ

[root@k8s-m-01 ~]# kubectl label pod test-tag app-

pod/test-tag labeled

# 4ЁЂВщПДБъЧЉ

[root@k8s-m-01 ~]# kubectl get pod --show-labels

NAME READY STATUS RESTARTS AGE LABELS

test-tag 1/1 Running 0 7m53s release=stable

# 5ЁЂаоИФБъЧЉ

## ЯШЩОГ§КѓдіМг

kubectl label pod test-tag app=tag release-

kubectl label pod test-tag app=tag release=bate

# 6ЁЂАцБО

stable ЮШЖЈАцБО

beta ЙЋВтАцБО

alpha ФкВтАцБО

=================================================================================

# ВщПДзЪдДБъЧЉБъЧЉ

kubectl get deployment --show-labels

# ДДНЈБъЧЉ

kubectl label [зЪдДРраЭ] [зЪдДУћ] [key=value]

# ЩОГ§БъЧЉ

kubectl label [зЪдДРраЭ] [зЪдДУћ] key-

3.k8sжаГЃгУУќСю

# 1.ЛёШЁзЪдД

kubectl get [зЪдДУћГЦ]

[root@k8s-m-01 ~]# kubectl get pod

NAME READY STATUS RESTARTS AGE

test 1/1 Running 1 6d

# 2.ДДНЈзЪдД

kubectl apply [зЪдДРраЭ] [зЪдДУћГЦ]

kubectl apply -f [зЪдДЧхЕЅЕФТЗОЖ]

[root@k8s-m-01 ~]# vim tag.yaml

[root@k8s-m-01 ~]# kubectl apply -f tag.yaml

4.ПижЦЦї

k8sжаПижЦЦїЗжЮЊ:deploymentЁЂDaemonSetЁЂStatufluset

ПижЦЦїЪЧгУРДЙмРэPod

# 1ЁЂDeployment:вЛАугУРДВПЪ№ГЄЦкдЫааЕФЁЂЮозДЬЌЕФгІгУ

ЬиЕу:МЏШКжЎжа,ЫцЛњВПЪ№

# 2ЁЂDaemonSet:УПвЛИіНкЕуЩЯВПЪ№вЛИіPod,ЩОГ§НкЕуздЖЏЩОГ§ЖдгІЕФPOD(zabbix-agent)

ЬиЕу:УПвЛЬЈЩЯгаЧвжЛгавЛЬЈ

# 3ЁЂStatudfluSet: ВПЪ№газДЬЌгІгУ

ЬиЕу:гаЦєЖЏЫГађ

ПижЦЦїЪЙгУРДзіЪВУДЕФ?

- ЙмРэPod

# Deploymnet:

дкDeploymentЖдЯѓжаУшЪіЫљашЕФзДЬЌ,ШЛКѓDeploymentПижЦЦїНЋЪЕМЪзДЬЌвдЪмПиЕФЫйТЪИќИФЮЊЫљашЕФзДЬЌЁЃ

1)deployment(ВПЪ№ГЄЦкдЫааЁЂЮозДЬЌгІгУ)

# 1ЁЂdeployment:дкdeploymentЖдЯѓжаУшЪіЫљашзДЬЌ,ШЛКѓdeploymentПижЦЦїНЋЪЕМЪзДЬЌвдЪмПиЕФЫйТЪИќИФЮЊЫљашЕФзДЬЌ(здгњ)

вЛАугУРДВПЪ№ГЄЦкдЫааЕФ,ЮозДЬЌЕФгІгУ(ЖдЦєЖЏЫГађУЛгавЊЧѓЕФ(php nginx))

змНс:жївЊЙІФмЪЧБЃжЄгазуЙЛЕФPodе§ГЃЖдЭтЬсЙЉЗўЮё

ЬиЕу:МЏШКжЎжа,ЫцЛњВПЪ№

# 2ЁЂДДНЈdeployment.yaml

[root@k8s-m-01 ~]# vim deployment.yaml

apiVersion: apps/v1 # kubectl explain deploymentВщПДdeploymentАцБОКХ:apps/v1

kind: Deployment #РраЭ

metadata: #дЊЪ§Он

name: deployment #deploymentЕФУћГЦ

spec: #ЖЈвхШнЦїЕФЯъЯИаХЯЂ

replicas: 1 #ДДНЈPodЕФИББОЪ§(ФЌШЯ)

selector: #БъЧЉбЁдёЦї:ЖЈвхDeployment ШчКЮевЕНвЊЙмРэЕФ Pod,гы template ЕФ label(БъЧЉ)ЖдгІ

matchLabels: #ОЋШЗЦЅХф

release: stable #ЖдгІPodБъЧЉ

template: #ДДНЈPodЕФФЃАх---------вдЯТЪЧPodаХЯЂ

metadata: #PodдЊЪ§Он

name: test-tag #PodУћГЦ(ПЩВЛЖЈвх,ЫцЛњЩњГЩ)

labels: #БъЧЉ

release: stable

spec: #ЖЈвхШнЦїЯъЯИаХЯЂ

containers: #ШнЦїСаБэ

- name: nginx

image: nginx

# 3ЁЂДДНЈdeployment

[root@k8s-m-01 ~]# kubectl apply -f deployment.yaml #ДДНЈdeployment

deployment.apps/deployment created

[root@k8s-m-01 ~]# kubectl get deployment #ВщПДdeployment

NAME READY UP-TO-DATE AVAILABLE AGE

deployment 1/1 1 1 51s

# 4ЁЂВщПДpods

[root@k8s-m-01 ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

deployment-7bf4d6cd75-nxsjg 1/1 Running 0 2m24s

test-tag 1/1 Running 0 41m

# 5ЁЂЩОГ§deployment

[root@k8s-m-01 ~]# kubectl delete pod deployment-7bf4d6cd75-nxsjg

# 6ЁЂжиаТВщПДpods

[root@k8s-m-01 ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

deployment-7bf4d6cd75-cm2jn 1/1 Running 0 21s

test-tag 1/1 Running 0 42m

# 7ЁЂВщПДВПЪ№ЯъЧщ

[root@k8s-m-01 ~]# kubectl describe deployments.apps

Name: deployment

Namespace: default

CreationTimestamp: Sat, 24 Jul 2021 10:52:32 +0800

Labels: <none>

Annotations: deployment.kubernetes.io/revision: 1

Selector: release=stable

Replicas: 1 desired | 1 updated | 1 total | 1 available | 0 unavailable

StrategyType: RollingUpdate

MinReadySeconds: 0

RollingUpdateStrategy: 25% max unavailable, 25% max surge

Pod Template:

Labels: release=stable

Containers:

nginx:

Image: nginx

Port: <none>

Host Port: <none>

Environment: <none>

Mounts: <none>

Volumes: <none>

Conditions:

Type Status Reason

---- ------ ------

Available True MinimumReplicasAvailable

Progressing True NewReplicaSetAvailable

OldReplicaSets: <none>

NewReplicaSet: deployment-7bf4d6cd75 (1/1 replicas created)

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal ScalingReplicaSet 75s deployment-controller Scaled up replica set deployment-7bf4d6cd75 to 1

1>ЕЏадРЉШнЕФ3жжЗНЗЈ

# 1.аоИФХфжУЧхЕЅ

[root@k8s-m-01 ~]# kubectl edit deployments deployment #ЭЦМі

# deploymentsЪЧзЪдДРраЭ зЪдДУћГЦЪЧdeployment

spec:

progressDeadlineSeconds: 600

replicas: 10 # аоИФетИіВЮЪ§

revisionHistoryLimit: 10

selector:

matchLabels:

release: stable

[root@k8s-m-01 ~]# kubectl get pods -w #МрПиpodзДЬЌ(здЖЏДДНЈ10Иі)

NAME READY STATUS RESTARTS AGE

deployment-7bf4d6cd75-cm2jn 1/1 Running 0 6m59s

test-tag 1/1 Running 0 48m

deployment-7bf4d6cd75-c25tl 0/1 Pending 0 0s

deployment-7bf4d6cd75-c25tl 0/1 Pending 0 0s

deployment-7bf4d6cd75-vvgff 0/1 Pending 0 0s

deployment-7bf4d6cd75-ghlvr 0/1 Pending 0 0s

deployment-7bf4d6cd75-j7zpk 0/1 Pending 0 0s

deployment-7bf4d6cd75-ck57d 0/1 Pending 0 0s

deployment-7bf4d6cd75-tk6sw 0/1 Pending 0 0s

deployment-7bf4d6cd75-8kljt 0/1 Pending 0 0s

deployment-7bf4d6cd75-vvgff 0/1 Pending 0 0s

deployment-7bf4d6cd75-ghlvr 0/1 Pending 0 0s

#2.УќСюааДђБъЧЉ

[root@k8s-m-01 ~]# kubectl patch deployments.apps deployment -p '{"spec":{"replicas":4}}' #здЖЏЫѕШнЕН4ЬЈ-

# deployments.apps зЪдДШЋГЦ

deployment.apps/deployment patched

[root@k8s-m-01 ~]# kubectl get pods -w #ЪЕЪБМрПи

NAME READY STATUS RESTARTS AGE

deployment-7bf4d6cd75-cm2jn 1/1 Running 0 11m

deployment-7bf4d6cd75-j7zpk 1/1 Running 0 4m21s

deployment-7bf4d6cd75-mrlj7 1/1 Running 0 4m21s

deployment-7bf4d6cd75-tk6sw 1/1 Running 0 4m21s

test-tag 1/1 Running 0 53m

[root@k8s-m-01 ~]# kubectl patch deployments.apps deployment -p '{"spec":{"replicas":40}}' #здЖЏРЉШнЕН40ЬЈ

deployment.apps/deployment patched

# 3.scale

[root@k8s-m-01 ~]# kubectl scale deployment/deployment --replicas=2

# зЪдДРраЭ/зЪдДУћГЦ

deployment.apps/deployment scaled

[root@k8s-m-01 ~]# kubectl get pods #ВщПДpods

NAME READY STATUS RESTARTS AGE

deployment-7bf4d6cd75-cm2jn 1/1 Running 0 14m

deployment-7bf4d6cd75-j7zpk 1/1 Running 0 7m36s

test-tag 1/1 Running 0 56m

2>ИќаТ(ЪзЯШвЊДцдкЕЭАцБОВХПЩвдИќаТ)

# 1.БрМdjango.yaml(ЛљДЁАцБО)

[root@k8s-m-01 ~]# vi djiaogo.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: django

spec:

replicas: 1

selector:

matchLabels:

app: stable

template:

metadata:

labels:

app: stable

spec:

containers:

- name: nginx1

image: nginx:1.17.10

#2.ДДНЈPod

[root@k8s-m-01 ~]# kubectl apply -f django.yaml

deployment.apps/django created

# 1ЁЊМрПижа (ЛёШЁpodid)

[root@k8s-m-01 ~]# kubectl get pods -w

NAME READY STATUS RESTARTS AGE

deployment-7bf4d6cd75-cm2jn 1/1 Running 0 18m

test-tag 1/1 Running 0 60m

django-54bb9d4cd6-m6pgm 0/1 Pending 0 0s

django-54bb9d4cd6-m6pgm 0/1 Pending 0 0s

django-54bb9d4cd6-m6pgm 0/1 ContainerCreating 0 0s

# 2-НјШыШнЦїВщПДАцБОКХ

[root@k8s-m-01 ~]# kubectl exec -it django-54bb9d4cd6-m6pgm --

root@django-54bb9d4cd6-m6pgm:/# nginx -v

nginx version: nginx/1.17.10

# 3.ИќаТОЕЯё

ЗНЪНвЛ:ДђБъЧЉ

## ДђБъЧЉ

[root@k8s-m-01 ~]# kubectl patch deployments.apps django -p '{"spec":{"template":{"spec":{"containers":[{"image":"nginx:1.18.0", "name":"nginx"}]}}}}'

deployment.apps/django patched

# бщжЄ

[root@k8s-m-01 ~]# kubectl exec -it django-6c5b55f69f-qnb6d --

Defaulted container "nginx" out of: nginx, nginx1

root@django-6c5b55f69f-qnb6d:/# nginx -v

nginx version: nginx/1.18.0

ЗНЪНЖў:аоИФХфжУЧхЕЅ

# аоИФХфжУЧхЕЅ

[root@k8s-m-01 ~]# vim django.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: django

spec:

replicas: 1

selector:

matchLabels:

app: stable

template:

metadata:

labels:

app: stable

spec:

containers:

- name: nginx

image: nginx:1.19.9

##бщжЄ

[root@k8s-m-01 ~]# kubectl exec -it deployment-5849786498-6zpws --

root@deployment-5849786498-6zpws:/# nginx -v

nginx version: nginx/1.19.9

ЗНЪНШ§:

##ЩшжУОЕЯё(жиЕу)

[root@k8s-m-01 ~]# kubectl set image deployment/django nginx=nginx:1.16.0

##бщжЄ

[root@k8s-m-01 ~]# kubectl exec -it django-65b6bd487f-qtrv9 --

Defaulted container "nginx" out of: nginx, nginx1

root@django-65b6bd487f-qtrv9:/# nginx -v

nginx version: nginx/1.16.0

ЗНЪНЫФ:

## edit

[root@k8s-m-01 ~]# kubectl edit deployment.apps django

template:

metadata:

creationTimestamp: null

labels:

app: stable

spec:

containers:

- image: nginx:1.19.0 #аоИФАцБОКХ

imagePullPolicy: IfNotPresent

name: nginx

resources: {}

terminationMessagePath: /dev/termination-log

terminationMessagePolicy: File

##бщжЄ

[root@k8s-m-01 ~]# kubectl exec -it django-65c9b58dfb-zwg6z --

Defaulted container "nginx" out of: nginx, nginx1

root@django-65c9b58dfb-zwg6z:/# nginx -v

nginx version: nginx/1.19.0

3>ЛиЙі

# 1ЁЂВщПДзЪдДРњЪЗ

[root@k8s-m-01 ~]# kubectl rollout history deployment django

deployment.apps/django

REVISION CHANGE-CAUSE

1 <none>

2 <none>

3 <none>

4 <none>

5 <none>

6 <none>

7 <none>

# 2ЁЂЛиЙіЕНЩЯвЛМЖ

[root@k8s-m-01 ~]# kubectl rollout undo deployment django

deployment.apps/django

REVISION CHANGE-CAUSE

1 <none>

2 <none>

3 <none>

4 <none>

5 <none>

8 <none>

9 <none>

зЂ:ФПЧАЪЧЕНЕк7МЖ,ЛиЙіЪЧЛиЙіЕН6,ЛиЙіКѓ7ВЛЯдЪО,ЯдЪОГЩ6,6гы7ФкШнвЛбљ

# 3ЁЂЛиЙіжИЖЈАцБО

[root@k8s-m-01 ~]# kubectl rollout undo deployment django --to-revision=1

deployment.apps/django rolled back

[root@k8s-m-01 ~]# kubectl rollout history deployment django

deployment.apps/django

REVISION CHANGE-CAUSE

2 <none>

3 <none>

4 <none>

5 <none>

8 <none>

9 <none>

10 <none>

зЂ:ЛиЙіЕН1АцБО,1ВЛеЙЪО,БфГЩ10

2)DaemonSet(вЛАугУРДМрПиЁЂЪеМЏШежО)

дкМЏШКжаЫљгаЕФНкЕуЩЯВПЪ№жЛВПЪ№вЛИіPod

# дкМЏШКжаЫљгаЕФНкЕуЩЯВПЪ№жЛВПЪ№вЛИіPod,ЩОГ§НкЕуздЖЏЩОГ§ЖдгІЕУPod

# ЬиЕу:УПЬЈЩЯгаЧвжЛгавЛИі

[root@k8s-m-01 ~]# vim zabbix-agent.yaml

apiVersion: apps/v1 #kubectl explain DaemonSet ВщПДАцБОКХ

kind: DaemonSet

metadata:

name: zabbix-agent

spec:

selector:

matchLabels:

app: zabbix-agent

template:

metadata:

labels:

app: zabbix-agent

spec:

containers:

- name: zabbix-agent

image: zabbix/zabbix-agent:5.2.6-centos

[root@k8s-m-01 ~]# kubectl apply -f zabbix-agent.yaml

# ИќаТ

1ЁЂаоИФХфжУЮФМў

[root@k8s-m-01 ~]# kubectl edit daemonsets.apps zabbix-agent

spec:

containers:

- image: zabbix/zabbix-agent:centos-5.2.5 #аоИФАцБО

daemonset.apps/zabbix-agent edited

2ЁЂДђБъЧЉЕФЗНЪН

[root@k8s-m-01 ~]# kubectl patch daemonsets.apps zabbix-agent -p '{"spec":{"template":{"spec":{"containers":[{"image":"zabbix/zabbix-agent:centos-5.2.4", "name":"zabbix-agent"}]}}}}'

daemonset.apps/zabbix-agent patched

3ЁЂЩшжУОЕЯё

[root@k8s-m-01 ~]# kubectl set image daemonset/zabbix-agent zabbix-agent=zabbix/zabbix-agent:centos-5.2.3

daemonset.apps/zabbix-agent image updated

4ЁЂВщПДМЧТМ

[root@k8s-m-01 ~]# kubectl rollout history daemonset zabbix-agent

daemonset.apps/zabbix-agent

REVISION CHANGE-CAUSE

1 <none>

2 <none>

3 <none>

4 <none>

## ЛиЙіЕНЩЯвЛИіАцБО

[root@k8s-m-01 ~]# kubectl rollout history daemonset zabbix-agent

daemonset.apps/zabbix-agent

REVISION CHANGE-CAUSE

1 <none>

2 <none>

4 <none>

5 <none>

## ЛиЙіЕНжИЖЈАцБО

[root@k8s-m-01 ~]# kubectl rollout undo daemonset zabbix-agent --to-revision=1

daemonset.apps/zabbix-agent rolled back

3)РЉеЙ

# 1ЁЂk8s-m-01НкЕужДаа

[root@k8s-m-01 ~]# kubectl get nodes # masterМрПи

NAME STATUS ROLES AGE VERSION

k8s-m-01 Ready control-plane,master 8d v1.21.2

k8s-n-01 Ready <none> 8d v1.21.2

k8s-n-02 Ready <none> 11s v1.21.2

[root@k8s-m-01 ~]# kubectl delete nodes k8s-n-02 #ЩОГ§k8s-n-02НкЕу

node "k8s-n-02" deleted

[root@k8s-m-01 ~]# kubectl get nodes

NAME STATUS ROLES AGE VERSION

k8s-m-01 Ready control-plane,master 8d v1.21.2

k8s-n-01 Ready <none> 8d v1.21.2

# 2ЁЂk8s-n-2НкЕужДаа

[root@k8s-n-02 ~]# kubeadm reset

[root@k8s-n-02 ~]# rm -rf /etc/kubernetes/

# 3ЁЂk8s-m-01НкЕуЩњГЩtoken

[root@k8s-m-01 ~]# kubeadm token create --print-join-command

kubeadm join 192.168.15.111:6443 --token uqvjwm.lr9e35a0brzl1r9f --discovery-token-ca-cert-hash sha256:e9a22201e9fb0575a7281b42c53377c119880e0aca5217a7134fe474e5cd7422

# 4ЁЂk8s-n-02НкЕужиаТМгШыМЏШК

[root@k8s-n-02 ~]# kubeadm join 192.168.15.111:6443 --token uqvjwm.lr9e35a0brzl1r9f --discovery-token-ca-cert-hash sha256:e9a22201e9fb0575a7281b42c53377c119880e0aca5217a7134fe474e5cd7422

# 5ЁЂжиаТВщПДmasterНкЕуМрПи

[root@k8s-m-01 ~]# kubectl get nodes

NAME STATUS ROLES AGE VERSION

k8s-m-01 Ready control-plane,master 8d v1.21.2

k8s-n-01 Ready <none> 8d v1.21.2

k8s-n-02 Ready <none> 11s v1.21.2