Ŀ ¼

- ǰ��

- һ��etcd��Ⱥ������

- ����docker��Ⱥ����

- ����flannel��Ⱥ����

- �ġ�����master�ڵ�

- �塢node�ڵ�IJ���

- �� ��kubelet��kube-proxy������node01�ڵ�

- �� �ϴ�Nodeѹ����

- �� ��������Kubelet�������ļ���Ŀ¼

- �� ����bootstrap��ɫ����Ȩ����������apiserver����ǩ��(�ؼ�)(master01�ϲ���)

- �� ִ��kubelet.sh�ű�(��node01�ڵ��ϲ���)

- �� ��鵽node01�ڵ������(master01�ϲ���)

- �� �鿴֤��(node01��)

- �� �鿴maser01Ⱥ���ڵ�,�ɹ�����node01�ڵ�

- �� ����ip_vsģ��(node01��02)

- �� ����proxy����(node01)

- ��node01�е������ļ����Ƶ�node02(��node01�ϲ���)

- ִ��(node02�ϲ���)

- ����kube-proxy

- �鿴��Ⱥ�ڵ�

ǰ��

����k8s����ʽ

��Minikube

Minikube��һ������,�����ڱ��ؿ�������һ�����ڵ���K8S,������ѧϰ��Ԥ��K8S��һЩ����ʹ�á�

�����ַ: https://kubernetes. io/docs/setup/minikube

��Kubeadmin

KubeadminҲ��һһ��:����,�ṩkubeadm init�� kubeadm join,���ڿ��ٲ���K8S��Ⱥ,��Լ�

https://kubernetes. io/decs/referencel/setup-toels/kubeadm/kubeadm/

������ư�װ����

������ѡ,�ӹٷ����ط��а�Ķ����ư�,�ֶ�����ÿ���������ǩTLS֤��,���K8S��Ⱥ,�����Ƽ���

https: //github. com/kubernetes/kubernetes/releases

һ��etcd��Ⱥ������

1��etcd�ĸ���

etcd��Coreos�Ŷ���2013��6�·���Ŀ�Դ��Ŀ,����Ŀ���ǹ���һ���߿��õķֲ�ʽ��ֵ( key-value)���ݿ���etcd�ڲ�����raftЭ����Ϊһ�����㷨,etcd��go���Ա�д�ġ�

2��etcd���ص�

- ��

��װ���ü�,�����ṩ��HTTP APr���н���,ʹ��Ҳ�ܼ� - ��ȫ

֧��sSL֤����֤�� - ����

��ʵ��֧��ÿ��2k+������ - �ɿ�

����raft�㷨,ʵ�ֲַ�ʽϵͳ���ݵĿ����Ժ�һ����

etcd ĿǰĬ��ʹ��2379�˿��ṩHTTP API����,2380�˿ں�peerͨ��(�������˿��Ѿ���IANA(���������ַ������)�ٷ�Ԥ����etcd)����etcdĬ��ʹ��2379�˿ڶ���Ϊ�ͻ����ṩͨѶ,ʹ���˿�12380�����з��������ڲ�ͨѶ��etcd������������һ���Ƽ���Ⱥ��ʽ��������etcd ��leaderѡ�ٻ���,Ҫ������Ϊ3̨�����ϵ�����̨��

3����ǩ��֤�黷��

CFSSL�� cloudFlare��˾��Դ��һ�� PKI/TLS ���ߡ�CPSSl����һ�������й��ߺ�һ������ǩ������֤������"TLs ֤���wrreAPI ����ʹ��Go���Ա�д��

CFSSIʹ�������ļ�����֤��,�����ǩ֮ǰ,��Ҫ������ʶ��� json ��ʽ�������ļ�,cFSS���ṩ�˷�������������������ļ���

CFSS����Ϊetcd�ṩTLS ֤��,��֧��ǩ�������͵�֤��:

- client ֤��,��������ӿͻ���ʱЯ����֤��,���ڿͻ�����֤���������,�� kube-apiserver���� etcd;

- server ֤��,�ͻ������ӷ����ʱЯ����֤��,���ڷ������֤�ͻ�������,�� etcd �����ṩ����;

- peer ֤��,�֮������ʱʹ�õ�֤��,��etcd �ڵ�֮�������֤��ͨ�š�

����ȫ����ʹ����һ��֤����֤��

������:

| ���� | ����ϵͳ | IP��ַ | ����/���� |

|---|---|---|---|

| master | CentOS7 | 192.168.217.40 | kube-apiserver kube-controller-manager kube-scheduler etcd |

| node1 | CentOS7 | 192.168.217.50 | kubelet kube-proxy docker flannel |

| node2 | CentOS7 | 192.168.217.60 | kubelet kube-proxy docker flannel |

�� ����ϵͳ��ʼ��

# 1���رշ���ǽ

systemctl stop firewalld

systemctl disable firewalld

# 2���ر�selinux

sed -i 's/enforcing/disabled/' /etc/selinux/config #���ùر�

setenforce 0 #��ʱ�ر�

# 3���ر�swap

swapoff -a #��ʱ�ر�

sed -ri 's/.*swap.*/#&/' /etc/fstab #���ùر�

# 4�����ݹ滮����������

hostnamectl set-hostname <������> #��������

hostname #�鿴������

# 5����master�ڵ�������hosts (IP���������hostname)

cat >> /etc/hosts << EOF

192.168.217.40 k8s-master

192.168.217.50 k8s-node1

192.168.217.60 k8s-node2

EOF

# 6�����Žӵ�IPv4�������ݵ�iptables����

cat > /etc/sysctl.d/k8s.conf <<EOF

net.bridge.bridge�\nf�\call�\ip6tables=1

net.bridge.bridge�\nf�\call�\iptables=1

EOF

sysctl --system #��Ч

# 7��ʱ��ͬ��

yum install ntpdate -y

ntpdate time.windows.com

����master�ڵ��ϲ���etcd

��master01 �ڵ��ϲ���(192.168.217.40)

//����֤����������

wget https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -O /usr/local/bin/cfssl

wget https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -O /usr/1ocal/bin/cfssljson

wget https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -O /usr/local/bin/cfssl-certinfo

��

curl -L https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -O /usr/ local/bin/cfssl

curl -L https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -O /usr/local/bin/cfssljson

curl -L https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -O /usr/local/bin/cfssl-certinfo

chmod +x /usr/local/bin/cfssl*

#master����

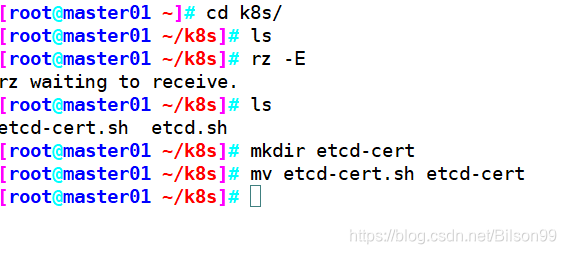

mkdir /opt/k8s

cd /opt/k8s/

//�ϴ�etcd-cert.sh ��etcd.sh ��/opt/k8s/Ŀ¼��

chmod +x etcd-cert.sh

//������������CA֤�顢etcd������֤���Լ�˽Կ��Ŀ¼

mkdir /opt/k8s/etcd-cert

mv etcd-cert.sh etcd-cert/

cd /opt/k8s/etcd-cert/

./etcd-cert.sh

#����CA֤�顢etcd������֤���Լ�˽Կ

#����֤����������

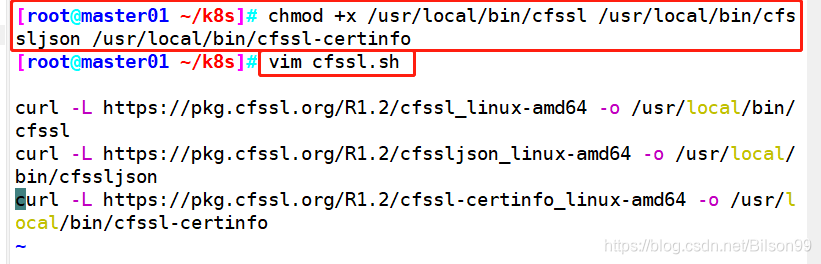

[root@localhost k8s]# vim cfssl.sh

curl -L https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -o /usr/local/bin/cfssl

curl -L https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -o /usr/local/bin/cfssljson

curl -L https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -o /usr/local/bin/cfssl-certinfo

chmod +x /usr/local/bin/cfssl /usr/local/bin/cfssljson /usr/local/bin/cfssl-certinfo

#����cfssl�ٷ���

[root@localhost k8s]# bash cfssl.sh

[root@localhost k8s]# ls /usr/local/bin/

cfssl cfssl-certinfo cfssljson

//��ʼ����֤��

//cfssl ����֤�鹤�� cfssljsonͨ������json�ļ�����֤��

cfssl-certinfo�鿴֤����Ϣ

#����ca֤��

[root@localhost etcd-cert]# cat > ca-config.json <<EOF

{

"signing": {

"default": {

"expiry": "87600h"

},

"profiles": {

"www": {

"expiry": "87600h",

"usages": [

"signing",

"key encipherment",

"server auth",

"client auth"

]

}

}

}

}

EOF

#ʵ��֤��ǩ��

[root@localhost etcd-cert]# cat > ca-csr.json <<EOF

{

"CN": "etcd CA",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "Beijing",

"ST": "Beijing"

}

]

}

EOF

#����֤��,����ca-key.pem ca.pem

[root@localhost etcd-cert]# cfssl gencert -initca ca-csr.json | cfssljson -bare ca -

#ָ��etcd�����ڵ�֮���ͨ����֤

[root@localhost etcd-cert]# cat > server-csr.json <<EOF

{

"CN": "etcd",

"hosts": [

"192.168.217.40",

"192.168.217.50",

"192.168.217.60"

],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "BeiJing",

"ST": "BeiJing"

}

]

}

EOF

#�����ļ�,�����ļ�,֤������ETCD֤�� server-key.pem server.pem

[root@localhost etcd-cert]# cfssl gencert -ca=ca.pem -ca-key=ca-key.pem -config=ca-config.json -profile=www server-csr.json | cfssljson -bare server

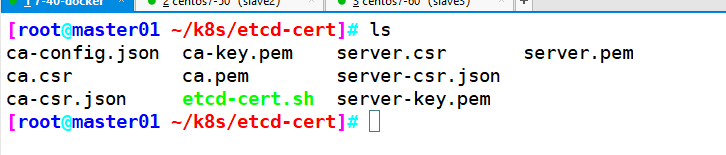

[root@localhost etcd-cert]# ls

ca-config.json etcd-cert.sh server-csr.json

ca.csr etcd-v3.3.10-linux-amd64.tar.gz server-key.pem

ca-csr.json flannel-v0.10.0-linux-amd64.tar.gz server.pem

ca-key.pem kubernetes-server-linux-amd64.tar.gz

ca.pem server.csr

[root@localhost etcd-cert]# mv *.tar.gz ../

[root@localhost k8s]# ls

cfssl.sh etcd.sh flannel-v0.10.0-linux-amd64.tar.gz

etcd-cert etcd-v3.3.10-linux-amd64.tar.gz kubernetes-server-linux-amd64.tar.gz

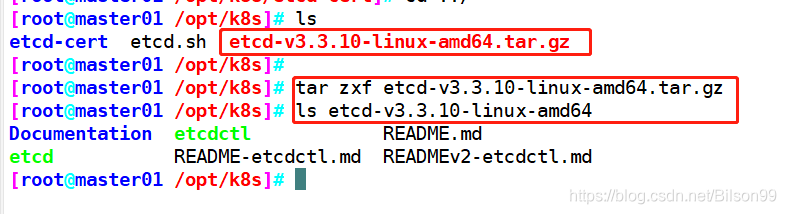

[root@localhost k8s]# tar zxvf etcd-v3.3.10-linux-amd64.tar.gz

[root@localhost k8s]# ls etcd-v3.3.10-linux-amd64

Documentation etcd etcdctl README-etcdctl.md README.md READMEv2-etcdctl.md

#���������ļ�,�����ļ�,֤��Ŀ¼

[root@localhost k8s]# mkdir /opt/etcd/{cfg,bin,ssl} -p

#�����ļ�,�����ļ�,֤��

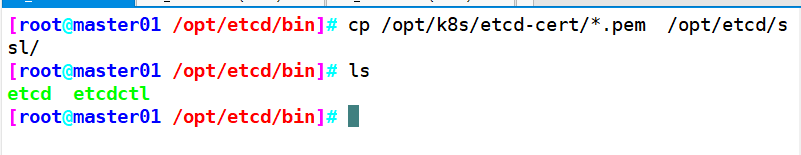

[root@localhost k8s]# mv etcd-v3.3.10-linux-amd64/etcd etcd-v3.3.10-linux-amd64/etcdctl /opt/etcd/bin/

#֤�鿽��

[root@localhost k8s]# cp etcd-cert/*.pem /opt/etcd/ssl/

#���뿨ס״̬�ȴ������ڵ����

./etcd.sh etcd01 192.168.217.40 etcd02=https://192.168.217.50:2380,etcd03=https://192.168.217.60:2380

//���뿨ס״̬�ȴ������ڵ����,������Ҫ��̨etcd����ͬʱ����,���ֻ��������һ̨��,����Ῠ������,ֱ����Ⱥ������etcd�ڵ㶼������,�ɺ���������

#ʹ������һ���Ự��,�ᷢ��etcd�����Ѿ�����

[root@localhost ~]# ps -ef | grep etcd

��master1�ڵ��ϲ���

#����֤��ȥ�����ڵ�

[root@localhost k8s]# scp -r /opt/etcd/ root@192.168.217.50:/opt

[root@localhost k8s]# scp -r /opt/etcd/ root@192.168.217.60:/opt

#�����ű����������ڵ�

[root@localhost k8s]# scp /usr/lib/systemd/system/etcd.service root@192.168.217.50:/usr/lib/systemd/system/

[root@localhost k8s]# scp /usr/lib/systemd/system/etcd.service root@192.168.217.60:/usr/lib/systemd/system/

����node�ڵ��ϲ���etcd

��node01�ڵ���(192.168.217.50)

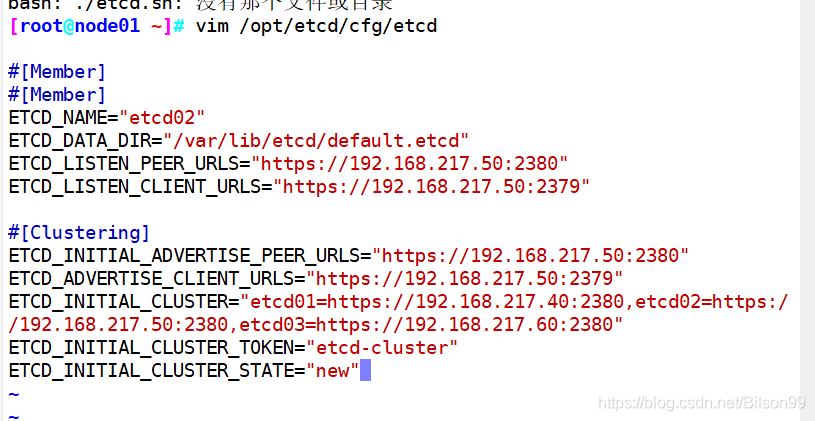

[root@localhost ~]# vim /opt/etcd/cfg/etcd

#[Member]

ETCD_NAME="etcd02"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.217.50:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.217.50:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.217.50:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.217.50:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.217.40:2380,etcd02=https://192.168.217.50:2380,etcd03=https://192.168.217.60:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

#����

[root@localhost ssl]# systemctl start etcd

[root@localhost ssl]# systemctl status etcd

��node02�ڵ���(192.168.217.60)

[root@localhost ~]# vim /opt/etcd/cfg/etcd

#[Member]

ETCD_NAME="etcd03"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.217.60:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.217.60:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.217.60:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.217.60:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.217.40:2380,etcd02=https://192.168.217.50:2380,etcd03=https://192.168.217.60:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

#����

[root@localhost ssl]# systemctl start etcd

[root@localhost ssl]# systemctl status etcd

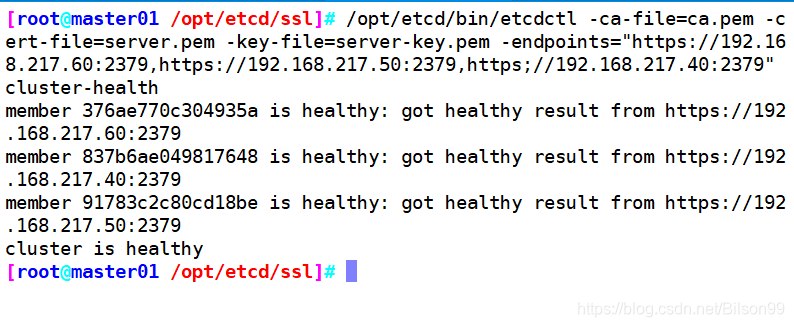

�� ���Ⱥ��״̬

��master01 �ڵ��ϲ���(192.168.217.40)

ln -s /opt/etcd/bin/etcd* /usr/local/bin

//���etcdȺ��״̬

cd /opt/etcd/ssl

/opt/etcd/bin/etcdctl \

-ca-file=ca.pem \

-cert-file=server.pem \

-key-file=server-key.pem \

-endpoints="https://192.168.217.60:2379,https://192.168.217.50:2379,https;//192.168.217.40:2379" \

cluster-health

����docker��Ⱥ����

node01(192.168.217.50)

node01(192.168.217.40)

//����node�ڵ㲿��docker����

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce

systemctl start docker.service

systemctl enable docker.service

����flannel��Ⱥ����

�����flannel����

K8S��Pod����ͨ��:

- Pod�����������������ͨ��:

- ��ͬһ�� Pod�ڵ�����(Pod �ڵ������Dz������������)����ͬһ����������ռ�,�൱��������ͬһ̨������һ��,������localhost��ַ���ʱ˴˵Ķ˿�

- ͬһ��Node��Pod֮���ͨ��:

- ÿ�� Pod ����һ����ʵ��ȫ��IP��ַ,ͬһ��Node �ڵIJ�ͬPod ֮�����ֱ�Ӳ��öԷ� Pod��IP��ַ����ͨ��,Pod1��Pod2����ͨ�� Veth���ӵ�ͬһ��docker0 ����,������ͬ,��������֮�����ֱ��ͨ�š�

- ��ͬ Node �� Pod ֮���ͨ��:

- Pod ��ַ�� docker0��ͬһ����,docker0������������������������ͬ������,�Ҳ�ͬNode֮���ͨ��ֻ��ͨ���������������������С�Ҫ��ʵ�ֲ�ͬNode �� Pod ֮���ͨ��,�ͱ�����취ͨ���������������� IP��ַ����Ѱַ��ͨ�š����Ҫ������������: Pod ��IP ���ܳ�ͻ;��Pod �� IP�����ڵ� Node��IP ��������,ͨ����������ò�ͬ Node �� Pod ֮��ֱ��ͨ������IP��ַͨ�š�

Overlay Network:

��������,�ڶ������������������ϵ��ӵ�һ���������缼��ģʽ,�������е�����ͨ��������·������������(������VPN)��

VXLAN:

��Դ���ݰ���װ��UDP��,��ʹ�û��������IP/MAC��Ϊ��㱨��ͷ���з�װ,Ȼ������̫���ϴ���,����Ŀ�ĵغ��������˵���װ�������ݷ���Ŀ���ַ��

Flannel:

Flannel �Ĺ������ü�Ⱥ�еIJ�ͬ�ڵ�����������Docker����������ȫ��ȺΨһ������IP��ַ��

Flannel�� overlay �����һ��,Ҳ�ǽ�TCPԴ���ݰ���װ����һ��������������·��ת����ͨ��,Ŀǰ����֧��UDP��VXLAN��AWS VPC������ת����ʽ��

Flannel����ԭ��:

���ݴ�node01��Pod ��Դ�����з�����,�������������� docker0��������ת���� flannel0 ��������, flanneld ��������� flannel0 ��������������һ�ˡ�flannel ͨ�� etcd ����ά����һ�Žڵ���·�ɱ���Դ���� node01 �� flanneld ����ԭ�����������ݷ�װ��UDP�к�����Լ���·�ɱ�ͨ����������Ͷ�ݸ�Ŀ�Ľڵ�node02�� flanneld����,���ݵ����Ժ��,Ȼ��ֱ�ӽ���Ŀ�Ľڵ��flannel0��������,֮��ת����Ŀ�������� docker0 ��������,����������ͨ��һ���� docker0 ת�����ձ�������

ETCD ֮Flannel �ṩ˵��:

�洢����Flannel�ɷ����Ip��ַ����Դ,���ETCD��ÿ��Pod��ʵ�ʵ�ַ,�����ڴ��н���ά��Pod�ڵ�·�ɱ�

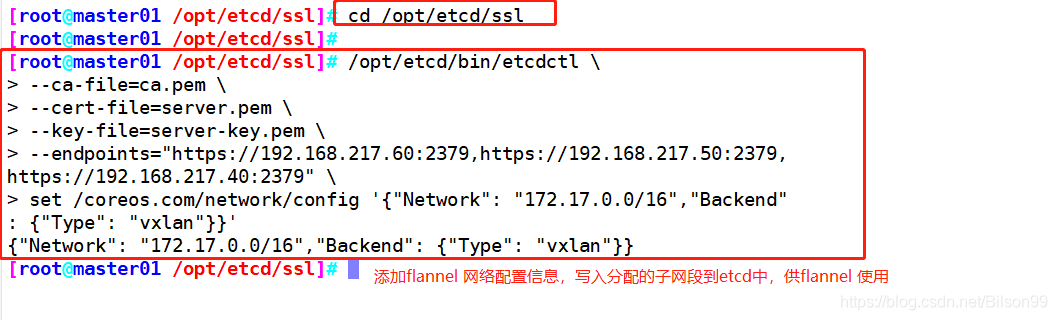

����master�ڵ��ϲ���flannel

master01(192.168.217.60)

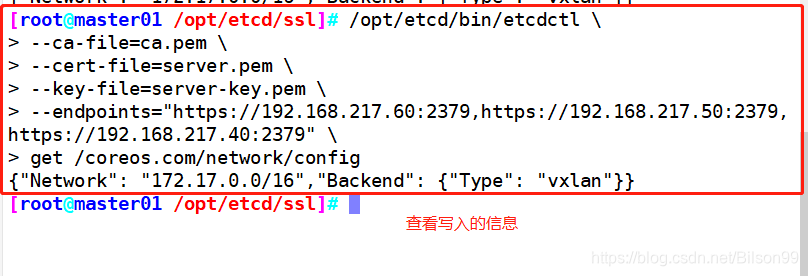

//����flannel ����������Ϣ,д�����������ε�etcd��,��flannel ʹ��

cd /opt/etcd/ssl

/opt/etcd/bin/etcdctl \

--ca-file=ca.pem \

--cert-file=server.pem \

--key-file=server-key.pem \

--endpoints="https://192.168.217.60:2379,https://192.168.217.50:2379,https://192.168.217.40:2379" \

set /coreos.com/network/config '{"Network": "172.17.0.0/16","Backend": {"Type": "vxlan"}}'

//�鿴д�����Ϣ

/opt/etcd/bin/etcdctl \

--ca-file=ca.pem \

--cert-file=server.pem \

--key-file=server-key.pem \

--endpoints="https://192.168.217.60:2379,https://192.168.217.50:2379,https://192.168.217.40:2379" \

get /coreos.com/network/config

set <key> <value>

set /coreos com/network/config����һ���������ü�¼,������ý�����flannel�����ÿ��docker������IP��ַ��

get

get /coreos.com/network/config��ȡ�������ü�¼,���治���ٸ�������

Network:����ָ��Flannel��ַ��

Backend:����ָ�����ݰ���ʲô��ʽת��,Ĭ��Ϊudpģʽ,BackendΪvxlan ����Ԥ���udp������Ժ�һЩ

����node�ڵ��ϲ���flannel

node01(192.168.217.50)

node02(192.168.217.40)

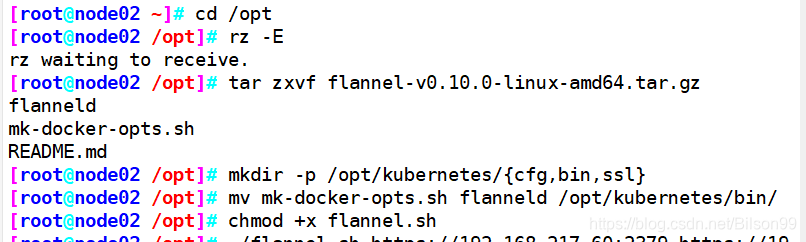

//�ϴ�flannel.sh��flannel-v0.10.0-1inux-amd64.tar.gz��/opt Ŀ¼��,��ѹflannel ѹ����

cd /opt

tar zxvf flannel-v0.10.0-linux-amd64.tar.gz

flanneld #flanneldΪ��Ҫ��ִ���ļ�

mk-docker-opts.sh #mk-docker-opts.sh�ű���������Docker��������

README.md

//����kubernetes����Ŀ¼

mkdir -p /opt/kubernetes/{cfg,bin,ssl}

mv mk-docker-opts.sh flanneld /opt/kubernetes/bin/

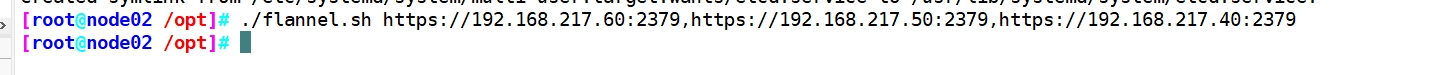

//����flanneld����,����flannel���繦��

cd /opt

chmod +x flannel.sh

����Flannel����Ľű���ϸ���ݲ鿴:flannel.sh

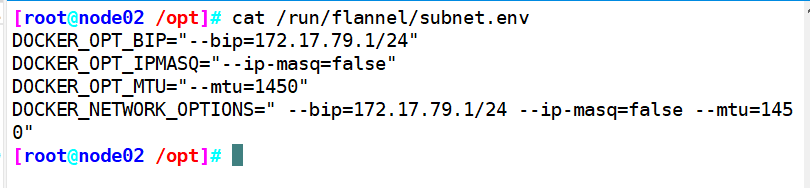

//flannel�����������һ��docker���������Ϣ�����ļ�/run/flannel/subnet.env,������dockerҪʹ��flannelͨѶ����ز���

cat /run/flannel/subnet.env

DOCKER_OPT_BIP="--bip=172.17.26.1/24"

DOCKER_OPT_ IPMASQ="--ip-masq= false"

DOCKER_OPT_MTU="--mtu=1450"

DOCKER NETWORK OPTIONS="--bip=172.17.26. 1/24 --ip-masq-false--mtu=1450"

�Cbip: ָ��docker����ʱ������

�Cip-masq: ����ipmasq=false �ر�snatαװ����

�Cmtu=1450:mtuҪ����50�ֽڸ�����vxlan����Ķ����ʹ��

�� ����Docker����Flannel

node01(192.168.217.50)

node02(192.168.217.40)

vim /usr/lib/systemd/system/docker.service

[Service]

....

#for containers run by docker

EnvironmentFile=/run/flannel/subnet.env #���Ӵ���

ExecStart=/usr/bin/dockerd $DOCKER_NETWORK_OPTIONS -H fd:// --containerd=/run/containerd/containerd.sock

....

//����docker����

systemctl daemon-reload

systemctl restart docker

//�鿴flannel����

ifconfig

//����pingͨ�Է�docker0����֤��flannel��·������

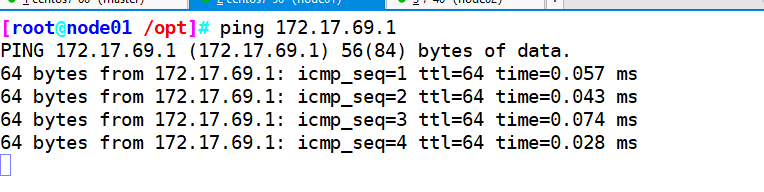

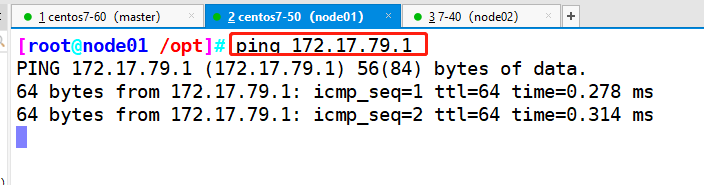

node1:ping 172.17.69.1

node2:ping 172.17.79.1

�� ������Node�ڵ��ڴ���Docker����,���в���

node01(192.168.217.50)

node02(192.168.217.40)

docker run -it centos:7 /bin/bash

yum install net-tools -y

ifconfig

�ֱ������������ڲ鿴IP��ַ

��node01�ڵ�:ping 172.17.79.1

��node01�ڵ�:ping 172.17.69.1

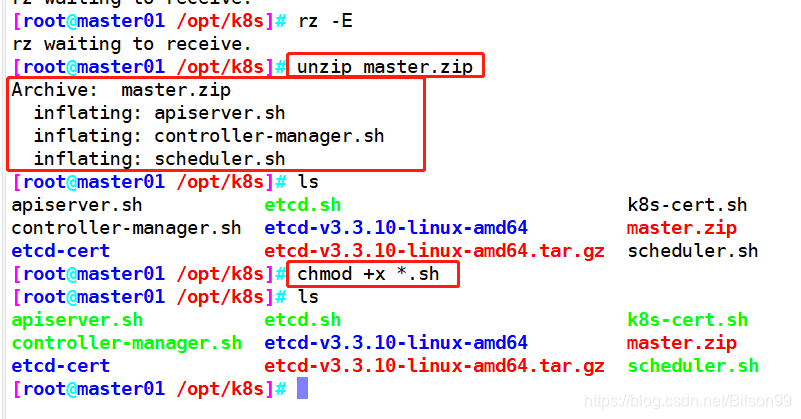

�ġ�����master�ڵ�

master01(192.168.217.60)

�� api-server����֤��

cd /opt/k8s/

unzip master.zip

chmod +x controller-manager.sh

mkdir /opt/kubernetes/{cfg,bin,ssl} -p

mkdir k8s-cert #����k8s֤����Ŀ¼

mv k8s-cert.sh k8s-cert

vim k8s-cert.sh

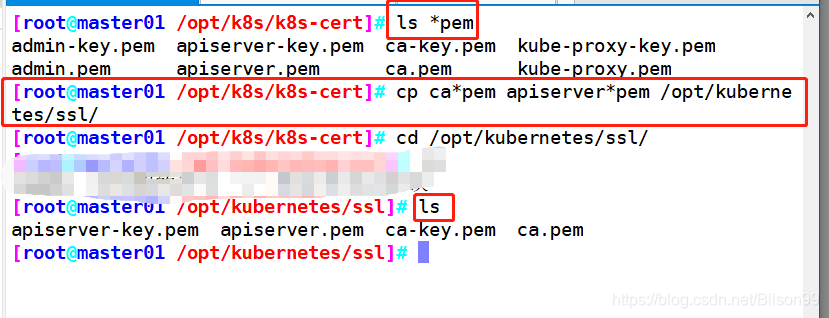

./k8s-cert.sh

cp apiserver*pem ca*pem /opt/kubernetes/ssl/

ls *pem

admin-key.pem apiserver-key.pem

ca-key.pem kube-proxy-key.pem

admin.pem

apiserver.pem

ca.pem

kube-proxy.pem

//controller-manager��kube-scheduler����Ϊֻ���õ�ǰ������apiserver, ʹ��127.0.0.1:8080 ͨ��,��˲���Ҫǩ��֤��

//����CA֤�顢apiserver���֤���˽Կ��kubernetes ����Ŀ¼��ssl�� Ŀ¼��

cp ca*pem apiserver*pem /opt/kubernetes/ssl/

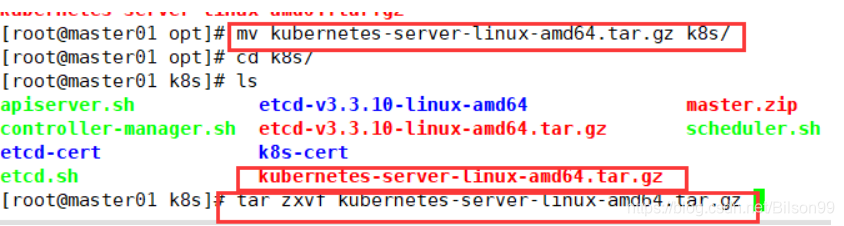

�� ��ѹ��װ��������Token��֤�ļ�

//�ϴ�kubernetes-server-linux-amd64.tar.gz��/opt/k8s/Ŀ¼��,��ѹkubernetesѹ����

cd /opt/k8s/

tar zxvf kubernetes-server-linux-anid64.tar.gz

//����master����Ĺؼ������ļ���kubernetes ����Ŀ¼��bin��Ŀ¼��

cd /opt/k8s/kubernetes/server/bin

cp kube-apiserver kubectl kube-controller-manager kube-scheduler /opt/kubernetes/bin/

ln -s /opt/kubernetes/bin/* /usr/local/bin/

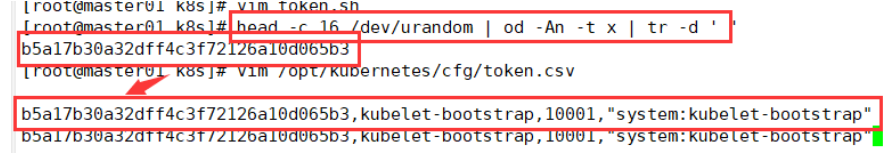

�� ����bootstrap token��֤�ļ�

//����bootstrap token��֤�ļ�,apiserver����ʱ�����,Ȼ����൱���ڼ�Ⱥ�ڴ�����һ������û�,�������Ϳ�����RBAC

������Ȩ

cd /opt/k8s/

#��ȡ�����ǰ16���ֽ�����,��ʮ�����Ƹ�ʽ���,��ɾ�����пո�

head -c 16 /dev/urandom | od -An -t x | tr -d ' '

3e40a8ddf4af904f7f922cce0fdded8b #�������ɵ������

#�༭token.csv�ļ�,����Token���к�,�û���,UID,�û���ĸ�ʽ����

vim /opt/kubernetes/cfg/token.csv

3e40a8ddf4af904f7f922cce0fdded8b,kubelet-bootstrap,10001,"system:kubelet-bootstrap"

cat /opt/kubernetes/cfg/token.csv

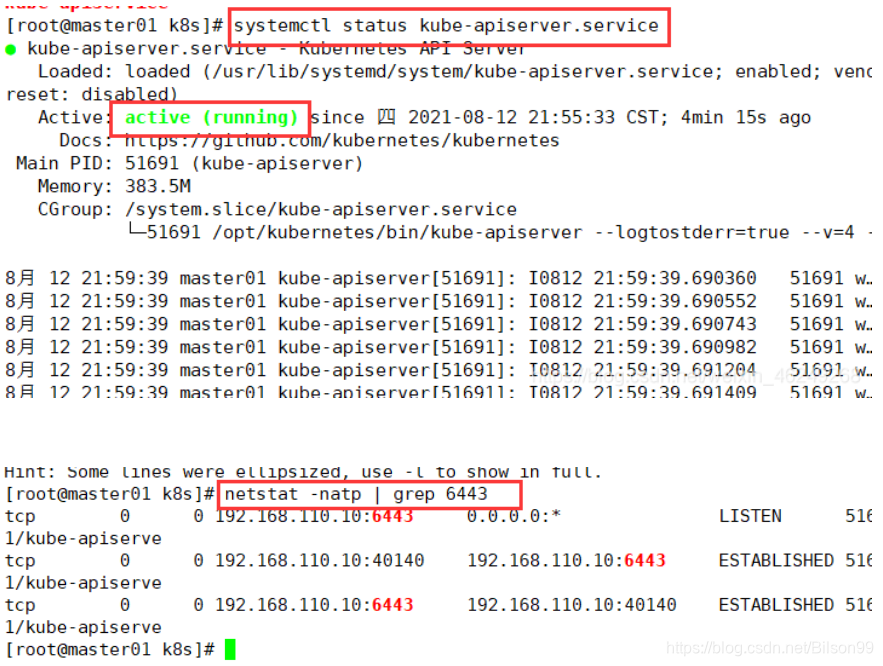

�� ����Apiserver����

//�������ļ���token��֤�鶼���ú�,����apiserver����

cd /opt/k8s/

./apiserver.sh 192.168.217.60 https://192.168.217.60:2379,https://192.168.217.50:2379,https://192.168.217.40:2379

//�������Ƿ������ɹ�

ps aux | grep kube-apiserver

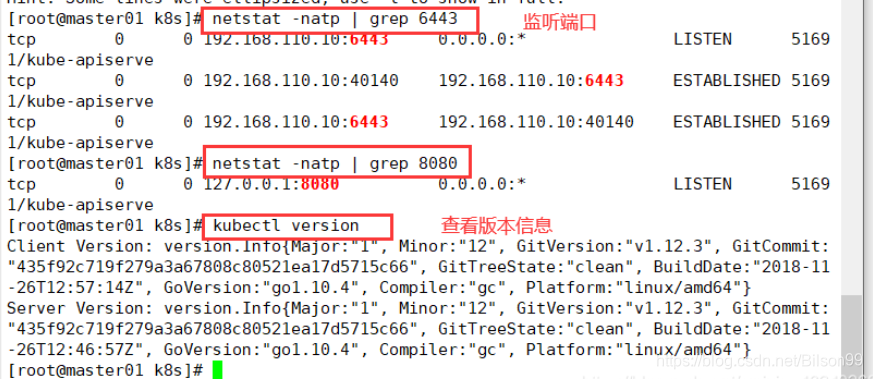

// k8sͨ��kube-apiserver��������ṩ����,�ý��������ڵ���master�ڵ��ϡ�Ĭ���������˿�6443��8080

//��ȫ�˿�6443���ڽ���HTTPS����,���ڻ���Token�ļ���ͻ���֤�����֤

netstat -natp |grep 6443

//���ض˿�8080���ڽ���HTTP����,����֤����Ȩ��HTTP����ͨ���ö˿ڷ���APIServer

netstat -natp | grep 8080

//�鿴�汾��Ϣ(���뱣֤apiserver��������,��Ȼ����ѯ��server�İ汾��Ϣ)

kubectl version

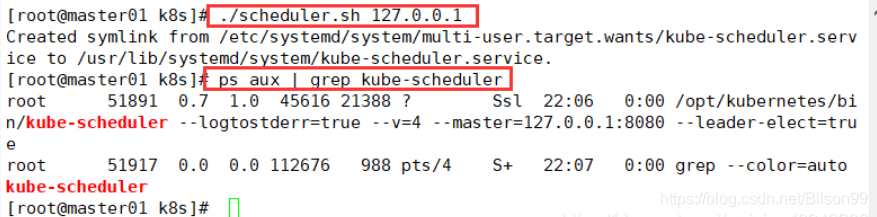

�� ����Scheduler����

//����scheduler����

cd /opt/k8s/

./scheduler.sh 127.0.0.1

ps aux | grep scheduler

����scheduler����Ľű���ϸ���ݲ鿴:scheduler.sh

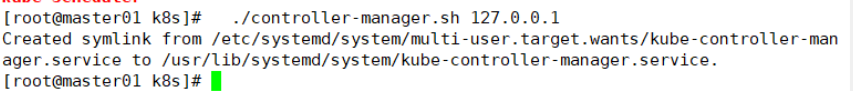

�� ����controller-manager����

//����controller-manager����

cd /opt/k8s/

./controller-manager.sh 127.0.0.1

ps aux | grep kube-controller-manager

����controller-manager����Ľű���ϸ���ݲ鿴:controller-manager.sh

�� �鿴Master�ڵ�״̬

//�鿴master �ڵ�״̬.

kubectl get componentstatuses

#Ҳ����kubectl get cs

�塢node�ڵ�IJ���

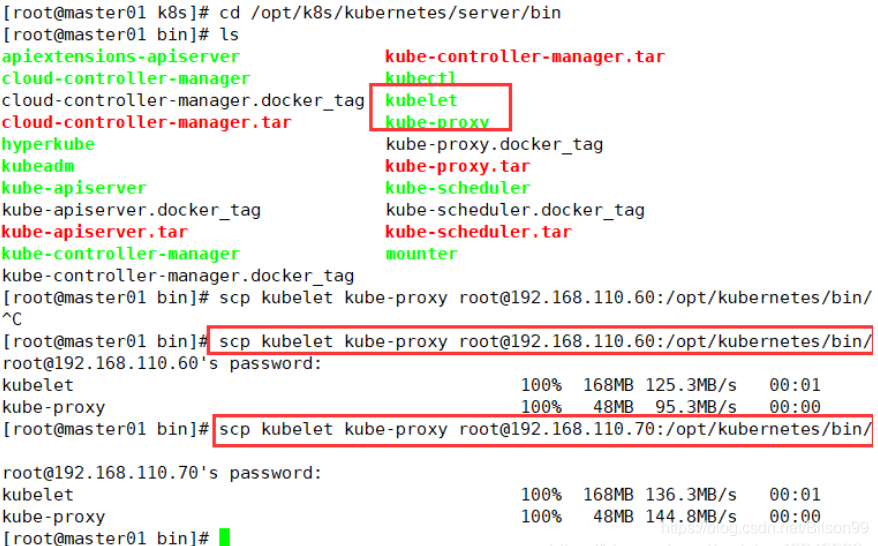

�� ��kubelet��kube-proxy������node01�ڵ�

Master01(192.168.217.60)

//��kubelet��kube-proxy ������node�ڵ�

cd /opt/k8s/kubernetes/server/bin

scp kubelet kube-proxy root@192.168.217.50:/opt/kubernetes/bin/

scp kubelet kube-proxy root@192.168.217.40:/opt/kubernetes/bin/

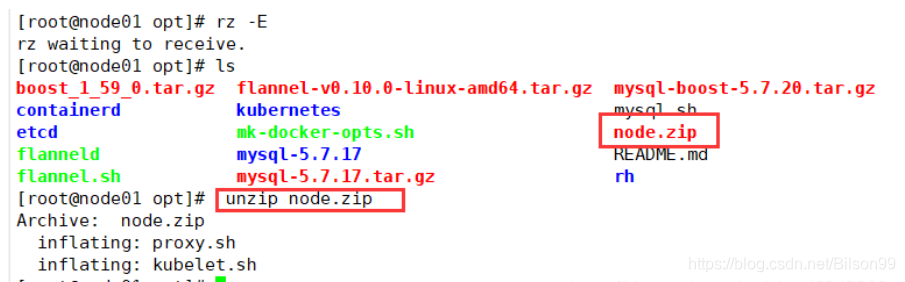

�� �ϴ�Nodeѹ����

node01(192.168.217.50)

//�ϴ�node.zip ��/opt��¼��,��ѹnode.zipѹ����,���kubelet.sh��proxy.sh

cd /opt/

unzip node.zip

�� ��������Kubelet�������ļ���Ŀ¼

Master01(192.168.217.60)

//������������kubelet�������ļ���Ŀ¼

mkdir /opt/k8s/kubeconfig

//�ϴ�kubeconfig.sh�ļ���/opt/k8s/kubeconfig��¼��

#kubeconfig.sh�ļ�������Ⱥ����(CA֤�顢API Server��ַ),�ͻ��˲���(�������ɵ�֤���˽Կ),��Ⱥcontext�����IJ���(��Ⱥ���ơ��û���)��Kubenetes ���(��kubelet��kube-proxy)ͨ������ʱָ����ͬ��kubeconfig�ļ������л�����ͬ�ļ�Ⱥ,���ӵ�apiserver��

cd /opt/k8s/kubeconfig

chmod +x kubeconfig.sh

����kubelet�������ļ��Ľű���ϸ���ݲ鿴:kubeconfig.sh

//����kubelet�������ļ�

cd /opt/k8s/kubeconfig

./kubeconfig.sh 192.168.217.60 /opt/k8s/k8s-cert/

ls

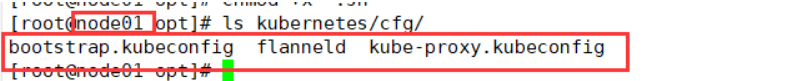

//�������ļ�bootstrap.kubeconfig��kube-proxy.kubeconfig������node�ڵ�

cd /opt/k8s/kubeconfig

scp bootstrap.kubeconfig kube-proxy.kubeconfig root@192.168.217.50:/opt/kubernetes/cfg/

scp bootstrap.kubeconfig kube-proxy.kubeconfig root@192.168.217.40:/opt/kubernetes/cfg/

//RBAC��Ȩ,��Ԥ���û�kubelet-bootstrap �����õ�ClusterRole system: node -bootstrapper��һ��, ʹ���ܹ�����CSR����

kubectl create clusterrolebinding kubelet-bootstrap --clusterrole=system:node-bootstrapper --user=kubelet-bootstrap

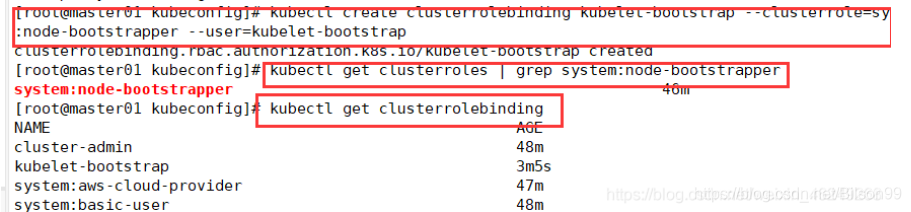

�� ����bootstrap��ɫ����Ȩ����������apiserver����ǩ��(�ؼ�)(master01�ϲ���)

//RBA��Ȩ

kubectl create clusterrolebinding kubelet-bootstrap --clusterrole=system:node-bootstrapper --user=kubelet-bootstrap

//�鿴��ɫ

kubectl get clusterroles | grep system:node-bootstrapper

//�鿴����Ȩ�Ľ�ɫ

kubectl get clusterrolebinding

�� ִ��kubelet.sh�ű�(��node01�ڵ��ϲ���)

./kubelet.sh 192.168.217.50

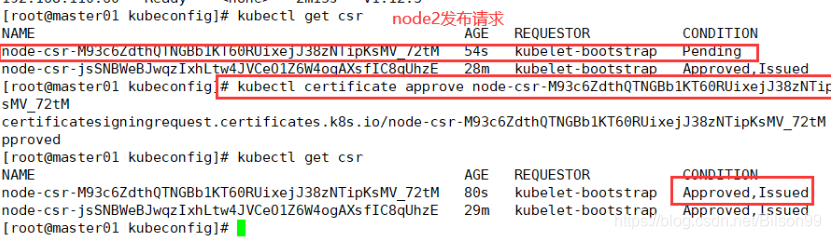

�� ��鵽node01�ڵ������(master01�ϲ���)

kubectl get csr

kubectl certificate approve node-csr-jsSNBWeBJwqzIxhLtw4JVCeO1Z6W4ogAXsfIC8qUhzE

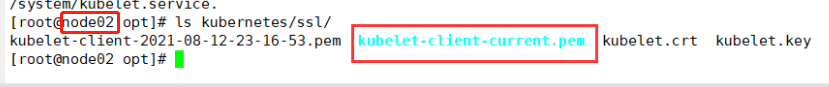

�� �鿴֤��(node01��)

ls /opt/kubernetes/ssl/

�� �鿴maser01Ⱥ���ڵ�,�ɹ�����node01�ڵ�

�� ����ip_vsģ��(node01��02)

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $1 >/dev/null 2>&1 && /sb1n/modprobe $i;done

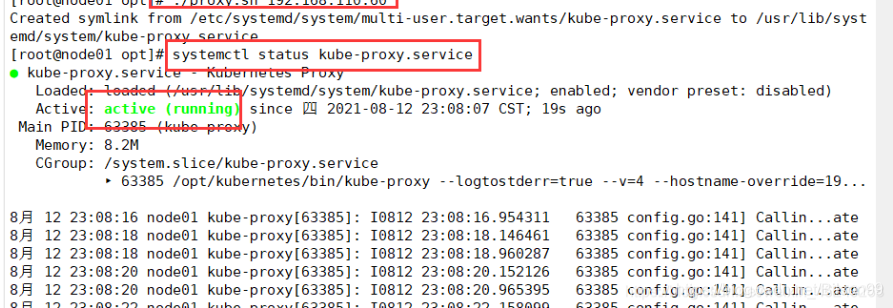

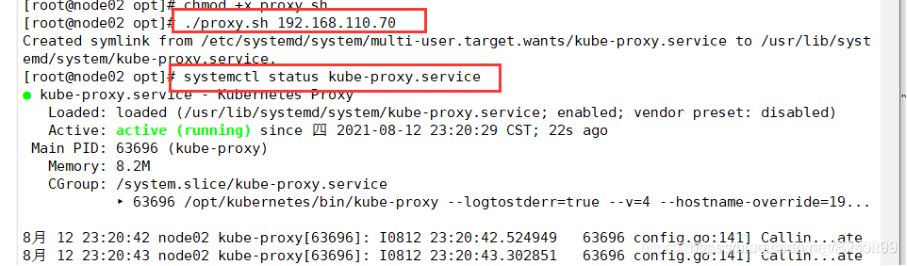

�� ����proxy����(node01)

./proxy.sh 192.168.217.50

systemctl status kube-proxy.service

��node01�е������ļ����Ƶ�node02(��node01�ϲ���)

scp kubelet.sh proxy.sh root@192.168.217.40:/opt

ִ��(node02�ϲ���)

./kubelet.sh 192.168.217.40

master01(192.168.217.60)

����kube-proxy

�鿴��Ⱥ�ڵ�

kubectl get node