����Ŀ¼

һ��kubeadmin������

| ������ | IP��ַ | ���� |

|---|---|---|

| master(2C/4G,cpu������Ҫ�����2) | 192.168.111.30 | docker��kubeadm��kubelet��kubectl��flannel |

| node01(2C/2G) | 192.168.111.40 | docker��kubeadm��kubelet��kubectl��flannel |

| node02(2C/2G) | 192.168.111.50 | docker��kubeadm��kubelet��kubectl��flannel |

1����������,���нڵ�Ҫ����

�رշ���ǽ����,�ر�selinux,�ر�swap����

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

iptables -F

swapoff -a #������������Ҫ�ر�

#���� ip_vs ģ��

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

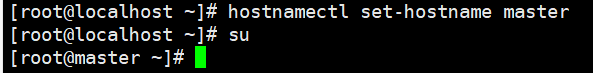

��������

hostnamectl set-hostname master

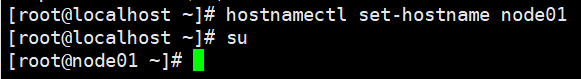

hostnamectl set-hostname node01

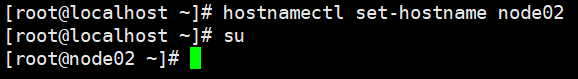

hostnamectl set-hostname node02

su

���нڵ���hosts�ļ�

vim /etc/hosts

192.168.111.30 master

192.168.111.40 node01

192.168.111.50 node02

�����ں˲���

cat > /etc/sysctl.d/kubernetes.conf << EOF

#��������ģʽ,�ɽ����ŵ��������ݸ�iptables��

net.bridge.bridge-nf-call-ip6tables=1

net.bridge.bridge-nf-call-iptables=1

#�ر�ipv6Э��

net.ipv6.conf.all.disable_ipv6=1

#����ipv·��ת��

net.ipv4.ip_forward=1

EOF

//������

sysctl --system

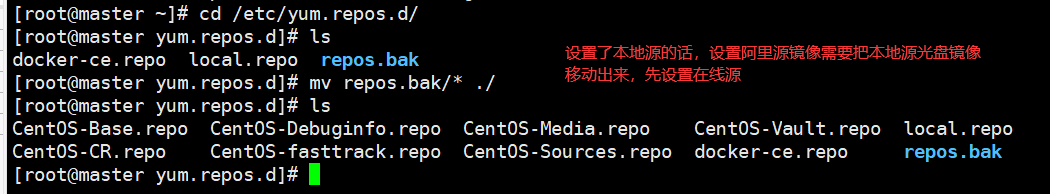

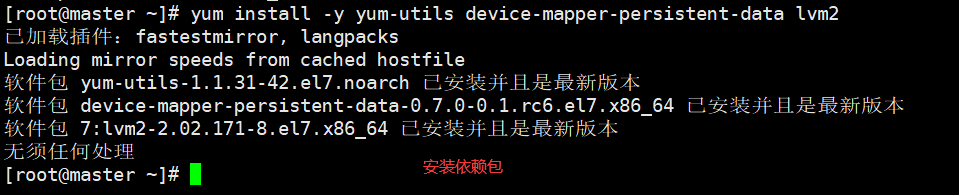

2�����нڵ㰲װdocker

��װ�����������ð���Դ����װdocker����

yum install -y yum-utils device-mapper-persistent-data lvm2

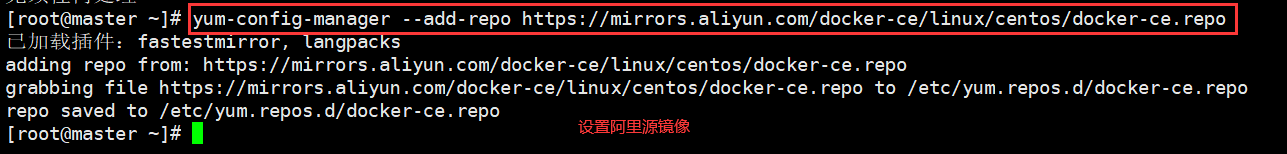

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce docker-ce-cli containerd.io

���������ļ�,����������ij�systemd

mkdir /etc/docker

cat > /etc/docker/daemon.json <<EOF

{

"registry-mirrors": ["https://6ijb8ubo.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"],

"log-driver": "json-file",

"log-opts": {

"max-size": "100m"

}

}

EOF

#ʹ��Systemd������Cgroup��������Դ���������,��Ϊ���Cgroupfs����,Systemd����CPU���ڴ����Դ���Ӽͳ����ȶ���

#��־ʹ��json-file��ʽ���ʹ洢,��СΪ100M,������/var/log/containersĿ¼��,����ELK����־ϵͳ�ռ�������־��

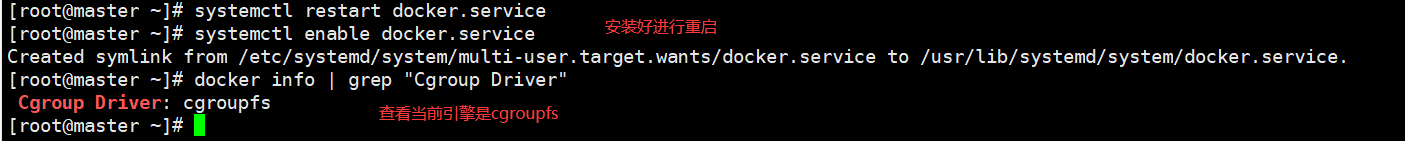

systemctl daemon-reload

systemctl restart docker.service

systemctl enable docker.service

docker info | grep "Cgroup Driver"

Cgroup Driver: systemd

5�����нڵ㰲װkubeadm,kubelet��kubectl

����kubernetesԴ

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

yum install -y kubelet-1.15.1 kubeadm-1.15.1 kubectl-1.15.1

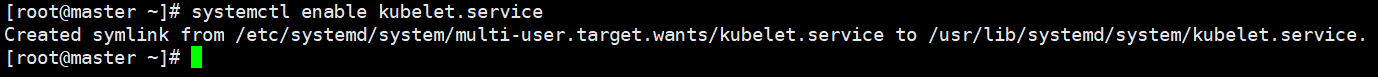

��������kubelet

systemctl enable kubelet.service

#K8Sͨ��kubeadm��װ�����Ժ�����Pod��ʽ����,���ײ�����������ʽ����,����kubelet�������ÿ�������

6������K8S��Ⱥ

�鿴��ʼ����Ҫ�ľ���

kubeadm config images list

��master �ڵ��ϴ� kubeadm-basic.images.tar.gz ѹ������ /opt Ŀ¼

kubeadm-basic.images.tar.gz ѹ����

cd /opt

tar zxvf kubeadm-basic.images.tar.gz

for i in $(ls /opt/kubeadm-basic.images/*.tar); do docker load -i $i; done

���ƾ���ͽű��� node �ڵ�,���� node �ڵ���ִ�нű� bash /opt/load-images.sh

scp -r kubeadm-basic.images root@node01:/opt

scp -r kubeadm-basic.images root@node02:/opt

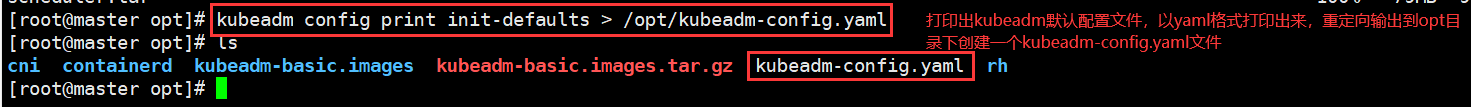

7����ʼ��kubeadm

���������ַ���,����ʹ�õ�һ�ַ���

����һ:

kubeadm config print init-defaults > /opt/kubeadm-config.yaml

cd /opt/

vim kubeadm-config.yaml

......

11 localAPIEndpoint:

12 advertiseAddress: 192.168.80.10 #ָ��master�ڵ��IP��ַ

13 bindPort: 6443

......

34 kubernetesVersion: v1.15.1 #ָ��kubernetes�汾��

35 networking:

36 dnsDomain: cluster.local

37 podSubnet: "10.244.0.0/16" #ָ��pod����,10.244.0.0/16����ƥ��flannelĬ������

38 serviceSubnet: 10.96.0.0/16 #ָ��service����

39 scheduler: {}

--- #ĩβ��������������

apiVersion: kubeproxy.config.k8s.io/v1alpha1

kind: KubeProxyConfiguration

featureGates:

SupportIPVSProxyMode: true

mode: ipvs #��Ĭ�ϵ�service���ȷ�ʽ��Ϊipvsģʽ

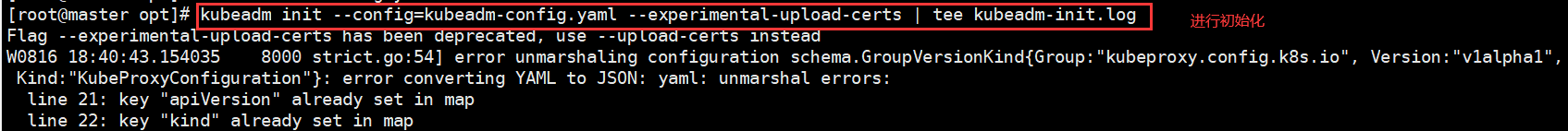

kubeadm init --config=kubeadm-config.yaml --experimental-upload-certs | tee kubeadm-init.log

#--experimental-upload-certs ���������ں���ִ�м���ڵ�ʱ�Զ��ַ�֤���ļ�,k8sV1.16�汾��ʼ�滻Ϊ --upload-certs

#tee kubeadm-init.log ���������־

�鿴 kubeadm-init ��־

less kubeadm-init.log

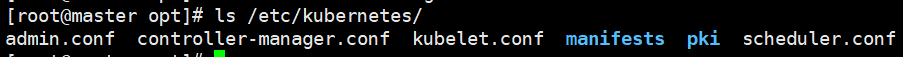

kubernetes�����ļ�Ŀ¼

ls /etc/kubernetes/

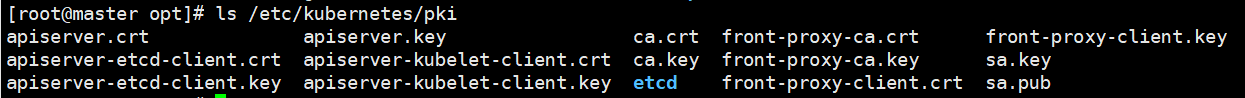

���ca��֤��������Ŀ¼

ls /etc/kubernetes/pki

������:

kubeadm init \

--apiserver-advertise-address=0.0.0.0 \

--image-repository registry.aliyuncs.com/google_containers \

--kubernetes-version=v1.15.1 \

--service-cidr=10.1.0.0/16 \

--pod-network-cidr=10.244.0.0/16

- ��ʼ����Ⱥ��ʹ��kubeadm init����,����ָ�����������ʼ��,Ҳ����ָ�������ļ���ʼ����

| ���� | ˵�� |

|---|---|

| �Capiserver-advertise-address | apiserver�ļ�����ַ |

| �Capiserver-bind-port | apiserver�ļ����˿�,Ĭ����6443 |

| �Ccert-dir | ͨѶ��ssl֤���ļ�,Ĭ��/etc/kubernetes/pki |

| �Ccontrol-plane-endpoint | ����̨ƽ��Ĺ����ն�,�����Ǹ��ؾ����ip��ַ����dns����,�߿��ü�Ⱥʱ��Ҫ���� |

| �Cimage-repository | ��ȡ����ľ���ֿ�,Ĭ����k8s.gcr.io |

| �Ckubernetes-version | ָ��kubernetes�汾 |

| �Cpod-network-cidr | pod��Դ������,����pod��������ֵ����һ�¡�ͨ��,Flannel��������Ĭ��Ϊ10.244.0.0/16,Calico�����Ĭ��ֵΪ192.168.0.0/16; |

| �Cservice-cidr | service��Դ������ |

| �Cservice-dns-domain | serviceȫ�����ĺ�,Ĭ����cluster.local |

��������ʼ������Ҫ�� kube-proxy �� configmap,���� ipvs

kubectl edit cm kube-proxy -n=kube-system

��mode: ipvs

�趨kubectl

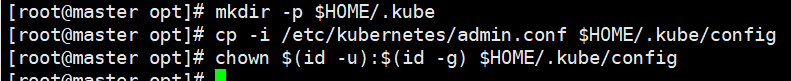

kubectl�辭��API server��֤����Ȩ����ִ����Ӧ�Ĺ�������,kubeadm ����ļ�ȺΪ��������һ�����й���ԱȨ����֤�����ļ� /etc/kubernetes/admin.conf,������ kubectl ͨ��Ĭ�ϵ� ��$HOME/.kube/config�� ��·�����м��ء�

mkdir -p $HOME/.kube

cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

chown $(id -u):$(id -g) $HOME/.kube/config

�� node �ڵ���ִ�� kubeadm join �������Ⱥ��

kubeadm join 192.168.111.30:6443 --token abcdef.0123456789abcdef \

--discovery-token-ca-cert-hash sha256:df1cff40971852c55d5ac812c3c7d2da42f845c6322c3879f4626d69c4ad647a

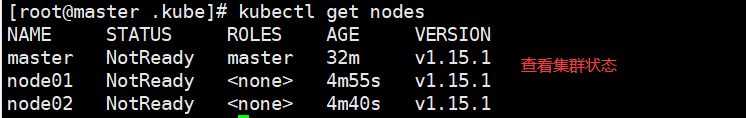

�鿴��Ⱥ״̬

kubectl get nodes

8�����нڵ㲿��������flannel

����һ:

���нڵ��ϴ�flannel���� flannel.tar �� /opt Ŀ¼,master�ڵ��ϴ� kube-flannel.yml �ļ�

cd /opt

docker load -i flannel.tar

//�� master �ڵ㴴�� flannel ��Դ

kubectl apply -f kube-flannel.yml

������:

kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

kubectl get pods -n kube-system

NAME READY STATUS RESTARTS AGE

coredns-bccdc95cf-c9w6l 1/1 Running 0 71m

coredns-bccdc95cf-nql5j 1/1 Running 0 71m

etcd-master 1/1 Running 0 71m

kube-apiserver-master 1/1 Running 0 70m

kube-controller-manager-master 1/1 Running 0 70m

kube-flannel-ds-amd64-kfhwf 1/1 Running 0 2m53s

kube-flannel-ds-amd64-qkdfh 1/1 Running 0 46m

kube-flannel-ds-amd64-vffxv 1/1 Running 0 2m56s

kube-proxy-558p8 1/1 Running 0 2m53s

kube-proxy-nwd7g 1/1 Running 0 2m56s

kube-proxy-qpz8t 1/1 Running 0 71m

kube-scheduler-master 1/1 Running 0 70m

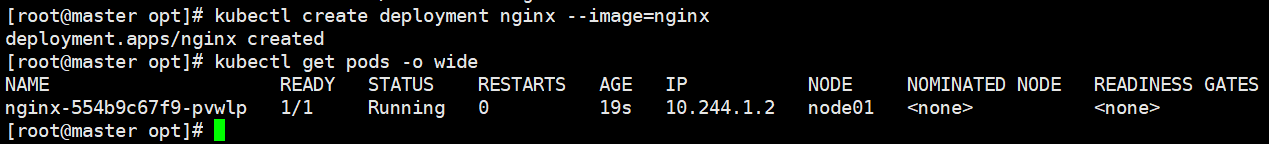

���� pod ��Դ����

kubectl create deployment nginx --image=nginx

kubectl get pods -o wide

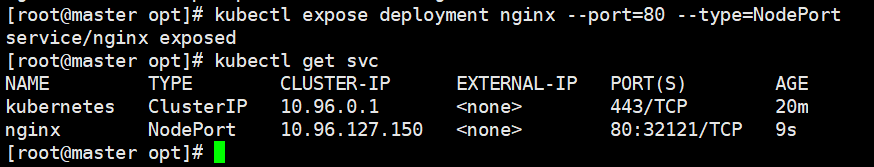

��¶�˿��ṩ����

kubectl expose deployment nginx --port=80 --type=NodePort

kubectl get svc

���Է���

��չ3������

kubectl scale deployment nginx --replicas=3

kubectl get pods -o wide