����

**���˲�����վ **ITС�� www.itxiaoshen.com

Kubernetes������ַ https://kubernetes.io

Kubernetes GitHubԴ���ַ https://github.com/kubernetes/kubernetes

Kubernetes,Ҳ��ΪK8s,�����������������ϵͳ,��һ�������Զ���������չ����������Ӧ�ó���Ŀ�Դϵͳ��

- Kubernetes,��һ��go���Կ���(dockerҲ��go���Կ���,�ɼ�go���Ե�����������,���� Python �ȶ�̬���ԵĿ����ٶȺ� C/C++ �ȱ��������Ե������밲ȫ�ԡ�,����������Ժá�����������á�ִ�����ܸ�,��������ר��ѧϰ��)���ڿ�����������������Ӧ�ó���Ŀ���Դ����ϵͳ����ΪӦ�ó���IJ���ά������չ�ṩ�˻������ơ�

- Kubernetes�ķ�չ��ʷ,�ӹ�����Iaas��Paas��Saas���Ƽ���ʱ����ʼ,��Docker Swarm������������Ⱥ��Apache MesosΪ�ֲ�ʽ��Դ�������,���ճ�Ϊ��������������������

����

-

- Kubernetes ��ֲ���ؽ����Ӧ�û������õĸ�������,ͬʱ����Ӧ�ó�������״����ȷ���㲻��ͬʱ��ֹ����ʵ���������������,Kubernetes ��Ϊ��ع��������ġ���Ӧ�ó�����ò��ϳɳ��IJ�����̬ϵͳ��

-

- ���������Ӧ�ó���ʹ��İ���ķ����ֻ��ơ�Kubernetes Ϊ�����ṩ���Լ��� IP ��ַ��һ�� DNS ����,���ҿ���������֮��ʵ�ָ��ؾ��⡣

-

- ������� Secrets ��Ӧ�ó�������ö��������¹�����������,�� ���ؽ�������ջ�����е�������Ϣ��¶������

-

- ������Դ���������Լ���Զ���������,ͬʱ����Ӱ������ԡ����ؼ��Թ������غ;�����Ϊ���ʵķ��������ؽ��л�Ϸ���,�������Դ�����ʲ���ʡ������Դ��

-

- ���˷���֮��,Kubernetes �����Թ�������������� CI ��������,������ʱ�滻��ʧЧ��������

-

- Ϊ Pod �� Service ���� IPv4 �� IPv6 ��ַ

-

- ʹ��һ�������һ�� UI ����� CPU ʹ������Զ���Ӧ�ó������������

-

- ��������ʧ�ܵ�����,�ڽڵ�����ʱ�滻�����µ�������,ɱ������Ӧ�û�����Ľ�����������,�������������÷���֮ǰ���Ὣ���ǹ������ͻ��ˡ�

-

- �����������Դ�뼴����չ��� Kubernetes ��Ⱥ

kubernetesʹ��

�ĵ�

kubernetes�����ĵ���ַ https://kubernetes.io/zh/docs/home

Ŀǰ���°汾Ϊ v1.22 ,�����Լ������ļ�Ⱥ,�ٷ�֧�ֵ����ڲ��� Kubernetes �Ĺ����� kubeadm��

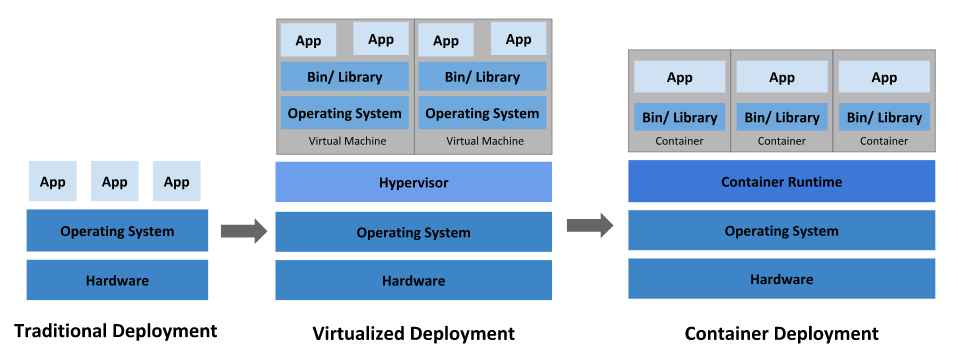

�ݽ�����:��ͳ����ʱ�� - ���⻯����ʱ�� - ��������ʱ��

- ��ͳ����ʱ��:������������������Ӧ�ó���

- ���⻯����ʱ��:���⻯�����������ڵ��������������� CPU �����ж�������

- ��������ʱ��:�� VM ����,������Ӧ�ó���֮�乲������ϵͳ,��������Ϊ����������,�����Լ����ļ�ϵͳ��CPU���ڴ桢���̿ռ�

����

Kubernetes ���

-

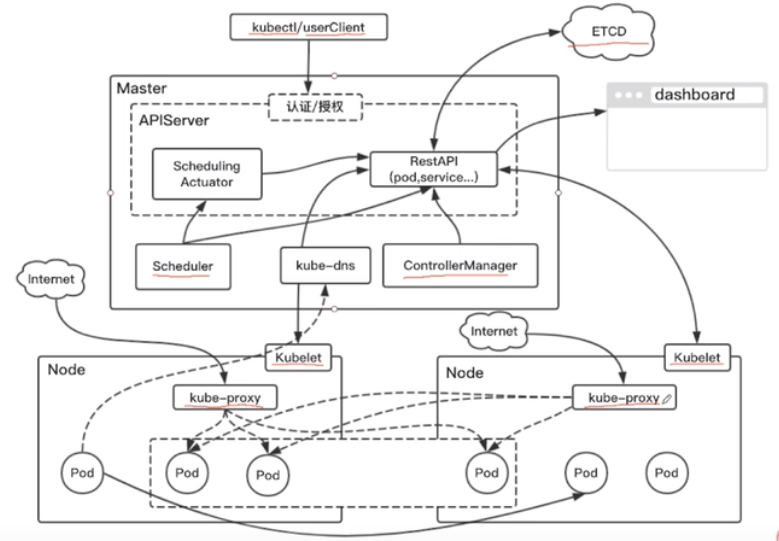

����ƽ�����(Control Plane Components)

- kube-apiserver:�ṩ�� Kubernetes API��ͳһ���,�� Kubernetes �������ǰ��,�ṩ HTTP API,�Թ��û�����Ⱥ�еIJ�ͬ���ֺͼ�Ⱥ�ⲿ����ͨ��,���Բ�ѯ�Ͳ��� Kubernetes API �ж���(����:Pod��Namespace��ConfigMap �� Event)��״̬,�ֲ���������ͨ��kubectl�����нӿڻ� ����kubeadm���������й�����ִ��, ��Щ�����ڱ���Ҳ�ǵ��� API,Ҳ����ʹ�� REST ������������Щ API����ʹ�ÿͻ��˿�

- etcd:���һ���Ժ߿����Եķֲ�ʽ��ֵ���ݿ�,���ڱ��� Kubernetes ���м�Ⱥ��״̬����Pod��Deployment��Service��

- kube-scheduler:��������´����ġ�δָ�����нڵ��pod,�����ѡ�� Pod ����Щ�ڵ�������,�����ڵ��������������������˵��������

- kube-controller-manager:���ڼ�Ⱥ��ء�����ת�Ƶ�,ִ�м�Ⱥ����Ĺ���,�縴��������ٹ������״̬���������ʧ�ܵ�

-

��ѡ���

- kube-dns:����������Ⱥ�ڲ�dns��������,���ڷDZ�Ҫ���,��ʵ������podͨ�����Ʒ���

- dashboard:�DZ���,�� Kubernetes ��Ⱥ��ͨ�õġ����� Web ���û����档 ��ʹ�û����Թ�����Ⱥ�����е�Ӧ�ó����Լ���Ⱥ���������й����ų�

- cloud-controller-manager:Ƕ���ض��ƵĿ������Ŀ���ƽ�����

-

Node ���(�ڵ������һ�������������������,�ڵ������ÿ���ڵ�������,������������������ά�����е� Pod )

- kubelet:����ڵ�������Pod������,���������ڵ��ϵ�����

- kube-proxy:���ڵ����,��Ⱥ��ÿ���ڵ������е��������,ʵ��Kubernetes ��Serviceӳ�����

- ��������ʱ:�ṩ Kubernetes ���л���ʵ�������������������docker��containerd��CRI-O

-

������(����docker������֮��ͨ����Ҫ����ʵ��CNI�IJ��)

- ������� Pod ����������������ӿ�(CNI),�� Pod �����ͨ��,����������Calico��Flannel��Cilium��Weave��,�ٷ����ṩ����������

����

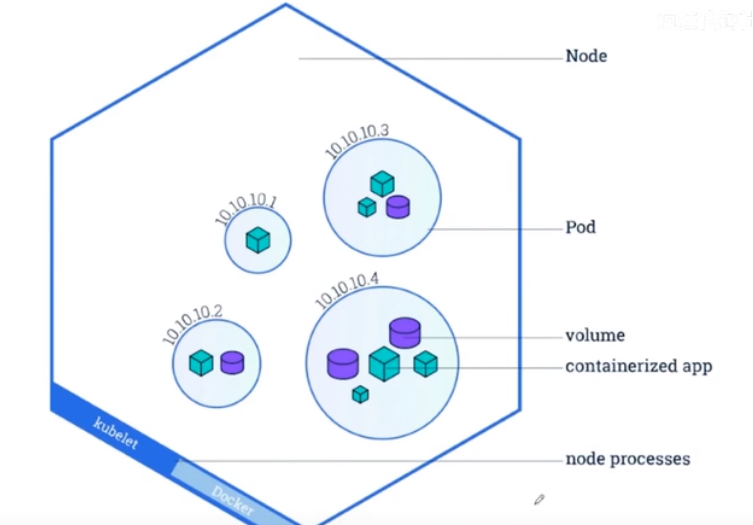

Pod

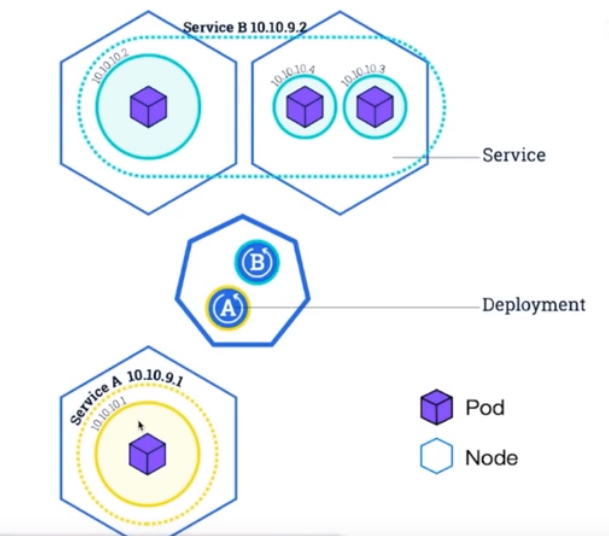

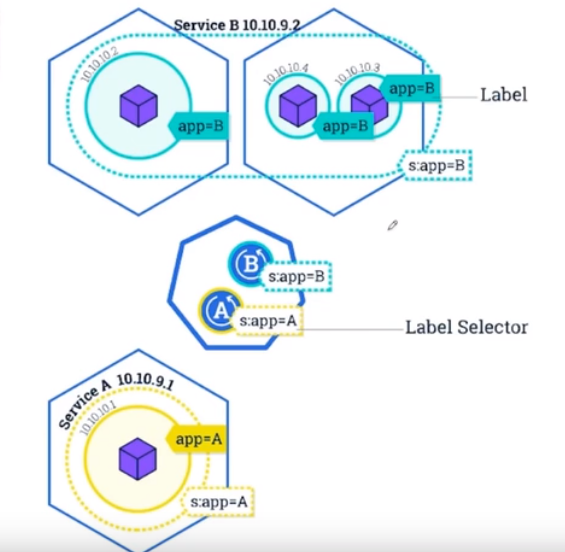

Pod �ǿ����� Kubernetes �д��������ġ���С�Ŀɲ���ļ��㵥Ԫ�͵��ȵ�λ,Pod��������һ�����߶��������Ӧ�á����غ����硣��һ���ڵ�NodeֻҪ��Դ�㹻�ǿ������к����ܶ�ܶ��pod;Pod��װ�ڽڵ���,����һ�������;���ͬһ��Pod�����������ͬһ�����������ռ�,����ʹ��localhost����ͨ��

���Pod�Ƕ��ݵ�,��ô��ô���ܳ־û���������ʹ���ܹ�������������? �ǵ�,Kubernetes֧�־��ĸ���,��˿���ʹ�ó־û��ľ����͡�

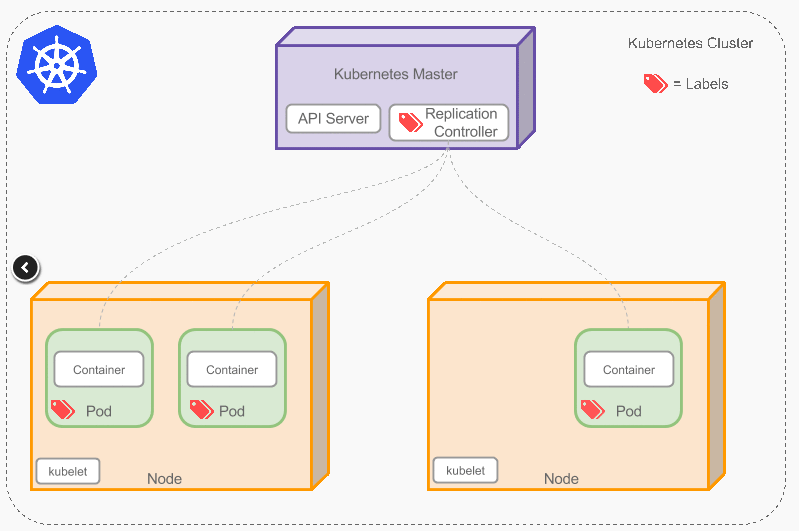

Replication Controller

�Ƿ��ֶ�����Pod,�����Ҫ����ͬһ�������Ķ�ݿ���,��Ҫһ�����ֱ�����ô?�����ֶ���������Pod,����Ҳ����ʹ��Replication Controllerʹ��Podģ�崴������ݿ�����

Replication Controllerȷ������ʱ�䶼��ָ��������Pod�������������С����Ϊij��Pod������Replication Controller����ָ��3������,���ᴴ��3��Pod,���ҳ���������ǡ����ij��Pod����Ӧ,��ôReplication Controller���滻��,��������Ϊ3�����֮ǰ����Ӧ��Pod�ָ���,���ھ���4��Pod��,��ôReplication Controller�Ὣ����һ����ֹ��������Ϊ3������������н�����������Ϊ5,Replication Controller����������2����Pod,��֤����Ϊ5���������������ķ�ʽ��СPod,���������ִ�й�������ʱ�����á�

������Replication Controllerʱ,��Ҫָ����������:

- Podģ��:��������Pod������ģ��

- Label:Replication Controller��Ҫ��ص�Pod�ı�ǩ

Deployment

deployment��pod�汾�����Ĺ���,�������ֲ�ͬ�汾��pod,��֤pod�������ͽ���;�ӿ����߽Ƕȿ�,deploymentҲ���Dz�����˼,����������Ӧ�ò�������,�������д���(��pod)֮��,��Ҫ���Ǹ��²���,��������,�ع�,�����Ȳ���

Service

Service��һ�����ĸ���,�Ƕ���һϵ��Pod�Լ�������ЩPod�IJ��Ե�һ��������Serviceͨ��Label�ҵ�Pod��;ͨ�����ڽ�һ����ͬpodӦ����һ����������IP���й���,���Pod�Ƕ��ݵ�,��ô����ʱIP��ַ���ܻ�ı�,��ô��ô���ܴ�ǰ��������ȷ�ɿ���ָ���̨������?��ʱ����ʹ��Service,Service������ʵ����һ��pod�ڲ��ķ����ֺ��ؾ���,ͨ��ÿ��Node�����еĴ���(kube-proxy)��ɡ�

����

����ʽ

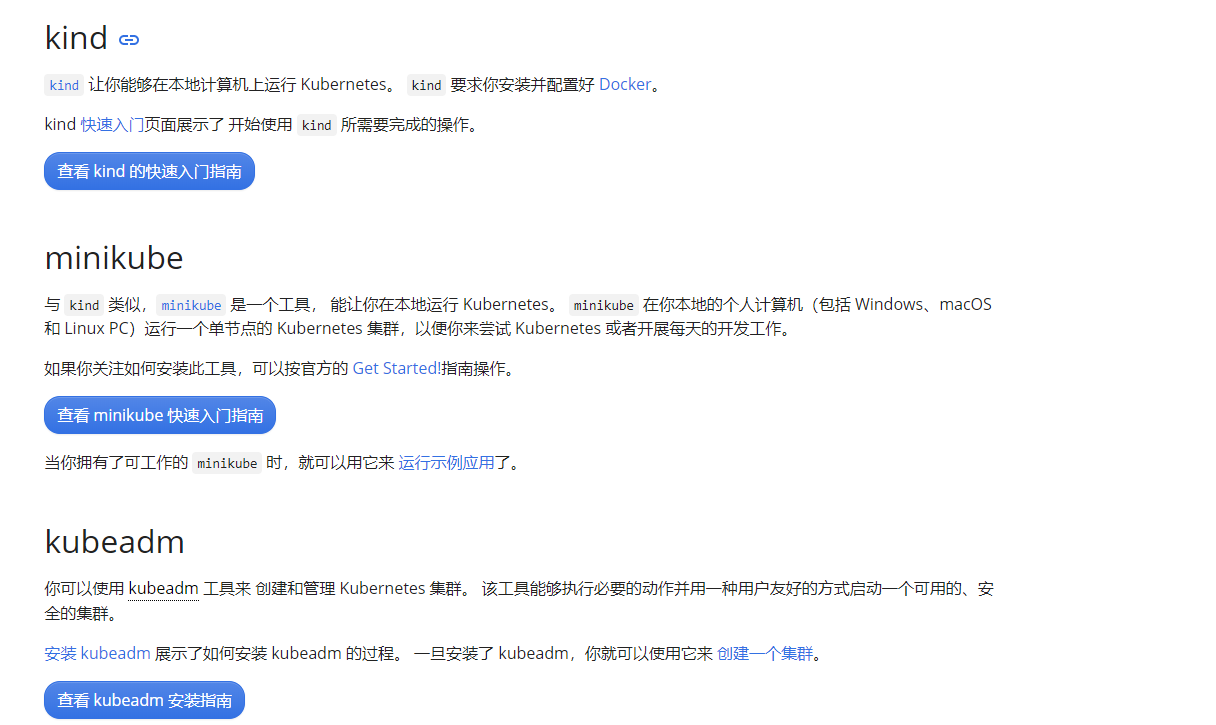

����Kubernetes��Ⱥ�ж��ַ�ʽ,����kind��minikube��kubeadm���������ļ���yum��װ�����������ߡ�kops��kubespray����Ǯ����

- kind�����ܹ��ڱ��ؼ���������� Kubernetes,һ������ѧϰʹ��

- minikube��kind����,����һ�����ڵ�� Kubernetes ��Ⱥ,Ҳ������ѧϰʹ��

- kubeadm�ù����ܹ�ִ�б�Ҫ�Ķ�������һ���û��Ѻõķ�ʽ����һ�����õġ���ȫ�ļ�Ⱥ�������,ͨ��kubeadm init��kubeadm join��������Ϳ��Դ�����Ⱥ��Ҳ�Ƚ��ʺ�ѧϰKubernetes��ά,����Ҳ�Ƚ��ȶ���������������

- �������ļ�:���ض����ư�,�ֶ�����ÿ�����,�ȽϷ���,�����ܶ�Kubernetes��������и���������̵���ʶ

- yum��װ:ͨ��yum��װÿ�����,����yumԴ�п��ܱȽ���,һ��Ҳ����ʹ��

- ����������,����GitHub��Щ�����װ��һЩ�������ڲ���Kubernetes��Ⱥ

- kops��kubespray

- ��Ǯ����:���簢���ơ���Ѷ�ƹ�����k8sƽ̨,һ���㶨

kubeadm��ʽ����

����滮

�������������Ҫ��: 2core ��2G�� 50G,������Ҫ����docker,��������centos��Ҫ��7����

���з������IJ���ϵͳ

cat /etc/redhat-release

CentOS Linux release 7.9.2009 (Core)

| ������ | IP |

|---|---|

| k8s-master2 | 192.168.50.36 |

| k8s-node-1 | 192.168.50.34 |

| k8s-node-2 | 192.168.50.35 |

�����

| ���� | IP���� | ��ע |

|---|---|---|

| service-cluster-ip | 10.10.0.0/16 | ���õ�ַ 65534 |

| pods-ip | 10.20.0.0/16 | ���õ�ַ 65534 |

| ��Ⱥdns | 10.10.0.2 | ���ڼ�Ⱥservice�������� |

| k8s svc | 10.10.0.1 | ��Ⱥ kubernetes svc ����ip |

������

���������еĽڵ�������

#����docker,�ҳ����°汾

yum list docker-ce --showduplicates | sort -r

yum list docker-ce-cli --showduplicates | sort -r

#��Ϊ���µİ汾

yum -y install docker-ce-20.10.8 docker-ce-cli-20.10.8 containerd.io

#����/etc/docker/daemon.json����Ϊ

{

"registry-mirrors": ["https://b9pmyelo.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"]

}

# ����docker

systemctl restart docker

systemctl enable docker.service

#�رշ���ǽ

systemctl stop firewalld # ��ʱ

systemctl disable firewalld # ����

#�ر� selinux

sed -i 's/enforcing/disabled/' /etc/selinux/config # ����

setenforce 0 # ��ʱ

#�ر� swap

swapoff -a # ��ʱ

vim /etc/fstab # ����

#��������

hostnamectl set-hostname <hostname>

#���� hosts

cat >> /etc/hosts << EOF

192.168.50.34 k8s-node-1

192.168.50.35 k8s-node-2

192.168.50.36 k8s-master-2

EOF

#ʹ�Ž�������iptables�ɼ�,���Žӵ� IPv4 �������ݵ� iptables ����

cat <<EOF > /etc/sysctl.d/k8s.conf

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

EOF

sysctl --system

#ʱ��ͬ��

yum install ntpdate -y

ntpdate time.windows.com

# ʹ�ñ�������������������װ kubectl �������ļ�

cat <<EOF > /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/

enabled=1

gpgcheck=1

repo_gpgcheck=1

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

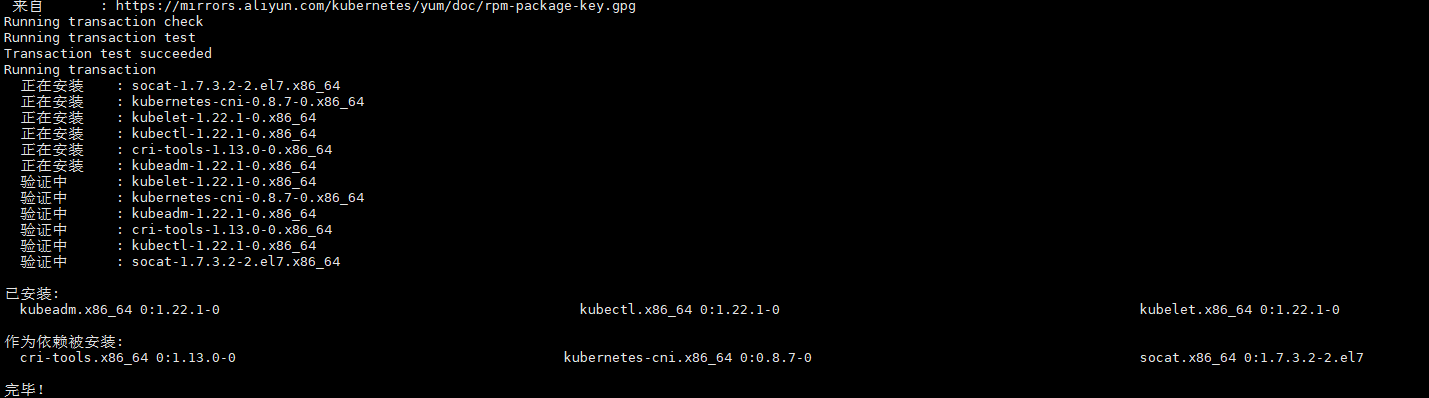

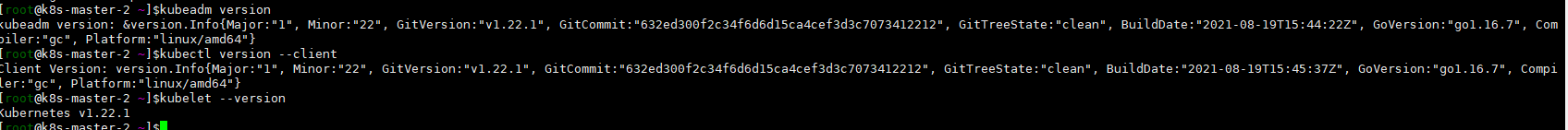

#��װ kubeadm,kubelet �� kubectl

yum install -y kubelet-1.22.1 kubeadm-1.22.1 kubectl-1.22.1

systemctl enable kubelet

�鿴�Ѱ�װ�汾��Ϣ

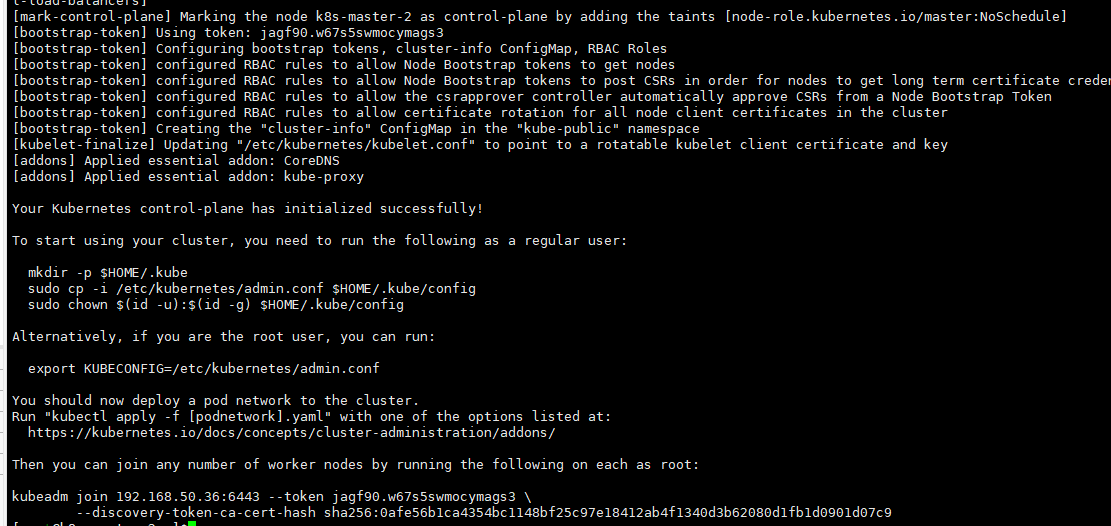

kubeadm init --kubernetes-version=1.22.1 \

--apiserver-advertise-address=192.168.50.36 \

--ignore-preflight-errors=all \

--image-repository registry.aliyuncs.com/google_containers \

--service-cidr=10.10.0.0/16 \

--pod-network-cidr=10.20.0.0/16

�����������ʾ��Ϣ��������

kubectl get nodesmkdir -p $HOME/.kube

cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

chown $(id -u):$(id -g) $HOME/.kube/config

#��������Ǻ�����node�ڵ����k8s��Ⱥ������

kubeadm join 192.168.50.36:6443 --token jagf90.w67s5swmocymags3 \

--discovery-token-ca-cert-hash sha256:0afe56b1ca4354bc1148bf25c97e18412ab4f1340d3b62080d1fb1d0901d07c9

# ����Ҫ��������token�������ɼ��뼯Ⱥ�����ʹ���������

kubeadm token create --print-join-command

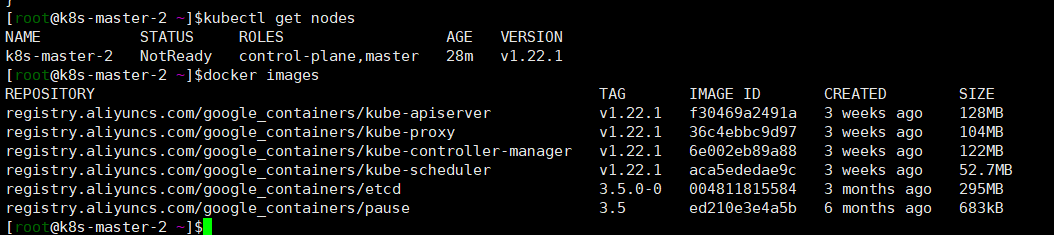

#�鿴��ǰ��Ⱥ�ڵ���Ϣ,Ŀǰ��Ⱥ�����绹û�д�ͨ,���״̬ΪNotReady

kubectl get nodes

#�鿴��ǰ�ڵ��docker����,kubeadm����ʽ����docker����ʽ���м�Ⱥ

docker images

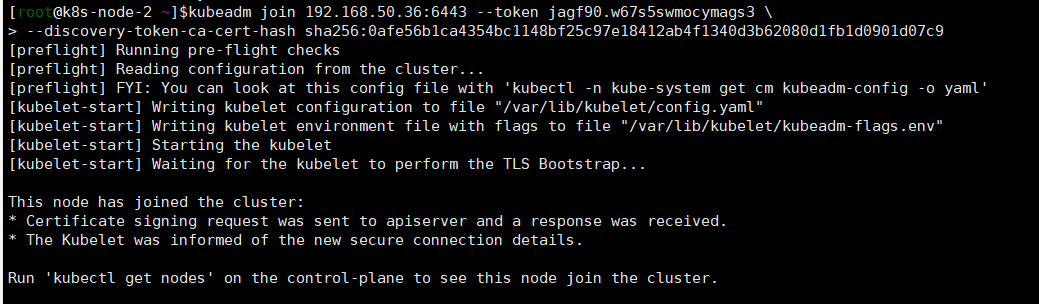

�ֱ�����̨node�ڵ�192.168.50.34��192.168.50.35ִ�м�k8s��Ⱥ������

kubeadm join 192.168.50.36:6443 --token jagf90.w67s5swmocymags3 \

--discovery-token-ca-cert-hash sha256:0afe56b1ca4354bc1148bf25c97e18412ab4f1340d3b62080d1fb1d0901d07c9

#ʹkubectl�Զ���ȫ

source <(kubectl completion bash)

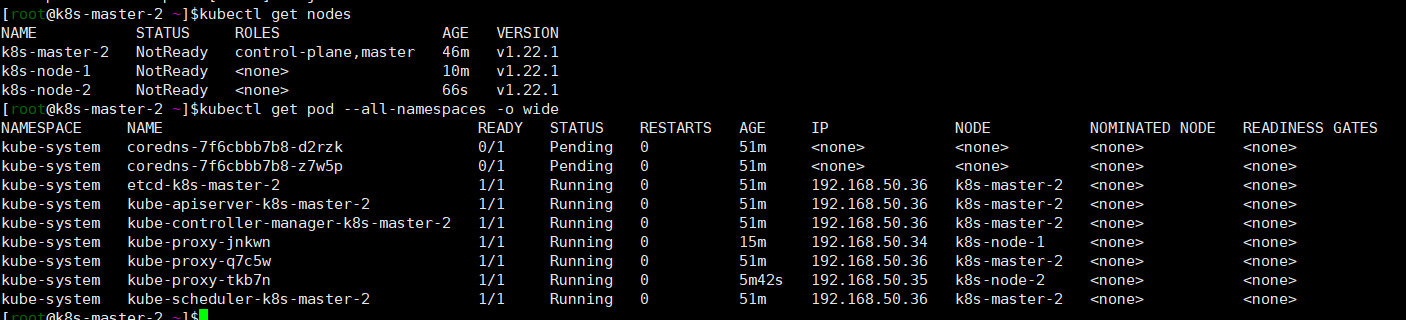

# ��ѯĿǰ�����ڵ����Ϣ����

kubectl get nodes

kubectl get pod --all-namespaces -o wide

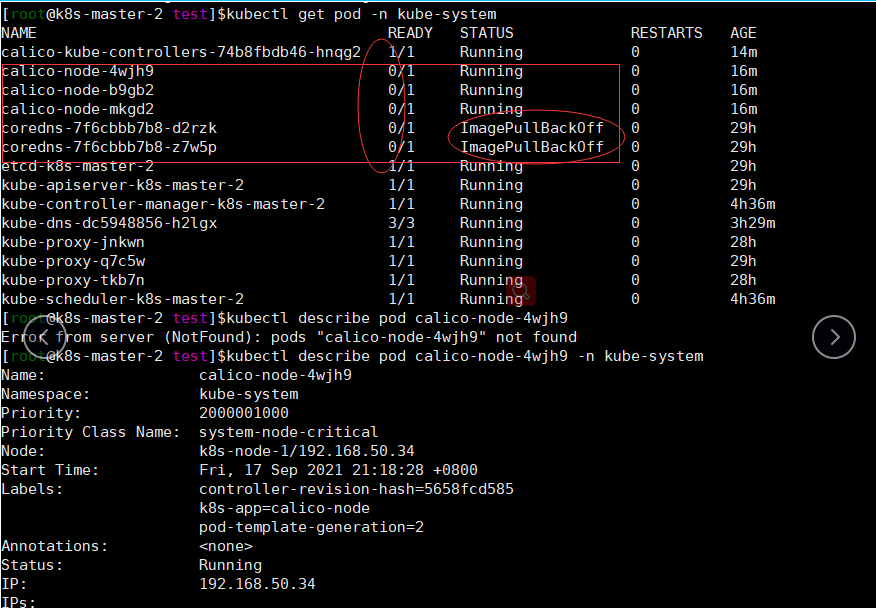

��������Ҫ��k8s��Ⱥ����CNI������,�кܶʽ,�������ṩ����

#calico����

kubectl apply -f https://docs.projectcalico.org/manifests/calico.yaml

#����ѡ��kube-flannel����

kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

#�������Ӻ��ٲ鿴�ڵ��״̬

[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-i0IVWXfV-1631893698870)(image-20210916170305883.png)]

ͨ������pod����ϸ��Ϣ��������

#calico.yaml����������

wget https://docs.projectcalico.org/manifests/calico.yaml

#calico.yaml����������Ϣ - name: IP_AUTODETECTION_METHOD value: "interface=ens.*",interface�������ʵ��,�ҵĻ���������ens160����ֱ����

# Cluster type to identify the deployment type

- name: CLUSTER_TYPE

value: "k8s,bgp"

- name: IP_AUTODETECTION_METHOD

value: "interface=ens160"

# Auto-detect the BGP IP address.

- name: IP

value: "autodetect"

#����Ӧ��calico.yaml

kubectl apply -f calico.yaml

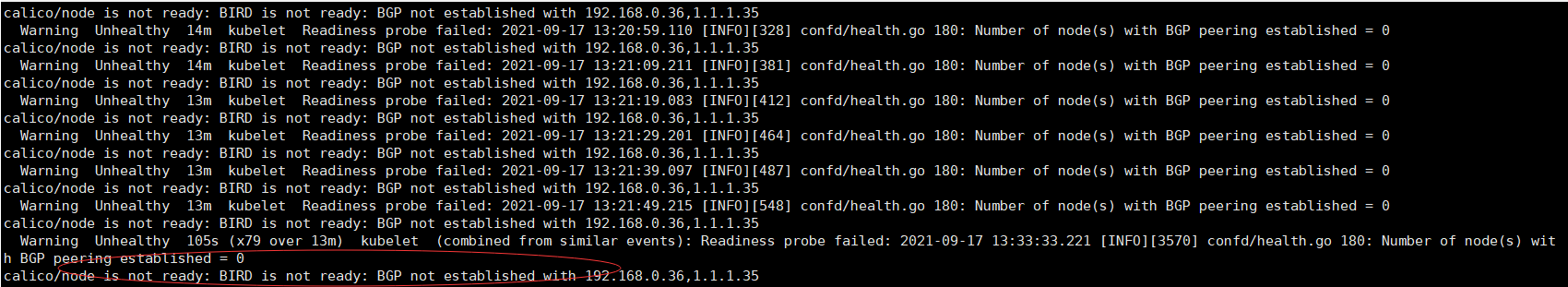

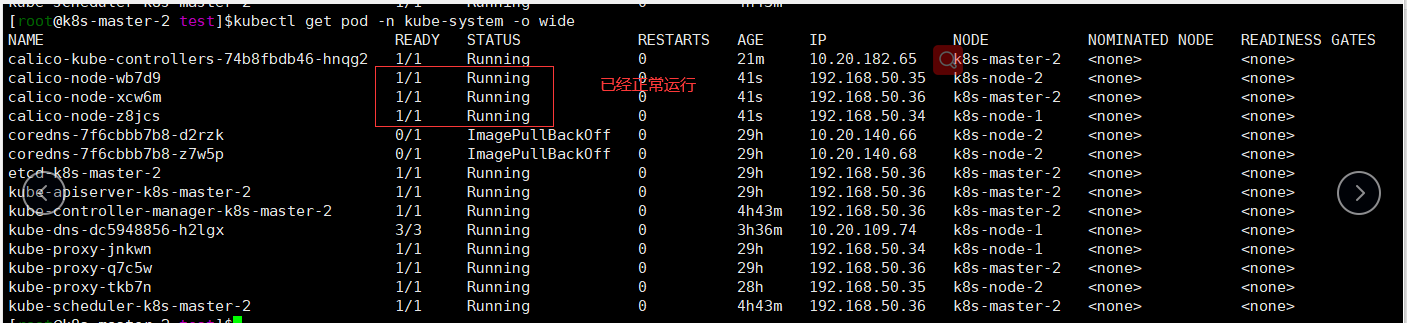

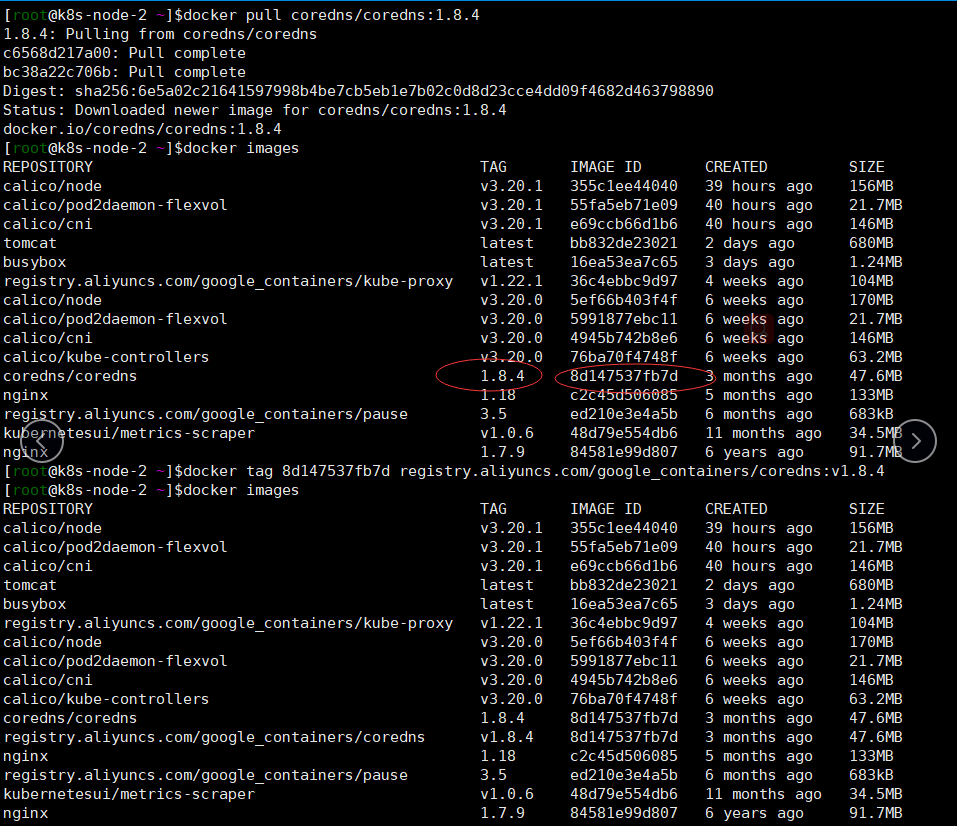

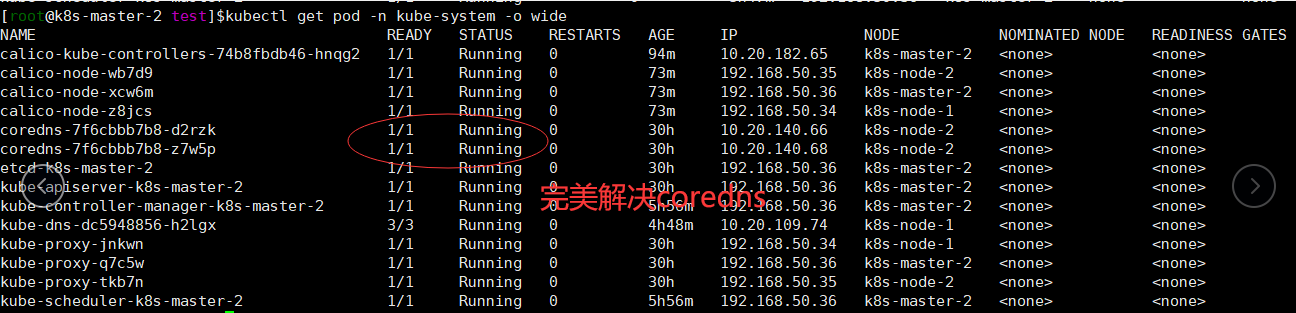

�����������coredns��ImagePullBackOff������

#�鿴coredns pod�ľ���

kubectl get pods coredns-7f6cbbb7b8-d2rzk -n kube-system -o yaml | grep image

#��ʾ��Ϣ����

image: registry.aliyuncs.com/google_containers/coredns:v1.8.4

imagePullPolicy: IfNotPresent

- image: registry.aliyuncs.com/google_containers/coredns:v1.8.4

imageID: ""

message: Back-off pulling image "registry.aliyuncs.com/google_containers/coredns:v1.8.4"

#����registry.aliyuncs.com/google_containers/coredns:v1.8.4�ٷ���û�е�,�ٷ�������coredns/coredns:1.8.4

#��coredns�ڵ���Ҳ����k8s-node-2Ҳ����192.168.50.35�������ؾ���

docker pull coredns/coredns:1.8.4

#�鿴coredns/coredns:1.8.4�����imageid,�������ֶ���tagΪregistry.aliyuncs.com/google_containers/coredns:v1.8.4

docker tag 8d147537fb7d registry.aliyuncs.com/google_containers/coredns:v1.8.4

������������

1. ���뼯Ⱥʱ����: /etc/kubernetes/kubelet.conf already exists

ԭ��: �ϴε������ļ�û�������ɾ�,ɾ������

rm -rf /etc/kubernetes/kubelet.conf /etc/kubernetes/pki/ca.crt

2. ���뼯Ⱥʱ����: [ERROR Port-10250]: Port 10250 is in use

ԭ��:�ϴμ���û�гɹ��رա�����kubeadm

kubeadm reset

3. ���뼯Ⱥ����:/proc/sys/net/ipv4/ip_forward contents are not set to 1

echo "1" >/proc/sys/net/ipv4/ip_forward

��������ʽ����

����滮

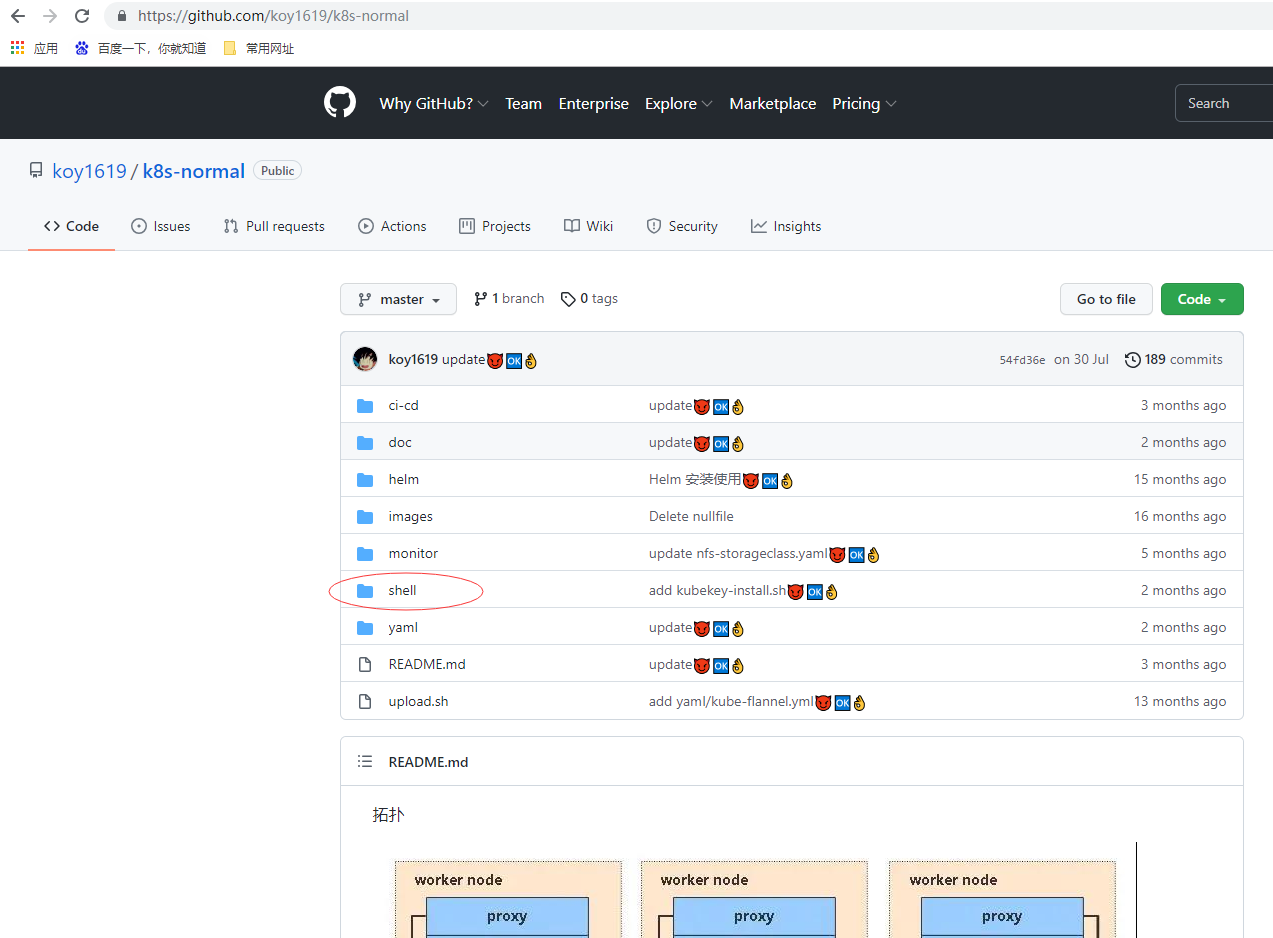

GitHub������kubernetes������,ѡ��һ�����µĽ��в���

GitHub kubernetes��Ⱥ����,����Դ���ļ�

�������������Ҫ��: 2core ��2G�� 50G,������Ҫ����docker,��������centos��Ҫ��7����

���з������IJ���ϵͳ

cat /etc/redhat-release

CentOS Linux release 7.9.2009 (Core)

�������滮

| ������ | IP |

|---|---|

| k8s-master1 | 192.168.50.33 |

| k8s-node-1 | 192.168.50.34 |

| k8s-node-2 | 192.168.50.35 |

| nginx-ingress-slb | 192.168.50.36 |

�����

| ���� | IP���� | ��ע |

|---|---|---|

| service-cluster-ip | 10.10.0.0/16 | ���õ�ַ 65534 |

| pods-ip | 10.20.0.0/16 | ���õ�ַ 65534 |

| ��Ⱥdns | 10.10.0.2 | ���ڼ�Ⱥservice�������� |

| k8s svc | 10.10.0.1 | ��Ⱥ kubernetes svc ����ip |

����汾

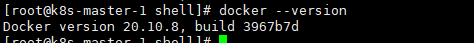

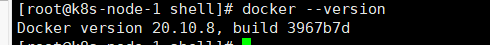

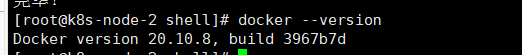

- Docker CE version 20.10.8

- Kubernetes Version 1.22.1

- Etcd Version v3.5.0

��Ⱥ˵��

- ��������ʹ�� CentOS Linux release 7.9.2009 (Core) �汾,�����ں˶�����5.x�汾��

- kube-proxy ʹ�� ipvs ģʽ(Ԥ��iptablesģʽ)

- Calico ʹ�� IPIP ģʽ

- ��Ⱥ��ʹ��Ĭ�� svc.cluster.local

- 10.10.0.1 Ϊ��Ⱥ kubernetes svc ����ip

- haproxy����TCP����nginx-ingress��svc�˿�,ʵ��ingress�߿���

- nginx-ingress��˻�ȡ�ͻ�����ʵIP

������

- ��ʼ��

- �ر� firewalld

- �ر� swap

- �ر� Selinux

- ���ں˲���

- Ԥ������ PATH

- ����hostname

- �ж��ں˲�����

- ��װdocker

- ֤������

- ��cfssl֤�����ɹ���

- ��ǩTLS֤��,metrics-server ֤��

- ����Etcd��Ⱥ

- ��Github����Etcd�������ļ���k8s������,��ѹk8s�����ư�

- ����master�ϵ�ssl֤�鵽node

- ����kubeconfig

- ��������etcd

- �������

- ����Master Node

- ����kube-apiserver

- ����kube-controller-manager

- ����kube-scheduler

- ����kubelet֤���Զ����ںʹ���Node��Ȩ�û�

- ��kubelet֤�����벢���뼯Ⱥ

- ����Worker Node

- ��������Ŀ¼�������������ļ�

- ����master�ϵ�ssl֤�鵽node

- ����kubelet

- ����kube-proxy

�Ƚ�k8s-normal-master.zip�ļ��ϴ���master��node�ڵ��ϲ���ѹ,����ڵ��Ѱ�װdocker��ִ��ж���ϰ汾

yum remove docker \

docker-client \

docker-client-latest \

docker-common \

docker-latest \

docker-latest-logrotate \

docker-logrotate \

docker-engine

��shell�ļ��������init.sh�ű��ļ�,���������������ط�

#��host��������

echo "192.168.50.33 k8s-master-1" >> /etc/hosts

echo "192.168.50.34 k8s-node-1" >> /etc/hosts

echo "192.168.50.35 k8s-node-2" >> /etc/hosts

#�ҳ����°汾

yum list docker-ce --showduplicates | sort -r

yum list docker-ce-cli --showduplicates | sort -r

#��Ϊ���µİ汾

yum -y install docker-ce-20.10.8 docker-ce-cli-20.10.8 containerd.io

#����hosts���ֶ���,������init

#master-1�ڵ���ִ��

sh init.sh k8s-master-1

#node1�ڵ���ִ��

sh init.sh k8s-node-1

#node2�ڵ���ִ��

sh init.sh k8s-node-2

����,��̨��������docker��װ�Ѱ�װ���

֤������ִ�в���

��mktls.sh����hostsΪ���Dz���ڵ�host

cat > server-csr.json <<EOF

{

"CN": "kubernetes",

"hosts": [

"127.0.0.1",

"192.168.50.33",

"192.168.50.34",

"192.168.50.35",

"10.10.0.1",

"kubernetes",

"kubernetes.default",

"kubernetes.default.svc",

"kubernetes.default.svc.cluster",

"kubernetes.default.svc.cluster.local"

],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "BeiJing",

"ST": "BeiJing",

"O": "k8s",

"OU": "System"

}

]

}

EOF

#��master�ڵ���ִ��

sh mktls.sh

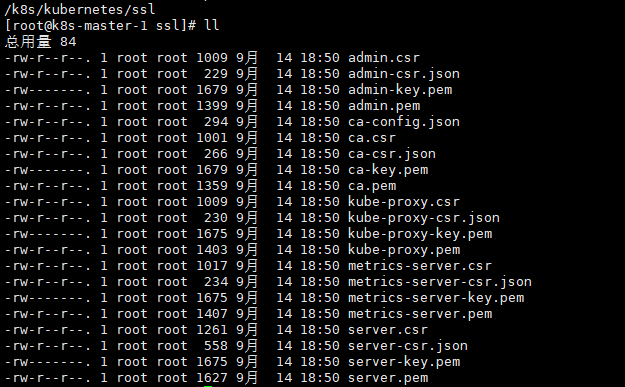

# �����ɵ�֤����ص��ļ�copy������node������

scp -r /k8s/kubernetes/ssl/* root@192.168.50.34:/k8s/kubernetes/ssl

scp -r /k8s/kubernetes/ssl/* root@192.168.50.35:/k8s/kubernetes/ssl

����Etcd��Ⱥִ�в���

��etcd_install.sh�ű�etcd�汾Ϊ���µ�v3.5.0

# ��Ϊetcd���°汾

wget https://github.com/etcd-io/etcd/releases/download/v3.5.0/etcd-v3.5.0-linux-amd64.tar.gz

tar zxvf etcd-v3.5.0-linux-amd64.tar.gz

cd etcd-v3.5.0-linux-amd64

# master�ڵ���ִ��

sh etcd_install.sh

# master�ڵ㴴��Ŀ¼

mkdir /opt/package-k8s

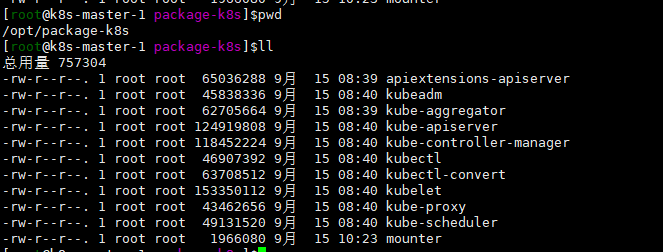

# �����ж������ļ����ص���Ŀ¼��

cd /opt/package-k8s

# cpoy ִ���ļ��� /opt/kubernetes/bin Ŀ¼,���������ļ����ӿ�ִ�е�Ȩ��

cp -a kube-apiserver kube-controller-manager kube-scheduler kubectl kubelet kube-proxy /k8s/kubernetes/bin

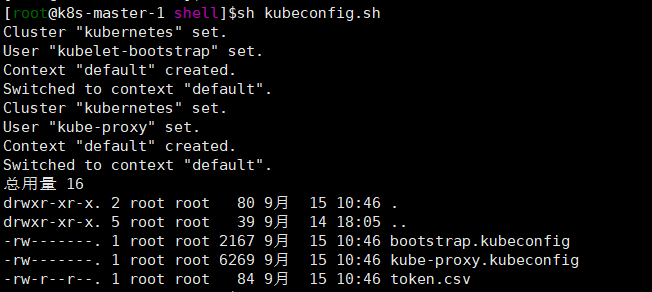

# ��kubeconfig.sh��������,����ʵ�������KUBE_APISERVER��ַ

export KUBE_APISERVER="https://192.168.50.33:6443"

#ִ�����ýű�

sh kubeconfig.sh

#����Ŀ¼�����нڵ���

scp -r /k8s/* root@192.168.50.34:/k8s/

scp -r /k8s/* root@192.168.50.35:/k8s/

# master�ڵ���ִ��etcd��������

sh etcd_conf.sh etcd01 192.168.50.33 etcd01=https://192.168.50.33:2380,etcd02=https://192.168.50.34:2380,etcd03=https://192.168.50.35:2380

# node1�ڵ���ִ��etcd��������

sh etcd_conf.sh etcd02 192.168.50.34 etcd01=https://192.168.50.33:2380,etcd02=https://192.168.50.34:2380,etcd03=https://192.168.50.35:2380

# node2�ڵ���ִ��etcd��������

sh etcd_conf.sh etcd03 192.168.50.35 etcd01=https://192.168.50.33:2380,etcd02=https://192.168.50.34:2380,etcd03=https://192.168.50.35:2380

# etcd�������

ETCDCTL_API=3 /k8s/etcd/bin/etcdctl --write-out=table \

--cacert=/k8s/kubernetes/ssl/ca.pem --cert=/k8s/kubernetes/ssl/server.pem --key=/k8s/kubernetes/ssl/server-key.pem \

--endpoints=https://192.168.50.33:2379,https://192.168.50.34:2379,https://192.168.50.35:2379 endpoint health

����Master Nodeִ�в���

��apiserver.sh������

#ȥ��kubelet-https

--kubelet-https=true \\

##����service-accoun����

--service-account-issuer=kubernetes.default.svc \\

--service-account-signing-key-file=/k8s/kubernetes/ssl/ca-key.pem \\

ȥ��controller-manager.sh�����ݨCfeature-gates=RotateKubeletClientCertificate=true \

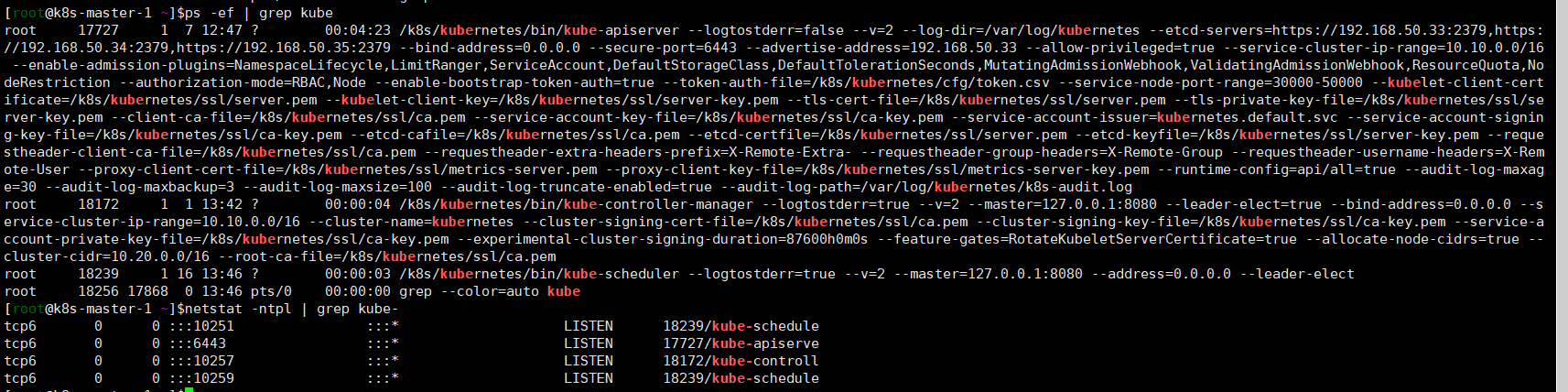

#master�ڵ�����apiserver

sh apiserver.sh 192.168.50.33 https://192.168.50.33:2379,https://192.168.50.34:2379,https://192.168.50.35:2379

#master�ڵ�����controller-manager

sh controller-manager.sh 127.0.0.1

#master�ڵ�����scheduler

sh scheduler.sh 127.0.0.1

# �鿴master���������Ƿ���������

ps -ef | grep kube

netstat -ntpl | grep kube-

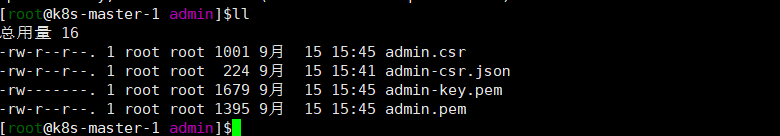

��admin֤������ admin-csr.json,���� adminĿ¼

{

"CN": "admin",

"hosts": [],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "Beijing",

"L": "XS",

"O": "system:masters",

"OU": "System"

}

]

}

ʹ�ø�֤��(ca.pem)ǩ��admin֤��

cfssl gencert \

-ca=/k8s/kubernetes/ssl/ca.pem \

-ca-key=/k8s/kubernetes/ssl/ca-key.pem \

-config=/k8s/kubernetes/ssl/ca-config.json \

-profile=kubernetes admin-csr.json | cfssljson -bare admin

#ָ��apiserver�ĵ�ַ��֤��λ��(ip������)

kubectl config set-cluster kubernetes \

--certificate-authority=/k8s/kubernetes/ssl/ca.pem \

--embed-certs=true \

--server=https://192.168.50.36:6443

#���ÿͻ�����֤����,ָ��admin֤�����Կ

kubectl config set-credentials admin \

--client-certificate=/k8s/kubernetes/ssl/admin/admin.pem \

--embed-certs=true \

--client-key=/k8s/kubernetes/ssl/admin/admin-key.pem

#�����û��ͼ�Ⱥ

kubectl config set-context kubernetes \

--cluster=kubernetes --user=admin

#���õ�ǰ������

kubectl config use-context kubernetes

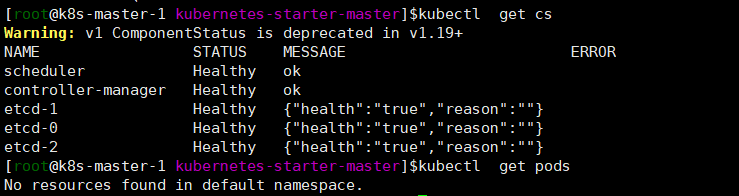

#�鿴�����״̬������

kubectl get cs

#�鿴pod

kubectl get pods

��ʱ�ȵ�����,�������������ʱ�������ټ���,��ƪ������Ҫ����ѧϰ����Ͳ���ʵս

�������Ų���ʵս

nginx����ʾ��

���������������èChelp������ܵ�������鿴,�������deployment����,��ȻҲ���Ե�������pod,������ʵ�ʳ�����Ƚ�����

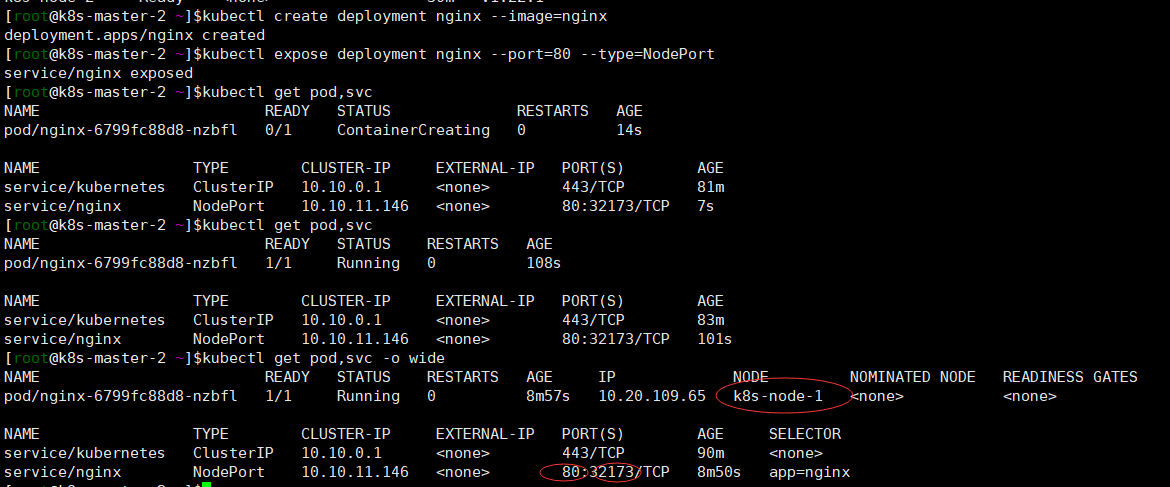

#����nginx����

kubectl create deployment nginx --image=nginx

#��¶�˿� type���Ϳ����ж���

kubectl expose deployment nginx --port=80 --type=NodePort

#�鿴pods��services����Ϣ,��������д,������д���Բ�ѯ--help����,������deployment��дΪdeploy,��Ӧ�������ǿ���ʹ��,һ��ʹ�ü�д

kubectl get pod,svc -o wide

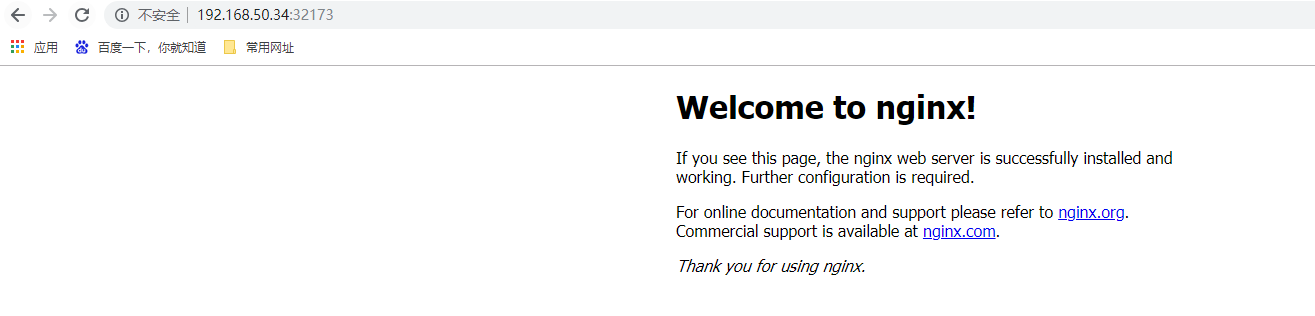

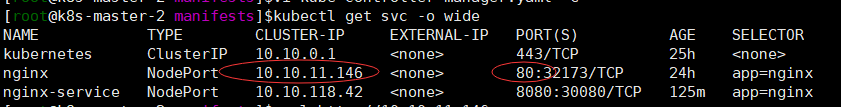

�����м���Ip�Ͷ˿���Ҫ�����¡�k8s-node-1��ip��192.168.50.34,�������ϵĶ˿�Ϊ32173,�������ǿ���ͨ��http://192.168.50.34:32173 ���ʵ����pod��¶�ķ���

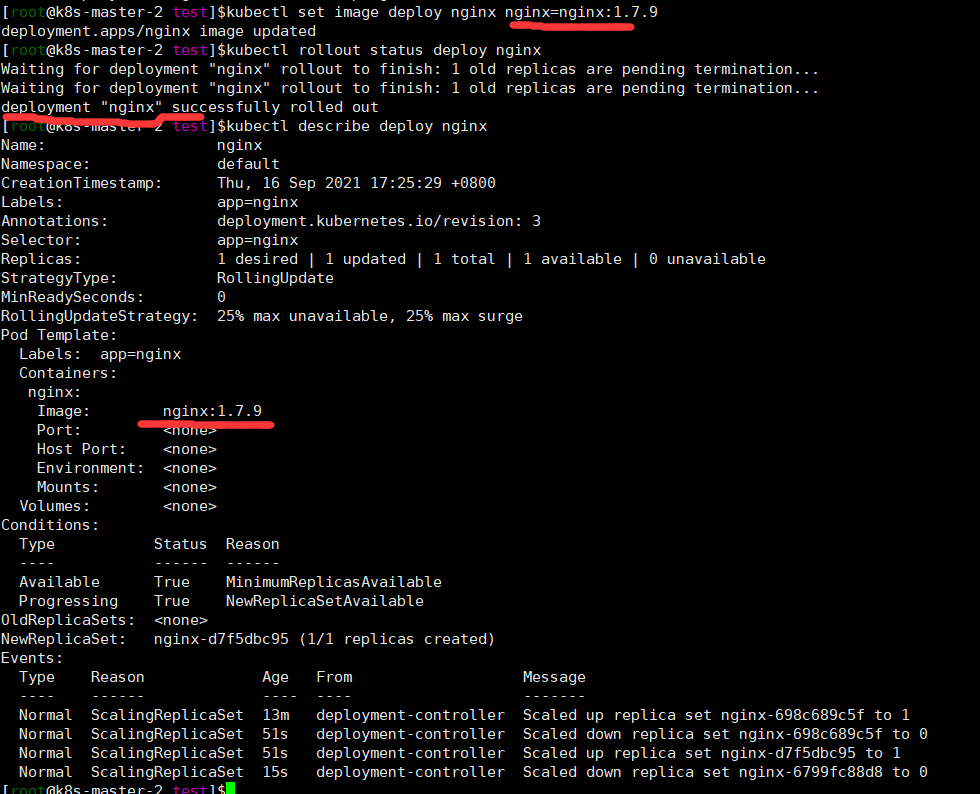

#���¾���汾

kubectl set image deploy nginx nginx=nginx:1.7.9

#�鿴����״̬

kubectl rollout status deploy nginx

#describe��ʾ�ض���Դ����Դ�����ϸ��Ϣ,������ʾnginx������ϸ��Ϣ

kubectl describe deploy nginx

#���˵���һ�εİ汾

kubectl rollout undo deploy nginx

#�鿴deployment����Ķ�Ӧ�汾

kubectl rollout history deploy nginx

#�鿴deployment����Ķ�Ӧ�汾��ϸ��

kubectl rollout history deploy nginx --revision=7

#�ع���ָ���İ汾

kubectl rollout undo deploy nginx --to-revision=7

# kubectl proxy��Ҫ���ڲ���,����ͨ��

kubectl proxy

curl http://localhost:8001/api/v1/proxy/namespaces/default/pods/podname����

����������ʾ��

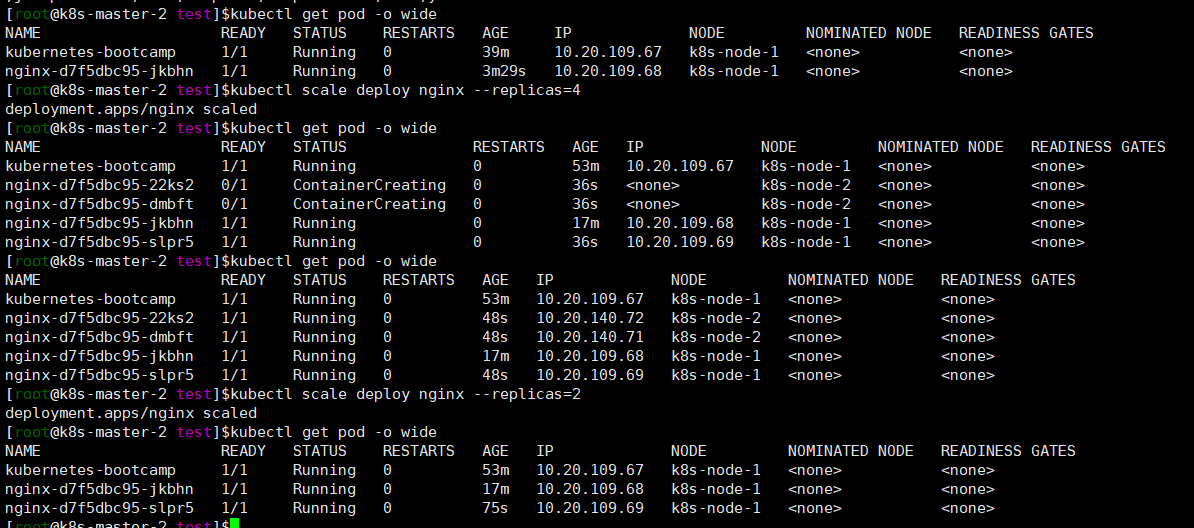

#����nginx pod����Ϊ4

kubectl scale deploy nginx --replicas=4

#�鿴pod��Ϣ,��һ�β�ѯ���k8s-node-1��pod���Ͼ���,Ӧ��k8s-node-1֮ǰ������nginx����,�ڶ���k8s-node-2�����꾵��Ҳ��������pod,k8s���Լ����㷨�ȽϾ��⽫pod�ֲ���Ⱥ�ڵ���

kubectl get pod -o wide

#����nginx pod����Ϊ2,

kubectl scale deploy kubernetes-bootcamp --replicas=2

����yaml�ļ���ʽ����

�������Ƕ��ǻ���kubectlҲ�������ʽֱ�Ӵ���deployment��pod��service,���ַ�ʽһ���Ǽ���ʹ��,���������ǻ���yaml�ļ���ʽ����

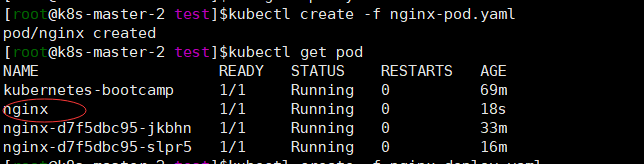

��д��������pod��yaml�ļ�nginx-pod.yaml

apiVersion: v1

kind: Pod

metadata:

name: nginx

spec:

containers:

- name: nginx

image: nginx:1.7.9

ports:

- containerPort: 80

# ͨ��create������yaml������pod,�������ʹ��apply������yaml������

kubectl create -f nginx-pod.yaml

��д����deploy��yaml�ļ�nginx-deploy.yaml,Ҳ����ֱ��ͨ��������������һ��deployment��yaml�ļ�

kubectl create deployment nginx-d1 --image=nginx:1.18 -o yaml --dry-run > nginx-deploy.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

creationTimestamp: null

labels:

app: nginx

name: nginx-deploment

spec:

replicas: 2

selector:

matchLabels:

app: nginx

strategy: {}

template:

metadata:

creationTimestamp: null

labels:

app: nginx

spec:

containers:

- image: nginx:1.18

name: nginx

resources: {}

status: {}

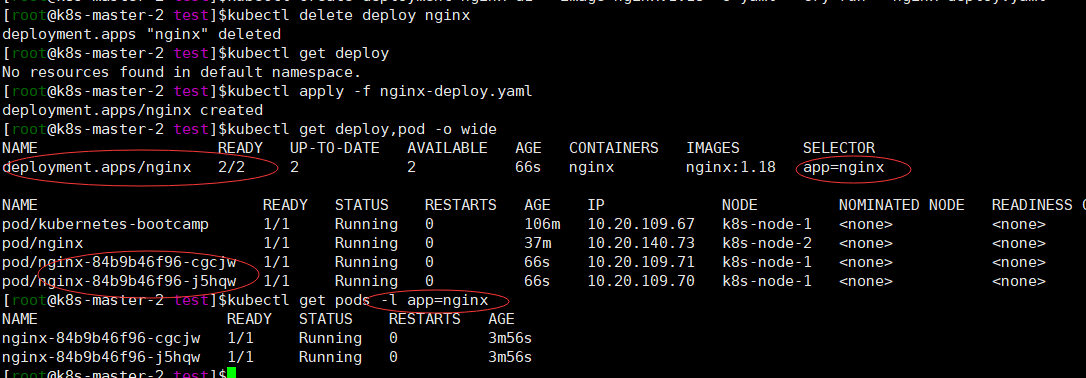

#ɾ��deployment

kubectl delete deploy nginx

# ����yaml����deployment

kubectl apply -f nginx-deploy.yaml

#�鿴labels��ǩΪapp=nginx��pod,����ѡ����Ϊapp=nginx,���Ǵ������pod,�ҵ�label,servicesҲ�Ǹ������label�ҵ�Ȼ�������ؾ���

kubectl get pods -l app=nginx

#���Բ鿴pod����־,������֮ǰdocker logsһ��

kubectl logs pod -f

���������ǿ���service����,Ҳ����kubernetes��ingress����¶Ӧ��,����nginx-service.yaml�ļ�

apiVersion: v1

kind: Service

metadata:

name: nginx-service

spec:

ports:

- port: 8080

targetPort: 80

nodePort: 30080

selector:

app: nginx

type: NodePort

#����service

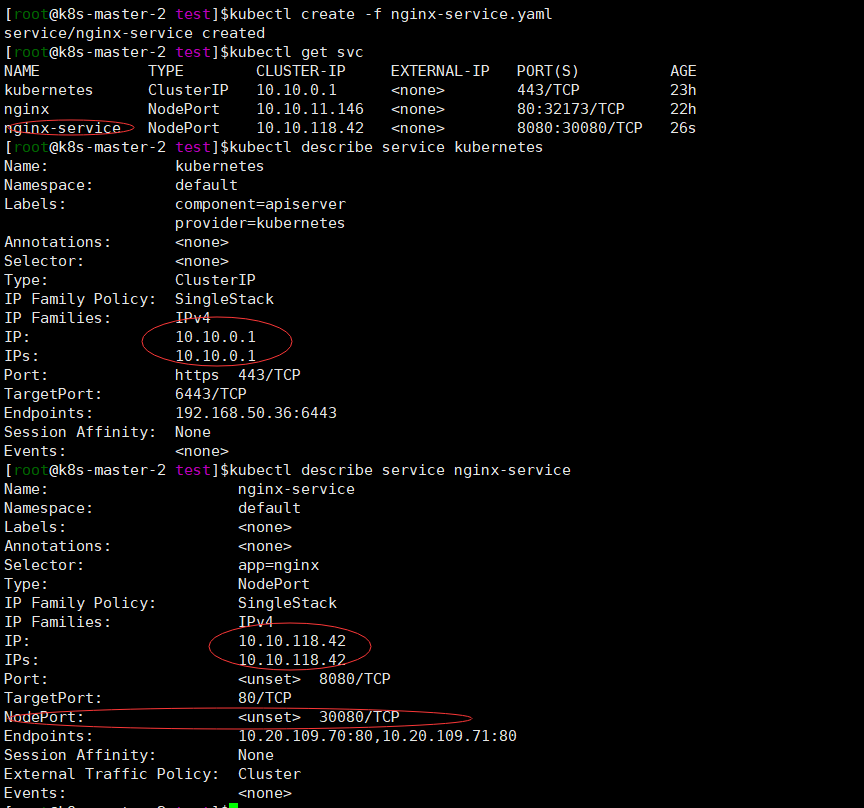

kubectl create -f nginx-service.yaml

#�鿴����service��ϸ��Ϣ,��װ��ϵͳ��һ������Ϊkubernetes��service,����൱��apiserver����һ��ip

kubectl describe service nginx-service

�м�����Ҫ�˿�����һ�����˽���

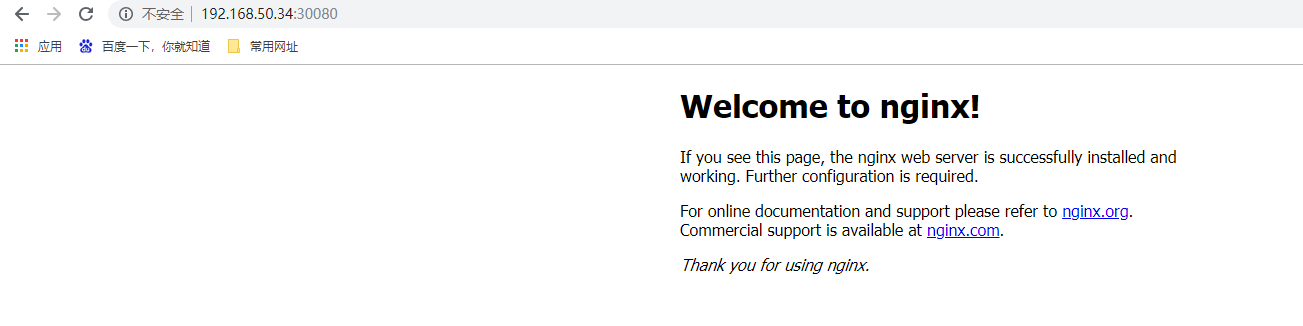

- nodePort:������ṩ����Ⱥ�ⲿ�ļ�Ⱥ���ʵ�,����������Ϊ30080������ṩ���ⲿ����,��������ֱ�ӷ���http://192.168.50.34:30080,service�ڲ�ʵ�ַ����ֺ��ؾ���

- targetPort:�����Ķ˿�,��������������ʱ��¶�˿�һ��,������֮ǰѧϰdocker����dockerfile�ļ���һ����,������������IJ��Ե�nginx,docker.io�ٷ�����¶�˿ھ���80

- port:�����kubernetes��Ⱥ�ڲ���������֮�以����ʵĶ˿�,��������mysql������Ȼ��¶3306�˿�,û������nodePort,�ⲿ��ֱ�ӷ�������,����Ⱥ�ڲ�����֮���ǿ���ͨ������mysql����

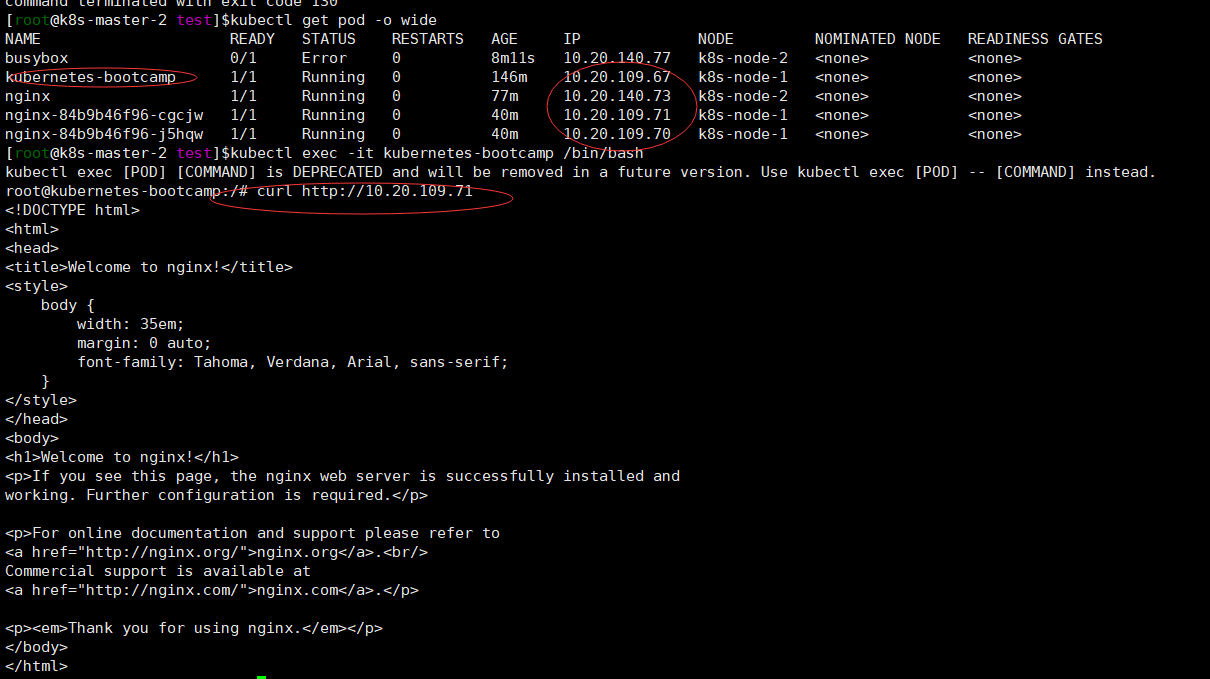

���ǿ��Խ�������һ���������в���,���ǽ��뵽kubernetes-bootcamp,Ȼ�����nginx��pod����

#����Ŀǰ�������ֻ��һ��pod

kubectl exec -it kubernetes-bootcamp /bin/bash

#����ж��pod,�Ǿ���Ҫͨ��docker�����ҵ�����������ָ����

kubectl exec -it kubernetes-bootcamp --container xxxxx /bin/bash

#����һ��װ�й�����Ļ���,һ�����ڲ���

kubectl run busybox --rm=true --image=busybox --restart=Never --tty -i

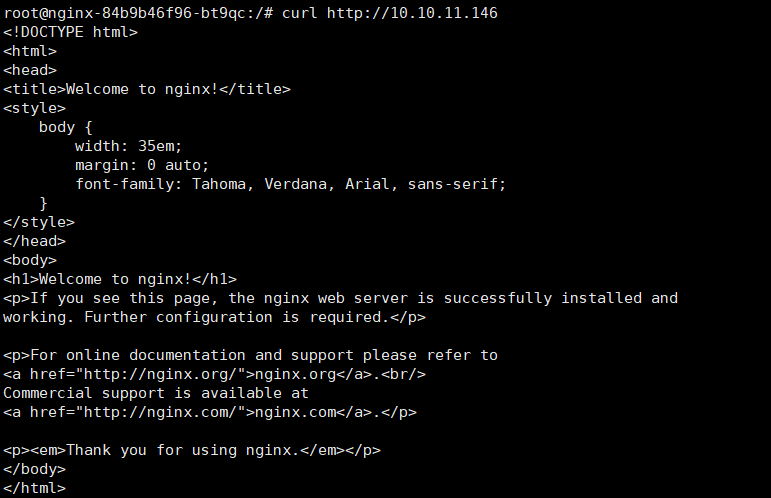

����10.20���εĵ�ַ�������ڵĵ�ַ,10.10���������ڼ�Ⱥ����ͨ�ŵĵ�ַ,Ҳ����podֱ�ӷ��� ,�������������http://10.10.11.146

����dns���ʼ�Ⱥ

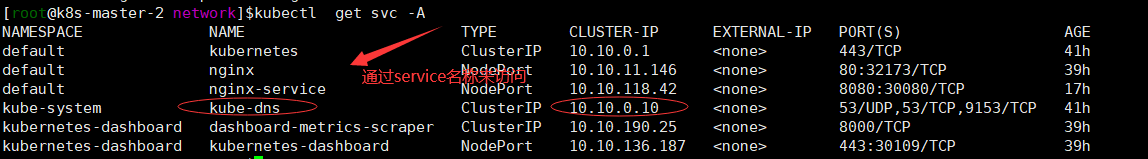

#��ѯ���������ռ��service,kube-dns��Ⱥ��ַΪ10.10.0.10,�����kubeadm����dns����

kubectl get svc -A

#������ֶ���װ���ǿ���ͨ��apply��ʽ����dns,kube-dns.yaml,���ص�ַ����������,����https://github.com/liuyi01/kubernetes-starter/blob/master/kubernetes-with-ca/services/kube-dns.yaml

kubectl apply -f kube-dns.yaml

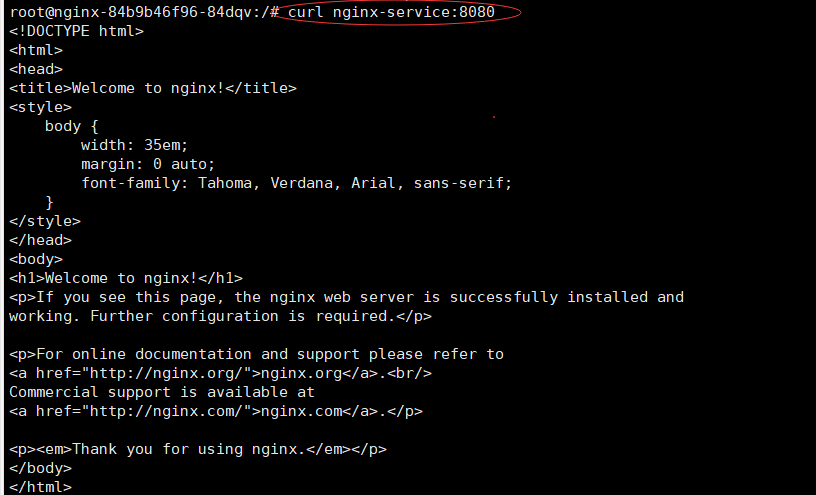

����ͨ��nginx-service���Ʒ��ʵ�nginx�ķ���

��װ�DZ���

# ���� dashboard.yaml �ļ�������,������github kubernetes dashboard��Ŀ�ϲ鿴���°汾,ĿǰU���°汾Ϊv2.3.1

wget https://raw.githubusercontent.com/kubernetes/dashboard/v2.3.1/aio/deploy/recommended.yaml

kubectl apply -f recommended.yaml

kubectl proxy

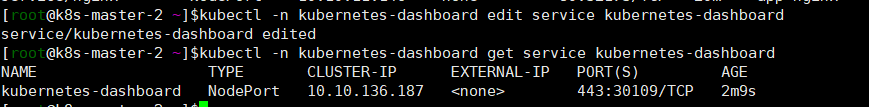

# ���ÿ������ⲿ����dashboard,�� dashboard�� nodePort ����,�༭�����ļ�

kubectl -n kubernetes-dashboard edit service kubernetes-dashboard

������

type: ClusterIP

��Ϊ

type: NodePort

#�鿴��¶�Ķ˿�

kubectl -n kubernetes-dashboard get service kubernetes-dashboard

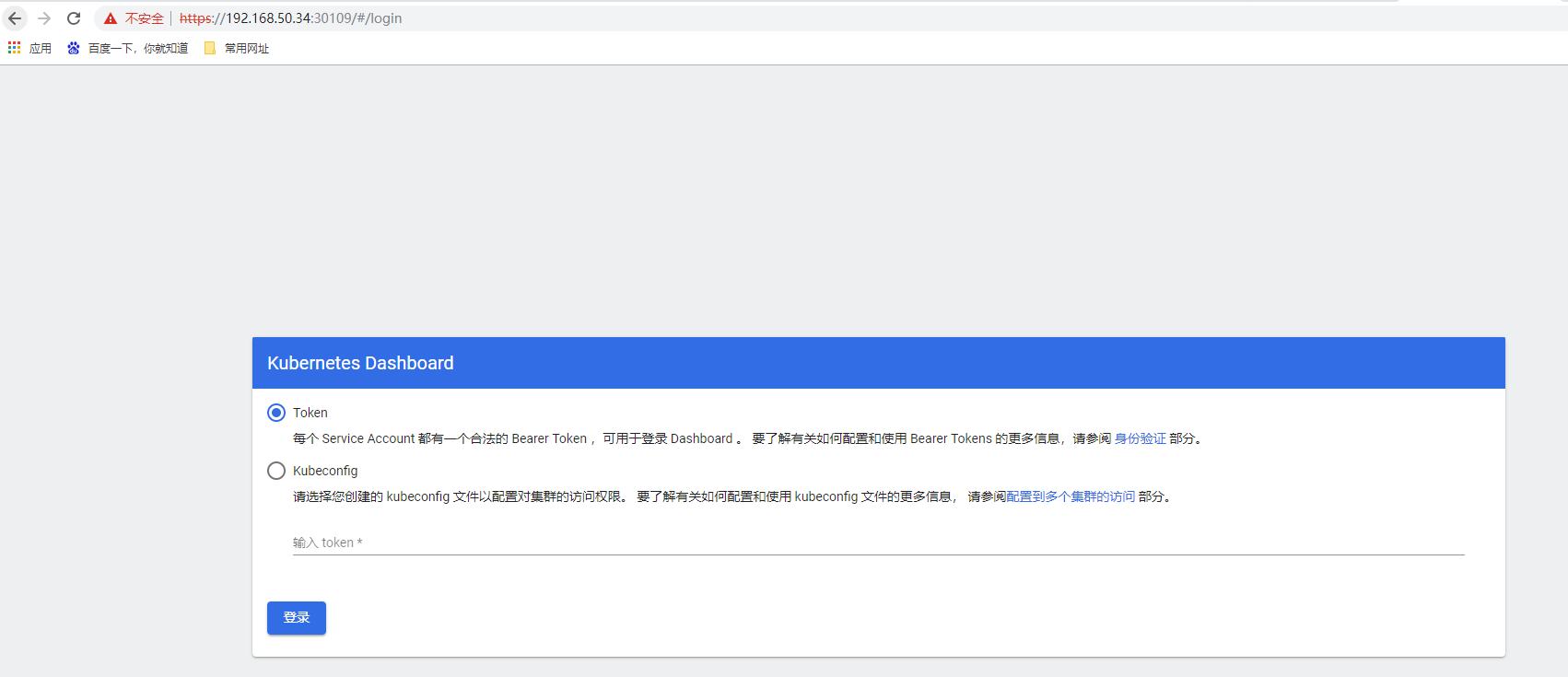

ͨ���ڵ����https://192.168.50.34:30109/#/login ҳ��

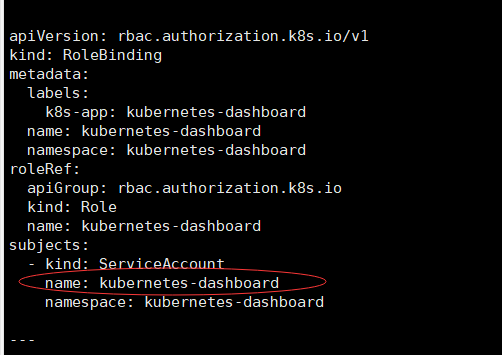

��������������recommended.yaml�ļ��������subjects,��ʾ������ kubernetes-dashbord �˻�

# Ϊ���˻�������¼ token

kubectl -n kubernetes-dashboard describe secret $(kubectl -n kubernetes-dashboard get secret | grep kubernetes-dashboard | awk '{print $1}')

Data

====

ca.crt: 1099 bytes

namespace: 20 bytes

token: eyJhbGciOiJSUzI1NiIsImtpZCI6Im5EOGxxZHFIdnFKeTRabmlicHhRNDVBZ3Y0WlR1enRLQkdoZ21EcFExLWcifQ.eyJpc3MiOiJrdWJlcm5ldGVzL3NlcnZpY2VhY2NvdW50Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9uYW1lc3BhY2UiOiJrdWJlcm5ldGVzLWRhc2hib2FyZCIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VjcmV0Lm5hbWUiOiJrdWJlcm5ldGVzLWRhc2hib2FyZC10b2tlbi1xenNiayIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VydmljZS1hY2NvdW50Lm5hbWUiOiJrdWJlcm5ldGVzLWRhc2hib2FyZCIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VydmljZS1hY2NvdW50LnVpZCI6IjcyNGQ0ODRmLTY2M2YtNGM2YS1hNGMyLTVlOTk3OTliYzczMyIsInN1YiI6InN5c3RlbTpzZXJ2aWNlYWNjb3VudDprdWJlcm5ldGVzLWRhc2hib2FyZDprdWJlcm5ldGVzLWRhc2hib2FyZCJ9.czIcgip4VJe7dEY_nulArhqKtd2Lc3JGlUrNmn4jGc2ZZ5TMeluRvv71Sztdmb-iYftWKnqil-OuCBgTFss6atShfiQ3__2i4V-vBAM1cFjBtxKZ0QgOpRvDri0hAj34XnF9uSzjH24Gt4x50OX9qaIKmJ8ppHVe0lxBWXP-Z-N4JbrKkRbD6c-EwYBhMoJo7ndUGmkxVsCvuNaE4yRfXENRaunPmGYJMgvFo4XSAz37cznNNVVj8BaIbSxgxv8XPgUEdQZxP2bm2TskVb3AYqeSVd4YR87NxYFod91IezRUBelbupaVWllJVcsEIaANfk4NNN61atWkGO9aNgyK4Q

�������token����,�����¼����

�������dz����˽�k8s��������,������ѧϰk8s�������ݡ�����configmap���߿���k8s��Ⱥ��helm�Լ���������Ⱥ�������Ų���ʵս��