k8s的数据存储

概述

在前面已经提到,容器的生命周期可能很短,会被频繁的创建和销毁。那么容器在销毁的时候,保存在容器中的数据也会被清除。这种结果对用户来说,在某些情况下是不乐意看到的。为了持久化保存容器中的数据,kubernetes引入了Volume的概念。

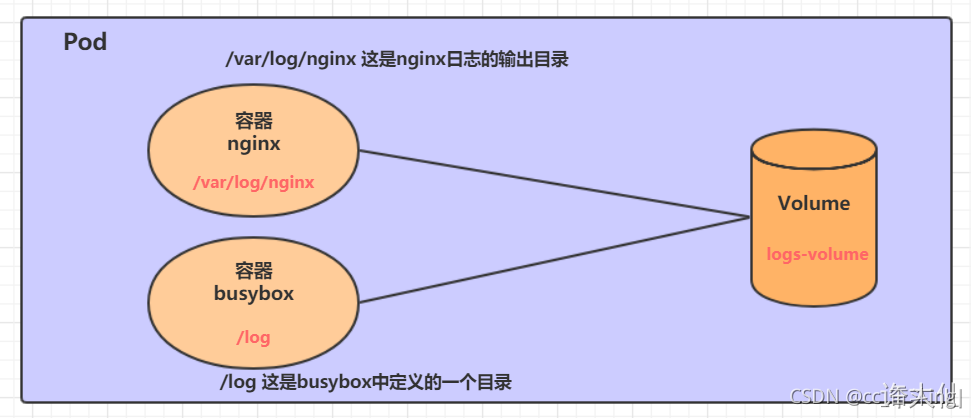

Volume是Pod中能够被多个容器访问的共享目录,它被定义在Pod上,然后被一个Pod里面的多个容器挂载到具体的文件目录下,kubernetes通过Volume实现同一个Pod中不同容器之间的数据共享以及数据的持久化存储。Volume的生命周期不和Pod中的单个容器的生命周期有关,当容器终止或者重启的时候,Volume中的数据也不会丢失。

有的Volume和Pod有关系 有的没有关系

? kubernetes的Volume支持多种类型,比较常见的有下面的几个:

- 简单存储:EmptyDir、HostPath、NFS。

- 高级存储:PV、PVC。

- 配置存储:ConfigMap、Secret。

基本存储

EmptyDir

概述

EmptyDir是最基础的Volume类型,一个EmptyDir就是Host上的一个空目录。

EmptyDir是在Pod被分配到Node时创建的,它的初始内容为空,并且无须指定宿主机上对应的目录文件,因为kubernetes会自动分配一个目录,当Pod销毁时,EmptyDir中的数据也会被永久删除。

EmptyDir的用途如下:

- 临时空间,例如用于某些应用程序运行时所需的临时目录,且无须永久保留。

- 一个容器需要从另一个容器中获取数据的目录(多容器共享目录)。

接下来,通过一个容器之间的共享案例来使用描述一个EmptyDir。

在一个Pod中准备两个容器nginx和busybox,然后声明一个volume分别挂载到两个容器的目录中,然后nginx容器负责向volume中写日志,busybox中通过命令将日志内容读到控制台。

创建Pod

? 创建volume-emptydir.yaml文件,内容如下:

apiVersion: v1

kind: Pod

metadata:

name: volume-emptydir

namespace: dev

spec:

containers:

- name: nginx

image: nginx:1.17.1

imagePullPolicy: IfNotPresent

ports:

- containerPort: 80

volumeMounts: # 将logs-volume挂载到nginx容器中对应的目录,该目录为/var/log/nginx

- name: logs-volume

mountPath: /var/log/nginx

- name: busybox

image: busybox:1.30

imagePullPolicy: IfNotPresent

command: ["/bin/sh","-c","tail -f /logs/access.log"] # 初始命令,动态读取指定文件

volumeMounts: # 将logs-volume挂载到busybox容器中的对应目录,该目录为/logs

- name: logs-volume

mountPath: /logs

volumes: # 声明volume,name为logs-volume,类型为emptyDir

- name: logs-volume

emptyDir: {}

? 创建Pod:

kubectl create -f volume-emptydir.yaml

2.1.3 查看Pod

? 查看Pod:

kubectl get pod volume-emptydir -n dev -o wide

2.1.4 访问Pod中的Nginx

? 访问Pod中的Nginx:

curl 10.244.2.2

2.1.5 查看指定容器的标准输出

? 查看指定容器的标准输出:

kubectl logs -f volume-emptydir -n dev -c busybox

HostPath

概述

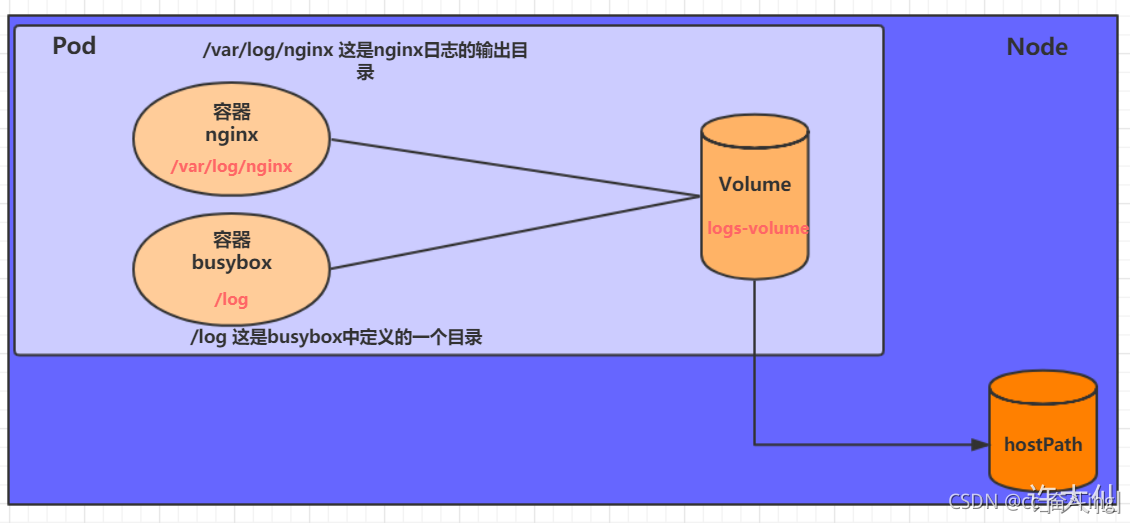

我们已经知道EmptyDir中的数据不会被持久化,它会随着Pod的结束而销毁,如果想要简单的将数据持久化到主机中,可以选择HostPath。

HostPath就是将Node主机中的一个实际目录挂载到Pod中,以供容器使用,这样的设计就可以保证Pod销毁了,但是数据依旧可以保存在Node主机上。

创建Pod

? 创建volume-hostpath.yaml文件,内容如下:

apiVersion: v1

kind: Pod

metadata:

name: volume-hostpath

namespace: dev

spec:

containers:

- name: nginx

image: nginx:1.17.1

imagePullPolicy: IfNotPresent

ports:

- containerPort: 80

volumeMounts: # 将logs-volume挂载到nginx容器中对应的目录,该目录为/var/log/nginx

- name: logs-volume

mountPath: /var/log/nginx

- name: busybox

image: busybox:1.30

imagePullPolicy: IfNotPresent

command: ["/bin/sh","-c","tail -f /logs/access.log"] # 初始命令,动态读取指定文件

volumeMounts: # 将logs-volume挂载到busybox容器中的对应目录,该目录为/logs

- name: logs-volume

mountPath: /logs

volumes: # 声明volume,name为logs-volume,类型为hostPath

- name: logs-volume

hostPath:

path: /root/logs

type: DirectoryOrCreate # 目录存在就使用,不存在就先创建再使用

type的值的说明:

- DirectoryOrCreate:目录存在就使用,不存在就先创建后使用。

- Directory:目录必须存在。

- FileOrCreate:文件存在就使用,不存在就先创建后使用。

- File:文件必须存在。

- Socket:unix套接字必须存在。

- CharDevice:字符设备必须存在。

- BlockDevice:块设备必须存在。

创建Pod:

kubectl create -f volume-hostpath.yaml

2.2.3 查看Pod

? 查看Pod:

kubectl get pod volume-hostpath -n dev -o wide

2.2.4 访问Pod中的Nginx

? 访问Pod中的Nginx:

curl 10.244.2.3

2.2.5 去node节点找到hostPath映射的目录中的文件

? 需要到Pod所在的节点(k8s-node2)查看hostPath映射的目录中的文件:

ls /root/logs

同样的道理,如果在此目录中创建文件,到容器中也是可以看到的。

volumes和Pod部署在同一个节点上

NFS

概述

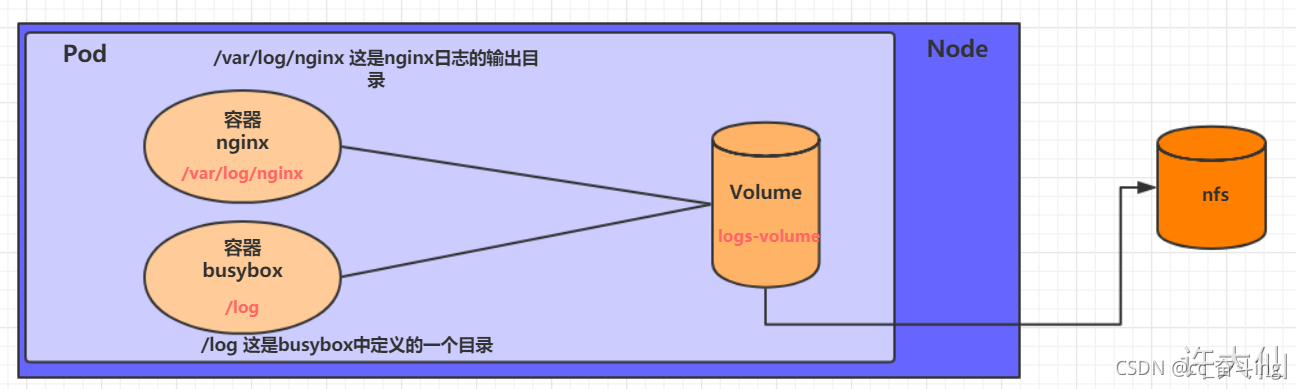

HostPath虽然可以解决数据持久化的问题,但是一旦Node节点故障了,Pod如果转移到别的Node节点上,又会出现问题,此时需要准备单独的网络存储系统,比较常用的是NFS和CIFS。

NFS是一个网络文件存储系统,可以搭建一台NFS服务器,然后将Pod中的存储直接连接到NFS系统上,这样,无论Pod在节点上怎么转移,只要Node和NFS的对接没有问题,数据就可以成功访问。

直接将volume连接到NFS系统 一般nfs都是做成高可用的集群

搭建NFS服务器

- 首先需要准备NFS服务器,这里为了简单,直接在Master节点做NFS服务器。

# 在Master节点上安装NFS服务器:

yum install -y nfs-utils rpcbind

# 准备一个共享目录:

mkdir -pv /root/data/nfs

# 将共享目录以读写权限暴露给192.168.18.0/24网段中的所有主机:

vim /etc/exports

/root/data/nfs 192.168.18.0/24(rw,no_root_squash) #其他的服务器地址

# 修改权限:

chmod 777 -R /root/data/nfs

# 加载配置:

exportfs -r

# 启动nfs服务:

systemctl start rpcbind

systemctl enable rpcbind

systemctl start nfs

systemctl enable nfs

# 在Master节点测试是否挂载成功:

showmount -e 192.168.18.100

- 接下来 要在Node节点上都安装NFS服务器,目的是为了Node节点可以驱动NFS设备 而不是像master一样安装NFS服务

# 在Node节点上安装NFS服务,不需要启动

yum -y install nfs-utils

# 在Node节点测试是否挂载成功:

showmount -e 192.168.18.100

# 高可用备份方式,在所有节点执行如下的命令:

mount -t nfs 192.168.18.100:/root/data/nfs /mnt

- 创建Pod

创建volume-nfs.yaml文件,内容如下:

apiVersion: v1

kind: Pod

metadata:

name: volume-nfs

namespace: dev

spec:

containers:

- name: nginx

image: nginx:1.17.1

imagePullPolicy: IfNotPresent

ports:

- containerPort: 80

volumeMounts: # 将logs-volume挂载到nginx容器中对应的目录,该目录为/var/log/nginx

- name: logs-volume

mountPath: /var/log/nginx

- name: busybox

image: busybox:1.30

imagePullPolicy: IfNotPresent

command: ["/bin/sh","-c","tail -f /logs/access.log"] # 初始命令,动态读取指定文件

volumeMounts: # 将logs-volume挂载到busybox容器中的对应目录,该目录为/logs

- name: logs-volume

mountPath: /logs

volumes: # 声明volume

- name: logs-volume

nfs:

server: 192.168.18.100 # NFS服务器地址

path: /root/data/nfs # 共享文件路径

# 创建Pod:

kubectl create -f volume-nfs.yaml

# 查看Pod

# 查看Pod:

kubectl get pod volume-nfs -n dev

# 查看nfs服务器上共享目录

# 查看nfs服务器上共享目录:

ls /root/data/nfs