k8s��Դ����

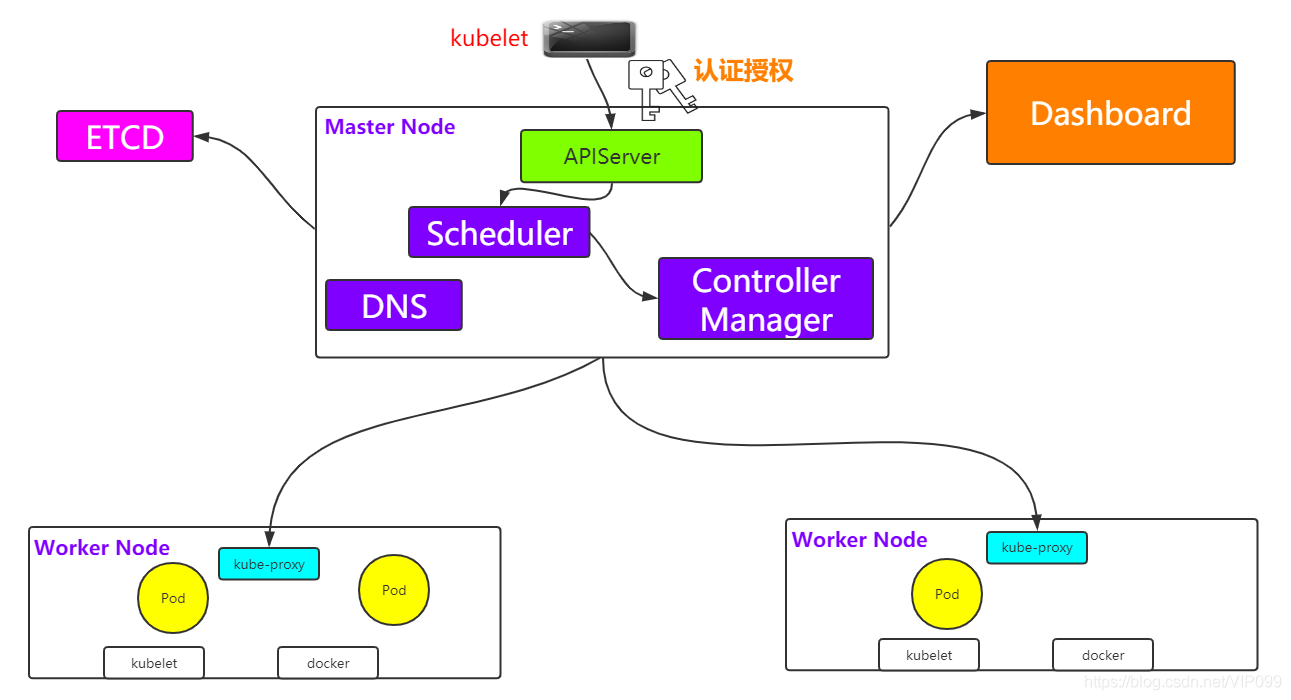

k8s�����ܹ�����

Scheduler��������ΪKubernetes����������֮һ, ������������Ⱥ��Դ�ĵ��ȹ���,������ض������㷨�Ͳ���,��Pod���ȵ����Ź����ڵ���,�Ӷ����������ֵ����ü�Ⱥ������Դ���������Ǹ����ض��ĵ����㷨�Ͳ��Խ�Pod���ȵ�ָ���ļ���ڵ�(Node)��,����Ϊ�����ij�������,����֮���һֱ����API Server,��ȡPodSpec.NodeNameΪ�յ�Pod,��ÿ��Pod���ᴴ��һ����Ĭ�������,k8s�ĵ�����������ɢ����,��ͬһ��Ⱥ�ڲ���pod������ȵ���ͬ��Node�ڵ�,�Ա�֤��Դ�ľ������á�

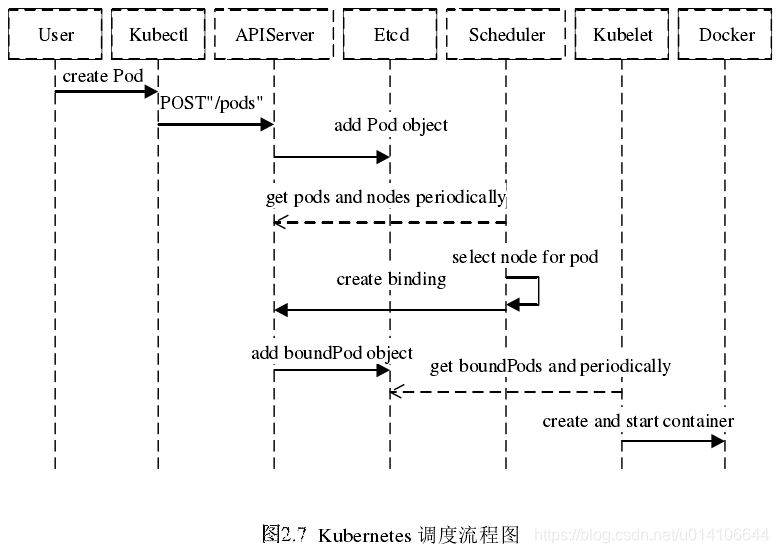

����ĵ��ȹ���,һ������:

-

����,�ͻ���ͨ��API Server��REST API/kubectl/helm����pod/service/deployment/job��,֧��������ҪΪJSON/YAML/helm tgz��

-

������,API Server�յ��û�����,�洢��������ݵ�etcd��

-

������ͨ��API Server�鿴δ����(bind)��Pod�б�,ѭ��������Ϊÿ��Pod����ڵ�,����ΪPod����ڵ㡣���ȹ��̷�Ϊ2����:

- ��һ��:Ԥѡ����,���˽ڵ�,��������һ�������˵�������Ҫ�������������Podָ��������Ҫ����Դ��,��ô������Դ��Pod��Ҫ����Դ���ٵ������ᱻ���˵���

- �ڶ���:��ѡ����,�ڵ����ȼ����,�Ե�һ��ɸѡ���ķ���Ҫ����������д��,��������ֽ�,�������ῼ��һЩ�����Ż�����,�������һ��Replication Controller�ĸ����ֲ�����ͬ��������,ʹ������ص������ȡ�

-

ѡ������:ѡ������ߵĽڵ�,����binding����,����洢��etcd�С�

-

��ѡ�ڵ���ڵ�kubelet���ݵ��Ƚ��ִ��Pod����������

nodeSelector

nodeSelector�����Լ����ʽ��nodeSelector��pod.spec��һ���ֶ�

ͨ��--show-labels���Բ鿴ָ��node��labels

[root@master ~]# kubectl get node node1 --show-labels

NAME STATUS ROLES AGE VERSION LABELS

node1 NotReady <none> 4d21h v1.20.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=node1,kubernetes.io/os=linux

���û�ж������� nodes labels,��ô������������ʾ��Ĭ�ϱ�ǩ�����ǿ���ͨ�� kubectl label node �����ָ�� node ���� labels:

[root@master ~]# kubectl label node node1 disktype=ssd

node/node1 labeled

[root@master ~]# kubectl get node node1 --show-labels

NAME STATUS ROLES AGE VERSION LABELS

node1 NotReady <none> 4d21h v1.20.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,disktype=ssd,kubernetes.io/arch=amd64,kubernetes.io/hostname=node1,kubernetes.io/os=linux

��Ȼ,��Ҳ����ͨ�� kubectl label node ɾ��ָ���� labels(��ǩ key �� - �ż���)

[root@master ~]# kubectl label node node1 disktype-

node/node1 labeled

[root@master ~]# kubectl get node node1 --show-labels

NAME STATUS ROLES AGE VERSION LABELS

node1 NotReady <none> 4d21h v1.20.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=node1,kubernetes.io/os=linux

�������� pod ��ָ�� nodeSelector ѡ��ڵ�:

[root@master mainfest]# kubectl label node node1 disktype=ssd

node/node1 labeled

[root@master mainfest]# kubectl get nodes node1 --show-labels

NAME STATUS ROLES AGE VERSION LABELS

node1 Ready <none> 4d21h v1.20.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,disktype=ssd,kubernetes.io/arch=amd64,kubernetes.io/hostname=node1,kubernetes.io/os=linux

[root@master mainfest]# vim test.yaml

apiVersion: v1

kind: Pod

metadata:

name: test

labels:

env: test

spec:

containers:

- name: test

image: nginx

imagePullPolicy: IfNotPresent

nodeSelector:

disktype: ssd

�鿴pod���ȵĽڵ�

[root@master mainfest]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

t1 1/1 Running 0 73s 10.244.1.31 node1 <none> <none>

test 1/1 Running 0 6s 10.244.1.32 node1 <none> <none>

���Կ���,test���pod��ǿ�Ƶ��ȵ�����disktype=ssd���label��node�ϡ�

nodeAffinity

nodeAffinity��Ϊnode���Ե��Ȳ��ԡ��������滻nodeSelector��ȫ�µ��Ȳ��ԡ�Ŀǰ�����ֽڵ����Ա���:

- RequiredDuringSchedulingIgnoredDuringExecution:

���������ƶ��Ĺ���ſ��Ե���pode��Node�ϡ��൱��Ӳ���� - PreferredDuringSchedulingIgnoreDuringExecution:

ǿ�����������ƶ�����,�������᳢�Ե���pod��Node��,������ǿ��,�൱�������ơ�������ȼ�����������Ȩ��ֵ,�Զ���ִ�е��Ⱥ�˳��

IgnoredDuringExecution����˼��:

���һ��pod���ڵĽڵ���pod�����ڼ��ǩ�����˱��,���ڷ��ϸ�pod�Ľڵ���������,��ϵͳ������node��lable�ı仯,��pod�ܻ�ѡ�ڸýڵ����С�

NodeAffinity �֧�ֵIJ���������:

- In:label ��ֵ��ij���б���

- NotIn:label ��ֵ����ij���б���

- Exists:ij�� label ����

- DoesNotExit:ij�� label ������

- Gt:label ��ֵ����ij��ֵ

- Lt:label ��ֵС��ij��ֵ

nodeAffinity�������õ�ע����������:

- ���ͬʱ������nodeSelector��nodeAffinity,name���������������õ�����,pod��������������ָ����node�ϡ�

- ���nodeAffinityָ���˶��nodeSelectorTerms,��ô����һ���ܹ�ƥ��ɹ����ɡ�

- �����nodeSelectorTerms���ж��matchExpressions,��һ���ڵ������������matchExpressions�������и�pod��

apiVersion: v1

kind: Pod

metadata:

name: test1

labels:

app: nginx

spec:

containers:

- name: test1

image: nginx

imagePullPolicy: IfNotPresent

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution: //Ӳ����

nodeSelectorTerms:

- matchExpressions:

- key: disktype

values:

- ssd

operator: In

preferredDuringSchedulingIgnoredDuringExecution: //������

- weight: 10

preference:

matchExpressions:

- key: name

values:

- test

operator: In

��node2����disktype=ssd�ı�ǩ

[root@master mainfest]# kubectl label node node2 disktype=ssd

node/node2 labeled

[root@master mainfest]# kubectl get node node2 --show-labels

NAME STATUS ROLES AGE VERSION LABELS

node2 Ready <none> 4d22h v1.20.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,disktype=ssd,kubernetes.io/arch=amd64,kubernetes.io/hostname=node2,kubernetes.io/os=linux

��node1����name=test��label��ɾ��name=test��label�����Բ鿴���

[root@master ~]# kubectl label node node1 name=test

node/node1 labeled

[root@master ~]# kubectl get node node1 --show-labels

NAME STATUS ROLES AGE VERSION LABELS

node1 Ready <none> 4d22h v1.20.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,disktype=ssd,kubernetes.io/arch=amd64,kubernetes.io/hostname=node1,kubernetes.io/os=linux,name=test

[root@master mainfest]# kubectl apply -f test1.yaml

pod/test1 created

[root@master mainfest]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

t1 1/1 Running 0 36m 10.244.1.31 node1 <none> <none>

test 1/1 Running 0 35m 10.244.1.32 node1 <none> <none>

test1 1/1 Running 0 3s 10.244.1.33 node1 <none> <none>

ɾ��node1��name=test��label

[root@master mainfest]# kubectl label node node1 name-

node/node1 labeled

[root@master mainfest]# kubectl get node node1 --show-labels

NAME STATUS ROLES AGE VERSION LABELS

node1 Ready <none> 4d22h v1.20.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,disktype=ssd,kubernetes.io/arch=amd64,kubernetes.io/hostname=node1,kubernetes.io/os=linux

[root@master mainfest]# kubectl apply -f test1.yaml

pod/test1 created

[root@master mainfest]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

t1 1/1 Running 0 40m 10.244.1.31 node1 <none> <none>

test 1/1 Running 0 39m 10.244.1.32 node1 <none> <none>

test1 1/1 Running 0 7s 10.244.2.44 node2 <none> <none>

�������pod������Ҫ��Ҫ��������disktype=ssd���label��node��,����ж��node�϶������label,����������name=test���label�ϴ���

taint

ʹ��kubeclt taint������Ը�ij��node�������,node�������۵�֮��ͺ�pod֮�������һ�����Ĺ�ϵ,������node�ܾ�pod�ĵ���ִ��,������node�ϱ��Ѵ��ڵ�pod�����ȥ

�۵���������:

key=value:effect

ÿ���۵���һ��key��value��Ϊ�۵�ı�ǩ,����value����Ϊ��,effect�����۵������

[root@master mainfest]# kubectl taint node node1 name=test:NoSchedule

node/node1 tainted

[root@master mainfest]# kubectl describe node node1|grep -i taint

Taints: name=test:NoSchedule

����һ����Ϊtest2��pod����

apiVersion: v1

kind: Pod

metadata:

name: test2

labels:

app: nginx

spec:

containers:

- name: test2

image: nginx

imagePullPolicy: IfNotPresent

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: disktype

values:

- ssd

operator: In

preferredDuringSchedulingIgnoredDuringExecution:

- weight: 1

preference:

matchExpressions:

- key: name

values:

- test

operator: In

[root@master mainfest]# kubectl apply -f test2.yaml

pod/test2 created

[root@master mainfest]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

t1 1/1 Running 0 6h25m 10.244.1.31 node1 <none> <none>

test 1/1 Running 0 6h24m 10.244.1.32 node1 <none> <none>

test1 1/1 Running 0 8m13s 10.244.2.45 node2 <none> <none>

test2 1/1 Running 0 6m31s 10.244.2.46 node2 <none> <none>

���������,test2Ӧ�ô�����node1��,������node1�������������۵�,���Բ����ᴴ����node1��,������ɾ���۵��,�Ϳ��Դ�����node1��

[root@master mainfest]# kubectl taint node node1 name-

node/node1 untainted

[root@master mainfest]# kubectl describe node node1|grep -i taint

Taints: <none>

[root@master mainfest]# kubectl apply -f test2.yaml

pod/test2 created

[root@master mainfest]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

t1 1/1 Running 0 6h29m 10.244.1.31 node1 <none> <none>

test 1/1 Running 0 6h28m 10.244.1.32 node1 <none> <none>

test1 1/1 Running 0 12m 10.244.2.45 node2 <none> <none>

test2 1/1 Running 0 9s 10.244.2.47 node1 <none> <none>

ɾ���۵��,test2�ͱ���������node1��

effect˵��

�����������effect��ȡֵΪNoSchedule,�����effect��ֵ���¼�˵��:

- NoSchedule: ���һ��podû�������������Taint,��ϵͳ����Ѹ�Pod���ȵ������Taint��node��

- PreferNoSchedule:NoSchedule�������ư汾,���һ��Podû�������������Taint,��ϵͳ�ᾡ����������pod���ȵ���һ�ڵ���ȥ,������ǿ�Ƶġ�

- NoExecute:����pod��������Ϊ,��Ӧ�Խڵ���ϡ�NoExecute���TaintЧ���Խڵ����������е�pod������Ӱ��:

- û������Toleration��Pod�ᱻ��������

- �����˶�ӦToleration��pod,���û��ΪtolerationSeconds��ֵ,���һֱ������һ�ڵ���

- �����˶�ӦToleration��pod��ָ����tolerationSecondsֵ,�����ָ��ʱ�������

- ��kubernetes 1.6�汾��ʼ������һ��alpha�汾�Ĺ���,���ѽڵ���ϱ��ΪTaint(Ŀǰֻ���node unreachable��node not ready,��Ӧ��NodeCondition "Ready"��ֵΪUnknown��False)������TaintBasedEvictions���ܺ�(�ڨCfeature-gates�����м���TaintBasedEvictions=true),NodeController���Զ�ΪNode����Taint,��״̬Ϊ"Ready"��Node��֮ǰ���ù�����ͨ���������ᱻ���á�ע��,�ڽڵ���������,Ϊ�˱����ִ��pod�������������,ϵͳ���������ٵ�ģʽ��node����Taint,����ܷ�ֹ��һЩ�ض������(����master��ʱʧ��)��ɵĴ���pod������ĺ������һ���ܼ�����tolerationSeconds,����pod����ڵ����ʱ������òű������

tolerations

�������۵��Node������taint��e?ect:NoSchedule��PreferNoSchedule��NoExecute��Pod֮���������Ĺ�ϵ,Pod����һ���̶��ϲ��ᱻ���ȵ�Node�ϡ�

�����ǿ�����Pod���������� (Toleration),��˼�����������̵�Pod�����������۵�Ĵ���,���Ա����ȵ������۵��Node��

tolerations:

- key: name

value: test

operator: Equal

effect: NoSchedule

����key,vaule,e?ectҪ��Node�����õ�taint����һ��

operator��ֵΪExists�������valueֵ

tolerationSeconds ���������� Pod ��Ҫ������ʱ������ Pod �ϼ����������е�ʱ��

[root@master mainfest]# kubectl taint node node2 name=test:NoSchedule

node/node2 tainted

[root@master mainfest]# kubectl describe node node2|grep -i taint

Taints: name=test:NoSchedule

[root@master mainfest]# kubectl apply -f test2.yaml

pod/test2 created

[root@master mainfest]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

t1 1/1 Running 0 6h38m 10.244.1.31 node1 <none> <none>

test 1/1 Running 0 6h37m 10.244.1.32 node1 <none> <none>

test1 1/1 Running 0 21m 10.244.2.45 node2 <none> <none>

test2 1/1 Running 0 7s 10.244.2.49 node2 <none> <none>

���Կ���,��Ȼ������node2���������۵�,����Ϊ��������Դ�嵥�ж������۵�����,����pod�����ܴ�����node2�ϡ�